背景建模算法

视频监控系统中的运动目标检测算法对比研究

视频监控系统中的运动目标检测算法对比研究现代社会,随着科技的飞速发展,视频监控系统在各个领域得到了广泛应用。

其中,运动目标的检测是视频监控系统中的一个重要任务。

本文将对比研究不同的运动目标检测算法,探讨各自的优缺点以及适用场景。

一、传统的运动目标检测算法1. 基于背景建模的算法基于背景建模的算法是最早被广泛应用的一种运动目标检测方法。

它通过对连续帧图像进行背景建模,从而得到每一帧图像中的前景物体。

根据像素的变化与模型的匹配程度,可以将前景与背景进行区分。

然而,传统的背景建模方法对于动态背景或者光线变化等因素的适应性不强,会产生较大的误检和漏检。

2. 基于运动强度的算法基于运动强度的算法是另一种常用的运动目标检测方法。

它通过计算像素在连续帧之间的强度变化来判断是否为运动目标。

这种方法简单且易于实现,适用于相对固定的背景场景。

然而,当背景中存在一些动态变化的元素时,例如树叶的摇曳或者水波纹的波动,会引发误检。

二、基于机器学习的运动目标检测算法1. 基于支持向量机的算法基于支持向量机的算法是一种常见的运动目标检测方法。

它利用训练样本的特征向量进行分类建模,并通过训练样本的标记来优化模型的参数。

该算法具有较高的准确性和较低的误检率,在相对复杂的场景中表现出很好的性能。

然而,由于支持向量机需要大量的计算资源和训练时间,对于实时性要求较高的应用场景可能不太适用。

2. 基于深度学习的算法基于深度学习的算法是当前运动目标检测领域的热点方法之一。

通过搭建深度神经网络,将图像特征进行高级抽象和学习,使得算法能够自动学习并理解运动目标的特征。

该算法具有较强的鲁棒性和处理能力,在复杂背景和光线变化等情况下仍能有效地检测目标。

然而,基于深度学习的算法需要大量的训练数据和计算资源,并且对于参数调整和模型选择有一定的难度。

三、算法比较及适用场景分析通过对比不同的运动目标检测算法,可以看出它们各自具有不同的优势和适用场景。

传统的背景建模算法适用于相对静止的背景场景,但对于动态背景或者光线变化等情况下会出现误检和漏检的问题。

背景建模算法

背景建模算法1 基本原理视频图像中运动目标检测的一种方法,其基本思想是对图像的背景进行建模。

一旦背景模型建立,将当前的图像与背景模型进行某种比较,根据比较结果确定前景目标(需要检测的运动目标)。

2 难点(1)环境光照的变化(光照突然性的变化和缓慢的变化)(2)背景的多模态性(背景中存在的细微的运动将影响前景目标检测的结果)(3)运动物体的阴影(4)图像噪声(5)新的不动的物体进入到背景中(如何快速适应背景的变化)3 分类背景建模方法可以分为两类,颜色背景模型和纹理背景模型。

3.1 颜色背景模型颜色背景模型其思想是对图像中每个像素的颜色值(灰度或彩色)进行建模。

如果当前图像坐标(x,y)上的像素颜色值与背景模型中(x,y)上的像素颜色值有较大差异时,当前像素被认为是前景,否则为背景。

颜色背景模型的一个最明显的缺点是对阴影敏感,即将阴影误检测为运动目标。

在特定场合下,需要在检测后对阴影进行抑制和消除。

3.1.1 平均背景模型平均背景模型(Average Background Model)是一种简单、计算速度快但对环境光照变化和背景的多模态性比较敏感的一种背景建模算法。

其基本思想是:计算每个像素的平均值作为它的背景模型。

检测当前帧时,只需要将当前帧像素值I(x,y)减去背景模型中相同位置像素的平均值u(x,y),得到差值d(x,y),将d(x,y)与一个阈值TH进行比较,那么得到输出图像output的值如下:(3-1)(3-2)这里TH可以采用自适应算法进行确定,需要计算每个像素的帧间差的平均值和标准差。

公式如下:令代表t时刻的图像中(x,y)处的像素值,inter代表两帧之间的间隔,通常设置为3,令如下:(3-3)(3-4)(3-5)M通常要足够大(>30+inter)来保证和的精确性。

得到了和后TH 可以这样确定:TH = + (3-6)其中一般设置为2。

为了提高算法的鲁棒性,可以在检测完之后要对背景模型进行更新,对于所有像素(x,y),令,,更新后分别为,,:(3-7)(3-8)(3-9)这里为学习率(0~1),越大,对背景变化的适应速度越快。

V i B e 算 法 原 理 详 解

目标检测之vibe---ViBe(Visual Background extractor)背景建模或前景检测ViBe算法:ViBe - a powerful technique for background detection and subtraction in video sequencesViBe是一种像素级视频背景建模或前景检测的算法,效果优于所熟知的几种算法,对硬件内存占用也少。

Windows and Linux users: a benchmarking program to evaluate the time needed by ViBe on your platform and on your own sequences!?Download an archive?zip archive [15 MB]?to evaluate the time needed by ViBe on your platform (Windows or Linux [Wine]), and on your own sequences.A program for Windows and Linux.?Download an archive?zip archive [16 MB]?to use ViBe on Windows (or under?Wine?in Linux).The program allows you to: (1) save the result for your own images, (2) change the few parameters of ViBe to experiment with, and (3) reproduce our results.Linux: link a C-C++ object file to your own code.?We provide the object (compiled) code of ViBe for non-commercial applications. Under Linux, download the32 bits zip file, or the?64 bits zip file. Details on?this page.当然,在使用ViBe算法时应该遵循算法官网的License。

混合高斯模型算法原理

混合高斯模型算法原理混合高斯模型是一种经典的背景建模算法,用于背景相对稳定情况下的运动目标检测。

它由单高斯模型发展而来,对于多模态的背景有一定的鲁棒性,如:树叶晃动、水纹波动等。

在介绍混合高斯模型前,首先介绍单高斯模型。

1.单高斯背景模型:单高斯模型将图像中每一个像素点的颜色值看成是一个随机过程,并假设该点的像素值出现的概率服从高斯分布。

该算法的基本原理就是对每一个像素位置建立一个高斯模型,模型中保存该处像素的均值和方差。

如,可设(尤,y)处像素的均值为u(尤,y),方差为。

2(x, y),标准差为。

(尤,y)。

由于随着视频图像序列的输入,模型参数不断更新,所以不同时刻模型参数有不同的值,故可将模型参数表示为三个变量x, y,t的函数:均值u(x, y,t)、方差。

2(x, y,t)、标准差c (x, y,t)。

用单高斯模型进行运动检测的基本过程包括:模型的初始化、更新参数并检测两个步骤。

1)模型初始化模型的初始化即对每个像素位置上对应的高斯模型参数进行初始化,初始化采用如下公式完成:'u(x, y,0) = I(x, y,0)<b 2(x, y,0) = std _ init2 ( 1)c (x, y,0) = std _ init其中,I(x,y,0)表示视频图像序列中的第一张图像(x,y)位置处的像素值,std_ init为一个自己设的常数,如可设std _ init = 20。

2)更新参数并检测每读入一张新的图片,判断新图片中对应点像素是否在高斯模型描述的范围中,如是,则判断该点处为背景,否则,判断该点处为前景。

假设前景检测的结果图为output,其中在t时刻(x, y)位置处的像素值表示为output(x, y, t),output(x, y,t)的计算公式如下:[0, |I (x, y, t) - u (x, y, t -1) <X x a (x, y, t -1)output (x, y, t) = <(2)1, otherwise其中,人是自己设的一个常数,如可设X= 2.5。

视频处理算法范文

视频处理算法范文一、视频去抖动算法视频去抖动是指消除视频中由于相机抖动或者拍摄器材不稳定导致的图像抖动。

常见的视频去抖动算法包括基于均值滤波、位移算法、卷积神经网络等。

其中,位移算法通过分析图像上的像素位移信息,计算抖动量,并根据计算结果对图像进行修复,能够有效地减少抖动现象。

二、背景建模算法背景建模是指对视频中的背景进行建模和分析,通过提取背景信息,可以实现目标检测、目标跟踪和背景减除等功能。

常见的背景建模算法包括基于高斯模型、自适应混合高斯模型、基于学习的方法等。

其中,自适应混合高斯模型是一种广泛使用的背景建模算法,它可以根据背景变化自动适应调整高斯分布的参数,从而更好地适应不同场景下的背景变化。

三、运动目标检测算法运动目标检测是指对视频中的移动目标进行检测和定位。

常见的运动目标检测算法包括帧差法、光流法、背景模型法和基于深度学习的方法。

帧差法通过比较相邻帧之间的像素差异,判断是否为运动目标,是一种简单高效的方法。

而光流法则通过分析相邻帧之间的像素位移,进一步计算运动目标的速度和方向。

基于深度学习的方法则通过卷积神经网络对视频图像进行特征提取,进而实现高精度的运动目标检测。

四、视频编码算法视频编码是指将视频信号经过压缩编码处理,以减少视频数据的存储空间和传输带宽。

常见的视频编码算法包括MPEG系列标准、H.264、H.265等。

其中,H.264是一种广泛使用的视频编码标准,它通过在空间和时间域上对图像进行预测和差分编码,并采用变换和量化等方法进行数据压缩,从而实现高效的视频编码。

opencv mog2 原理

opencv mog2 原理OpenCV MOG2(Mixture of Gaussians)是一种常用的背景建模算法,用于视频中的移动目标检测。

MOG2算法基于高斯混合模型,能够自动学习和更新背景模型,从而准确地提取前景目标。

本文将介绍MOG2算法的原理和应用。

一、背景建模算法介绍背景建模是计算机视觉中的一项重要任务,广泛应用于视频监控、智能交通等领域。

其主要目的是从视频中提取出静态背景,以便于后续的目标检测和跟踪。

MOG2算法是背景建模算法中的一种,相比于传统的MOG算法,它具有更好的适应性和鲁棒性。

二、MOG2算法原理MOG2算法使用高斯混合模型来对每个像素的颜色进行建模,即假设每个像素的颜色值来自于多个高斯分布的混合。

通过学习像素颜色的分布,MOG2算法能够自动地建立起背景模型,并根据新的观测数据进行模型的更新。

MOG2算法的具体步骤如下:1. 初始化背景模型:对于每个像素,初始化一个包含K个高斯分布的混合模型,其中K是一个预先设定的常数。

2. 前景检测:对于每一帧输入图像,计算每个像素与其对应的背景模型之间的匹配度。

如果像素的颜色与背景模型的某个高斯分布的匹配度低于一个阈值,那么该像素被认为是前景。

3. 模型更新:对于被认为是前景的像素,更新其对应的高斯分布的参数;对于被认为是背景的像素,不进行更新。

通过这种方式,MOG2算法能够自动地适应场景变化,减少误检率。

4. 背景更新:定期对背景模型进行更新,以适应长时间运行中的光照变化和场景变化。

三、MOG2算法的优点MOG2算法相比于传统的背景建模算法具有以下优点:1. 自适应性:MOG2算法能够自动地学习和适应场景的变化,减少了手动调参的工作量。

2. 鲁棒性:MOG2算法能够处理光照变化、动态背景等复杂场景,具有更好的鲁棒性。

3. 低延迟:MOG2算法使用了基于高斯分布的建模方法,计算效率高,能够实时处理视频流。

四、MOG2算法的应用MOG2算法在视频监控、智能交通等领域得到了广泛的应用。

背景建模算法范文

背景建模算法范文背景建模算法是指通过对一段视频序列进行分析和处理,将视频中动态的前景部分与静态的背景部分进行差异化处理,从而提取出图像的背景信息。

背景建模算法在目标检测、视频监控、运动跟踪等领域具有重要的应用。

以下将介绍一些常见的背景建模算法。

1. 帧差法(Frame Difference Method):该算法基于当前帧与前一帧之间的差异来提取前景物体。

算法简单,计算速度快,但对光照变化和摄像机自己的移动比较敏感。

2. 混合高斯模型(Gaussian Mixture Model, GMM):该算法使用高斯分布来对背景建模,每个像素位置都建立一个高斯分布模型。

对于新的输入样本,通过统计学方法计算其是否属于背景。

该方法较好地处理了光照变化和摄像机移动的问题。

3. 基于像素选择的背景模型(Pixel Based Adaptive Segmenter):该算法通过对每个像素位置进行分析,通过计算像素灰度值频率来确定前景和背景。

通过设置合适的阈值,可以得到良好的背景分割。

4. 基于背景改变的自适应的背景匹配(Background Subtraction Based on Change Detection):该算法通过分析前景物体的运动区域来更新背景模型。

当检测到图像中的前景物体与背景有较大差异时,将其作为背景更新依据,并对背景进行自适应更新。

5. 基于像素邻域的背景建模(Pixel Neighborhood Based Background Modeling):该算法通过对每个像素位置的邻域像素进行分析,利用邻域像素的灰度值来判断当前像素是前景还是背景。

该方法在处理光照变化、阴影等问题上表现较好。

6. 基于像素纹理特征的背景建模(Texture Based Background Modeling):该算法通过对每个像素位置的纹理特征进行分析,利用纹理特征来区分前景和背景。

对于相同纹理特征的像素,可以认为其属于背景。

计算机视觉中的背景建模与运动目标检测技术

计算机视觉中的背景建模与运动目标检测技术计算机视觉是人工智能领域的一个重要分支,旨在使计算机具备理解和处理图像的能力。

在计算机视觉中,背景建模和运动目标检测是两个关键问题,它们能够帮助计算机自动识别图像中的目标物体和运动变化。

背景建模是指通过分析图像序列中的像素值,提取出背景信息并建立背景模型,从而实现对背景和前景的区分。

它是许多计算机视觉任务的基础,如运动目标检测、行人跟踪和视频分析等。

背景建模的关键问题是如何在不同光照条件下准确地估计背景模型,以便更好地检测运动目标。

传统的背景建模方法主要基于统计学模型,如高斯混合模型(GMM)和自适应背景平均(ABM)。

高斯混合模型假设每个像素的像素值是由一个或多个高斯分布组合而成,而自适应背景平均方法则通过对每个像素的像素值进行平均来建模。

然而,这些方法对于复杂场景的处理效果有限,比如光照变化、场景动态等。

近年来,随着深度学习的快速发展,基于深度学习的背景建模方法逐渐成为研究的热点。

深度学习模型能够自动提取图像的特征,并具有较强的非线性建模能力,可以更好地适应不同场景的复杂性。

例如,基于卷积神经网络(CNN)的背景建模方法,可以学习到图像的空间、时间和频率等多维特征,从而提高建模的准确性。

运动目标检测是计算机视觉中另一个重要的任务,它旨在自动检测和跟踪图像序列中的运动目标。

运动目标检测可以广泛应用于视频监控、交通流量统计、智能驾驶等领域。

基于背景建模的运动目标检测方法可以分为两类:基于像素的方法和基于区域的方法。

基于像素的方法主要通过将前景和背景进行像素级别的比较来实现目标的检测。

这类方法对光照变化和复杂背景的适应性较强,但对于噪声、遮挡和长时间运动等情况的处理效果较差。

相比之下,基于区域的方法则将图像分割成多个区域,并对每个区域进行运动目标的检测。

这类方法不仅可以提高检测的准确性,还可以减少计算量,但对于背景的变化较敏感。

随着计算机硬件的不断增强和图像处理算法的不断改进,背景建模和运动目标检测技术在实际应用中取得了令人瞩目的成果。

海思 移动侦测实现原理

海思移动侦测实现原理

海思(HiSilicon)是华为旗下的芯片设计公司,主要致力于开发处理器、芯片和解决方案。

移动侦测(Mobile Detection)通常指的是在视频监控中,通过算法检测视频中是否有运动物体。

下面是一般移动侦测的实现原理:

1.背景建模:移动侦测首先需要建模背景,以便将运动物体与静

态背景分离。

这通常包括获取视频的一定时间段内的背景图像,并使用

这些图像建立一个静态背景模型。

2.帧差法:帧差法是最简单的移动侦测算法之一。

它通过比较当

前帧和背景帧之间的差异来检测移动物体。

如果两帧之间的像素差异超

过了设定的阈值,就认为该像素处有运动物体。

3.光流法:光流法是基于图像中像素在时间上的位移来检测运动

物体。

它利用图像中相邻帧像素之间的位移关系,通过计算光流场来确

定物体的运动。

4.高级背景建模算法:为了更准确地建模背景,一些高级背景建

模算法被引入,例如基于高斯混合模型(Gaussian Mixture Model,

GMM)的背景建模。

这种方法使用多个高斯分布来建模背景,能够更

好地适应场景中的动态变化。

5.形状分析和目标跟踪:一旦检测到移动物体,可以通过形状分

析和目标跟踪来进一步分析和追踪物体的运动。

这包括目标的形状、大

小、速度等信息。

在实际应用中,移动侦测常用于视频监控系统,例如智能家居、商业安防、交通监控等领域。

具体的实现方式和算法选择可能因系统需求和环境特点

而有所不同。

混合高斯背景建模原理及实现

一、理论混合高斯背景建模是基于像素样本统计信息的背景表示方法,利用像素在较长时间内大量样本值的概率密度等统计信息(如模式数量、每个模式的均值和标准差)表示背景,然后使用统计差分(如3σ原则)进行目标像素判断,可以对复杂动态背景进行建模,计算量较大。

在混合高斯背景模型中,认为像素之间的颜色信息互不相关,对各像素点的处理都是相互独立的。

对于视频图像中的每一个像素点,其值在序列图像中的变化可看作是不断产生像素值的随机过程,即用高斯分布来描述每个像素点的颜色呈现规律【单模态(单峰),多模态(多峰)】。

对于多峰高斯分布模型,图像的每一个像素点按不同权值的多个高斯分布的叠加来建模,每种高斯分布对应一个可能产生像素点所呈现颜色的状态,各个高斯分布的权值和分布参数随时间更新。

当处理彩色图像时,假定图像像素点R、G、B三色通道相互独立并具有相同的方差。

对于随机变量X的观测数据集{x1,x2,…,x N},x t=(r t,g t,b t)为t时刻像素的样本,则单个采样点x t其服从的混合高斯分布概率密度函数:其中k为分布模式总数,η(x t,μi,t,τi,t)为t时刻第i个高斯分布,μi,t为其均值,τi,t为其协方差矩阵,δi,t 为方差,I为三维单位矩阵,ωi,t为t时刻第i个高斯分布的权重。

详细算法流程:高斯背景模型是由Stauffer等人提出的经典的自适应混合高斯背景提取方法,是一种基于背景建模的方法,它是根据视频中的每个像素在时域上的分布情况来构建各个像素的颜色分布模型,依次来达到背景建模的目的。

混合高斯背景模型是有限个高斯函数的加权和,它能描述像素的多峰状态,适用于对光照渐变、树木摇摆等复杂背景进行准确建模。

此后经过很多研究人员的不断改进,该方法目前已经成为比较常用的背景提取方法。

knn背景建模算法

knn背景建模算法

KNN背景建模算法是一种基于邻近性的监督学习算法,常用

于图像处理和计算机视觉领域中的背景建模任务。

背景建模是指从图像或视频序列中提取出背景信息,用于后续的目标检测、跟踪或分割等任务。

KNN背景建模算法在这一

过程中,通过对每个像素点周围的邻近像素进行统计和比较,来判断该像素是否属于背景。

具体来说,KNN背景建模算法的步骤如下:

1. 初始化背景模型:对于每个像素点,构建一个大小为N的

邻近像素点群体。

2. 提取特征向量:计算每个像素点的特征向量,通常包括颜色、纹理和运动等。

3. 邻近性比较:对于每个像素点的特征向量,通过计算与邻近像素点群体中所有特征向量的相似度,得到一个排序列表。

4. 确定背景像素:按照相似度排序列表,选择前K个最相似

的邻近像素作为背景模型,并计算平均值或中值作为当前像素的背景值。

5. 更新模型:对于每一帧的图像,根据当前像素的特征向量与其邻近像素的相似度,更新对应的背景模型。

KNN背景建模算法的优点是简单易理解、易于实现,对于复

杂的场景和光照变化具有一定的鲁棒性。

然而,由于算法需要计算每个像素与邻近像素的相似度,因此计算量较大,并且容易受到噪声和异常值的影响。

基于交通视频图像的车辆行为识别算法研究

基于交通视频图像的车辆行为识别算法研究随着城市化进程的加速,交通拥堵成为了人们常常面临的挑战。

解决交通拥堵问题、提升交通效率已成为城市管理者的重要任务。

在这方面,利用交通视频图像中的车辆行为识别算法能够为城市交通管理提供有力的支持。

一、车辆行为识别算法的意义实时、准确地了解车辆的行为可以帮助交通管理者更好地调度交通资源、规划交通策略和预防事故发生。

而图像处理技术则提供了一种高效、低成本的解决方案。

二、图像处理与行为识别技术1. 图像处理技术图像处理技术可以通过对交通视频图像进行预处理以提取出车辆的特征信息。

比如,通过图像分割技术,可以将图像中的车辆和背景分离,以便后续的车辆轨迹识别。

此外,还可以借助边缘检测、颜色分布等技术对车辆进行特征提取。

2. 车辆行为识别技术车辆行为识别是通过对车辆特征的分析和建模来判断车辆的行为。

比如,当车辆出现加速、减速、转弯等行为时,可以通过图像处理技术提取特征,并结合机器学习算法进行识别和分类。

通过对大量样本的学习,算法可以识别和预测车辆的行为,为交通管理者提供决策支持。

三、常用的车辆行为识别算法1. 基于背景建模的算法背景建模算法将交通视频中的背景与车辆目标进行分离,以便更好地提取车辆特征。

常用的背景建模算法包括高斯混合模型(GMM)和自适应背景建模算法。

2. 基于运动轨迹的算法运动轨迹算法是一种通过分析车辆在时间序列中的运动轨迹来识别车辆行为的方法。

通过对车辆轨迹的速度、方向和加速度等特征进行分析和建模,可以判断车辆的行为,如加速、减速、变道等。

3. 基于深度学习的算法深度学习算法利用神经网络模型进行特征学习和分类,具有较高的识别准确率。

通过对大量车辆行为样本的学习和训练,深度学习算法可以自动提取车辆特征,并进行行为分类。

四、车辆行为识别算法的应用场景1. 交通流量统计车辆行为识别算法可以帮助交通管理者实时监测道路上的车辆数量和密度,并进一步预测交通流量,为交通管理提供数据支持。

如何解决图像识别中的背景复杂问题(三)

图像识别是一项复杂而重要的技术,它在实际应用中日益广泛。

然而,背景复杂是图像识别中一个常见的问题,而且它往往会给图像处理带来很大的挑战。

本文将探讨如何解决图像识别中的背景复杂问题,以提高图像处理的准确性和效率。

一、背景复杂问题的挑战背景复杂问题主要体现在图像中存在大量的杂乱背景,并且与目标物体具有相似的颜色、纹理等特征。

这就导致了在图像识别过程中,算法往往会误将背景部分识别为目标物体,从而导致识别结果的不准确性。

二、图像增强技术的应用图像增强技术是解决图像背景复杂问题的一种有效方法。

该技术可以通过增强图像的对比度、亮度等属性,使目标物体在图像中更加明显和突出。

常见的图像增强技术包括直方图均衡化、拉普拉斯锐化等。

通过将这些技术应用于图像识别中,可以有效地提高图像处理的准确性。

三、背景建模算法的改进背景建模算法是解决背景复杂问题的另一种重要方法。

传统的背景建模算法往往只能对静态背景进行建模,而对于复杂背景来说,识别准确率较低。

为了解决这一问题,研究者们提出了一些改进的背景建模算法。

例如,基于混合高斯模型的背景建模算法可以对动态背景进行建模,并根据图像的变化情况来更新背景模型,从而提高识别准确率。

四、深度学习的应用深度学习作为一种新兴的机器学习算法,已经在图像识别领域取得了显著成果。

深度学习可以通过多层神经网络对图像进行复杂的特征提取和分析,从而提高图像处理的准确性。

在解决图像背景复杂问题中,可以利用深度学习来提取目标物体的特征,并与背景进行区分,从而提高图像识别算法的准确率。

五、数据集的构建与标记数据集的构建和标记对于图像识别算法的准确性至关重要。

在解决背景复杂问题时,应尽量收集包含复杂背景的图像,以使算法能够更好地适应真实场景。

此外,在数据集标记过程中,应严格标注目标物体的位置和区域,以提高算法对目标物体的识别准确性。

六、结合多种技术方法解决图像识别中的背景复杂问题往往需要结合多种技术方法。

可以根据实际情况,选择合适的图像增强技术、背景建模算法和深度学习方法,在实际应用中进行组合,以提高图像处理的效果。

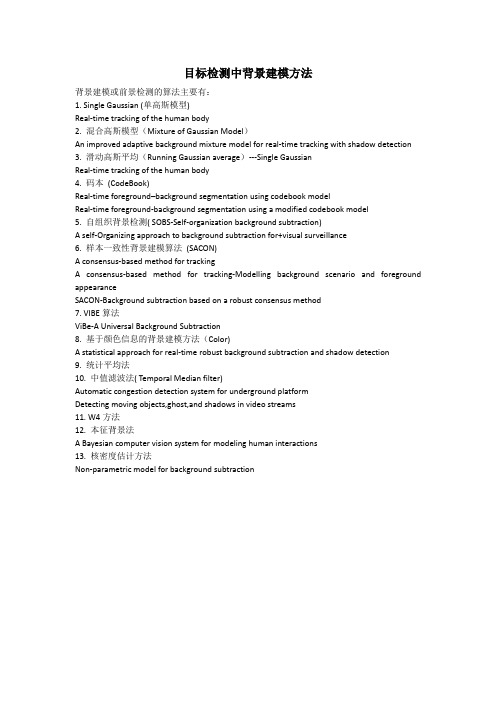

目标检测中的背景建模方法

目标检测中背景建模方法背景建模或前景检测的算法主要有:1. Single Gaussian (单高斯模型)Real-time tracking of the human body2. 混合高斯模型(Mixture of Gaussian Model)An improved adaptive background mixture model for real-time tracking with shadow detection 3. 滑动高斯平均(Running Gaussian average)---Single GaussianReal-time tracking of the human body4. 码本(CodeBook)Real-time foreground–background segmentation using codebook modelReal-time foreground-background segmentation using a modified codebook model5. 自组织背景检测( SOBS-Self-organization background subtraction)A self-Organizing approach to background subtraction for+visual surveillance6. 样本一致性背景建模算法(SACON)A consensus-based method for trackingA consensus-based method for tracking-Modelling background scenario and foreground appearanceSACON-Background subtraction based on a robust consensus method7. VIBE算法ViBe-A Universal Background Subtraction8. 基于颜色信息的背景建模方法(Color)A statistical approach for real-time robust background subtraction and shadow detection9. 统计平均法10. 中值滤波法( Temporal Median filter)Automatic congestion detection system for underground platformDetecting moving objects,ghost,and shadows in video streams11. W4方法12. 本征背景法A Bayesian computer vision system for modeling human interactions13. 核密度估计方法Non-parametric model for background subtraction。

基于光流优化的堆叠Unet背景建模神经网络

Vol. 77 No. 9Sep. 2220第37卷第9期2020年9月计算机应用研究 Application Research of Computers 基于光流优化的堆叠Unet 背景建模神经网络*陶冶,凌志浩十(华东理工大学化工过程先进控制和优化技术教育部重点实验室,上海202277)摘要:针对现有背景建模算法难以处理复杂前景及间歇性运动前景的问题,提出了一种基于非监督学习的背景建模算法(改进的BM-Unei 算法)。

该算法结合光流法和Pearson 相关系数在视频帧上提取背景关注区域,以 此优化网络训练集和损失函数,从而有效提高了该算法在复杂前景情况和前景停留情况下的适应性;在此基础上,为进一步提高背景生成的精确度,又提出了一种堆叠Unei 网络架构BM-SUnet( background modelling stachepUnet )。

在SBMnei 数据集上与现有算法在可视化效果和评估参数两方面的比较结果表明,所提算法在复杂前景和间歇运动前景情况下建模准确性好且鲁棒性高的结论。

关键词:非监督学习;卷积神经网络;背景建模;堆叠Unet ;复杂前景;间歇运动前景中图分类号:TP371 文献标志码:A 文章编号:1021-3695(2222)29-262-2861-05eoi :10. 10736/j. isse. 1021-3695.2210.05.0107Optical flow based stcchep Unei bcchrnumd moUelinn networCTco Ye, Lin Zhihso 卞(Key Laboratory of A dvanced Control & Optimization f or Chemical Processes , East China University of Science & Technology , Ministry of E duca tion ,Shanghai 022277 , China)Abstract : To tackle tie clutterep foreproone ann We intermitter) foreproonn motion chaOennes of bacarroonn moneling alfo- Cthms,this paper proposep an nnsopervisep bachgronnn monelline metfoO (improvep BM-Unet). The proposep methoO com- binee ontical flow and Pearson correlation coefficient te extract the attention repion in frames. In aneihon,the attention repion contWhutep te moOiOy the trainine set oeneration ann loss function te improve the anilita te anant te the circumstance incUnine the clutterei ann the intermittent motion of foreeronnn. In a furtheo step,this paper pronosep s stachep Unet architecture ( BM- SUnet) te enhance the accuracy of bacheronne oeneration. Experiments on iataset SBMnet show that the aforithm is nvt only robnst to the clutterep 00X0-11) ann ihe intermittent motion challenhe, bnt alse ontperforms the latest methons in terms of both qnaiUative ann qnantitative evalnation.Keywords : nnsupervisep l earninh ; convolutional nenraf networV ; bachoronnn monelnnh ; stachep Unet ; clutterep fore-Oronnn ; forearonnn intermittent motion0引言背景建模问题是计算机视觉领域的一块重要基石。

基于像素的背景建模方法综述

基于像素的背景建模方法综述像素级背景建模是计算机视觉领域中一个重要的任务,它用于提取图像背景并将其与前景物体分离。

背景建模在很多应用中具有重要的作用,例如视频监控、人体识别、交通流量分析等。

本文将综述一些常见的像素级背景建模方法,并对它们的优缺点进行比较。

1. 高斯混合模型(Gaussian Mixture Model,GMM)高斯混合模型是一种常用的背景建模方法。

它假设背景像素是由多个高斯分布的线性组合得到的,而前景像素则无法用高斯分布描述。

通过对每个像素的特征进行建模,可以根据像素的概率分布来判断其是否属于背景。

优点:GMM方法简单易于理解和实现,能够有效地处理静态背景和动态背景的背景建模问题。

缺点:对于复杂背景、光照变化等因素的建模效果较差,容易导致漏检和误检。

2. 自适应混合高斯模型(Adaptive Mixture of Gaussians,AMoG)自适应混合高斯模型是对传统高斯混合模型的改进。

它引入了像素权重的概念,通过根据像素的观察结果来动态更新每个高斯分布的权重和参数。

这样可以在保持背景模型的鲁棒性的同时更好地适应动态场景和光照变化。

优点:相比于GMM方法,AMoG对光照变化和动态场景的适应能力更强,检测准确性更高。

缺点:算法复杂度较高,计算资源需求较大。

3.基于聚类的方法聚类是一种将样本划分为不同类别的无监督学习方法。

在背景建模中,聚类可以用于将像素划分为不同的背景和前景类别。

常见的聚类算法包括k均值聚类和DBSCAN。

这些方法可以通过像素之间的相似性度量来区分背景和前景。

优点:聚类方法可以自动学习图像中的背景和前景分布,适应性较好。

缺点:聚类方法对噪声和异常数据较敏感,容易导致误检和漏检。

4.基于稠密光流的方法稠密光流是一种用于捕捉图像中像素运动信息的技术。

背景建模可以通过计算像素的光流来判断它是否属于背景。

根据光流的大小和方向,可以将静止的像素划分为背景,而移动的像素划分为前景。

一种新的背景模型建立及更新方法

一种新的背景模型建立及更新方法

背景模型是视频处理和计算机视觉领域中常用的技术,用于对场景中的静态背景进行建模。

传统的背景模型建立方法是基于帧间差异或统计学方法,但这些方法往往会受到光照变化、物体遮挡等因素的影响,导致背景模型的准确性下降。

因此,提出了一种新的背景模型建立及更新方法。

该方法基于深度学习,利用深度卷积神经网络(CNN)对场景中的每个像素进行二分类,判断该像素是否为背景像素。

在模型的训练阶段,首先使用一组有标注的样本对CNN进行训练,学习出背景像素的特征。

在测试阶段,将视频帧输入CNN中,得到每个像素的背景像素概率值,根据这些概率值对每个像素进行分类,得到背景图像。

为了保证背景模型的实时更新,当新的帧到来时,该方法会使用前面的一系列背景图像作为输入,同时将当前帧送入CNN中,得到该帧中的每个像素的背景像素概率值。

然后,基于这些概率值和前面的背景图像来更新背景模型,以适应新的场景。

实验结果表明,该方法对于光照变化、物体遮挡等因素的干扰具有较强的鲁棒性,能够实现较准确的背景建模和实时更新。

同时,该方法不仅适用于静态背景的建模,也可用于动态背景的建模,具有较广泛的应用前景。

opencv createbackgroundsubtractormog2 参数

opencv createbackgroundsubtractormog2 参数OpenCV是一个流行的开源计算机视觉库,它提供了各种功能来处理图像和视频。

其中之一是背景建模。

背景建模是一种将场景中动态的物体与静态背景分离的技术。

OpenCV中的`createBackgroundSubtractorMOG2`方法是一种常用的背景建模算法,它使用了高斯混合模型(Gaussian Mixture Model, GMM)来对背景进行建模。

本文将详细解释`createBackgroundSubtractorMOG2`的各种参数,并逐步回答相关问题。

1. 背景建模的概念及应用介绍(200-300字)背景建模是计算机视觉领域中的一项基础技术,用于从视频序列中提取出静态背景。

它通过分析每一帧图像中的像素值,将被运动物体遮挡的背景部分提取出来。

这项技术在许多领域都有广泛的应用,例如视频监控、运动检测、虚化背景等。

2. `createBackgroundSubtractorMOG2`方法的参数介绍(500-600字)`createBackgroundSubtractorMOG2`方法是OpenCV中的一个函数,用于创建一个基于高斯混合模型的背景建模器。

该方法有多个参数,下面将逐一介绍这些参数的含义和作用。

- `history`参数用于指定需要考虑的过去帧的数量。

它定义了模型中保留的观察帧的数量。

这个参数的值越大,模型将考虑更长时间内的像素值,从而更好地适应背景的变化。

默认值为500。

- `varThreshold`参数用于指定高斯分布的阈值。

当像素值与背景差异超过这个阈值时,该像素被认为是前景对象的一部分。

较小的值可以捕捉到更小的变化,但也可能会引入噪声。

默认值为16。

- `detectShadows`参数用于指定算法是否检测阴影。

如果设置为True,则会检测并标记出阴影区域。

默认值为True。

- `shadowValue`参数用于指定阴影像素的值。

利用计算机视觉技术实现物体跟踪的步骤与技巧

利用计算机视觉技术实现物体跟踪的步骤与技巧随着计算机视觉技术的不断发展,物体跟踪成为该领域中的一项重要任务。

物体跟踪能够实现对视频中感兴趣的物体进行实时准确的跟踪,为许多应用场景提供了便利,如智能监控、自动驾驶、增强现实等。

本文将介绍利用计算机视觉技术实现物体跟踪的步骤与技巧。

首先,物体跟踪的基本步骤包括前景提取、特征提取和目标定位。

前景提取是指将视频帧中感兴趣的物体与背景进行区分,以便后续处理。

常用的前景提取方法包括背景建模、基于像素的分割算法、基于运动的方法等。

背景建模算法通过对视频序列中的像素进行统计来建立场景的背景模型,从而将前景与背景进行分割。

基于像素的分割算法则是基于像素的颜色、纹理等特征对前景和背景进行分割。

基于运动的方法则是通过检测运动物体与静止背景之间的运动差异来提取前景。

接下来,特征提取是指从前景中提取出能够表征物体特征的信息,以便进行进一步的跟踪。

常用的特征包括颜色、纹理、形状、边缘等。

这些特征能够帮助计算机识别物体并进行跟踪。

在特征提取过程中,可以使用一些图像处理技术,如滤波、直方图均衡化等,来增强特征的鲁棒性和可靠性。

最后,目标定位是指通过采用一些目标定位算法将前景中的物体进行定位和跟踪。

常用的目标定位算法包括卡尔曼滤波器、粒子滤波器、相关滤波器等。

这些算法基于物体的动态模型和观测模型,对物体的位置和状态进行估计和预测,在跟踪中进行目标位置的预测和修正。

然而,物体跟踪任务并不是一件容易的工作,有一些技巧可以帮助提高跟踪的准确性和性能。

首先,选择合适的背景建模算法和前景提取方法对于物体跟踪至关重要。

不同的场景和物体可能需要不同的算法来适应复杂的环境。

其次,选择合适的特征类型和提取方式,对于物体的鲁棒性和可靠性也有重要影响。

例如,对于易受光照变化影响的物体,选择颜色特征可能更为合适;对于复杂纹理的物体,则可以选择纹理特征进行跟踪。

除此之外,选择合适的目标定位算法也是关键。

不同的算法有不同的适用性和性能,需要根据实际情况进行选择和调优。

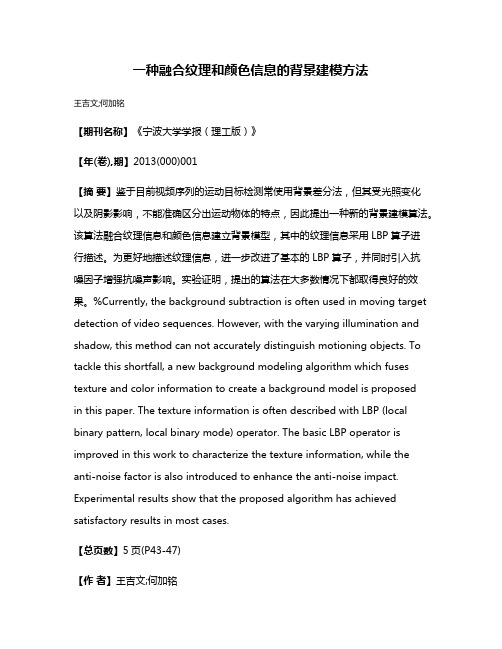

一种融合纹理和颜色信息的背景建模方法

一种融合纹理和颜色信息的背景建模方法王吉文;何加铭【期刊名称】《宁波大学学报(理工版)》【年(卷),期】2013(000)001【摘要】鉴于目前视频序列的运动目标检测常使用背景差分法,但其受光照变化以及阴影影响,不能准确区分出运动物体的特点,因此提出一种新的背景建模算法。

该算法融合纹理信息和颜色信息建立背景模型,其中的纹理信息采用LBP算子进行描述。

为更好地描述纹理信息,进一步改进了基本的LBP算子,并同时引入抗噪因子增强抗噪声影响。

实验证明,提出的算法在大多数情况下都取得良好的效果。

%Currently, the background subtraction is often used in moving target detection of video sequences. However, with the varying illumination and shadow, this method can not accurately distinguish motioning objects. To tackle this shortfall, a new background modeling algorithm which fuses texture and color information to create a background model is proposedin this paper. The texture information is often described with LBP (local binary pattern, local binary mode) operator. The basic LBP operator is improved in this work to characterize the texture information, while theanti-noise factor is also introduced to enhance the anti-noise impact. Experimental results show that the proposed algorithm has achieved satisfactory results in most cases.【总页数】5页(P43-47)【作者】王吉文;何加铭【作者单位】宁波大学通信技术研究所,浙江宁波 315211; 浙江省移动网应用技术重点实验室,浙江宁波 315211;宁波大学通信技术研究所,浙江宁波 315211; 浙江省移动网应用技术重点实验室,浙江宁波 315211【正文语种】中文【中图分类】TP391.4【相关文献】1.一种融合局部纹理和颜色信息的背景减除方法 [J], 徐剑;丁晓青;王生进;吴佑寿2.融合码本和纹理的双层视频背景建模方法 [J], 李峰;周荷琴3.一种从融合颜色信息和深度信息的PNG文件中提取点云数据的方法 [J], 赵矿军4.一种从融合颜色信息和深度信息的PNG文件中提取点云数据的方法 [J], 赵矿军;5.一种基于面部纹理特征融合的人脸表情识别方法 [J], 高婷婷;李航;殷守林因版权原因,仅展示原文概要,查看原文内容请购买。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

背景建模算法1 基本原理视频图像中运动目标检测的一种方法,其基本思想是对图像的背景进行建模。

一旦背景模型建立,将当前的图像与背景模型进行某种比较,根据比较结果确定前景目标(需要检测的运动目标)。

2 难点(1)环境光照的变化(光照突然性的变化和缓慢的变化)(2)背景的多模态性(背景中存在的细微的运动将影响前景目标检测的结果)(3)运动物体的阴影(4)图像噪声(5)新的不动的物体进入到背景中(如何快速适应背景的变化)3 分类背景建模方法可以分为两类,颜色背景模型和纹理背景模型。

3.1 颜色背景模型颜色背景模型其思想是对图像中每个像素的颜色值(灰度或彩色)进行建模。

如果当前图像坐标(x,y)上的像素颜色值与背景模型中(x,y)上的像素颜色值有较大差异时,当前像素被认为是前景,否则为背景。

颜色背景模型的一个最明显的缺点是对阴影敏感,即将阴影误检测为运动目标。

在特定场合下,需要在检测后对阴影进行抑制和消除。

3.1.1 平均背景模型平均背景模型(Average Background Model)是一种简单、计算速度快但对环境光照变化和背景的多模态性比较敏感的一种背景建模算法。

其基本思想是:计算每个像素的平均值作为它的背景模型。

检测当前帧时,只需要将当前帧像素值I(x,y)减去背景模型中相同位置像素的平均值u(x,y),得到差值d(x,y),将d(x,y)与一个阈值TH进行比较,那么得到输出图像output的值如下:(3-1)(3-2)这里TH可以采用自适应算法进行确定,需要计算每个像素的帧间差的平均值和标准差。

公式如下:令代表t时刻的图像中(x,y)处的像素值,inter代表两帧之间的间隔,通常设置为3,令如下:(3-3)(3-4)(3-5)M通常要足够大(>30+inter)来保证和的精确性。

得到了和后TH 可以这样确定:TH = + (3-6)其中一般设置为2。

为了提高算法的鲁棒性,可以在检测完之后要对背景模型进行更新,对于所有像素(x,y),令,,更新后分别为,,:(3-7)(3-8)(3-9)这里为学习率(0~1),越大,对背景变化的适应速度越快。

于是,平均背景建模算法的流程如下:a. 计算M帧图像的平均值建立一个初始背景BG并计算和。

b. 将当前图像减去BG得到差D,通过公式(3-2)检测前景像素和背景像素。

c. 通过公式(3-7)、(3-8)、(3-9)对BG、和进行更新。

d. 返回b直至停止。

算法的改进:增加一个辅助背景SBG(Secondary Background),将SBG的初始值设置为BG,即:SBG(x,y) = BG(x,y) (3-10)得到的新的输出图像output_s的值如下:(3-11)其中:THS = (3-12)检测后通过下式对辅助背景进行更新:(3-13)3.1.2高斯背景模型单高斯背景模型(Single Gaussian Background Model)的基本思想是:将图像中每一个像素点的颜色值看成是一个随机过程X,并假设该点的某一像素值出现的概率服从高斯分布。

令I(x,y,t)表示像素点(x,y,t)在t时刻的像素值,则有:(3-14)其中分别为t时刻该像素高斯分布的期望值和标准差。

简单来说,每一个像素点的背景模型包含一个期望值和一个偏差。

假设一个图像序列I0,I1,…,In,对于坐标为(x,y)的像素,它的初始背景模型的期望值u0(x,y)和偏差(x,y),另外为了计算偏差,增加一个方差(x,y):(3-15)(3-16)(3-17)其中std_init通常设置为20。

对于t时刻的像素值I(x,y,t),按照下面的公式来判断它是否为背景像素,令output为输出图像:(3-18)检测完毕后对那些被判定为背景的像素的背景模型进行更新:(3-19)(3-20)(3-21)高斯背景建模算法的流程如下:a. 用第一帧图像的数据通过公式(3-15)、(3-16)、(3-17)初始化背景模型b. 通过公式(3-18)检测前景像素和背景像素。

c. 通过公式(3-19)、(3-20)、(3-21)对背景模型进行更新d. 返回b直至停止。

算法的改进:混合高斯背景模型(Gaussian Mixture Model)。

在单高斯背景模型中将单个高斯分布作为相应某一像素值的概率密度分布,混合高斯背景模型对其进行了扩展,通过多个高斯概率密度函数的加权平均来平滑地近似任意形状的密度分布函数。

令I(x,y,t)表示像素点(x,y,t)在t时刻的像素值,则有:(3-22)其中K为高斯分布的个数,称为高斯混合概率密度的混合系数。

为t时刻第i个高斯分量的加权系数,也即权重。

对于一个像素的K个高斯分量,根据的值对它们从大到小进行排列,对于满足下式的前B个高斯分布被当作是背景模型。

(3-23)其中T是背景模型占有高斯分布的最小比例,通常为0.7,如果T太小退化为单高斯,T较大则可以描述复杂的动态背景。

对于当前像素(x,y,t),如果它的值I(x,y,t)与它的背景模型中第k(k<=B)个高斯分布匹配,即I(x,y,t)在范围之内,一般设置为2.5,那么该像素被认为是背景,否则是前景。

令输出图像为output,公式如下:(3-24)在检测完前景之后,若该像素被认为是前景,即前B个高斯分布中没有一个与之匹配,则用一个新的高斯分布取代权重最小的那个高斯分布。

新的分布的期望值即为当前的像素值,同时为它分配一个较大的初始偏差std_init和较小的初始权重值weight_init。

若该像素被认为是背景,则对该像素的各个高斯分布的权重做如下调整:(3-25)其中为学习率,值在0~1之间。

如果第i个高斯分布与当前像素匹配,则,否则。

对于与当前像素匹配的高斯分布,更新它们的期望值和偏差值:(3-26)(3-27)(3-28)3.1.3非参数化背景模型高斯背景模型对像素点值的概率密度分布做了假设,而这个假设不一定成立。

非参数化背景模型不对像素点值做出任何假设,而通过概率密度估计的方法建立像素的背景统计模型。

其基本思想是:为被建模场景中的像素点保存一段时间内的一系列颜色样本值,并根据这些样本值来估计当前帧图像中每一个像素点的概率。

给定一维空间n个数据点集合S={xi}i=1…n,它的未知概率密度函数为P(x),取核函数为Kh(x),那么在x点处密度可用如下式估计:(3-29)这里h是核函数的带宽,x为核函数的中心点,核函数估计可以理解为:将在每个采样点为中心的局部函数的平均效果,作为该采样点概率密度函数的估计值,或是核估计器在被估计点为中心的窗口内,计算数据点加权的局部平均。

均值漂移(Mean Shift)算法是目前最流行的非参数化背景建模方法。

对于目标像素,将它建模为q={qu},u=1…m, m为特征值的个数,在图像处理中为灰度等级划分的个数,也是灰度直方图的bins值。

且有:(3-30)其中X0为目标区域窗口的中心像素的坐标向量,Xi为窗口内第i点的坐标向量,C为归一化常数,使得。

k(x)为核函数,H为核函数的带宽向量。

δ(x)为脉冲函数(当x 不为0时,δ(x)=0),保证只有u特征值的像素才对概率分布做出贡献。

函数b:R2->{1…m}是位于Xi的像素向颜色索引的映像。

由于受到遮挡或者背景的影响,目标模型中心附近的像素比其他像素更可靠,因此对于不同位置的像素赋予不用的权值,靠近中心的像素赋予一个较大的权值,远离中心的像素赋予一个小的权值。

因此引入k(x),其中的作用是消除不同大小目标计算时的影响。

由可以得到:(3-31)匹配对象,也称为候选区域,也采用特征值加权概率分布。

匹配窗口的中心坐标为Y,也是核函数的中心坐标。

Xi为匹配窗口中第i点的坐标向量,Hh为匹配窗口的核函数带宽向量。

Ch为匹配窗口特征向量的归一化常数。

匹配对象的被描述为p={pu},u=1…m(3-32)匹配对象和目标模型的相似程度采用Bhattacharyya系数进行描述。

(3-33)匹配过程就是寻找相似函数最大值的寻优过程,Mean-Shift 采用的是梯度下降法。

首先将(Y)在p(Y0)附近进行泰勒级数展开,取前两项。

即:(3-34)定义从而因此要使得向最大值迭代,只要Y的搜索方向与梯度方向一致即可,通过求导可得到Y-0的梯度方向为:其中为权值,g(x)=-k’(x),因此如果如下确定Y1,那么Y1-Y0将于梯度方向一致。

(3-35)根据上面的基础,mean shift算法的过程如下:(1) 计算目标模型的初始分布:{qu}u=1…m,目标被估计位置为Y0。

(2) 用Y0初始化当前帧的候选区域位置,计算分布{pu(Y0)}u=1…m,估计Bhattacharyya 系数:。

(3) 根据计算得到权值。

(4) 根据均值平移向量,计算目标的新位置:(5) 计算{pu(Y1)}u=1…m和。

(6) 如果<,则Y1 <- (Y0+Y1)/2。

(7) 如果Y1-Y0 < ε则停止,否则 Y0 <- Y1,执行步骤(2)。

3.1.4 CodeBook背景模型CodeBook算法的基本思想是得到每个像素的时间序列模型。

这种模型能很好地处理时间起伏,缺点是需要消耗大量的内存。

CodeBook算法为当前图像的每一个像素建立一个CodeBook(CB)结构,每个CodeBook结构又由多个CodeWord(CW)组成。

CB和CW的形式如下:CB={CW1,CW2,…CWn,t}CW={lHigh,lLow,max,min,t_last,stale}其中n为一个CB中所包含的CW的数目,当n太小时,退化为简单背景,当n较大时可以对复杂背景进行建模;t为CB更新的次数。

CW是一个6元组,其中IHigh和ILow作为更新时的学习上下界,max和min记录当前像素的最大值和最小值。

上次更新的时间t_last和陈旧时间stale(记录该CW多久未被访问)用来删除很少使用的CodeWord。

假设当前训练图像I中某一像素为I(x,y),该像素的CB的更新算法如下,另外记背景阈值的增长判定阈值为Bounds:(1) CB的访问次数加1;(2) 遍历CB中的每个CW,如果存在一个CW中的IHigh,ILow满足ILow≤I(x,y)≤IHigh,则转(4);(3) 创建一个新的码字CWnew加入到CB中, CWnew的max与min都赋值为I(x,y),IHigh <- I(x,y) + Bounds,ILow <- I(x,y) – Bounds,并且转(6);(4) 更新该码字的t_last,若当前像素值I(x,y)大于该码字的max,则max <- I(x,y),若I(x,y)小于该码字的min,则min <- I(x,y);(5) 更新该码字的学习上下界,以增加背景模型对于复杂背景的适应能力,具体做法是:若IHigh < I(x,y) + Bounds,则IHigh 增长1,若ILow > I(x,y) – Bounds,则ILow减少1;(6) 更新CB中每个CW的stale。