图像融合

图像融合评价方法

图像融合评价方法

图像融合评价方法是用来衡量图像融合算法效果的一种指标体系。

常见的图像融合评价方法包括以下几种:

1. 主客观评价法:将图像融合的结果与原始图像进行比较,主要评价指标包括图像的清晰度、对比度、亮度等客观指标,同时也可通过主观评价调查收集用户观感作为评价依据。

2. 直观评价法:通过几个专业的评价人员对图像融合的结果进行主观评价,根据整体效果和细节特征等来评判融合结果的优劣,常用的评价方法包括比较法、分级法和排序法等。

3. 结构相似度评价法(SSIM):通过比较原始图像和融合结果之间的结构特征相似性来评价融合算法的效果,通过计算亮度、对比度和结构相似性三个维度的相似度指标来衡量。

4. 峰值信噪比评价法(PSNR):通过比较原始图像和融合结果之间的峰值信噪比来评价融合算法的效果,PSNR越高表示图像质量越好。

5. 色彩保真度评价法(CIEDE2000):通过比较原始图像和融合结果之间的颜色差异来评价融合算法的效果,CIEDE2000是一种广泛使用的色彩差异评价方法。

综合使用上述评价方法可以全面地评价图像融合算法的效果,并挑选出最好的融合结果。

信息融合_第6章 图像融合

6.3 图像匹配

• 特征匹配:匹配图像的相似性度量 – 即确定待匹配特征之间的相似性,通常定义为 某种代价函数或距离函数的形式。 – 经典的相似性度量包括相关函数和Minkowski距 离,近年来还有Hausdorff距离、互信息作为匹 配度量。 – Hausdorff距离对噪声非常敏感,分数 Hausdorff距离能处理当目标存在遮挡的情况, 但计算费时; – 互信息方法对照明的改变不敏感,在医学等图 像的匹配中得到了广泛应用,但计算量大,且 要求图像之间有较大的重叠区域。

6.2 图像融合分类

• 特征级图像融合: – 属于中间层次,先对来自不同传感器的原始信 息进行特征抽取,然后再对从多传感器获得的 多个特征信息进行综合分析和处理,以实现对 多传感器数据的分类、汇集和综合。 – 一般来说,提取的特征信息应是像素信息的充 分表示量或充分统计量,包括目标的边缘、方 向以及运动速度等; – 特征级图像融合可分为两大类,即目标状态数 据融合和目标特性融合;

• •

佘二永.多源图像融合方法研究[D]. 国防科技大学,2005 刘贵喜. 多传感器图像融合方法研究[D]. 西安电子科技大学, 2001

6.1 图像融合概论

• 图像融合: 将不同传感器获得的同一景物的图像或同一传感 器在不同时刻获得的同一景物的图像,经过去噪、 时间配准、空间配准和重采样后,再运用某种融 合技术得到一幅合成图像的过程。 通过对多幅传感器图像的融合,可克服单一传感 器图像在几何、光谱和空间分辨率等方面存在的 局限性和差异性,提高图像的质量,有利于对物 理现象和事件进行定位、识别和解释.

•

信号级融合: – 合成一组传感器信号,提供与原始信号形式相 同但品质更高的信号。

6.2 图像融合分类

图像融合

2.5图像融合一、实验背景图像融合技术是指将多源信道所采集到的关于同一目标图像经过一定的图像处理,提取各自信道的信息,最后综合成同一图像以供观察或进一步处理。

二、实验目的学会将同一目标具有高空间分辨率和高光谱分辨率的两幅图像融合。

三、实验数据Examples\spots.img、dmtm.img四、实验步骤(1)启动图像融合工具。

在ERDAS图标面板菜单条,选择Main | Image Interpreter | Spatial Enhancement | Resolution Merge菜单,打开Resolution Merge对话框。

(2)确定高分辨率输入文件(High Resolution File)为D:\examples \ spots.img。

(3)确定多光谱输入文件(Multispectral Input File)为dmtm.img。

(4)定义输出文件(Output File)为E:\2016271132\reso-merge.img。

(5)选择融合方法(Method),这里选用主成分变换法(Principle Component)。

(6)选择重采样方法(Resample Techniques),这里设置为Bilinear Interpolation双线性插值。

(7)输出数据选择(Output Options)为Stretch Unsigned 8 bit。

(8)输出波段选择(Layer Selection)为Select Layers1:7。

(9)单机OK按钮,关闭Resolution Merge对话框,执行分辨率融合。

五、实验结果(1)原始图像:spots.img dmtm.img(2)图像融合结果:reso-merge.img六、结果评价在Erdas系统中分辨率融合提供了三种方法:主成分变换融合(Principle Component)、乘积变换融合(Mutiplicative)和比值变换融合(Brovey Transformation)。

如何利用图像处理技术进行多视角图像融合

如何利用图像处理技术进行多视角图像融合图像融合是计算机视觉领域中的重要技术之一,它能够将多个视角的图像信息融合为一个更为准确和完整的图像。

图像融合技术在许多应用领域具有广泛的应用,例如航空航天、地质勘探、医学影像等。

其中,利用图像处理技术进行多视角图像融合是一种常见且有效的方法。

本文将介绍如何利用图像处理技术进行多视角图像融合。

多视角图像融合的基本原理是通过对多幅图像进行配准和融合,从而得到更为准确和全面的图像信息。

图像配准是指将多幅图像进行对齐,使得它们在相对位置和尺度上保持一致。

图像融合是指将多幅配准后的图像进行加权或融合,得到一幅综合的图像。

下面将逐步介绍多视角图像融合的具体过程。

第一步是图像配准。

图像配准可以采用特征点匹配的方法,通过检测图像中的特征点,并找出它们之间的对应关系。

常用的特征点包括角点、斑点、边缘等。

一旦找到了特征点的对应关系,就可以通过应用几何变换,如仿射变换或投影变换,将图像进行对齐。

图像对齐后,它们的尺度、旋转和平移关系将一致,为后续的图像融合奠定基础。

第二步是图像融合。

在图像融合过程中,可以采用像素级融合或特征级融合的方法。

像素级融合是指通过调整图像的亮度、对比度和颜色等属性,使得它们在空间上平滑过渡,并融合为一幅全新的图像。

常用的像素级融合方法包括加权平均、Laplace金字塔融合和小波变换融合等。

特征级融合是指将图像中的特征提取出来,再进行融合。

常用的特征级融合方法包括特征加权融合、特征匹配融合和特征拼接融合等。

在进行图像融合时,还需要考虑到图像质量的评估和优化。

图像质量评估是指通过一些客观的指标,如均方误差、峰值信噪比和结构相似性指标等,对融合后的图像进行质量评估。

根据评估结果,可以对融合过程进行优化,以得到更好的图像融合效果。

除了基本的图像处理技术,还有一些高级的技术可以用于多视角图像融合。

例如,通过深度学习方法,可以学习图像的特征表示和融合权重,以得到更准确和自然的图像融合结果。

图像融合层次

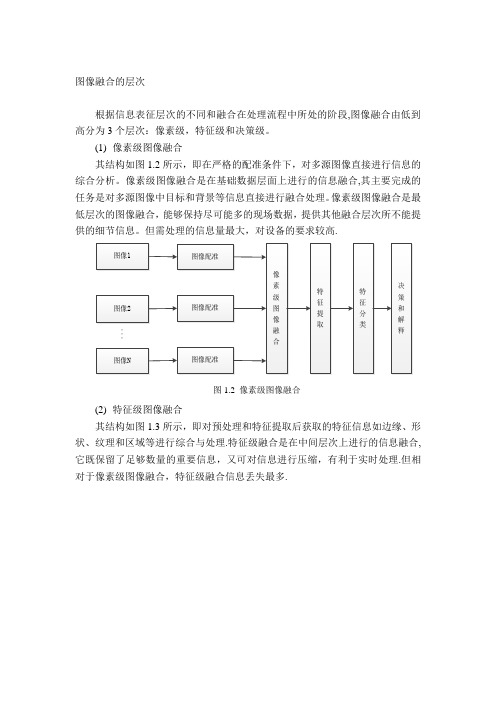

图像融合的层次根据信息表征层次的不同和融合在处理流程中所处的阶段,图像融合由低到高分为3个层次:像素级,特征级和决策级。

(1)像素级图像融合其结构如图1.2所示,即在严格的配准条件下,对多源图像直接进行信息的综合分析。

像素级图像融合是在基础数据层面上进行的信息融合,其主要完成的任务是对多源图像中目标和背景等信息直接进行融合处理。

像素级图像融合是最低层次的图像融合,能够保持尽可能多的现场数据,提供其他融合层次所不能提供的细节信息。

但需处理的信息量最大,对设备的要求较高.图1.2 像素级图像融合(2)特征级图像融合其结构如图1.3所示,即对预处理和特征提取后获取的特征信息如边缘、形状、纹理和区域等进行综合与处理.特征级融合是在中间层次上进行的信息融合,它既保留了足够数量的重要信息,又可对信息进行压缩,有利于实时处理.但相对于像素级图像融合,特征级融合信息丢失最多.图1.3 特征级图像融合(3)决策级图像融合其结构如图1。

4所示,即在每个传感器已完成目标提取与分类之后,融合系统根据一定的准则以及每个决策的可信度作出决策融合处理。

此种融合实时性好,并且具有一定的容错能力。

决策级融合方法主要是基于认知模型的方法,需要大型数据库和专家决策系统进行分析、推理、识别和判决.图1.4 决策级图像融合像素级融合和特征层融合都需要对多源信息进行关联和配准,决策层融合只需要对数据进行关联。

只是它们进行相关联和识别的顺序不同,像素级融合直接对原始数据进行配准和关联,特征层融合对特征向量进行配准和关联,然后再进行识别,而决策层融合则是先进行识别,再对各个决策结果进行关联,得到融合的判决结果。

决策层融合对传感器依赖性较小,传感器可以是同质的,也可以是异质的。

除非传感器的信号是独立的,否则,决策层融合的分类性能可能低于特征层融合。

对于特定的应用选择在哪一个层次进行融合是一个系统工程问题,需要综合考虑通信带宽、信源的特点、可用的计算资源等方面的因素影响。

遥感图像融合方法

遥感图像融合方法遥感图像融合是指将来自不同传感器或不同波段的遥感图像进行融合,以获取更丰富的信息和更高的分辨率。

在遥感领域,图像融合技术被广泛应用于土地利用分类、环境监测、资源调查等领域。

本文将介绍几种常见的遥感图像融合方法,以及它们的优缺点和适用范围。

首先,基于像素级的遥感图像融合方法是最简单和常见的方法之一。

这种方法将来自不同传感器的图像进行逐像素的加权平均或逻辑运算,以获得融合后的图像。

这种方法的优点是简单易行,适用于大多数遥感图像。

然而,由于它忽略了图像的空间信息,导致融合后的图像质量较低,对细节的保留不足。

其次,基于特征的遥感图像融合方法通过提取图像的特征信息,如边缘、纹理等,然后将这些特征信息进行融合。

这种方法能够更好地保留图像的细节信息,提高融合后图像的质量。

然而,这种方法需要对图像进行复杂的特征提取和匹配,计算量较大,且对图像质量和几何精度要求较高。

另外,基于变换的遥感图像融合方法是利用变换域的方法对图像进行融合,如小波变换、PCA变换等。

这种方法能够更好地提取图像的频域信息,获得更高质量的融合图像。

然而,这种方法对图像的几何变换和配准要求较高,且需要较高的计算复杂度。

此外,基于深度学习的遥感图像融合方法是近年来的研究热点。

通过使用深度神经网络对图像进行端到端的融合,能够更好地提取图像的语义信息,获得更高质量的融合图像。

然而,这种方法需要大量的训练数据和计算资源,且对算法的调参和模型的选择要求较高。

综上所述,不同的遥感图像融合方法各有优缺点,适用于不同的应用场景。

在实际应用中,需要根据具体的需求和条件选择合适的融合方法,以获得最佳的效果。

希望本文能够对遥感图像融合方法有所了解,并为相关研究和应用提供参考。

图像融合拼接方法

图像融合拼接方法图像融合拼接是指将多幅图像进行合并处理,形成一幅新的图像。

它在计算机视觉、图像处理领域具有重要应用,可以用于拼接全景图、生成虚拟实境等。

本文将介绍几种常见的图像融合拼接方法。

一、传统图像融合拼接方法1.1 直观图像融合拼接方法直观图像融合拼接方法是最简单的一种方法,它直接将两幅图像进行叠加。

例如,在拼接两张风景照片时,可以将两个图像的像素值相加或取平均值,从而合并成一幅新的图像。

这种方法的优点是操作简单,但缺点是容易导致拼接处的边缘不连续,不够自然。

1.2 重叠区域混合融合拼接方法重叠区域混合融合拼接方法通过将两幅图像在重叠区域内进行像素值的平滑过渡,实现更自然的融合效果。

常用的方法有线性混合、高斯混合等。

线性混合是指在重叠区域内,按照一定的权重将两幅图像的像素值进行逐点插值,从而形成新的图像。

而高斯混合则是通过使用高斯模糊滤波器,降低重叠区域内图像的对比度,实现平滑过渡。

1.3 多尺度图像融合拼接方法多尺度图像融合拼接方法是一种层次化的拼接方法。

它首先将两幅图像进行金字塔分解,分别得到不同尺度的图像金字塔。

然后,在每一层金字塔上进行拼接处理,得到对应尺度的融合结果。

最后将各层结果合并,得到最终的融合图像。

这种方法能够有效处理图像的尺度变化,并保持较高的拼接质量。

二、深度学习图像融合拼接方法随着深度学习技术的发展,越来越多的研究者开始将其应用于图像融合拼接中,取得了很好的效果。

深度学习图像融合拼接方法主要包括基于生成对抗网络(GAN)的方法、基于卷积神经网络(CNN)的方法等。

2.1 基于生成对抗网络的图像融合拼接方法基于生成对抗网络的图像融合拼接方法是将两幅图像作为输入,通过生成器和判别器的协同训练,使生成器能够生成与真实图像相似的图像。

这种方法可以有效地学习到图像的分布特征,从而生成更自然的融合结果。

2.2 基于卷积神经网络的图像融合拼接方法基于卷积神经网络的图像融合拼接方法主要通过卷积层、池化层和全连接层等结构,对输入图像进行特征提取和融合操作。

图像拼接算法

图像拼接算法简介图像拼接算法是一种用于将多个图像合并成一个更大图像的技术。

该算法通过找到输入图像之间的共同特征点并对齐它们,然后通过一些图像处理方法来融合它们,从而生成一个完整的图像。

拼接算法可应用于多个领域,如摄影、航拍、医学图像等。

在这些领域中,往往需要获取更大的视野范围或更高的分辨率,因此使用拼接算法可以满足这些需求。

基本步骤图像拼接算法通常包括以下几个基本步骤:1.特征点检测:首先对输入图像进行特征点检测,例如使用SIFT(尺度不变特征变换)算法。

特征点是图像中具有显著特征的一组像素。

2.特征点匹配:将不同图像中的特征点进行匹配,并根据匹配程度将它们分组。

常见的算法有RANSAC(随机抽样一致性)算法。

3.图像对齐:通过对齐特征点,将不同图像进行几何变换,从而使它们在同一坐标系下对齐。

常见的变换包括平移、旋转、缩放等。

4.图像融合:将对齐后的图像进行融合,使它们看起来无缝连接。

常见的融合方法有线性融合、金字塔融合、平面拼接等。

算法实现以下是一个简单的图像拼接算法的示例实现:import cv2import numpy as npdef stitch_images(images):# 特征点检测sift = cv2.SIFT_create()keypoints = []descriptors = []for image in images:kp, des = sift.detectAndCompute(image, None) keypoints.append(kp)descriptors.append(des)# 特征点匹配matcher = cv2.BFMatcher(cv2.NORM_L2)matches = []for i in range(len(keypoints) -1):matches.append(matcher.match(descriptors[i], descriptors[i+1]))# 图像对齐homography_matrices = []for i in range(len(matches)):src_pts = np.float32([keypoints[i][m.queryId x].pt for m in matches[i]]).reshape(-1, 1, 2)dst_pts = np.float32([keypoints[i+1][m.trainI dx].pt for m in matches[i]]).reshape(-1, 1, 2)M, _ = cv2.findHomography(src_pts, dst_pts, c v2.RANSAC, 5.0)homography_matrices.append(M)# 图像融合result = images[0]for i in range(len(images) -1):result = cv2.warpPerspective(result, homograp hy_matrices[i], (result.shape[1] + images[i+1].sh ape[1], result.shape[0]))result[0:images[i+1].shape[0], 0:images[i+1]. shape[1]] = images[i+1]return result结果展示下面是使用示例实现对两张图像进行拼接的结果展示:import cv2import matplotlib.pyplot as pltimage1 = cv2.imread('image1.jpg')image2 = cv2.imread('image2.jpg')result = stitch_images([image1, image2])plt.imshow(cv2.cvtColor(result, cv2.COLOR_BGR2RG B))plt.axis('off')plt.show()总结图像拼接算法是一种用于将多个图像合并成一个更大图像的技术。

图像融合ppt课件

多源遥感数据合的内涵与基本原理 数据融合过程 数据融合分类及方法

•数据融合的方法分类 •主要图像融合方法

多源遥感数据融合的内容分类

ppt课件.

1

4.4.1 多源遥感数据融合的内涵与基本原理

多种信息源的遥感数据融合是指多种空间分辨率、辐射分辨 率、波谱分辨率和时间分辨率的遥感数据之间以及遥感数据 与非遥感数据之间的信息进行多层次有机组合匹配的技术, 包括空间几何配准和数据融合两个方面,从而在统一地理坐 标系统下,构成一组新的空间信息和合成图像。

七波段图 像

ppt课件.

6

10米分辨 率SPOT 图像

ppt课件.

7

对比两图, 可以看出, 复合后的图 像既保留了 TM的光谱分 辨率又保留 了SPOT的空 间分辨率, 图像质量有 所提高。

ppt课件.

8

4.4.2 数据融合过程

1.预处理:主要包括遥感影像的几何纠正、辐射 校正和空间配准

(1)几何纠正、辐射校正的目的主要在于去除图 像变形、阴影等因素以及卫星扰动、天气变化、 大气散射等随机因素对成像结果一致性的影响;

决策级融合的流程:经过预处理的遥感影像数 据——特征提取——属性说明——属性融合——融 合属性说明。

ppt课件.

14

三级融合层次的特点

融合 框架

像元 级

特征 级

决策 级

信息 损失 小

中

大

实时 性 差

中

优

精度 高 中 低

容错 性 差

中

优

抗干 扰力

差

中

优

工作 量 小

中

大

融合 水平 低

中

高

ppt课件.

图像融合及应用ppt课件

4. 相似性度量

征。

37

三、图像配准

配准步骤

图像配准的过程也就是“确定空间 变换模型——求解变换模型参数”的过 程。

1. 搜索空间 2. 特征空间 3. 搜索策略

在搜索空间寻找最佳 的变换模型参数的过程 中所采用的方法。

4. 相似性度量

38

三、图像配准

配准步骤

图像配准的过程也就是“确定空间 变换模型——求解变换模型参数”的过 程。

B

I

3

3

1200

SI

[min(R,G, B)]

(R G B)

00

H

arccos

(

R

(R G) R B)/

G)2 (R B)(G

2 B)

1/

2

2400 IHS柱形空间

51

四、(5图)像RGB融-I合HS变方换法法

(1) RGB-IHS变换法

13

国内出版物

14

参考书

15

国内出版物

[1]覃征等,数字图像融合,西安交通大学出版社,2005年

[2]张永生等,天基多源遥感信息融合—理论算法与应用系统,科学出版 社 ,2005 [3]韩崇昭等,多源信息融合,清华大学出版社,2006

[4]那彦,焦李成等,基于多分辨分析理论的图像融合方法(研究生系列教 材),西安电子科技大学出版社,2007 [5]李振华等,图像融合—理论与应用,高等教育出版社,2007 [6] 胡良梅等,基于信息融合的图像理解方法研究,合肥工业大学 出版 社,2007. [7]郭雷,李晖晖等,图像融合,电子工业出版社,2008 [8] 刘卫光等,图像信息融合与识别,电子工业出版社,2008

小波变换融合原理

小波变换融合是一种常用的图像融合技术,它基于小波变换将不同来源的图像进行分解和重构,从而实现图像的融合。

具体来说,小波变换融合的原理如下:

1. 小波分解

首先,将不同来源的图像进行小波分解,将图像分解成不同尺度和频率的子图像,这些子图像被称为小波系数。

2. 选择系数

根据需要融合的图像的特征,选择不同的小波系数进行保留或删除。

通常情况下,高频系数对应图像的细节信息,低频系数对应图像的整体信息。

因此,可以保留高频系数,删除低频系数来保留图像的细节信息,或者相反。

3. 重构图像

根据选择的小波系数进行重构,得到最终的融合图像。

需要注意的是,小波变换融合的效果取决于选择的小波系数的数量和权重。

如果选择的小波系数过多或权重不合适,可能会导致图像失真或细节丢失。

因此,需要根据具体情况进行选择和调整。

总的来说,小波变换融合是一种有效的图像融合技术,它能够保留图像的细节信息,同时实现不同来源图像的融合。

08.图像融合

Sharpening /Image Sharpening/NNDiffuse Pan Sharpening

本节收获

• 掌握图像融合的基本方法和流程 • 学习了Gram-Schmidt Pan Sharpening融合方法 • 学习了NNDiffuse 图像融合工具 • 学习了不同传感器、相同传感器图像的融合

图像融合

技术支持邮箱:ENVI-IDL@ 技术支持热线:400-819-2881-5 官方技术博客:/enviidl 官方技术qq群:184886955

课程简介

• 图像融合,是将低分辨率的多光谱影像与高分辨率的单 波段影像重采样生成一副高分辨率多光谱影像遥感的图 像处理技术,使得处理后的影像既有较高的空间分辨率 ,又具有多光谱特征。

NNDiffuse

pan 理和投影坐标系统、具备RPC信息和基于像元位置(无空间坐标系)几种地理信息

sharpening(NND)

元数据类型;支持多线程计算,能进行高性能处理。

融合结果对于色彩、纹理和光谱信息,均能得到很好保留。

练习

• 数据:

SPOT4 的10米全色波段和Landsat TM 30m QuickBird全色和多光谱图像

• 图像融合除了要求融合图像精确配准外,融合方法的选 择也非常重要,同样的融合方法在用在不同影像中,得 到的结果往往会不一样。

各种融合方法说明

NNDiffuse融合方法是最新的融合算法,支持最近传感器类型,如Landsat 8、 SPOT、WorldView-2/3、Pléiades-1A/1B、QuickBird、GeoEye-1、EO-1 ALI 、IKONOS、DubaiSat-1/2、NigeriaSat-2、高分数据等,融合结果对于色彩、 纹理和光谱信息,均能得到很好保留。这种方法可以满足绝大部分多光谱与全色 分辨率为整数倍关系的图像融合,推荐使用。

第15章 多光谱图像融合技术与

(c)通过不同时刻的图像序列融合来检测场景/目标的 变化情况;

(d)通过融合多个二维图像产生具有立体视觉的三维 图像,可用于三维重建或立体摄影、测量等;

(e)利用来自其它传感器的图像来替代/弥补某一传感 器图像中的丢失/故障信息。

j)

ij

ij

融合结果

原始微光

原始红外

加权平均

基于Laplace金字塔分解

融合结果

原始微光

原始红外

基于低通比率金字塔分解

基于小波变换

融合结果

4. 彩色图像融合

(1) 直接映射法 (2) TNO融合法 (3)MIT融合法 (4) 基于空间色彩传递的图像融合方法 (5)基于空间色彩传递的图像融合方法

多光谱图像融合的基本方法

像素级融合 特征级融合 决策级融合

1. 加权融合

设A(x,y)和B(x,y)分别为两幅图像A和B的 像素点,经融合后得到的融合结果图像为 F(x,y),那么对源图像的像素灰度值加权 融合的过程可以表示为:

F(x, y) wA A(x, y) wBB(x, y)

第15章 多光谱图像融合技术与 系统

为什么进行图像融合?

为什么进行图像融合?

为什么进行图像融合?

为什么进行图像融合?

为什么进行图像融合?

为什么进行图像融合?

多光谱图像融合的概念

冗余信息

图像传感器A

图像传感器B

互补信息

多光谱图像融合是为了克服单一光谱成像系统 图像信息不够丰富的缺点,利用不同光谱图像 的冗余特性和互补特性重新进行信息组合,获 得能反映各种光谱特点的图像的过程。

图像融合技术

对任意 L R 上的二维矩阵

2

A am, n m,nZ

a 2 m, n 满足:m,nZ

Company Logo

基于多分辨图像融合的实现

定义如下算子为

H r Am, n H C Am, n Gr Am, n GC Am, n 1

Company Logo

分类

预处理 图像

特征提取

图像分类

应用

像素级 图 像 融 合

特征级 图 像 融 合

决策级 图 像 融 合

Company Logo

分类

像素级融合

像素级融合中有空间域算法和变换域算法,空 间域算法中又有多种融合规则方法,如逻辑滤

波法,灰度加权平均法,对比调制法等;变换

域中又有金字塔分解融合法,小波变换法。其 中的小波变换是当前最重要,最常用的方法。

Company Logo

应用

图像融合技术广泛应用于各个领域: 如医学、军事等。

医 疗 应 用

Company Logo

军事应用

海湾战争中发挥很好作战性 能的“LANTIRN”吊舱就是一 种图像融合系统。是一种用 于飞行战斗机的低空红外夜 视目标侦测系统。

Company Logo

远程遥感应用

LANDSAT项目工作组 LANDSAT采集的图像 LANDSAT发射火箭

Company Logo

分类

决策级融合

决策级融合主要在于主观的要求,同样也有一些

规则,如贝叶斯法,D-S证据法和表决法等。

融合算法常结合图像的平均值、熵值、标准 偏差、平均梯度;平均梯度反映了图像中的微小 细节反差与纹理变化特征,同时也反映了图像的 清晰度。目前对图像融合存在两个问题:最佳小 波基函数的选取和最佳小波分解层数的选取。

第七章医学图像的配准与融合

四、医学图像配准方法的分类

(六)根据配准过程中变换参数确定的方式分类

1、通过直接计算公式得到变换参数的配准:限制在基于特征信息(例 如小数目的特征点集、二维曲线、三维表面)的配准应用中。

2、通过在参数空间中寻求某个函数的最优解得到变换参数的配准: 所有的配准都变成一个能量函数的极值求解问题。

四、医学图像配准方法的分类

(四)根据用户交互性的多少分类

自动配准:用户只需提供相应的算法和图像数据。 半自动配准:用户需初始化算法或指导算法(如拒绝或接

受配准假设); 交互配准:用户在软件的帮助下进行配准

四、医学图像配准方法的分类

(五)根据配准所基于的图像特征分类

基于外部特征的图像配准:是指在研究对象上设置一些 标志点,使这些标记点能在不同的影像模式中 显示,然后再用自动、半自动或交互式的方法 用标记将图像配准。

7.1 应用背景介绍

目前这两类成像设备的研究都已取得了很大的进步,图像的 空间分辨率和图像质量有很大的提高,但由于成像原理不同所 造成的图像信息局限性,使得单独使用某一类图像的效果并不理 想。 因此,为了提高诊断正确率,需要综合利用患者的各种图像 信息。

7.1 应用背景介绍

最有效的解决方法:以医学图像配准技术为基础,利用信息 融合技术,将这两种图像结合起来,利用各自的信息优势,在 一幅图像上同时表达来自人体的多方面信息。 更加直观地提供了人体解剖、生理及病理等信息。其中配准 技术是图像融合的关键和难点。

后保持不变。 例如:人体的头部由坚硬的颅骨支撑,在处理时通常忽

略头部皮肤的微小变形,将整个人脑看作是一个 刚体。

图像融合

遥感图像处理与分析(十一)Remote Sensing ImageProcessingand Analysis第十一章图像融合主要内容:图像融合的基本概念图像融合的预处理图像融合的基本方法图像融合的效果评价一、基本概念数据融合:指对多个信息源的若干观测数据和信息,在一定准则下加以自动分析、综合,以完成所需的决策和评估任务而进行的信息处理技术。

图像融合:是将2个或2个以上的传感器在同一(或不同时间)获取的关于某个具体场景的图像或图像序列信息加以综合,生成一个新的有关此场景的解释,而这个解释是从单一传感器获取的信息中无法得到的。

图像融合的主要形式:有3种:多传感器不同时获取的图像的融合多传感器同时获取的图像的融合单一传感器不同时间,或不同环境条件下获取的图像的融合图像融合的层次:可分为:(信号级)、像素级、特征级和决策级像素级图像融合像素级融合是一种低等级的融合。

一般步骤:预处理、变换、综合和反变换预处理:对原始图像进行滤波和配准处理配准:将融合的原始图像进行变换,使被融合图像的每个像素都严格对准的过程。

主要的变换方法:PCA(主成分分析)、HIS变换、小波变换、Brovery变换等特征级图像融合特征级融合是一种中间层次的融合。

分类:目标状态数据融合(主要用于多传感器目标跟踪)和目标特性融合(进行特征层联合目标识别等) 处理方法:首先对来自不同传感器的原始信息进行特征提取,然后再对多传感器获得的多个特征信息进行综合分析和处理,以实现对多传感器数据的分类、汇集和综合。

优点:实现了可观的信息压缩,便于实时处理 主要方法:聚类分析法、贝叶斯估计法、信息熵法、神经网络法等决策级图像融合决策级融合是更高层次的融合。

方法:首先对每一数据进行特征提取和属性说明,然后对其结果加以融合。

特点:具有很强的容错性,处理时间短,数据要求低;但信息损失较大,且精度较差。

主要方法:贝叶斯估计法、神经网络法、模糊聚类法、专家系统等图像融合的方法融合功能模型组合融合模式不同传感器图像不同时刻的热红外图像印度IRS-1C,1D(5.8米空间分辨率)机载光学和热红外图像二、图像融合的预处理辐射改正:传感器不同、成像环境不同,图像间存在一定的辐射变形。

图像融合简述

图像融合简述1、图像融合:图像融合是指将多幅图像,在经过去噪、配准等预处理后,再依据某些融合规则合成⼀幅图像的过程。

融合图像对⽬标的描述更清晰和准确,更适合图像后续的处理。

(多传感器图像融合(可见光图像和红外图像融合)、单⼀传感器多聚焦图像融合)图像融合需要遵守的3个基本原则:1)融合后图像要含有所有源图像的明显突出信息;2)融合后图像不能加⼊任何的⼈为信息;3) 对源图像中不感兴趣的信息,如噪声要尽可能多地抑制其出现在融合图像中。

融合图像的作⽤①图像增强。

通过综合来⾃多传感器(或者单⼀传感器在不同时间)的图像,获得⽐原始图像清晰度更⾼的新图像。

②特征提取。

通过融合来⾃多传感器的图像更好地提取图像的特征,如线段,边缘等。

③去噪。

④⽬标识别与跟踪。

⑤三维重构。

2、图像融合应⽤领域图像融合技术的研究呈不断上升的趋势,应⽤领域也遍及遥感图像处理,可见光图像处理,红外图像处理,医学图像处理等。

3、⼏种典型的数字图像融合⽅法主成分分析法差分演化计算法(DE)遗传算法 GA粒⼦群算法(PSO)蚁群算法神经⽹络法⼩波变换法模糊图像融合。

如果按研究⽅法分类,彩⾊图像融合⼤体可以分为两类:基于⼈的视觉系统和直接基于物理光学。

基于物理光学的研究是直接在颜⾊空间RGB中对图像进⾏处理、融合。

⽽基于⼈的视觉系统的融合,更多是从感官上在⾊彩的 HI V空间对图像进⾏融合。

4、融合过程:图像融合的⽅法很多,按照信息提取的层次从低到⾼的原则可划分为 3 类:像素级图像融合、特征级图像融合和决策级图像融合。

像素级融合依据⼀定的融合规则直接对源图像基于像素的特征进⾏融合,最后⽣成⼀幅融合图像的过程。

它保留源图像的原始信息最多、融合准确性最⾼,但该类⽅法也存在着信息量最⼤、对硬件设备和配准的要求较⾼、计算时间长和实时处理差等缺点。

特征级图像融合是⾸先对源图像进⾏简单的预处理,再通过⼀定模型对源图像的⾓点、边缘、形状等特征信息进⾏提取,并通过合适的融合规则进⾏选取,再依据⼀定的融合规则对这些特征信息进⾏选取和融合,最后⽣成⼀幅融合图像的过程。

图像拼接和图像融合

编辑ppt

10

2. 图像矫正和配准

◦ 基于灰度信息的图像配准

基于灰度的一些统计信息来度量图像的相似度。 优点简单易行,缺点计算量大,对噪声敏感。 三种方法

互相关法 序贯相似度检测匹配 交互信息法

◦ 基于变换域图像配准方法

图像间的平移,旋转,缩放在频域上有对应,对抗噪声有一 定的鲁棒性

编辑ppt

2

图像融合是将两个或两个以上的传感器在同一时间 或不同时间获取的关于某个具体场景的图像或图像 序列信息加以综合,以生成新的有关此场景解释的 信息处理过程。

图像融合是是指将多源信道所采集到的关于同一目 标的图像数据经过图像处理和计算机技术等,最大 限度的提取各自信道中的有利信息,最后综合成高 质量的图像,以提高图像信息的利用率、改善计算 机解译精度和可靠性、提升原始图像的空间分辨率 和光谱分辨率。

编辑ppt

3

图像融合是以图像为研究对象的信息融合,它把对 同一目标或场景的用不同传感器获得的不同图像, 或用同种传感器以不同成像方式或在不同成像时间 获得的不同图像,融合为一幅图像,在一幅融合图 像中能反应多重原始图像的信息,已达到对目标和 场景的综合描述,使之更适合视觉感知或计算机处 理。

它综合了传感器、信号处理、图像处理和人工智能 等技术的新兴学科。

最低层次的图像融合,准确性最高,能够提供其他层次处理所具有的细 节信息。处理的信息量较大。

◦ 特征级

与处理和特征提取后获得的景物信息如边缘,形状,纹理和区域等信息 进行综合与处理。

中间层次信息融合,即保留了足够数量的重要信息,有可对信息进行压 缩,有利于实时处理

◦ 决策级

根据一定的准则以及每个决策的可信度做出最优决策。 最高层次的信息融合,实时性好,并且具有一定的容错能力。 基于认知模型的方法,需要大型数据库和专家决策系统进行分析、推断、

envi图像融合

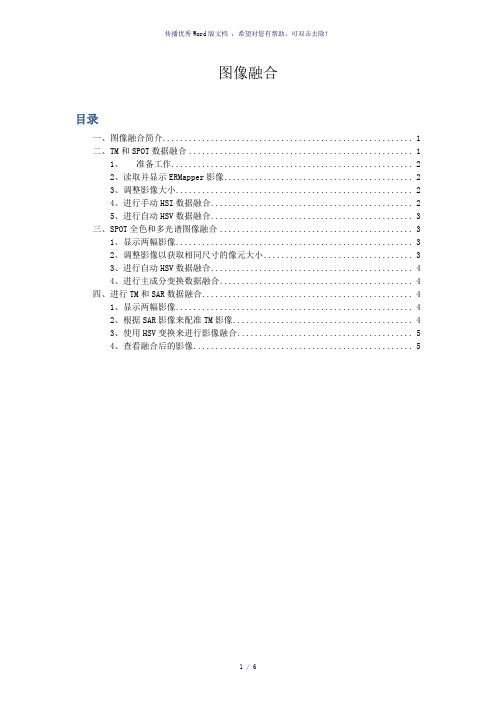

图像融合目录一、图像融合简介 (1)二、TM和SPOT数据融合 (1)1、准备工作 (2)2、读取并显示ERMapper影像 (2)3、调整影像大小 (2)4、进行手动HSI数据融合 (2)5、进行自动HSV数据融合 (3)三、SPOT全色和多光谱图像融合 (3)1、显示两幅影像 (3)2、调整影像以获取相同尺寸的像元大小 (3)3、进行自动HSV数据融合 (4)4、进行主成分变换数据融合 (4)四、进行TM和SAR数据融合 (4)1、显示两幅影像 (4)2、根据SAR影像来配准TM影像 (4)3、使用HSV变换来进行影像融合 (5)4、查看融合后的影像 (5)一、图像融合简介数据融合是将多幅影像组合到单一合成影像的处理过程。

一般使用高空间分辨率的全色影像或单一波段的雷达影像来增强多光谱影像的空间分辨率。

图像融合的关键是融合前两幅图像的精确配准以及处理过程中融合方法的选择。

●只有将两幅融合图像进行精确配准,才可能得到满意的结果。

●对于融合方法的选择,取决于被融合图像的特征以及融合目的。

ENVI中提供的融合方法有:HSV变换、Brovey变换、乘积运算(CN)、主成分(PC)变换、Gram-Schmidt Pan Sharpening(GS)。

表1 融合方法说明融合方法适用范围HSV纹理改善,空间保持较好。

光谱信息损失较大,受波段限制Brovey变换光谱信息保持较好,受波段限制乘积运算(CN)对大的地貌类型效果好,同时可用于多光谱与高光谱图像的融合主成分(PC)变换无波段限制,光谱保持好。

第一主成分信息高度集中,色调发生较大变化Gram-Schmidt Pan Sharpening(GS)改进了PCA中信息过分集中的问题,不受波段限制,较好的保持空间纹理信息,尤其能高保真保持光谱特征。

专为最新高空间分辨率图像设计,能较好保持图像的纹理和光谱信息二、TM和SPOT数据融合数据一:lon_spot :London SPOT数据lon_spot.ers :ER Mapper的头文件lon_tm :London Landsat TM数据lon_tm.ers :ER Mapper的头文件1、准备工作为了在ENVI中进行数据融合,一般要求影像文件含有地理坐标(在这种情况下,空间重采样会自动进行),否则影像必须覆盖同一地理区域,并且有相同的像素大小、影像大小以及相同的方位。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

图像融合是将两幅或多幅图像融合在一起,以获取对同一场景的更为精确、更为全面、更为可靠的图像描述。

融合算法应该充分利用各原图像的互补信息,使融合后的图像更适合人的视觉感受,适合进一步分析的需要;并且应该统一编码,压缩数据量,以便于传输。

图像融合可分为三个层次:1. 像素级融合2. 特征级融合3. 决策级融合其中像素级融合是最低层次的融合,也是后两级的基础。

它是将各原图像中对应的像素进行融合处理,保留了尽可能多的图像信息,精度比较高,因而倍受人们的重视。

像素级的图像融合方法大致可分为三大类:1. 简单的图像融合方法2. 基于塔形分解(如Laplace塔形分解、比率塔等)的图像融合方法3. 基于小波变换的图像融合方法小波变换是图像的多尺度、多分辨率分解,它可以聚焦到图像的任意细节,被称为数学上的显微镜。

近年来,随着小波理论及其应用的发展,已将小波多分辨率分解用于像素级图像融合。

小波变换的固有特性使其在图像处理中有如下优点:1. 完善的重构能力,保证信号在分解过程中没有信息损失和冗余信息;2. 把图像分解成平均图像和细节图像的组合,分别代表了图像的不同结构,因此容易提取原始图像的结构信息和细节信息;3. 具有快速算法,它在小波变换中的作用相当于FFT算法在傅立叶变换中的作用,为小波变换应用提供了必要的手段;4. 二维小波分析提供了与人类视觉系统方向相吻合的选择性图像。

——像素级图像融合的主要步骤以两幅图像的融合为例。

设A,B为两幅原始图像,F为融合后的图像。

若对二维图像进行N层的小波分解,最终将有(3N+1)个不同频带,其中包含3N 个高频子图像和1个低频子图像。

其融合处理的基本步骤如下:(1)对每一原图像分别进行小波变换,建立图像的小波塔型分解;(2)对各分解层分别进行融合处理。

各分解层上的不同频率分量可采用不同的融合算子进行融合处理,最终得到融合后的小波金字塔;(3)对融合后所得小波金字塔进行小波重构,所得到的重构图像即为融合图像。

图 1在图像融合过程中,小波基的种类和小波分解的层数对融合效果有很大的影响,对特定的图像来说,哪一种小波基的融合效果最好,分解到哪一层最合适,都是需要考虑的问题。

为此可以通过引入融合效果的评价来构成一个闭环系统。

如图2所示。

对图像而言,小波变换是将图像分解成频域上各个频率段的子图,以代表原图的各个特征分量。

这对后续的融合处理极为重要,使得融合处理可以根据不同的特征分量采用不同的融合方法以达到最佳融合效果。

图像的融合策略(方法)是图像融合的核心,方法与规则的优劣直接影响融合的速度与质量。

在一幅图像的小波分解中,绝对值较大的小波高频系数对应着亮度急剧变化的点,也就是图像中对比度变换较大的边缘特征,如边界、亮线及区域轮廓。

融合的效果就是对同样的目标,融合前在图像A中若比图像B中显著,融合后图像A中的目标就被保留,图像B中的目标就被忽略。

这样,图像A、B中目标的小波变换系数将在不同的分辨率水平上占统治地位,从而在最终的融合图像中,图像A 与图像B中的显著目标都被保留。

目前小波域的融合规则主要分为两种:一、基于单个像素的融合规则主要包括:(1)小波系数的直接替换或追加;(2)最大值选取;(3)加权平均。

二、基于区域特征的融合规则。

主要包括:(1)基于梯度的方法;(2)基于局域方差的方法;(3)基于局域能量的方法。

基于像素的融合规则在融合处理时表现出对边缘的高度敏感性,使得在预处理时要求图像是严格对准的,否则处理结果将不尽人意,这就加大了预处理的难度。

基于区域的融合规则由于考虑了与相邻像素间的相关性,降低了对边缘的敏感性,所以具有更加广泛的适用性。

图1针对不同类型的图像,下面介绍几种常用的融合方法:(1)取系数绝对值较大法适合高频成分较丰富,亮度、对比度较高的原图像,否则在融合图像中只保留一幅图像的特征,其他的特征被覆盖;融合图像中基本保留原图像的特征,图像对比度与原图像基本相同。

小波变换的实际作用是对信号解相关,并将信号的全部信息集中到一部分具有大幅值的小波系数中。

这些大的小波系数含有的能量远比小系数含有的能量大,从而在信号的重构中,大的系数比小的系数更重要。

(2)加权平均法权重系数可调,适用范围广,可消除部分噪声,原图像信息损失较少,但会造成图像对比度的下降,需要进行图像灰度增强。

(3)消除高频噪声法高频噪声基本消除,融合图像对比度较高,原图像特征可较好地保留在融合图像中,但在消除高频噪声的同时,损失了部分高频信息。

(4)双阈值法适于原图像中一幅图像的灰度分布均衡,高频成分较多;双阈值可选,增加了算法的实用性,但选择阈值时要考虑原图像灰度分布的特点,否则有可能出现边缘跳跃的现象。

前几天我们讨论了一种基于低频融合策略的小波图像融合算法(/chenyusiyuan/archive/2007/11/14/1883987.aspx),今天就来说说算法编程实现的几个细节问题。

(1)高频带的融合首先,高频系数融合均采用基于像素点绝对值取大的规则,这里要注意的是,比较的对象是两幅原始图像的像素点的绝对值,而融合后图像的像素点的取值是两幅原始图像像素点绝对值大的那一点的值,也就是说,要取绝对值大的那个点的实际值。

故相应的Matlab 程序为:% I1,I2 为两幅原始图像y1=mywavedec2(I1,dim);y2=mywavedec2(I2,dim);[r,c]=size(y1); % 根据低频融合算法进行图像融合for i=1:r % 首先取两幅源图像相应的小波分解系数绝对值最大者的值作为融合图像的分解系数for j=1:cif ( abs(y1(i,j)) >= abs(y2(i,j)) )y3(i,j)=y1(i,j);elseif ( abs(y1(i,j)) < abs(y2(i,j)) )y3(i,j)=y2(i,j);end% y3(i,j)=max( abs(y1(i,j)) , abs(y2(i,j)) ); % 这行代码是错误的,取了绝对值而非实际值endend(2)低频融合的对象低频融合的对象是N级分解后图像的LL-N子图像,相应的程序代码为:LLa=y1(1:r/(2^dim),1:c/(2^dim)); % 调用lowfrefus函数对低频部分的小波分解系数进行融合LLb=y2(1:r/(2^dim),1:c/(2^dim));y3(1:r/(2^dim),1:c/(2^dim))=lowfrefus(LLa,LLb);(3)低频融合策略的程序代码这一部分程序代码的实现难度不大,根据算法原理中列出的公式可以很快写出相应的代码。

不过有些细节问题还是要花心思处理,比如区域大小的确定、区域边界与图像边界的关系、区域中心与区域中各点的权值确定、区域中心在原始图像中的具体位置等等。

function y = lowfrefus(A,B);% 函数 Y=LOWFREFUS(A,B) 对输入的两个小波分解系数矩阵,根据低频融合算法,得出融合图像的低频小波分解系数[row,col]=size(A); % 求出分解系数矩阵的行列数alpha=0.5; % alpha是方差匹配度比较的阈值for i=1:row % 根据低频融合算法,先求出矩阵A,B中以点P为中心的区域方差和方差匹配度for j=1:col % 再根据方差匹配度与阈值的比较确定融合图像的小波分解系数[m2p(i,j),Ga(i,j),Gb(i,j)] = area_var_match(A,B,[i,j]);Wmin=0.5-0.5*((1-m2p(i,j))/(1-alpha));Wmax=1-Wmin;if m2p(i,j)<alpha % m2p表示方差匹配度if Ga(i,j)>=Gb(i,j) % 若匹配度小于阈值,则取区域方差大的相应点的分解系数作为融合图像的分解系数y(i,j)=A(i,j);elsey(i,j)=B(i,j);endelse % 若匹配度大于阈值,则采取加权平均方法得出相应的分解系数if Ga(i,j)>=Gb(i,j)y(i,j)=Wmax*A(i,j)+Wmin*B(i,j);elsey(i,j)=Wmin*A(i,j)+Wmax*B(i,j);endendendendfunction w = weivec(x,p);% 函数 W=WEIVEC(X,P) 对输入的r*c矩阵,计算出以点p为中心时矩阵各点的对应权值% 距离点p越近,权值就越大。

权值是通过行和列的高斯分布加权相加得到的。

[r,c]=size(x);p1=p(1); p2=p(2);sig=1;for i=1:rfor j=1:cw(i,j)=0.5*(gaussmf(i,[sig p1])+gaussmf(j,[sig p2]));endendfunction [m2p,Ga,Gb] = area_var_match(A,B,p);% 函数 area_var_match 计算两个输入矩阵以点p为中心的区域方差以及区域方差匹配度level=1; % 设置区域的大小[subA,mpa,npa]=submat(A,p,level); % submat 函数取输入矩阵中以点P为中心、阶数为(2*level+1)的方阵作为子矩阵[subB,mpb,npb]=submat(B,p,level);[r,c]=size(subA);w=weivec(subA,[mpanpa]); % 获取子矩阵的权值分布averA=sum(sum(subA))/(r*c); % 计算子矩阵的平均值averB=sum(sum(subB))/(r*c);Ga=sum(sum(w.*(subA-averA).^2)); % 计算子矩阵的区域方差Gb=sum(sum(w.*(subB-averB).^2));if (Ga==0)&(Gb==0) % 计算两个子矩阵的区域方差匹配度m2p=0;elsem2p=2*sum(sum(w.*abs(subA-averA).*abs(subB-averB)))/(Ga+Gb);endfunction [smat,mp,np] = submat(x,p,level);% 函数 submat 取输入矩阵中以点P为中心、阶数为(2*level+1)的方阵作为输出的子矩阵[row,col]=size(x);m=p(1); n=p(2);if (m>row)||(n>col)error('Point p is out of matrix X !');return;endif ((2*level+1)>row)||((2*level+1)>col)error('Too large sample area level !');return;end% 设置子矩阵的边界值up=m-level; down=m+level;left=n-level; right=n+level;% 若子矩阵的某一边界值超出输入矩阵的相应边界,就进行边界处理,% 即超出边界后往相反方向平移,使其恰好与边界重合if left<1right=right+1-left;left=1;endif right>colleft=left+col-right;right=col;endif up<1down=down+1-up;up=1;endif down>rowup=up+row-down;down=row;end% 获取作为输出的子矩阵,并计算点p在输出的子矩阵中的位置smat = x(up:down,left:right);mp=m-up+1;np=n-left+1;下面我们给出相应的图片示例,图1 是一幅远景清晰近景模糊的图片,图2 是一幅远景模糊近景清晰的图片,图3是融合效果图。