Numerical-Estimation-Test2

机器学习设计知识测试 选择题 53题

1. 在机器学习中,监督学习的主要目标是:A) 从无标签数据中学习B) 从有标签数据中学习C) 优化模型的复杂度D) 减少计算资源的使用2. 下列哪种算法属于无监督学习?A) 线性回归B) 决策树C) 聚类分析D) 支持向量机3. 在机器学习模型评估中,交叉验证的主要目的是:A) 增加模型复杂度B) 减少数据集大小C) 评估模型的泛化能力D) 提高训练速度4. 下列哪项不是特征选择的方法?A) 主成分分析(PCA)B) 递归特征消除(RFE)C) 网格搜索(Grid Search)D) 方差阈值(Variance Threshold)5. 在深度学习中,卷积神经网络(CNN)主要用于:A) 文本分析B) 图像识别C) 声音处理D) 推荐系统6. 下列哪种激活函数在神经网络中最为常用?A) 线性激活函数B) 阶跃激活函数C) ReLUD) 双曲正切函数7. 在机器学习中,过拟合通常是由于以下哪种情况引起的?A) 模型过于简单B) 数据量过大C) 模型过于复杂D) 数据预处理不当8. 下列哪项技术用于处理类别不平衡问题?A) 数据增强B) 重采样C) 特征选择D) 模型集成9. 在自然语言处理(NLP)中,词嵌入的主要目的是:A) 提高计算效率B) 减少词汇量C) 捕捉词之间的语义关系D) 增加文本长度10. 下列哪种算法不属于集成学习方法?A) 随机森林B) AdaBoostC) 梯度提升机(GBM)D) 逻辑回归11. 在机器学习中,ROC曲线用于评估:A) 模型的准确性B) 模型的复杂度C) 模型的泛化能力D) 分类模型的性能12. 下列哪项不是数据预处理的步骤?A) 缺失值处理B) 特征缩放C) 模型训练D) 数据标准化13. 在机器学习中,L1正则化主要用于:A) 减少模型复杂度B) 增加特征数量C) 特征选择D) 提高模型精度14. 下列哪种方法可以用于处理时间序列数据?A) 主成分分析(PCA)B) 线性回归C) ARIMA模型D) 决策树15. 在机器学习中,Bagging和Boosting的主要区别在于:A) 数据处理方式B) 模型复杂度C) 样本使用方式D) 特征选择方法16. 下列哪种算法适用于推荐系统?A) K-均值聚类B) 协同过滤C) 逻辑回归D) 随机森林17. 在机器学习中,A/B测试主要用于:A) 模型选择B) 特征工程C) 模型评估D) 用户体验优化18. 下列哪种方法可以用于处理缺失数据?A) 删除含有缺失值的样本B) 使用均值填充C) 使用中位数填充D) 以上都是19. 在机器学习中,偏差-方差权衡主要关注:A) 模型的复杂度B) 数据集的大小C) 模型的泛化能力D) 特征的数量20. 下列哪种算法属于强化学习?A) Q-学习B) 线性回归C) 决策树D) 支持向量机21. 在机器学习中,特征工程的主要目的是:A) 减少数据量B) 增加模型复杂度C) 提高模型性能D) 简化数据处理22. 下列哪种方法可以用于处理多分类问题?A) 一对多(One-vs-All)B) 一对一(One-vs-One)C) 层次聚类D) 以上都是23. 在机器学习中,交叉熵损失函数主要用于:A) 回归问题B) 分类问题C) 聚类问题D) 强化学习24. 下列哪种算法不属于深度学习?A) 卷积神经网络(CNN)B) 循环神经网络(RNN)C) 随机森林D) 长短期记忆网络(LSTM)25. 在机器学习中,梯度下降算法的主要目的是:A) 减少特征数量B) 优化模型参数C) 增加数据量D) 提高计算速度26. 下列哪种方法可以用于处理文本数据?A) 词袋模型(Bag of Words)B) TF-IDFC) 词嵌入D) 以上都是27. 在机器学习中,正则化的主要目的是:A) 减少特征数量B) 防止过拟合C) 增加数据量D) 提高计算速度28. 下列哪种算法适用于异常检测?A) 线性回归B) 决策树C) 支持向量机D) 孤立森林(Isolation Forest)29. 在机器学习中,集成学习的主要目的是:A) 提高单个模型的性能B) 结合多个模型的优势C) 减少数据量D) 增加模型复杂度30. 下列哪种方法可以用于处理高维数据?A) 主成分分析(PCA)B) 特征选择C) 特征提取D) 以上都是31. 在机器学习中,K-均值聚类的主要目的是:A) 分类B) 回归C) 聚类D) 预测32. 下列哪种算法适用于时间序列预测?A) 线性回归B) ARIMA模型C) 决策树D) 支持向量机33. 在机器学习中,网格搜索(Grid Search)主要用于:A) 特征选择B) 模型选择C) 数据预处理D) 模型评估34. 下列哪种方法可以用于处理类别特征?A) 独热编码(One-Hot Encoding)B) 标签编码(Label Encoding)C) 特征哈希(Feature Hashing)D) 以上都是35. 在机器学习中,AUC-ROC曲线的主要用途是:A) 评估分类模型的性能B) 评估回归模型的性能C) 评估聚类模型的性能D) 评估强化学习模型的性能36. 下列哪种算法不属于监督学习?A) 线性回归B) 决策树C) 聚类分析D) 支持向量机37. 在机器学习中,特征缩放的主要目的是:A) 减少特征数量B) 提高模型性能C) 增加数据量D) 简化数据处理38. 下列哪种方法可以用于处理文本分类问题?A) 词袋模型(Bag of Words)B) TF-IDFC) 词嵌入D) 以上都是39. 在机器学习中,决策树的主要优点是:A) 易于理解和解释B) 计算效率高C) 对缺失值不敏感D) 以上都是40. 下列哪种算法适用于图像分割?A) 卷积神经网络(CNN)B) 循环神经网络(RNN)C) 随机森林D) 支持向量机41. 在机器学习中,L2正则化主要用于:A) 减少模型复杂度B) 增加特征数量C) 特征选择D) 提高模型精度42. 下列哪种方法可以用于处理时间序列数据的季节性?A) 移动平均B) 季节分解C) 差分D) 以上都是43. 在机器学习中,Bagging的主要目的是:A) 减少模型的方差B) 减少模型的偏差C) 增加数据量D) 提高计算速度44. 下列哪种算法适用于序列数据处理?A) 卷积神经网络(CNN)B) 循环神经网络(RNN)C) 随机森林D) 支持向量机45. 在机器学习中,AdaBoost的主要目的是:A) 减少模型的方差B) 减少模型的偏差C) 增加数据量D) 提高计算速度46. 下列哪种方法可以用于处理文本数据的情感分析?A) 词袋模型(Bag of Words)B) TF-IDFC) 词嵌入D) 以上都是47. 在机器学习中,支持向量机(SVM)的主要优点是:A) 适用于高维数据B) 计算效率高C) 对缺失值不敏感D) 以上都是48. 下列哪种算法适用于推荐系统中的用户行为分析?A) 协同过滤B) 内容过滤C) 混合过滤D) 以上都是49. 在机器学习中,交叉验证的主要类型包括:A) K-折交叉验证B) 留一法交叉验证C) 随机划分交叉验证D) 以上都是50. 下列哪种方法可以用于处理图像数据?A) 卷积神经网络(CNN)B) 循环神经网络(RNN)C) 随机森林D) 支持向量机51. 在机器学习中,梯度提升机(GBM)的主要优点是:A) 适用于高维数据B) 计算效率高C) 对缺失值不敏感D) 以上都是52. 下列哪种算法适用于异常检测中的离群点检测?A) 线性回归B) 决策树C) 支持向量机D) 孤立森林(Isolation Forest)53. 在机器学习中,特征提取的主要目的是:A) 减少特征数量B) 提高模型性能C) 增加数据量D) 简化数据处理答案:1. B2. C3. C4. C5. B6. C7. C8. B9. C10. D11. D12. C13. C14. C15. C16. B17. D18. D19. C20. A21. C22. D23. B24. C25. B26. D27. B28. D29. B30. D31. C32. B33. B34. D35. A36. C37. B38. D39. D40. A41. A42. D43. A44. B45. B46. D47. A48. D49. D50. A51. D52. D53. B。

机器学习考试题目及答案

机器学习考试题目答案1.简描述机器学习概念?TomMitCheI1:"对于某类任务T和性能度量P,如果一个计算机程序在T上以P衡量的性能随着经验E而自我完善,那么我们称这个计算机程序在从经验E学习J 我们遇到的大部分事情一般包括分类问题与回归问题。

如房价的预测,股价的预测等属于分类问题。

一般的处理过程是:首先,1)获取数据;2)提取最能体现数据的特征;3)利用算法建模;4)将建立的模型用于预测。

如人脸识别系统,首先我们获取到一堆人脸照片,首先,对数据进行预处理,然后提取人脸特征,最后用算法如SVM或者NN等。

这样,我们就建立了一个人脸识别系统,当输入一张人脸,我们就知道这张面孔是否在系统中。

这就是机器学习的整个流程,其次还包括寻找最优参数等。

机器学习主要分为:监督学习:数据集是有标签的,大部分机器学习模型都属于这一类别,包括线性分类器、支持向量机等等;无监督学习:跟监督学习相反,数据集是完全没有标签的,主要的依据是相似的样本在数据空间中一般距离是相近的,这样就能通过距离的计算把样本分类,这样就完全不需要IabeI,比如著名的kmeans算法就是无监督学习应用最广泛的算法;半监督学习:半监督学习一般针对的问题是数据量超级大但是有标签数据很少或者说标签数据的获取很难很贵的情况,训练的时候有一部分是有标签的而有一部分是没有的;强化学习:一直激励学习的方式,通过激励函数来让模型不断根据遇到的情况做出调整;2.循环神经网络的基本原理?RNNS的目的是用来处理序列数据。

在传统的神经网络模型中,是从输入层到隐含层再到输出层,层与层之间是全连接的,每层之间的节点是无连接的。

但是这种普通的神经网络对于很多问题却无能无力。

例如,你要预测句子的下一个单词是什么,一般需要用到前面的单词,因为一个句子中前后单词并不是独立的。

RNNS之所以称为循环神经网路,即一个序列当前的输出与前面的输出也有关。

具体的表现形式为网络会对前面的信息进行记忆并应用于当前输出的计算中,即隐藏层之间的节点不再无连接而是有连接的,并且隐藏层的输入不仅包括输入层的输出还包括上一时刻隐藏层的输出。

计量经济学复习题(3)教学文稿

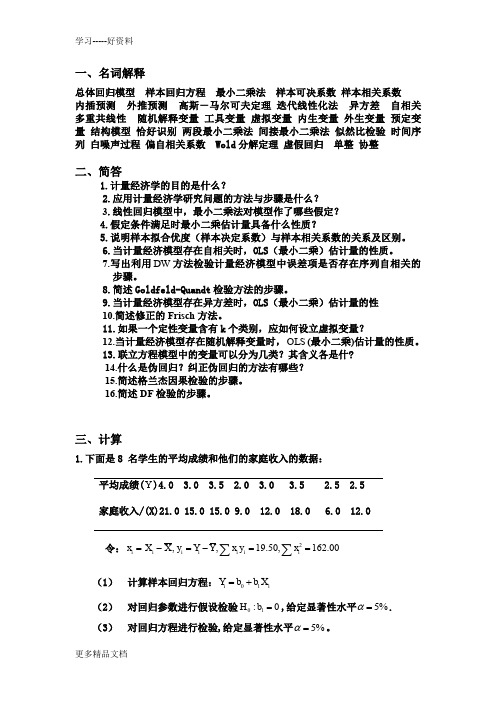

一、名词解释总体回归模型 样本回归方程 最小二乘法 样本可决系数 样本相关系数 内插预测 外推预测 高斯-马尔可夫定理 迭代线性化法 异方差 自相关 多重共线性 随机解释变量 工具变量 虚拟变量 内生变量 外生变量 预定变量 结构模型 恰好识别 两段最小二乘法 间接最小二乘法 似然比检验 时间序列 白噪声过程 偏自相关系数 Wold 分解定理 虚假回归 单整 协整二、简答1.计量经济学的目的是什么?2.应用计量经济学研究问题的方法与步骤是什么?3.线性回归模型中,最小二乘法对模型作了哪些假定?4.假定条件满足时最小二乘估计量具备什么性质?5.说明样本拟合优度(样本决定系数)与样本相关系数的关系及区别。

6.当计量经济模型存在自相关时,OLS (最小二乘)估计量的性质。

7.写出利用DW 方法检验计量经济模型中误差项是否存在序列自相关的步骤。

8.简述Goldfeld-Quandt 检验方法的步骤。

9.当计量经济模型存在异方差时,OLS (最小二乘)估计量的性10.简述修正的Frisch 方法。

11.如果一个定性变量含有k 个类别,应如何设立虚拟变量?12.当计量经济模型存在随机解释变量时,OLS (最小二乘)估计量的性质。

13.联立方程模型中的变量可以分为几类?其含义各是什?14.什么是伪回归?纠正伪回归的方法有哪些?15.简述格兰杰因果检验的步骤。

16.简述DF 检验的步骤。

三、计算1.下面是8 名学生的平均成绩和他们的家庭收入的数据:平均成绩(Y )4.0 3.0 3.5 2.0 3.0 3.5 2.5 2.5家庭收入/(X)21.0 15.0 15.0 9.0 12.0 18.0 6.0 12.0 令:2,,19.50,162.00i i i i i i i x X X y Y Y x y x =-=-==∑∑(1) 计算样本回归方程:01i i Y b b X =+(2) 对回归参数进行假设检验01:0H b =,给定显著性水平5%α=.(3) 对回归方程进行检验,给定显著性水平5%α=。

CFA考试二级最详细笔记

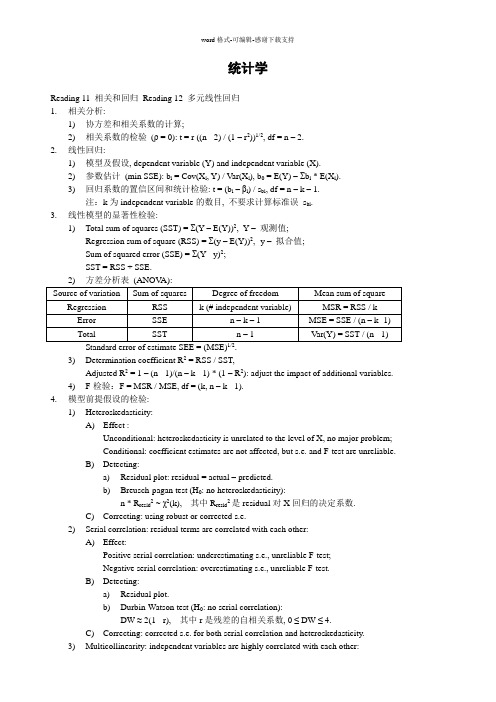

统计学Reading 11 相关和回归Reading 12 多元线性回归1. 相关分析:1) 协方差和相关系数的计算;2) 相关系数的检验(ρ = 0): t = r ((n - 2) / (1 – r2))1/2, df = n – 2.2. 线性回归:1) 模型及假设, dependent variable (Y) and independent variable (X).2) 参数估计(min SSE): b i = Cov(X i, Y) / Var(X i), b0 = E(Y) –Σb i * E(X i).3) 回归系数的置信区间和统计检验: t = (b i–βi) / s bi, df = n – k – 1.注:k为independent variable的数目, 不要求计算标准误s bi.3. 线性模型的显著性检验:1) Total sum of squares (SST) = Σ(Y – E(Y))2, Y –观测值;Regression sum of square (RSS) = Σ(y – E(Y))2, y –拟合值;Sum of squared error (SSE) = Σ(Y - y)2;SST = RSS + SSE.Standard error of estimate SEE = (MSE).3) Determination coefficient R2 = RSS / SST,Adjusted R2 = 1 – (n - 1)/(n – k - 1) * (1 – R2): adjust the impact of additional variables.4) F-检验:F = MSR / MSE, df = (k, n – k - 1).4. 模型前提假设的检验:1) Heteroskedasticity:A) Effect :Unconditional: heteroskedasticity is unrelated to the level of X, no major problem;Conditional: coefficient estimates are not affected, but s.e. and F-test are unreliable.B) Detecting:a) Residual plot: residual = actual – predicted.b) Breusch-pagan test (H0: no heteroskedasticity):n * R resid2 ~ χ2(k), 其中R resid2是residual对X回归的决定系数.C) Correcting: using robust or corrected s.e.2) Serial correlation: residual terms are correlated with each other:A) Effect:Positive serial correlation: underestimating s.e., unreliable F-test;Negative serial correlation: overestimating s.e., unreliable F-test.B) Detecting:a) Residual plot.b) Durbin-Watson test (H0: no serial correlation):DW ≈ 2(1 - r), 其中r是残差的自相关系数, 0 ≤ DW ≤ 4.C) Correcting: corrected s.e. for both serial correlation and heteroskedasticity.3) Multicollinearity: independent variables are highly correlated with each other:A) Effect: individual variables are not significant (large s.e.) but their combination is.B) Detecting:a) None of individual coefficient is significant, but F-test is.b) Correlations between variables (> 0.7).注:两变量间的相关系数并未考虑变量线性组合的相关性,因此低相关系数并不一定意味着不存在multicollinearity.C) Correcting: omit correlated variables or take stepwise regression.4) Model misspecification: 不合适地选取解释变量(实际意义不对或不满足线性模型的前提假设)或不恰当的变量转换等.5. Dummy variable (0 – 1 variable):1) Independent dummy variable: linear regression is appropriate.注:n classes → (n - 1) dummy variable.2) Qualitative dependent variable (Y取0, 1): ordinary regression may not be appropriate, use logit regression model or discriminate model.Reading 13 时间序列分析1. Trend model:1) Linear: x t = b0 + b1t + εt;2) Log-linear: ln(x t) = b0 + b1t + εt, 常用于为增长率建模.2. Autoregressive model (AR):1) AR(p): x t = b0 + b1x t-1 + … + b p x t-p + εp, lag: 1, … , p.2) Covariance stationarity:a) Constant and finite E(X t): mean-reverting level for AR(1) E(X t) = b0 / (1 – b1).Random walks (unit root process): x t = b0 + x t-1 + εt不是平稳过程.b) Constant and finite Var(X t);c) Constant and finite Cov(X t, X t-k):对AR平稳序列, 自相关系数Cor(X t, X t-k) = ρk→ 0.3) Forecasting:a) In-sample (within the range of data) and out-sample forecasts.b) Short time series: more stable (no dramatic change);Long-time series: more reliable.c) Predicting power: root mean squared error (RMSE) on the out-sample data.3. AR模型的检验与修正:1) Nonstationarity:a) Detecting: Dickey-Fuller (DF) test or unit root test:For AR(1): x t– x t-1 = b0 + (b1 - 1)x t-1 + εt, H0: b1 = 1, t-test with modified s.e.b) Correcting - differencing:For random walks: 令y t = x t– x t-1, 有y t = b0 + εt.2) Serial correlation (residual terms should not exhibit serial correlation):a) Detecting:H0: Cor(εt, εt-k) = 0 for any lag k; t = Cor(εt, εt-k) / (1 / T) 1/2, df = T – p - 1.注: T – number of effective observations, T = n – p.一般线性回归中的DW检验不适用于AR模型。

面板数据分析与Stata应用_浙江大学中国大学mooc课后章节答案期末考试题库2023年

面板数据分析与Stata应用_浙江大学中国大学mooc课后章节答案期末考试题库2023年1.关于xtabond2这一命令的使用,以下说法错误的是:答案:iv( ) 内放置的是内生的解释变量2.关于门限面板模型的估计,以下说法错误的是:答案:使用 xthreg 命令确定门限值时,是将门限变量的所有值逐一代入进行计算的3.以下哪组数据是短面板数据?答案:N=31,T=214.以下哪个不是非观测效应模型(存在不可观测的个体效应的模型)?答案:混合回归模型5.以下哪个选项符合随机效应模型的设定?答案:不可观测的个体效应与所有解释变量不相关6.使用xtscc命令估计,得到的标准误是:答案:Driscoll-Kraay标准误7.使用聚类稳健的标准误,不能解决以下三大问题中的哪一个?答案:截面相关8.短面板数据模型中的husman检验适用于哪两种模型之间的选择判断?答案:固定效应模型与随机效应模型9.以下命令中,无需其他选项就能够同时处理组内误差自相关、组间异方差和组间相关这三大问题的命令是?答案:xtscc10.以下哪个命令能够检验长面板数据的组间相关问题?答案:xttest211.以下哪个命令没有同时处理三大问题?答案:xtpcse lnc lnp lnpmin lny state2-state10 t, corr(ar1) hetonly12.三阶段最小二乘法的命令是:答案:reg313.以下哪个命令没有同时处理三大问题?答案:xtgls lnc lnp lnpmin lny state2-state10 t,corr(ar1) panels(heteroskedastic) 14.对于解释变量与误差项存在相关性这一内生性问题,以下说法错误的是:答案:其余选项均不正确15.关于两阶段最小二乘法,以下说法错误的是:答案:其余选项均不正确16.以下不属于内生性的三大检验的是:答案:异方差检验17.如果在强相关性检验中,发现当前使用的工具变量是弱工具变量,那么以下说法错误的是:答案:此时不存在任何可以解决的方法,IV方法不再适用18.关于理解DID方法的方式,以下说法错误的是:答案:其余选项均不正确19.以下关于DID模型的设定,表示错误的是:答案:多组多期:20.以下方法中,不属于安慰剂检验的是:答案:可以按照样本的异质性特征,将样本分为不同的小组,在不同组内进行回归21.如果对照组和处理组不满足共同趋势的假定,以下解决方法中不正确的是:答案:不必在意,不满足共同趋势假设也可以继续使用DID方法22.关于合成控制法,以下说法错误的是:答案:合成控制法无法解决选择控制组时存在的主观随意性问题23.关于合成控制法中合成地区的构建,以下说法正确的是:答案:其余三个说法都正确24.下图是上课所举案例在 stata 中运用合成控制法的 synth 命令得到的部分结果:根据上述运行结果,以下说法错误的是:答案:由于预测变量的拟合效果均很好,cigsale(1975)、cigsale(1980)、cigsale(1988) 这三个变量可以省去25.我们可以通过如下目标函数来确定最优带宽:,以下说法错误的是:答案:三角核函数相当于普通 OLS 回归,矩形核函数相当于加权的 OLS 回归26.对动态面板模型使用固定效应方法进行估计时,估计结果一定是有偏且不一致的。

伍德里奇《计量经济学导论》复习笔记和课后习题详解-含有定性信息的多元回归分析:二值变量

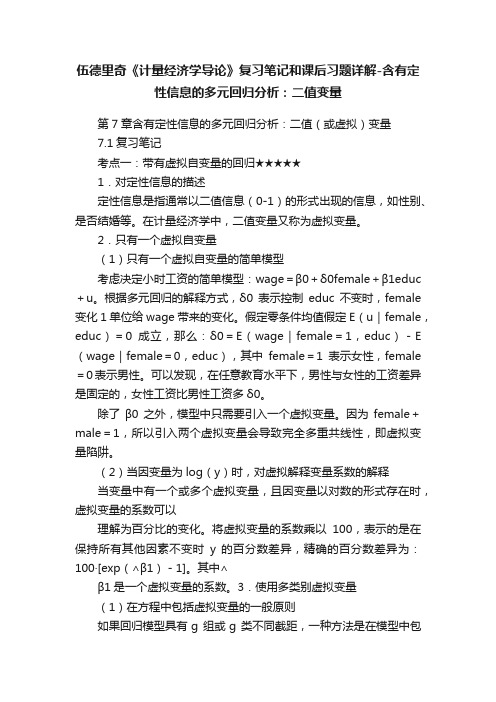

伍德里奇《计量经济学导论》复习笔记和课后习题详解-含有定性信息的多元回归分析:二值变量第7章含有定性信息的多元回归分析:二值(或虚拟)变量7.1复习笔记考点一:带有虚拟自变量的回归★★★★★1.对定性信息的描述定性信息是指通常以二值信息(0-1)的形式出现的信息,如性别、是否结婚等。

在计量经济学中,二值变量又称为虚拟变量。

2.只有一个虚拟自变量(1)只有一个虚拟自变量的简单模型考虑决定小时工资的简单模型:wage=β0+δ0female+β1educ +u。

根据多元回归的解释方式,δ0表示控制educ不变时,female 变化1单位给wage带来的变化。

假定零条件均值假定E(u|female,educ)=0成立,那么:δ0=E(wage|female=1,educ)-E (wage|female=0,educ),其中female=1表示女性,female =0表示男性。

可以发现,在任意教育水平下,男性与女性的工资差异是固定的,女性工资比男性工资多δ0。

除了β0之外,模型中只需要引入一个虚拟变量。

因为female+male=1,所以引入两个虚拟变量会导致完全多重共线性,即虚拟变量陷阱。

(2)当因变量为log(y)时,对虚拟解释变量系数的解释当变量中有一个或多个虚拟变量,且因变量以对数的形式存在时,虚拟变量的系数可以理解为百分比的变化。

将虚拟变量的系数乘以100,表示的是在保持所有其他因素不变时y 的百分数差异,精确的百分数差异为:100·[exp(∧β1)-1]。

其中∧β1是一个虚拟变量的系数。

3.使用多类别虚拟变量(1)在方程中包括虚拟变量的一般原则如果回归模型具有g 组或g 类不同截距,一种方法是在模型中包含g-1个虚拟变量和一个截距。

基组的截距是模型的总截距,某一组的虚拟变量系数表示该组与基组在截距上的估计差异。

如果在模型中引入g 个虚拟变量和一个截距,将会导致虚拟变量陷阱。

另一种方法是只包括g 个虚拟变量,而没有总截距。

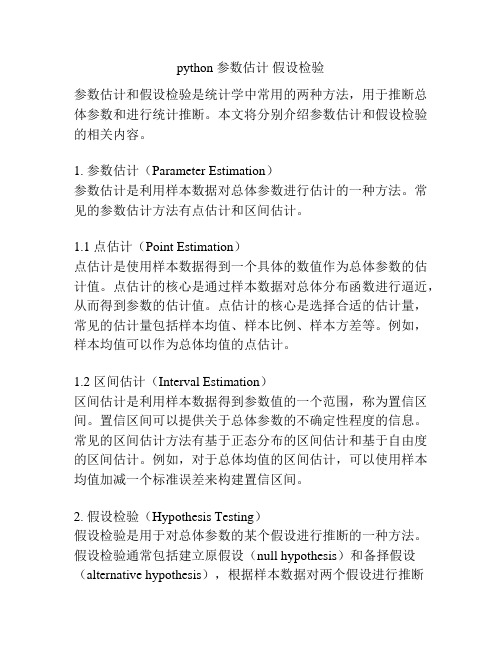

python 参数估计 假设检验

python 参数估计假设检验参数估计和假设检验是统计学中常用的两种方法,用于推断总体参数和进行统计推断。

本文将分别介绍参数估计和假设检验的相关内容。

1. 参数估计(Parameter Estimation)参数估计是利用样本数据对总体参数进行估计的一种方法。

常见的参数估计方法有点估计和区间估计。

1.1 点估计(Point Estimation)点估计是使用样本数据得到一个具体的数值作为总体参数的估计值。

点估计的核心是通过样本数据对总体分布函数进行逼近,从而得到参数的估计值。

点估计的核心是选择合适的估计量,常见的估计量包括样本均值、样本比例、样本方差等。

例如,样本均值可以作为总体均值的点估计。

1.2 区间估计(Interval Estimation)区间估计是利用样本数据得到参数值的一个范围,称为置信区间。

置信区间可以提供关于总体参数的不确定性程度的信息。

常见的区间估计方法有基于正态分布的区间估计和基于自由度的区间估计。

例如,对于总体均值的区间估计,可以使用样本均值加减一个标准误差来构建置信区间。

2. 假设检验(Hypothesis Testing)假设检验是用于对总体参数的某个假设进行推断的一种方法。

假设检验通常包括建立原假设(null hypothesis)和备择假设(alternative hypothesis),根据样本数据对两个假设进行推断并做出决策。

2.1 原假设(Null Hypothesis)原假设是关于总体参数的一个假设,通常表示没有发生某种变化或效应。

原假设是需要被推翻的假设,常用符号H0表示。

例如,对于总体均值的原假设可以是总体均值等于某个特定值。

2.2 备择假设(Alternative Hypothesis)备择假设是与原假设相对立的假设,通常表示发生了某种变化或效应。

备择假设是需要被验证的假设,常用符号H1或Ha表示。

例如,对于总体均值的备择假设可以是总体均值不等于某个特定值。

大样本怎么计算斯皮尔曼相关系数

大样本怎么计算斯皮尔曼相关系数

斯皮尔曼相关系数,也被称为Spearman秩相关系数,是一种非参数统计方法,用于衡量两个变量之间的相关性。

它并不假设数据来自特定的分布,也不假设变量之间的关系是线性的。

这使得它在处理非线性关系和非正态分布的数据时特别有用。

对于大样本数据,计算斯皮尔曼相关系数的步骤大致如下:

首先,需要将原始数据转换为秩次数据。

对于每一个变量,都将数据从小到大排序,并给每一个数据点分配一个秩次。

如果有相同的数据点,那么需要给它们分配平均秩次。

例如,如果有三个数据点都是5,那么它们的秩次应该是(3+4+5)/3=4。

然后,计算每一个数据点的秩次差。

这是通过从一个变量的秩次中减去另一个变量的秩次来完成的。

这些差值被平方并求和,以计算斯皮尔曼相关系数的分子。

接着,计算样本大小n,并从n中减去1得到n-1,这是计算斯皮尔曼相关系数的分母的一部分。

最后,使用这些值来计算斯皮尔曼相关系数。

公式为:1 - (6 * Σd^2) / (n * (n^2 - 1)),其中Σd^2是所有秩次差的平方和,n是样本大小。

然而,对于大样本数据,手动执行这些步骤可能会非常耗时且容易出错。

因此,通常使用统计软件或编程语言(如Python、R等)中的内置函数来计算斯皮尔曼相关系数。

这些函数已经过优化,可以处理大量数据,并提供准确的结果。

需要注意的是,虽然斯皮尔曼相关系数对于处理非线性关系和非正态分布的数据很有用,但它并不总是能提供关于变量之间关系的完整信息。

因此,在解释结果时,应结合其他统计方法和领域知识来进行。

李子奈《计量经济学》(第4版)配套题库-考研真题精选(圣才出品)

圣才电子书 十万种考研考证电子书、题库视频学习平台

模型无法估计的情况,这称为虚拟变量陷阱。

8.多重共线性[湖南大学 2016、2011 研] 答:多重共线性是在多元回归中可能存在的现象,如果在模型中某两个或多个解释变量 之间出现了相关性,则称为存在多重共线性,多重共线性分为完全共线与近似共线两类。当 某一个解释变量可以用其他解释变量的线性组合表示,称解释变量之间存在完全共线性,此 时模型参数无法进行估计。完全共线性的情况并不多见,一般出现的是在一定程度上的共线 性,即近似共线性。近似共线性可能使估计值的正负符号与客观实际不一致,且参数估计值 的标准误差变得很大,从而 t 值变得很小,参数的显著性下降,回归方程不稳定等,但模型 参数的估计仍是无偏、一致且有效的。 检验模型是否存在多重共线性的方法有:①若多个解释变量间的相关系数接近于±1, 则可认为模型存在多重共线性;②在普通最小二乘法下,模型的 R2 与 F 值较大,但各参数 估计的 t 检验值较小,此时解释变量之间往往存在多重共线性;③当方差膨胀因素 VIF 大于 10 时,模型也可能存在较严重的多重共线性。如果存在多重共线性,需进一步确定判明存 在多重共线性的范围,可以用判定系数检验法、逐步回归法等方法进行判定。 多重共线性问题的处理方法主要有增加样本容量、精简变量法、逐步回归判别法、主成 分回归法等。

2.拟合优度[湘潭大学 2013 研] 答:拟合优度是模型对样本观测值的拟合程度。一般用来自回归线的回归平方 ESS 和 占观测值 Y 的总离差平方和 TSS 的比例来判断样本回归线与样本观测值的拟合优度,在总 离差平方和中,回归平方和所占的比重越大,残差平方和所占的比重越小,回归直线与样本 点拟合得越好。

3.显著性水平[湘潭大学 2013 研] 答:显著性水平通常用α表示,是一个临界概率值。它表示在假设检验中,用样本推断 总体时,当原假设正确时却被拒绝的可能性大小,也即在假设检验中犯“弃真”错误的概率。

统计机器学习考试试题及答案

统计机器学习考试试题及答案一、选择题1. 机器学习的目标是什么?A. 实现人工智能的超级智能B. 通过数据构建模型并进行预测和决策C. 改善计算机硬件性能D. 消除人工智能的存在答案:B2. 以下哪个不是监督学习的特点?A. 数据集中包含标签或类别信息B. 可以通过已有数据训练模型进行预测C. 适用于分类和回归问题D. 不需要通过数据训练,直接进行预测答案:D3. 以下哪个算法通常用于聚类问题?A. 决策树B. 支持向量机C. K-meansD. 随机森林答案:C4. 以下哪个是特征工程的主要任务?A. 数据清洗和预处理B. 模型训练和优化C. 模型评估和选择D. 模型部署和应用答案:A5. 以下哪个算法不适用于异常检测问题?A. 密度估计B. 协同过滤C. 孤立森林D. One-Class SVM答案:B二、简答题1. 请简要解释监督学习和非监督学习的区别。

监督学习是指通过已有的标签或类别信息,通过训练一个模型来预测新的未知数据的标签或类别。

而非监督学习则是没有标签或类别信息,通过数据之间的相似性进行聚类分析或异常检测等任务。

2. 请简述决策树模型的工作原理。

决策树模型通过将数据集分割成不同的节点和分支,每个节点代表一个特征并且选择一个划分规则,以便将数据以最佳方式分割。

决策树的每个叶节点代表一个类别或标签,通过沿着树的分支进行特征判断最终得出预测结果。

3. 请列举至少三个常用的模型评估指标,并简要解释其含义。

- 准确率:正确预测的样本数与总样本数之比,衡量模型的整体预测准确性。

- 精确率:在所有预测为正例的样本中,实际为正例的比例,衡量模型预测为正例的准确性。

- 召回率:在所有实际为正例的样本中,被预测为正例的比例,衡量模型对正例的覆盖程度。

三、大题1. 请以决策树模型为例,分析其优缺点及适用场景。

决策树模型的优点包括:容易理解和解释,可以处理各种数据类型,对缺失值和异常值具有鲁棒性,可以处理大规模数据集。

泰尔森估算法 稳健非参数统计方法

泰尔森估算法稳健非参数统计方法泰尔森估算是通过选择通过成对点的所有线的斜率的中值来稳健地将线拟合到平面中的采样点(简单线性回归)的方法。

它也被称为Sen的斜率估计,斜率选择,单中值方法,Kendall鲁棒线拟合方法,和Kendall-Theil鲁棒线。

泰尔森估算(英文:Theil–Sen estimator)是通过选择通过成对点的所有线的斜率的中值来稳健地将线拟合到平面中的采样点(简单线性回归)的方法。

它也被称为Sen 的斜率估计,斜率选择,单中值方法,Kendall 鲁棒线拟合方法,和Kendall-Theil 鲁棒线。

它以Henri Theil 和Pranab K. Sen 命名,他们分别在1950 年和1968 年以及Maurice Kendall 之后发表了关于这种方法的论文。

该估计器可以有效地计算,并且对异常值不敏感。

对于偏斜和异方差数据,它可以比非鲁棒简单线性回归明显更准确,并且就统计功效而言,即使对于正态分布的数据也能很好地与非鲁棒最小二乘法竞争。

它被称为“用于估计线性趋势的最流行的非参数技术”。

根据Theil(1950)的定义,一组二维点的Theil-Sen 估计量是由所有样本对确定的斜率的中值m。

点。

Sen(1968)扩展了这个定义来处理两个数据点具有相同x 坐标的情况。

在Sen 的定义中,人们只采用仅具有不同x 坐标的点对定义的斜率的中值。

一旦确定了斜率m,就可以通过将y 截距b 设置为值yi-mxi 的中值来确定来自采样点的线。

正如Sen 观察到的那样,这个估计量是使得Kendall tau 秩相关系数比较xi 的值与第i 次观测的残差的值近似为零。

斜率估计的置信区间可以被确定为包含由点对确定的线的中间95%的斜率的区间,并且可以通过采样点对并且确定采样的95%间隔来快速估计。

连续下坡。

根据模拟,大约600 个样本对足以确定准确的置信区间。

Theil-Sen 估计量的变化,Siegel(1982)的重复中值回归,确定每个样本点,通过斜率的中间mi那一点,然后将整体估计量确定为这些中位数的中位数。

机器学习复习题及答案

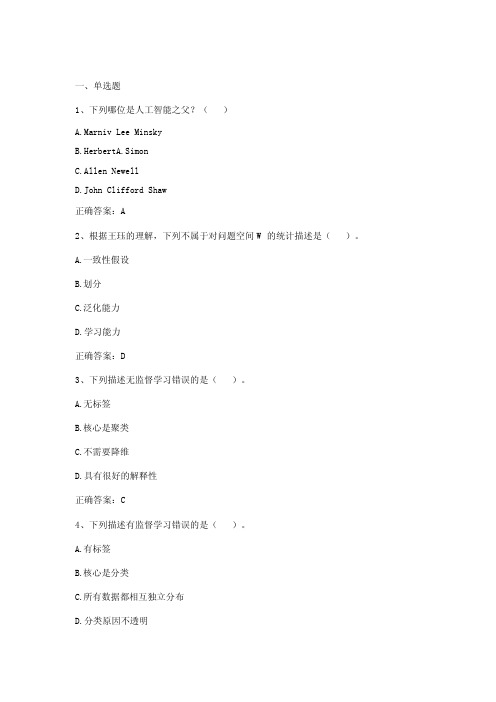

一、单选题1、下列哪位是人工智能之父?( )A.Marniv Lee MinskyB.HerbertA.SimonC.Allen NewellD.John Clifford Shaw正确答案:A2、根据王珏的理解,下列不属于对问题空间W的统计描述是( )。

A.一致性假设B.划分C.泛化能力D.学习能力正确答案:D3、下列描述无监督学习错误的是( )。

A.无标签B.核心是聚类C.不需要降维D.具有很好的解释性正确答案:C4、下列描述有监督学习错误的是( )。

A.有标签B.核心是分类C.所有数据都相互独立分布D.分类原因不透明正确答案:C5、下列哪种归纳学习采用符号表示方式?( )A. 经验归纳学习B.遗传算法C.联接学习D.强化学习正确答案:A6、混淆矩阵的假正是指( )。

A.模型预测为正的正样本B.模型预测为正的负样本C.模型预测为负的正样本D.模型预测为负的负样本正确答案:B7、混淆矩阵的真负率公式是为( )。

A.TP/(TP+FN)B.FP/(FP+TN)C.FN/(TP+FN)D.TN/(TN+FP)正确答案:D8、混淆矩阵中的TP=16,FP=12,FN=8,TN=4,准确率是( )。

A.1/4B.1/2C.4/7D.4/6正确答案:B9、混淆矩阵中的TP=16,FP=12,FN=8,TN=4,精确率是( )。

A.1/4B.1/2C.4/7D.2/3正确答案:C10、混淆矩阵中的TP=16,FP=12,FN=8,TN=4,召回率是( )。

A.1/4B.1/2C.4/7D.2/3正确答案:D11、混淆矩阵中的TP=16,FP=12,FN=8,TN=4,F1-score是( )。

A.4/13B.8/13C.4/7D.2/30.00/2.00正确答案:B12、EM算法的E和M指什么?( )A.Expectation-MaximumB.Expect-MaximumC.Extra-MaximumD.Extra-Max正确答案:A13、EM算法的核心思想是?( )A.通过不断地求取目标函数的下界的最优值,从而实现最优化的目标。

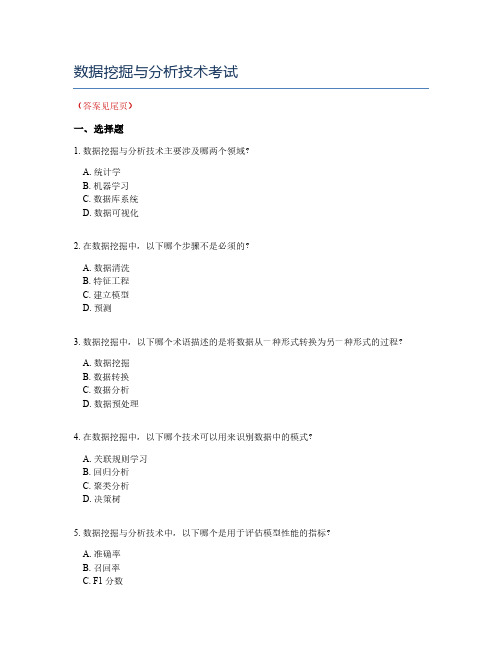

数据挖掘与分析技术考试

数据挖掘与分析技术考试(答案见尾页)一、选择题1. 数据挖掘与分析技术主要涉及哪两个领域?A. 统计学B. 机器学习C. 数据库系统D. 数据可视化2. 在数据挖掘中,以下哪个步骤不是必须的?A. 数据清洗B. 特征工程C. 建立模型D. 预测3. 数据挖掘中,以下哪个术语描述的是将数据从一种形式转换为另一种形式的过程?A. 数据挖掘B. 数据转换C. 数据分析D. 数据预处理4. 在数据挖掘中,以下哪个技术可以用来识别数据中的模式?A. 关联规则学习B. 回归分析C. 聚类分析D. 决策树5. 数据挖掘与分析技术中,以下哪个是用于评估模型性能的指标?A. 准确率B. 召回率C. F1 分数D. 均方误差6. 在数据挖掘中,以下哪个技术可以用来预测未来的趋势?A. 时间序列分析B. 逻辑回归C. 支持向量机D. 神经网络7. 数据挖掘中,以下哪个步骤通常在模型的训练阶段进行?A. 数据收集B. 数据清洗C. 模型训练D. 模型评估8. 在数据挖掘中,以下哪个技术可以用来发现数据中的异常值?A. 聚类分析B. 神经网络C. 异常检测D. 自然语言处理9. 数据挖掘与分析技术中,以下哪个是用于描述数据集中各数值之间关系的方法?A. 统计描述B. 数据可视化C. 聚类分析D. 关联规则学习10. 在数据挖掘中,以下哪个技术可以用来评估数据集的密度和复杂度?A. 分形维数B. 熵C. 置换-扩散算法D. k-均值聚类11. 数据挖掘与分析技术主要涉及哪几个方面?B. 机器学习C. 深度学习D. 数据库管理12. 在数据挖掘中,以下哪个算法常用于分类和预测?A. K-均值算法B. 决策树算法C. 聚类算法D. 神经网络算法13. 数据挖掘中,用于发现数据项之间有趣关系的方法有哪几种?A. 关联规则挖掘B. 分类和预测C. 文本挖掘D. 回归分析14. 在数据挖掘中,以下哪个工具常用于数据清洗和预处理?A. ExcelB. SQLC. PythonD. R语言15. 数据挖掘与分析技术中,哪一项是用于评估模型性能的方法?A. 交叉验证B. K-折叠交叉验证C.留一法D. 自助法16. 在数据挖掘中,以下哪个技术常用于处理大规模数据集?A. 分布式计算B. 缓存技术C. 索引技术17. 数据挖掘与分析技术中,哪一项是用于描述数据集中模式和趋势的方法?A. 聚类分析B. 回归分析C. 时间序列分析D. 神经网络18. 在数据挖掘中,以下哪个步骤通常不是数据挖掘流程的第一步?A. 数据收集B. 数据清洗C. 数据转换D. 数据挖掘19. 数据挖掘与分析技术中,哪一项是用于预测未来事件的方法?A. 预测建模B. 分类C. 聚类D. 关联规则挖掘20. 在数据挖掘中,以下哪个技术常用于从大量数据中提取知识?A. 数据可视化B. 数据挖掘C. 数据分析D. 数据仓库21. 数据挖掘中常用的聚类算法有哪些?A. K-meansB. DBSCANC.层次聚类D. GMM(高斯混合模型)22. 以下哪个技术可以用来评估数据集的内在质量?B. 数据转换C. 数据验证D. 数据可视化23. 关联规则挖掘中,什么指标用于衡量规则的实用性?A. 置信度B. 支持度C. 强关联规则D. 假设检验24. 在数据挖掘中,什么是分类和预测?A. 分类是将数据划分为不同的组或类别B. 预测是根据历史数据进行趋势分析C. 分类是将数据划分为不同的组或类别D. 预测是根据历史数据进行趋势分析25. 数据挖掘中,什么技术可以用来发现数据中的异常值?A. 数据清理B. 数据转换C. 数据验证D. 数据可视化26. 以下哪个是决策树的构建方法?A. 连续属性分割B. 基于信息增益C. 基于最小描述长度D. 基于贝叶斯分类器27. 数据挖掘中,什么技术可以用来识别数据集中的模式?A. 数据清理B. 数据转换C. 数据验证28. 以下哪个技术可以用来评估模型的预测能力?A. 模型训练B. 模型评估C. 模型测试D. 模型优化29. 在关联规则挖掘中,什么指标用于衡量规则的普遍性?A. 置信度B. 支持度C. 强关联规则D. 假设检验30. 数据挖掘中,什么技术可以用来预测未来的趋势?A. 时间序列分析B. 回归分析C. 聚类分析D. 决策树31. 在数据挖掘中,以下哪个步骤不是必然发生的?A. 数据预处理B. 特征工程C. 建立模型D. 模型评估32. 以下哪个算法不是监督学习算法?A. 决策树B. 支持向量机C. 随机森林D. 神经网络33. 数据挖掘中,用于描述数据集的分布情况的统计量有哪些?A. 均值B. 中位数C. 标准差D. 四分位距34. 在数据挖掘中,以下哪个选项不是数据预处理的一部分?A. 数据清洗B. 数据转换C. 数据集成D. 数据压缩35. 在进行数据挖掘时,以下哪个因素可能影响挖掘效果?A. 数据质量B. 算法选择C. 业务理解D. 计算资源36. 数据挖掘中,以下哪个术语用来描述从大量数据中抽取出有意义的信息的过程?A. 数据挖掘B. 数据分析C. 数据可视化D. 数据建模37. 在数据挖掘中,以下哪个技术可以用来评估模型的性能?A. 交叉验证B. 超参数调整C. 误差计算D. 特征选择38. 在数据挖掘项目中,以下哪个角色通常负责监控项目的进度和资源?A. 项目经理B. 数据分析师C. 数据工程师D. 商业分析师39. 在数据挖掘中,以下哪个步骤属于数据挖掘的后续阶段?A. 数据收集B. 数据清洗C. 模型评估D. 结果解释40. 数据挖掘的目的是什么?A. 了解客户需求B. 预测未来趋势C. 提高决策效率D. 优化产品性能41. 数据挖掘中使用最频繁的算法是?A. 决策树B. 支持向量机(SVM)C. 神经网络D. 关联规则学习42. 数据挖掘中,以下哪个步骤不属于数据预处理阶段?A. 数据清洗B. 数据转换C. 数据集成D. 数据划分43. 在数据挖掘中,用于描述和评估模型预测能力的是?A. 精确率B. 召回率C. F1分数D. AUC-ROC曲线44. 以下哪个选项不属于数据挖掘中的特征工程?A. 特征选择B. 特征转换C. 特征规范化D. 特征降维45. 在数据挖掘中,以下哪个技术用于发现数据中的关联关系?A. 分类B. 聚类C. 关联规则学习D. 回归46. 数据挖掘中,用于评估模型对未知数据的预测能力的是?A. 置信区间B. 交叉验证C. 模型泛化能力D. AUC-ROC曲线47. 在数据挖掘中,以下哪个步骤属于数据挖掘的结果评估阶段?A. 数据清洗B. 模型训练C. 模型评估D. 模型部署48. 数据挖掘中,以下哪个技术可以用来评估数据集的内在质量?A. 数据可视化B. 数据质量指标计算C. 数据分布分析D. 数据相关性分析49. 在数据挖掘中,以下哪个技术可以用来预测未来的趋势和行为?A. 时间序列分析B. 回归分析C. 文本挖掘D. 机器学习二、问答题1. 什么是数据挖掘?请简要介绍数据挖掘的基本过程。

ma2模型预测未来的置信区间计算题

ma2模型预测未来的置信区间计算题

在 Ma2 模型中,可以使用置信区间来计算预测的未来值的可信度。

置信区间是指由样本统计量所构造的总体参数的估计区间,它展现了这个参数的真实值有一定概率落在测量结果的周围的程度。

置信水平是置信区间的可信度,通常使用百分比表示,例如 95%。

假设我们使用 Ma2 模型对未来的销售额进行预测。

我们可以使用以下步骤来计算置信区间:

1. 计算样本平均值和标准差:

样本平均值 = (预测值 + 样本偏差)/ 2

样本标准差 = 样本偏差的平方根

2. 计算置信水平:

置信水平 = 95%

3. 计算置信区间:

置信区间 = 1.96 * 样本标准差 * sqrt(n)

其中,n 是样本大小。

4. 计算置信区间上界和下界:

置信区间上界 = 样本平均值 + 置信区间

置信区间下界 = 样本平均值 - 置信区间

5. 使用置信区间计算预测值的可信度:

可信度 = 置信区间上界 / 预测值

如果可信度大于等于 95%,则认为预测值可信度较高。

例如,如果我们使用 Ma2 模型对未来的销售额进行预测,样本

大小为 100,置信水平为 95%,那么置信区间的上界和下界分别为: 置信区间上界 = 1.96 * 样本标准差 * sqrt(100) ≈ 3.82

置信区间下界 = 1.96 * 样本标准差 * sqrt(100) ≈ 3.82

因此,置信区间的上界和下界都约为 3.82,这表示未来销售额的可信度约为 95%。

我们可以使用这个置信区间来评估预测的准确性和可信度。

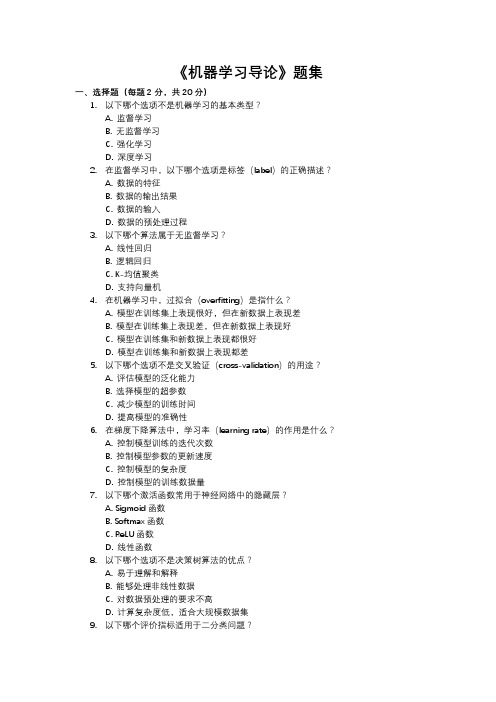

《机器学习导论》题集

《机器学习导论》题集一、选择题(每题2分,共20分)1.以下哪个选项不是机器学习的基本类型?A. 监督学习B. 无监督学习C. 强化学习D. 深度学习2.在监督学习中,以下哪个选项是标签(label)的正确描述?A. 数据的特征B. 数据的输出结果C. 数据的输入D. 数据的预处理过程3.以下哪个算法属于无监督学习?A. 线性回归B. 逻辑回归C. K-均值聚类D. 支持向量机4.在机器学习中,过拟合(overfitting)是指什么?A. 模型在训练集上表现很好,但在新数据上表现差B. 模型在训练集上表现差,但在新数据上表现好C. 模型在训练集和新数据上表现都很好D. 模型在训练集和新数据上表现都差5.以下哪个选项不是交叉验证(cross-validation)的用途?A. 评估模型的泛化能力B. 选择模型的超参数C. 减少模型的训练时间D. 提高模型的准确性6.在梯度下降算法中,学习率(learning rate)的作用是什么?A. 控制模型训练的迭代次数B. 控制模型参数的更新速度C. 控制模型的复杂度D. 控制模型的训练数据量7.以下哪个激活函数常用于神经网络中的隐藏层?A. Sigmoid函数B. Softmax函数C. ReLU函数D. 线性函数8.以下哪个选项不是决策树算法的优点?A. 易于理解和解释B. 能够处理非线性数据C. 对数据预处理的要求不高D. 计算复杂度低,适合大规模数据集9.以下哪个评价指标适用于二分类问题?A. 准确率(Accuracy)B. 召回率(Recall)C. F1分数(F1 Score)D. 以上都是10.以下哪个算法属于集成学习(ensemble learning)?A. 随机森林B. K-近邻算法C. 朴素贝叶斯D. 感知机二、填空题(每空2分,共20分)1.在机器学习中,数据通常被分为训练集、_______和测试集。

2._______是一种常用的数据预处理技术,用于将数值特征缩放到一个指定的范围。

机器学习试卷试题及答案

机器学习试题(一共30题,标有下划线的,如34,3_2,只用选择其中一题)1 .在回归模型中,下列哪一项在权衡欠拟合(under-fitting)和过拟合(C)Ver-fitting)中影响最大?A.多项式阶数B.更新权重W时,使用的是矩阵求逆还是梯度下降C,使用常数项2 .假设你有以下数据:输入和输出都只有一个变量。

使用线性回归模型(y=wx+b)来拟合数据。

那么使用留一法(1eave-OneOut)交叉验证得到的均方误差是多少?A. 10/27B. 39/27C. 49/27D. 55/273_1.下列关于极大似然估计(MaXimUm1ike1ihoodEstimate,M1E),说法正确的是(多选)?A. M1E可能并不存在B. M1E总是存在C.如果M1E存在,那么它的解可能不是唯一的D.如果M1E存在,那么它的解一定是唯一的3_2.下列哪些假设是我们推导线性回归参数时遵循的(多选)?AX与Y有线性关系(多项式关系)B.模型误差在统计学上是独立的C,误差一般服从O均值和固定标准差的正态分布D.X是非随机且测量没有误差的4_1.为了观察测试Y与X之间的线性关系,X是连续变量,使用下列哪种图形比较适合?A.散点图B.柱形图C.直方图D,以上都不对4_2,一般来说,下列哪种方法常用来预测连续独立变量?A.线性回归B.逻辑回顾C,线性回归和逻辑回归都行D.以上说法都不对5.个人健康和年龄的相关系数是-1.09o根据这个你可以告诉医生哪个结论?A.年龄是健康程度很好的预测器B.年龄是健康程度很糟的预测器C.以上说法都不对6.下列哪一种偏移,是我们在最小二乘直线拟合的情况下使用的?图中横坐标是输入X,纵坐标是输出Y overtica1offsetsperpendicu1aroffsetsA,垂直偏移(vertica1offsets)B.垂向偏移(perpendicu1aroffsets)C,两种偏移都可以D.以上说法都不对7 .假如我们利用Y是X的3阶多项式产生一些数据(3阶多项式能很好地拟合数据)。

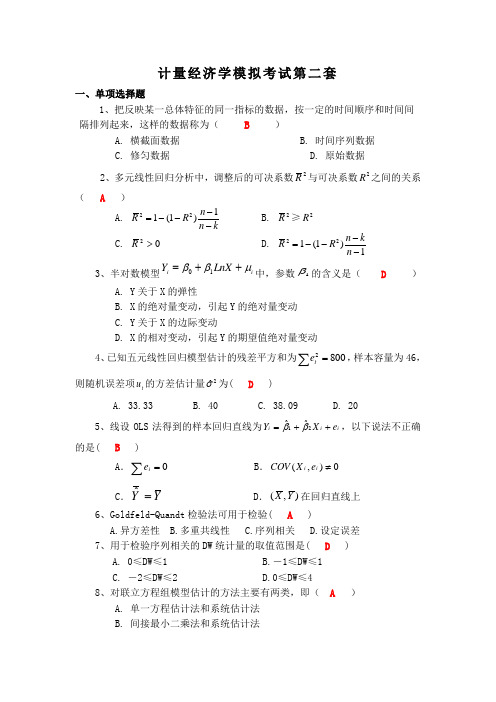

计量经济学模拟考试题第2套含答案

计量经济学模拟考试第二套一、单项选择题1、把反映某一总体特征的同一指标的数据,按一定的时间顺序和时间间隔排列起来,这样的数据称为( B )A. 横截面数据B. 时间序列数据C. 修匀数据D. 原始数据2、多元线性回归分析中,调整后的可决系数2R 与可决系数2R 之间的关系( A ) A. kn n R R ----=1)1(122 B. 2R ≥2R C. 02>R D. 1)1(122----=n k n R R 3、半对数模型i i LnX Y μββ++=10中,参数1β的含义是( D )A. Y 关于X 的弹性B. X 的绝对量变动,引起Y 的绝对量变动C. Y 关于X 的边际变动D. X 的相对变动,引起Y 的期望值绝对量变动4、已知五元线性回归模型估计的残差平方和为8002=∑t e ,样本容量为46,则随机误差项t u 的方差估计量2ˆσ为( D ) A. 33.33 B. 40 C. 38.09 D. 205、线设OLS 法得到的样本回归直线为i i i e X Y ++=21ˆˆββ,以下说法不正确的是( B )A .0=∑i eB .0),(≠i i e X COVC .Y Y =ˆD .),(Y X 在回归直线上6、Goldfeld-Quandt 检验法可用于检验( A )A.异方差性B.多重共线性C.序列相关D.设定误差7、用于检验序列相关的DW 统计量的取值范围是( D )A. 0≤DW ≤1B.-1≤DW ≤1C. -2≤DW ≤2D.0≤DW ≤48、对联立方程组模型估计的方法主要有两类,即( A )A. 单一方程估计法和系统估计法B. 间接最小二乘法和系统估计法C. 单一方程估计法和二阶段最小二乘法D. 工具变量法和间接最小二乘法9、在模型t t t t u X X Y +++=33221βββ的回归分析结果报告中,有23.263489=F ,000000.0=值的p F ,则表明( C )A 、解释变量t X 2 对t Y 的影响是显著的B 、解释变量t X 3对t Y 的影响是显著的C 、解释变量t X 2和t X 3对t Y 的联合影响是显著的. D 、解释变量t X 2和t X 3对t Y 的影响是均不显著 10、如果回归模型中解释变量之间存在完全的多重共线性,则最小二乘估计量( A )A.不确定,方差无限大B.确定,方差无限大C.不确定,方差最小D.确定,方差最小在序列自相关的情况下,参数估计值仍是无偏的,其原因是( C )A. 无多重共线性假定成立B. 同方差假定成立C. 零均值假定成立D. 解释变量与随机误差项不相关假定成立11、应用DW 检验方法时应满足该方法的假定条件,下列不是其假定条件的为( B )A.解释变量为非随机的B.被解释变量为非随机的C.线性回归模型中不能含有滞后内生变量D.随机误差项服从一阶自回归12、在具体运用加权最小二乘法时, 如果变换的结果是 则Var(u)是下列形式中的哪一种?( B )13、经济变量的时间序列数据大多存在序列相关性,在分布滞后模型中,这种序列相关性就转化为( B )A .异方差问题 B. 多重共线性问题x u x x x 1xy 21+β+β=xD x C x B x A log ....22222σσσσC .序列相关性问题 D. 设定误差问题14、关于自适应预期模型和局部调整模型,下列说法错误的有( D )A .它们都是由某种期望模型演变形成的B .它们最终都是一阶自回归模型C .它们的经济背景不同D .都满足古典线性回归模型的所有假设,故可直接用OLS 方法进行估计15、设某地区消费函数中,消费支出不仅与收入x 有关,而且与消费者的年龄构成有关,若将年龄构成分为小孩、青年人、成年人和老年人4个层次。

机器学习模拟试题含答案

机器学习模拟试题含答案一、单选题(共50题,每题1分,共50分)1、同质集成中的个体学习器亦称()A、组件学习器B、基学习器C、异质学习器D、同质学习器正确答案:B2、假设我们使用原始的非线性可分版本的 Soft-SVM 优化目标函数。

我们需要做什么来保证得到的模型是线性可分离的?A、C = 0B、C = 1C、C 正无穷大D、C 负无穷大正确答案:C3、关于logistic回归和SVM不正确的是()A、Logistic 回归目标函数是最小化后验概率B、Logistic回归可以用于预测事件发生概率的大小C、SVM可以有效避免模型过拟合D、SVM目标是结构风险最小化正确答案:A4、构建一个最简单的线性回归模型需要几个系数(只有一个特征)?A、1 个B、2 个C、4 个D、3 个正确答案:B5、假如我们使用 Lasso 回归来拟合数据集,该数据集输入特征有 100 个(X1,X2,…,X100)。

现在,我们把其中一个特征值扩大 10 倍(例如是特征 X1),然后用相同的正则化参数对 Lasso 回归进行修正。

那么,下列说法正确的是?A、特征 X1 很可能被排除在模型之外B、特征 X1 很可能还包含在模型之中C、无法确定特征 X1 是否被舍弃D、以上说法都不对正确答案:B6、下面关于SVM算法叙述不正确的是()A、SVM是一种基于经验风险最小化准则的算法B、SVM求得的解为全局唯一最优解C、SVM在解决小样本、非线性及高维模式识别问题中具有优势D、SVM最终分类结果只与少数支持向量有关正确答案:A7、KNN算法属于一种典型的()算法A、无监督学习B、半监督学习C、弱监督学习D、监督学习正确答案:D8、关于BP算法特点描述错误的是 ( )A、输入信号顺着输入层、隐层、输出层依次传播B、计算之前不需要对训练数据进行归一化C、预测误差需逆向传播,顺序是输出层、隐层、输入层D、各个神经元根据预测误差对权值进行调整正确答案:B9、关于维数灾难说法错误的是?A、高维度数据可使得算法泛华能力变得越来越弱B、高维度数据增加了运算难度C、降低高维度数据会对数据有所损伤D、高维度数据难以可视化正确答案:A10、做一个二分类预测问题,先设定阈值为0.5,概率大于等于0.5的样本归入正例类(即1),小于0.5的样本归入反例类(即0)。

stata 信度检验命令

stata 信度检验命令摘要:一、信度检验概述1.信度检验的重要性2.常见信度检验方法二、Stata 信度检验命令介绍1.命令概述2.语法结构3.参数解释三、Stata 信度检验命令应用实例1.具体操作步骤2.结果解读四、Stata 信度检验命令的优缺点1.优点2.缺点五、总结正文:一、信度检验概述在社会科学研究中,信度是评估测量工具(如问卷、量表等)的一个重要指标。

信度检验的主要目的是检验测量工具的稳定性和一致性,以确保研究结果的有效性和可靠性。

常见的信度检验方法有Cronbach"s Alpha 系数、KR-20 值、折半信度等。

二、Stata 信度检验命令介绍1.命令概述Stata 是一款广泛应用于社会科学数据分析的软件,提供了丰富的信度检验命令。

其中,最常用的信度检验命令为`reliability`。

2.语法结构`reliability`命令的基本语法结构如下:```reliability dep_var [indep_vars] [if] [in] [, absorb(absorb_vars) [options]]```其中,`dep_var`表示因变量(即需要进行信度检验的变量);`indep_vars`表示自变量(可选);`if`和`in`为筛选样本的条件;`absorb_vars`表示需要控制的固定效应变量(可选);`options`为命令选项。

3.参数解释- `dep_var`:需要进行信度检验的因变量。

- `indep_vars`:可选,与因变量一起进行多元回归分析的自变量。

- `if`和`in`:可选,用于筛选样本的条件。

- `absorb_vars`:可选,需要控制的固定效应变量。

- `options`:可选,命令选项,例如`vif`(计算VIF 值)和`test`(进行信度检验)。

三、Stata 信度检验命令应用实例假设我们有一个数据集,其中`y`表示因变量,`x1`和`x2`表示自变量,我们想要检验`y`的信度。