搜索引擎蜘蛛机器人工作原理

搜索引擎spider爬虫(蜘蛛)原理

搜索引擎spider爬⾍(蜘蛛)原理做SEO的⼈应该要对搜索引擎的基本原理有⼀些了解,从搜索引擎发现⽹址到该页⾯拥有排名,以及后续更新整个过程中,搜索引擎到底是怎么⼯作的?你都需要了解。

对于专业的算法不必进⾏深⼊的研究,但是对于搜索引擎⼯作中的⽣命⼒和算法原理要有个简单的认知,这样才能更有效地开展SEO⼯作,知其然也要知其所以然;当然也有⼀些朋友不懂这些,照样做昨有声有⾊,但是有对搜索引擎⼯作原理,懂总⽐不懂好⼀点。

以往的SEO书藉中对这内容讲解都⽐较简单,希望在些能够尝试结合SEO实际⼯作和现象,更进⼀步剖析⼀下搜索引擎的⼯作原理,其实当你了解了搜索引擎的⼯作流程、策略和基本算法后,就可以在⼀定程序上避免因为不当操作⽽带来的不必要处罚,同也可以快速分析出很多搜索引擎搜索结果异常的原因。

有搜索⾏为的地⽅就有搜索引擎,站内搜索、全⽹搜索、垂直搜索等都⽤到搜索引擎;接下来,本⽂会根据从业认知,讨论⼀下全⽂搜索引擎的基本架构。

百度、⾕歌等综合搜索巨头肯定有着更为复杂的架构和检索技术,但宏观上基本原理都差不多的。

搜索引擎的⼤概架构如图2-1所⽰。

可以分成虚线左右两个部分:⼀部分是主动抓取⽹页进⾏⼀系列处理后建⽴索引,等待⽤户搜索;另⼀部分是分析⽤户搜索意图,展现⽤户所需要的搜索结果。

搜索引擎主动抓取⽹页,并进⾏内容处理、索引部分的流程和机制⼀般如下:1.派出spider按照⼀定策略把⽹页抓回到搜索引擎服务器;2.对抓回的⽹页进⾏链接抽离、内容处理,削除噪声、提取该页主题⽂本内容等;3.对⽹页的⽂本内容进⾏中⽂分词、去除停⽌词等;4.对⽹页内容进⾏分词后判断该页⾯内容与已索引⽹页是否有重复,剔除重复页,对剩余⽹页进⾏倒排索引,然后等待⽤户的检索。

当有⽤户进⾏查询后,搜索引擎⼯作的流程机制⼀般如下:1.先对⽤户所查询的关键词进⾏分词处理,并根据⽤户的地理位置和历史检索特征进⾏⽤户需求分析,以便使⽤地域性搜索结果和个性化搜索结果展⽰⽤户最需要的内容;2.查找缓存中是否有该关键词的查询结果,如果有,有为最快地呈现查询,搜索引擎会根据当下⽤户的各种信息判断其真正需求,对缓存中的结果进⾏微调或直接呈现给⽤户;3.如果⽤户所查询的关键词在缓存中不存在,那么就在索引库中的⽹页进⾏调取排名呈现,并将该关键词和对应的搜索结果加⼊到缓存中;4.⽹页排名是⽤户的搜索词和搜索需求,对索引库中⽹页进⾏相关性、重要性(链接权重分析)和⽤户体验的⾼低进⾏分析所得出的。

百度蜘蛛爬行原理

百度蜘蛛爬行原理百度蜘蛛,是百度搜索引擎的一个自动程序。

它的作用是访问收集整理互联网上的网页、图片、视频等内容,然后分门别类建立索引数据库,使用户能在百度搜索引擎中搜索到您网站的网页、图片、视频等内容。

(1)通过百度蜘蛛下载回来的网页放到补充数据区,通过各种程序计算过后才放到检索区,才会形成稳定的排名,所以说只要下载回来的东西都可以通过指令找到,补充数据是不稳定的,有可能在各种计算的过程中给k掉,检索区的数据排名是相对比较稳定的,百度目前是缓存机制和补充数据相结合的,正在向补充数据转变,这也是目前百度收录困难的原因,也是很多站点今天给k了明天又放出来的原因。

(2)深度优先和权重优先,百度蜘蛛抓页面的时候从起始站点(即种子站点指的是一些门户站点)是广度优先抓取是为了抓取更多的网址,深度优先抓取的目的是为了抓取高质量的网页,这个策略是由调度来计算和分配的,百度蜘蛛只负责抓取,权重优先是指反向连接较多的页面的优先抓取,这也是调度的一种策略,一般情况下网页抓取抓到40%是正常范围,60%算很好,100%是不可能的,当然抓取的越多越好。

百度蜘蛛在从首页登陆后抓取首页后调度会计算其中所有的连接,返回给百度蜘蛛进行下一步的抓取连接列表,百度蜘蛛再进行下一步的抓取,网址地图的作用是为了给百度蜘蛛提供一个抓取的方向,来左右百度蜘蛛去抓取重要页面,如何让百度蜘蛛知道那个页面是重要页面?可以通过连接的构建来达到这个目的,越多的页面指向该页,网址首页的指向,副页面的指向等等都能提高该页的权重,地图的另外一个作用是给百度蜘蛛提供更多的链接来达到抓去更多页面的目的,地图其实就是一个链接的列表提供给百度蜘蛛,来计算你的目录结构,找到通过站内连接来构建的重要页面。

补充数据到主检索区的转变:在不改变板块结构的情况下,增加相关连接来提高网页质量,通过增加其他页面对该页的反向连接来提高权重,通过外部连接增加权重。

如果改变了板块结构将导致seo的重新计算,所以一定不能改变板块结构的情况下来操作,增加连接要注意一个连接的质量和反向连接的数量的关系,短时间内增加大量的反向连接将导致k站,连接的相关性越高,对排名越有利。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种用于在互联网上搜索信息的工具。

它通过采集、索引和排序互联网上的网页内容,为用户提供相关的搜索结果。

搜索引擎的工作原理可以简单地分为三个步骤:抓取网页、建立索引和提供搜索结果。

1. 抓取网页搜索引擎通过网络爬虫(也称为蜘蛛或者机器人)来抓取互联网上的网页。

网络爬虫会按照一定的规则从一个网页转到另一个网页,将网页的内容下载下来。

爬虫会根据网页中的链接不断地跳转到其他网页,形成一个爬行路径,以获取尽可能多的网页内容。

2. 建立索引抓取下来的网页内容会被搜索引擎进行处理和分析,以建立一个庞大的网页索引。

索引是一种结构化的数据存储方式,它会记录每一个网页的关键信息,如标题、摘要、URL和关键词等。

搜索引擎会对网页内容进行分词处理,将关键词和对应的网页进行关联。

这样,当用户搜索关键词时,搜索引擎可以快速地找到相关的网页。

3. 提供搜索结果当用户输入关键词进行搜索时,搜索引擎会根据用户的需求从建立的索引中匹配相关的网页。

搜索引擎会根据一系列的算法,对匹配的网页进行排序,并将最相关的网页展示给用户。

排序算法会考虑多个因素,如关键词的浮现频率、网页的权重和链接的质量等。

搜索引擎还会提供一些搜索结果的过滤选项,如时间范围、文件类型和地域等,以满足用户的个性化需求。

搜索引擎的工作原理虽然看似简单,但实际上暗地里涉及了复杂的技术和算法。

为了提高搜索结果的质量和准确性,搜索引擎公司会不断地改进和优化搜索引擎的工作原理。

他们会利用机器学习和人工智能等技术,不断提升搜索引擎的智能化水平,以更好地满足用户的搜索需求。

搜索引擎蜘蛛机器人工作原理

搜索引擎蜘蛛机器人工作原理现代意义上的搜索引擎的祖先,是1990年由蒙特利尔大学学生Alan Emtage发明的Archie。

虽然当时World Wide Web还未出现,但网络中文件传输还是相当频繁的,而且由于大量的文件散布在各个分散的FTP主机中,查询起来非常不便,因此Alan Emtage想到了开发一个可以以文件名查找文件的系统,于是便有了Archie。

Archie工作原理与现在的搜索引擎已经很接近,它依靠脚本程序自动搜索网上的文件,然后对有关信息进行索引,供使用者以一定的表达式查询。

由于Archie深受用户欢迎,受其启发,美国内华达System Computing Services大学于1993年开发了另一个与之非常相似的搜索工具,不过此时的搜索工具除了索引文件外,已能检索网页。

当时,“机器人”一词在编程者中十分流行。

电脑“机器人”(Computer Robot)是指某个能以人类无法达到的速度不间断地执行某项任务的软件程序。

由于专门用于检索信息的“机器人”程序象蜘蛛一样在网络间爬来爬去,因此,搜索引擎的“机器人”程序就被称为“蜘蛛”程序。

网络蜘蛛即Web Spider,是一个很形象的名字。

把互联网比喻成一个蜘蛛网,那么Spider 就是在网上爬来爬去的蜘蛛。

网络蜘蛛是通过网页的链接地址来寻找网页,从网站某一个页面(通常是首页)开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一直循环下去,直到把这个网站所有的网页都抓取完为止。

如果把整个互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。

对于搜索引擎来说,要抓取互联网上所有的网页几乎是不可能的,从目前公布的数据来看,容量最大的搜索引擎也不过是抓取了整个网页数量的百分之四十左右。

这其中的原因一方面是抓取技术的瓶颈,100亿网页的容量是100times;2000G字节,即使能够存储,下载也存在问题(按照一台机器每秒下载20K计算,需要340台机器不停的下载一年时间,才能把所有网页下载完毕)。

搜索引擎的原理是

搜索引擎的原理是

搜索引擎的原理是通过收集和组织互联网上的信息,然后根据用户的搜索关键词来匹配和排名搜索结果。

首先,搜索引擎会使用网络爬虫程序(也称为蜘蛛或机器人)来自动浏览互联网上的网页。

爬虫程序会从一个网页开始,然后通过页面上的链接跳转到其他页面,并将这些页面的内容下载到搜索引擎的数据库中。

这个过程称为爬行。

接下来,搜索引擎会对收集到的网页进行索引。

索引是一个结构化的数据库,其中存储了每个网页的关键信息,如标题、URL、摘要和内容标签等。

通过索引,搜索引擎可以快速地查找和检索网页,以便根据用户的搜索查询返回相关的结果。

当用户输入一个搜索关键词时,搜索引擎会根据索引中的信息来匹配相关的网页。

它会比较关键词与网页标题、正文和其他标签的相似度,并根据算法对搜索结果进行排序。

常见的算法包括PageRank和TF-IDF等。

在返回搜索结果时,搜索引擎会根据搜索查询的相关性和网页的质量来排名结果。

相关性指的是搜索查询与网页内容的匹配程度,而质量则涉及到网页的可信度、权威性、受欢迎程度等因素。

在确保搜索结果的多样性的情况下,搜索引擎会尽可能地提供最相关和有用的结果给用户。

此外,搜索引擎还会根据用户的搜索历史、地理位置和其他个性化因素来调整搜索结果,以提

供更加个性化的搜索体验。

总之,搜索引擎的原理是通过爬行、索引和排序等步骤来收集和组织互联网上的内容,并根据用户的搜索查询来返回最相关和有用的搜索结果。

标题的重要性在搜索引擎的算法中扮演着重要的角色,但是搜索引擎也会考虑其他因素来提供更全面、准确和个性化的搜索结果。

百度搜索引擎工作原理

第二讲:百度搜索引擎及工作原理一、百度搜索引擎及工作原理?1、抓取:搜索引擎蜘蛛又叫爬虫或机器人,是一套信息抓取的程序,百度蜘蛛是通过网络上链接来爬取、搜集网页上的内容信息。

分为深度抓取和广度抓取,怎么让蜘蛛来抓取呢?一般有三种途径:外链、主动提交链接、蜘蛛自己来。

我们可以通过服务器日志及百度站长平台抓取频率来判断蜘蛛是否来抓取网页了。

在抓取的过程当中影响蜘蛛抓取的因素有路径(过长、中文)以及服务器打开速度。

2、过滤:通过过滤系统将一些低质量的垃圾内容过滤掉,比如说复制来的,采集来的,主题内容不相关的无价值内容,不够丰富的内容(内容是否为高质量、稀缺性内容)通通过滤掉。

另外,对于一些无法识别的:js、没有添加alt属性的图片、视频上下方没有加加文字说明的、flash、iframe框架结构、登录页面都会过滤掉。

3、收录:将通过过滤模块的页面储存在索引库里,我们称之为收录。

怎么查询呢?直接在搜索框内输入网址即可查询是否被收录了,查询整个网站收录量用到site指令:site+域名收录了并不一定有排名,它是网页参与排名的前提条件并非充分条件。

只有网站单个页面权重提升了整个网站权重才会更高更强大。

搜索引擎对网站的信任度非常重要,是一个长期积累过程,最终可以达到一个秒收的程度。

4、排序:通过百度算法系统进行评分,来计算页面的综合得分情况进行排序,最后展现在搜索引擎的搜索结果页中。

因此,我们必须研究搜索引擎排名机制和影响页面排名的因素有哪些。

二、你知道网站不收录的原因有哪些?1、有没有通知蜘蛛来或对蜘蛛有没有进行封禁2、页面内容质量低3、排名周期(观察期)4、网页内容是否能够被蜘蛛识别。

搜索引擎Web Spider(蜘蛛)爬取的原理分享

搜索引擎Web Spider(蜘蛛)爬取的原理分享一、网络蜘蛛基本原理网络蜘蛛即WebSpider,是一个很形象的名字。

把互联网比方成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛。

网络蜘蛛是通过网页的链接地址来寻觅网页,从网站某一个页面(通常是首页)开头,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻觅下一个网页,这样向来循环下去,直到把这个网站全部的网页都抓取完为止。

假如把囫囵互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上全部的网页都抓取下来。

对于搜寻引擎来说,要抓取互联网上全部的网页几乎是不行能的,从目前公布的数据来看,容量最大的搜寻引擎也不过是抓取了囫囵网页数量的百分之四十左右。

这其中的缘由一方面是抓取技术的瓶颈,薹ū槔械耐常行矶嗤澄薹ù悠渌车牧唇又姓业剑涣硪桓鲈蚴谴娲⒓际鹾痛砑际醯奈侍猓绻凑彰扛鲆趁娴钠骄笮∥0K计算(包含),100亿网页的容量是100×2000G字节,即使能够存储,下载也存在问题(根据一台机器每秒下载20K计算,需要340台机器不停的下载一年时光,才干把全部网页下载完毕)。

同时,因为数据量太大,在提供搜寻时也会有效率方面的影响。

因此,许多搜寻引擎的网络蜘蛛只是抓取那些重要的网页,而在抓取的时候评价重要性主要的依据是某个网页的链接深度。

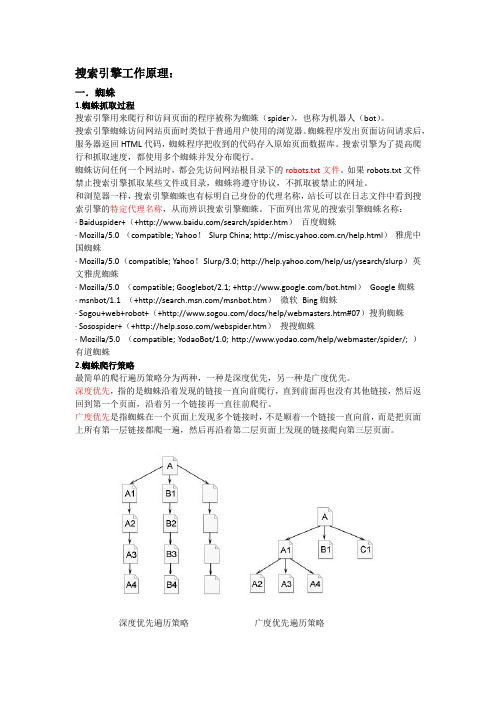

在抓取网页的时候,网络蜘蛛普通有两种策略:广度优先和深度优先(如下图所示)。

广度优先是指网络蜘蛛会先抓取起始网页中链接的全部网页,然后再挑选其中的一个链接网页,继续抓取在此网页中链接的全部网页。

这是最常用的方式,由于这个办法可以让网络蜘蛛并行处理,提高其抓取速度。

深度优先是指网络蜘蛛会从起始页开头,一个链接一个链接跟踪下去,处理完这条线路之后再转入下一个起始页,继续跟踪链接。

这个办法有个优点是网络蜘蛛在设计的时候比较简单。

两种策略的区分,下图的解释会越发明确。

百度蜘蛛爬行原理

百度蜘蛛爬行原理百度蜘蛛,是百度搜索引擎的一个自动程序。

它的作用是访问收集整理互联网上的网页、图片、视频等内容,然后分门别类建立索引数据库,使用户能在百度搜索引擎中搜索到您网站的网页、图片、视频等内容蜘蛛抓取第一步爬行和抓取爬行到你的网站网页,寻找合适的资源。

蜘蛛它有一个特性,那就是他的运动轨迹通常都是围绕着蜘蛛丝而走的,而我们之所以将搜索引擎的机器人命名为蜘蛛其实就是因为这个特性。

当蜘蛛来到你的网站之后,它就会顺着你网站中的链接(蜘蛛丝)不断的进行爬行,因此如何让蜘蛛能够更好的在你的网站中进行爬行就成为了我们的重中之重。

抓取你的网页。

引导蜘蛛的爬行这只是一个开始,一个好的开始意味着你将有一个高起点。

通过自己的内链设计,使得网站中不存在任何死角,蜘蛛可以轻松的到达网站中的每一个页面,这样蜘蛛在进行第二步工作——抓取的时候,将会事半功倍。

而在这一步抓取的过程中我们又需要注意的就是要精简网站的结构,将那些不必要、不需要的多余代码去掉,因为这些都将会影响蜘蛛抓取网页的效率与效果。

另外还需要大家注意的事情就是通过我们都不建议网站中放入FLASH,因为蜘蛛对于FLASH是不好抓取的,过多的FLASH会导致蜘蛛放弃抓取你网站的页面。

蜘蛛抓取第二步存储抓取了链接所对应的页面,会把这些页面的内容存储到搜索引擎的原始数据库里面。

会抓取一些文本内容。

网站在优化的时候不要盲目的给网站添加一些图片或者动画flash文件。

这样不利搜索引擎的抓取。

这类对排没有太大价值,应该多做内容。

抓取到搜索引擎原始数据中,不代表你的网站内容就一定会被百度采纳。

搜索引擎还需要再进行下一步处理。

蜘蛛抓取第三步预处理搜索引擎主要还是以(文字)为基础。

JS,CSS程序代码是无法用于排名。

蜘蛛将第一步中提取的文字进行拆分重组,组成新的单词。

去重处理(去掉一些重复的内容,搜索引擎数据库里面已经存在的内容)要求我们在做SEO优化的人员在优化网站内容的不能完全抄袭别人的站点内容。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种用于从互联网上获取信息的工具,它通过采集、索引和排序网页来提供用户所需的搜索结果。

搜索引擎的工作原理可以分为以下几个步骤:网页抓取、网页索引和搜索结果排序。

1. 网页抓取:搜索引擎通过网络爬虫程序(也称为蜘蛛、机器人)从互联网上抓取网页。

网络爬虫会按照一定的规则自动遍历互联网上的网页,并将抓取到的网页内容保存在搜索引擎的数据库中。

爬虫程序会从一个初始网页开始,然后通过网页中的链接逐步遍历其他网页,形成一个庞大的网页索引。

2. 网页索引:网页索引是搜索引擎的核心组成部份,它是一个包含大量网页信息的数据库。

搜索引擎会对抓取到的网页进行处理,提取出网页的关键词和其他相关信息,并将这些信息存储在索引中。

索引的目的是为了加快搜索引擎的检索速度和准确性。

当用户输入关键词进行搜索时,搜索引擎会根据索引中的信息进行匹配,找到与关键词相关的网页。

3. 搜索结果排序:当用户输入关键词进行搜索后,搜索引擎会根据一定的算法对索引中的网页进行排序,以便将最相关的网页展示给用户。

搜索引擎的排序算法通常会考虑多个因素,如关键词的匹配程度、网页的权威性和用户的搜索习惯等。

通过不断优化算法,搜索引擎可以提供更准确、相关的搜索结果。

除了以上的基本工作原理,搜索引擎还会根据用户的搜索行为和反馈信息进行改进和优化。

例如,搜索引擎会记录用户的搜索历史和点击行为,以便更好地理解用户的需求,并根据用户的反馈信息对搜索结果进行调整。

总结起来,搜索引擎的工作原理主要包括网页抓取、网页索引和搜索结果排序。

通过不断优化算法和采集用户反馈,搜索引擎可以提供更准确、相关的搜索结果,匡助用户快速获取所需的信息。

搜索引擎工作原理

搜索引擎工作原理搜索引擎是一种用于帮助用户在互联网上查找信息的工具,通过收集、索引和展示网页内容,为用户提供相关的搜索结果。

搜索引擎的工作原理可以分为以下几个步骤:网页抓取、索引建立和搜索结果展示。

1. 网页抓取搜索引擎通过网络爬虫(也称为蜘蛛、机器人)自动访问互联网上的网页,并将网页内容下载到搜索引擎的服务器上。

爬虫按照一定的规则遍历网页,通过链接跳转和网页分析等方式获取更多的网页。

爬虫会定期访问已抓取的网页,以便更新搜索引擎的索引。

2. 索引建立在网页抓取后,搜索引擎会对网页内容进行处理和分析,提取出网页中的关键词、标题、摘要等信息,并将这些信息存储在索引数据库中。

索引数据库是搜索引擎的核心组成部分,它包含了大量的网页信息和相关的索引信息。

索引数据库会根据关键词的频率、位置和其他相关度因素对网页进行排序和分类。

3. 搜索结果展示当用户在搜索引擎中输入关键词进行搜索时,搜索引擎会根据用户的搜索词在索引数据库中进行匹配和排序。

搜索引擎会根据网页的相关度对搜索结果进行排序,并将最相关的网页展示给用户。

搜索引擎还会根据用户的搜索历史、地理位置和其他个性化因素对搜索结果进行调整和个性化推荐。

搜索引擎的工作原理涉及到多个技术和算法,以下是一些常用的技术和算法:1. 爬虫技术爬虫技术是搜索引擎获取网页内容的基础。

爬虫会按照一定的规则和策略遍历网页,通过链接跳转和网页分析等方式获取更多的网页。

爬虫还会处理网页中的链接,将新的网页添加到待抓取队列中。

爬虫的设计和实现需要考虑到网页的数量、抓取速度和网络资源的限制等因素。

2. 关键词匹配算法关键词匹配算法是搜索引擎对用户搜索词和网页内容进行匹配的核心算法。

关键词匹配算法会根据关键词的频率、位置和其他相关度因素对网页进行排序和分类。

常见的关键词匹配算法包括向量空间模型(VSM)、BM25和TF-IDF等。

3. 网页排名算法网页排名算法是搜索引擎对搜索结果进行排序的算法。

搜索引擎(百度)工作原理——蜘蛛爬行和抓取

搜索引擎(百度)工作原理——蜘蛛爬行和抓取引擎的工作过程一般分为三个阶段:爬行和抓取:通过引擎蜘蛛跟踪链接和访问页面,抓取内容,存入数据库。

预处理:引擎抓取的数据,会进行文字提取,中文分词,索引,倒排索引,方便日后排名程序调用。

排名:用户输入查询关键以后,排名程序会调用索引库数据,按相关性生成结果页面。

一、蜘蛛爬行和抓取是引擎的第一步,收集数据的过程。

引擎是爬行和访问页面的自动程序收集数据,这种程序也叫蜘蛛或者机器人。

引擎蜘蛛访问网站类似于我们浏览网站,也可以理解蜘蛛爬行就像司令部放出去的收集情报员一样。

引擎蜘蛛访问网站是和普通用户基本一致的,蜘蛛程序访问页面以后,服务器会返回HTML代码,蜘蛛程序会把代码,出入原始页面数据库,引擎会同时使用很多蜘蛛程序提高抓取数据的效率。

引擎为了提高爬行和抓取速度,都使用多个蜘蛛进行发布和爬行,情报员多了,自然信息收集的就会更多,工作效率也就更高了。

蜘蛛访问网站时,会先访问网站的robots.txt文件,如果robots.txt文件里头有止访问的文件或者目录,蜘蛛就不会抓取。

其实就是入乡随俗,比如:回族人不吃猪肉,你虽然是客人,去了回族地域,也需要遵守当地习俗,就是这个意思。

引擎蜘蛛也是有自己的用户代理名称的,就好像警察的工作证一样,执行公务的时候都要先把证件拿出来,蜘蛛也是一样的,站长可以通过日志文件看到蜘蛛的用户代理,从而识别出到底是什么网站的引擎蜘蛛。

360蜘蛛:Mozilla5.0(Windows;U;Windows NT5.1;zh-CN;)Firefox/1.5.0.11;360Spider二、跟踪链接为了爬取更多的页面蜘蛛,都是靠跟踪网页的的链接爬取的,从一个页面到另一个页面,蜘蛛从任何一个页面出发都能爬取到网上所有的页面,不过,网站的机构复杂,信息太多,所有蜘蛛爬行也是有一定策略的,一般是2中深度优先和广度优先。

从理论上讲,只要给蜘蛛足够的时间,就能爬完所有网络内容。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种用于在互联网上查找信息的工具。

它通过收集、索引和排序互联网上的网页,以便用户能够快速、准确地找到所需的信息。

下面将详细介绍搜索引擎的工作原理。

一、网络爬虫搜索引擎的工作始于网络爬虫,也被称为蜘蛛或机器人。

网络爬虫是一种自动化程序,它会按照预定的规则从互联网上下载网页。

爬虫从一个种子URL开始,然后通过解析网页中的链接,逐步扩展到其他网页。

爬虫会定期访问网页,以确保索引的内容是最新的。

二、网页索引爬虫下载的网页会被送往搜索引擎的索引程序进行处理。

索引程序会提取网页的关键信息,并创建一个包含这些信息的索引数据库。

这个数据库类似于一本巨大的目录,记录了互联网上的各个网页的关键词、标题、摘要和链接等信息。

索引程序还会对这些信息进行分析和处理,以提高搜索结果的质量。

三、关键词匹配当用户在搜索引擎中输入关键词进行搜索时,搜索引擎会将这些关键词与索引数据库中的内容进行匹配。

搜索引擎会根据关键词的相关性和网页的权威性来确定搜索结果的排序。

关键词的相关性是指关键词与网页内容的匹配程度。

搜索引擎会将关键词与网页的标题、正文和链接等进行比对,以确定网页与关键词的相关性。

通常情况下,如果一个网页中包含了用户搜索的关键词,并且关键词在网页中的位置较为靠前,那么这个网页就会被认为与关键词的相关性较高。

网页的权威性是指网页在互联网上的信誉和影响力。

搜索引擎会根据网页的外部链接数量和质量来评估网页的权威性。

如果一个网页被其他网页广泛引用,那么搜索引擎就会认为这个网页的权威性较高。

四、搜索结果页面当搜索引擎确定了搜索结果的排序后,它会将这些结果展示给用户。

搜索结果页面通常包含了多个搜索结果,每个搜索结果都包括了网页的标题、摘要和链接等信息。

用户可以点击链接来访问他们感兴趣的网页。

搜索结果页面还可能包含一些相关的搜索建议、广告和其他相关信息。

搜索引擎会根据用户的搜索行为和个人资料来定制搜索结果页面,以提供更加个性化和有用的搜索结果。

蜘蛛机器人原理

蜘蛛机器人原理蜘蛛机器人是一种仿生机器人,它的设计灵感来源于蜘蛛的生物特性。

蜘蛛机器人可以在复杂的环境中自由移动,具有很强的适应能力和灵活性,被广泛应用于搜索救援、探索和监测等领域。

那么,蜘蛛机器人是如何实现这些功能的呢?接下来,我们将深入探讨蜘蛛机器人的原理。

首先,蜘蛛机器人的运动原理是仿生学的一个重要方面。

蜘蛛机器人通常采用多足结构,每条腿都配有独立的驱动装置,可以实现灵活的步态和多样的运动方式。

这种设计灵感来源于蜘蛛的八条腿,可以在不同的地形上行走,具有很强的适应能力。

同时,蜘蛛机器人的运动系统还可以模拟蜘蛛的爬墙能力,通过粘附或吸盘等装置实现在垂直表面上的移动,这为蜘蛛机器人在复杂环境中的探索提供了便利。

其次,蜘蛛机器人的感知原理也是其关键之一。

蜘蛛机器人通常配备了多种传感器,如红外线传感器、超声波传感器、摄像头等,可以实时感知周围环境的信息。

这些传感器可以帮助蜘蛛机器人避开障碍物、识别目标并进行定位,保证其在复杂环境中的安全行走和有效探索。

同时,蜘蛛机器人还可以利用这些传感器获取环境参数,为后续的数据分析和决策提供支持。

另外,蜘蛛机器人的智能控制系统也是其核心之一。

蜘蛛机器人通常配备了高性能的处理器和智能控制算法,可以实现对感知信息的快速处理和分析,根据环境变化实时调整运动轨迹和步态。

这种智能控制系统可以使蜘蛛机器人在复杂环境中做出快速反应,保证其在任务执行过程中的高效性和稳定性。

综上所述,蜘蛛机器人的原理主要包括运动原理、感知原理和智能控制系统。

通过仿生学的设计理念,蜘蛛机器人可以在复杂环境中实现自由灵活的移动,具有很强的适应能力和智能性。

未来,随着科技的不断发展,相信蜘蛛机器人将会在更多领域发挥重要作用,为人类社会带来更多的便利和帮助。

搜索引擎工作原理简介

一、搜索引擎工作的一个大概过程:1.爬行和抓取搜索引擎蜘蛛通过跟踪链接访问网页,获得页面HTML 代码存入数据库,抓取从左往右,从上往下2.预处理索引程序对抓取来的页面数据进行文字提取、中文分词、索引等处理,以备排名程序调用3.排名用户输入关键词后,排名程序调用索引库数据,计算相关性,然后按一定格式生成搜索结果页面二、爬行和抓取1.蜘蛛概念:搜索引擎用来爬行和访问页面的程序被称为蜘蛛,也称为机器人2.跟踪链接最简单的爬行查看方式分为两种:深度优先和广度优先(1)深度优先(2)广度优先A B1 B2 B3 A1 A2A3 指的是蜘蛛沿着发现的链接一直向前爬行,直到前面再也没有其他链接,然后返回到第一个页面,沿着另一个链接再一直往前爬行。

图例解说:蜘蛛跟踪链接从A 页面爬行到A1、A2、A3到A3页面后,没有其它链接可以跟踪就返回A 页面,顺着页面上的另一链接,爬行到B1、B2、B3 A C1 B1A1 A2 A3 A4 指蜘蛛在一个页面上发现多个链接时,不是顺着一个链接一直向前,而是把页面上所有第一层链接都爬一遍,然后再沿着第二层页面上的发现链接爬向第三层。

图例解说:蜘蛛从A 页面爬行到A1、B1、C1页面,直到A 页面上的所有链接都爬行完,然后从A1页面发现的下一层链接,爬行到A1、A2、A33.吸引蜘蛛理论上蜘蛛可以爬行和抓取所有页面,但实际上不能、也不会这么做。

既然不能抓取所有页面,它所要做的就是尽量抓取重要页面。

影响页面重要性的因素有哪些呢?——网站和页面权重。

质量高、资格老的网站被认为权重比较高,这种页面被爬行的深度也越深,内页被收录更多——页面更新度。

经常更新的页面(高质量信息)蜘蛛抓取的也频繁——导入链接。

页面的抓取要有导入链接,不然就会形成一种“孤岛效应”,无法访问。

高质量的导入链接也经常使页面上的导出链接被爬行深度增加——与首页点击距离。

离首页点击距离越近,页面权重越高,被蜘蛛爬行的机会也越大4.地址库为了避免重复爬行和抓取网址,搜索引擎会建立一个地址库,记录已经被发现还没有抓取的页面,以及已经被抓取的页面5.爬行时的复制内容检测检测并删除复制内容通常是在预处理过程中进行的,但现在蜘蛛在爬行和抓取文件时也会进行一定程度的复制内容检测。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种通过自动化程序来帮助用户在互联网上查找相关信息的工具。

它能够从海量的网页中快速检索出用户所需的信息,并按照相关性进行排序,以便用户能够更快地找到自己所需的内容。

搜索引擎的工作原理可以分为三个主要的步骤:抓取、索引和排序。

1. 抓取:搜索引擎通过网络爬虫(也称为蜘蛛或机器人)来抓取互联网上的网页。

网络爬虫会从一个起始网址开始,然后按照一定的规则跟踪和抓取其他网页上的链接,形成一个网页的网络图。

爬虫会下载这些网页的内容,并提取其中的文本、链接和其他元数据。

2. 索引:在抓取的过程中,搜索引擎会将抓取到的网页内容进行分析和处理,然后将其存储在索引数据库中。

索引是搜索引擎的核心部分,它类似于一本巨大的目录,记录了互联网上的网页和相关的关键词。

索引可以帮助搜索引擎快速找到与用户查询相关的网页。

为了构建索引,搜索引擎会对抓取到的网页进行文本分析,将网页内容中的关键词提取出来,并建立关键词与网页的映射关系。

同时,搜索引擎还会考虑其他因素,如网页的重要性、链接的质量等,来确定网页的排名。

3. 排序:当用户输入查询词后,搜索引擎会根据索引数据库中的信息进行匹配,并找到相关的网页。

搜索引擎会根据一系列算法和规则来对搜索结果进行排序,以便将最相关的网页展示给用户。

排序算法通常会考虑多个因素,如关键词的匹配度、网页的权威性、用户的搜索历史等。

搜索引擎还会根据用户的查询行为和反馈来不断优化排序结果,以提供更加准确和个性化的搜索体验。

除了以上三个主要的步骤,搜索引擎还会提供其他的功能和服务,如搜索建议、语义理解、垂直搜索等,以满足用户不同的需求。

总结起来,搜索引擎的工作原理包括抓取、索引和排序三个主要的步骤。

通过抓取互联网上的网页内容,建立索引数据库,并根据用户的查询词和一系列算法进行排序,搜索引擎能够帮助用户快速找到所需的信息。

不断的优化和改进使得搜索引擎能够提供更加准确和个性化的搜索结果,满足用户的需求。

搜索引擎工作原理

搜索引擎工作原理:一.蜘蛛1.蜘蛛抓取过程搜索引擎用来爬行和访问页面的程序被称为蜘蛛(spider),也称为机器人(bot)。

搜索引擎蜘蛛访问网站页面时类似于普通用户使用的浏览器。

蜘蛛程序发出页面访问请求后,服务器返回HTML代码,蜘蛛程序把收到的代码存入原始页面数据库。

搜索引擎为了提高爬行和抓取速度,都使用多个蜘蛛并发分布爬行。

蜘蛛访问任何一个网站时,都会先访问网站根目录下的robots.txt文件。

如果robots.txt文件禁止搜索引擎抓取某些文件或目录,蜘蛛将遵守协议,不抓取被禁止的网址。

和浏览器一样,搜索引擎蜘蛛也有标明自己身份的代理名称,站长可以在日志文件中看到搜索引擎的特定代理名称,从而辨识搜索引擎蜘蛛。

下面列出常见的搜索引擎蜘蛛名称:· Baiduspider+(+/search/spider.htm)百度蜘蛛· Mozilla/5.0 (compatible; Yahoo!Slurp China; /help.html)雅虎中国蜘蛛· Mozilla/5.0 (compatible; Yahoo!Slurp/3.0; /help/us/ysearch/slurp)英文雅虎蜘蛛· Mozilla/5.0 (compatible; Googlebot/2.1; +/bot.html)Google蜘蛛· msnbot/1.1 (+/msnbot.htm)微软Bing蜘蛛· Sogou+web+robot+(+/docs/help/webmasters.htm#07)搜狗蜘蛛· Sosospider+(+/webspider.htm)搜搜蜘蛛· Mozilla/5.0 (compatible; YodaoBot/1.0; /help/webmaster/spider/; )有道蜘蛛2.蜘蛛爬行策略最简单的爬行遍历策略分为两种,一种是深度优先,另一种是广度优先。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种用于在互联网上查找和获取信息的工具。

它通过收集、索引和排名互联网上的网页内容,以便用户可以通过关键词搜索来获取相关的信息。

搜索引擎的工作原理可以分为以下几个步骤:网页抓取、索引构建和搜索结果展示。

1. 网页抓取:搜索引擎通过网络爬虫(也称为蜘蛛或机器人)来抓取网页。

网络爬虫是一种自动化程序,它按照一定的规则遍历互联网上的网页,并将这些网页的内容下载到搜索引擎的服务器上。

网络爬虫会从一个起始网页开始,然后通过网页上的链接不断地跳转到其他网页,以此类推,直到抓取到所有相关的网页。

2. 索引构建:抓取到的网页内容会被搜索引擎进行处理和分析,以构建索引。

索引是搜索引擎的核心部分,它类似于一本巨大的目录,记录了互联网上所有网页的相关信息。

搜索引擎会提取网页中的关键词、标题、摘要等内容,并将这些信息存储在索引中。

同时,搜索引擎还会记录网页的URL、发布时间、页面质量等信息,以便后续的搜索和排名。

3. 搜索结果展示:当用户输入关键词进行搜索时,搜索引擎会根据索引中的信息进行匹配和排序,并返回相关的搜索结果。

搜索引擎会根据关键词的相关性、网页的质量和用户的搜索历史等因素,对搜索结果进行排序。

通常,搜索引擎会将最相关的网页显示在前面,并提供摘要、URL和其他相关信息,以便用户快速浏览和选择。

搜索引擎的工作原理还涉及到一些其他的技术和算法,例如倒排索引、关键词提取、页面质量评估等。

倒排索引是一种常用的索引结构,它将关键词映射到对应的网页,以加快搜索的速度。

关键词提取是指从网页中提取出最相关的关键词,以便搜索引擎进行匹配和排序。

页面质量评估是搜索引擎用来评估网页质量的一种方法,它可以通过分析网页的链接、用户反馈等指标来判断网页的可信度和权威性。

总结起来,搜索引擎的工作原理是通过网页抓取、索引构建和搜索结果展示三个步骤来实现的。

搜索引擎通过收集和索引互联网上的网页内容,以便用户可以通过关键词搜索来获取相关的信息。

搜索引擎工作原理

搜索引擎工作原理搜索引擎是一种用于在互联网上搜索信息的工具,通过对网页进行收录、索引和排序,帮助用户找到他们所需的信息。

搜索引擎的工作原理可以分为三个主要步骤:爬取、索引和排序。

1. 爬取:搜索引擎通过爬虫程序(也称为蜘蛛、机器人或爬行器)自动地访问互联网上的网页。

爬虫按照一定的规则从一个网页链接到另一个网页,逐个爬取网页内容。

爬虫会收集网页的URL、标题、正文、图片等信息,并将这些信息存储在搜索引擎的数据库中。

2. 索引:索引是搜索引擎将爬取到的网页内容进行整理、分类和存储的过程。

搜索引擎会对爬取到的网页进行分词处理,将网页中的文本内容划分为一个个独立的词语。

然后,搜索引擎会建立一个倒排索引,记录每个词语在哪些网页中出现,并为每个词语建立索引。

倒排索引包含了词语、对应的网页列表以及词语在每个网页中的位置信息。

3. 排序:当用户输入关键词进行搜索时,搜索引擎会根据索引中的数据进行匹配,并计算每个网页与关键词的相关度。

搜索引擎使用一系列的算法来判断网页的相关度,其中最著名的算法是PageRank算法,它根据网页之间的链接关系来评估网页的重要性。

搜索引擎会根据相关度对搜索结果进行排序,并将最相关的网页显示在前面。

除了以上的基本步骤,搜索引擎还会考虑一些其他因素来提高搜索结果的质量。

例如,搜索引擎会考虑网页的可信度和权威性,以及用户的搜索历史和地理位置等因素。

此外,搜索引擎还会提供搜索建议、相关搜索和过滤器等功能,以帮助用户更准确地找到他们所需的信息。

总结起来,搜索引擎通过爬取、索引和排序的过程,帮助用户在海量的互联网信息中快速、准确地找到所需的内容。

搜索引擎的工作原理是一个复杂而精密的系统,它不仅需要高效的爬虫程序和索引算法,还需要考虑用户需求和信息质量等因素,以提供优质的搜索结果。

搜索引擎蜘蛛地工作原理

一、蜘蛛搜索引擎用来爬行和访问页面的程序被称为蜘蛛(spider),也叫机器人(bot)。

搜索引擎蜘蛛访问网站页面时类似于普通用户使用浏览器。

蜘蛛程序发出页面访问请求后,服务器返回HTML代码,蜘蛛程序把收到的代码存入原始页面数据库。

搜索引擎为了提高爬行和抓取的速度,都使用多个蜘蛛分布爬行。

蜘蛛访问网站时,首先会访问网站根目录下的robots.txt文件。

如果robots.txt文件禁止搜索引擎抓取某些网页或者内容,再或者网站,蜘蛛将遵循协议,不对其进行抓取。

蜘蛛也是有自己的代理名称的,在站长日志中可以看出蜘蛛爬行的痕迹,所以为什么这么多站长解答问题的时候会说先查看网站日志(作为一个出色的SEO你必须具备不借助任何软件查看网站日志的能力,并且要非常熟悉其代码的意思)。

二、追踪链接由于搜索引擎蜘蛛为了能够抓取网上尽量多的页面,它会追踪网页上的链接,从一个页面爬到下一个页面,就好像是蜘蛛在蜘蛛网上爬行那样,这就是搜索引擎蜘蛛这个名称的来因。

整个互联网网站都是相互链接组成的,也就是说,之处从任何一个页面出发最终会爬完所有页面。

当然网站和页面链接结构太过于复杂,所以蜘蛛只有采用一定的方法才能够爬完所有页面。

最简单的爬行策略有两种,一种是深度优先,另一种是广度优先。

深度优先是指蜘蛛沿着发现的链接一直向前爬行,直到前面再也没有其他链接,然后返回到第一个页面,沿着另一个链接再一直往前爬行。

广度优先是指蜘蛛在一个页面发现多个链接时,不是顺着一个链接一直向前,而是把页面上所有链接都爬一遍,然后再进入第二层页面沿着第二层上发现的链接爬向第三层页面。

从理论上说,无论是深度优先还是广度优先,只要给蜘蛛足够的时间,都能爬完整个互联网。

在实际工作中,蜘蛛的带宽资源、时间都不是无限的。

也不能爬完所有页面。

实际上最大的搜索引擎也只是爬行和收录了互联网的一小部分。

因此,为了尽量多的抓取用户信息,深度优先和广度优先通常是混合使用的,这样既可以照顾到尽量多的网站,也能照顾到一部分网站的内页。

搜索引擎的工作原理

搜索引擎的工作原理搜索引擎是一种用于帮助用户找到互联网上相关信息的工具。

它通过收集、索引和排序互联网上的网页内容,以便用户可以通过关键词搜索来获取相关的信息。

下面将详细介绍搜索引擎的工作原理。

一、网络爬虫搜索引擎的第一步是使用网络爬虫(也称为蜘蛛或机器人)来收集互联网上的网页内容。

网络爬虫会从一个起始网页开始,然后通过网页上的链接不断地跳转到其他网页,以此类推,直到爬取到互联网上的大部分网页。

爬虫会将爬取到的网页内容保存到搜索引擎的数据库中,以备后续的索引和排序。

二、网页索引搜索引擎的第二步是对收集到的网页内容进行索引。

索引是一个包含关键词和网页相关信息的数据库。

搜索引擎会对每个网页的标题、正文、URL等进行解析,并提取出其中的关键词。

然后将这些关键词和网页的相关信息存储到索引数据库中,以便后续的搜索查询。

三、搜索算法搜索引擎的第三步是使用搜索算法来对索引数据库中的网页进行排序。

搜索算法会根据用户输入的关键词,从索引数据库中找到包含这些关键词的网页,并根据一定的规则和权重来确定每个网页的相关性。

相关性较高的网页会在搜索结果中排名较靠前,以便用户更容易找到相关的信息。

四、搜索结果展示搜索引擎的最后一步是将排序后的搜索结果展示给用户。

搜索引擎会根据用户的搜索查询,从索引数据库中获取相关的网页,并将这些网页的标题、摘要和URL等信息展示给用户。

用户可以通过点击搜索结果中的链接来访问具体的网页,以获取更详细的信息。

除了上述的基本工作原理外,搜索引擎还会考虑其他因素来提高搜索结果的质量和准确性。

例如,搜索引擎会根据网页的信誉度、页面质量、用户反馈等因素来调整搜索结果的排序。

此外,搜索引擎还会根据用户的搜索历史和地理位置等信息来个性化搜索结果,以提供更符合用户需求的搜索体验。

总结起来,搜索引擎的工作原理包括网络爬虫的收集、网页索引的建立、搜索算法的排序以及搜索结果的展示。

通过这些步骤,搜索引擎能够帮助用户快速、准确地找到所需的信息。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

搜索引擎蜘蛛机器人工作原理

现代意义上的搜索引擎的祖先,是1990年由蒙特利尔大学学生Alan Emtage发明的Archie。

虽然当时World Wide Web还未出现,但网络中文件传输还是相当频繁的,而且由于大量的文件散布在各个分散的FTP主机中,查询起来非常不便,因此Alan Emtage想到了开发一个可以以文件名查找文件的系统,于是便有了Archie。

Archie工作原理与现在的搜索引擎已经很接近,它依靠脚本程序自动搜索网上的文件,然后对有关信息进行索引,供使用者以一定的表达式查询。

由于Archie深受用户欢迎,受其启发,美国内华达System Computing Services大学于1993年开发了另一个与之非常相似的搜索工具,不过此时的搜索工具除了索引文件外,已能检索网页。

当时,“机器人”一词在编程者中十分流行。

电脑“机器人”(Computer Robot)是指某个能以人类无法达到的速度不间断地执行某项任务的软件程序。

由于专门用于检索信息的“机器人”程序象蜘蛛一样在网络间爬来爬去,因此,搜索引擎的“机器人”程序就被称为“蜘蛛”程序。

网络蜘蛛即Web Spider,是一个很形象的名字。

把互联网比喻成一个蜘蛛网,那么Spider 就是在网上爬来爬去的蜘蛛。

网络蜘蛛是通过网页的链接地址来寻找网页,从网站某一个页面(通常是首页)开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一直循环下去,直到把这个网站所有的网页都抓取完为止。

如果把整个互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。

对于搜索引擎来说,要抓取互联网上所有的网页几乎是不可能的,从目前公布的数据来看,容量最大的搜索引擎也不过是抓取了整个网页数量的百分之四十左右。

这其中的原因一方面是抓取技术的瓶颈,100亿网页的容量是100times;2000G字节,即使能够存储,下载也存在问题(按照一台机器每秒下载20K计算,需要340台机器不停的下载一年时间,才能把所有网页下载完毕)。

同时,由于数据量太大,在提供搜索时也会有效率方面的影响。

因此,许多搜索引擎的网络蜘蛛只是抓取那些重要的网页,而在抓取的时候评价重要性主要的依据是某个网页的链接深度。

在抓取网页的时候,网络蜘蛛一般有两种策略:广度优先和深度优先(如下图所示)。

广度优先是指网络蜘蛛会先抓取起始网页中链接的所有网页,然后再选择其中的一个链接网

页,继续抓取在此网页中链接的所有网页。

这是最常用的方式,因为这个方法可以让网络蜘蛛并行处理,提高其抓取速度。

深度优先是指网络蜘蛛会从起始页开始,一个链接一个链接跟踪下去,处理完这条线路之后再转入下一个起始页,继续跟踪链接。

这个方法有个优点是网络蜘蛛在设计的时候比较容易。

由于不可能抓取所有的网页,有些网络蜘蛛对一些不太重要的网站,设置了访问的层数。

例如,在上图中,A为起始网页,属于0层,B、C、D、E、F属于第1层,G、H属于第2层,I属于第3层。

如果网络蜘蛛设置的访问层数为2的话,网页I是不会被访问到的。

这也让有些网站上一部分网页能够在搜索引擎上搜索到,另外一部分不能被搜索到。

对于网站设计者来说,扁平化的网站结构设计有助于搜索引擎抓取其更多的网页。

网络蜘蛛在访问网站网页的时候,经常会遇到加密数据和网页权限的问题,有些网页是需要会员权限才能访问。

当然,网站的所有者可以通过协议让网络蜘蛛不去抓取,但对于一些出售报告的网站,他们希望搜索引擎能搜索到他们的报告,但又不能完全免费的让搜索者查看,这样就需要给网络蜘蛛提供相应的用户名和密码。

网络蜘蛛可以通过所给的权限对这些网页进行网页抓取,从而提供搜索。

而当搜索者点击查看该网页的时候,同样需要搜索者提供相应的权限验证。