第三讲 回归结果处理和大样本OLS

第三讲 回归结果处理和大样本OLS

命令1:est table est table m_1 m_2 m_3 est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) star est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) star(0.1 0.05 0.01)

对数形式的选择与解释

例题

例一:利用wage2的数据检验明瑟(mincer) 工资方程的简单形式: ln(wage)=b0+b1*educ+b2*exper +b3*exper^2+ u Ln(wage)=b0+b1*ln(educ)+b2*exper +b3*exper^2+ u 比较含义

Stata结果的呈现

回归的假设检验(wald检验)

test命令 例一 sysuse auto, clear reg price mpg weight length 1。检验参数的联合显著性 2。分别检验各参数的显著性

例二: use wage2, clear reg lnwage educ tenure exper exper2 1。教育(educ)和工作时间(tenure)对工资的 影响相同。 2。工龄(exper)对工资没有影响 3。检验 educ和 tenure的联合显著性

非线性检验:testnl

命令格式: testnl 表达式 表达式中的变量格式为:_b[变量名] 例一: sysuse auto,clear gen weight2 = weight^2 reg price mpg trunk length weight weight2 foreign

1. 检验mpg与weight为倒数关系 testnl _b[mpg] = 1/_b[weight] 2. 检验mpg与weight为倒数关系,同 时trunk与length也为倒数关系。 testnl (_b[mpg] = 1/_b[weight]) (_b[trunk] = 1/_b[length])

stata第三讲【山大陈波】

例题:利用MLE方法估计下列两个方程: 1.price=b0+b1*weight+b2*length+ε 2.price=b0+b1*weight+b2*length+b3*mpg+ε 利用wald检验和LR检验验证:b3=0

sysuse auto,clear ml model lf myprog (price = weight length) (sigma:) ml max est store r0 ml model lf myprog (price = weight length mpg) (sigma:) ml max est store r1

异方差的检验与FGLS

异方差是违背了球型扰动项假设的一种情形。 在存在异方差的情况下: (1)OLS 估计量依然是无偏、一致且渐近 正态的。 (2)估计量方差Var(b|X) 的表达式不再是 σ2(X’X)−1,因为Var(ε|X) ≠σ2I。 (3)Gauss-Markov 定理不再成立,即OLS 不再是最佳线性无偏估计(BLUE)。

参数约束检验的三大方法: Wald检验 似然比检验(LR) 拉格朗日乘数检验(LM) 注意: 1。参数约束检验不仅用于MLE中,同时可以用在其 他计量方法中。 2。由于LM检验在后面的计量模型中广泛使用,检验 过程与模型设定密切相关,因此stata没有提供单纯 使用LM进行检验的命令,只能通过手动计算的方法, 因此,在此我们重点关注前两种检验。

Stata上机实验

大样本OLS

大样本OLS经常采用稳健标准差估计(robust) 稳健标准差是指其标准差对于模型中可能存 在的异方差或自相关问题不敏感,基于稳健 标准差计算的稳健t统计量仍然渐进分布t分布。 因此,在Stata中利用robust选项可以得到异 方差稳健估计量。

大样本OLS

第 5 章大样本 OLS5.1 为何需要大样本理论“大样本理论”(large sample theory),也称“渐近理论”(asymptotic theory),研究当样本容量n 趋无穷时统计量的性质。

大样本理论近年来大受欢迎的原因如下。

(1)小样本理论的假设过强。

小样本理论的严格外生性假设要求解释变量与所有的扰动项均正交。

在时间序列模型中,这意味着1解释变量与扰动项的过去、现在与未来值全部正交!2自回归模型必然违背此假定。

大样本理论只要求解释变量与同期扰动项不相关。

例yt=βy t -1 +εt ,其中E( y t -1εt ) = 0。

由于εt 是yt的一部分,故二者相关,即E( y ε) = E[(βy +ε)ε]=βE( y ε) + E(ε2 ) = E(ε2 ) > 0 t t t -1 t t t -1 t t t小样本理论假定扰动项为正态分布,大样本理论无此限制。

(2)小样本的精确分布(exact distribution)难推导。

大样本的渐近分布较易推导。

(3)大样本理论要求样本容量较大,至少n ≥ 30,最好100 以上。

345.2 随机收敛1. 确定性序列的收敛定义 确定性序列{a }∞ = {a , a , a , }“收敛”(converges)于常 n n =1 1 2 3 数 a ,记为lim a n →∞ = a 或a n → a ,如果∀ε > 0,存在N > 0,只要n > N ,就有 a n - a < ε ,即{a N +1, a N +2 , }均落入区间(a - ε , a + ε )内。

图 5.1 确定性序列的收敛n2. 随机序列的收敛定义随机序列{x }∞ ={x , x , x , }“依概率收敛”(converges inn n=1 1 2 3probability)于常数a,记为p l im xn =a,或xn−p−→a,如果∀ε > 0,n→∞当n →∞时,都有lim Pn→∞ xn-a >ε)= 0 。

ols、固定效应和随机效应解释变量的回归结果

ols、固定效应和随机效应解释变量的回归结果下载提示:该文档是本店铺精心编制而成的,希望大家下载后,能够帮助大家解决实际问题。

文档下载后可定制修改,请根据实际需要进行调整和使用,谢谢!本店铺为大家提供各种类型的实用资料,如教育随笔、日记赏析、句子摘抄、古诗大全、经典美文、话题作文、工作总结、词语解析、文案摘录、其他资料等等,想了解不同资料格式和写法,敬请关注!Download tips: This document is carefully compiled by this editor. I hope that after you download it, it can help you solve practical problems. The document can be customized and modified after downloading, please adjust and use it according to actual needs, thank you! In addition, this shop provides you with various types of practical materials, such as educational essays, diary appreciation, sentence excerpts, ancient poems, classic articles, topic composition, work summary, word parsing, copy excerpts, other materials and so on, want to know different data formats and writing methods, please pay attention!OLS、固定效应和随机效应解释变量的回归结果1. 引言线性回归是统计学中常用的一种方法,用于探究自变量与因变量之间的关系。

ols regression results表的结果解读

ols regression results表的结果解读1. 被解释变量(Dependent Variable):这是你要预测或解释的变量,通常用Y 表示。

2. 解释变量(Independent Variable):这些是用来预测被解释变量的变量,通常用X1, X2, ..., Xk 表示。

3. 回归系数(Coefficients):这一列显示了每个解释变量对被解释变量的影响程度。

系数的大小表示当解释变量增加一个单位时,被解释变量的预期变化量。

正的系数表示正相关关系,负的系数表示负相关关系。

4. 标准误差(Std. Error):这是每个回归系数的标准误差,用于衡量估计值的精度。

较小的标准误差意味着估计值更可靠。

5. t 统计量(t-Statistic):这是用于检验每个回归系数是否显著不为零的统计量。

它计算了回归系数与零假设之间的差异,并根据自由度进行调整。

较高的t 值表示回归系数与零假设有较大的差异,更有可能拒绝零假设。

6. 概率(P-Value):这是每个回归系数的p 值,用于确定回归系数是否显著。

p 值越小,说明拒绝零假设的证据越强。

通常,我们使用一个特定的显著性水平(如0.05)来判断是否拒绝零假设。

7. R-squared(R-squared):这是衡量回归模型解释被解释变量变异的比例的指标。

它表示自变量对被解释变量的解释能力。

R-squared 的取值范围在0 到1 之间,越高表示模型的解释能力越强。

8. 调整后的R-squared(Adjusted R-squared):这是一种调整了自由度的R-squared 指标,用于考虑自变量数量对模型拟合效果的影响。

它通常比R-squared 稍微小一些,但在自变量数量较多时更能准确反映模型的拟合效果。

9. 残差标准误差(Residual Standard Error):这是模型预测误差的标准差,用于衡量模型的精度。

较小的残差标准误差意味着模型的预测更准确。

第5章-大样本OLS

渐近标准正态的平方服从渐近 (1) 分布。

12

5.3 大数定律与中心极限定理 1.弱大数定律(Weak Law of Large Numbers) 假定 xn n1为独立同分布的随机序列, 且 E( x1 ) , Var( x1 ) 2 存 1 n p 。 在,则样本均值 xn i 1 xi n

1

自回归模型必然违背此假定。大样本理论只要求解释变量与同 期扰动项不相关。 例

yt yt 1 t ,其中 E( yt 1 t ) 0 。

由于 t 是 yt 的一部分,故二者相关,即

E( yt t ) E ( yt 1 t ) t E( yt 1 t ) E( t2 ) E( t2 ) 0

n

p a ,如果 0 , probability)于常数 a,记为 plim xn a ,或 xn

当 n 时,都有 lim P xn a 0 。

n

任 意 给 定 0 , 当 n 越 来 越 大 时 , 随 机 变 量 xn 落 在 区 间 (a , a ) 之外的概率收敛于 0。

证明:因为 E( xn ) ,而 2 x1 xn 1 2 故 xn 依均方收敛于 。 0, Var( xn ) Var 2 n n n n p 因此, xn 。样本无限大时,样本均值趋于总体均值,故名 “大数定律” 。

ˆ ) E( ˆ ) E E( ˆ) ˆ E( ˆ ) 2E ˆ E( E 2 ˆ ˆ ˆ ˆ ˆ Var( ) 2E E( ) E( ) Bias( )

python的ols回归格式

Python的OLS(Ordinary Least Squares)回归是统计学中常用的线性回归分析方法,该方法通过最小化观测值与回归线的残差平方和来估计自变量对因变量的影响程度。

在本文中,我们将深入探讨Python 中OLS回归的格式和相关内容。

一、准备工作在使用Python进行OLS回归之前,首先需要安装必要的库和模块。

常用的统计学库包括statsmodels和Pandas,通过以下代码可以轻松导入这些库:```pythonimport numpy as npimport pandas as pdimport statsmodels.api as sm```二、数据准备在进行OLS回归分析之前,需要准备好要分析的数据集。

通常情况下,数据集以DataFrame的形式存储在.csv或.xlsx文件中,可以通过Pandas库的read_csv()或read_excel()函数进行读取。

假设我们有一个包含自变量X和因变量Y的数据集data.csv,可以使用以下代码加载数据:```pythondata = pd.read_csv('data.csv')X = data['X']Y = data['Y']```三、添加截距在进行OLS回归分析时,通常会添加一个截距项。

在Python的OLS 回归中,可以通过Statsmodels库的add_constant()函数为自变量添加截距。

具体操作如下:```pythonX = sm.add_constant(X)```四、拟合模型添加截距项后,接下来就可以利用Statsmodels库的OLS()函数拟合回归模型。

该函数的参数包括因变量Y和自变量X,拟合过程如下:```pythonmodel = sm.OLS(Y, X).fit()```五、查看回归结果拟合回归模型后,可以通过summary()方法查看OLS回归结果的详细信息,包括回归系数、截距、残差、拟合优度等指标。

计量经济学4简单的回归模型OLS

残差:yi的实际值与拟合值之差:

ui yi yi yi 0 1xi

7

• 最小化残差平方和:

n

2

n

ui

( yi 0 1xi )2

i 1

i 1

8

• 样本回归函数:(总体回归函数的一个样本估计)

y 0 1x

y 1x

• 描述了x变化如何引起y的变化,解释变量对被解释变量 的影响

n

2

( yi y)

i1

i 1

11

• 改变变量单位的影响。

12

• 在简单回归中加入非线性因素: • 加入自然对数

• 例如: log(wage) 0 1edu

• 1 描述了教育每增加一个单位 工资所增加的百

分比

13

OLS估计量的特征

• 假定1: y 0 1x u • 假定2:xi,yi为总体模型方程的随机样本,样

16

Var(1)

2

2

n

(xi x)2

SSTx

i 1

17

• 误差方差的估计:

• 误差与残差的区别

• 误差:u, error term

• 残差: u residual

• 无偏估计:

2

1

n

2

ui

SSR

n 2 i1

n2

18

简单回归模型应了解:

• 1、计量模型的思路: • (1)找到感兴趣的问题 • (2)建立函数关系 • (3)建立数据库 • (4)回归,得到函数关系中的参数,分析

变量间影响 • (5)分析估计量统计特征 • (6)对模型进行检验

19

本容量n

• 假定3: E( | x) 0

第6章大样本OLS6.1为何需要大样本理论

9

根据大样本理论,只要研究统计量的大样本分布,即当n 时 的渐近分布,相对容易推导(可使用大数定律与中心极限定理)。

(3) 使用大样本理论的代价是要求样本容量较大,以便大数定律 与中心极限定理可以起作用。

.4

.2

0

0

0

500

1000

1500

wage

kdensity wage

kdensity lnw

图 6.1 工资与工资对数的分布

工资的分布与正态分布相去甚远。

即使工资对数,在取值范围为(, ) 这一点上,严格来说也 与正态分布不符。

6

被解释变量的分布可能为各种形状;有时即使取对数也不能使 其接近正态分布。

无论教育年限还是其对数,都与“单峰”的正态分布相去甚远。

8

通过取对数使得变量的分布接近于正态并非万能(对于像工资那 样的单峰右偏分布比较有效)。

对于小样本理论来说,为了进行统计推断(比如,推导t 统计量与 F 统计量的有限样本分布),必须假设扰动项服从正态分布(故被解 释变量也服从正态分布)。

由于现实中的被解释变量可能服从各种分布(比如,变量婚否 mrt 为离散的两点分布),故基于正态假设的小样本理论的适用范 围受到很大限制。

定义

确定性序列an

n1

a1,

a2

,

a3

,收敛(converge)于常数

a,

记

为

lim

n

an

a

或 an

a ,如果对于任意小的正数

0 ,都存在

N 0 , 只 要 n N , 就 有 an a , 即 在 aN 以 后 的 序 列

第5 章 大样本OLS

教学用PPT,《高级计量经济学及Stata应用》,陈强编著,高等教育出版社,© 2010年第5章大样本OLS5.1为何需要大样本理论“大样本理论”(large sample theory),也称为“渐近理论”(asymptotic theory),研究的是当样本容量n趋向无穷大时统计量的性质。

大样本理论的重要性在于,(1)小样本理论的假设过强。

(2)在小样本下,我们必须研究统计量的精确分布,但常常难以推导。

(3)使用大样本理论的代价是要求样本容量较大,一般n≥。

由于现代的数据集越来越大,经常成百要求至少30上千,渐近理论就是对实际数据的很好近似。

5.2随机收敛的概念1.确定性序列的收敛定义 确定性序列{}1n n a ∞=“收敛”于常数a ,记为lim nn aa →∞=或n a a →,如果0ε∀>,存在0N >,只要n N ∀>,就有n a a ε−<,即{}12,,N N a a ++"均落入区间(,)a a εε−+内。

图5.1、确定性序列的收敛aa ε+a ε−2.随机序列的收敛定义 随机序列{}1n n x ∞=“依概率收敛”于常数a ,记为plim nn x a →∞=,或pn x a ⎯⎯→,如果0ε∀>,当n →∞时,都有()lim P 0n n x a ε→∞−>=。

图5.2、随机序列的收敛定义 随机序列{}1n n x ∞=“依概率收敛”于随机变量x ,记为pn x x ⎯⎯→,如果随机序列{}1n n x x ∞=−依概率收敛于0。

命题(连续函数与概率收敛可交换运算次序):假设()g ⋅为连续函数,则plim ()plim n n n n g x g x →∞→∞⎛⎞⎟⎜=⎟⎜⎝⎠。

证明:使用连续函数与依概率收敛的定义(略)。

从直观上可以理解为,当n x 的分布越来越集中于某x 附近时,()n g x的分布自然也就越来越集中于()g x 附近。

ols的基本假定

ols的基本假定

OLS,即最小二乘法,是一种经典的回归分析方法。

虽然它被广

泛使用,但它在应用中需要满足一些基本的假设。

第一个基本假设是线性关系。

OLS要求因变量和自变量之间存在

线性关系。

换句话说,自变量的变化会导致因变量的相应变化。

第二个基本假设是无多重共线性。

多重共线性是指两个或多个自

变量之间存在高度相关性。

这种情况下,OLS不能准确地估计每个系数的影响,因为它们不再是独立的。

第三个基本假设是零条件均值。

OLS要求每个自变量与残差之间

不存在相关性,即残差的平均值为0。

第四个基本假设是同方差性。

如果残差的方差不同,则OLS不能

准确地估计每个系数的影响。

因此,同方差性假设要求残差的方差在

整个数据集中是相同的。

最后一个基本假设是正态分布。

OLS要求残差分布是正态分布的。

如果残差分布不是正态分布的,则OLS可能会导致不准确的预测结果。

总的来说,OLS需要满足这些基本假设才能产生可靠的预测结果。

当这些假设被违反时,我们必须考虑使用其他回归方法或采取其他措

施来解决问题。

op法、lp 法和ols法 -回复

op法、lp 法和ols法-回复"OP法、LP法和OLS法"是统计学中常用的数据分析方法。

本文将逐步解释和比较这三种方法,以帮助读者更好地理解它们的使用和适用范围。

第一步:介绍OP法OP法(Ordinary Pointwise法)是一种常用的非参数统计方法,用于比较两个或多个样本的差异。

它的基本原理是将每个样本中的观测值配对,然后比较配对后的差异。

通过计算每个配对之间的差异,并对这些差异进行统计推断,我们可以得出样本之间差异的结论。

OP法的优点在于它不依赖于分布假设,适用于不符合正态分布的数据。

此外,OP法还可以用于数据的非对称性和离群值分析。

然而,OP方法的一个主要限制是它对数据点的排列顺序敏感,因此需要小心地选择数据的排列顺序。

第二步:介绍LP法LP法(Linear Programming法)是一种常用的优化方法,用于解决线性规划问题。

线性规划是一种数学模型,用于在给定约束条件下最大化或最小化线性目标函数。

LP法的基本思想是通过线性规划模型来解决问题,其中约束条件和目标函数都是线性的。

LP法的优点在于它可以处理复杂的约束条件,并且可以在较短的时间内找到全局最优解。

此外,LP法还可以用于多目标优化和灵活约束条件的处理。

然而,LP方法的一个主要限制是它只适用于线性问题,对于非线性问题并不适用。

第三步:介绍OLS法OLS法(Ordinary Least Squares法)是一种最小二乘法,常用于线性回归模型的估计。

OLS法的基本原理是通过最小化实际观测值和预测值之间的残差平方和来估计模型的参数。

通过最小二乘法估计的参数可以用于预测未来的观测值,评估模型的拟合优度以及进行统计推断。

OLS法的优点在于它是一种无偏估计方法,具有较好的数学性质和较小的估计误差。

此外,OLS法还可以进行统计推断和参数检验,并提供有关模型拟合优度的指标。

然而,OLS方法的一个主要限制是它对线性关系的假设,不适用于非线性问题。

python ols用法 -回复

python ols用法-回复OLS(最小二乘法)是一种常用的统计分析方法,用于拟合包含多个自变量的线性回归模型。

在本文中,我们将逐步回答关于OLS的用法的问题,并了解如何在Python中使用它。

第一部分:什么是OLS?OLS是一种基于最小化误差平方和的线性回归方法。

它的主要思想是通过拟合一条直线或平面,使得模型的预测值与实际观测值之间的误差最小化。

OLS假设误差项满足一些基本的假设,如线性关系、常数方差和无自相关性。

第二部分:如何使用OLS进行线性回归分析?要使用OLS进行线性回归分析,我们需要准备如下的数据:1. 因变量(依赖变量):这是我们希望预测或解释的变量。

2. 自变量(独立变量):这些是我们用来对因变量进行预测或解释的变量。

可以有一个或多个自变量。

在Python中,我们可以使用statsmodels库来进行OLS分析。

首先,我们需要安装statsmodels库。

可以使用pip安装,命令为:pip install statsmodels然后我们需要导入相关的库和数据。

以下是一个例子:pythonimport pandas as pdimport statsmodels.api as sm# 导入数据data = pd.read_csv('data.csv')# 指定因变量和自变量y = data['y']X = data[['x1', 'x2', 'x3']]在导入库和数据之后,我们可以使用statsmodels的OLS函数创建一个模型对象,并使用fit方法进行拟合。

拟合的结果将包含有关模型的信息,例如系数、标准误差和显著性水平等。

python# 创建OLS模型对象并进行拟合model = sm.OLS(y, X)results = model.fit()# 打印模型结果print(results.summary())第三部分:如何解读OLS结果?OLS拟合的结果提供了很多信息,帮助我们解释变量之间的关系。

45PPT-第6章-大样本OLS-计量经济学及Stata应用

机序列 xn n1依分布收敛(converge in distribution)于随机变量 x ,记

d x ,并称 x 的分布为 xn 的渐近分布(asymptotic distribution) 为 xn 或极限分布(limiting distribution)。

当 n 时, xn 的分布函数越来越像 x 的分布函数。

量 x ,意味着 xn 的每个分量都依概率收敛至 x 的相应分量,记为 plim xn x 。

n

3.依均方收敛 定义 如果随机序列 xn n1的期望收敛于 a,即 lim E( xn ) a ;而

方差收敛于 0,即 lim Var( xn ) 0 ,则称 xn n1依均方收敛(converge

10

6.2 随机收敛 1.确定性序列的收敛 定义 确定性序列an n1 a1 , a2 , a3 , 收敛(converge)于常数 a,

n

记为 lim an a 或 an a ,如果对于任意小的正数 0 ,都存在

aN 1 , aN 2 , 均落入区间 (a , a ) 内,参见图 6.3。

© 陈强,2015 年,《计量经济学及 Stata 应用》,高等教育出版社。

第 6 章 大样本 OLS 6.1 为何需要大样本理论 “大样本理论” (large sample theory), 也称 “渐近理论” (asymptotic theory),研究当样本容量 n 趋向无穷大时统计量的性质。 大样本理论已成为当代计量经济学的主流方法,原因如下。 (1) 小样本理论的假设过强。 首先,小样本理论的严格外生性假设要求解释变量与所有的扰 动项均正交(不相关)。

7

2.2 .3

120-演示文稿-多元线性回归模型的OLS估计

RSS

N i 1

ˆ

2

总总总总总总总总 K+1 总总总总总总

损失了 K+1 个自由度。

3. ESS 总总总总总 K 总 ESS ˆ1

N i 1

(

yi

x1i

)

ˆ

K

N i 1

(

yi

x

Ki

)

总 K 总总总总总总总总总总总

ˆk

N i 1

(

yi

xki

)

总总总总总 1 总

《计量经济学》,高教出版社 2011 年 6 月,王少平、杨继生、欧14阳志刚等

《计量经济学》,高教出版社 2011 年 6 月,王少平、杨继生、欧4阳志刚等

假定 7 :回归模型的解释变量之间不 能存在完全的多重共线性。

“ 完全的多重共线性”:是指一个解释变量是 其他解释变量的线性组合 。说明该解释变量 所提供的信息与其他解释变量是完全重复的 。

当存在完全共线性时,模型的参数不可识别。即任 何方法都无法得到参数估计值,包括 OLS 。

组中的 K+1 个约束估计了 K+1 个回归系数,所以损失 了 K+1 个自由度,独立的观测信息只剩下 N-(K+1) 个。

《计量经济学》,高教出版社 2011 年 6 月,王少平、杨继生、欧11阳志刚等

三、判定系数的调整

总总总总总总总总总总总总总总总总总总

TSS = ESS+RSS

判定系数

R2

ESS TSS

《计量经济学》,高教出版社 2011 年 6 月,王少平、杨继生、欧13阳志刚等

基本统计量 TSS 、 RSS 、 ESS 的自由度:

1. TSS 总总总总总 N-1 总总总总总总总 N 总

计量经济学4简单的回归模型OLS

残差:yi的实际值与拟合值之差:

ui yi yi yi 0 1xi

7

• 最小化残差平方和:

n

2

n

ui

( yi 0 1xi )2

i 1

i 1

8

• 样本回归函数:(总体回归函数的一个样本估计)

y 0 1x

y 1x

• 描述了x变化如何引起y的变化,解释变量对被解释变量 的影响

• 零条件均值假定:

E( | x) 0

3

• 四类数据的关系: • 1 真值 • 2 预测值 • 3 估计值 • 4 观察值

4

• 总体回归函数(population regression function PRF):

E( y | x) 0 1x

• 给出了不同x水平上y的平均水平之间的关系

y E( y | x) u 0 1x u

变量间影响 • (5)分析估计量统计特征 • (6)对模型进行检验

19

• 2 了解术语,及其中含义 • 真值,估计值,观察值,误差项,拟合值,

残差,拟合优度。。。

• 3 估计量的统计特征 • 无偏性,方差估计。。。

20

2

SSE ( yi y)

i 1

• 残差平方和(residual sum of squares)(度量了残

差的波动):

n2

SSR ui

i 1

10

SST SSE SSR

• 拟合优度:

R2 SSE / SST 1 SSR / SST

n

2

(yi y)

n2

ui

R2

i 1

n

2

( yi y)

1 i1

n2( yi y)i1i 111

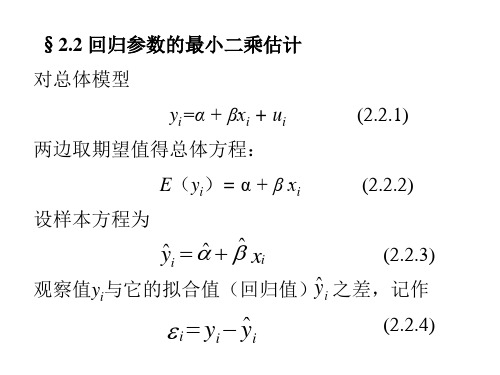

(1)2.2回归参数OLS估计

ˆˆ

n xi

xi xi2

1

yi xi yi

xi2 xi

n

xi

n

xi

xi

yi xi yi

xi2

xi2 yi xi xi yi n xi yi xi yi n xi2 ( xi)2

根据克莱姆法则,有解

yi xi

ˆ xi yi xi2 n xi xi xi2

n yi

ˆ xi xi yi n xi xi xi2

或者将正规方程组写成:

n xi

xi xi2

ˆˆ

yi xi yi

(2.2.7) ′

② i xi 0

(2.2.8) ′

表明自变量与残差不相关,即协方差为零。

③ ( x, y )在样本直线上

(2.2.7) ,(2.2.8), (2.2.7) ′, (2.2.8) ′ 称为正规方

程组,也称为OLS估计值的一阶条件。

解正规方程(2.2.7)、(2.2.8),得,的表达式:

(2.2.11)

ˆ xi yi (2.2.12)

xi2

作业:

一、利用正规方程(2.2.7) ′和(2.2.8) ′可以证明:

1. yˆ y

2. yˆi 和 i 之间的样本协方差为零,即 yˆi i 0

二、证明模型(2.2.1)的参数估计:

yi xi

n yi

观察值yi与它的拟合值(回归值)yˆi 之差,记作

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

我们可以利用矩阵运算的方法将回归结果展 现的所有统计量都手动计算出来。 大家有兴趣回去做一遍,可以加深你对这些 知识的理解。

逐步回归法

逐步回归法分为逐步剔除和逐步加入。 逐步剔除又分为逐步剔除(Backward selection)和逐步分层 剔除(Backward hierarchical selection) 1。逐步剔除 stepwise, pr(显著性水平): 回归方程 例如:对auto数据 Stepwise,pr(0.05):reg price mpg rep78 headroom trunk weight length turn displacement gear_ratio foreign 2。逐个分层剔除 Stepwise,pr(0.05) hier:reg price mpg rep78 headroom trunk weight length turn displacement gear_ratio

矩阵运算

1。手动建立矩阵命令:matrix Mat input 矩阵变量名=(矩阵) 同一行元素用,分隔 不同行元素用\分割 建立矩阵 : 3 6 8 5 11 7 2 18 16

显示矩阵变量 mat dir 显示矩阵内容 Mat list 矩阵变量

常用矩阵运算: C=A+B A-B A*B Kronecker乘积 :C=A#B 常用矩阵函数: trace(m1) m1的迹 Diag(v1) 向量的对角矩阵 inv(m1) m1的逆矩阵

Nerlove(1963)的一篇著名 文章

为了检验美国电力行业是否存在规模经济, Nerlove(1963)收集了1955年145家美国 电力企业的总成本(TC)、产量(Q)、工资率 (PL)、燃料价格(PF)及资本租赁价格(PK)的 数据(nerlove.dta)。假设第个i企业的生 产函数为Cobb-Douglas:

2。还可以将变量转换为矩阵 mkmat 变量名表,mat(矩阵名)

练习:sysuse auto reg price mpg weight foreign 要求:利用矩阵运算手动计算出参数

1 ˆ β ( X ' X) X ' y

gen cons = 1 mkmat price, mat(y) mkmat mpg weight foreign cons, mat(X) mat b = inv(X'*X)*X'*y mat list b (还可以看一下矩阵x与y的值)

est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) se(%6.2f) est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) t(%6.2f)

命令2:esttab findit esttab esttab m_1 m_2 m_3 esttab m_1 m_2 m_3, scalar(r2 r2_a N F) star(* 0.1 ** 0.05 *** 0.01) compress esttab m_1 m_2 m_3, scalar(r2 r2_a N F) compress star(* 0.1 ** 0.05 *** 0.01) mtitles(精简模型 一般模型 较大 模型)

约束回归

例一:use production,clear cons def 1 lnl+lnk = 1 cnsreg lny lnl lnk, c(1)

例二:use nerlove,clear

cons def 1 lnpl+lnpk+lnpf=1 . cons def 2 lnq=1 . cnsreg lntc lnq lnpl lnpk lnpf, c(12)

test命令 例一 sysuse auto, clear reg price mpg weight length 1。检验参数的联合显著性 2。分别检验各参数的显著性

例二: use wage2, clear reg lnwage educ tenure exper exper2 1。教育(educ)和工作时间(tenure)对工资的 影响相同。 test educ=tenure 2。工龄(exper)对工资没有影响 test exper 或者 test exper =0 3。检验 educ和 tenure的联合显著性 test educ tenure 或者 test (educ=0) (tenure=0)

逐步加入又分为逐步加入(Forward selection)和逐步分层 加入(Forward hierarchical selection) 1。逐步加入 stepwise, pe(显著性水平): 回归方程 例如:对auto数据 Stepwise,pe(0.05):reg price mpg rep78 headroom trunk weight length turn displacement gear_ratio foreign

例二:打开production reg lny lnl lnk testnl _b[lnl] * _b[lnk] = 0.25 testnl _b[lnl] * _b[lnk] = 0.5

大样本OLS

大样本OLS经常采用稳健标准差估计(robust) 稳健标准差是指其标准差对于模型中可能存 在的异方差或自相关问题不敏感,基于稳健 标准差计算的稳健t统计量仍然渐进分布t分 布。因此,在Stata中利用robust选项可以 得到异方差稳健估计量。

1 r i

1 r i

2 r i

3 r i

取对数后得到如下模型:

3 1 1 2 log TCi 1 log Qi log PLi log PK i log PF i i r r r r

为了简单起见,我们将模型的方程设定为:

ln TC 1 2 ln Q 3 ln PL 4 ln PK 5 ln PF

Stata返回结果的读取

sysuse auto,clear reg price weight length f命令1:est table 命令2:esttab sysuse auto,clear reg price weight length est store m_1 reg price weight length foreign est store m_2 reg price weight length foreign mpg gear_ratio est store m_3

命令1:est table est table m_1 m_2 m_3 est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) star est table m_1 m_2 m_3, stat(r2 r2_a N F) b(%6.3f) star(0.1 0.05 0.01)

例三:生产函数production use production,clear reg lny lnl lnk test lnl lnk test (lnl=0.8) (lnk=0.2) test lnk+lnl=1

非线性检验:testnl

例一 sysuse auto gen weight2 = weight^2 reg price mpg trunk length weight weight2 foreign testnl _b[mpg] = 1/_b[weight] testnl (_b[mpg] = 1/_b[weight]) (_b[trunk] = 1/_b[length])

Qi Ai Li K i Fi

1

2

3

r 1 2 3

其中分别为生产率、劳动力、资本与燃料。 记为规模效应(degree of returns to scale)。假设企业追求成本最小化,可证 明其成本函数也为Cobb-Douglas:

TCi i Q PL PK PF

测算规模报酬系数 display 1/_b[lnq]

分别使用普通OLS和稳健的标准差OLS进行估 计。 结果可以看到:稳健标准差与普通标准差的估 计的系数相同,但标准差和t值存在着较大的 差别,尤其是lnq的标准差。

约束回归

定义约束条件 constraint define n 条件 约束回归语句 cnsreg 被解释变量 解释变量, constraints(条件编号)

2。逐步分层加入 Stepwise,pe(0.05) hier:reg price mpg rep78 headroom trunk weight length turn displacement gear_ratio foreign

边际效果及其解释

对数形式的选择与解释

例题

例一:利用wage2的数据检验明瑟(mincer) 工资方程的简单形式: Ln(wage)=b0+b1*educ+b2*exper +b3*exper^2+ u wage=b0+b1*educ+b2*exper +b3*exper^2+ u 比较含义

回归结果处理和大样本OLS

回归后预测值的获得

Predict 1。拟合值的获得: predict yhat, xb 或者 predict yhat 2。残差的获得 predict e , residuals 或者 predict e, res 3。 残差分布图 rvfplot yline(0)

回归的假设检验(wald检验)