回归分析spss实现

实训6教学演示:直线相关与回归分析的SPSS软件实现方法

【实训结果】

【结果解释】

实训表29相关分析结果显示,身高与前臂 长两个变量的相关系数为0.795。经检验, P=0.002(P<0.05),有统计学意义,可认为 身高与前臂长之间存在线性相关关系,且为 正相关。

项目二:回归分析

【实训目的】

运用SPSS“分析”菜单中的“回归”选项, 建立回归方程,并检验总体回归系数是否 为0,正确解释SPSS的输出结果。

【实训结果】

【结果解释】

✓ 实训表30为模型摘要表,显示了模型的拟合优度情况, 相关系数为0.795,决定系数为0.633,校正决定系数为 0.596。

✓ 实训表31为回归方程的方差分析表,显示了变异分解情 况,F=17.216,P<0.01,建立的模型具有统计学意义。

✓ 实训表32为回归系数表,给出了回归系数的估计及检验, 回归方程的常数项为10.700,身高的回归系数为0.200。 经回归系数t检验,t=4.149,P<0.01,说明身高与前臂 长之间存在线性回归关系,回归方程:^Y=10.7+0.2X。

项目一:直线相关分析

【实训目的】

运用SPSS“分析”菜单中“相关”选项, 计算相关系数,并检验两变量总体相关系 数是否为0,正确解释SPSS的输出结果。

【实训内容】

✓ 见第十一章例11-1,某医师测量12名20岁健康男大学生 的身高与前臂长,资料见表11-1。试求身高与前臂长的 相关系数。

表11-1 12名20岁健康男大学生身高与前臂长资料

实训6 直线相关与回归分析的SPSS软件实现方166

155

188

190

171

前臂 长 43 45 47 47 44 42 46 44 41 49 50 47 /cm

如何使用统计软件SPSS进行回归分析

如何使用统计软件SPSS进行回归分析如何使用统计软件SPSS进行回归分析引言:回归分析是一种广泛应用于统计学和数据分析领域的方法,用于研究变量之间的关系和预测未来的趋势。

SPSS作为一款功能强大的统计软件,在进行回归分析方面提供了很多便捷的工具和功能。

本文将介绍如何使用SPSS进行回归分析,包括数据准备、模型建立和结果解释等方面的内容。

一、数据准备在进行回归分析前,首先需要准备好需要分析的数据。

将数据保存为SPSS支持的格式(.sav),然后打开SPSS软件。

1. 导入数据:在SPSS软件中选择“文件”-“导入”-“数据”命令,找到数据文件并选择打开。

此时数据文件将被导入到SPSS的数据编辑器中。

2. 数据清洗:在进行回归分析之前,需要对数据进行清洗,包括处理缺失值、异常值和离群值等。

可以使用SPSS中的“转换”-“计算变量”功能来对数据进行处理。

3. 变量选择:根据回归分析的目的,选择合适的自变量和因变量。

可以使用SPSS的“变量视图”或“数据视图”来查看和选择变量。

二、模型建立在进行回归分析时,需要建立合适的模型来描述变量之间的关系。

1. 确定回归模型类型:根据研究目的和数据类型,选择适合的回归模型,如线性回归、多项式回归、对数回归等。

2. 自变量的选择:根据自变量与因变量的相关性和理论基础,选择合适的自变量。

可以使用SPSS的“逐步回归”功能来进行自动选择变量。

3. 建立回归模型:在SPSS软件中选择“回归”-“线性”命令,然后将因变量和自变量添加到相应的框中。

点击“确定”即可建立回归模型。

三、结果解释在进行回归分析后,需要对结果进行解释和验证。

1. 检验模型拟合度:可以使用SPSS的“模型拟合度”命令来检验模型的拟合度,包括R方值、调整R方值和显著性水平等指标。

2. 检验回归系数:回归系数表示自变量对因变量的影响程度。

通过检验回归系数的显著性,可以判断自变量是否对因变量有统计上显著的影响。

标准化的回归系数 spss

标准化的回归系数 spss在统计学中,回归系数是回归方程中自变量的系数,它表示因变量每单位变化时,自变量相应变化的程度。

在SPSS软件中,进行回归分析后,我们可以得到回归系数的估计值。

本文将介绍如何在SPSS中进行回归分析,并解释标准化的回归系数的含义和应用。

在SPSS中进行回归分析,首先需要导入数据,并选择“回归”分析。

在“回归”对话框中,将因变量和自变量添加到相应的框中。

在“统计”选项中,勾选“标准化系数”以获取标准化的回归系数。

点击“确定”后,SPSS将输出回归分析的结果,其中包括标准化的回归系数。

标准化的回归系数是指在进行回归分析时,对自变量和因变量进行标准化处理后得到的回归系数。

标准化处理可以消除不同变量之间的量纲影响,使得回归系数可以直接比较不同变量对因变量的影响程度。

标准化的回归系数的计算公式为,标准化系数=回归系数×(自变量标准差/因变量标准差)。

标准化的回归系数的绝对值表示自变量对因变量的影响程度,而正负号表示自变量对因变量的影响方向。

当标准化系数的绝对值越大时,自变量对因变量的影响越大;当标准化系数为正时,自变量和因变量呈正相关关系,为负时呈负相关关系。

标准化的回归系数在实际应用中具有重要意义。

首先,它可以帮助我们理解自变量对因变量的影响程度,从而进行变量的重要性排序。

其次,标准化系数可以用来比较不同变量对因变量的影响,找出对因变量影响最大的自变量。

此外,标准化系数还可以用来进行跨样本的比较,因为它消除了不同样本之间的量纲差异。

在解释回归分析的结果时,我们通常会关注标准化的回归系数。

通过解释标准化系数,我们可以清晰地说明自变量对因变量的影响程度和方向,从而为决策提供依据。

在学术研究和商业决策中,标准化的回归系数都扮演着重要的角色。

总之,标准化的回归系数是回归分析中的重要指标,它可以帮助我们理解自变量对因变量的影响程度和方向。

在SPSS中进行回归分析时,我们可以轻松获取标准化的回归系数,并通过解释它们来深入理解变量之间的关系。

相关分析和回归分析SPSS实现

相关分析和回归分析SPSS实现SPSS(统计包统计分析软件)是一种广泛使用的数据分析工具,在相关分析和回归分析方面具有强大的功能。

本文将介绍如何使用SPSS进行相关分析和回归分析。

相关分析(Correlation Analysis)用于探索两个或多个变量之间的关系。

在SPSS中,可以通过如下步骤进行相关分析:1.打开SPSS软件并导入数据集。

2.选择“分析”菜单,然后选择“相关”子菜单。

3.在“相关”对话框中,选择将要分析的变量,然后单击“箭头”将其添加到“变量”框中。

4.选择相关系数的计算方法(如皮尔逊相关系数、斯皮尔曼等级相关系数)。

5.单击“确定”按钮,SPSS将计算相关系数并将结果显示在输出窗口中。

回归分析(Regression Analysis)用于建立一个预测模型,来预测因变量在自变量影响下的变化。

在SPSS中,可以通过如下步骤进行回归分析:1.打开SPSS软件并导入数据集。

2.选择“分析”菜单,然后选择“回归”子菜单。

3.在“回归”对话框中,选择要分析的因变量和自变量,然后单击“箭头”将其添加到“因变量”和“自变量”框中。

4.选择回归模型的方法(如线性回归、多项式回归等)。

5.单击“统计”按钮,选择要计算的统计量(如参数估计、拟合优度等)。

6.单击“确定”按钮,SPSS将计算回归模型并将结果显示在输出窗口中。

在分析结果中,相关分析会显示相关系数的数值和统计显著性水平,以评估变量之间的关系强度和统计显著性。

回归分析会显示回归系数的数值和显著性水平,以评估自变量对因变量的影响。

值得注意的是,相关分析和回归分析在使用前需要考虑数据的要求和前提条件。

例如,相关分析要求变量间的关系是线性的,回归分析要求自变量与因变量之间存在一定的关联关系。

总结起来,SPSS提供了强大的功能和工具,便于进行相关分析和回归分析。

通过上述步骤,用户可以轻松地完成数据分析和结果呈现。

然而,分析结果的解释和应用需要结合具体的研究背景和目的进行综合考虑。

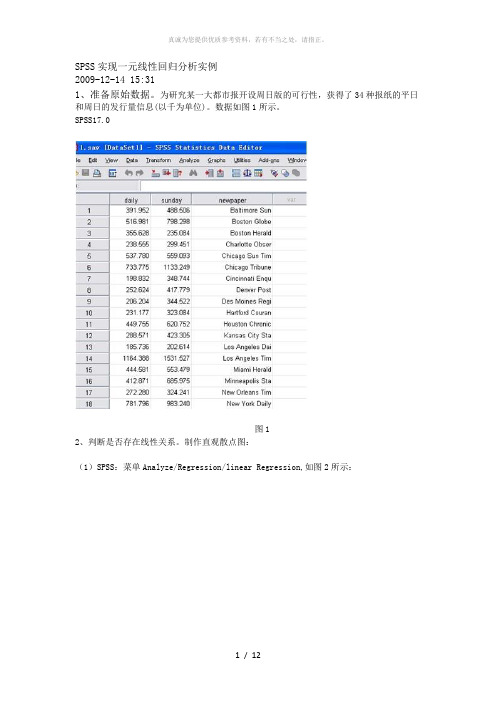

SPSS实现一元线性回归分析实例

SPSS实现一元线性回归分析实例2009-12-14 15:311、准备原始数据。

为研究某一大都市报开设周日版的可行性,获得了34种报纸的平日和周日的发行量信息(以千为单位)。

数据如图1所示。

SPSS17.0图12、判断是否存在线性关系。

制作直观散点图:(1)SPSS:菜单Analyze/Regression/linear Regression,如图2所示:图2 (2)打开对话框如图3图3图3中,Dependent是因变量,Independent是自变量,分别将左栏中的sunday选入因变量,daily选入自变量,newspaper作为标识标签选入case labels.(3)点击图3对话框中的plots按钮,如图4所示:图4将因变量DEPENTENT 选入Y:,自变量 ZPRED 选入X: continue 返回上级对话框。

单击主对话框OK.便生成散点图如图5所示:图5从以上散点图可看出,二者变量之间关系趋势呈线性关系。

2、回归方程菜单Analyze/Regression/linear Regression,在图3对话框的右边单击statistics如图6所示:图6regression coefficient回归系数,estimates估计值,confidence intervals level:95%置信区间,model fit拟合模型。

点击continue返回主对话框,单击OK.结果如图7、图8所示:图7图7中第一个图是变量的输入与输出,从图下的提示可知所有变量均输入与输出,没有遗漏。

图7中的第二图是模型总和R值,R平方值,R调整后的平方值,及标准误。

图8图8中第一图为方差统计图,包括回归平方和,自由度,方程检验F值及P值。

图8第二图为回归参数图,从图中可知,constant为回归方程截距,即13.836,回归系数为1.340,标准误分别为:35.804和0.071,及t检验值和95%的置信区间的最大值和最小值。

用spss软件进行一元线性回归分析

step2:做散点图

给散点图添加趋势线的方法: • 双击输出结果中的散点图 • 在“图表编辑器”的菜单中依次点击“元素”—“总计拟合线”,由此“属性”中加载了 “拟合线” • 拟合方法选择“线性”,置信区间可以选95%个体,应用

step3:线性回归分析

从菜单上依次点选:分析—回归—线性 设置:因变量为“年降水量”,自变量为“纬度” “方法”:选择默认的“进入”,即自变量一次全部进入的方法。 “统计量”:

step4:线性回归结果

【Anova】 (analysisofvariance方差分析) • 此表是所用模型的检验结果,一个标准的方差分析表。 • Sig.(significant )值是回归关系的显著性系数,sig.是F值的实际显著性概率即P值。 当sig. <= 0.05的时候,说明回归关系具有统计学意义。如果sig. > 0.05,说明二者 之间用当前模型进行回归没有统计学意义,应该换一个模型来进行回归。 • 由表可见所用的回归模型F统计量值=226.725 ,P值为0.000,因此我们用的这个回 归模型是有统计学意义的,可以继续看下面系数分别检验的结果。 • 由于这里我们所用的回归模型只有一个自变量,因此模型的检验就等价与系数的检验, 在多元回归中这两者是不同的。

• 勾选“模型拟合度”,在结果中会输出“模型汇总”表 • 勾选“估计”,则会输出“系数”表 “绘制”:在这一项设置中也可以做散点图 “保存”: • 注意:在保存中被选中的项目,都将在数据编辑窗口显示。 • 在本例中我们勾选95%的置信区间单值,未标准化残差 “选项”:只需要在选择方法为逐步回归后,才需要打开

利用spss进行一元线性回归

step1:建立数据文件 打开spss的数据编辑器,编辑变量视图

相关分析和回归分析SPSS实现

相关分析与回归分析一、试验目标与要求本试验项目的目的是学习并使用SPSS软件进行相关分析与回归分析;具体包括:(1)皮尔逊pearson简单相关系数的计算与分析(2)学会在SPSS上实现一元及多元回归模型的计算与检验..(3)学会回归模型的散点图与样本方程图形..(4)学会对所计算结果进行统计分析说明..(5)要求试验前;了解回归分析的如下内容..参数α、β的估计回归模型的检验方法:回归系数β的显着性检验t-检验;回归方程显着性检验F-检验..二、试验原理1.相关分析的统计学原理相关分析使用某个指标来表明现象之间相互依存关系的密切程度..用来测度简单线性相关关系的系数是Pearson简单相关系数..2.回归分析的统计学原理相关关系不等于因果关系;要明确因果关系必须借助于回归分析..回归分析是研究两个变量或多个变量之间因果关系的统计方法..其基本思想是;在相关分析的基础上;对具有相关关系的两个或多个变量之间数量变化的一般关系进行测定;确立一个合适的数据模型;以便从一个已知量推断另一个未知量..回归分析的主要任务就是根据样本数据估计参数;建立回归模型;对参数与模型进行检验与判断;并进行预测等..线性回归数学模型如下:在模型中;回归系数是未知的;可以在已有样本的基础上;使用最小二乘法对回归系数进行估计;得到如下的样本回归函数:回归模型中的参数估计出来之后;还必须对其进行检验..如果通过检验发现模型有缺陷;则必须回到模型的设定阶段或参数估计阶段;重新选择被解释变量与解释变量及其函数形式;或者对数据进行加工整理之后再次估计参数..回归模型的检验包括一级检验与二级检验..一级检验又叫统计学检验;它是利用统计学的抽样理论来检验样本回归方程的可靠性;具体又可以分为拟与优度评价与显着性检验;二级检验又称为经济计量学检验;它是对线性回归模型的假定条件能否得到满足进行检验;具体包括序列相关检验、异方差检验等..三、试验演示内容与步骤1.连续变量简单相关系数的计算与分析在上市公司财务分析中;常常利用资产收益率、净资产收益率、每股净收益与托宾Q值4个指标来衡量公司经营绩效..本试验利用SPSS对这4个指标的相关性进行检验..操作步骤与过程:打开数据文件“上市公司财务数据连续变量相关分析.sav”;依次选择“分析→相关→双变量”打开对话框如图;将待分析的4个指标移入右边的变量列表框内..其他均可选择默认项;单击ok提交系统运行..图5.1 Bivariate Correlations对话框结果分析:表给出了Pearson简单相关系数;相关检验t统计量对应的p值..相关系数右上角有两个星号表示相关系数在0.01的显着性水平下显着..从表中可以看出;每股收益、净资产收益率与总资产收益率3个指标之间的相关系数都在0.8以上;对应的p值都接近0;表示3个指标具有较强的正相关关系;而托宾Q值与其他3个变量之间的相关性较弱..表5.1 Pearson简单相关分析Correlations每股收益率净资产收益率资产收益率托宾Q值每股收益率PearsonCorrelation1.877.824-.073Sig.2-tailed..000.000.199N315315315315净资产收益率Pearson.8771.808-.001 CorrelationSig..000..000.983 2-tailedN315315315315资产收益率Pearson.824.8081.011 CorrelationSig..000.000..849 2-tailedN315315315315托宾Q值Pearson-.073-.001.0111 CorrelationSig..199.983.849.2-tailedN315315315315 Correlation is significant at the 0.01 level 2-tailed.2.一元线性回归分析实例分析:家庭住房支出与年收入的回归模型在这个例子里;考虑家庭年收入对住房支出的影响;建立的模型如下:其中;yi是住房支出;xi是年收入线性回归分析的基本步骤及结果分析:1绘制散点图打开数据文件;选择图形-旧对话框-散点/点状;如图5.2所示..图5.2 散点图对话框选择简单分布;单击定义;打开子对话框;选择X变量与Y变量;如图5.3所示..单击ok提交系统运行;结果见图5.4所示..图5.3 Simple Scatterplot 子对话框从图上可直观地看出住房支出与年收入之间存在线性相关关系..图5.4 散点图2简单相关分析选择分析—>相关—>双变量;打开对话框;将变量“住房支出”与“年收入”移入variables列表框;点击ok运行;结果如表5.2所示..表5.2 住房支出与年收入相关系数表CorrelationsCorrelation is significant at the 0.01 level 2-tailed.从表中可得到两变量之间的皮尔逊相关系数为0.966;双尾检验概率p值尾0.000<0.05;故变量之间显着相关..根据住房支出与年收入之间的散点图与相关分析显示;住房支出与年收入之间存在显着的正相关关系..在此前提下进一步进行回归分析;建立一元线性回归方程..3 线性回归分析步骤1:选择菜单“分析—>回归—>线性”;打开Linear Regression 对话框..将变量住房支出y移入Dependent列表框中;将年收入x移入Independents列表框中..在Method 框中选择Enter 选项;表示所选自变量全部进入回归模型..图5.5 Linear Regresssion对话框步骤2:单击Statistics按钮;如图在Statistics子对话框..该对话框中设置要输出的统计量..这里选中估计、模型拟合度复选框..图5.6 Statistics子对话框估计:输出有关回归系数的统计量;包括回归系数、回归系数的标准差、标准化的回归系数、t统计量及其对应的p值等..置信区间:输出每个回归系数的95%的置信度估计区间..协方差矩阵:输出解释变量的相关系数矩阵与协差阵..模型拟合度:输出可决系数、调整的可决系数、回归方程的标准误差、回归方程F检验的方差分析..步骤3:单击绘制按钮;在Plots子对话框中的标准化残差图选项栏中选中正态概率图复选框;以便对残差的正态性进行分析..图5.7 plots子对话框步骤4:单击保存按钮;在Save子对话框中残差选项栏中选中未标准化复选框;这样可以在数据文件中生成一个变量名尾res_1 的残差变量;以便对残差进行进一步分析..图5.8 Save子对话框其余保持Spss默认选项..在主对话框中单击ok按钮;执行线性回归命令;其结果如下:表5.3给出了回归模型的拟与优度R Square、调整的拟与优度Adjusted R Square、估计标准差Std. Error of the Estimate以及Durbin-Watson统计量..从结果来看;回归的可决系数与调整的可决系数分别为0.934与0.93;即住房支出的90%以上的变动都可以被该模型所解释;拟与优度较高..表5.4给出了回归模型的方差分析表;可以看到;F统计量为252.722;对应的p值为0;所以;拒绝模型整体不显着的原假设;即该模型的整体是显着的..表5.5给出了回归系数、回归系数的标准差、标准化的回归系数值以及各个回归系数的显着性t检验..从表中可以看到无论是常数项还是解释变量x;其t统计量对应的p值都小于显着性水平0.05;因此;在0.05的显着性水平下都通过了t检验..变量x的回归系数为0.237;即年收入每增加1千美元;住房支出就增加0.237千美元..表5.3 回归模型拟与优度评价及Durbin-Watson检验结果Model Summaryba Predictors: Constant;年收入千美元b Dependent Variable:住房支出千美元表5.4 方差分析表ANOVAba Predictors: Constant; 年收入千美元b Dependent Variable: 住房支出千美元表5.5 回归系数估计及其显着性检验Coefficientsaa Dependent Variable: 住房支出千美元为了判断随机扰动项是否服从正态分布;观察图5.9所示的标准化残差的P-P图;可以发现;各观测的散点基本上都分布在对角线上;据此可以初步判断残差服从正态分布..为了判断随机扰动项是否存在异方差;根据被解释变量y与解释变量x的散点图;如图5.4所示;从图中可以看到;随着解释变量x的增大;被解释变量的波动幅度明显增大;说明随机扰动项可能存在比较严重的异方差问题;应该利用加权最小二乘法等方法对模型进行修正..图5.9 标准化残差的P-P图四、备择试验现有1987~2003年湖南省全社会固定资产投资总额NINV与GDP两个指标的年度数据;见下表..试研究全社会固定资产投资总额与GDP的数量关系;并建立全社会固定资产投资总额与GDP之间的线性回归方程..。

利用SPSS进行logistic回归分析(二元、多项)

线性回归是很重要的一种回归方法,但是线性回归只适用于因变量为连续型变量的情况,那如果因变量为分类变量呢?比方说我们想预测某个病人会不会痊愈,顾客会不会购买产品,等等,这时候我们就要用到logistic回归分析了。

Logistic回归主要分为三类,一种是因变量为二分类得logistic回归,这种回归叫做二项logistic回归,一种是因变量为无序多分类得logistic回归,比如倾向于选择哪种产品,这种回归叫做多项logistic回归。

还有一种是因变量为有序多分类的logistic回归,比如病重的程度是高,中,低呀等等,这种回归也叫累积logistic回归,或者序次logistic回归。

二值logistic回归:选择分析——回归——二元logistic,打开主面板,因变量勾选你的二分类变量,这个没有什么疑问,然后看下边写着一个协变量。

有没有很奇怪什么叫做协变量?在二元logistic回归里边可以认为协变量类似于自变量,或者就是自变量。

把你的自变量选到协变量的框框里边。

细心的朋友会发现,在指向协变量的那个箭头下边,还有一个小小的按钮,标着a*b,这个按钮的作用是用来选择交互项的。

我们知道,有时候两个变量合在一起会产生新的效应,比如年龄和结婚次数综合在一起,会对健康程度有一个新的影响,这时候,我们就认为两者有交互效应。

那么我们为了模型的准确,就把这个交互效应也选到模型里去。

我们在右边的那个框框里选择变量a,按住ctrl,在选择变量b,那么我们就同时选住这两个变量了,然后点那个a*b的按钮,这样,一个新的名字很长的变量就出现在协变量的框框里了,就是我们的交互作用的变量。

然后在下边有一个方法的下拉菜单。

默认的是进入,就是强迫所有选择的变量都进入到模型里边。

除去进入法以外,还有三种向前法,三种向后法。

一般默认进入就可以了,如果做出来的模型有变量的p值不合格,就用其他方法在做。

再下边的选择变量则是用来选择你的个案的。

用SPSS做回归分析

用SPSS做回归分析回归分析是一种统计方法,用于研究两个或多个变量之间的关系,并预测一个或多个因变量如何随着一个或多个自变量的变化而变化。

SPSS(统计软件包的统计产品与服务)是一种流行的统计分析软件,广泛应用于研究、教育和业务领域。

要进行回归分析,首先需要确定研究中的因变量和自变量。

因变量是被研究者感兴趣的目标变量,而自变量是可能影响因变量的变量。

例如,在研究投资回报率时,投资回报率可能是因变量,而投资额、行业类型和利率可能是自变量。

在SPSS中进行回归分析的步骤如下:1.打开SPSS软件,并导入数据:首先打开SPSS软件,然后点击“打开文件”按钮导入数据文件。

确保数据文件包含因变量和自变量的值。

2.选择回归分析方法:在SPSS中,有多种类型的回归分析可供选择。

最常见的是简单线性回归和多元回归。

简单线性回归适用于只有一个自变量的情况,而多元回归适用于有多个自变量的情况。

3.设置因变量和自变量:SPSS中的回归分析工具要求用户指定因变量和自变量。

选择适当的变量,并将其移动到正确的框中。

4.运行回归分析:点击“运行”按钮开始进行回归分析。

SPSS将计算适当的统计结果,包括回归方程、相关系数、误差项等。

这些结果可以帮助解释自变量如何影响因变量。

5.解释结果:在完成回归分析后,需要解释得到的统计结果。

回归方程表示因变量与自变量之间的关系。

相关系数表示自变量和因变量之间的相关性。

误差项表示回归方程无法解释的变异。

6.进行模型诊断:完成回归分析后,还应进行模型诊断。

模型诊断包括检查模型的假设、残差的正态性、残差的方差齐性等。

SPSS提供了多种图形和统计工具,可用于评估回归模型的质量。

回归分析是一种强大的统计分析方法,可用于解释变量之间的关系,并预测因变量的值。

SPSS作为一种广泛使用的统计软件,可用于执行回归分析,并提供了丰富的功能和工具,可帮助研究者更好地理解和解释数据。

通过了解回归分析的步骤和SPSS的基本操作,可以更好地利用这种方法来分析数据。

spss标准化回归系数

spss标准化回归系数SPSS标准化回归系数。

标准化回归系数是回归分析中一个重要的统计指标,它能够帮助研究者理解自变量对因变量的影响程度,并且消除了不同变量量纲不同的影响,使得不同自变量之间可以进行比较。

在SPSS软件中,我们可以通过进行标准化回归来得到标准化回归系数,本文将介绍如何在SPSS中进行标准化回归分析,并解释标准化回归系数的含义和解释。

首先,打开SPSS软件并导入需要进行标准化回归分析的数据集。

在“分析”菜单中选择“回归”选项,然后在弹出的对话框中选择“线性”回归分析。

在“因变量”框中输入需要预测的因变量,然后将所有自变量添加到“自变量”框中。

接下来,点击“统计”按钮,在弹出的对话框中勾选“标准化系数”选项,然后点击“确定”进行分析。

得到标准化回归系数之后,我们需要对结果进行解释。

标准化回归系数表示的是因变量每变化一个标准差时,自变量的变化量。

标准化回归系数的绝对值大小反映了自变量对因变量的影响程度,而正负号则表示了自变量对因变量的正向或负向影响。

例如,如果某个自变量的标准化回归系数为0.5,那么当该自变量增加一个标准差时,因变量也会增加0.5个标准差。

在解释标准化回归系数时,需要注意到不同自变量之间的标准化回归系数是可以进行比较的。

绝对值较大的标准化回归系数表示该自变量对因变量的影响更大,而绝对值较小的标准化回归系数则表示影响较小。

通过比较不同自变量的标准化回归系数,可以得出它们对因变量的相对重要性,从而更好地理解自变量对因变量的影响。

此外,标准化回归系数还可以用来进行假设检验,判断自变量对因变量的影响是否显著。

在SPSS的回归结果中,标准化回归系数的t检验可以用来检验自变量的系数是否显著异于零。

如果t检验的p值小于显著性水平(通常取0.05),则可以拒绝原假设,即认为该自变量对因变量的影响是显著的。

总之,标准化回归系数是回归分析中一个重要的统计指标,它能够帮助研究者理解自变量对因变量的影响程度,并进行自变量之间的比较。

回归分析例题SPSS求解过程

回归分析例题SPSS求解过程(一)1、一元线性回归SPSS求解过程:判别:xy202.0173.2ˆˆˆ1+=+=ββ,且x与y的线性相关系数为R=0.951,回归方程的F检验值为75.559,对应F值的显著性概率是0.000<0.05,表示线性回归方程具有显著性,当对应F值的显著性概率>0.05,表示回归方程不具有显著性。

每个系数的t检验值分别是3.017与8.692,对应的检验显著性概率分别为:0.017(<0.05)和0.000(<0.05),即否定0H,也就是线性假设是显著的。

二、一元非线性回归SPSS求解过程:1、Y与X的二次及三次多项式拟合:所以,二次式为:2029.07408.00927.6xxY-+=三次式为:320046.01534.07068.1118.4xxxY+-+=2、把Y与X的关系用双曲线拟合:作双曲线变换:xVyU1,1==判别:V U 131.0082.0-=,x V y U 1,1==,V 与U 的相关系数为R=0.968,回归方程系数的F 检验值为196.227,对应F 值的显著性概率是0.000(<0.05),表示线性回归方程具有显著性 ,每个系数的t 检验值分别是440514与14.008,对应的检验显著性概率分别为:0.000(<0.05)和0.000(<0.05),即否定0H ,也就是线性假设是显著的。

3、把Y 与X 的关系用倒指数函数拟合:x bae Y =,则x b a Y 1ln ln +=令U1=LN (Y ),V1=V=1/x,有 U1=c+bV1.判别:V U 111.1458.21-=,x V y U /1,ln 1==,V 与1U 的相关系数为R=0.979,回归方程的F 检验值为303.190,对应F 值的显著性概率是0.000(<0.05),表示线性回归方程具有显著性 ,每个系数的t 检验值分别是195.221与-17.412,对应的检验显著性概率分别为:0.000(<0.05)和0.000(<0.05),即否定0H ,也就是线性假设是显著的。

用SPSS做回归分析

结果说明——回归系数分析:

1. Model 为回归方程模型编号 2. Unstandardized Coefficients 为非标准化系数,B为系数值, Std.Error为系数的标准差 3. Standardized Coefficients 为标准化系数 4. t 为t检验,是偏回归系数为0(和常数项为0)的假设检验 5. Sig. 为偏回归系数为0 (和常数项为0)的假设检验的显著性 水平值 6. B 为Beta系数,Std.Error 为相应的标准差

结果:

y 0.0472 0.3389 x 2 0.0019

F 117.1282 F0.01 (1, 8) 11.26 R 0.9675 R0.01 (8) 0.765

检验说明线性关系显著

操作步骤:Analyze→Regression →Linear… →Statistics→Model fit Descriptives

162 150 140 110 128 130 135 114 116 124 158 144 130 125 175

以年龄为自变量x, 血压为因变量y,可 作出如下散点图:

SPSS如何进行线性回归分析操作 精品

SPSS如何进行线性回归分析操作本节内容主要介绍如何确定并建立线性回归方程。

包括只有一个自变量的一元线性回归和和含有多个自变量的多元线性回归。

为了确保所建立的回归方程符合线性标准,在进行回归分析之前,我们往往需要对因变量与自变量进行线性检验。

也就是类似于相关分析一章中讲过的借助于散点图对变量间的关系进行粗略的线性检验,这里不再重复。

另外,通过散点图还可以发现数据中的奇异值,对散点图中表示的可能的奇异值需要认真检查这一数据的合理性。

一、一元线性回归分析用SPSS进行回归分析,实例操作如下:1.单击主菜单Analyze / Regression / Linear…,进入设置对话框如图7-9所示。

从左边变量表列中把因变量y选入到因变量(Dependent)框中,把自变量x选入到自变量(Independent)框中。

在方法即Method一项上请注意保持系统默认的选项Enter,选择该项表示要求系统在建立回归方程时把所选中的全部自变量都保留在方程中。

所以该方法可命名为强制进入法(在多元回归分析中再具体介绍这一选项的应用)。

具体如下图所示:2.请单击Statistics…按钮,可以选择需要输出的一些统计量。

如RegressionCoefficients(回归系数)中的Estimates,可以输出回归系数及相关统计量,包括回归系数B、标准误、标准化回归系数BETA、T值及显著性水平等。

Model fit 项可输出相关系数R,测定系数R2,调整系数、估计标准误及方差分析表。

上述两项为默认选项,请注意保持选中。

设置如图7-10所示。

设置完成后点击Continue返回主对话框。

回归方程建立后,除了需要对方程的显著性进行检验外,还需要检验所建立的方程是否违反回归分析的假定,为此需进行多项残差分析。

由于此部分内容较复杂而且理论性较强,所以不在此详细介绍,读者如有兴趣,可参阅有关资料。

3.用户在进行回归分析时,还可以选择是否输出方程常数。

多元线性回归的SPSS实现

多元线性回归的SPSS实现

接下来,我们进入多元线性回归分析过程。

在菜单栏选择"回归",然后选择"线性"。

将自变量和因变量添加到"因变量"和"自变量"框中。

可以通过拖拽变量到框中,或者使用箭头按钮来添加变量。

请确保选择正确的变量,并按照研究目的和理论基础进行选择。

在"统计"菜单中,SPSS提供了一些重要的检验和结果输出选项。

其中,"检验"选项提供了多元共线性和异方差性等问题的检验,例如改进的燕达可决系数、方差膨胀因子等。

"图形"选项提供了残差图、正态概率图等图形结果。

在多元线性回归模型设定中,可以选择是否加入交互项。

交互项可以用于分析两个或多个自变量之间的交互效应。

在"选项"菜单中,可以勾选"交互"选项并设置交互项的组合。

在进行多元线性回归分析时,还需要考虑到模型的鲁棒性和假设的满足程度。

可以使用"异常值"选项来检测并处理异常值,以提高模型的稳定性。

在"选项"菜单中,可以勾选"异常值"选项,SPSS将生成回归系数的鲁棒和标准误差。

综上所述,通过SPSS软件的多元线性回归分析功能,我们可以有效地分析和解释多个自变量对因变量的影响。

通过合理设置选项和参数,并结合结果的检验和图形,可以得出科学、准确和可信的结论。

「相关分析与回归分析SPSS实现」

「相关分析与回归分析SPSS实现」相关分析与回归分析是统计学中常用的方法,可以用来研究两个或多个变量之间的相关关系,并进行预测和解释。

SPSS(Statistical Package for the Social Sciences)是一种常见的统计分析软件,提供了完成相关分析和回归分析的功能。

本文将从相关分析和回归分析的基本原理、SPSS的操作步骤以及分析结果的解释等方面进行阐述。

首先,相关分析用于研究两个变量之间的相关关系。

可以通过计算相关系数来衡量两个变量之间的相关程度。

根据变量的度量尺度不同,常用的相关系数有皮尔逊相关系数、斯皮尔曼等级相关系数和切比雪夫距离等。

在SPSS中,进行相关分析的步骤如下:1.打开SPSS软件,并导入待分析的数据文件。

2.选择“分析”菜单,点击“相关”子菜单。

3.在弹出的对话框中,选择需要进行分析的变量,并选择相关系数的计算方法。

4.点击“确定”按钮,即可得到相关分析的结果。

相关分析的结果包括相关系数、显著性水平和样本大小等。

相关系数的取值范围在-1到1之间,接近-1或1表示两个变量呈现很强的正相关或负相关关系,接近0表示两个变量之间没有线性相关关系。

其次,回归分析用于预测和解释变量之间的关系。

回归分析可以包括一元回归分析和多元回归分析。

一元回归分析用于研究一个自变量对一个因变量的影响,多元回归分析则可以同时研究多个自变量对一个因变量的影响。

在SPSS中,进行回归分析的步骤如下:1.打开SPSS软件,并导入待分析的数据文件。

2.选择“分析”菜单,点击“回归”子菜单。

3.在弹出的对话框中,选择需要进行分析的因变量和自变量。

对于多元回归分析,可以选择多个自变量。

4.可以选择加入交互项和控制变量等进行高级分析。

5.点击“确定”按钮,即可得到回归分析的结果。

回归分析的结果包括回归方程、回归系数、显著性水平和拟合优度等。

回归方程可以用来预测因变量的取值,回归系数表示自变量对因变量的影响程度,显著性水平表示回归模型是否具有统计学意义,拟合优度表示回归模型对观测数据的拟合程度。

应用SPSS软件进行多分类Logistic回归分析

应用SPSS软件进行多分类Logistic回归分析应用SPSS软件进行多分类Logistic回归分析一、简介Logistic回归是一种常用的统计分析方法,在很多领域中都有广泛的应用。

它主要用于预测一个分类变量的可能性或概率,例如判断一个疾病的患病风险、判断学生成绩的优劣、预测金融市场的涨跌等。

本文将介绍如何使用SPSS软件进行多分类Logistic回归分析,并以一个具体案例来说明其应用。

二、SPSS软件介绍SPSS软件是统计分析的常用工具之一,它具有友好的用户界面和丰富的分析功能。

在进行Logistic回归分析时,SPSS可以帮助我们进行数据处理、模型建立、模型拟合、模型评估等步骤,并输出详细的分析结果。

三、案例描述我们假设有一份数据集,包含了500个样本和5个自变量,要根据这些自变量对样本进行多分类。

自变量包括性别、年龄、教育水平、收入和职业。

而多分类的目标变量是购买冰淇淋的偏好,包括三个分类:喜欢巧克力口味、喜欢草莓口味和喜欢香草口味。

四、数据处理首先,我们需要对数据进行处理。

SPSS可以读取各种文件格式,如Excel、CSV等。

我们将数据导入SPSS后,可以进行缺失值处理、异常值处理等预处理步骤。

这些步骤是为了保证后续的分析结果的准确性和可靠性。

五、模型建立在SPSS中,我们可以使用多分类Logistic回归模型进行建模。

它采用最大似然估计方法来估计模型参数,以便进行分类预测。

我们需要将自变量和目标变量进行指定,SPSS会自动计算出各个自变量对目标变量的系数和统计学意义。

六、模型拟合在模型拟合阶段,SPSS会对模型进行拟合优度的检验,包括卡方拟合优度检验、Hosmer-Lemeshow检验等。

这些检验可以帮助我们评估模型的拟合程度和可靠性。

如果模型的拟合程度不好,我们可以对模型进行进一步调整和改进。

七、模型评估在模型评估阶段,SPSS提供了一系列的统计指标和图表,用于评估多分类Logistic回归模型的性能。

spss回归分析案例

spss回归分析案例SPSS回归分析案例。

回归分析是一种统计方法,用于研究自变量和因变量之间的关系。

SPSS是一种常用的统计软件,可以帮助研究人员进行回归分析。

在本文中,我们将介绍一个关于回归分析的案例,以帮助读者更好地理解和应用这一方法。

案例背景:假设我们是一家电子产品公司的市场营销团队,我们想要了解广告投入对产品销量的影响。

我们收集了一段时间内的广告投入和产品销量数据,希望通过回归分析来探究它们之间的关系。

数据收集:我们收集了每个月的广告投入(自变量X)和产品销量(因变量Y)的数据,共计12个月的数据。

数据分析:首先,我们在SPSS中导入数据,并进行描述性统计分析,以了解数据的分布情况。

然后,我们进行了回归分析,以探究广告投入对产品销量的影响。

回归分析结果:通过回归分析,我们得到了如下结果:1. 回归方程,Y = 10 + 2X。

这意味着,每增加1单位的广告投入,产品销量将增加2个单位。

此外,截距项为10,表示在广告投入为0时,产品销量为10个单位。

2. 相关性分析,相关系数为0.8。

相关系数为0.8,表明广告投入和产品销量之间存在较强的正相关关系。

结论与建议:根据回归分析的结果,我们可以得出以下结论和建议:1. 广告投入对产品销量有显著影响,每增加1单位的广告投入,产品销量将增加2个单位。

2. 我们建议在未来的市场营销策略中,增加广告投入,以促进产品销量的增长。

总结:通过本案例的回归分析,我们得出了广告投入对产品销量的影响,并提出了相应的建议。

回归分析是一种强大的统计方法,可以帮助研究人员深入了解变量之间的关系,为决策提供科学依据。

希望本文能够帮助读者更好地理解和应用回归分析方法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Coefficieants

UnstandardSiztaenddardized CoefficienCtsoefficients 95% Confidence IntervalCfoorrBelationCsollinearity Statistics

Model

BStd. ErrorBeta

t SiLgo. wer BUopupnedr BZoeurnod-ordPearrtial PaTrtolerancVe IF

关系。

• 3)多重共线性检验:容忍度(tolerance)越接近于0,多重共 线性越强;方差膨胀因子(VIF)越大,一般大于等于10 时,说明解释变量Xi 与其余解释变量之间有较强的多重 共线性。

第九讲 回归分析的SPSS实现

精品

线性回归分析

• 被解释变量和各个解释变量各对应一个 spss变量.

• 一元线性回归和多元线性回归分析的功能 菜单是集成到一起的.

• 数据:高校科研研究.data

精品

一、描绘散点交互图

• 基本步骤

– Graphs---interactive---Scatterplot – Assign Variable---y=课题数;x=高级职称人数 – Fit---Method---选择Regression – OK

bD . ependent Variable: 课 题 总 数

结果说明: 1)调整后的R2=0.939,因此模型的拟和优度较高; 模型 的F检验达到了0.00的极显著水平.说明模型的线 性关 系较显著,具有较强的解释能力 2)D.W值=1.838接近于2,说明模型的序列相关性不强.

精品

结果二:模型方差分析表

1 (Consta-3n5t).31736.580

-.461 .64-1993.361722.740

投 入 人 年.数 698 .208 1.3613.352 .003 .268 1.128 .959 .565 .169 .01654.811

投入高级职称的人 年 数 ( 上-.年 46) 7 .626 -.464 -.747 .463 -1.759 .824 .944 -.151 -.038 .010571.824

ANOVA b

Sum of

Model

Squares

1

Regress1io9n790313

df Mean Square F 36298385.480 61.532

Sig. .000a

Residual 1286497

24 53604.047

Total 21076810

30

a.Predic tors: (Constant), 获 奖 数 ( 上 年 ) , 投 入 科 研 事 业 费 ( 百 元 论 文 数 (上 年 ) , 专 著 数 ( 上 年 ) , 投 入 人 年 数 , 投 入 高 级 职 称 年)

ModeRlR SquRarS eqtu ha erE e stim Cahtaen FgC e hangd ef1

1 .969a.939 .922341.5255 .93691.532

6

DurbindSf2 ig. F ChaW ngaetson

24 .000 1.838

aP . redictors: (Constant), 获 奖 数 ( 上 年 ) , 投 入 科 研 事 业 费 职称 的人 年数 (上年 )

probality plot” • 选择”ZPRED”输入到”Y”;选择”SRESID”输入到”X”; • OK

精品

(一)立项课题数多元线性回归分析结果 (enter策略)

结果一:模型综述表

Model Summ b ary

Change Statistics

AdjuS st d e.d Er rR orSoqfuare

aD . ep endent Variable : 课 题 总 数

精品

结果说明:

• 1)由于回归方程:课题立项数=-35.313+0.698投入人年数+---

• 2)变量的显著性检验:只有“投入人年数”达到了0.003

的极显

著水平,其他变量都不显著,说明除了 “投

入人年数”外, 其他变量都与课题立项数没有显著的线性

精品

课题 总数

40 00.0 30 00.0

课题总数 = -24.52 + 0.95 * X3

R-Square = 0.89

20 010 00.0

20 00.0

投入高级职称的人年数(上年)

30 00.0

精品

Linea r Re gre ssion with 95.00% Mea n Pr ediction Interval

b.Dependent Variable: 课 题 总 数

结果说明: 模型的F检验值=61.532,对应的概率值P=0.00,远小于0.01

的极显著水平,应该拒绝回归系数为零的原假设,即认为回归 系数不同时为零,被解释变量与解释变量全体的线性关系是显 著的,可以建立线性模型.

精品

结果三:系数分析表

论 文 数 (上 -.0年 64).053 -.252-1.198 .243 -.173 .046 .887 -.238 -.060 .05187.384

获 奖 数 (.上 71年 2 .) 503 .1191.416 .170 -.326 1.751 .665 .278 .071 .3582.796

投入科研事业费 ( 百 元 ).( 00上 3 .年 00) 2 .2371.601 .122 -.001 .007 .862 .311 .081 .1178.576

专 著 数 (.上 02年 2 .) 377 .014 .059 .953 -.755 .800 .868 .012 .003 .04261.875

二、用Linear Regression分析

• Analyze---Regression---Linear • 选择被解释变量进入Dependent框---课题数 • 选择一个或多个解释变量进入Independent(s)框 • METHOD---Enter; stepwise;--• 单击Statistics,选择全部核选框 • 单击Plots,选择”Histogram”核选框和”Normal