多元最小二乘法

最小二乘法拟合回归直线的注意事项

最小二乘法是一种常用的回归分析方法,用于拟合一条直线以描述自变量和因变量之间的关系。

在实际应用中,最小二乘法可以帮助我们找到最符合观测数据的线性模型,从而进行预测和分析。

然而,最小二乘法也存在一些注意事项,需要我们在使用时特别留意。

下面将详细介绍最小二乘法拟合回归直线的注意事项。

一、数据的准备在使用最小二乘法拟合回归直线之前,首先需要准备好观测数据。

数据的准备包括收集样本数据、对数据进行清洗和处理,确保数据的准确性和完整性。

还需要对数据进行可视化分析,探索自变量和因变量之间的关系。

只有在数据准备充分的情况下,才能保证最小二乘法的拟合结果具有可靠性和有效性。

二、线性关系的验证在使用最小二乘法进行回归分析时,需要验证自变量和因变量之间是否存上线性关系。

线性关系的验证可以通过散点图、相关系数等统计手段进行分析。

如果自变量和因变量之间呈现非线性关系,那么使用最小二乘法拟合回归直线可能会导致模型拟合不佳,影响数据分析的准确性。

三、异常值的处理在进行最小二乘法拟合回归直线时,需要注意异常值的存在。

异常值可能会对拟合结果产生较大影响,导致模型失真。

需要对异常值进行识别和处理,可以采用箱线图、3σ原则等方法进行异常值的识别,并对异常值进行必要的调整或剔除。

四、多重共线性的检测在多元最小二乘法中,需要特别注意自变量之间是否存在多重共线性。

多重共线性会导致自变量之间存在高度相关性,从而使得最小二乘法的拟合结果不稳定,模型的解释性降低。

需要通过方差膨胀因子(VIF)等方法进行多重共线性的检测,并在必要时进行变量的调整或剔除。

五、残差的验证在进行最小二乘法拟合回归直线后,需要对模型的残差进行验证。

残差是预测值与观测值之间的差异,通过对残差的分析可以检验模型的拟合程度和预测效果。

可以使用残差图、残差分布等方法进行残差的验证,确保模型的残差符合正态分布和独立同分布的假设。

六、模型的解释和评价在使用最小二乘法拟合回归直线后,需要对模型进行解释和评价。

多重共线性问题的偏最小二乘估计

多重共线性问题的偏最小二乘估计1. 引言1.1 背景介绍多重共线性问题是回归分析中常见的一个问题,指的是自变量之间存在高度相关性或线性关系,导致回归系数估计不准确甚至不可靠的情况。

在实际应用中,多重共线性问题可能会导致回归系数估计出现偏差,增加了模型的不确定性,降低了模型的预测能力。

传统的最小二乘估计方法在存在多重共线性问题时表现不佳,容易导致过拟合或欠拟合的情况。

为了解决多重共线性问题,偏最小二乘估计方法被提出并得到广泛应用。

偏最小二乘估计方法通过降低自变量之间的相关性,提高回归系数的稳定性和准确性,从而改善模型的性能。

偏最小二乘估计方法在多元回归分析、主成分回归、岭回归等领域都有重要的应用价值。

本文旨在探讨多重共线性问题对回归分析的影响,分析传统最小二乘估计方法存在的问题,介绍偏最小二乘估计方法的原理和应用,并探讨偏最小二乘估计方法相对于传统方法的优势和未来研究展望。

通过本文的阐述,读者将更加深入地了解多重共线性问题以及对应的解决方法,为实际应用中的数据分析提供参考依据。

1.2 研究意义多重共线性问题的偏最小二乘估计方法在回归分析领域具有重要的研究意义。

多重共线性是指自变量之间存在高度相关性或线性关系,导致回归模型失真或不准确的问题。

在实际数据分析中,多重共线性现象时常存在,特别是在变量较多或样本量较小的情况下。

解决多重共线性问题可以提高回归模型的精确度和解释力,对实际问题的预测和分析具有重要意义。

偏最小二乘估计方法正是针对多重共线性问题而提出的一种有效技术。

与传统的最小二乘法相比,偏最小二乘法能够有效地降低自变量之间的相关性,减少共线性带来的影响,提高模型的稳定性和准确性。

研究偏最小二乘估计方法不仅可以帮助我们更好地理解多重共线性问题的本质,还可以为实际数据分析提供更有效的工具和方法。

研究偏最小二乘估计方法对于解决多重共线性问题具有重要意义,可以提高回归模型的质量和可靠性,为相关领域的研究和应用带来更多的启发和帮助。

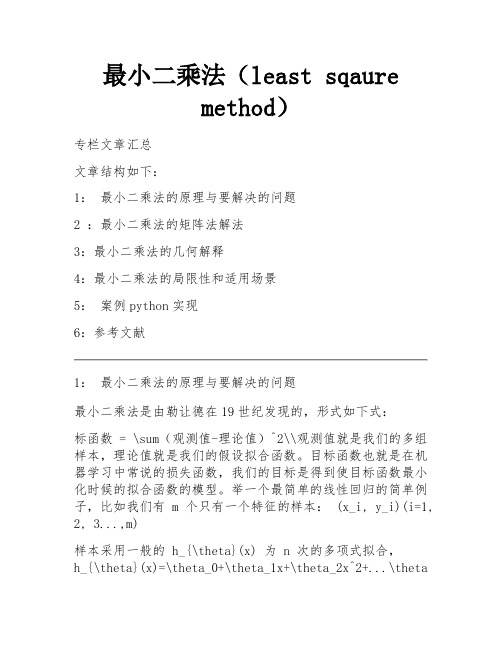

最小二乘法(least sqaure method)

最小二乘法(least sqauremethod)专栏文章汇总文章结构如下:1:最小二乘法的原理与要解决的问题2 :最小二乘法的矩阵法解法3:最小二乘法的几何解释4:最小二乘法的局限性和适用场景5:案例python实现6:参考文献1:最小二乘法的原理与要解决的问题最小二乘法是由勒让德在19世纪发现的,形式如下式:标函数 = \sum(观测值-理论值)^2\\观测值就是我们的多组样本,理论值就是我们的假设拟合函数。

目标函数也就是在机器学习中常说的损失函数,我们的目标是得到使目标函数最小化时候的拟合函数的模型。

举一个最简单的线性回归的简单例子,比如我们有 m 个只有一个特征的样本: (x_i, y_i)(i=1, 2, 3...,m)样本采用一般的 h_{\theta}(x) 为 n 次的多项式拟合,h_{\theta}(x)=\theta_0+\theta_1x+\theta_2x^2+...\theta_nx^n,\theta(\theta_0,\theta_1,\theta_2,...,\theta_n) 为参数最小二乘法就是要找到一组\theta(\theta_0,\theta_1,\theta_2,...,\theta_n) 使得\sum_{i=1}^n(h_{\theta}(x_i)-y_i)^2 (残差平方和) 最小,即,求 min\sum_{i=1}^n(h_{\theta}(x_i)-y_i)^22 :最小二乘法的矩阵法解法最小二乘法的代数法解法就是对 \theta_i 求偏导数,令偏导数为0,再解方程组,得到 \theta_i 。

矩阵法比代数法要简洁,下面主要讲解下矩阵法解法,这里用多元线性回归例子来描:假设函数h_{\theta}(x_1,x_2,...x_n)=\theta_0+\theta_1x_1+...+\t heta_nx_n 的矩阵表达方式为:h_{\theta}(\mathbf{x})=\mathbf{X}\theta\\其中,假设函数 h_{\theta}(\mathbf{x})=\mathbf{X}\theta 为 m\times1 的向量, \theta 为 n\times1 的向量,里面有 n 个代数法的模型参数。

matlab 最小二乘法 多个自变量

matlab 最小二乘法多个自变量多个自变量的最小二乘法在MATLAB中的应用最小二乘法(Least Squares Method)是一种常见的数据拟合方法,在MATLAB中具有广泛的应用。

它可以用于多个自变量的情况,即多元线性回归问题。

本文将介绍如何使用MATLAB进行多个自变量的最小二乘法拟合,并给出一个实际案例进行说明。

我们需要明确什么是多元线性回归问题。

在统计学中,回归分析是研究两个或多个变量之间关系的一种方法。

多元线性回归是回归分析中的一种常见形式,其模型可以表示为:Y = β0+ β1*X1 + β2*X2 + ... + βn*Xn + ε其中,Y是因变量,X1、X2、...、Xn是自变量,β0、β1、β2、...、βn是回归系数,ε是误差项。

我们的目标是通过拟合数据,估计回归系数的值。

在MATLAB中,可以使用“polyfit”函数来进行多元线性回归拟合。

该函数的基本用法如下:p = polyfit(X, Y, n)其中,X是自变量的矩阵,Y是因变量的向量,n是多项式的次数。

函数的返回值p是一个向量,包含了拟合多项式的系数。

使用polyval函数可以通过这些系数来计算拟合的值。

下面我们通过一个实际案例来演示多个自变量的最小二乘法拟合在MATLAB中的应用。

假设我们有一组数据,包含两个自变量X1和X2,和一个因变量Y。

我们的目标是通过这些数据来拟合一个多元线性回归模型。

我们需要准备数据。

我们可以使用rand函数生成一组随机数据作为示例数据,代码如下:X1 = rand(100,1);X2 = rand(100,1);Y = 2*X1 + 3*X2 + randn(100,1);接下来,我们可以使用polyfit函数进行拟合,代码如下:p = polyfit([X1, X2], Y, 1);这里我们将X1和X2合并成一个矩阵作为自变量。

函数的第三个参数1表示拟合一个一次多项式。

拟合完成后,我们可以使用polyval函数来计算拟合的值,代码如下:Y_fit = polyval(p, [X1, X2]);现在,我们已经得到了拟合的值Y_fit。

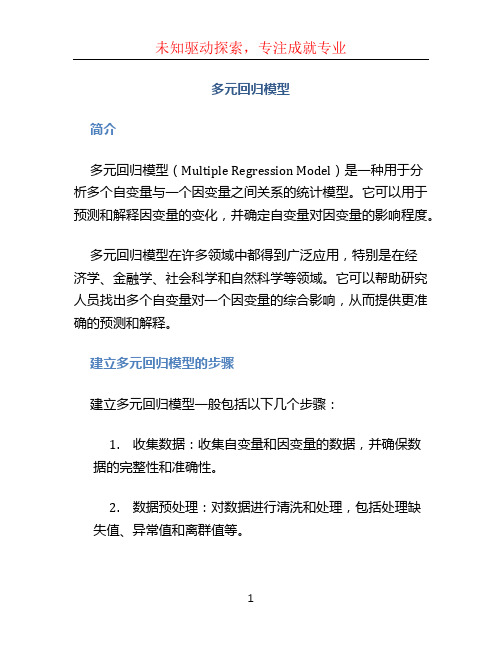

多元回归模型

多元回归模型简介多元回归模型(Multiple Regression Model)是一种用于分析多个自变量与一个因变量之间关系的统计模型。

它可以用于预测和解释因变量的变化,并确定自变量对因变量的影响程度。

多元回归模型在许多领域中都得到广泛应用,特别是在经济学、金融学、社会科学和自然科学等领域。

它可以帮助研究人员找出多个自变量对一个因变量的综合影响,从而提供更准确的预测和解释。

建立多元回归模型的步骤建立多元回归模型一般包括以下几个步骤:1.收集数据:收集自变量和因变量的数据,并确保数据的完整性和准确性。

2.数据预处理:对数据进行清洗和处理,包括处理缺失值、异常值和离群值等。

3.确定自变量和因变量:根据研究目的和领域知识,确定自变量和因变量。

4.拟合回归模型:选择合适的回归模型,并使用最小二乘法等方法拟合回归模型。

5.模型评估:通过分析回归系数、残差、拟合优度等指标来评估模型的拟合效果。

6.解释结果:根据回归模型的系数和统计显著性,解释自变量对因变量的影响。

多元回归模型的方程多元回归模型可表示为以下方程:Y = β0 + β1X1 + β2X2 + … + βk*Xk + ε其中,Y表示因变量,X1、X2、…、Xk表示自变量,β0、β1、β2、…、βk表示回归系数,ε为误差项。

回归系数β0表示截距,表示当所有自变量为0时,因变量的值。

回归系数βi表示自变量Xi对因变量的影响,即当自变量Xi增加一个单位时,因变量的平均变化量。

误差项ε表示模型无法解释的部分,代表了观测误差和模型中遗漏的影响因素。

多元回归模型的拟合和评估拟合多元回归模型的常用方法是最小二乘法(Ordinary Least Squares,OLS)。

最小二乘法通过最小化观测值和模型预测值之间的残差平方和,找到最佳拟合的回归系数。

拟合好的多元回归模型应具备以下特征:1.较小的残差:模型的残差应该较小,表示模型能够较好地拟合数据。

2.显著的回归系数:回归系数应该达到统计显著性水平,表示自变量对因变量的影响是真实存在的。

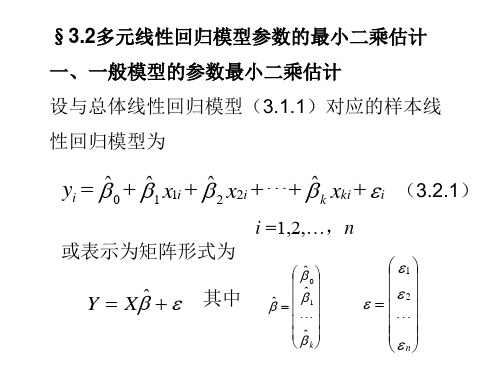

多元线性回归模型参数的最小二乘估计

1

2

n

相应的样本线性回归方程为

yˆi ˆ0 ˆ1 x1i ˆ2 x2i ˆk xki

i =1, 2 ,…,n

(3.2.2)

利用最小二乘法求参数估计量 ˆ0, ˆ1, ˆ2,,ˆk :

设残差平方和为Q,则

Q

=

2 i

(

yi

yˆi

)2

( yi ˆ0 ˆ1 x1i ˆ 2 x2i ˆ k xki )2

(3.2.25)

从而参数估计量的表达式可以简记为

ˆ1

D1 (2) D(2)

(3.2.26)

ˆ 2

D2 (2) D(2)

(3.2.27)

推广至 k 元线性回归,其参数的表达式便有:

ˆ

j

D j (k) D(k)

j =1,2,…,k

ˆ0 y ˆ1 x1 ˆ2 x2 ˆk xk

(3.2.28) (3.2.29)

我们的任务是寻求适当的 ˆ0, ˆ1, ˆ2,,ˆk 使Q达到 最小。根据多元函数的极值原理,ˆ0, ˆ1, ˆ2,,ˆk

应是下列方程组的解:

Q

ˆ0

2 ( yi

ˆ 0

ˆ1 x1i

ˆ 2

x2i

ˆ k

xki)

0

Q

ˆ1

2

(

yi

ˆ 0

ˆ1

x1i

ˆ

2

x2i

ˆ

k

xki)

x1i

0

… … … … … … … …… … … …

Q

ˆ k

2 ( yi

ˆ 0

ˆ1 x1i

ˆ 2 x2i

ˆ k

xki) xki

0

整理可得正规方程组:

简单线性回归与多元线性回归

简单线性回归与多元线性回归简单线性回归与多元线性回归是统计学中两个常用的回归分析方法。

它们用于分析自变量与因变量之间的关系,并建立数学模型来预测或解释因变量的变化。

本文将对简单线性回归与多元线性回归进行详细介绍,并比较它们的不同之处。

一、简单线性回归简单线性回归是一种基本的回归分析方法,适用于只包含一个自变量和一个因变量的情况。

它基于以下线性模型:Y = β0 + β1X + ε其中,Y表示因变量,X表示自变量,β0和β1表示回归系数,ε表示误差项。

简单线性回归的目标是通过寻找最佳拟合直线来描述X和Y之间的关系。

常用的拟合方法是最小二乘法,即通过最小化观测值与拟合值之间的残差平方和来确定回归系数的估计值。

根据最小二乘法,可以得到回归方程的估计值:Ŷ = b0 + b1X其中,Ŷ表示Y的估计值,b0和b1表示回归系数的估计值。

简单线性回归的模型可以用来预测因变量Y的取值,以及解释自变量X对因变量Y的影响程度。

然而,它只适用于关系简单、因变量唯一受自变量影响的情况。

二、多元线性回归多元线性回归是一种扩展的回归分析方法,适用于包含多个自变量和一个因变量的情况。

它基于以下线性模型:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε其中,Y表示因变量,X1、X2、...、Xn表示自变量,β0、β1、β2、...、βn表示回归系数,ε表示误差项。

多元线性回归的目标是通过寻找最佳拟合超平面来描述X1、X2、...、Xn和Y之间的关系。

与简单线性回归类似,多元线性回归也采用最小二乘法来估计回归系数的取值。

根据最小二乘法,可以得到回归方程的估计值:Ŷ = b0 + b1X1 + b2X2 + ... + bnXn其中,Ŷ表示Y的估计值,b0、b1、b2、...、bn表示回归系数的估计值。

多元线性回归的模型可以用来预测因变量Y的取值,以及解释自变量X1、X2、...、Xn对因变量Y的影响程度。

多元总体最小二乘问题的牛顿解法

多元总体最小二乘问题的牛顿解法王乐洋;赵英文;陈晓勇;臧德彦【摘要】为提高多元总体最小二乘问题参数估值的解算效率,推导了基于牛顿法的多元加权总体最小二乘算法;分析比较了基于牛顿法的多元加权总体最小二乘解和基于拉格朗日乘数法多元加权总体最小二乘解之间的关系,根据协因数传播律给出了多元总体最小二乘平差的16种协因数阵的近似计算公式.新算法能够解决观测矩阵和系数矩阵元素具有相关性的问题,并且可以把观测矩阵和系数矩阵的随机元素和常数元素纳入到一个协因数阵中进行处理.算例结果表明,本文提出的多元总体最小二乘问题的牛顿解法可行且收敛速度更快.【期刊名称】《测绘学报》【年(卷),期】2016(045)004【总页数】8页(P411-417,424)【关键词】多元总体最小二乘;牛顿法;协因数传播律;仿射变换【作者】王乐洋;赵英文;陈晓勇;臧德彦【作者单位】东华理工大学测绘工程学院,江西南昌330013;流域生态与地理环境监测国家测绘地理信息局重点实验室,江西南昌330013;江西省数字国土重点实验室,江西南昌330013;东华理工大学测绘工程学院,江西南昌330013;东华理工大学测绘工程学院,江西南昌330013;流域生态与地理环境监测国家测绘地理信息局重点实验室,江西南昌330013;江西省数字国土重点实验室,江西南昌330013;东华理工大学测绘工程学院,江西南昌330013;流域生态与地理环境监测国家测绘地理信息局重点实验室,江西南昌330013;江西省数字国土重点实验室,江西南昌330013【正文语种】中文【中图分类】P207transformationFoundation support: The National Natural Science Foundation of China ( Nos. 41204003; 41161069; 41304020; 41464001); The National Department Public Benefit Research Foundation (Surveying,Mapping and Geoinformation)(No. 201512026); The Natural Science Found ation of Jiangxi Province (No. 20151BAB203042); The Science and Technol ogy Project of the Education Department of Jiangxi Province (Nos. GJJ1505 95; KJLD12077; KJLD14049); The Found of Key Laboratory of Watershed Ec ology and Geographical Environment Monitoring (No. WE2015005); The Sc ientific Research Foundation of ECIT(No. DHBK201113); Innovation Fund D esignated for Graduate Students of Jiangxi Province (Nos. YC2015-S266; YC2015-S267); Innovation Fund Designated for Graduate Students of ECIT(No. DHY C-2015005); The Found of the Key Laboratory of Mapping from Space, NASG (No.K201502)总体最小二乘(total least squares,TLS)方法是近30多年来发展起来的一种能同时顾及观测值误差和模型系数矩阵误差的数学方法,其理论及应用研究是目前国内外研究的热点问题[1]。

最小二乘法贝塔与相关系数

最小二乘法贝塔与相关系数

最小二乘法用于拟合数据,其中贝塔(β)通常表示回归系数,相关系数则用来衡量变量之间的线性相关性。

1. 贝塔(β):在最小二乘法中,贝塔(β)是回归系数,表示自变量对因变量的影响程度。

在简单线性回归中,有一个自变量和一个因变量,贝塔表示自变量对因变量的影响程度。

在多元线性回归中,每个自变量都有一个对应的贝塔系数,表示它们对因变量的影响程度。

2. 相关系数:相关系数(通常用符号r 表示)衡量了两个变量之间的线性相关程度。

它的取值范围在-1 到1 之间。

当相关系数接近于1 时,表示两个变量之间存在强正相关性;当相关系数接近于-1 时,表示两个变量之间存在强负相关性;当相关系数接近于0 时,表示两个变量之间几乎没有线性相关性。

在最小二乘法中,通常会计算相关系数来评估拟合模型的质量。

如果相关系数接近于1,表示模型对数据的拟合程度较好;如果相关系数接近于0,表示模型对数据的拟合程度较差。

1/ 1。

python多元最小二乘法

Python多元最小二乘法1. 介绍多元最小二乘法(Multiple Linear Regression)是一种常用的统计分析方法,用于建立多个自变量与一个因变量之间的线性关系模型。

在Python中,我们可以使用statsmodels库来进行多元最小二乘法的实现。

本文将介绍多元最小二乘法的原理和基本概念,并展示如何使用Python进行多元最小二乘法分析。

2. 多元最小二乘法原理多元最小二乘法的目标是找到一条直线(或超平面),使得该直线与实际观测值之间的误差平方和最小。

该直线的方程可以表示为:y=β0+β1x1+β2x2+⋯+βn x n其中,y是因变量,x1,x2,…,x n是自变量,β0,β1,β2,…,βn是回归系数。

多元最小二乘法的核心是通过最小化误差平方和来求解回归系数。

误差平方和定义为:m∑(y i−y î)2i=1其中,m是观测值的数量,y i是实际观测值,y î是根据回归方程计算出的预测值。

为了求解回归系数,我们可以使用最小二乘法的正规方程解,公式如下:β=(X T X)−1X T y其中,β是回归系数的向量,X是自变量的矩阵,y是因变量的向量。

3. 使用Python进行多元最小二乘法分析3.1 准备数据在进行多元最小二乘法分析之前,我们首先需要准备数据。

假设我们有一个数据集,包含了3个自变量(x1,x2,x3)和1个因变量(y)。

我们可以使用pandas库来读取和处理数据。

import pandas as pd# 读取数据data = pd.read_csv('data.csv')# 提取自变量和因变量X = data[['x1', 'x2', 'x3']]y = data['y']3.2 构建模型在准备好数据之后,我们可以使用statsmodels库来构建多元最小二乘模型。

import statsmodels.api as sm# 添加常数列X = sm.add_constant(X)# 构建模型model = sm.OLS(y, X)3.3 拟合模型使用构建好的模型,我们可以拟合数据,得到回归系数。

多元最小二乘法

多元最小二乘法

多元最小二乘法是一种常用的统计学方法,用于处理多个自变量和一个因变量之间的关系。

它是一种模型拟合方法,可以帮助我们预测因变量的值,并检验多个自变量之间的相互影响。

在使用多元最小二乘法时,我们需要先建立数学模型,以确定因变量与自变量之间的某种函数关系。

这个函数关系可以是线性的、非线性的,也可以包含交互项。

接下来,我们需要利用样本数据集,计算出最小二乘估计量,即找到最优的系数值,使得模型与样本数据集的拟合程度最好。

最后,我们可以利用这个模型来进行预测和推断分析,以找出变量之间的关系。

多元最小二乘法的优势在于它可以帮助我们分析多个自变量之间的相互作用,找出它们之间的相互影响。

在建立模型时,我们可以利用一些统计方法,如主成分分析和因子分析,并考虑到自变量之间的相关性,来消除冗余和噪音,以提高模型的精度和可靠性。

然而,多元最小二乘法也存在一些限制和注意事项。

首先,我们在建立模型时需要严格遵守统计学原理,避免过度拟合和抽样误差。

其次,在处理样本数据时,我们需注意缺失值和异常值,以确保结果的准确性和可靠性。

综上所述,多元最小二乘法是一个非常有用的统计学方法,可以帮助我们分析多个自变量之间的关系,预测因变量的值,并进行各种

推断分析。

在正确定义模型和处理数据时,我们需要谨慎选择方法并注意减少误差,以得到最精确的结果。

最小二乘法求解参数

最小二乘法求解参数

最小二乘法求解参数是数学分析中使用最广泛的一种方法,它可以将某种未知参数变量和它们之间的数据进行关联。

本文将介绍最小二乘法的原理、算法实现方法以及其优点等内容。

一、最小二乘法原理

最小二乘法是一种通过求解最小二乘函数来求解参数的方法。

最小二乘函数定义为:

y = f(x, b)

其中,y 为拟合函数,f 为未知的参数的函数,x 为自变量,b 为参数变量。

因此,最小二乘法的目标就是最小化 y 与 f(x,b)之间的误差,以求得准确的参数变量 b。

求解的过程中,要求解的函数f(x,b)必须可导,以便求解极值问题。

二、最小二乘法算法实现

最小二乘法的算法实现主要包括四步:

(1)将原始数据进行处理,提取出可用的参数变量和自变量;

(2)确定迭代函数,将输入数据与特定的函数f(x,b)定义关系;

(3)利用最小二乘法求解出函数f(x,b)的参数变量b;

(4)对拟合曲线进行验证,确定最小二乘法求解的参数变量b 的准确性。

三、最小二乘法的优点

最小二乘法求解参数的优点如下:

(1)能够实现复杂的参数变量拟合,可以有效的拟合散乱点;

(2)可以将多个未知参数变量放入拟合曲线中,可以较好的拟合多元数据;

(3)不会受到采样点分布的影响,可以较为准确的拟合数据;

(4)能够求出拟合曲线的最小值,使得容差最小。

四、结论

最小二乘法是一种比较简单有效的求解参数的方法,它可以提供一种准确的拟合散乱点的方法,可以有效的解决参数估计问题。

不仅可以拟合多元函数,同时还可以很好的拟合非线性数据。

最小二乘法能够求出最小值,使得容差最小,因此应用十分广泛。

多重共线性问题的偏最小二乘估计

多重共线性问题的偏最小二乘估计1. 引言1.1 多重共线性问题介绍多重共线性问题是指自变量之间存在高度相关性,导致最小二乘估计的系数不稳定或偏误的情况。

在实际数据分析中,多重共线性经常会出现,给回归分析结果的解释和预测带来困难。

多重共线性问题会导致估计的系数具有高方差,降低了模型的精确性和可靠性,也影响了变量的解释能力。

当多重共线性存在时,模型的系数可能与理论假设不一致,使得结果产生偏误。

在处理多重共线性问题时,传统的最小二乘估计方法往往表现不佳。

引入偏最小二乘估计方法成为解决多重共线性问题的重要手段。

偏最小二乘估计能够有效地削弱自变量之间的相关性对估计结果的影响,提高模型的稳定性和准确性,从而更好地解释变量之间的关系。

1.2 传统的最小二乘估计存在的问题传统的最小二乘估计存在的问题主要体现在多重共线性问题上。

多重共线性是指自变量之间存在高度相关性,导致最小二乘估计结果不稳定、系数估计不准确甚至无法计算的问题。

当自变量之间存在较高的相关性时,最小二乘法会放大这种相关性对估计结果的影响,使得模型的预测能力下降,导致模型的解释性变差。

多重共线性问题会导致最小二乘估计的系数估计不稳定,系数估计的标准误差增大,使得模型的显著性降低。

多重共线性还可能导致自变量的系数估计出现错误的符号,使得对真实关系的解释产生混淆。

传统的最小二乘估计在面对多重共线性问题时,往往无法给出令人满意的结果,因此需要引入偏最小二乘估计来解决这一问题。

偏最小二乘估计通过降维的方式消除自变量之间的相关性,从而提高模型的稳定性和有效性。

在实际应用中,偏最小二乘估计已被广泛应用于多个领域,并取得了显著的效果。

2. 正文2.1 偏最小二乘估计的原理偏最小二乘估计的原理是建立在最小二乘估计的基础之上的一种方法。

在多重共线性问题中,自变量之间存在高度相关性,这会导致最小二乘估计中回归系数的估计不准确甚至不可靠。

偏最小二乘估计通过对自变量进行降维处理,将原始自变量转化为新的一组与因变量相关性最大的维度,从而减少共线性带来的影响。

多元函数的最小二乘法

q=[0,50,200,100;100,0,150,200;50,150,0,200;50,100,150,0];

P=[350,450,400,300];

A=[200,300,500,500];

r=[0,8,17,15;12,0,16,20;10,12,0,18;6,9,10,0];

用心打造免费、绿色、专业、海量的教育网站 本文档来源于第一网: https:///news/397823987C39DF1B.html

end end end % for i=1:4 % for j=1:4 % if(r(i,j)~=0) % u(i,j)=0.0571*(P(i)*A(j))^0.496/(r(i,j)^(-0.6952)); % end % end % end % for i=1:4 % for j=1:4 % r1(i,j)=f(i,j)-q(i,j); % r2(i,j)=u(i,j)-q(i,j); % end % end % s1=0;s2=0; % for i=1:4 % for j=1:4 % s1=s1+ r1(i,j)^2; % s2=s2+ r2(i,j)^2; % end % end

多元最小二乘法 多元最小二乘法原理 多元非线性最小二乘法 矩阵的最小二乘法 最小二乘法的推导 最小二乘法的原理 最小二乘法的定义 最小二乘法的应用 带权的最小二乘法 最小二乘法的功能 更多相关文档请访问:https:///

用心打造免费、绿色、专业、海量的教育网站 a0=0;b0=0;c0=0;

a1=0;b1=0;c1=0;

a2=0;b2=0;c2=0;

Q=zeros(4);R=zeros(4);PA=zeros(4);

多元线性回归与最小二乘估计

多元线性回归与最小二乘估计1.假定条件、最小二乘估计量和高斯—马尔可夫定理 多元线性回归模型:y t = β0 +β1x t 1 +β2x t 2 +…+βk - 1x t k -1 + u t(1.1)其中y t 是被解释变量(因变量),x t j 是解释变量(自变量),u t 是随机误差项,βi , i = 0, 1, … , k - 1是回归参数(通常未知)。

对经济问题的实际意义:y t 与x t j 存在线性关系,x t j , j = 0, 1, … , k - 1, 是y t 的重要解释变量。

u t 代表众多影响y t 变化的微小因素。

使y t 的变化偏离了E( y t ) =多元线性回归与最小二乘估计1.假定条件、最小二乘估计量和高斯—马尔可夫定理 多元线性回归模型:y t = β0 +β1x t 1 +β2x t 2 +…+βk - 1x t k -1 + u t(1.1)其中y t 是被解释变量(因变量),x t j 是解释变量(自变量),u t 是随机误差项,βi , i = 0, 1, … , k - 1是回归参数(通常未知)。

对经济问题的实际意义:y t 与x t j 存在线性关系,x t j , j = 0, 1, … , k - 1, 是y t 的重要解释变量。

u t 代表众多影响y t 变化的微小因素。

使y t 的变化偏离了E( y t ) =β0 +β1x t 1 +β2x t 2 +…+βk - 1x t k -1决定的k 维空间平面。

当给定一个样本(y t , x t 1, x t 2 ,…, x t k -1), t = 1, 2, …, T 时, 上述模型表示为y 1 =β0 +β1x 11 +β2x 12 +…+βk - 1x 1 k -1 + u 1, 经济意义:x t j 是y t 的重要解释变量。

y 2 =β0 +β1x 21 +β2x 22 +…+βk - 1x 2 k -1 + u 2, 代数意义:y t 与x t j 存在线性关系。

最小二乘法

第 2 页,共 4 页

n n n x y n x xi yi − ∑ ∑ ∑ i i i a = 1 i 1= −1 i 1 = i 1 = = b A n n n n det( ) A 2 ∑ yi − ∑ xi ∑ xi ∑ yi = = = i 1 i1 i 1= i1 n n n n x y x yi − ∑ ∑ ∑ i i i 1 = i 1 i 1= i 1 = . = n n det( A) n 2 n ∑ xi ∑ yi − ∑ xi ∑ xi yi = = i 1 i 1= i 1 i 1=

ˆ= a + bx y

(1)

,是为了区分 y 的实际值(实验值,观察值) yi , 这里在 y 的上方加“ ” ˆ i ,而直线上对 表示当 x 取值为 xi ( i = 1, 2,3, , n )时, y 的相应预测值为 y ˆ( x 应于 xi 的纵坐标是 = yi y = axi + b 。(1) 式叫作 y 对 x 的回归直线方 i) 程,斜率 a 叫做回归系数(regressi,平 均而言, y 将变动 a 单位。 现在的问题是如何求回归直线方程 (1),即如何确定 a 和 b 。

n ∂Q ( a, b) = −2∑ xi [ yi − ( axi + b)] = 0, ∂a i =1 n ∂Q ( a, b) = −2∑ [ yi − ( axi + b)] = 0. ∂b i =1

得

n n n n 2 xi 0, )] ∑ xi yi − a ∑ xi − b∑ = ∑ xi [ yi − ( axi + b= i 1 = = i 1 = i 1= i 1 n n n − + = − = 0. y ax b y a xi − nb ( ) [ ] ∑ i ∑ ∑ i i i1 = = i 1= i 1

多元最小二乘例子

多元最小二乘例子

**方言小故事:小明和多元最小二乘法**

咱村的小明啊,是个聪明伶俐的孩子。

他不但算术好,还特别喜欢琢磨些新鲜玩意儿。

这不,最近老师讲了多元最小二乘法,小明就琢磨着这玩意儿到底有啥用呢。

有一天,小明去帮爷爷放羊,他数了数,有十只羊。

他想:“如果我能知道每只羊的重量,再知道它们吃的草量,那我是不是就能算出平均每天需要多少草来喂它们呢?”

小明回家后就琢磨开了。

他找爷爷问每只羊的大概重量,又去看了看羊圈里每天剩下的草量。

他发现,羊的重量和吃的草量不是简单的正比关系,因为有的羊吃得多长得慢,有的羊吃得少长得快。

这下可把小明难住了,他想了想,想起了老师说的多元最小二乘法。

他想:“如果把羊的重量和吃的草量都当成变量,然后用最小二乘法来拟合一个曲线,那是不是就能更准确地算出每天需要多少草了呢?”

于是,小明拿出纸笔,开始列方程、算数据。

经过一番努力,他终于得到了一个公式,这个公式能够根据羊的重量和吃的草量来预测每天需要的草量。

小明高兴地把这个结果告诉了爷爷,爷爷听了也直夸他聪明。

小明心里美滋滋的,他觉得多元最小二乘法真是个好东西,能帮他解决这么实际的问题。

从此以后啊,小明就更加喜欢数学了,他觉得数学不仅有趣,还能帮助他解决生活中的问题。

而那个多元最小二乘法的例子,也成了他和朋友们分

享数学乐趣的一个小故事。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多元最小二乘法[C语言版]2007年02月13日 星期二 13:19/*======关键词:最小二乘法,逆矩阵,矩阵,伴随矩阵,矩阵乘法,c语言,数组==*/

/*======春节在厦大过年了,将最小二乘法用C语言实现,也算一点收获.:)==*/

{

printf("%10.15f ",Carray[i][j]);

}

printf("\n");

}

for(i=1;i<=mcount;i++){/*计算AX'矩阵数据M行*N列 */

for(j=1;j<=ncount;j++)

FILE *f;

main()

{

int i,j;

if ((f=fopen("array.txt","rt"))==NULL)

{printf("Open file error!Please check the file.\n");

{

for(j=1;j<=i;j++)

{

if(i!=X && j!=X)

if(Order[i]<Order[j])

counter++;

}

}

return getov(counter);

};

int getov(int c){

if((c%2)==0) return 1;/*return(counter);得到序数的奇偶,奇则为-1否则为1*/

}

printf("=> ");

for(m=1;m<=mcount;m++){

if(m!=X){

if(order[m]!=Y)

printf("%3.2f ",array[m][order[m]]);

else

printf("invaluable");

fscanf(f,"%lf\n",&Barray[i]);

}

printf("All data read over.\n");

OLS();

}

/*=======================================================*/

for(j=1;j<=mcount;j++)

{

array[i][j]=0;

for(k=1;k<=ncount;k++){

array[i][j]=array[i][j]+Aarray[k][i]*Aarray[k][j];

}

}

}

printf("X'X over\n");

double Barray[25];

for(i=1;i<=mcount;i++){/*显示X'X矩阵数据m*m */

for(j=1;j<=mcount;j++)

{

printf("%5.8f ",array[i][j]);

}

printf("\n");

}

printf("The value is: %10.15f\n",getvalue());

}

}

printf("\n");*/

value=value+val;

}

};

int check(int m,int k)/*检查该序数是否已分配*/

{

int i;

for(i=mcount;i>k;i--)

if(m==order[i])

return 0;

{

int i,j,m;

double val;/*一排列元素的值*/

if(k>=1)/*未生成完毕*/

{

for(i=mcount;i>=1;i--)

{

if(check(i,k))/*若该序数未分配,则分配*/

{

order[k]=i;

creatorder(k-1);/*分配下一个*/

{

for(k=1;k<=mcount;k++){

Darray[i][j]=Darray[i][j]+Carray[i][k]*Aarray[j][k];

}

}

}

printf("The result is:");

for(i=1;i<=mcount;i++){/*计算DY矩阵数据M行*/

{

for(i=mcount;i>=1;i--)

{

if(check(i,k))/*若该序数未分配,则分配*/

{

order[k]=i;

creataorder(k-1,X,Y);/*分配下一个*/

}

}

}

else/*一个序列生成完毕*/

{

val=getaorder(order,mcount,X);

for(j=2;j<=mcount;j++)

{

fscanf(f,"%lf ",&Aarray[i][j]);

fscanf(f,"\n");

}

}

fscanf(f,"\n");

for(i=1;i<=ncount;i++){/*读Y矩阵数据n列*/

for(i=1;i<=ncount;i++){/*X矩阵数据n*m */

for(j=1;j<=mcount;j++)

{

printf("%5.8f ",Aarray[i][j]);

}

printf("\n");

}

for(i=1;i<=mcount;i++){/*计算X'X矩阵数据m*m */

}

}

}

else/*一个序列生成完毕*/

{

val=getorder(order,mcount);

for(m=1;m<=mcount;m++){

val=val*array[m][order[m]];

}

value=value+val;

}

};

double getavalue(int X,int Y)/*得到伴随矩阵值*/

return 1;

}

/*=======================================================*/

/*========================getorder.c=============================*/

#include <stdio.h>

}

fscanf(f,"%d %d\n",&ncount,&mcount);/*得到矩阵维数*/

mcount++;/*列数加1*/

for(i=1;i<=ncount;i++){/*读X矩阵数据n行*m列*/

Aarray[i][1]=1;/*第一列置1*/

int getorder(int Order[],int COUN)/*得到序数*/ {

int counter=0;

int i=1,j=1;

for(i=1;i<=COUNT;i++)

{

for(j=1;j<=i;j++)

{

if(Order[i]<Order[j])

/*========================getvalue.c=============================*/

#include <..\array\head.h>

#include <..\array\getord

{

counter++;

}

}

}

return getov(counter);

};

int getaorder(int Order[],int COUNT,int X)/*得到伴随矩阵的序数,X为除去的序数*/

{

int counter=0;