3-1最优化搜索算法的结构

最优化方法第二章_线搜索算法_最速下降法

f x1 , x2 c, c>0,

2

改写为:

x12 2c 1

2 x2

2c 2

2

1

二、最速下降法

x2

这是以

2c

1

和

2c

2

为半轴的椭圆

2c

2c

2

2

从下面的分析可见 两个特征值的相对

x1

大小决定最速下降法的收敛性。

(1)当 1 2 时,等值线变为圆

2 2

4 f x , 2

2 x1 2 x2 4 f ( x) , 2 x1 +4x2

4 d = f x , 2

0 0

=40 2 20 3 令 0= ' ( ) 80 20, 得 0 =1/4,

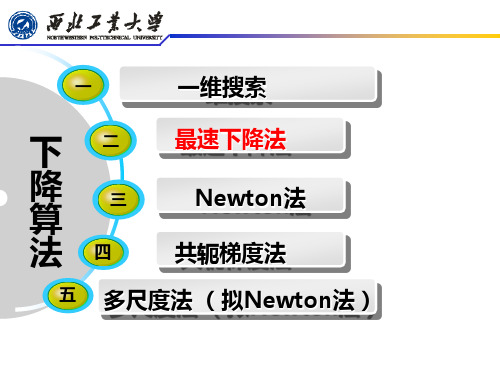

一

一维搜索

二 三 四

下 降 算 法

五

最速下降法 Newton法 共轭梯度法

多尺度法 (拟Newton法)

二、最速下降法 假设 f 连续可微,取 线搜索方向

k

d f ( x )

k

步长k 由精确一维搜索得到。 从而得到第 k+1次迭代点,即

f ( x k k d k ) min f ( x k d k )

(推论)在收敛定理的假设下,若f (x)为凸函数,则最速下降 法或在有限迭代步后达到最小点;或得到点列 x k ,它的任 何聚点都是 f (x)的全局最小点。

二、最速下降法

最速下降法特征:相邻两次迭代的方向互相垂直。

令

( ) f ( x d ), 利用精确一维搜索,可得

最优化fr算法

最优化fr算法最优化FR算法介绍最优化FR算法是一种用于解决无约束优化问题的算法,它是由Fletcher和Reeves在1964年提出的。

该算法通过使用梯度信息来确定搜索方向,并利用一定的步长来更新当前位置,从而逐步逼近极小点。

原理最优化FR算法基于以下原理:1. 梯度信息:在每个迭代步骤中,计算当前位置的梯度信息。

2. 搜索方向:使用梯度信息来确定搜索方向。

3. 步长:使用一定的步长来更新当前位置。

具体地说,最优化FR算法通过以下方式实现:1. 初始化:选择一个初始点x0,并设置一个初始搜索方向d0为负梯度方向。

2. 迭代:对于每个迭代k,计算当前位置xk的梯度gk,并计算搜索方向dk。

3. 步长计算:使用一定的步长tk来更新当前位置xk+1=xk+tkdk,并计算下一次迭代时的搜索方向dk+1。

4. 终止条件:当满足某个终止条件时停止迭代,例如当梯度范数小于某个阈值时停止迭代。

优缺点最优化FR算法具有以下优点:1. 简单易实现:该算法的实现相对简单,且不需要额外的约束条件。

2. 收敛性:在一定条件下,该算法可以保证收敛到全局最小值。

3. 适用性:该算法可以应用于各种类型的优化问题。

然而,最优化FR算法也存在以下缺点:1. 收敛速度:在某些情况下,该算法的收敛速度可能较慢。

2. 局部极小值:该算法可能会陷入局部极小值而无法找到全局最小值。

改进为了克服最优化FR算法的缺点,研究人员提出了许多改进版本。

以下是其中一些常见的改进:1. 最优化PRP算法:该算法使用了更复杂的搜索方向计算方法,并在一定程度上提高了收敛速度。

2. 最优化CD算法:该算法使用了更复杂的步长计算方法,并在一定程度上提高了收敛速度和稳定性。

3. 最优化DFP和BFGS算法:这两种基于拟牛顿方法的改进版本可以更好地处理非线性问题,并且具有更快的收敛速度和更好的稳定性。

总结最优化FR算法是一种简单易实现且适用性广泛的无约束优化算法。

最优化问题的算法迭代格式

最优化问题的算法迭代格式最优化问题的算法迭代格式最优化问题是指在一定的条件下,寻找使某个目标函数取得极值(最大值或最小值)的变量取值。

解决最优化问题的方法有很多种,其中较为常见的是迭代法。

本文将介绍几种常用的最优化问题迭代算法及其格式。

一、梯度下降法梯度下降法是一种基于负梯度方向进行搜索的迭代算法,它通过不断地沿着目标函数的负梯度方向进行搜索,逐步接近极值点。

该方法具有收敛速度快、易于实现等优点,在许多应用领域中被广泛使用。

1. 算法描述对于目标函数 $f(x)$,初始点 $x_0$ 和学习率 $\alpha$,梯度下降算法可以描述为以下步骤:- 计算当前点 $x_k$ 的梯度 $\nabla f(x_k)$;- 更新当前点 $x_k$ 为 $x_{k+1}=x_k-\alpha\nabla f(x_k)$;- 如果满足停止条件,则输出结果;否则返回第 1 步。

2. 算法特点- 沿着负梯度方向进行搜索,能够快速收敛;- 学习率的选择对算法效果有重要影响;- 可能会陷入局部极小值。

二、共轭梯度法共轭梯度法是一种基于线性方程组求解的迭代算法,它通过不断地搜索与当前搜索方向共轭的新搜索方向,并在该方向上进行一维搜索,逐步接近极值点。

该方法具有收敛速度快、内存占用少等优点,在大规模问题中被广泛使用。

1. 算法描述对于目标函数 $f(x)$,初始点 $x_0$ 和初始搜索方向 $d_0$,共轭梯度算法可以描述为以下步骤:- 计算当前点 $x_k$ 的梯度 $\nabla f(x_k)$;- 如果满足停止条件,则输出结果;否则进行下一步;- 计算当前搜索方向 $d_k$;- 在当前搜索方向上进行一维搜索,得到最优步长 $\alpha_k$;- 更新当前点为 $x_{k+1}=x_k+\alpha_k d_k$;- 计算新的搜索方向 $d_{k+1}$;- 返回第 2 步。

2. 算法特点- 搜索方向与前面所有搜索方向都正交,能够快速收敛;- 需要存储和计算大量中间变量,内存占用较大;- 可以用于非线性问题的求解。

人工智能导论 第5讲 超越经典的搜索

➢竞争比越小越好

➢竞争比可以是无穷大,比如达到某些状态后 无法达到目标状态(活动不可逆)

➢可安全探索的状态空间:每个可达到的状态 出发都有达到目标状态的行动,如迷宫问题, 八数码问题

➢ 局部搜索算法 ➢ 不确定动作的搜索 ➢ 使用部分可观察信息的搜索 ➢ 联机搜索

QA?

32752411

24748552

突变点

3 2 7 4 8 51 5 2

交叉点

父代 交叉点

子代

样本被选择繁衍后 代的概率正比于它 的适应度函数值

发生交叉操作的概 率需要预先设定, 交叉位置随机产生

发生突变操作的概 率需要预先设定, 通常远小于交叉概 率

➢环境是完全可观察的和确定的

➢可以知道任何动作序列之后达到的状态

➢环境是部分可观察或者是不确定的

➢无法准确预知未来状态 ➢需根据未来感知信息制定相应的行为

➢例子:真空洗尘器世界的不稳定行为

➢在一块脏区域吸尘可以使该区域干净,有时也 会清洁邻近区域

➢在干净区域吸尘可能是该区பைடு நூலகம்弄脏

➢Suck when state=1

➢If state=5 then [right,suck] ➢Else do nonthing

➢ 随机束搜索:不是找到k个最佳,而是随机找 到k个后继状态,随机概率与状态值成正比。

➢ 遗传算法是模仿生物遗传学和自然选择机理, 通过人工方式所构造的一类优化搜索算法,是 对生物进化过程进行的一种数学仿真。

➢ 遗传算法为那些难以找到传统数学模型的难题 指出了一个解决方法。

➢ 遗传算法借鉴了生物科学的知识,体现了人工 智能这一交叉学科的特点。

➢遗传算法的编码方法有二进制编码、浮点数 编码方法、格雷码、符号编码方法、多参数 编码方法等。

多参数寻找最优解算法_解释说明以及概述

多参数寻找最优解算法解释说明以及概述1. 引言1.1 概述本篇长文将介绍多参数寻找最优解算法,该算法可以应用于各个领域的优化问题。

在实际问题中,往往存在多个参数需要同时调整以获取最佳解,而传统的单参数最优化算法无法满足这种需求。

因此,我们需要一种能够同时考虑多个参数的寻找最优解算法。

1.2 文章结构本文分为五个主要部分进行阐述和探讨。

首先,在引言部分我们将概述本篇文章的目的和内容,并介绍多参数寻找最优解算法的定义和特点(第2部分)。

接着,在第3部分我们将详细解释说明该算法的原理,并提供相应的流程图解析。

在第4部分,我们将通过具体的案例来展示该算法的实现步骤与技巧分享,并进行案例选择和分析方法论述。

最后,在第5部分中,我们将总结研究成果并讨论存在问题及改进方向,并展望未来相关研究领域。

1.3 目的本文旨在深入探讨多参数寻找最优解算法,并且通过具体案例的分析展示其实现步骤与技巧。

我们希望读者能够对该算法的原理和应用有一个清晰的了解,并能够在实际问题中灵活运用。

通过本文的阅读,读者将能够了解到该算法在不同领域的应用,并对相关的研究方向和改进方法提供参考和启示。

2. 多参数寻找最优解算法2.1 定义多参数寻找最优解算法是一种用于在具有多个参数的问题中找到最优解的方法。

通常,在现实世界中的许多问题都具有多个输入或参数,而这些参数之间可能存在复杂的相互关系。

因此,通过使用多参数寻找最优解算法,可以更全面地分析和评估各种可能的参数组合,并找到最佳的解决方案。

2.2 特点多参数寻找最优解算法具有以下特点:- 能够同时考虑多个参数的影响:相比于单一参数优化方法,如经典的梯度下降算法,在处理多个参数时更加有效。

- 考虑了各个参数之间的相互关系:该算法考虑到不同参数之间可能存在着相关性或交互作用,从而能够更全面地搜索最优解空间。

- 涵盖了广泛的应用领域:由于许多实际问题涉及到多个变量或条件,因此该算法在各种领域中都具有广泛应用价值。

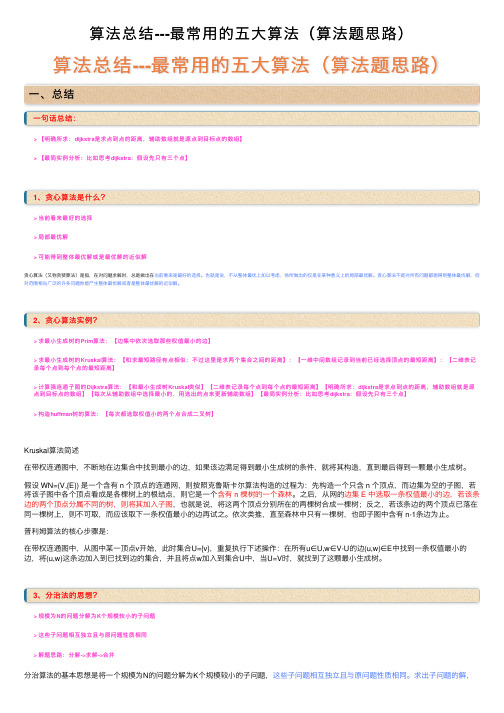

算法总结---最常用的五大算法(算法题思路)

算法总结---最常⽤的五⼤算法(算法题思路)算法总结---最常⽤的五⼤算法(算法题思路)⼀、总结⼀句话总结:> 【明确所求:dijkstra是求点到点的距离,辅助数组就是源点到⽬标点的数组】> 【最简实例分析:⽐如思考dijkstra:假设先只有三个点】1、贪⼼算法是什么?> 当前看来最好的选择> 局部最优解> 可能得到整体最优解或是最优解的近似解贪⼼算法(⼜称贪婪算法)是指,在对问题求解时,总是做出在当前看来是最好的选择。

也就是说,不从整体最优上加以考虑,他所做出的仅是在某种意义上的局部最优解。

贪⼼算法不是对所有问题都能得到整体最优解,但对范围相当⼴泛的许多问题他能产⽣整体最优解或者是整体最优解的近似解。

2、贪⼼算法实例?> 求最⼩⽣成树的Prim算法:【边集中依次选取那些权值最⼩的边】> 求最⼩⽣成树的Kruskal算法:【和求最短路径有点相似:不过这⾥是求两个集合之间的距离】:【⼀维中间数组记录到当前已经选择顶点的最短距离】:【⼆维表记录每个点到每个点的最短距离】> 计算强连通⼦图的Dijkstra算法:【和最⼩⽣成树Kruskal类似】【⼆维表记录每个点到每个点的最短距离】【明确所求:dijkstra是求点到点的距离,辅助数组就是源点到⽬标点的数组】【每次从辅助数组中选择最⼩的,⽤选出的点来更新辅助数组】【最简实例分析:⽐如思考dijkstra:假设先只有三个点】> 构造huffman树的算法:【每次都选取权值⼩的两个点合成⼆叉树】Kruskal算法简述在带权连通图中,不断地在边集合中找到最⼩的边,如果该边满⾜得到最⼩⽣成树的条件,就将其构造,直到最后得到⼀颗最⼩⽣成树。

假设 WN=(V,{E}) 是⼀个含有 n 个顶点的连通⽹,则按照克鲁斯卡尔算法构造的过程为:先构造⼀个只含 n 个顶点,⽽边集为空的⼦图,若将该⼦图中各个顶点看成是各棵树上的根结点,则它是⼀个含有 n 棵树的⼀个森林。

运筹学与最优化方法 第3版 第1章 运筹学思想与运筹学建模

1.5基本概念和符号

2.多元函数及其导数

(1) n元函数:f (x): Rn R

线性函数:f (x) = cTx + b = ci xi + b 二次函数:f (x) = (1/2) xTQx + cTx + b

= (1/2) aij xi xj + ci xi + b 向量值线性函数:F(x) = Ax + d Rm

其中, A为 mn矩阵,d为m维向量

F(x)=( f1(x), f2(x), … , fm(x) )T 记 aiT为A的第i行向量,f(x) = aiTx

1.5基本概念和符号

(2) 梯度(一阶偏导数向量): f (x)=( f / x1 , f / x2 , … , f / xn )TRn 线性函数:f (x) = cTx + b , f (x) = c

x , y 的距离: ‖x-y ‖= [(x - y)T(x - y)](1/2)

x 的长度: ‖x‖= [ xTx ](1/2)

三角不等式: ‖x + y ‖≤‖x‖+‖y‖

x

x+y

y

点列的收敛:设点列{x(k)} Rn , x Rn

点列{x(k)}收敛到 x ,记

lim

k

x(k)

=

x

lim‖x(k)

1.5基本概念和符号

规定:x , y Rn,x ≤ y xi ≤ yi ,i ; 类似地规定 x ≥ y,x = y,x < y , x > y 。

一个有用的定理

设 xRn,R,L为Rn 的线性子空间。 若 xTy ≤ , yRn 且 y ≥ 0, 则

x ≤ 0, ≥ 0 若 xTy ≤ , y L Rn , 则

基于最优化方法的结构可靠度计算及matlab程序实现

基于最优化方法的结构可靠度计算及matlab程序实现一、引言随着科技的飞速发展,现代化的工程、机械、技术装备等趋于复杂,对其结构可靠性提出了更高的要求。

结构可靠度分析是为了确保这些工程在设计、施工、管理、应用等环节能够安全、可靠地运行。

最优化方法作为一种求解问题的有效手段,在结构可靠度计算中得到了广泛的应用。

本文将探讨基于最优化方法的结构可靠度计算及MATLAB程序实现,以期为相关领域的研究和工程实践提供参考。

二、最优化方法的理论基础1.优化算法的选择在结构可靠度计算中,优化算法主要用于求解最优化问题。

常见的优化算法有梯度下降法、牛顿法、拟牛顿法、信赖域反射算法等。

针对结构可靠度计算的特点,本文选取一种适用于求解非线性规划问题的优化算法——梯度下降法。

2.适应度函数的构建适应度函数是衡量优化算法搜索过程中解的质量的重要依据。

在结构可靠度计算中,适应度函数应包含结构参数、载荷、材料性能等因素,以反映结构的可靠度水平。

构建适应度函数时,需考虑以下几个方面:(1)极限状态方程:根据结构设计要求,建立极限状态方程,用以描述结构在承受载荷时的应力、应变关系。

(2)失效概率:根据极限状态方程,计算结构在不同条件下失效的概率。

(3)可靠度指标:结合失效概率,构建结构可靠度指标,用于评价结构的可靠度水平。

三、结构可靠度计算的最优化方法1.极限状态方程的建立根据结构设计要求和相关规范,建立极限状态方程,用以描述结构在承受载荷时的应力、应变关系。

极限状态方程一般形式为:σ= F(x)其中,σ表示结构应力,x表示结构参数,F(x)为应力函数。

2.失效概率的计算根据极限状态方程,计算结构在不同条件下失效的概率。

失效概率可通过以下公式计算:P(σ > σ_0) = 1 / (1 + k)其中,P(σ > σ_0)表示失效概率,k为安全系数,σ_0为极限应力。

3.可靠度指标的求解结合失效概率,构建结构可靠度指标:β= ∫(1 / (1 + k)) dx其中,β为可靠度指标,积分范围为结构参数x的取值范围。

最优化方法第三章-孙文瑜

Fnk k ak (1 )(bk a k ) Fnk 1

Fn k 1 k a k (bk a k ), k 1,2,, n 1 Fn k 1 Fn k k ak (bk a k ), k 1,2,, n 1 Fn k 1

25

2018/12/11

3.2.2 Fibonacci法

另一种与0 .618 法相类似的分割方法叫Fibonacci 法. 它与0 .618 法的主要区别之一在于: 搜索区间长度的 缩短率不是采用0 .618 而是采用Fibonacci 数. Fibonacci 数列满足 F0 F1 1

Fk 1 Fk Fk 1 , k 1,2 Fibonacci 法中的计算公式为

N

1

2

1 2

Y

* (t * )

a t1 , t1 t 2 ,

1

最优化:最速下降法和Newton法

定理 3.1.1 设假设 2.4.1的条件成立 , 那么采用精确搜索 , 或 Armijo搜索或 Wolfe- P owell搜索的最速下降法产生 的迭 代序列{xk }满足 lim || f ( xk ) || 0

k

由前面的例子看到, 最速下降法的收敛速度至多是线性的, 具体 见下面的两个定理.

第一节

最速下降法

最古老的优化方法,十九世纪中叶由Cauchy提出

1、 思想 :每次沿负梯度方向进行搜索

●

x*

xk 1

等值线(面)

●

xk

●

f ( xk )

负梯度方向也称为最速下降方向:

事实上,对任意p R n 且 || p || , 由Cauchy - Schwarz 不等式得 f ( xk ) T P - || f ( xk ) || || P || - || f ( xk ) || - f ( xk ) - f ( xk ) 当取p 时等号成立,即 p 是下列问题 || f ( xk ) || || f ( xk ) || 的解 min f ( xk ) T P

从上面的例子看到, 对于简单的二元二次函数极小化问题, 最速下降法在有限次迭代并没有求出其精确最优解, 但能 以较慢的速度无限接近最优解.

事实上,上面的例子刻画了最速下降法的所有收 敛特征

3、 最速下降法的收敛性 全局收敛性

由于最速下降法的搜索方向与负梯度方向一致, 即 k 0, 且 || f ( xk ) || || d k || 所以, 由定理2.4.1 - 2.4.3, 我们很容易得到最速下降算法的全 局收敛性.

2

max 其中 , 且max 和min分别是 f ( x * )的最大和最小特征值 . min

最优化基础理论与方法

最优化基础理论与⽅法⽬录1.最优化的概念与分类 (2)2. 最优化问题的求解⽅法 (3)2.1线性规划求解 (3)2.1.1线性规划模型 (3)2.1.2线性规划求解⽅法 (3)2.1.3 线性规划算法未来研究⽅向 (3)2.2⾮线性规划求解 (4)2.2.1⼀维搜索 (4)2.2.2⽆约束法 (4)2.2.3约束法 (4)2.2.4凸规划 (5)2.2.5⼆次规划 (5)2.2.6⾮线性规划算法未来研究⽅向 (5)2.3组合规划求解⽅法 (5)2.3.1 整数规划 (5)2.3.2 ⽹络流规划 (7)2.4多⽬标规划求解⽅法 (7)2.4.1 基于⼀个单⽬标问题的⽅法 (7)2.4.2 基于多个单⽬标问题的⽅法 (8)2.4.3多⽬标规划未来的研究⽅向 (8)2.5动态规划算法 (8)2.5.1 逆推解法 (8)2.5.2 顺推解法 (9)2.5.3 动态规划算法的优点及研究⽅向 (9)2.6 全局优化算法 (9)2.6.1 外逼近与割平⾯算法 (9)2.6.2 凹性割⽅法 (9)2.6.3 分⽀定界法 (9)2.6.4 全局优化的研究⽅向 (9)2.7随机规划 (9)2.7.1 期望值算法 (10)2.7.2 机会约束算法 (10)2.7.3 相关机会规划算法 (10)2.7.4 智能优化 (10)2.8 最优化软件介绍 (11)3 最优化算法在电⼒系统中的应⽤及发展趋势 (12)3.1 电⼒系统的安全经济调度问题 (12)3.1.1电⼒系统的安全经济调度问题的介绍 (12)3.1.2电⼒系统的安全经济调度问题优化算法的发展趋势 (12)2. 最优化问题的求解⽅法最优化⽅法是近⼏⼗年形成的,它主要运⽤数学⽅法研究各种优化问题的优化途径及⽅案,为决策者提供科学决策的依据。

最优化⽅法的主要研究对象是各种有组织系统的管理问题及其⽣产经营活动。

最优化⽅法的⽬的在于针对所研究的系统,求得⼀个合理运⽤⼈⼒、物⼒和财⼒的最佳⽅案,发挥和提⾼系统的效能及效益,最终达到系统的最优⽬标。

Python最优化算法实战学习笔记

Python最优化算法实战第一章最优化算法概述1.1最优化算法简介最优化算法,即最优计算方法,也是运筹学。

涵盖线性规划、非线性规划、整数规划、组合规划、图论、网络流、决策分析、排队论、可靠性数学理论、仓储库存论、物流论、博弈论、搜索论和模拟等分支。

当前最优化算法的应用领域如下。

(1)市场销售:多应用在广告预算和媒体的选择、竞争性定价、新产品开发、销售计划的编制等方面。

如美国杜邦公司在20世纪50年代起就非常重视对广告、产品定价和新产品引入的算法研究。

(2)生产计划:从总体确定生产、储存和劳动力的配合等计划以适应变动的需求计划,主要采用线性规划和仿真方法等。

此外,还可用于日程表的编排,以及合理下料、配料、物料管理等方面。

(3)库存管理:存货模型将库存理论与物料管理信息系统相结合,主要应用于多种物料库存量的管理,确定某些设备的能力或容量,如工厂库存量、仓库容量,新增发电装机容量、计算机的主存储器容量、合理的水库容量等。

(4)运输问题:涉及空运、水运、陆路运输,以及铁路运输、管道运输和厂内运输等,包括班次调度计划及人员服务时间安排等问题。

(5)财政和会计:涉及预算、贷款、成本分析、定价、投资、证券管理、现金管理等,采用的方法包括统计分析、数学规划、决策分析,以及盈亏点分析和价值分析等。

(6)人事管理:主要涉及以下6个方面。

①人员的获得和需求估计。

②人才的开发,即进行教育和培训。

③人员的分配,主要是各种指派问题。

④各类人员的合理利用问题。

⑤人才的评价,主要是测定个人对组织及社会的贡献。

⑥人员的薪资和津贴的确定。

(7)设备维修、更新可靠度及项目选择和评价:如电力系统的可靠度分析、核能电厂的可靠度B风险评估等。

(8)工程的最佳化设计:在土木,水利、信息电子、电机、光学、机械、环境和化工等领域皆有作业研究的应用。

(9)计算机信息系统:可将作业研究的最优化算法应用于计算机的主存储器配置,如等候理论在不同排队规则下对磁盘、磁鼓和光盘工作性能的影响。

最优化理论与算法完整版课件

多目标规划 对策论等

随机过程方法

统计决策理论 马氏过程 排队论 更新理论 仿真方法 可靠性理论等

TP SHUAI

统计学方法

回归分析 群分析 模式识别 实验设计 因子分析等

6

优化树

TP SHUAI

7

•最优化的发展历程

2E d 2 B2 p L2 h2 0

8 L2 h2

dhB

6.结构设计问题

另外还要考虑到设计变量d和h有界。 从而得到两杆桁架最优设计问题的数学模型:

min 2dB L2 h2

s.t.

p L2 h2 0 dhB

2E d 2 B2

则称x0为极小化问题min f(x),x S的局部最优解

TP SHUAI

30

优化软件 / /neos/solvers/index.html

TP SHUAI

23

6.结构设计问题

p1

p2

h

2p

2L

B

d

受力分析图

圆杆截面图

2p

h

2L

桁杆示意图

TP SHUAI

24

6.结构设计问题

解:桁杆的截面积为 : S dB

桁杆的总重量为:W 2dB L2 h2

负载2p在每个杆上的分力为:p1

p

cos

p

L2 h2 h

20

5负载平衡(1)

实例: 网络G(V,E) 及一组m 个数的集合{s,d>0},表示 连接源点 s与汇点d 之间的流量

解: {s,d>0}的一组路由, 即G(V,E) 中m 条s 与 d间的路, 表示连接s与d 的负载流量的路径。

最优化方法概述

X(1)=(0, 0,120,50)T 相当于O(0,0)

20

x2 50 Q3¨0£ 40£ £ ¬ © 40 30 Q2¨15£ 20£ £ ¬ © É ò ¿ Ð Ó 10

X(2)=(25, 0,20,0)T 相当于Q1(25,0)

20

Q1¨25£ 0£ £ ¬ ©

O£ 0£ 0£ ¨ ¬ © 10 20 30 40 x

迭代数 函数计算数 使用的算法 PCG迭代数(large-scale algorithm only) 最终步长(medium-scale algorithm only)

无约束非线性规划

一元函数无约束优化问题

多元函数无约束优化问题

min{ f (x)| x ∈En }, 这里x =(x1 , x2 , …, xn)T.

S= 0

0 X3 1 0 0 0 X4 0 1 0 120 50 0 b Θ

x2 50 Q3¨0£ 40£ £ ¬ © 40 30 Q2¨15£ 20£ £ ¬ © É ò ¿ Ð Ó 10 Q1¨25£ 0£ £ ¬ © O£ 0£ 0£ ¨ ¬ © 10 20 30 40 x

X(1)=(0, 0,120,50)T 相当于O(0,0)

•x称为决策变量, •满足所有约束的变量称为可行解或可行点,可行点 的集合称为可行域。 •问题的求解是指在可行域中找一点x*,使得目标函 数在该点取极小值,这样的点称为问题的最优点,也 称为最小点,而相应的目标函数值f(x*)称为最优值, (x*,f(x*))称为最优解,习惯上x*称为最优解。

定义1:整体(全局)最优解:若x* D,对于一切 x D , 恒有 f x* f x 则称 x *是最优化问题的整体最优解。

局部最优解

最优化第3章一维搜索方法

§3.1 搜索区间的确定

根据函数的变化情况,可将区间分为单峰区间和多峰区间。 所谓单峰区间,就是在该区间内的函数变化只有一个峰值, 即函数的极小值。

§3.4 插值方法

一、牛顿法

f(x)

利用一点的函数值、 一阶导数以及二阶 导数构造二次多项 式。用构造的二次 多项式的极小点作 为原函数极小点的 近似。

φ0(x)

φ1(x) f(x)

x*

x2

x1

x0 x

§3.4 插值方法

一、牛顿法

设f(x)为一个连续可微的函数,则在点x0附近 进行泰勒展开并保留到二次项:

§3.1 搜索区间的确定

f(x)

f(x)

f(a0) f(a0+h)

f(a0+3h)

f(a0-h) f(a0)

f(a0+h)

0 a0 a

a0+h

a0+3h x b

0 a0-h

a0

a

进退试算法的运算步骤如下:

a0+h x b

(1)给定初始点α0和初始步长h (2)将α0及α0+h 代入目标函数 f(x) 进行计算并比较大小

φ0(x)

φ1(x) f(x)

f ′ (x)

x*

x2 x1

x0

φ ′ 1(x) f ′ (x)

x* x2

x1

x0

牛顿法程序框图

开始

x 给定初始点 ,误差 0

,

令k=0

最优化算法【线搜索-黄金分割(0.618)算法】

最优化算法【线搜索-黄⾦分割(0.618)算法】使⽤条件优化函数在搜索区间内为单峰函数算法算法类似于⼆分查找算法,能够求单峰函数在搜索区间的极值算法如下:step0:确定单峰函数f(x)的搜索区间[a0,b0];容错误差δ=a−b, ϵ=f(b)−f(a) ,t=0.618;p=a0+(1−t)(b0−a0),q=a0+t(b0−a0) step1:f(p)<=f(q)yes,to step 2 no,to step 3step2:if |f(b)-f(a)| >= $\epsilon or |b-a|>=\delta$b=q,f(b)=f(q), q=p, f(q)=f(p);p=a+(1-t)(b-a), resolve f(p);elsestop;print p;\\p为求得极值点step3:if |f(b)-f(a)| >= $\epsilon or |b-a|>\delta$a=p,f(a)=f(p), p=q, f(p)=f(q);q=a+t(b-a), resolve f(q);elsestop;print q;\\p为求得极值点算法实现函数:function [R,loos,loos_t] = xiansousuo_golds(func,a,b,delta,epsilon,iterate) t = (sqrt(5)-1)/2;p = a+(1-t)*(b-a);q = a+t*(b-a);f_a=func(a);f_b=func(b);f_p = func(p);f_q = func(q);R=zeros(1,2);loos_t = zeros(iterate,1);loos = zeros(1,2);%step1k=0;while abs(f_b-f_a)>=epsilon || abs(b-a) >= delta || k < iteratek=k+1;loos_t(k,1)=abs(f_b-f_a);if f_p <= f_qb=q;f_b=f_q;q=p;f_q =f_p;p=a+(1-t)*(b-a);f_p = func(p);elsea=p;f_a=f_p;p=q;{f_p =f_q;q=a+t*(b-a);f_q=func(q);end%disp([p,abs(f_b-f_a)]);endif f_p <= f_qR(1,1)=p;R(1,2)=func(p);elseR(1,1)=q;R(1,2)=func(q);endloos=[abs(b-a),abs(f_b-f_a)];endmain函数clc;close all;iterate=30;func=@(s) s^2-sin(s);[R,loos,loos_t]=xiansousuo_golds(func,0,1,1e-4,1e-5,iterate);disp(R);disp(loos);figure(1);plot(1:iterate,loos_t);figure(2);t=linspace(0,1,iterate);y=zeros(iterate,1);for i =1:iteratey(i,1)=func(t(i));endplot(t,y);hold on;minimum = fminbnd(func,0,1);f_min=func(minimum);plot(minimum,f_min,'rp','MarkerSize',10);text(minimum,f_min,['(',num2str(minimum),',',num2str(f_min),')'],'color','b'); disp([minimum,f_min]);epsilon随迭代变化所求函数及极⼩值conclusion1. 算法求得结果和matlab极⼩值函数结果相同,精度较⾼;2. 对于应⽤范围有限制【单峰函数】。

最优化计算方法第1章

•最优化问题的数学模型与分类

•数学模型的建立

• 建立数学模型时要尽可能简单,而且要能完整地描 述所研究的系统。

• 过于简单的数学模型所得到的结果可能不符合实际情 况;而过于详细复杂的模型又给分析计算带来困难。 • 具体建立怎样的数学模型需要丰富的经验和熟练的技 巧。 •

线性规划:目标函数、约束条件都是线性的 非线性规划:目标函数、约束条件中的函数不全是线性

的。 二次规划:目标函数为二次函数,约束条件中的函数为线

• 最优化技术与数学模型所包括的知识点很多,选取了一些 实用的方法。

课程简介

从工程应用的角度出发,注重工程优化的基本思想和 方法的阐述。

内容主要包括: 线性规划、非线性规划、约束优化、无约束优化等, 并对如何建立数学模型、如何选择优化方法和提高优 化效率作了适当的介绍。

课程任务

讲授工程优化的基本理论和方法,要求通过本课程的学 习,具有应用工程优化方法解决实际问题的技能,并为以后 的学习和工作打好基础。

的约束下求决

策变量x,使函数

达到极

其中: 为决策变量 为已知参数

小min;若求极大max,相当于一个 min(-f)。

为随机因素

为(一般或广义)函数

•建立优化模型的三要素

•决策变量和参数

• 决策变量是由数学模型的解确定的未知数。参数表示 系统的控制变量,有确定性的也有随机性的。

约束或限制条件

由于现实系统的客观物质条件限制,模型必须包括 把决策变量限制在它们可行值之内的约束条件,而这通常 是用约束的数学函数形式来表示的。

最优化计算方法第1章

2020年5月31日星期日

为什么要学习工程优化

运筹学与最优化方法

( 1)

,d

(2)

,…,d

(m) m

R, d

(j)

n

(k)

0

记 L( d

(1)

,d

(2)

,…,d

(m)

)={ x = d j j =1

jR }

为由向量d , d , … , d 生成的子空间,简记为L。 n 正交子空间:设 L 为R 的子空间,其正交子空间为 n L ={ x R xTy=0 , y L } n n 子空间投影定理:设 L 为R 的子空间。那么 x R , 唯一 x L , y L , 使 z=x+y , 且 x 为问题 min ‖z - u‖ s.t. u L 的唯一解,最优值为‖y‖。 n 特别, L =R 时,正交子空间 L ={ 0 }(零空间)

x

x+y

点列的收敛:设点列{x(k)} R , x R 点列{x(k)}收敛到 x ,记 (k) = x lim‖x(k)- x‖ = 0 lim x (k) = x ,i lim x i k k ki

y

n

n

五、基本概念和符号(续)

1、向量和子空间投影定理

(3) 子空间:设 d

“若 xTy ≤ , yRn 且 y ≤ 0,则 x ≥ 0, ≥ 0 .” “若 xTy ≥ , yRn 且 y ≥ 0,则 x ≥ 0, ≤ 0 .” n “若 xTy ≥ , yR 且 y ≤ 0,则 x ≤ 0, ≤ 0 .” “若 xTy ≥ , y L Rn , 则 x L, ≤ 0 .”

一、什么是运筹学

为决策机构在对其控制下的业务活动进

行决策时,提供一门量化为基础的科学 方法。 或是一门应用科学,它广泛应用现有的 科学技术知识和数学方法,解决实际中 提出的专门问题,为决策者选择最优决 策提供定量依据。 运筹学是一种给出问题坏的答案的艺术, 否则的话,问题的结果会更坏。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

qk(λ) = ф(λk) +ф’(λk)(λ-λk) + (1/2)ф’’(λk)(λ-λk)2

3.2 一维搜索

二、牛顿法(Newton)和插值法 1、Newton法:(续)

用qk(λ)作为ф(λ)的近似,当ф″(λk) > 0时,其驻 点为极小点:

,称d 为

在 x点的下降方向。

3.1 常用的搜索算法结构

四、下降算法模型(续) _

△可行方向:设 x∈S,d∈Rn,d≠0,若存

在 _ ,0 使 x_ d S, (0, ) ,称d 为 x点的可行方向。

同时满足上述两个性质的方向称 下降可行方向。

3.1 常用的搜索算法结构

3.2 一维搜索

一、缩小区间的精确一维搜索(续)

若对任意λ1 ,λ2, α≤ λ1 < λ2 ≤β满足:

1º若λ2 ≤ λ* ,则φ(λ1) > φ(λ2); 2º若λ1 ≥λ* ,则φ(λ1) <φ(λ2). 则称φ(λ)在[α, β] 上强单峰。

若只有当φ(λ1) ≠φ(λ* ), φ(λ2) ≠φ(λ* )时,上述1º, 2º式才成立,

x(k) || x* ||

1

证明只需注意

| ||x(k+1) –x* || -|| x(k) –x* || |≤ ||x(k+1) –x(k) || ≤ ||x(k+1)

–x* || +|| x(k) –x* || ,除以|| x(k) –x* || 并令k→∞, 利用超线性收敛定义可得结果。

……①

(使“坏”的情况去掉,区间长度不小于“好”的情 况)

2°保持缩减比 t=(保留的区间长度/原区间长度) 不变。

(使每次保留下来的节点, λ或 μ,在下一次的比较中成为 一个相应比例位置的节点 )。

推导缩减比 t : 如图设第一次保留[α, μ] (去掉[μ, β]),那么第二

次保留的长度为[α, λ],则

模型算法 初始x(1) ∈S, k =1

k=k+1

对x(k)点选择下降 可行方向d(k)

线性搜索求 ,k

新点

x(k 1) x(k ) (k )d (k )

使x(k+1)∈S

no

yes

是否满足停机条件?

停

3.2 一维搜索

一元函数求极小及线性搜索均为一维搜索。常用于求:

min f(x(k)+ d(k))=φ(λ)

注意 上式有 t2=1-t , 故有

μ =α +t(β -α )

λ = α + (1-t)(β -α ) (算法框图见下页)

3.2 一维搜索

一、缩小区间的精确一维搜索 之 黄金分割法(0.618 法)(算法)

初始[α,β], ε>0

t ( 5 1) / 2

λ = α + (1-t)(β -α )

3.1 常用的搜索算法结构

三、二次终结性

▲一个算法用于解正定二次函数的无约束极 小时,有限步迭代可达最优解,则称该算 法具有二次终结性。

▲二次终结性=共轭方向+精确一维搜索。

▲共轭方向

·定义:

∈Rn , d

(1)

≠设0,Adn×(2)n≠对0,称满正足定d,(1)dTA(1d),(d2)=(20) ,

则称φ(λ)在[α, β] 上单峰。

α λ* λ1λ2 β 强单峰

α λ*

β

单峰

3.2 一维搜索

一、缩小区间的精确一维搜索(续)

定理:设Ф:R→R 在[α,β ]上单峰,α≤λ<μ≤ β 。那么

1°若Ф(λ)≥ Ф(μ),则Ф(ρ) ≥Ф(μ), ρ ∈[α,λ];如左下图

2°若Ф(λ)< Ф(μ),则Ф(ρ)≥Ф(λ), ρ ∈[μ , β];如右下图

3.1 常用的搜索算法结构

四、下降算法模型

考虑(fs)

min f(x)

s.t. x∈S

常用一种线性搜索的方式来求解:迭代中从一

点出发沿下降可行方向找一个新的、性质有 改善的点。

△下降方向 :

_

设 x∈S,d ∈Rn,d≠0,若存在 ,0

使

_

_

_ f (x d ) f (x), (0, )

d(1),d(2), …,d(m) 线性无关。

proof: 设d= 1 d(1)+ 2d(2)+…+ md(m) =0, j=1,2, …,m, d(j)TAd= jd(j)TAd(j)=0

∵ d(j)TAd(j) >0,故j =0,即线性无关。

超线性收敛和二次终结性常用来讨论算法的优点。

0

解: ф′ (λ) =arctan λ , ф″(λ)=1/(1+ λ2)

迭代公式: λk +1= λk - (1+ λ2) arctan λk 取λ1= 1,计算结果:

k

λk

ф′ (λk)

1

1

0.7854

1/ф″(λk ) 2

2

-0.5708

-0.5187

1.3258

3

0.1169

-0.1164

1.0137

4

-0.001095 -0.001095

λ4≈ λ* =0 取λ1=2,计算结果如下:

3.2 一维搜索

第三章

最优化搜索算法的结构 与

一维搜索

3.1 常用的搜索算法结构 一、收敛性概念: 考虑(fs)

设迭代算法产生点列{x(k)} S. 1. 理想的收敛性:设x*∈S是g.opt.当

x*∈ {x(k)} 或 x(k) ≠ x*, k,满足

lim x(k ) x*

k

时,称算法收敛到最优解 x*。

局部收敛:当x(1) 充分接近解x*时,算法 才收敛。

3.1 常用的搜索算法结构

二、收敛速度

设算法产生点列{x(k)},收敛到解x*,且x(k)≠x*,

k,

1.线性收敛:

|| x(k 1) x* || || x(k ) x* ||

1

当k充分大时成立。

2.超线性收敛: lim || x(k1) x* || 0 k || x(k) x* ||

设ф (λ)在 [α ,β]上可微,且当导数为零时是解。取λ=(α+β) /

2,那么

ф′ (λ)=0 时, λ为最小点, λ= λ* ; ф′ (λ)>0 时, λ在上升段, λ* < λ,去掉[λ,β] ; ф′ (λ)<0 时, λ在下降段, λ* > λ,去掉[α ,λ] ; (自己画算法框图)

s.t. λ∈S

S有3种情况(-∞,+∞)或(0, +∞ )或[a,b] 一、缩小区间的精确一维搜索:考虑问题(P)

min φ(λ) s.t. λ ∈[α, β] φ (λ):R→R 1、不确定区间及单峰函数

△不确定区间: [α, β]含φ(λ)的最小点,但不知其位 置

3.2 一维搜索

一、缩小区间的精确一维搜索(续)

α λ μβ

αλ μ

β

3.2 一维搜索

一、缩小区间的精确一维搜索(续)

Proof. 1°反证:设

λ* ∈[α,β]为最小点,γ∈[α,λ]及γ﹤λ﹤λ*,使ф (γ)<ф (μ )<ф (λ),

若λ* ∈[λ ,β],由定义ф (γ)>ф (λ),矛盾(假设); 若λ* ∈[α ,λ),由定义及μ >λ ≥λ*, ф(μ )>ф (λ),

定义:设φ: [α, β] →R, λ* ∈[α, β] 是φ在

[α, β] 上的最小点 λ2 ≤β满足:

,若对任意λ1

,λ2,

α≤

λ1

<

1º若λ2 ≤ λ* ,则φ(λ1) > φ(λ2);

2º若λ1 ≥λ* ,则φ(λ1) <φ(λ2).

则称φ(λ)在[α, β] 上强单峰。

若述只1º,有2º当式φ才(λ1成) ≠立φ(,λ*则),称φφ((λλ2))在≠φ[α(λ, *β)]时上,单上峰。

tg α>0

ф′ (λ)

α

α

λ

β

tg α<0

ф′ (λ)

α

α

λ

β

3.2 一维搜索

4、进退法求初始不确定区间

找三点使两端点的函数值大于中间点的函数值。

思路:任取λ0,步长δ >0,取λ1=λ0 + δ , 1°若ф(λ0 )< ф(λ1), 令δ=2 δ(步长加倍),λ2=λ0 - δ ,

若ф(λ2 )< ф(λ0),则令λ1=λ0 ,λ0=λ2 ,重复 1° 若ф(λ2 )>ф(λ0),则停,α= λ2,β= λ1 (图1)

称

d(1),d(2) 关于矩阵A共轭。

·共轭向量组:d(1),d(2), …,d(m) ∈Rn 均非零, 满足d(i)TAd(j)=0,(i≠j) .

3.1 常用的搜索算法结构

三、二次终结性(续)

·当A=I(单位矩阵)时, d(1)TAd(2)= d(1)Td(2)=0,即正

交关系。

正定

·当d(1),d(2), …,d(m) 关于正定矩阵A两两共轭时,

μ =α +t(β -α )

α λμ β

μβ

Β= μ, μ= λ

λ = α + (1-t)(β -α ) No

yes β -α <ε?

No

Ф(λ)-Ф(μ)>0?

yes

STOP; λ* =(α+β)/2