通用图像识别的神经网络代码描述

人脸识别核心算法及MATLAB代码

人脸识别核心算法在检测到人脸并定位面部关键特征点之后,主要的人脸区域就可以被裁剪出来,经过预处理之后,馈入后端的识别算法。

识别算法要完成人脸特征的提取,并与库存的已知人脸进行比对,完成最终的分类。

我们在这方面的主要工作包括:∙基于LGBP的人脸识别方法问题:统计学习目前已经成为人脸识别领域的主流方法,但实践表明,基于统计学习的方法往往会存在“推广能力弱”的问题,尤其在待识别图像“属性”未知的情况下,更难以确定采用什么样的训练图像来训练人脸模型。

鉴于此,在对统计学习方法进行研究的同时,我们还考虑了非统计模式识别的一类方法。

思路:对于给定的人脸图像,LGBP方法首先将其与多个不同尺度和方向的Gabor滤波器卷积(卷积结果称为Gabor特征图谱)获得多分辨率的变换图像。

然后将每个Gabor特征图谱划分成若干互不相交的局部空间区域,对每个区域提取局部邻域像素的亮度变化模式,并在每个局部空间区域内提取这些变化模式的空间区域直方图,所有Gabor特征图谱的、所有区域的直方图串接为一高维特征直方图来编码人脸图像。

并通过直方图之间的相似度匹配技术(如直方图交运算)来实现最终的人脸识别。

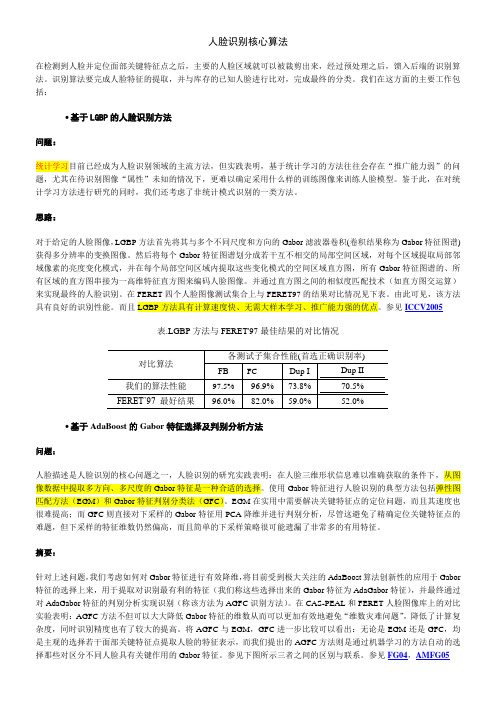

在FERET四个人脸图像测试集合上与FERET97的结果对比情况见下表。

由此可见,该方法具有良好的识别性能。

而且LGBP方法具有计算速度快、无需大样本学习、推广能力强的优点。

参见ICCV2005表.LGBP方法与FERET'97最佳结果的对比情况∙基于AdaBoost的Gabor特征选择及判别分析方法问题:人脸描述是人脸识别的核心问题之一,人脸识别的研究实践表明:在人脸三维形状信息难以准确获取的条件下,从图像数据中提取多方向、多尺度的Gabor特征是一种合适的选择。

使用Gabor特征进行人脸识别的典型方法包括弹性图匹配方法(EGM)和Gabor特征判别分类法(GFC)。

EGM在实用中需要解决关键特征点的定位问题,而且其速度也很难提高;而GFC则直接对下采样的Gabor特征用PCA降维并进行判别分析,尽管这避免了精确定位关键特征点的难题,但下采样的特征维数仍然偏高,而且简单的下采样策略很可能遗漏了非常多的有用特征。

人工智能深度学习技术练习(试卷编号242)

人工智能深度学习技术练习(试卷编号242)说明:答案和解析在试卷最后1.[单选题]手写字识别模型中,输入层的节点个数为()A)28B)784C)1024D)5762.[单选题]在keras的自带模型中, Xception V1 模型的默认输入尺寸是()A)229x229B)299x299C)224x224D)244x2443.[单选题]训练神经网络可以修改的参数有()。

A)学习速率B)梯度下降参数C)回归参数D)RELU4.[单选题]负矩阵用那种形式表示()。

A)OB)AC)-AD)AT5.[单选题]( )是定义在单个样本上的,是指一个样本的误差A)损失函数(Loss Function)B)代价函数(Cost Function)C)目标函数(Object Function)D)范数6.[单选题]下列使用归一化操作的激活函数有:A)reluB)softmaxC)tanh7.[单选题]样本点数量相同的概率空间,可以等价互换。

A)是B)不能C)部分能D)部分不能8.[单选题]所有rnn中的门使用()激活函数处理A)RELUB)sigmoidC)softmaxD)tanh9.[单选题]假设我们有一个使用ReLU激活函数(ReLU activation function)的神经网络,假如我们把ReLU激活替换为线性激活,那么这个神经网络能够模拟出同或函数(XNOR function)吗?A)可以B)不好说C)不一定D)不能10.[单选题]item()在pytorch中的作用是A)获取数据值B)获取维度C)获取梯度D)获取降维后的结果11.[单选题]( )就是在不同的训练过程中随机扔掉一部分神经元。

也就是让某个神经元的激活值以一定的概率p,让其停止工作,这次训练过程中不更新权值,也不参加神经网络的计算。

但是它的权重得保留下来(只是暂时不更新而已)A)conv2dB)max_poolC)DropoutD)FC12.[单选题]能消除过拟合的方法是A)线性化B)非线性化C)归一化D)正则化13.[单选题]于Python的全局变量和局部变量,以下选项中描述错误的是()。

deeplearning tutorial (2) 原理简介+代码详解

deeplearning tutorial (2) 原理简介+代码详解【原创实用版】目录一、Deep Learning 简介二、Deep Learning 原理1.神经网络2.梯度下降3.反向传播三、Deep Learning 模型1.卷积神经网络(CNN)2.循环神经网络(RNN)3.生成对抗网络(GAN)四、Deep Learning 应用实例五、Deep Learning 代码详解1.TensorFlow 安装与使用2.神经网络构建与训练3.卷积神经网络(CNN)实例4.循环神经网络(RNN)实例5.生成对抗网络(GAN)实例正文一、Deep Learning 简介Deep Learning 是一种机器学习方法,其主要目标是让计算机模仿人脑的工作方式,通过多层次的抽象表示来理解和处理复杂的数据。

Deep Learning 在图像识别、语音识别、自然语言处理等领域取得了显著的成果,成为当前人工智能领域的研究热点。

二、Deep Learning 原理1.神经网络神经网络是 Deep Learning 的基本构成单元,它由多个神经元组成,每个神经元接收一组输入信号,根据权重和偏置计算输出信号,并将输出信号传递给其他神经元。

神经网络通过不断调整权重和偏置,使得模型能够逐渐逼近目标函数。

2.梯度下降梯度下降是一种优化算法,用于求解神经网络的权重和偏置。

梯度下降算法通过计算目标函数关于权重和偏置的梯度,不断更新权重和偏置,使得模型的预测误差逐渐减小。

3.反向传播反向传播是神经网络中计算梯度的一种方法。

在训练过程中,神经网络根据实际输出和预期输出的误差,按照梯度下降算法计算梯度,然后沿着梯度反向更新权重和偏置,使得模型的预测误差逐渐减小。

三、Deep Learning 模型1.卷积神经网络(CNN)卷积神经网络是一种特殊的神经网络,广泛应用于图像识别领域。

CNN 通过卷积层、池化层和全连接层等操作,对图像进行特征提取和分类,取得了在图像识别领域的突破性成果。

神经网络的图像识别技术及方法分析

1.1 图像 识别 、图像处理 以及 图像理 解的关 系

1.2 人 工神 经 网络

人 工 神 经 网络 没 有 固定 概 念 ,通 常 人 们将 具 有 大 量 简单 计 算单 元 、单 元之 间连接 特 性和 方式 以及单 位 之 间连接形成的算法或模型称之为人工神经网络。不 同的 单 元特 性 、连 接方 式 和调 节规 律 将会 产 生各 种 不 同 的神 经 网络 模 型 。随着 信 息技 术 的发 展 ,信 息分 布 、储 存和 处理 方 式都 得到 了提升 ,开 始广 泛应 用 到智 能控制 学 习 、 信 息 处 理 、 模 式 识 别 等 领 域 中 ,具有 很 广 泛 的应 用 前 景 。尤其 多层 前 馈 网络 (BP),已经广泛 应 用 到函数 逼近 、 模 式 分类 和线 形 建模 中。

2 BP神 经 网络

2.1 分析 BP神经算 法

多层 网 络 的 组 成 可 以在 BP网 络 的 基 础 上 ,利 用 Window-Hoff算法 与 非线 性 转移 函 数组 成 。BP网络经 常 采 用梯 度 下 降 算法 计 算 。BP网络 结 构 算法 描 述 。第 一 , 将 网络 参 数 回 归到 初始 化状 态 ;学 习 网络 初始 矩 阵和 学 习因子等参数 ;第二 ,实施网络训练操作 ,满足系统要

求 ;第三 ,传 播过 程 ,根 据 系统指 定模 式 完成 数据 输入 , 并进 行计 算 ,如果 存在 误差 执行 继续 计算 后 向传 播过 程 。 后 向传播 过 程重 点进 行 同一 层 单元 误差 计 算 、修正 权 职 和 阀值等 操作 。

神经网络及深度学习(包含matlab代码)

f ( x)

1 1 e Qx

(2.3)

它反映了神经元的饱和特性。 上式中, Q 为表示神经元非线性的参数, 称增益值(Gain), 也称调节参数。 Q 值越大, S 形曲线越陡峭; 反之, Q 值越小, S 形曲线越平坦; 一般取 Q=1。 (b)双曲正切激励函数,一般取为(-1,1)内连续取值:

神经网络及深度学习

(包含 MATLAB 仿真) 人工神经网络(Artificial Neural Network,即 ANN ) ,作为对人脑最简单的一种抽象和 模拟,是人们模仿人的大脑神经系统信息处理功能的一个智能化系统,是 20 世纪 80 年代 以来人工智能领域兴起的研究热点。 人工神经网络以数学和物理方法以及信息处理的角度对 人脑神经网络进行抽象, 并建立某种简化模型, 旨在模仿人脑结构及其功能的信息处理系统。 人工神经网络最有吸引力的特点就是它的学习能力。因此从 20 世纪 40 年代人工神经 网络萌芽开始, 历经两个高潮期及一个反思期至 1991 年后进入再认识与应用研究期, 涌现 出无数的相关研究理论及成果, 包括理论研究及应用研究。 最富有成果的研究工作是多层网 络 BP 算法,Hopfield 网络模型,自适应共振理论,自组织特征映射理论等。因为其应用价 值, 该研究呈愈演愈烈的趋势, 学者们在多领域中应用人工神经网络模型对问题进行研究优 化解决。 人工神经网络是由多个神经元连接构成,因此欲建立人工神经网络模型必先建立人工 神经元模型,再根据神经元的连接方式及控制方式不同建立不同类型的人工神经网络模型。 一、人工神经元及神经网络 1.1 人工神经元模型 仿生学在科技发展中起着重要作用,人工神经元模型的建立来源于生物神经元结构的 仿生模拟,用来模拟人工神经网络。人们提出的神经元模型有很多,其中最早提出并且影响 较大的是 1943 年心理学家 McCulloch 和数学家 W. Pitts 在分析总结神经元基本特性的基础上 首先提出的 MP 模型。该模型经过不断改进后,形成现在广泛应用的 BP 神经元模型。人工 神经元模型是由人量处理单元厂泛互连而成的网络,是人脑的抽象、简化、模拟,反映人脑 的基本特性。一般来说,作为人工神经元模型应具备三个要素: (1) 具有一组突触或连接,常用 wij 表示神经元 i 和神经元 j 之间的连接强度。 (2) 具有反映生物神经元时空整合功能的输入信号累加器 。 (3) 具有一个激励函数 f 用于限制神经元输出。激励函数将输出信号限制在一个允许 范围内。 一个典型的人工神经元模型如图 1-11-1 所示。

人工智能算法入门考试

人工智能算法入门考试(答案见尾页)一、选择题1. 人工智能算法的基础是什么?A. 机器学习B. 深度学习C. 自然语言处理D. 计算机视觉2. 以下哪个是人工智能算法的一种?A. 决策树B. 随机森林C. 神经网络D. 支持向量机3. 人工智能算法在哪些领域有广泛应用?A. 医疗保健B. 交通运输C. 金融服务D. 所有以上领域4. 机器学习中,以下哪个概念描述了模型的预测能力?A. 精确率B.召回率C. F1 分数D. A和B5. 在深度学习中,哪种类型的神经网络通常用于图像识别任务?A. 卷积神经网络(CNN)B. 循环神经网络(RNN)C. 长短期记忆网络(LSTM)D. 以上都可以6. 人工智能算法与传统计算机算法的主要区别是什么?A. 计算能力B. 学习能力C. 交互性D. 并行性7. 在人工智能中,什么是“黑箱”模型?A. 不能解释模型的决策过程B. 可以完全解释模型的决策过程C. 模型决策过程可以部分解释D. 没有实际模型8. 人工智能算法的哪个发展方向是模拟人类大脑的工作方式?A. 机器学习B. 深度学习C. 强化学习D. 人工神经网络9. 在人工智能中,什么是“训练集”?A. 训练模型的数据集合B. 训练模型的硬件设备C. 训练模型的软件环境D. 训练模型的算法10. 人工智能算法的未来发展趋势是什么?A. 更加智能化B. 更加广泛的应用C. 更加普及到各行各业D. A和B11. 什么是人工智能算法?A. 人工智能算法是一种计算机程序B. 人工智能算法是一组用于解决人工智能问题的规则和程序C. 人工智能算法是一种模拟人类智能行为的计算模型D. 人工智能算法是一种数据挖掘技术12. 人工智能算法可以分为哪几类?A. 机器学习算法B. 深度学习算法C. 自然语言处理算法D. 计算机视觉算法13. 机器学习算法中,哪种算法不是无监督学习算法?A. K-均值聚类B. 线性回归C. 逻辑回归D. 支持向量机14. 深度学习算法中,哪种算法不是卷积神经网络的一种?A. 循环神经网络B. 长短期记忆网络C. 卷积神经网络D. 调整线性单元15. 自然语言处理算法中,哪种算法主要用于情感分析?A. 文本分类算法B. 词袋模型C. 得到向量算法D. 注意力机制16. 计算机视觉算法中,哪种算法可以用于物体检测?A. 霍夫变换B. 边缘检测C. K-均值聚类D. YOLO(You Only Look Once)17. 人工智能算法在哪个领域有广泛的应用?A. 医疗保健B. 金融C. 教育D. 所有领域18. 人工智能算法的发展历程可以分为几个阶段?A. 早期研究B. 快速发展期C. 稳定应用期D. 高级阶段19. 人工智能算法的未来发展方向是什么?A. 提高算法性能B. 提高算法可解释性C. 降低算法成本D. 扩大应用领域20. 在人工智能算法中,哪种算法通常用于模式识别?A. 决策树B. 支持向量机C. 随机森林D. 神经网络21. 什么是人工智能?A. 人工智能是一种模拟人类智能的技术和系统B. 人工智能可以替代人类进行所有的思考和工作C. 人工智能只能在特定领域内应用D. 人工智能的发展前景充满了不确定性22. 人工智能的基本组成包括哪些?A. 硬件和软件B. 数据和算法C. 机器学习和深度学习D. 人工智能语言和框架23. 在人工智能中,哪种技术是用于处理大量数据的?A. 机器学习B. 深度学习C. 自然语言处理D. 计算机视觉24. 以下哪个不是人工智能的应用领域?A. 医疗保健B. 交通管理C. 农业生产D. 金融投资25. 人工智能的发展历程可以分为几个阶段?A. 初创期B. 成熟期C. 衰退期D. 繁荣期26. 在人工智能中,哪种技术是用于模拟人类智能行为的?A. 神经网络B. 专家系统C. 模糊逻辑D. 遗传算法27. 人工智能中的机器学习技术包括哪些方法?A. 监督学习B. 无监督学习C. 强化学习D. 集成学习28. 在人工智能中,哪种技术是用于将人类语言转化为计算机可以理解的代码?A. 自然语言处理B. 语音识别C. 计算机视觉D. 机器翻译29. 人工智能的发展对于就业市场有什么影响?A. 会导致某些岗位的消失B. 会创造新的就业机会C. 会使所有工作变得更容易D. 会对经济发展产生负面影响30. 以下哪个因素对人工智能的发展最为关键?A. 计算能力的提升B. 互联网的出现C. 人类的创造力D. 政策和法规的支持31. 人工智能算法的基础是什么?A. 机器学习B. 深度学习C. 自然语言处理D. 计算机视觉32. 以下哪个不是人工智能算法的应用领域?A. 医疗诊断B. 交通控制C. 虚拟现实D. 农业生产33. 人工智能中的深度学习与机器学习的主要区别是什么?A. 深度学习模型包含多个隐层B. 机器学习模型需要手动特征工程C. 深度学习模型的训练速度更快D. 机器学习模型可以处理结构化数据34. 人工智能算法中,哪种算法是用于模式识别?A. 随机森林B. 支持向量机(SVM)C. 神经网络D. K-均值聚类35. 人工智能在自然语言处理中的应用有哪些?A. 语音识别B. 机器翻译C. 情感分析D. 文本摘要36. 人工智能算法中,哪种算法是用于解决优化问题?A. 线性规划B. 随机搜索C. 动态规划D. 蚁群算法37. 人工智能中的卷积神经网络(CNN)主要用于哪种类型的图像识别任务?A. 基于颜色的分类B. 基于形状的分类C. 基于纹理的分类D. 基于对象的识别38. 人工智能算法中,哪种算法是用于时间序列预测?A. 长短期记忆网络(LSTM)B. 支持向量机(SVM)C. 神经网络D. 随机森林39. 在人工智能中,什么是“黑箱”模型?A. 一个不透明的模型,其内部运作不可见B. 一个需要大量数据的模型C. 一个简单的模型,易于理解和解释D. 一个高度复杂的模型,难以理解40. 人工智能算法的发展对于未来社会的影响是什么?A. 提高生产效率B. 促进教育公平C. 解决资源短缺问题D. 增加就业机会二、问答题1. 什么是人工智能?请简述人工智能的定义及其发展历程。

【图像识别】基于卷积神经网络(CNN)实现垃圾分类Matlab源码

【图像识别】基于卷积神经⽹络(CNN)实现垃圾分类Matlab源码⼀、垃圾分类如何通过垃圾分类管理,最⼤限度地实现垃圾资源利⽤,减少垃圾处置量,改善⽣存环境质量,是当前世界各国共同关注的迫切问题之⼀。

根据国家制定的统⼀标准,现在⽣活垃圾被⼴泛分为四类,分别是可回收物、餐厨垃圾、有害垃圾和其他垃圾。

可回收物表⽰适宜回收和资源利⽤的垃圾,主要包括废纸、塑料、玻璃、⾦属和布料五⼤类,⽤蓝⾊垃圾容器收集,通过综合处理回收利⽤。

餐厨垃圾包括剩菜剩饭、⾻头、菜根菜叶、果⽪等⾷品类废物,⽤绿⾊垃圾容器收集等等。

但是随着深度学习技术的发展,为了简单⾼效地对⽣活垃圾进⾏识别分类,本篇⽂章将实现⼀种基于卷积神经⽹络的垃圾分类识别⽅法。

该⽅法只需要对图像进⾏简单的预处理,CNN模型便能够⾃动提取图像特征且池化过程能够减少参数数量,降低计算的复杂度,实验结果表明卷积神经⽹络,能克服传统图像分类算法的诸多缺点,当然更为复杂的模型等待⼤家去实验研究。

但是⽬前认为采⽤VGG或者global 池化⽅式可能效果更好⼀点。

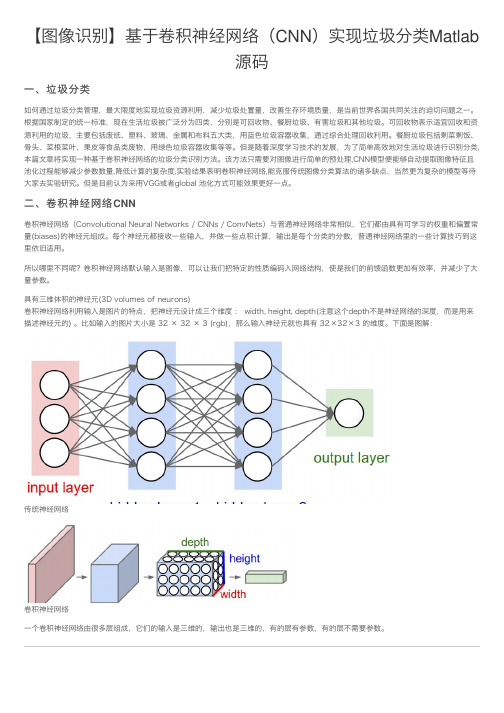

⼆、卷积神经⽹络CNN卷积神经⽹络(Convolutional Neural Networks / CNNs / ConvNets)与普通神经⽹络⾮常相似,它们都由具有可学习的权重和偏置常量(biases)的神经元组成。

每个神经元都接收⼀些输⼊,并做⼀些点积计算,输出是每个分类的分数,普通神经⽹络⾥的⼀些计算技巧到这⾥依旧适⽤。

所以哪⾥不同呢?卷积神经⽹络默认输⼊是图像,可以让我们把特定的性质编码⼊⽹络结构,使是我们的前馈函数更加有效率,并减少了⼤量参数。

具有三维体积的神经元(3D volumes of neurons)卷积神经⽹络利⽤输⼊是图⽚的特点,把神经元设计成三个维度 : width, height, depth(注意这个depth不是神经⽹络的深度,⽽是⽤来描述神经元的) 。

⽐如输⼊的图⽚⼤⼩是 32 × 32 × 3 (rgb),那么输⼊神经元就也具有 32×32×3 的维度。

基于 CNN-SVM-GA 的图像分类系统的设计与实现代码大全

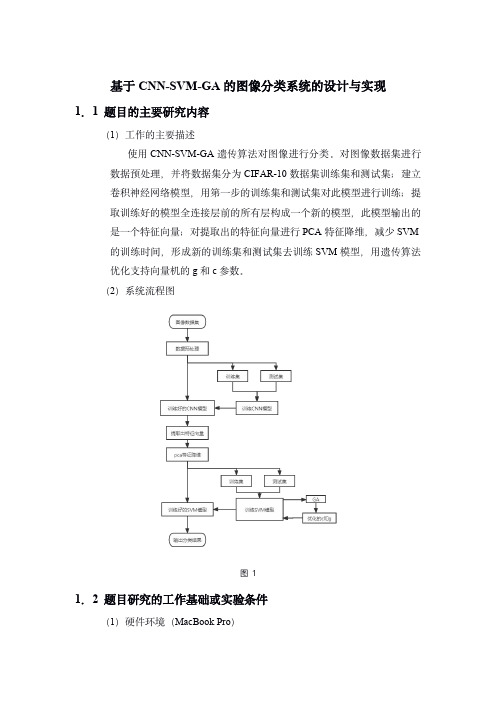

基于CNN-SVM-GA的图像分类系统的设计与实现1.1题目的主要研究内容(1)工作的主要描述使用CNN-SVM-GA遗传算法对图像进行分类。

对图像数据集进行数据预处理,并将数据集分为CIFAR-10数据集训练集和测试集;建立卷积神经网络模型,用第一步的训练集和测试集对此模型进行训练;提取训练好的模型全连接层前的所有层构成一个新的模型,此模型输出的是一个特征向量;对提取出的特征向量进行PCA特征降维,减少SVM的训练时间,形成新的训练集和测试集去训练SVM模型,用遗传算法优化支持向量机的g和c参数。

(2)系统流程图图11.2题目研究的工作基础或实验条件(1)硬件环境(MacBook Pro)(2)软件环境(pycharm,python3.9)1.3理论基础(1)卷积神经网络(CNN)卷积神经网络(CNN)是典型的前馈神经网络,由输入层,隐藏层和输出层组成。

隐藏层由卷积层,池化层和全连接层组成。

卷积模拟单个神经元对视觉刺激的反应。

它使用卷积层卷积输入数据,然后将结果传输到下一层。

卷积层由一组卷积核组成。

尽管这些内核具有较小的感知视野,但是内核延伸到输入数据的整个深度。

卷积运算可以提取输入数据的深层特征。

卷积神经网络通过卷积、池化等操作可以实现特征的自动提取,再通过全连接层实现分类。

卷积神经网络的结构:一般地,卷积神经网络由输入层、卷积层、RELU层、池化层和全连接层构成,通过梯度下降的方式训练网络模型的参数,从而实现分类。

下面将对每类层进行介绍。

卷积层。

卷积神经网络的核心功能(特征提取)由卷积层完成。

卷积层由许多可学习的卷积核(滤波器)构成,滤波器按照一定的步长对输入的张量进行遍历,当遇到某些类型的形状特征时就激活。

池化层。

池化层又可称为下采样层,通过池化操作可以减少特征图的参数量,减少运算量。

池化层对每个通道的特征图进行操作,不改变通道数,但减少每个通道的特征图的大小。

常用的池化操作有均值池化和最大池化。

2024年华为人工智能方向HCIA考试复习题库(含答案)

2024年华为人工智能方向HCIA考试复习题库(含答案)一、单选题1.以下哪—项不属于MindSpore全场景部署和协同的关键特性?A、统一模型R带来一致性的部署体验。

B、端云协同FederalMetaLearning打破端云界限,多设备协同模型。

C、数据+计算整图到Ascend芯片。

D、软硬协同的图优化技术屏蔽场景差异。

参考答案:C2.在对抗生成网络当中,带有标签的数据应该被放在哪里?A、作为生成模型的输出值B、作为判别模型的输入值C、作为判别模型的输出值D、作为生成模型的输入值参考答案:B3.下列属性中TensorFlow2.0不支持创建tensor的方法是?A、zerosB、fillC、createD、constant参考答案:C4.以下哪一项是HiAI3.0相对于2.0提升的特点?A、单设备B、分布式C、多设备D、端云协同参考答案:B5.以下哪个不是MindSpore中Tensor常见的操作?A、asnumpy()B、dim()C、for()D、size()参考答案:C6.优化器是训练神经网络的重要组成部分,使用优化器的目的不包含以下哪项:A、加快算法收敛速度B、减少手工参数的设置难度C、避过过拟合问题D、避过局部极值参考答案:C7.K折交叉验证是指将测试数据集划分成K个子数据集。

A、TRUEB、FALSE参考答案:B8.机器学习是深度学习的一部分。

人工智能也是深度学习的一部分。

A、TrueB、False参考答案:B9.在神经网络中,我们是通过以下哪个方法在训练网络的时候更新参数,从而最小化损失函数的?A、正向传播算法B、池化计算C、卷积计算D、反向传播算法参考答案:D10.以下不属于TensorFlow2.0的特点是?A、多核CPU加速B、分布式C、多语言D、多平台参考答案:A11.以下关于机器学习中分类模型与回归模型的说法,哪一项说法是正确的?A、对回归问题和分类问题的评价,最常用的指标都是准确率和召回率B、输出变量为有限个离散变量的预测问题是回归问题,输出变量为连续变量的预测问题是分类问题C、回归问题知分类问题都有可能发生过拟合D、逻辑回归是一种典型的回归模型参考答案:C12.ModelArts平台中的数据管理中不支持视频数据格式。

关于人工智能的图像识别技术分析

关于人工智能的图像识别技术分析【摘要】图像识别技术是人工智能领域的一个重要分支,通过对图片进行分析和识别,使机器能够像人类一样理解和处理图像信息。

本文首先介绍了人工智能的发展背景和图像识别技术的重要性。

然后详细探讨了图像识别技术的原理、应用领域、发展趋势、挑战以及算法介绍。

最后从图像识别技术的未来发展、影响以及建议与展望等方面进行了总结和展望。

随着人工智能技术的不断进步和应用领域的不断拓展,图像识别技术将在未来发挥越来越重要的作用,对社会和经济的发展产生深远影响。

我们需要关注和加强对图像识别技术的研究和应用,以推动其更好地为人类社会服务。

【关键词】人工智能, 图像识别技术, 发展背景, 重要性, 原理, 应用领域, 发展趋势, 挑战, 算法介绍, 未来发展, 影响, 建议与展望.1. 引言1.1 人工智能的发展背景人工智能是一种模拟人类智能行为的技术,其发展历史可以追溯至20世纪50年代。

在当时,人工智能被定义为一种能够模拟人的智能行为方式的计算机程序。

随着计算机技术不断发展,人工智能也在不断地演进和完善。

在过去的几十年里,人工智能已经取得了巨大的突破,包括语音识别、自然语言处理、机器学习等领域。

人工智能的发展背景可以追溯至二战后期,由于计算机技术的快速发展,人们开始尝试将计算机应用于模拟人的智能行为。

随着时间的推移,人工智能逐渐从学术研究走向商业应用,并在各行各业得到了广泛应用。

如今,人工智能已经成为科技行业的一个热门话题,各大科技公司都在加大对人工智能技术的研发和投入。

人工智能的发展背景可以说是计算机技术的不断进步和人类对智能的探索。

随着人工智能的发展,人类可以更好地利用这项技术来解决现实生活中的问题,提高生产效率,改善生活品质。

1.2 图像识别技术的重要性图像识别技术在人工智能领域发挥着至关重要的作用。

通过利用大数据和深度学习算法,图像识别技术能够让计算机系统识别、理解和处理图像数据,实现对现实世界的认知和交互。

计算机视觉技术中常见的图像识别方法

计算机视觉技术中常见的图像识别方法在计算机视觉领域,图像识别是一项重要的技术,它使得计算机能够理解和识别图像中的内容。

图像识别方法包括了很多不同的技术和算法,本文将介绍一些常见的图像识别方法。

1. 特征提取方法:特征提取是图像识别的关键步骤,它能将图像中的关键信息提取出来,以便后续的识别和分类。

常见的特征提取方法包括:- 边缘检测:边缘是图像中明显颜色或灰度值变化的地方,边缘检测方法可以通过计算像素灰度值的一阶或二阶导数来检测并标记出边缘。

常用的边缘检测方法包括Sobel算子、Canny算子等。

- 尺度不变特征变换(SIFT):SIFT是一种对图像局部特征进行提取和描述的算法。

它通过寻找图像中的关键点,并计算关键点周围的局部特征描述子来实现图像的特征提取。

SIFT算法具有尺度不变性和旋转不变性等优点,被广泛应用于目标识别和图像匹配领域。

- 主成分分析(PCA):PCA是一种统计学方法,用于将高维数据转变为低维数据,并保留原始数据的主要特征。

在图像识别中,可以使用PCA方法将图像像素矩阵转换为特征向量,从而实现图像的特征提取和降维。

2. 分类器方法:分类器方法是图像识别中常用的方法之一,它通过训练一个分类器来预测图像的类别。

常见的分类器方法包括:- 支持向量机(SVM):SVM是一种监督学习算法,它通过将数据映射到高维空间中,构建一个能够将不同类别分开的超平面来实现分类。

在图像识别中,可以利用SVM方法通过给定的特征来训练一个分类器,再用该分类器对新的图像进行预测。

- 卷积神经网络(CNN):CNN是一种前馈神经网络,它通过多层卷积和池化层来自动学习和提取图像中的特征。

CNN在图像识别领域取得了很大的成功,被广泛应用于图像分类、目标检测和图像分割等任务中。

- 决策树:决策树是一种基于树形结构的分类方法,它通过根据特征的不同取值来对样本进行分类。

在图像识别中,可以构建一棵决策树来实现对图像的分类和识别。

res2net代码解析

res2net代码解析一、介绍r e s2ne t(Re si du al-Re so lu ti on Ne two r k)是一种提升图像识别性能的卷积神经网络结构。

它利用了多尺度特征之间的相互依赖关系,通过增加分辨率分支和多尺度特征融合模块,有效提高了网络的特征表达能力。

二、网络结构r e s2ne t的主要特点在于引入了分辨率分支和多尺度特征融合模块。

下面将详细介绍这两个重要的组成部分。

2.1分辨率分支r e s2ne t通过在主干网络的每个模块中增加一个分辨率分支,实现了多尺度特征的提取。

具体而言,分辨率分支由两个卷积层组成,分别用于提取低分辨率和高分辨率特征。

这种设置可以捕捉到更丰富的图像细节和上下文信息。

2.2多尺度特征融合模块为了充分利用不同分辨率特征的信息,re s2n et引入了多尺度特征融合模块。

该模块通过将多个分辨率特征叠加在一起,并通过卷积操作进行特征融合,从而生成新的特征表示。

这样做有助于提高网络对不同尺度目标的感知能力。

三、代码实现下面给出了r es2n et代码的基本实现步骤,供大家参考。

```p yt ho ni m po rt to rc hi m po rt to rc h.nn asn nc l as sR es2N et(n n.M o du le):d e f__i ni t__(se lf,n um_c la ss es):s u pe r(Re s2Ne t,sel f).__in it__()网络结构定义代码...d e ff or wa rd(s el f,x):前向传播代码...r e tu rn xm o de l=Re s2Ne t(num_cl as se s=100)```需要注意的是,这只是r es2n et代码的基本实现框架,具体细节实现需要根据具体任务进行调整。

四、应用领域r e s2ne t在图像识别领域取得了很多突破性的成果。

图像识别的技术现状和发展趋势

图像识别的技术现状和发展趋势随着科技的快速发展,图像识别技术已经成为人们日常生活中不可或缺的一部分。

从人脸识别到物体识别,从安全监控到智能驾驶,图像识别技术在各个领域都有广泛的应用。

本文将介绍图像识别技术的现状、发展趋势以及具体应用案例。

图像识别技术主要涉及到的算法有深度学习的卷积神经网络(CNN)、支持向量机(SVM)、特征提取等。

其中,卷积神经网络在图像识别领域取得了显著的成果,它能够自动学习图像的特征,提高了图像识别的准确率。

在图像识别领域,常用的数据集包括MNIST、CIFAR-ImageNet等。

这些数据集包含了大量的标签化图像数据,为研究者提供了充足的训练样本。

图像识别的评价指标主要包括准确率、召回率、F1分数等,用于衡量模型的性能。

随着深度学习技术的进步,未来图像识别技术将更加注重模型结构的优化和新型算法的探索。

例如,研究人员正在尝试使用更复杂的神经网络模型,如Transformer、GPT等,以提高图像识别的性能。

随着图像识别技术的不断发展,其应用领域也将越来越广泛。

未来,图像识别技术将更多地与机器人技术、虚拟现实技术等相结合,为人们的生活带来更多便利。

随着图像识别技术的广泛应用,相关产业也将逐渐壮大。

例如,图像识别技术公司将会提供更多的解决方案,推动全球经济的发展。

以自动驾驶汽车为例,图像识别技术在其中扮演着至关重要的角色。

自动驾驶汽车需要利用图像识别技术来识别道路上的行人、车辆、交通信号等信息,从而实现安全驾驶。

通过深度学习的卷积神经网络,自动驾驶汽车能够实现对道路状况的实时监控和准确判断,提高行车安全性能。

同时,自动驾驶汽车还能够通过高精度地图、雷达等手段获取更多环境信息,结合人工智能技术实现更加智能的驾驶。

图像识别技术作为领域的重要分支,已经得到了广泛的应用并取得了显著的成果。

随着技术的不断进步和应用场景的拓展,图像识别技术将在未来发挥更大的作用,推动社会的科技进步和产业发展。

Python中的深度学习

Python中的深度学习深度学习是一种自动学习方法,通过构建神经网络模型不断优化模型参数,从而实现对数据的有效分析和处理。

与传统机器学习方法相比,深度学习在模型设计和优化层面减少了大量人工干预的因素,可以更好地应对复杂的数据处理问题。

Python作为当今最为流行的编程语言之一,对于深度学习的实现也有着很大的帮助和便利。

Python语言的易用性、开源性、扩展性成为了深度学习开发者的首选。

在Python中实现深度学习任务,可以利用众多开源的深度学习框架,如TensorFlow、Keras 、DNN等,它们提供了非常可靠且快速的实现解决方案。

python有更加友好的开发环境以及更加动态的开发支持,使得机器学习和深度学习在python上开发更加顺畅。

为了更好地了解Python深度学习的开发过程,下面就让我们一步步的来了解Python深度学习的基本模型、搭建流程和优秀的应用案例。

首先,Python深度学习的基本模型,即神经网络。

神经网络是深度学习的重要组成部分,它是一种通过模拟人类大脑神经元的运行原理,实现对数据的有效分类和预测的一种计算模型。

神经网络将数据输入到神经元中,经过一系列的权重计算和偏置处理,最终输出预测结果。

在Python中,通过调用深度学习框架,可以快速实现神经网络模型的构建和训练。

下面我们以TensorFlow为例,来学习神经网络模型的构建过程。

首先,我们需要在Python中安装好TensorFlow。

在命令台输入pip install tensorflow,即可完成TensorFlow的安装过程。

安装完成后,我们可以通过以下代码来构建一个简单的神经网络模型:```import tensorflow as tf#构建神经网络模型model = tf.keras.Sequential()model.add(yers.Dense(64, activation='relu', input_shape=(28*28,)))model.add(yers.Dense(10, activation='softmax')) #编译模型pile(optimizer='adam',loss='sparse_categorical_crossentropy',metrics=['accuracy'])```上述代码中,我们首先引入TensorFlow库,并使用其提供的Sequential()方法来创建一个序列模型对象。

基于卷积神经网络的图像识别综述

基于卷积神经网络的图像识别综述一、引言随着数字化时代的到来,图像数据在社会生活和工业生产中的应用越来越广泛,如人脸识别、自动驾驶、智能安防等。

图像识别技术的发展对于提高生产效率和生活品质具有重要意义。

卷积神经网络(Convolutional Neural Network,CNN)作为一种深度学习模型,在图像识别领域取得了显著的成果。

本文旨在对基于卷积神经网络的图像识别技术进行全面综述,并分析其挑战和未来发展方向。

二、卷积神经网络基础卷积神经网络(CNN)的基础理论是深度学习和计算机视觉领域的重要基石。

其核心概念包括卷积操作、激活函数、池化层以及全连接层等,这些组件共同构建了一个强大的特征提取和分类器。

以下是关于CNN基础的一些相似论述:1.局部感知与权重共享:卷积神经网络中的卷积操作利用了局部感知和权重共享的思想。

局部感知意味着每个神经元只关注输入数据的一小部分区域,这模拟了生物视觉系统中局部感受野的概念。

权重共享则是指在整个输入数据上共享相同的卷积核权重,这大大减少了模型的参数数量,并提高了计算效率。

2.层次化特征提取:CNN通过层次化的结构实现了从低级到高级的特征提取。

在网络的浅层,卷积层能够学习到图像的基础特征,如边缘、角点等;而在深层,网络能够组合这些基础特征形成更加抽象和复杂的特征表示,如物体的部件或整体结构。

3.非线性激活函数:在CNN中,非线性激活函数(如ReLU、sigmoid等)被用于增加网络的非线性表达能力。

这些激活函数能够将神经元的输出映射到一个非线性空间,使得网络能够学习和模拟复杂的非线性关系。

三、卷积神经网络的发展历程卷积神经网络的发展历程也体现了许多相似之处,以下是关于CNN发展历程的一些相似论述:1.从LeNet到现代CNN:Yann LeCun等人于1998年提出的LeNet-5是卷积神经网络的早期代表。

随着计算能力的提升和数据集的扩大,现代CNN模型如AlexNet、VGGNet、ResNet等逐渐出现并不断改进,取得了更高的性能和准确率。

C语言实现的人工神经网络

C语言实现的人工神经网络人工神经网络(Artificial Neural Network,简称ANN)是一种受到人脑神经元启发的计算模型,用于模拟和解决复杂的计算问题。

C语言是一种高级编程语言,具有广泛的应用领域和强大的计算能力。

本文将介绍如何使用C语言来实现人工神经网络,并探讨其应用和优势。

一、人工神经网络简介人工神经网络是由大量的人工神经元组成的网络结构,其中每个神经元都与其他神经元相连。

每个神经元接收一组输入信号,并通过权重和激活函数来计算输出。

神经网络通过不断训练和调整权重,以便学习和适应输入信号的模式,最终实现对复杂问题的解决。

二、C语言实现神经网络的步骤1. 定义数据结构在C语言中,我们可以使用结构体来定义神经元和神经网络,包括神经元的输入、输出、权重等参数。

2. 初始化神经网络在使用神经网络之前,我们需要对其进行初始化。

可以随机初始化神经元的权重,并设置其他参数如学习率等。

3. 前向传播前向传播是指从输入层开始,逐层计算每个神经元的输出值,并将其传递到下一层。

通过定义激活函数,我们可以实现对神经元输出的非线性变换。

4. 反向传播反向传播是神经网络的训练过程,通过计算损失函数的导数,将误差从输出层反向传递到输入层,并根据梯度下降算法来调整权重。

5. 更新权重根据反向传播的计算结果和学习率,我们可以更新每个神经元的权重,以提高神经网络的性能和准确性。

6. 循环迭代通过多次重复执行前向传播和反向传播,直到神经网络收敛或达到预定的训练轮数。

三、C语言实现神经网络的应用1. 图像识别通过训练神经网络,可以实现对图像中物体的自动识别和分类。

利用C语言实现的神经网络可以处理大量的图像数据,并能够识别出数字、人脸、动物等特定的目标。

2. 语音识别神经网络在语音识别领域有着广泛的应用。

通过训练神经网络,可以实现对语音信号的识别和转录,将人类的语音转化为文本数据。

利用C语言实现的神经网络可以处理实时的语音数据,并能够实现语音识别的高效率和准确性。

神经网络在图像处理中的应用

神经网络在图像处理中的应用随着科技的不断发展,图像处理已经成为人们生活中不可或缺的一部分。

从数码相机到智能手机的普及,从社交媒体到安防监控,图像处理技术贯穿于我们的日常生活。

而近年来,神经网络在图像处理领域的应用越来越广泛,为我们的生活带来了诸多便利。

神经网络在图像处理中的应用原理主要是通过对人脑神经元的模仿,构建一个由多个神经元相互连接而成的网络结构。

这个网络结构在接收到输入图像后,会通过一系列复杂的计算和传递过程,最终输出处理后的图像。

神经网络在图像处理中主要用于识别、分类、压缩、增强等场景。

在图像降噪方面,神经网络的应用取得了显著的成果。

传统的降噪方法主要是基于图像的统计特性或滤波器,但这些方法往往难以处理复杂的噪声类型。

而神经网络可以通过对大量数据进行训练,学习到噪声的特性并自动进行降噪处理。

在图像压缩方面,神经网络可以通过对图像的深层特征进行提取和编码,实现高效的图像压缩,且在解压缩时能够保证图像的清晰度。

在实际应用中,神经网络在图像处理方面已经取得了巨大的成功。

例如,在社交媒体上,神经网络可以用于人脸识别和表情分类,帮助人们更好地理解他人的情感;在安防监控领域,神经网络可以用于目标检测和行为分析,提高监控的准确性和效率;在医疗图像处理中,神经网络可以用于疾病诊断和治疗方案的制定,为医生提供有力的辅助工具。

虽然神经网络在图像处理中已经取得了许多成果,但未来的发展仍面临着诸多挑战。

如何提高神经网络的训练效率和准确性是需要解决的关键问题。

神经网络的模型复杂度较高,需要在保证处理效果的降低模型的复杂度和计算量。

如何确保神经网络在处理图像时的安全性和隐私性也是一个亟待解决的问题。

随着深度学习和的不断发展,神经网络在图像处理中的应用也将逐渐扩展到更多的领域,例如虚拟现实、智能驾驶等。

因此,未来的研究需要不断探索新的应用场景和优化方法,以适应不断变化的市场需求和技术趋势。

神经网络在图像处理中发挥着越来越重要的作用,为我们的生活带来了诸多便利。

基于卷积神经网络的手势识别实验

“剪刀石头布”手势识别——基于卷积神经网络一、实验目的与要求1.上网查询人工智能卷积神经网络相关知识,掌握卷积神经网路CNN的基本原理2.利用CNN实现“剪刀石头布”的手势识别二、实验环境本次实验用的是python+TensorFlow的方式实现的CNN识别器。

实验环境包括:TensorFlow1.5.0、CUDAv11.3、Cudnn-11.2,python3.6版本三、实验代码源程序:CallFrame.py# 单独给CloseButton添加标签self.CloseButton.setProperty('color', 'gray') # 自定义标签self.GetGestureButton.setProperty('color', 'same')self.JudgeButton.setProperty('color', 'same')self.HelpButton.setProperty('color', 'same')# 定义槽函数def GetGesture(self):self.LitResultlabel.setText("")self.ImaResultlabel.setPixmap(QPixmap('./ges_ico/white.ico'))self.LitResultlabel.setAutoFillBackground(False)saveGesture()self.LitResultlabel.setText("已经将该图像保存在电脑本地")self.LitResultlabel.setAlignment(Qt.AlignCenter)def JudgeGesture(self):global gesture_action # 要修改全局变量需要先在函数里面声明一下self.LitResultlabel.setText("正在调用卷积神经网络识别图像")self.LitResultlabel.setAlignment(Qt.AlignCenter)QApplication.processEvents() # 这里需要刷新一下,否则上面的文字不显示gesture_num = evaluate_one_image()if gesture_num == 1:gesture_action = "1"self.result_show_1()elif gesture_num == 2:gesture_action = "2"self.result_show_2()elif gesture_num == 3:gesture_action = "3"self.result_show_3()elif gesture_num == 4:gesture_action = "4"self.result_show_4()elif gesture_num == 5:gesture_action = "5"self.result_show_5()def ExcuteGesture(self):self.serial_communicate()def Help(self):rmation(self, "操作提示框", "获取手势:通过OpenCV和摄像头获取一张即时照片。

基于卷积神经网络的图像识别研究

基于卷积神经网络的图像识别研究作者:房梦婷陈中举来源:《电脑知识与技术》2020年第10期摘要:为提高图像识别的准确率,提出了一种基于卷积神经网络的图像识别模型。

本实验使用Python编程语言实现模型的训练与测试。

对图像数据集cifar-10进行预处理后,使用Python中的Keras框架进行模型的构建与训练,模型训练完毕后,对识别准确率进行评估,最后对测试集中的图片进行识别,获得预测准确率和混淆矩阵。

通过增加卷积运算的次数,提高图像识别的准确率。

关键词:卷积神经网络;图像识别;Python;Keras中图分类号:TP391 文献标识码:A文章编号:1009-3044(2020)10-0190-031概述卷积神经网络,简称CNN,是多层神经网络模型的一个变种,受到生物学的启发,卷积神经网络在图像领域得到了广泛的应用。

最早的神经网络模型是1998年由LeCun等人提出的LeNet5m,它以交替出现的卷积层和池化层作为基础的主干网络,结合全连接层组成完整的网络结构。

在2012年,Krizhevsky等人设计了AlexNetN网络,它的主干网络包含了五个卷积层,全连接层增加到三个,并且将传统的激活函数替换成ReLU函数。

2013年,MinLin在NetworkinNetworkN中首次明确提出了在进行卷积运算的时候使用1Xl的卷积核。

2014年,Szegedv等人提出了并行卷积的Inception模块。

2015年,HeK等人提出了使用两个3x3的卷积核代替原来的5x5的卷积核的MSRA-Net[S],使网络的性能得到非常大的提升。

同年,HeK等人提出的RestNet网络,进一步提升了网络性能。

2相关技术2.1Keras框架Keras是一个使用Python编写的模型级的高级深度学习程序库,只处理模型的建立、训练和预测等,使用最少的程序代码、花费最少的时间建立深度学习模型。

对于深度学习底层的运算(如张量运算),使用的是“后端引擎”。

图像识别与机器学习考试

图像识别与机器学习考试(答案见尾页)一、选择题1. 图像识别中常用的算法有哪些?A. 边缘检测B. SIFT(尺度不变特征变换)C. SURF(加速稳健特征)D.ORB(Oriented FAST and Rotated BRIEF)E. KAZEF. AKAZEG. SIFT奔豚H. DAISY2. 机器学习中,以下哪个不是常见的评估指标?A. 准确率B. 精确率C. 召回率D. F1分数E. R2分数3. 在卷积神经网络中,哪种类型的层被称为卷积层?A. 全连接层B. 激活层C. 卷积层D. 池化层4. 以下哪个选项是监督学习的代表算法?A. 决策树B. 支持向量机C. 随机森林D. 神经网络5. 在深度学习中,哪种类型的神经网络通常用于图像识别任务?A. 循环神经网络(RNN)B. 长短期记忆网络(LSTM)C. 卷积神经网络(CNN)D. 生成对抗网络(GAN)6. 在图像处理中,锐化是一种常见的操作,它的作用是:A. 增强图像边缘B. 增强图像细节C. 减少图像噪点D. 对图像进行平滑处理7. 在机器学习中,以下哪个概念与“模型预测”无关?A. 特征工程B. 训练数据C. 正则化D. 测试数据8. 在卷积神经网络中,池化层的主要作用是什么?A. 提取图像特征B. 进行特征变换C. 减少特征图大小D. 增加特征图通道数9. 以下哪个选项是深度学习与传统机器学习的主要区别?A. 模型复杂度B. 数据量C. 计算资源需求D. 特征工程10. 在图像识别任务中,以下哪个因素对模型的性能影响最大?A. 算法选择B. 训练数据质量C. 模型优化D. 硬件设备11. 图像识别中常用的特征提取方法有哪些?A. HOGB. SIFTC. SURFD. ORBE. LBP12. 以下哪种机器学习算法可以用于图像分类?A. 决策树B. 支持向量机(SVM)C. 随机森林D. 神经网络E. K-最近邻(KNN)13. 在图像识别中,以下哪个步骤不是特征提取?A. 特征选择B. 特征转换C. 特征规范化D. 特征计算14. 以下哪种图像处理技术可以增强特征提取的效果?A. 图像平滑B. 图像锐化C. 图像去噪D. 图像分割15. 在机器学习中,以下哪种评估指标用于衡量分类器的性能?A. 准确率B. 精确率C. 召回率D. F1 分数16. 以下哪种深度学习架构被广泛应用于图像识别任务?A. 卷积神经网络(CNN)B. 循环神经网络(RNN)C. 生成对抗网络(GAN)D. 深度残差网络(ResNet)17. 在图像识别中,以下哪种技术可以用于减少过拟合?A. 正则化B. 早停法C. 数据增强D. 权重衰减18. 以下哪种机器学习算法可以用于物体检测?A. 深度学习中的卷积神经网络(CNN)B. 支持向量机(SVM)C. 决策树D. 随机森林19. 在图像分割中,以下哪种技术可以实现基于像素的分类?A. 阈值分割B. 区域生长C. 分水岭算法D. K-means聚类20. 以下哪种图像处理技术可以用于测量图像的相似性?A. 图像标准化B. 图像配准C. 图像金字塔D. 图像压缩21. 图像识别中常用的算法有哪些?A. SIFT(尺度不变特征变换)B. SURF(加速稳健特征)C.ORB(Oriented FAST and Rotated BRIEF)D. KAZE(KAZE特征)E. AKAZE(加快的速度和自适应阈值)22. 机器学习在图像识别中的应用有哪些?A. 监督学习B. 无监督学习C. 强化学习D. 半监督学习E. 图像分割23. 深度学习中,卷积神经网络(CNN)在图像识别中的优势体现在哪些方面?A. 自动特征提取B. 参数共享C. 多层次抽象D. 并行计算24. 在图像识别中,以下哪个因素会影响模型的性能?A. 数据集的大小B. 训练数据的数量C. 表示层的维度D. 所用的特征提取算法25. 以下哪种图像处理技术可以用于提高特征点检测的精度?A. 图像平滑B. 图像锐化C. 图像去噪D. 图像分割26. 在机器学习中,以下哪种方法可以用来评估模型的性能?A. 计算准确率B. 计算混淆矩阵C. 计算ROC曲线下面积(AUC)D. 计算均方误差(MSE)27. 以下哪种算法可以用于图像恢复?A. 反向传播算法B. 高斯-牛顿算法C. 小波变换D. 深度学习中的卷积神经网络28. 在图像识别中,以下哪个步骤不是特征提取阶段的一部分?A. 特征选择B. 特征量化C. 特征转换D. 特征匹配29. 以下哪种图像处理技术可以用于提高图像的质量?A. 图像缩放B. 图像旋转C. 图像滤波D. 图像增强30. 在机器学习中,以下哪种算法可以用于分类问题?A. 决策树B. 支持向量机(SVM)C. 随机森林D. 神经网络31. 图像识别与机器学习在计算机视觉领域中的应用有哪些?A. 目标检测B. 人脸识别C. 图像分割D. 手写数字识别32. 机器学习中常用的算法有哪些?A. 决策树B. 支持向量机(SVM)C. 随机森林D. 神经网络33. 什么是深度学习?它在图像识别中的应用有哪些?A. 深度学习是一种机器学习方法B. 深度学习可以自动提取特征C. 深度学习可以用于物体检测和识别D. 深度学习可以用于图像生成34. 在图像识别中,卷积神经网络(CNN)的优势是什么?A. 可以自动提取局部特征B. 计算效率较高C. 对于小样本数据集表现较好D. 具有较好的泛化能力35. 什么是迁移学习?在图像识别中如何应用?A. 将预训练模型迁移到新的任务上B. 使用预训练模型的权重作为初始权重C. 可以减少训练时间和计算资源D. 可以提高模型的性能36. 在机器学习中,什么是过拟合和欠拟合?它们如何影响模型的性能?A. 过拟合:模型在训练数据上表现很好,但在测试数据上表现较差B. 欠拟合:模型在训练数据和测试数据上的表现都较差C. 过拟合:模型的复杂度过高,导致泛化能力下降D. 欠拟合:模型的复杂度过低,无法捕捉到数据的底层结构37. 什么是交叉验证?它在图像识别中有何作用?A. 一种评估模型性能的方法B. 可以评估模型的泛化能力C. 可以调整模型参数D. 可以减少计算资源38. 在图像识别中,什么是混淆矩阵?它如何帮助我们评估模型的性能?A. 一种可视化工具,用于展示分类结果B. 可以帮助我们计算准确率、召回率等指标C. 可以帮助我们找出模型的错误类型D. 可以帮助我们进行模型优化39. 什么是特征向量?它在图像识别中的作用是什么?A. 特征向量是图像的一种表示形式B. 特征向量可以用于计算图像之间的相似性C. 特征向量可以用于分类和识别D. 特征向量可以用于生成新的图像40. 什么是超参数?它在机器学习中如何调整?A. 超参数是模型的参数,用于控制模型的学习过程B. 超参数可以在训练过程中调整C. 超参数可以是固定的,也可以是根据经验进行调整D. 超参数的调整对模型的性能有很大影响二、问答题1. 什么是图像识别中的特征提取?请列举几种常用的特征提取方法,并简要说明它们的原理和应用场景。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

写人脸检测程序的时候顺带写的,网络格式是靠读入一个文件定义的,文件的格式如下:输入图像长输入图像宽隐层神经元个数输出神经元个数不同网络结构数量[连接位置不同的隐层神经元的个数连接的隐层神经元个数][隐层神经元连接的输入神经元的位置表]下面是一个例子:24 28 52 1316 321 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 41 1 1 1 1 12 2 2 2 2 23 3 3 3 3 34 4 4 4 4 45 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 85 5 5 5 5 56 6 6 6 6 67 7 7 7 7 78 8 8 8 8 89 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 129 9 9 9 9 9 10 10 10 10 10 10 11 11 11 11 11 11 12 12 12 12 12 1213 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 1613 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 1613 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 1613 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 16 13 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 16 13 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 16 13 13 13 13 13 13 14 14 14 14 14 14 15 15 15 15 15 15 16 16 16 16 16 16 4 81 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 21 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 23 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 43 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 46 121 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 11 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 11 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 11 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 12 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 22 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 22 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 22 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 23 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 33 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 33 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 33 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 3 34 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 44 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 44 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 44 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 4 45 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 55 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 55 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 55 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 5 56 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 66 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6 6下面是程序代码:typeTSingleExtendedArray = array of extended; TDoubleExtendedArray = array of array of extended;TSamples = packed recordIns: TSingleExtendedArray;Outs: TSingleExtendedArray;end;typeTGraphicBpnn = classprivateprocedure BackPropagate(t: TSingleExtendedArray; n, m: extended);function UpDate(inputs: TSingleExtendedArray): extended;publicsamplecounts, TestCounts: longint;procedure AddToTrain(Ins, Outs: TSingleExtendedArray);procedure AddToTest(Ins, Outs: TSingleExtendedArray);procedure SaveToFile(FileName: string);procedure LoadFromFile(FileName: string);procedure Train(n, m: extended);function Init(FileName: string): boolean;function Predict(Ins: TSingleExtendedArray): extended;function Test: extended;destructor Destroy; override;privatenI, nH, nO: longint;aI, aH, aO, Output_Deltas, Hidden_Deltas: TSingleExtendedArray;wI, wO, cI, cO: TDoubleExtendedArray;Connections: array of array of boolean;Samples: array of TSamples;TestSet: array of TSamples;end;implementationfunction TGraphicBpnn.Init(FileName: string): boolean;vari, j, k, fi, fj: longint;nIw, nIh, RopMax, RopNum, RopTypes: longint;RopMap: array of longint;beginAssignFile(Input, FileName);ReSet(Input);Readln(Input, nIw, nIh, nH, nO);nI := nIw * nIh;setlength(aI, nI);setlength(aH, nH);setlength(aO, nO);for i := 0 to nI - 1 do aI[i] := 1;for i := 0 to nH - 1 do aH[i] := 1;for i := 0 to nO - 1 do aO[i] := 1;setlength(wI, nI, nH);setlength(wO, nH, nO);setlength(cI, nI, nH);setlength(cO, nH, nO);setlength(Connections, nI, nH);for i := 0 to nI - 1 dofor j := 0 to nH - 1 doConnections[i, j] := False;Readln(RopTypes); fj := 0;for k := 1 to RopTypes do beginReadln(RopMax, RopNum);setlength(RopMap, nI);fi := 0;for i := 1 to nIh do beginfor j := 1 to nIw do beginRead(RopMap[fi]);Inc(fi);end;Readln;end;fi := 0;for i := 1 to RopNum do beginInc(fi);if fi > RopMax then fi := 1;for j := 0 to nI - 1 doif RopMap[j] = fi then Connections[j, fj] := true;Inc(fj);end;end;setlength(Output_Deltas, nO);setlength(Hidden_Deltas, nH);randomize;for i := 0 to nI - 1 dofor j := 0 to nH - 1 do begincI[i, j] := 0;wI[i, j] := random(40000) / 10000 - 2;end;for i := 0 to nH - 1 dofor j := 0 to nO - 1 do begincO[i, j] := 0;wO[i, j] := random(40000) / 10000 - 2;end;setlength(Samples, $100); setlength(TestSet, $100);samplecounts := 0; TestCounts := 0;CloseFile(Input);end;procedure TGraphicBpnn.BackPropagate(t: TSingleExtendedArray; n, m: extended); vari, j, k: Longint;Sum, Change: extended;beginfor i := 0 to nO - 1 doOutput_Deltas[i] := aO[i] * (1 - aO[i]) * (t[i] - aO[i]);for j := 0 to nH - 1 do beginSum := 0;for k := 0 to nO - 1 doSum := Sum + Output_Deltas[k] * wO[j, k];Hidden_Deltas[j] := aH[j] * (1 - aH[j]) * Sum;end;for j := 0 to nH - 1 dofor k := 0 to nO - 1 do beginChange := Output_Deltas[k] * aH[j];wO[j, k] := wO[j, k] + n * Change + m * cO[j, k];cO[j, k] := Change;end;for i := 0 to nI - 1 dofor j := 0 to nH - 1 doif Connections[i, j] then beginChange := Hidden_Deltas[j] * aI[i];wI[i, j] := wI[i, j] + n * Change + m * cI[i, j];cI[i, j] := Change;end;end;function TGraphicBpnn.UpDate(inputs: TSingleExtendedArray): extended; vari, j, k: Longint;Sum: extended;beginfor i := 0 to nI - 1 doaI[i] := Inputs[i];for j := 0 to nH - 1 do beginSum := 0;for i := 0 to nI - 1 doif Connections[i, j] thenSum := Sum + aI[i] * wI[i, j];aH[j] := 1 / (1 + Exp(-Sum));end;for k := 0 to nO - 1 do beginSum := 0;for j := 0 to nH - 1 doSum := Sum + aH[j] * wO[j, k];aO[k] := 1 / (1 + Exp(-Sum));end;UpDate := aO[0];end;procedure TGraphicBpnn.Train(n, m: extended);var i: Longint;beginfor i := 0 to samplecounts - 1 do beginUpDate(Samples[i].Ins);BackPropagate(Samples[i].Outs, n, m);end;end;procedure TGraphicBpnn.AddToTrain(Ins, Outs: TSingleExtendedArray);var i: longint;beginif samplecounts > High(Samples) then setlength(Samples, samplecounts + $100); setlength(Samples[samplecounts].Ins, nI);setlength(Samples[samplecounts].Outs, nO);for i := 0 to nI - 1 do Samples[samplecounts].Ins[i] := Ins[i];for i := 0 to nO - 1 do Samples[samplecounts].Outs[i] := Outs[i];Inc(samplecounts);end;procedure TGraphicBpnn.AddToTest(Ins, Outs: TSingleExtendedArray);var i: longint;beginif TestCounts > High(TestSet) then setlength(TestSet, TestCounts + $100); setlength(TestSet[TestCounts].Ins, nI);setlength(TestSet[TestCounts].Outs, nO);for i := 0 to nI - 1 do TestSet[TestCounts].Ins[i] := Ins[i];for i := 0 to nO - 1 do TestSet[TestCounts].Outs[i] := Outs[i];Inc(TestCounts);end;procedure TGraphicBpnn.SaveToFile(FileName: string);vari, j, k: longint;SaveStream: TMemoryStream;beginSaveStream := TMemoryStream.Create;SaveStream.Seek(0, 0);for i := 0 to nI - 1 dofor j := 0 to nH - 1 do beginSaveStream.Write(wI[i, j], sizeof(wI[i, j]));SaveStream.Write(cI[i, j], sizeof(cI[i, j]));end;for j := 0 to nH - 1 dofor k := 0 to nO - 1 do beginSaveStream.Write(wO[j, k], sizeof(wO[j, k]));SaveStream.Write(cO[j, k], sizeof(cO[j, k]));end;SaveStream.SaveToFile(FileName);SaveStream.Free;end;procedure TGraphicBpnn.LoadFromFile(FileName: string); vari, j, k: longint;ReadStream: TMemoryStream;beginReadStream := TMemoryStream.Create;ReadStream.LoadFromFile(FileName);ReadStream.Seek(0, 0);for i := 0 to nI - 1 dofor j := 0 to nH - 1 do beginReadStream.Read(wI[i, j], sizeof(wI[i, j]));ReadStream.Read(cI[i, j], sizeof(cI[i, j]));end;for j := 0 to nH - 1 dofor k := 0 to nO - 1 do beginReadStream.Read(wO[j, k], sizeof(wO[j, k]));ReadStream.Read(cO[j, k], sizeof(cO[j, k]));end;ReadStream.Free;end;function TGraphicBpnn.Predict(Ins: TSingleExtendedArray): extended; begintryPredict := Update(Ins);exceptPredict := 0;end;end;function TGraphicBpnn.Test: extended;varPreRet: extended;i, Counts, Ret: longint;beginCounts := 0;for i := 0 to TestCounts - 1 do beginPreRet := Predict(TestSet[i].Ins);if PreRet > 0.5 then Ret := 1 else Ret := 0;if Ret = TestSet[i].Outs[0] then Inc(Counts);end;Result := Counts / TestCounts;end;destructor TGraphicBpnn.Destroy;beginsetlength(aI, 0);setlength(aH, 0);setlength(aO, 0);setlength(Output_Deltas, 0);setlength(Hidden_Deltas, 0);setlength(wI, 0, 0);setlength(wO, 0, 0);setlength(cI, 0, 0);setlength(cO, 0, 0);setlength(Connections, 0, 0); setlength(Samples, 0); inherited;end;。