广义线性模型(一)

广义线性模型课件

(三)条件Logistic回归分析的基本原理

1.概述 条件Logistic回归是经典Logistic回归的重要拓展方法 之一,它主要用于分层数据(strata data)的影响因素 分析,通过分层来控制可能的混杂因素对结局变量的影 响。分层变量可以包括一个变量或者几个变量 。

2.条件 Logistic模型 令yk为第k层的因变量,yk=1或0;xk1,xk2…xki… xkm为 第k层的m个自变量。第k层的模型为:

推荐书籍:

Hosmer, David W . (2000). Applied logistic regression . John Wiley, New York.

(一)Logistic回归分析的任务

影响因素分析 logistic回归常用于疾病的危险因素分析,logistic回归 分析可以提供一个重要的指标:OR。

(2)令病例的生存时间比对照短 (3)在设置生存状态变量(status)时,令病例组为完全 数据,对照组为删失数据

以下实例摘自Hosme and Lemeshow(2000). Applied Logistic Regression: Second Edition.

John Wiley & Sons Inc.

Logistic回归

因变量

协变量(自变量)

注:此处将X1、X3看作为连续变量。

OR的95%置信区间

对模型的检验

模型拟合良好

经统计学检验,模型2=13.951,P=0.003,Logistic回 归模型有显著性。

拟合分类表

符合率为 70.0%

回归系数 标准误 Wald值

P值

OR

OR置信区间

g(x)是对P的变换,称为logit变换:

广义估计方程

总结

其特点归纳如下: 1)建模稳健。即使作业相关矩阵指定不正确

,只要联接函数正确,仍然可以得到稳定的参 数估计值。

2)充分利用资料信息。对多次重复测量的纵 向数据,广义估计方程利用了每次测量的结果 ,较少损失资料的信息。

总结3)应变量不是连续性变量时,考察应变量之间

联合分布和协方差矩阵非常困难,常规的统计模 型难以处理这个问题。利用广义估计方程不仅解 决了这类资料的建模问题,还可得到相关矩阵以 衡量重复测量之间相关性的大小,是一种较好的 分析策略。

一般线性模型

方差分析

一般线性模型

应用: 用于研究某个指标(应变量,记为Yi)与一

组指标(Xi1, Xi2,… ,Xij)之间的线性关系 。 表达式:

yi=β0+ β1Xi1+ β2Xi2+ … βjXij+ei

一般线性模型

一般线性模型对于残差分布的三个重要假设: (1)独立 (2)符合正态分布,且均数为0 (3)方差齐性,即ei的方差相等

纵向数据

传统的统计方法一般都要求应变量是独立 的,因而,由于应变量之间的相关,纵向数据 不能用传统的方法来分析。因为如果忽略重复 测量间的相关性,将损失数据中的信息,参数 估计可能不准确。因此,Liang和Zeger等创立 了广义估计方程(generalized estimating equations) 。

4)模型可以引入多种形式的自变量,考察分类 、等级、连续的或其他形式的自变量对应变量影 响的大小。

应用举例

表2 某药物抗癫痫的随机对照临床试验对照组每2周的发作次数

ID Base Visit4

Visit1

Visit2 Visit3

1

11

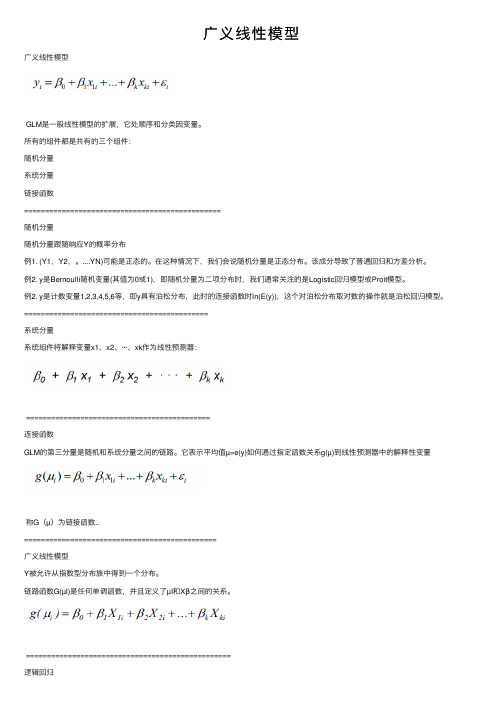

广义线性模型

⼴义线性模型⼴义线性模型GLM是⼀般线性模型的扩展,它处顺序和分类因变量。

所有的组件都是共有的三个组件:随机分量系统分量链接函数===============================================随机分量随机分量跟随响应Y的概率分布例1. (Y1,Y2,。

....YN)可能是正态的。

在这种情况下,我们会说随机分量是正态分布。

该成分导致了普通回归和⽅差分析。

例2. y是Bernoulli随机变量(其值为0或1),即随机分量为⼆项分布时,我们通常关注的是Logistic回归模型或Proit模型。

例2. y是计数变量1,2,3,4,5,6等,即y具有泊松分布,此时的连接函数时ln(E(y)),这个对泊松分布取对数的操作就是泊松回归模型。

============================================系统分量系统组件将解释变量x1、x2、···、xk作为线性预测器:============================================连接函数GLM的第三分量是随机和系统分量之间的链路。

它表⽰平均值µ=e(y)如何通过指定函数关系g(µ)到线性预测器中的解释性变量称G(µ)为链接函数..==============================================⼴义线性模型Y被允许从指数型分布族中得到⼀个分布。

链路函数G(µI)是任何单调函数,并且定义了µI和Xβ之间的关系。

=================================================逻辑回归因变量是⼆进制的评估多个解释变量(可以是数值型变量和/或类别型变量)对因变量的影响。

=============================================模型含义:鸟类的巢址使⽤响应变量是有巢的站点的概率,其中概率计算为p/(1-p),p是有巢的站点的⽐例。

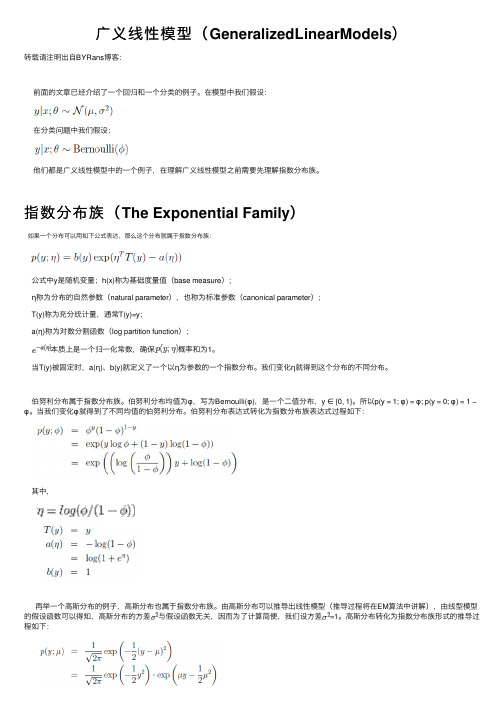

广义线性模型(GeneralizedLinearModels)

⼴义线性模型(GeneralizedLinearModels)在线性回归问题中,我们假设,⽽在分类问题中,我们假设,它们都是⼴义线性模型的例⼦,⽽⼴义线性模型就是把⾃变量的线性预测函数当作因变量的估计值。

很多模型都是基于⼴义线性模型的,例如,传统的线性回归模型,最⼤熵模型,Logistic回归,softmax回归。

指数分布族在了解⼴义线性模型之前,先了解⼀下指数分布族(the exponential family)指数分布族原型如下如果⼀个分布可以⽤上⾯形式在表⽰,那么这个分布就属于指数分布族,⾸先来定义⼀下上⾯形式的符号:η:分布的⾃然参数(natural parameter)或者称为标准参数(canonical parameter)T (y):充分统计量,通常⽤T(y) = ya(η):对数分割函数(log partition function):本质上是⼀个归⼀化常数,确保概率和为1。

当给定T时,a、b就定义了⼀个以η为参数的⼀个指数分布。

我们变化η就得到指数分布族的不同分布。

论证伯努利分布和⾼斯分布为指数分布族,伯努利分布均值φ,记为Bernoulli(φ),y ∈ {0, 1},所以p(y = 1; φ) = φ; p(y = 0; φ) = 1 − φ对⽐指数分布族的表达式可以得到:η = log(φ/(1-φ)) 我们将φ⽤η表⽰,则:φ=1/(1+e-η),是不是发现和sigmoid函数⼀样了。

这就表明,当我们给定T,a,b,伯努利分布可以写成指数分布族的形式,也即伯努利分布式指数分布族。

同理,在⾼斯分布中,有:对⽐指数分布族,我们得到:因为⾼斯分布的⽅差与假设函数⽆关,因⽽为了计算简便,我们设⽅差=1,这样就得到:所以这也表明,⾼斯分布也是指数分布族的⼀种。

构造⼴义线性模型(Constructing GLMs)怎么通过指数分布族来构造⼴义线性模型呢?要构建⼴义线性模型,我们要基于以下三个假设:1. 给定特征属性和参数后,的条件概率服从指数分布族,即。

第3章-广义线性模型

年收入 (万元)

是否有车

年收入 (万元)

是否有车

年收入 (万元)

是否有车

15

1

25

1

12

0

20

1

12

0

15

1

10

0

10

0

9

0

12

1

15

1

8

0

8

0

7

0

10

0

30

1

22

1

22

1

6

0

7

0

24

1

16

1

16

1

9

0

22

1

18

1

10

0

36

1

211181707

0

30

1

24

1

9

0

6

0

6

0

6

0

13

0

11

0

20

1

23

1

18

.

8

2. 正态线性回归模型

• 只要取联结函数为 m (i) i x iT (i 1 , ,n ),则正

态线性回归模型满足广义线性模型的定义.

• 类似的,容易验证,二项分布和泊松分布都属 于指数分布族.

• 下面介绍实际中应用广泛的两种广义线性

模型:Logistic模型和对数线性模型.

2020/8/5

1

16

1

10

0

2020/8/5

.

11

2. 模型的参数估计和检验

• 采用R软件中的广义线性模型过程glm( )可以完成 回归系数的估计,以及模型回归系数的显著性检验. 程序如下:

generalized linear model结果解释-概述说明以及解释

generalized linear model结果解释-概述说明以及解释1.引言1.1 概述概述部分的内容可以包括对广义线性模型的简要介绍以及结果解释的重要性。

以下是一种可能的编写方式:在统计学和机器学习领域,广义线性模型(Generalized Linear Model,简称GLM)是一种常用的统计模型,用于建立因变量与自变量之间的关系。

与传统的线性回归模型不同,广义线性模型允许因变量(也称为响应变量)的分布不服从正态分布,从而更适用于处理非正态分布的数据。

广义线性模型的理论基础是广义线性方程(Generalized Linear Equation),它通过引入连接函数(Link Function)和系统误差分布(Error Distribution)的概念,从而使模型能够适应不同类型的数据。

结果解释是广义线性模型分析中的一项重要任务。

通过解释模型的结果,我们可以深入理解自变量与因变量之间的关系,并从中获取有关影响因素的信息。

结果解释能够帮助我们了解自变量的重要性、方向性及其对因变量的影响程度。

通过对结果进行解释,我们可以推断出哪些因素对于观察结果至关重要,从而对问题的本质有更深入的认识。

本文将重点讨论如何解释广义线性模型的结果。

我们将介绍广义线性模型的基本概念和原理,并指出结果解释中需要注意的要点。

此外,我们将提供实际案例和实例分析,以帮助读者更好地理解结果解释的方法和过程。

通过本文的阅读,读者将能够更全面地了解广义线性模型的结果解释,并掌握解释结果的相关技巧和方法。

本文的目的是帮助读者更好地理解和运用广义线性模型,从而提高统计分析和机器学习的能力。

在接下来的章节中,我们将详细介绍广义线性模型及其结果解释的要点,希望读者能够从中受益。

1.2文章结构文章结构部分的内容应该是对整篇文章的结构进行简要介绍和概述。

这个部分通常包括以下内容:文章结构部分的内容:本文共分为引言、正文和结论三个部分。

其中,引言部分主要概述了广义线性模型的背景和重要性,并介绍了文章的目的。

广义线性模型的分析及应用

广义线性模型的分析及应用一、引言广义线性模型(Generalized Linear Model, GLM)提供了一种在保持简单性的前提下,对非正态响应变量建立连续性预测模型的方法,适用于许多实际应用问题中。

本文旨在介绍广义线性模型的基本概念、模型构建方法、推断等内容,并通过实际案例的分析加深对GLM的理解与应用。

二、基本概念GLM是统计学中一种具有广泛适用性的模型框架,它的基本思想是将未知的响应变量与已知的协变量之间的关系描述为一个线性预测器和一个非线性函数的组合,即:g(E(Y)) = β_0 + β_1X_1 + ⋯+ β_pX_p其中,g(·)称为联接函数(Link Function),它定义了响应变量的均值与预测变量之间的关系,E(Y)为响应变量的期望,X_1,X_2,…,X_p为解释变量(predictor)或协变量(covariate),β_0, β_1, …, β_p是模型的系数或参数。

GLM假定响应变量Y服从指数分布族中的某一个分布,如正态分布、二项分布、泊松分布等。

三、模型构建方法1. 选择联接函数和分布族:不同的响应变量应选用不同的分布族。

例如,连续性响应变量可选用正态分布,二元响应变量可选用二项分布,而计数型响应变量可选用泊松分布等。

2. 选择解释变量:可使用变量选择算法,如前向选择法、向后选择法、逐步回归等,在给定样本内拟合出最佳模型。

3. 选择估计方法:由于某些非正态分布族无法使用最小二乘法拟合,可以使用极大似然估计法或广义估计方程法。

对于大样本,一般使用广义线性混合模型等。

4. 模型比较与选择:模型拟合后,需要进行模型检验和模型诊断,主要包括残差分析、Q-Q图检验、$R^2$值、F检验、AIC/BIC值等指标的分析。

四、模型应用GLM的应用非常广泛,特别是在医学、生态、社会科学、金融等领域。

下面以某市2019年全年医疗保险数据为例,运用GLM模型进行分析。

1. 数据描述健康保险数据包含了每个缴费人的性别、年龄、缴费金额、报销金额等信息。

广义线性模型

广义线性模型广义线性模型*(Nelder和Wedderburn,1972)除了正态分布,也允许反应分布,以及模型结构中的一定程度的非线性。

GLM具有基本结构g(μi)=X iβ,其中μi≡E(Yi),g是光滑单调'链接函数',Xi是模型矩阵的第i行,X和β是未知参数的向量。

此外,GLM通常会做出Yi是独立的和Yi服从一些指数族分布的假设。

指数族分布包括许多对实际建模有用的分布,如泊松分布,二项分布,伽马分布和正态分布。

GLM的综合参考文献是McCullagh和Nelder(1989),而Dobson(2001)提供了一个全面的介绍。

因为广义线性模型是以“线性预测器”Xβ的形式详细说明的,所以线性模型的许多一般想法和概念通过一些修改而继续存在到广义线性模型中。

除了必须选择的链接函数和分布之外,基本模型公式与线性模型公式基本相同。

当然,如果恒等函数被选择作为链接以及正态分布,那么普通线性模型将作为特例被恢复。

然而,泛化是以某种成本为代价的:现在的模型拟合必须要迭代完成,而且用于推理的分布结果是近似的,并且由大样本限制结果证明是正确的而不是精确的。

但在深入探讨这些问题之前,请考虑几个简单的例子。

μi=cexp(bt i),例1:在疾病流行的早期阶段,新病例的发生率通常会随着时间以指数方式增加。

因此,如果μi是第ti天的新病例的预期数量,则该形式的模型为请注意,“广义”和“一般”线性模型之间存在区别-后一个术语有时用于指除简单直线以外的所有线性模型。

可能是合适的,其中c和b是未知参数。

通过使用对数链路,这样的模型可以变成GLM形式log(μi)=log(c)+bt i=β0+t iβ1(根据β0=logc和β1=b的定义)。

请注意,模型的右侧现在在参数中是线性的。

反应变量是每天新病例的数量,因为这是一个计数,所以泊松分布可能是一个合理的可以尝试的分布。

因此,针对这种情况的GLM使用泊松反应分布,对数链路和线性预测器β0+tiβ1。

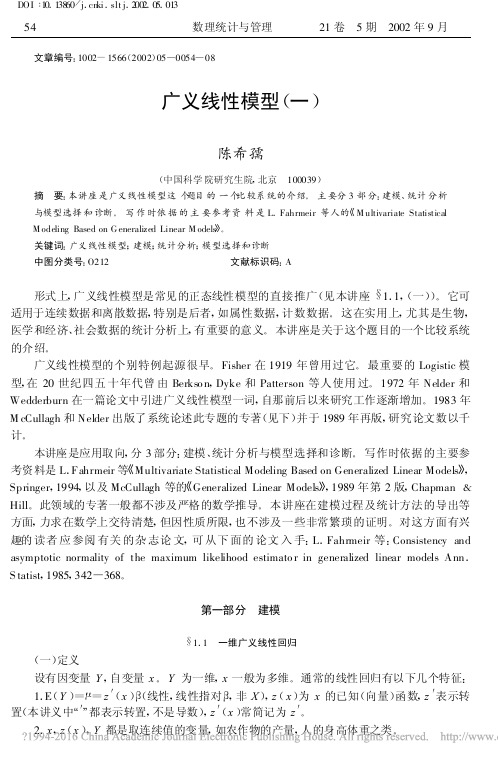

广义线性模型_一_陈希孺

DOI:10.13860/ ki.slt j.2002.05.01354数理统计与管理 21卷 5期 2002年9月 文章编号:1002-1566(2002)05—0054—08广义线性模型(一)陈希孺(中国科学院研究生院,北京 100039)摘 要:本讲座是广义线性模型这个题目的一个比较系统的介绍。

主要分3部分:建模、统计分析与模型选择和诊断。

写作时依据的主要参考资料是L.Fahrmeir等人的《M ultivariate StatisticalM odeling Based on G eneralized Linear M odels》。

关键词:广义线性模型;建模;统计分析;模型选择和诊断中图分类号:O212文献标识码:A形式上,广义线性模型是常见的正态线性模型的直接推广(见本讲座§1.1,(一))。

它可适用于连续数据和离散数据,特别是后者,如属性数据,计数数据。

这在实用上,尤其是生物,医学和经济、社会数据的统计分析上,有重要的意义。

本讲座是关于这个题目的一个比较系统的介绍。

广义线性模型的个别特例起源很早。

Fisher在1919年曾用过它。

最重要的Logistic模型,在20世纪四五十年代曾由Berkso n,Dyke和Patterson等人使用过。

1972年Nelder和Wedderburn在一篇论文中引进广义线性模型一词,自那前后以来研究工作逐渐增加。

1983年M cCullagh和Nelder出版了系统论述此专题的专著(见下)并于1989年再版,研究论文数以千计。

本讲座是应用取向,分3部分:建模、统计分析与模型选择和诊断。

写作时依据的主要参考资料是L.Fahrmeir等《Multivariate Statistical Modeling Based on Generalized Linear Models》, Springer,1994,以及McCullagh等的《Generalized Linear Models》,1989年第2版,Chapman& Hill。

广义线性模型的实现与分析

广义线性模型的实现与分析广义线性模型是一种常用的数据分析工具,可用于回归分析、分类、预测等多种实际问题。

在本文中,我们将探讨广义线性模型的实现和分析方法。

一、概述广义线性模型是一种扩展的线性模型,它通过对响应变量的分布进行建模,使得该模型能够适应更多类型的数据。

广义线性模型主要由三个重要组成部分组成:随机部分、系统部分和连接函数。

1、随机部分随机部分是指与响应变量相关的随机分布。

通常情况下,响应变量的分布都会根据其自然属性而确定不同的随机分布类型,如正态分布、泊松分布、二项分布等。

2、系统部分系统部分由自变量和一组参数所组成,用于描述响应变量的均值。

形式上,系统部分一般表示为:η=g(μ)=Xβ,其中,η表示线性预测子,g表示连接函数,μ表示响应变量的均值,X表示自变量矩阵,β表示回归系数。

3、连接函数连接函数将随机部分和系统部分连接起来,将预测值转换为响应变量的实际值。

广义线性模型中常用的连接函数有:恒等函数、对数函数、逆双曲正切函数、逆高斯函数等。

二、实现方法广义线性模型的实现方法分为两种:最大似然估计和贝叶斯估计。

1、最大似然估计最大似然估计法是广义线性模型中最常用的参数估计方法。

最大似然估计的思想是在给定自变量的前提下,寻找一个最符合响应变量的参数值,使得预测值与实际值的差异最小化。

具体来说,假设我们的模型已知,我们要求出回归系数β的值,使得给定自变量矩阵X和响应变量y的情况下,模型的对数似然函数值最大。

最大化对数似然函数可以通过梯度下降、拟牛顿法等算法来实现。

2、贝叶斯估计贝叶斯估计是一种基于贝叶斯统计理论的参数估计方法。

贝叶斯估计可以在多次观测数据的基础上,对未知参数的历史数据进行推断,从而得到该参数的后验分布概率。

贝叶斯估计中一般会引入一些先验分布信息,使得最终的参数估计更准确。

贝叶斯参数估计方法可以通过马尔科夫链蒙特卡罗(MCMC)算法来实现。

三、分析方法广义线性模型分析主要包括模型拟合和模型诊断两部分。

广义线性模型(GeneralizedLinearModels)

⼴义线性模型(GeneralizedLinearModels)转载请注明出⾃BYRans博客:前⾯的⽂章已经介绍了⼀个回归和⼀个分类的例⼦。

在模型中我们假设:在分类问题中我们假设:他们都是⼴义线性模型中的⼀个例⼦,在理解⼴义线性模型之前需要先理解指数分布族。

指数分布族(The Exponential Family)如果⼀个分布可以⽤如下公式表达,那么这个分布就属于指数分布族:公式中y是随机变量;h(x)称为基础度量值(base measure);η称为分布的⾃然参数(natural parameter),也称为标准参数(canonical parameter);T(y)称为充分统计量,通常T(y)=y;a(η)称为对数分割函数(log partition function);本质上是⼀个归⼀化常数,确保概率和为1。

当T(y)被固定时,a(η)、b(y)就定义了⼀个以η为参数的⼀个指数分布。

我们变化η就得到这个分布的不同分布。

伯努利分布属于指数分布族。

伯努利分布均值为φ,写为Bernoulli(φ),是⼀个⼆值分布,y ∈ {0, 1}。

所以p(y = 1; φ) = φ; p(y = 0; φ) = 1 −φ。

当我们变化φ就得到了不同均值的伯努利分布。

伯努利分布表达式转化为指数分布族表达式过程如下:其中,再举⼀个⾼斯分布的例⼦,⾼斯分布也属于指数分布族。

由⾼斯分布可以推导出线性模型(推导过程将在EM算法中讲解),由线型模型的假设函数可以得知,⾼斯分布的⽅差与假设函数⽆关,因⽽为了计算简便,我们设⽅差=1。

⾼斯分布转化为指数分布族形式的推导过程如下:其中许多其他分部也属于指数分布族,例如:伯努利分布(Bernoulli)、⾼斯分布(Gaussian)、多项式分布(Multinomial)、泊松分布(Poisson)、伽马分布(Gamma)、指数分布(Exponential)、β分布、Dirichlet分布、Wishart分布。

广义线性模型

报告人:宋 捷 指导教师:谢邦昌 日期:2007年11月6日

统计分析、数据挖掘与商业智能应用研究小组

• 广义线性模型介绍

广义线性模型的一般形式 指数分布族下的广义线性模型 广义线性模型的参数估计方法 相关检验

• Climentine 中广义线性模型的实现

● 象回归分析一样,广义线性模型的建立也是为了找出自变量 与因变量这两种变量之间的关系。只是不象经典的线性回归 模型那样需要一些正态性等的假设。

统计分析、数据挖掘与商业智能应用研究小组

广义线性模型的一般形式

关于自变量X与因变量y的广义线性模型一般有如下的形式:

g(E( y)) X , y ~ F

统计分析、数据挖掘与商业智能应用研究小组

结点的fields设置

对于两分类变量的因变量来说,要选择一个参照类(基本类)。

• 如果参照类是最后的值,那么第 一类表示成功,我们就是对第一类 成功的概率进行建模。 • 比如:如果参照类是在二元形式 “male/female”,”1/2”,”a/b”中的最 后的值,“female”,”2”,”b”,他们 就会被转变成“0”,而“male”, “1”,”a”将会相应地被转变成1。 如果想对 “female”,”2”,”b”这些类成 功的概率进行建模,那么我们可以 将参照类的值指定为最前面的值。

3. 对binomial分布而言,y必须取值两类的变量,如果多于两类算法也会终止 报错。

4. 对binomial分布而言,如果选择的 因变量是成功的次数/试验次数(r/m), 那么r必须是非负整数,m必须是正整数, 并且r<=m。否则选定的分布也不可用。

统计分析、数据挖掘与商业智能应用研究小组

广义线性模型

广义线性模型广义线性模型(Generalized Linear Model,GLM)是一种在统计学中常用的模型,它是对普通线性模型的扩展和推广。

在广义线性模型中,因变量不需要满足正态分布的假设,而是通过连接函数(link function)与线性组合的结果进行建模。

广义线性模型的应用领域十分广泛,涵盖了回归分析、分类分析以及其他众多领域。

1. 普通线性模型普通线性模型是一种经典的建模方法,其基本形式为:$$ Y = \\beta_0 + \\beta_1 X_1 + \\beta_2 X_2 + ... + \\beta_k X_k + \\epsilon $$ 其中,Y表示因变量,X1,X2,...,X k表示自变量,$\\beta_0, \\beta_1,\\beta_2, ..., \\beta_k$为模型参数,$\\epsilon$为误差项。

普通线性模型的关键假设是因变量Y服从正态分布。

2. 广义线性模型的基本原理广义线性模型是对普通线性模型的推广,其基本形式为:$$ g(\\mu) = \\beta_0 + \\beta_1 X_1 + \\beta_2 X_2 + ... + \\beta_k X_k $$其中,g()为连接函数(link function),$\\mu$表示期望的因变量Y,其他符号的含义同普通线性模型。

通过连接函数g(),广义线性模型在一般性上不再要求因变量Y服从正态分布。

3. 连接函数(Link Function)连接函数g()的选择是广义线性模型的关键之一,不同的连接函数对应不同的模型形式。

常见的连接函数包括:•恒等连接函数(Identity link function): $g(\\mu) = \\mu$,对应普通线性模型。

•对数连接函数(Log link function): $g(\\mu) = log(\\mu)$,常用于泊松回归等模型。

•逆连接函数(Inverse link function): $g(\\mu) = \\frac{1}{\\mu}$,用于逻辑回归等模型。

广义线性模型

⼴义线性模型从线性回归,logistic回归,softmax回归,最⼤熵的概率解释来看,我们会发现线性回归是基于⾼斯分布+最⼤似然估计的结果,logistic回归是伯努利分布+对数最⼤似然估计的结果,softmax回归是多项分布+对数最⼤似然估计的结果,最⼤熵是基于期望+对数似然估计的结果。

前三者可以从⼴义线性模型⾓度来看。

⼴义线性模型⼴义线性模型建⽴在三个定义的基础上,分别为:定义线性预测算⼦η=θT x定义y的估计值h(x,θ)=E(y|x,θ)定义 y 的估值概率分布属于某种指数分布族:Pr(y|x,θ)=b(y)exp(ηT T(y)−a(η))接下来详细解释各个定义指数分布家族指数分布家族是指可以表⽰为指数形式的概率分布,指数分布的形式如下:p(y;η)=b(y)exp(ηT T(y)−a(η))其中:1. η被称为⾃然参数(natural parameters)2. T(y)称为充分统计量,通常T(y)=y3. a(η)称为对数分割函数(log partition function);4. e−a(η)本质上是⼀个归⼀化常数,确保p(y;η)概率和为1。

当T(y)被固定时,a(η)、b(y)就定义了⼀个以η为参数的⼀个指数分布。

我们变化η就得到这个分布的不同分布。

为什么要把$ y的条件分布定义为这么奇怪的指数分布族?这是因为,在这样的定义下,我们可以证明:p(y|η)$ 的期望值满⾜:E(y|η)=ddηa(η)p(y|η)的⽅差满⾜:Var(y|η)=d2dη2a(η)如此简洁的期望和⽅差意味着:⼀旦待估计的y的概率分布写成了某种确定的指数分布族的形式(也就是给定了具体的a,b,T),那么我们可以直接套⽤公式h(x,θ)=E(y|x,θ)=ddηa(η) 构建回归模型。

实际上⼤多数的概率分布都属于指数分布家族,⽐如1)伯努利分布 0-1问题2)⼆项分布,多项分布多取值多次试验3)泊松分布计数过程4)伽马分布与指数分布5)β分布6)Dirichlet分布7)⾼斯分布现在我们将⾼斯分布和伯努利分布⽤指数分布家族的形式表⽰:Bernoulli分布的指数分布族形式:p(y=1;ϕ)=ϕ;p(y=0;ϕ)=1−ϕ⟹p(y;ϕ)=ϕy(1−ϕ)1−y=exp(ylogϕ+(1−y)log(1−ϕ))=exp((log(ϕ1−ϕ))y+log(1−ϕ))即:在如下参数下⼴义线性模型是 Bernoulli 分布η=log(ϕ/(1−ϕ))⟹ϕ=1/(1+e−η)T(y)=ya(η)=−log(1−ϕ)=log(1+eη)b(y)=1 Gaussian 分布的指数分布族形式:在线性回归中,σ对于模型参数θ的选择没有影响,为了推导⽅便我们将其设为1:p(y;µ)=1√2πexp(−12(y−µ)2)=1√2πexp(−12y2)⋅exp(µy−12µ2)得到对应的参数:η=µT(y)=ya(η)=µ2/2=η2/2b(y)=1√2πexp(−12y2)⽤⼴义线性模型进⾏建模想⽤⼴义线性模型对⼀般问题进⾏建模⾸先需要明确⼏个假设:1.y|x;θ∼ExponentialFamily(η)的条件概率属于指数分布族2.给定x ⼴义线性模型的⽬标是求解 T(y)|x ,不过由于很多情况下T(y)=y所以我们的⽬标变成了y|x , 也即我们希望拟合函数为h(x)=E[y|x](NOTE:这个条件在线性回归和逻辑回归中都满⾜,例如逻辑回归中hθ(x)=p(y=1|x;θ))3.⾃然参数η与x是线性关系:η=θT x (η为向量时,ηi=θT i x )有了如上假设就可以进⾏建模和求解了:⼴义线性模型推导出线性回归:step1: p(y|x;theta)∼N(µ,θ)step2: 由假设2h(x)=E[y|x]得到:h(x)=E[y|x]=µ=η=θT x⼴义线性模型推导出逻辑回归:step1: p(y|x;theta)∼Bernoulli(ϕ)step2: 由假设2h(x)=E[y|x]得到:h(x)=E[y|x]=ϕ=11+e−η=11+e−θT xProcessing math: 100%。

线性模型(5)——广义线性模型

线性模型(5)——广义线性模型广义线性模型是一种扩展了一般线性模型的模型,它在混合线性模型的基础上进一步扩展,使得线性模型的使用范围更加广泛。

每次扩展都是为了适用更多的情况。

一般线性模型要求观测值之间相互独立,残差(因变量)服从正态分布,残差(因变量)方差齐性。

而混合线性模型取消了观测值之间相互独立和残差(因变量)方差齐性的要求。

广义线性模型又取消了对残差(因变量)服从正态分布的要求。

残差不一定要服从正态分布,可以服从二项、泊松、负二项、正态、伽马、逆高斯等分布,这些分布被统称为指数分布族,并且引入了连接函数。

根据不同的因变量分布、连接函数等组合,可以得到各种不同的广义线性模型。

需要注意的是,虽然广义线性模型不要求因变量服从正态分布,但是仍要求相互独立。

如果不符合相互独立的要求,需要使用广义估计方程。

广义线性模型的一般形式包括线性部分、随机部分εi和连接函数。

连接函数为单调可微的函数,起到连接因变量的估计值μ和自变量的线性预测值η的作用。

在广义线性模型中,自变量的线性预测值是因变量的函数估计值。

广义线性模型设定因变量服从指数族概率分布,这样因变量就可以不局限于正态分布,并且方差可以不稳定。

指数分布族的概率密度函数包括θ和φ两个参数,其中θ为自然参数,φ为离散参数,a、b、c为函数广义线性模型的参数估计。

广义线性模型的参数估计一般不能使用最小二乘法,常用加权最小二乘法或极大似然法。

回归参数需要用迭代法求解。

广义线性模型的检验和拟合优度一般使用似然比检验和Wald检验。

似然比检验是通过比较两个相嵌套模型的对数似然函数来进行的,统计量为G。

模型P中的自变量是模型K 中自变量的一部分,另一部分是要检验的变量。

G服从自由度为K-P的卡方分布。

回归系数使用Wald检验进行模型比较。

广义线性模型的拟合优度通常使用以下统计量来度量:离差统计量、Pearson卡方统计量、AIC、AICC、BIC、CAIC准则,准则的值越小越好。

广义线性模型(一)

( 本讲 义 中“ ’ 表 示 转 置 , 是 导 数 ) z ( ) 简记 为 z 。。 ¨都 不 , z 常 2 z, ( ) Y都 是 取 连 续 值 的变 量 , 农 作 物 的 产 量 , 的 身 高 体 重 之 类 。 . zz , 如 人

维普资讯

Mo es , p ig r 1 9 , d I》 S r e ,9 4 以及 Mc l g n Cul h等 的 《 n r l e ie rMo es , 9 9年 第 2版 , a Ge eai d L n a d l》 1 8 z C a ma & Hi 。 此 领 域 的专 著 一 般 都 不 涉 及 严 格 的 数 学 推 导 。本 讲 座 在 建 模 过 程 及 统 计 hp n l l 方 法 的 导 出等 方 面 , 求 在 数 学 上 交 待 清 楚 , 因性 质 所 限 , 不 涉 及 一 些 非 常 繁 琐 的 证 明 。 力 但 也

维普资讯

5 4

数 理 统 计 与 管理

2 1卷 5期 2 0 0 2年 9, J

文 章 编 号 : 0 2 1 6 ( O 2 0 0 5 0 1 0 5 6 2 O ) 5 0 4 8

广义线性模型 ( ) 一

陈 希 孺

( l 科 学 院 研 究 生 院 , 京 1 0 3 ) 【 I 北 0 0 9 摘 要 : 讲 座 是 广 义 线 性 模 型 这 个 题 目的 一 个 比 较 系统 的 介 绍 。 主 要 分 3部 分 : 模 、 计 分 析 本 建 统 与 模 型 选 择 和 诊 断 。 写 作 时 依 据 的 主 要 参 考 资 料 是 I F h me a r i 人 的 《 ut a i e S a i i l . r等 M l v r t tt t a i a s c

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

陈希孺 数理统计与管理 21 卷 5 期 2002

年9 月

简介

广义线性模型是常见的正态线性模型的直 接推广

适用于连续数据和离散数据,特别是后者,如 属性数据,计数数据

在实用上,尤其是生物,医学和经济、社会数 据的统计分析上,有重要的意义

起源

Fisher 在1919 年曾用过它。 Logistic 模型,在20 世纪四五十年代曾由

(1 , x1 , x 2)′, (1 , x1 , x2 , x21, x22, x 1 x2) 等。

3. Y 的分布属于指数型,正态是其一特例。这 里考虑的Y 为一维,故属于一维指数型。其 形式为:

c ( y) exp (θy - b (θ) ) dμ( y) ,θ ∈Θ (参数空间)

θ为参数,称为自然参数。b (θ) 为θ的已知函 数。μ为一测度(不一定是概率测度) ,常见的 有两种可能:

起着重要的作用。它称为自然联系函数,这时 有z′β= g (μ) = g ( b (θ) ) =θ

因此,指数型分布(1. 1) 中的自然参数,就是z′β。 这一重要关系式是“自然联系函数”这一名称 的由来。

其形式比在其他联系函数下来得简单,其最 重要的优点是:它使广义线性模型下统计推 断的大样本理论更易处理。当然,在一个实 际问题中选择联系函数,主要应依据问题本

身的情况。

probit模型 log-log模型

这个差距中有一部分是由于“位置”与“刻度”

的差异而来, 并非真实的有实际意义的差距。

第一部分 建模

§1. 1 一维广义线性回归 (一) 定义

设有因变量Y ,自变量x 。Y 为一维, x 一般为

多维

通常的线性回归

E( Y) =μ= z′( x)β(线性,线性指对β,非X) , z ( x)

为x 的已知(向量) 函数, z′表示转置(本讲义中 “′”都表示转置,不是导数) , z′( x) 常简记为z′。

因为 两边对θ求导,有

例1. 1 研究一些因素(自变量) 对“剖 腹产后是否有感染”的影响。

此例中z 就取为x ,引进记号

例1. 2 研究两种化学物质TNF 与IFN 对引发细胞癌变的影响。

x = ( x1 , x2)′:

例1. 3 Y 是某种极值(水文、地震、 材料断裂强度之类)

及McCullagh 等的《Generalized Linear Models》,1989 年第2 版,Chapman &Hill 。

L. Fahrmeir 等: Consistency and asymptotic normality of the maximum likelihood estimator in generalized linear models Ann. Statist ,1985 ,342 —368 。

设这个试验只包括“品种”这一个因素,模型 为

可见

这种取哑变量法,是以状态k 作为标准,而βj 衡量 (在产量上) 状态j 超出状态k之值。

另一种取法( j = 1 , ⋯, q)

(三) 联系函数·自然联系函数

联系函数g∶g (μ) =η= z′β,μ= E( Y) ,其反函数h 也

很常用。作为联系函数, g 必须严格单调且充分 光滑,即有足够阶数的导数。有一个特殊的联 系函数,即

2. x , z ( x) , Y 可取连续或离散值,且在应用上更多 见的情况为离散值,如{0 , 1} ,{0 , 1 ,2 ⋯⋯}等

例如, x 为1 维, z ( x) 可以是(1 , x) , (1 , x , x2) , (1 , ex) 等。若x = ( x1 , x2)′, z ( x) 可以是

x , z ( x) , Y 都是取连续值的变量,如农作物的 产量,人的身高体重之类。

Y 的分布为正态,或接近正态之分布。

广义线性回归从以下几方面推广:

1. E( Y) =μ= h ( z′β) , h 为一严格单调,充分光滑的 函数。h 已知, g = h - 1 ( h 的反函数) 称为联系 函数(link function) 。有g (μ) = z′β。

Berkson ,Dyke 和Patterson 等人使用过。 1972 年Nelder 和Wedderburn 在一篇论文中

引进广义线性模型一词,自那前后以来研究 工作逐渐增加 1983 年McCullagh 和Nelder 出版了系统论述 此专题的专著并于1989 年再版

主要参考资料

L. Fahrmeir 等《Multivariate Statistical Modeling Based on Generalized Linear Models》,Springer ,1994

采用Gamma (Γ) 分布去描述: Y有密度

提醒两点

当Y 为1 维时,只能有1 个未知参数(此例中为 μ) 。若有多个参数,剩下的为冗余,它必须已 知或可由样本估计,即以估计值为已知值。

在各次观察中冗余参数不变。如在此例中, 相应yi 的μ值可变,为μi (与此相应,θ值则为θi

= - v/μi ) ,但v 则不随i 变化。

两点注意:

在有些实际问题中,数据显示均值方差之间 的关系不符合(1. 20) 。这时就不可能使用单 参指数族的模型。在Γ和正态分布的例中包 含了一个冗余参数,调整它的值有时可以解 决上述问题。

(二) 哑(或虚) 变量(dummy variable)

设有一个因素(自变量之一) 有k 个“状态”, 我们固然可以用数字1 , ⋯,k 来标识它,但不 可用于计算,因为它们无数量意义。例ห้องสมุดไป่ตู้农 业试验中,品种是一个因素。有k 类种子,解 决的办法是引进哑变量

a. 当Y 为连续变量时, dμ( y) 为Lebesgue 测度:

dμ( y) = dy ;

b. 当Y 为离散变量时, Y 取有限个值a1 , ⋯, am 或可列个值a1 , a2 , ⋯,这时μ({ ai} ) = 1 , i = 1 , ⋯, m ;或μ({ ai} ) = 1 , i = 1 ,2 ⋯