TensorFlow 2.0 将包含许多 API 变更

TensorFlow新特性与应用模型训练和部署

TensorFlow新特性与应用模型训练和部署随着人工智能领域的快速发展,深度学习框架TensorFlow作为其中的重要一员,不断推出新的特性以满足用户需求。

本文将介绍TensorFlow的若干新特性,并探讨其在模型训练和部署方面的应用。

一、TensorFlow 2.0版本的全面升级TensorFlow 2.0是TensorFlow近几年来最重要的一个版本升级。

相较于之前的版本,TensorFlow 2.0主要进行了以下改进:1. 引入了动态图机制:TensorFlow2.0使用了Eager Execution(即动态图机制),将计算图和计算过程融为一体,使得代码更加直观易懂,开发更加方便快捷。

2. 支持Keras作为主要的高级API:TensorFlow 2.0将Keras整合到核心代码库中,使得Keras成为TensorFlow的默认高级API。

Keras提供了简单易用的接口,可以方便地构建神经网络模型。

3. 优化了模型的可读性和调试性:TensorFlow 2.0对原有的API进行了重构和简化,使得模型的可读性更强,调试更加方便。

TensorFlow 2.0的全面升级,大大降低了使用门槛,提升了开发效率,使得用户能够更加专注于模型的设计和应用。

二、TensorFlow模型训练TensorFlow提供了丰富的模型训练工具和库,可以方便地进行模型训练和调优。

1. 数据准备与预处理:TensorFlow提供了一系列的数据处理工具,如tf.data模块,可以高效地处理和加载大量数据,并进行预处理操作,例如数据增强、标准化等。

2. 网络模型的构建:通过使用TensorFlow的Keras API,我们可以轻松地构建各种类型的神经网络模型,包括卷积神经网络、循环神经网络等。

同时,TensorFlow也提供了一些预训练模型,如ResNet、Inception等,可以直接使用或进行迁移学习。

3. 模型训练与调优:TensorFlow提供了多种优化器,如常见的随机梯度下降(SGD)、Adam等,可以根据问题的特点选择合适的优化算法。

tensorflow 大纲

TENSORFLOW 大纲TensorFlow(中文名:张量流)是由Google开发的开源深度学习框架,广泛应用于机器学习和深度学习领域。

TensorFlow提供了丰富的工具和资源,使得开发者能够构建、训练和部署各种复杂的神经网络模型。

本文将介绍TensorFlow的基本概念、特性和使用方式,以及一些常见的应用场景。

1. TensorFlow基本概念张量(Tensor):TensorFlow的名字来源于“张量”,它是TensorFlow中最基本的数据结构。

张量可以看作是多维数组或矩阵的泛化。

在深度学习中,所有的数据都以张量的形式表示,包括输入数据、权重、偏置等。

计算图(Computational Graph):TensorFlow使用计算图来表示整个机器学习模型的计算过程。

计算图是由节点和边组成的有向图,节点表示操作(如加法、乘法),边表示数据流向。

通过定义计算图,可以有效地进行异步、分布式计算。

会话(Session):TensorFlow的计算是延迟执行的,即在定义计算图后并不立即执行。

为了实际运行计算图,需要创建一个会话。

会话控制着张量的计算和存储,使得模型的训练和推断能够顺利进行。

2. TensorFlow特性灵活性:TensorFlow提供了丰富的API,支持多种深度学习模型的构建,包括卷积神经网络(CNN)、循环神经网络(RNN)等。

同时,TensorFlow支持符号式编程和命令式编程,使得开发者可以根据任务选择适合的编程方式。

跨平台和分布式计算:TensorFlow可以在各种硬件设备上运行,包括CPU、GPU、TPU等。

此外,TensorFlow支持分布式计算,可以将计算任务分配到多个设备上进行加速。

内置工具和库:TensorFlow提供了一系列内置工具和库,用于简化深度学习任务的实现。

包括用于图像处理的TensorFlow Image处理库(TF.image)、用于自然语言处理的TensorFlow文本处理库(TF.text)等。

TensorFlow深度学习框架的并行计算技巧

TensorFlow深度学习框架的并行计算技巧TensorFlow是目前使用最广泛的深度学习框架之一,它在机器学习领域的广泛应用使得研究人员和工程师们能够更轻松地构建和训练复杂的神经网络模型。

然而,对于大规模的数据集和复杂的模型结构来说,训练过程的时间和资源成本可能会成为限制因素。

因此,使用并行计算技巧来加速TensorFlow的训练过程变得非常重要。

本文将介绍一些TensorFlow深度学习框架的并行计算技巧,帮助您更有效地利用计算资源。

一、多GPU并行训练多GPU并行训练是加速深度学习模型训练的常用技巧之一。

TensorFlow提供了一些工具和API来支持多GPU并行训练。

其中,tf.distribute.Strategy是一种强大的工具,它可以根据不同的硬件环境和场景选择合适的策略来并行训练模型。

首先,我们需要通过tf.distribute.MirroredStrategy来创建一个分布式策略对象。

该策略会在不同的GPU上创建镜像,并自动将数据和模型复制到各个设备上。

然后,我们可以使用该策略执行训练过程。

在模型的定义中,我们需要将所有的变量和操作封装在strategy.scope()中,以确保它们能够在所有的设备上运行。

除了tf.distribute.Strategy,TensorFlow还提供了其他的API和工具来简化多GPU并行训练的过程,如tf.distribute.experimental.MultiWorkerMirroredStrategy和tf.distribute.experimental.TensorFlowOnColabStrategy等。

这些工具可以帮助我们更方便地进行分布式训练,从而充分利用多个GPU的算力。

二、数据并行处理在深度学习训练中,数据处理可能成为一个瓶颈。

为了充分利用计算资源,我们可以使用数据并行处理技术来加速训练过程。

数据并行处理指的是将单个批次的数据划分到多个GPU上进行计算,然后将它们的结果合并。

Python深度学习库TensorFlow

Python深度学习库TensorFlow一、引言随着人工智能技术的不断发展,深度学习已经成为当前最热门的研究领域之一。

在深度学习中,神经网络是最基本的模型之一,而TensorFlow正是一款用于建立神经网络的深度学习框架。

TensorFlow是谷歌(Google)公司开发的一套开源机器学习库,它能够支持多种语言,包括Python和C++。

TensorFlow提供了一个强大的图计算框架,使得用户可以轻松地构建、训练和优化神经网络模型。

本文将介绍TensorFlow的基本概念、基础用法以及构建深度神经网络模型的相关内容,以帮助初学者快速上手TensorFlow。

本文还将简要介绍TensorFlow在各种领域中的应用案例,以展示TensorFlow的强大功能和广泛应用领域。

二、TensorFlow基本概念TensorFlow的整个计算过程都是基于图(Graph)的,其中节点表示操作(Operation),边表示操作之间的依赖关系。

一个TensorFlow 程序通常包括两个阶段:定义阶段和执行阶段。

在定义阶段,用户需要定义神经网络的结构和目标函数;在执行阶段,TensorFlow会建立图并运行神经网络。

下面是TensorFlow的几个基本概念及其简要介绍:1.张量(Tensor):张量是TensorFlow中的核心数据结构,可以看做是多维数组,可以包含任意数量的维度。

张量用于表示神经网络的输入、输出和参数。

2.操作(Operation):操作是TensorFlow中的基本计算单元,表示节点。

节点可以是数学运算、数组操作或是神经网络层等。

例如,加法操作(tf.add)和矩阵乘法操作(tf.matmul)都是一种操作。

3.变量(Variable):变量是TensorFlow中的一个或多个张量,用于存储模型的参数。

变量在训练过程中会被更新,从而实现模型的优化。

4.会话(Session):会话是TensorFlow中的一个运行环境。

人工智能深度学习技术练习(试卷编号261)

人工智能深度学习技术练习(试卷编号261)1.[单选题]考虑以下问题:假设我们有一个5层的神经网络,这个神经网络在使用一个4GB显存显卡时需要花费3个小时来完成训练。

而在测试过程中,单个数据需要花费2秒的时间。

如果我们现在把架构变换一下,当评分是0.2和0.3时,分别在第2层和第4层添加Dropout,那么新架构的测试所用时间会变为多少? CA)少于2sB)大于2sC)是2sD)说不准答案:C解析:2.[单选题]关于面向对象的继承,以下选项中描述正确的是()A)继承是指一组对象所具有的相似性质B)继承是指类之间共享属性和操作的机制C)继承是指各对象之间的共同性质D)继承是指一个对象具有另一个对象的性质答案:B解析:难易程度:易题型:3.[单选题]pytorch执行参数更新的函数是A)optimizer.zero_grad()B)zero.autoC)cost.backward()D)optimizer.step()答案:D解析:4.[单选题]哪个选项不是数据维度的种类?()。

A)二维数据B)高维数据C)多维数据D)正交数据答案:D解析:难易程度:易题型:5.[单选题]在绘图时“m”表示那种颜色()。

A)红色D)以上都不是答案:D解析:难易程度:易题型:6.[单选题]在h_fc1 = tf.nn.relu(tf.matmul(h_flat, W_fc1) + b_fc1)操作,b_fc1是A)对图像池化B)偏置项C)激活函数D)平均答案:B解析:7.[单选题]Adam算法的tensorflow代码是:A)tf.example.AdamOptimizerB)tf.train.AdamOptimizerC)tf.nn.AdamOptimizerD)tf.AdamOptimizer答案:B解析:8.[单选题]训练模型最灵活的方式是:A)内置fitB)内置train_on_batchC)自定义训练循环D)内置compile答案:C解析:9.[单选题]一幅彩色数字图像,分辨率为1024*768,请问在计算机中存储需要多少空间?A)0.28MBB)1.28MBC)2.28MBD)3.28MB答案:C解析:10.[单选题]Hinton和Bengio、Yann.lecun等提成了一个实际可行的( )框架A)MLB)deep learningC)opencv11.[单选题]在多层感知器中,为什么要使用激活函数,下列说法正确的是()A)为了让输出变成归一化数据B)为了让每一层的输出为非线性函数C)为了和输出保持一致D)为了让数据更加真实答案:B解析:不使用激活函数,每一层输出都是上层输入的线性函数,无论神经网络有多少层,输出都是输入的线性组合。

Java机器学习实战使用TensorFlow和Python进行数据分析和模型训练

Java机器学习实战使用TensorFlow和Python进行数据分析和模型训练机器学习已经成为计算机科学领域中的热门话题之一。

它为我们提供了一种通过数据分析和模型训练来实现自动化决策和预测的方法。

在这篇文章中,我们将探讨如何使用Java编程语言结合TensorFlow和Python来进行数据分析和模型训练。

一、引言机器学习是人工智能的一个重要分支,它使用统计学和计算机科学的方法来让机器通过数据学习和改进。

TensorFlow是一个开源机器学习框架,它可以用于构建各种各样的机器学习模型。

Python是一种广泛使用的编程语言,它提供了丰富的机器学习库和工具。

二、数据分析在进行机器学习之前,我们首先需要对数据进行分析。

Java提供了许多用于数据分析的库,比如Apache Commons Math和Weka。

这些库可以帮助我们处理数据,进行统计分析和可视化。

在数据分析过程中,我们可以使用Python的pandas库。

pandas 提供了高效的数据结构和数据分析工具,可以帮助我们对数据进行清洗、转换和处理。

通过pandas,我们可以很方便地对数据进行操作,并从中提取有用的信息。

三、模型训练在数据分析完成后,我们就可以使用TensorFlow来构建和训练机器学习模型了。

TensorFlow提供了丰富的API和工具,可以支持各种机器学习算法和模型类型。

我们可以使用Java编写TensorFlow的代码,并调用Python的运行时来执行模型训练。

为了使用TensorFlow,我们需要安装相应的Python库和依赖项。

安装完成后,我们可以使用Java与TensorFlow进行交互,并传递数据和参数。

通过训练模型,我们可以使其学习并改进自己的预测能力。

四、应用实例让我们通过一个简单的实例来展示Java机器学习的应用。

假设我们有一组房屋的数据,包括房屋的面积和价格。

我们可以使用TensorFlow来构建一个回归模型,通过输入房屋面积来预测价格。

stablediffusionapi实现多人列队及切换模型的方法

stablediffusionapi实现多人列队及切换模型的方法稳定的扩散API是一个用于实现多人列队和模型切换的方法。

该方法可以在现有的扩散API上进行扩展,以满足多个用户同时使用API的需求,并且能够根据需求切换不同的模型。

在实现多人列队的方法中,首先需要为每个用户创建一个独立的会话。

会话可以使用唯一的标识符或者其他身份信息进行标识。

每个用户的请求都会被链接到对应的会话,这样可以确保每个用户的数据和结果不会混淆。

为了实现多人列队,可以使用队列数据结构来存储用户的请求。

当一个用户发起请求时,将该请求加入到队列中。

系统会按照请求的顺序进行处理,并返回相应的结果。

如果有多个请求同时到达,可以使用先进先出的原则进行处理,确保公平性。

同时,为了提高系统的吞吐量,可以使用多线程或者异步处理技术来并行处理多个用户的请求。

这样可以节省时间,并且提高整体的响应速度。

可以根据实际的需求来确定使用哪种处理方式。

另外,为了避免由于一些用户的请求导致整个系统的崩溃,可以使用失败重试机制。

当一些请求处理失败时,可以将该请求重新加入到队列中,并进行重试。

如果重试多次仍然失败,可以将该请求放入到一个特殊的队列中,用于记录这些失败请求,以便后续排查问题。

在切换模型的方法中,可以为每个用户提供一个接口来选择使用的模型。

用户可以在请求中指定要使用的模型的名称或者对应的参数。

系统根据用户的请求来选择加载不同的模型,并执行相应的操作。

为了支持模型的切换,可以使用插件化的架构来加载和管理多个模型。

每个模型可以对应一个插件,插件可以通过配置文件或者其他方式进行加载。

系统可以根据用户的选择来加载对应的插件,并使用该插件进行处理。

同时,为了提高系统的灵活性,可以支持动态加载和卸载模型。

用户可以在运行时随时切换模型,而不需要停止整个系统。

可以通过监听用户的请求,检测到模型切换的信号,并在切换的时候加载新的模型,以及卸载旧的模型。

综上所述,稳定的扩散API实现多人列队和切换模型的方法可以通过使用会话管理、队列数据结构、多线程或异步处理、失败重试机制、插件化架构和动态加载卸载等技术来实现。

机器学习项目图像分类数据及分类代码详解

机器学习项目Tensorflow2图像分类-Flowers数据及分类代码详解

评估模型

为了评估模型的性能,我们可以使用Flowers数据集的一部分图片(如20%)来进行测试。通 过比较模型在这些图片上的预测结果和实际标签,我们可以计算出模型的准确率、召回率 等指标。如果模型的性能不佳,我们可以尝试调整模型的结构或参数,然后重新进行训练 和评估

机器学习项目Tensorflow2图像分类-Flowers数据及分类代码详解

数据预处理

机器学习项目Tensorflow2图像分类-Flowers数据及分类代码详解

在进行图像分类任务之前,我们 需要对数据进行预处理。这包括 将图片转换为Tensorflow2可以 处理的格式(如张量),以及对标 签进行编码。对于Flowers数据 集,我们可以使用Keras库中的 ImageDataGenerator类来自动完 成这些操作

-

请各位老师批评指正!

THESIS DEFENSE POWERPOINT

XXXXXXXXXX

指导老师:XXX

答 辩 人 :XXX

机器学习项目Tensorflow2 图像分类-Flowers数据及分

类代码详解

-

1 数据集介绍 3 数据预处理 5 训练模型 7 应用模型

2 环境搭建 4 构建模型 6 评估模型

机器学习项目Tensorflow2图像分类-Flowers数据及分类代码详解

标题:使用Tensorflow2进行图像分类:Flowers数据集实践 副标题:掌握深度学习技术,实现花卉图像自动识别 正文 随着计算机视觉技术的发展,图像分类已经成为了人工智能领域的一个热门研究方向。在 众多的图像分类任务中,花卉图像分类是一个具有挑战性的任务,因为它涉及到多种花卉 的识别和分类。本文将介绍如何使用Tensorflow2框架和Flowers数据集来实现花卉分类-Flowers数据及分类代码详解

TensorFlow和自动机器学习(AutoML)

TensorFlow和自动机器学习(AutoML)TensorFlow是一个开源的机器学习框架,它提供了丰富的工具和库,帮助研究人员和开发者设计、构建和训练各种机器学习模型。

而自动机器学习(AutoML)则是一种旨在简化机器学习流程的方法,通过自动化和自动化工具来减少人工干预,从而更高效地构建和应用机器学习模型。

本文将介绍TensorFlow和自动机器学习的概念和应用,并探讨它们在现代科技发展中的重要性。

一、TensorFlow简介TensorFlow 是一个由Google Brain团队开发的开源框架,可用于各种机器学习任务,包括图像和语音识别、自然语言处理、强化学习等。

它的核心是一个基于数据流图的编程模型,通过在节点之间传递张量(tensors)来表示数学操作。

TensorFlow提供了一种灵活且高效的方式,使开发人员能够轻松构建、训练和部署机器学习模型。

1.1 TensorFlow的特性TensorFlow具有许多强大的特性,使其成为机器学习领域的热门工具之一。

首先,TensorFlow提供了一个易于使用的Python API,使开发人员能够在Python环境中方便地进行模型开发和调试。

此外,它还支持多种编程语言,包括C++、Java和Go,为机器学习任务的灵活性和可扩展性提供了支持。

其次,TensorFlow具有分布式计算的能力,可在多个设备和多个计算节点上进行模型训练和推断。

这使得在大规模数据集和复杂模型上进行高性能计算成为可能。

另外,TensorFlow提供了一个可视化的工具,称为TensorBoard,用于可视化模型的结构和训练过程。

通过TensorBoard,用户可以轻松地监视模型的性能和调试潜在问题。

1.2 TensorFlow的应用领域TensorFlow在各个领域都有广泛的应用。

以下是一些典型的应用场景:1. 图像和语音识别:TensorFlow可以用于图像和语音识别任务,例如人脸识别、语音指令识别等。

有关TensorFlow的相关研究

有关TensorFlow的相关研究本文将探讨TensorFlow的相关研究,包括其在机器学习和深度学习领域的应用、最新的发展趋势以及未来的发展方向。

我们将从以下五个方面展开讨论:1. TensorFlow在机器学习和深度学习中的应用2. TensorFlow的最新发展趋势3. TensorFlow的研究进展4. TensorFlow在特定领域的研究应用5. TensorFlow未来的发展方向一、TensorFlow在机器学习和深度学习中的应用TensorFlow在机器学习和深度学习领域有着广泛的应用。

它提供了灵活的架构和丰富的工具,可以支持各种类型的神经网络模型,如卷积神经网络(CNN)、循环神经网络(RNN)等。

在图像识别领域,TensorFlow被广泛应用于目标检测、图像分类、语义分割等任务。

在自然语言处理领域,TensorFlow被用于机器翻译、文本生成、情感分析等任务。

TensorFlow还被应用于推荐系统、强化学习等领域。

二、TensorFlow的最新发展趋势近年来,随着深度学习技术的迅速发展,TensorFlow也在不断演进。

TensorFlow 2.0版本在易用性和性能上都有了很大的改进,简化了API接口,提高了运行速度和计算效率。

TensorFlow还加入了许多新的功能,如自动微分、模型部署等,使得开发者可以更加轻松地构建和部署深度学习模型。

TensorFlow还提供了Keras等高级API,使得开发者可以更加方便地构建和训练神经网络模型。

在TensorFlow的基础上,有许多研究工作涉及到了更加深入和复杂的深度学习模型和算法。

一些研究人员致力于改进卷积神经网络的结构,提高图像识别和语义分割的性能;一些研究人员对循环神经网络进行了优化,以应对自然语言处理中的长文本建模等挑战;还有一些研究人员关注于如何将深度学习模型应用于具体的领域,如医疗影像识别、金融风控等。

TensorFlow在特定领域的研究应用也是研究人员关注的焦点之一。

tensorflowflow使用手册

tensorflowflow使用手册摘要:一、TensorFlow简介1.TensorFlow的发展历程2.TensorFlow的特点与优势二、TensorFlow安装与配置1.安装TensorFlow的环境要求2.安装TensorFlow的步骤3.TensorFlow的版本更新与维护三、TensorFlow基础操作1.TensorFlow的数据类型2.TensorFlow的张量操作3.TensorFlow的变量与占位符四、TensorFlow模型构建1.TensorFlow的模型结构2.TensorFlow的损失函数与优化器3.TensorFlow的模型编译与训练五、TensorFlow高级应用1.TensorFlow的数据流图2.TensorFlow的分布式训练3.TensorFlow的动态图与控制流六、TensorFlow在实际项目中的应用1.TensorFlow在计算机视觉中的应用2.TensorFlow在自然语言处理中的应用3.TensorFlow在推荐系统中的应用正文:TensorFlow是一个开源的机器学习框架,由谷歌公司开发。

TensorFlow 的发布标志着深度学习领域的重大进步,它让开发者能够轻松地构建、训练和部署深度学习模型。

本手册将详细介绍TensorFlow的使用方法,帮助读者更好地理解和应用TensorFlow。

一、TensorFlow简介TensorFlow是谷歌公司在2015年发布的深度学习框架,其核心是用Python编写的,同时也支持C++、Java和Go等多种编程语言。

TensorFlow 具有强大的计算能力、灵活的模型构建和易用的API接口,使得开发者能够快速构建和训练深度学习模型。

TensorFlow在学术界和工业界都得到了广泛的应用,例如计算机视觉、自然语言处理和推荐系统等领域。

二、TensorFlow安装与配置TensorFlow的安装需要满足一定的环境要求,主要包括Python版本、CUDA工具包和cuDNN库等。

tensorflow2.0模式下训练的模型转成tf1.x版本的pb模型实例

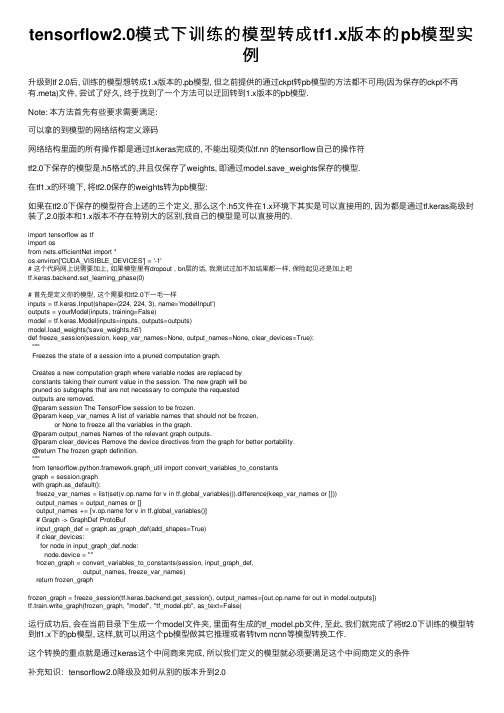

tensorflow2.0模式下训练的模型转成tf1.x版本的pb模型实例升级到tf 2.0后, 训练的模型想转成1.x版本的.pb模型, 但之前提供的通过ckpt转pb模型的⽅法都不可⽤(因为保存的ckpt不再有.meta)⽂件, 尝试了好久, 终于找到了⼀个⽅法可以迂回转到1.x版本的pb模型.Note: 本⽅法⾸先有些要求需要满⾜:可以拿的到模型的⽹络结构定义源码⽹络结构⾥⾯的所有操作都是通过tf.keras完成的, 不能出现类似tf.nn 的tensorflow⾃⼰的操作符tf2.0下保存的模型是.h5格式的,并且仅保存了weights, 即通过model.save_weights保存的模型.在tf1.x的环境下, 将tf2.0保存的weights转为pb模型:如果在tf2.0下保存的模型符合上述的三个定义, 那么这个.h5⽂件在1.x环境下其实是可以直接⽤的, 因为都是通过tf.keras⾼级封装了,2.0版本和1.x版本不存在特别⼤的区别,我⾃⼰的模型是可以直接⽤的.import tensorflow as tfimport osfrom nets.efficientNet import *os.environ['CUDA_VISIBLE_DEVICES'] = '-1'# 这个代码⽹上说需要加上, 如果模型⾥有dropout , bn层的话, 我测试过加不加结果都⼀样, 保险起见还是加上吧tf.keras.backend.set_learning_phase(0)# ⾸先是定义你的模型, 这个需要和tf2.0下⼀⽑⼀样inputs = tf.keras.Input(shape=(224, 224, 3), name='modelInput')outputs = yourModel(inputs, training=False)model = tf.keras.Model(inputs=inputs, outputs=outputs)model.load_weights('save_weights.h5')def freeze_session(session, keep_var_names=None, output_names=None, clear_devices=True):"""Freezes the state of a session into a pruned computation graph.Creates a new computation graph where variable nodes are replaced byconstants taking their current value in the session. The new graph will bepruned so subgraphs that are not necessary to compute the requestedoutputs are removed.@param session The TensorFlow session to be frozen.@param keep_var_names A list of variable names that should not be frozen,or None to freeze all the variables in the graph.@param output_names Names of the relevant graph outputs.@param clear_devices Remove the device directives from the graph for better portability.@return The frozen graph definition."""from tensorflow.python.framework.graph_util import convert_variables_to_constantsgraph = session.graphwith graph.as_default():freeze_var_names = list(set( for v in tf.global_variables()).difference(keep_var_names or []))output_names = output_names or []output_names += [ for v in tf.global_variables()]# Graph -> GraphDef ProtoBufinput_graph_def = graph.as_graph_def(add_shapes=True)if clear_devices:for node in input_graph_def.node:node.device = ""frozen_graph = convert_variables_to_constants(session, input_graph_def,output_names, freeze_var_names)return frozen_graphfrozen_graph = freeze_session(tf.keras.backend.get_session(), output_names=[ for out in model.outputs])tf.train.write_graph(frozen_graph, "model", "tf_model.pb", as_text=False)运⾏成功后, 会在当前⽬录下⽣成⼀个model⽂件夹, ⾥⾯有⽣成的tf_model.pb⽂件, ⾄此, 我们就完成了将tf2.0下训练的模型转到tf1.x下的pb模型, 这样,就可以⽤这个pb模型做其它推理或者转tvm ncnn等模型转换⼯作.这个转换的重点就是通过keras这个中间商来完成, 所以我们定义的模型就必须要满⾜这个中间商定义的条件补充知识:tensorflow2.0降级及如何从别的版本升到2.0代码实践《tensorflow实战GOOGLE深度学习框架》时,由于本机安装的tensorflow为2.0版本与配套书籍代码1.4的API不兼容,只得将tensorflow降级为1.4.0版本使⽤,降级⽅法如下1 pip uninstall tensorflow验证import tensorflow as tfprint(tf.version)⼆从别的版本升级到2.0⾃动卸载与其相关包pip uninstall tensorflow安装某版本pip install --no-cache-dir tensorflow==x.xx (此处填写2.0)验证以上这篇tensorflow 2.0模式下训练的模型转成 tf1.x 版本的pb模型实例就是⼩编分享给⼤家的全部内容了,希望能给⼤家⼀个参考,也希望⼤家多多⽀持。

TensorFlow因代码执行缺陷已弃用YAML,建议使用JSON来替代

据外媒报道,由于缺陷,由谷歌的源机器学习和人工智能—— TensorFlow 已经放弃了对 YAML 的支持。

在最新版本中,Google 已将 YAML 删除,以解决不受信任的反序列化漏洞执行问题。

据悉,本次编号为 CVE-2021-37678 的漏洞,由研究员 Arjun Shibu 提交给谷歌的,其严重程度较高,CVSS 得分为 9.3 。

YAML 一种更可读的格式,用于表示数据序列化。

研究人员发现,当 TensorFlow代码加载 yaml.unsafe_load()函数时,攻击者可通过该漏洞,在应用程序反序列化 yaml 格式的 Keras 模型上执行任意代码。

通常,反序列化漏洞容易发生在应用程序从不真实的源读取格式或恶意数据之时,此时 TensorFlow 中的反序列化漏洞,可能导致 DoS 崩溃或拒绝。

更糟糕的,此漏洞甚至可以执行任意代码。

以上,就为什么“yaml.unsafe_load()” 函数漏洞的 CVSS 得分高达 9.3 分(满分10 分),且“臭名昭著”的原因。

众所周知,“unsafe_load” 函数反序列化 YAML 数据的相当宽松,并可以解析所有标记,包括已知不受信任的标记。

这意味着在理想情况下,unsafe_load 应该只在没有任何恶意内容的可信源输入上调用。

否则,攻击者则可以利用反序列化机制,通过将恶意负载注入到尚未序列化的 YAML 数据中,以执行想要执行的代码。

一项关于漏洞概念脆弱性的 PoC 示例,证实了这一:从 tensorflow.keras 导入模型有效载荷 = ''' !!python/object/new:type args:['z', !!python/tuple [], {'extend': !!python/name:exec }] listitems:"__import__('os').system('cat /etc/passwd')" ''' models.model_from_yaml(payload)正因为如此,在研究人员通知 Google 该漏洞后,TensorFlow 的维护人员决定完全放弃 YAML的使用,转而使用 JSON 反序列化。

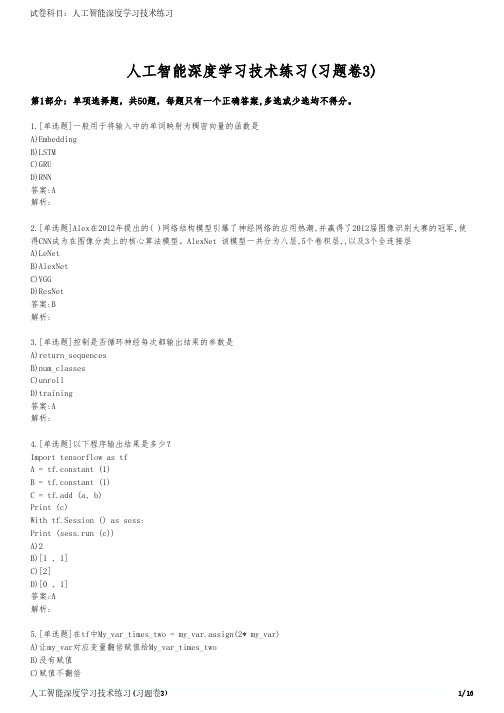

人工智能深度学习技术练习(习题卷3)

人工智能深度学习技术练习(习题卷3)第1部分:单项选择题,共50题,每题只有一个正确答案,多选或少选均不得分。

1.[单选题]一般用于将输入中的单词映射为稠密向量的函数是A)EmbeddingB)LSTMC)GRUD)RNN答案:A解析:2.[单选题]Alex在2012年提出的( )网络结构模型引爆了神经网络的应用热潮,并赢得了2012届图像识别大赛的冠军,使得CNN成为在图像分类上的核心算法模型。

AlexNet 该模型一共分为八层,5个卷积层,,以及3个全连接层A)LeNetB)AlexNetC)VGGD)ResNet答案:B解析:3.[单选题]控制是否循环神经每次都输出结果的参数是A)return_sequencesB)num_classesC)unrollD)training答案:A解析:4.[单选题]以下程序输出结果是多少?Import tensorflow as tfA = tf.constant (1)B = tf.constant (1)C = tf.add (a, b)Print (c)With tf.Session () as sess:Print (sess.run (c))A)2B)[1 , 1]C)[2]D)[0 , 1]答案:A解析:5.[单选题]在tf中My_var_times_two = my_var.assign(2* my_var)A)让my_var对应变量翻倍赋值给My_var_times_twoD)my_var对应变量翻倍答案:D解析:6.[单选题]( )是指在一个操作系统中多个程序同时并行运行A)超线程B)多线程C)虚拟化D)多任务答案:D解析:多任务是指在一个操作系统中多个程序同时并行运行7.[单选题]多层神经网络中使用全连接层的目的是?A)滤波B)One-hot处理C)用于特征提取D)用于分类答案:D解析:8.[单选题]面向对象编程类使用哪个保留字定义()。

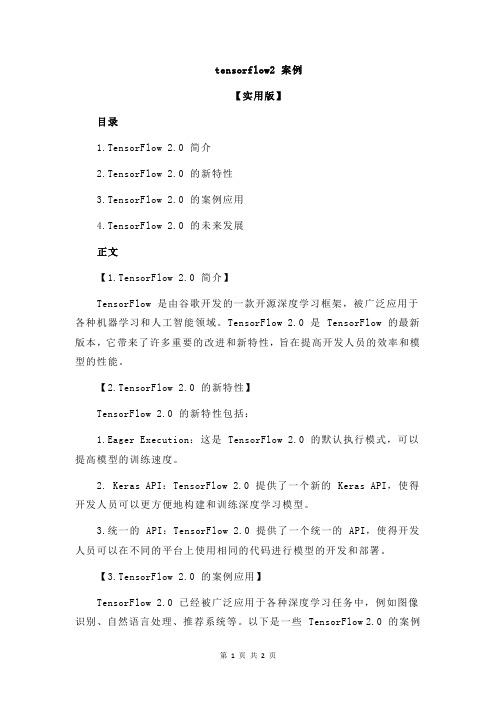

tensorflow2 案例

tensorflow2 案例【实用版】目录1.TensorFlow2.0 简介2.TensorFlow 2.0 的新特性3.TensorFlow 2.0 的案例应用4.TensorFlow 2.0 的未来发展正文【1.TensorFlow 2.0 简介】TensorFlow 是由谷歌开发的一款开源深度学习框架,被广泛应用于各种机器学习和人工智能领域。

TensorFlow 2.0 是 TensorFlow 的最新版本,它带来了许多重要的改进和新特性,旨在提高开发人员的效率和模型的性能。

【2.TensorFlow 2.0 的新特性】TensorFlow 2.0 的新特性包括:1.Eager Execution:这是 TensorFlow2.0 的默认执行模式,可以提高模型的训练速度。

2. Keras API:TensorFlow 2.0 提供了一个新的 Keras API,使得开发人员可以更方便地构建和训练深度学习模型。

3.统一的 API:TensorFlow 2.0 提供了一个统一的 API,使得开发人员可以在不同的平台上使用相同的代码进行模型的开发和部署。

【3.TensorFlow 2.0 的案例应用】TensorFlow 2.0 已经被广泛应用于各种深度学习任务中,例如图像识别、自然语言处理、推荐系统等。

以下是一些 TensorFlow 2.0 的案例应用:1.图像识别:使用 TensorFlow2.0,开发人员可以轻松地构建和训练卷积神经网络(CNN)模型,进行图像识别任务。

2.自然语言处理:TensorFlow 2.0 提供了一系列的自然语言处理工具,例如 Embedding、RNN、LSTM 等,可以进行文本分类、机器翻译等任务。

3.推荐系统:TensorFlow 2.0 可以用于构建和训练推荐系统的模型,例如基于深度学习的协同过滤模型。

【4.TensorFlow 2.0 的未来发展】TensorFlow 2.0 的发布,标志着 TensorFlow 的发展进入了一个新的阶段。

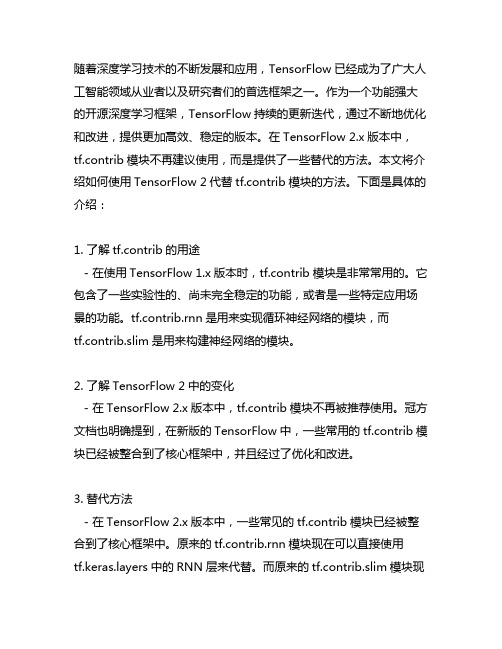

tensorflow2 代替contrib的方法

随着深度学习技术的不断发展和应用,TensorFlow已经成为了广大人工智能领域从业者以及研究者们的首选框架之一。

作为一个功能强大的开源深度学习框架,TensorFlow持续的更新迭代,通过不断地优化和改进,提供更加高效、稳定的版本。

在TensorFlow 2.x版本中,tf.contrib模块不再建议使用,而是提供了一些替代的方法。

本文将介绍如何使用TensorFlow 2代替tf.contrib模块的方法。

下面是具体的介绍:1. 了解tf.contrib的用途- 在使用TensorFlow 1.x版本时,tf.contrib模块是非常常用的。

它包含了一些实验性的、尚未完全稳定的功能,或者是一些特定应用场景的功能。

tf.contrib.rnn是用来实现循环神经网络的模块,而tf.contrib.slim是用来构建神经网络的模块。

2. 了解TensorFlow 2中的变化- 在TensorFlow 2.x版本中,tf.contrib模块不再被推荐使用。

冠方文档也明确提到,在新版的TensorFlow中,一些常用的tf.contrib模块已经被整合到了核心框架中,并且经过了优化和改进。

3. 替代方法- 在TensorFlow 2.x版本中,一些常见的tf.contrib模块已经被整合到了核心框架中。

原来的tf.contrib.rnn模块现在可以直接使用yers中的RNN层来代替。

而原来的tf.contrib.slim模块现在可以使用tf.keras.models中的模型构建方法来代替。

另外,还有一些功能被整合到了其他模块中,比如tf.math模块包含了一些在tf.contrib模块中常见的数学计算功能。

4. 迁移代码- 对于迁移已有代码的情况,需要根据实际情况来选择合适的替代方法。

一般来说,冠方文档中对应的替代方法会有详细的说明和示例。

在迁移代码时,需要注意一些参数和接口的变化,以及可能需要调整的部分。

TF家族三代值得摘抄的句子

TF家族三代值得摘抄的句子一、介绍TF家族是指自从2015年Google发布开源深度学习库TensorFlow以来,其不断演进和发展的三代产品。

每一代的TensorFlow都有其独特的特点和优势,为深度学习领域的研究和应用提供了强大的支持。

本文将会对TF家族三代值得摘抄的句子进行探讨,带领读者了解每一代TensorFlow的特点和突出之处。

二、TensorFlow 1.x1. TensorFlow 1.x的背景与优势•TensorFlow 1.x是第一代的TensorFlow,于2015年发布,其目标是构建一个灵活且可扩展的机器学习平台。

•TensorFlow 1.x采用静态图的计算模型,将计算图定义和执行分离,可以对图进行优化和并行计算。

•TensorFlow 1.x支持多种硬件设备(CPU、GPU等)和平台(Windows、MacOS、Linux等),使得运行环境更加灵活多样。

2. TensorFlow 1.x的特点和亮点(1) 强大的计算图•TensorFlow 1.x将计算过程表示为一个有向无环图,称为计算图。

这使得TensorFlow 1.x能够自动进行优化,提高计算效率。

•可以通过TensorBoard可视化计算图,从而更好地理解模型的结构和计算流程。

(2) 动态计算•TensorFlow 1.x中引入了tf.placeholder和tf.Variable等可变操作符,使得计算图具有更大的灵活性。

•可以在计算图的运行时动态地传递数据,并对变量进行更新,为更复杂的模型提供了可能。

(3) 强大的工具支持•TensorFlow 1.x提供了一系列用于辅助开发和调试的工具,例如TensorBoard和tfdbg等。

•TensorBoard可以可视化模型的训练曲线、计算图等信息,有助于分析和优化模型。

•tfdbg是一个交互式调试器,可以帮助开发者定位和解决模型中的问题。

3. TensorFlow 1.x值得摘抄的句子1.“TensorFlow 1.x将计算过程表示为一个有向无环图,这样可以提高计算效率和并行计算能力。

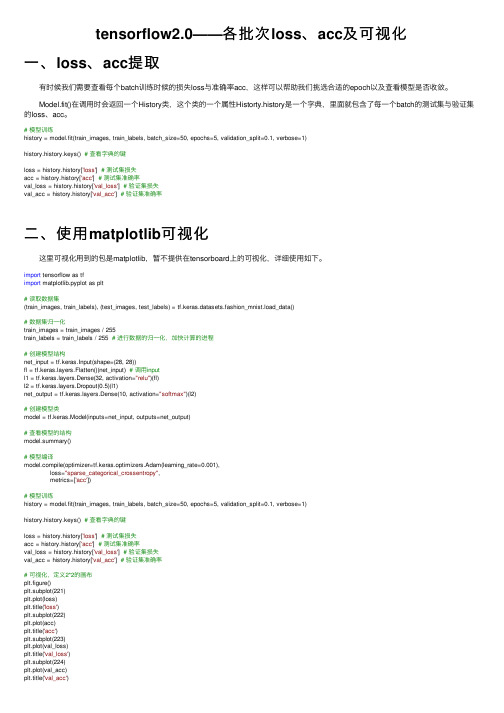

tensorflow2.0——各批次loss、acc及可视化

tensorflow2.0——各批次loss、acc及可视化⼀、loss、acc提取 有时候我们需要查看每个batch训练时候的损失loss与准确率acc,这样可以帮助我们挑选合适的epoch以及查看模型是否收敛。

Model.fit()在调⽤时会返回⼀个History类,这个类的⼀个属性Historty.history是⼀个字典,⾥⾯就包含了每⼀个batch的测试集与验证集的loss、acc。

# 模型训练history = model.fit(train_images, train_labels, batch_size=50, epochs=5, validation_split=0.1, verbose=1)history.history.keys() # 查看字典的键loss = history.history['loss'] # 测试集损失acc = history.history['acc'] # 测试集准确率val_loss = history.history['val_loss'] # 验证集损失val_acc = history.history['val_acc'] # 验证集准确率⼆、使⽤matplotlib可视化 这⾥可视化⽤到的包是matplotlib,暂不提供在tensorboard上的可视化,详细使⽤如下。

import tensorflow as tfimport matplotlib.pyplot as plt# 读取数据集(train_images, train_labels), (test_images, test_labels) = tf.keras.datasets.fashion_mnist.load_data()# 数据集归⼀化train_images = train_images / 255train_labels = train_labels / 255 # 进⾏数据的归⼀化,加快计算的进程# 创建模型结构net_input = tf.keras.Input(shape=(28, 28))fl = yers.Flatten()(net_input) # 调⽤inputl1 = yers.Dense(32, activation="relu")(fl)l2 = yers.Dropout(0.5)(l1)net_output = yers.Dense(10, activation="softmax")(l2)# 创建模型类model = tf.keras.Model(inputs=net_input, outputs=net_output)# 查看模型的结构model.summary()# 模型编译pile(optimizer=tf.keras.optimizers.Adam(learning_rate=0.001),loss="sparse_categorical_crossentropy",metrics=['acc'])# 模型训练history = model.fit(train_images, train_labels, batch_size=50, epochs=5, validation_split=0.1, verbose=1)history.history.keys() # 查看字典的键loss = history.history['loss'] # 测试集损失acc = history.history['acc'] # 测试集准确率val_loss = history.history['val_loss'] # 验证集损失val_acc = history.history['val_acc'] # 验证集准确率# 可视化,定义2*2的画布plt.figure()plt.subplot(221)plt.plot(loss)plt.title('loss')plt.subplot(222)plt.plot(acc)plt.title('acc')plt.subplot(223)plt.plot(val_loss)plt.title('val_loss')plt.subplot(224)plt.plot(val_acc)plt.title('val_acc')plt.show()输出结果:。

【TensorFlow2.0】以后我们再也离不开Keras了?

【TensorFlow2.0】以后我们再也离不开Keras了?TensorFlow2.0 Alpha版已经发布,在2.0中最重要的API或者说到处都出现的API是谁,那无疑是Keras。

因此用过2.0的人都会吐槽全世界都是Keras。

今天我们就来说说Keras这个高级API。

作者 | 汤兴旺编辑 | 汤兴旺1 Keras概述在TensorFlow2.0中,Keras是一个用于构建和训练深度学习模型的高阶API。

因此如果你正在使用TensorFow2.0,那么使用Keras 构建深度学习模型是您的不二选择。

在Keras API中总共有如下三大块:在Modules中有构建训练模型各种必备的组件,如激活函数activations、损失函数losses、优化器optimizers等;在Class中有Sequential和Model两个类,它们用来堆叠模型;在Functions中有Input()函数,它用来实例化张量。

因此若您使用的深度学习框架是TensorFlow,而且是2.0版本,那么你就不可能不使用tensorflow.keras。

这也就是使用过TensorFlow2.0版本的都在吐槽全世界都是Keras的原因。

2 Modules通过上面的介绍,我们知道在Modules中有activations、losses、optimizers等构建训练模型时各种必备的组件。

下图就是Modules中有所的模块。

下面我们详细说说里面最常见的几个模块应该如何使用。

1. 常用的数据集(datasets)在TensorFlow2.0中,常用的数据集需要使用tf.keras.datasets 来加载,在datasets中有如下数据集。

对于上图中的数据集我们可以像下面这样加载(train_images,train_labels),(test_images,test_labels)= keras.datasets.fashion_mnist.load_data()当然我们平时使用的数据集肯定不在于此,这些数据集都是些最基础的数据集。

tensorflow原理

tensorflow原理TensorFlow 是一个开源的机器学习框架,广泛用于构建和训练各种机器学习模型。

它的核心原理是基于计算图的方式进行模型的构建和运算。

在 TensorFlow 中,计算和数据流动都以图的形式表达。

图由节点和边组成,每个节点代表一个操作,边代表操作之间的数据依赖关系。

这种图的表示方式使得 TensorFlow 能够高效地对复杂的计算任务进行分布式并行计算。

通过将大型计算任务分解为多个小的计算单元,TensorFlow 可以有效地利用多个CPU 或 GPU 进行计算,提高计算效率。

TensorFlow 运行时,首先需要构建计算图。

计算图可以通过TensorFlow 的 API 来定义,包括变量的定义、操作的定义以及数据的输入等。

然后,创建一个会话(Session)来执行计算图。

在会话中,可以根据需要运行特定的操作,以获取相应的结果。

由于计算图的惰性执行特性,只有在运行操作时,TensorFlow 才会根据依赖关系逐一执行所需的计算操作。

TensorFlow 支持自动求导机制,可以根据定义的计算图自动计算变量的梯度。

这对于训练机器学习模型非常有用,因为我们可以通过梯度下降等优化算法来调整模型参数,使得模型在训练数据上的误差不断减小。

通过反向传播算法,TensorFlow 可以根据目标函数对模型参数进行求导,得到每个参数的梯度,从而优化模型。

此外,TensorFlow 还提供了丰富的高级 API,如 Keras、Estimator 等,使机器学习模型的构建更加简单和便捷。

这些API提供了各种预定义的模型、层和优化算法,可以大大简化模型的构建过程,提高开发效率。

总结来说,TensorFlow 是一个强大的机器学习框架,它基于计算图的方式进行模型的构建和运算。

通过高效的分布式并行计算和自动求导机制,TensorFlow 可以快速构建和训练各种复杂的机器学习模型。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

TensorFlow 2.0 将包含许多API 变更

TensorFlow 2.0 将包含许多API 变更,例如,对参数进行重新排序、重新命名符号和更改参数的默认值。

手动执行所有这些变更不仅枯燥乏味,而且容易出错。

为简化变更过程并让您尽可能顺畅地过渡到TensorFlow 2.0,TensorFlow 工程团队创建了实用程序tf_upgrade_v2,可帮助您将旧代码转换至新API。

传送门:

tf_upgrade_v2:https://github/tensorflow/docs/blob/master/site/en/r2/guide/upgrade.md

使用pip 安装 TensorFlow 2.0 时,系统会自动添加tf_upgrade_v2 实用程序。

该程序可将现有的TensorFlow 1.13 Python 脚本转换为TensorFlow 2.0,以帮助加快您的升级过程。

我们已尝试自动化处理尽可能多的升级任务,但脚本仍无法处理一些句法和风格方面的变更。

某些API 符号可能无法仅使用字符串替代方案简单升级。

为确保TensorFlow 2.0 仍支持您的代码,升级脚本加入了compat.v1 模块。

此模块将以等效的tfpat.v1.foo 引用代替表单tf.foo 的调用。

不过,建议您手动检查此类替代方案,并尽快将其迁移至tf.* 命名空间(代替tfpat.v1.* 命名空间)中的新API。

此外,由于我们弃用了某些模块(例如tf.flags 和tf.contrib),您将无法通过切换至compat.v1 来实现TensorFlow 2.0 中的某些变更。

升级使用这些模块的代码可能需要额外使用一个库(如absl.flags)或切换至tensorflow/addons 中的软件包。

传送门:

tensorflow/addons:

https://github/tensorflow/addons

如果您想尝试将模型从TensorFlow 1.12 升级至TensorFlow 2.0,请按照下方说明执行操作:

首先,安装tf-nightly-2.0-preview / tf-nightly-gpu-2.0-preview。

注意:使用pip 安装。