基于Bootstrapping的文本分类模型

基于Boosting算法的文本自动分类器设计

第2 7卷 第Βιβλιοθήκη 2期 20 0 7年 2月

文 章 编 号 :0 1 9 8 ( 07 0 0 8 0 10 — 0 1 2 0 )2— 3 4— 3

计 算 机应 用

Co u e p l ai n mp tr A pi t s c o

分类器有很好的分类精度。 关键 词 : 文本 分类 ; 器学 习 ;osn 法 机 B t g算 i 中图分类 号 : P 1 文 献标 识码 : T3 1 A

De in fa t e tc t g rz to l si e a e n Bo si lo ih sg o u o t x a e o ia in ca sf r b s d o o tng ag rt m i

DONG L - o g , GE u - u HO n - u n ‘ eh n NG G o h a ,Z U Mi g q a

( . oeeo nom t nSi c n ehooy N r w s U i rt ’nS a ni 10 9 C i ; 1 C lg frai c nead Tcnl , o h et nv sy l fI o e g t e i, 口 ha x 7 0 6 , hn a 2 o eefI o ainSi e n eh l y B in om l nvr y B rn 0 8 5 C i ) .C lg n r t c n d Tcno , e gN r a i s , eig107 , hn l o fm o e a c o g U e i t a

近邻分类 、 回归模型 、 策树 、 决 推导 规则 、 贝叶斯 分类 、 经 网 神 络、 支持 向量机 以及相 关反馈 。组合 分类 器方法 是近年 来流 行 的一种 分类 方法 , 将多个 分类器 的判定 结果合并 为一 它是 个分类器 的方法 。即 : 对于需要专家介入 的任务 , 个 独立 的 s 专家 的 判 断 经 过 适 当 归 并 ,比单 个 人 作 出 的判 断 要 好。

文本分类模型

文本分类模型

数

本文旨在探究深度学习技术在文本分类中的应用,讨论其模型优势及潜在风险。

文本分类是自然语言处理领域中的重要任务,它能够有效将可变长度的文本文档和段

落编组成不同的类别,实现自动批量归类,是一项重要的计算机技术。

传统的文本分类算

法使用手工提取的特征来体现文档的内容,但是,这些算法容易受到特征提取的结果,效

果也很难满足实际应用的要求,这是由于现有的手工特征提取方法对于不同的文档类别难

以统一定义。

深度学习是机器学习技术,利用深层网络架构来挖掘大量复杂的数据表征表示,为文

本分类提供了一个新的思路。

深度学习的模型假定每个文本文档可以表示为一个不断迭代

的低纬度表示,这种自学习的分类器比传统分类器更好。

深度学习模型通过抽取文档本身

的语义特征和词汇表示来预测文档所属类别,而且不需要进行手工特征提取,可以节省大

量时间和精力。

此外,深度学习模型具有良好的灵活性,可以保证训练过程对干扰处理、

偏置抑制和处理稀疏文本数据的有效性。

很显然,深度学习应用在文本分类中的模型优势是显而易见的,但也存在一定的风险。

由于深度学习模型的训练和维护成本高,需要大量的数据和计算资源,容易导致训练过程

的过度拟合,即准确率偏低,从而影响模型的总体性能。

另外,训练过程中受到语料库中

数据不平衡的影响,易产生人为偏差,并浪费大量时间。

本文从理论层面分析了深度学习技术在文本分类中的应用,重点介绍了其模型优势及

潜在风险。

建议在未来的应用中,针对深度学习模型的结构进行适当的改进和优化,有助

于提升模型的稳定性,从而达到实现较高准确度和效率的目的。

P15_基于Bootstrapping的文本分类模型

中 文 信 息 学 报第19卷第2期 JOURNA L OF CHINESE INFOR MATION PR OCESSING V ol119N o12文章编号:1003-0077(2005)02-0086-07基于Bootstrapping的文本分类模型①陈文亮,朱慕华,朱靖波,姚天顺(东北大学自然语言处理实验室,辽宁沈阳 110004)摘要:本文提出一种基于Bootstrapping的文本分类模型,该模型采用最大熵模型作为分类器,从少量的种子集出发,自动学习更多的文本作为新的种子样本,这样不断学习来提高最大熵分类器的文本分类性能。

文中提出一个权重因子来调整新的种子样本在分类器训练过程中的权重。

实验结果表明,在相同的手工训练语料的条件下,与传统的文本分类模型相比这种基于Bootstrapping的文本分类模型具有明显优势,仅使用每类100篇种子训练集,分类结果的F1值为70156%,比传统模型高出4170%。

该模型通过使用适当的权重因子可以更好改善分类器的训练效果。

关键词:计算机应用;中文信息处理;文本分类;最大熵模型;权重因子中图分类号:TP391 文献标识码:ASemi2Supervised T ext C ategorization Using BootstrappingCHE N Wen2liang,ZH U Mu2hua,ZH U Jing2bo,Y AO T ian2shun(Natural Language Processing Lab,N ortheastern University,Shenyang,Liaoning110004,China)Abstract:This paper proposes a semi2supervised text categ orization using bootstrapping.The System uses the Maximum En2 tropy M odel as the text classifier.It learns m ore automatic labeled samples as new seed training samples from unlabeled sam2 ples using a small size of seed training samples.In this paper,we use a weighted factor to adjust the weight of new seed samples during the following training process.The experimental results show that the proposed system performs better than the conventional system with the same labeled documents.And it yields70156%F1using only1002labeled documents for each categ ory,417%over the conventional system does.And it can provide the same performance as the conventional sys2 tem using50%or less training samples.The results als o show that the weighted factor can improve the performance.key w ords:computer application;Chinese in formation processing;text categ orization;maximum entropy;weight factor1 引言文本分类问题一直是自然语言处理领域的一个重要课题。

基于Bootstrapping的本体标注方法

VO . 6 13

・

计

算

机

工

程

21 0 0年 1 2月

De e b r2 0 cu e g ne rn m t rEn i e i g

软 件技 术与 数据 库 ・

文 章编号: 0 482l) —08—0 1 0 2 ( o2 0 3 0 —3 o 3 5

Ont l g no a i n M e h d Ba e n B0 t t a p ng o o y An t to t o sd o 0sr p i

IUo u GAo , W ANG J n, Qi Yi

( l g fCo p t r S in e Co l e o m u e ce c ,Ch n q n e o g i g Uni e s t vri y,Ch n i g 4 0 3 o gq n 0 0 0,Ch n ) ia

p e e sa n w n o ain meho r snt e a n tto t dwhih i a e n B o srp i ga d r ls On oo y s o l e p r e o g neae t er l i s n o i c sb sd o o tta p n n u e. t lg h ud b as d t e r t h u efl ,a d d man e

d c m e t h u d b it r d b e t c a sfe . S v r l l o s u i g B o s r p i g t nn t t nd e t a t i f r t n n e n o o y a e o u n s s o l e f e e y t x l s iir l e e a o p sn o t t a p n o a o a e a x r c n o ma i a d i f r o t l g r on ma e k d,S o d a o a i n r s l c n b c i v d b e s r i i g do u n s Ex e i nt h w h tt e me h d wih h g e o niin r t O a g o nn t to e u t a e a h e e y a f w t a n n c me t . p rme ss o t a h t o t i h r c g t a e o i f e tv . S e f c ie

一种基于Bootstrapping构建训练语料的方法

algorithm. A small subset is selected randomly ,t he wr ng ann tations are corrected ,and a seed set is o o

generated. T his seed set trains one clas 一 s based language model,and then this model ann tate the rest o s corpus . 0 ther small subsets are selected fr m the rest c rpus . T his proce sing is iterated until t he quantity o o s of t raining corpus is optimizat ion . This method can minimize the human eff rt while keeping t he quality of o the annotation reas nably go d f r stat ist ical language m del . o o o o

计算机研究与发展

Jo r al of Cbn1Puter Re u n a e s rch and Develo ment P

IS N 1000一 S 1239l CN l l 一 1777/ TP 44(Suppl. ) : 394 一397 , 2007

ห้องสมุดไป่ตู้

一种基于Bootstrapping 构建习练语料的方法 1 1

一个 完整 的训 练语料.

1

类语言模型

基于类 的语言模型可 以较好地识别命 名实

基于Bootstrap法的模型评估

基于Bootstrap法的模型评估在机器学习领域中,模型评估是非常重要的一项任务。

通过评估模型的性能,我们可以了解其在真实数据上的表现,并作出相应的改进。

而Bootstrap法作为一种常用的统计学方法,可以有效地对模型进行评估和验证。

本文将介绍Bootstrap法在模型评估中的应用,并分析其优势和局限性。

Bootstrap法是由Bradley Efron于1979年提出的一种统计学方法。

其基本思想是通过对原始数据进行有放回抽样,生成若干个新样本,并利用这些新样本进行统计推断。

在模型评估中,我们可以利用Bootstrap法来生成多个训练集和测试集,从而对模型进行多次训练和测试,并得到更为准确和稳定的性能指标。

首先,我们来介绍一下Bootstrap法在训练集生成方面的应用。

传统机器学习算法通常将原始数据集划分为训练集和测试集两部分,在训练集上训练模型,在测试集上验证性能。

然而,在实际应用中,数据往往是有限且宝贵的资源。

通过Bootstrap法可以从原始数据中有放回地抽取样本生成多个新样本,在这些新样本上进行训练,从而充分利用原始数据的信息,提高模型的训练效果。

其次,Bootstrap法在测试集生成方面也有其独特的优势。

在传统的模型评估中,通常只有一个测试集用于评估模型的性能。

然而,由于测试集的选择可能存在偶然性和不确定性,所得到的评估结果可能不够稳定和可靠。

通过Bootstrap法生成多个测试集,并对模型在这些测试集上进行评估,可以得到更为准确和稳定的性能指标。

此外,Bootstrap法还可以用于对模型进行参数调优。

传统的参数调优方法通常是通过网格搜索等方式,在给定参数范围内进行搜索,并选择最优参数组合。

然而,在实际应用中,最优参数组合可能存在一定偶然性。

通过Bootstrap法可以生成多个训练集和测试集,在这些数据上对不同参数组合进行训练和评估,并选择平均性能最好的参数组合作为最终结果。

虽然Bootstrap法在模型评估中有诸多优势,但也存在一些局限性。

使用机器学习技术进行文本分类的模型选择

使用机器学习技术进行文本分类的模型选择近年来,随着大数据时代的到来,文本数据的规模和复杂度不断增加,如何高效地处理文本数据成为了一个重要的挑战。

在处理文本数据时,文本分类是一个常见的任务,它可以帮助我们将大量的文本数据按照预先定义的类别进行分类和归类,从而为后续的分析和应用提供支持。

为了解决文本分类问题,机器学习技术被广泛应用。

机器学习算法可以通过对大量标记好的文本数据进行学习和训练,从而构建出一个可以自动分类新文本的模型。

然而,在选择适合的机器学习模型时,我们需要考虑多个因素,如精度、性能、可解释性等。

在进行文本分类任务时,我们需要考虑以下几个常见的机器学习模型选择:1. 朴素贝叶斯:朴素贝叶斯分类器是一种基于概率模型的机器学习方法。

它假设特征之间相互独立,能够高效地处理高维数据,尤其适用于文本分类任务。

朴素贝叶斯分类器的优点是简单快速,且对小规模数据表现良好。

然而,它的模型假设可能与实际情况不符,导致分类结果不够准确。

2. 支持向量机(SVM):SVM是一种非常强大的机器学习模型,它通过构建一个超平面来实现分类。

SVM在处理文本分类任务时可以灵活地选择不同的核函数,以适应不同的数据结构。

它在处理高维稀疏数据时表现出色,适用于处理大规模文本数据。

然而,SVM对参数的选择比较敏感,需要进行仔细调参,且在处理大规模数据时需要较长的训练时间。

3. 决策树:决策树是一种常见的机器学习模型,它通过构建一系列的决策规则来进行分类。

决策树的优点是易于理解和解释,可以用图形化的方式展示分类过程。

同时,决策树对缺失值和异常值有较好的容错能力。

但是,决策树容易过拟合,需要进行剪枝策略来提高模型的泛化能力。

4. 集成学习:集成学习通过将多个基本的分类器集成起来,从而提高整体的分类性能。

常见的集成学习方法包括随机森林和梯度提升树。

随机森林通过随机选择特征和样本进行训练,得到多个决策树模型,最终通过投票或平均的方式进行分类。

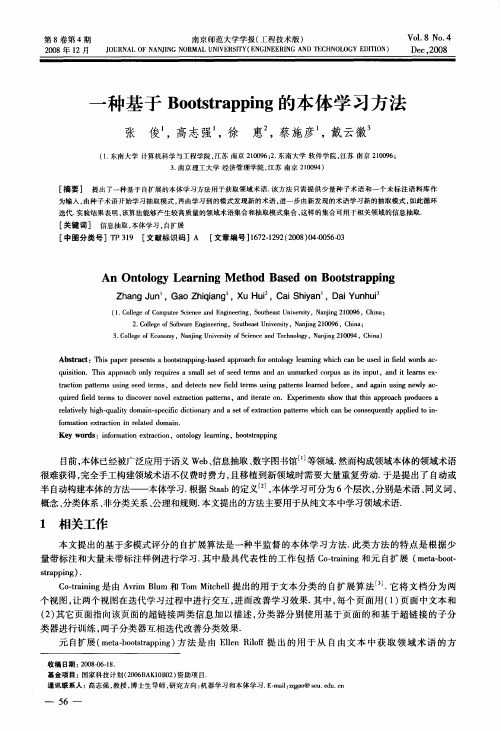

一种基于Bootstrapping的本体学习方法

( . ol eo o u r c neadE g er g S u es U i rt, aj g20 9 ,C ia 1 C lg f mpt i c n ni ei , ot at nv sy N ni 10 6 hn ; e C eSe n n h ei n 2 C l g f ow r n ne n , otes nvrt, aj g 10 6 hn ; . ol eo f aeE g er g Suhat i s y N ni 0 9 ,C ia e St i i U ei n2

Vo. . 18 No 4 De ,0 8 c2 0

一

种基于 B os a pn ot rp ig的本体学 习方法 t

张 俊 高 志 , , 徐 惠 , 蔡施彦 戴云徽 ,

(. 1东南大学 计算机科学与工程学院, 江苏 南京 2 0 9 ;. 10 6 2 东南大学 软件学院 , 江苏 南京 20 9 10 6; 3 南京理工大学 经济管理学 院, . 江苏 南京 2 0 9 ) 10 4

第 8卷第 4期 20 0 8年 l 2月

南京师范大学学报 ( 工程技术 版) JU N LO A J GN R A NV R I ( N IE RN N E H O O YE IIN O R A FN NI O M LU IE S Y E GN E IGA DT C N L G DTO ) N T

目前 , 体 已经被广泛应用 于语 义 we、 本 1 信息抽取 、 图书馆 … 等领 域. ) 数字 然而构成领域 本体 的领域术 语 很难 获得 , 完全手工 构建领域术语不仅 费时 费力 , 移植 到新领 域时需 要大 量重 复劳动 . 且 于是提 出 了 自动 或 半 自动构建本体 的方 法— — 本体学习. 根据 S a t b的定义 , a 本体学 习可分为 6个层次 , 是术语 、 分别 同义词 、 概念 、 分类体 系 、 非分类 关系 、 公理和规则. 本文提 出的方 法主要用 于从纯 文本 中学 习领域术语 .

文本分类中常见的机器学习模型及使用方法

文本分类中常见的机器学习模型及使用方法在文本分类问题中,机器学习模型扮演着重要的角色。

这些模型通过学习从已标记的文本数据中提取特征,并根据这些特征将文本分为不同的类别。

在本文中,我们将介绍一些常见的机器学习模型及其使用方法。

1. 朴素贝叶斯分类器(Naive Bayes Classifier)朴素贝叶斯分类器是一种基于贝叶斯定理的概率模型,常用于文本分类任务。

该模型假设文本的特征之间相互独立,从而简化了计算和学习过程。

通常使用词袋模型将文本表示为特征向量,然后使用贝叶斯定理计算给定类别的条件概率,最后选择具有最大概率的类别作为分类结果。

2. 支持向量机(Support Vector Machines,SVM)支持向量机是一种基于统计学习理论的二分类模型,在文本分类中也能得到良好的应用。

SVM通过寻找最佳的超平面将数据分割为不同的类别。

在文本分类中,首先需要将文本表示为特征向量,然后使用SVM模型进行训练和分类。

SVM模型通过最大化两个类别之间的间隔来找到最佳分类边界。

3. 逻辑回归(Logistic Regression)逻辑回归是一种广泛应用于文本分类问题的线性模型,主要用于二分类任务。

逻辑回归通过将特征与权重相乘,并使用sigmoid函数对结果进行映射,从而得到一个概率值。

通常,将概率大于0.5的文本分为正类,概率小于0.5的文本分为负类。

4. 随机森林(Random Forest)随机森林是一种基于决策树的集成学习方法,在文本分类中也有广泛应用。

随机森林通过构建多个决策树,并通过投票的方式来选择最终的分类结果。

在文本分类中,首先需要将文本转化为特征向量,然后使用随机森林模型进行训练和分类。

5. 卷积神经网络(Convolutional Neural Networks,CNN)卷积神经网络是一种深度学习模型,在文本分类中也表现出了强大的能力。

CNN通过多层卷积和池化操作来提取文本中的局部特征,并将这些特征传递给全连接层进行分类。

基于Bootstrapping技术的领域本体概念自动获取方法[发明专利]

![基于Bootstrapping技术的领域本体概念自动获取方法[发明专利]](https://img.taocdn.com/s3/m/f646d86aa0116c175e0e4886.png)

专利名称:基于Bootstrapping技术的领域本体概念自动获取方法

专利类型:发明专利

发明人:杜军平,杨月华,李雪

申请号:CN201210118233.2

申请日:20120420

公开号:CN102622341A

公开日:

20120801

专利内容由知识产权出版社提供

摘要:为了实现领域概念的自动获取,本发明提出了一种基于Bootstrapping技术的领域本体概念自动获取方法。

首先为了解决无法提取复合形式领域概念的问题,本文基于互信息和左、右信息熵提取了复合词语;然后基于共现句频的候选概念判定条件从中提取出候选领域概念;之后应用M评价和T评价结合的方法对候选概念进行评价,将其中符合评价标准的领域概念提取出来,并将评价值较高的领域概念选作重要概念进行新一轮的学习过程;为了避免遗漏出现频率较低、语义相似的领域概念,本方法引入了语义因素,通过计算语义相似度提取出语义相似的领域概念;最后给出了详细的算法实现流程。

申请人:北京邮电大学

地址:100876 北京市海淀区西土城路10号

国籍:CN

更多信息请下载全文后查看。

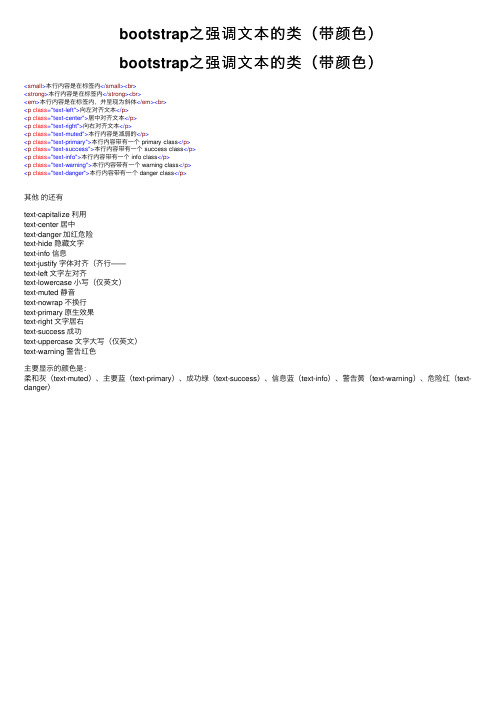

bootstrap之强调文本的类(带颜色)

bootstrap之强调⽂本的类(带颜⾊)bootstrap之强调⽂本的类(带颜⾊)<small>本⾏内容是在标签内</small><br><strong>本⾏内容是在标签内</strong><br><em>本⾏内容是在标签内,并呈现为斜体</em><br><p class="text-left">向左对齐⽂本</p><p class="text-center">居中对齐⽂本</p><p class="text-right">向右对齐⽂本</p><p class="text-muted">本⾏内容是减弱的</p><p class="text-primary">本⾏内容带有⼀个 primary class</p><p class="text-success">本⾏内容带有⼀个 success class</p><p class="text-info">本⾏内容带有⼀个 info class</p><p class="text-warning">本⾏内容带有⼀个 warning class</p><p class="text-danger">本⾏内容带有⼀个 danger class</p>其他的还有text-capitalize 利⽤text-center 居中text-danger 加红危险text-hide 隐藏⽂字text-info 信息text-justify 字体对齐(齐⾏——text-left ⽂字左对齐text-lowercase ⼩写(仅英⽂)text-muted 静⾳text-nowrap 不换⾏text-primary 原⽣效果text-right ⽂字居右text-success 成功text-uppercase ⽂字⼤写(仅英⽂)text-warning 警告红⾊主要显⽰的颜⾊是:柔和灰(text-muted)、主要蓝(text-primary)、成功绿(text-success)、信息蓝(text-info)、警告黄(text-warning)、危险红(text-danger)。

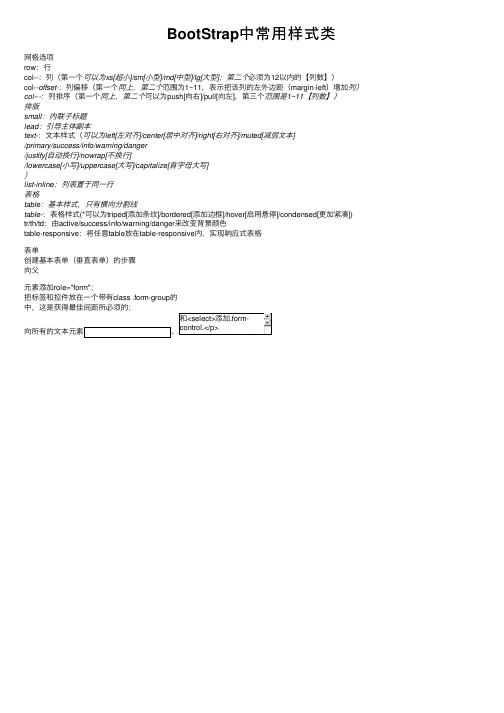

BootStrap中常用样式类

BootStrap中常⽤样式类⽹格选项row:⾏col--:列(第⼀个可以为xs[超⼩]/sm[⼩型]/md[中型]/lg[⼤型];第⼆个必须为12以内的【列数】)col--offset-:列偏移(第⼀个同上,第⼆个范围为1~11,表⽰把该列的左外边距(margin-left)增加列)col---:列排序(第⼀个同上,第⼆个可以为push[向右]/pull[向左],第三个范围是1~11【列数】)排版small:内联⼦标题lead:引导主体副本text-:⽂本样式(可以为left[左对齐]/center[居中对齐]/right[右对齐]/muted[减弱⽂本]/primary/success/info/warning/danger/justify[⾃动换⾏]/nowrap[不换⾏]/lowercase[⼩写]/uppercase[⼤写]/capitalize[⾸字母⼤写])list-inline:列表置于同⼀⾏表格table:基本样式,只有横向分割线table-:表格样式(*可以为triped[添加条纹]/bordered[添加边框]/hover[启⽤悬停]/condensed[更加紧凑])tr/th/td:由active/success/info/warning/danger来改变背景颜⾊table-responsive:将任意table放在table-responsive内,实现响应式表格表单创建基本表单(垂直表单)的步骤向⽗元素添加role="form";把标签和控件放在⼀个带有class .form-group的中,这是获得最佳间距所必须的;<br>向⽗<form>元素添加class .form-horizontal;<br>把标签和控件放在⼀个带有class .form-group的<div>中;<br>向标签添加class .control-label<br>常⽤的表单控件主要有:<br>input:声明type有text</p><p>按钮</p><p>图⽚</p><p>辅助类</p><p>字体图标</p><p>下拉菜单</p><p>按钮组</p><p>输⼊框组</p><p>导航元素</p><p>导航栏</p><p>⾯包屑导航</p><p>分页</p><p>标签</p><p>徽章</p><p>超⼤屏幕</p><p>页⾯标题</p><p>缩略图</p><p>警告</p><p>进度条</p><p>多媒体对象</p><p>列表组</p><p>⾯板</p>。

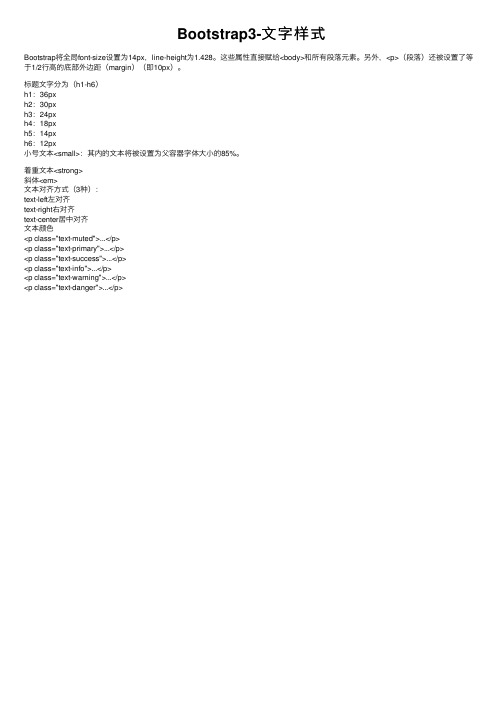

Bootstrap3-文字样式

Bootstrap3-文 字 样ቤተ መጻሕፍቲ ባይዱ式

Bootstrap将全局font-size设置为14px,line-height为1.428。这些属性直接赋给<body>和所有段落元素。另外,<p>(段落)还被设置了等 于1/2行高的底部外边距(margin)(即10px)。

标题文字分为(h1-h6) h1:36px h2:30px h3:24px h4:18px h5:14px h6:12px 小号文本<small>:其内的文本将被设置为父容器字体大小的85%。

着重文本<strong> 斜体<em> 文本对齐方式(3种): text-left左对齐 text-right右对齐 text-center居中对齐 文本颜色 <p class="text-muted">...</p> <p class="text-primary">...</p> <p class="text-success">...</p> <p class="text-info">...</p> <p class="text-warning">...</p> <p class="text-danger">...</p>

基于机器学习的文本分类器设计

基于机器学习的文本分类器设计文本分类器是一种将文本按照预先定义的类别进行自动归类的工具。

它在信息检索、情感分析、垃圾邮件过滤等领域发挥着重要作用。

基于机器学习的文本分类器设计使用机器学习算法来构建分类器模型,它能够学习文本的语义和特征,并将文本分配到合适的类别中。

在进行基于机器学习的文本分类器设计之前,需要明确以下几个步骤:1. 数据收集和处理:收集包含各个类别文本的数据集,并进行预处理,包括去除噪声数据、进行词干提取或词形还原、去除停用词等。

2. 特征提取:从文本中提取特征用于训练分类器。

常用的特征提取方法包括词袋模型、TF-IDF(词频-逆文档频率)和词嵌入(word embedding)等。

3. 选择和训练模型:选择适合的机器学习算法来训练分类器模型。

常用的算法包括朴素贝叶斯、支持向量机、随机森林和深度学习方法等。

通过将预处理的文本数据和提取的特征输入到选定的算法中进行训练,得到分类器模型。

4. 模型评估和优化:使用评估指标(如准确率、召回率和F1分数)来评估分类器模型的性能。

如果性能不够理想,可以尝试不同的特征提取方法、调整模型参数或尝试其他算法来优化模型。

5. 应用部署:将训练好的文本分类器模型应用到实际问题中。

对于新的文本数据,使用训练好的模型进行预测,并将其归类到相应的类别中。

基于机器学习的文本分类器设计是一个迭代过程,需要不断地尝试和改进。

下面,将介绍几种常用的机器学习方法来设计文本分类器。

1. 朴素贝叶斯分类器:朴素贝叶斯分类器是一种基于贝叶斯定理和特征条件独立性假设的统计分类器。

它在文本分类中常用于垃圾邮件过滤和情感分析等任务。

朴素贝叶斯分类器假设文本的特征之间是相互独立的,通过计算给定类别的条件概率来进行分类。

2. 支持向量机(SVM):支持向量机是一种常用的监督学习算法,可用于二分类和多分类问题。

SVM通过在特征空间中找到一个最优超平面,将不同类别的样本点分隔开。

在文本分类中,可以将文本表示为向量,并使用SVM进行分类。

飞桨层次文本分类

飞桨层次文本分类

飞桨层次文本分类是一种基于深度学习的文本分类方法,可以有效地处理大规模的文本数据。

该方法采用层次结构来组织文本数据,将每个文本分解成多个层次,每个层次都包含一些特征。

通过对每个层次进行分类,可以得到最终的文本分类结果。

具体来说,飞桨层次文本分类方法包含以下步骤:

1. 数据预处理:对文本数据进行清洗、分词等处理,将文本数

据转换成计算机可以处理的数字形式。

2. 特征提取:通过将每个文本分解成多个层次,提取每个层次

的特征,包括词汇、句法、语义等。

3. 层次分类:通过对每个层次进行分类,得到每个层次的分类

结果,然后将不同层次的分类结果进行组合,得到最终的文本分类结果。

飞桨层次文本分类方法具有以下优点:

1. 可以处理大规模的文本数据,适用于互联网、金融、医疗等

领域。

2. 采用层次结构来组织文本数据,可以更好地利用文本的结构

信息。

3. 可以同时考虑不同层次的特征,提高文本分类的准确率。

总的来说,飞桨层次文本分类是一种高效、灵活、准确的文本分类方法,可以帮助企业和研究者更好地处理和分析大规模的文本数据。

- 1 -。

文本分类模型 相似度模型

文本分类模型相似度模型

文本分类模型和相似度模型是两种不同的机器学习模型,它们在处理文本数据时有着不同的应用和目标。

文本分类模型的主要目标是识别和分类文本数据。

这种模型通过学习大量文本数据的模式和特征,将新的文本数据自动归类到已知的类别中。

例如,垃圾邮件分类器可以将一封电子邮件自动标记为垃圾邮件或非垃圾邮件。

文本分类模型通常使用基于规则的方法、决策树、支持向量机(SVM)、朴素贝叶斯、深度学习等算法进行训练和预测。

相似度模型的主要目标是衡量不同文本之间的相似度或相关性。

这种模型通常用于信息检索、推荐系统、语义分析等领域。

相似度模型通过比较不同文本之间的语义相似度,找出相似的文本或与特定文本相关的其他文本。

相似度模型可以使用基于规则的方法、余弦相似度、Jaccard相似度、编辑距离等算法进行计算。

总之,文本分类模型主要关注文本的分类和识别,而相似度模型则更注重衡量不同文本之间的相似度和关系。

在实际应用中,这两种模型可以结合使用,以实现更复杂的文本处理和分析任务。

基于Bootstrapping的文本分类模型

基于Bootstrapping的文本分类模型陈文亮;朱慕华;朱靖波;姚天顺【期刊名称】《中文信息学报》【年(卷),期】2005(019)002【摘要】本文提出一种基于Bootstrapping的文本分类模型,该模型采用最大熵模型作为分类器,从少量的种子集出发,自动学习更多的文本作为新的种子样本,这样不断学习来提高最大熵分类器的文本分类性能.文中提出一个权重因子来调整新的种子样本在分类器训练过程中的权重.实验结果表明,在相同的手工训练语料的条件下,与传统的文本分类模型相比这种基于Bootstrapping的文本分类模型具有明显优势,仅使用每类100篇种子训练集,分类结果的F1值为70.56%,比传统模型高出4.70%.该模型通过使用适当的权重因子可以更好改善分类器的训练效果.【总页数】7页(P86-92)【作者】陈文亮;朱慕华;朱靖波;姚天顺【作者单位】东北大学,自然语言处理实验室,辽宁,沈阳,110004;东北大学,自然语言处理实验室,辽宁,沈阳,110004;东北大学,自然语言处理实验室,辽宁,沈阳,110004;东北大学,自然语言处理实验室,辽宁,沈阳,110004【正文语种】中文【中图分类】TP391【相关文献】1.基于分层Attention机制的Bi-GRU中文文本分类模型 [J], 胡玉兰;赵青杉;牛永洁;陈莉2.基于改进ERNIE-DPCNN模型的中文文本分类 [J], 牛玉婷;陈伯琪;陈彬3.基于BERT-TextCNN模型的临床试验筛选短文本分类方法 [J], 杨飞洪;王序文;李姣4.基于GRW和FastText模型的电信用户投诉文本分类应用 [J], 赵进;杨小军5.基于LSTM-Attention与CNN混合模型的文本分类方法 [J], 滕金保;孔韦韦;田乔鑫;王照乾因版权原因,仅展示原文概要,查看原文内容请购买。

一种基于Bootstrapping构建训练语料的方法

一种基于Bootstrapping构建训练语料的方法

尹继豪;樊孝忠;刘士宁;于江德

【期刊名称】《计算机研究与发展》

【年(卷),期】2007(044)0z2

【摘要】提出一种基于Bootstrapping算法构建训练语料的方法.该方法从自动标注的语料中随机选取部分语料,人工修正后生成种子集,用该种子集训练一个基于类的语言模型,然后使用该模型自动标注剩余的语料;再从剩余语料中选取部分语料进行以上处理,如此循环直到训练语料标注质量理想.实验结果表明,该方法在保证训练语料标注质量理想的情况下,能够大幅度地减少人工参与.

【总页数】4页(P394-397)

【作者】尹继豪;樊孝忠;刘士宁;于江德

【作者单位】北京理工大学计算机科学技术学院,北京,100081;北京理工大学计算机科学技术学院,北京,100081;青岛市国土资源和房屋管理局,青岛,266002;北京理工大学计算机科学技术学院,北京,100081;安阳师范学院计算机科学系,安

阳,455000

【正文语种】中文

【中图分类】TP391

【相关文献】

1.一种基于Bootstrapping的本体学习方法 [J], 张俊;高志强;徐惠;蔡施彦;戴云徽

2.一种用未分析语料训练文法的方法 [J], 王挺;史晓东;陈火旺;杨谊

3.一种网络多模态语料库构建方法 [J], 张晓

4.一种网络多模态语料库构建方法 [J], 张晓[1]

5.一种面向Web的英汉平行语料库的构建方法 [J], 徐润华;王东波

因版权原因,仅展示原文概要,查看原文内容请购买。

用Boosting方法组合增强Stumps进行文本分类

用Boosting方法组合增强Stumps进行文本分类刁力力;胡可云;陆玉昌;石纯一【期刊名称】《软件学报》【年(卷),期】2002(013)008【摘要】Stumps, classification trees with only one split at the root node, have been shown by Schapire and Singer to be an effective method for text categorization when embedded in a boosting algorithm as its base classifiers. In their experiments, the splitting point (the partition) of each stump is decided by whether a certain term appears or not in a text document, which is too weak to obtain satisfied accuracy even after they are combined by boosting, and therefore the iteration times needed by boosting is sharply increased as an indicator of low efficiency. To improve these base classifiers, an idea is proposed in this paper to decide the splitting point of each stump by all the terms of a text document. Specifically, it employs the numerical relationship between the similarities of the VSM-vector of text document and the representational VSM-vector of each class as the partition criteria of the base classifiers. Meanwhile, to further facilitate its convergence, the boosting weights assigned to sample documents are introduced to the computation of representational VSM-vectors for possible classes dynamically. Experimental results show that the algorithm is both more efficient for training and more effective than its predecessor for fulfilling text categorization tasks. This trend seems moreconspicuous along with the incensement of problem scale.%为提高文本分类的精度,Schapire和Singer尝试了一个用Boosting来组合仅有一个划分的简单决策树(Stumps)的方法.其基学习器的划分是由某个特定词项是否在待分类文档中出现决定的.这样的基学习器明显太弱,造成最后组合成的Boosting分类器精度不够理想,而且需要的迭代次数很大,因而效率很低.针对这个问题,提出由文档中所有词项来决定基学习器划分以增强基学习器分类能力的方法.它把以VSM表示的文档与类代表向量之间的相似度和某特定阈值的大小关系作为基学习器划分的标准.同时,为提高算法的收敛速度,在类代表向量的计算过程中动态引入Boosting分配给各学习样本的权重.实验结果表明,这种方法提高了用Boosting组合Stump分类器进行文本分类的性能(精度和效率),而且问题规模越大,效果越明显.【总页数】7页(P1361-1367)【作者】刁力力;胡可云;陆玉昌;石纯一【作者单位】清华大学,计算机科学与技术系,北京,100084;清华大学,智能技术与系统国家重点实验室,北京,100084;清华大学,计算机科学与技术系,北京,100084;清华大学,智能技术与系统国家重点实验室,北京,100084;清华大学,计算机科学与技术系,北京,100084;清华大学,智能技术与系统国家重点实验室,北京,100084;清华大学,计算机科学与技术系,北京,100084;清华大学,智能技术与系统国家重点实验室,北京,100084【正文语种】中文【中图分类】TP181【相关文献】1.多文本分类器组合方法 [J], 申建国;王舵;王玮2.基于Adaboost框架下自动编码器提升方法的文本分类 [J], 刘广秀;宋单单3.基于Boost和信任函数的多文本分类器组合模型 [J], 王爱华;张铭;杨冬青;唐世渭4.结合旋转森林和AdaBoost分类器的多标签文本分类方法 [J], Han Dong;Wang Chunhua;Xiao Min5.增强领域特征的电力审计文本分类方法 [J], 陈平;匡尧;胡景懿;王向阳;蔡静因版权原因,仅展示原文概要,查看原文内容请购买。

基于BootStrapping的集成分类器的中文观点句识别方法

基于BootStrapping的集成分类器的中文观点句识别方法吕云云;李旸;王素格

【期刊名称】《中文信息学报》

【年(卷),期】2013(27)5

【摘要】领域相关的大规模和高质量的标注训练数据是分类器性能的重要保证,而标注训练语料是一件费时费力的工作.该文提出了一种采用小规模标注语料识别中文观点句的方法.首先采用Bootstrapping方法扩展训练语料,分别训练贝叶斯、支持向量机和最大熵分类器.最后,通过给三个训练好的分类器赋权获得一个集成分类器.实验结果表明,集成后的分类器性能优于单分类器,并且该方法在使用部分标注训练数据的情况下也能取得与采用全部标注训练数据相近的实验结果.

【总页数】9页(P84-92)

【作者】吕云云;李旸;王素格

【作者单位】山西大学计算机与信息技术学院,山西太原030006;山西大学计算机与信息技术学院,山西太原030006;山西大学计算机与信息技术学院,山西太原030006 ;山西大学计算智能与中文信息处理教育部重点实验室,山西太原030006【正文语种】中文

【中图分类】TP391

【相关文献】

1.基于新词扩充和特征选择的微博观点句识别方法 [J], 赵洁;温润

2.基于共现词的中文微博观点句识别 [J], 郑诚;张吉赓;杨希

3.基于词项共现关系图模型的中文观点句识别研究 [J], 王明文;付翠琴;徐凡;洪欢

4.基于语言模型的中文话头自足句识别方法 [J], 张禹尧;蒋玉茹;毛腾;张仰森

5.基于语义模式的半监督中文观点句识别研究 [J], 刘荣;郝晓燕;李颖

因版权原因,仅展示原文概要,查看原文内容请购买。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

中 文 信 息 学 报第19卷第2期 JOURNA L OF CHINESE INFOR MATION PR OCESSING V ol119N o12文章编号:1003-0077(2005)02-0086-07基于Bootstrapping的文本分类模型①陈文亮,朱慕华,朱靖波,姚天顺(东北大学自然语言处理实验室,辽宁沈阳 110004)摘要:本文提出一种基于Bootstrapping的文本分类模型,该模型采用最大熵模型作为分类器,从少量的种子集出发,自动学习更多的文本作为新的种子样本,这样不断学习来提高最大熵分类器的文本分类性能。

文中提出一个权重因子来调整新的种子样本在分类器训练过程中的权重。

实验结果表明,在相同的手工训练语料的条件下,与传统的文本分类模型相比这种基于Bootstrapping的文本分类模型具有明显优势,仅使用每类100篇种子训练集,分类结果的F1值为70156%,比传统模型高出4170%。

该模型通过使用适当的权重因子可以更好改善分类器的训练效果。

关键词:计算机应用;中文信息处理;文本分类;最大熵模型;权重因子中图分类号:TP391 文献标识码:ASemi2Supervised T ext C ategorization Using BootstrappingCHE N Wen2liang,ZH U Mu2hua,ZH U Jing2bo,Y AO T ian2shun(Natural Language Processing Lab,N ortheastern University,Shenyang,Liaoning110004,China)Abstract:This paper proposes a semi2supervised text categ orization using bootstrapping.The System uses the Maximum En2 tropy M odel as the text classifier.I t learns m ore automatic labeled sam ples as new seed training sam ples from unlabeled sam2 ples using a small size of seed training sam ples.In this paper,we use a weighted factor to adjust the weight of new seed sam ples during the following training process.The experimental results show that the proposed system per forms better than the conventional system with the same labeled documents.And it yields70156%F1using only1002labeled documents for each categ ory,417%over the conventional system does.And it can provide the same per formance as the conventional sys2 tem using50%or less training sam ples.The results als o show that the weighted factor can im prove the per formance.key w ords:com puter application;Chinese in formation processing;text categ orization;maximum entropy;weight factor1 引言文本分类问题一直是自然语言处理领域的一个重要课题。

近年来,国内外研究人员对文本分类问题进行深入研究,他们采用很多不同方法来构造分类器,例如:K NN、na ve Bayes、Maxi2 mum Entropy、S VM、R occhio、Decision T ree、NNet、LLSF等等,这些分类系统都需要大量的标注语料才能达到较好的分类性能[1~4]。

同时,随着互联网的发展,大规模的无标注文档越来越容易获得。

近年来,有很多研究者开始研究如何用无标注的语料来提高小标注训练集的训练效果。

Nigam提出用E M方法从未标注语料和小标注语料训练分类器,其中,E M是一种最大似然估计①收稿日期:2004-06-15基金资助:国家自然科学基金和微软亚洲研究院联合资助项目(60260319);教育部科学技术研究重点资助项目(104065);国家自然科学基金资助项目(6047140)作者简介:陈文亮(1977—),男,博士生,研究方向为文本分类和机器学习.的迭代方法[5]。

Blum和Mitchell提出用C o2training方法[6]来解决用于网页分类的手工标注语料训练不足的问题,构造两个不同的分类器来进行标注学习。

本文采用一种基于bootstrapping的学习方法,采用最大熵作为分类器,从少量的种子集出发,自动学习新的种子样本,通过不断学习,来提高最大熵分类器的文本分类性能。

Bootstrap2 ping[7]是一种被广泛应用于知识获取的机器学习技术,E llen Riloff用来构造信息抽取的知识库[8],David Y arowsky用来进行语义消歧[9]等。

一般首先给定种子集合,通过学习器来学习新的种子样本。

这样达到用少量的标注训练样本就可以达到传统方法的大标注训练集训练效果。

在学习过程中,新的种子样本必然存在一些误标注,这样对下一轮的训练学习会造成一些不利的影响,本文引入一个权重因子到最大熵模型的特征函数中实现初始种子集和新种子集较合理的组合。

实验表明,这种权重因子可以改善学习模型的训练效果,进而提高分类性能。

2 最大熵模型最大熵(Maximum Entropy2ME)模型已经成功用到了自然语言处理多个领域,如:文本分类、词性标注、名词实体识别等等。

本文将简介最大熵模型在文本分类中的应用,详细描述请参看文献[10,11]。

最大熵模型在给定约束的条件下,尽可能的使分布变得平均。

存在训练样本集T={(d1, c1)(d2,c2),…,(d N,c N)},其中d i是一个训练样本,c i是文档d i的类别。

在给定T和与之相关的约束条件下,存在一个唯一概率模型:该模型的熵达到最大值,概率模型的计算公式如下:PΛ(c|d)=1ZΛ(d)exp[6iλi f i(d,c)] 其中,Λ={λ1,λ2,…,λn}是模型的参数,f i(d,c)是给定的特征函数,Z(d)是一个归一化因子:Z(d)=6c exp(6iλi f i(d,c)) 这样,最大熵模型的求解可以通过下式:LΛ=6d,c p~(d,c)log p(c|d) 其中,p~(d,c)是经验概率分布,求解过程可以通过参数优化算法来完成。

本文实验中采用了Limited2Mem ory Variable Metric(一种牛顿迭代法)来求解Λ={λ1,λ2,…,λn}。

最大熵模型在实际应用时的关键问题是如何选取特征函数,根据不同的应用选择不同的特征函数。

3 B2ME模型本节构建一个基于Bootstrapping的文本分类自学习模型,该模型使用少量标注样本作为种子集,首先用种子集作为训练集来训练文本分类器,然后利用分类器对未标注文本进行类别标注,从中选取部分文本作为新种子样本加入训练集中,再重复训练标注,直到结束。

这样就实现利用少量种子集加上大量未标注语料学习出一个较好的文本分类器。

本文选用最大熵模型作为分类器,最大熵模型可以给出文档属于某个类别的概率。

本文把这种基于Bootstrapping和最大熵模型(ME)的文本分类自学习模型称为B2ME模型。

在本文中,训练集D={L,U},其中L表示标注好的种子集,U表示大规模的无标注文本集。

表1表示B2ME模型的整个学习过程,其中n=|U|k,而|U|是U的文档数,k是迭代的轮数。

在学习过程中,包含3个重要的步骤:1)训练分类器:训练最大熵模型分类器;2)无标注语料的标注:利用训练好的最大熵模型分类器对语料U分类;3)新种子样本选取:从步骤2)中的标注结果选取部分文本,提供给下轮次学习使用。

算法1 B2ME模型的学习算法输入:L-少量带标注种子集;U-大规模未标注文本集输出:训练好的最大熵模型分类器步骤: 用L来训练最大熵分类器ME L′=< 迭代k轮 ■ 使用当前最大熵分类器标注U得到L U ■ 选取置信度最高的n个文本,并加到L′;U=U-L′ ■ 使用L∪L′来训练最大熵分类器311 训练分类器:f w,c′(d,c)=0c≠c′tf(w,d) c=c′ 其中,tf(w,d)是词w在文档d中出现的频数。

训练最大熵模型分为两种情况:1)开始阶段:训练语料是种子集L(少量标注语料);2)学习过程中:训练语料是L和L′的并集,其中L′是自动学习的新种子集(获取方法见节313)。

312 无标注语料的标注使用当前训练好的最大熵模型分类器对语料U={d1,d2,…,d|U|}进行分类,得到每一文档d i的最大类别概率p i=max0≤j≤|C|(p(c j|d i)),本文称p i为该文档的分类置信度,这样得到U的标注结果为:L U={(d1,p1),(d2,p2),…,(d|U|,p|U|)}。

313 新种子样本选取新种子样本选取是从L U中选择部分文本作为新的种子样本提供给下一轮学习使用。

选取步骤:首先,根据文档分类置信度对L U进行排序;再选择前面n个文本作为新的种子样本加入到训练集中。

4 B2ME2β模型在B2ME模型中,新学习到的种子样本在加入训练集后,就不再区分手工标注的种子样本和自动标注的新种子样本。

但是新种子样本必然还存在一些错误,这样对分类器的下一轮训练会带来一些不利的影响。

因此,本文引入一个新的参数β(0≤β≤1)到特征函数中,来调整自动标注的新种子样本对训练模型的影响。

首先,定义一个δ表示权重因子:δ(d,c)=β d∈U 1 d∈L 把权重因子加入特征函数中:f w,c′(d,c)=0c≠c′δ(d,c)tf(w,d) c=c′ 本文把这时的最大熵模型称为ME2β模型。

在ME2β模型中,文档d产生的特征函数通过δ来调整权重。

基于Bootstrapping和ME2β模型的自学习模型被称为B2ME2β模型。