视频寻车代码

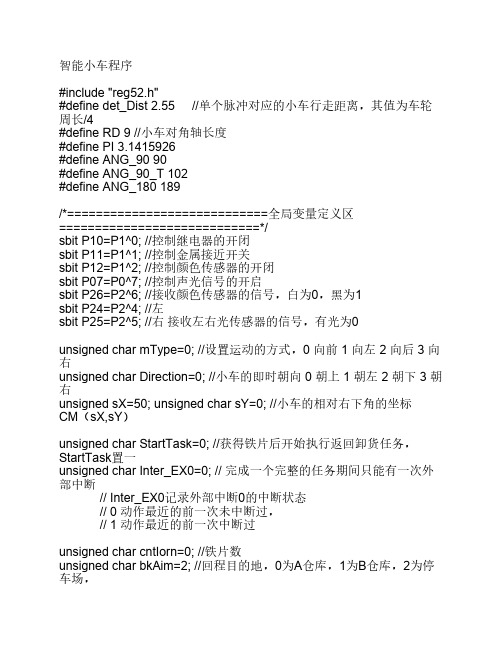

循迹小车程序代码

//(在MAIN中接受铁片颜色判断传感器的信号来赋值) unsigned char Light_Flag=0;//进入光引导区的标志(1) unsigned int cntTime_5Min=0;//时间周期数,用于 T0 精确定时 unsigned int cntTime_Plues=0; //霍尔开关产生的脉冲数 /*============================全局变量定义区 ============================*/ /*------------------------------------------------*/ /*-----------------通用延迟程序-------------------*/ /*------------------------------------------------*/ void delay(unsigned int time) { unsigned int i,j; for(j=0;j<time;j++) { for(i=0;i<60;i++) {;} } } /*-----------------------------------------------*/ /*-------------------显示控制模块----------------*/ /*-----------------------------------------------*/ /*数码管显示,显示铁片的数目(设接在P0,共阴)*/ void Display(unsigned char n) { char Numb[12]= {0x3F,0x06,0x5B,0x4F,0x66,0x6D,0x7D,0x07,0x7F,0x6F,0x37,0x77}; P0=Numb[n]; } // time*0.5ms延时

车辆识别行人检测的python代码

车辆识别行人检测的python代码以下是一个简单的使用OpenCV库进行车辆识别和行人检测的Python代码示例:```pythonimport cv2# 加载OpenCV的人脸和车辆检测器car_cascade = cv2.CascadeClassifier('haarcascade_car.xml') pedestrian_cascade =cv2.CascadeClassifier('haarcascade_pedestrian.xml')# 加载图像或视频image = cv2.imread('image.jpg')# 或者从摄像头读取# cap = cv2.VideoCapture(0)# 将图像转换为灰度图像gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)# 进行车辆检测cars = car_cascade.detectMultiScale(gray, 1.1, 5)for (x, y, w, h) in cars:cv2.rectangle(image, (x, y), (x+w, y+h), (0, 0, 255), 2)# 进行行人检测pedestrians = pedestrian_cascade.detectMultiScale(gray, 1.1, 5) for (x, y, w, h) in pedestrians:cv2.rectangle(image, (x, y), (x+w, y+h), (0, 255, 0), 2)# 显示结果cv2.imshow('Car and Pedestrian Detection', image)cv2.waitKey(0)cv2.destroyAllWindows()```要运行此代码,您需要将`haarcascade_car.xml`和`haarcascade_pedestrian.xml`文件下载到同一目录下。

智能循迹小车程序代码(4路)

void pwm_out_left_moto(void) //左电机调速,调节push_val_left的值改变

电机转速,占空比

{

if(Left_moto_stp)

{

if(pwm_val_left<=push_val_left)

pwm_val_right++;

pwm_out_left_moto();

pwm_out_right_moto();

}

/***************************************************/

void main(void)

{

TMOD=0X01;

}

void stop(void)

{

Right_moto_stop; //右电机停走

Left_moto_stop; //左电机停走

Delayms(3000);

run();

Delayms(100);

}

/*************************PWM调 制 电 机 转 速

TH0= 0XF8; //2ms定时

TL0= 0X30;

TR0= 1;

ET0= 1;

EA = 1;

while(1) /*无限循环*/

{

xunji(); }

}

P1_5接驱动模块ENB使能端输入PWM信号调节速度

P1_0 P1_1接IN1 IN2 当 P1_0=1,P1_1=0; 时左电机正转 驱动蓝色输出

端OUT1 OUT2接左电机

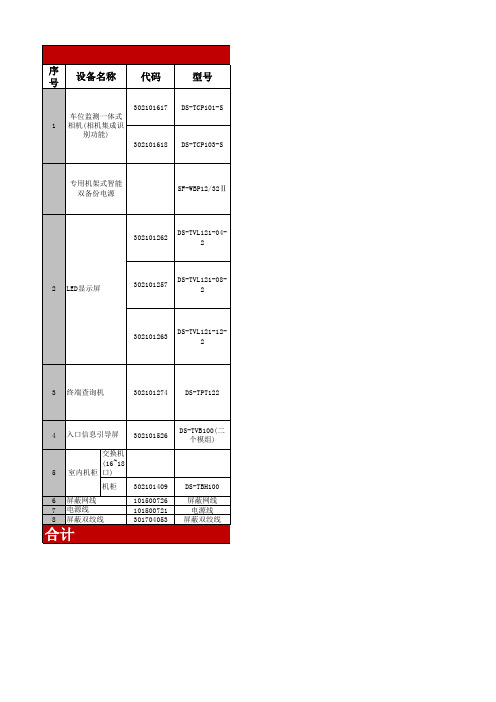

芜湖综合大楼视频反向寻车(无终端版)方案清单报价表

DS-TVL121-08-2

302101263

DS-TVL121-12-2

3

终端查询机

302101274

DS-TPT122

4

入口信息引导屏

302101526 DS-TVB100(二个模组)

交换机(16~18口) 5 6 7 8 室内机柜 机柜 302101409 101500726 101500721 301704053 DS-TBH100 屏蔽网线 电源线 屏蔽双绞线

芜湖大楼车位引导及反向寻

序 号 设备名称 代码

302101617 1 车位监测一体式 相机(相机集成识 别功能) 302101618 DS-TCP103-S

型号

DS-TCP101-S

专用机架式智能 双备份电源

SF-WBP12/32Ⅱ

302101262

DS-TVL121-04-2

2

LED显示屏

302101257

屏蔽芜湖大楼车位引导及反向寻车系统

详细参数 品牌

海康威视

单位

台

海康威视 2U机架式,带32个DC12V输出端口,总输出电流37.5A、 总输出功率450W,内置遇故障自动切换 的主、备双直流电源模块,每路输出具独立自恢复保护及指示灯。带可靠的防雷接地保护,具 有通风散热功能,带网管功能:网络集中管理软件能实时显示电源的输出电压、总负载电流和 内部温度,有主电源模块故障及各种超限报警、故障修复时间等报警记录,具有历史信息查询 下载功能。 工作电压:AC 220V;最大功耗:35.2W;显示方式:即显、左移、上移、上展开、下展开、动态箭 头六种显示方式;扫描场频:400Hz;扫描方式:1/16扫描A模式;屏体尺寸(含边框):735.5× 250.4×90;显示屏边框:黑色铝合金边框;字符显示:支持GB2312字符集,支持32×32点阵常用 汉字;显示颜色:红绿双色;发光点直径/间距:3.75/4.75;通讯方式:RS485;显示数字:可显示 当行,每行显示4个汉字,每个汉字点阵数:32×32;使用环境:温度-20℃~50℃、湿度<95%。 工作电压:AC 220V;最大功耗:48.4W;显示方式:即显、左移、上移、上展开、下展开、动态箭 头六种显示方式;扫描场频:400Hz;扫描方式:1/16扫描A模式;屏体尺寸(含边框):1342.4× 250.4×90;显示屏边框:黑色铝合金边框;字符显示:支持GB2312字符集,支持32×32点阵常用 汉字;显示颜色:红绿双色;发光点直径/间距:3.75/4.75;通讯方式:RS485;显示数字:可显示 当行,每行显示6个汉字,每个汉字点阵数:32×32;使用环境:温度-20℃~50℃、湿度<95%。 工作电压:AC 220V;最大功耗:77W;显示方式:即显、左移、上移、上展开、下展开、动态箭头 六种显示方式;扫描场频:400Hz;扫描方式:1/16扫描A模式;屏体尺寸(含边框):1703.1× 250.4×90;显示屏边框:黑色铝合金边框;字符显示:支持GB2312字符集,支持32×32点阵常用 汉字;显示颜色:红绿双色;发光点直径/间距:3.75/4.75;通讯方式:RS485;显示数字可显示 当行,每行显示10个汉字,每个汉字点阵数:32×32;使用环境:温度-20℃~50℃、湿度<95% 。 显示屏类型:22”AU液晶显示器;触摸屏:22”五线声波式触摸屏;CPU:Intel core E5700; 主板:Intel GA61H;内存:2GB/4GB DDR3 内存;硬盘:WD 320G SATA 接口硬盘;读卡器: (客户自提供);打印机:EPSON TM532热敏打印机(客户自提供);机柜:豪华金属烤漆机 柜;网口:1个RJ45端口;音频:LINE-out;USB:2个USB2.0端口;RESET:1个RESET端口;散 热系统:正压风扇、无噪音、防尘、循环散热;多媒体音响系统:双声道立体声电子音效,环 绕功效,防磁设计。

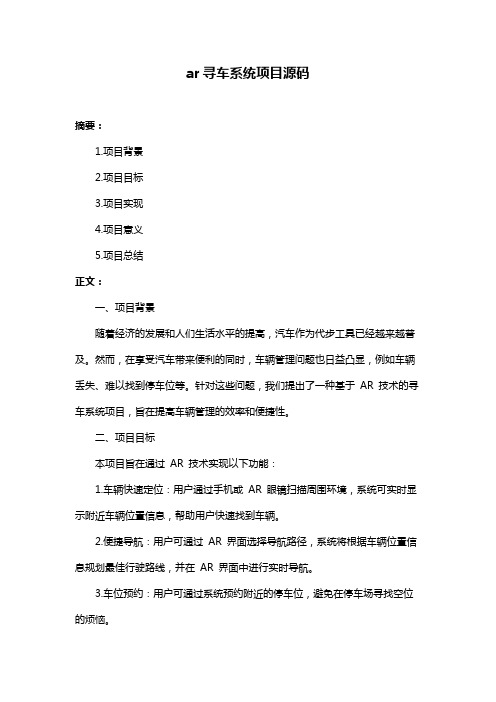

ar寻车系统项目源码

ar寻车系统项目源码摘要:1.项目背景2.项目目标3.项目实现4.项目意义5.项目总结正文:一、项目背景随着经济的发展和人们生活水平的提高,汽车作为代步工具已经越来越普及。

然而,在享受汽车带来便利的同时,车辆管理问题也日益凸显,例如车辆丢失、难以找到停车位等。

针对这些问题,我们提出了一种基于AR 技术的寻车系统项目,旨在提高车辆管理的效率和便捷性。

二、项目目标本项目旨在通过AR 技术实现以下功能:1.车辆快速定位:用户通过手机或AR 眼镜扫描周围环境,系统可实时显示附近车辆位置信息,帮助用户快速找到车辆。

2.便捷导航:用户可通过AR 界面选择导航路径,系统将根据车辆位置信息规划最佳行驶路线,并在AR 界面中进行实时导航。

3.车位预约:用户可通过系统预约附近的停车位,避免在停车场寻找空位的烦恼。

三、项目实现1.前期准备:项目团队首先对AR 技术进行了深入研究,并选择了适合本项目的硬件设备和软件平台。

同时,收集了大量车辆数据和停车场信息,为后续开发提供支持。

2.系统设计:项目团队设计了系统的整体架构,包括前端展示、数据处理和后端服务等模块。

并对各模块进行了详细设计,确保系统功能的实现和性能的优化。

3.系统开发:项目团队采用敏捷开发模式,分多个迭代进行开发。

在每个迭代中,团队成员分工合作,完成各自负责模块的开发,并进行集成测试。

4.系统调试与优化:在系统开发完成后,项目团队对系统进行了全面的测试和调试,以确保系统在各种场景下的稳定性和可用性。

同时,团队根据测试结果对系统进行了优化,提升了用户体验。

四、项目意义本项目的成功实施,对于解决当前车辆管理问题具有重要意义:1.提高车辆管理效率:通过AR 技术实现车辆快速定位、便捷导航等功能,帮助用户节省寻找车辆和行驶时间,提高管理效率。

2.提升用户体验:本系统采用AR 技术,为用户提供了直观、便捷的交互方式,提升了用户体验。

3.推动AR 技术发展:本项目对AR 技术在车辆管理领域的应用进行了深入探索,为AR 技术的发展提供了新的方向和场景。

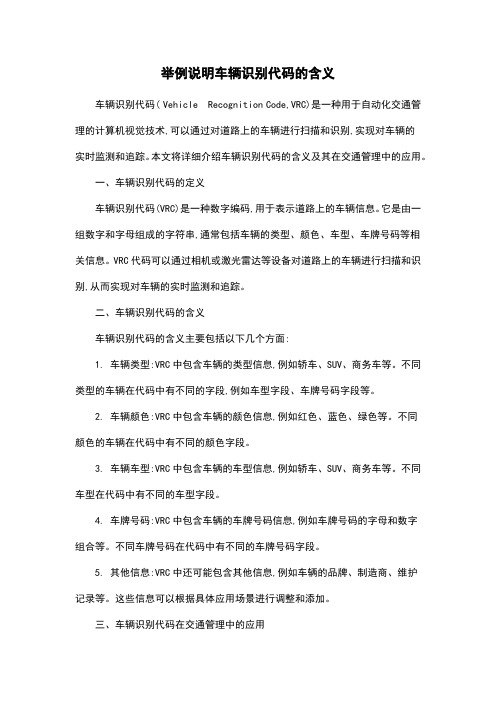

举例说明车辆识别代码的含义

举例说明车辆识别代码的含义车辆识别代码( Vehicle Recognition Code,VRC)是一种用于自动化交通管理的计算机视觉技术,可以通过对道路上的车辆进行扫描和识别,实现对车辆的实时监测和追踪。

本文将详细介绍车辆识别代码的含义及其在交通管理中的应用。

一、车辆识别代码的定义车辆识别代码(VRC)是一种数字编码,用于表示道路上的车辆信息。

它是由一组数字和字母组成的字符串,通常包括车辆的类型、颜色、车型、车牌号码等相关信息。

VRC代码可以通过相机或激光雷达等设备对道路上的车辆进行扫描和识别,从而实现对车辆的实时监测和追踪。

二、车辆识别代码的含义车辆识别代码的含义主要包括以下几个方面:1. 车辆类型:VRC中包含车辆的类型信息,例如轿车、SUV、商务车等。

不同类型的车辆在代码中有不同的字段,例如车型字段、车牌号码字段等。

2. 车辆颜色:VRC中包含车辆的颜色信息,例如红色、蓝色、绿色等。

不同颜色的车辆在代码中有不同的颜色字段。

3. 车辆车型:VRC中包含车辆的车型信息,例如轿车、SUV、商务车等。

不同车型在代码中有不同的车型字段。

4. 车牌号码:VRC中包含车辆的车牌号码信息,例如车牌号码的字母和数字组合等。

不同车牌号码在代码中有不同的车牌号码字段。

5. 其他信息:VRC中还可能包含其他信息,例如车辆的品牌、制造商、维护记录等。

这些信息可以根据具体应用场景进行调整和添加。

三、车辆识别代码在交通管理中的应用车辆识别代码在交通管理中的应用非常广泛,主要包括以下几个方面:1. 交通监控:车辆识别代码可以通过对道路上的车辆进行实时监测和追踪,实现对交通流量、拥堵情况等数据的实时监控和分析,为交通管理部门提供决策支持。

2. 车辆轨迹记录:车辆识别代码可以记录车辆行驶轨迹,包括时间、地点、速度等信息,为交通事故分析和车辆保养维护提供数据支持。

3. 交通流量预测:车辆识别代码可以通过对历史交通数据进行分析,预测未来一段时间内的交通流量和拥堵情况,为交通管理部门提供决策支持。

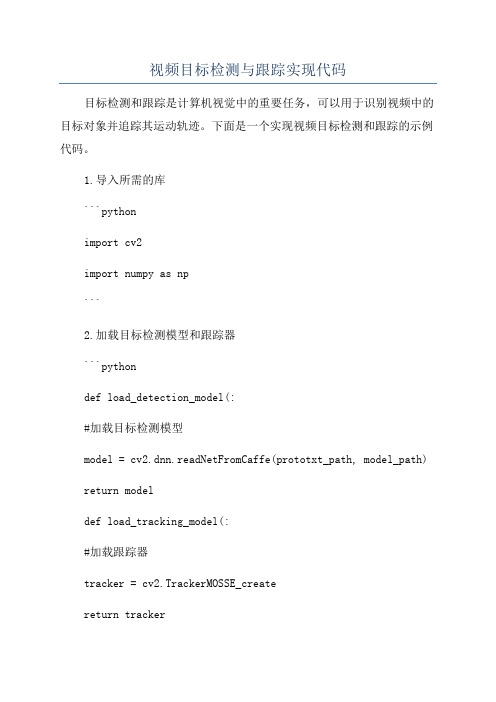

视频目标检测与跟踪实现代码

视频目标检测与跟踪实现代码目标检测和跟踪是计算机视觉中的重要任务,可以用于识别视频中的目标对象并追踪其运动轨迹。

下面是一个实现视频目标检测和跟踪的示例代码。

1.导入所需的库```pythonimport cv2import numpy as np```2.加载目标检测模型和跟踪器```pythondef load_detection_model(:#加载目标检测模型model = cv2.dnn.readNetFromCaffe(prototxt_path, model_path) return modeldef load_tracking_model(:#加载跟踪器tracker = cv2.TrackerMOSSE_createreturn tracker#检测模型的配置文件和权重文件路径prototxt_path = 'detection_model.prototxt'model_path = 'detection_model.caffemodel'```3.定义目标检测函数```pythondef detect_objects(frame, detection_model):# 将帧图像转换为 blob 形式# 将 blob 输入到模型中进行目标检测detection_model.setInput(blob)detections = detection_model.forward#解析检测结果num_detections = detections.shape[2]for i in range(num_detections):confidence = detections[0, 0, i, 2]if confidence > 0.5:class_id = int(detections[0, 0, i, 1])x1 = int(detections[0, 0, i, 3] * frame.shape[1]) y1 = int(detections[0, 0, i, 4] * frame.shape[0])x2 = int(detections[0, 0, i, 5] * frame.shape[1])y2 = int(detections[0, 0, i, 6] * frame.shape[0])cv2.rectangle(frame, (x1, y1), (x2, y2), (0, 255, 0), 2)label = f'Class: {class_id}, Confidence: {int(confidence * 100)}%'cv2.putText(frame, label, (x1, y1 - 10),cv2.FONT_HERSHEY_SIMPLEX, 0.9, (0, 255, 0), 2, cv2.LINE_AA) ```4.定义目标跟踪函数```pythondef track_objects(frame, bbox, tracker):#初始化跟踪器tracker.init(frame, bbox)while True:#读取下一帧图像success, frame = cap.readif not success:break#更新跟踪器success, bbox = tracker.update(frame)if success:#跟踪成功,绘制边界框x, y, w, h = [int(x) for x in bbox]cv2.rectangle(frame, (x, y), (x + w, y + h), (0, 255, 0), 2) else:#跟踪失败,输出失败消息cv2.putText(frame, "Tracking failure detected", (100,80), cv2.FONT_HERSHEY_SIMPLEX, 0.75, (0,0,255),2)#显示图像cv2.imshow("Tracking", frame)if cv2.waitKey(1) == ord('q'):break```5.主函数```pythonif __name__ == '__main__':#打开摄像头或视频文件cap = cv2.VideoCapture(0)#加载目标检测模型和跟踪器detection_model = load_detection_model tracker = load_tracking_modelwhile True:#读取下一帧图像success, frame = cap.readif not success:break#目标检测detect_objects(frame, detection_model) #显示图像cv2.imshow("Object Detection", frame) if cv2.waitKey(1) == ord('t'):#选择一个ROI来跟踪bbox = cv2.selectROI(frame, False)cv2.destroyAllWindows#开始目标跟踪track_objects(frame, bbox, tracker) break#释放资源cap.releasecv2.destroyAllWindows```这是一个简单的视频目标检测和跟踪实现的示例代码。

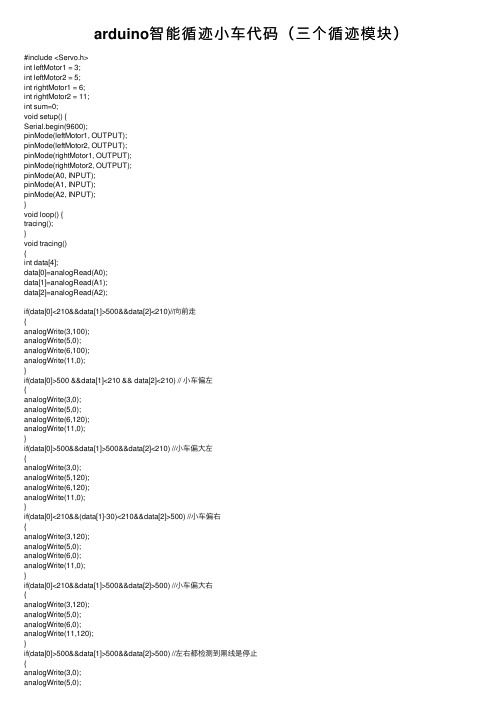

arduino智能循迹小车代码(三个循迹模块)

arduino智能循迹⼩车代码(三个循迹模块)#include <Servo.h>int leftMotor1 = 3;int leftMotor2 = 5;int rightMotor1 = 6;int rightMotor2 = 11;int sum=0;void setup() {Serial.begin(9600);pinMode(leftMotor1, OUTPUT);pinMode(leftMotor2, OUTPUT);pinMode(rightMotor1, OUTPUT);pinMode(rightMotor2, OUTPUT);pinMode(A0, INPUT);pinMode(A1, INPUT);pinMode(A2, INPUT);}void loop() {tracing();}void tracing(){int data[4];data[0]=analogRead(A0);data[1]=analogRead(A1);data[2]=analogRead(A2);if(data[0]<210&&data[1]>500&&data[2]<210)//向前⾛{analogWrite(3,100);analogWrite(5,0);analogWrite(6,100);analogWrite(11,0);}if(data[0]>500 &&data[1]<210 && data[2]<210) // ⼩车偏左{analogWrite(3,0);analogWrite(5,0);analogWrite(6,120);analogWrite(11,0);}if(data[0]>500&&data[1]>500&&data[2]<210) //⼩车偏⼤左{analogWrite(3,0);analogWrite(5,120);analogWrite(6,120);analogWrite(11,0);}if(data[0]<210&&(data[1]-30)<210&&data[2]>500) //⼩车偏右{analogWrite(3,120);analogWrite(5,0);analogWrite(6,0);analogWrite(11,0);}if(data[0]<210&&data[1]>500&&data[2]>500) //⼩车偏⼤右{analogWrite(3,120);analogWrite(5,0);analogWrite(6,0);analogWrite(11,120);}if(data[0]>500&&data[1]>500&&data[2]>500) //左右都检测到⿊线是停⽌{analogWrite(3,0);analogWrite(5,0);analogWrite(6,0); analogWrite(11,0);}Serial.print(data[0]); Serial.print("---"); Serial.print(data[1]-30); Serial.print("---"); Serial.print(data[2]); Serial.print("---"); Serial.println(data[3]); }。

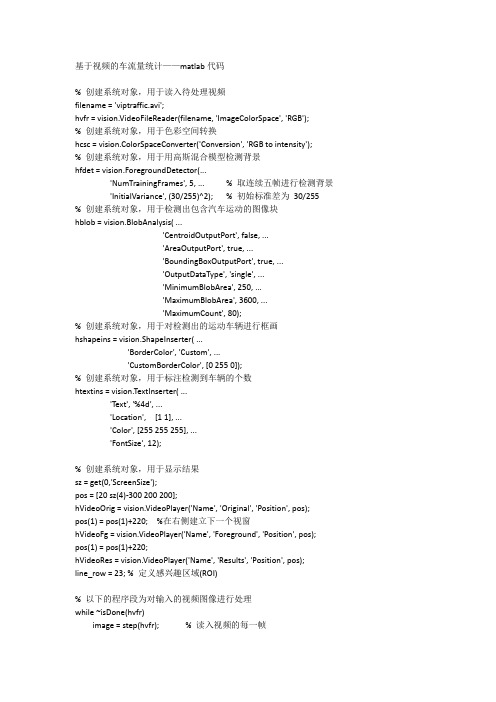

基于视频的车流量统计——matlab代码

基于视频的车流量统计——matlab代码% 创建系统对象,用于读入待处理视频filename = 'viptraffic.avi';hvfr = vision.VideoFileReader(filename, 'ImageColorSpace', 'RGB');% 创建系统对象,用于色彩空间转换hcsc = vision.ColorSpaceConverter('Conversion', 'RGB to intensity');% 创建系统对象,用于用高斯混合模型检测背景hfdet = vision.ForegroundDetector(...'NumTrainingFrames', 5, ... % 取连续五帧进行检测背景'InitialVariance', (30/255)^2); % 初始标准差为30/255% 创建系统对象,用于检测出包含汽车运动的图像块hblob = vision.BlobAnalysis( ...'CentroidOutputPort', false, ...'AreaOutputPort', true, ...'BoundingBoxOutputPort', true, ...'OutputDataType', 'single', ...'MinimumBlobArea', 250, ...'MaximumBlobArea', 3600, ...'MaximumCount', 80);% 创建系统对象,用于对检测出的运动车辆进行框画hshapeins = vision.ShapeInserter( ...'BorderColor', 'Custom', ...'CustomBorderColor', [0 255 0]);% 创建系统对象,用于标注检测到车辆的个数htextins = vision.TextInserter( ...'Text', '%4d', ...'Location', [1 1], ...'Color', [255 255 255], ...'FontSize', 12);% 创建系统对象,用于显示结果sz = get(0,'ScreenSize');pos = [20 sz(4)-300 200 200];hVideoOrig = vision.VideoPlayer('Name', 'Original', 'Position', pos);pos(1) = pos(1)+220; %在右侧建立下一个视窗hVideoFg = vision.VideoPlayer('Name', 'Foreground', 'Position', pos); pos(1) = pos(1)+220;hVideoRes = vision.VideoPlayer('Name', 'Results', 'Position', pos);line_row = 23; % 定义感兴趣区域(ROI)% 以下的程序段为对输入的视频图像进行处理while ~isDone(hvfr)image = step(hvfr); % 读入视频的每一帧y = step(hcsc, image); % 将彩色图像转换成灰度图像% 采用自动白平衡算法去除灰度突变y = y-mean(y(:));fg_image = step(hfdet, y); % 检验背景% 采用数学形态学,在前景图像中检测变化的联通图像块区域的面积[area, bbox] = step(hblob, fg_image);image_out = image;image_out(22:23,:,:) = 255; % 仅对经过白线后的车辆进行计数image_out(1:15,1:30,:) = 0; % 将背景置为黑色Idx = bbox(:,2) > line_row; %选择感兴趣区域.% 当在感兴趣区域中,联通图像块的比例占整个变化区域的40%以上时,便认为是车辆ratio = zeros(length(Idx),1);ratio(Idx) = single(area(Idx,1))./single(bbox(Idx,3).*bbox(Idx,4));ratiob = ratio > 0.4;count = int32(sum(ratiob)); % 车辆的数量bbox(~ratiob,:) = int32(-1);% 将检测出的车辆圈画出来image_out = step(hshapeins, image_out, bbox);% 显示检测汽车的数量image_out = step(htextins, image_out, count);step(hVideoOrig, image); % 原始视频step(hVideoFg, fg_image); % 前景step(hVideoRes, image_out); % 用方框勾画检测出的车辆end%关闭视频文件release(hvfr);。

trackir5 示例代码

trackir5 示例代码

TrackIR5是一款头部追踪设备,通常用于游戏和虚拟现实应用。

以下是一个简单的示例代码,演示如何使用TrackIR5在Python中获取头部位置:

```python

import trackir5

初始化TrackIR5

tracker = ()

开始追踪

_tracking()

循环获取头部位置

while True:

获取头部位置

pos = _position()

打印头部位置

print("Head Position:", pos)

```

在上面的代码中,我们首先导入了`trackir5`模块,并创建了一个`TrackIR`对象来初始化TrackIR5。

然后,我们调用`start_tracking()`方法来开始追踪头部位置。

接下来,我们进入一个无限循环,并使用`get_position()`方法获取当前头部位置。

最后,我们将头部位置打印到控制台中。

请注意,要使用TrackIR5,您需要安装相应的驱动程序和库。

此外,您还需要将TrackIR5与计算机连接,并确保它已正确安装和配置。

ar寻车系统项目源码

ar寻车系统项目源码摘要:一、项目背景二、项目介绍三、系统功能四、技术实现五、项目优势六、应用场景七、结论正文:【项目背景】随着社会的进步和科技的发展,人们的生活水平不断提高,对出行的需求也日益增加。

为了满足人们多样化的出行需求,AR 寻车系统应运而生。

该项目源码旨在为用户提供便捷的寻车服务,降低找车时间,提高出行效率。

【项目介绍】AR 寻车系统是一款基于增强现实技术(AR)的智能寻车应用,通过将虚拟信息与现实场景相结合,为用户提供实时的车辆定位、导航等功能。

用户只需通过手机扫描停车场的平面图,即可快速找到自己的车辆。

【系统功能】1.车辆定位:通过蓝牙或GPS 定位技术,实时获取车辆位置信息。

2.导航指引:提供详细的行走路线,引导用户前往停车位置。

3.实时更新:根据用户需求,实时更新车辆位置信息。

4.搜索功能:支持关键字搜索,帮助用户快速找到特定车辆。

5.数据统计:统计用户用车时间、频率等数据,为用户提供个性化的出行建议。

【技术实现】1.增强现实技术:通过将虚拟信息与现实场景相结合,实现车辆的实时定位。

2.定位技术:采用蓝牙或GPS 定位技术,获取车辆的精确位置。

3.地图导航:通过高德地图或百度地图等地图服务,为用户提供导航功能。

4.数据存储:使用云存储技术,保存用户车辆定位数据和搜索记录。

【项目优势】1.便捷性:用户只需通过手机即可实现车辆的实时定位和导航,无需额外携带设备。

2.高效性:降低用户找车时间,提高出行效率。

3.实用性:适用于商场、机场、火车站等各类停车场所。

4.节能环保:减少用户在停车场内寻找车辆的行驶距离,降低能源消耗。

【应用场景】1.商场:用户在商场购物后,可通过AR 寻车系统快速找到自己的车辆。

2.机场:旅客在机场办理完登机手续后,可通过该系统找到停车位置。

3.火车站:乘客在火车站下车后,可通过该系统快速找到自己的车辆。

【结论】AR 寻车系统源码项目是一款基于AR 技术的智能寻车应用,具有便捷、高效、实用等优点,适用于各类停车场所。

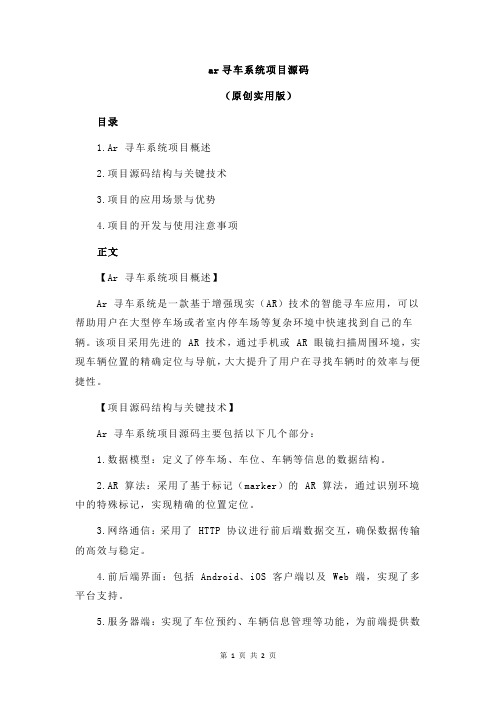

ar寻车系统项目源码

ar寻车系统项目源码(原创实用版)目录1.Ar 寻车系统项目概述2.项目源码结构与关键技术3.项目的应用场景与优势4.项目的开发与使用注意事项正文【Ar 寻车系统项目概述】Ar 寻车系统是一款基于增强现实(AR)技术的智能寻车应用,可以帮助用户在大型停车场或者室内停车场等复杂环境中快速找到自己的车辆。

该项目采用先进的 AR 技术,通过手机或 AR 眼镜扫描周围环境,实现车辆位置的精确定位与导航,大大提升了用户在寻找车辆时的效率与便捷性。

【项目源码结构与关键技术】Ar 寻车系统项目源码主要包括以下几个部分:1.数据模型:定义了停车场、车位、车辆等信息的数据结构。

2.AR 算法:采用了基于标记(marker)的 AR 算法,通过识别环境中的特殊标记,实现精确的位置定位。

3.网络通信:采用了 HTTP 协议进行前后端数据交互,确保数据传输的高效与稳定。

4.前后端界面:包括 Android、iOS 客户端以及 Web 端,实现了多平台支持。

5.服务器端:实现了车位预约、车辆信息管理等功能,为前端提供数据支持。

【项目的应用场景与优势】Ar 寻车系统项目具有广泛的应用场景,如大型商业综合体、机场、火车站等,可以为用户提供以下优势:1.快速找到车辆:通过 AR 技术实现车辆位置的精确定位,提升寻找车辆的效率。

2.多平台支持:支持 Android、iOS 等多个平台,满足不同用户的需求。

3.实时更新:服务器端可实时更新车位信息,为用户提供最新的车位预约信息。

4.方便管理:管理员可以通过服务器端实现车位预约、车辆信息管理等功能,方便对停车场的管理。

【项目的开发与使用注意事项】1.开发过程中,需注意算法的精度与稳定性,确保在不同环境下都能实现精确的定位效果。

2.在使用过程中,用户需确保手机或 AR 眼镜的摄像头清晰,避免因环境光线等因素影响识别效果。

3.对于开发者,建议深入了解 AR 技术的原理与实现,以便更好地进行项目开发与优化。

ar寻车系统项目源码

AR寻车系统项目源码项目背景随着城市化进程的加快,汽车数量不断增加,停车难成为了一个普遍存在的问题。

为了解决这个问题,许多城市引入了智能停车系统,但是用户仍然需要花费很多时间来找到自己停放的车辆。

为了提供更好的用户体验,AR寻车系统项目应运而生。

项目简介AR寻车系统项目旨在利用增强现实(AR)技术,帮助用户更快、更准确地找到停放的车辆。

通过手机应用程序和AR眼镜等设备,用户可以实时查看停车场的实际场景,并在屏幕上显示出停车位的位置和用户当前的位置。

用户只需按照屏幕上的指示,即可轻松找到自己的车辆。

项目流程AR寻车系统项目的流程主要包括车辆注册、车位识别、导航引导等步骤。

车辆注册在项目开始之前,用户需要将自己的车辆信息注册到系统中。

用户可以通过手机应用程序输入车辆的品牌、型号、车牌号等信息,并上传车辆的照片。

系统将根据用户提供的信息生成一个唯一的车辆标识符,并将其与用户的账号进行绑定。

车位识别在停车场安装了摄像头和传感器等设备,用于实时监测停车位的状态。

当车辆停放在某个停车位上时,系统将自动识别车辆并将其标记为已占用状态。

同时,系统还可以通过车辆的车牌号识别出车辆的品牌和型号,并将这些信息与车辆标识符进行关联。

导航引导当用户需要找到自己的车辆时,他们可以打开手机应用程序或佩戴AR眼镜,进入AR寻车模式。

系统将通过摄像头实时捕捉用户所处的环境,并使用AR技术在屏幕上显示出停车场的实际场景。

用户只需在屏幕上点击“寻车”按钮,系统将根据用户的位置和车辆的位置,计算出最佳的导航路径,并在屏幕上显示出导航指示。

技术实现AR寻车系统项目的实现主要依赖于以下技术:增强现实(AR)增强现实技术是一种将虚拟信息与现实世界相结合的技术。

通过手机应用程序或AR眼镜等设备,用户可以在屏幕上看到实时的增强现实场景。

在AR寻车系统中,用户可以通过AR技术在屏幕上看到停车场的实际场景,并在屏幕上显示出停车位的位置和用户当前的位置。

车位引导视频寻车专业技术分析报告

车位引导视频寻车专业技术分析报告发表时间:2017-08-21T09:52:40.860Z 来源:《建筑学研究前沿》2017年第10 作者:叶志江[导读] 车位引导视频寻车系统是通过在车道中心线上方安装视频探测器。

深圳达实智能股份有限公司 518057摘要:车位引导视频寻车系统运用视频图像处理技术,精确检测车位状态,引导顾客便捷停车,实现人性化的停车服务;准确识别车牌,只需输入车牌号,即可显示停车位置,引导顾客快速找到停车位置。

车位引导视频寻车系统完美结合引导和寻车功能,以全自动的方式管理停车场,有效统计停车场车流、车位使用率,寻车定位精准度高,提供多种查找方式,确保车主快速寻车。

增加停车场使用率,提升经营者经济效益,降低停车场的运营成本,改善城市交通状况,提高驾驶人员停车效率提供了有效的技术支持。

关键词:车位引导视频技术分析一、系统工作原理及技术亮点1.系统工作原理车位引导视频寻车系统是通过在车道中心线上方安装视频探测器,一个视频探测器监测2个车位,对车位信息图片进行实时抓拍,视频探头通过车牌识别技术对抓拍到的车位信息图片进行车牌识别分析处理,分析车位使用情况及识别车牌,并把车牌号码和车辆图片(含车牌部分)通过无线WIFI传输到服务器进行统一管理。

工作流程:每3秒拍一张照片(拍照周期可设置),然后由探测器内的处理器,对图片进行车牌、车位识别,当当前状态与前期缓存内存储状态有差异时,就将最新信息(照片、车牌号等信息),通过网络,上传到服务器(探测器——无线路由器——网络交换机——服务器),并对车位指示灯做出相应控制(亮红灯还是绿灯)。

车位引导功能:服务器对视频探测器上传上来的车位信息进行数据处理,并将实时空车位信息通过无线WIFI发布到出入口信息屏和室内信息屏,车主进入停车场出入口和分岔路口即可通过引导屏显示的车位数量信息,选择停车区域,通过视频探头的红绿指示灯即可轻松找到剩余空车位,引导驾驶者便捷停车,实现人性化服务,避免找车位难及停车场内堵车情况。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

<span style="font-size: 14px"><span style="font-size: 12px"><span style="font-size: 14px"><span style="font-size: 14px"><strong>视频寻车管理系统</strong></span></span></span></span></p>

<p>

<span style="font-size: 14px"><span style="font-size: 12px"><strong><span style="font-size: 14px"> </span></strong><span style="font-size: 12px"><strong> </strong>平治寻车系统由刷卡定位终端和寻车查询机组成,现场无需布线。将刷卡定位终端分布在停车场区域内,一般20个停车位设置一台刷卡定位终端,在停车场出入口设定寻车查询机,车辆停稳后车主将IC卡在就近的刷卡定位终端上刷卡,定位终端在司机的IC卡上写入定位标识,定位精度高,可靠性好;当车主返回停车场时,在寻车查询机上刷卡,通过查询机液晶屏上显示目前车辆所在位置以及查询地点到车辆所在区域的最近线路。<br />

<span style="font-size: 14px"><span style="font-size: 12px">● 区域控制器</span></span></p>

<p style="margin-left: 20pt"Байду номын сангаас

<span style="font-size: 14px"><span style="font-size: 12px">● 视频分控制器</span></span></p>

<p style="text-align: center">

<span style="font-size: 14px"><span style="font-size: 12px"><span style="font-size: 14px"><img alt="平治视频寻车系统结构图" src="/ckfinder/userfiles/images/SPXC-4.jpg" style="width: 540px; height: 262px;" /></span></span></span></p>

</span><span style="font-size: 14px"><img alt="" src="/ckfinder/userfiles/images/车主刷卡定位.JPG" style="width: 339px; height: 170px" /> <img alt="" src="/ckfinder/userfiles/images/车主寻找车(1).JPG" style="width: 281px; height: 167px" /> <br />

<p>

<span style="font-size: 14px"><span style="font-size: 12px"><strong><font size="3"> </font></strong>通过在每个车位的正上方安装视频采集终端,实时采集停车场内各个车位的车辆信息。当车辆进入停车位停放时,视频采集终端的车位指示灯由绿色转变为红色同时采集车位图片上传至视频处理器(每台视频处理器可接受12个视频采集模块),视频处理器整理图片信息然后发送给车牌识别处理器(每台车牌识别模块可接收5台视频处理器),由车牌识别处理器完成数据处理,并将处理后的车位数据发送到视频处理器,由视频处理器统一分配发送到停车场内的区域引导屏,通过区域引导屏进行空车位信息的更新,从而实现停车场内的空车位数量的显示及引导功能,车牌识别处理器同时将数据传送给后端计算机,由管理软件将数据存放到数据库。</span></span></p>

<p style="text-align: center">

<span style="font-size: 14px"><span style="font-size: 12px">(平治视频引导系统结构图)</span></span></p>

<p>

<span style="font-size: 14px"><span style="font-size: 12px"><span style="font-size: 14px"><strong>系统组成</strong></span></span></span></p>