西安交通大学 信息论与编码第二章习题答案

信息论与编码理论习题答案

信息论与编码理论习题答案LG GROUP system office room 【LGA16H-LGYY-LGUA8Q8-LGA162】第二章 信息量和熵八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log = bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log = bit 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log = bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C = bit 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6= bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6= bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H = bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H 而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H = bit),|(Y X Z H =)|(Y Z H =)(X H = bit )|,(Y Z X H =)|(Y X H +)|(XY Z H =+= bit设一个系统传送10个数字,0,1,…,9。

信息论编码与基础课后题(第二章)

第二章习题解答2-1、试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解:四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3}八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n X H / 38log log )(2=== 二进制脉冲的平均信息量symbol bit n X H / 12log log )(0===所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

2、 设某班学生在一次考试中获优(A )、良(B )、中(C )、及格(D )和不及格(E )的人数相等。

当教师通知某甲:“你没有不及格”,甲获得了多少比特信息?为确定自己的成绩,甲还需要多少信息? 解:根据题意,“没有不及格”或“pass”的概率为54511pass =-=P 因此当教师通知某甲“没有不及格”后,甲获得信息在已知“pass”后,成绩为“优”(A ),“良”(B ),“中”(C )和“及格”(D ) 的概率相同:41score )pass |()pass |()pass |()pass |(=====D P C P B P A P P 为确定自己的成绩,甲还需信息bits 241loglog score score =-=-=P I 3、中国国家标准局所规定的二级汉字共6763个。

设每字使用的频度相等,求一个汉字所含的信息量。

设每个汉字用一个1616⨯的二元点阵显示,试计算显示方阵所能表示的最大信息。

显示方阵的利用率是多少?解:由于每个汉字的使用频度相同,它们有相同的出现概率,即67631=P 因此每个汉字所含的信息量为bits 7.1267631loglog =-=-=P I 字每个显示方阵能显示256161622=⨯种不同的状态,等概分布时信息墒最大,所以一个显示方阵所能显示的最大信息量是bits322.054log log passpass =-=-=P Ibits 25621loglog =-=-=P I 阵显示方阵的利用率或显示效率为0497.02567.12===阵字I I η 4、两个信源1S 和2S 均有两种输出:1 ,0=X 和1 ,0=Y ,概率分别为2/110==X X P P ,4/10=Y P ,4/31=Y P 。

《信息论与编码》习题解答-第二章

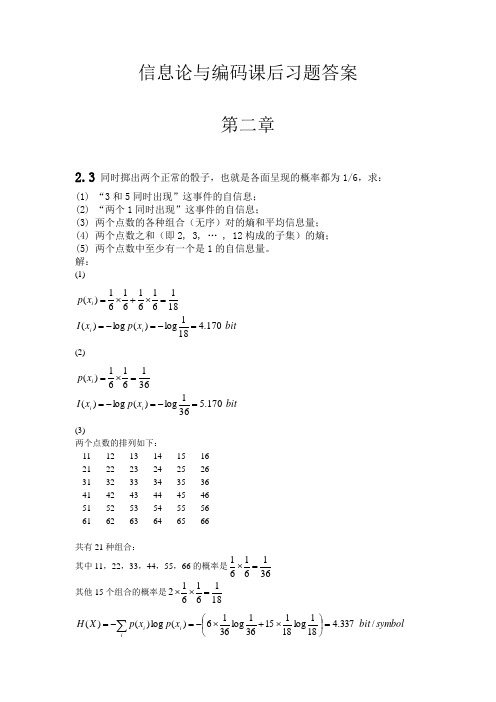

《信息论与编码》习题解答第二章 信源熵-习题答案2-1解:转移概率矩阵为:P(j/i)=,状态图为:⎪⎩⎪⎨⎧==∑∑j jj ij ii W W P W 1,⎪⎪⎪⎪⎩⎪⎪⎪⎪⎨⎧=++=+=++=1323221313121321233123211W W W W W W W W W W W W 解方程组求得W=2-2求平稳概率符号条件概率状态转移概率解方程组得到 W=2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

解: (1)bitx p x I x p i i i 170.4181log )(log )(18161616161)(=-=-==⨯+⨯=(2)bitx p x I x p i i i 170.5361log )(log )(3616161)(=-=-==⨯=(3)共有21种组合:其中11,22,33,44,55,66的概率是3616161=⨯ 其他15个组合的概率是18161612=⨯⨯symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑(4)参考上面的两个点数的排列,可以得出两个点数求和的概率分布如下:symbolbit x p x p X H X P Xii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)bit x p x I x p i i i 710.13611log)(log )(3611116161)(=-=-==⨯⨯=2-4(4)2.5 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。

信息论编码与基础课后题(第二章)

第二章习题解答2-1、试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解:四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n X H / 38log log )(2=== 二进制脉冲的平均信息量symbol bit n X H / 12log log )(0===所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

2、 设某班学生在一次考试中获优(A )、良(B )、中(C )、及格(D )和不及格(E )的人数相等。

当教师通知某甲:“你没有不及格”,甲获得了多少比特信息?为确定自己的成绩,甲还需要多少信息? 解:根据题意,“没有不及格”或“pass”的概率为54511pass =-=P 因此当教师通知某甲“没有不及格”后,甲获得信息在已知“pass”后,成绩为“优”(A ),“良”(B ),“中”(C )和“及格”(D ) 的概率相同:41score )pass |()pass |()pass |()pass |(=====D P C P B P A P P 为确定自己的成绩,甲还需信息bits 241loglog score score =-=-=P I 3、中国国家标准局所规定的二级汉字共6763个。

设每字使用的频度相等,求一个汉字所含的信息量。

设每个汉字用一个1616⨯的二元点阵显示,试计算显示方阵所能表示的最大信息。

显示方阵的利用率是多少?解:由于每个汉字的使用频度相同,它们有相同的出现概率,即67631=P 因此每个汉字所含的信息量为bits 7.1267631loglog =-=-=P I 字每个显示方阵能显示256161622=⨯种不同的状态,等概分布时信息墒最大,所以一个显示方阵所能显示的最大信息量是bits 322.054loglog passpass =-=-=P Ibits 25621loglog 256=-=-=P I 阵显示方阵的利用率或显示效率为0497.02567.12===阵字I I η 4、两个信源1S 和2S 均有两种输出:1 ,0=X 和1 ,0=Y ,概率分别为2/110==X X P P ,4/10=Y P ,4/31=Y P 。

最新信息论与编码习题参考答案

第二章习题参考答案2-1解:同时掷两个正常的骰子,这两个事件是相互独立的,所以两骰子面朝上点数的状态共有6×6=36种,其中任一状态的分布都是等概的,出现的概率为1/36。

(1)设“3和5同时出现”为事件A ,则A 的发生有两种情况:甲3乙5,甲5乙3。

因此事件A 发生的概率为p(A)=(1/36)*2=1/18 故事件A 的自信息量为I(A)=-log 2p(A)=log 218=4.17 bit(2)设“两个1同时出现”为事件B ,则B 的发生只有一种情况:甲1乙1。

因此事件B 发生的概率为p(B)=1/36 故事件B 的自信息量为I(B)=-log 2p(B)=log 236=5.17 bit (3) 两个点数的排列如下:因为各种组合无序,所以共有21种组合: 其中11,22,33,44,55,66的概率是3616161=⨯其他15个组合的概率是18161612=⨯⨯ symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑(4) 参考上面的两个点数的排列,可以得出两个点数求和的概率分布:symbolbit x p x p X H X P X ii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)“两个点数中至少有一个是1”的组合数共有11种。

bit x p x I x p i i i 710.13611log)(log )(3611116161)(=-=-==⨯⨯=2-2解:(1)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡2121)(21x x x p X i 比特 12log *21*2)(log )()(2212==-=∑=i i i x p x p X H(2)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡100110099)(21x x x p X i 比特 08.0100log *100199100log *10099)(log )()(22212=+=-=∑=i i i x p x p X H (3)四种球的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡41414141)(4321x x x x x p X i ,42211()()log ()4**log 4 2 4i i i H X p x p x ==-==∑比特 2-5解:骰子一共有六面,某一骰子扔得某一点数面朝上的概率是相等的,均为1/6。

信息理论与编码课后答案第2章

第二章 信息的度量习题参考答案不确定性与信息(2.3)一副充分洗乱的牌(含52张),试问: (1)任一特定排列所给出的不确定性是多少?(2)随机抽取13张牌,13张牌的点数互不相同时的不确定性是多少? 解:(1)一副充分洗乱的扑克牌,共有52张,这52张牌可以按不同的一定顺序排列,可能有的不同排列状态数就是全排列种数,为6752528.06610P =≈⨯!因为扑克牌充分洗乱,所以任一特定排列出现的概率是相等的。

设事件A 为任一特定排列,则其发生概率为 ()6811.241052P A -=≈⨯!可得,任一特定排列的不确定性为()()22log log 52225.58I A P A =-=≈!比特 (2)设事件B 为从中抽取13张牌,所给出的点数都不同。

扑克牌52张中抽取13张,不考虑其排列顺序,共有1352C 种可能的组合,各种组合都是等概率发生的。

13张牌中所有的点数都不相同(不考虑其顺序)就是13张牌中每张牌有4种花色,所以可能出现的状态数为413。

所以()131341352441339 1.05681052P B C -⨯!!==≈⨯!则事件B 发生所得到的信息量为()()13213524log log 13.208I B P B C =-=-≈ 比特2.4同时扔出两个正常的骰子,也就是各面呈现的概率都是1/6,求: (1)“2和6 同时出现”这事件的自信息量。

(2)“两个3同时出现”这事件的自信息量。

(3)两个点数的各种组合(无序对)的熵。

(4)两个点数之和(即2,3,…,12构成的子集)的熵。

(5)两个点数中至少有一个是1的自信息。

解:同时扔两个正常的骰子,可能呈现的状态数有36种,因为两骰子是独立的,又各面呈现的概率为61,所以36种中任一状态出现的概率相等,为361。

(1) 设“2和6同时出现”这事件为A 。

在这36种状态中,2和6同时出现有两种情况,即2,6和2,6。

信息论与编码第二章习题参考答案

2.1 同时掷两个正常的骰子,也就是各面呈现的概率都是1/6,求: (1)“3和5同时出现”事件的自信息量; (2)“两个1同时出现”事件的自信息量;(3)两个点数的各种组合(无序对)的熵或平均信息量; (4)两个点数之和(即2,3,…,12构成的子集)的熵;(5)两个点数中至少有一个是1的自信息。

解:(1)一个骰子点数记为X ,另一个骰子的点数记做Y ,X 、Y 之间相互独立,且都服从等概率分布,即同理一个骰子点数为3,另一个骰子点数为5属于组合问题,对应的概率为181616161613Y Py 5X Px 5Y Py 3X Px P 1=⨯+⨯===+===)()()()(对应的信息量为比特)()(17.4181-lb P -I 11===lb(2)两个骰子点数同时为1的概率为)()(3611Y Py 1X Px P 2==== 对应的信息量为比特)()(17.5361-lb P -I 22===lb(3)各种组合及其对应的概率如下,6,5,4,3,2,1Y X 3616161Y X P ===⨯==)(共6种可能18161612Y X P =⨯⨯=≠)( 共有15种可能因此对应的熵或者平均自信息量为34.418118115-3613616-H 1=⨯⨯⨯⨯=)()(lb lb 比特/符号 (4)令Z=X+Y ,可以计算出Z 对应的概率分布如下对应的熵为符号比特)()()()()()()(/1.914366366-3653652-3643642-3633632-3633632-3623622-361361-2H 1=⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯⨯=lb lb lb lb lb lb lb (5)X 、Y 相互独立,所以联合熵为比特)()(597.06162Y X,I =⨯=lb2.2 设在一只布袋中装有100个大小、手感完全相同的球,每个球上涂有一种颜色。

100个球的颜色有下列3种情况:(1)红色球和白色球各50个; (2)红色球99个,白色球1个; (3)红、黄、蓝、白色球各25个。

信息论与编码第二章答案

第二章信息的度量2.1信源在何种分布时,熵值最大?又在何种分布时,熵值最小?答:信源在等概率分布时熵值最大;信源有一个为1,其余为0时熵值最小。

2.2平均互信息量I(X;Y)与信源概率分布q(x)有何关系?与p(y|x)又是什么关系?答:若信道给定,I(X;Y)是q(x)的上凸形函数;若信源给定,I(X;Y)是q(y|x)的下凸形函数。

2.3熵是对信源什么物理量的度量?答:平均信息量2.4设信道输入符号集为{x1,x2,……xk},则平均每个信道输入符号所能携带的最大信息量是多少?答:kk k xi q xi q X H i log 1log 1)(log )()(2.5根据平均互信息量的链规则,写出I(X;YZ)的表达式。

答:)|;();();(Y Z X I Y X I YZ X I 2.6互信息量I(x;y)有时候取负值,是由于信道存在干扰或噪声的原因,这种说法对吗?答:互信息量)()|(log );(xi q yj xi Q y x I ,若互信息量取负值,即Q(xi|yj)<q(xi),说明事件yi 的出现告知的是xi 出现的可能性更小了。

从通信角度看,视xi 为发送符号,yi 为接收符号,Q(xi|yj)<q(xi),说明收到yi 后使发送是否为xi 的不确定性更大,这是由于信道干扰所引起的。

2.7一个马尔可夫信源如图所示,求稳态下各状态的概率分布和信源熵。

答:由图示可知:43)|(41)|(32)|(31)|(41)|(43)|(222111110201s x p s x p s x p s x p s x p s x p 即:43)|(0)|(41)|(31)|(32)|(0)|(0)|(41)|(43)|(222120121110020100s s p s s p s s p s s p s s p s s p s s p s s p s s p 可得:1)()()()(43)(31)()(31)(41)()(41)(43)(210212101200s p s p s p s p s p s p s p s p s p s p s p s p得:114)(113)(114)(210s p s p s p )]|(log )|()|(log )|()[()]|(log )|()|(log )|()[()]|(log )|()|(log )|()[(222220202121211111010100000s s p s s p s s p s s p s p s s p s s p s s p s s p s p s s p s s p s s p s s p s p H 0.25(bit/符号)2.8一个马尔可夫信源,已知:0)2|2(,1)2|1(,31)1|2(,32)1|1(x x p x x p x x p x x p 试画出它的香农线图,并求出信源熵。

信息论与编码第2章习题解答

2.1设有12枚同值硬币,其中一枚为假币。

只知道假币的重量与真币的重量不同,但不知究竟是重还是轻。

现用比较天平左右两边轻重的方法来测量(因无砝码)。

为了在天平上称出哪一枚是假币,试问至少必须称多少次?解:分三组,每组4个,任意取两组称。

会有两种情况,平衡,或不平衡。

(1) 平衡:明确假币在其余的4个里面。

从这4个里面任意取3个,并从其余8个好的里面也取3个称。

又有 两种情况:平衡或不平衡。

a )平衡:称一下那个剩下的就行了。

b )不平衡:我们至少知道那组假币是轻还是重。

从这三个有假币的组里任意选两个称一下,又有两种情况:平衡与不平衡,不过我们已经知道假币的轻重情况了,自然的,不平衡直接就知道谁是假币;平衡的话,剩下的呢个自然是假币,并且我们也知道他是轻还是重。

(2) 不平衡:假定已经确定该组里有假币时候:推论1:在知道该组是轻还是重的时候,只称一次,能找出假币的话,那么这组的个数不超过3。

我们知道,只要我们知道了该组(3个)有假币,并且知道轻重,只要称一次就可以找出来假币了。

从不平衡的两组中,比如轻的一组里分为3和1表示为“轻(3)”和“轻(1)”,同样重的一组也是分成3和1标示为“重(3)”和“重(1)”。

在从另外4个剩下的,也就是好的一组里取3个表示为“准(3)”。

交叉组合为:轻(3) + 重(1) ?=======? 轻(1) + 准(3)来称一下。

又会有3种情况:(1)左面轻:这说明假币一定在第一次称的时候的轻的一组,因为“重(1)”也出现在现在轻的一边,我们已经知道,假币是轻的。

那么假币在轻(3)里面,根据推论1,再称一次就可以了。

(2)右面轻:这里有两种可能:“重(1)”是假币,它是重的,或者“轻(1)”是假币,它是轻的。

这两种情况,任意 取这两个中的一个和一个真币称一下即可。

(3)平衡:假币在“重(3)”里面,而且是重的。

根据推论也只要称一次即可。

2.2 同时扔一对骰子,当得知“两骰子面朝上点数之和为2”或“面朝上点数之和为8”或“骰子面朝上之和是3和4”时,试问这三种情况分别获得多少信息量?解:设“两骰子面朝上点数之和为2”为事件A ,则在可能出现的36种可能中,只能个骰子都为1,这一种结果。

信息论与编码课后习题答案

信息论与编码课后习题答案第二章2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

解:(1)bitx p x I x p i i i 170.4181log )(log )(18161616161)(=-=-==⨯+⨯=(2)bitx p x I x p i i i 170.5361log )(log )(3616161)(=-=-==⨯=(3)两个点数的排列如下: 11 12 13 14 15 16 21 22 23 24 25 26 31 32 33 34 35 36 41 42 43 44 45 46 51 52 53 54 55 56 61 62 63 64 65 66共有21种组合:其中11,22,33,44,55,66的概率是3616161=⨯ 其他15个组合的概率是18161612=⨯⨯ symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑参考上面的两个点数的排列,可以得出两个点数求和的概率分布如下:symbolbit x p x p X H X P X ii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)bit x p x I x p i i i 710.13611log)(log )(3611116161)(=-=-==⨯⨯=2.42.12 两个实验X 和Y ,X={x 1 x 2 x 3},Y={y 1 y 2 y 3},l 联合概率(),i j ij r x y r =为1112132122233132337/241/2401/241/41/2401/247/24r r r r r r rr r ⎛⎫⎛⎫⎪ ⎪= ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭(1) 如果有人告诉你X 和Y 的实验结果,你得到的平均信息量是多少?(2) 如果有人告诉你Y 的实验结果,你得到的平均信息量是多少?(3) 在已知Y 实验结果的情况下,告诉你X 的实验结果,你得到的平均信息量是多少?解:联合概率(,)i j p x y 为 22221(,)(,)log (,)724112log 4log 24log 4247244i j i j ijH X Y p x y p x y ==⨯+⨯+∑=2.3bit/符号X 概率分布 21()3log 3 1.583H Y =⨯=bit/符号(|)(,)() 2.3 1.58H X Y H X Y H Y =-=- Y 概率分布是 =0.72bit/符号 Y y1 y2 y3 P8/248/248/242.15P(j/i)=2.16 黑白传真机的消息元只有黑色和白色两种,即X={黑,白},一般气象图上,黑色的Y X y1y 2 y 3 x 1 7/24 1/24 0 x 2 1/24 1/4 1/24 x 31/247/24X x 1 x 2 x 3 P8/248/248/24出现概率p(黑)=0.3,白色出现的概率p(白)=0.7。

信息论与编码习题解答(待校200812)

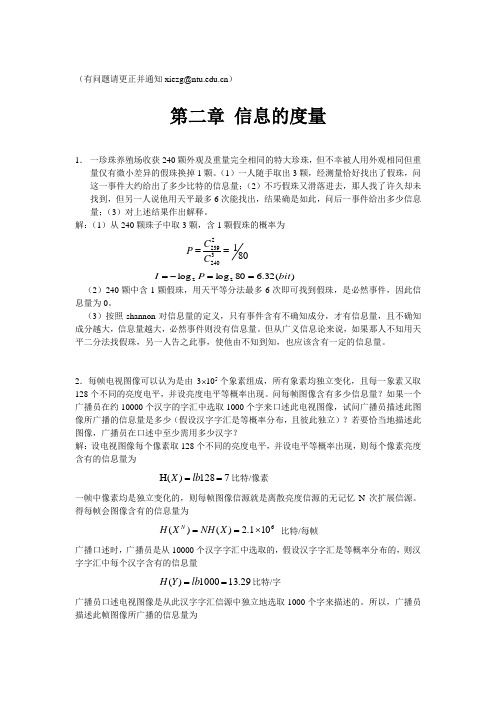

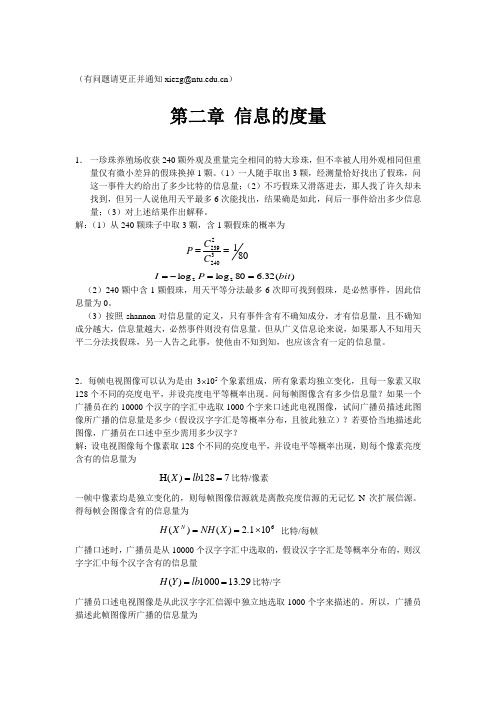

(有问题请更正并通知xiezg@ )第二章 信息的度量1. 一珍珠养殖场收获240颗外观及重量完全相同的特大珍珠,但不幸被人用外观相同但重量仅有微小差异的假珠换掉1颗。

(1)一人随手取出3颗,经测量恰好找出了假珠,问这一事件大约给出了多少比特的信息量;(2)不巧假珠又滑落进去,那人找了许久却未找到,但另一人说他用天平最多6次能找出,结果确是如此,问后一事件给出多少信息量;(3)对上述结果作出解释。

解:(1)从240颗珠子中取3颗,含1颗假珠的概率为(2)240颗中含1颗假珠,用天平等分法最多6次即可找到假珠,是必然事件,因此信息量为0。

(3)按照shannon 对信息量的定义,只有事件含有不确知成分,才有信息量,且不确知成分越大,信息量越大,必然事件则没有信息量。

但从广义信息论来说,如果那人不知用天平二分法找假珠,另一人告之此事,使他由不知到知,也应该含有一定的信息量。

2.每帧电视图像可以认为是由3⨯105个象素组成,所有象素均独立变化,且每一象素又取128个不同的亮度电平,并设亮度电平等概率出现。

问每帧图像含有多少信息量?如果一个广播员在约10000个汉字的字汇中选取1000个字来口述此电视图像,试问广播员描述此图像所广播的信息量是多少(假设汉字字汇是等概率分布,且彼此独立)?若要恰当地描述此图像,广播员在口述中至少需用多少汉字?解:设电视图像每个像素取128个不同的亮度电平,并设电平等概率出现,则每个像素亮度含有的信息量为7128)(H ==lb X 比特/像素一帧中像素均是独立变化的,则每帧图像信源就是离散亮度信源的无记忆N 次扩展信源。

得每帧会图像含有的信息量为6101.2)()(⨯==X NH X H N比特/每帧广播口述时,广播员是从10000个汉字字汇中选取的,假设汉字字汇是等概率分布的,则汉字字汇中每个汉字含有的信息量29.131000)(==lb Y H 比特/字广播员口述电视图像是从此汉字字汇信源中独立地选取1000个字来描述的。

《信息论与编码》第二章习题解答

H (Z Y ) = H ( X3)= H(X )= 2.585 bit

H (X |Y ) = H (X ) + H(Y X ) − H(Y ) = H (X ) + H( X 2 ) − H(Y )

I (X ;Y ) =

p(x , y )log

xy

p( x)

2

2

在上式求和中,使 p(x, y) ≠ 0 的输入,输出对

3

3

4

4

(x, y)可分为 3 类:

5

5ห้องสมุดไป่ตู้

6 7

6 7

S1 = {(0,0), (2,2), (4,4),(6,6),(8,8)}

8 9

8 9

S2 = {(1,1),(3,3), (5,5),(7,7),(9,9)}

在已知第一位数字下,第二位数字携带信息为 H (Y | X ) = 0.75H(0.1,0.9) + 0.25H (0.5,0.5)

=0.602 bit

在已知前二位数字下,第三位数字携带信息为:

H (Z | X ,Y ) = H (Z | Y )

(因为 X→Y→Z)

= 0.2H(1) + 0.8H(0.4,0.6)

=0.158 bit

2.3 在某中学有 3 学生通过了考试, 1 学生没有通过。在通过考试的同学中 10%有自行

4

4

车,而没有通过的学生中 50%有自行车,所有有自行车的同学都加入了联谊会,

无自行车的同学中仅有 40%加入联谊会。

a. 通过询问是否有自行车,能获得多少关于学生考试成绩的信息?

信息论与编码第二版第2章习题答案

2 3 4 5 6 7 8 9 10 11 12 X 1 1 1 1 5 1 5 1 1 1 1 = P ( X ) 36 18 12 9 36 6 36 9 12 18 36 H ( X ) = −∑ p ( xi ) log p ( xi )

画出状态图,并计算各状态的稳态概率。 解: p (0 | 00) = p (00 | 00) = 0.8

p (0 | 01) = p (10 | 01) = 0.5 p (0 |10) = p (00 |10) = 0.5 p (1| 01) = p (11| 01) = 0.5 p (1|10) = p (01|10) = 0.5

15 25 35 45 55 65

16 26 36 46 56 66

1 1 1 × = 6 6 36

1 1 1 × = 6 6 18

1 1 1 1 H ( X ) = −∑ p ( xi ) log p ( xi ) = − 6 × log + 15 × log = 4.337 bit / symbol 36 18 18 36 i

2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为: p (0 | 00) =0.8, p (0 |11) =0.2,

p (1| 00) =0.2, p (1|11) =0.8, p (0 | 01) =0.5, p (0 |10) =0.5, p (1| 01) =0.5, p (1|10) =0.5。

87.81 = 1.95 bit/符号 45

2-14 (1)

P(ij)=

P(i/j)=

(2) 方法 1:

信息论与编码习题参考答案

第二章习题参考答案2-1解:同时掷两个正常的骰子,这两个事件是相互独立的,所以两骰子面朝上点数的状态共有6×6=36种,其中任一状态的分布都是等概的,出现的概率为1/36。

(1)设“3和5同时出现”为事件A ,则A 的发生有两种情况:甲3乙5,甲5乙3。

因此事件A 发生的概率为p(A)=(1/36)*2=1/18 故事件A 的自信息量为I(A)=-log 2p(A)=log 218=4.17 bit(2)设“两个1同时出现”为事件B ,则B 的发生只有一种情况:甲1乙1。

因此事件B 发生的概率为p(B)=1/36 故事件B 的自信息量为I(B)=-log 2p(B)=log 236=5.17 bit (3) 两个点数的排列如下:因为各种组合无序,所以共有21种组合: 其中11,22,33,44,55,66的概率是3616161=⨯其他15个组合的概率是18161612=⨯⨯ symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑(4) 参考上面的两个点数的排列,可以得出两个点数求和的概率分布:sym bolbit x p x p X H X P X ii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)“两个点数中至少有一个是1”的组合数共有11种。

bitx p x I x p i i i 710.13611log )(log )(3611116161)(=-=-==⨯⨯=2-2解:(1)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡2121)(21x x x p X i 比特 12log *21*2)(log )()(2212==-=∑=i i i x p x p X H(2)红色球x 1和白色球x 2的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡100110099)(21x x x p X i 比特 08.0100log *100199100log *10099)(log )()(22212=+=-=∑=i i i x p x p X H (3)四种球的概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡41414141)(4321x x x x x p X i ,42211()()log ()4**log 4 2 4i i i H X p x p x ==-==∑比特2-5解:骰子一共有六面,某一骰子扔得某一点数面朝上的概率是相等的,均为1/6。

信息论与编码理论第二章习题答案(王育民)

部分答案,仅供参考。

2.1信息速率是指平均每秒传输的信息量点和划出现的信息量分别为3log ,23log ,一秒钟点和划出现的次数平均为415314.0322.01=⨯+⨯一秒钟点和划分别出现的次数平均为45.410那么根据两者出现的次数,可以计算一秒钟其信息量平均为253log 4153log 4523log 410-=+2.3 解:(a)骰子A 和B ,掷出7点有以下6种可能:A=1,B=6; A=2,B=5; A=3,B=4; A=4,B=3; A=5,B=2; A=6,B=1 概率为6/36=1/6,所以信息量-log(1/6)=1+log3≈2.58 bit(b) 骰子A 和B ,掷出12点只有1种可能: A=6,B=6概率为1/36,所以信息量-log(1/36)=2+log9≈5.17 bit2.5解:出现各点数的概率和信息量:1点:1/21,log21≈4.39 bit ; 2点:2/21,log21-1≈3.39 bit ; 3点:1/7,log7≈2.81bit ; 4点:4/21,log21-2≈2.39bit ; 5点:5/21,log (21/5)≈2.07bit ; 6点:2/7,log(7/2)≈1.81bit 平均信息量:(1/21)×4.39+(2/21)×3.39+(1/7)×2.81+(4/21)×2.39+(5/21)×2.07+(2/7)×1.81≈2.4bit2.7解:X=1:考生被录取; X=0:考生未被录取; Y=1:考生来自本市;Y=0:考生来自外地; Z=1: 考生学过英语;Z=0:考生未学过英语P(X=1)=1/4, P(X=0)=3/4; P(Y=1/ X=1)=1/2; P(Y=1/ X=0)=1/10;P(Z=1/ Y=1)=1, P(Z=1 / X=0, Y=0)=0.4, P(Z=1/ X=1, Y=0)=0.4, P(Z=1/Y=0)=0.4 (a) P(X=0,Y=1)=P(Y=1/X=0)P(X=0)=0.075, P(X=1,Y=1)= P(Y=1/X=1)P(X=1)=0.125P(Y=1)= P(X=0,Y=1)+ P(X=1,Y=1)=0.2P(X=0/Y=1)=P(X=0,Y=1)/P(Y=1)=0.375, P(X=1/Y=1)=P(X=1,Y=1)/P(Y=1)=0.625 I (X ;Y=1)=∑∑=====xx)P()1Y /(P log)1Y /(P )1Y (I )1Y /(P x x x x;x=1)P(X )1Y /1X (P log)1Y /1X (P 0)P(X )1Y /0X (P log)1Y /0X (P =====+======0.375log(0.375/0.75)+0.625log(0.625/0.25)=(5/8)log5-1≈0.45bit(b) 由于P(Z=1/ Y=1)=1, 所以 P (Y=1,Z=1/X=1)= P (Y=1/X=1)=0.5 P (Y=1,Z=1/X=0)= P (Y=1/X=0)=0.1那么P (Z=1/X=1)= P (Z=1,Y=1/X=1)+ P (Z=1,Y=0/X=1)=0.5+ P (Z=1/Y=0,X=1)P (Y=0/X=1)=0.5+0.5*0.4=0.7P(Z=1/X=0)= P (Z=1,Y=1/X=0)+ P (Z=1,Y=0/X=0)=0.1+P(Z=1/Y=0,X=0)P(Y=0/X=0)=0.1+0.9*0.4=0.46P (Z=1,X=1)= P (Z=1/X=1)*P(X=1)=0.7*0.25=0.175 P (Z=1,X=0)= P (Z=1/X=0)*P(X=0)= 0.46*0.75=0.345 P(Z=1) = P(Z=1,X=1)+ P(Z=1,X=0) = 0.52 P(X=0/Z=1)=0.345/0.52=69/104 P(X=1/Z=1)=35/104I (X ;Z=1)=∑∑=====xx )P()1Z /(P log )1Z /(P )1Z (I )1Z /(P x x x x;x=1)P(X )1Z /1X (P log )1Z /1X (P 0)P(X )1Z /0X (P log )1Z /0X (P =====+======(69/104)log(23/26)+( 35/104)log(35/26) ≈0.027bit(c)H (X )=0.25*log(1/0.25)+0.75*log(1/0.75)=2-(3/4)log3=0.811bit H(Y/X)=-P(X=1,Y=1)logP(Y=1/X=1) -P(X=1,Y=0)logP(Y=0/X=1)-P(X=0,Y=1)logP(Y=1/X=0) -P(X=0,Y=0)logP(Y=0/X=0)=-0.125*log0.5-0.125*log0.5-0.075*log0.1-0.675*log0.9=1/4+(3/40)log10-(27/40)log(9/10)≈0.603bitH(XY)=H(X)+H(Y/X)=9/4+(3/4)log10-(21/10)log3=1.414bitP(X=0,Y=0,Z=0)= P(Z=0 / X=0, Y=0)* P( X=0, Y=0)=(1-0.4)*(0.75-0.075)=0.405 P(X=0,Y=0,Z=1)= P(Z=1 / X=0, Y=0)* P( X=0, Y=0)=0.4*0.675=0.27P(X=1,Y=0,Z=1)= P(Z=1/ X=1,Y=0)* P(X=1,Y=0)=0.4*(0.25-0.125)=0.05 P(X=1,Y=0,Z=0)= P(Z=0/ X=1,Y=0)* P(X=1,Y=0)=0.6*0.125=0.075 P(X=1,Y=1,Z=1)=P(X=1,Z=1)- P(X=1,Y=0,Z=1)=0.175-0.05=0.125 P(X=1,Y=1,Z=0)=0 P(X=0,Y=1,Z=0)=0P(X=0,Y=1,Z=1)= P(X=0,Z=1)- P(X=0,Y=0,Z=1)= 0.345-0.27=0.075H(XYZ)=-0.405*log0.405-0.27*log0.27-0.05*log0.05-0.075*log0.075-0.125*log0.125-0.075*log 0.075=(113/100)+(31/20)log10-(129/50)log3 =0.528+0.51+0.216+0.28+0.375+0.28=2.189 bitH(Z/XY)=H(XYZ)-H(XY)= -28/25+(4/5)log10-12/25log3 =0.775bit2.9 解:A ,B ,C 分别表示三个筛子掷的点数。

信息论与编码第二章课后答案

信息论与编码第二章课后答案在信息科学领域中,信息论和编码是两个息息相关的概念。

信息论主要研究信息的传输和处理,包括信息的压缩、传输的准确性以及信息的安全性等方面。

而编码则是将信息进行转换和压缩的过程,常用的编码方式包括霍夫曼编码、香农-费诺编码等。

在《信息论与编码》这本书的第二章中,涉及了信息的熵、条件熵、熵的连锁法则等概念。

这些概念对于信息理解和编码实现有着重要的意义。

首先是信息的熵。

熵可以简单理解为信息的不确定性。

当信息的发生概率越大,它的熵就越小。

比如说,一枚硬币的正反面各有50%的概率,那么它的熵就是1bit。

而如果硬币只有正面,那么它的熵就是0bit,因为我们已经知道了结果,不再有任何不确定性。

其次是条件熵。

条件熵是在已知某些信息(即条件)的前提下,对信息的不确定性进行量化。

它的定义为已知条件下,信息的熵的期望值。

比如说,在猜词游戏中,我们手中已经有一些字母的信息,那么此时猜测单词的不确定性就会下降,条件熵也就会减少。

除了熵和条件熵之外,连锁法则也是信息理解和编码实现中的重要概念。

连锁法则指的是一个信息在不同时刻被传输的情况下,熵的变化情况。

在信息传输的过程中,信息的熵可能会发生改变。

这是因为在传输过程中,可能会发生噪声或者数据重复等情况。

而连锁法则就是用来描述这种情况下信息熵的变化情况的。

最后,霍夫曼编码和香农-费诺编码是两种比较常用的编码方式。

霍夫曼编码是一种无损压缩编码方式,它可以将出现频率高的字符用较短的二进制编码表示,出现频率较低的字符用较长的二进制编码表示。

香农-费诺编码则是一种用于无失真信源编码的方法,可以把每个符号用尽可能短的二进制串来表示,使得平均码长最小化。

总的来说,信息论和编码是信息科学中非常重要的两个概念。

通过对信息熵、条件熵、连锁法则等的探讨和了解,可以更好地理解信息及其传输过程中的不确定性和数据处理的方法。

而霍夫曼编码和香农-费诺编码则是实现数据压缩和传输的常用编码方式。

信息论编码与基础课后题第二章

信息论编码与基础课后题(第二章)————————————————————————————————作者:————————————————————————————————日期:第二章习题解答2-1、试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解:四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n X H / 38log log )(2=== 二进制脉冲的平均信息量symbol bit n X H / 12log log )(0===所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

2、 设某班学生在一次考试中获优(A )、良(B )、中(C )、及格(D )和不及格(E )的人数相等。

当教师通知某甲:“你没有不及格”,甲获得了多少比特信息?为确定自己的成绩,甲还需要多少信息? 解:根据题意,“没有不及格”或“pass”的概率为54511pass =-=P 因此当教师通知某甲“没有不及格”后,甲获得信息在已知“pass”后,成绩为“优”(A ),“良”(B ),“中”(C )和“及格”(D )的概率相同:41score )pass |()pass |()pass |()pass |(=====D P C P B P A P P 为确定自己的成绩,甲还需信息bits 241loglog score score =-=-=P I 3、中国国家标准局所规定的二级汉字共6763个。

设每字使用的频度相等,求一个汉字所含的信息量。

设每个汉字用一个1616⨯的二元点阵显示,试计算显示方阵所能表示的最大信息。

信息论与编码习题解答(待校200812)

(有问题请更正并通知xiezg@ )第二章 信息的度量1. 一珍珠养殖场收获240颗外观及重量完全相同的特大珍珠,但不幸被人用外观相同但重量仅有微小差异的假珠换掉1颗。

(1)一人随手取出3颗,经测量恰好找出了假珠,问这一事件大约给出了多少比特的信息量;(2)不巧假珠又滑落进去,那人找了许久却未找到,但另一人说他用天平最多6次能找出,结果确是如此,问后一事件给出多少信息量;(3)对上述结果作出解释。

解:(1)从240颗珠子中取3颗,含1颗假珠的概率为(2)240颗中含1颗假珠,用天平等分法最多6次即可找到假珠,是必然事件,因此信息量为0。

(3)按照shannon 对信息量的定义,只有事件含有不确知成分,才有信息量,且不确知成分越大,信息量越大,必然事件则没有信息量。

但从广义信息论来说,如果那人不知用天平二分法找假珠,另一人告之此事,使他由不知到知,也应该含有一定的信息量。

2.每帧电视图像可以认为是由3⨯105个象素组成,所有象素均独立变化,且每一象素又取128个不同的亮度电平,并设亮度电平等概率出现。

问每帧图像含有多少信息量?如果一个广播员在约10000个汉字的字汇中选取1000个字来口述此电视图像,试问广播员描述此图像所广播的信息量是多少(假设汉字字汇是等概率分布,且彼此独立)?若要恰当地描述此图像,广播员在口述中至少需用多少汉字?解:设电视图像每个像素取128个不同的亮度电平,并设电平等概率出现,则每个像素亮度含有的信息量为7128)(H ==lb X 比特/像素一帧中像素均是独立变化的,则每帧图像信源就是离散亮度信源的无记忆N 次扩展信源。

得每帧会图像含有的信息量为6101.2)()(⨯==X NH X H N比特/每帧广播口述时,广播员是从10000个汉字字汇中选取的,假设汉字字汇是等概率分布的,则汉字字汇中每个汉字含有的信息量29.131000)(==lb Y H 比特/字广播员口述电视图像是从此汉字字汇信源中独立地选取1000个字来描述的。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

信息论第二章习题

2-1 设用ASCII 码传送英文单词“so ”,“s ”和“o ”的ASCII 码分别是115和111。

(a) 设所有ASCII 字符出现的概率相同,且字符间不相关,求“so ”所携带的信息量; (b) 如信源产生“so ”所花费的时间是1 ms ,求信源的信息速率(设信源以恒定速率产生字符)。

2-2 设以8000 samp/sec 的速率抽样一语音信号,并以25628==M 级对抽样均匀量化,设抽样值取各量化值的概率相等,且抽样间相互统计独立。

(a) 求每抽样的信息熵; (b) 求信源的信息速率; (c) 如以10进制数表示的M 进制抽样序列为“126 24 53”,求以二进制数表示时,该M 进制序列的形式; (d) 它所对应的二进制序列的长度是多少?

2-3 一幅标准的黑白电视图像有26253/4×个象素。

如每个象素的灰度电平用一个256进制的整数符表示,一幅画面所含的信息量为多少?(设灰度取各电平级的概率相等,且象素间统计独立。

)如摄像机的扫描速度为25幅画面/秒,求摄像机产生的信息率(设各画面互不相关)。

它相当于多少路话音源的信息率?

2-4 设一连续无记忆信源产生数符],0[A X =,其概率密度函数为

)/(1)(a b x p −=,A b x a ≤≤≤≤0。

求X 的相对信息熵)(X H 。

在什么条件下,0)(<X H ,它的含义是什么?

2-5 一信源产生的时不变波形信号(即信号统计特性不随时间而变)的带宽4=W kHz ,幅度分布为

0 ,)(≥=−x e x p x

试求该信源的输出信息率。

2-6 设某离散一阶记忆信源以速率r 产生数符],0[A X =,其概率分布为

3/2 ,3/110==X X P P 。

但当第1−i 个数符已知时,第i 个数符的概率分布变

为

12/7)1|1( 5/12 )1|0(6/5)0|1( 1/6 )0|0(1111============−−−−i i i i i i i i X X P X X P X X P X X P 求X 的信息熵)(X H 和条件信息熵)|(1−i i X X H ,以及信源的信息率R 。

如使序列通过一扰码器,扰乱后的序列的信息率是多少?。