单目标图像的目标区域提取

目标检测的流程

目标检测的流程

目标检测的流程主要包括以下步骤:

1. 特征提取:这是目标检测的第一步,需要通过一系列的滤波和高级特征提取算法,从输入图像中提取已知目标的特征。

2. 定位预测:在特征提取之后,需要训练一个模型,这个模型可以从图像中检测出目标的位置。

这个阶段通常会生成一系列的bounding box,这些box包围了图像中的目标。

3. 分类:在定位预测阶段之后,需要利用训练好的模型对检测到的目标进行精确的分类。

4. 感兴趣区域提取:由于一张图片中含有大量背景信息,因此通常会先产生目标可能存在的大致区域,即感兴趣区域(Region of Interest,ROI),再对这些感兴趣区域进行微调。

5. 非极大值抑制:对上一步产生的bounding box进行筛选重组,如非极大值抑制(Non Maximum Suppression,NMS),使得每个目标由单一box框定。

这个过程是目标检测的一般流程,具体实现时可能会根据实际需求和数据集进行调整。

斑点提取最简单方法

斑点提取最简单方法引言在图像处理和计算机视觉领域,斑点提取是一个很基础但非常重要的任务。

斑点提取是指从图像中将感兴趣的目标物体或目标区域与背景区域分离出来,常用于医学图像分析、目标检测、图像分割等许多应用中。

本文将介绍斑点提取的最简单方法。

方法一:灰度阈值法最简单的斑点提取方法之一是灰度阈值法。

该方法基于一个简单的思想:将图像转换为灰度图像后,通过设定一个阈值来将像素分为目标和背景两类。

具体步骤如下:1. 将彩色图像转换为灰度图像。

2. 选择一个合适的阈值,将灰度图像转换为二值图像。

阈值的选择可以根据经验或采用自适应阈值的方法。

3. 对二值图像进行连通域分析,得到目标区域的位置和大小信息。

灰度阈值法是一种简单而常用的方法,适用于目标与背景之间的灰度差异较明显且背景相对简单的情况。

方法二:基于颜色特征的方法对于彩色图像,我们可以利用目标物体与背景在颜色上的差异来进行斑点提取。

具体步骤如下:1. 将彩色图像从RGB颜色空间转换为HSV颜色空间。

2. 提取目标物体所对应的颜色范围,可以通过手动选择合适的颜色范围或采用自适应的方法。

3. 根据颜色范围,在HSV图像中对目标物体进行分割得到二值图像。

4. 对二值图像进行连通域分析,得到目标区域的位置和大小信息。

基于颜色特征的方法适用于目标物体与背景在颜色上有明显差异的情况,例如水果、花朵等图像。

方法三:基于纹理特征的方法有时候,目标物体与背景在纹理上的差异更为显著,这时候可以使用基于纹理特征的方法进行斑点提取。

具体步骤如下:1. 将彩色图像转换为灰度图像。

2. 对灰度图像进行纹理特征提取,可以采用LBP(Local Binary Pattern)等方法。

3. 根据提取的纹理特征,将图像分割为目标和背景的两个类别。

4. 对二值图像进行连通域分析,得到目标区域的位置和大小信息。

基于纹理特征的方法在一些纹理丰富的图像中效果较好,例如布料、树皮等图像。

方法四:基于深度学习的方法近年来,深度学习在图像处理领域取得了很大的突破,也可以用于斑点提取。

遥感影像处理中的特征提取方法和应用

遥感影像处理中的特征提取方法和应用遥感影像是通过无人机、卫星等载体获取的地球表面的影像数据。

特征提取是遥感影像处理中的一项重要任务,旨在从遥感影像中提取出地物的特定特征,以实现对地物的分类、识别和监测等应用。

本文将介绍遥感影像处理中常用的特征提取方法及其应用。

一、特征提取方法1. 基于像素的特征提取方法基于像素的特征提取方法是从单个像素点的信息中提取特征。

常用的方法包括:(1)颜色特征提取:利用遥感影像中的颜色信息进行特征提取。

常用的方法包括二值化、RGB分量、HSV、归一化差异植被指数(NDVI)等。

(2)纹理特征提取:利用遥感影像中的纹理信息进行特征提取。

常用的方法包括灰度共生矩阵(GLCM)、灰度值标准差、平均灰度值等。

(3)形状特征提取:利用遥感影像中的形状信息进行特征提取。

常用的方法包括链码、Hu不变矩、区域面积等。

2. 基于目标的特征提取方法基于目标的特征提取方法是在已知地物目标的前提下,根据地物目标的特定特征进行特征提取。

常用的方法包括:(1)形状特征提取:利用地物目标的形状信息进行特征提取。

常用的方法包括面积、周长、伸长率等。

(2)纹理特征提取:利用地物目标的纹理信息进行特征提取。

常用的方法包括纹理能量、纹理熵、纹理对比度等。

(3)上下文特征提取:利用地物目标的上下文信息进行特征提取。

常用的方法包括边界连接、邻居分析、局部空间关系等。

二、特征提取应用1. 地物分类特征提取在地物分类中起到了关键作用。

通过提取不同地物的特定特征,可以将遥感影像中的地物进行分类,如水体、森林、建筑等。

特征提取方法可以通过训练分类器来实现自动分类。

2. 土地利用监测特征提取可以应用于土地利用监测。

通过提取遥感影像中地物的特定特征,可以实现对土地的类型和变化进行监测,如农田的扩张、森林的退化等,为土地规划和资源管理提供支持。

3. 城市规划特征提取在城市规划中具有重要意义。

通过提取遥感影像中的建筑、道路等特定特征,可以分析城市的发展趋势和扩张方向,为城市规划和交通规划提供数据支持。

遥感影像处理中的分类与目标提取方法

遥感影像处理中的分类与目标提取方法遥感影像处理是利用遥感技术获取的遥感影像数据进行分析、处理和应用的过程。

在遥感影像处理中,分类和目标提取是非常重要的步骤。

分类是将遥感影像中的像素或区域划分到不同的类别中,而目标提取则是从遥感影像中提取出感兴趣的目标对象。

一、分类方法1.1 基于像素的分类方法基于像素的分类方法是将遥感影像中的每一个像素点都进行分类,常见的分类方法包括最大似然分类、支持向量机和随机森林等。

这些方法通过对每个像素的特征进行分析,将其划分到最适合的类别中。

1.2 基于目标的分类方法与基于像素的分类方法不同,基于目标的分类方法将遥感影像中的目标对象作为分类的基本单元。

例如,在城市遥感影像中,目标可以是建筑物、道路或植被等。

这种方法首先对目标进行提取,然后通过对提取的目标进行特征分析和分类。

二、目标提取方法2.1 基于形状特征的目标提取方法基于形状特征的目标提取方法主要是通过对目标的形状进行分析和比较来提取目标。

例如,可以使用边缘检测算法来提取目标的轮廓,然后通过对轮廓的形状进行分析和比较。

这种方法适用于目标具有明显边界和规则形状的情况,如建筑物和道路等。

2.2 基于纹理特征的目标提取方法基于纹理特征的目标提取方法通过对目标的表面纹理进行分析和比较来提取目标。

例如,可以使用纹理特征提取算法来提取目标的纹理特征,然后通过对纹理特征的分析和比较来判断目标。

这种方法适用于目标具有特殊的纹理特征的情况,如森林和农田等。

2.3 基于深度学习的目标提取方法近年来,随着深度学习的发展,基于深度学习的目标提取方法在遥感影像处理中得到了广泛的应用。

深度学习通过构建深度神经网络模型,可以从遥感影像中学习到更高级别的特征表示,从而实现更准确的目标提取。

例如,可以使用卷积神经网络来提取目标的特征,然后通过对特征进行分类或分割来提取目标。

三、遥感影像处理中的挑战在分类和目标提取的过程中,遥感影像处理面临着一些挑战。

matlab目标与背景的分割与提取

matlab目标与背景的分割与提取"Matlab目标与背景的分割与提取"目标与背景的分割与提取是计算机视觉和图像处理中的重要课题,它涉及到将图像中的目标与背景进行有效的分离与提取。

Matlab 作为一种强大的编程工具,为我们提供了丰富多样的图像处理函数和工具箱,可以帮助我们实现目标与背景的分割与提取任务。

本文将一步一步地介绍如何使用Matlab来进行目标与背景的分割与提取。

首先,我们需要加载并显示图像。

在Matlab中,可以使用imread 函数来读取图像数据,并使用imshow函数来显示图像。

例如,下面的代码将加载并显示一张名为"image.jpg"的图像:matlabimage = imread('image.jpg');imshow(image);接下来,我们可以使用Matlab的图像处理函数来对图像进行预处理,以便更好地进行目标与背景的分割与提取。

常见的预处理操作包括图像灰度化、图像平滑和图像增强等。

首先,我们可以使用rgb2gray函数将彩色图像转换为灰度图像。

灰度图像只包含一个亮度通道,而彩色图像包含红、绿、蓝三个通道,因此灰度图像更便于对比度和亮度的调整。

例如,下面的代码将将图像转换为灰度图像:matlabgrayImage = rgb2gray(image);然后,我们可以使用图像平滑操作来减少图像中的噪声,以便更准确地进行目标与背景的分割与提取。

常见的图像平滑算法有高斯滤波和中值滤波。

例如,下面的代码将使用高斯滤波对灰度图像进行平滑处理:matlabsmoothImage = imgaussfilt(grayImage);imshow(smoothImage);最后,我们可以使用图像增强操作来增强图像的对比度和清晰度,以便更好地进行目标与背景的分割与提取。

常见的图像增强算法有直方图均衡化和自适应直方图均衡化等。

例如,下面的代码将使用直方图均衡化对平滑后的图像进行增强处理:matlabenhancedImage = histeq(smoothImage);imshow(enhancedImage);在图像预处理完成后,我们可以使用Matlab的图像分割算法来实现目标与背景的分割与提取。

阈值分割原理

阈值分割原理介绍阈值分割是一种常用的图像处理技术,用于将图像分为不同的区域,以实现目标检测和图像分析等应用。

本文将详细介绍阈值分割的原理和应用。

原理阈值分割的原理是基于图像的灰度级别将像素分为不同的区域。

首先,选择一个阈值。

然后,将图像的每个像素与该阈值进行比较,将像素值超过阈值的像素归为一个区域,将像素值低于阈值的像素归为另一个区域。

这样就实现了图像的分割。

应用阈值分割在很多图像处理技术中都有广泛的应用。

下面列举了一些常见的应用场景。

1. 目标检测阈值分割可用于目标检测。

通过将高于某个阈值的像素视为目标,就可以在图像中提取出目标区域。

2. 图像分析阈值分割可用于图像分析。

例如,可以将图像中的背景与前景分离,从而实现图像的特征提取和目标识别。

3. 图像增强阈值分割可以用于图像增强。

通过调整阈值的大小,可以改变图像的亮度和对比度,从而提升图像的质量。

阈值分割可以将图像分割成不同的区域。

这对于图像分析和图像处理来说是非常重要的,可以提取出图像中的各个部分以进行进一步的处理和分析。

阈值选择方法选择合适的阈值是阈值分割的一个关键步骤。

下面介绍几种常见的阈值选择方法。

1. 固定阈值固定阈值是一种简单直观的阈值选择方法。

通过计算图像的全局平均值或者直方图的峰值来确定一个固定的阈值。

但是这种方法无法处理光照不均匀或者图像噪声较大的情况。

2. 自适应阈值自适应阈值是一种根据图像局部特性来选择阈值的方法。

它将图像分成若干个子区域,在每个子区域内计算局部平均值或者局部直方图的峰值,作为该子区域的阈值。

这样能够有效处理光照不均匀和噪声干扰的情况。

3. 基于聚类的阈值选择基于聚类的阈值选择方法将像素值作为聚类的特征,通过聚类分析来选择阈值。

常见的方法有Otsu算法和K-means算法。

这种方法可以自动选择最佳的阈值,适用于不同类型的图像。

优化技术为了提高阈值分割的性能和效果,可以采用一些优化技术。

1. 预处理在进行阈值分割之前,可以对图像进行预处理。

roi提取方法

roi提取方法ROI提取方法是一种常用的图像处理技术,它可以帮助我们从图像中提取出感兴趣的区域,从而实现图像分割、目标检测等应用。

本文将介绍ROI提取方法的原理、常用算法以及应用场景。

一、ROI提取方法的原理ROI提取方法的原理是基于图像的像素值进行分析和处理。

在图像中,每个像素都有一个对应的灰度值或颜色值,这些值可以用来描述像素的特征。

ROI提取方法就是通过对图像像素值的分析,找到感兴趣的区域,并将其从图像中分离出来。

二、常用的ROI提取算法1. 阈值分割法阈值分割法是一种简单而常用的ROI提取算法。

它的原理是将图像中的像素值与一个预设的阈值进行比较,将大于阈值的像素标记为目标区域,将小于阈值的像素标记为背景区域。

这样就可以将目标区域从背景区域中分离出来。

2. 区域生长法区域生长法是一种基于像素相似性的ROI提取算法。

它的原理是从一个种子点开始,将与该点相邻的像素逐个加入到目标区域中,直到达到一定的相似性阈值为止。

这样就可以将目标区域从背景区域中分离出来。

3. 边缘检测法边缘检测法是一种基于图像边缘特征的ROI提取算法。

它的原理是通过检测图像中的边缘,将目标区域从背景区域中分离出来。

常用的边缘检测算法包括Sobel算子、Canny算子等。

三、ROI提取方法的应用场景1. 图像分割图像分割是指将图像分成若干个互不重叠的区域,每个区域内具有相似的像素特征。

ROI提取方法可以帮助我们从图像中提取出感兴趣的区域,从而实现图像分割。

2. 目标检测目标检测是指在图像中检测出特定的目标物体。

ROI提取方法可以帮助我们从图像中提取出目标物体的区域,从而实现目标检测。

3. 医学影像分析医学影像分析是指对医学影像进行分析和处理,以帮助医生进行诊断和治疗。

ROI提取方法可以帮助我们从医学影像中提取出感兴趣的区域,从而实现医学影像分析。

ROI提取方法是一种非常重要的图像处理技术,它可以帮助我们从图像中提取出感兴趣的区域,从而实现图像分割、目标检测等应用。

遥感图像的分割与目标提取方法

遥感图像的分割与目标提取方法近年来,随着科技的飞速发展,遥感图像在各个领域得到了广泛的应用。

然而,遥感图像中的目标提取和分割一直是一个具有挑战性的问题。

本文将介绍一些常用的遥感图像分割和目标提取方法,以及它们的优势和不足之处。

首先,传统的阈值分割方法是最简单和最常见的一种方法。

它基于图像像素的灰度值或颜色等特征进行分割。

然而,由于遥感图像的复杂性,单纯的阈值分割往往无法得到满意的结果。

例如,在大面积的农田中,由于农作物的生长状况不同,颜色和亮度也有所不同,采用单一的阈值就无法准确地提取出农作物的区域。

为了克服传统阈值分割的不足,图像分割中引入了聚类算法。

聚类算法的基本思想是将图像像素根据其特征进行分组。

常用的聚类算法有K均值聚类和谱聚类等。

通过聚类算法,可以将遥感图像中的目标区域与背景区域分开,提高分割的准确性。

然而,聚类算法对于图像噪声和复杂背景的鲁棒性不强,容易引入错误的分割结果。

另一种常见的图像分割方法是基于边缘检测的方法。

边缘检测可以有效地检测图像中的目标边界,从而实现目标的分割。

常用的边缘检测算法包括Sobel算子、Canny算子和Laplacian算子等。

这些算子可以通过计算图像像素值的梯度来检测目标边缘。

然而,边缘检测算法对于噪声和纹理等复杂情况的处理效果较差。

此外,边缘检测结果通常是不连续的,需要进一步进行处理才能得到完整的目标区域。

为了克服传统方法的不足,近年来,深度学习方法在图像分割中得到了广泛应用。

深度学习方法通过构建卷积神经网络(CNN)模型,可以自动从训练数据中学习目标的特征表示,并实现精确的分割和目标提取。

例如,U-Net模型是一种常用的用于遥感图像分割的深度学习模型。

它通过将输入图像和输出分割图像进行级联,可以保留更多的低级特征,从而提高分割的准确性。

此外,还有一些基于注意力机制的深度学习模型,可以对目标区域进行重点关注,提高分割的效果。

尽管深度学习方法在遥感图像分割中取得了显著的成果,但仍然存在一些挑战。

二阶段目标检测算法

二阶段目标检测算法一、区域提取阶段:区域提取阶段的主要功能是对输入图像进行初步处理,提取出可能含有目标的区域。

这个阶段的主要任务是减少计算量,降低后续处理的复杂度。

常用的区域提取算法有以下几种:1. Selective Search:Selective Search是一种基于图像分割的区域提取算法。

它将图像分割成多个不同的区域,并根据这些区域的相似性进行合并,从而得到候选区域。

Selective Search具有较好的召回率和准确率,适用于检测尺度变化较大的目标。

2. Edge Boxes:Edge Boxes是一种基于边缘信息的区域提取算法。

它使用了候选区域的边缘响应作为指标,从而提取出可能的目标区域。

Edge Boxes算法的特点是简单高效,适用于处理大规模的图像数据。

3. Region Proposal Network (RPN):RPN是一种通过深度学习网络自动学习生成候选区域的方法。

它将图像输入到一个神经网络中,通过网络的输出得到候选区域。

RPN算法的优点是能够自动学习提取特征,并具有较好的准确率和召回率。

二、目标分类与定位阶段:目标分类与定位阶段主要是对提取出的候选区域进行进一步的处理和分类,确定每个区域是否含有目标,并对目标进行定位。

常用的目标分类与定位算法有以下几种:1.卷积神经网络(CNN):CNN是一种用于图像分类和定位的深度学习算法。

它通过多层卷积和池化操作,从输入图像中提取特征,并通过全连接层进行目标分类和定位。

CNN算法的优点是能够自动学习提取特征,并具有较好的准确率。

2. Faster R-CNN:Faster R-CNN是一种基于深度学习的目标检测算法。

它使用RPN网络生成候选区域,并利用ROI Pooling和全连接层进行目标分类和定位。

Faster R-CNN算法具有较快的处理速度和较好的准确率,是目标检测领域的主流算法之一3. Mask R-CNN:Mask R-CNN是一种在Faster R-CNN的基础上进一步发展的算法。

图像处理中的图像分割与提取方法

图像处理中的图像分割与提取方法图像分割与提取在图像处理中是非常重要的技术,它能够将一幅图像分割成不同的区域,并且提取出感兴趣的目标。

图像分割与提取的应用广泛,涉及到医学图像分析、计算机视觉、遥感图像分析等领域。

本文将介绍几种常用的图像分割与提取方法。

1. 阈值分割阈值分割是最简单也是最常用的图像分割方法之一。

该方法通过设定一个或多个阈值,将图像分成不同的区域。

阈值的选取可以根据图像的特点和需求来确定。

在灰度图像中,通常使用单一阈值来分割图像;而在彩色图像中,可以同时对多个颜色通道进行分割,或者将颜色空间转换为其他颜色空间进行分割。

2. 区域生长区域生长是一种基于像素相似性的图像分割方法,其基本思想是选择一个或多个种子点,然后根据像素相似性的准则逐步生长区域,直到满足停止准则为止。

区域生长方法对于具有明显边界的目标图像分割效果较好。

在实际应用中,可以使用均值、标准差、梯度等准则来评估像素之间的相似性。

3. 边缘检测边缘检测是一种常用的图像提取方法,其目的是识别图像中的边界。

边缘是图像中像素灰度变化明显的地方,可以通过求取像素灰度值的梯度来检测。

常用的边缘检测算法包括Sobel算子、Prewitt算子、Canny算子等。

在实际应用中,边缘检测算法通常需要经过非极大值抑制、双阈值处理等步骤进行优化。

4. 分水岭算法分水岭算法是一种基于图论的图像分割算法,它模拟了水在图像中流动的过程。

该算法首先将图像中的亮度值作为高度值构建一个二维拓扑图,然后根据图像中的边缘信息和像素灰度值的梯度计算图像中各个区域的边界。

通过对边界进行变换,可以将图像分割成不同的区域。

分水岭算法在处理具有复杂纹理和连续边界的图像时效果较好。

5. 基于深度学习的方法近年来,基于深度学习的图像分割与提取方法取得了显著的进展。

通过搭建深度神经网络,可以利用大规模训练样本进行图像分割与提取任务。

常见的深度学习方法包括全卷积神经网络(FCN)、U-Net、Mask R-CNN等。

yolo的算法原理

标题:YOLO算法原理简析一、概述YOLO(You Only Look Once)是一种先进的实时目标检测算法,它通过将目标检测任务转化为单阶段的目标定位任务,实现了高性能的检测性能。

相比于传统的两阶段检测算法(如R-CNN系列算法),YOLO大大减少了计算复杂度和时间成本,成为当前深度学习在计算机视觉领域的重要应用之一。

二、算法原理1. 特征提取网络:YOLO采用了卷积神经网络(CNN)进行特征提取。

通过训练网络,可以学习到用于目标检测的图像特征。

相较于传统两阶段检测算法中的区域建议网络(RPN),YOLO直接从原始图像中提取特征,避免了生成候选区域的复杂过程。

2. 单阶段的目标定位:传统目标检测算法通常分为两个阶段:首先在候选区域(通常是人工选取或机器学习生成的)中识别目标,然后再对识别到的目标进行属性识别和位置精确定位。

而YOLO将这两个阶段合并为一个阶段,通过在特征图上进行网格定位,直接预测每个网格内是否存在目标以及目标的类别和位置。

3. 预测对象边界框:YOLO通过神经网络自动学习到不同类别目标的特征表示,并利用这些表示进行边界框的预测。

相较于传统算法需要手动设计或机器学习得到的边界框参数,YOLO 的预测更加灵活和准确。

4. 置信度与类别预测:YOLO不仅预测了目标边界框的坐标,还对每个预测的边界框给出了置信度分数,以及对目标的类别进行预测。

这些信息有助于更准确地识别和定位目标。

总结,YOLO通过将目标检测任务转化为单阶段的目标定位任务,利用卷积神经网络进行特征提取,以及预测对象边界框和置信度分数,实现了高性能的检测性能。

同时,其简化的流程和自动学习的特征表示,使得YOLO在实时目标检测任务中具有显著的优势。

hog方法

hog方法HOG方法:从图像中提取特征的有效方法引言在计算机视觉领域,图像特征提取是一项重要的任务。

特征提取通常用于图像分类、目标检测和目标跟踪等应用中。

HOG (Histogram of Oriented Gradients)方法是一种常用的图像特征提取方法,它通过计算图像局部区域的梯度直方图来描述图像的特征,被广泛应用于人脸识别、行人检测等领域。

HOG方法的原理HOG方法的基本思想是将图像分割成小的重叠区域,并计算每个区域内的梯度直方图。

具体步骤如下:1. 图像预处理:首先,需要对图像进行预处理,包括图像归一化、灰度化和高斯平滑等操作。

这些预处理步骤有助于降低噪声的影响,并提高特征的稳定性。

2. 计算梯度:接下来,需要计算图像中每个像素点的梯度。

通常使用Sobel算子对图像进行卷积操作,得到每个像素点的梯度幅值和方向。

3. 划分单元格:将图像分割成小的单元格,通常为16×16像素大小。

每个单元格内包含一定数量的像素点。

4. 构建梯度直方图:对每个单元格内的像素点,根据其梯度方向,将其投票到相应的梯度直方图中。

梯度直方图可以反映该单元格内的梯度分布情况。

5. 归一化:为了保持特征的不变性,需要对梯度直方图进行归一化处理。

通常使用块归一化的方法,将若干个相邻单元格的梯度直方图进行拼接,并进行L2范数归一化。

6. 特征向量表示:最终,将所有归一化后的梯度直方图拼接成一个特征向量,即HOG特征向量。

该特征向量可以用于后续的分类、检测和跟踪任务。

HOG方法的优势HOG方法在图像特征提取中具有以下优势:1. 不受光照变化的影响:HOG方法基于局部梯度的计算,对光照变化不敏感。

这使得HOG方法在人脸识别、行人检测等应用中具有较好的鲁棒性。

2. 提取局部纹理信息:HOG方法通过计算梯度直方图,可以有效地提取图像的局部纹理信息。

这些纹理信息对于物体的识别和检测非常重要。

3. 低维度特征表示:HOG方法提取的特征向量维度相对较低,不仅节省了存储空间,也降低了后续分类和检测任务的计算复杂度。

图像分割区域生长法

江苏科技大学数字图像处理图像分割——区域生长法专题1 图像分割简介图像分割( image segmentation) 就是把图像分成各具特征的区域并提取出感兴趣目标的技术和过程。

这里特征可以是象素的灰度、颜色、纹理等, 预先定义的目标可以对应单个区域也可以对应多个区域。

图像分割是图像处理到图像分析的关键步骤, 在图像工程中占据重要的位置。

一方面, 它是目标表达的基础, 对特征测量有重要的影响。

另一方面, 因为图像分割及其基于分割的目标表达、特征提取和参数测量等将原始图像转化为更抽象更紧凑的形式, 使得更高层的图像分析和理解成为可能。

图像分割是一种重要的图像处理技术, 它不仅得到人们的广泛重视和研究, 在实际中也得到大量的应用。

图像分割包括目标轮廓、阈值化、图像区分或求差、目标检测、目标识别、目标跟踪等技术。

从大的方面来说,图像分割方法可大致分为基于区域的方法、基于边缘的方法、区域与边缘相结合的方法,以及在此基础上的采用多分辨率图像处理理论的多尺度分割方法。

其中基于区域的方法采用某种准则,直接将图像划分为多个区域。

而基于边缘的方法则通过检测包含不同区域的边缘,获得关于各区域的边界轮廓描述,达到图像分割的目的,而区域与边缘相结合的方法通过区域分割与边缘检测的相互作用,得到分割结果。

图像分割中基于区域的方法主要有直方图门限法、区域生长法、基于图像的随机场模型法、松弛标记区域分割法等。

本文主要讨论基于区域分割的区域生长法。

区域生长是一种古老的图像分割方法,最早的区域生长图像分割方法是由Levine等人提出的。

该方法一般有两种方式,一种是先给定图像中要分割的目标物体内的一个小块或者说种子区域,再在种子区域基础上不断将其周围的像素点以一定的规则加入其中,达到最终将代表该物体的所有像素点结合成一个区域的目的;另一种是先将图像分割成很多的一致性较强,如区域内像素灰度值相同的小区域,再按一定的规则将小区域融合成大区域,达到分割图像的目的,典型的区域生长法如T. C. Pong等人提出的基于小面(facet)模型的区域生长法,区域生长法固有的缺点是往往会造成过度分割,即将图像分割成过多的区域。

hog特征提取

hog特征提取HOG特征提取:基本原理与应用HOG(Histogram of Oriented Gradients)是一种计算机视觉领域常用的特征提取算法。

它可以在图像(或图像的局部区域)上提取出具有较强判别能力的特征,常用于目标检测、行人检测等任务。

本文将介绍HOG特征提取的基本原理和一些常见的应用。

一、HOG特征提取的基本原理HOG特征提取的基本原理可概括为以下几个步骤:1. 图像预处理:首先,需要对输入图像进行预处理。

常见的预处理方法包括图像灰度化、直方图均衡化等。

灰度化可以将彩色图像转换为灰度图像,减少计算量;直方图均衡化可以增强图像的对比度,有助于提取稳定的HOG特征。

2. 计算图像梯度:在预处理后的图像上计算梯度。

梯度可以描述图像中每个像素处的灰度变化情况。

一般采用Sobel算子对图像进行卷积操作,得到图像在水平和垂直方向上的梯度值。

梯度可以表达图像的纹理和边缘信息,是HOG特征提取的基础。

3. 划分图像为小块:将整个图像划分为若干个小块,通常是以4×4像素为单位进行划分。

每个小块称为一个细胞(cell)。

这种划分方式可以保留图像的空间结构信息,并减少计算复杂度。

4. 统计每个细胞的梯度直方图:对于每个细胞,统计其内部像素的梯度直方图。

梯度直方图表示了每个细胞内部的梯度分布情况。

一般将梯度方向分为若干个方向区间(一般为9个),统计每个方向区间内的梯度强度。

通过梯度直方图,可以反映出图像中纹理的局部特征。

5. 组合细胞的梯度直方图:将多个细胞的梯度直方图进行组合,得到更高层次的特征表示。

一种常用的方法是将图像划分为若干个块(block),每个块包含若干个细胞。

对于每个块内的细胞,可以将其梯度直方图进行拼接,形成一个更长的向量表示该块的特征。

6. 进行归一化:对于每个块的特征向量,进行归一化处理,使其对光照变化等因素具有更好的鲁棒性。

常用的归一化方法有L2范数和L1范数等。

7. 得到最终的特征向量:将所有块的特征向量进行拼接,得到最终的特征向量表示整个图像。

目标检测经典算法

目标检测经典算法目标检测是计算机视觉领域的重要问题之一。

其任务是在图像中定位出物体的位置并且给出对应的类别。

在实际应用中,目标检测技术广泛应用于自动驾驶、智能安防、工厂产线等多个领域。

目前,目标检测算法已经达到了极高的精度和速度,并且还在不断地进行改进和优化。

下面将介绍目标检测的一些经典算法。

一、基于图像区域提取的目标检测算法基于图像区域提取的目标检测算法与分类器密切相关。

其基本思想是首先在图像中生成一些可能包含物体的区域,然后对这些图像区域进行分类来确定物体的类别。

这类算法包括Selective Search、EdgeBoxes 等。

1. Selective SearchSelective Search是基于启发式搜索的目标检测算法。

其可以在不同尺度和分辨率下生成大量的候选区域。

具体来说,它使用类似于人类视觉系统的方式来不断地合并相邻的像素,直到整个图像被分成了一组连通的区域。

然后,使用其他算法来筛选出可能包含物体的候选区域,并且对这些候选区域进行分类。

2. EdgeBoxesEdgeBoxes算法是一种基于边缘的目标检测算法。

其使用边缘检测算法来检测出图像中的边缘,并且利用这些边缘来提取可能包含物体的候选区域。

与Selective Search不同,EdgeBoxes可以生成高质量的大型目标框,并且具有高效的性能。

二、基于深度学习的目标检测算法基于深度学习的目标检测算法是目前最为流行和高精度的算法。

这类算法通过训练深度神经网络来完成目标检测任务。

其中最著名的算法包括Faster R-CNN、YOLO、SSD等。

1. Faster R-CNNFaster R-CNN算法是一种基于区域提取网络(RPN)的目标检测算法。

其使用RPN来产生候选框,并且使用RoI池化层将候选框缩放为固定大小的特征图,然后输入到全连接层进行分类和位置回归。

2. YOLOYOLO算法(You Only Look Once)是一种单阶段目标检测算法。

图像处理中的目标检测算法的使用技巧

图像处理中的目标检测算法的使用技巧目标检测是图像处理中的一项关键任务,它可以识别图像中的特定物体并将其标记出来。

随着深度学习的发展,目标检测算法得到了巨大的改进和提升。

本文将介绍图像处理中常用的目标检测算法以及它们的使用技巧。

一、传统方法传统的目标检测方法主要基于特征工程和机器学习算法。

常见的传统方法包括HOG (Histogram of Oriented Gradients)、SIFT (Scale-Invariant Feature Transform) 和SURF (Speeded Up Robust Features)。

1. HOG特征:HOG是一种用于物体检测的特征表示方法。

它通过计算图像中的梯度方向直方图来描述图像的局部外观和形状特征。

使用HOG特征进行目标检测时,需要选择合适的窗口大小和步长,以及适当的训练样本。

2. SIFT特征:SIFT是一种用于图像局部特征提取和匹配的算法。

它通过检测和描述图像中的关键点来表示图像的局部外观。

使用SIFT特征进行目标检测时,需要先检测关键点,然后计算关键点的描述子进行匹配。

3. SURF特征:SURF是一种类似于SIFT的图像特征描述算法,它具有更快的计算速度。

SURF特征的检测和匹配步骤与SIFT类似。

传统方法在某些场景下仍然具有优势,但由于其对图像特征的选择和机器学习算法的依赖,其准确度和鲁棒性相对较低。

二、深度学习方法深度学习方法近年来在目标检测领域取得了显著的突破,特别是基于卷积神经网络 (Convolutional Neural Networks, CNN) 的目标检测算法。

1. R-CNN (Region-based Convolutional Neural Networks):R-CNN是一种经典的基于区域的CNN目标检测方法。

它首先在图像中选择候选区域,然后对每个候选区域进行特征提取和分类。

R-CNN在准确度上取得了很好的表现,但速度较慢。

单目标检测

单目标检测单目标检测是计算机视觉领域中的重要任务之一,目标是从给定的图像中准确地检测出图像中的目标物体。

单目标检测区别于多目标检测,它只关注在图像中存在的某一个特定目标物体。

在单目标检测任务中,常用的方法是基于深度学习的目标检测算法。

这些算法通常采用卷积神经网络(CNN)作为基础网络结构,用于提取图像的特征。

常用的CNN网络结构有Faster R-CNN、YOLO和SSD等。

在这些算法中,Faster R-CNN是最早提出的单目标检测算法之一,它通过使用候选区域提取网络(Region Proposal Network,简称RPN)生成一系列的候选区域,并利用这些候选区域进行目标检测。

Faster R-CNN相比于传统的目标检测算法,能够在准确性和速度上都有显著提升。

YOLO(You Only Look Once)是另一种常用的单目标检测算法,它将目标检测任务视为一个回归问题,通过将图像划分为预定义的网格,并对每个网格预测边界框和类别,从而实现目标检测。

YOLO算法具有很好的实时性能,但在精度上稍逊于Faster R-CNN。

SSD(Single Shot MultiBox Detector)是一种结合了Faster R-CNN和YOLO的算法,它在各个尺度上都预测目标的边界框和类别,通过多尺度的预测能够提高检测准确性。

SSD算法在速度和精度上都取得了很好的平衡。

除了这些经典的单目标检测算法,还有许多改进和优化的方法被提出,例如基于注意力机制的方法、基于语义分割的方法等。

这些方法都旨在提高单目标检测的准确性和鲁棒性。

单目标检测在许多应用场景中有着广泛的应用,例如智能监控、自动驾驶、无人机等。

在智能监控中,单目标检测能够帮助识别出特定的目标物体,例如人、车辆等,从而实现实时监控和安全预警。

在自动驾驶和无人机中,单目标检测可以用于识别和跟踪其他交通参与者,确保驾驶或飞行的安全性。

总之,单目标检测是计算机视觉领域中一个重要且具有挑战的任务。

opencvsharp区域提取

opencvsharp区域提取(原创版)目录1.OpenCVSharp 简介2.区域提取的概念和方法3.区域提取的应用实例正文1.OpenCVSharp 简介OpenCVSharp 是一款基于.NET 平台的开源计算机视觉库,它提供了丰富的图像处理和计算机视觉功能。

OpenCVSharp 基于 OpenCV 构建,因此它具有 OpenCV 的强大功能,同时它还具有.NET 平台的易用性和高效性。

在 OpenCVSharp 中,用户可以轻松地实现图像读取、显示、保存、转换、滤波、特征提取、目标检测、目标跟踪等操作。

2.区域提取的概念和方法区域提取是计算机视觉中的一种常用技术,它指的是从图像中提取感兴趣区域,以便进行后续的图像处理和分析。

区域提取在很多实际应用中都有重要意义,例如目标检测、目标跟踪、人脸识别等。

在 OpenCVSharp 中,有多种方法可以实现区域提取。

其中,最常见的方法是使用 ROI(Region of Interest,感兴趣区域)功能。

ROI 功能允许用户定义一个矩形区域,从而提取该区域内的图像。

在 OpenCVSharp 中,可以使用`ROI`类来创建一个 ROI 对象,然后使用该对象进行图像处理和分析。

3.区域提取的应用实例下面是一个使用 OpenCVSharp 进行区域提取的简单示例:```csharpusing System;using System.Drawing;using OpenCvSharp;class Program{static void Main(string[] args){// 读取图像Image img = Image.FromFile("image.jpg");// 创建 ROI 对象,提取右上角的区域Rectangle rect = new Rectangle(100, 100, 200, 200);ROI roi = new ROI(img, rect);// 显示提取的区域Console.WriteLine("Extracted region:");roi.Show();// 保存提取的区域roi.Save("extracted_region.jpg");}}```在这个示例中,我们首先使用`Image.FromFile`方法读取一张图像。

两阶段和单阶段目标检测算法流程

两阶段和单阶段目标检测算法流程下载温馨提示:该文档是我店铺精心编制而成,希望大家下载以后,能够帮助大家解决实际的问题。

文档下载后可定制随意修改,请根据实际需要进行相应的调整和使用,谢谢!并且,本店铺为大家提供各种各样类型的实用资料,如教育随笔、日记赏析、句子摘抄、古诗大全、经典美文、话题作文、工作总结、词语解析、文案摘录、其他资料等等,如想了解不同资料格式和写法,敬请关注!Download tips: This document is carefully compiled by theeditor. I hope that after you download them,they can help yousolve practical problems. The document can be customized andmodified after downloading,please adjust and use it according toactual needs, thank you!In addition, our shop provides you with various types ofpractical materials,such as educational essays, diaryappreciation,sentence excerpts,ancient poems,classic articles,topic composition,work summary,word parsing,copy excerpts,other materials and so on,want to know different data formats andwriting methods,please pay attention!两阶段和单阶段目标检测算法流程两阶段目标检测算法流程:1. 第一阶段:生成候选框,使用区域提议网络(RPN)或选择性搜索等方法从图像中提取候选区域。

单目测距算法

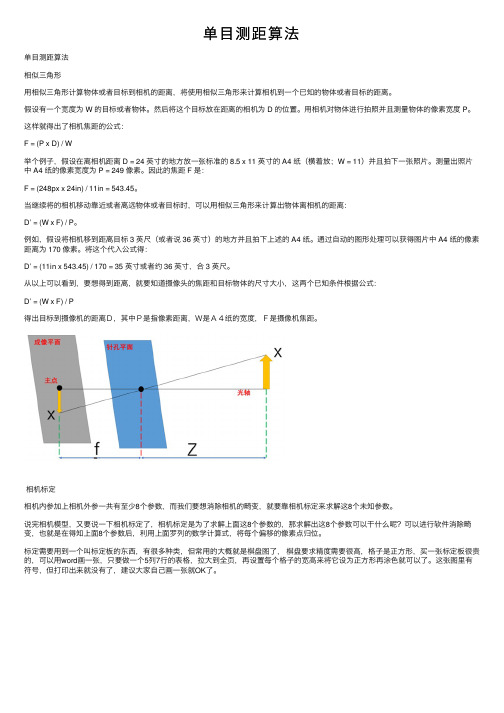

单⽬测距算法单⽬测距算法相似三⾓形⽤相似三⾓形计算物体或者⽬标到相机的距离,将使⽤相似三⾓形来计算相机到⼀个已知的物体或者⽬标的距离。

假设有⼀个宽度为 W 的⽬标或者物体。

然后将这个⽬标放在距离的相机为 D 的位置。

⽤相机对物体进⾏拍照并且测量物体的像素宽度 P。

这样就得出了相机焦距的公式:F = (P x D) / W举个例⼦,假设在离相机距离 D = 24 英⼨的地⽅放⼀张标准的 8.5 x 11 英⼨的 A4 纸(横着放;W = 11)并且拍下⼀张照⽚。

测量出照⽚中 A4 纸的像素宽度为 P = 249 像素。

因此的焦距 F 是:F = (248px x 24in) / 11in = 543.45。

当继续将的相机移动靠近或者离远物体或者⽬标时,可以⽤相似三⾓形来计算出物体离相机的距离:D’ = (W x F) / P。

例如,假设将相机移到距离⽬标 3 英尺(或者说 36 英⼨)的地⽅并且拍下上述的 A4 纸。

通过⾃动的图形处理可以获得图⽚中 A4 纸的像素距离为 170 像素。

将这个代⼊公式得:D’ = (11in x 543.45) / 170 = 35 英⼨或者约 36 英⼨,合 3 英尺。

从以上可以看到,要想得到距离,就要知道摄像头的焦距和⽬标物体的尺⼨⼤⼩,这两个已知条件根据公式: D’ = (W x F) / P 得出⽬标到摄像机的距离D,其中P是指像素距离,W是A4纸的宽度,F是摄像机焦距。

相机标定相机内参加上相机外参⼀共有⾄少8个参数,⽽我们要想消除相机的畸变,就要靠相机标定来求解这8个未知参数。

说完相机模型,⼜要说⼀下相机标定了,相机标定是为了求解上⾯这8个参数的,那求解出这8个参数可以⼲什么呢?可以进⾏软件消除畸变,也就是在得知上⾯8个参数后,利⽤上⾯罗列的数学计算式,将每个偏移的像素点归位。

标定需要⽤到⼀个叫标定板的东西,有很多种类,但常⽤的⼤概就是棋盘图了,棋盘要求精度需要很⾼,格⼦是正⽅形,买⼀张标定板很贵的,可以⽤word画⼀张,只要做⼀个5列7⾏的表格,拉⼤到全页,再设置每个格⼦的宽⾼来将它设为正⽅形再涂⾊就可以了。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

西安理工大学研究生课程论文课程名称:数字图像分析课程代号:任课教师:论文题目:单目标图像的目标区域提取完成日期:2015 年 1 月13 日学科:姓名:单目标图像的目标区域提取摘要:图像分割的目的是将图像划分为不同的区域,区域增长是一种根据事先定义的准则将像素或子区域聚合成为更大的区域的过程,分裂合并是根据一致性准则处理目标和背景之间灰度渐变图像的典型算法。

本文以单目标图像为对象,通过区域增长和分裂合并的方法实现了对目标区域的提取,并对实验结果进行了分析。

关键字:图像分割;区域增长;分裂合并;二值化Abstract:The purpose of image segmentation is to divide the image into different areas, regional growth is a kind of according to predefined criteria will become more pixels or subdomain polymerization process of large area, split the merger is processed according to the consistency criterion between target and background gray gradient image of typical algorithm. Based on the single target image as the object, through regional growth and division merge method to extract the target area is achieved, and the experiment results are analyzed.Key words:Image segmentation;Regional growth;Split the merger;binarization 1引言数字图像处理的目的之一是图像识别, 而图像分割与测量是图像识别工作的基础。

图像分割是将图像分成一些有意义的区域, 然后对这些区域进行描述, 相当于提取出某些目标区域图像的特征, 判断图像中是否有感兴趣的目标。

图像分割是图像处理到图像分析的关键步骤,在图像工程中占据重要的位置。

一方面,它是目标表达的基础,对特征测量有重要的影响。

另一方面,因为图像分割及其基于分割的目标表达、特征提取和参数测量等将原始图像转化为更抽象更紧凑的形式,使得更高层的图像分析和理解成为可能。

2技术分析2.1图像分割图像分割就是将待处理的图像表示为物理上有意义的连通区域的集合,一般是通过对图像的不同特征如纹理、颜色、边缘、亮度等特征的分析,来达到图像分割的目的。

图像分割通常是为了进一步对图像进行分析、理解、识别、处理、跟踪等,分割的准确性直接影响到后续任务的有效性,因此分割在图像处理中具有十分重要的意义。

图像分割可以依据图像中每个像素的颜色、灰度、纹理信息和几何性质等特征,将图像中具有某些特殊含义的不同区域区分开,分割后所形成的这些区域是互不重叠的,并且每个区域都满足特定区域的一致性。

分割出来的区域应该同时满足]1[:(1)分割出来的图像区域的均匀性和连通性。

(2)相邻分割区域之间针对选定的某种特征具有明显的差异。

(3)分割区域边界应该规整,同时保证边缘的空间定位精度。

根据图像分割的处理方式不同,可以将基于区域的图像分割算法分为以下三大类:a.阈值法;b.区域生长和分裂合并法;c.基于统计学的算法。

常见的经典的图像分割技术有:并行边界分割技术、串行边界分割技术、并行区域分割技术和串行区域分割技术。

串行区域分割技术指采用串行处理的策略通过对目标区域的直接检测来实现图像分割的技术, 它的特点是将整个处理过程分解为顺序的多个步骤逐次进行, 对后继步骤的处理要对前面已完成步骤的处理结果进行判断而确定。

这里的判定要根据一定的准则, 一般来说如果准则是基于图像灰度特性的, 则这个方法可以用于灰度图像分割。

基于区域的串行分割技术有两种基本的形式, 一是从单个象素出发, 渐渐合并以形成所需的分割区域, 二是从整个图出发, 分裂切割至所需要的分割区域, 第一种方法的典型技术就是区域增长。

本文主要讨论的就是区域增长算法和分裂合并算法。

2.2区域增长算法基于区域生长的算法的基本思想是把具有相似性质的像素归并在同一个区域内。

像素的相似性判定包括图像的纹理信息、灰度值、颜色等其他像素特性。

该算法首先对需要分割的每个区域选取一个种子像素,作为区域生长的起点位置,然后将种子像素与周围邻域内的像素进行相似性比较,如果满足约定好的相似性准则或生长准则,就把当前比较的像素合并到种子像素所在的区域。

再利用新合并进去的像素作为种子点,与它周围的像素进行相似性比较,直到没有满足条件的像素可以被合并进来就表示完成了一个区域的生长过程。

下图中给出了一个已知种子点进行区域生长的示例。

图 2-1(a)表示需要分割的图像,设已知有两个种子像素(用下划线标注),现进行区域生长。

这里选取的合并准则是:如果种子像素的灰度值与邻域像素的灰度值之差小于等于门限值 T ,则将当前比较的像素归并到种子像素所在的区域。

图 2-1(b)给出了 T=3 时的结果,图像被分割为两个区域。

图 2-1(c)给出的是 T=1 时的结果,从图中可以看出分割结果中存在着较小的区域,产生了过分割现象。

图 2-1(d)给出的是当 T=6 时的分割结果,该图显示图像中的所有像素都在一个区域内,没有达到分割图像的目的。

因此可见,门限值的选取对于分割结果的好坏起着决定性的作用]3[。

(a)原图 (b)T=3(c)T=1 (d)T=6图2-1原图像和 T 取不同值的区域生长结果算法的好坏取决于三个要素:(1)如何选择一组能够正确代表所选区域的种子像素;(2)如何确定在生长过程中能将相邻像素合并进来的准则;(3)如何确定生长终止的条件或规则。

其优点是当区域的相似性准则和生长终止的条件比较容易找到时,可以取得较好的分割效果。

但是,该算法在生长过程中考虑的只是当前种子点像素与周围邻域像素的相似性也即仅考虑了图像的局部信息,没有考虑生长的过程,对于变化特征比较缓慢的图像不能得到较好的分割效果。

另外,种子像素点的选取和生长准则的确定直接影响到分割的效果图,如果选取不当则可能造成过分割或不能有效分割的问题(如图 2-1(c)和图2-1(d)所示)。

区域增长的关键是相似性准则也即区域生长准则的选取,相似性准则依赖于图像的灰度、纹理等信息。

使用不同的增长准则会影响到图像的最终分割结果。

最简单的生长准则是基于灰度信息的生长准则。

区域生长法是以区域为处理对像的, 它考虑到区域内部和区域之间的同异性, 尽量保持区域中像素的临近性和一致性的统一。

这样就可以更好地分辨图像真正的边界。

基于区域的分割方法的关键在于定义一个一致性准则, 用来判断两个邻接的区域是否可以合并, 一致则将两区域合并, 直到不能合并为止。

区域增长是以像素为基本单位进行操作的,基于灰度信息的区域生长算法实现过程]4[:(1)顺序扫描图像,找到第一个还没有被合并的像素,设该像素为()00,y x 。

(2)以()00,y x 为中心,考虑()00,y x 的4邻域像素,将该像素周围邻域内的像素()y x ,与之进行比较,如果点()y x ,与()00,y x的灰度值之差小于预先设定的值,则将它们合并在同一个区域内,同时将()y x ,压入堆栈。

(3)从堆栈中取出一个像素作为中心像素()00,y x ,返回执行步骤(2)。

(4)当堆栈为空时,回到步骤(1)。

(5)重复(1)-(4)步,直到图像中的每个像素点都不能满足归并条件,增长结束。

2.3分裂与合并算法分裂合并算法是处理目标和背景之间灰度渐变图像的典型算法。

它首先选取一致性准则,然后根据这一准则将图像分成四个区域,并分别判断这些区域是否满足一致性准则。

如果不满足,则继续分割;否则,将满足准则的所有区域放在一起重新判断他们合并如此反复,直到不能再分割也不能再合并为止。

分裂合并算法并不需要向区域增长法那样预先指定种子,它的研究重点是分裂和合并的规则设计]5[。

分裂合并算法的分割原理:从整个图像出发,根据图像和各区域的不均匀性,把图像或区域分裂成新的子区域;根据毗邻区域的均匀性,把毗邻的子区域合并成新的较大区域。

设用R 表示整个图像,用i R 表示分割成的一个图像区域;并假设同一区域i R 中的所有像素都满足某一相似性准则时,TRUE R P i =)(,否则FALSE R P i =)(。

当TRUE R P i =)(时,不再进一步分割该区域;当FALSER P i =)(时,继续将该区域分成大小相同的四个更小的象限区域。

在这种分割过程中,必定存在h R 的每个子区域j R 与l R 的某个子区域k R 具有相同性质,也即TRUE R R P k j =)( 时,这时就可以吧j R 和k R 合并组成新的区域]6[。

如图2-2所示。

图2-2 分割示意图3实现流程本程序在VS 2010下采用C++语言实现,这里以对印章图像的特征提取为例,在处理图像之前需要对图像做二值化处理,采集的印章图像可以划分为三个部分:白色或灰色的背景区域;红色(为主)印章代表的目标区域以及干扰噪声;黑色或蓝色的手写体签名、印刷体文字或底纹。

当对一幅图像进行分割时,使用两个不同的灰度级对其分割结果区分,把前景像素点的灰度值都赋为a,如O,而所有的背景像素灰度值都赋为b,如1或255。

a与b是不相等的,这样就可在结果图像中区分出前景和背景了。

对于这种表示方法来说,图像分割的过程也就是将一幅多灰度级的图像转化为只有两个灰度级图像的过程。

只有两个灰度级的图像为二值图像,而由一幅多灰度级图像转化为二值图像的过程,我们称之为图像二值化]2[。

将彩色图像转化成灰阶图像时,常采用如下的经验公式:gray=0.3×R+0.59×G+0.11×B其中,gray为灰度值,R、G、B分别为红色、绿色、蓝色分量值,二值化图像就是把经过HSI模型红色提取的图像转化为0、1取值的二值化图像,具体做法是:如果Pixeli(R) threshold(R) 否则令:Pixeli (R)=0 Pixeli(R)=255Pixeli (G)=0 Pixeli(G)=255Pixeli (B)=0 Pixeli(B)=255其中:Pixeli (R)、Pixeli(G)、Pixeli(B)是图像中第i像素点的红、绿、蓝三基色值,threshold(R)为R基色的阈值。