第6章_近邻法

第6章 OSPF路由协议配置

6.1.2 链路状态协议的工作原理

1. 发现邻居 向所有可用网络发送Hello分组,依靠这种Hello协议,链路状态协议 实现邻居的发现。

2. 数据库同步 在确定了邻居之后,路由器将进行链路状态数据库(LSDB)的同步,主 要包括以下三个过程: (1)创建链路状态通告(LSA) 在创建链路状态通过的过程中,其中一个重要的步骤是计算出每个接 口的度量值。在OSPF中使用代价(cost)作为度量值。Cost为1到65535之间 的一个整数。不同厂商的代价计算方法不尽相同,但其一般原则是带宽越 高,代价越小(越优先)。思科的代价计算公式是108/带宽。 如果带宽大于100M的话,将产生1个小于1的小数,这是不允许的.因此从 IOS版本11.2之后,可以使用命令ospf auto-cost reference-bandwidth 来 修正这个问题,允许管理者更改缺省的参考带宽。

第6章 OSPF动态路由的配置

(时间:8学时)

第6章 动态路由的配置

学习目的与要求:

动态路由协议能够动态地反映网络的状态,当网络发 生变化时,网络中的路由器会把这个消息通告给其他的路 由器,最终所有的路由器将知道网络的变化,及时调整路 由表,从而保证数据包的正常传输。 学完本章,你将能够: 描述链路状态路由协议原理 熟练配置OSPF路由

6.2.1

OSPF协议概述

OSPF是开放标准同时性能远强于RIP协议,因此在大中型 网络中OSPF协议得到了普遍使用,其特点如下: (1)OSPF是自治系统内部使用的协议即内部网关协议,是 基于链路状态算法的路由协议。 (2)OSPF使用IP分组直接封装OSPF协议报文,协议号是89。 OSPF数据包的TTL值被设为1,即OSPF数据包只能被传送到 一跳范围之内的邻居路由器。 (3)OSPF当前主要使用的版本是针对IPv4开发的OSPFv2, 其协议的具体描述在RFC2328中。另外针对IPv6的OSPFv3 也开始使用,在RFC2470中确定了OSPFv3的基本标准。 (4)OSPF能快速收敛,当网络拓扑发生变化时,OSPF可以 立即发送更新报文,使这一变化在自治系统中同步。同时 OSPF这种不定时广播路由,也节省了带宽资源。

机器学习基础智慧树知到答案章节测试2023年太原理工大学

第一章测试1.样本是连续型数据且有标签,我们采用()进行机器学习。

A:嵌入算法B:聚类算法C:分类算法D:回归算法答案:D2.在机器学习中,样本常被分成()。

A:训练集B:其它选项都有C:测试集D:评估集答案:B3.机器学习算法需要显示编程,具备归纳、总结等自学习能力。

()A:错B:对答案:A4.机器学习和人工智能、深度学习是一个概念,都是指机器模仿人类推理、学习能力。

()A:错B:对答案:A5.特征工程非常重要,在采用机器学习算法前,首先需要利用特征工程确定样本属性。

()A:错B:对答案:B第二章测试1.K近邻算法认为距离越近的相似度越高。

()A:对B:错答案:A2.K近邻算法中数据可以不做归一化,因为是否归一化对结果影响不大。

()A:错B:对答案:A3.K近邻算法中采用不同的距离公式对于结果没有影响。

()A:错答案:A4.在上面图中,K=5,绿色样本的类别是()。

A:红色三角形B:蓝色正方形C:不能确定D:绿色圆形答案:B5.在K近邻算法中,K的选择是()?A:越大越好B:与样本有关C:其它都不正确D:越小越好答案:B第三章测试1.下列()中两个变量之间的关系是线性的。

A:猫的皮毛颜色和体重B:人的工作环境和健康状况C:重力和质量D:女儿的身高和父亲的体重答案:C2.下列说法不正确的是()。

A:线性回归模型也可以解决线性不可分的情况B:回归用于预测输入变量和输出变量之间的关系C:回归就是数据拟合D:回归分析就是研究两个事物的相关性答案:C3.从某大学随机选择8名女大学生,其身高x(cm)和体重y(kg)的回归方程是y=0.849x-85.712,则身高172cm的女大学生,预测体重为()。

A:60.316kgB:大于60.316kgC:小于60.316kgD:其它都不正确答案:Asso中采用的是L2正则化。

()A:错B:对答案:A5.线性回归中加入正则化可以降低过拟合。

()A:错答案:B第四章测试1.以下说法正确的是()。

第6章 医学图像基础(2)

具有最均匀直方图的增强图像可由下式计算:

g ( x , y ) = ( P − 1) ⋅ H ( f ( x , y ))

14

图(a)是原始脑图像,对应直方图(图 (b))中灰度分布很不均匀;图(c) 是归一化累加直方图。图(d)和图(e)是增强后的图像与直方图;图(f)是增强后 的归一化累加直方图,接近一条直线。经直方图均衡化处理后MRI脑图像中 的细节明显得到增强。

19

均值滤波 (Mean Filtering)

图像与尺度为 (2K+1)×(2L+1)核的卷积,核的元素值为总元 素个数的倒数,例如,当K=L=1时, ⎡ 1 1 1 ⎤ ⎡1 1 1⎤ 9 9 9

⎥ ⎢ 1 1 1 ⎥ = 1 ⎢1 1 1⎥ w(k, l) = ⎢ ⎥ ⎢ 19 19 19⎥ 9 ⎢ ⎦ ⎢ 9 9 9⎥ ⎢1 1 1⎥ ⎦ ⎣ ⎣

28

6.4.7频域增强技术

图像f(x, y)的富立叶变换f (u,v)定义为

1 F (u ,v ) = M ⋅N

M −1 N −1 x =0 y =0 ⎛ ux vy ⎞ − 2πj ⎜ + ⎟ ⎝M N ⎠

∑ ∑ f ( x , y )e

u = 0, 1, 2, … , M-1, v = 0, 1, 2, …, N-1 其中u,v 是空间频率参数。富氏变换给出图像的谱表示,可以参照频 谱,增强所需要的性质对系数进行调整,再通过富立叶逆变换,可以 得到该图像的空间域形式:

K

L

+ k )− i )

i = 0,1,..., P − 1

局部区域累加直方图:

j 1 H LA (x , y )( j ) = ∑ hLA ( x , y )( i ) (2 K + 1) ⋅ (2 L + 1) i =0

模式识别第4章 线性判别函数

w1。

44

4.3 判别函数值的鉴别意义、权空间及解空间 4.3.2 权空间、解矢量与解空间

(3) 解空间

w1

先看一个简

单的情况。设一

维数据1,2属于

w0

1, -1,-2属

于2 求将1和

2区分开的w0 ,

w1。

45

4.3 判别函数值的鉴别意义、权空间及解空间 4.3.2 权空间、解矢量与解空间

(3) 解空间

53

第四章 线性判别方法

4.1 用判别域界面方程分类的概念

有 4.2 线性判别函数 监 4.3 判别函数值的鉴别意义、权空间及解空间 督 4.4 Fisher线性判别 分 4.5 一次准则函数及梯度下降法 类 4.6 二次准则函数及其解法

4.7 广义线性判别函数

54

4.4 Fisher线性判别

这一工作是由R.A.Fisher在1936年的论文中 所提出的,因此称为Fisher线性判别方法。

0123456789

x1

d23(x)为正

d32(x)为正 d12(x)为正 d21(x)为正

i j两分法例题图示

24

25

3、第三种情况(续)

d1(xr) d2(xr)

1

2

d1(xr ) d3(xr )

3

d2 (xr ) d3(xr )

多类问题图例(第三种情况)

26

27

上述三种方法小结:

8

4.2 线性判别函数

9

10

11

d3(xr) 0

不确定区域

r

xr xrxr xr xr

x2

?

d1(x) 0

1

2

3

x1 d2(xr ) 0

第6-8章 图论2

5.设D是有向图,当且仅当D中有一条通过每个 D 结点的通路时,D为( )连通的。 答案:单向 6.设有向图D=<V,E>,V={a,b,c,d}, E={<a,b><a,d><d,c><b,d><c,d>},则D是 ( )连通的,c的可达集为(),d(c,a)=()

6.设有向图D=<V,E>,V={a,b,c,d,}, E={<a,b>,<a,d>,<d,c>,<b,d>,<c,d>}, 则D是( )连通的,c的可达集为( ),d(a,b)=() 答案:单向 {c,d} 7.图6-1的点连通度为(),边连通度为() 答案: 1 1 8.k5的点连通度为(),边连通度为()。 答案: 4 4

7.若无向图中恰有2个度数为奇数的结点,则这两个结 点必连通。( ) 答案:T 8.在有向图中,结点间的可达关系是等价关系。( ) 答案:F 9. 若有向图中有两个奇度结点,则它们中一个可达另 一个或互相可达。( ) 答案:F

10.若图G不连通,则 G 必连通。( ) 答案:T 11.有向图的每个结点恰位于一个单向分图中。( ) 答案:F 12.图6-3为无强分图( ) 答案:F 13.若图G的边e不包含在G的某简 图6-3 单回路中,则e是G的割边。( ) 答案:T

22.设G= <V,E>为连通的简单平面图,若|V|>=3,则 所有结点v,有deg(v)<=5.( ) 答案:F

第7章 树 章

树是图论中最重要的概念之一,它是基尔霍夫在解决 电路理论中求解联立方程时首先提出的。它又是图论 中结构最简单,用途最广泛的一种平面图,在计算机 科学的算法分析、数据结构等方面有着广泛的应用, 本章主要介绍树的基本概念、性质和若干应用。

模式识别(山东联盟)智慧树知到课后章节答案2023年下青岛大学

模式识别(山东联盟)智慧树知到课后章节答案2023年下青岛大学青岛大学第一章测试1.关于监督模式识别与非监督模式识别的描述正确的是答案:非监督模式识别对样本的分类结果是唯一的2.基于数据的方法适用于特征和类别关系不明确的情况答案:对3.下列关于模式识别的说法中,正确的是答案:模式可以看作对象的组成成分或影响因素间存在的规律性关系4.在模式识别中,样本的特征构成特征空间,特征数量越多越有利于分类答案:错5.在监督模式识别中,分类器的形式越复杂,对未知样本的分类精度就越高答案:错第二章测试1.下列关于最小风险的贝叶斯决策的说法中正确的有答案:条件风险反映了对于一个样本x采用某种决策时所带来的损失;最小风险的贝叶斯决策考虑到了不同的错误率所造成的不同损失;最小错误率的贝叶斯决策是最小风险的贝叶斯决策的特例2.我们在对某一模式x进行分类判别决策时,只需要算出它属于各类的条件风险就可以进行决策了。

答案:对3.下面关于贝叶斯分类器的说法中错误的是答案:贝叶斯分类器中的判别函数的形式是唯一的4.当各类的协方差矩阵相等时,分类面为超平面,并且与两类的中心连线垂直。

答案:错5.当各类的协方差矩阵不等时,决策面是超二次曲面。

答案:对第三章测试1.概率密度函数的估计的本质是根据训练数据来估计概率密度函数的形式和参数。

答案:对2.参数估计是已知概率密度的形式,而参数未知。

答案:对3.概率密度函数的参数估计需要一定数量的训练样本,样本越多,参数估计的结果越准确。

答案:对4.下面关于最大似然估计的说法中正确的是答案:在最大似然函数估计中,要估计的参数是一个确定的量。

;在最大似然估计中要求各个样本必须是独立抽取的。

;最大似然估计是在已知概率密度函数的形式,但是参数未知的情况下,利用训练样本来估计未知参数。

5.贝叶斯估计中是将未知的参数本身也看作一个随机变量,要做的是根据观测数据对参数的分布进行估计。

答案:对第四章测试1.多类问题的贝叶斯分类器中判别函数的数量与类别数量是有直接关系的。

哈工大模式识别课程7近邻法

,则

不可能是 不可能是 中的样本到

的最近邻。 的最近邻。 的

17

:当前已经涉及到的样本集 最 近距离。 近距离。

【搜索算法的基本思想 】

搜索算法的大体过程是这样的: 搜索算法的大体过程是这样的: 当搜索树形样本 集结构由高层次向低层次深入时, 由高层次向低层次深入时 集结构由高层次向低层次深入时,对同一层次的 所有结点,可以利用规则 规则1排除掉一些不可能包含 所有结点,可以利用规则 排除掉一些不可能包含 待识别样本的近邻的结点(样本子集 样本子集)。 待识别样本的近邻的结点 样本子集 。但是这往往 不能做到只留下唯一的待搜索结点,因此必须选 不能做到只留下唯一的待搜索结点,因此必须选 择其中某一结点先深入搜索, 择其中某一结点先深入搜索,以类似于深度优先 的方法确定搜索路径直至叶结点。 的方法确定搜索路径直至叶结点。然而在该叶结 点中找到的近邻并不能保证 不能保证确实是全样本集中的 点中找到的近邻并不能保证确实是全样本集中的 最近邻者, 最近邻者,所找到的该近邻样本需要在那些有可 能包含最近邻的样本子集中核对与修正,直至找 能包含最近邻的样本子集中核对与修正, 核对与修正 到真正的最近邻样本为止。 到真正的最近邻样本为止。

23

【基本步骤】

两分剪辑近邻法 假定样本集被分为两个独立的样本集-考试集和参考集,分别对 假定样本集被分为两个独立的样本集-考试集和参考集, 应于错误率估计中的考试集和设计集。 应于错误率估计中的考试集和设计集。 剪辑: 剪辑:利用参考集的中样本对考试集的每个样本利用最近邻法 进行分类决策,剪辑掉那些被参考集中样本错分类的样本, 进行分类决策,剪辑掉那些被参考集中样本错分类的样本, 然后将参考集中剩余样本构成剪辑样本集。 然后将参考集中剩余样本构成剪辑样本集。

机器学习原理及应用练习题答案

第一章机器学习概述1.机器学习研究什么问题,构建一个完整的机器学习算法需要哪些要素?机器学习主要研究如何选择统计学习模型,从大量已有数据中学习特定经验。

构建一个完整的机器学习算法需要三个方面的要素,分别是数据,模型,性能度量准则。

2.可以生成新数据的模型是什么,请举出几个例子可以生成新数据的模型是生成模型,典型的生成模型有朴素贝叶斯分类器、高斯混合模型、隐马尔可夫模型、生成对抗网络等。

3.监督学习、半监督学习和无监督学习是什么,降维和聚类属于哪一种?监督学习是指样本集合中包含标签的机器学习,无监督学习是无标签的机器学习,而半监督学习介于二者之间。

降维和聚类是无监督学习。

4.过拟合和欠拟合会导致什么后果,应该怎样避免?过拟合导致模型泛化能力弱,发生明显的预测错误,往往是由于数据量太少或模型太复杂导致,通过增加训练数据量,对模型进行裁剪,正则化的方式来缓解。

而欠拟合则会导致模型不能对数据进行很好地拟合,通常是由于模型本身不能对训练集进行拟合或者训练迭代次数太少,解决方法是对模型进行改进,设计新的模型重新训练,增加训练过程的迭代次数。

5.什么是正则化,L1正则化与L2正则化有什么区别?正则化是一种抑制模型复杂度的方法。

L1正则化能够以较大概率获得稀疏解,起到特征选择的作用,并且可能得到不止一个最优解。

L2正则化相比前者获得稀疏解的概率小的多,但得到的解更加平滑。

第二章逻辑回归与最大熵模型1.逻辑回归模型解决(B )A.回归问题B.分类问题C.聚类问题D.推理问题2.逻辑回归属于(B )回归A.概率性线性B.概率性非线性C.非概率性线性D.非概率性非线性3.逻辑回归不能实现(D )A.二分类B.多分类C.分类预测D.非线性回归4.下列关于最大熵模型的表述错误的是(B )A.最大熵模型是基于熵值越大模型越稳定的假设B.最大熵模型使用最大熵原理中一般意义上的熵建模以此缩小模型假设空间C.通过定义最大熵模型的参数可以实现与多分类逻辑回归相同的作用D.最大熵模型是一种分类算法5.下列关于模型评价指标的表述错误的是(C )A.准确率、精确率、召回率以及AUC均是建立在混淆矩阵的基础上B.在样本不平衡的条件下准确率并不能作为很好的指标来衡量结果C.准确率表示所有被预测为正的样本中实际为正的样本的概率D.一般来说,置信度阈值越高,召回率越低,而精确率越高6.简述逻辑回归的原理。

《数据科学导论》复习资料

《数据科学导论》复习资料本页仅作为文档封面,使用时可以删除This document is for reference only-rar21year.March《数据科学》课程期末复习资料《数据科学》课程讲稿章节目录:第一章导论第一节了解数据科学的基本概念第二节了解数据科学的应用第三节了解数据科学的过程第四节掌握数据科学的方法第二章数据获取及预处理第一节了解获取数据的途径和方法第二节掌握数据质量检验的方法第三节掌握数据清洗第四节掌握数据集成第五节掌握数据规约第六节掌握数据变换第三章数据分析第一节了解探索性数据分析的概念第二节掌握单变量分析方法第三节掌握多变量分析方法第四节掌握样本相似性与相异性分析的方法第四章特征工程第一节了解特征的介绍和创建过程第二节了解降维的基本概念第三节掌握主成分分析-PCA第四节掌握奇异值分解-SVD第五节了解特征选择的基本概念第六节掌握过滤式方法第七节了解产生特征子集的搜索策略第八节了解封装式方法第九节了解嵌入式方法第五章关联规则算法第一节了解关联规则的基本概念第二节掌握频繁项集的产生过程第三节掌握Apriori算法第六章分类算法第一节了解分类问题基本概念第二节掌握k近邻算法第三节了解贝叶斯定理第四节掌握朴素贝叶斯第五节了解决策树的基本概念第六节了解决策树-特征选择第七节了解决策树-剪枝算法第七章线性回归算法第一节了解线性回归的基本概念第二节掌握一元线性回归第三节掌握多元线性回归第八章人工神经网络第一节了解神经网络的基本概念第二节掌握感知机的学习算法第三节掌握多层感知机-反向传播算法第九章聚类算法第一节了解聚类问题的介绍第二节掌握层次聚类第三节掌握K-means聚类第四节了解BFR聚类一、客观部分:(单项选择、判断)(一)、选择部分1、通过构造新的指标-线损率,当超出线损率的正常范围,则可以判断这条线路的用户可能存在窃漏电等异常行为属于数据变换中的(C)A.简单函数变换B.规范化C.属性构造D.连续属性离散化★考核知识点: 数据变换参见讲稿章节:2-6附(考核知识点解释):数据变换是对数据进行规范化处理,将数据转换成“适当的”形式,更适用于任务及算法需要。

区域经济 第六章 区域空间结构的开发模式

三、网络开发模式(是点轴开发模式的延续) (一)网络开发模式概述 在经历较长时期的增长极开发和点轴开发阶段形成的 发达地区,一般经济发达。但伴随日积月累,形成潜在 的衰退因素。因此,要对原有大城市集聚区进行整治地 同时,又要全面开发新区,新区的开发,一般也是采取 点轴开发的形式,而不是全面铺开。这种新旧点轴的不 断交织,将逐渐在空间上形成一个经济网络体系。 (二)网络开发模式形成的内在动力 发达地区之所以采取网络开发模式,主要有两方面的 驱使因素。 第一,缩小地区差异。 第二,大分散,小集中的特征。

第六章 区域空间结构 的开发模式

6.1 区域空间结构概述

一、区域空间结构的构成要素 人们进行各种社会、经济活动都要占据一定的空间 范围。这些社会、经济活动在空间上以点、线、面三 种空间形式表现出来,而这三种空间形式是研究区域 空间结构的三个基本要素。 (一)点状要素 在一定区域范围内,由经济活动内聚力的作用而产 生的极化作用,使经济活动向区域的经济中心集中, 这样的中心被称作点。点是组成线和面的基本元素。 点状区域一般都是发展条件较好且较早地发展成城市 的地方。点的主要特征包括:

(三)增长极开发模式的区域选择 增长极开发模式通常适用于经济发展水平较低的地区。 (四)增长极开发模式在中国的适用区域 根据当地的自然、经济环境条件及资源优势,选择适合本区发 展的增长极类型,是我国中西部一些地区和贫困山区在进行区域 经济开发时首先考虑的问题。 1、城市依托型增长极 2、资源综合开发型增长极 3、外向型增长极。 二、点轴开发模式(是增长极开发模式的延伸) (一)点轴开发模式的形成 工业点(增长极)逐渐增多,在点与点之间,由于经济联系的 加强,必然会建设各种形式的交通通信线路将这些工业点联系起 来,这些线路就构成了轴线。这些轴线首先是为工业点服务而产 生的,但它一经形成,就对人口和产业产生极大的吸引力,吸引 企业向轴线两侧集聚,并产生新的工业点,从而促进区域经济发 展,此即点轴开发模式。

第六章X射线吸收精细结构(XAFS)

XAFS可分为两部分:

1)EXAFS(扩展X射线吸收精细结构)

吸收边高能侧(30-50)eV至1000eV的吸收系数 的震荡, 称为EXAFS。它含有吸收原子的近邻原子结构信息(近(E邻) 原子种类、配位数、配位距离等)。

700

600

Ge

500

400

FT值

300 200

100

0 0

2

4

6

R (Ǻ)

8

10

图28. Fourier变换的结果,

虚线为滤出第一配位壳层的窗函数

20

10

k2(k)

0

-10

-20

0

10

20

k (Ǻ-1)

图29 Fourier变换乘以窗函数

5.EXAFS的特点

1)样品广泛 EXAFS取决于短程有序作用,不依赖长程有序,因而可测 得样品广泛,可用于非晶、液态、熔态、催化剂活性中心, 金属蛋白,晶体中的杂质原子的结构研究; 2)X射线吸收边具有元素特征,对样品中不同元素的原子, 可分别进行研究; 3)利用荧光法可测量浓度低至的元素的样品; 4)样品制备比较简单。

c)

,

的

,,

,得出归一化 。d 0 (E)

Ex k (k) [(k) 0 (k)] / 0 (E) (k) k n (k)

t(Ex) t(Ex)

(Ex) t

(E)

k (Ex) t

C03+D03

0 (Ex) t

(C13+D13)t

7.0

7.2 7.4 7.6 7.0

美食行业外卖配送路线优化方案

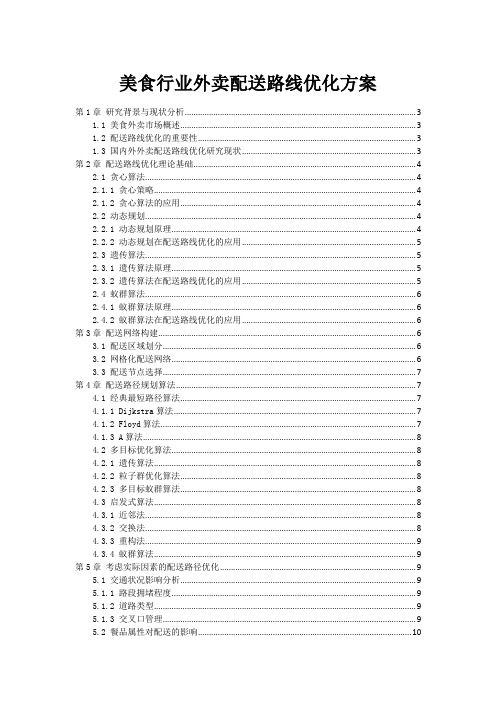

美食行业外卖配送路线优化方案第1章研究背景与现状分析 (3)1.1 美食外卖市场概述 (3)1.2 配送路线优化的重要性 (3)1.3 国内外外卖配送路线优化研究现状 (3)第2章配送路线优化理论基础 (4)2.1 贪心算法 (4)2.1.1 贪心策略 (4)2.1.2 贪心算法的应用 (4)2.2 动态规划 (4)2.2.1 动态规划原理 (4)2.2.2 动态规划在配送路线优化的应用 (5)2.3 遗传算法 (5)2.3.1 遗传算法原理 (5)2.3.2 遗传算法在配送路线优化的应用 (5)2.4 蚁群算法 (6)2.4.1 蚁群算法原理 (6)2.4.2 蚁群算法在配送路线优化的应用 (6)第3章配送网络构建 (6)3.1 配送区域划分 (6)3.2 网格化配送网络 (6)3.3 配送节点选择 (7)第4章配送路径规划算法 (7)4.1 经典最短路径算法 (7)4.1.1 Dijkstra算法 (7)4.1.2 Floyd算法 (7)4.1.3 A算法 (8)4.2 多目标优化算法 (8)4.2.1 遗传算法 (8)4.2.2 粒子群优化算法 (8)4.2.3 多目标蚁群算法 (8)4.3 启发式算法 (8)4.3.1 近邻法 (8)4.3.2 交换法 (8)4.3.3 重构法 (9)4.3.4 蚁群算法 (9)第5章考虑实际因素的配送路径优化 (9)5.1 交通状况影响分析 (9)5.1.1 路段拥堵程度 (9)5.1.2 道路类型 (9)5.1.3 交叉口管理 (9)5.2 餐品属性对配送的影响 (10)5.2.2 餐品包装 (10)5.3 骑手工作强度与效率 (10)5.3.1 配送距离 (10)5.3.2 配送时间 (10)5.3.3 骑手休息与轮换 (10)第6章大数据分析与预测 (11)6.1 数据收集与处理 (11)6.1.1 数据来源 (11)6.1.2 数据收集方法 (11)6.1.3 数据预处理 (11)6.2 用户下单行为分析 (11)6.2.1 用户下单时间分布 (12)6.2.2 用户下单地点分布 (12)6.2.3 用户消费偏好 (12)6.3 预测模型构建 (12)6.3.1 配送时间预测模型 (12)6.3.2 用户满意度预测模型 (12)6.3.3 配送成本预测模型 (12)第7章智能配送系统设计与实现 (12)7.1 系统架构设计 (12)7.2 配送路径推荐模块 (12)7.2.1 路径规划算法 (12)7.2.2 数据处理 (13)7.2.3 配送路径推荐 (13)7.3 配送过程监控模块 (13)7.3.1 实时监控 (13)7.3.2 异常处理 (13)7.3.3 配送质量评估 (13)7.3.4 数据分析与优化 (13)第8章配送效率与效果评估 (13)8.1 评估指标体系构建 (13)8.1.1 配送时间指标 (13)8.1.2 配送成本指标 (14)8.1.3 配送服务质量指标 (14)8.2 配送效率分析 (14)8.2.1 配送时间分析 (14)8.2.2 配送成本分析 (14)8.3 配送效果分析 (14)8.3.1 服务质量分析 (14)8.3.2 综合效益分析 (15)第9章案例分析与优化实践 (15)9.1 典型城市外卖配送案例分析 (15)9.2 配送路线优化实践 (15)第10章未来发展趋势与展望 (16)10.1 新技术在外卖配送中的应用 (16)10.2 配送模式创新 (16)10.3 绿色配送与可持续发展 (16)10.4 政策法规对行业的影响与机遇 (16)第1章研究背景与现状分析1.1 美食外卖市场概述互联网技术的迅速发展和移动终端设备的普及,我国美食外卖市场近年来呈现出爆发式增长。

数字图像处理第6章二值图像处理-专业文档资料

二阶矩则描述了图像的对于直线和对轴与轴的转动惯量,因 此常常也把物体的二阶矩称为惯性矩。

中心矩 :

p q (x x)p(y y )qf(x ,y )d xp d ,q y 0 ,1 ,2

第6章 二值图像处理

低阶矩主要描述区域的面积、转动惯量、质心等等,具有 明显得几何意义,,四阶矩描述峰值的状态等等,一般 来说高阶矩受到图像离散化等的影响,高阶矩一般在应用中 不一定十分准确。

D e(ac)2(bd)2

② 街区距离,用Ds来表示:

(6-1)

D s |ac||bd|

③ 棋盘距离,用Dg表示如下:

(6-2)

D gma a x c|, ( |b|d|)

(6-3)

三者之间的关系为:Dg Ds,如De图6-1(a)、(b)和(c)所示。

第6章 二值图像处理

(a) 欧氏距离 (b) 街区距离 (c) 棋盘距离 (d)≤2构成菱形 (e)≤2构成正方形 图6-1 三种距离示意图

第6章 二值图像处理

6.2 二值图像的几何特征描述

6.2.1 二值图像中曲线的描述 6.2.1.1 轮廓跟踪-甲虫算法

目标区域的边界轮廓是描述目标的重要特征,对于二 值图像中的目标区域轮廓可以通过一种简单的轮廓跟踪算 法来得到,这种方法也被称作甲虫算法。如图6-6所示的二 值图像4连通分量,假定目标区域用1(黑色)表示,背景区域

1 (x,y)(x,y)

f(x,y)

0

else

M1N1

那么区域的面积为: S f (x, y) x0 y0

如果经过目标标记,区域占有的连通分量有k个,那么目

标区域的面积则是k个连通分量的面积总和,即有:

k

S Si i 1

第六章金属磁性的能带模型理论

如Fe,Co,Ni分别是2.2 B ,1.7 B ,0.6 B 以及Cr的复杂情况等。

②铁磁金属(Fe,Co,Ni)以及其他金属组成的合金磁 矩与成分的变化有些可用Slater-Pauling曲线表 示.

③对于金属磁性材料,用居里定律中常数C计算原子 磁矩时,得不到半整数S值.

④在居里点以上,Fe服从海森伯模型.对于Cr而言, 显示出不服从海森伯模型.

mU BH

kBT

1

[其中N(ε)态密度,自由电子

N

3 4

N E3/ 2

1 2

]

f

E' / kT

f

Ef、Ef′分别为T=0和T≠0时的费米能。

令

mU ' m ' B H

k BT

kBT T

kBT

则

N

3 4

N

kBT Ef

3/ 2

0

x1/ 2dx ex ' 1

H Ek nk k ,

其中 nk Ck Ck

k带中自旋为σ的电子数

Ek

k

U N

k'

n k

'

,

......(6)

状态为k和σ的电子能量

令

1

n n N k' nk' ,

∴每个原子的平均电子数为

n n n......(7)

相对磁矩 m n n......(8)

Ek k Un ......(9)

。实验上大部分物质

1 3

少数为

1 2

④Fe和Co金属电阻率 在 Tc 附近有转变,d dT

有极大值。可以用局域电子自旋无序散射来解释。

⑤基于局域电子交换模型的自旋波理论成功说明了

第六章+聚合物的结晶态

vt v v0 v

1 2

时

t1 2 (

ln 2 K

成核: • 均相成核:由熔体中高分子链靠热运动形成有序排 列的链束为晶核; • 异相成核:以外来杂质、固体颗粒、未完全熔融的 高分子或容器壁为中心,吸附熔体中高分子链作有 序排列形成的晶核。

结晶生长:

• 成核速度 用偏光显微镜、电镜直接观察单位时间内形 成晶核的数目。 • 结晶生长速度 用偏光显微镜法、小角激光散射法测定 球晶半径随时间的增大速度,即球晶的径向生长速度。 • 结晶总速度 用膨胀计法、光学解偏振法等测定结晶过 程进行到一半所需的时间t1/2的倒数作为结晶总速度。 几种主要的实验方法 1.膨胀计法….

天然橡胶 全同聚丙烯(IPP) 尼龙6 聚对苯二甲酸乙二酯(PET) 等规聚苯乙烯(IPS) 5×103 1.25 5.0 42.0 185 无规PS不结晶

_________________________________________________________

结晶总速度 = 成核速度 + 结晶生长速度

黑十字消光:是高聚物球晶双折 射性质和对称性的反映。一束 自然光通过起偏镜后,变成平 面偏振光,其振动(电矢量) 方向都在单一方向上。一束偏 振光通过高聚物球晶时,发生 双折射,分成二束电矢量相互 垂直的偏振光,它们的电矢量 分别平行和垂直于球晶的半径 方向,由于这两个方向的折射 率不同,这两束光通过样品的 速度是不相等的,必然产生相 位差而发生干涉现象,结果使 通过球晶的一部分区域的光可 以通过与起偏镜处在正交位臵 的检偏镜(产生亮区),而另 一部分则不能通过(产生暗 区)。 球晶的双折射Δn分为径向折射 率(nr)与切向折射率(nt)之差, 当 nr 〉nt, △n〉0 正球晶;nr 〈 nt, △n〈 0 负球晶。

第六章 第六节 反磁化过程 磁滞与矫顽力

1、发动场理论(德棱W.Doring, 1938年—反核长大问题) 反磁化核长大的条件,从能量上看,就是随着反磁化核的长大,其能量

必须降低。而由于反磁化核的长大(体积增大dV),必然引起:

1)畴壁面积增大dS,使畴壁能量增加γωdS 2)反磁化核形状变化,引起退磁场能量变化dFd 3)反抗壁移的最大阻力做功:2μ0MsHodV (H0—临界磁场强度) 4)磁场作用能降低:2μ0MsHdV 所以反磁化核的长大条件为:

3

160Ms H H0 1-2Ms

1

H H0 ln 2k 1.25

k 2 dd

由dl=dd=ds可求出反磁化核能同时沿长短轴长大的临界尺寸ds

ds

5 3

6H

(80M s )

H0

ln 2ks ln 2ks

1.4 1.5

ks通常很大

5

160M s H H0

推出发动场(即反磁化核要开始长大需要的外磁场):

滞回线。分三种情况讨论

1 时,F Ku

sin2 2h cos

,由平衡条件 F 0,得:

2Ku sin cos hsin 0, sin 0或cos h,

1 0,2 ,3 cos1 h

上述三个解是否合理,只要看其是否满足 2F 0

2

2F

2

2Ku

cos 2

h cos

化;第二项—反磁化核本身长大所带来的能量变化。Fm和Fn分 别为反磁化核产生前后在晶粒总边界面积As上退磁场的表面能密 度;n为单位体积内所包含的反磁化核的数目;γw是反磁化核的 180º畴壁能密度;α1和α2为外磁场强度H与相邻晶粒易磁化轴方 向的夹角;V为反磁化核的体积;Fp为畴壁面上磁极与晶粒边界 面上磁极之间的相互作用能;Fnp为近邻畴壁面上的磁极之间相 互作用能。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

i

K近邻法

(1)已知N个已知 类别样本X

(2)输入未知类别 样本x

(3)计算x到 xiX,(i=1, 2,…,N)的 距离di(x)

(6) 判xω2 (4)找出x的k个最近邻 元Xk={xi,i=1,2,…,k} (5)看Xk中属于哪一类的样 本最多k1=3<k2=4

讨论k为奇数时的两类问题

xi X p

第二阶段用搜索算法

检验未知样本x的最近邻是否在X p中的两个规则。 规则1:如果存在 B rp D x, M p 则xi X p 不可能是x的最近邻。其中B是在算法执行过程 中,对于已涉及到的那些样本集X p中的样本到x 的最近 距离。初始B可置为, 以后的B在算法中求得。

c * P P P 2 P c 1 * 其中P 为贝叶斯错误率,c为类数。

* *

可以证明,当样本数相当多时,近邻法错误 率与贝叶斯错误率存在以下关系:

• 上式表明,当样本数相当多时,近邻法的错误 率在贝叶斯错误率和两倍的贝叶斯错误率之间。

最近邻法错误率上下界与贝叶斯错误率的关系

5在目录表中选择最近节点p, 它使D x, M p 最小化,并

称该p为当前执行节点,从目录表中去掉p。如果当前 的水平L是最终水平,则转步骤6。否则置L L 1,转 步骤2。

6对现在执行节点p中的每个x,利用规则2作如下检验。

如果

D x, M p D xi , M p B

规则2:如果存在

B xi , M p D x, M p

其中xi X p,则xi 不是x的最近邻。 D x, xi D x, M p D xi , M p B D xi , M p 在计算rp中已用到,并可存储在机器中。

利用规则1或2,可以剔除不可能是 x 最近 邻的子集或点

近邻法由Cover和Hart于1968年提出

6.1 最近邻法 6.2 k-近邻法 6.3 关于减少近邻法计算量和存储量的 考虑 6.4 可做拒绝决策的近邻法 6.5 最佳距离度量最近邻法

最近邻分类器(nearest

近邻法

neighborhood classifier, nnc): 最小距离分类器的一种极端的情况,以 全部训练样本作为代表点,计算测试样本与 所有样本的距离,并以最近邻者的类别作为 决策类。

第6章 近邻法

Bayes方法需要借助概率密度函数估计。可以看 出,其应用受到很大限制。事实上,非参数模 式识别方法更为实用。由于能解决许多实际的 模式识别问题,虽然在许多情况下它们不是最 优的,但却是应用的最多最有效的方法。统计 模式识别中常用的基本非参数方法除了前面介 绍的线性判别函数外,还有将要介绍的近邻法 和聚类。近邻法属于有监督学习,聚类属于无 监督学习。它是在已知模式类别的训练样本的 条件下,绕开概率的估计,按最近距离原则对 待识别模式直接进行分类。

欧氏距离、马氏距离★ 基于类内散布矩阵的单类模式特征提取★ 基于自相关矩阵的K-L变换的特征提取★ 聚类的概念与理解★ 监督分类、无监督分类★

聚类与分类★

近邻聚类法算法步骤★ 最大最小距离算法★ 层次聚类法★ 动态聚类法:K-均值聚类算法★

考试题型

第一题 概念题 (2个小题)10分 第二题 简答题 (3个小题)30分 第三题 计算题 (4个小题)50分 第四题 综合应用题 10分

考试重点

模式识别的基本概念★ 模式识别系统★ 最小错误率贝叶斯分类器 ★ 最小风险贝叶斯分类器★ 线性判别分类器的设计步骤★ 由***两分法,判断某个模式的所属类别★ 广义线性分类器(非线性→线性) ★ 感知器准则函数及迭代解★ Fisher判别分类的思想、原则及准则函数★ 特征提取、特征选择的概念★ 最近邻法、K-近邻法的决策规则★

k

其中,xik 的角标i表示i 类,k 表示i 类N i中 的第k 个样本。 由此得到最近邻法的决策规则为: 若g j ( x) min gi ( x), i 1, 2, , c, 则决策 x j

i

直观解释

对未知样本x, 我们只要比较x和N N i 个已知

i 1 c

近邻法的错误率

6.2 k-近邻法

取未知样本的k个近邻,看这k个近 邻中哪类的样本数最多,就把未知 样本归到该类。

k -近邻法

图中为k 5的情 况,根据判定规 则,测试样本点 x被归类为黑色 的点所属的类别。

k-近邻法的基本规则

已知类别标签的样本集合N i (i 1, 2, , c), 类别标签分 别为1 , 2 , , c , 未知样本x的近邻样本数k1 ,k2 , , kc 分别来自于样本集合N1 ,N 2 , , N c,则定义判别函数 为 gi ( x) ki , i 1, 2, ,c K-近邻法的决策规则为: 若g j ( x) max ki,则决策x j。

• 利用上面两个规则,可以设计适当的树 搜索算法。

树搜索算法

1 置B , L 0, p 0。(L是当前水平, p是当前节点) 2 将当前节点的所有直接后继节点放入一个目录表中, 并对这些节点计算D( x, M p )。 3 对步骤2中的每个节点p,根据规则1,如果有 D x, M p B rp 则从目录表中去掉p。 4 如果步骤3目录表中的已没有节点,则后退到前一个 水平,即置L L 1。如果L 0则停止, 否则转步骤3。 如果目录表中有一个以上k近邻的快速算法(树搜索 )

近邻法存在的问题

–存储量大;计算量大,要计算大量的样

本间的距离 • 为了减少查找k-近邻的计算量,需要尽量避免 穷尽地计算所有样本间的距离,可把训练样本 组织(分解)成一定的等级如树结构等,尽量 排除一些不必要的计算。

用X x1 , x2 , , xN 表示样本集。目的是在X 中寻找 未知样本x的k 个近邻。首先讨论k 1的情况,即最近 邻情况,然后再扩展到k -近邻情况。 算法分两个阶段: 第一阶段是将样本集X 分级分解,形成树形结构。 第二阶段用搜索算法找出待识别样本的最近邻。

第一阶段:样本集X 分级分解

首先将X 分为l个子集,每个子集再分成l子集,这样依次 下去就可得到一个树形结构。每个节点上对应一群样本, 用p表示一个节点,该节点所对应样本子集的参数如下: X p:节点p对应的样本子集; N p:X p中样本数; M p:样本子集X p中的样本均值; rp max D xi , M p :从M p到xi X p的最大距离。

根据三角不等式:

D x, xi D xi , M p D x, M p D x, xi D x, M p D xi , M p D x, M p rp B

规则1

• 当规则1不满足时,对于终端节点xi ,可以利 用下面的规则2迅速检验它能否成为 x 的最近 邻,省去计算所有的D x, xi 。

最初的近邻法是由Cover和Hart于1968年提出

的,随后得到理论上深入的分析与研究,是 非参数法中最重要的方法之一。

6.1 最近邻法

6.1.1 最近邻决策规则

6.1.2 最近邻法的错误率分析

i 1

N Ni

c

6.1.1 最近邻决策规则

已知类别标签的样本集合N i (i 1, 2, , c), 类别标签分别 为1 , 2 , , c ,定义i的判别函数为 gi ( x) min x xik , k 1, 2, , N i

则xi 不是x的最近邻,不计算D x, xi ,否则计算D x, xi 。 若D x, xi B, 置NN i和B D x, xi 。在当前执行节点 中所有被检验完之后,转步骤3。 当算法结束时,输出x的最近邻xNN 和x与xNN的距离 D x, xNN B。

k-近邻法的错误率界

近邻法存在的问题

( )需将所有样本存入计算机中,每次决策都要计算待 1 识别样本与全部训练样本之间的距离并进行比较。 因此,存储量和计算量都很大。 (2)虽然在所有情况下,对未知样本都可进行决策,但 当错误代价很大时,会产生较大的风险。 (3)上述分析都是渐近的,就是说要求样本数N , 这在任何实际场合都是无法实现的。

类别的样本之间的欧氏距离,并决策x与离它最 近的样本同类。

最近邻方法

(1) N个已知类别 样本X

(2)输入未知类别 样本x

(3)计算x到 xiX,(i=1, 2,…,N)的 距离di(x)

(5) 判xωm (4)找出最小距离 dm(x)=min{di(x)}

6.1.2 最近邻法的错误率分析