通信系统原理 第一章

通信原理讲义

通信原理讲义第一章绪论1.1 通信系统的组成1.1.1 通信一般系统模型点对点通信模型:反映了通信系统的共性。

1.1.2 模拟通信与数字通信●消息可以分成两类ﻩﻩ离散消息:消息的状态是可数的或离散型的(如符号、文字等),也称为数字消息。

连续消息:状态连续变化的消息(如语音、图像),也称为模拟消息。

●消息与电信号之间必须建立单一的对应关系。

通常,消息被载荷在电信号的某以参量上。

ﻩﻩ数字信号:电信号的参量携带离散消息,该参量离散取值。

模拟信号:电信号的参量携带连续消息,参量连续取值。

●相应的通信系统分成两类ﻩ数字通信系统ﻩﻩ模拟通信系统●模拟信号与数字信号之间可以相互转换在信息源中使用模-数(数-模)转换器,接受端使用数-模(模-数)转换器。

●数字通信比模拟通信更能适应对通信技术越来越高的要求(1)数字传输的抗干扰能力强,中继时可以消除噪声的积累;(2)传输差错可以控制;(3)便于使用现代数字信号处理技术对信息进行处理;(4) 易于加密处理;(5) 可以综合传递各种消息,增强系统功能。

● 模拟通信系统模型(点对点)基带信号:携带信息,但具有频率很低的频谱分量,不适宜传输的原始电信号。

已调信号:基带信号经过调之后转换成其频带适合信道传输的信号,也称频带信号。

调制器:将基带信号转变为频带信号的设备。

解调器:将频带信号转变为基带信号的设备。

模拟通信强调变换的线性特性,既已调参量与基带信号成比例。

● 数字通信系统模型(点对点) 强调已调参量与基带信号之间的一一对应。

数字通信需要解决的问题:(2) 编码与解码:通过差错控制编码消除噪声或干扰造成的差错; (3) 加密和解密:对基带信号进行人为“搅乱”;(4) 同步:发送和接收节拍一致,包括:位同步(码元同步)和群同步、帧同步、句同步或码组同步。

数字通信模型:同步环节的位置不固定,图中没有出现。

消息消息数字基带传输模型:● 数字通信的缺点 比模拟通信占据更宽的频带。

通信原理 (完整)精选全文

数字通信的主要优点:

(a) 失真的数字信号

(b) 恢复的数字信号

数字信号波形的失真和恢复

数字通信的主要缺点:

➢ 占用带宽大 ➢ 设备复杂 ➢ 同步要求高

宽带通信、压缩编码 VLSI、SOC、ASIC 信号处理技术

应用实例:

➢ 数字传输技术:电话、电视、计算机数据等 信号的远距离传输。

➢ 模拟传输技术:有线电话环路、无线电广 播、电视广播等。

狭义信道

有线信道 无线信道

中长波地波 短波电离层反射 超短波、微波视距传输 超短波、微波对流层散射 卫星中继

编码信道 调制信道

信 源

加 密 器

编 码 器

调 制 器

发 转 换 器

信 道

收 转 换 器

解 调 器

解解 码密 器器

信 宿

发送设备

噪 声

接收设备

广义信道

广义信道

调制信道:

调制器输出端到解调器输入端的所有设备和媒介。 研究调制和解调时,常用调制信道。 连续信道/模拟信道。

eo(t)

e0t htei t nt e0t kt ei t nt

n(t)

n(t): 加性干扰 k(t): 乘性干扰

k t 依赖于网络的特性,k t 反映网络特性对 ei t 的作用。

干扰

加性干扰:本地噪声

始终存在

乘性干扰:非理理想信道 与信号共存

sR t sT tht nt

乘性 加性

增量调制DM

军用、 民用电话

Hale Waihona Puke 差分脉码调制DPCM电视电话、 图像编码

其 他 语 言 编 码 方 式 中低速数字电话 ADPCM、 APC、 LPC

按信号复用方式分类

精品课件-通信原理-第1章

第1章 通信原理概述 图1.2.4 测量系统模型

第1章 通信原理概述

这类系统主要由4个部分组成: 信号源、待测物体(中介 体)、信号检测(比较)部分和接收终端(显示)。此类系统中, 信号源发出的信号是已知的,一路作为标准信号,另一 路为经待测物体后变化的信号,根据两路信号的变化量来判断 待测物体的特征,即通过系统主要测量信号经过中介体后的变 化,来判断中介体的特征。

无线广播通信系统中的调制是将基带信号附加到合适的载 波信号上,以便在信道上进行传输。针对不同的系统有不同的 处理方式,比如上面介绍的无线广播通信系统中的调制,是由

第1章 通信原理概述

由于消息存在着许多不同的类型以及不同的传输方法, 因此产生了种类繁多的通信系统。

为了分析消息传输的实质,可以把各类通信系统共性及基 本组成概括为一个一般模型。不管何种通信系统,信息总是由 发送端通过信道传递到接收端的。因此,通信系统的一般模型 如图1.2.3

第1章 通信原理概述

有些信号没有确定的数学表示式,当给定一个时间值时, 信号的值并不确定,通常只知道它取某一数值的概率,这种信 号称为随机信号或不规则信号。严格地说,所有的信号都是随 机信号。因为对于接收者来说并不能确定地预知信号在某一瞬 间应取何值。研究随机信号时应该用统计的观点和方法。图 1.3.2(b)所示为随机信号的波形举例,我们无法确定在某一

接收设备的作用则是完成发送设备的逆变换,它把接收的

第1章 通信原理概述

信宿是信息到达的目的地,信息通过接收的信号还原为原

噪声可以由消息的初始产生环境、构成变换器的电子设备、传 输信道以及各种接收设备等所有信号传输环节中的一个或几个 产生,为分析方便起见,在模型中把噪声集中由一个噪声源表

根据研究的对象或关心的问题的不同,还可以出现不同形 式的具体通信系统模型,比如雷达、声纳及地震法勘测等测量 系统,如图1.2.4

通信原理第一章

任何人、任何时候在任何地方以任意的方式进行通信。

1.1.1 通信系统的一般模型(主要培养全局系统的概念) 通信: 从一地向另一地传递和交换信息。

通信系统:实现信息传递所需的一切技术设备和传输媒质基于点与点之间的通信系统的模型用图1 -1 来描述。

送设备信道接收设备受信者噪声源接收端信息源:消息的产生地,其作用是把各种消息转换成原始电信号,称之为基带信号。

包括:电话机、电视摄像机和电传机、计算机等。

前者是模拟信源,输出模拟信号;后者是数字信源,输出数字信号。

发送设备:将信源和信道匹配起来,即将信源产生的消息信号变换成适合在信道中传输的信号。

变换方式是多种多样的,比如:放大、调制、编码等等; 信道:指传输信号的物理媒质。

包括:大气(自由空间)、明线、电缆或光纤。

模拟信号:凡信号参量的取值是连续的或取无穷多个值的,且直接与消息相对应的信号。

数字信号:凡信号参量只能取有限个值,并且常常不直接与消息相对应的信号。

通信系统分为模拟通信系统+数字通信系统。

1. 模拟通信系统模型图1-4 模拟通信系统模型信息源调制器信道解调器受信者噪声源课程重点调制器:原始基带信号变换成适合信道传输的信号;从信号与系统的角度:调制器=频带搬移。

调制后的信号称为已调信号、频带信号。

已调信号有三个基本特征:一:携带有完整的基带信息二:适合在信道中传输三:信号的频谱具有带通形式且中心频率远离零频,因而已调信号又称频带信号。

信道编译码 数字信号在信道传输时,由于噪声、衰落以及人为干扰等,将会引起差错。

为了减少差错,信道编码器对传输的信息码元按一定的规则加入保护成分(监督元),组成所谓“抗干扰编码”。

接收端的信道译码器按一定规则进行解码,从解码过程中发现错误或纠正错误,从而提高通信系统抗干扰能力,实现可靠通信。

作用:提高通信系统抗干扰能力。

数字调制与解调 把数字基带信号的频谱搬移到高频处,形成适合在信道中传输的频带信号。

基本的数字调制方式有振幅键控ASK、频移键控FSK、绝对相移键控PSK、相对(差分)相移键控DPSK。

通信原理 第1章绪论

消息的传递是通过它的物质载体 — — 电信号来实现的, 即把消息寄托在电信号的某一参量上(如连续波的幅度、 频率或相位;脉冲波的幅度、宽度或位置)。按信号参量 的取值方式不同可把信号分为两类,即模拟信号和数字信 号。

可编辑版

8

凡信号参量的取值是连续的或取无穷多个值的,且直 接与消息相对应的信号,均称为模拟信号(电话机送出的 语音信号、电视摄像机输出的图像信号)。模拟信号有时 也称连续信号,这个连续是指信号的某一参量可以连续变 化,或者说在某一取值范围内可以取无穷多个值,而不一 定在时间上也连续,如图 1 - 2(b)所示的抽样信号。

f (nT )

1 0 0 1 10 1 1 10 0 1

O

t

(a )

数字信 息

0

0

1

1

1

0

0

1

PSK波 形

(b )

图 1 -3数字信号波形 (a) 二进制波形 (b) 2PSK波形

可编辑版

10

因此,按照信道中传输的信号的性质可以分为模拟通 信系统、数字通信系统和模拟信号的数字传输系统。

1. 模拟通信系统模型

第一章 绪论

1.1 通信系统的组成 1.2 通信系统分类与通信方式 1.3 信息及其度量 1.4 通信系统的主要性能指标

可编辑版

1

ቤተ መጻሕፍቲ ባይዱ

1.1 通信系统的组成

从古到今,人类的社会活动总离不开消息的传递和 交换, 古代的消息树、烽火台和驿马传令,以及现代社 会的文字、 书信、电报、电话、广播、电视、遥控、遥 测等,这些都是消息传递的方式或信息交流的手段。人 们可以用语言、文字、 数据或图像等不同的形式来表达 信息。但是这些语言、文字、 数据或图像本身不是信息 而是消息,信息是消息中所包含的人们原来不知而待知 的内容。因此,通信的根本目的在于传输含有信息的消 息,否则,就失去了通信的意义。基于这种认识, “通信 ”也就是“信息传输”或“消息传输”。

通信原理第一章

P7

特点:随机性的,无法预知的。

信号:反映消息的电信号。

信息:把消息中的内容用概率统计的方法抽象出来。 信息是消息和信号中包含的某种有意义的抽象的东西。

2、信息量:是信息或消息的一种度量。信息的 大小由信息量来衡量。

不同的消息人们对它的反映是不同的,如:下雨、地震

(太阳从东方升起) 下雨:经常发生,不足为奇,信息量小; 地震:不常发生,很惊讶,信息量大。 (太阳从西方升起)

P(x):消息的概率 a :2的整数次幂 P8

信息量的单位的确定取决于底数a:

若对数以2为底时单位是“比特”(bit — binary unit的缩 写);

若以e为底时单位是“奈特”(nat—nature unit的缩写);

若以10为底时单位是“哈特”(Hart — Hartley的缩写)。

数字通信系统还有一个非常重要的控制单元, 即同步系统。使收发两端的信号在时间上保持 步调一致

3、数字通信的主要特点 目前,无论是模拟通信还是数字通信, 在不同的通信业务中都得到了广泛的应用。 但是,数字通信更能适应现代社会对通信技 术越来越高的要求,数字通信技术已成为当 代通信技术的主流。

与模拟通信相比,它有如下优点: 1、抗干扰、抗噪声性能好 2、差错可控 3、易加密 4、数字通信设备和模拟通信设备相比,设计 和制造更容易,体积更小,重量更轻。 5、数字信号便于计算机处理,数字信号可以 通过信源编码进行压缩,以减少冗余度,提 高信道利用率。 6、易于与现代技术相结合。

消息出现的概率越大,则消息中包含的信息量 越小; 消息出现的概率越小,则消息中包含的信息量 越大。

信息量:I information ∵ P(x)=1 必然事件 P(x)=0 不可能发生事件 I=0 I=∞

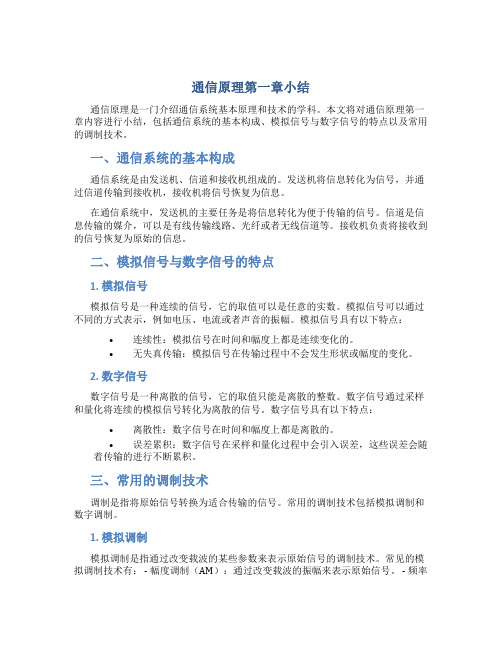

通信原理第一章小结

通信原理第一章小结通信原理是一门介绍通信系统基本原理和技术的学科。

本文将对通信原理第一章内容进行小结,包括通信系统的基本构成、模拟信号与数字信号的特点以及常用的调制技术。

一、通信系统的基本构成通信系统是由发送机、信道和接收机组成的。

发送机将信息转化为信号,并通过信道传输到接收机,接收机将信号恢复为信息。

在通信系统中,发送机的主要任务是将信息转化为便于传输的信号。

信道是信息传输的媒介,可以是有线传输线路、光纤或者无线信道等。

接收机负责将接收到的信号恢复为原始的信息。

二、模拟信号与数字信号的特点1. 模拟信号模拟信号是一种连续的信号,它的取值可以是任意的实数。

模拟信号可以通过不同的方式表示,例如电压、电流或者声音的振幅。

模拟信号具有以下特点:•连续性:模拟信号在时间和幅度上都是连续变化的。

•无失真传输:模拟信号在传输过程中不会发生形状或幅度的变化。

2. 数字信号数字信号是一种离散的信号,它的取值只能是离散的整数。

数字信号通过采样和量化将连续的模拟信号转化为离散的信号。

数字信号具有以下特点:•离散性:数字信号在时间和幅度上都是离散的。

•误差累积:数字信号在采样和量化过程中会引入误差,这些误差会随着传输的进行不断累积。

三、常用的调制技术调制是指将原始信号转换为适合传输的信号。

常用的调制技术包括模拟调制和数字调制。

1. 模拟调制模拟调制是指通过改变载波的某些参数来表示原始信号的调制技术。

常见的模拟调制技术有: - 幅度调制(AM):通过改变载波的振幅来表示原始信号。

- 频率调制(FM):通过改变载波的频率来表示原始信号。

- 相位调制(PM):通过改变载波的相位来表示原始信号。

2. 数字调制数字调制是指将原始信号转换为离散的数字信号的调制技术。

常见的数字调制技术有: - 脉冲调制(PAM):通过改变脉冲的幅度来表示数字信号。

- 正交幅度调制(QAM):通过改变两个正交载波的幅度和相位来表示数字信号。

- 正交频分复用(OFDM):将数字信号分成多个子载波进行传输。

通信原理课件第1章 绪论

2021/1/17

6

1.2.3 数字通信系统模型

1.数字通信系统模型

信

信

数

数信

信

信

源

加

道

字

信

字

道

解

源

信

编

编

调

解译

译

源

码

密

码

制

道

调

码

密

码

宿

器

器

器

器器

器

噪声源

图1.3 数字频带通信系统模型 ★ 一般数字通信系统的收端要有同步的功能

2021/1/17

7

2. 数字通信的优点

(1) 抗干扰能力强,可多次再生,无噪声积累; (2)自动检错、纠错,降低误码率,提高传输质量; (3)便于对信息处理、变换、存储; (4)设备便于集成化、小型化; (5)便于加密处理,保密性好。

2021/1/17

发

接

送

收

设

设

备

备

(a)串行传输

发

接

送

收

设

设

备

备

(b)并行传输

13

3.按同步方式分类

按同步方式的不同,可分为同步通信和异步通信。

同步通信——是指在约定的通信速率下, 发送端和接收 端的时钟信号频率始终保持一致。“同步通信”的通信 双方必须先建立同步,即双方的时钟要调整到同一个频 率。收发双方不停地发送和接收连续的同步比特流。 异步通信——是指通信中两个字符之间的时间间隔是不 固定的,而在一个字符内各位的时间间隔是固定的。

消息中所含信息量的大小与消息发生的概率有关。 一件事发生的概率愈小,愈使人感到意外的惊喜,在 这种情况下消息所含的信息量就愈大。 若消息出现的概率0,说明消息的信息量趋于无穷大; 若消息出现的概率1,说明消息的信息量为0。

通信原理第01章绪论 ppt课件

第1章 绪论

1.2.3 数字通信的特点

优点

抗干扰能力强,且噪声不积累 传输差错可控 便于处理、变换、存储 便于将来自不同信源的信号综合到一起传输 易于集成,使通信设备微型化,重量轻 易于加密处理,且保密性好

在电通信系统中,消息的传递是通过电信号来实 现的。

通信原理第01章绪论

第1章 绪论

1.2 通信系统的组成

1.2.1 通信系统的一般模型

信息源(简称信源):把各种消息转换成原始电信 号,如麦克风。信源可分为模拟信源和数字信源。

发送设备:产生适合于在信道中传输的信号。 信道:将来自发送设备的信号传送到接收端的物理

串行/并行 转换器

优点:只需一条通信信道,节省线路铺设费用

缺点:速度慢,需要外加码组或字ቤተ መጻሕፍቲ ባይዱ同步措施

其他分类方式:

同步通信和异步通信

(异步:发送帧首尾有标志;同步:发送端和接收端时间同步)

专线通信和网通信

通信原理第01章绪论

第1章 绪论

1.4 信息及其度量

信息:是消息中包含的有效内容 如何度量离散消息中所含的信息量?

度量信息量的原则

能度量任何消息,并与消息的种类无关。 度量方法应该与消息的重要程度无关。 消息中所含信息量和消息内容的不确定性有关

【例】 “某客机坠毁”这条消息比“今天下雨”这 条消息包含有更多的信息。

上例表明: 消息所表达的事件越不可能发生,信息量就越大。

通信原理第01章绪论

第1章 绪论

通信原理第1章绪论x

模拟通信系统:是利用模拟信号来传递信息的通信系统。

信息源

调制器

信道

解调器

受信者

发送端

发送设 备

噪声源

图 1-4 模拟通信系统模型

接收端

接收设 备

18

第一章 绪论

1. 模语图音像拟信信通号号信、 系统模型

消息

原始电信号 (基带信号)

(频带信号)

变换 调制

信道 反变换

解调

信息源

调制器

信道

原始电信号 消息

数字信号参量(幅度等)离散。

14

第一章 绪论

模拟信号有时也称连续信号

连续指信号的某一参量

连续变化, 在某一取值范围内可以取无穷多个值

f (t)

f (nT )

PAM信号

O (a)

时间连续信号

t

O

t

抽样信号

(b)

图 1 – 2 模拟信号波形

15

第一章 绪论

数字信号有时也称离散信号

离散:指信号的某一参量离散变化

信号:(signal)

连续消息:消息状态是连续变化的

3

第一章 绪论

1.1通信系统的组成

常用通信术语

通信:(communication) 克服距离上障碍,交换和传递信息。

利用“电”来传递消息的方式称为“电通信”,简称“通 消信息”:。(message) 有待于传输的语言、文字、 数据或图像等。

信息:(Information) 是消息中有意义的内容。 消息中所包含的人们原来不知而待知的内容。

信息源

发送设备

信道

【课件】通信原理第一章ppt

1.2 通信系统的组成 1.2.1 通信系统的一般模型

我们把实现信息传输所需一切设备 和传输媒介所构成的总体称为通信系 统。以点对点通信为例,通信系统的 一般模型如图1-1所示。

图1-1通信系统的一般模型

图1-1中,发送设备的作用一方面是 把信息转换成原始电信号,该原始电 信号称为基带信号;另一方面将原始 电信号处理成适合在信道中传输的信 号。它所要完成的功能很多,例如调 制、放大、滤波和发射等,在数字通 信系统中发送设备又常常包含信源编 码和信道编码等。

1.2.3 数字通信系统模型

数字通信系统是利用数字信号来传递 信息的通信系统。数字通信系统可进一 步细分为数字频带传输通信系统和数字 基带传输通信系统。

图1-3中,变换器的作用是把信息转 换成数字基带信号。信源编码的主要 任务是提高数字信号传输的有效性。 信源编码器的输出就是信息码元,此外, 话音和图像压缩编码等都是在信源编 码器内完成。接收端信源译码则是信 源编码的逆过程

6、易于与现代技术相结合。

1.3 通信系统分类及通信方式

பைடு நூலகம்

通信中信息的传送是通过信号来进行 的,如:电压、电流信号等。信号是信 息的载荷者。在各种各样的通信方式中, 利用“电信号” 来承载信息的通信方 式称之为电通信,这种通信具有迅速、 准确、可靠等特点,而且几乎不受时间、 空间、地点、距离的限制,因而得到了 飞速发展和广泛应用。如今,在自然科 学中,“通信”与“电通信”几乎是同 义词。在本书中的通信均指电通信。

信道是指信号传输通道,按传输媒介 的不同,可分为有线信道和无线信道两 大类。

图中的噪声源,是信道中的所有噪声 以及分散在通信系统中其它各处噪声的 集合。

在接收端,接收设备的功能与发送设 备相反,即进行解调、译码等。它的任 务是从带有干扰的接收信号中恢复出相 应的原始电信号,并将原始电信号转换 成相应的信息,提供给受信者。

通信系统原理第一章PPT课件

第一章 序论

• 通信发展历史:远古----非电通信

数字通信:旗语,烽火台(光通信?)等等

• 近代:电通信 1844 Morse;1876: Bell; 1894:Lodge(wireless);

1900:Marconi;1937:Reeves(PCM);1948:Shannon;1958:IC;60:Elect.Tel.S witching System;1965:Satellite;1972: Cellular Telephone(Motorola);1976:PC;80:Optical fiber;90:DWDM +SDH+Wireless;

• 信息速率Rb(比特率,bit rate):信源每秒钟发出的平 均比特数。单位:bps or bit/sec

• 码元速率和比特速率的关系:1个码元可以含多比特或小 于1个比特的信息,因此一般情况下码元速率与比特速率 在数值上是不等的。

• 例:四进制等概分布情况下,一个码元含二比特的信息 量。在数值上我们有Rb =2RB. 二进制时,在等概情况下,Rb =RB。也就是说只有在二进 制等概分布时才有码元速率和比特速率在数值上相同。

4. 通信系统的主要性能指标

• 性能指标

质量指标:是整个通信系统的综合评估

• 通信系统:有效性,可靠性,适应性,标准性,经济性, 可维护性和友好性

• 但从根本来说,通信系统的目的是将信息从信源传递到信 宿,因此可靠性(质量)和有效性(传输效率)是首先要 考虑的。

• 模拟通信系统的评估:可靠性:发与收信号的差异程度---均方误差(噪声的影响,系统的不完善因素)

有效性:消息中所含的信息量,单位时间可传递的信息量 多少。

• 数字通信系统:信息传输速率和发生差错的概率(误码概 率)

通信原理第1章 绪论

I0 I1 I2 I3 log2 4 2 b

评注 概率相同,每个符号蕴含的信息量也相同;

二进制的每个码元含 1 (b) 四进制的每个码元含 2 (b)

每个四进制符号可用 2 个二进制符号表示。

推广:M进制的每个码元含 log2M (b)

2.离散信源的平均信息量

——信源中每个符号所含信息量的统计平均值。 设

按传输方向和时间划分

单工通信:

发端 信道 (a) 单工方式 发端 (A) 信道 收端 (A) (b) 半双工方式 发端 (A) 收端 (B) 收端 (B) 发端 (B) 收端

(单向)

半双工通信:

(双向、不同时)

全双工通信:

(双向、同时)

收端 (A)信道A 信Fra bibliotekB发端 (B)

(c) 全双工方式

H与热力学中的熵形式一样,故称为信源的熵。

M

例

【1-3】 四进制信源(0,1,2, 3), P(0)=3/8, P(1)= P(2)= 1/4, P(3)=1/8, 试求信源的平均信息量。

解

1 H p ( xi ) log 2 p ( xi ) i 1

M

1 I log 2 P( x)

x1 , , x i , , x M P ( x ), , P ( x ), , P ( x ) 且 i M 1

P( x ) 1

i i

M

则 统计独立的M个符号的离散信源的平均信息量为

1 H p ( xi ) log 2 (b / 符号) p ( xi ) i 1

RB B

(Baud/Hz)

Rb b B

b log 2 M

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

模拟与数字通信系统

• 数字通信系统 数字通信系统:传输数字消息的通信系统

Digital source transmitter channel receiver sink

info

T

C

noise

R

加密器

编码器

调制器

解密器

解码器

解调器

模拟通信系统

• 框图:

Analog source transmitter channel receiver sink

码元速率和比特速率

• 码元 码元:信源发出的消息或代表每个消息的信号(符号) • 码元速率RB:信源每秒钟发出的码元数,单位波特 波特 码元速率 (Baud), 又称符号速率 符号速率(symbol rate),波特率 波特率 符号速率 • 信息速率 b(比特率,bit rate):信源每秒钟发出的 信息速率R 平均比特数。单位:bps or bit/sec • 码元速率和比特速率的关系:1个码元可以含多比特或 码元速率和比特速率的关系:1 小于1个比特的信息,因此一般情况下码元速率与比特 速率在数值上是不等的。 • 例:四进制等概分布情况下,一个码元含二比特的信 息量。在数值上 数值上我们有Rb =2RB. 数值上 二进制时,在等概情况下,Rb =RB。也就是说只有 。 在二进制等概分布时才有码元速率和比特速率在数值 数值 上相同。

差错率和信噪比

• 数字通信系统衡量传输消息的可靠程度:误码率或误 信率BER。 通信系统一般要求BER≤10-6,当BER≥10-3时通信 中断。 • 模拟通信系统衡量传输消息的可靠程度:信号与噪声 功率比(信噪比,S/N),单位dB 传输信号的保真程度

系统框图等

• 给出一些基本定义和概念

信息,消息,信号等

• 给出通信系统的基本类型和通信方式

模拟通信系统和数字通信系统等

• 给出通信系统的主要性能指标

通信系统的通信质量等

1. 通信系统的组成

• 通信的目的:保证消息(或信息)的传递,消息的种类多 种多样,不同的消息有不同的系统:电报,电话,数 据… • 典型的通信系统模型:point-to point communication system,将消息从一个点(信源)传送到一定距离以外的目 的地(信宿)。因此几乎所有的电子系统都是通信系统。 • 通信系统基本功能是消息的传递,本课程研究的主要 对象是信息传输的原理和问题----获得可以广泛应用的 通信系统分析和设计方法 • 我们不关心系统的具体实现,我们关心的是符合什么 样条件的通信系统是最佳的。

3. 信息及度量

• 信息:消息中有意义部分。因此,我们可以对消息中信 息进行度量----信息量。 • 消息中所含的信息量I与该消息发生的概率P(x)有关, 其关系应满足以下条件: 1 I是P(x)的函数:I=I[P(x)] 2 P(x)越小 I越大 ;且P(x)=1则I=0 3 若干独立事件构成的消息,所含的信息量等于各独立 事件信息量之和: I[P(x1),P(x2),…]=I[P(x1)]+I[P(x2)]+…. 满足以上条件的函数-----对数函数: I=loga[1/P(x)]= - logaP(x) • 其中a=2, I 为bit; a=e, I为nit。

H:信息源的熵(entropy)。H也可理解为信源中每个消息 所含的平均信息量。 H越大,每个消息的I越大。希望H最大,数学告诉我们只 有在消息等概分布时H为最大。

连续消息的信息量计算

• 可用概率密度函数来描述。连续消息源的平均信息量 为: H1(x)=-∞∫+∞f(x)log2[f(x)]dx Bit f(x)为连续消息的概率密度函数。 Ex.:suppose a digital source formed by four digits 0(1/8), 1(1/2),2(1/8),3(1/4). Find:a)the entropy of the source b)the information quantity for each digit. Sol.: H=1/8log2(8) + 1/2log2(2) + 1/8log2(8) + 1/4log2(4) =1.75bits I1=log8=3bits, I2=log2=1bit, I3=log8=3bits, I4=log4=2bits

通信系统原理

• 教材:通信原理 周炯磐 周炯磐等著 • 主要参考书:通信原理 樊昌信等 • Digital and analog communication systems 5th

edition Leon W. Couch II

• 课时:68小时 68 • 先修课:高等数学,概率论与随机过程,信号 与系统,复变函数,线性代数等 • 授课方式:课堂教学 • 内容:通信传输系统基本原理

• 本课涉及的通信系统是指电或电子通信系统 • 通信:信息的传递过程,因此它包含了传输和交换 ---通信: 传输和交换

Transmission and switching

• 通信系统原理主要要解决的问题是:信息的传递,即通信传 通信系统原理主要要解决的问题是:

输

本章内容提要

• 给出通信原理课程的研究对象ຫໍສະໝຸດ infoTC

noise

R

信号 处理

调制器

解调器

信号 处理

2. 通信系统的分类和通信方式

• • • • • • • • • • • 分类:随意性 按信源特征分:数字通信系统和模拟通信系统 按消息的物理特征分:电报,电话,图象等 按调制方式分:FM,PM,AM等 按传输媒介分:有线,无线等 按信号的复用方式分:FDM,TDM,WDM,CDM等 通信方式: 单工(simplex) 半双工(half-duplex) 全双工(full-duplex) 数字通信中的串序和并序传输方式

通信系统的基本框图

• 一个P-TO-P通信系统的基本模型为:

source transmitter channel receiver sink

info

T

C

noise

R

基本定义和概念

• 结合系统模型介绍一些基本概念和定义 • 信源 信源:消息的产生----离散消息和连续消息 • 几个名词:消息(message),信息(information), 信号(signal) • Message:信源产生的信息的物理表现 • Information:消息的数学抽象(定义) Information: • Signal:传输的电信号,包含了消息。我们研究的重点 是电信号的传输。 • 信号和消息都是信息的物理体现。 • 离散信号源 离散信号源(digital source):消息可取状态(值)的 数目为有限个。 • 模拟信号源 模拟信号源(analog source):消息可取状态(值)的 数目为无限个。

模拟与数字信号

• 模拟信号:状态无限 状态无限,因此信号的时域表达式可以是时间 状态无限 时间 连续函数也可以是时间离散函数 连续函数 时间离散函数

f(t)

时间连续函数

f(t)

时间离散函数

t

t

• 数字信号:状态有限 状态有限,因此信号的时域表达式可以是时间 状态有限 时间 连续函数也可以是时间离散函数 连续函数 时间离散函数 • 如:二进制的一可以是高电平,零低电平;同样一可以是 频率为f1的正弦波,零是频率为f2的正弦波

示例与信源的平均信息量

• 信息量的计算: • M个相互独立的消息等概率传输,每个消息的信息量 为: I=log2[1/(1/M)]=log2M bits • M=2,I=1bit • M=2k,I=k bits • 信源的平均信息量:信源所发出的每个消息所含信息 量的统计平均值:

H=ΣPjI j=Σ Pj log2(1/Pj) bits

4. 通信系统的主要性能指标

• 性能指标 质量指标:是整个通信系统的综合评估 • 通信系统:有效性,可靠性,适应性,标准性,经济性, 可维护性和友好性 • 但从根本来说,通信系统的目的 目的是将信息从信源传递到 目的 信宿,因此可靠性(质量)和有效性(传输效率)是首 可靠性( 可靠性 质量)和有效性(传输效率) 先要考虑的。 • 模拟通信系统的评估:可靠性:发与收信号的差异程度---均方误差(噪声的影响,系统的不完善因素) 有效性:消息中所含的信息量,单位时间可传递的 信息量多少。 • 数字通信系统:信息传输速率和发生差错的概率(误码 概率)

第一章 序论

• 通信发展历史 通信发展历史:远古----非电通信

数字通信:旗语,烽火台(光通信?)等等

• 近代:电通信 1844 Morse;1876: Bell; 1894:Lodge(wireless); 近代:

1900:Marconi;1937:Reeves(PCM);1948:Shannon;1958:IC;60:Elect.Tel. Switching System;1965:Satellite;1972: Cellular Telephone(Motorola);1976:PC;80:Optical fiber;90:DWDM +SDH+Wireless;