基于动态窗口的运动车辆颜色特征提取算法

无人驾驶汽车中的图像处理与目标检测技术研究

无人驾驶汽车中的图像处理与目标检测技术研究随着科技的不断进步和人们对智能交通系统需求的增加,无人驾驶汽车成为了汽车行业的新热点。

而无人驾驶汽车的核心技术之一就是图像处理与目标检测。

本文将科普无人驾驶汽车中的图像处理与目标检测技术,揭示其重要性及应用。

一、图像处理1. 图像传感器图像传感器是无人驾驶汽车中图像处理的起点。

无人驾驶汽车通常配备了多种传感器,如摄像头、激光雷达等。

其中,摄像头是最常用的图像传感器之一,它可以感知车辆周围的环境,采集图像数据。

2. 图像采集与预处理图像采集是指摄像头获取实时图像的过程。

得到的图像数据需要进行预处理,包括去噪、调整图像亮度、对比度等,以提高图像质量和准确性。

此外,还需要进行图像校准,消除摄像头畸变等。

3. 特征提取与图像识别特征提取是图像处理的核心环节。

通过提取图像中的关键特征,如边缘、纹理、颜色等信息,可以帮助识别和跟踪目标。

图像识别算法能够将图像中的内容与已有的数据进行匹配,从而识别出不同的目标,如路标、行人、车辆等。

4. 图像分割与分类图像分割是将图像中不同的区域划分出来,以便更好地理解和处理。

通过图像分割技术,可以将车辆、行人等目标从背景中分离出来,为目标检测奠定基础。

图像分类是将图像划分为不同的类别,如道路、交通标志等,以进一步分析和理解图像。

二、目标检测1. 目标检测算法目标检测是指在图像中准确地定位和识别出不同的目标。

无人驾驶汽车需要通过目标检测算法来检测和识别道路、行人、车辆等。

传统的目标检测算法包括基于模板匹配、基于滑动窗口和分类器、基于特征提取等方法。

而随着深度学习的发展,现代目标检测算法如卷积神经网络(CNN)、区域卷积神经网络(R-CNN)等也得到了广泛应用。

2. 目标跟踪与预测目标跟踪是无人驾驶汽车中的重要任务之一。

通过目标跟踪技术,无人驾驶汽车可以实时地跟踪和预测行人、车辆等目标的位置和运动轨迹。

这对于实现智能行驶、避免碰撞等至关重要。

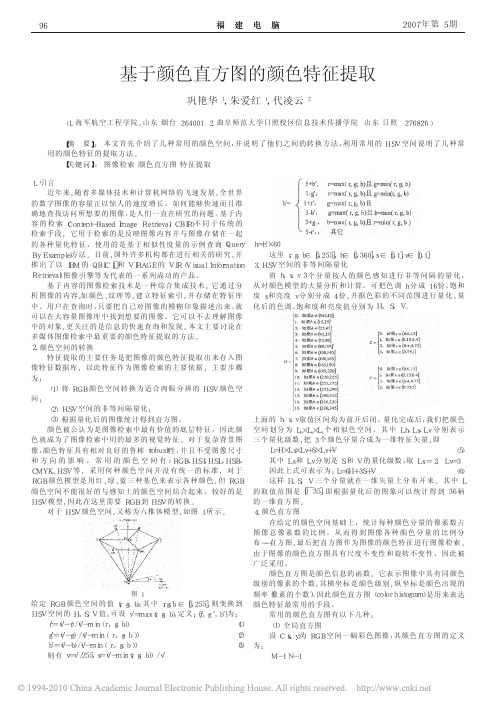

基于颜色直方图的颜色特征提取

推 出 了 以 IBM 的 QBIC[1]和 VIRAGE 的 VIR( Visual Information 3. HSV 空间的非等间隔量化

Retrieval) 图像引擎等为代表的一系列成功的产品。

将 h, s, v 3 个 分 量 按 人 的 颜 色 感 知 进 行 非 等 间 隔 的 量 化 ,

由于区域颜色分布具有局域性, 有的颜色出现的很少, 为了 不敏感, 具有相当强的鲁棒性。同时, 在许多情况下, 颜色又是描

简化直方图描述, 有必要对其进行优选。一种基于阀值的颜色集 述一幅图像最简便而有效的特征。人们对于一幅图像的印象, 往

(color set)的思想是针对颜色直方图中每个颜色项 k, 引入阀值 T 往从图像中颜色的空间分布开始。所有这些都促使颜色成为基

HSV 空间的 H, S, V 值, 可设 v'=max(r, g, b), 定义:{r' , g ' , b'}为:

r'=(v'- r)/(v'- min( r , g, b))

(1)

g'=(v'- g) /(v'- min( r , g, b ))

(2)

b'=(v'- b)/(v'- min( r , g, b ))

96

福建电脑

2007 年第 5 期

基于颜色直方图的颜色特征提取

巩艳华 1, 朱爱红 1, 代凌云 2

( 1. 海军航空工程学院, 山东 烟台 264001 2. 曲阜师范大学日照校区信息技术传播学院 山东 日照 276826 )

【摘 要】: 本文首先介绍了几种常用的颜色空间, 并说明了他们之间的转换方法, 利用常用的 HSV 空间说明了几种常 用的颜色特征的提取方法。

HSV 模型, 因此在这里需要 RGB 到 HSV 的转换。

基于视频的车流量统计算法

基于视频的车流量统计算法常志国;李晶;胡云鹭;郭茹侠【摘要】The vehicle counting algorithm based on virtual line inevitably exists the possibility of missing and error. Concerning this issue, this paper extracts and combines two types of image information- the virtual lines’ relative positions with the objects and its pixel value variance, then a new vehicle segmentation and counting method is proposed. First, it determines the relative positions between the objects and the virtual lines, and combines with the variance of virt ual lines’ pixel value. With these information, it can improves the accuracy of the traffic flow by means of dividing vehicles. A testing system is developed for testing the performance of the method. The system has run in some kinds of weather, and its result is analyzed. The results show that the method has excellent performance both in real-time and accuracy in the daytime and the accuracy was above 95% for each lane of traffic. But the performance in the nighttime may not be optimal. Therefore, improvement is planned to make during following research.%基于虚拟检测线的车辆计数算法不可避免地会出现漏检和误检问题。

一种基于SVM和HOG特征的视频车辆识别算法

• 74•图2 运行界面②快递员模块功能(a)首页:包括“物流查询”,“查看寄快递费用”,“实名注册”,“订单查询”。

(b)收件:包括“快递编号”,“联系电话”,“收件时间”,“地址派送位置”。

(c)寄件:包括“帮寄件”“查找快递员”,“选择寄件的快递公司”。

(d)个人中心:包括“登录”,“添加地址”,“钱包”,“设置”,“问题反馈”。

(e)订单:包括“已完成的订单”,“正在进行的订单”,“订单费用”。

(f)派件:包括“抢单”,“确定派件时间”。

订单模块,如图1所示。

3.系统实现限于篇幅,进介绍部分功能的实现和运行界面。

如图2(a),(b)所示。

(a)图为当用户登录后的界面,有基本的寄件取件等功能。

(b)图为当想为别人代取快递是的界面,需要进行实名制认证,通过后即可成为“快递员”,帮别人代取快递。

4.结论本APP目的在于解决当下大学校园快递无人取,没时间取等问题,运用Android开发,后台服务器、MySQL数据库等技术,实现快递代取,快递代送,大学生课余时间通过实名认证成为“快递员”来帮助同学取快递以及赚取“小费”等功能。

经过测试APP使用方便,设计合理,运行可靠,用户体验感好,有效的解决了人们的需求。

西北民族大学国家级大学生创新创业训练计划资助项目(项目编号:201810742070)。

作者简介:汪慧兴(1997—),男,山东济宁人,现就读西北民族大学数学与计算机科学学院2016级软件工程专业。

视频车检技术在智能交通系统(ITS)中具有广泛的应用。

本文基于梯度分布直方图(HOG)和支持向量机(SVM),开发了一种视频车辆识别算法。

首先介绍了车辆特征提取方法,重点论述了选择车前窗作为样本进行特征提取的优势;描述了HOG特征和SVM 的相关原理;考虑实际的应用场景,对扫描窗的尺寸及扫描方式进行了优化。

实验结果表明,本文提出的算法能够适应复杂的道路环境,对视频图像中的车窗识别效果较好。

引言:智能交通系统(ITS )是将通信技术、传感技术、电子控制技术及计算机处理技术有效地集成应用于交通管理而建立的一种全面、实时、准确、高效的综合交通运输管理系统。

智能驾驶系统中的目标检测技术

智能驾驶系统中的目标检测技术目标检测技术是智能驾驶系统中的核心技术之一。

它的作用是通过分析车辆周围的环境信息,准确地检测出道路上的行人、车辆、交通标志和道路边界等目标物体,为智能驾驶系统提供准确的感知能力,从而确保驾驶安全。

一、目标检测技术的基本原理目标检测技术主要使用计算机视觉和机器学习的方法,通过图像或视频的处理和分析,实现对目标物体的准确检测和识别。

1. 特征提取目标检测技术首先需要从图像中提取出与目标物体相关的特征。

常用的特征提取方法包括颜色特征、纹理特征和形状特征等。

通过对这些特征进行提取和描述,可以有效地表示目标物体在图像中的位置和属性。

2. 候选框生成在确定目标物体的位置时,目标检测技术会生成一系列候选框。

这些候选框是可能包含目标物体的矩形或者多边形区域。

常用的候选框生成方法有滑动窗口和图像分割等。

通过生成候选框,可以缩小目标物体的搜索范围,提高检测的效率。

3. 目标分类和位置回归在生成候选框后,目标检测技术会对每个候选框进行分类和位置回归。

分类是指判断候选框中是否存在目标物体,常用的分类方法有支持向量机、卷积神经网络等。

位置回归是指根据候选框的位置和特征,对目标物体的精确位置进行修正。

二、目标检测技术在智能驾驶系统中的应用目标检测技术在智能驾驶系统中有着广泛应用,主要体现在以下几个方面:1. 碰撞预警和安全驾驶智能驾驶系统利用目标检测技术可以实时地监测行人、车辆和其他障碍物的位置和动态信息。

当检测到潜在的碰撞风险时,系统会及时发出预警信号,提醒驾驶员采取相应的安全措施,从而大大降低交通事故的发生率。

2. 自动泊车和道路辅助目标检测技术可以帮助智能驾驶系统实现自动泊车和道路辅助功能。

系统可以通过检测停车位周围的目标物体,准确判断停车位的大小和空闲情况,并对车辆进行自动控制,实现自动泊车的效果。

同时,在高速公路上,系统也可以通过检测车道线和其他车辆,提供车道偏离预警和自动跟车辅助功能。

基于机器视觉的避障智能小车系统研究

基于机器视觉的避障智能小车系统研究一、本文概述随着技术的快速发展,机器视觉在各个领域的应用日益广泛。

特别是在智能移动机器人领域,基于机器视觉的避障技术成为了研究的热点。

本文旨在探讨基于机器视觉的避障智能小车系统的设计与实现,分析其在现代自动化和智能化领域的应用价值。

本文首先介绍了智能小车系统的研究背景和意义,阐述了基于机器视觉的避障技术在智能小车中的重要性。

接着,文章对机器视觉的基本原理和关键技术进行了概述,包括图像采集、预处理、特征提取和目标识别等步骤。

在此基础上,文章详细描述了避障智能小车系统的总体架构和关键功能模块,如环境感知模块、决策控制模块和执行驱动模块等。

文章还深入探讨了避障算法的设计和实现,包括基于规则的避障策略、基于深度学习的避障方法等。

通过对不同避障算法的比较和分析,文章提出了适用于智能小车的优化算法,并进行了实验验证。

实验结果表明,本文设计的基于机器视觉的避障智能小车系统具有较高的避障性能和稳定性,能够适应复杂多变的环境。

文章总结了基于机器视觉的避障智能小车系统的研究成果和贡献,并展望了未来的发展方向和应用前景。

本文的研究不仅为智能小车的设计和优化提供了理论支持和实践指导,也为机器视觉在其他领域的应用提供了有益的借鉴和参考。

二、系统总体设计在《基于机器视觉的避障智能小车系统研究》的项目中,系统总体设计是确保整个避障智能小车系统能够高效、稳定、安全地运行的关键。

在设计过程中,我们充分考虑了硬件和软件两个方面,力求实现系统的高集成度、高可靠性和高适应性。

在硬件设计方面,我们采用了模块化设计思路,将系统划分为多个功能模块,包括传感器模块、控制模块、驱动模块和电源模块等。

传感器模块主要负责采集环境信息,包括摄像头、超声波传感器等,用于获取实时的视频流和距离数据。

控制模块作为系统的核心,负责处理传感器数据,进行图像处理和决策分析,输出控制指令。

驱动模块则负责将控制指令转换为电机的实际动作,驱动小车前进、后退、转弯等。

自适应融合角点特征的Camshift目标跟踪

自适应融合角点特征的Camshift目标跟踪陈丽君;马永杰【摘要】为了能够实时有效地跟踪运动目标,提出了一种新的自适应融合角点特征和颜色特征的Camshift目标跟踪算法。

该算法融合了角点的特征不变性,并采用Mean-Shift算法提供的非参数核密度估计的统计思想,计算各特征的概率密度函数,用Bhattacharyya系数作为相似性度量函数,利用相似性度量值之比自适应地融合角点特征和颜色特征,将得到的新的概率密度分布结合Camshift跟踪算法实现目标跟踪。

测试结果表明,该算法比传统的Camshift算法跟踪效果更好,更准确。

%In order to track moving targets in real time and effectively, in this paper, a new Camshift target tracking algo-rithm is proposed, in which corner features and color features are fused adaptively. The invariance of the corner is com-bined in this algorithm, and the kernel probability density estimation of the Mean-Shift algorithm is used to calculate the probability density function for each feature. Bhattacharyya coefficient is adopted as similarity measure function, then using the ratio of similarity to achieve adaptive fusion of corner and color features. The new probability density distribution and the Camshift tracking algorithm will be combined to achieve the target tracking. Simulation results show that the algo-rithm is better than traditional Camshift algorithm, and tracks object more accurately.【期刊名称】《计算机工程与应用》【年(卷),期】2014(000)024【总页数】5页(P178-182)【关键词】Camshift;特征融合;Harris角点;Bhattacharyya系数;自适应【作者】陈丽君;马永杰【作者单位】西北师范大学物理与电子工程学院,兰州 730070;西北师范大学物理与电子工程学院,兰州 730070【正文语种】中文【中图分类】TP391目标跟踪是计算机视觉重要的研究方向之一,被广泛应用于监控、视觉导航、军事制导、交通等领域[1],但是,目标和背景的外观发生改变,或者目标的突然运动等因素都会加大目标跟踪的难度。

基于视频的交通目标跟踪方法研究

基于视频的交通目标跟踪方法研究雷云;王夏黎;孙华【摘要】交通目标的检测是智能交通系统(ITS)中的一项关键技术,基于视频跟踪方法的检测技术是目前研究的热点.介绍了近年来提出的一些主要的基于视频的运动目标跟踪方法,对各种方法进行了归类,并分析比较了这些方法的优缺点.在此基础上,着重介绍了一种快速运动目标跟踪方法--MeanShift算法.该算法主要利用图像的颜色统计直方图作为特征,利用Bhattacharyya距离作为目标匹配相似性测度,采用梯度优化方法完成对运动目标的快速跟踪.该方法非常适合对交通目标的跟踪.【期刊名称】《计算机技术与发展》【年(卷),期】2010(020)007【总页数】4页(P44-47)【关键词】智能交通系统;视频图像处理;目标跟踪;MeanShift算法【作者】雷云;王夏黎;孙华【作者单位】长安大学信息工程学院,陕西西安710064;长安大学信息工程学院,陕西西安710064;长安大学信息工程学院,陕西西安710064【正文语种】中文【中图分类】U491.1+160 引言随着经济的发展和社会的进步,对交通场景的监控已经成为一个十分重要的课题。

现如今通过摄像机来监控交通场景,早已被广泛应用于社会生活当中,但是在很多场合下,由人来分析视频序列是不合适的。

而基于计算机视觉和图像处理的视觉监控技术提供了一种更加先进和可行的方法,其广泛的应用前景和潜在的商业价值已经引起了国内外学术界和企业界的极大关注。

文中将对视觉交通监控中的交通目标跟踪方法进行研究。

1 常用的目标跟踪算法目标跟踪,就是通过分析然后在视频序列的每幅图像中找到所感兴趣的运动目标的位置,建立起运动目标在各幅图像中的联系。

简单的说就是在视频序列的每一幅图像中对运动目标进行定位。

基于视频或图像序列的交通目标跟踪长期以来都是计算机视觉、数字视频与图像处理和模式识别领域中一个非常重要和活跃的研究课题。

目标跟踪的作用非常重要,因为它是衔接运动目标检测和目标行为分析与理解的一个重要环节。

a-loam算法

a-loam算法a-loam算法是一种用于在移动机器人中实现自主定位与建图(SLAM)的算法。

例如在无人驾驶汽车中, a-loam算法用于在汽车周围的环境中进行建图和定位。

a-loam算法的全名称是"Adaptive Robustness Analysis Based on LOAM Algorithm",它是LOAM算法的改进版。

与LOAM算法相比,a-loam算法具有更高的鲁棒性和更适应动态环境的特点。

在a-loam算法中,使用了自适应滤波器和统计分析等技术,可以更好地处理复杂的环境变化。

a-loam算法主要包括六个步骤:前后点云配准、平面提取、特征提取、匹配、优化和地图生成。

下面我们来详细介绍一下这六个步骤:一、前后点云配准:在这一步骤中,算法通过对前后时间段的点云进行匹配,以消除机器人移动造成的误差,并估计机器人位姿。

这个过程从激光雷达的原始数据中提取了点特征,并将这些特征描述为局部6自由度(6DoF)的运动模式,以便进行匹配。

二、平面提取:在将前后点云进行配准后,算法将点云聚类成平面和非平面两类。

然后,将非平面点通过曲率特征描述为局部6DoF的运动模式,用于后续匹配。

三、特征提取:在这一步骤中,算法计算非平面点云的特征描述符,并通过描述符匹配来创建一个不确定度图来确定运动。

四、匹配:在这个步骤中,算法将前后时间段的点云进行特征匹配,以获取机器人的位姿反演,并在已有的地图中进行位置估计。

这个过程使用自适应统计方法来提高鲁棒性。

五、优化:在这个步骤中,使用优化算法对位姿进行滑动窗口优化,以确保地图的一致性和最小误差。

六、地图生成:根据前面的步骤生成地图,包括点云地图和位姿信息等。

总之,a-loam算法是一种高鲁棒性和适应性的SLAM算法,适用于自主移动机器人在不确定性高,动态环境复杂的现场应用。

halcon颜色特征提取

halcon颜色特征提取Halcon是一款针对计算机视觉领域的软件工具,拥有强大的图像处理和机器视觉功能。

其中,颜色特征提取是其最常用的功能之一。

在实际应用中,通过提取图像中的颜色特征,可以实现多种目标检测、识别等应用。

本文将针对Halcon颜色特征提取进行详细的介绍。

1. 选择图像并加载首先,在Halcon主界面打开“图像操作(Image)”选项卡,选择“加载图像(Read Image)”命令,加载需要进行颜色特征提取的图像。

可以使用该命令的窗口浏览器选择图像路径并加载。

2. 颜色空间设置接下来,在图像操作选项卡中选择“颜色空间(Color Space)”命令,在弹出的窗口中选择需要进行颜色特征提取的颜色空间。

通常情况下,选择Halcon支持的标准颜色空间,如RGB,HSV等。

当然,也可以自己定义颜色空间,根据具体需求进行调整。

3. 创建颜色模板完成颜色空间设置后,需要创建用于颜色特征提取的颜色模板。

选择“颜色模板(Create Color Template)”命令,在弹出的窗口中选择需要提取特征的颜色范围,并指定颜色模板的名称。

通常情况下,选择某一特定色值或者一定颜色范围,用于提取具有相似颜色的图像特征。

4. 应用颜色模板完成颜色模板创建后,需要应用该模板实现颜色特征提取。

选择“颜色特征(Color Feature)”命令,在弹出的窗口中选择刚刚创建的颜色模板,并设置提取颜色特征的方法和阈值。

其中,提取颜色特征的方法包括区域面积,颜色灰度和颜色直方图等。

阈值则用于对特征进行筛选,滤除不必要的数据。

5. 显示结果完成以上步骤后,可以通过选择“显示区域(Display Region)”命令,查看颜色特征提取的结果。

在显示窗口中,可以观察到经特征提取后的图像区域,颜色特征的分布情况,以及可能的异常点等信息。

总结:通过以上步骤,我们可以成功的实现Halcon颜色特征提取功能。

在具体的实际应用中,还需要根据不同场景进行参数的调整和算法的优化,实现更高效准确的特征提取。

点云目标识别算法

点云目标识别算法随着激光雷达技术的发展,点云数据成为了三维环境感知中最重要的数据形式之一。

在自动驾驶、机器人感知和虚拟现实等领域,点云目标识别算法是一个非常重要的研究方向。

本文将介绍点云目标识别算法的基本原理和常见方法。

1. 点云点云是由大量的点组成的三维离散数据。

每个点都有自己的坐标和属性信息,如法向量、颜色等。

点云可以通过激光雷达、摄像机和深度摄像机等设备获取。

2. 点云目标识别算法点云目标识别算法的主要任务是在点云数据中识别出目标物体并提取其特征。

常见的点云目标包括车辆、行人、建筑物等。

点云目标识别算法主要分为两个阶段:物体检测和物体识别。

物体检测是指在点云数据中寻找可能的目标物体,并将其转化为一个三维框。

物体识别是指通过对三维框内的点云进行特征提取和分类,确定目标物体的类别。

3. 常见的点云目标识别算法(1)基于滑动窗口的方法基于滑动窗口的方法是将点云数据分割为多个三维框,然后对每个三维框进行分类。

这种方法可以使用卷积神经网络(CNN)来提取特征。

常见的基于滑动窗口的方法包括F-PointNet和VoxelNet等。

(2)基于点云分割的方法基于点云分割的方法是将点云数据分割为多个小部分,然后对每个小部分进行分类。

这种方法可以使用传统的分类算法,如支持向量机(SVM)和随机森林(RF)。

常见的基于点云分割的方法包括PointSIFT和PointCNN等。

(3)基于深度学习的方法基于深度学习的方法是使用深度神经网络(DNN)来提取点云数据的特征,并进行分类。

这种方法可以使用PointNet、PointNet++、DGCNN等模型。

基于深度学习的方法通常具有更高的准确性和更好的鲁棒性。

4. 总结点云目标识别算法是一个非常重要的研究方向。

在自动驾驶、机器人感知和虚拟现实等领域,点云目标识别算法是必不可少的。

本文介绍了点云目标识别算法的基本原理和常见方法,希望能对读者有所启发。

基于多特征融合的视频检索算法

基于多特征融合的视频检索算法侯严明;李菲菲;陈虬【摘要】随着视频等多媒体数据呈指数式迅猛增长,高效快速的视频检索算法引起越来越多的重视.传统的图像特征如颜色直方图以及尺度不变特征变换等对视频拷贝检测中检索速度以及检测精度等问题无法达到很好的效果,因此文中提出一种多特征融合的视频检索方法.该方法利用前后两帧的时空特征进行基于滑动窗口的时间对齐算法,以达到减少检索的范围和提高检索速度的目的.该算法对关键帧进行灰度序列特征、颜色相关图特征以及SIFT局部特征提取,然后融合全局特征和局部特征两者的优势,从而提高检测精度.实验结果表明,该方法可达到较好的视频检索精度.【期刊名称】《电子科技》【年(卷),期】2019(032)005【总页数】6页(P44-48,54)【关键词】视频检索;滑动窗口;多特征融合;颜色自相相图;时空特征;关键帧【作者】侯严明;李菲菲;陈虬【作者单位】上海理工大学光电信息与计算机工程学院,上海200093;上海理工大学光电信息与计算机工程学院,上海200093;上海理工大学光电信息与计算机工程学院,上海200093【正文语种】中文【中图分类】TP391.41当今社会,人们生活中的方方面面都和电子产品有很深的联系。

同时,越来越多的信息通过图像和视频来进行传递。

虽然信息全球化的不断扩展给我们带了很多方便,但是也因为信息大爆炸使得处理这些大数据的时间不足。

而由于移动互联网时代快速发展,在很多视频分享平台中出现了大量的重复或者近似的视频,不仅影响了用户体验,而且侵犯了原创视频的知识产权。

因此,如何在保证高检测精度的前提下实现快速视频检索成为了一项重要的研究课题。

在实际生活中,视频相似性变换具有多样性与不确定性。

但这些视频主要由原始视频经过光学变换或时间变换等方式转换产生。

视频变换方式包括编码格式、比特率、颜色亮度、插入LOGO、添加字幕以及添加不相关帧等等变化。

许多方法对各种变换都有一定的效果,但不同变化之间存在着一定差异。

一种基于颜色和边缘特征的Mean Shift目标跟踪算法

Ke r y wo ds:ta e a ki g;M e it d p i r g tt c n r n a Sh f ;a a t ve;m o e p tn d lu dai g

在动 态环 境 下进行 目标跟踪 是 当今 机器 视 觉

线 索 , 大 的特 点 就 是 跟 踪 系 统对 环 境 和 场 景 变 最 化 的 自组 织 和 自适 应 力 强 。C ln ol s等 将 一 种 i 在 线多 特 征 自适 应 选择 机 制嵌 入在 均值 漂移 跟 踪

t o a p o d n m i ha g n n io m e t To s v hepr blm ,a n w e n Sh f a g tta k n l o y t da tt y a c c n i g e v r n n. ol e t o e e M a i t r e r c i g a g — t

缺 乏有效 的模板更 新 机制 。

除这种影响 , 本文对亮度设定阈值 , 剔除掉小于或 者大 于一 定亮 度值 的像 素 。本文 只考虑那 些 与亮 度值 大 于 1 0或者小 于 2 0对 应 的 值 。 4

0。 V =0

6 0ox

=尺

6  ̄X G - B 0

学 基 金 ( 目编 号 :0 8 C 4 0 项 20 Z 50 8)

作者简介 : 祥滨( 93一) 男 , 石 16 , 辽宁普兰店人 , 博士 , 教授 , 主要研究方 向: 分布式虚拟现实 、 图像处理 、 游戏 , — a : b a . 网络 Em i s @su lx

模式识别的动态特征提取方法

模式识别的动态特征提取方法随着科技的不断进步,人工智能的应用范围越来越广泛,其中模式识别技术是一个非常重要的方向。

然而,在实际应用中,特征提取一直是模式识别中最关键的环节之一。

在许多实际应用中,要识别的模式通常都是动态的,因此需要采用动态特征提取方法来对模式进行刻画和描述。

本文将从动态特征提取方法的相关技术入手,深入分析在模式识别中的应用和实际意义。

一、基于基准模型的特征提取在模式识别中,最常用的特征提取方法是基于基准模型的特征提取。

这种方法通常是通过对一个基准模型和待识别模式的比较,来提取出可靠的特征信息。

在动态场景中,基准模型通常是一个时间序列,而待识别模式则是从基准模型中提取出的某一段子序列。

子序列的选取方式也可以根据实际应用进行优化,例如可以使用滑动窗口的方式从不同位置提取子序列。

在基准模型和待识别模式之间的比较中,常用的度量方式有欧式距离、曼哈顿距离以及余弦距离。

例如,欧式距离可以通过计算基准模型和待识别模式之间各个时间点的点差平方和来计算。

通过这种方法,可以提取出基准模型和待识别模式之间的所有时间点的差异,从而进一步分析模式的动态特征。

二、基于自适应滤波的特征提取除了基于基准模型的特征提取方法之外,还可以采用基于自适应滤波的特征提取方法。

这种方法的核心思想是通过将信号进行滤波,提取出具有不同动态特征的信号,从而进一步分析和分类模式。

该方法通常采用一系列高通、低通或带通滤波器来提取特定范围内的动态特征,例如频率范围等。

在实际应用中,该方法通常需要根据不同的信号特征进行调整和优化。

例如,对于呼吸信号,可以采用带通滤波器来提取呼吸率,以及通过低通滤波器来提取呼吸振幅。

同样,对于心电信号,可以根据其特定波形进行不同滤波处理,例如QRS波形采用带通滤波器,P波形和T波形采用低通滤波器等。

三、基于时频分析的特征提取除了基于基准模型和自适应滤波器的方法之外,还可以采用基于时频分析的特征提取方法。

该方法可以将信号在时间和频率上进行分析,从而进一步提取信号的动态特征。

基于动态窗口的运动车辆颜色特征提取算法

2 ,62 ) 0 4 (4 1 0

1 9

基于 动态窗 口的运动车辆 颜色特征提 取算法

佟 守愚 郑黎 黎 杨 吉 丁 同强 , , ,

TO N G Shou— u , y ZH EN G Lil, -i YAN G Ji t . e e r h o ,e a1 s a c R n c l r e ur e r ton o o f at e xt ac i al ihm of gort m o ng vi ve c e hil bas d e

ae ajs d acrig t te v hce cne oriae n eil tp s i t fc se e h B c lrmo e i ue n r du t codn o h e i e t codnts ad vhc y e n ri cn . e RG oo dl s sd i e l r e a T

1 引言

运动 车辆 的分类 识别 与跟踪 技术 是智能 交通 系统 (T ) I S 中先进的交通管理系统( T ) A MS和先进的车辆控制系统 ( VC ) A S 的重要研 究 内容 , 此类 问题 的研 究常 常需要 借助 车辆 的颜色

信 息 。颜 色是 图像 内容组成 的基本 要素 , 人识 别图像 的主 是

t e n t t t e e f c i e e s a d b n ft o h r p s d me h d o d mo s a e h fe t n s n e e s f t e p o o e t o . r v i Ke r s mo i g v h c e c l r f a u e d n mi n o y wo d : v n e i l ; o o e t r ; y a c wi d w

无人驾驶车辆_北京理工大学中国大学mooc课后章节答案期末考试题库2023年

无人驾驶车辆_北京理工大学中国大学mooc课后章节答案期末考试题库2023年1.2007年 DARPA举办的城市挑战赛,冠军是斯坦福大学的无人车。

参考答案:错误2.相机与激光雷达数据融合主要是指空间数据融合。

()参考答案:错误3.关于激光雷达slam,以下描述正确的有()参考答案:Gmapping 采用粒子滤波的方法,在二维激光雷达slam中使用广泛。

_Karto SLAM采用图优化的方法计算更新激光雷达的位姿。

_Cartographer以子地图为单位构建全局地图,以消除构图过程中产生的累积误差。

_Hector SLAM采用基于扫描匹配的方法,在传感器精度高的情况下,定位建图效果好。

4.视觉里程计的目的是根据拍摄的图像估计相机的运动,其关键步骤包括()参考答案:特征提取_局部优化_运动估计_特征匹配5.以下哪些曲线可以用于状态空间采样()参考答案:Dubins曲线_Reeds-shepp曲线_B样条曲线_高次多项式曲线6.单层感知机无法解决异或问题,这是因为异或问题是一个非线性问题,而单层感知机属于一种线性分类器。

参考答案:正确7.LPA*算法是一种实时、增量式的规划算法。

参考答案:错误8.通过卫星播发导航电文的方式可以将电离层时间误差、对流层时间误差、多路径延迟误差和卫星位置j等信息提供给用户。

参考答案:正确9.拓扑地图模型选用节点来表示道路上的特定位置,用节点与节点间的关系来表示道路间联系。

这种地图表示方法结构简单、存储方便、全局连贯性好,适合于大规模环境下的路径规划。

参考答案:正确10.相机成像时,像素点是离散的,像素值是连续的。

参考答案:错误11.假如激光雷达坐标系到车体坐标系的旋转矩阵为[0.83, -0.26, 0.49; 0.36, 0.93,-0.11; -0.42, 0.27, 0.87;],平移向量为[-0.1, -0.6, 0.6],激光雷达坐标系中坐标为[1.6, -1.5, 1.5]的点,在车体坐标系中的坐标是()参考答案:[2.35, -1.58, 0.83]12.Dijkstra算法只能求出起点到终点的最短路径,不能得到起点到其它各节点的最短路径。

滑动窗口和人工特征提取算法

滑动窗口和人工特征提取算法首先,我们来了解一下滑动窗口算法。

滑动窗口算法是一种基于窗口扫描的方法,它将一个固定大小的窗口在输入数据上从左到右滑动,并在每个窗口位置上进行分类或者检测操作。

滑动窗口算法通常用于目标检测、行人检测、物体识别等任务。

其基本思想是将输入数据分割成多个固定大小的子窗口,然后在每个子窗口上运行分类或者检测算法。

通过调整窗口的大小和位置,可以在不同尺度和位置上进行目标检测或者分类。

滑动窗口算法的优点是简单易懂、易于实现。

它可以适应不同尺度的目标,具有一定的稳定性和鲁棒性。

然而,滑动窗口算法也存在一些缺点。

首先,滑动窗口算法需要对输入数据进行多次扫描,计算复杂度较高。

其次,滑动窗口算法只考虑了局部信息,没有利用全局上下文信息。

此外,滑动窗口算法的窗口大小和位置选择有一定的主观性,需要手动调整参数。

接下来,我们来介绍人工特征提取算法。

人工特征提取算法是一种通过设计合适的特征来描述输入数据的方法。

在计算机视觉和模式识别中,人工特征提取算法常用于图像分类、目标识别和图像检索等任务。

通过提取有效的特征,可以减少数据维度、提高分类或者识别准确率。

人工特征提取算法的基本思想是将输入数据映射到一个高维特征空间,然后在特征空间上进行分类或者检测。

常用的人工特征提取算法包括SIFT、HOG和SURF等。

这些算法通过提取图像的局部纹理、形状和颜色等特征来描述图像的内容。

人工特征提取算法的设计需要依据专业知识和经验,并且需要对不同任务进行定制。

人工特征提取算法的优点是可以提取有效的特征来描述输入数据。

这些特征具有一定的可解释性,可以传递对输入数据的理解。

此外,人工特征提取算法的计算复杂度较低,适用于大规模数据处理。

然而,人工特征提取算法也存在一些缺点。

首先,特征的设计和选择需要专业知识和经验,不可避免地带有主观性。

其次,人工特征提取算法很难适应不同的任务和数据集,需要进行针对性的调整和优化。

综上所述,滑动窗口算法和人工特征提取算法是计算机视觉和模式识别领域中常用的两种基本技术。

基于图像处理的车辆检测与识别算法研究

基于图像处理的车辆检测与识别算法研究车辆的检测与识别在交通管理、城市规划和智能交通系统等领域具有重要意义。

随着图像处理技术的发展和计算机性能的提升,基于图像处理的车辆检测与识别算法成为当前研究的热点。

本文将重点研究车辆检测与识别算法的基本原理、发展历程以及应用场景。

一、车辆检测算法的基本原理车辆检测算法的目标是从图像或视频中准确地定位和识别车辆。

基于图像处理的车辆检测算法通常包括以下几个步骤。

1. 图像预处理:包括图像的灰度化、滤波和增强等操作,以提取车辆特征。

2. 区域提取:通过分割和边缘检测等方法,将车辆区域从背景中提取出来。

3. 特征提取:利用图像特征描述算子,如HOG(Histogram of Oriented Gradients)、LBP(Local Binary Patterns)等,提取车辆的特征向量。

4. 目标识别:通过机器学习和模式识别算法,如支持向量机(SVM)、卷积神经网络(CNN)等,对提取到的特征向量进行分类和识别。

二、车辆检测与识别算法的发展历程车辆检测与识别算法经历了漫长的发展过程,不断积累经验和改进方法。

下面简要介绍几种常见的算法。

1. Haar特征检测算法:该算法利用Haar小波特征和AdaBoost分类器,通过在图像上滑动窗口的方式进行目标检测,被广泛用于人脸和车辆检测。

2. HOG特征检测算法:该算法通过提取图像中的梯度方向直方图,来描述车辆的外观特征。

它具有计算简单、检测速度快的优势,被广泛应用于车辆检测。

3. CNN深度学习算法:该算法通过多层卷积神经网络进行特征提取和分类。

由于其强大的学习能力和适应性,目前被认为是车辆检测与识别的state-of-the-art 算法。

三、车辆检测与识别算法的应用场景基于图像处理的车辆检测与识别算法在许多领域具有广泛的应用。

以下是几个应用场景的简要介绍。

1. 交通管理:车辆检测与识别算法可用于交通流量统计、违法监测和交通信号自适应控制等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一阶颜色矩反映了图像的平均色, 二阶颜色矩描述了图 像颜色分布的一致性。由图 2 和图 3 可以看出, 在车头部分车 体颜色分布相对于其他部分颜色的一致性好得多, 因此可以 用二阶颜色矩来区分车窗和车头, 然后用一阶矩来描述车体 的主要颜色, 提取算法如下:

佟守愚, 郑黎黎, 杨

吉, 等: 基于动态窗口的运动车辆颜色特征提取算法

[2]

2

算法描述

算法基本思路是首先利用背景差分方法提取交通场景中

的车辆, 并剔除车辆阴影对车辆中心定位的影响; 然后根据车 辆中心坐标和车辆类型的不同, 在车辆中心区域开设 3 个动 态窗口, 通过二阶颜色矩来分析比较每个窗口区域内的颜色 一致性; 最后选取颜色一致性最好的区域, 计算其一阶颜色 矩, 并以此作为所检测车辆的主体颜色。算法流程如图 1 所示。

Computer Engineering and Applications 计算机工程与应用

2010, 46 (24)

19

基于动态窗口的运动车辆颜色特征提取算法

佟守愚 1, 郑黎黎 2, 杨 吉 1, 丁同强 2 TONG Shou-yu1, ZHENG Li-li2, YANG Ji1, DING Tong-qiang2

为( x ′c y ′c), 则其颜色特征窗口 (图 3) 的坐标( x ′i y ′ j )按如下公式 (2) 和 (3) 确定, 即先平移, 再按视距深度进行比例缩放:

x͂ i = xi + ( x ′c - x c) y͂ j = y j + ( y ′c - y c) y′ y′ x ′i = c x͂ i y ′ j = c y͂ j yc yc

O

x ′1 x ′2

(2) (3)

X

图1

车辆颜色特征提取算法流程图

y ′1 y ′2 y ′3 y ′4

考虑阴影的影响, 很可能导致如下严重问题: (1) 提取的车辆 中心位置坐标严重偏离实际; (2) 目标类型的判断出现严重错 误。这些都将直接影响到车辆颜色提取窗口的确定, 从而影 响颜色提取的准确性。近年来阴影消除已成为基于视频技术 的交通信息检测研究的一项重要内容[5-8]。文中采用文献[8]提 出的阴影剪除方法。

Y

2.2

车辆中心定位与车型判别

利用图像背景差分方法将车辆目标从背景中提取出来并

图3

车辆颜色特征动态窗口

2.4

车辆颜色信息的提取

确定了车辆的位置后, 就可以根据位置信息进一步获取

剪除阴影, 即可对车辆进行定位, 也就是确定车辆的中心。对 剪除阴影后的差分图像作二值化处理, 得到二值化的车辆图 像。车辆的中心位置可以通过计算各象素点横、 纵坐标相加 求和后取平均来求得车辆的中心位置坐标C ( x c y c), 如下式:

于多色或杂色车辆颜色特征识别效果也在 80%以上。在交通 场景中对运动车辆的颜色特征提取会受到诸多因素的干扰, 如场景中的天气、 光照强度与角度、 车辆的阴影、 车型以及不 同颜色模型的选取等, 因此, 如何克服各种因素导致的颜色提 取失真, 仍是一个有待深入研究的课题。

2010, 46 (24)

21

(1) 根据车辆的中心坐标, 在相应的视频图像中找到车辆 的对应区域, 由中心点沿车体方向开 3 个连续的窗, 如图 3 所示; (2) 求得每个窗内的 RGB 平均二阶颜色矩M i = (r 2 + g 2 + b 2)/3, 计算M min = min(M1, M 2, M 3); (3) 计算与M min相应的区间内的一阶颜色矩(r1, g1, b1)。

型的不同进行动态调整; 颜色提取算法采用 RGB 颜色模型, 利用颜色的一阶矩和二阶矩作为车辆主体颜色的判定依据。算法经 实验验证具有较高的检测精度。 关键词: 运动车辆; 颜色特征; 动态窗口 DOI: 10.3778/j.issn.1002-8331.2010.24.006 文章编号: 1002-8331 (2010) 24-0019-03 文献标识码: A 中图分类号: TP391.41

(4) (5) (6) (7) (8) (9)

相同的不同车辆在视频显示时, 视距远的车辆会比视距近的 车辆小; 即使同一运动辆车, 在不同时刻抓拍到的图像帧, 其 显示的车辆图像大小也必定不同。因此, 在车辆中心区域开 设的 3 个颜色提取窗口的大小应随着车辆中心位置的不同进 行动态调整。即使在摄像机相同视距上, 对于不同大小的车 辆, 其颜色提取窗口的大小也应根据车辆类型不同而进行相 应的动态调整。具体实现过程如下: (1) 在每一车道某一固定位置分别抓拍大、 中、 小 3 种类 型的静止车辆 (称为基准车辆) 图片, 并根据式 (1) 提取基准车 辆的中心坐标( x c y c), 作为后续动态窗口调整时的基准坐标。 (2) 依据车头方向, 沿车辆纵向中心线位置由前至后连续 开设 3 个大小相同的颜色特征提取窗口, 窗口的位置坐标和 尺寸大小根据实验的实际显示状况确定, 并作为后续动态窗 口调整时的基准窗口。图 2 所示的是小型基准车辆颜色窗口 的位置和大小。 (3) 设同一车道小型运动车辆的中心坐标按公式 (1) 提取

2.1

车辆检测与阴影剪除

在车辆中心位置开设窗口时, 需要确定车辆的中心位置

坐标并判别车辆类型。本文利用背景差分方法提取车辆目 标。但该方法的缺点是提取场景内目标时, 将目标和它的阴 影作为一体分割出来, 所以阴影点将被误检为目标点。如不

基金项目: 国家自然科学基金 (the National Natural Science Foundation of China under Grant No.50808093/E0807) ; 中国博士后科学基金 (the Postdoctoral Science Foundation of China under Grant No.20070411000) 。 作者简介: 佟守愚 (1962-) , 男, 博士, 副教授, 主要研究方向: 交通信息工程与控制; 郑黎黎 (1975-) , 女, 博士后, 副教授, 研究方向: 智能交通系统; 杨吉 (1959-) , 副教授, 研究方向: 数学建模; 丁同强 (1977-) , 博士, 副教授, 研究方向: 交通安全。 收稿日期: 2010-03-19 修回日期: 2010-07-09

x c = 1 å xi y c = 1 å yi L i=0 L i=0

L-1 L-1

车辆的颜色信息。由于摄像机是以一定的俯视角度来拍摄车 辆, 挡风玻璃等部分占据了图像中车辆目标区域相当的面积, 对车辆的颜色提取造成很大干扰, 因此如何从目标区域中分 离出带有车辆颜色信息的部分将对颜色信息提取至关重要。 文中就这一问题给出了利用一阶、 二阶颜色矩来区分和描述 车体信息的有效方法。颜色矩是反映一幅图像颜色及其分布 的统计量。一幅用 RGB 表示的大小为 m×n 的图像 f (i j)的一 阶颜色矩(r1 g1 b1)、 二阶颜色矩(r 2 g 2 b 2)表示如下:

1.空军航空大学 基础部, 长春 130022 2.吉林大学 交通学院, 长春 130025 1.Foundational Department, Aviation University of Air Force, Changchun 130022, China 2.College of Transportation, Jilin University, Changchun 130025, China E-mail: shouyutong@ TONG Shou-yu, ZHENG Li-li, YANG Ji, et al.Research on color feature extraction algorithm of moving vehicle based on dynamic puter Engineering and Applications, 2010, 46 (24) : 19-21. Abstract:A dynamic windows based color extraction algorithm of moving vehicle is proposed.The color extraction windows are adjusted according to the vehicle center coordinates and vehicle types in traffic scene.The RGB color model is used in color extraction algorithm.The main color of vehicle is judged by color moment and second moment.Experiments are given to demonstrate the effectiveness and benefits of the proposed method. Key words:moving vehicle; color feature; dynamic window 摘 要: 提出了基于动态窗口的运动车辆颜色提取算法, 其中颜色提取窗口根据车辆中心坐标在交通场景中的位置以及车辆类

r1 = g1 = b1 = r2 = g2 = b2 = 1 å r(i j) m´n å i=0 j=0 1 å g(i j) m´n å i=0 j=0 1 å b(i j) m´n å i=0 j=0 1 å (r(i j) - r1)2 m´n å i=0 j=0 1 å (g(i j) - g1)2 m´n å i=0 j=0 1 å (b(i j) - b1)2 m´n å i=0 j=0

1

引言

运动车辆的分类识别与跟踪技术是智能交通系统 (ITS)

前人研究成果的基础上, 提出了基于动态窗口的运动车辆颜 色提取算法, 其中颜色提取窗口根据车辆中心坐标在交通场 景中位置以及车辆类型的不同进行动态调整。算法经实验验 证具有较高的检测精度。