R语言(多元回归)1

多元回归分析R语言代码

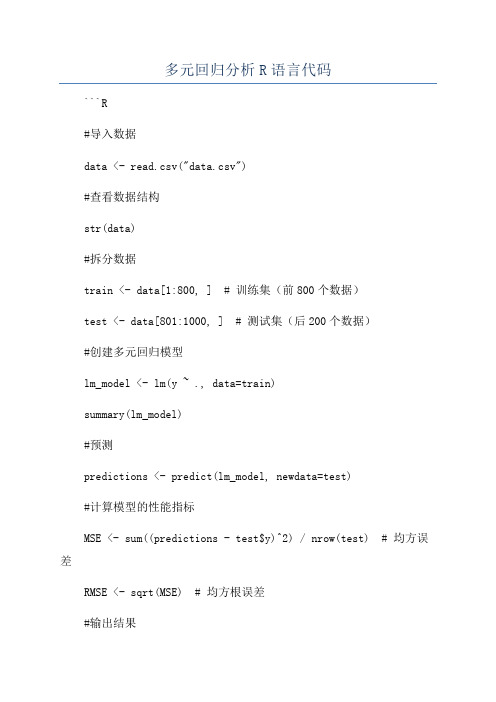

多元回归分析R语言代码```R#导入数据data <- read.csv("data.csv")#查看数据结构str(data)#拆分数据train <- data[1:800, ] # 训练集(前800个数据)test <- data[801:1000, ] # 测试集(后200个数据)#创建多元回归模型lm_model <- lm(y ~ ., data=train)summary(lm_model)#预测predictions <- predict(lm_model, newdata=test)#计算模型的性能指标MSE <- sum((predictions - test$y)^2) / nrow(test) # 均方误差RMSE <- sqrt(MSE) # 均方根误差#输出结果print(paste("MSE:", MSE))print(paste("RMSE:", RMSE))```在以上代码示例中,我们首先导入数据集,然后拆分成训练集和测试集。

接下来,使用`lm(`函数创建多元回归模型,其中`y ~ .`表示使用除因变量(`y`)外的所有其他变量作为自变量。

使用`summary(`函数可以查看模型的统计摘要信息。

然后,我们使用训练好的模型对测试集进行预测,得到预测值`predictions`。

接着,我们计算模型的性能指标,例如均方误差(MSE)和均方根误差(RMSE)。

最后,我们输出结果。

使用`print(`函数将MSE和RMSE输出到控制台上。

需要注意的是,以上代码仅为多元回归分析的一个简单示例,在实际应用中可能需要根据数据集的特点和分析目的进行相应的修改和调整。

r语言 多元回归 解释

r语言多元回归解释多元回归简介多元回归是一种统计技术,用于研究多个自变量(预测变量)对单个因变量(响应变量)的影响。

其目标是创建一个方程,利用自变量预测因变量的值。

模型方程多元回归模型通常表示为以下方程:```Y = β0 + β1 X1 + β2 X2 + ... + βn Xn + ε```其中:Y 是因变量,被自变量预测。

X1, X2, ..., Xn 是自变量,用于预测 Y。

β0 是截距,表示当所有自变量都为零时的 Y 值。

β1, β2, ..., βn 是回归系数,表示每个自变量与 Y 之间的线性关系。

ε 是误差项,表示模型无法解释的 Y 值的变化。

回归系数的解释回归系数(βi) 表示自变量 Xi 单位变化对 Y 产生的平均变化量,其他自变量保持不变。

正回归系数(βi > 0):随着 Xi 的增加,Y 也倾向于增加。

负回归系数(βi < 0):随着 Xi 的增加,Y 倾向于减少。

回归系数接近零(βi ≈ 0):Xi 与 Y 之间几乎没有线性关系。

模型拟合优度为了评估模型的拟合优度,可以使用以下指标:决定系数 (R²):表示模型解释 Y 值变化的程度。

R²值为1 表示模型完美拟合数据,而 R²值为 0 表示模型无法解释任何方差。

调整决定系数 (R²adj):与 R²类似,但它考虑了模型的自变量数量,以惩罚过拟合。

均方根误差 (RMSE):表示预测值和观测值之间的平均差异。

RMSE 值较小表明模型预测更加准确。

多元回归的假设为了确保多元回归模型的有效性,必须满足以下假设:线性关系:自变量和因变量之间的关系必须是线性的。

自变量独立性:自变量不应相互关联,即不存在多重共线性。

正态性:误差项应服从正态分布。

等方差性:误差项的方差应在所有自变量值上保持恒定。

多元回归的优点可以同时考虑多个自变量。

提供每个自变量对因变量影响的量化度量。

允许预测因变量的值,给定一组自变量值。

多元线性回归分析数据可视化的R

在数据分析中,多元线性回归是一种常见的预测和分析方法,它可以帮助我 们了解自变量和因变量之间的关系。然而,对于非专业的数据分析师来说,理解 回归结果可能比较困难。这时,数据可视化就显得尤为重要。R语言作为一种开 源的数据分析工具,被广泛用于多元线性回归分析和数据可视化。本次演示将介 绍在R语言中进行多元线性回归分析和数据可视化的基本概念、方法和实际应用 案例。

然后,我们使用summary()函数 查看回归结果。

css

summary(price_model)

3、数据可视化接下来,我们使用ggplot2包将回归结果可视化。首先,我们 创建一个散点图,以显示每辆车的功率、气缸数和马力与价格之间的关系。然后, 我们添加一个拟合线来展示回归模型的结果。

scss

多元线性回归模型可以表示为: Y = β0 + β1X1 + β2X2 + β3X3 + β4X4 + ε

其中,β0是截距项,β1、β2、β3和β4是自变量的系数,ε是误差项。

为了估计这个模型中的参数,我们可以使用最小二乘法。最小二乘法是一种 优化算法,它通过最小化预测值和实际值之间的平方误差来估计模型参数。

多元线性回归分析数据可视化 的R

01 理论概述

目录

02 方法与技巧

03 案例分析

04 scss

05 data(mtcars)

06 scss

07 css

目录

08 scss

09 library(ggplot2)

010 theme_minimal()

011 总结

012 参考内容

多元线性回归分析数据可视化在 R语言中的重要性和应用场景

方法与技巧

在R语言中进行多元线性回归分析和数据可视化有很多方法和技巧。下面介 绍一些常用的技巧:

R语言与回归分析

R语言与回归分析R语言是用于统计分析和图形展示的开源编程语言。

它提供了丰富的统计和图形显示功能,特别适用于回归分析。

回归分析是一种统计方法,用于探索两个或多个变量之间的关系。

回归分析可以用来预测一个变量(因变量)的值,基于其他变量(自变量)的值。

回归分析通常用来解决以下问题:-预测:根据已知的自变量值,预测因变量的值-解释:了解自变量如何解释因变量的变化-诊断:检验模型的拟合程度,评估因变量的异常值和离群值在R语言中,回归分析可以通过多种函数和包来实现。

以下是R语言中最常用的回归分析函数和包:1. lm函数:lm函数是R中最基本的回归函数,用于拟合线性回归模型。

它可以通过最小二乘法估计回归系数,并得到相应的拟合优度、方差分析和置信区间等结果。

2. glm函数:glm函数用于拟合广义线性模型,可以处理因变量为二元变量或计数变量的情况。

它使用的是最大似然估计方法,可以拟合logistic回归、泊松回归等非线性模型。

3. caret包:caret包提供了一种简洁的接口来拟合回归模型,并提供了模型选择、交叉验证和预测等功能。

它可以自动选择最佳的模型,并使用不同的评估指标进行模型性能评估。

4. ggplot2包:ggplot2包是一个用于绘制高质量统计图形的包。

它支持直观的图形语法,可以用于绘制回归线、散点图和残差图等。

在进行回归分析之前,我们需要准备数据。

R语言提供了多种输入数据的方式,包括读取Excel文件、导入CSV文件、从数据库中读取数据等。

在数据准备之后,我们可以使用lm函数或glm函数拟合回归模型,并使用summary函数查看结果。

通过summary函数,我们可以获取拟合的系数、截距、p值、拟合优度R-squared等统计指标。

除了基本的回归函数和包,R语言还提供了更加灵活和复杂的回归模型,如非线性回归、广义可加模型(GAM)和混合效应模型等。

这些模型需要使用更专业的包,如nlme包、lme4包和mgcv包等。

r语言结构方程模型如何构建回归模型

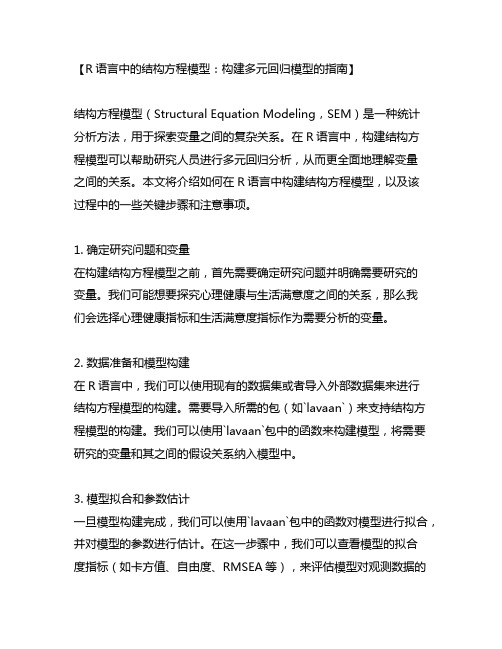

【R语言中的结构方程模型:构建多元回归模型的指南】结构方程模型(Structural Equation Modeling,SEM)是一种统计分析方法,用于探索变量之间的复杂关系。

在R语言中,构建结构方程模型可以帮助研究人员进行多元回归分析,从而更全面地理解变量之间的关系。

本文将介绍如何在R语言中构建结构方程模型,以及该过程中的一些关键步骤和注意事项。

1. 确定研究问题和变量在构建结构方程模型之前,首先需要确定研究问题并明确需要研究的变量。

我们可能想要探究心理健康与生活满意度之间的关系,那么我们会选择心理健康指标和生活满意度指标作为需要分析的变量。

2. 数据准备和模型构建在R语言中,我们可以使用现有的数据集或者导入外部数据集来进行结构方程模型的构建。

需要导入所需的包(如`lavaan`)来支持结构方程模型的构建。

我们可以使用`lavaan`包中的函数来构建模型,将需要研究的变量和其之间的假设关系纳入模型中。

3. 模型拟合和参数估计一旦模型构建完成,我们可以使用`lavaan`包中的函数对模型进行拟合,并对模型的参数进行估计。

在这一步骤中,我们可以查看模型的拟合度指标(如卡方值、自由度、RMSEA等),来评估模型对观测数据的拟合程度。

4. 模型诊断和修正当模型拟合度不佳时,可能需要进行模型的诊断和修正。

在R语言中,我们可以使用`lavaan`包中的函数来进行模型的修改和改进,以提高模型的拟合度。

5. 结果解释和报告我们可以通过`lavaan`包中的函数获取模型的结果,并将其解释和报告。

我们还可以使用R语言中的其他包(如`semTools`)来可视化模型结果,以更直观地展现变量之间的关系和模型效果。

《r语言结构方程模型如何构建回归模型》是一个非常广泛的研究领域,利用 R 语言进行结构方程模型的构建是近年来研究中的热点。

熟练掌握 R 语言中结构方程模型的建模方法对于提升研究效率和质量具有重要的意义。

总结回顾,通过本文的介绍,希望能帮助你更好地理解在R语言中构建结构方程模型的方法和技巧。

R语言学习系列32-回归分析

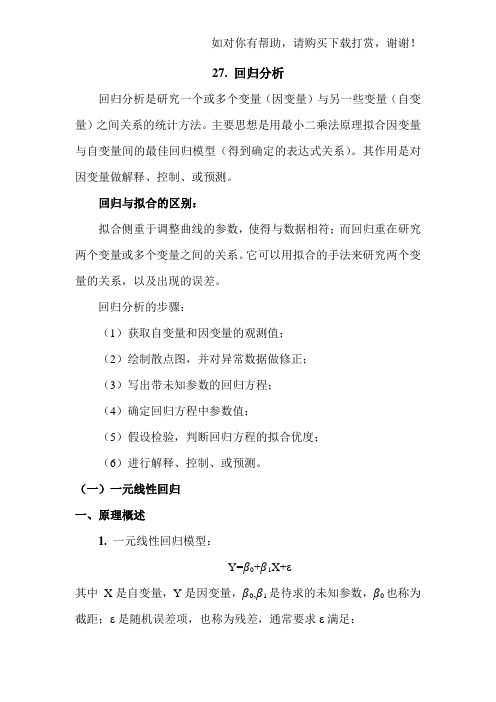

27. 回归分析回归分析是研究一个或多个变量(因变量)与另一些变量(自变量)之间关系的统计方法。

主要思想是用最小二乘法原理拟合因变量与自变量间的最佳回归模型(得到确定的表达式关系)。

其作用是对因变量做解释、控制、或预测。

回归与拟合的区别:拟合侧重于调整曲线的参数,使得与数据相符;而回归重在研究两个变量或多个变量之间的关系。

它可以用拟合的手法来研究两个变量的关系,以及出现的误差。

回归分析的步骤:(1)获取自变量和因变量的观测值;(2)绘制散点图,并对异常数据做修正;(3)写出带未知参数的回归方程;(4)确定回归方程中参数值;(5)假设检验,判断回归方程的拟合优度;(6)进行解释、控制、或预测。

(一)一元线性回归一、原理概述1. 一元线性回归模型:Y=0+1X+ε其中X是自变量,Y是因变量,0,1是待求的未知参数,0也称为截距;ε是随机误差项,也称为残差,通常要求ε满足:① ε的均值为0;② ε的方差为 2;③ 协方差COV(εi , εj )=0,当i≠j 时。

即对所有的i≠j, εi 与εj 互不相关。

用最小二乘法原理,得到最佳拟合效果的01ˆˆ,ββ值: 1121()()ˆ()n i i i nii x x y y x x β==--=-∑∑, 01ˆˆy x ββ=- 2.模型检验(1) 拟合优度检验计算R 2,反映了自变量所能解释的方差占总方差的百分比,值越大说明模型拟合效果越好。

通常可以认为当R 2大于0.9时,所得到的回归直线拟合得较好,而当R 2小于0.5时,所得到的回归直线很难说明变量之间的依赖关系。

(2) 回归方程参数的检验回归方程反应了因变量Y 随自变量X 变化而变化的规律,若 1=0,则Y 不随X 变化,此时回归方程无意义。

所以,要做如下假设检验:H 0: 1=0, H 1: 1≠0;① F 检验若 1=0为真,则回归平方和RSS 与残差平方和ESS/(N-2)都是 2的无偏估计,因而采用F 统计量:来检验原假设β1=0是否为真。

【R语言】logistic回归分析

0.01825 *

Age

0.013747 0.015796 0.870

0.38415

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

剔除没有显著贡献的变量,重新建模

Fit2<-glm(Choice~.-Brand-Price-Fat-AgeVitamin,data=SoftDrink,family=binomial(li nk="logit"))

0.7842038=323.4649

Logistic回归回归系数检验

Coefficients:

Estimate Std. Error z value

Pr(>|z|)

(Intercept) 20.851906 8.081177 2.580

0.00987 **

Price

0.423373 0.327125 1.294

0.19559

Calories -0.025519 0.008767 -2.911

0.00361 **

Fat

-0.080466 0.048667 -1.653

0.09825 .

Vitamin -0.940737 0.460753 -2.042

0.04118 *

Fruits 0.376950 0.159685 2.361

403.43

Price 1

57.228 290

346.20

3.88e-14 ***

Calories 1

255.548 289

90.65

< 2.2e-16 ***

Fat

1

3.545 288

多元线性回归r语言

多元线性回归r语言

多元线性回归(Multiple Linear Regression, MLR)是一种被广泛应用的统计学

方法,用于探索决定性变量和因变量之间的关系。

多元线性回归基于假定变量之间的关系复杂,同时寻找若干个决定性变量的线性函数表达,用于预测系统中的因变量。

由于多元线性回归模型简单而有效,因此它在统计分析、科学研究以及经济学领域都被广泛采用。

R语言是一种强大的计算机编程语言,用于实现专业统计建模和分析。

在R语言中,我们能够使用其预定义的函数在多元线性回归中进行实验,以提取多元线性拟合函数,以及参数的估计和统计特性的分析。

在使用R语言进行多元线性回归之前,有必要进行一些准备工作,首先要准备所需的决定性变量和因变量,然后收集和准备需处理的统计数据,并估计统计模型的参数。

接着,就可以使用R语言的多元线性回归函数lm,基于收集的统计数据,估计出模型参数,从而分析变量之间的关系,构建出模型。

多元线性回归方法有助于从许多个因素中归纳出一个简单而有效的分析模型,更有利于预测和解释数据间的复杂关联。

利用R语言进行多元线性回归分析总结

出模型中变量之间的关系,可以为科学研究和决策提供有效的参考。

R做多元线性回归全攻略_光环大数据 Python培训机构

R做多元线性回归全攻略_光环大数据 Python培训机构R中的线性回归函数比较简单,就是lm(),比较复杂的是对线性模型的诊断和调整。

这里结合Statistical Learning和杜克大学的Data Analysis andStatistical Inference的章节以及《R语言实战》的OLS(Ordinary Least Square)回归模型章节来总结一下,诊断多元线性回归模型的操作分析步骤。

1、选择预测变量因变量比较容易确定,多元回归模型中难在自变量的选择。

自变量选择主要可分为向前选择(逐次加使RSS最小的自变量),向后选择(逐次扔掉p值最大的变量)。

个人倾向于向后选择法,一来p值比较直观,模型返回结果直接给出了各变量的p值,却没有直接给出RSS;二来当自变量比较多时,一个个加比较麻烦。

Call:lm(formula = Sales ~ . + Income:Advertising + Age:Price, data= Carseats)Residuals:Min 1Q Median 3Q Max-2.9208-0.7503 0.0177 0.6754 3.3413Coefficients:Estimate Std. Error t valuePr(>|t|)(Intercept) 6.5755654 1.0087470 6.519 2.22e-10***CompPrice 0.0929371 0.0041183 22.567 < 2e-16 ***Income 0.0108940 0.0026044 4.183 3.57e-05 ***Advertising 0.07024620.0226091 3.107 0.002030 **Population 0.0001592 0.00036790.433 0.665330Price -0.1008064 0.0074399 -13.549 <2e-16 ***ShelveLocGood 4.8486762 0.1528378 31.724 < 2e-16***ShelveLocMedium 1.9532620 0.1257682 15.531 < 2e-16 ***Age -0.0579466 0.0159506 -3.633 0.000318 ***Education-0.0208525 0.0196131 -1.063 0.288361UrbanYes 0.14015970.1124019 1.247 0.213171USYes -0.1575571 0.1489234-1.058 0.290729Income:Advertising 0.0007510 0.0002784 2.6980.007290 **Price:Age 0.0001068 0.0001333 0.8010.423812---Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’0.1 ‘ ’ 1Residual standard error: 1.011 on 386 degrees offreedomMultiple R-squared: 0.8761, Adjusted R-squared:构建一个回归模型后,先看F统计量的p值,这是对整个模型的假设检验,原假设是各系数都为0,如果连这个p值都不显著,无法证明至少有一个自变量对因变量有显著性影响,这个模型便不成立。

r语言lm函数多元回归公式 截距-1

R语言是一种用于统计分析和数据可视化的编程语言,而lm函数是R 语言中用于进行线性回归分析的重要函数之一。

在lm函数中进行多元回归分析时,可以使用一系列自变量来预测因变量的取值。

在多元回归公式中,截距通常表示因变量在自变量取值为0时的取值。

在R语言中,进行多元回归分析的公式可以表示为:1. lm(y ~ x1 + x2 + x3 + ..., data = dataset)其中,y表示因变量,x1、x2、x3等表示自变量,dataset表示数据集。

lm函数将根据数据集中的因变量和自变量的取值来拟合回归方程,从而得到回归模型的系数和截距。

2. 如果只有一个自变量,回归分析公式可以简化为:lm(y ~ x, data = dataset)这里的y表示因变量,x表示自变量,dataset表示数据集。

lm函数将根据数据集中的因变量和自变量的取值来拟合回归方程,从而得到回归模型的系数和截距。

3. 在多元回归分析中,截距的含义是当所有自变量的取值都为0时,因变量的取值。

截距为-1表示当所有自变量的取值都为0时,因变量的取值为-1。

这个截距的值可以帮助我们更好地理解因变量和自变量之间的关系,以及自变量对因变量的影响。

通过lm函数进行多元回归分析,我们可以得到回归方程的系数和截距,从而可以进一步分析自变量对因变量的影响程度、预测因变量的取值等。

lm函数在R语言中是一种非常重要的工具,对于数据分析和统计建模有着重要的作用。

在实际应用中,我们可以根据具体的数据集和问题,使用lm函数进行多元回归分析,得到回归方程的系数和截距,并根据这些结果来进行进一步的分析和预测。

我们也需要注意多元回归分析的前提条件,以及对结果的解释和验证,从而保证分析的准确性和可靠性。

R语言中的lm函数可以用于进行多元回归分析,得到回归方程的系数和截距,从而帮助我们分析自变量对因变量的影响,预测因变量的取值等。

掌握lm函数的使用方法和相关知识,对于进行数据分析和统计建模是非常重要的。

回归分析R语言代码

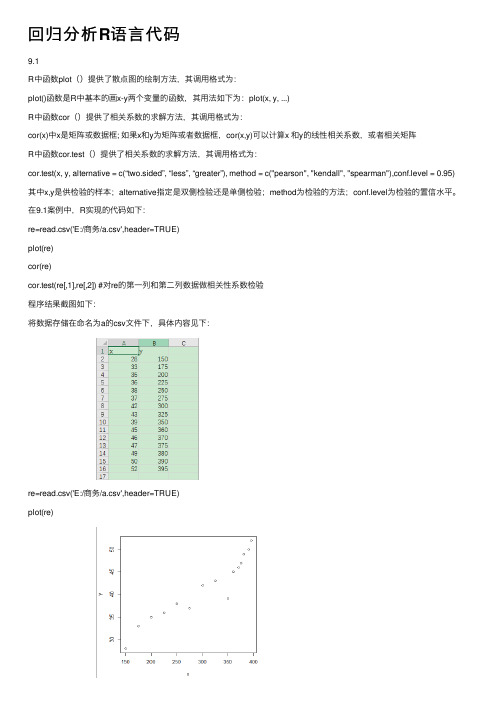

回归分析R语⾔代码9.1R中函数plot()提供了散点图的绘制⽅法,其调⽤格式为:plot()函数是R中基本的画x-y两个变量的函数,其⽤法如下为:plot(x, y, ...)R中函数cor()提供了相关系数的求解⽅法,其调⽤格式为:cor(x)中x是矩阵或数据框; 如果x和y为矩阵或者数据框,cor(x,y)可以计算x 和y的线性相关系数,或者相关矩阵R中函数cor.test()提供了相关系数的求解⽅法,其调⽤格式为:cor.test(x, y, alternative = c(“two.sided”, “less”, “greater”), method = c("pearson", "kendall", "spearman"),conf.level = 0.95)其中x,y是供检验的样本;alternative指定是双侧检验还是单侧检验;method为检验的⽅法;conf.level为检验的置信⽔平。

在9.1案例中,R实现的代码如下:re=read.csv('E:/商务/a.csv',header=TRUE)plot(re)cor(re)cor.test(re[,1],re[,2]) #对re的第⼀列和第⼆列数据做相关性系数检验程序结果截图如下:将数据存储在命名为a的csv⽂件下,具体内容见下:re=read.csv('E:/商务/a.csv',header=TRUE)plot(re)cor(re)cor.test(re[,1],re[,2])9.2R中函数lm()提供了R语⾔中经常⽤到的函数,⽤来拟合回归模型,其调⽤格式为:myfit<-lm(formula,data)formula指要拟合的模型形式,data是⼀个数据框,包含了⽤于拟合模型的数据。

在9.2案例中,R实现的代码如下:sol.lm<-lm(y~x,re)summary(sol.lm)程序结果截图如下:9.3R中函数lm()提供了R语⾔中经常⽤到的函数,⽤来拟合回归模型,其调⽤格式为:myfit<-lm(formula,data)formula指要拟合的模型形式,data是⼀个数据框,包含了⽤于拟合模型的数据。

用R语言做回归分析

⽤R语⾔做回归分析使⽤R做回归分析整体上是⽐较常规的⼀类数据分析内容,下⾯我们具体的了解⽤R语⾔做回归分析的过程。

⾸先,我们先构造⼀个分析的数据集x<-data.frame(y=c(102,115,124,135,148,156,162,176,183,195),var1=runif(10,min=1,max=50),var2=runif(10,min=100,max=200),var3=c(235,321,412,511,654,745,821,932,1020,1123))接下来,我们进⾏简单的⼀元回归分析,选择y作为因变量,var1作为⾃变量。

⼀元线性回归的简单原理:假设有关系y=c+bx+e,其中c+bx 是y随x变化的部分,e是随机误差。

可以很容易的⽤函数lm()求出回归参数b,c并作相应的假设检验。

model<-lm(y~var1,data=x)summary(model)Call:lm(formula = x$y ~ x$var1 + 1)Residuals:Min 1Q Median 3Q Max-47.630 -18.654 -3.089 21.889 52.326Coefficients:Estimate Std. Error t value Pr(>|t|)(Intercept) 168.4453 15.2812 11.023 1.96e-09 ***x$var1 -0.4947 0.4747 -1.042 0.311Signif. codes: 0 ‘’ 0.001 ‘’ 0.01 ‘’ 0.05 ‘.’ 0.1 ‘ ’ 1Residual standard error: 30.98 on 18 degrees of freedomMultiple R-squared: 0.05692, Adjusted R-squared: 0.004525F-statistic: 1.086 on 1 and 18 DF, p-value: 0.3111从回归的结果来看,p值为0.311,变量var1不不显著,正常情况下p值⼩于0.05则认为有⾼的显著性⽔平。

多元线性回归公式推导及R语言实现

多元线性回归公式推导及R语⾔实现多元线性回归多元线性回归模型实际中有很多问题是⼀个因变量与多个⾃变量成线性相关,我们可以⽤⼀个多元线性回归⽅程来表⽰。

为了⽅便计算,我们将上式写成矩阵形式:Y = XW假设⾃变量维度为NW为⾃变量的系数,下标0 - NX为⾃变量向量或矩阵,X维度为N,为了能和W0对应,X需要在第⼀⾏插⼊⼀个全是1的列。

Y为因变量那么问题就转变成,已知样本X矩阵以及对应的因变量Y的值,求出满⾜⽅程的W,⼀般不存在⼀个W是整个样本都能满⾜⽅程,毕竟现实中的样本有很多噪声。

最⼀般的求解W的⽅式是最⼩⼆乘法。

最⼩⼆乘法我们希望求出的W是最接近线性⽅程的解的,最接近我们定义为残差平⽅和最⼩,残差的公式和残差平⽅和的公式如下:上⾯的公式⽤最⼩残差平⽅和的⽅式导出的,还有⼀种思路⽤最⼤似然的⽅式也能推导出和这个⼀样的公式,⾸先对模型进⾏⼀些假设:误差等⽅差不相⼲假设,即每个样本的误差期望为0,每个样本的误差⽅差都为相同值假设为σ误差密度函数为正态分布 e ~ N(0, σ^2)简单推导如下:由此利⽤最⼤似然原理导出了和最⼩⼆乘⼀样的公式。

最⼩⼆乘法求解⼆次函数是个凸函数,极值点就是最⼩点。

只需要求导数=0解出W即可。

模拟数据我们这⾥⽤R语⾔模拟实践⼀下,由于我们使⽤的矩阵运算,这个公式⼀元和多元都是兼容的,我们为了可视化⽅便⼀点,我们就⽤R语⾔⾃带的women数据做⼀元线性回归,和多元线性回归的⽅式基本⼀样。

women数据如下> womenheight weight1 58 1152 59 1173 60 1204 61 1235 62 1266 63 1297 64 1328 65 1359 66 13910 67 14211 68 14612 69 15013 70 15414 71 15915 72 164体重和⾝⾼具有线性关系,我们做⼀个散点图可以看出来:我们⽤最⼩⼆乘推导出来的公式计算w如下X <- cbind(rep(1, nrow(women)), women$height)X.T <- t(X)Y <- women$weightw <- solve(X.T %*% X) %*% X.T %*% Y> w[,1][1,] -87.51667[2,] 3.45000> lm.result <- lm(women$weight~women$height)> lm.resultCall:lm(formula = women$weight ~ women$height)Coefficients:(Intercept) women$height-87.52 3.45上⾯的R代码w使我们利⽤公式计算出来的,下边是R语⾔集成的线性回归函数拟合出来的,可以看出我们的计算结果是正确的,lm的只是⼩数点取了两位⽽已,将回归出来的函数画到图中看下回归的效果。

r语言 多元 复相关系数

r语言多元复相关系数1.引言1.1 概述在概述部分,我们将介绍本文的主题:R语言中的多元复相关系数。

多元复相关系数是一种统计方法,用于衡量多个变量之间的相关性。

它可以帮助我们理解变量之间的相互关系,并在实际问题中提供有用的信息。

在统计学中,相关性是指两个或多个变量之间的关系程度。

然而,当我们面对多个变量时,简单的相关系数无法完全描述它们之间的复杂关系。

为了解决这个问题,多元复相关系数应运而生。

多元复相关系数可以通过对多个变量进行综合分析来揭示它们之间的复杂关系。

它可以展示变量之间的线性关系、非线性关系以及任意关系。

通过计算复相关系数,我们可以确定变量之间的相互依赖性和相互影响性,有助于我们进行更准确的预测和决策。

本文将首先介绍R语言的基本概念和特点,以便读者了解如何使用R 语言进行多元复相关系数的计算和分析。

然后,我们将详细解释多元复相关系数的定义和计算方法,包括相关性矩阵、复相关矩阵和复相关系数的性质。

最后,我们将探讨多元复相关系数在实际问题中的应用,并总结本文的主要观点和结论。

通过阅读本文,读者将能够深入了解R语言中的多元复相关系数,并将其应用于实际问题中。

无论是在学术研究还是实际应用中,多元复相关系数都具有重要的意义,可以帮助我们更好地理解变量之间的关系,为决策提供支持。

1.2文章结构在文章结构部分,我们将介绍本文的组织结构和每个部分的主要内容。

本文主要围绕着R语言中的多元复相关系数展开讨论。

第一部分是引言部分,其中包括本文的概述、文章结构和目的。

在概述中,我们将简要介绍多元复相关系数的概念和重要性。

接着,我们将详细描述本文的组织结构,并介绍每个部分的内容。

最后,我们明确本文的目的,即通过分析多元复相关系数的定义、计算和应用,揭示其在R语言中的重要性和实用性。

第二部分是正文部分,包括R语言简介和多元复相关系数的定义与计算。

在R语言简介中,我们将简要介绍R语言的特点、优势和应用领域,为读者提供必要的背景知识。

R语言

R很适合被用于发展中的新方法所进行的交互式数据分析。由于R是一个动态的环境,所以新发布的版本并不 总是与之前发布的版本完全兼容。某些用户欢迎这些变化因为新技术和新方法的所带来的好处;有些则会担心旧 的代码不再可用。尽管R试图成为一种真正的编程语言,但是不要认为一个由R编写的程序可以长命百岁。

主窗口上方的一些文字是刚运行R时出现的一些说明和指引。文字下的:>符号便是R的命令提示符,在其后 可输出命令;>后的矩形是光标。R一般是采用交互方式工作的,在命令提示符后输入命令,回车后便会输出结果。

在R朴素的界面下,是丰富而复杂的运算功能。

谢谢观看

S(和R)与其他主流的统计系统在本质上有一个很重要的不同。在S中,统计分析通常由一系列的步骤完成, 同时将交互的结果存储在对象中。所以,尽管SAS和SPSS在一个回归或者判别分析中会给出丰富的输出结果,R只 是给出一个最小的输出,而将结果保存在一个适当的对象中由R函数进行后续查询。

使用R最便捷的方式是在一个运行视窗系统的图形工作站上。这份指南就是为拥有这项便利的用户准备的。尽 管我们绝大部分的内容都是来讲R环境的一般应用,我们还是会时不时的提到R在Xwindow系统下的应用。

CRAN

CRAN为Comprehensive R Archive Network(R综合典藏)的简称。它除了收藏了R的执行档下载版、源代 码和说明文件,也收录了各种用户撰写的软件包。现时,全球有超过一百个CRAN镜像站。

安装

以下简述R FOR WINDOWS的安装和使用:

贝尔实验室美国总部下可以找到R的各个版本的安装程序和源代码。点击进入:Windows (95 and later), 再点击:base,下载SetupR.exe,约18兆,此便是R FOR WINDOWS的安装程序。双击SetupR.exe,按照提示一 步步安装即可。

r语言多元线性回归模型

r语言多元线性回归模型

多元线性回归模型是最常用的统计分析方法之一,常用于模拟一些统计数据,衡量变量之间存在的某种影响关系。

多元线性回归模型可以用来确定影响因素,以及出现的预测值的变化趋势。

本文将介绍多元线性回归模型,以及如何使用R语言进行多元线性回归分析。

多元线性回归模型也称为多元回归,是一种用于描述两个或更多不同类型的变量之间关系的数据分析工具。

它通常用来分析多个解释变量(也称为自变量)与一个响应变量(也称为因变量)之间的相互作用和依赖关系。

主要思想是假定因变量和自变量之间存在线性关系,以及自变量的变化将导致因变量的变化,反之亦然。

R语言是一种对多元线性回归分析提供了良好支持的数

据分析工具。

要进行多元线性回归分析,首先需要选择合适的数据集。

接下来,使用R语言中的lm函数建立

模型,该函数可以接收参数x和y来确定因变量和自变量。

然后,使用summary函数对结果进行整理和汇总,获得每个变量的系数和参数估计值,并计算残差值。

最后,使用plot函数可以得到建立的模型的图像。

多元线性回归模型可以被用来研究一定定量变量之间的关系。

通过调整参数优化各个变量的回归,可以更准确地预测变量之间存在的关系,用以分析数据所暗示的影响关系,同时给出科学的建议和结果,用以指导实际的解决方案。

R语言是实现多元线性回归的有效数据分析工具,可以很好地帮助我们理解多变量之间的关系以及分析数据所蕴含的影响关系。

R语言多元线性回归分析

R语⾔多元线性回归分析#线性模型中有关函数#基本函数 a<-lm(模型公式,数据源)#anova(a)计算⽅差分析表#coef(a)提取模型系数#devinace(a)计算残差平⽅和#formula(a)提取模型公式#plot(a)绘制模型诊断图#predict(a)⽤作预测#print(a)显⽰#residuals()计算残差#setp()逐步回归分析#summary()提取模型资料#多元线性回归分析#回归系数的估计#显著性检验:1回归系数的显著性检验 t检验就是检验某个变量系数是否为02回归⽅程的显著性检验 F检验就是检验该数组数据是否能适⽤于线性⽅程做回归#1.载⼊数据求回归系数并作显著性检验mltest<-data.frame(X1=c(76.0, 91.5, 85.5, 82.5, 79.0, 80.5, 74.5,79.0, 85.0, 76.5, 82.0, 95.0, 92.5),X2=c(50, 20, 20, 30, 30, 50, 60, 50, 40, 55,40, 40, 20),Y= c(120, 141, 124, 126, 117, 125, 123, 125,132, 123, 132, 155, 147))ML<-lm(Y~X1+X2,data=mltest)summary(ML)coef(ML)#2.参数区间估计#3.预测#求X=(80,40)时相应Y的概率为0.95的预测区间newdata<-data.frame(X1=80,X2=40)lmpred<-predict(ML,newdata,interval="prediction",level=0.95)lmpred#4.修正拟合模型#根据实际问题的背景对模型进⾏适当的修正#增加新的⾃变量对响应变量取对数或者开⽅运算update()函数。

r语言求回归方程

r语言求回归方程在R语言中,求回归方程通常使用lm()函数。

这个函数属于统计包,如果没有安装,需要先安装并加载该包。

下面是一个简单的例子:首先,安装并加载stats包:```Rinstall.packages("stats")library(stats)```然后,准备数据。

这里假设我们有以下数据:```R# 输入数据x <- c(1, 2, 3, 4, 5) # 自变量y <- c(2, 4, 5, 4, 5) # 因变量```接着,使用lm()函数求回归方程:```R# 拟合线性模型model <- lm(y ~ x, data.frame(x, y))```这里的"y ~ x"表示因变量y对自变量x的回归模型。

拟合完成后,我们可以查看回归系数:```R# 查看回归系数summary(model)```这将给出斜率(coefficients中的Estimate项)、截距、t值、P值等统计量。

如果你只需要回归方程,也可以直接提取:```R# 提取回归方程fit <- predict(model)```这样,变量fit将包含回归方程的预测值。

如果你想得到具体的回归方程形式,可以直接打印模型对象:```R# 打印回归方程print(model)```或者使用`summary(model)$coefficients`,它会给出回归方程的系数,包括截距和各个自变量的系数。

以上就是用R语言求回归方程的基本步骤。

需要注意的是,实际应用中,数据往往需要预处理和检查,确保满足线性回归模型的假设条件。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

4、回归诊断

对残差进行分析

> res2<-residuals(mul_step)

> par(mfrow=c(1,2))

> plot(Y,res2);qqnorm(res2)

>由系数的显著性可以知道,X4有较强的显著性,回归系数显著性检验通过,但其他变量去不行,尽管有回归方程的P值知道回归方程也不显著,需要做进一步的分析。

2、利用逐步回归法进行更进一步的回归工作。

> mul_step<-step(mul_re)

Start: AIC=183.16

Y ~ 1 + X1 + X2 + X3 + X4 + X5

Residual standard error: 86.27 on 14 degrees of freedom

Multiple R-squared: 0.4997, Adjusted R-squared: 0.321

F-statistic: 2.796 on 5 and 14 DF, p-value: 0.05913

> mul_re<-lm(Y~1+X1+X2+X3+X4+X5) #establish the multiple regression model

> summary(mul_re)

Call:

lm(formula = Y ~ 1 + X1 + X2 + X3 + X4 + X5)

Residuals:

Min 1Q Median 3Q Max

利用一下数据对电池的失效周期的影响因素进行分析,选出最优的变量子集

充电率

X1

放电率X2

放电深度X3

温度X4

充电电压极限X5

失效周期Y

0.375

3.13

60

40

2

101

1

3.13

76.8

30

1.99

141

1

3.13

60

20

2

96

1

3.13

60

20

1.98

125

1.625

3.13

43.2

10

2.01

43

Residual standard error: 79.6 on 18 degrees of freedom

Multiple R-squared: 0.4523, Adjusted R-squared: 0.4219

F-statistic: 14.86 on 1 and 18 DF, p-value: 0.001159

- X4 1 87911 192140 191.41

Step: AIC=179.9

Y ~ X3 + X4 + X5

Df Sum of Sq RSS AIC

- X3 1 3996 112075 178.62

- X5 1 5191 113270 178.84

<none> 108079 179.90

- X4 1 93574 201652 190.37

学生学号

0120814440111

实验课成绩

学生实验报告书

实验课程名称

统计计算(R软件)

开课学院

理学院

指导教师姓名

毛树华

学生姓名

李旭升

学生专业班级

统计学0801

2010—2011学年第2学期

实验项目名称

多元分析的R软件实现

实验者

李旭升

专业班级

统计学0801

同组者

实验日期

2011-6-1

一、实验题目

卫星应用推动了银----锌电池的发展,表1列出了表征电池的在其寿命周期内失效的性能失效数据,利用这些数据:

> Y<-M[,1];X1<-M[,2];X2<-M[,3];X3<-M[,4];X4<-M[,5];X5<-M[,6];X6<-M[,7]

> Y<-M[,6];X1<-M[,1];X2<-M[,2];X3<-M[,3];X4<-M[,4];X5<-M[,5]; #vector assignment

-178.735 -26.345 -1.327 22.221 167.110

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 214.066 222.602 0.962 0.353

X1 -32.214 45.401 -0.710 0.490

<none> 114051 176.97

- X4 1 94179 208230 187.01

> summary(mul_step)

Call:

lm(formula = Y ~ X4)

Residuals:

Min 1Q Median 3Q Max

-151.803 -46.733 -4.664 32.062 198.853

76.8

30

2

160

1

1.25

60

0

2

3

1.625

1.25

43.2

30

1.99

216

1.625

1.25

60

20

2

73

0.375

3.13

76.8

30

1.99

314

0.375

3.13

60

20

2

170

一、实验步骤及结果分析(R语言程序)

1、数据的读取及初步的多元回归分析模型

M<-read.table("1234.txt",head=TRUE)

1.625

3.13

60

20

2

16

1.625

3.13

60

20

2.02

188

0.375

5

76.8

10

2.01

10

1

5

43.2

10

1.99

3

1

5

43.2

30

2.01

386

1

5

100

2

0

45

1.625

5

76.8

10

1.99

2

0.375

1.25

76.8

10

2.01

76

1

1.25

43.25

Step: AIC=178.62

Y ~ X4 + X5

Df Sum of Sq RSS AIC

- X5 1 1976 114051 176.97

<none> 112075 178.62

- X4 1 91305 203380 188.54

Step: AIC=176.97

Y ~ X4

Df Sum of Sq RSS AIC

二、实验结果分析

逐步回归法:

根据逐步回归法选入的自变量为X4,则回归方程为:

由此可知,对电池影响最大的是温度因素。

> sdres<-rstandard(mul_step)

> sdres

1 2 3 4 5 6

-2.21633551 -0.61434217 -0.32872226 0.04523956 -0.16847822 -1.36034107

7 8 9 10 11 12

0.85763938 -0.60160701 -0.69348282 2.64726058 0.57698808 -0.70660793

Step: AIC=181.17

Y ~ X1 + X3 + X4 + X5

Df Sum of Sq RSS AIC

- X1 1 3850 108079 179.90

- X5 1 6552 110780 180.39

- X3 1 6641 110869 180.41

<none> 104228 181.17

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) -9.819 36.334 -0.270 0.79004

X4 6.566 1.703 3.855 0.00116 **

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

X2 1.111 14.756 0.075 0.941

X3 -1.575 1.671 -0.943 0.362

X4 6.873 1.999 3.438 0.004 **

X5 -53.054 59.835 -0.887 0.390

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

13 14 15 16 17 18

0.26465057 0.29090080 -0.36140154 0.18099931 0.38410766 -0.62531267

19 20

1.68874875 0.62552515

残差分布较分散,无明显趋势,且QQ图显示叫符合正态分布的假设。

同时分析标准化残差,也得到每一个自变量对应的标准化残差都小于2,满足要求。