信源编码-3

chap4-信源编码3

0.5

0.514

0.52

A(cad)=A(ca)p(d)=0.006=p(cad)

0.514 0.5146 0.52

F(cadb)=F(cad)+p(cad)F(b)=0.5146

A(cadb)=A(cad)p(b)=0.0024=p(cadb)

算术编码--------------------递推公式

9

算术编码------------------基本思路

从整个符号序列出发,将各信源序列的概率映 射到[0,1)区间上,使每个符号序列对应于区 间内的一点,也就是一个二进制的小数。这些 点把[0,1)区间分成许多小段,每段的长度等 于某一信源序列的概率。再在段内取一个二进 制小数,其长度可与该序列的概率匹配,达到 高效率编码的目的。

我们可取该小区间内的一点来代表这个信源符号序 列,那么选取此点方法可以有多种,实际中常取小区 间的下界值。对信源符号序列的编码方法也可有多种, 下面介绍常用的一种算术编码方法。

13

算术编码--------------------二元码

14

算术编码---------------二元码递推公式

r=0,1,F(0)=0;F(1)=p(0)

区间宽度的递推公式 A( Sr ) A( S ) p( r ) p( S ) p( r ) p( Sr ) 累积概率的递推公式 F ( S 0) F ( S ) F ( S 1) F ( S ) p( S )F (1) F ( S ) p( S ) p(0) F ( S )为 符 号 序 列 的 累 积 概 率 , S p( S )为 符 号 序 列 的 联 合 概 率 S

该行经编码后只需用54位二元码元,而原 来一行共有1728个像素,如用“0”表示白,用 “l”表示黑,则共需1728位二元码元。可见, 这一行数据的压缩比为1728:54=32,因此压 缩效率很高。

信源编码

信息工程学院通信工程系

4.1 信源编码基本概念

信源编码模型

信源编码是对信源发出的符号按一定的数学规则进行的 一种变换。 为了分析方便和突出研究的重点,当研究信源编码时, 将信道编码和译码看成是一个整体,以突出信源编码的研究。 X=X1X2… Xi …XK

信源序列

信源编码器

Y=Y1Y2…Yj …YL

信息工程学院通信工程系

4.1 信源编码Leabharlann 本概念N次扩展码 信源符号集

S {s1 , s2 , , sq }

C {W1 ,W2 , ,Wq }

码字符号集 N次扩展信源符号集

N次扩展码字集

S N {1 , 2 , , q N }, j s j1 s j2 s jN

二元码 若码符号集为 {0,1} ,所得码字都是二进制序列,则称为二 元码。二元码是数字通信和计算机系统中最常用的一种码。 等长码(固定长度码) 若一组码中所有码字的码长都相等,称为等长码。 变长码(非固定长度码) 若一组码中码字的码长不完全相同,则称为变长码。

信息工程学院通信工程系

4.1 信源编码基本概念

C N {W1 ,W2 , ,Wq N }, W j W j1W j2 W jN

信息工程学院通信工程系

4.1 信源编码基本概念

唯一可译码

若码的任意一串有限长的码符号序列只能被唯一的译成其 对应的信源符号序列,则此码称为惟一可译码或单义可译码, 否则则称为非惟一可译码或非单义可译码。 若要所编的码是唯一可译码,不但要求编码时不同的信源 符号序列变换成不同的码序列,而且还要求任意有限长的信源 序列所对应的码符号序列各不相同。只有任意有限长的信源序 列所对应的码符号序列各不同,才能将该码符号序列惟一的分 割成一个个对应的信源序列,从而实现惟一的译码。 即时码 在译码过程中只要接收到每个码字(码序列)的最后一个 符号就可立即将该码字译出,这样的码称为即时码;否则称为 非即时码。

第11讲信源编码三个基本编码

5.1.5 游程编码 5.1.6 冗余位编码

赫夫曼(Huffman) 编码是一种效率比较高的变长无失 真信源编码方法。

5.3.1 二进制哈夫曼编码 5.3.2 m 进制哈夫曼编码(自学)

5.3.1 二进制哈夫曼编码

例:设单符号离散无记忆信源如下,要求对信源 编二进制哈夫曼码。

编法一的平均码长为

5

K 1 p ( x i) k i 0 .4 1 0 .2 2 0 .2 3 ( 0 .1 0 .1 ) 4 2 .2 ( 码 /符 元 ) 号 i 1

编法二的平均码长为

5

K 2p (x i)k i (0 .4 0 .2 0 .2 ) 2 (0 .1 0 .1 ) 3 2 .2 (码 /符 元 ) 号 i 1

6 0 x .0 5 , 8 0 x .0 6 4

对该信源编二进制费诺码。

(1)将概率按从大到小的顺序排列

p(x1)≥ p(x2)≥…≥ p(xn)

(2)按编码进制数将概率分组,使每组概率尽可能接近

或相等。如编二进制码就分成两组,编 m 进制码就分

成 m 组。

信源符号 概率

编码

码字 码长

x1

0.18

x4

0.16 1

x5

0.08

x6

0.04

编码 0 1 0

0 1

1

码字 码长

00

2

01

2

10

2

110

3

0 1110 4

1 1111 4

6

该信源的熵为 H (X) p(xi)lo2p g (xi)2.3(比 5 /符 特 )号 i 1

平均码长为

信源编码及信道编码

-3/61-

3.6 信道的定义和分类

1. 信道的定义:

信道是指信息传输的通道,包括空间传输和时间传输。 空间传输:利用各种物理通道将信息从一端发到另一端 时间传输:是指将信息保存,在以后读取,如磁带、光

盘等在时间上将信息进行传输的信道。

关于信道的主要问题有:

➢ 信道的建模(信道的统计特性的描述) ➢ 信道容量的计算 ➢ 在有噪信道中能不能实现可靠传输?怎样实现可靠传输?

信源编码及信道编码

学习目标

学习完本节课程,您应该能够: 掌握信道的定义和分类 掌握信道的数学模型 掌握什么是信道容量 了解信道复用 掌握信道编码及信道差错控制方法

-2/61-

课程内容

3.6 信道的定义和分类 3.7 信道的数学模型 3.8 信道容量及信道复用 3.9 信道编码基本概念 3.10 信道差错控制及编码方法

① 离散信道 ② 连续信道 ③ 半连续信道 ④ 时间离散的连续信道

按信道的记忆特性

① 无记忆信道 ② 有记忆信道

-6/61-

3.6 信道的定义和分类(续)

2. 信道的分类(续)

按输入/输出信号之间的关系分为

① 噪声信道 ② 无噪声信道

根据信道输入和输出的个数可分为

① 两端信道(单用户信道):只有一个输入端和一个输出端 的单向通信的信道。

➢ 例如短波电离层反射信道。

-8/61-

3.6 信道的定义和分类(续)

3. 通信信道实例:

随参信道举例:短波电离层反射信道

① 短波是指波长为100m-10m(频率为3-30MHz)的无线电波。 可沿地表面传播(地波传播),传播距离近;可由电离层反射 传播(天波传播)。传输几千千米,至上万千米。

② 传播路径:电离层离地面高60-600km的大气层。分为D、E、 F2 等层。

信源编码

码方差例子

设离散无记忆信源如下,分别按如下两种方 式编码,分析哪种编码更好。

X x1 x2 x3 x4 x5 P 0.4 0.2 0.2 0.1 0.1

Huffman编码1

信源符号 码字 0.4 0.2 0.2 0 1 0.2 1 0 0.4 0.4 0.2 0 1 0.6 0 1 0.4 1

非续长码例子

相同点:码1、码2都是单义码; 不同点:

码2中,每个码字都以“1”为终端,这样在接收过程中,只要一出 现“1”时,就知道这是一个码字已经终结,新的码字就要开始, 因此当出现“1”后,就可以立即将收到的码元序列译成对应的信 源符号; 码1中,当收到一个或几个码元符号后,不能即时判断码字是否已 经终结,必须等待下一个或几个码元符号收到后,才能作出判断。 例:码1组成的序列:1000100101 码2组成的序列:0001011001

i 1 7

L p( x i )ni 2.72

i 1

7

H 0.96 L log D

S

S1

S2

S3

S4 0.39

S5 1 1.00 0.61 0 11

0.35 0.26 X1 0.20

1 0

1

0

x2 0.19

x3 0.18 x4 0.17 x5 0.15 x6 0.10 1 0 0.11 1 0 1 0

霍夫曼编码方法编码的特点

X { x1 , x 2 ,..., x n } P ( X ) { p1 , p2 ,..., pn }

编码方法(对二元系统)

将N个信源符号按概率递减的方式排列起来; 用“0”,“1”码符号分别表示概率最小的两个信源符号, 并将这两个概率最小的信源符号合并成一个符号,从而得 到只包含N-1个符号的新信源,称为S信源的缩减信源S1; 将缩减信源S1的符号仍按概率大小以递减次序排列,再将 其最后两个概率最小的符号合并成一个符号,并分别用0, 1码符号表示,这样又形成了N-2个符号的缩减信源S2; 依次继续下去,直到信源最后只剩下两个符号为止,将这 最后两个符号分别用0,1码符号表示,然后从最后一级缩 减信源开始,向前返回,就得出各信源符号所对应的码符 号序列,即得出对应的码字。

数字通信原理3信源编码

2 q/ 2 e2 p(e)de q/ 2 e2 1 de q2

q/2

q q / 2

12

2010 Copyright

SCUT DT&P Labs

27

均匀量化(续)

第三章 信源编码

量化信噪比与量化电平数M之间的关系

设量化范围为:-VP -- +VP,量化电平数 M=2b

量化间隔:q=2VP/M=2VP/2b

3

= 1

12

M i 1

p(mk )q3

q2 12

M i 1

p(mk )q

2010 Copyright

SCUT DT&P Labs

26

均匀量化(续) 利用概率的性质

M

p(mk )q 1

i 1

进一步可得量化噪声功率的简化计算公式

2 q2

12

第三章 信源编码

如假设量化噪声服从均匀分布,亦可得

第三章 信源编码

量化误差

2010 Copyright

SCUT DT&P Labs

24

标量量化(续) (3)有偏型

第三章 信源编码

(4)非均匀型(对小信号误差小)

量化误差

2010 Copyright

SCUT DT&P Labs

25

均匀量化

第三章 信源编码

模拟信号的取值范围:a -b,

量化电平数为M

量化噪声功率:

2 q

q2 12

= VP2 3M 2

1 12

2VP 2b

2 1 12

2VP

2 2 2b

信号功率:

2 x

信噪比:

VP VP

x2

信源编码

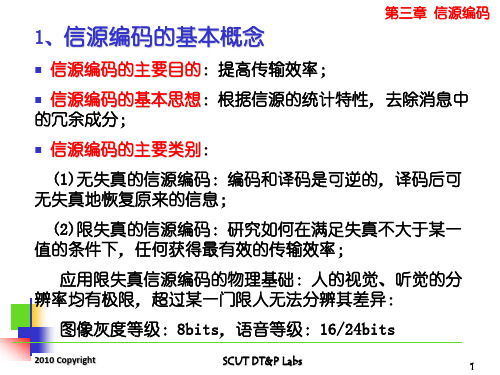

信源编码技术为什么要进行信源编码通信系统就是将产生的信息传输到目的地。

信源有各种不同的形式,如广播的信源是语音或音乐,电视的信源是活动图像,这些信源的输出都是模拟信号,称为模拟信源。

计算机和存储器件(磁盘或光盘)输出的是离散信号,称为数字信源。

在数字系统中传输的都是数字信息,不论是模拟信源还是离散信源其输出都必须转化为可以传输的数字信息,这种转化通常是由信源编码器来完成的。

信源编码在移动通信中也称语音编码。

Ø信源编码的作用是用信道能传输的符号来表示信源发出的信息,在不失真或一定失真的条件下用尽可能少的符号传送信源消息,提高信息传输率。

信源编码(如语音)对数字传输非常重要,而且对无线通信来说显得尤其重要。

Ø随着数字电话和数据通信容量日益增长的迫切要求,而又不希望明显降低传送话音信号的质量,除了提高通信带宽之外,对话音信号进行压缩是提高通信容量的重要措施。

Ø在移动通信中,稀少而又昂贵的无线信道更一定要和必须要对传输的各种信号源进行压缩,以提高通信容量。

模拟信源(语音)编码的种类波形编码、参量编码、混合编码一般来说,波形编码器的话音质量高,但数据率也很高;参量编码器的数据率很低,产生的合成话音的音质有待提高;混合编码器同时使用参量编译码技术和波形编译码技术,数据率和音质介于它们之间。

(1)波形编码波形编码比较简单,编码前采样定理对模拟语音信号进行量化,然后进行幅度量化,再进行二进制编码。

解码器作数/模变换后再由低通滤波器恢复出现原始的模拟语音波形,这就是最简单的脉冲编码调制(PCM),也称为线性PCM。

可以通过非线性量化,前后样值的差分、自适应预测等方法实现数据压缩。

波形编码的目标是让解码器恢复出的模拟信号在波形上尽量与编码前原始波形相一致,也即失真要最小。

波形编码的方法简单,数码率较高,在64kbit/s至32kbit/s之间音质优良,当数码率低于32kbit/s的时候音质明显降低,16 kbit/s时音质非常差。

信源编码

H(X ) 1 lo g 2 D L

n

H(X ) lo g 2 D

L

可见, 当L 时, lim n

H(X ) lo g 2 D

[注]:(1) 该定理只是一个极限定理,必须在L为无穷时才能达 到理论情况; (2)某些信源(如语音、图象等)在实际应用中往往允许 一定的失真(不研究)。

Ry 1 0.125

• 信源编码的必要性:

实际信源往往含有大量冗余, 比如,英文字母表(含空格 符)共27个符号, 若等概出现,则每个符号的信息量为4.76bit, 而在无记忆情况下实际信源熵只有4.076bit/符号, 若考虑两 个字母之间的相关性,则实际熵只有3.32bit/符号;若考虑 100个字母之间的相关性,则实际信源熵只有1bit/符号,此时 编码剩余度为79%!

W4=111

用码树图编码的步骤: • 从顶点(树根)出发,画出两条(D=2)分枝,一条代表 “0”,另一条代表“1”。选取其中的一个终点作为码字,如 w1=0; • 从未被选用的终点再画出两枝,选其中的一个终点作为码字 w2; • 继续下去,直至W中所有的码字都有一个终点来表示为止; • 从树根出发到各个终点,依次读出各枝代表的符号(0,1), 便得到相应的码字。

例 已知信源S由两个符号S1, S2组成, 其概率分别为3/4和1/4, 试用{0, 1}进行编码. 解 : H (S )

i 1

2

1 3 4 pi log pi log4 log 0.811 bit/符号 4 4 3

(1)单符号编码 : 令S1 0, S2 1 n

n p 1

码效率为100%。

1963年Abramson 发现,若符号出现的概率为 ,取码字长度为ni, 便能编出紧致即时码。

第三章信源编码

1/8 0 256Δ 1/4 512Δ 1/2 1024Δ 1

2048Δ

1/128 1/64 16Δ 32Δ

1/32 64Δ

1/16 128Δ

1/8 256Δ

第一量化段间隔Δ1:

Δ2=Δ;Δ3=2Δ;Δ4=4Δ;Δ5=8Δ; Δ6=16Δ;Δ7=32Δ;Δ8=64Δ

1 ( 0) 1 128 1 16 2048

序号 量化值 范围 自然二进码 a1 a2 a3 7 6 5 +3.5 +2.5 +1.5 +3.0~+4.0 +2.0~+3.0 +1.0~+2.0 111 110 101 折叠二进码 b1 b2 b3 111 110 101

4

3 2 1 0

+0.5

-0.5 -1.5 -2.5 -3.5

0~1.0

非均匀量化信噪比的波动

(

32 29 26

S ) dB Nq

35 30 25 20 15 10 5

Li(dB)

-50 -40 -30 -20 -10 0

图5-1-11 n=7时A律13折线信噪比与输入电平关系

3.4 编码与解码

编码—将量化后的多电平值用二进制数表示。 码字—一个样值对应n位二进制数。 编码码型—编码时所遵循的规律(传输时有 传输码型)

脉冲编码调制使模拟信号数字化必须经过抽样、量化、 编码三个过程

低 x(t) 抽 样 PAM 量 化 编 码 PCM 信 道 PCM 解 码 通 滤 波 x`(t)

图5-1-1

PCM单向通信过程

抽样——将模拟信号在时间上离散(PAM)。 量化——对抽样后的信号在幅度上离散。 编码——将量化后的信号用二进制数代替(PCM)。 解码——将PCM信号还原为重建的PAM信号。 低通——在重建的PAM信号中取出低频模拟信号。 PAM——脉冲幅度调制

《信源编码》课件

= 31

则有

∞

=

=−∞

∞

− = 31

=−∞

′ − 31

例题12-5

∞

= 31

′ − 31

=−∞

(3)接收网络的传输函数2()应设计为

1

2 = 1

0

此时能由()不失真地恢复 。

∞

=

=−∞

∞

− = 5

=−∞

− 5

例题12-4

其频谱图为

例题12-5

【例题12-5】已知某信号 的频谱 如题图(a)所示,将它通过传输函数为1()的滤波器(见题

图(b))后再进行理想抽样。

(1)抽样速率应为多少?

(2)若抽样速率 = 31,试画出已抽样信号()的频谱。

(3)接收网络的传输函数2()应如何设计,才能由()不失真地恢复 ?

例题12-5

解:(1) 通过1 变为 ′ , ′ 与()相乘,所以采样的对象是 ′ 。欲求采样速率,首

先须求得 ′ 的最高频率。

可见, 通过1()后的最高频率仍为1,故抽样频率为 ≥ 21。

1

= 400时

∞

= 400

其频谱图为

=−∞

− 400

例题12-4

【例题12-4】对基带信号 = 2000 + 24000进行理想抽样,为了在接收端能不失真地从已

抽样信号()中恢复 。

(1)抽样间隔应如何பைடு நூலகம்择?

(2)若抽样间隔取为0.2,试画出已抽样信号的频谱图。

0.25

第三章 信源编码

编码就是从信源符号到码符号组成的码字之

间的一种映射。

S : s {1 ,, q }

C : c {W1 ,,Wq }

X : x {x1 ,, xr }

Wi ( xi1 , xi2 ,, xil )

c. 定义1. 若某一种码的任意一串有限长的符号序列 只能被惟一地译成所对应的信源符号,则该码称 为惟一可译码。 定义2. 若用r元码对信源 S N 进行编码,设S中每个 符号所需的平均码长为 LN / N ,则定义

x(t )

n

x(

n ) 2W

sin[2W (t

利用抽样定理可把模拟信源的输出转换成等效的 离散时间信源。

n )] 2W n 2W (t ) 2W

二. 信息的量度——熵及其性质

1. 熵 离散随机变量 xi

事件X

yi 事件Y 事件Y yi 的出现提供事件X xi 的信息量 xi 和 yi 间的互信息:

d (ui , v j ) (ui v j ) P ( P 2)

平均失真度定义:

D [d (ui , v j )] E[d (u, v)]

(2)信息率失真函数 a. R(D) min{p(v j | ui ), D D} {I (U ;V )} (比特 / 符号) 信息传输率 I (U ;V ) b. 无记忆高斯信源的率失真函数(香农,1959年)

p( xi | yi ) I ( xi ; yi ) log2 p( xi )

xi 的自信息:

1 I ( xi ) log2 p( xi )

平均互信息:( X ; Y ) p( xi , y j ) log2 I

i 1 j 1

n

第五章信源编码

若信源符号数小于16,可以去掉几个节点, 若信源符号数小于 ,可以去掉几个节点,码树为非满树 只有部分树枝延伸到最后一级) (只有部分树枝延伸到最后一级)

0

r 进制 ---每个节点长出 个树枝。 每个节点长出r个树枝 每个节点长出 个树枝。 如r=3,三进制码树 三进制码树 2、kraft(克劳夫特 不等式 、 克劳夫特)不等式 克劳夫特

(2)若K1 = 1, K 2 = 2, K 3 = 3, K 4 = 3,则: m − K i = 1,满足不等式 ∑

i =1 n

对四元符号进行二进制编码,存在长度为 、 3、 1 2、 3的惟一可译码。

用码树验证以上结果: 用码树验证以上结果: 无论如何也不能构造出长 度为1、 、 、 的即时码 度为 、2、2、3的即时码

v 码长K Li,i = 1,2....n ;平均码长:K L = ∑ K Li P( yi )码元 / 符号序列

L i =1

_

nL

定长编码:K L1 = K L2 = ......K LnL = K L,K L = K L

_

2、码长的意义:衡量码的性能的重要参数 、码长的意义:衡量码的性能的重要参数 码的性能 对于无失真信源编码, 越长, 对于无失真信源编码,平均码长 K L 越长,说明通过编码 压缩去的冗余越少。 越短,冗余压缩越多。 压缩去的冗余越少。反之平均码长 越短,冗余压缩越多。 _ 最小是多少呢? 小于此值, 平均码长 K L 最小是多少呢? (小于此值,就会产生失 )。有下面的定理 有下面的定理: 真)。有下面的定理: 一、定长编码定理: 定长编码定理:

若映射规则f 2为:a1 − − > w1 = 0,a 2 − − > w 2 = 01, a 3 − − > w 3 = 001,a 4 − − > w 4 = 011 那么,码字集为 W = {0,01,001,011},称为码2 v v 当输入序列为x = a 2a1a 4a 3a 2时,输出序列为: y = 01001100101

信源编码的基本方法

X

m

k

S : Si ,i

1,2,...L

编码输出

YNmJ

C

X

m

J

其中 YNmJ Y1mY2m...YNmJ Ykm C : Ci ,i 1,2,..., D

C : Ci ,i 1,2,...D 为输出的码元集。

接收端的译码输出

X 'Jm C1 YnJm

XJ

YnJ

4.6 率失真理论

一.实际系统中的权衡问题

实际系统中通常需要考虑性能与经济性之间的权衡问题;

可采用以某些不可察觉或可察觉但不影响应用的信号失真代 价,来换取所需的传输速率、存储空间、运算复杂度和系统实 现成本的降低;

电话系统采样8kHz采样,8比特量化;

数字音响系统采样44kHz采样,16或24比特量化;

R

nJ J

log2

D

其中 nJ 为不等长编码的平均码长。

定义4.5.3 信源的熵 H S 与编码速率R 的比值定义为编码效率

C

H S

R

要保证编码没有信息丢失,要求

R H S C 1

3. 霍夫曼(Huffman)编码 霍夫曼编码是一种异字头不等长编码,其基本思想是: 对出现概率大的符号或符号组用位数较少的码字表示; 对出现概率小的符号或符号组用位数较多的码字表示。 由此可提高编码效率。 霍夫曼编码: 定理4.5.17 霍夫曼编码一种最佳的不等长编码。 霍夫曼编码的应用条件: 信源的分布(统计)特性已知。

P

Si

ni

n

2

其中 n

LP

i 1

Si

ni

编码过程的排序过程不同会影响码长的方差。

码字长度的均匀性和方差 示例:信源的符号空间为

《信源编码》PPT课件

器的存在性,它使输出符号的信息率与信源熵之比接

近于 1 ,即:

若要实现,取无限长 L 的

信源符号进行统一编码。

精选ppt

30

例: 设离散无记忆信源概率空间为

•

信源熵:

H

(

X

)

=

-

∑

i=

p

1

(

xi

)

log

p

(

xi

)

=

2.55

bit

/

符号

对信源符号采用定长二元编码, 要求编码效率η为 90 %

若取 L = 1 ,则

• 信源熵: H ( X ) = 2 . 55 bit / 符号

要求编码效率η为 90 % 用二进制变长编码, m = 2

精选ppt

38

例: 设离散无记忆信源概率空间为

• 信源熵: H ( X ) = 1/4 log4 +3/4 log3/4 = 0. 811 bit / 信源符号

精选ppt

存在唯一可译码

20

K1 =1 , K2 =2 , K3 =3 , K4 =3 。

注意Βιβλιοθήκη Kraft 不等式只是用来说明唯一可译码是 否存在,并不能作为唯一可译码的判据。

如码字 {0,10,010,111} 虽然满足 Kraft 不等式,

但它不是唯一可译码。

精选ppt

21

5.2 无失真信源编码

在不失真或允许失真的条件下,用

尽可能少的符号传送信源信息。

精选ppt

3

• 信道编码: – 是以提高信息传输的可靠性为目的的编码。 – 通常通过增加信源的冗余度来实现。采用的 一般方法是增大码率/带宽。

信源编码知识点总结

信源编码知识点总结一、引言信源编码是数字通信中的一个重要环节,它的作用是将源符号序列转换为码字序列,以便能够方便地存储、传输和解码。

在实际应用中,不同的信源编码算法有不同的适用领域,可以根据实际情况选择合适的编码算法。

二、基本概念1. 信源:信源是指产生消息的实体,它可以是声音、图像、文本等各种形式的信息。

2. 符号:符号是信源所产生的基本单位,它可以是0/1比特、字母、数字或其它形式的符号。

3. 离散信源和连续信源:离散信源是指符号集合有限的信源,可以通过一定的方式对其信号进行采样和量化;而连续信源是指符号集合是无限的信源,信号无法进行离散化处理。

三、信息熵信息熵是度量信源信息量大小的一种方法,它描述了信息的不确定度。

信息熵越大,表示信息的不确定度越大;而信息熵越小,表示信息的不确定度越小。

信息熵的计算公式为:H(X) = -Σp(x)log2p(x)其中,H(X)表示信源的信息熵,p(x)表示信源符号x出现的概率。

四、香农定理香农定理是描述信源编码极限的理论基础,它指出了信源编码的极限压缩率。

其中,信源编码的极限压缩率为信源的信息熵和编码方法的平均码长之间的关系:R ≥ H(X)其中,R表示平均码长。

五、熵编码熵编码是一种利用符号出现概率来确定码字长度的编码方法。

常见的熵编码方法有霍夫曼编码、算术编码等。

熵编码的特点是能够达到香农定理的极限压缩率,因此在实际应用中有着广泛的应用。

六、字典编码字典编码是一种通过查表来实现编码的方法,它可以根据出现频率的不同来确定码字的长度。

常见的字典编码算法有静态字典编码和动态字典编码。

字典编码的特点是在一定程度上可以实现压缩,但通常达不到熵编码的效率。

七、变长编码变长编码是一种根据符号出现概率来确定码字长度的编码方法。

它的特点是可以根据符号出现概率确定码字长度,从而达到一定的压缩效果。

变长编码方法包括前缀编码、霍夫曼编码等。

八、无损编码和有损编码无损编码是一种通过编码解码过程中不损失信息的编码方法,它对信源进行了完全可逆的编码。

二章节信源编码

1.68

(4) H(x) 1.631 0.971 N 1.68

第2章 模拟信号的数字传输

22

2.2 模拟信号数字化的方法

1、利用数字通信系统传输模拟信号的步骤:

❖ 把模拟信号数字化,即模数转换(A/D); ❖ 进行数字方式传输; ❖ 把数字信号还原为模拟信号,即数模转换(D/A)。

把发端的A/D变换称为信源编码,而收端的 D/A变换称为信源译码,如语音信号的数字 化叫做语音编码。

第2章 模拟信号的数字传输

23

2.2 模拟信号数字化的方法

模拟 信息源

抽样、量化 和编码

数字 通信系统

译码和低通 滤波

m(t) 模拟随机信号

{s }

k

数字随机序列

{s }

k

数字随机序列

m(t) 模拟随机信号

2.2.1 抽样

带通均匀抽样定理

一个带通信号m(t),其频率限制在fL与fH之间, 带宽为B=fH-fL,如果最小抽样速率fs=2fH/n, 那么m(t)可完全由其抽样值确定。

n

fH B

第2章 模拟信号的数字传输

32

2.2.1 抽样

例如:信号 312KHz~552KHz,求fs

B 552 312 240kHz

第2章 模拟信号的数字传输

3

2.1 离散无记忆信源(DMS)编码

2、DMS编码分类

(1)等长编码 (2)不等长编码

第2章 模拟信号的数字传输

4

2.1.1 等 长 编 码

1、等长编码的编码长度

又称均匀编码。即不论符号出现的概率如何,对 每个符号都用N位二进制码表示。

设信源共有 L种符号,每个符号用N位二 进制表示,则有(2.1-2)

第5章信源编码-信息论与编码(第3版)-曹雪虹-清华大学出版社

普通高等教育“十五”国家级规划教材《信息论与编码》 曹雪虹等编著

7

5.1 编码的概念

码可分为两类: 一、固定长度的码,码中所有码字的长度

都相同,如表5-1中的码1就是定长码 二、可变长度码,码中的码字长短不一,

如表中码2就是变长码。

普通高等教育“十五”国家级规划教材《信息论与编码》 曹雪虹等编著

8

1

第5章 信源编码

信源编码的作用可归纳为:

(1) 符号变换:使信源的输出符号与信 道的输入符号相匹配;

(2)信息匹配:使信息传输率达到信道 容量;

(3) 冗余度压缩:使编码效率等于或接 近100%。

普通高等教育“十五”国家级规划教材《信息论与编码》 曹雪虹等编著

2

第5章 信源编码

信源编码的基础是信息论中的两个编码定理:

每个符号序列xi依照固定码表映射成一个码字yi, yi=(yi1yi2…yil…yiL), yilB={b1,b2,…,bi,…,bm}

这样的码称为分组码,有时也叫块码。只有分组码才有对 应的码表,而非分组码中则不存在码表。

普通高等教育“十五”国家级规划教材《信息论与编码》 曹雪虹等编著

6

5.1 编码的概念

9

5.1 编码的概念

(1)奇异码和非奇异码 若信源符号和码字是一一对应的,则该 码为非奇异码。反之为奇异码。 如表5-2中的码1是奇异码,码2是非奇异 码。

普通高等教育“十五”国家级规划教材《信息论与编码》 曹雪虹等编著

10

5.1 编码的概念

(2)唯一可译码 任意有限长的码元序列,只能被唯一地 分割成一个个的码字,便称为唯一可译 码

如图5-1所示,如果信源输出符号序列长度L=1,

信源符号集A(a1,a2,…,an)

信源编码详解

应能能合成语音!

注:参见数字语音处理

4.5 语音的参量编码

4.5.1 参量编码原理

三、 语音参量编码的可能速率 # 语音参数一般有128~256个,假设为256个,用8bit/参数 表示; 假设发音速率是10参数/秒,

Rb = 8bit/参数•10参数/秒= 80 bit/s

# 当前语音参量编码(混合)达到的速率: CDMA移动通信系统(IS-95) :1.2Kb/s 实验室达到的速率:低于800 bit/s

4.5 语音的参量编码

4.5.2 语音参量编码的实现

一、参量空间

分析一段语音,提取一组参量:

A a1,a2,....ai....an 这组参量代表了这段语音,是一个整体,因而对参 量的处理必须是对这一整体进行处理,并把这组参 量视为n维空间的一点。

由某类消息参量组成的多维空间,称之为参量空间。

DPCM思想

4.4.2 脉冲差分编码调制(DPCM)

二、DPCM原理

xn 1

xni

xn2

xn

t

tn1 tn

t tn1

n2

假设 xn 与 xn 之前k 次采样有关,有:

k

x n

ai xni

ai 为一组系数

i 1

xn与真值 xn 之差为 en ,有:

k

k

x e x x x e n = n -

n=

预测值

加入平滑 量化值

xn xn en

实际参数:k=12,4比特 (16电平)量化差值,码速 率32Kb/s 。

图 4.4.4 DPCM 原理图

4.4.2 脉冲差分编码调制(DPCM)

四、ADPCM 编码-------DPCM的改进

信源编码

应用

表1信源编码实例表以简单的数据压缩为例即可说明信源编码的应用。若有一离散、无失真、无记忆信源,它 含有五种符号U0~U4及其对应概率Pi,对它进行两种编码:等长码和最佳哈夫曼码(见表1)。

其中,等长码的平均码长:=3,即三位码。若采用哈夫曼编码,平均码长,即不足两位码。这就是说,数据 压缩了以上。

另外,在数字电视领域,信源编码包括通用的MPEG—2编码和H.264(MPEG—Part10 AVC)编码等。

相应地,信道编码是为了对抗信道中的噪音和衰减,通过增加冗余,如校验码等,来提高抗干扰能力以及纠 错能力。

定理

不同类型的信源,是否存在有每种信源的最佳的信源编码,这通常是用信源编码定理来表示。最简单、最有 实用指导意义的信源编码定理是离散、无记忆型信源的二进制变长编码的编码定理。它证明,一定存在一种无失 真编码,当把N个符号进行编码时,平均每个符号所需二进码的码长满足。

信源编码

以提高通信有效性为目的而对信源符号 进行的变换,或者说为了减少或消除信

源冗余度而进行的信源符号变换

01 编码结果

03 方式

目录

02 作用 04 定理

目录

05 分类

07 通信系统模型

06 应用 08 专业表述

信源编码是一Βιβλιοθήκη 以提高通信有效性为目的而对信源符号进行的变换,或者说为了减少或消除信源冗余度而进 行的信源符号变换。具体说,就是针对信源输出符号序列的统计特性来寻找某种方法,把信源输出符号序列变换 为最短的码字序列,使后者的各码元所载荷的平均信息量最大,同时又能保证无失真地恢复原来的符号序列。

通信系统模型

[信源]->[信源编码]->[信道编码]->[信道传输+噪声]->[信道解码]->[信源解码]->[信宿] 一般信息论的书上都会有信源编码和信道编码的具体讲解,包括具体的编码方法。

信源编码

信源编码的原理、方法、优缺点及应用信源编码就是从信源产生的信号到码符号的一种映射,它把信源输出的符号变换成码元序列。

信源编码主要是利用信源的统计特性,解决信源的相关性,去掉信源冗余信息,从而达到压缩信源输出的信息率,提高系统有效性的目的。

冗余信息是指信源产生信息所用数据位数与消息中包含的实际信息数据位的数目差值。

解决信源的相关性本质就是降低信源中的冗余,常用消除信源相关性的方法:“合并法”和“预测法”。

如果信源的符号序列中,只在相邻的少数几个符号之间有相关性,而相距较远的符号之间的相关性可以忽略不计,那么,这种信源称为弱记忆信源。

在这种情况下,可以把具有较强相关性的邻近几个符号看成一个大符号。

于是,这些大符号之间的相关性就变得很小了。

实际上就是把原来的基本信源空间变换成了多重空间。

多重空间的重数越高,这种大符号之间的相关性越小,最终可以获得相互独立的情况。

这种方法称为合并法。

如果信源的符号序列之间存在较强的相关性联系,以至根据其中一部分符号能够以一定的准确性推测出其余的符号,这种信源就称为强记忆信源。

在传递这样的信息时,那些可以被精确推断出来的符号就不必传送,从而可以节省时间,提高传输的效率。

但是,大多数情况下,完全可以精确推断出来的情况是极少的,只能根据信源的统计相关性作近似的预测,这就是预测法。

信源编码的作用之一是设法减少码元数目和降低码元速率,即通常所说的数据压缩:作用之二是将信源的模拟信号转化成数字信号,以实现模拟信号的数字化传输。

最原始的信源编码就是莫尔斯电码,另外还有电报码都是信源编码,它们主要用于传输电报信息。

但现代通信应用中常见的信源编码方式有:香农编码、费诺编码、Huffman 编码、算术编码、L-Z编码等,另外还有一些有损的编码方式。

信源编码的目标就是使信源减少冗余,更加有效、经济地传输,最常见的应用形式就是压缩。

另外,在数字电视领域,信源编码包括通用的MPEG—2编码和H.264(MPEG—Part10 AVC)编码等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1 K0 hW B

27

• 对中文A4文件七种样张的平均值: 分辨率8×8 分辨率8×4

pW =0. 9326 pB = 0.0674 LW = 85.99 LB = 5.73

HW = 5.89 HB = 3.14 hWB= 0.1003 K0 =9.97

0.933 ; 0.0670 86.44 5.72

Xij

0(白色) 1(黑色)

19

传真编码

• 直接编码:

– 每一个像素用一位二进码(0或1)代表 – 一页文件的码元数就等于该页二值图像的像 素数 0(白色) • X, 3 =1111 0010 0011 0001 1111

1(黑色)

• 分辨率: – 单位长度(lmm)包含的像素数。 – 分辨率愈高,文件细节愈清晰,文件 质量也就愈高。但是表示一页文件 的比特数就愈多。

X a1 ,, an

信道

Y

Y b1 ,, bn

4

信源编码器

信源编码器示意图

限失真信源编码定理

有失真信源编码的中心任务是:在允许的失真范围内 把编码后的信息率压缩到最小。有失真信源编码的失 真范围受限,所以又称为限失真信源编码;编码后的 信息率得到压缩,因此属熵压缩编码。之所以引入有 失真的熵压缩编码,原因如下: 保熵编码并非总是必要的; 保熵编码并非总是可能的; 降低信息率有利于传输和处理,因此有必要进行熵压 缩编码。

16

冗余位编码

• 冗余位编码——游程编码在多元信源的应用

• 在许多信源序列中,常有不少符号不携带信息, 除了它的数目和所占时长外,完全可以不传送。

• 例如在电话通信中,讲话时常有间隙,如字句间 的停顿,听对方讲话而静默;又如图像信息中, 背景基本不变,并在图像中占相当大一部分,而 其值为常量相当于平均亮度,一般也可以不传送; 在数据信源序列中,信息包间的间歇或某种固定 模式,也属于冗余性质。这些符号可称为冗余位, 若能删除它们,可得较大的压缩比。

P92:5-2-9 每像素的编 码比特数 平均每像素 的熵值

25

LW p( LW ) LW

LW 1

L

H W KW H W 1 LW LW LW LW

• 黑游程熵:

H B p( LB ) log p( LB )

LB 1

L

• 黑游程平均编码长应满足

H B KB H B 1 LB LB LB LB

x1,x2,…,xm1,x m1+1,x m1+2…x 2,…

(取消冗余位后留下的所有信息位)

18

传真编码

• 文件传真的基本特性 – 文字传真:黑、白两个灰度级

– 图像传真:有比较丰富的灰度的图片、图像

• 数字式文件传真把一页文件分为n×m个像素 – Xij表示第i行(i=l,2…n)第j列(j=l,2…m)的像素 • 由于文件传真是二值电平的,即只有两个灰度值,

第5章

信源编码

内容

5.1 编码的5.4 常用信源编码方法简介

2

5.3 限失真信源编码定理

3

限失真信源编码定理

• 将信源编码器看作信道,信源编码模型如下图所示。无 失真信源编码对应于无损确定信道,有失真信源编码对 应于有燥信道。对于无失真信源编码,信道的输入符号 个数与输出符号个数相等,呈一一对应关系,信道的损 失熵H(X|Y)和噪声熵H(Y|X)均为零,通过信道的信息传输 率R等于信源熵H(X),因此,从信息处理角度看,无失真 信源编码是保熵的,只是对冗余度进行了压缩,因为冗 余度是对信号携带信息能力的一种浪费。 X

20

• 例如一页A4文件,分辨率为5点/mm。

• 直接编码时需传送: 210(宽)×297(长)×52=1.5Mbit • 用2400bit/s的数码率传送约需11分钟 • 如果希望达到CCITT的第3类文件传真机的标准,即用

市话网作信道,1分钟内传输一页A4文件,那么我们就需

要找到一种编码方法,把数码压缩到原来的1/11。 • 某一种编码的压缩比为:

6

限失真信源编码定理

限失真信源编码定理:

压缩的太多了,超出最小 极限值R(D),就肯定出错

• 设离散无记忆信源 X 的信息率失真函数为R(D) , – 当信息率 R>R(D)时,只要信源序列长度 L 足够长, 一定存在一种编码方法,其译码失真小于或等于 D+ε,ε为任意小的正数; – 反之,若R<R(D) ,则无论采用什么样的编码方法,其 译码失真必大于D。 • 如是二元信源,则对于任意小的ε>0,每一个信源符号的 平均码长满足如下公式:

理。

8

限失真信源编码定理

限失真信源编码定理只能说明最佳编码

是存在的,而具体构造编码方法却一无所

知。因而就不能像无损编码那样从证明过 程中引出概率匹配的编码方法。一般只能 从优化的思路去求最佳编码。实际上迄今 尚无合适的可实现的编码方法可接近R(D) 这个界。

9

5.4 常用信源编码方法

10

• 前面介绍了信源编码的两大定理,实用的编码方法需要

• 经过黑、白平均可得每个像素的熵值

HW HB hW B pW pB LW LB

• 每个像素的编码比特数

KW KB kW B pW pB LW LB

26

游程编码

hWB kWB pW pB hWB LW LB

• 黑、白游程分别最佳编码后,由每个像素的熵hWB 即可得到最小比特率。 • 极限压缩比 直接编码,每个像素用1个比特率

22

• CCITT建议使用两种分辨率: ⑴ 1728像素/行(8样点/mm),3.85行/mm(4行/mm)

⑵ 1728像素/行(8样点/mm),7.7行/mm (8行/mm)

• 根据汉字的特点,对传真用的七种试用样张进 行了统计,测得下列平均值:

p(白) = pW = 93.3%

p(黑) = pB = 6.7%

14

游程编码

• 游程变换减弱了原序列符号间的相关性。 • 游程变换将二元序列变换成了多元序列;

• 这样就适合于用其他方法,如哈夫曼编码,进一步压

缩信源,提高通信效率。 • 编码方法: – 首先测定“0‖游程长度和“1‖游程长度的概率 分布,即以游程长度为元素,构造一个新的信源; – 对新的信源(游程序列)进行哈夫曼编码。

17

冗余位编码

如下多元序列 x1,x2,…,xm1,y,y,…,y,x y,y,… 一 一 对 应

m1+1,xm1+2,…x m2,

x是含有信息的代码,取值于m元符号集A,可称为信 息位,y是冗余位,它们可为全零,即使未传送,在接 收端也可恢复。 可以用下面两个序列代替

111,…,100,…,000111,…,111000( 1表示信息 位,0表示冗余位)

5.87 3.14 0.0997 10.03

像素(pel) 像素(pel) b/run b/run b/ pel

对中文A4文件,7种样 张的统计极限压缩比 K0 ≈10倍

28

5.4.2 算术编码

• 算术编码是近十多年来发展迅速的一种无失真信源编码,

它与最佳的哈夫曼码相比,理论性能稍加逊色,而实际压

R ( D) K R ( D)

此时平均码长与 信息率R相等

7

限失真信源编码定理

上述定理指出,在失真限度内使信息率任意接近 R(D)的编码方法存在。然而,要使信息率小于 R(D),平均失真一定会超过失真限度D。 对于连续平稳无记忆信源,无法进行无失真编码,

在限失真情况下,有与上述定理一样的编码定

符号数不大时,编码效率提高不多,尤其对于相关信源,

不能令人满意,而合并的符号数增大时,码表中的码字 数很多,设备越来越复杂。因此在实用中常需作一些改

进,同时也就有研究非分组码的必要性。

11

常用信源编码

• 香农编码、费诺编码、哈夫曼编码主要 是针对无记忆信源。

– 当信源有记忆时上述编码效率不高;

• 游程编码对相关信源编码更有效; • 香农编码、费诺编码、哈夫曼编码属于 无失真信源编码; • 游程编码属于限失真信源编码。

5

限失真信源编码定理

• 在本章一开始我们就分析了在很多实际信源中, 特别在模拟的连续信源中,无失真要求是完全

没有必要的,而且也是达不到的。

• 在实际中限失真信源是具有现实意义的 在第4章讨论中,信息率失真函数给出了失真小 于D时所必须具有的最小信息率R(D); 只要信息率大于R(D),一定可以找到一种编码, 使译码后的失真小于D。

缩率和编码效率却往往还优于哈夫曼码,且实现简单,故 很受工程上的重视。

• 算术编码不同于哈夫曼码,它是非分组(非块)码。它从全

序列出发,考虑符号之间的关系来进行编码。 • 算术编码利用了累积概率的概念。 • 算术码主要的编码方法是计算输入信源符号序列所对应 的区间。

29

算术编码的基本思路

从全序列出发,将各信源序列的概率映射到

• “0‖游程和“1‖游程总是交替出现,若规定二元序列总是 从“0‖开始,第一个游程是“0‖游程,则第二个游程必为 “1‖游程,第三个又是“0‖游程……。 • 对于随机二元序列,各游程长度将是随机变量,其取值可 为1,2,3,…,直至无穷。 • 游程长度序列/游程序列:用交替出现的“0‖游程和“1‖ 游程长度表示任意二元序列。 • 游程变换:即将二元序列变成为游程长度序列。 – 是一种一一对应的变换,也是可逆变换。 例如:二元序列000101110010001… 可变换成如下游程序列 31132131

直接编码的数码 压缩比 某种编码的数码

21

• CCITT是Commite' Consultatif International de Telegraphique et Telephonique. 的简称。 • 其英文全称是International consultative committee on telecommunications and Telegraphy 可译成中文: 国际电报电话咨询委员会 • 解释: CCITT是国际电报电话咨询委员会的简称, 它是国际电信联盟(ITU)的常设机构之一。主 要职责是研究电信的新技术、新业务和资费等问 题,并对这类问题通过建议使全世界的电信标准 化。 • 从1993年3月1日起,国际电报电话咨询委员会 (CCITT)改组为国际电信联盟(ITU)电信标 准化部门,简称ITU-T。