最速下降法无约束最优化

Matlab中的最优化问题求解方法

Matlab中的最优化问题求解方法近年来,最优化问题在各个领域中都扮演着重要的角色。

无论是在工程、经济学还是科学研究中,我们都需要找到最优解来满足特定的需求。

而Matlab作为一种强大的数值计算软件,在解决最优化问题方面有着广泛的应用。

本文将介绍一些Matlab中常用的最优化问题求解方法,并探讨其优缺点以及适用范围。

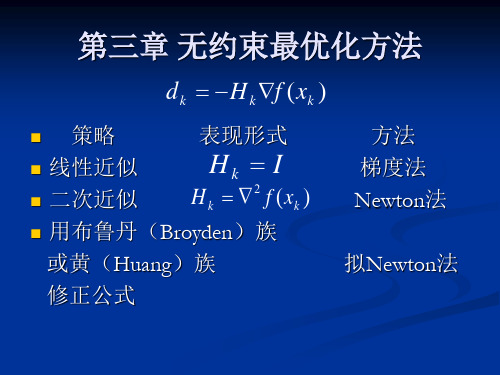

一. 无约束问题求解方法1. 最速下降法最速下降法是最简单且直观的无约束问题求解方法之一。

其基本思想是沿着梯度的反方向迭代求解,直到达到所需的精度要求。

然而,最速下降法的收敛速度通常很慢,特别是在局部极小值点附近。

2. 共轭梯度法共轭梯度法是一种改进的最速下降法。

它利用了无约束问题的二次函数特性,通过选择一组相互共轭的搜索方向来提高收敛速度。

相比于最速下降法,共轭梯度法的收敛速度更快,尤其适用于大规模优化问题。

3. 牛顿法牛顿法是一种基于二阶导数信息的优化方法。

它通过构建并求解特定的二次逼近模型来求解无约束问题。

然而,牛顿法在高维问题中的计算复杂度较高,并且需要矩阵求逆运算,可能导致数值不稳定。

二. 线性规划问题求解方法1. 单纯形法单纯形法是一种经典的线性规划问题求解方法。

它通过在可行域内进行边界移动来寻找最优解。

然而,当问题规模较大时,单纯形法的计算复杂度会大幅增加,导致求解效率低下。

2. 内点法内点法是一种改进的线性规划问题求解方法。

与单纯形法不同,内点法通过将问题转化为一系列等价的非线性问题来求解。

内点法的优势在于其计算复杂度相对较低,尤其适用于大规模线性规划问题。

三. 非线性规划问题求解方法1. 信赖域算法信赖域算法是一种常用的非线性规划问题求解方法。

它通过构建局部模型,并通过逐步调整信赖域半径来寻找最优解。

信赖域算法既考虑了收敛速度,又保持了数值稳定性。

2. 遗传算法遗传算法是一种基于自然进化过程的优化算法。

它模拟遗传操作,并通过选择、交叉和变异等操作来搜索最优解。

遗传算法的优势在于其适用于复杂的非线性规划问题,但可能需要较长的计算时间。

最优化方法实验报告(2)

最优化方法实验报告Numerical Linear Algebra And ItsApplications学生所在学院:理学院学生所在班级:计算数学10-1学生姓名:甘纯指导教师:单锐教务处2013年5月实验三实验名称:无约束最优化方法的MATLAB实现实验时间: 2013年05月10日星期三实验成绩:一、实验目的:通过本次实验的学习,进一步熟悉掌握使用MATLAB软件,并能利用该软件进行无约束最优化方法的计算。

二、实验背景:(一)最速下降法1、算法原理最速下降法的搜索方向是目标函数的负梯度方向,最速下降法从目标函数的负梯度方向一直前进,直到到达目标函数的最低点。

2、算法步骤用最速下降法求无约束问题n R()min的算法步骤如下:xxf,a )给定初始点)0(x ,精度0>ε,并令k=0;b )计算搜索方向)()()(k k x f v -∇=,其中)()(k x f ∇表示函数)(x f 在点)(k x 处的梯度;c )若ε≤)(k v ,则停止计算;否则,从)(k x 出发,沿)(k v 进行一维搜索,即求k λ,使得)(min )()()(0)()(k k k k v x f v x f λλλ+=+≥; d )令1,)()()1(+=+=+k k v x x k k k k λ,转b )。

(二)牛顿法1、算法原理牛顿法是基于多元函数的泰勒展开而来的,它将)()]([-)(1)(2k k x f x f ∇∇-作为搜索方向,因此它的迭代公式可直接写出来:)()]([)(1)(2)()(k k k k x f x f x x ∇∇-=-2、算法步骤用牛顿法求无约束问题n R x x f ∈),(min 的算法步骤如下:a )给定初始点)0(x ,精度0>ε,并令k=0;b )若ε≤∇)()(k x f ,停止,极小点为)(k x ,否则转c );c )计算)()]([,)]([)(1)(2)(1)(2k k k k x f x f p x f ∇∇-=∇--令;d )令1,)()()1(+=+=+k k p x x k k k ,转b )。

最速下降法求解这一无约束的最优化问题

第五题:解:选择类型为:2/13()x ty t x ex =+其中123,,x x x 是待求参数。

根据最小二乘原理,参数123,,x x x 是下面优化问题的解。

[]281231m in (,,)()i i i f x x x y t y ==-å用最速下降法求解这一无约束的最优化问题。

zuiyouhua.mfunction sh=zuiyouhua(x0) % x0为初始猜测值 syms x y z a al;%====================================== t=[0.2,1,2,3,5,7,11,16];r1=[5.05,8.88,11.63,12.93,14.15,14.73,15.30,15.60]; minf=0; for i=1:8r(i)=x*exp(y/t(i))+z-r1(i); %构造最小二乘最优化的目标函数 minf=r(i)^2+minf;end%====================================== f1=diff(minf,x); f2=diff(minf,y);f3=diff(minf,z); %求目标函数的梯度 F=[f1,f2,f3];%====================================== Fx1= -subs(F,{x,y,z},x0); Fx=Fx1/norm(Fx1); k=0;%====================================== %最速下降法核心迭代程序 while 1 x1=x0+a*Fx;P=subs(minf,{x,y,z},x1);xx1=xianxing(P); %调用线性搜索函数 al=huangjing(P,xx1); %调用黄金分割法函数; x0=x0+al*Fx;Fx1= -subs(F,{x,y,z},x0); Fx=Fx1/norm(Fx1); if norm(Fx1)<5e-4 sh=x0;return; end end%====================================== function xx=xianxing(Pa) %一维搜索法线性搜索函数 aa=findsym(Pa); a1=1; h=0.5; k=0; t1=2; while 1 a2=a1+h;Pa1=subs(Pa,aa,a1); Pa2=subs(Pa,aa,a2); if Pa2< Pa1 h=t1*h; a0=a1; a1=a2; k=k+1;if k>1000disp('迭代步数太多,可能不收敛!'); end else if k==0 h=-h; a0=a2; elsec1=min(a0,a2); d1=max(a0,a2); xx=[c1,d1]; return; end endend%====================================== function al1=huangjing(Pb,xx2)%黄金分割法函数 ab=findsym(Pb); c=xx2(1); d=xx2(2);lamda=0.618;eps1=1e-3; u=d-lamda*(d-c); v=c+lamda*(d-c); N=1000; pu=subs(Pb,ab,u); pv=subs(Pb,ab,v); for K=1:Nif abs(v-u)<eps1 g=(u+v)/2; al1=g; return; endif pu <= pv c=c; d=v; v=u; pv=pu;u=d-lamda*(d-c); pu=subs(Pb,ab,u); else c=u; d=d; u=v; pu=pv;v=c+lamda*(d-c); pv=subs(Pb,ab,v); end if K==Ndisp('迭代次数过多,不收敛!'); end end%==================================== >> x0=[0,0,0]; >> zuiyouhua(x0) ans =11.3459 -1.0730 4.9972所以:12311.3459, 1.0730, 4.9972x x x ==-=%=====================================================================================画图程序:x=[11.3459,-1.0730,4.9972];tdata=[0.2,1,2,3,5,7,11,16];ydata=[5.05,8.88,11.63,12.93,14.15,14.73,15.30,15.60];f=x(1)*exp(x(2)./tdata)+x(3); plot(tdata,ydata,'o',tdata,f,'r-')计算所得得图为:。

第3章 无约束最优化方法 3-1 最速下降法 3-2 牛顿法

1

u f ( x)u m u

T 2

2

u R

n

则从任意的初始点 x 0 出发,阻尼牛顿法产 生的迭代点列 满足: (1)当 x k 为有穷点列时,其最后一个点 为 f ( x) 的唯一极小点。 (2)当 x k 为无穷点列时,收敛到 f ( x) 的

第3.2节 Newton法及其改进

第3.1节 最速下降法(Steepest Method)

对于最速下降法的几点说明 (1)第2.6节中介绍的关于下降算法的收敛 性定理对最速下降法都是成立的 。 (2)目标函数在负梯度方向下降得最快只 是局部性质。 (3)锯齿现象 (4)改进策略:在计算的开始阶段使用最 速下降法,在迭代数次后,改用其他算法。

本节的主要内容:

(1)牛顿法的基本思想

(2)阻尼牛顿法

(3)带保护措施的阻尼牛顿法

(4)吉尔-默里稳定牛顿法

(5)信赖域方法(一)

第3.2节 Newton法及其改进

(1)牛顿法的基本思想: * 在目标函数f ( x)的极小点 x 的近似点 x k 附近将 f ( x) 二阶Tayler展开,用展开的二次 函数去逼近 f ( x),将这个二次函数的极小点 * x 作为 的一个新的近似点 x k 1 ,依次下去, 用一系列二次函数的极小点 xk 1 去逼近 f ( x) 的极小点 x * 。

第3.2节 Newton法及其改进

设 f ( x)二次连续可微,则 f ( x) 在 x k 处的二次 近似为: 1 T f ( x) qk ( x) f ( xk ) f ( xk ) ( x xk ) ( x xk )T 2 f ( xk )( x xk ) 2 令

无约束常用优化方法

步长 ,作前进(或后退)试探.如试探成功(目

标函数值有所减小),则按步长序列

,加

大步长(注意每次加大步长都是由初始点算起),直

至试探失败(目标函数值比前一次的有所增加)时,

则取其前一次的步长作为沿这个坐标轴方向搜索的最

优步长,并计算出该方向上的终止点,而后以这个终

止点为始点再进行下一坐标轴方向的搜索,并重复上

处

显然 是二次函数,并且还是正定二次函数,所以 是凸函数且存在唯一全局极小点.为求此极小点,令

即可解得

即

(5.9)

对照基本迭代公式,易知,式(5.9)中的搜索方向

步长因子

方向

是直指点 处近似二次函数

的极小点的方向.此时称此方向为从点 出发的

Newton方向.从初始点开始,每一轮从当前迭代点出发,

沿Newton方向并取步长 的算法称为Newton法.

另外,共轭梯度法不要求精确的直线搜 索.但是,不精确的直线搜索可能导致迭代 出来的向量不再共轭,从而降低方法的效 能.克服的办法是,重设初始点,即把经过 n次迭代得到的Xn作为初始点重新迭代.

五、坐标轮换法

在坐标轮换法中,沿各个坐标轴方向进行一维搜索

时,常选用最优步长法或加速步长法.加速步长法从

初始点出发,沿搜索(坐标轴)方向先取一个较小的

三、共轭方向法

1、概念

通常,我们把从任意点

出发,依次沿某组共轭

方向进行一维搜索的求解最优化问题的方法,叫做共

轭方向法.

2、特点

• 一般地,在n维空间中可以找出n个互相共轭的方向,对于n元正 定二次函数,从任意初始点出发,顺次沿这n个共轭方向最多作n 次直线搜索就可以求得目标函数的极小点.这就是共轭方向法的 算法形成的基本思想.

最优化方法第四章B

将上式右边极小化, 即令

q(k) (s) f (xk ) 2 f (xk )s 0

得:

xk1 xk [ 2 f (xk )]1 f (xk )

(4.2.2) (4.2.3)

这就是牛顿法迭代公式.相应的算法称为牛顿法

令 Gk 2 f (xk ), gk f (xk ) , 则(4.2.3)也可写成

事实上, 由于精确线性搜索满足gkT1dk 0则

gT k 1

g

k

dkT1dk

0

(4.1.11)

这表明最速下降法中相邻两次的搜索方向是相互直

交的, 这就产生了锯齿形状.越接近极小点, 步长越

小, 前进越慢.

最速下降法的锯齿现象

x2 x1

x*

x3

最速下降法的收敛速度

精确线性搜索的最速下降法的收敛速度是线性的

dk

o(

x xk

)

(4.1.2)

显然, 若dk 满足 gkT dk 0 , 则是下降方向, 它使得

f (xk dk ) f (xk )

当

取定后,

g

T k

d

的值越小,

k

即

g

T k

dk

的值越大,

函

数f(x)在xk处下降量越大.

由Cauchy-Schwartz(柯西-施瓦)不等式

二次型 f (x1, x2 ,, xn ) 如果对于任意一组不全为零的 实数 c1 , c2 ,, cn都有 f (c1, c2 ,, cn ) 0 就称为正定的.

A是一个实对称矩阵,如果 实二次型

xT Ax

是正定的,则A称为正定矩阵.

第3章 无约束最优化方法 3-1 最速下降法 3-2 牛顿法

是局部性质。 n (3)锯齿现象 n (4)改进策略:在计算的开始阶段使用最

速下降法,在迭代数次后,改用其他算法。

第3.1节 最速下降法(Steepest Method)

n [引理3.2](康德洛维奇Kntorovich不等式)

第3.2节 Newton法及其改进

n [推论3.8]设 且对任意的 在水平集

在开凸集D上二阶连续可微, ,存在常数 ,使得

上满足

则从任意的初始点 出发,牛顿法产生的迭

代点列 满足

,且收敛到

的唯一极小点。

第3.2节 Newton法及其改进

n 阻尼牛顿法的优点与缺点: 阻尼牛顿法克服了牛顿法要求初始点充分靠

n

,则d是下降方向;

n

,则 是下降方向。

第3.2.4节 吉尔-默里稳定牛顿法

n Gill-Murray稳定牛顿法的基本思想: n 当Hesse矩阵 在迭代点

处为不定矩阵时,对其进行强迫正 定的 分解;当 趋于零时, 采用负曲率方向使函数值下降。

第3.2.4节 吉尔-默里稳定牛顿法

n [算法3.15](求负曲率方向的算法)

得到方向 ,令

。

n (6)精确线性搜索求 ,且令

n (7)若

,则进行步(8);否则,

令

,转步(2)。

n (8)输出

,停止计算。

第3.2.4节 吉尔-默里稳定牛顿法

n [定理3.18]设 二阶连续可微,且存在

,使得

为有界闭

凸集。假定在吉尔-默里稳定牛顿法中取

,且初始点

,则吉尔-默里稳

定牛顿法产生的迭代序列 满足:

最速下降法

随着人工智能、模糊控制、模式识别、人工网络等新技术的应用和发展。

可以让它们与广义预测控制相结合,建立高精度、多模态的预测模型。

使广义预测控制在异常情况下可以稳定运行,推进广义预测控制的进一步发展。

2.2.1最速下降法最速下降法是无约束最优化中是比较有效的方法,它是以d}=一可(x})作为下降方向的算法。

其迭代格式为xx+i=xx一。

*Of (xk)上式中,一般通过精确线搜索准则求得步长因子。

*,当然也不排除可以利用非精确线搜索准则来求得步长因子。

*。

不管最速下降法采取何种线搜索准则,它均具有全局收敛性,但是这也不能直接就认为最速下降算法就是一个良好的优化算法。

在实际试验中,有很多优化问题利用最速下降法并不是下降的特快,反而下将的十分缓慢。

这是因为出现了锯齿现象:就是在计算过程中,最速下降法开始几步还是挺快的,但是当目标函数f (x)的等高线接近于一个球的时候,就出现了类似锯齿现象,前进十分缓慢,降低了算法的效能。

2.2.12.2.2牛顿法牛顿法也是无约束最优化问题中的一种经典算法,它是利用目标函数.f (x)的二次泰勒展开式,并将二次泰勒展开式进行极小化。

其迭代格式为x}+}=xA十d}(2-5)其中步长因子。

、=l} d、为02f (x} )d + Of (xA ) = 0的解。

当目标函数f(x)是正定二次函数的时候,牛顿法可以一步达到最优解;当目标函数f (x)是非二次函数的时候,牛顿法经过有限次迭代之后就不能确保求得目标函数f (x)的最优解。

我们知道目标函数f (x)在极小点附近是很接近于二次函数的,所以,假如初始点非常靠近无约束最优化问题((1-1)的最优解x的时候,并且}Z.f (x.)正定的时候,那么牛顿法就会有很快的收敛速度,而由此算法产生的点列也具有了超线性收敛速度,同时还在一定条件下具有二次收敛性;假如初始点与无约束最优化问题(1-1)的最优解x’相距比较远的时候,这时的}Z.}(x})就不一定是正定的了,也就存在了一个问题,那就是此时的牛顿方向就不一定是下降方向,有可能是上升方向,此时由此算法产生的点列可能也就不收敛于无约束最优化问题((1-1)的最优解了。

最优化方法第六讲 无约束(多维)最优化

step4. 若 || f ( xk1) || ,停止,x* xk1 ;

否则,令 k : k 1, 转step 2 。

14

➢算法框图

给定初始点x0和精度 || f ( x0 ) ||

停止,输出x1

否

是

| x1 x0 |

是 停止,输出x0

否 否

2 f (x0) 0

计算x1

x0

f ( x0 ) 2 f (x0)

1

13 62

x2

x1

1d 1

(

36 , 31

8 31

)T

7

三、最速下降法的特点

1.性质. 设 f ( x) 有一阶连续偏导数,若 步长 满足 k

f ( xk d k ) min f ( xk d k )

k

则有 f ( xk d k )T d k 0。 k

证明:令 ( ) f ( xk d k ),所以

5

一、梯度法(最速下降法):

1. 搜索方向:d k f ( xk ) ,也称为最速下降方向;

2. 搜 索 步 长: k 取 最 优 步 长, 即 满 足

f (xk

kd k )

min

f

(xk

d k ) 。

二、梯度法算法步骤:

1. 给定初始点 x1 Rn ,允许误差 0, 令k 1。

2. 计算搜索方向 d k f ( xk ) ;

Step3. 令 xk 1 xk kd k , 其中tk : f ( xk kd k ) min f ( xk d k )。

24

Step 4. 判断 xk 1 是否满足终止准则: yes: 计算 stop, 则x* : xk1

No : 转 step 5 。

五种最优化方法

五种最优化方法 Prepared on 22 November 2020五种最优化方法1. 最优化方法概述最优化问题的分类1)无约束和有约束条件;2)确定性和随机性最优问题(变量是否确定);3)线性优化与非线性优化(目标函数和约束条件是否线性);4)静态规划和动态规划(解是否随时间变化)。

最优化问题的一般形式(有约束条件):式中f(X)称为目标函数(或求它的极小,或求它的极大),si(X)称为不等式约束,hj(X)称为等式约束。

化过程就是优选X,使目标函数达到最优值。

2.牛顿法简介1)解决的是无约束非线性规划问题;2)是求解函数极值的一种方法;3)是一种函数逼近法。

原理和步骤3. 最速下降法(梯度法)最速下降法简介1)解决的是无约束非线性规划问题;2)是求解函数极值的一种方法;3)沿函数在该点处目标函数下降最快的方向作为搜索方向;最速下降法算法原理和步骤4. 模式搜索法(步长加速法)简介1)解决的是无约束非线性规划问题;2)不需要求目标函数的导数,所以在解决不可导的函数或者求导异常麻烦的函数的优化问题时非常有效。

3)模式搜索法每一次迭代都是交替进行轴向移动和模式移动。

轴向移动的目的是探测有利的下降方向,而模式移动的目的则是沿着有利方向加速移动。

模式搜索法步骤5.评价函数法简介评价函数法是求解多目标优化问题中的一种主要方法。

在许多实际问题中,衡量一个方案的好坏标准往往不止一个,多目标最优化的数学描述如下:min (f_1(x),f_2(x),...,f_k(x)). g(x)<=0传统的多目标优化方法本质是将多目标优化中的各分目标函数,经处理或数学变换,转变成一个单目标函数,然后采用单目标优化技术求解。

常用的方法有“线性加权和法”、“极大极小法”、“理想点法”。

选取其中一种线性加权求合法介绍。

线性加权求合法6. 遗传算法智能优化方法是通过计算机学习和存贮大量的输入-输出模式映射关系,进而达到优化的一种方法,主要有人工神经网络法,遗传算法和模拟退火法等。

最速下降法-最优化方法

(4)f

(

X

)

3

(0.04,0.04)T

,

f ( X 3) 2 0.0032 0.01

X 3 已达到预定精度要求,迭代终止。

故f(x)的无约束近似极小点为

X X 3 (0.96,1.44)T

注:原问题的精确极小点为

X (1,1.5)T

3. 最速下降法性质与评价

x1 x1

2 2

x2 x2

1 1

(1) X 0 (1,1)T

,

f

(

X

)

0

(1,1)T

,

P0

f

(

X

)

0

(1,1)T

X P (t ) f( 0 t

)

0

5t 2

2t

1

,t>0

ቤተ መጻሕፍቲ ባይዱ

应用一维搜索技术,可解得 (t) 的极小点为t0=0.2

所以 X 1 X 0 t0 P0 (1,1)T 0.2(1,1)T (0.8,1.2)T

X X P

Y f (X ) N 输出X

停止

例3.18 用最速下降法求解无约束优化问题:

x x x x x x min f (X ) 2 2 2

2

1

12

2

1

2

初始点 X 0 (1,1)T

,迭代终止准则为

f

(X k)

2

0.01

。

解:

f

(

X

)

4 2

1. 最速下降法原理 2. 最速下降法算法 3. 最速下降法性质与评价

5 常用无约束最优化方法

0.22152 f ( X 1 ) 0.06134 , g 2 f ( X 2 ) , g 2 0.91335. 0.88008

因为

T g1 g0 0.0000, T g 2 g1 0.0000,

说明相邻两个搜索方向是正交的.

有关说明

最速下降法的优点是算法简单,每 次迭代计算量小,占用内存量小, 即使从一个不好的初始点出发,往 往也能收敛到局部极小点,但它有 一个严重缺点就是收敛速度慢. 沿负梯度方向函数值下降很快的说法,容易使人们产生 一种错觉,认为这一定是最理想的搜索方向,沿该方向 搜索时收敛速度应该很快,然而事实证明,梯度法的收 敛速度并不快.特别是对于等值线(面)具有狭长深谷 形状的函数,收敛速度更慢.其原因是由于每次迭代后 下一次搜索方向总是与前一次搜索方向相互垂直,如此 继续下去就产生所谓的锯齿现象.即从直观上看,在远 离极小点的地方每次迭代可能使目标函数有较大的下降, 但是在接近极小点的地方,由于锯齿现象,从而导致每 次迭代行进距离缩短,因而收敛速度不快.

第 五 章 常 用 无 约 束 优 化 方 法

在基本迭代公式 X k 1 X k tk Pk 中,每次迭代搜索方向 Pk 取为目标函数 f (X )的负梯度方向,即 Pk f ( X k ),而 每次迭代的步长 t k 取为最优步长,由此所确定的算法 称为最速下降法.

第 五 章 常 用 无 约 束 优 化 方 法

f ( X * ) f ( X ) (5.2)

成立.点 X *就是问题(5.1)的全局最优点.但是, 大多数最优化方法只能求到局部最优点.这个矛盾对 于实际问题来讲一般容易解决,因为根据问题的实际 意义多半可以直接判定用优化方法求出的局部最优解 是否为全局最优解.但在理论上这是个比较复杂的问 题,本书不涉及. 无约束优化方法是优化技术中极为重要,它不仅可以直 接用来求解无约束优化问题,而且很多约束优化问题 也常将其转化为无约束优化问题,然后用无约束优化 方法来求解.同时,有些无约束优化方法只需略加处 理,即可用于求解约束优化问题.

第三章非线性规划无约束问题的最优化方法

x0

0p 0

1.919877 还需要经过10次迭代才

能满足精度要求

0.003070

第三节 牛顿法

3. 牛顿法的缺点: 牛顿法要求初始解离最优解不远,若初始点选得离最优解太

远时,牛顿法并不能保证其收敛,甚至也不是下降方向。因此, 常将牛顿法与最速下降法结合起来使用。前期使用最速下降法, 当迭代到一定程度后,改用牛顿法,可得到较好的效果。 4. 修正牛顿法 基本思想: 保留了从牛顿法中选取牛顿方向作为搜索方向,摒弃其步长恒 为1的做法,而用一维搜索确定最优步长来构造算法。

2

2

0

2e2 2 3

00 21 0

03

f x3 9

第二节 最速下降法

再从x(3)点 出发,沿x3轴方向e3进行一维搜索:

0 x 3 e3 0

3

00 00 13

f x 3 e3

32

f' 0 x4 x3

3

3

0

3e3 0 0

f x4 0

第二节 最速下降法

因为 x 1

x 4 ,0故.0以1 x(4)点作为新的x(1) ,进行新一轮迭代。

0

1 33 22

f x0

p0

52 5

42

f' x0

p0 5 5 0

22

01

第三节 牛顿法

x1 x0

1 p0 3

2

3

f x1

14

12 2

0

30

12 1 2

2

f x1

所以选取 x* x 1

1 3 作为极小点。 2

第三节 牛顿法

6. 修正牛顿法的缺点: 修正牛顿法虽然比牛顿法有所改进,但也有不足之处:

最速下降法

0 为一维搜索最佳步长,应满足极值必要条件

0Байду номын сангаас0 f x1 min f x f x

min 2 4 25 2 100 min

2 2

0 8 2 4 5000 2 100 0

解 取初始值

x 0 2, 2

T

则初始点处函数值及梯度分别为

f x0 104 2 x1 4 f x0 50 x2 x0 100 沿负梯度方向进行一维搜索,有

x1 x 0 0f x 0 2 4 2 4 0 2 0 100 2 100 0

从直观上看在远离极小点的地方每次迭代可能使目标函数有较大的下降但是在接近极小点的地方由于锯齿现象从而导致每次迭代行进距离缩短因而收敛速度不快

最速下降法

1 无约束多变量问题最优化

考虑无约束问题

min

f (X) X E n

其中函数f (X)具有一阶连续偏导数。 在处理这类问题时,总希望从某一点出发,选择一个目

其中 d ( k ) 是从 x ( k ) 出发的搜索方向,这里取在点x ( k ) 处的最速 下降方向,即

d ( k ) f ( x ( k ) )

k 是从 x ( k )出发沿方向 d ( k )进行一维搜索的步长,即 k 满足

f ( x ( k ) k d ( k ) ) min f ( x ( k ) d ( k ) )

x 0

*

f

* x 0

0

T

根据一元函数极值的必要条件

和复合函数求导公式可得:

用最速下降法求解无约束非线性规划问题

运筹学实习报告姓名: xxxxxxxxxx 学号: xxxxxxxxxxx 专业班级: xxxxxxxxxxxx 2 0 1 3年 7 月 0 4 日题目:用最速下降法求解无约束非线性规划问题 摘要:无约束最优化问题的求解方法分为解析法和直接法两大类。

解析法需要计算函数的梯度,其中最速下降法就属于解析法中的一种。

对于一个无约束非线性规划利用最速下降法求解,首先需要确定其优化方向,此优化方向应该选择为f 在当前点处的负梯度方向,利用一维搜索法找出沿此方向上的最小值及其对应点,此后将该点作为新的出发点重复上述过程,直到达到允许的误差为止。

本文通过理论的计算方法,进一步分析,最后用c++编程实现求出允许误差内的最优解。

此编程可用于计算符合下列形式的函数求最优解过程:f(x)=a[0]x1*x1+a[1]x2*x2+a[2]x1*x2+a[3]x1+a[4]x2+a[5]其中:a[i] (i=0,1,2,3,4,5) 为函数的系数。

本文以“ 李占利 主编,中国矿业大学出版社出版”的《最优化理论与方法》 第五章 “无约束最优化方法,5.1 最速下降法 ”例5—1为实例,首先利用上述迭代的方法,计算出各迭代点的函数值,梯度及其模。

然后应用c++语言编程,得到在精度范围内的精确最优解。

C++编程计算的最优解为 : T x x ]0329218.0,00823045.0[)3(*-==。

即转化为分数结果为:⎥⎦⎤⎢⎣⎡-==412432)3(*x x 。

满足精度要求的模为:1010736154.0||||)3(=<=εp 。

关键词:无约束非线性规划 解析法 最速下降法 梯度 模 最优解一、算法思想无约束最优化方法中的最速下降法首先需要确定其优化方向,此优化方向应该选择为f 在当前点处的负梯度方向,利用一维搜索法找出沿此方向上的最小值及其对应点,此后将该点作为新的出发点重复上述过程,直到达到允许的误差为止。

最速下降法

随着人工智能、模糊控制、模式识别、人工网络等新技术的应用和发展。

可以让它们与广义预测控制相结合,建立高精度、多模态的预测模型。

使广义预测控制在异常情况下可以稳定运行,推进广义预测控制的进一步发展。

2.2.1最速下降法最速下降法是无约束最优化中是比较有效的方法,它是以d}=一可(x})作为下降方向的算法。

其迭代格式为xx+i=xx一。

*Of (xk)上式中,一般通过精确线搜索准则求得步长因子。

*,当然也不排除可以利用非精确线搜索准则来求得步长因子。

*。

不管最速下降法采取何种线搜索准则,它均具有全局收敛性,但是这也不能直接就认为最速下降算法就是一个良好的优化算法。

在实际试验中,有很多优化问题利用最速下降法并不是下降的特快,反而下将的十分缓慢。

这是因为出现了锯齿现象:就是在计算过程中,最速下降法开始几步还是挺快的,但是当目标函数f (x)的等高线接近于一个球的时候,就出现了类似锯齿现象,前进十分缓慢,降低了算法的效能。

2.2.12.2.2牛顿法牛顿法也是无约束最优化问题中的一种经典算法,它是利用目标函数.f (x)的二次泰勒展开式,并将二次泰勒展开式进行极小化。

其迭代格式为x}+}=xA十d}(2-5)其中步长因子。

、=l} d、为02f (x} )d + Of (xA ) = 0的解。

当目标函数f(x)是正定二次函数的时候,牛顿法可以一步达到最优解;当目标函数f (x)是非二次函数的时候,牛顿法经过有限次迭代之后就不能确保求得目标函数f (x)的最优解。

我们知道目标函数f (x)在极小点附近是很接近于二次函数的,所以,假如初始点非常靠近无约束最优化问题((1-1)的最优解x的时候,并且}Z.f (x.)正定的时候,那么牛顿法就会有很快的收敛速度,而由此算法产生的点列也具有了超线性收敛速度,同时还在一定条件下具有二次收敛性;假如初始点与无约束最优化问题(1-1)的最优解x’相距比较远的时候,这时的}Z.}(x})就不一定是正定的了,也就存在了一个问题,那就是此时的牛顿方向就不一定是下降方向,有可能是上升方向,此时由此算法产生的点列可能也就不收敛于无约束最优化问题((1-1)的最优解了。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

《MATLAB 程序设计实践》课程考核实践一、编程实现以下科学计算法,并举一例应用之。

(参考书籍《精通MATLAB 科学计算》,王正林等著,电子工业出版社,2009年)“最速下降法无约束最优化”最速下降法:解: 算法说明:最速下降法是一种沿着N 维目标函数的负梯度方向搜索最小值的方法。

原理:由高等数学知识知道任一点的负梯度方向是函数值在该点下降最快的方向,那么利用负梯度作为极值搜索方向,达到搜寻区间最速下降的目的。

而极值点导数性质,知道该点的梯度=0,故而其终止条件也就是梯度逼近于0,也就是当搜寻区间非常逼近极值点时,即:当▽f(a )→0推出f(a )→极值)(x f ,f(a )即为所求。

该方法是一种局部极值搜寻方法。

函数的负梯度表示如下:-g(x )=-▽f(x)=-⎢⎣⎡∂∂1)(x x f 2)(x x f ∂∂ … T N x x f ⎥⎦⎤∂∂)(搜索步长可调整,通常记为αk (第k 次迭代中的步长)。

该算法利用一维的线性搜索方法,如二次逼近法,沿着负梯度方向不断搜索函数的较小值,从而找到最优解。

方法特点(1)初始值可任选,每次迭代计算量小,存储量少,程序简短。

即使从一个不好的初始点出发,开始的几步迭代,目标函数值下降很快,然后慢慢逼近局部极小点。

(2)任意相邻两点的搜索方向是正交的,它的迭代路径胃绕道逼近极小点。

当迭代点接近极小点时,步长变得很小,越走越慢。

(3)全局收敛,线性收敛,易产生扭摆现象而造成早停。

算法步骤:最速下降法的基本求解流程如下:第一步迭代次数初始化为k=0,求出初始点0x 的函数值f 0=f (0x )。

第二步迭代次数加1,即k=k+1,用一维线性搜索方法确定沿负梯度方向-1-k g 的步长1k -α,其中1k -α=ArgMinaf (111k /----k k g g x α)。

第三步沿着负梯度方向寻找下一个接近最小值的点,其中步长为1k -α,得到下一点的坐标为:1111/-----=k k k k k g g x x α。

第四步如果k x ≈1-k x ,且f (k x )≈f (1-k x ),那么就认为k x 为所求的最小值点,并结束循环;否则,就跳到步骤二。

流程图:题目:最速下降法求解无约束最优化问题实例。

采用最速下降法求如下函数的最小值问题:f(x,y)=x(x-5-y)+y(y-4)即用最速下降法求解函数的最小值问题。

解:需先求出该函数的梯度函数。

可知其梯度函数为:g(x)=(2x-5-y,-x+2y-4)。

源程序代码如下:Opt_Steepest.m文件%用最速下降法求最优化解;function [xo,fo]=Opt_Steepest(f,grad,x0,TolX,TolFun,dist0,MaxIter)%f:函数名;%grad:梯度函数;%x0:搜索初始值;%TolX:最优值点间的误差阈值;%TolFun:函数的误差阈值;%dist0:初始步长;%MaxIter:最大的迭代次数;%xo:最优化点值;%fo:函数在点xo处的函数值。

%%%%%%判断输入的变量数,设定一些变量为默认值if nargin<7MaxIter=100; %最大的迭代次数默认为100endif nargin<6dist0=10; %初始步长默认为10endif nargin<5TolFun=1e-8; %函数值误差为1e-8endif nargin<4TolX=1e-6; %自变量距离误差endx=x0;fx0=feval(f,x0);fx=fx0;dist=dist0;kmax1=25; %线性搜索法确定步长的最大搜索次数warning=0;%%%%%迭代计算求最优解for k=1:MaxIterg=feval(grad,x);g=g/norm(g); %求点x处的梯度%%线性搜索方法确定步长dist=dist*2;fx1=feval(f,x-dist*2*g);for k1=1:kmax1fx2=fx1;fx1=feval(f,x-dist*g);if fx0>fx1+TolFun && fx1<fx2-TolFun %fx0>fx1<fx2,den=4*fx1-2*fx0-2*fx2;num=den-fx0+fx2;%二次逼近法dist=dist*num/den;x=x-dist*g;fx=feval(f,x); %确定下一点break;elsedist=dist/2;endendif k1>=kmax1warning=warning+1; %无法确定最优步长elsewarning=0;endif warning>=2||(norm(x-x0)<TolX&&abs(fx-fx0)<TolFun)break;endx0=x;fx0=fx;endxo=x;fo=fx;if k==MaxIterfprintf('Just best in %d iteration',MaxIter);endQ1.m文件f1004=inline('[x(1)*(x(1)-5-x(2))+x(2)*(x(2)-4)]','x'); %目标函数grad=inline('[2*x(1)-5-x(2),-x(1)+2*x(2)-4]','x'); %目标函数的梯度函数x0=[1 4];TolX=1e-4;TolFun=1e-9;MaxIter=100;dist0=1;[xo,fo]=Opt_Steepest(f1004,grad,x0,TolX,TolFun,dist0,MaxIter)运行结果如下:由计算结果可知,当x=4.6667,y=4.3333时,函数f(x,y)=x(x-5-y)+y(y-4)取得最小值-20.3333。

二.编程解决以下科学计算和工程实际问题。

作用(如下图1-1),求简支梁受左半均匀分布载荷q及右边L/4处集中力偶M=900N*m,其弯矩、转角和挠度。

设L=2m,q=1000N/m,ME=200*109N/m2,I=2*10-6m4.图1-1①解题思路:首先对简支梁进行受力分析,受力分析图(如下图1-2)所示:图1-2从材料力学的知识可知道,由弯矩求转角要经过一次不定积分,而由转角求挠度又要经过一次不定积分,通常这是很麻烦而且容易出错的,而在MATLAB中,可用cumsum函数或cumtrapz函数作近似的不定积分,只要x取得足够密,其结果将相当准确,而程序非常简单。

第一步:计算支反力设支座a和b处的支反力分别为Na和Nb,则据∑Ma=0,∑Fy=0得到平衡方程为:Nb=(q*L^2/8+M0)/LNa=q*L/2-Nb第二步:建立弯矩方程以截面c,d为分界面,将梁划分为ac,cd,db三段分别建立ac,cd,db三段对应的弯矩方程:M1=Na*x-q*x.^2/2; 0≦x≦L/2M2=Nb*(L-x)-M0; L/2≦x≦3L/4M3=Nb*(L-x); 3L/4≦x≦L第三步:建立挠曲轴近似微分方程并积分建立挠曲轴近似微分方程d2Y/dx2=M(x)/EI对M/EI积分,得转角A,再做一次积分,得挠度Y,每次积分都有一个待定的积分常数。

A=∫(M)*dx/(E*I)+Ca= A0(x)+Ca,此处设A0(x)= cumtrapz(M)*dx/(E*I) Y=∫(A)*dx+Cy=∫A0(x) *dx+Ca*x+Cy,此处设Y0(x)=cumtrapz(A0)*dx第四步:确定相应的积分常数Ca,Cy由边界条件Y(0)=0,Y(L)=0确定Y(0)= Y0(0)+Cy=0Y(L)= Y0(L)+Ca*L+Cy=0即[0 1;L 1] [Ca;Cy]=[-Y0(0);-Y0(L)][Ca;Cy]=[0,1;L,1]\[-Y0(0);-Y0(L)];第五步:根据计算结果绘制弯矩、转角以及挠度图形②源程序:L=2;q=1000;M0=900;E=200e9;I=2e-6; %输入已知参数Nb=(q*L^2/8+M0)/L;Na=q*L/2-Nb; %求支反力x=linspace(0,L,101);dx=L/100; %linspace是线性空间向量M1=Na*x(1:51)-q*x(1:51).^2/2; %分三段用数组列出M数组M2=Nb*(L-x(52:76))-M0;M3=Nb*(L-x(77:101));M=[M1,M2,M3]; %写出完整的M数组A0=cumtrapz(M)*dx/(E*I); %由M积分求转角AY0=cumtrapz(A0)*dx; %由转角积分求挠度YC=[0,1;L,1]\[-Y0(1);-Y0(101)]; %由边界条件求积分常数Ca=C(1),Cy=C(2),A=A0+Ca;Y=Y0+Ca*x+Cy; %A为转角,Y为挠度,求出转角和挠度的完整数值subplot(3,1,1),plot(x,M),grid %绘制弯矩图形subplot(3,1,2),plot(x,A),grid %绘制转角图形subplot(3,1,3),plot(x,Y),grid %绘制挠度图形③运行结果:④流程图:第三题流程图:开始输入已知的数据表作为样本;设置插值节点针对不同的方法选用相应的函数及格式将已知数据和插值节点代入求得插值节点处的函数值(1)A.正弦值算法:x=0:pi/12:pi/2;y=[0 0.2588 0.5000 0.7071 0.8660 0.9659 1.0000];xi=0:pi/180:pi/2;%三次样条差值yi=interp1(x,y,xi,'spline')%五次多项式拟合A=polyfit(x,y,5);yj=polyval(A,xi)运行结果:yi =Columns 1 through 110 0.0175 0.0349 0.0524 0.0698 0.0872 0.1045 0.1219 0.1392 0.1564 0.1737Columns 12 through 220.1908 0.2079 0.2249 0.2419 0.2588 0.2756 0.2923 0.3090 0.3255 0.3420 0.3583Columns 23 through 330.3746 0.3907 0.4067 0.4226 0.4384 0.4540 0.4695 0.4848 0.5000 0.5150 0.5299Columns 34 through 440.5446 0.5592 0.5736 0.5878 0.6018 0.6157 0.6293 0.6428 0.6561 0.6691 0.6820Columns 45 through 550.6947 0.7071 0.7193 0.7313 0.7431 0.7547 0.7660 0.7771 0.7880 0.7986 0.8090Columns 56 through 660.8191 0.8290 0.8387 0.8480 0.8571 0.8660 0.8746 0.8829 0.8910 0.8987 0.9062Columns 67 through 770.9135 0.9204 0.9271 0.9335 0.9396 0.9454 0.9510 0.9563 0.9612 0.9659 0.9703Columns 78 through 880.9744 0.9782 0.9817 0.9849 0.9878 0.9904 0.9927 0.9946 0.9963 0.9977 0.9987Columns 89 through 910.9995 0.9999 1.0000yj =Columns 1 through 110.0000 0.0174 0.0349 0.0523 0.0697 0.0871 0.1045 0.1218 0.1391 0.1564 0.1736Columns 12 through 220.1908 0.2079 0.2249 0.2419 0.2588 0.2756 0.2924 0.3090 0.3256 0.3420 0.3584Columns 23 through 330.3746 0.3907 0.4067 0.4226 0.4384 0.4540 0.4695 0.4848 0.5000 0.5150 0.5299Columns 34 through 440.5446 0.5592 0.5736 0.5878 0.6018 0.6157 0.6293 0.6428 0.6561 0.6691 0.6820Columns 45 through 550.6946 0.7071 0.7193 0.7313 0.7431 0.7547 0.7660 0.7771 0.7880 0.7986 0.8090Columns 56 through 660.8191 0.8290 0.8386 0.8480 0.8571 0.8660 0.8746 0.8829 0.8910 0.8988 0.9063Columns 67 through 770.9135 0.9205 0.9272 0.9336 0.9397 0.9455 0.9510 0.9563 0.9612 0.9659 0.9703Columns 78 through 880.9743 0.9781 0.9816 0.9848 0.9877 0.9902 0.9925 0.9945 0.9962 0.9975 0.9986Columns 89 through 910.9994 0.9998 1.0000通过比较,两种方法得到的结果近似相等。