构建高斯RBF网络 神经网络控制课件(第三版)

rbf神经网络原理

rbf神经网络原理

RBF神经网络是一种基于径向基函数(Radial Basis Function,简称RBF)的人工神经网络模型。

它在解决分类和回归等问题上具有优良的性能和灵活性。

RBF神经网络的基本思想是利用一组基函数来表示输入空间中的复杂映射关系。

这些基函数以输入样本为中心,通过测量样本与中心之间的距离来计算输出值。

常用的基函数包括高斯函数、多项式函数等。

与传统的前馈神经网络不同,RBF神经网络采用两层结构,包括一个隐含层和一个输出层。

隐含层的神经元是基函数的中心,负责对输入样本进行映射。

输出层的神经元用于组合隐含层的输出,并产生网络的最终输出结果。

RBF神经网络的训练过程分为两个阶段:中心选择和参数调整。

在中心选择阶段,通过聚类算法来确定基函数的中心,例如K-means聚类算法。

在参数调整阶段,使用误差反向传播算法来调整基函数的权值和输出层的权值。

RBF神经网络具有较强的非线性拟合能力和逼近性能。

它可以处理高维数据和大规模数据集,并且对于输入空间中的非线性映射具有较好的适应性。

此外,RBF神经网络还具有较快的训练速度和较好的泛化能力。

总结来说,RBF神经网络通过基函数的组合来实现对输入样

本的映射,从而实现对复杂映射关系的建模。

它是一种强大的人工神经网络模型,在多个领域和问题中表现出色。

RBF网络应用—逼近非线性函数 神经网络控制课件(第三版)

1

RBF网络应用—逼近非线性函数

Matlab程序

m265a.m

4

RBF网络应用—逼近非线性函数

m265a.m执行结果

构造3个高斯RBF

5

RBF网络应用—逼近非线性函数

m265a.m执行结果

构造非线性函数d=f(u)

6

RBF网络应用—逼近非线性函数

12

RBF网络应用—逼近非线性函数

m265b.m执行结果

网络输出

13

RBF网络应用—逼近非线性函数

m265b.m执行结果

非线性函数d(o) 、网络输出y(*)

14

RBF网络应用—逼近非线性函数

m265b.m执行结果

与m265a.m 执行 结果 比较: 相同

非线性函数d(o) 、网络输出y(*)

m265a.m执行结果

设计的网络输出 y逼近d=f(u)

7

RBF网络应用—逼近非线性函数

m265a.m执行结果

Command Window:

w1 = 0.7000

-1.7000

2.1000

-0.1000

2.7000

-1.4000

3.0000

b1 = 26

1. 设计的RBFNN结构。 2. RBFNN的所有参数。 由m265b.m程序,仿真N1,7,1 逼近非线性函数d=f(u)的过程。

10

RBF网络应用—逼近非线性函数

m265b.m执行结果

7个隐层节点的输出

11

RBF网络应用—逼近非线性函数

m265b.m执行结果

7个隐层节点输出的加权、网络输出

15

RBF网络应用—逼近非线性函数

神经网络设计课件_Ch12_径向基函数(RBF)网络

7

12+

RBF网络实现内插问题

• 内插问题(数值逼近)

– 给定样本数据:{p1, t1} {p2, t 2} {pQ, tQ } – 寻找函数,使之满足:ti F ( Pi ) ,1 i Q

• RBF网络解决内插问题

– – – – 网络隐层使用Q个隐节点 把所有Q个样本输入分别作为Q个隐节点的中心 各基函数取相同的扩展常数 确定权值可解线性方程组:

radbas (t )

radbas (t )

2

1

t2

1 e

2

3. 逆多二次函数:

1 (t 2 2 )

( 0)

δ 称为基函数的扩展常数 或宽度,δ 越小,径向基 函数的宽度越小,基函数 就越有选择性。

3

12+

RBF网络结构(续)

• 网络结构

RBF网络是个三层结构(R-S1-S2)的前馈网,其中,R代 表输入层并指出输入维数; S1代表由径向基神经元构成的隐 层并指出神经元数目; S2是线性输出层。

8

12+

RBF网络实现内插问题(续)

F ( pi ) w j ( pi c j )

j 1 Q

– RBF网络的输出为:

C j Pj 是 其中 ()为隐节点的激活函数( RBF函数); 第 j个隐节点的RBF函数的数据中心。 – RBF网络的结构为:

9

12+

RBF网络实现内插问题(续)

• 交替梯度方法

– 为提高网络的训练效率,将梯度方法分为两阶段,这 两个阶段交替进行训练,直到达到要求的精度为止

• 输入层-隐层阶段:固定网络的权值,训练网络的 中心和扩展宽度 • 隐层-输出层阶段:固定网络的中心和扩展宽度, 训练网络的权值

智能控制(第三版)chap9-神经网络控制

第9章 神经网络控制

9.1 概述

神经网络是一种具有高度非线性的连续时间动力 系统,它有着很强的自学习功能和对非线性系统的强 大映射能力,已广泛应用于复杂对象的控制中。

神经网络的硬件实现愈趋方便。大规模集成电路 技术的发展为神经网络的硬件实现提供了技术手段。

2

神经网络控制所取得的进展为: (1) 基于神经网络的系统辨识:可在已知常规模型结构 的情况下,估计模型的参数;或利用神经网络的非线 性特性,建立非线性系统的静态、动态、逆动态及预 测模型;

图9-2(a) 神经网络直接逆控制 14

(2)神经网络间接自校正控制:使用常规控制器, 神经网络估计器需要较高的建模精度。假设控制对象: y(t) = f(yt) + g(yt)u(t),其结构如图9-3所示。

图9-3 神经网络间接自校正控制

15

假设被控对象为如下单变量仿射非线性系统:

y(t)fytgytu(t)

第9章 神经网络控制

9.1 概述 9.2 神经网络控制结构 9.3 单神经元网络控制 9.4 RBF网络监督控制 9.5 RBF网络自校正控制 9.6 基于RBF网络直接模型参考自适应控制 9.7 一种简单的RBF网络自适应控制

9.8 基于不确定逼近的RBF网络自适应控制 9.9 基于模型整体逼近的机器人RBF网络自适应控制 9.10 神经网络数字控制

11

9.2.3 神经网络自适应控制

①与传统自适应控制相同,神经网络自适应控制也分 为神经网络自校正控制和神经网络模型参考自适应 控制两种。

②自校正控制根据系统正向或逆向模型的结果来调节 控制器内部参数,使系统满足给定的指标。

③而在模型参考自适应控制中,闭环控制系统的期望 性能由一个稳定的参考模型来描述。

rbf神经网络原理

rbf神经网络原理

RBF神经网络,即径向基函数神经网络,是一种常用的神经网络模型。

它的核心思想是通过选择合适的基函数来近似非线性函数关系,从而实现对复杂模式的学习与分类。

RBF神经网络由三层组成:输入层,隐含层和输出层。

输入层接收外部输入的数据,每个输入节点对应一个特征。

隐含层是RBF神经网络的核心,其中的每个神经元都是一个径向基函数。

在隐含层中,每个神经元都有一个中心向量和一个标准差,用于确定其基函数的形状和大小。

通过计算输入向量与神经元中心之间的距离,再经过基函数的转换,即可得到神经元的输出。

输出层是整个神经网络的分类器,它通常采用线性组合来产生最终的输出。

常见的方法是采用最小均方误差(MSE)准则函数来训练神经网络,通过调整神经元中心和标准差的参数,以最小化实际输出与期望输出之间的误差。

RBF神经网络具有以下优点:

1. 相较于传统的前馈神经网络,RBF神经网络对线性可分和线性不可分问题的逼近能力更强。

2. RBF神经网络的训练速度较快,且容易实现并行计算。

3. 网络结构简单,参数少,不容易出现过拟合问题。

4. 对于输入输出空间中的噪声和干扰具有较强的鲁棒性。

总而言之,RBF神经网络通过径向基函数的选取,能够有效地近似非线性函数,并在模式分类等任务中取得较好的结果。

[课件]第5章 典型人工神经网络(RBF)PPT

![[课件]第5章 典型人工神经网络(RBF)PPT](https://img.taocdn.com/s3/m/1f14d91243323968001c9200.png)

8

补充:RBF网络工具箱函数

RBF网络演示函数

demorb1 - Radial basis approximation. demorb3 - Radial basis underlapping neurons. demorb4 - Radial basis overlapping neurons. demogrn1 - GRNN function approximation. demopnn1 - PNN classification.

版权所有 复制必究 2009

第5章 典型 人工神经网 络(RBF)

版权所有 复制必究 2009

第二节

2.1 2.2 2.3 2.4

径向基函数神经网络

RBF神经网络结构 RBF神经网络基本功能 RBF神经网络学习算法

RBF神经网络的扩展

2

版权所有 复制必究 2009

1. 模型

2.1 RBF神经网络结构 数学描述(向量):

版权所有 复制必究 2009

RBF网络相关指令 P192 表7-2-4 RBF网络没有单独的训练函数,在网

络设计函数或者新建函数中都已包括

了训练部分,因此,solverb, solverbe, newrb,网络即为训练后的网络。

9

7

2, j

版权所有 复制必究 2009

2.4 RBF神经网络的扩展

扩展的方式 (1) 改变核函数

T 1 为 协 方 差 矩 阵 u e x p ( x w ) ( x w ) , j 1 , 2 ,, N 1 , j 1 , j j 1 , j 1

(2) 改变学习算法 精炼参数算法;有序的样本输入;在输出层学习中, 改变目标函数准则. (3) 两者同时改变

神经网络控制(RBF)

17/20

1.3 基本概念 生物神经元的基本特征

神经元具有感知外界信息或其它神经元信息的输入端 神经元具有向外界或其它神经元输出信息的输出端 神经元之间的连接强度(连接权)决定信号传递的强 弱,而且联接强度是可以随训练改变的 信号可以是起刺激作用的,也可以是起抑制作用的, 即连接权的值(权值)可正、可负 每个神经元有一个阀值 神经元可以对接受的信号进行累积(加权) 神经元的兴奋程度(输出值的大小),取决于其传输 函数及其输入(输入信号的加权与阈值之和)

4/20

1.1 概述

神经细胞利用电-化学过程交换信号。输入信号来自另一些神 经细胞。这些神经细胞的轴突末梢(也就是终端)和本神经细胞的 树突相遇形成突触(synapse),信号就从树突上的突触进入本细胞。 信号在大脑中实际怎样传输是一个相当复杂的过程,但就我们而言, 重要的是把它看成和现代的计算机一样,利用一系列的0和1来进行 操作。就是说,大脑的神经细胞也只有两种状态:兴奋(fire)和不 兴奋(即抑制)。发射信号的强度不变,变化的仅仅是频率。神经 细胞利用一种我们还不知道的方法,把所有从树突上突触进来的信号 进行相加,如果全部信号的总和超过某个阀值,就会激发神经细胞 进入兴奋(fire)状态,这时就会有一个电信号通过轴突发送出去给 其他神经细胞。如果信号总和没有达到阀值,神经细胞就不会兴奋 起来。这样的解释有点过分简单化,但已能满足我们的目的。 。

RBF神经网络演示课件

RBF神经网络结构

这个网络,实现从输入空间到隐藏 空间的一个非线性映射,随后从隐 藏空间到输出空间是线性映射。

16

RBF中的插值问题

在RBF中是如何通过插值方法进行网路的训练呢? 首先假设我们有N个m0维向量,那么我们就确定了输入层节点有 m0 个。相当于一个从m0维输入空间到一维输出空间的映射,可以写成 如下形式:

不需要通过权连接)映射到隐空间 ; 当RBF的中心点确定后,映射关系也就确定; 隐含层空间到输出空间的映射是线性的 通过最小二乘估计来解给定的分类问题。

7

Cover理论

定义:假设空间不是稠密分布的,将复杂的模式分类问题非线性地投射到高维空 间将比投射到低微空间更可能是线性可分的。

x=0

8

Cover 的插值问题

RBF神经网络是基于RBF函数,RBF函数是解决多变量插值问题

首先了解下什么是插值问题?

13

插值问题

在工程技术上,给出一批离散的点,要求作出一条通过这些点的光滑曲线,以满足设计 和加工的需要。反映在数学上,即已知函数在一些点的值,寻求它的分析表达式。

y

y0

y1

o

x0

x1

Y(x)

P(x)=?

y2

yi

yn

x2

xi

xnn

14

插值问题

一是在选定近似函数H(x)后,不要求它们通过已知样点 ,只要求

在某种意义下它在这些样点的总偏差最小----曲线拟合法。

二是给出函数f(x)的一些样点值,选定某些便于计算的函数,要求它们

通过已知样点,由此确定函数H(x)为f(x)的近似值----插值法;

RBF(径向基)神经网络

Keynote: 尤志强

构建高斯RBF网络 神经网络控制课件(第三版)

dist

b1 S1 1

lw 2,1

S2 S1

n1

+

S1 1 S1

a1 1 b2

S1 1

S2 1

n2

+

S2 1

a2 S2 1

a1i radba( si wi p b1i )

a2 purelin(lwa1 b2)

书用符号

qi R(uci)σTi2(uci)

y wq θ

3

构建高斯RBF网络

12

构建高斯RBF网络

思考与练习

1.在程序m263a.m、m263b.m中, 设sc=2,4, 等,执行,观测结果, 并与sc=1的结果比较。

2.观测程序m263a.m 、m263b.m执行结果: 输入样本长度L=? 隐层节点数=? 二者是否相同?

3. 构建的网络有否误差,即y=d?

13

结束

14

4.1600

d= 2.0000 4.0000 5.9000 y= 2.0000 4.0000 5.9000

8

构建高斯RBF网络

m263a.m执行结果

说明 由函数newrbe(u,d,sc)构建高斯RBFNN: 1. 其隐层节点数 = 输入样本的长度L, 因此,若L大,则网络结构很复杂,故不宜用。 2. 隐层节点的b1i值相等,为 0. 832F网络

1

高斯RBF网络

结构 与 模型

书用符号

u

q

W

y

输入层 节点

隐层 节点

输出层 节点

qi R(uci)σTi2(uci)

y wq θ

2

高斯RBF网络

结构 与 模型

输入层

隐层(RBF 神经元层)

【精品】绝对经典RBF神经网络PPT课件

一. 自组织中心选取法

1989年,Moody和Darken提出了一种由两个阶段组成的混 合学习过程的思路。

两个步骤:①无监督的自组织学习阶段

②有监督学习阶段

其任务是用有监督 学习算法训练输出 层权值,一般采用 梯度法进行训练。

其任务是用自组织聚类方法为隐 层节点的径向基函数确定合适的 数据中心,并根据各中心之间的

其中 G' • 是 G•的导数

Q k n i X k t in X k t in T

1n 1 i

i 1n 3 E 1 n n

i

三.随机选取中心法

条件:典型的训练样本,隐含单元的中心是 随机的在输入 样本中选取,且中心固定。因此此算法学习的参数只有两 个:

方差和权值

四.OLS学习算法

两种方法中心的选取

1.中心从样本输入中选取

一般来说,样本密集的地方中心点可以适当多些,样本稀疏的地方 中心点可以少些;若数据本身是均匀分布的,中心点也可以均匀分 布。总之,选出的数据中心应具有代表性。径向基函数的扩展常数 是根据数据中心的散布而确定的,为了避免每个径向基函数太尖或 太平,一种选择方法是将所有径向基函数的扩展常数设为 dmax

心的最小欧式距离确定其归类i(Xk) ,即当

i i而(X 将k)全m 部i 样X i本kn划ti(n 分)时为,I个X k 子被集归U 为1 (n 第)U ,2 ( n 类) , ,U I( 从n )

每个子集构成一个以聚类中心为典型代表 的聚类域。

(4)更新各类的聚类中心。采用竞争学习规

则进行调整

距离确定隐节点的扩展常数。 一般采用Duda和Hart1973年提

出的k-means聚类算法。

智能控制(第三版)chap7-典型神经网络2

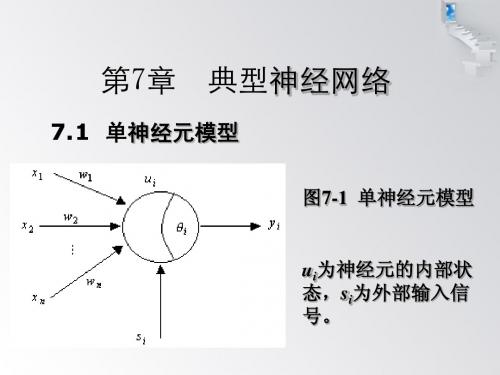

根据前面网络结构知:x1=u(k).

武汉科技大学 信息科学与工程学院

18

7.2.4 BP网络的优缺点

BP网络的优点为: ①可以逼近任意的非线性映射关系; ②是全局逼近算法,具有较强的泛化能力。 ③具有较好的容错性。 BP网络的主要缺点为: ①收敛速度慢;

②容易陷入局部极小值;

③难以确定隐层及隐层节点的数目。 武汉科技大学 信息科学与工程学院

2

武汉科技大学 信息科学与工程学院

常用的神经元非线性特性有以下3种: (1)阈值型

1 f ( Neti ) 0 Neti 0 Neti 0

图7-2 阈值型函数 武汉科技大学 信息科学与工程学院

3

(2)分段线性型

0 f ( Neti ) kNeti f max Neti Neti 0 Neti 0 Neti Netil Neti Netil

出层;

(2)层与层之间采用全互连方式,同一层神经元之间 不连接; (3)权值通过δ 学习算法进行调节; (4)神经元激活函数为S函数;

(5)学习算法由正向传播和反向传播组成;

(6)层与层的连接是单向的,信息的传播是双向的。

武汉科技大学 信息科学与工程学院

7

7.2.2 BP网络结构

包括一个隐含层的BP网络结构如下图,图中i为输

使用高斯函数作为激活函数,网络具有唯一最佳逼

近的特性,无局部极小。

武汉科技大学 信息科学与工程学院

24

7.3.1 RBF网络结构与算法

多输入单输出的RBF神经网络结构如图7-13所示。

图7-13 RBF网络结构 武汉科技大学 信息科学与工程学院

25

在RBF神经网络中,x=[x1 x2 … xn]T为网络输入, hj为隐含层第 j个神经元的输出,即

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

构建高斯RBF网络

思考与练习

1.在程序m263a.m、m263b.m中, 设sc=2,4, 等,执行,观测结果, 并与sc=1的结果比较。

2.观测程序m263a.m 、m263b.m执行结果: 输入样本长度L=? 隐层节点数=? 二者是否相同?

3. 构建的网络有否误差,即y=d?

13

结束

14

9

构建高斯RBF网络

输入样本集:u=-3:3 输出样本集:d=radbas(u)*1.2

10

构建高斯RBF网络

Matlab程序: m263b.m

11

构建高斯RBF网络

m263b.m执行结果

Command Window:

Sc=1

见数据: w1 b1 w2 b2

d = 0.0001 0.0220 0.4415 1.2000 0.4415 0.0220 0.0001 y = 0.0001 0.0220 0.4415 1.2000 0.4415 0.0220 0.0001

4.1600

d= 2.0000 4.0000 5.9000 y= 2.0000 4.0000 5.9000

8

构建高斯RBF网络

m263a.m执行结果

说明 由函数newrbe(u,d,sc)构建高斯RBFNN: 1. 其隐层节点数 = 输入样本的长度L, 因此,若L大,则网络结构很复杂,故不宜用。 2. 隐层节点的b1i值相等,为 0. 8326/sc

例 2-6-3M

构建 高斯RBF网络

1

高斯RBF网络

结构 与 模型

输入层

隐层(RBF 神经元层)

输出层

M用 符号

S1 R iw1,1

lw 2,1

p R 1

1

R

dist

b1 S1 1

S2 S1

n1

+

S1 1 S1

a1 1 b2

S1 1

S2 1

n2

+

S2 1

a2 S2 1

符号对应

a1i radba( si wi p b1i )

5

构建高斯RBF网络

输入样本集:u=[1 2 3] 输出样本集:d=[2.0 4.0 5.9]

6

构建高斯RBF网络

Matlab程序: m263a.m

7

构建高斯RBF网络

m263a.m执行结果

Command Window:

sc=1 w1= 1

2 3 b1=0.8326 0.8326 0.8326 w2=0 0.R(uci)σTi2(uci)

1 b1i i

a2 purelin(lwa1 b2)

y wq θ

4

构建高斯RBF网络

构建函数 newrbe(u,d,sc)

()中,为构建需的条件: u:输入样本集,维数 n (书用符号) R (M用符号) d:输出样本集,维数 m (书用符号) S2 (M用符号) sc:伸展系数,缺省=1