面向新媒体的爬虫搜索技术研究

基于Python的网络爬虫与数据挖掘技术研究

基于Python的网络爬虫与数据挖掘技术研究一、引言随着互联网的快速发展,数据量呈现爆炸式增长,如何从海量数据中获取有用信息成为了各行各业关注的焦点。

网络爬虫和数据挖掘技术作为信息检索和分析的重要手段,受到了广泛关注。

本文将重点探讨基于Python的网络爬虫与数据挖掘技术在实际应用中的研究和发展。

二、网络爬虫技术概述网络爬虫是一种自动化程序,可以模拟人类用户浏览网页的行为,按照一定规则抓取网页信息。

Python作为一种简洁而强大的编程语言,拥有丰富的库和工具,使得开发网络爬虫变得更加高效和便捷。

通过Python编写网络爬虫程序,可以实现对网页内容的快速抓取和处理,为后续的数据挖掘提供支持。

三、Python在网络爬虫中的应用1. 爬虫框架Python中有许多优秀的爬虫框架,如Scrapy、BeautifulSoup、Requests等,这些框架提供了丰富的功能和接口,可以帮助开发者快速构建高效稳定的网络爬虫程序。

其中,Scrapy作为一个功能强大的爬虫框架,被广泛应用于各类网站数据的抓取和处理。

2. 数据解析在网络爬虫过程中,获取到的数据通常是HTML或JSON格式的文本数据,需要进行解析和提取有用信息。

Python中的BeautifulSoup库和正则表达式等工具可以帮助开发者高效地解析网页内容,并提取目标数据。

3. 反爬机制随着反爬技术的不断升级,网站为了防止被恶意抓取数据,会采取各种反爬措施。

Python开发者需要了解常见的反爬手段,并通过设置请求头、使用代理IP等方式规避反爬策略,确保网络爬虫程序正常运行。

四、数据挖掘技术概述数据挖掘是从大量数据中发现潜在模式、关系或规律的过程,旨在帮助人们更好地理解数据并做出有效决策。

Python作为一种灵活多样的编程语言,在数据挖掘领域也有着广泛应用。

五、Python在数据挖掘中的应用1. 数据清洗与预处理在进行数据挖掘之前,通常需要对原始数据进行清洗和预处理,包括缺失值处理、异常值检测、特征选择等步骤。

基于网络爬虫的信息抓取与分析技术研究

基于网络爬虫的信息抓取与分析技术研究近年来,随着互联网的普及和技术的发展,信息量呈现几何级数的增长。

如何从庞杂的数据中精确地提取有用的信息,成为了亟待解决的问题。

为此,基于网络爬虫的信息抓取与分析技术应运而生。

本文将重点探讨该技术在实际应用中的研究与发展。

网络爬虫是一种自动化程序,通过模拟用户在互联网上的浏览,收集并提取各类信息。

基于网络爬虫的信息抓取与分析技术,通过使用爬虫工具,从互联网上获取数据,并对数据进行清洗、处理和分析,以发现其中的规律和价值。

要进行信息抓取与分析,首先需要明确目标。

例如,想要获取某个特定话题的新闻报道,可以通过设定关键词来获得相关的新闻网页,并通过爬虫工具收集数据。

然后,对收集到的数据进行初步处理,去除噪声、重复等无用信息,保留有用的文本、图片等内容。

接下来,可以利用文本挖掘、机器学习等技术对数据进行进一步的分析。

信息抓取与分析的技术工具有很多,其中最常用的是Python语言中的Scrapy框架。

Scrapy框架提供了强大的爬取工具和丰富的数据处理能力,可以方便地进行数据获取和清洗。

通过Scrapy框架,可以简洁高效地实现网页内容的自动化采集和提取。

在进行信息抓取时,需要注意合法、合规的原则。

合法地获取数据可以避免侵犯他人的权益,同时也可以减少风险和法律纠纷的潜在危险。

因此,在使用网络爬虫进行信息抓取时,应该尊重网站的规则和政策,遵循robots.txt协议等。

信息抓取与分析技术主要包括数据清洗、数据处理和数据分析三个步骤。

在数据清洗过程中,需要对原始数据进行去重、去除噪声和无效字符等操作,使得数据质量得到提高。

数据处理过程中,可以利用文本挖掘、自然语言处理等技术将数据转换为结构化信息。

数据分析阶段,则通过数据挖掘、机器学习、统计分析等方法,对数据进行更深入的探索和挖掘,以发现其中的潜在价值和规律。

基于网络爬虫的信息抓取与分析技术的应用广泛。

在新闻媒体行业中,可以通过抓取新闻网站上的报道,进行舆情分析和热点预测。

基于Python的网络爬虫技术研究

基于Python的网络爬虫技术研究随着互联网的快速发展,网络爬虫技术成为了信息获取和数据分析的重要工具。

而Python作为一种简洁、灵活且易于学习的编程语言,被广泛应用于网络爬虫的开发和研究。

本文将探讨基于Python的网络爬虫技术的原理、应用和发展趋势。

一、概述网络爬虫是一种自动化程序,能够模拟人类在互联网上的浏览行为,获取网页内容并进行进一步的处理。

基于Python的网络爬虫技术主要利用Python的强大的文本处理能力和丰富的第三方库,实现对网页的抓取、解析和数据提取。

二、原理1. URL请求和响应网络爬虫首先通过URL发送请求获取网页内容,然后根据网页的响应状态码判断是否获取成功。

Python的requests库和urllib库是常用的URL请求库,能够方便地发送HTTP请求并接收响应。

2. 网页解析获取网页内容后,网络爬虫需要对网页进行解析以提取所需的信息。

Python的Beautiful Soup库和XPath是常用的网页解析技术,能够快速、高效地提取目标数据。

3. 数据存储网络爬虫获取到的数据需要进行存储和管理。

Python的sqlite3模块和MySQLdb模块提供了方便的数据库操作功能,可以将数据存储在本地数据库中。

此外,还可以使用Python的pandas库将数据保存为CSV 或Excel文件。

三、应用基于Python的网络爬虫技术在各个领域有广泛的应用。

1. 数据采集网络爬虫可以帮助我们自动化地从互联网上获取大量的数据。

比如,在电商行业,利用网络爬虫可以获取商品信息、评论数据等,用于市场分析和竞争情报;在金融行业,可以获取股票、财经新闻等数据,用于量化交易和投资决策。

2. 舆情分析网络爬虫可以从社交媒体平台、新闻网站等获取用户的评论和观点,用于进行舆情分析。

比如,在政府部门中,可以通过分析网民的意见和情绪,了解公众对政策的反应;在企业中,可以通过分析用户的评价和意见,改进产品和服务。

基于网络爬虫的四川大学资讯整合网站的研究与设计

基于网络爬虫的四川大学资讯整合网站的研究与设计摘要:由于工作与生活节奏的加快,人们的时间呈现出碎片化,新媒体因迎合这种现状而生。

随着互联网信息呈“爆发式”增长,人们更需要新媒体能够及时、准确地提供资讯,资源整合就成了其中的必要环节。

以四川大学为例,利用网络爬虫技术整合四川大学学生经常浏览的教务处网站、团委网站、学生工作处网站的通知及新闻,以计算机科学技术解决问题,满足学生群体对新媒体运营效果的期望。

关键词:网络爬虫新媒体研究设计中图分类号:tp393 文献标识码:a 文章编号:1007-3973(2013)007-063-031 引言随着新媒体的飞速发展与逐渐成熟,新媒体这一媒体形式凭借其便利、便捷的特点获得了人们的认可和关注。

由于新媒体平台的数量增长,人们已经逐渐迷失在浩瀚的网络中,无法在有限的时间内及时、准确地获得想要的信息,所以对新媒体进行有效的资源整合成了解决这一问题的首要途径。

本文以四川大学教务处网站、四川大学团委网站、四川大学学生工作处网站为研究背景,结合计算科学技术,提出了新媒体资源整合的方法,使广大的学生群体在有限的课余时间内准确、高效地了解校内外的资讯。

本文主要工作包括:(1)研究四川大学网络媒体现状;(2)提出新媒体平台数量增长背景下,如何及时、高效地获取资讯的办法;(3)介绍新媒体资源整合的核心技术—网络爬虫技术及相关关键技术;(4)结合网络爬虫技术设计资源整合网站,整合四川大学教务网站、学生工作处网站、团委网站的资讯。

2 四川大学网络媒体现状分析经调查,四川大学学生最经常访问的校园官方网络平台有“四川大学教务处网站”、“四川大学团委网站”、“四川大学学生工作处网站”,其主要原因在于以上几个网络媒体平台经常颁布贴近学生校园生活的资讯信息,学生急需从中获取及时的资讯了解校园内的实时动态。

现阶段,四川大学官方网络媒体具有以下几个特点:2.1 资讯重复出现,缺乏系统性新媒体飞速发展,其主要原因在于其便捷和便利的特点。

爬虫技术和网站数据抓取方法

爬虫技术和网站数据抓取方法随着互联网的发展,数据成为了一种可贵的资源,越来越多的人开始关注数据的获取和利用。

在数据的获取中,爬虫技术和网站数据抓取方法已经成为非常流行的方式之一。

本文将简单介绍爬虫技术和网站数据抓取方法,并探讨它们的应用。

一、爬虫技术1.1 爬虫的概念爬虫(Spider)是指一种在互联网上自动获取信息的程序。

它模拟浏览器行为,通过对网页中的链接进行解析和跟踪,自动获取网页中的数据。

爬虫技术主要用于数据抓取、搜索引擎、信息源汇聚等领域。

1.2 爬虫的工作原理爬虫的工作过程可以简单概括为先请求网页,再解析网页,最后抽取数据三个步骤。

首先,爬虫会发送请求到指定网页,获取网页的源代码。

然后,爬虫会对获取的网页源代码进行解析,找到网页中包含的链接和数据。

最后,爬虫会抽取有价值的数据,并进行存储和处理。

1.3 爬虫的分类根据不同的目的和需求,爬虫可以分为通用网页爬虫、数据整合爬虫、社交媒体爬虫和搜索引擎爬虫等。

通用网页爬虫:主要用于搜索引擎,通过搜索引擎抓取尽可能多的网页,并且对网页进行索引,提高搜索引擎的检索效率。

数据整合爬虫:主要用于整合互联网上的数据,如新闻、股票数据、房价数据等,以便于大众获取和使用。

社交媒体爬虫:主要用于在社交媒体平台上获取用户的信息,如微博、微信等。

搜索引擎爬虫:主要是为了让搜索引擎收录网站的数据,从而提升网站排名。

二、网站数据抓取方法2.1 网站数据抓取的目的网站数据抓取主要是为了收集和分析网站上的数据,从而了解网站的性质、变化、趋势,为网站提供参考和决策依据。

2.2 网站数据抓取的工具与技术网站数据抓取可以使用多种工具和技术,如爬虫技术、API接口、网站抓取软件等。

(1)爬虫技术爬虫技术是一种高效的网站数据抓取方式,可以快速有效地获取网站上的数据。

但是需要注意网站的反爬机制,防止被网站封禁或者被告上法庭。

(2)API接口API(Application Programming Interface)接口是一种标准化的数据交换格式,是实现不同应用程序之间的数据传递的重要方式之一。

爬虫的发展现状

爬虫的发展现状当前爬虫技术的发展已经趋于成熟,并在各个领域得到了广泛的应用。

以下是爬虫发展的一些现状:1. 爬虫技术的需求不断增加:由于互联网信息的爆炸式增长,越来越多的企业和个人需要利用爬虫技术获取和处理海量的数据。

例如,电商企业需要从各大网站抓取商品信息进行价格比较和竞争分析,金融机构需要从网络上获取各种新闻和舆情数据进行分析等。

2. 爬虫技术日趋智能化:随着人工智能技术的快速发展,爬虫技术也开始融入更多的智能算法。

例如,深度学习技术可以使爬虫更好地理解和解析网页内容,自动提取信息。

同时,自然语言处理和情感分析等技术也可以应用于爬虫,使其能够更好地处理文本信息。

3. 爬虫技术面临的挑战不断增加:随着各大网站对爬虫的防护措施越来越严格,爬虫技术所面临的反爬虫机制也越来越复杂。

许多网站采取了验证码、IP封禁、页面加密等措施来限制爬虫的访问。

这使得爬虫需要不断地提升反反爬虫的能力,避免被封禁或识别。

4. 数据隐私保护成为一大亟待解决的问题:随着数据隐私保护意识的增强,个人信息的获取和使用受到越来越多的限制。

在爬虫抓取数据时,需要注意遵守相关法律法规,尊重用户隐私。

越来越多的网站开始采用反爬虫技术来保护用户的信息安全。

5. 爬虫技术的应用领域不断扩展:除了常见的搜索引擎、电商、社交媒体等领域外,爬虫技术在其他领域也得到了广泛应用。

例如,医疗领域可以利用爬虫技术从各大医疗网站获取疾病信息和医疗知识,教育领域可以利用爬虫技术收集学术论文和教材资源等。

综上所述,爬虫技术在不断发展和演进的同时,也面临着诸多挑战与需求。

未来随着技术的不断进步和法律法规的完善,爬虫技术将在更多领域发挥其作用,并对相关行业产生积极的影响。

Python爬虫案例分析案例

Python爬虫案例分析案例Python爬虫案例分析Python爬虫是一种自动化抓取网络信息的技术,它可以通过编写程序来获取互联网上的数据,并进行分析和处理。

在本文中,将通过分析两个实际案例来探讨Python爬虫的具体应用。

案例一:新闻网站爬取在这个案例中,我们将使用Python爬虫来抓取一个新闻网站的文章,并提取其中的标题、摘要和链接。

首先,我们需要导入相应的库,如requests和BeautifulSoup,以便进行网页请求和数据解析。

然后,我们可以使用requests库发送HTTP请求并获取网页内容,接着使用BeautifulSoup库解析HTML,并提取需要的信息。

最后,我们可以将获取到的数据保存到数据库或者以其他形式进行进一步的分析。

这个案例的一个应用场景是,我们可以利用爬虫来监测新闻网站的更新情况,并将新文章的标题、摘要和链接自动推送给用户。

这不仅可以帮助用户及时获取最新的新闻内容,还可以实现自动化的信息收集。

案例二:电商网站数据采集在这个案例中,我们将使用Python爬虫来采集一个电商网站的商品信息。

我们可以选择目标网站上的一些分类,然后通过爬虫程序自动抓取每个分类下的商品信息,并收集商品的名称、价格和评论等数据。

同样,我们需要使用requests库发送HTTP请求,使用BeautifulSoup 库解析HTML,然后提取和保存数据。

在电商网站数据采集的应用场景中,我们可以根据采集到的商品信息来进行价格监测、市场分析和竞争对手调研等工作。

同时,我们也可以使用爬虫来获取用户对商品的评论和评分,以便进行用户行为分析和用户满意度评估。

通过上述两个案例的分析,我们可以清楚地看到Python爬虫在实际应用中的价值。

它可以帮助我们自动化地获取网络上的数据,从而进行进一步的分析和应用。

当然,在进行爬虫开发时,我们也需要注意一些法律和道德的约束,遵守相关的网络爬取规则,确保数据的合法获取和使用。

总结:Python爬虫是一种强大的工具,可以帮助我们获取网络上的数据,并进行进一步的分析和应用。

中国爬虫现状分析报告

中国爬虫现状分析报告背景介绍随着互联网技术的不断发展和普及,信息获取和处理的需求也逐渐增加。

爬虫作为一种自动化获取和处理信息的工具,在互联网时代有着广泛的应用。

本报告旨在对中国爬虫的现状进行分析,探讨其发展趋势和面临的挑战。

爬虫的定义和主要应用领域爬虫,又称网络爬虫或网络蜘蛛,是一种模拟人类浏览器行为的程序,通过自动地访问互联网上的网页,并提取感兴趣的信息。

爬虫的应用领域十分广泛,主要包括以下几个方面:1. 搜索引擎搜索引擎是爬虫应用的重要领域之一。

著名的搜索引擎如谷歌、百度、必应等都需要使用大规模的爬虫系统来收集和索引互联网上的网页信息,以提供用户最精准和最全面的搜索结果。

2. 电商数据采集在电商领域,爬虫被广泛应用于商品信息的采集和价格比较。

例如,一些比价网站通过爬虫定期抓取不同电商平台上的商品信息,以提供给用户一个价格对比的平台。

3. 舆情监测在政府、企业等领域,通过监测互联网上的舆论和信息,可以及时了解社会公众的关注点和态度。

因此,舆情监测已经成为了爬虫技术在这些领域中重要的应用之一。

4. 其他领域爬虫还被应用在许多其他领域,例如学术研究、金融、新闻媒体等。

在学术研究中,研究人员可以利用爬虫工具收集、清洗和分析大量的研究数据。

而在金融领域,一些投资机构通过爬虫程序定期收集和分析财经信息,以辅助投资决策。

中国爬虫现状分析1. 技术发展随着互联网技术的不断发展,中国爬虫技术也在不断壮大和创新。

有越来越多的大型互联网公司、初创企业以及研究机构投入到爬虫技术的研发和应用中。

爬虫技术逐渐向着智能化方向发展,采用了更加高效、准确和智能的爬取和分析算法,提升了爬取效率和数据质量。

2. 法律法规在中国,爬虫的使用受到法律法规的限制和监管。

由于一些不法分子利用爬虫技术进行网络攻击、侵犯他人隐私等不良行为,相关法律法规逐渐完善,对于爬虫行为提出了明确的约束和规定。

例如,《中华人民共和国刑法》第二百六十七条规定了非法获取计算机信息系统数据的法律责任。

网络爬虫技术在搜索引擎中的应用分析

网络爬虫技术在搜索引擎中的应用分析随着互联网的快速发展,搜索引擎在人们生活中的重要性变得越来越突出。

作为互联网最主要的应用之一,搜索引擎的发展进程中,网络爬虫技术起到了关键的作用。

网络爬虫技术通过自动化程序从互联网上大量抓取信息,并将其整理、索引,使得用户能够通过搜索引擎快速地找到自己所需要的信息。

本文将就网络爬虫技术在搜索引擎中的应用进行分析。

首先,网络爬虫技术在搜索引擎的信息抓取中扮演着重要的角色。

网络爬虫通过遍历网络上的网页来搜集信息。

在这个过程中,网络爬虫会根据一定的规则从网页中提取出有用的内容,并将其保存到数据库中。

这些数据库会成为搜索引擎后续检索的基础。

网络爬虫技术的高效和准确性直接决定了搜索引擎的检索结果的质量。

因此,采用合适的网络爬虫技术对于一个搜索引擎来说至关重要。

其次,网络爬虫技术在搜索引擎的信息索引中发挥了重要作用。

一旦信息被网络爬虫抓取并保存到数据库中,搜索引擎就会利用索引技术将这些信息进行组织和分类。

索引技术通过对信息进行分词、建立倒排索引等方式,使得用户能够通过关键词快速定位到所需的信息。

网络爬虫技术的高效率和准确性决定了索引的质量,直接影响用户的搜索体验。

例如,当用户在搜索引擎中输入关键词时,搜索引擎会迅速地从庞大的数据库中查询索引,将与关键词相关的结果返回给用户。

这个过程背后离不开网络爬虫技术的支持。

此外,网络爬虫技术还在搜索引擎的排名算法中发挥了重要作用。

搜索引擎的排名算法决定了用户搜索结果的排序顺序。

一般来说,排名靠前的结果更符合用户的需求。

网络爬虫技术通过抓取和索引的数据为排名算法提供了重要的基础。

搜索引擎可以根据网络爬虫获取的信息,分析网页的质量、关键词的密度等因素,为不同网页进行评分,然后根据评分确定搜索结果的排序。

网络爬虫技术的准确性和智能化程度决定了排名算法的公正性和准确性。

然而,网络爬虫技术也存在一些问题和挑战。

首先是数据隐私和安全性问题。

网络爬虫技术的广泛应用意味着用户隐私可能会被泄露。

网络爬虫技术的概述与研究

网络爬虫技术的概述与研究摘要网络爬虫,又被称为网页蜘蛛,网络机器人,随着网络的迅速发展,万维网成为大量信息的载体,如何有效地提取并利用这些信息成为一个巨大的挑战;搜索引擎 Search Engine,例如传统的通用搜索引擎AltaVista,Yahoo和Google等,作为一个辅助人们检索信息的工具成为用户访问web的入口和指南;但是,这些通用性搜索引擎也存在着一定的局限性;为了解决上述问题,定向抓取相关网页资源的聚焦爬虫应运而生;聚焦爬虫是一个自动下载网页的程序,它根据既定的抓取目标,有选择的访问万维网上的网页与相关的链接,获取所需要的信息;本文将对网络爬虫技术及其原理进行简单的介绍,并且给出实例;关键词网络爬虫聚焦爬虫网页抓取搜索策略 URL一、网络爬虫的简介1、URL在介绍网络爬虫之前,先引入URL的相关知识;URL是URI的一个子集;它是Uniform Resource Locator的缩写,译为“统一资源定位符”;通俗地说,URL是Internet上描述信息资源的字符串,主要用在各种客户程序和服务器程序上,特别是著名的Mosaic;采用URL可以用一种统一的格式来描述各种信息资源,包括文件、服务器的地址和目录等;URL的格式由三部分组成:·第一部分是协议或称为服务方式;·第二部分是存有该资源的主机IP地址有时也包括端口号;·第三部分是主机资源的具体地址,如目录和文件名等;第一部分和第二部分用“://”符号隔开,第二部分和第三部分用“/”符号隔开;第一部分和第二部分是不可缺少的,第三部分有时可以省略;用URL表示文件时,服务器方式用file表示,后面要有主机IP地址、文件的存取路径即目录和文件名等信息;有时可以省略目录和文件名,但“/”符号不能省略;例如file://ftp.yoyodyne/pub/files/foobar.txt爬虫最主要的处理对象就是URL,它根据URL地址取得所需要的文件内容,然后对它进行进一步的处理;2、传统爬虫与聚焦爬虫网络爬虫是一个自动提取网页的程序,它为搜索引擎从web上下载网页,是搜索引擎的重要组成;传统爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入队列,直到满足系统的一定停止条件;搜索引擎是基于传统爬虫技术建立的,但其存在着一定的局限性,例如:1 不同领域、不同背景的用户往往具有不同的检索目的和需求,通用搜索引擎所返回的结果包含大量用户不关心的网页;2通用搜索引擎的目标是尽可能大的网络覆盖率,有限的搜索引擎服务器资源与无限的网络数据资源之间的矛盾将进一步加深;3万维网数据形式的丰富和网络技术的不断发展,图片、数据库、音频、视频多媒体等不同数据大量出现,通用搜索引擎往往对这些信息含量密集且具有一定结构的数据无能为力,不能很好地发现和获取;4通用搜索引擎大多提供基于关键字的检索,难以支持根据语义信息提出的查询;为了解决以上问题,定向抓取网页的聚焦爬虫应运而生;聚焦爬虫的工作流程较为复杂,需要根据一定的网页分析算法过滤与主题无关的链接,保留有用的链接并将其放入等待抓取URL的队列;然后,它将根据一定的搜索策略从队列中选择下一步要抓取的网页URL,并重复上述过程,直到达到系统的某一条件时停止;二、网络爬虫的工作原理在网络爬虫的系统框架中,主过程由控制器,解析器,资源库三部分组成;控制器的主要工作是负责给多线程中的各个爬虫线程分配工作任务;解析器的主要工作是下载网页,进行页面的处理,主要是将一些JS脚本标签、CSS代码内容、空格字符、HTML标签等内容处理掉,爬虫的基本工作是由解析器完成;资源库是用来存放下载到的网页资源,一般都采用大型的数据库存储,如Oracle数据库,并对其建立索引;相对于通用网络爬虫,聚焦爬虫还需要解决三个主要问题:1 对抓取目标的描述或定义;2 对网页或数据的分析与过滤;3 对URL的搜索策略;抓取目标的描述和定义是决定网页分析算法与URL搜索策略如何制订的基础;而网页分析算法和候选URL排序算法是决定搜索引擎所提供的服务形式和爬虫网页抓取行为的关键所在;这两个部分的算法又是紧密相关的;1、抓取目标描述现有聚焦爬虫对抓取目标的描述可分为基于目标网页特征、基于目标数据模式和基于领域概念3种;基于目标网页特征的爬虫所抓取、存储并索引的对象一般为网站或网页;根据种子样本获取方式可分为:1 预先给定的初始抓取种子样本;2 预先给定的网页分类目录和与分类目录对应的种子样本,如Yahoo分类结构等;3 通过用户行为确定的抓取目标样例,分为:a 用户浏览过程中显示标注的抓取样本;b 通过用户日志挖掘得到访问模式及相关样本;其中,网页特征可以是网页的内容特征,也可以是网页的链接结构特征,等等;2、网页搜索策略网页的抓取策略可以分为深度优先、广度优先和最佳优先三种;深度优先在很多情况下会导致爬虫的陷入trapped问题,目前常见的是广度优先和最佳优先方法;1广度优先搜索策略广度优先搜索策略是指在抓取过程中,在完成当前层次的搜索后,才进行下一层次的搜索;该算法的设计和实现相对简单;在目前为覆盖尽可能多的网页,一般使用广度优先搜索方法;也有很多研究将广度优先搜索策略应用于聚焦爬虫中;其基本思想是认为与初始URL在一定链接距离内的网页具有主题相关性的概率很大;另外一种方法是将广度优先搜索与网页过滤技术结合使用,先用广度优先策略抓取网页,再将其中无关的网页过滤掉;这些方法的缺点在于,随着抓取网页的增多,大量的无关网页将被下载并过滤,算法的效率将变低;2最佳优先搜索策略最佳优先搜索策略按照一定的网页分析算法,预测候选URL与目标网页的相似度,或与主题的相关性,并选取评价最好的一个或几个URL进行抓取;它只访问经过网页分析算法预测为“有用”的网页;存在的一个问题是,在爬虫抓取路径上的很多相关网页可能被忽略,因为最佳优先策略是一种局部最优搜索算法;因此需要将最佳优先结合具体的应用进行改进,以跳出局部最优点;将在第4节中结合网页分析算法作具体的讨论;研究表明,这样的闭环调整可以将无关网页数量降低30%~90%;3深度优先搜索策略深度优先搜索策略从起始网页开始,选择一个URL进入,分析这个网页中的URL,选择一个再进入;如此一个链接一个链接地抓取下去,直到处理完一条路线之后再处理下一条路线;深度优先策略设计较为简单;然而门户网站提供的链接往往最具价值,PageRank也很高,但每深入一层,网页价值和PageRank都会相应地有所下降;这暗示了重要网页通常距离种子较近,而过度深入抓取到的网页却价值很低;同时,这种策略抓取深度直接影响着抓取命中率以及抓取效率,对抓取深度是该种策略的关键;相对于其他两种策略而言;此种策略很少被使用;3、网页分析算法网页分析算法可以归纳为基于网络拓扑、基于网页内容和基于用户访问行为三种类型;1基于网络拓扑的分析算法基于网页之间的链接,通过已知的网页或数据,来对与其有直接或间接链接关系的对象可以是网页或网站等作出评价的算法;又分为网页粒度、网站粒度和网页块粒度这三种;a、网页Webpage粒度的分析算法PageRank和HITS算法是最常见的链接分析算法,两者都是通过对网页间链接度的递归和规范化计算,得到每个网页的重要度评价; PageRank算法虽然考虑了用户访问行为的随机性和Sink网页的存在,但忽略了绝大多数用户访问时带有目的性,即网页和链接与查询主题的相关性;针对这个问题,HITS算法提出了两个关键的概念:权威型网页authority和中心型网页hub;基于链接的抓取的问题是相关页面主题团之间的隧道现象,即很多在抓取路径上偏离主题的网页也指向目标网页,局部评价策略中断了在当前路径上的抓取行为;文献21提出了一种基于反向链接BackLink的分层式上下文模型Context Model,用于描述指向目标网页一定物理跳数半径内的网页拓扑图的中心Layer0为目标网页,将网页依据指向目标网页的物理跳数进行层次划分,从外层网页指向内层网页的链接称为反向链接;b、网站粒度的分析算法网站粒度的资源发现和管理策略也比网页粒度的更简单有效;网站粒度的爬虫抓取的关键之处在于站点的划分和站点等级SiteRank的计算; SiteRank的计算方法与PageRank类似,但是需要对网站之间的链接作一定程度抽象,并在一定的模型下计算链接的权重;网站划分情况分为按域名划分和按IP地址划分两种;文献18讨论了在分布式情况下,通过对同一个域名下不同主机、服务器的IP地址进行站点划分,构造站点图,利用类似PageRank的方法评价SiteRank;同时,根据不同文件在各个站点上的分布情况,构造文档图,结合 SiteRank分布式计算得到DocRank;文献18证明,利用分布式的SiteRank计算,不仅大大降低了单机站点的算法代价,而且克服了单独站点对整个网络覆盖率有限的缺点;附带的一个优点是,常见PageRank 造假难以对SiteRank进行欺骗;c、网页块粒度的分析算法在一个页面中,往往含有多个指向其他页面的链接,这些链接中只有一部分是指向主题相关网页的,或根据网页的链接锚文本表明其具有较高重要性;但是,在PageRank和HITS算法中,没有对这些链接作区分,因此常常给网页分析带来广告等噪声链接的干扰;在网页块级别Block level 进行链接分析的算法的基本思想是通过VIPS网页分割算法将网页分为不同的网页块page block,然后对这些网页块建立page to block和block to page的链接矩阵, 分别记为Z和X;于是,在 page to page图上的网页块级别的PageRank为 W p=X×Z;在block to block图上的BlockRank为 W b=Z×X; 已经有人实现了块级别的PageRank和HITS算法,并通过实验证明,效率和准确率都比传统的对应算法要好;2基于网页内容的网页分析算法基于网页内容的分析算法指的是利用网页内容文本、数据等资源特征进行的网页评价;网页的内容从原来的以超文本为主,发展到后来动态页面或称为Hidden Web数据为主,后者的数据量约为直接可见页面数据PIW,Publicly Indexable Web的400~500倍;另一方面,多媒体数据、Web Service等各种网络资源形式也日益丰富;因此,基于网页内容的分析算法也从原来的较为单纯的文本检索方法,发展为涵盖网页数据抽取、机器学习、数据挖掘、语义理解等多种方法的综合应用;本节根据网页数据形式的不同,将基于网页内容的分析算法,归纳以下三类:第一种针对以文本和超链接为主的无结构或结构很简单的网页;第二种针对从结构化的数据源如RDBMS动态生成的页面,其数据不能直接批量访问;第三种针对的数据界于第一和第二类数据之间,具有较好的结构,显示遵循一定模式或风格,且可以直接访问;三、小结1、网络爬虫安全性问题网络爬虫会占用网络带宽并增加Web服务器的处理开销,恶意用户甚至会利用爬虫程序对服务器发动Dos攻击;恶意用户还可能通过网络爬虫抓取各种敏感资料,主要表现在以下几个方面:1搜索目录列表:互联网中的许多Web服务器在客户端请求站点中某个没有默认页面的目录时,会返回一个目录列表;该目录列表通常包括一个描述当前目录的标题,可供用户点击的目录和文件链接,及一个脚注;因而通过抓取目录列表,恶意用户往往可获取大量有用的资料,包括站点的目录结构、敏感文件以及Web 服务器配置信息等等;2搜索测试页面、联机手册与样本程序:大多数Web 服务器软件附带了测试页面、联机手册与样本程序;这些文件往往会泄漏大量的系统信息,成为恶意用户剖析Web 服务器的工具,而且这些文件的存在也往往暗示网站的安全管理有问题,网站中存在潜在的安全漏洞;3搜索管理员登录页面:许多网络产品提供了基于Web的管理接口,允许管理员在互联网中对其进行远程管理与控制;如果管理员疏于防范,没有修改网络产品默认的管理员名及密码,一旦其管理员登录页面被恶意用户搜索到,网络安全将面临极大威胁;4 搜索互联网用户的姓名、电话、通信地址等个人信息,以便于实施社交攻击;5 搜集群发垃圾邮件所需的邮件地址;6 查找一个站点中的各种敏感文件,包括各种程序使用的配置文件、日志文件、密码文件、数据库文件等等;7 搜索Web 站点中存在缺陷的程序;8 获取互联网用户的信用卡密码,银行帐号等机密信息等等;因此,采取适当的措施限制网络爬虫的访问权限,对于保持网站的正常运行、保护用户的隐私是极其重要的;2、网络爬虫的最新发展传统的网络爬虫技术主要应用于抓取静态Web 网页,随着AJAX/Web2.0的流行,如何抓取AJAX 等动态页面成了搜索引擎急需解决的问题,因为AJAX颠覆了传统的纯HTTP 请求/响应协议机制,如果搜索引擎依旧采用“爬”的机制,是无法抓取到AJAX 页面的有效数据的;AJAX 采用了JavaScript 驱动的异步请求/响应机制,以往的爬虫们缺乏JavaScript语义上的理解,基本上无法模拟触发JavaScript的异步调用并解析返回的异步回调逻辑和内容;另外,在AJAX的应用中,JavaScript 会对DOM结构进行大量变动,甚至页面所有内容都通过JavaScript 直接从服务器端读取并动态绘制出来;这对习惯了DOM 结构相对不变的静态页面简直是无法理解的;由此可以看出,以往的爬虫是基于协议驱动的,而对于AJAX 这样的技术,所需要的爬虫引擎必须是基于事件驱动的;3、一些开源爬虫DataparkSearch是一个在GNU GPL许可下发布的爬虫搜索引擎;GNU Wget是一个在GPL许可下,使用C语言编写的命令行式的爬虫;它主要用于网络服务器和FTP服务器的镜像;Heritrix是一个互联网档案馆级的爬虫,设计的目标为对大型网络的大部分内容的定期存档快照,是使用java编写的;HTTrack用网络爬虫创建 网络站点镜像,以便离线观看;它使用C语言编写,在GPL许可下发行;ICDL Crawler是一个用C++编写,跨平台的网络爬虫;它仅仅使用空闲的CPU资源,在ICDL标准上抓取整个站点;JSpider是一个在GPL许可下发行的,高度可配置的,可定制的网络爬虫引擎; Nutch是一个使用java编写,在Apache许可下发行的爬虫;它可以用来连接Lucene的全文检索套件;。

Python网络爬虫的应用场景

Python网络爬虫的应用场景Python网络爬虫是一种自动化程序,可通过在Web上抓取和提取信息来实现数据采集和处理的目的。

由于Python的灵活性和便捷性,这种网络爬虫在各行各业中得到了广泛的应用。

本文将介绍Python网络爬虫的几个主要应用场景。

一、新闻媒体的数据采集如今,越来越多的新闻媒体机构通过网络来获取新闻和其他相关信息。

Python网络爬虫可以自动抓取各大新闻网站的新闻文章、评论和其他相关数据,帮助媒体机构快速获取并处理这些信息。

例如,利用网络爬虫可以从多个新闻网站抓取相关新闻的标题、摘要、发布时间和作者等信息,实现新闻数据的采集和整合。

二、电子商务的数据挖掘在电子商务领域,通过网络爬虫可以获取各个电商平台的商品信息、评价和销售数据。

利用Python网络爬虫可以自动抓取这些信息,并从中提取关键数据,如商品名称、价格、评价等。

这些数据可以帮助电商企业进行市场分析、竞争对手研究和商品定价策略的制定。

三、搜索引擎的数据索引网络爬虫在搜索引擎的数据索引中起着重要的作用。

搜索引擎的爬虫程序使用Python等编程语言编写,通过访问各个网站并抓取网页信息来建立索引。

爬虫根据一定的算法对网页进行排序,以便搜索引擎能够根据用户的搜索查询返回相关的结果。

搜索引擎通过网络爬虫不断更新自己的索引库,保持搜索结果的及时性和准确性。

四、金融数据的采集与分析金融行业对大量的数据进行分析和挖掘,以辅助投资决策和风险控制。

Python网络爬虫可以定期抓取金融数据,如股票价格、汇率、基金信息等,并将这些数据进行整理和分析。

通过网络爬虫获取的金融数据可以用于制定投资策略、生成报表和生成相应的图表,为金融业务提供有力的支持。

五、学术研究与数据分析Python网络爬虫在学术研究和数据分析方面有着广泛的应用。

研究人员可以利用网络爬虫从学术数据库和网站上获取相关文献、论文和研究数据。

通过爬取这些数据,研究人员可以快速收集大量的数据和信息,用于学术研究和科研项目的数据挖掘。

网络爬虫技术与数据采集

网络爬虫技术与数据采集近年来,随着信息时代的快速发展,数据的采集和处理变得愈发重要。

在这个背景下,网络爬虫技术逐渐崭露头角。

本文将探讨网络爬虫技术的基本原理、应用场景以及数据采集的重要性。

一、网络爬虫技术的基本原理1.1 网络爬虫的定义网络爬虫是一种自动化程序,能够模拟人类用户在浏览器上浏览网页的行为,从而抓取、解析、存储网络上的数据。

1.2 网络爬虫的工作流程(这里可以分小节阐述爬虫工作流程的各个环节)二、网络爬虫技术的应用2.1 信息抓取网络爬虫在信息抓取方面具有强大的能力。

通过设置合适的抓取规则和算法,可以高效地从海量的网页中提取所需数据。

比如,搜索引擎通过爬虫技术抓取网络上的网页,然后进行索引和排名,从而提供用户准确和有用的搜索结果。

2.2 商业数据分析网络爬虫在商业数据分析中也扮演着重要的角色。

许多公司通过利用爬虫技术从网络上获取相关数据,如用户评论、竞争对手信息等,来进行市场研究和竞争分析,为企业决策提供重要的数据支持。

2.3 新闻媒体新闻媒体行业也广泛应用网络爬虫技术。

通过爬虫程序实时监测各个新闻网站的更新信息,并及时抓取相关新闻,以便编辑和发布。

这样可以大大提高新闻稿件的采集效率,同时也能够及时了解和报道重要新闻事件。

三、数据采集的重要性3.1 数据驱动的决策在大数据时代,数据已经成为企业决策的重要依据之一。

正确的数据采集和分析能够提供企业决策所需的准确、全面的信息,从而指导企业战略和发展方向。

3.2 竞争优势通过合理利用网络爬虫技术进行数据采集,企业可以及时掌握市场动态、竞争对手信息等关键数据,从而研发出更具竞争力的产品和服务,赢得市场先机。

3.3 数据挖掘和机器学习数据采集是进行数据挖掘和机器学习的前提和基础。

在大数据时代,数据采集的重要性非常突出。

网络爬虫技术的应用能够帮助研究人员从庞杂的数据中发现规律和趋势,进而进行更深入的数据分析和应用。

四、总结网络爬虫技术作为一种重要的数据采集工具,具有广泛的应用前景。

基于Python的互联网数据爬取研究

基于Python的互联网数据爬取研究随着互联网的不断发展,人们获取信息的方式越来越多样化。

其中,数据爬取技术成为了互联网获取数据的重要手段之一。

在这个过程中,Python作为一种流行的编程语言,被广泛应用于数据爬取方面。

一、Python在数据爬取中的优势1.1 Python语言简单易学Python是一种易于上手的编程语言,入门门槛低,学习难度相对其他编程语言较小。

因此,很多初学者会选择Python作为入门编程语言。

1.2 Python拥有强大的数据处理能力Python在数据处理方面也有很强的表现。

Python提供了许多数据处理的库与框架,例如pandas、Numpy等库,可以帮助开发者处理大量的数据。

1.3 Python具有强大的网络爬虫框架Python在网络爬虫这一方面也有非常强的表现。

Scrapy、BeautifulSoup等著名的网络爬虫框架都是基于Python构建的。

开发者可以快速构建一些简单的爬虫,帮助获取网站上的数据。

二、Python爬虫的常见用途Python爬虫在互联网数据获取方面有着广泛的应用。

下面我们列举了一些Python爬虫常见的用途:2.1 获取各种网站上的数据结合Python中的网络爬虫框架,可以获取各种网站上的数据,如商品信息、新闻信息、外汇信息、股票数据等等。

2.2 分析竞争对手信息Python爬虫可以帮助企业分析竞争对手的信息,了解对手的网站信息、广告投放、产品定位等,从而给企业提供灵感。

2.3 数据科学与机器学习的数据采集在数据科学与机器学习方面,Python爬虫可以用于获取需要的数据。

例如,淘宝商品信息爬取用于商品推荐,或者从天气预报网站中获取历史气象数据训练并评估预测模型。

三、爬虫相关注意事项3.1 尊重网站的robots.txt文件一个网站的robots.txt文件是指令文件,其作用是告诉爬虫哪些内容应该被抓取,哪些内容不应该被抓取。

因此,在构建爬虫时,一定要尊重网站的robots.txt文件避免逆袭法律。

毕业论文 爬虫

毕业论文爬虫近年来,随着互联网的快速发展,网络数据的获取和处理成为了一个重要的研究领域。

在这个背景下,爬虫技术作为一种自动化获取网络数据的工具,被广泛应用于各个领域。

本文将探讨毕业论文中关于爬虫技术的研究和应用。

首先,我们需要明确什么是爬虫技术。

爬虫技术,又称网络爬虫、网络蜘蛛,是一种模拟浏览器行为,自动化获取互联网数据的技术。

通过编写程序,爬虫可以自动访问网页,提取所需信息,并将其存储或进一步处理。

爬虫技术的核心是对网页的解析和数据的提取,因此对HTML、CSS、JavaScript等前端技术的理解是必不可少的。

在毕业论文中,爬虫技术可以应用于各个领域。

举个例子,我们可以以电商数据分析为研究对象。

通过爬虫技术,我们可以自动抓取电商网站上的商品信息、价格、评论等数据,并进行整理和分析。

这样的研究可以帮助电商平台优化商品推荐算法,提高用户购物体验。

同时,也可以为消费者提供更准确的商品信息,帮助他们做出更明智的购买决策。

此外,爬虫技术还可以应用于舆情监测和情感分析。

通过爬虫技术,我们可以自动抓取新闻网站、社交媒体等平台上的用户评论、新闻报道等信息,对舆情进行监测和分析。

这对于政府、企业等机构来说,可以及时了解公众对于某一事件或产品的态度和情感倾向,从而做出相应的决策和调整。

除了上述应用,爬虫技术还可以用于学术研究。

例如,我们可以利用爬虫技术获取学术论文数据库中的论文信息,并进行数据分析和挖掘。

这样的研究可以帮助学者们了解某一领域的研究热点、学术合作网络等情况,为他们的研究提供参考和指导。

然而,我们也要认识到爬虫技术的合法性和道德性问题。

在使用爬虫技术时,我们需要遵守相关的法律法规,尊重网站的使用规则,不进行恶意攻击和侵犯隐私的行为。

此外,我们也需要考虑到爬虫行为对网站服务器的负载和流量的影响,避免给网站带来过大的压力。

在毕业论文中,我们可以对爬虫技术进行深入研究和创新。

例如,我们可以探索如何提高爬虫的效率和稳定性,如何应对网站的反爬虫机制等问题。

互联网行业中的网络爬虫技术的应用场景

互联网行业中的网络爬虫技术的应用场景互联网的快速发展和数据爆炸式增长带来了前所未有的信息获取难题,同时也为网络爬虫技术的兴起提供了广阔的应用场景。

网络爬虫技术是一种通过自动化程序访问互联网并提取相关信息的技术,它不仅可以帮助企业快速获取大量有效数据,还能够为用户提供高质量的信息服务。

下面将介绍互联网行业中网络爬虫技术的几个主要应用场景。

1. 搜索引擎搜索引擎是互联网用户访问和获取信息的主要入口,而网络爬虫技术是搜索引擎运行的基础。

网络爬虫通过自动访问和抓取互联网上的网页,构建海量的网页索引,为用户提供快速、准确的搜索结果。

通过分析网页的关键词、链接结构等信息,搜索引擎可以为用户推荐相关度高的网页。

同时,网络爬虫还可以定期更新索引,确保搜索引擎中的信息保持最新。

2. 数据挖掘与商业智能在互联网上,各种类型的数据不断涌现,这些数据蕴含着丰富的商业价值。

通过网络爬虫技术,企业可以自动化地收集和提取互联网上与其业务相关的数据,如产品价格、用户评价、竞争对手动向等。

通过对这些数据的分析和挖掘,企业可以获取市场趋势、用户需求、竞争对手情报等重要信息,从而指导业务决策和制定营销策略。

3. 垂直搜索与信息聚合除了综合性的搜索引擎,垂直搜索引擎和信息聚合网站也是互联网用户获取特定领域信息的重要途径。

垂直搜索引擎通过网络爬虫技术,在特定领域的网站中提取相关内容,为用户提供更专业化、精准的搜索结果。

例如,房产垂直搜索引擎可以从各大房产网站中抓取房源信息,为用户提供更便捷的房屋查询工具。

信息聚合网站也依赖网络爬虫技术,从各大新闻网站、博客等媒体中抓取新闻资讯等信息,并将其汇总成一个平台,供用户整体浏览。

4. 金融行业数据分析网络爬虫技术在金融行业中也有重要应用。

投资者和资产管理人员需要及时获取大量股票、债券和其他相关金融数据来做出决策。

网络爬虫技术可以帮助金融机构抓取交易所、金融新闻网站等数据来源中的信息,进行分析和预测,提供决策支持。

举例说明爬虫技术的应用场景

举例说明爬虫技术的应用场景

1. 搜索引擎:百度,谷歌等搜索引擎使用爬虫技术收集网络上所有的数据,再根据搜索关键词进行搜索,展示搜索结果页面。

2. 商品价格比较:比价网站通过爬虫爬取电商网站的商品信息,将同一种产品在不同商家的价格进行比较,为消费者提供最合适的购买选择。

3. 数据分析:爬虫可以收集社交媒体,交易信息、新闻报道以及其他有用数据进行分析,推算出市场趋势、用户满意度等市场分析报告。

4. 信息采集:政府机构或者舆情监测需要大量的信息搜集,爬虫技术可以让这个程序更快速地搜集相关信息,辅助政策决策。

5. 竞品监控:电商平台常用的商家也会通过爬虫将整个电商中销售最好的产品,评论区反馈和用户编码进行竞品监控,了解用户需求和市场变化。

6. 舆情监测:政府机构或企业常常需要对舆论进行监测。

爬虫可以帮助采集所有社交媒体、时事新闻、博客文章、讨论和评论等文本数据,分析全民态度和形势变化。

7. 程序测试:在软件开发中,爬虫的数据提供可以用于测试、效果判断和反馈,而且这种校准方式相比手动校准更加快捷高效。

8. 智能问答:通过爬虫技术对外部网络信息源进行收集和分析,自然语言理解与语法基础相结合,建立精准的数据集,提高智能问答、机器翻译等应用的精准性和效率。

基于Python的网络爬虫技术在新媒体数据分析中的应用研究

基于Python的网络爬虫技术在新媒体数据分析中的应用研究一、引言随着互联网的快速发展,新媒体平台如雨后春笋般涌现,海量的数据在这些平台上产生并传播。

如何高效地获取和分析这些数据成为了新媒体从业者关注的焦点之一。

网络爬虫技术作为一种自动化数据获取工具,在新媒体数据分析中发挥着重要作用。

本文将探讨基于Python的网络爬虫技术在新媒体数据分析中的应用研究。

二、网络爬虫技术概述网络爬虫是一种按照一定规则自动地抓取互联网信息的程序或脚本。

通过模拟人类用户访问网页的行为,网络爬虫可以获取网页上的各种信息,并将其保存下来供后续分析使用。

Python作为一种简洁而强大的编程语言,拥有丰富的网络爬虫库,如BeautifulSoup、Scrapy 等,使得开发网络爬虫变得更加高效和便捷。

三、新媒体数据分析需求新媒体平台上产生的海量数据包含了用户行为、内容传播、舆情监测等多方面信息,对这些数据进行分析可以帮助从业者更好地了解用户需求、优化内容策略、提升营销效果等。

然而,手动收集和整理这些数据是一项繁琐且耗时的工作,而网络爬虫技术可以帮助我们自动化这一过程,提高工作效率。

四、基于Python的网络爬虫技术在新媒体数据分析中的应用1. 数据采集利用Python编写的网络爬虫程序可以访问新媒体平台上的页面,抓取所需的数据,如文章内容、评论信息、用户行为等。

通过设定合适的规则和筛选条件,可以实现有针对性地采集目标数据。

2. 数据清洗从网页上抓取下来的数据往往杂乱无章,包含大量无关信息,需要经过清洗和处理才能变得有用。

Python提供了丰富的数据处理库,如Pandas、NumPy等,可以帮助我们对采集到的数据进行清洗和整理,使其符合分析需求。

3. 数据分析清洗完毕的数据可以进行进一步的分析。

利用Python强大的数据分析库,如Matplotlib、Seaborn等,可以对数据进行可视化展示,发现其中隐藏的规律和趋势。

通过对用户行为、内容传播路径等方面进行深入分析,可以为新媒体从业者提供决策支持。

Python网络爬虫的数据爬取与社交媒体分析案例

Python网络爬虫的数据爬取与社交媒体分析案例在当今信息爆炸的时代,社交媒体成为人们获取信息、交流互动的重要平台。

对于企业和个人而言,了解社交媒体上的舆情和用户需求变得至关重要。

而Python网络爬虫作为一种高效、灵活的数据获取工具,被广泛应用于社交媒体数据爬取与分析。

本文将围绕Python网络爬虫的数据爬取与社交媒体分析展开,以一个实际案例为例,介绍爬取社交媒体数据的步骤和常用工具,并通过数据分析展示其应用的效果。

一、案例背景介绍我们假设是一家手机厂商,为了了解市场上消费者对我们产品的评价和需求,需要收集社交媒体上关于我们产品的数据进行分析。

通过分析这些数据,我们可以获取用户对产品的喜好、评价,了解竞争对手的产品情况以及挖掘用户的需求。

二、数据爬取为了获取社交媒体上的数据,我们需要使用Python编写网络爬虫程序。

Python提供了一系列强大的爬虫库,如BeautifulSoup、Scrapy等,可以帮助我们实现数据的抓取和解析。

首先,我们需要选择目标社交媒体平台。

常见的社交媒体平台有Twitter、Facebook、Instagram等。

每个平台都有相应的API接口可以使用,但请注意遵守平台的使用规定和法律法规。

以Twitter为例,我们可以通过Twitter的API获取用户信息、推文、话题等数据。

其次,我们需要构建爬虫程序,设置好数据获取的目标和参数。

可以使用Python的requests库发送网络请求,获取HTML页面的源代码。

然后,使用BeautifulSoup等库解析源代码,提取出需要的数据。

对于Twitter这样的平台,我们可以通过API获取JSON格式的数据,然后使用Python的json库解析JSON数据。

三、数据清洗和整理获取到原始数据后,我们需要进行数据的清洗和整理,以便进一步进行分析。

首先,我们需要去除重复的数据和噪声数据。

可以使用Python的pandas库对数据进行去重处理,并使用正则表达式来删去不需要的特殊字符或噪声数据。

基于深度学习的网络爬虫技术在大数据分析中的应用研究

基于深度学习的网络爬虫技术在大数据分析中的应用研究在当今互联网时代,人们在生产和生活中所接触到的数据量越来越大,如何有效地利用这些数据对经济和社会发展做出贡献,是摆在我们面前的一个巨大挑战。

而基于深度学习的网络爬虫技术,已经成为大数据分析领域中应用最广泛和效果最好的技术之一。

一、深度学习网络爬虫技术的原理深度学习网络爬虫技术是通过模拟人类的搜索方式,通过深度学习技术识别网站中的信息,并将其存储到数据库中。

其原理是通过数据的训练和学习,实现自动提取网站中的信息。

具体而言,深度学习网络爬虫技术通过两个主要步骤实现数据的抓取。

首先,需要收集与目标网站相关的信息,例如网站页面的结构、元素的属性和链接等。

其次,利用深度学习算法实现数据的提取,主要是通过对页面中的内容进行识别和分类。

这样就可以提取出所有符合要求的信息,并将其按照一定的规则保存到数据库中。

二、深度学习网络爬虫技术在大数据分析中的应用深度学习网络爬虫技术在大数据分析中具有广泛的应用前景,并已经被广泛应用于各个领域,例如金融、医疗、教育等。

主要应用如下:1. 情感分析深度学习网络爬虫技术可以自动爬取社交媒体内容、电商评论等有关大众情感的数据,并通过其情感识别模型进行分析和挖掘,得出人们对某个产品或服务的态度和观点,这对于企业营销决策具有重要意义。

2. 产品推荐深度学习网络爬虫技术可以爬取大量的产品信息数据,并使用机器学习技术进行数据分析,以提高推荐的精准度。

这使得企业能够更好地为客户提供个性化的产品推荐服务,从而提高客户满意度和忠诚度。

3. 健康管理深度学习网络爬虫技术可以爬取医学文献、病历记录等大量的医学数据,并使用自然语言处理技术对其进行分析和挖掘,从而为病人和医生提供更好的健康管理服务。

4. 舆情监测深度学习网络爬虫技术可以爬取新闻、博客、微博等大量的社会公共事件信息,并利用机器学习技术进行情感分析和事件跟踪,为政府、企业等提供重要的决策参考。

网络爬虫 毕业论文

网络爬虫毕业论文网络爬虫:数据挖掘的利器随着互联网的迅猛发展,我们进入了一个信息爆炸的时代。

海量的数据涌入我们的生活,如何从这些数据中获取有用的信息成为了一个重要的问题。

在这个背景下,网络爬虫应运而生,成为了数据挖掘的利器。

一、网络爬虫的定义和原理网络爬虫,顾名思义,就是像蜘蛛一样在网络上爬行,自动地从网页中提取信息。

它的工作原理可以简单地概括为以下几个步骤:首先,爬虫会从一个起始网页开始,通过解析网页中的链接找到其他网页;然后,它会递归地访问这些链接,进一步抓取网页;最后,爬虫会将抓取到的网页进行处理,提取出所需的信息。

二、网络爬虫的应用领域网络爬虫在各个领域都有广泛的应用。

在搜索引擎领域,爬虫是搜索引擎的核心组成部分,它通过抓取网页并建立索引,为用户提供准确、全面的搜索结果。

在电子商务领域,爬虫可以用来抓取商品信息,帮助企业了解市场动态和竞争对手的情况。

在金融领域,爬虫可以用来抓取股票、基金等金融数据,为投资者提供决策依据。

此外,爬虫还可以应用于舆情监测、航空订票、房产信息等领域。

三、网络爬虫的技术挑战尽管网络爬虫在各个领域都有广泛的应用,但是它也面临着一些技术挑战。

首先,网络爬虫需要解决网页的反爬虫机制,如验证码、IP封锁等,以确保能够正常抓取数据。

其次,网络爬虫还需要处理大规模数据的存储和处理问题,以确保抓取的数据能够高效地被利用。

此外,网络爬虫还需要解决网页结构的变化和网页内容的多样性等问题,以确保能够准确地提取所需信息。

四、网络爬虫的伦理问题随着网络爬虫的应用越来越广泛,一些伦理问题也逐渐浮现出来。

首先,网络爬虫可能会侵犯个人隐私,特别是在抓取个人信息时需要注意保护用户的隐私权。

其次,网络爬虫可能会对网站的正常运行造成影响,如过于频繁地访问网站可能会导致网站崩溃。

因此,在使用网络爬虫时,需要遵守相关的法律法规和伦理规范,确保合法、合理地使用爬虫工具。

五、网络爬虫的未来发展随着人工智能和大数据技术的不断发展,网络爬虫在未来还将有更广阔的应用前景。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

©-E福建电脑U JIA N C O M P U T E RD01:10.16707/ki.fjpc.2017.07.002面向新媒体的爬虫搜索技术研究吴美茜,崔宗敏,喻静(九江学院信息科学与技术学院江西九江332005)【摘要】近年来,随着网络技术的发展,新媒体迅速发展,已成为信息共享和传播的重要平台。

如何从海量的新媒体 数据中爬取出令人感兴趣的信息就成为了当前研究的热点之一e本文论述的是面向新媒体的爬虫搜索技术。

首先,使用 Python语言制作一个简单高效的网络爬虫抓取人们感兴趣的内容如:微信公众号、微博、新闻等。

接着将爬取的数据导入 数据分析平台进行分析。

【关键词】结构方程;大数据;新媒体1引言随着移动电子设备和网络技术的高速发展,新媒体发展迅 速,已经融入到学习、娱乐、生活的方方面面[1]。

因此,从海量的 新媒体数据中爬取出令人感兴趣的信息就成为了当前研究的热点之—2研究背景厲_外从二十世纪九十尔代开始就对网络爬虫的进行了很多研究[3,~现在的网络爬虫技术已经十分成熟t5,%网络上比 较著名的开源爬虫苻Nutch,Larbin和Heritrix[7,l网络爬虫最重 要的是M贞爬取策略和N贞信总分析策略[9]。

随着Python语言的广泛使用,使用Python语言开发的网 络爬虫也引起了网内外学苕的广泛关注111)1。

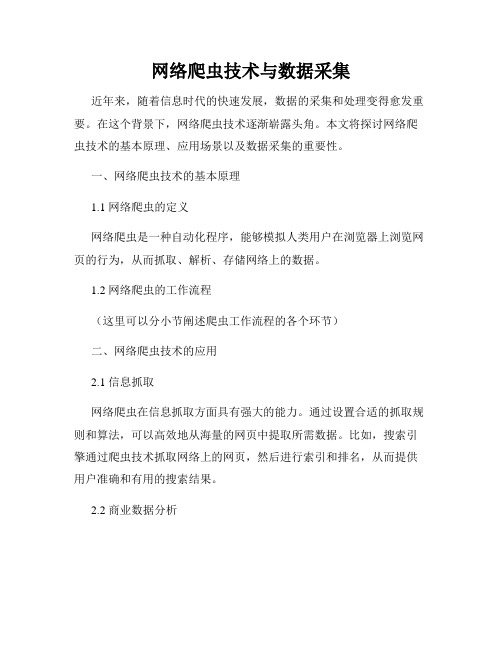

3网络爬虫3.1爬虫架构f f先,侖一个网络爬虫的调度器,对爬虫的进程进行控制。

网页符理器:对统一资源定位符(URL)列表进行插入和删 除等操作u网页下载器:将指定的U RL页面全部K载K来。

网页解析器:利川N页卜戗器卜'载K来的网页宁•符小数据 解析出关键字相关的有价值的数据和指向其他网页的统一资源定位符。

统一资源定位符被解析出来之/r7可以传给M页宵理 器进行统一资源定位符的统一管理。

本网络爬虫工作流程图如下I图1工作流程图3.2总体设计本论文的网络爬虫要实现的总体功能:1.设汁战于Python语言的网络爬虫。

2.使顧BeautifulSoup这个Pythoft第三方包的模块解析网页,将其中的统一资源定位符和与关键字匹配的倍总捉取出来®3. 从目标链接出发,获取该链接网页丨:的所脊链接沖添加 到U RL管理器屮。

再从U RL符理器屮获取一个新的统一资源定位符。

重复以上步骤。

总而言之,爬虫程序根据目标URL地址,抓取N苋扑提取U R L返冋到Python的set()集合屮。

网络爬虫代码文件构成(如图2):S baike_spider- [C:\U5e rs\S iia\P ych iF ile E d it V iew N avigate Code R dbaike sp id&r x in li spider ■F P r o je c t▼G) +祭-baike_spider C:\U5e r5\M H S\Pyc*»h tm ljdow nloader.py1h tm l_outp uter,p yhtm ljp ar&er.pyI-1outp uthtm l二 5pider__m a in.p y**u r l_m anager.pylll l l E x te rn a l L ib raries图2文件构成图详细流程:第一步:从sp id e im a in.p y开始运行爬虫,这是爬虫的主调度类,可修改起始U R L的内容。

第二步:调用 html_downlader.py 下载隨Ifn第二步:调用html_parser.py解析网衷,将解析出来的URL通过调用url_manager.py的方法添加进待爬取或已爬取的列表。

将解析出来的内养伟给html_outputer.py。

笫叫步:当U R L列农屮还乜待爬取的URL或爬取的网真数小于3000时对以上两步进行循环。

第五步:调用 html_downloader.py 和 html_outputer.py 将与主题相关的信总K载并存储入数据痄。

各个类分析:SpiderMain类:该类是爬虫程序的主调度类,接收爬虫的致谢:本课题得到江西省教育科学“十三五”规划2016年度课题(N a:16Y B143),江西省社会科学“十三五”(2016年)规划项目:(N〇.16JY19) 和江西省高等学校教学改革研究课题(N o.J XJG-16 -17-?)的资助&福建电脑JIA N C O M P U T E R入URL 、设置爬取网页的数量,调用其他类的功能。

UrlManager 类:该类是U RL 管理器的作用,用两个集合set 〇保存已经爬取的U RL 和待爬取的URL (Python 中的set ()可以 自动去除重复的URL ),并将不在两个Set 〇中的URL 添加进待 爬取的U R L 列表。

.HtmlDownloader 类:将网页下载下来。

HtmlParser ..类i .使用BeautifulSoup 模块解析下载下来的字. 符串文档,提取新的URL ,并提取目标信息相关的内容。

HtmlOutputef 类:输出到数据库网络爬虫各个类之间的关系图(如图3):图3各个类的关系图3.3详细设计3.3.1网页下载、管理模块的设计网實下载模块:使用Urllib2的urlopen ()方法获取网賞信 息,为提高爬取成功概率,添加一'个header :header = {"Aeeept"i ^text /litm ^application /xhtml +xm ^appli - eation /xml ;q =0.9,*/*;q =0.8",M A 〇cept -Encoding 11: "gzip , deflate ”, w Accept.-Language ” : ''zh -C l f ;q =0.8,q =0.5,en ;q =0.3",” C on :n :e e:tion *’:*' keep -alive ”,"Host ": "weixin .sogou .com ","Referer ": "http ://weixiii .sagou .com/weixinfquery =%E 5%BF %83%E 7%90%86&type =2&page =l &ie =utf 8&p = 01030402&dp =l «,''User -Agent '*! "Mozilla /5.0 (Windows NT 6.2;WOW 64; rv :45.0) Gecko /20100101 Fifefox /45.0")#发送请求requests = urllib 2.Request (url , header =header )#获取内容html = urllib2.urlopen (requests ).read ()网页管理模块:1•保存待爬取和已爬取的URL 列表,采用Python 自带的 setG 集合,其具有去重的功能。

def —init _(self ): self .new _urls=setQ self . o ld _urls =set ()2.判断待爬取的U RL 列表是否为空,这可以作为爬虫循环的一个终止条件。

def has _new _url (self ):return len (self .new _urls ) ! =03. 插入新的URL 或URL 列表。

def add _new _url (self , url ):if url is None : returnif url not in self .new_urls and url not in self .old _urls : self • n ew—urls • a dd (url ) def add _new _urls (self , urls ):if urls is None or len (urls ) 〇:return for url in urls :self • a dd —new _url (url )4.获取一个待爬取的URL 。

def get _new _url (self ):new_url = self .new _urls .pop () self . o ld_urls • a dd (new —url ) return new_url3.3.2网页解析模块的详細设计网页解析模块主要是使用BS 4库的BeautifulSoup 进行解析。

1. 创建一个Soup 对象soup = BeautifulSoup (html _cont ,’htmLparser ’,from _encod - ing =litf -8’)2. 解析出URLdef _get _new_urls (self ,page _url , s oup ): new_urls = set ()links = soup .find_allhref = pile (rf ,/viewAd +\.htm ”))for link in links :new_url = link [’href ’]new _full_url = parse .urlparse.urljoin (page _url ,new _urls . a dd (new _full _url ) return new_urls 3.解析出价值数据def _get _new _data (self ? page _url , soup ): res_data = {}#urlres—data [’url ’] = page—url#<dd class = ”lemmaWgt -lemmaTitle -title ”> <h l >新媒体</ h l >title_node = soup .find (^divy 9 class _=M lemmaWgt -lemmaTi -tle -titleM ).find (M h l M)res_data [’title ’] = title —node .get _text ()# <div class = "lemma —summary ” label —module = "lemma —Summary M >summary_node = soup.find (^divx ,class _= n lemma —summa —ry”)res _data [x summary ^] = summary _node .get _text () return res—data3.3.3数据输出模块的详细设计数据输出到数据库使用的是sqlite 3库:import sqlite 31•打开数据库conn = sqlite 3.connect (lest .db y ) print ("Opened database successfully ")2.添加数据 try :conri .cxc 〇L tlc("INSERT INTO COMPANY (1D ?NAME ,con tent ) VALUES (null /%s ^/%s 〇"%(b ,a ))conn .commit ()《下转第54 页)■E l 福建电脑IA N COMPUTER(1〉大力开展校企合作,将学由送出去进行毕业设计闺前师儀类高:校的知识体系和教师敢实瞻技术水平对乎塔养学生的创新设计能力仍有一定的局限性。