信息论与编码 曹雪芹 Chap5

信息论与编码 曹雪虹 PPT 第第5章

信息论基础B

35

5.2 无失真信源编码

编码效率为

H(X .811比特 二元码符号 比特/二元码符号 = 比特

信息论基础B

7

5.1 编码的定义

如图5-1所示,如果信源输出符号序列长度L=1,信源 符号集A(a1,a2,…,an) 信源概率空间为

X a1 = P p(a1 )

a2 L an p ( a 2 ) L p ( an )

若将信源X通过二元信道传输 , 若将信源 通过二元信道传输, 就必须把信源符 通过二元信道传输 变换成由0, 符号组成的码符号序列 符号组成的码符号序列, 号 ai 变换成由 , 1符号组成的码符号序列 , 这个 过程就是信源编码

2

= 0.4715(bit ) 2

0.4715 (0.96) 7 L≥ • =4.13 × 10 -5 2 2 (0.811) 0.04 × 10

信息论基础B

41

2

5.2 无失真信源编码

能获得最佳码的编码方法主要有: 香农(Shannon) 费诺(Fano) 哈夫曼(Huffman)等

信息论基础B

信息论基础B

8

5.1 编码的定义

不同的码符号序列,如表5-1所示。

信源符 号ai a1 a2 a3 a4 信源符号出 现概率p(ai) p(a1) p(a2) p(a3) p(a4) 码表 码1 00 01 10 11 码2 0 01 001 111

表5-1 变长码与定长码

信息论与编码

滨江学院《信息论与编码》课程论文题目阐述信息论院系电子工程系专业班级12通信3 班学生姓名学号教师杨玲成绩二O一四年十二月二十二日阐述信息论20122334942摘要:本文介绍了信息论的基础探究,通过本文可以让读者更好的去了解信息论的发展历史和应用。

现代社会是一个充满信息的世界,没有信息的世界是混乱的世界。

因而信息十分重要,随着社会信息化进程的加速,人们对信息的依赖程度会越来越高。

所以关于信息的研究——信息论也因运而生。

提到信息论就不得不提一个人——香农,他为信息论的发展做出了巨大的贡献。

信息论的主要基本理论包括:信息的定义和度量;各类离散信源和连续信源的信源熵;有记忆、无记忆离散和连续信道的信道容量;无失真信源编码和限失真信源编码定理等。

关键词:信息,信源,信源熵,信道容量、信源编码引言现代社会是一个充满信息的世界,没有信息的世界是混乱的世界。

因而信息十分重要,随着社会信息化进程的加速,人们对信息的依赖程度会越来越高。

结合所学知识和查阅相关书籍本文简要介绍了信息论的发展、和主要的几个基础理论,让人们更好的去了解信息论这门课程。

一、信息论的发展过程信息论理论基础的建立,一般来说开始于香农(C.E.Shannon)在研究通信系统时所发表的论文。

随着研究的深入与发展,信息论有了更为宽广的内容。

信息在早些时期的定义是由奈奎斯特(H.Nyquist)和哈特利(L.V.R.Hartley)在20世纪20年代提出来的。

香农被称为是“信息论之父”。

人们通常将香农于1948年10月发表于《贝尔系统技术学报》上的论文《A Mathematical Theory of Communication》(通信的数学理论)作为现代信息论研究的开端。

这一文章部分基于哈里·奈奎斯特和拉尔夫·哈特利先前的成果。

后来其他科学家维纳、朗格等科学家又对信息理论作出了更加深入的探讨。

使得信息论到现在形成了一套比较完整的理论体系。

信息论与编码习题答案-曹雪虹

3-14

信源 符号 xi x1 x2 x3 x4 x5 x6 x7

符号概 率 pi 1/3 1/3 1/9 1/9 1/27 1/27 1/27 1/3 1/3 1/9 1/9 2/27 1/27 1/3 1/3 1/9 1/9 1/9

编码过程

编码 1/3 1/3 1/3 2/3 1/3 00 01 100 101 111 1100 1101

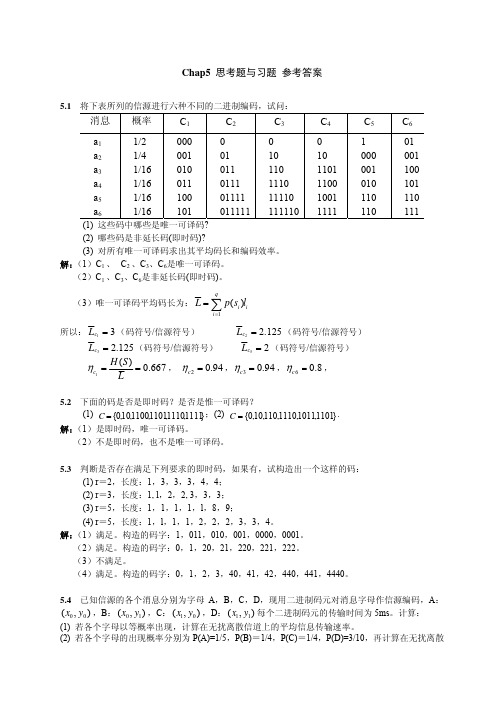

得p0p1p223当p0或p1时信源熵为0第三章无失真信源编码31321因为abcd四个字母每个字母用两个码每个码为05ms所以每个字母用10ms当信源等概率分布时信源熵为hxlog42平均信息传递速率为2信源熵为hx0198bitms198bitsbitms200bits33与上题相同351hu12log2?14log4?18log8?116log16?132log32?164log64?1128log128?1128log128?1984111111112481632641281282每个信源使用3个二进制符号出现0的次数为出现1的次数为p0p134相应的香农编码信源符号xix1x2x3x4x5x6x7x8符号概率pi12141811613216411281128累加概率pi00507508750938096909840992logpxi12345677码长ki12345677码字010110111011110111110111111011111110相应的费诺码信源符号概符号xi率pix1x2x3x4x5x6x7x812141811613216411281128111第一次分组0第二次分组0第三次分组0第四次分组0第五次分组011第六次分组01第七次分组01二元码0101101110111101111101111110111111105香农码和费诺码相同平均码长为编码效率为

信息论与编码-曹雪虹-课件第1章

信息论

一门应用概率论、随机过程、数理统计 和近代代数的方法,来研究信息传输、 提取和处理系统中一般规律的学科。

信息论是在信息可以量度的基础上,研究有 效地和可靠地传递信息的科学,它涉及信息 量度、信息特性、信息传输速率、信道容 量、干扰对信息传输的影响等方面的知识

30

信息

是事物运动状态或存在方式的不确定性的描

香农定义的信息也有其局限性,存在一些缺陷 定义的出发点是假定事物状态可以用一个以 经典集合论为基础的概率模型来描述。 没有考虑收信者的主观特性和主观意义,也 撇开了信息的具体含意、具体用途、重要程 度和引起后果等因素。

36

37

狭义信息论:

主要研究信息的测度、信道容量以及信源和信 道编码理论等问题。

接收者在收到信息之前,对它的内容是不知道的, 所以,信息是新知识、新内容;

信息是能使认识主体对某一事物的未知性或不确 定性减少的有用知识;

信息可以产生,也可以消失,同时信息可以被携 带、贮存及处理;

信息是可以量度的,信息量有多少的差别

32

例:气象预报 甲

乙

• “甲地晴”比“乙地晴”的不确定性来的 小

第一层:通信符号如何精确传输?(技术问题)

第二层:传输的符号如何精确携带所需要的含义? (语义问题)

第三层:所接收的含义如何以所需要的方式有效 地影响行为?(效用问题)

Weaver认为仙农的工作属于第一层,但他又证明 仙农的工作是交叉的,对第二、三层也有意义。

信息是认识主体(人、生物、机器) 所感受的和所表达的事物运动的状态和运 动状态变化的方式。

把广义信息分成三个基本层次,即语法 信息,语义信息,语用信息,分别反映事 物运动状态及其变化方式的外在形式、内 在含义和效用价值。

信息论与编码(第二版)曹雪虹(最全版本)答案精编版

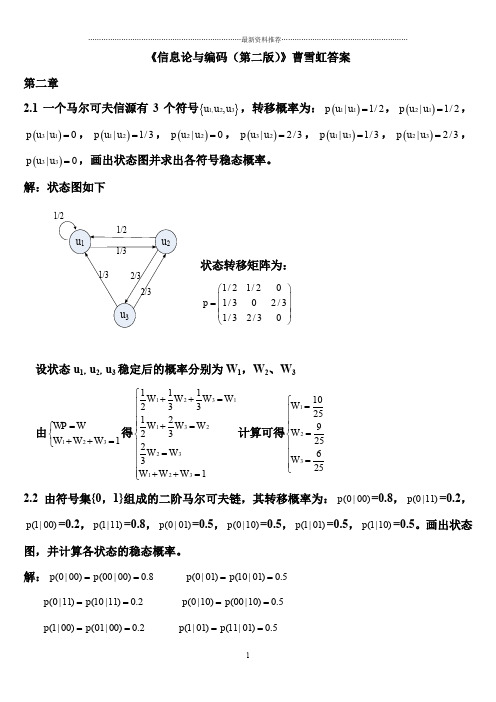

《信息论与编码(第二版)》曹雪虹答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p ==u 1u 2u 31/21/21/32/32/31/3(1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:000110110.80.20.50.50.50.50.20.8设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码(第三版)

8

的倒对数x的i的某不一确函定数性。可表示为先验概率p(xi) (4)自信息

(5)互信息

I (ai )

log

1 P(ai )

先验I 的(ai不;b确j ) 定 l性og减P去(1a尚i ) 存lo的g不p(确a1i定bj性) 。

后发验送概端率发p(的ai是|abi的j)概:率接。收端收到消息bj后而

信宿:信息归宿之意,亦即收信者或用户, 是信息传送的终点或目的地。

信道:传输信息的物理媒介。

13

信源编码器与译码器

信源编码器

通过信源编码可以压缩信源的冗余度,以提高通 信系统传输消息的效率。

信源编码器分为两类

无失真信源编码:适用于离散信源或数字信号;

限失真信源编码:用于连续信源或模拟信号,如 语音、图像等信号的数字处理。

信息论与编码 计算器

简介

是一门应用概率论、随机过程、数理统计和 近代代数的方法,来研究信息传输、提取和处 理中一般规律的学科。

奠基人:美国数学家香农(C.E.Shannon) 1948年“通信的数学理论”

2

简介

信息论的基本问题—信息的度量 无失真信源编码定理—香农第一定理 信道编码定理—香农第二定理 信源编码、信道编码

1)离散信源

特点:输出单符号消息。符号集的取值A:{a1,a2,…,aq} 是有限的或可数的,可用离散型随机变量X描述。

数学模型:设每个信源符号ai出现的(先验)概率p(ai)

(i=1,2,…,q) 满足:

q

p(ai ) 1

i 1

则:

X P(x)

a1 P(a1 )

简史 现代信息论是从20世纪20年代奈奎斯特和哈特莱的工 Nhomakorabea开始的:

信息论与编码ppt

人们对客观世界运动规律 和存在状态的认识结果

信息 传递 信息 获取

信息处理—再生 信息处理 再生

信息 传递

外部世界 问题/ 问题/环境

信息运动过程

信息 施用

二、信息论的形成和发展 信息论的形成和发展

信息论的奠基人是谁? 信息论的奠基人是谁?信息论的开创文 章是什么? 章是什么? 编码理论的开创文章是什么? 编码理论的开创文章是什么? 香龙的三大定理是什么? 香龙的三大定理是什么?

3

注意事项

1、实行请假制度 、 2、保持课堂纪律 、 3、欢迎提出反馈意见 、

4

学习方法

本课程以概率论为基础,数学推导较多, 本课程以概率论为基础,数学推导较多,学习 时主要把注意力集中到概念的理解上, 概念的理解上 时主要把注意力集中到概念的理解上,不过分 追求数学细节的推导。 追求数学细节的推导。学习时一定要从始至终 注意基本概念的理解,不断加深概念的把握。 注意基本概念的理解,不断加深概念的把握。 学习时注意理解各个概念的“用处” 学习时注意理解各个概念的“用处”,结合其 他课程理解它的意义, 他课程理解它的意义,而不要把它当作数学课 来学习,提倡独立思考, 来学习,提倡独立思考,注重思考在学习中的 重要性。 重要性

在通信系统中形式上传输的是消息,但实质上传输的是信息 在通信系统中形式上传输的是消息 但实质上传输的是信息

什么叫数据? 什么叫数据?

载有信息的可观测、可传输、 载有信息的可观测、可传输、可存储及可 处理的信号均称为数据。 处理的信号均称为数据。

17

4.信息的分类 信息的分类

语义信息:事物运动状态及方式的具体含义, 语义信息:事物运动状态及方式的具体含义, 研究信息的主体含义。 研究信息的主体含义。 语法信息:事物的状态和状态改变方式本身。 语法信息:事物的状态和状态改变方式本身。 研究事物运动出现的各种可能状态和这些状态 之间的联系。是抽象的。 之间的联系。是抽象的。(各种信息要素出现 的可能性及各要素之间的相互关系)。 的可能性及各要素之间的相互关系)。 语用信息:事物运动状态、 语用信息:事物运动状态、方式及其含义对观 察者的效用,研究信息客观价值。 察者的效用,研究信息客观价值。

信息论与编码(第三版)

信息熵H(X)表征了变量X的随机性。

3.3 信息熵的基本性质

信息熵是信源概率空间的一种特殊函数。这个函数的取 值大小,与信源的符号数及其概率分布有关。

用概率矢量P来表示概率分布P(x):

当时 r : = H (X ) 2 E lo p ( 1 a g i) i q 1p (a i)lo p (a g i)

H r(X)H (X)/lorg

熵的含义

熵是从整个集合的统计特性来考虑的,它从平均意 义上来表征信源的总体特征。

信源输出前,熵H(X)表示信源的平均不确定性;

N

P (x i) P (a i1 a i2 ,.a i .N ) . , P (a ik ),ik ( 1 ,2 ,.q ) ..,

k 1

N维随机矢量的一个取值, i=(ai1 ai2…aiN)

P(aik)是符号集A的一维 概率分布

3)离散无记忆信源的N次扩展信源

若X为离散无记忆信源: P X (x) P ( a a 1 1 )

通信的实质?

即:传递信息,消除不确定性。

2.2.2 信息熵

对一个信源发出不同消息所含有的信息量也不同。所以 自信息I(ai)是一个随机变量,不能用它来作为整个信源 的信息测度。

信息熵:自信息的数学期望,平均自信息量Hr(X):

H r(X )E lo rp g (1 a i) i q 1p(a i)lo rp g (a i) r进制单位/符号

简介

是一门应用概率论、随机过程、数理统计和近 代代数的方法,来研究信息传输、提取和处理 中一般规律的学科。

奠基人:美国数学家香农(C.E.Shannon) 1948年“通信的数学理论”

信息理论与编码第5章

2.唯一可译性 定义2 若一个分组码的任意一串有限长码序列,只能唯一

地分割一个个的码字,则称为唯一可译码。 唯一可译码又称为单义码。 例 分组码为: s1→1 s2→10 s3→11 s1s1 →11 ,s3→11, s1s1 与 s3 不是一一对应的。

s2 s3 s1… 10 111 …. s2 s1 s1 s1 … s2 s1 s3 …

5.1 信源编码器

信源

编码器

信道

码表

1. 信源的符号集和符号序列

1°信源符号集

信源发出的符号消息的集合,记为S;设 S 有q个符号:

S 2°信源符号序列:Βιβλιοθήκη ={s1,

s2

,

…

,

sq

}

由信源符号集合 S 中符号的N 次扩展组成长度为N 的

符号序列,符号序列的集合记为 S N ;

N — 信源符号序列长;

非唯一可译码对有限长码流,不能唯一地分割一个个 的码字。唯一可译码在传输过程中不需要同步码。

非奇异定长码是唯一可译码

3.即时性 定义 在分组码形成码序列中,一个完整的码字接收到后,

无需等到接收下一个码字,就能立即译码,称为即 时码。

即时码又称为非延长码、异前缀码或逗点码。

异前缀码(即时码)指的是码集任何一个码不能是其他 码的前缀。

信息论与编码

Information Theory & Coding 第5章 无失真信源编码

信源编码一直是信息论研究的一个重要方向。信源编 码是通过压缩编码来去掉信号源中的冗余成分,提高信息 传输的有效性。

本章的重点

1.信源编码的概念; 2.变长码的分类与主要编码方法; 3.惟一可译码的判别准则; 4. Huffman编码

信息论与编码技术第五章课后习题答案

信源符 符 号 概 第一次 第二次 第三次 第四次 第五次 第 六 次 第 七 次 二元码

号 xi 率 pi

分组 分组 分组 分组 分组 分组 分组

x1

1/2

0

0

x2

1/4

0

10

x3

1/8

0

110

x4

1/16

0

1110

x5

1/32

1

0

1

x6

1/64

1

0

1

x7

1/128

1

1

x8

1/128

(5)香农码和费诺码相同

(1/8)+0* (1/8)=2/3

p0 =p(0| a0)*p(a0)+ p(0| a1)*p(a1)+ p(0| a2)*p(a2)+ p(0| a3)*p(a3)=1*(1/2)+ (1/2)* (1/4)+ (1/3)* (1/8)+0*

(1/8)=2/3

p1 =p(1| a0)*p(a0)+ p(1| a1)*p(a1)+ p(1| a2)*p(a2)+ p(1| a3)*p(a3)=0*(1/2)+ (1/2)* (1/4)+ (2/3)* (1/8)+1*

8

∑ 解:(1) H ( X ) = − pi log pi = 1.984 (bit/信源符号) i

(2) 每个信源使用 3 个二进制符号,

出现 0 的次数为:

出现 1 的次数为:

所以:P(0)=

,P(1)=

(3) 因为 K = 3 ,所以 η = 0.661

(4) 相应的香农编码 信 源 符 号 符 号 概 率 累 加 概 率 -Logp(xi)

信息论与编码(第二版)曹雪虹(最全版本)答案讲解

《信息论与编码(第二版)》曹雪虹答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==u 1u 2u 31/21/21/32/32/31/3于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:000110110.80.20.50.50.50.50.20.8设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码教学课件(全)

目录

• 课程介绍与背景 • 信息论基础 • 编码理论基础 • 信道编码技术 • 数据压缩技术 • 多媒体信息编码技术 • 课程总结与展望

01

课程介绍与背景

Chapter

信息论与编码概述

信息论的基本概念

01

信息、信息量、信息熵等

编码的基本概念

02

信源编码、信道编码、加密编码等

02

极化码(Polar Codes)

一种新型信道编码方式,通过信道极化现象实现高效可靠的信息传输。

03

深度学习在信道编码中的应用

利用深度学习技术优化传统信道编码算法,提高编码性能和效率。

05

数据压缩技术

Chapter

数据压缩概述与分类

数据压缩定义

通过去除冗余信息或使用更高效的编码方式,减小数据表示所需存储空间的过 程。

线性分组码原理:线性分组码是一 种将信息序列划分为等长的组,然 后对每组信息进行线性变换得到相 应监督位的编码方式。

具有严谨的代数结构,易于分析和 设计;

具有一定的检错和纠错能力,适用 于各种通信和存储系统。

循环码原理及特点

循环码原理:循环码是一种特殊的线 性分组码,其任意两个码字循环移位

后仍为该码的码字。

03

编码理论基础

Chapter

编码的基本概念与分类

编码的基本概念

编码是将信息从一种形式或格式转换为另一种形式的过程,以 满足传输、存储或处理的需要。

编码的分类

根据编码的目的和原理,可分为信源编码、信道编码、加密编 码等。

线性分组码原理及特点

线性分组码特点

监督位与信息位之间呈线性关系, 编码和解码电路简单;

信息论与编码第六章课后习题答案(曹雪虹)(word文档良心出品)

第六章:信道编码(本章复习大纲我重新修改了一下,尤其要关注红色内容)1、基本概念:差错符号、差错比特;差错图样:随机差错、突发差错;纠错码分类:检错和纠错码、分组码和卷积码、线性码与非线性码、纠随机差错码和纠突发差错码;矢量空间、码空间及其对偶空间; 有扰离散信道的编码定理:-()NE R e P e (掌握信道编码定理的内容及减小差错概率的方法);线形分组码的扩展与缩短(掌握奇偶校验码及缩短码的校验矩阵、生成矩阵与原线形分组码的关系)。

2、线性分组码(封闭性):生成矩阵及校验矩阵、系统形式的G 和H 、伴随式与标准阵列译码表、码距与纠错能力、完备码(汉明码)、循环码的生成多项式及校验多项式、系统形式的循环码。

作业:6-1、6-3、6-4、6-5和6-6选一、6-7 6-8和6-9选一 6-1 二元域上4维4重失量空间的元素个数总共有24=16个,它们分别是(0,0,0,0),(0,0,0,1)…(1,1,1,1),它的一个自然基底是(0,0,0,1),(0,0,1,0),(0,1,0,0)和(1,0,0,0);其中一个二维子空间含有的元素个数为22个,选取其中一个自然基底为(0,0,0,1)和(0,0,1,0),则其二维子空间中所包含的全部矢量为(0,0,0,0,),(0,0,0,1),(0,0,1,0)和(0,0,1,1)(注选择不唯一);上述子空间对应的对偶子空间可以有三种不同的选择:(0,0,0,0) ,(0,1,0,0),(1,0,0,0),(1,1,0,0)或(0,0,0,0) ,(0,1,0,0)或(0,0,0,0) (1,0,0,0)。

(注意本题中所包含的关于矢量空间的一些基本概念)6-3 由题设可以写出该系统(8,4)码的线形方程组如下:736251403320231012100321v u v u v u v u v u u u v u u u v u u u v u u u=⎧⎪=⎪⎪=⎪=⎪⎨=++⎪⎪=++⎪=++⎪⎪=++⎩(注:系统码高四位与信息位保持一致,u i 为信息位) 把上述方程组写成矩阵形式,可以表示为 V =U G ,其中V 为码字构成的矢量,即V =(v 7,v 6,v 5,v 4,v 3,v 2,v 1,v 0),U 为信息位构成的矢量,即U =( u 3,u 2,u 1,u 0),观察方程组可得系统生成矩阵为:[]44*41000110101001011G I |P 0010011100011110⎡⎤⎢⎥⎢⎥==⎢⎥⎢⎥⎣⎦由系统生成矩阵和校验矩阵的关系可得:4*441101100010110100H P |I 0111001011100001T ⎡⎤⎢⎥⎢⎥⎡⎤==⎣⎦⎢⎥⎢⎥⎣⎦由校验矩阵可以看出,矩阵H 的任意三列都是线性无关的(任意三列之和不为0),但存在四列线性相关的情况(如第1、5、6、8列,这四列之和为0),即校验矩阵H 中最小的线性相关的列数为4,从而得该线性分组码的最小码距为4。

信息论与编码 曹雪芹 Chap5

信源编码

内容

5.1 编码的定义 5.2 无失真信源编码 5.3 限失真信源编码

5.4 常用信源编码方法简介

2

5.1 编码的定义

3

• 编码

• 信源编码:

– 无失真信源编码—第一极限定理 离散信源 – 限失真信源编码—第三极限定理 连续信源 • 信道编码 第二极限定理

• 信源编码

– 在不失真或允许一定失真条件下,如何用尽可 能少的符号来传送信源信息,以便提高信息传 输率

0 0 0 0 1 0 10 1 0 1 0 1 0

A

1 0 1 0 0 1

分成r个树枝—码的进制数 中间节点—码字的一部分

1 1 0 0 1 2 0

终端节点—码字1101

1

1 2 2 0 1 2

0 1 0 1

二进制码树 节数—码长

01 2

0

1

2

三进制码树

15

• 树码

– 如果有n个信源符号,那么在码树上就要选择n 个终端节点,用相应的r元基本符号表示这些 码字。

KL 1 K log m log M 最小 L L

31

_

5.2.1 定长编码定理

• 在定长编码中,K是定值。 • 我们的目的是寻找最小K值。 • 编码器输入X=(X1 X2…Xl …XL), Xl∈{a1,…an}, 输入的消息总共有nL种可能的组合 • 输出的码字Y=(Y1 Y2 …Yk… YK ) , Yk∈{b1,…bm} 输出的码字总共有mK种可能的组合。

25

设C为码字集合,按以下步骤构造此码的尾随后缀集合F:

(1) 考查C中所有的码字,若 Wi 是 W j 的前缀,则将相应的 后缀作为一个尾随后缀码放入集合 F0中;

信息论与编码曹雪虹著第二章

2.1信源描述与分类

(2)马尔可夫信源 a)马尔可夫链定义: 若某事件发生的概率只与前m个事件相关,而与 更前面的事件无关,那么该事件集合称为马尔可 夫链,其概率可描述为:

p( x1 , x2 , x3 xL ) p( xL x1 , x2 , x3 xL 1 ) p( x1 , x2 , x3 xL 1 ) p( xL xL m , x2 , x3 xL 1 ) p( x1 , x2 , x3 xL 1 ) p( xL xL m , x2 , x3 xL 1 ) p( xL 1 xL m1 , x2 , x3 xL 2 ) p( x1 , x2 , x3 xL 2 )

X x1 P p( x ) 1

称为概率空间,

x2 p( x 2 )

x3 xn p( x 3 ) p( x n )

其中 p( x i ) 0,

p( x

i 1

n

i

)1

15

2.1信源描述与分类

例1:离散无记忆信源 单个符号 X={0, 1} X={A, B , … ,Z }

信源的基本特性是具有随机不确定性

2

2.1信源特性与分类

信源分类

(1)按信源发出消息在时间和幅度上分布情况

离散信源:时间和幅度上都是离散分布的离散消 息。如:文字、数字等。 • 单符号离散信源 • 符号序列离散信源 连续信源:时间或幅度上是连续分布的连续消息。 如:话音、图像等。

3

2.1信源特性与分类

16

2.1信源描述与分类

单符号无记忆信源的性质

它是最简单也是最基本的信源,是组成实际信源的基本 单元。 当信源给定,其相应的概率空间就已给定;反之,如果 概率空间给定,这就表示相应的信源已给定。所以,概 率空间能表征这离散信源的统计特性,因此有时也把这 个概率空间称为信源空间。 这些信源可能输出的消息数是有限的或可数的,而且每 次只输出其中一个消息。因此,可以用一个离散型随机 变量X来描述这个信源输出的消息。这个随机变量X的样 本空间就是符号集A;而X的概率分布就是各消息出现的 先验概率,信源的概率空间必定是一个完备集。

信息论与编码综述

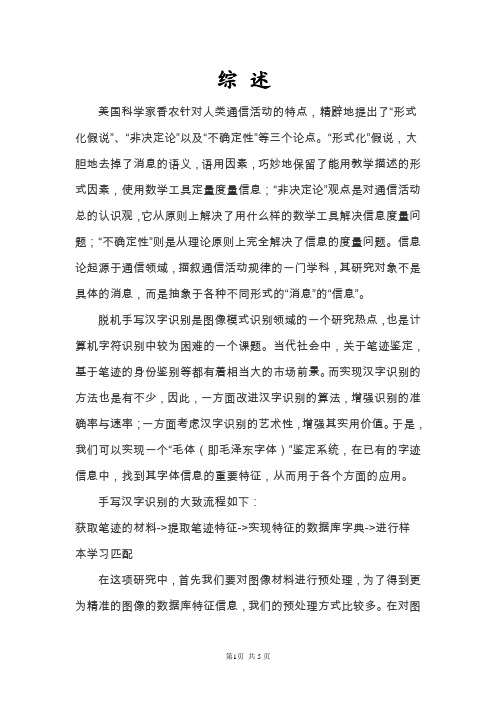

综述美国科学家香农针对人类通信活动的特点,精辟地提出了“形式化假说”、“非决定论”以及“不确定性”等三个论点。

“形式化”假说,大胆地去掉了消息的语义,语用因素,巧妙地保留了能用教学描述的形式因素,使用数学工具定量度量信息;“非决定论”观点是对通信活动总的认识观,它从原则上解决了用什么样的数学工具解决信息度量问题;“不确定性”则是从理论原则上完全解决了信息的度量问题。

信息论起源于通信领域,描叙通信活动规律的一门学科,其研究对象不是具体的消息,而是抽象于各种不同形式的“消息”的“信息”。

脱机手写汉字识别是图像模式识别领域的一个研究热点,也是计算机字符识别中较为困难的一个课题。

当代社会中,关于笔迹鉴定,基于笔迹的身份鉴别等都有着相当大的市场前景。

而实现汉字识别的方法也是有不少,因此,一方面改进汉字识别的算法,增强识别的准确率与速率;一方面考虑汉字识别的艺术性,增强其实用价值。

于是,我们可以实现一个“毛体(即毛泽东字体)”鉴定系统,在已有的字迹信息中,找到其字体信息的重要特征,从而用于各个方面的应用。

手写汉字识别的大致流程如下:获取笔迹的材料->提取笔迹特征->实现特征的数据库字典->进行样本学习匹配在这项研究中,首先我们要对图像材料进行预处理,为了得到更为精准的图像的数据库特征信息,我们的预处理方式比较多。

在对图像进行配准之前,包括对样本图像的归一化紧缩重排、图像去噪、灰度化、二值化、梯度锐化、汉字细化处理、字符切割等。

灰度化由于256色的位图的调色板内容比较复杂,使得图像处理的许多算法不能展开,因此有必要进行灰度处理。

所谓的灰度图像就是图像的每一个像素R,G,B 的分量的值是相等的,灰度图像只有亮度上的差异。

算法各有不同,比较直接的一种就是给像素的RGB 各自一个加权系数,然后求和;()()()()f x y 0.3*x y 0.59*x y 0.11*x y R G B =++,,,,来自于RGB 三原色体系转换到孟赛尔颜色体系时的明度近似构造函数,优点是非常符合人眼对颜色的感觉,其颜色空间比较均匀。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

码1是非即时码,码2是即时码

信源符号 si s1 s2 s2 s4 码1 1 10 100 1000 码2 1 01 001 0001

13

编码的定义

非分组码 码 奇异码 分组码 非唯一可译码 非即时码 非奇异码 唯一可译码 即时码 (非延长码)

14

• 码树

– 表示各码字的构成;构造即时码

树根—码字的起点

27

例

设消息集合共有7个元素 s1 , s2 , s3 , s4 , s5 , s6 , s7 , 它们分别被编码为 a, c, ad , abb, bad , deb, bbcde ,判断 是否是唯一可译码。 解:

C a c ad abb bad deb bbcde F1 d bb F2 eb cde F3 de F4 b F5 ad bcde

11

编码的定义

• 唯一可译码 • 非即时码: – 如果接收端收到一个完整的码字后不能立即 译码,还需等下一个码字开始接收后才能判 断是否可以译码 • 即时码: (非延长码) (异前缀码) – 在译码时无需参考后续的码符号就能立即作 出判断,译成对应的信源符号。 – 任意一个码字都不是其它码字的前缀部分 • 在延长码中,有的码是唯一可译的,取决于码的 总体结构

码0 00 01 10 11

码1 0 11 00 11

码 表 码2 0 10 00 01

码3 1 10 100 1000

码4 1 01 001 0001

• • • •

等长码:码中所有码字的长度都相同 变长码:码中的码字长短不一 非奇异码:信源符号与码字是一一对应的 奇异码:码1

8

对离散无记忆信源的N次扩展信源进行编码得到N次扩 展码。 S {s1 , s2 , sq } 假定信源符号集为

17

编码的定义

• 满树:

– 每个节点上都有r个分枝的树——等长码

• 非满树:

– 变长码 • 用树的概念可导出唯一可译码存在的充分和必 要条件,即各码字的长度Li应符合Kraft不等式

r

i 1

q

li

1

式中: r是进制数 q是信源符号数

18

编码的定义

定理 设信源符号集为 S {s1 , s2 , sq,码符号集 } 为 X {x1 , x2 , xr } ,对信源进行编码,得到的码 为 C w1 , w2 , wq ,码长分别为 l1 , l2 , lq 。即时码存在的充要 条件是

0

0

00

01 10 11

1

1

1

1 0 0

01

码0

1

001

1 0001 1 0

码4

0

1

• 任一即时码都可用树 图法来表示。 • 当码字长度给定,即时 码不是唯一的。

0 0

0

10 110

1

0 1

1

1110 0

16

码3

编码的定义

• 码3对应的树如下图:

1 1 0 10 0 100 0 1000

• 该码树从根到终端节点所经路径上每一个中间 节点皆为码字,因此不满足前缀条件。 • 虽然码3不是即时码,但它是唯一可译码。

… 111111

9

编码的定义

分组码和非分组码

将信源符号集中的每个信源符号 si 固定地映 射成一个码字 wi ,这样的码称为分组码,也叫块 码 与分组码对应的是非分组码,又称为树码、 树码编码器输出的码符号通常与编码器的所有信 源符号都有关。

10

编码的定义

• 唯一可译码:

• •

• • – 任意有限长的码元序列,只能被唯一地分割 成一个个的码字。 例:{0,10,11}是一种唯一可译码。 任意一串有限长码序列,如100111000,只能被分 割成10,0,11,10,0,0。任何其他分割法都会产生 一些非定义的码字。 奇异码不是唯一可译码 非奇异码 – 唯一可译码 — 码3 – 非唯一可译码 — 码2

24

唯一可译码的判别准则

A.A.Sardinas和G.W.Patterson于1957年提出下述算法用 于判断码C的唯一可译性.此算法的原理如下所示:

A1 B1 B2 A2

A3 Am

B3 Bn

其中 Ai , Bi都是码字。可知,当且仅当某个有限长的码符 号序列能译成两种不同的码字序列时,此码不是唯一可 译码,此时B1 一定是 A1 的前缀,而A1 的尾随后缀一定是 另一码字 B2 的前缀;而B2的尾随后缀又是其他码字的前 缀.最后,码符号序列的尾部一定是一个码字。

• 若对信源进行定长编码,必须满足: nL≤mK

X

信源

L长序列

信源编码器

Y

信道

32

码表

• 信道编码

– 在信道受干扰的情况下如何增加信号的抗干扰 能力,同时又使得信息传输率最大。

4

编码的定义

• 信源编码:

– 将信源输出符号,经信源编码器后变换成另外的 压缩符号,然后将压缩后信息经信道传送给信宿 • 信源符号之间存在分布不均匀和相关性,使得信源 存在冗余度,信源编码的主要任务就是减少冗余,提 高编码效率。 • 针对信源输出符号序列的统计特性,寻找一定的方 法把信源输出符号序列变换为最短的码字序列。

(3) F Fi 即为码C的尾随后缀集合;

i

(4) 若F中出现了C中的元素,则算法终止,返回假(C不是 唯一可译码);否则若F中没有出现新的元素,则返回真。

26

定理 一个码是唯一可译码的充要条件是的 F1 , F2 , 的 并集中没有C中的码字。 直观理解,当码字组成码字序列时,所有后缀不能 是一个码字。

KL 1 K log m log M 最小 L L

31

_

5.2.1 定长编码定理

• 在定长编码中,K是定值。 • 我们的目的是寻找最小K值。 • 编码器输入X=(X1 X2…Xl …XL), Xl∈{a1,…an}, 输入的消息总共有nL种可能的组合 • 输出的码字Y=(Y1 Y2 …Yk… YK ) , Yk∈{b1,…bm} 输出的码字总共有mK种可能的组合。

若要实现无失真编码,映射必须是一一对应的、可逆的。

7

编码的定义

• 若码集为{0,1},所得码字为二元序列,称为二元码 • 例如,信源符号X={a1,a2,a3,a4},对应不同码字如表

信源符号

信源符号

出现概率

a1 a2 a3 a4

p(a1)=1/2 p(a2)=1/4 p(a3)=1/8 p(a4)=1/8

X

信源

L长序列

信源编码器 码表

Y

信道

30

K长码字

无失真信源编码

• 实现无失真的信源编码,要求: – 信源符号X1 X2…Xl …XL 是一一对应的 – 码字Y1 Y2…Yk… YK • 能够无失真或无差错地从Y恢复X,也就是能正 确地进行反变换或译码 ; • 传送Y时所需要的信息率最小 信息率最小就是找到一种编码方式使

0 0 0 0 1 0 10 1 0 1 0 1 0

A

1 0 1 0 0 1

分成r个树枝—码的进制数 中间节点—码字的一部分

1 1 0 0 1 2 0

终端节点—码字1101

1

1 2 2 0 1 2

0 1 0 1

二进制码树 节数—码长

01 2

0

1

2

三进制码树

15

• 树码

– 如果有n个信源符号,那么在码树上就要选择n 个终端节点,用相应的r元基本符号表示这些 码字。

i 1 i 1

对于唯一可译码,该不等式又称为McMillan不等式。

21

定理 唯一可译码存在的充要条件是

r li 1

i 1

q

li r为码符号个数,为码字长度,q为信源符号个数。

McMillan不等式指出了唯一可译码中r、q、 之间的关 li 系,如果满足这个不等式的条件,则一定能够构成至 少一种唯一可译码,否则,无法构成唯一可译码.它 给出了唯一可译变长码的存在性。

S {s1 , s2 , sq N } N次扩展信源符号集为 N次扩展码为 C {w1 , w2 , wq N } 二次扩展码

二次扩展信源符 号si s 1= s 1 s 1 s 2= s 1 s 2 s 3= s 1 s 3

二次扩展码字 wj 11 110 1100

… s16= s4 s4

第5章

信源编码

内容

5.1 编码的定义 5.2 无失真信源编码 5.3 限失真信源编码

5.4 常用信源编码方法简介

2

5.1 编码的定义

3

• 编码

• 信源编码:

– 无失真信源编码—第一极限定理 离散信源 – 限失真信源编码—第三极限定理 连续信源 • 信道编码 第二极限定理

• 信源编码

– 在不失真或允许一定失真条件下,如何用尽可 能少的符号来传送信源信息,以便提高信息传 输率

必要性: 由于即时码必然可以用树图构造。可取l阶的r叉树且 l max li i l ,在第l阶上共有 r 个节点,于是长为li 的码字相当于砍去了 l l 该叉树第l阶上的 r i 个节点,q个码字共砍去第l阶的节点数 q q l 必小于 r ,即 l li l , r li 1 r r

X

信源

信源编码器

Y

信道

码表

5

编码的定义

码序列: 信源输出符号序列变换成适合信道传 输的符号序列 编码: 对信源输出的原始符号按照一定数学规则 进行的变换 编码器: 完成编码功能的器件 译码器: 接收端完成与编码相反功能的器件

6

信源编码器

码元或码符号 码字:输出的码符号序列;与信源符号一一对应。 码:码字的集合C;码字长度或码长。 信源编码就是把信源符号序列变换到码符号序列的一 种映射。