最优化理论与算法(第三章)

搜索引擎优化 第3章 SEO的基本理论

3.2.1 SEO的核心思维

下面分别从SEO工作围绕的核心要素、要达到的核心目的、核心要素间的关系三个方面 介绍SEO核心思维方面的内容。

1.核心要素

在互联网中,搜索引擎的一端连接着用户,另一端连接着网站,用户通过搜索引擎得到 网站的信息。同样的道理,网站通过搜索引擎使用户发现自己,达到展现,以至收益的目 的。可见SEO工作实际是围绕着三个核心要素展开:用户、网站和平台(搜索引擎),它 们之间的关系如图3-4所示。

3.1.1 SEO的基本原则

1.整体性 搜索引擎对某个网站的评价是由多个因素根据重要性占不同的权重组成的综 合评价。某个网站的一两个优点并不能给网站带来多大的权重,只有整体各项指 标都比较优秀,才会引起搜索引擎的足够重视,也才能给用户带来更好的浏览体 验。像优化项目和指标兼顾用户和搜索引擎的体验,网站在PC端和手机端都能 有很好的浏览体验,网站的域名、服务器、页面内容、排版、样式都经过精心组 织和选择等,都属于从整体性的角度去考虑优化工作。 因此,SEO人员在对网站进行优化时,要注重制定整体性的策略,使各项优 化项目和指标做到互相支持,同步促进。网站的整体评价得分高了,就会被搜索 引擎列入重点关注对象,及时抓取网站内容,优先排序。

3.熟悉搜索引擎优化的基本矛盾

4.了解搜索引引擎; 既适用于PC端搜索引擎,也适用于移动端搜索引擎。但是它们在某些表达对 象的称呼不同,为了方便起见,我们把SEO对象默认为网站,读者在理解上 注意通用性。 SEO工作主要受搜索引擎算法和SEOer(SEO从业人员)的影响。搜索 引擎算法的调整会给很多网站的搜索排名带来较大影响,SEOer的工作水平 直接影响到网站的搜索排名及排名的稳定性。本书简要总结了SEO工作的基 本理论,供读者参考。

最优化理论与算法

最优化理论与算法

优化理论与算法研究的目标是解决最优化问题,即给定一定的约束条

件下,求得目标函数的最佳值,优化理论与算法是计算机科学、数学、运

筹学及其它相关学科的重要组成部分,是一个多学科交叉学科。

优化理论

与算法是指对复杂环境、条件、限制等进行模型建立,并以此模型为基础,运用计算机对各种优化问题进行求解,得到最优解的方法。

它在产业中的

应用非常广泛,包括交通系统、排课模式、物流系统、科研计划等,它的

应用领域也不断扩大。

优化理论与算法包括几何优化、数值优化、组合优化、动态规划等,

其中几何优化是指把优化问题转换成几何问题,按照优化准则进行空间,

以求取最优解的方法。

数值优化是指根据给定的模型,使用计算机求解目

标函数的最优解的方法。

组合优化是指求解那些变量数量特别多,而每个

变量又只能取有限的取值,使其能达到最优解的一种技术。

动态规划是指

通过构建有限步骤,每步骤之间相互关联的一个优化过程,以求得最优解

的方法。

优化理论与算法综合利用了统计学、数理统计、概率论、凸分析、数

值分析和计算机程序的优势和特点,能有效地处理实际中复杂的优化问题。

AAA最优化理论与方法课件(第3章,马昌凤版)

0.78

H

0.02

0.12

0.14

0.02 0.86

0.04 0.06

0.12 0.04

0.72 0.08

0.14

0.06

0.08

0.74

c 0.76, 0.08,1.12, 0.68T

其最小特征值n 0.52,最大特征值1 0.94

1 1

Байду номын сангаас

n n

2

0.081

方法分类:

1、间接法:对简单问题,求解必要条件或充分条件;

零阶法:只需计算函数值 f(x)

2、迭代算法: 一阶法:需计算 ▽f(x)

二阶法:需计算 ▽2f(x)

直接法 梯度法

从梯度下降到拟牛顿法

训练神经网络的五大学习算法

1、梯度下降法,又称为最速下降法

2、牛顿法

3、共轭梯度法(Conjugate gradient)

最优化理论与方法

Chapter 3 最速下降法和牛顿法

经典是永恒的

3.1 最速下降法及其Matlab实现 3.2 牛顿法及其Matlab实现 3.3 修正牛顿法及其Matlab实现

学习的重要性:

1、直接用于无约束的实际问题; 2、其基本思想和逻辑结构可以推广到约束问题;

3、约束问题可以转化成无约束问题求解。

min f (x) x12 x22 .

xR 2

a2 b2

显然该问题有精确解x* (0,0)T , f (x*) 0. 分析a与b 取不同值时迭代次数的变化规律。初始点都取为

(1,1)T,精度取1e-5。

a

b

离心率

迭代次数 最后目标值

d (1) 4 5 1 / 10 9

最优化理论与算法完整版课件 PPT

Bazaraa, J. J. Jarvis, John Wiley & Sons, Inc.,

1977.

组合最优化算法和复杂性

Combinatorial

Optimization 蔡茂诚、刘振宏

Algorithms and Complexity

清华大学出版社,1988 I运nc筹.,学19基82础/1手99册8

最优化首先是一种理念, 运筹学的“三个代表”

其次才是一种方法.

• 模型

• 理论

2021/4/9

• 算法

5

绪论---运筹学(Operations Research -

运筹学O方R)法

最优化/数学规划方法

连续优化:线性规划、 非线性规划、非光滑优 化、全局优化、变分法、 二次规划、分式规划等

离散优化:组合优化、 网络优化、整数规划等

2021/4/9

11

1. 食谱问题

我每天要求一定量的两种维生素,Vc和Vb。 假设这些维生素可以分别从牛奶和鸡蛋中得到。

维生素

Vc(mg) Vb(mg) 单价(US$)

奶中含量

2 3 3

蛋中含量

4 2 2.5

每日需求 40 50

需要确定每天喝奶和吃蛋的量, 目标以便以最低可能的花费购买这些食物, 而满足最低限度的维生素需求量。

最优化理论与算法

2021/4/9

1

提纲

使用教材:

最优化理论与算法 陈宝林

参考书 :

数学规划 黄红选, 韩继业 清华大学出版社

1. 线性规划 对偶定理

2. 非线性规划 K-K-T 定理

3. 组合最优化 算法设计技巧

2021/4/9

2

其他参考书目

最优化理论与算法第二版教学设计

最优化理论与算法第二版教学设计一、课程背景随着社会的发展,各行各业对效率的要求越来越高。

优化理论与算法作为一门重要的数学工具,已经成为计算机科学、工业工程、运筹学、统计学等诸多领域必不可少的一部分。

本课程主要介绍常见的最优化算法、模型与理论,旨在让学生在课程学习中掌握优化问题的建模与求解方法,了解常见的优化算法及其应用,并培养学生解决实际问题的能力。

二、课程目标本课程旨在培养学生以下能力:•掌握最优化问题的概念与一般形式;•熟悉线性规划、整数规划、动态规划、贪心算法、分治算法、模拟退火等常见的最优化算法及其应用;•熟练运用MATLAB等工具对优化问题进行数值求解;•能够分析、解决实际问题中的优化问题。

三、教学大纲第一章最优化理论基础•最优化问题与应用•最优化问题的概率与形式化描述•不等式约束条件的最优化问题•拉格朗日乘数法第二章线性规划•线性规划的基本概念•线性规划模型的构建•单纯形法与其扩展算法•求解线性规划的MATLAB工具箱lpSolve第三章整数规划•整数规划的基本概念•分支限界法、割平面法等求解整数规划的方法•求解整数规划的MATLAB工具箱IntLinProg 第四章动态规划•动态规划的基本思想与模型•背包问题的动态规划算法•求解非线性规划的MATLAB工具箱fmincon 第五章贪心算法与分治算法•贪心算法的基本思想与模型•贪心算法求解集合覆盖、活动选择等问题•分治算法的基本思想与模型•分治算法求解归并排序、快速排序等算法第六章模拟退火与遗传算法•模拟退火算法的基本思想及其应用•遗传算法的基本思想及其应用•求解非线性规划的MATLAB工具箱fminsearch四、课程教学教学方式本课程为理论与实践相结合的课程,采用教师讲解、案例分析、课堂练习和课程论文等多种教学方式。

课程中将提供足够的例子和案例分析,以丰富课程内容。

教材主教材为《最优化理论与算法第二版》(作者:D.M.库珀等,译者:范玉平、钱启祥)。

最优化理论与算法

最优化理论与算法

最优化理论与算法是一门使用数学和统计分析工具来解决问题的学科。

它用于寻求系统最佳运行状态,并帮助系统达到最优性能。

它研究的

主要问题包括目标函数最大化或最小化,最优化问题的非线性性质,

以及对某些未知变量的极大或极小。

最优化理论和算法的种类繁多。

其中包括最小化法,最大化法,拉格

朗日乘数法,拟牛顿法,模拟退火法,遗传算法,蚁群算法,鲁棒优

化等等。

它们在很多领域中都有应用,如机器学习,金融保险,供应

链管理,交通路线规划,排队分析,测量定位等等。

例如,在机器学

习领域,拉格朗日乘数法和拟牛顿法用于求解最优超参数。

此外,在

金融保险领域,最优化理论和算法常常用于分析风险和收益、以及给

定投资者希望达到的目标所必需要承担的风险等。

最优化大在一些方法上求解适当的最佳参数,从而开发高性能算法。

它可以用来解决各种最优化问题,如局部最优化问题,全局最优化问题,非线性最优化问题,多目标最优化问题等。

最优化算法也可以用

来实施和评估各种经济模型,如产品管理、能源管理和风险管理。

总的来说,最优化理论和算法在许多重要领域都有着广泛的应用。

它

可以用来解决各种最优化问题,并为解决实际问题提供有效解决方案。

最优化理论与算法完整版课件陈宝林

TP SHUAI

1

提纲

使用教材:

最优化理论与算法 陈宝林

参考书 :

数学规划 黄红选, 韩继业 清华大学出版社

1. 线性规划 对偶定理

2. 非线性规划 K-K-T 定理

3. 组合最优化 算法设计技巧

TP SHUAI

2

其他参考书目

Nonlinear Programming - Theory and Algorithms

j1

m

s.t xij bj

i1

xij 0

i 1, 2, , m

j 1, 2, n i 1, 2, , m j 1, 2, n

TP SHUAI

15

3 税下投资问题

• 以价格qi 购买了si份股票i,i=1,2,…,n

• 股票i的现价是pi

• 你预期一年后股票的价格为ri • 在出售股票时需要支付的税金=资本收益×30% • 扣除税金后,你的现金仍然比购买股票前增多 • 支付1%的交易费用 • 例如:将原先以每股30元的价格买入1000股股票,以

最优化首先是一种理念, 运筹学的“三个代表”

其次才是一种方法.

• 模型

• 理论

• 算法 TP SHUAI

5

绪论---运筹学(Operations Research - OR)

运筹学方法

最优化/数学规划方法

连续优化:线性规划、 非线性规划、非光滑优 化、全局优化、变分法、 二次规划、分式规划等

离散优化:组合优化、 网络优化、整数规划等

TP SHUAI

23

6.结构设计问题

p1

p2

h

2p

2L

B

d

受力分析图

最优化设计 课后习题答案

最优化方法-习题解答张彦斌计算机学院2014年10月20日Contents1第一章最优化理论基础-P13习题1(1)、2(3)(4)、3、412第二章线搜索算法-P27习题2、4、643第三章最速下降法和牛顿法P41习题1,2,374第四章共轭梯度法P51习题1,3,6(1)105第五章拟牛顿法P73-2126第六章信赖域方法P86-8147第七章非线性最小二乘问题P98-1,2,6188第八章最优性条件P112-1,2,5,6239第九章罚函数法P132,1-(1)、2-(1)、3-(3),62610第十一章二次规划习题11P178-1(1),5291第一章最优化理论基础-P13习题1(1)、2(3)(4)、3、4 1.验证下列各集合是凸集:(1)S={(x1,x2)|2x1+x2≥1,x1−2x2≥1};需要验证:根据凸集的定义,对任意的x(x1,x2),y(y1,y2)∈S及任意的实数λ∈[0,1],都有λx+(1−λ)y∈S.即,(λx1+(1−λ)y1,λx2+(1−λ)y2)∈S证:由x(x1,x2),y(y1,y2)∈S得到,{2x1+x2≥1,x1−2x2≥12y1+y2≥1,y1−2y2≥1(1)1把(1)中的两个式子对应的左右两部分分别乘以λ和1−λ,然后再相加,即得λ(2x1+x2)+(1−λ)(2y1+y2)≥1,λ(x1−2x2)+(1−λ)(y1−2y2)≥1(2)合并同类项,2(λx1+(1−λ)y1)+(λx2+(1−λ)y2)≥1,(λx1+(1−λ)y1)−2(λx2+(1−λ)y2)≥1(3)证毕.2.判断下列函数为凸(凹)函数或严格凸(凹)函数:(3)f(x)=x21−2x1x2+x22+2x1+3x2首先二阶导数连续可微,根据定理1.5,f在凸集上是(I)凸函数的充分必要条件是∇2f(x)对一切x为半正定;(II)严格凸函数的充分条件是∇2f(x)对一切x为正定。

最优化理论与算法

最优化理论与算法(数学专业研究生)第一章 引论§ 引言一、历史与现状最优化理论最早可追溯到古老的极值问题,但成为一门独立的学科则是在20世纪四十年代末至五十年代初。

其奠基性工作包括Fritz John 最优性条件(1948),Kuhn-Tucker 最优性条件(1951),和Karush 最优性条件(1939)。

近几十年来最优化理论与算法发展十分迅速,应用也越来越广泛。

现在已形成一个相当庞大的研究领域。

关于最优化理论与方法,狭义的主要指非线性规划的相关内容,而广义的则涵盖:线性规划、非线性规划、动态规划、整数规划、几何规划、多目标规划、随机规划甚至还包括变分、最优控制等动态优化内容。

本课程所涉及的内容属于前者。

二、最优化问题的一般形式 1、无约束最优化问题min ()nx Rf x ∈ () 2、约束最优化问题min ()()0, ..()0, i i f x c x i E s t c x i I=∈⎧⎨≥∈⎩ ()这里E 和I 均为指标集。

§数学基础一、 范数 1. 向量范数max i x x ∞= (l ∞范数) ()11ni i x x ==∑ (1l 范数) ()12221()ni i x x ==∑ (2l 范数) ()11()np pi pi xx ==∑ (p l 范数) ()12()TAxx Ax = (A 正定) (椭球范数) ()事实上1-范数、2-范数与∞-范数分别是 p -范数当 p =1、2和p →∞时情形。

2.矩阵范数定义 方阵A 的范数是指与A 相关联并记做A 的一个非负数,它具有下列性质: ① 对于0A ≠都有0A >,而0A =时0A =; ② 对于任意k R ∈,都有kA k A =; ③ A B A B +≤+; ④ AB A B ≤; 若还进一步满足: ⑤ pp AxA x ≤则称之为与向量范数p g 相协调(相容)的方阵范数。

最优化理论与算法习题答案

最优化理论与算法习题答案最优化理论与算法习题答案最优化理论与算法是应用数学中的一个重要分支,它研究如何在给定的约束条件下,找到一个使目标函数取得最优值的解。

在实际应用中,最优化问题广泛存在于各个领域,如经济学、管理学、物理学等。

本文将回答一些与最优化理论与算法相关的习题,帮助读者更好地理解和应用这一领域的知识。

1. 什么是最优化问题?最优化问题是指在给定的约束条件下,寻找一个使目标函数取得最优值的解。

其中,目标函数是需要最大化或最小化的函数,约束条件是对解的限制条件。

最优化问题可以分为无约束最优化和有约束最优化两种情况。

2. 什么是凸优化问题?凸优化问题是指目标函数和约束条件均为凸函数的最优化问题。

凸函数具有良好的性质,例如局部最小值即为全局最小值,因此凸优化问题的求解相对容易。

常见的凸优化问题有线性规划、二次规划等。

3. 什么是拉格朗日乘子法?拉格朗日乘子法是一种求解有约束最优化问题的方法。

它通过引入拉格朗日乘子,将有约束最优化问题转化为无约束最优化问题。

具体地,对于一个有约束最优化问题,我们可以构造拉格朗日函数,然后通过求解无约束最优化问题来获得原问题的解。

4. 什么是线性规划?线性规划是一种特殊的最优化问题,其中目标函数和约束条件均为线性函数。

线性规划在实际应用中非常广泛,例如在生产计划、资源分配等方面都有重要的应用。

线性规划可以使用单纯形法等算法进行求解。

5. 什么是整数规划?整数规划是一种最优化问题,其中变量需要取整数值。

与线性规划相比,整数规划的求解更加困难,因为整数约束条件使得问题的解空间变得离散。

常见的整数规划问题有旅行商问题、装箱问题等。

6. 什么是非线性规划?非线性规划是一种最优化问题,其中目标函数或约束条件为非线性函数。

非线性规划的求解相对复杂,通常需要使用迭代算法进行求解,例如牛顿法、拟牛顿法等。

非线性规划在实际应用中非常广泛,例如在经济学、工程学等领域都有重要的应用。

7. 什么是梯度下降法?梯度下降法是一种常用的优化算法,用于求解无约束最优化问题。

最优化理论与算法完整版课件

TP SHUAI

1

提纲

使用教材:

最优化理论与算法 陈宝林

参考书 :

数学规划 黄红选, 韩继业 清华大学出版社

1. 线性规划 对偶定理

2. 非线性规划 K-K-T 定理

3. 组合最优化 算法设计技巧

TP SHUAI

2

其他参考书目

Nonlinear Programming - Theory and Algorithms

TP SHUAI

11

1. 食谱问题

我每天要求一定量的两种维生素,Vc和Vb。 假设这些维生素可以分别从牛奶和鸡蛋中得到。

维生素

Vc(mg) Vb(mg) 单价(US$)

奶中含量

2 3 3

蛋中含量

4 2 2.5

每日需求 40 50

需要确定每天喝奶和吃蛋的量, 目标以便以最低可能的花费购买这些食物, 而满足最低限度的维生素需求量。

TP SHUAI

9

电子计算机----------最优化

1930年代,康托诺维奇:线性规划 1940年代,Dantzig:单纯形方法,

冯 诺依曼:对策论 1950年代,Bellman:动态规划,最优性原理;

KKT条件; 1960年代:Zoutendijk,Rosen,Carroll,etc.非线性规划算

TP SHUAI

23

6.结构设计问题

p1

p2

h

2p

2L

B

d

受力分析图

圆杆截面图

2p

h

2L

桁杆示意图

TP SHUAI

24

6.结构设计问题

解:桁杆的截面积为 : S dB

桁杆的总重量为:W 2dB L2 h2

最优化方法第三章-孙文瑜

Fnk k ak (1 )(bk a k ) Fnk 1

Fn k 1 k a k (bk a k ), k 1,2,, n 1 Fn k 1 Fn k k ak (bk a k ), k 1,2,, n 1 Fn k 1

25

2018/12/11

3.2.2 Fibonacci法

另一种与0 .618 法相类似的分割方法叫Fibonacci 法. 它与0 .618 法的主要区别之一在于: 搜索区间长度的 缩短率不是采用0 .618 而是采用Fibonacci 数. Fibonacci 数列满足 F0 F1 1

Fk 1 Fk Fk 1 , k 1,2 Fibonacci 法中的计算公式为

N

1

2

1 2

Y

* (t * )

a t1 , t1 t 2 ,

1

最优化:最速下降法和Newton法

定理 3.1.1 设假设 2.4.1的条件成立 , 那么采用精确搜索 , 或 Armijo搜索或 Wolfe- P owell搜索的最速下降法产生 的迭 代序列{xk }满足 lim || f ( xk ) || 0

k

由前面的例子看到, 最速下降法的收敛速度至多是线性的, 具体 见下面的两个定理.

第一节

最速下降法

最古老的优化方法,十九世纪中叶由Cauchy提出

1、 思想 :每次沿负梯度方向进行搜索

●

x*

xk 1

等值线(面)

●

xk

●

f ( xk )

负梯度方向也称为最速下降方向:

事实上,对任意p R n 且 || p || , 由Cauchy - Schwarz 不等式得 f ( xk ) T P - || f ( xk ) || || P || - || f ( xk ) || - f ( xk ) - f ( xk ) 当取p 时等号成立,即 p 是下列问题 || f ( xk ) || || f ( xk ) || 的解 min f ( xk ) T P

从上面的例子看到, 对于简单的二元二次函数极小化问题, 最速下降法在有限次迭代并没有求出其精确最优解, 但能 以较慢的速度无限接近最优解.

事实上,上面的例子刻画了最速下降法的所有收 敛特征

3、 最速下降法的收敛性 全局收敛性

由于最速下降法的搜索方向与负梯度方向一致, 即 k 0, 且 || f ( xk ) || || d k || 所以, 由定理2.4.1 - 2.4.3, 我们很容易得到最速下降算法的全 局收敛性.

2

max 其中 , 且max 和min分别是 f ( x * )的最大和最小特征值 . min

最优化理论与算法

最优化理论与算法在当今的科技时代,最优化理论与算法已经成为解决各种实际问题的重要工具。

从经济决策到工程设计,从物流运输到人工智能,其应用几乎无处不在。

那么,什么是最优化理论与算法呢?简单来说,最优化就是在众多可能的选择中找到最好的那个。

想象一下你要从家去学校,有多种路线可供选择,你会选择距离最短、花费时间最少或者最省钱的那一条,这就是一个最优化的问题。

而最优化理论就是研究如何找到这样的最优解,算法则是实现这个目标的具体步骤和方法。

最优化问题可以分为无约束优化和约束优化两大类。

无约束优化问题就是在没有任何限制条件的情况下寻找最优解。

比如,找到一个函数的最小值或者最大值。

举个例子,对于函数 f(x) = x^2 2x + 3,我们要找到 x 使得 f(x) 最小。

通过求导并令导数为 0,可以得到 x = 1 时,f(x) 取得最小值 2。

约束优化问题则是在一定的条件限制下寻找最优解。

比如说,你有一定的预算去购买几种商品,每种商品都有价格和所能带来的满足感,你需要在不超过预算的情况下,让总的满足感最大。

这时候就需要考虑各种约束条件来找到最优的购买方案。

在解决最优化问题时,常用的算法有很多。

比如梯度下降法,它就像是在一个山坡上,沿着山坡最陡峭的方向往下走,逐步接近最低点。

这种方法简单直观,但也可能会陷入局部最优解,而找不到全局最优解。

还有牛顿法,它利用了函数的二阶导数信息,收敛速度比梯度下降法快,但计算复杂度较高。

此外,还有模拟退火算法、遗传算法等启发式算法。

模拟退火算法模仿了金属退火的过程,通过在搜索过程中随机地接受一些较差的解,避免陷入局部最优。

遗传算法则借鉴了生物进化的思想,通过选择、交叉和变异等操作来逐步优化解。

最优化理论与算法在实际生活中的应用非常广泛。

在工业生产中,为了提高生产效率、降低成本,需要对生产流程进行优化。

比如,在制造汽车的过程中,如何安排各个零部件的生产顺序,如何分配工人的工作时间,以使得整个生产过程最快、成本最低,这都可以通过最优化算法来解决。

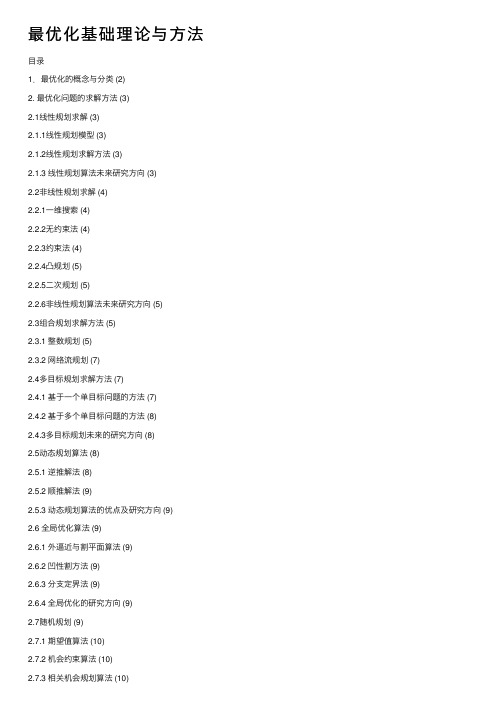

最优化基础理论与方法

最优化基础理论与⽅法⽬录1.最优化的概念与分类 (2)2. 最优化问题的求解⽅法 (3)2.1线性规划求解 (3)2.1.1线性规划模型 (3)2.1.2线性规划求解⽅法 (3)2.1.3 线性规划算法未来研究⽅向 (3)2.2⾮线性规划求解 (4)2.2.1⼀维搜索 (4)2.2.2⽆约束法 (4)2.2.3约束法 (4)2.2.4凸规划 (5)2.2.5⼆次规划 (5)2.2.6⾮线性规划算法未来研究⽅向 (5)2.3组合规划求解⽅法 (5)2.3.1 整数规划 (5)2.3.2 ⽹络流规划 (7)2.4多⽬标规划求解⽅法 (7)2.4.1 基于⼀个单⽬标问题的⽅法 (7)2.4.2 基于多个单⽬标问题的⽅法 (8)2.4.3多⽬标规划未来的研究⽅向 (8)2.5动态规划算法 (8)2.5.1 逆推解法 (8)2.5.2 顺推解法 (9)2.5.3 动态规划算法的优点及研究⽅向 (9)2.6 全局优化算法 (9)2.6.1 外逼近与割平⾯算法 (9)2.6.2 凹性割⽅法 (9)2.6.3 分⽀定界法 (9)2.6.4 全局优化的研究⽅向 (9)2.7随机规划 (9)2.7.1 期望值算法 (10)2.7.2 机会约束算法 (10)2.7.3 相关机会规划算法 (10)2.7.4 智能优化 (10)2.8 最优化软件介绍 (11)3 最优化算法在电⼒系统中的应⽤及发展趋势 (12)3.1 电⼒系统的安全经济调度问题 (12)3.1.1电⼒系统的安全经济调度问题的介绍 (12)3.1.2电⼒系统的安全经济调度问题优化算法的发展趋势 (12)2. 最优化问题的求解⽅法最优化⽅法是近⼏⼗年形成的,它主要运⽤数学⽅法研究各种优化问题的优化途径及⽅案,为决策者提供科学决策的依据。

最优化⽅法的主要研究对象是各种有组织系统的管理问题及其⽣产经营活动。

最优化⽅法的⽬的在于针对所研究的系统,求得⼀个合理运⽤⼈⼒、物⼒和财⼒的最佳⽅案,发挥和提⾼系统的效能及效益,最终达到系统的最优⽬标。

最优化理论与算法完整版课件陈宝林PPT课件

2020/3/26

可编辑

11

1. 食谱问题

我每天要求一定量的两种维生素,Vc和Vb。 假设这些维生素可以分别从牛奶和鸡蛋中得到。

维生素

Vc(mg) Vb(mg) 单价(US$)

奶中含量

2 3 3

蛋中含量

4 2 2.5

每日需求 40 50

需要确定每天喝奶和吃蛋的量, 目标以便以最低可能的花费购买这些食物, 而满足最低限度的维生素需求量。

几何规划 动态规划 不确定规划:随机规 划、模糊规划等

多目标规划 20对20/策3/2论6 等

随机过程方法

统计决策理论 马氏过程 排队论 更新理论 仿真方法 可靠性理论等

可编辑

统计学方法

回归分析 群分析 模式识别 实验设计 因子分析等

6

优化树

2020/3/26

可编辑

7

•最优化的发展历程

费马:1638;牛顿,1670

min f (x) x:数

欧拉,1755

df(x) 0 dx

Min f(x1 x2 ··· xn )

f(x)=0

2020/3/26

可编辑

8

拉格朗日,1797

Min f(x1 x2 ··· xn) s.t. gk (x1 x2 ··· xn )=0, k=1,2,…,m

欧拉,拉格朗日:无穷维问题,变分学 柯西:最早应用最速下降法

如果运输问题的总产量等于总销量,即有

m

n

ai bj

i 1

j 1

则称该运输问题为产销平衡问题;反之,称产销不平 衡问题。

2020/3/26

可编辑

14

2 运输问题(续)

令xij表示由产地Ai运往销地Bj的物品数量,则产销平衡 问题的数学模型为:

数值最优化算法与理论理论-第三章算法

1、最速下降法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=steepestmain(x0)max_iter=5000; % max number of iterationsEPS=1e-6; % threshold of gradient normrho=0.8;sigma=0.59; % Armijo parametersk=0;xk=x0; % initializationwhile k<max_iterdk=fun_grad(xk);d=-dk; % search directionif norm(dk)<EPS %precisionbreak;endmk=armijo(xk,rho,sigma,d); %armijo line searchxk=xk+rho^mk*d; %updatefk=fun_obj(xk);k=k+1;endx0=[-1,2];[xk,fk,k]=steepestmain(x0);2、Newton法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];function He=Hess(x)He=[1200*x(1)^2-400*x(2)+2,-400*x(1);-400*x(1),200];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=Newtonmain(x0)max_iter=5000; % 最大迭代次数EPS=1e-6; % 精度rho=1;sigma=1e-4; % Armijo 参数k=0;xk=x0; % 初值while k<max_iter % 迭代次数超过最大迭代次数时跳出循环k=k+1;dk=fun_grad(xk); % x(k)处的梯度H=Hess(xk); % x(k)处的Hessian矩阵d=-H\dk'; % x(k)处的搜索方向if norm(dk)<EPS % 终止条件break;endmk=armijo(xk,rho,sigma,d'); % 利用armijo搜索确定步长xk=xk+rho^mk*d'; % 计算x(k+1)的值fk=fun_obj(xk); % 计算x(k+1)处函数的值endx0=[1.2,1.2];[xk,fk,k]=Newtonmain(x0);3、Newton-最速下降法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];function He=Hess(x)He=[1200*x(1)^2-400*x(2)+2,-400*x(1);-400*x(1),200];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=newton_steepest(x0)max_iter=5000; % 最大迭代次数EPS=1e-6; % 精度rho=1;sigma=1e-4; % Armijo 参数 rho=0.8;sigma=0.59;k=0;xk=x0; % 初值while(k<max_iter)k=k+1;dk=fun_grad(xk); % x(k)处的梯度,注意dk为行向量G=Hess(xk); % x(k)处的Hessian矩阵d=-G\dk'; % x(k)处的搜索方向,注意此时d为列向量if norm(dk)<EPS % x(k)处的搜索方向break;end%% 判断d是否为下降方向if d'*dk'<0 % 若d'*dk<0,则d为下降方向d=d;else% 若d'*dk>=0,则d不为下降方向,令下降方向为负梯度方向 d=-dk';endmk=armijo(xk,rho,sigma,d'); % 利用armijo搜索确定步长 xk=xk+rho^mk*d'; % 计算x(k+1)的值fk=fun_obj(xk); % 计算x(k+1)处函数的值endx0=rand(1,2000);[xk,fk,k]=newton_steepest(x0);。

最优化理论与算法(第三章)

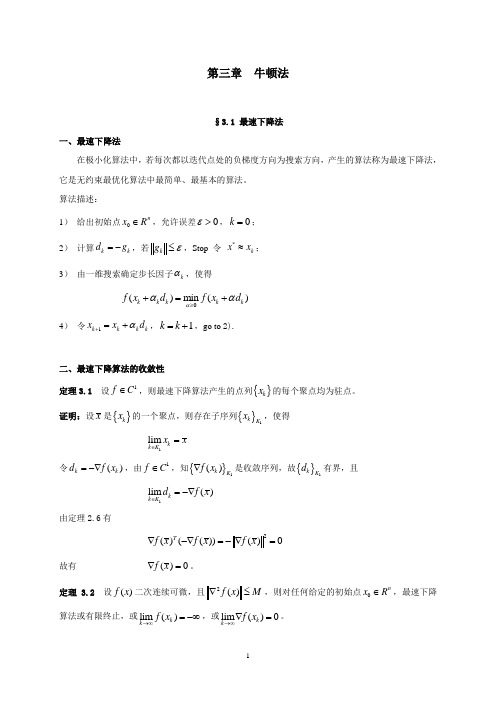

第三章 牛顿法§3.1 最速下降法一、最速下降法在极小化算法中,若每次都以迭代点处的负梯度方向为搜索方向,产生的算法称为最速下降法,它是无约束最优化算法中最简单、最基本的算法。

算法描述:1) 给出初始点0n x R ∈,允许误差0ε>,0k =; 2) 计算k k d g =-,若k g ε≤,Stop 令 *k x x ≈; 3) 由一维搜索确定步长因子k α,使得()min ()k k k k k f x d f x d ααα≥+=+4) 令1k k k k x x d α+=+,1k k =+,go to 2).二、最速下降算法的收敛性定理3.1 设1f C ∈,则最速下降算法产生的点列{}k x 的每个聚点均为驻点。

证明:设x 是{}k x 的一个聚点,则存在子序列{}1k K x ,使得1lim k k K x x ∈=令()k k d f x =-∇,由1f C ∈,知{}1()k K f x ∇是收敛序列,故{}1k K d 有界,且1lim ()k k K d f x ∈=-∇由定理2.6有2()(())()0Tf x f x f x ∇-∇=-∇=故有 ()0f x ∇=。

定理 3.2 设()f x 二次连续可微,且2()f x M ∇≤,则对任何给定的初始点0n x R ∈,最速下降算法或有限终止,或lim ()k k f x →∞=-∞,或lim ()0k k f x →∞∇=。

证明:不妨设k ∀,()0k f x ∇≠。

由定理2.5有211()()()2k k k f x f x f x M+-≥∇ 于是 []120101()()()()()2kk k i i i i i f x f x f x f x f x M -+==-=-≥∇∑∑令k →∞,由{()}k f x 为单调下降序列,则要么lim ()k k f x →∞=-∞,要么 lim ()0k k f x →∞∇=。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第三章 牛顿法§3.1 最速下降法一、最速下降法在极小化算法中,若每次都以迭代点处的负梯度方向为搜索方向,产生的算法称为最速下降法,它是无约束最优化算法中最简单、最基本的算法。

算法描述:1) 给出初始点0n x R ∈,允许误差0ε>,0k =; 2) 计算k k d g =-,若k g ε≤,Stop 令 *k x x ≈; 3) 由一维搜索确定步长因子k α,使得()min ()k k k k k f x d f x d ααα≥+=+4) 令1k k k k x x d α+=+,1k k =+,go to 2).二、最速下降算法的收敛性定理3.1 设1f C ∈,则最速下降算法产生的点列{}k x 的每个聚点均为驻点。

证明:设x 是{}k x 的一个聚点,则存在子序列{}1k K x ,使得1lim k k K x x ∈=令()k k d f x =-∇,由1f C ∈,知{}1()k K f x ∇是收敛序列,故{}1k K d 有界,且1lim ()k k K d f x ∈=-∇由定理2.6有2()(())()0Tf x f x f x ∇-∇=-∇=故有 ()0f x ∇=。

定理 3.2 设()f x 二次连续可微,且2()f x M ∇≤,则对任何给定的初始点0nx R ∈,最速下降算法或有限终止,或lim ()k k f x →∞=-∞,或lim ()0k k f x →∞∇=。

证明:不妨设k ∀,()0k f x ∇≠。

由定理2.5有211()()()2k k k f x f x f x M+-≥∇ 于是 []120101()()()()()2kk k i i i i i f x f x f x f x f x M -+==-=-≥∇∑∑令k →∞,由{()}k f x 为单调下降序列,则要么lim ()k k f x →∞=-∞,要么 lim ()0k k f x →∞∇=。

最速下降算法若采用不精确一维搜索,仍有下列总体收敛性定理。

定理3.3 设1f C ∈,则采用不精确一维搜索得到的点列{}k x 的每个聚点均为驻点。

证明:直接由定理2.14可得。

注:1) 最速下降算法的收敛性也可由前述关于模式算法收敛性结果定理2.7直接获得;2)最速下降算法的主要优点是方法简单、直观,有好的总体收敛性,但收敛很慢。

三、最速下降算法的收敛速度 1. 先考虑二次函数情形定理3.4 对极小化问题1min ()2Tf x x Gx =,其中G 为n n ⨯对称正定矩阵,1λ,n λ分别为G 的最大与最小特征值。

设*x 是最优解,则最速下降算法的收敛速度至少是线性的,且下面的界成立:*2211*221()()()(1)()()(1)()k n k n f x f x f x f x λλττλλ+---≤=-++,*1*k k x x x x+-≤- 其中11n G G τλλ-==(τ为矩阵G 的条件数)。

证明:由()f x Gx ∇=,有()k k f x Gx ∇=。

故1()()k k k k k k k k k k k k x x d x f x x Gx I G x αααα+=+=-∇=-=-其中k α使 (())(())k k k f I G x f I G x αα-≤-, 0α∀≥ 若设 ()1k P t t α=-,()Q t ut λ=- 其中,u R λ∈。

则有()Q G I uG λ=-,而(0)Q λ=,利用这些,可知1()()(())()(0)k k k k Q G f x f I G x f x Q α+=-≤, (要求0u λ>)21()()1()()(())(())2(0)(0)2(0)T T k k k k Q G Q G x G x Q G x G Q G x Q Q Q == 设12,,n λλλ≥≥是G 的特征值,而(1,,)i u i n =是对应得标准特征向量(两两正交的单位向量)。

令()1nk k i ii x au ==∑,则上式可进一步表示为:()()2111(())(())2(0)n nk T k i i j j i j a Q G u G a Q G u Q ==∑∑ ()()2111(())(())2(0)n nk Tk i i i j j j i j a Q u G a Q u Q λλ===∑∑ (将G 作用到∑内每一项) ()()2111(())(())2(0)n nk T k i i i j j j j i j a Q u a Q u Q λλλ===∑∑ ()2()2211()2(0)nk i i i i a Q Q λλ==∑ (由i u 是标准正交向量组) 对()Q t ut λ=-,可适当选取,u λ,使1()1,()1n Q Q λλ==-。

事实上,只须令1()1()1n Q Q λλ=⎧⎨=-⎩ 即可求得()1112,n n nu λλλλλλλ-+==-- 从而 ()112()n nt Q t λλλλ-+=-。

显然()Q t 单调上升。

由1()1,()1n Q Q λλ==-,及12,,n λλλ≥≥,即得()1(1,,)i Q i n λ≤=。

由 ()()22()2()1221111()()2(0)2(0)n nk k k i i i i i i i f x a Q a Q Q λλλ+==≤≤∑∑ 及 ()2()()()()()11111111()()()()()222n nn n n k T k k T k k k i i j j i i j j j i i i j i j i f x a u G a u a u a u a λλ========∑∑∑∑∑即得 12()()(0)k k f x f x Q +≤. 再由 2211(0)n n Q λλλλ⎛⎫+= ⎪-⎝⎭最后得 2111()()n k k n f x f x λλλλ+⎛⎫-≤ ⎪+⎝⎭0k ∀≥.由1101nnλλλλ-<<+,并注意到()f x 是正定二次函数(()0f x ≥), 则有()0 ()k f x k →→∞。

再由()f x 为严格凸二次函数(正定二次型),故当且仅当0x =时,()0f x =,由此可推得必有 *0k x x →=.再注意到*()0f x =,则有2*111*1()()()()()()k k n k k n f x f x f x f x f x f x λλλλ++⎛⎫--=≤ ⎪-+⎝⎭从而定理第一式得证。

下面再证定理第二式,记*k k e x x =-,k ∀。

由G 是对称正定的,故有1T T T n k k k k k k e e e Ge e e λλ≤≤由*0x =,则 2()T T k k k k k e Ge x Gx f x == 故有12()T T n k k k k k e e f x e e λλ≤≤, k ∀注意到: 2111()()n k k n f x f x λλλλ+⎛⎫-≤ ⎪+⎝⎭因而有22*1111112*112()2()k T k k k n n Tk kn n k k f x x xe e e e x xf x λλλλλλλλ++++-⎛⎫-=≤≤ ⎪+-⎝⎭最后得*1*k k x x x x +-≤-(其中1nλτλ=)。

这表明:最速下降算法至少具有线性收敛速度。

定理3.5(Kantorovich 不等式)设G 是n 阶对称正定矩阵,1λ和n λ分别为其最大和最小特征值,则nx R ∀∈,有211214()()()()T n T T n x x x Gx x G x λλλλ-≥+。

证明:参见袁亚湘等《最优化理论与方法》第三章附录,略。

以上对特殊形式的二次函数1()2Tf x x Gx =的收敛速度进行讨论,对一般的二次函数 1()2TT f x x Gx b x =+ 利用Kantorovich 不等式可得类似的结论,其证明思路如下:设*x 是极小点,则*x 满足*0Gx b +=且()f x 可表示为 ****11()()()22T T f x x x G x x x Gx =--- 记 **1()()()2T E x x x G x x =--,则()E x 与()f x 仅相差一个常数,它们有相同的最优解,且使用最速下降算法时,每次迭代方向产生的迭代序列均完全相同。

现在考察对()E x 的极小化,这时最速下降算法的迭代公式为:1T k k k k k T k k g g x x g g Gg +=- (这里T k k k T k kg gg Gg α=为最优步长因子)其中k k g Gx b =+。

直接计算可得:211121()()()4()()()()Tk k k k nT T k k k k k n E x E x g g E x g Gg g G g λλλλ+--=≥+(由Kantorovich 不等式) 故有: 21112114()1()()()n n k k k n n E x E x E x λλλλλλλλ+⎧⎫⎛⎫-≤-=⎨⎬⎪++⎩⎭⎝⎭(1) 由(1)即得: ()0k E x →(或*()()k E x E x →)。

由G 正定,当且仅当*x x =时,**1()()()02T E x x x G x x =--= 利用()E x 一致凸性,可证必有:*k x x →。

这表明:算法产生的点列{}k x 是整体收敛到*x 的。

由(1)有: 2*111*1()()()()()()k k n kk n f x f x E x f x f x E x λλλλ++⎛⎫--=≤ ⎪-+⎝⎭(2) 注意到: ***1()02T f x x Gx ≤-≤,由(2)有 22*11111()()1()n nk k n n f x f x f x λλλλλλλλ+⎡⎤⎛⎫⎛⎫--⎢⎥≤+- ⎪ ⎪++⎢⎥⎝⎭⎝⎭⎣⎦211()n k n f x λλλλ⎛⎫-≤ ⎪+⎝⎭(3)再令*k k e x x =-(k ∀),则1T T T n k k k k k k e e e Ge e e λλ≤≤,k ∀注意到2()T k k k e Ge E x = 即有: 22**12()n k k k x xE x x x λλ-≤≤-,k ∀从而有:22*1111112*112()()2()()k k nk n n k n n k k E x x xE x E x x x E x λλλλλλλλλλ+++-⎛⎫-=≤=≤ ⎪+-⎝⎭,(令1nλτλ=) 最后得:*1*k k x x x x +-≤- 当目标函数为非二次函数时,最速下降算法的收敛速度依然是线性的。