第十二章:主成分分析2013

主成分分析法精华讲义及实例

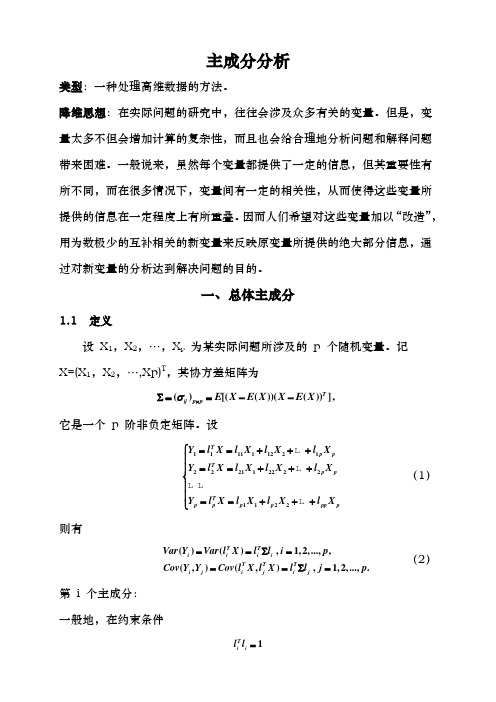

主成分分析类型:一种处理高维数据的方法。

降维思想:在实际问题的研究中,往往会涉及众多有关的变量。

但是,变量太多不但会增加计算的复杂性,而且也会给合理地分析问题和解释问题带来困难。

一般说来,虽然每个变量都提供了一定的信息,但其重要性有所不同,而在很多情况下,变量间有一定的相关性,从而使得这些变量所提供的信息在一定程度上有所重叠。

因而人们希望对这些变量加以“改造”,用为数极少的互补相关的新变量来反映原变量所提供的绝大部分信息,通过对新变量的分析达到解决问题的目的。

一、总体主成分1.1 定义设 X 1,X 2,…,X p 为某实际问题所涉及的 p 个随机变量。

记 X=(X 1,X 2,…,Xp)T ,其协方差矩阵为()[(())(())],T ij p p E X E X X E X σ⨯∑==--它是一个 p 阶非负定矩阵。

设1111112212221122221122Tp p Tp pT pp p p pp p Y l X l X l X l X Y l X l X l X l X Y l X l X l X l X⎧==+++⎪==+++⎪⎨⎪⎪==+++⎩(1) 则有()(),1,2,...,,(,)(,),1,2,...,.T T i i i i TT T i j ijij Var Y Var l X l l i p Cov Y Y Cov l X l X l l j p ==∑===∑= (2)第 i 个主成分: 一般地,在约束条件1T i i l l =及(,)0,1,2,..., 1.T i k i k Cov Y Y l l k i =∑==-下,求 l i 使 Var(Y i )达到最大,由此 l i 所确定的T i i Y l X =称为 X 1,X 2,…,X p 的第 i 个主成分。

1.2 总体主成分的计算设 ∑是12(,,...,)T p X X X X =的协方差矩阵,∑的特征值及相应的正交单位化特征向量分别为120p λλλ≥≥≥≥及12,,...,,p e e e则 X 的第 i 个主成分为1122,1,2,...,,T i i i i ip p Y e X e X e X e X i p ==+++= (3)此时(),1,2,...,,(,)0,.Ti i i i Ti k i k Var Y e e i p Cov Y Y e e i k λ⎧=∑==⎪⎨=∑=≠⎪⎩ 1.3 总体主成分的性质1.3.1 主成分的协方差矩阵及总方差记 12(,,...,)T p Y Y Y Y = 为主成分向量,则 Y=P T X ,其中12(,,...,)p P e e e =,且12()()(,,...,),T T p Cov Y Cov P X P P Diag λλλ==∑=Λ=由此得主成分的总方差为111()()()()(),p ppTTiii i i i Var Y tr P P tr PP tr Var X λ=====∑=∑=∑=∑∑∑即主成分分析是把 p 个原始变量 X 1,X 2,…,X p 的总方差1()pii Var X =∑分解成 p 个互不相关变量 Y 1,Y 2,…,Y p 的方差之和,即1()pii Var Y =∑而 ()k k Var Y λ=。

主成分分析和聚类分析的比较

主成分分析和聚类分析的比较摘要:主成分分析和聚类分析方多元统计中两种重要的分析方法,但却容易在使用中混淆。

本文从基本思想,应用的优缺点、应用实例中讨论两者的异同,并简述两种方法在实际问题中的应用。

关键词:主成分分析;聚类分析一、引言主成分分析是利用降维的思想,在缺失很少信息的前提下,把多个指标转化为几个综合指标的多元统计方法。

通常把转化生成的综合指标称为主成分,其中每个主成分都是原始变量的线性组合,且各个主成分之间互不相关,使得主成分比原始变量具有某些更优越的性能。

聚类分析是依据实验数据本身所具有的定性或定量的特征来对大量的数据进行分组归类以了解数据集的内在结构,并且对每一个数据集进行描述的过程。

其主要依据是聚到同一个数据集的样本应该性质相似,而属于不同组的样本应该足够不相似。

两种方法既有区别又有联系,本文将两者的异同进行比较,并举例说明两者在实际应用中的联系,以便更好地理解这两种统计方法而为实际所应用。

二、基本思想的异同相同点:主成分分析方法是用少数的几个变量来综合反映原始变量的主要信息,变量虽然较原始变量少,但所包含的信息量却占原始信息的85%以上,因此其可信度很高。

通过主成分分析,可以将事物之间错综复杂的关系中找出一些主要成分,从而能有效利用大量统计数据进行定量分析,解释变量之间的内在关系。

因此主成分变量比原始变量少了很多,从而起到了降维的作用。

聚类分析的基本思想是采用多变量的统计值,定量的确定相互之间的亲疏关系,考虑对象多因素的联系和主导作用。

按它们亲疏差异程度,归类不同的分类中的一元。

使分类更具有客观实际并能反映事物的内在必然联系。

聚类分析是通过一种大的对称矩阵来探索相关关系的一种数学分析方法。

对变量分类后,我们对数据的处理难度也降低,所以从某种意义上说,聚类分析也起到了降维的作用。

不同点:主成分分析是研究如何通过原来变量的少数几个变量组合来解释原来变量绝大多数信息的一种多元统计方法。

(完整版)主成分分析在STATA中的实现以及理论介绍

第十二章 主成分分析主成分分分析也称作主分量分析,是霍特林(Hotelling)在1933年首先提出。

主成分分析是利用降维的思想,在损失较少信息的前提下把多个指标转化为较少的综合指标。

转化生成的综合指标即称为主成分,其中每个主成分都是原始变量的线性组合,且各个主成分互不相关。

Stata 对主成分分析的主要内容包括:主成分估计、主成分分析的恰当性(包括负偏协方差矩阵和负偏相关系数矩阵、KMO(Kaiser-Meyer-Olkin)抽样充分性、复相关系数、共同度等指标测度)、主成分的旋转、预测、各种检验、碎石图、得分图、载荷图等。

p j n i b a y ij j i ij ,,2,1,,2,1,' ==+=ε 主成分的模型表达式为:pp j i i i i diag v v v v i p V V C λλλλλλλ≥≥≥=∧=''==∧=∑ 2121),,,,(01其中,a 称为得分,b 称为载荷。

主成分分析主要的分析方法是对相关系数矩阵(或协方差矩阵)进行特征值分析。

Stata 中可以通过负偏相关系数矩阵、负相关系数平方和KMO 值对主成分分析的恰当性进行分析。

负偏相关系数矩阵即变量之间两两偏相关系数的负数。

非对角线元素则为负的偏相关系数。

如果变量之间存在较强的共性,则偏相关系数比较低。

因此,如果矩阵中偏相关系数较高的个数比较多,说明某一些变量与另外一些变量的相关性比较低,主成分模型可能不适用。

这时,主成分分析不能得到很好的数据约化效果。

Kaiser-Meyer-Olkin抽样充分性测度也是用于测量变量之间相关关系的强弱的重要指标,是通过比较两个变量的相关系数与偏相关系数得到的。

KMO介于0于1之间。

KMO越高,表明变量的共性越强。

如果偏相关系数相对于相关系数比较高,则KMO比较低,主成分分析不能起到很好的数据约化效果。

根据Kaiser(1974),一般的判断标准如下:0.00-0.49,不能接受(unacceptable);0.50-0.59,非常差(miserable);0.60-0.69,勉强接受(mediocre);0.70-0.79,可以接受(middling);0.80-0.89,比较好(meritorious);0.90-1.00,非常好(marvelous)。

主成分分析实例和含义讲解

• 这x文6来个)表表,示说hism明toa六rtyh(个(历变数史量学)和),因,e子pnhg的ylis关s(h(系物英。理语为))简,等单ch变记em量,(。我化这们学样用)因x1,,子xli2ft,1e和xr3a,ft2x(与4,语这x5, 些原变量之间的关系是(注意,和主成分分析不同,这里把成分(因

• 主成分分析与因子分析的公式上的区别

y1 a11x1 a12 x2 a1 p x p y2 a21x1 a22 x2 a2 p x p

y p a p1x1 a p2 x2 a pp xp

主成分分析

x1 a11 f1 a12 f2 a1m fm 1 x2 a21 f1 a22 f2 a2m fm 2

2 .353

3 -.040

4 .468

5 .021

6 .068

PHYS

-.674

.531 -.454 -.240 -.001 -.006

CHEM

-.675

.513

.499 -.181

.002

.003

LITERAT .893

.306 -.004 -.037

.077

.320

HISTORY .825

.435

子)写在方程的右边,把原变量写在左边;但相应的系数还是主成分 和各个变量的线性相关系数,也称为因子载荷):

x1 -0 .3 8 7 f1 0 .7 9 0 f2; x2 -0 .1 7 2 f1 0 .8 4 1 f2 ; x3 -0 .1 8 4 f1 0 .8 2 7 f2 x4 0 .8 7 9 f1 - 0 .3 4 3 f2; x5 0 .9 1 1 f1 - 0 .2 0 1 f2; x6 0 .9 1 3 f1 - 0 .2 1 6 f2

主成分分析详解范文

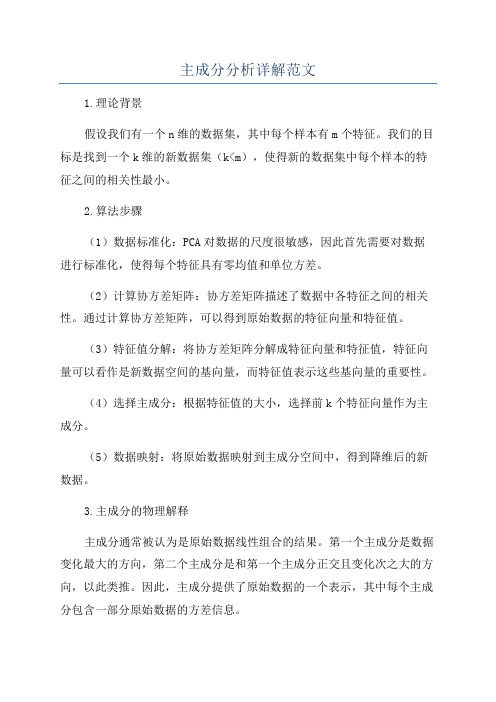

主成分分析详解范文1.理论背景假设我们有一个n维的数据集,其中每个样本有m个特征。

我们的目标是找到一个k维的新数据集(k<m),使得新的数据集中每个样本的特征之间的相关性最小。

2.算法步骤(1)数据标准化:PCA对数据的尺度很敏感,因此首先需要对数据进行标准化,使得每个特征具有零均值和单位方差。

(2)计算协方差矩阵:协方差矩阵描述了数据中各特征之间的相关性。

通过计算协方差矩阵,可以得到原始数据的特征向量和特征值。

(3)特征值分解:将协方差矩阵分解成特征向量和特征值,特征向量可以看作是新数据空间的基向量,而特征值表示这些基向量的重要性。

(4)选择主成分:根据特征值的大小,选择前k个特征向量作为主成分。

(5)数据映射:将原始数据映射到主成分空间中,得到降维后的新数据。

3.主成分的物理解释主成分通常被认为是原始数据线性组合的结果。

第一个主成分是数据变化最大的方向,第二个主成分是和第一个主成分正交且变化次之大的方向,以此类推。

因此,主成分提供了原始数据的一个表示,其中每个主成分包含一部分原始数据的方差信息。

4.特征值与解释方差特征值表示每个主成分的重要性。

较大的特征值对应较重要的主成分。

通过特征值的比例,我们可以了解这些主成分对数据方差的解释程度。

通常,我们选择特征值之和的一部分来解释原始数据方差的比例(例如,90%)。

这样可以帮助我们确定保留多少个主成分,以在保持数据信息的同时降低数据维度。

5.应用场景主成分分析在许多领域都有广泛的应用,包括数据预处理,模式识别,图像处理等。

例如,在图像压缩中,我们可以使用PCA将图像从RGB颜色空间转换为YCbCr颜色空间,然后把Cb和Cr分量降维,从而减少图像的存储空间。

总的来说,主成分分析是一种常用的降维算法,通过找到数据中的主要特征,可以帮助我们减少数据的维度,简化计算和分析的复杂性,并在保持数据信息的同时减少噪声和冗余。

同时,PCA的应用还涉及到数据可视化、数据压缩和模式识别等领域,具有广泛的实际应用价值。

主成分分析

§11.3 总体主成分的推导及性质

性质5

i 1

p

ii

( Fk , X i ) k

2

(k 1,, p)

此性质说明:上表中Fk对应的每一列关于各变量相关系数的加 权平方和为λk即Var(Fk)。

§11.3 总体主成分的推导及性质

§11.4 有关问题的讨论

(一)从协差阵出发还是从相关阵出发求主成分

根据旋转变换的公式:

F1 x1 cos x2 sin F2 x1 sin x2 cos

F1 cos F2 sin sin x1 cos x2

旋转变换的目的是为了使得n个样品点在Fl轴方向 上的离 散程度最大,即Fl的方差最大。变量Fl代表了 原始数据的绝大 部分信息,在研究某问题时,即使不

i ai uia

i 1 p

p

i (ai )(ai )

i 1

p

2 i (a i ) i 1

p

所以, aa 1 ( ai ) 2 =1 ( aU )( aU ) 1aUU a 1aa 1

i 1

而且,当a u1时,有 u1 u1 ( i i i )u1 u1

不直接由其协差阵出发而应该考虑将数据标准化。

原始数据标准化处理后倾向于各个指标的作用在主成分的构成中相等。

数据标准化的过程实际上就是抹杀原始变量离散程度差异的过程,标准化

后各变量方差相等均等于1,而实际上方差也是对数据信息的重要概括形 式,即对原始数据进行标准化后抹杀了一部分重要信息,因此才使得标准 化后各变量在对主成分构成中的作用趋于相等。

主成分分析完整版

体重x3(kg)

38.5 55.5 50.8 65.5 49.0 45.5 51.0 59.5 43.5 53.5

对此进行主成分分析。

1. 求样本均值和样本协方差矩阵

x1 161.2 x2 77.3 x3 51.2

46.67

S 17.12 21.11

30.00 32.58 55.53

1、数据标准化 2、 求相关矩阵R

zij

xij si

xi

R 1 ZZT n1

Z (zij )

3、 计算R的特征值及累积贡献率,并计算相应的特征 向量

经过计算取2个主成分,信息的可靠程度超过85%

F1 0.445Z1 0.48Z2 0.45Z3 0.17Z4 0.58Z5 F2 0.45Z1 0.40Z2 0.436Z3 0.65Z4 0.16Z5

最大。

问对方题应差的的。答 单案 位特是征:向X的量协即方为差矩a11阵, aS2。1的并最且大特征就根是1 F11所的

同样,F2可以表示为 F2 a12 (x1 x1) a22 (x2 x2 )

寻找合适的单位向量 (a12, a22,) 使F2与F1独立,且 使F2的方差(除F1之外)最大。

在F1的表达式中,只有第三个指标Z3(万元产值流动资金占用 率)的系数为负值(-0.45),而Z5的系数最大,Z5与Z3是刻画 企业经营水平高低的。当Z3取值较小,Z5取值较大时,F1就较 大。于是F1在此突出地反映了一个企业经营水平的高低。

由计算结果可见,企业7的经营水平最高,企业2的经营水平最 低。

5. 主成分的含义 F1表示学生身材大小。 F2反映学生的体形特征

三个主成分的方差贡献率分别为:

1 3 i

98.15 98.15 23.60 1.56

主成分分析(principal components analysis,PCA)又称:主分量分析,主成分回归分析法

主成分分析(principal components analysis,PCA)又称:主分量分析,主成分回归分析法什么是主成分分析法主成分分析也称主分量分析,旨在利用降维的思想,把多指标转化为少数几个综合指标。

在统计学中,主成分分析(principal components analysis,PCA)是一种简化数据集的技术。

它是一个线性变换。

这个变换把数据变换到一个新的坐标系统中,使得任何数据投影的第一大方差在第一个坐标(称为第一主成分)上,第二大方差在第二个坐标(第二主成分)上,依次类推。

主成分分析经常用减少数据集的维数,同时保持数据集的对方差贡献最大的特征。

这是通过保留低阶主成分,忽略高阶主成分做到的。

这样低阶成分往往能够保留住数据的最重要方面。

但是,这也不是一定的,要视具体应用而定。

[编辑]主成分分析的基本思想在实证问题研究中,为了全面、系统地分析问题,我们必须考虑众多影响因素。

这些涉及的因素一般称为指标,在多元统计分析中也称为变量。

因为每个变量都在不同程度上反映了所研究问题的某些信息,并且指标之间彼此有一定的相关性,因而所得的统计数据反映的信息在一定程度上有重叠。

在用统计方法研究多变量问题时,变量太多会增加计算量和增加分析问题的复杂性,人们希望在进行定量分析的过程中,涉及的变量较少,得到的信息量较多。

主成分分析正是适应这一要求产生的,是解决这类题的理想工具。

同样,在科普效果评估的过程中也存在着这样的问题。

科普效果是很难具体量化的。

在实际评估工作中,我们常常会选用几个有代表性的综合指标,采用打分的方法来进行评估,故综合指标的选取是个重点和难点。

如上所述,主成分分析法正是解决这一问题的理想工具。

因为评估所涉及的众多变量之间既然有一定的相关性,就必然存在着起支配作用的因素。

根据这一点,通过对原始变量相关矩阵内部结构的关系研究,找出影响科普效果某一要素的几个综合指标,使综合指标为原来变量的线性拟合。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一. 从协方差矩阵出发求解主成分 设 X=(x1,x2,…,xp )´是一个p 维随机向量,∑表示X的协方差矩阵 (covariance matrix ),表达式为:

Cov(x,x)=Var(X)

cov( x1, x2 ) var( x1 ) cov( x x ) var( x2 ) 2, 1 Σ = Cov( x , x ) = L L cov( x p, x1 ) cov( x p, x2 )

Au 1 = λ 1 u 1

Ø 结论:若对称矩阵A为正定矩阵(positive definite matrix),则有: (1)|A| >0 (2)A 所有的特征根都大于等于0

2

第十二章 主成分分析Principal Component Analysis(PCA)

§12.1 主成分分析的基本思想

The basic idea of principal component analysis 在经济实证问题的研究中,要考虑许多对某经济过程有影响的因素 (称为指标或变量)。这时产生了这样的问题,一方面为了避免遗漏重要 的信息而考虑尽可能多的指标;另一方面随指标的增多既增加了问题的复 杂性,还造成信息的重叠,可能会抹杀了事物的真正的特征和内在的规律 性。为了解决这个问题,即产生了主成分分析的方法。 Ø主成分分析的基本思想 经济问题涉及的众多变量之间有一定的相关性,就必然存在着起支 配作用的共同因素。主成分分析就是根据这一点,通过对原始变量相关 矩阵内部结构关系的研究,找出影响某一经济过程的几个综合指标(主 成分)。

由上述原则可知,y1在总方差中占的比重最大,其余综合变量 y2,y3,…,yp的方差依次递减。 在具体经济分析时,我们只挑选前几个方差最大的主成分进行分 析,这样可以简化系统结构、抓住问题实质进行分析。

7

§12.3 主成分的求解方法及性质

The solving method of principal component and properties 主成分分析的思想是在保留原始变量尽可能多的信息的前题下达 到降维的目的. 而求解主成分的过程就是求出满足三个原则的原始变 量的线性组合的过程. 对于随机变量X1,X2,…Xp而言,其协方差矩阵或相关矩阵(原始变 量标准化后的协方差矩阵)是对各变量的离散程度及变量之间的相关 程度的反映. 保留原始信息就是要求生成的综合变量的方差尽可能多的接近原 始变量的方差总和. 一般从原始变量出发求得的主成分与从相关矩阵 出发求得的主成分是有差异的,下面分别就这两个不同的情况进行讨 论.

杜志渊

线性代数知识回顾 Linear Algebra Knowledge Review

Ø 定义:设向量(vector) α=(α1, α2,...α n),β=(β1, β 2...βn) ,则 向量α和β内积的为: α·β = α 1β 1+ α 2 β 2+……+ α n β n 如果两个向量的内积为0,那么它们互相称为正交向量( Orthogonal vector) 。 如果向量α的模长为1,则称α为单位向量。

y 1 = u′ 1x,

y 2 = u ′2 x

L , y p = u′ px Nhomakorabea根据U´∑U=(λ)以及Yi之间相互独立的条件,得出:

var( y i ) = ui′ ∑ ui = λ i cov( y i , y j ) = ui′ ∑ u j = 0

i = 1, 2 , L , p i≠ j

sin θ x 1 = U ′x cos θ x2

cosθ U = sin θ

− sin θ cosθ

U ′ = U − 1 , U ′U = I

其中,U为正交矩阵,满足

X2 Y2

Y1

X1

旋转变换使得 样品点在Y1轴 方向上的离散 程度最大,即 Y1 的方差最 大。 在研究某 经济问题时, 即使不考虑变 量Y2也无损大 局。另外,Y1. Y2还具有不相 关(正交)的 性质 .

Ø 结论:设A为实对称矩阵 ,则存在正交矩阵U,使得:

0 0 λ2 ; AU = U λ M M 0 λn λ i ( i = 1 , 2 , L , n ) 称作矩阵 A 的特征根。 0 L L L L λ1 U ′AU = λ = M 0

u 11 u 12 U = (u 1 , u 2 , L , u n ) u1 = M u 1n 则 u1 就是 λ 1的正交特征向量。

第i个主成分yi 的向量表达式是 : 方差: 协方差:

y i = u′ iX,

i = 1, 2 , L , p

′ ′ cov y i , y j = cov u′ i x , u j x = u i ∑ u j ; i ≠ j;

′ var( y i ) = var( u i′ x ) = u′ i var( x ) u i = u i ∑ u i ;

C的取值可以 任意大

因此,按照上述公式,Y的方差可以任意大。为避免上述情况发 生,对线性变换U必须作出相应的规定。

确定系数 uij的原则:Principle:

u u

u′ k uk = 1

k = 1,2, L, p

yi与yj (i≠j; i,j=1,2, …,p)互不相关 。

u y1是 x1 , x 2 , L , x p 的一切线性组合中方差最大者;y2是与y1不相 关的 所有 x1 , x2 ,L , x p 线性组合中方差最大者;…; yp是与y1, y2, …,yp-1都不相关的 x1 , x 2 , L , x p 的所有线性组合中方差最大者。

3

§12.2 主成分的几何意义与一般数学模型

The geometric meaning of principal components and the general mathematical model

一、主成分的几何意义

The geometric meaning of principal components

(

)

(

)

现在我们所要的问题转化为:在新变量y1, y2,…yp相互独立的条 件下,要求ui使得Var(yi)达到最大。 即在ui´ui =1的限制条件下,使 得ui´x的方差尽可能地大。问题是:满足条件的U是否存在?

根据矩阵代数理论,若∑是正定的,可以证明:协方差阵Σ的非0特 征根λ1≥λ2≥…≥λp >0所对应的单位化的特征向量 u1, u2, …,up, 分 别作为系数向量可以满足以上的要求。 令U =( u1 u2 … up) , 则有 U´∑U=(λ) 其中(λ)是个对角矩阵.因此,记 Y =U´X,则Y的分量可记为:

6

i X 的方 差尽可能大, 线性变换后 Y i = u ′ 则可以得到:

var( Yi ) = var( ui′ X ) = ui′ var( X ) ui = u′ i Σui

若取Yi=Cui´X,C为任一不为0的常数,则有:

var(Yi ) = var(cui′ X ) = c 2 ui′Σui

L cov( x1, x p ) L cov( x2, x p ) = σ ij L L L var( x p )

( )

协方差矩阵的性质:当A,B为常数矩阵时,由定义推出:

1 .Var ( AX ) = AVar ( X ) A ′ = A Σ A ′ 2 .Cov ( AX , BY ) = ACov ( X , Y ) B ′

2 2 α = α 12 + α 2 + L+ αn =1

Ø 定义:如果一个方阵U满足: UU′= U′U =I 其中I单位矩阵,则称U为正交矩阵(orthogonal matrix)。

1

Ø 定义:若A是线性空间中的线性变换对应的矩阵, λ是一个实数,若 存在一个非零向量ξ,满足等式 A ξ= λ ξ,或(A- λI)ξ=0 则称λ为A的一个特征值(根)(eigenvalue),ξ称为A的属于特征值λ的 一个特征向量。上式有非零解的充要条件|A-λI|=0 . 记f(λ)=|λI-A|, f(λ)叫A的特征多项式,其根叫做A的特征根 (值)。对称矩阵的特征根都为实数。 Ø 若A是实对称矩阵(real symmetric matrix), 则A的不同的特征值 对应的特征向量必正交。

3. 设X为p维向量,它的期望值为µ,协方差为∑,A为p×p矩 阵,则: E ( X ′AX ) = tr ( A Σ ) + µ ′A µ

8

经过线性变换

′X y1 = u11 x1 + u21 x2 + L + u p1 x p = u1 ′X y2 = u12 x1 + u22 x2 + L + u p 2 x p = u2 Y = U ′X = L L L L L L y p = u1 p x1 + u2 p x2 + L + u pp x p = u′p X

在涉及多个指标的问题时,为了提高分析效率,不直接对P个指标 构成的指标向量X(X1,X2,…Xp)进行分析, 而是对X进行线性变换, 形成少数几个综合变量Y. 这个变换过程可以通过在二维空间中讨论主 成分的几何意义得到诠释。 设在二维空间中每个样品有两个观测变量x1和x2,如果由变量 和所确定的二维平面中,n个样本点所散布的情况如带状. 即两个变 量之间具有一定的相关性.

将二维空间点的描述用Y1这个综合变量来代替,所损失的信息最 小,由此Y1称为第一主成分, Y2为第二主成分。若忽略Y2方向上的经 济信息,且损失的信息并不多。这样,二维空间降为一维空间了。

5

二、主成分分析的基本理论

The basic theory of principal component analysis 经济研究中经常见到的是关于n个样品(企业、年份),p个变量(经 济指标、因素) X1X2 … Xp ( n >p )的问题,设随机向量X的均值为µ, 协 方差为∑.经原始统计资料整理的原始数据矩阵为: