粒子群优化论文

粒子群算法改进及其应用-硕士论文

2.1 粒子群算法简介 ................................................................................................ 4 2.2 基本粒子群算法 ................................................................................................ 4 2.3 粒子群算法流程 ................................................................................................ 5 2.4 粒子群算法的改进 ............................................................................................ 6

摘要

粒子群算法改进及应用

摘要

粒子群优化算法最早是由 Eberhart 和 Kennedy 模拟自然界的生物群体觅 食提出的一种群智能化方法。后来 Shi 等人引入惯性权重来更好的控制收敛和 探索,形成了当前的标准 PSO 算法。由于该算法实现简单,需要调整的参数 少,已被广泛地应用于函数优化、通信系统设计、电子系统设计以及经济管 理等领域。

学 校 代 码 10608

学

号 200808120306

分 类 号 TP18

粒子群优化算法的研究及改进

optimized function is differentiable,derivative

continuous.The PSO

is

simple in structure,fast in

convergence,few

in parameters and easy in programming.

So it has attracted researchers at home and abroad and applyed in many areas since it is

systematic

study

PSO

on

the aspects of

algorithm modification

and used

and its application.The main

content

is

arranged as

(1)Upon analysing the

capabilities systems is

1 3 benchmark functions.The results indicate that GPSO algorithm have improved

performance

(3)Based

on

of the

convergence

speed and the search accuracy. the

and the algorithm

to‘'premature

convergence”.Finally,the

PSO algorithm is not strong in of the

a

climbing ability and lack of

基于改进粒子群算法的工程设计优化问题研究

基于改进粒子群算法的工程设计优化问题研究在当今的工程领域,优化设计问题至关重要。

它不仅能够提高工程产品的性能和质量,还能有效降低成本和缩短研发周期。

而粒子群算法作为一种强大的优化工具,在解决工程设计优化问题方面展现出了巨大的潜力。

然而,传统的粒子群算法在某些复杂的工程问题中可能存在局限性,因此对其进行改进成为了研究的热点。

粒子群算法的基本原理是模拟鸟群觅食的行为。

在算法中,每个粒子代表问题的一个潜在解,它们在解空间中飞行,通过不断调整自己的速度和位置来寻找最优解。

粒子的速度和位置更新取决于其自身的历史最优位置和整个群体的历史最优位置。

这种简单而有效的机制使得粒子群算法在处理许多优化问题时表现出色。

然而,在实际的工程设计优化中,问题往往具有高维度、多约束和非线性等特点,这给传统粒子群算法带来了挑战。

例如,在高维度空间中,粒子容易陷入局部最优解;多约束条件可能导致算法难以满足所有约束;非线性特性则可能使算法的搜索变得困难。

为了克服这些问题,研究人员提出了多种改进粒子群算法的策略。

其中一种常见的方法是引入惯性权重。

惯性权重的引入可以控制粒子的飞行速度,使其在搜索过程中更好地平衡全局搜索和局部搜索能力。

较大的惯性权重有利于全局搜索,能够帮助粒子跳出局部最优;较小的惯性权重则有助于在局部区域进行精细搜索,提高解的精度。

另一种改进策略是对粒子的学习因子进行调整。

学习因子决定了粒子向自身历史最优位置和群体历史最优位置学习的程度。

通过合理设置学习因子,可以提高算法的收敛速度和搜索效率。

此外,还有一些研究将粒子群算法与其他优化算法相结合,形成混合算法。

例如,将粒子群算法与遗传算法相结合,利用遗传算法的交叉和变异操作来增加种群的多样性,避免算法早熟收敛。

在工程设计优化问题中,改进粒子群算法已经取得了许多显著的成果。

以机械工程中的结构优化设计为例,通过改进粒子群算法,可以在满足强度、刚度等约束条件的前提下,优化结构的形状、尺寸和材料分布,从而减轻结构重量,提高结构的性能。

毕业设计(论文)-一种改进的粒子群算法

南京邮电大学毕业设计(论文)题目一种改进的粒子群算法专业网络工程学生姓名班级学号指导教师指导单位物联网学院日期:2017年1月15日至2017年6月16日毕业设计(论文)原创性声明本人郑重声明:所提交的毕业设计(论文),是本人在导师指导下,独立进行研究工作所取得的成果。

除文中已注明引用的内容外,本毕业设计(论文)不包含任何其他个人或集体已经发表或撰写过的作品成果。

对本研究做出过重要贡献的个人和集体,均已在文中以明确方式标明并表示了谢意。

论文作者签名:日期:年月日摘要粒子群优化(PSO: Particle Swarm Optimization)是在20世纪被引入的一种强大且广泛使用的群优化计算方式,用于解决优化问题。

由于其实施的简单性,PSO 在过去几十年中已经广泛应用于各个领域。

粒子群的个体行为和整体行为互相影响,粒子之间信息互换,群体之间的信息共享,因此可通过粒子的协作对分布式问题进行求解。

粒子群算法具有参数较少、实现容易、寻找能力强的优点。

但是随着当前问题的规模不断增大,粒子群算法常常容易陷入搜索精度不足的问题。

针对上述问题,研究人员提出了许多的优化策略,社会学习机制就是其中的一种。

社会学习机制包含好几种学习机制,即联结,强化和模仿。

在这些机制中,应用最广泛的社会学习机制是模仿。

同样在粒子群算法中粒子与粒子之间的相互学习影响也可以利用这种机制。

粒子通过动态学习自身历史经验和模仿周围粒子的社会经验完成粒子最优解的搜索。

这种基于模仿的社会学习机制可以使得算法的搜索性能更加的强大。

本文将社会学习机制引入PSO,提出了一种基于社会学习的改进的粒子群算法,称为SL-PSO(Social Learning-Particle Swarm Optimization),仿真实验表明所提出的基于整个群体的算法在问题的维度变化的时候具有较好的性能,但是收敛速度慢的问题我们不能忽略。

为了避免出现收敛速度慢的问题,我们需要减少搜索范围,然后将向整个种群中的行为学习改变成向前5个优秀学习的粒子进行学习,并且定义为ISL-PSO(Improved Social Learning-Particle Swarm Optimization)。

粒子群优化方法范文

粒子群优化方法范文

具体而言,粒子群优化算法包括以下几个步骤:

1.初始化粒子群:设定种群中粒子的初始位置和初始速度,并为每个粒子随机分配初始解。

2.评估个体适应度:通过适应度函数评估每个粒子的适应度,确定其解的质量。

3.更新粒子速度和位置:根据自身历史最优解和全局历史最优解,调整粒子的速度和位置,并更新粒子自身的最优解。

4.更新全局最优解:根据所有粒子的最优解,更新全局最优解,记录当前到的最佳解。

5.判断终止条件:设定终止条件,例如达到最大迭代次数、适应度值的收敛等,判断是否结束优化。

6.迭代更新:不断重复步骤2至5,直到满足终止条件。

相对于其他优化算法,粒子群优化算法具有以下优点:

1.简单而直观:算法的核心思想易于理解,模拟了生物群体的行为规律。

2.全局能力:粒子群优化算法可以问题的全局最优解,避免陷入局部最优解。

3.并行化和分布式计算:粒子群优化算法的并行化和分布式计算非常容易实现,能够加速求解过程。

然而,粒子群优化算法也存在一些不足之处:

1.对参数的敏感性:算法的性能受到参数设置的影响,不同问题需要不同的参数组合。

2.适应度函数的选取:适应度函数的选择对算法的结果有着重要的影响,需要根据问题的特点进行合理的设计。

3.收敛速度较慢:在寻找复杂问题的最优解时,粒子群优化算法可能需要较长的时间来收敛。

总之,粒子群优化算法是一种有效的全局优化算法,能够在多种问题中找到较优解。

通过合理选择参数和适应度函数,并结合其他优化方法,可以进一步提高算法的性能和收敛速度。

改进的粒子群优化算法研究及其若干应用

改进的粒子群优化算法研究及其若干应用一、本文概述随着和计算智能的快速发展,群体智能优化算法已成为解决复杂优化问题的重要手段。

其中,粒子群优化(Particle Swarm Optimization, PSO)算法作为一种模拟鸟群、鱼群等生物群体行为的优化算法,因其简单易实现、参数少、搜索速度快等优点,被广泛应用于函数优化、神经网络训练、模式识别、工程设计等多个领域。

然而,传统的粒子群优化算法也存在易陷入局部最优、收敛速度慢、全局搜索能力弱等问题。

因此,对粒子群优化算法进行改进,提高其优化性能和应用范围,具有重要的理论价值和现实意义。

本文首先介绍了粒子群优化算法的基本原理和发展历程,分析了其优缺点及适用场景。

在此基础上,重点研究了几种改进的粒子群优化算法,包括引入惯性权重的PSO算法、基于社会心理学的PSO算法、基于混合策略的PSO算法等。

这些改进算法在保持PSO算法原有优点的同时,通过调整粒子运动规则、引入新的优化策略、结合其他优化算法等方式,提高了算法的收敛速度、全局搜索能力和优化精度。

本文还将探讨这些改进的粒子群优化算法在若干实际问题中的应用,如函数优化问题、神经网络训练问题、路径规划问题等。

通过实际应用案例的分析和比较,验证了改进算法的有效性和优越性,为粒子群优化算法在实际问题中的应用提供了有益的参考和借鉴。

本文旨在深入研究和改进粒子群优化算法,探索其在复杂优化问题中的应用潜力,为推动群体智能优化算法的发展和应用做出贡献。

二、粒子群优化算法的基本原理粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化搜索技术,由Eberhart和Kennedy于1995年提出。

该算法模拟了鸟群觅食过程中的社会行为,通过个体(粒子)之间的信息共享和协作,达到在搜索空间内寻找最优解的目的。

在PSO中,每个粒子代表问题解空间中的一个候选解,每个粒子都有一个适应度值,用于衡量其解的优劣。

基于粒子群优化算法的研究

1、参数优化:这方面的研究主要集中在如何调整算法的参数以获得更好的 优化效果。例如,如何设置惯性权重w、加速常数c1和c2等参数。

2、混合算法:这方面的研究主要集中在如何将粒子群优化算法与其他优化 算法或启发式算法相结合,以获得更好的优化效果。例如,将粒子群优化算法与 遗传算法相结合,形成一种混合的优化算法。

1、函数优化:粒子群优化算法可以用于寻找给定函数的最小值或最大值。 例如,可以用于求解多元函数的最小值,或者用于约束优化问题。

2、神经网络训练:在神经网络训练中,粒子群优化算法可以用于优化神经 网络的连接权值和偏置项,以提高网络的训练效果。

3、控制系统设计:粒子群优化算法可以用于优化控制系统的参数,以提高 系统的性能和稳定性。例如,可以用于优化PID控制器的参数。

基于粒子群优化算法的研究

目录

01 粒子群优化算法的基 本原理

02

粒子群优化算法的应 用领域

03

粒子群优化算法的研 究现状

04

粒子群优化算法的发 展趋势

05 参考内容

粒子群优化算法是一种基于群体智能的优化算法,它受到鸟群觅食行为的启 发而发展起来。在过去的几十年里,粒子群优化算法在许多领域得到了广泛的应 用,如函数优化、神经网络训练、控制系统设计等。本次演示将介绍粒子群优化 算法的基本原理、应用领域、研究现状和发展趋势。

3、多目标优化:这方面的研究主要集中在如何利用粒子群优化算法解决多 目标优化问题。多目标优化问题比单目标优化问题更加复杂,需要考虑多个目标 的平衡和优化。

4、约束处理:这方面的研究主要集中在如何处理约束条件。在许多实际问 题中,优化问题往往受到一些约束条件的限制,如何处理这些约束条件是优化算 法的关键。

2、改进版本

学术研究中的粒子群优化算法

学术研究中的粒子群优化算法摘要:粒子群优化算法是一种基于群体智能的优化算法,具有易于实现、鲁棒性强等特点,被广泛应用于各种优化问题。

本文主要介绍了粒子群优化算法的基本原理、算法流程、参数选择和改进方法,并讨论了其在学术研究中的应用。

一、引言随着计算机科学和人工智能技术的不断发展,优化算法在各个领域得到了广泛应用。

粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化算法,通过模拟鸟群觅食过程中的行为,寻找最优解。

与其他优化算法相比,PSO具有易于实现、鲁棒性强、适用范围广等特点,因此在学术研究和工业应用中得到了广泛关注。

二、粒子群优化算法的基本原理粒子群优化算法是一种基于种群的随机搜索算法,通过不断迭代寻找最优解。

在算法中,每个粒子表示一个潜在解,其位置和速度反映了该解的质量。

每个粒子都会根据历史最佳解(Best Personal Best)和群体最佳解(Best Global Best)来更新自己的位置和速度。

在每一代,粒子会根据适应度函数评估自己的质量,并不断更新最佳解。

最终,算法将收敛于一群局部最优解,其中包含真实的最优解。

三、粒子群优化算法的流程1.初始化:随机生成一组粒子,每个粒子的位置和速度表示一个潜在解。

2.适应度评估:根据适应度函数评估每个粒子的质量,并记录最佳解。

3.更新最佳解:每个粒子根据自身最佳解和全局最佳解更新位置和速度。

4.更新粒群:将新生成的粒子加入粒群中,并根据粒群大小调整粒子的数量。

5.终止条件:当满足终止条件(如达到最大迭代次数或最优解的改变小于某个阈值)时,算法停止并输出全局最佳解。

四、参数选择和改进方法粒子群优化算法的参数包括种群规模、迭代次数、学习因子等。

这些参数的选择对算法的性能有重要影响。

合适的参数设置可以提高算法的搜索效率和精度。

此外,为了进一步提高算法的性能,可以对PSO进行一些改进,如引入惯性权重的自适应调整、引入惯性权重的混合PSO、离散空间PSO等。

粒子群优化算法论文

粒子群优化算法论文粒子群优化算法摘要近年来,智能优化算法—粒子群算法(particle swarm optimization,简称PSO)越来越受到学者的关注。

粒子群算法是美国社会心理学家JamesKennedy 和电气工程师Russell Eberhart在1995年共同提出的,它是受到鸟群社会行为的启发并利用了生物学家Frank Heppner的生物群体模型而提出的。

它用无质量无体积的粒子作为个体,并为每个粒子规定简单的社会行为规则,通过种群间个体协作来实现对问题最优解的搜索。

由于算法收敛速度快,设置参数少,容易实现,能有效地解决复杂优化问题,在函数优化、神经网络训练、图解处理、模式识别以及一些工程领域都得到了广泛的应用。

PSO是首先由基于不受约束的最小化问题所提出的基于最优化技术。

在一个PSO系统中,多元化解决方案共存且立即返回。

每种方案被称作“微粒”,寻找空间的问题的微粒运动着寻找目标位置。

一个微粒,在他寻找的时间里面,根据他自己的以及周围微粒的经验来调整他的位置。

追踪记忆最佳位置,遇到构建微粒的经验。

因为那个原因,PSO占有一个存储单元(例如,每个微粒记得在过去到达时的最佳位置)。

PSO系统通过全局搜索方法(通过)搜索局部搜索方法(经过自身的经验),试图平衡探索和开发。

粒子群优化算法是一种基于群体的自适应搜索优化算法,存在后期收敛慢、搜索精度低、容易陷入局部极小等缺点,为此提出了一种改进的粒子群优化算法,从初始解和搜索精度两个方面进行了改进,提高了算法的计算精度,改善了算法收敛性,很大程度上避免了算法陷入局部极小.对经典函数测试计算,验证了算法的有效性。

关键词:粒子群优化算法;粒子群;优化技术;最佳位置;全局搜索;搜索精度Particle swarm optimization (PSO) algorithm is a novel evolutionary algorithm. It is a kind of stochastic global optimization technique. PSO finds optimal regions of complex search spaces through the interaction of individualsin a population of particles. The advantages of PSO lie in simple and powerful function. In this paper , classical particle swarm optimization algorithm , thepresent condition and some applications of the algorithms are introduced , and the possible research contents in future are also discussed.PSO is a population-based optimization technique proposed firstly for the above unconstrained minimization problem. In a PSO system, multiple candidate solutions coexist and collaborate simultaneously. Each solution called a ‘‘particle’’, flies in the problem sear ch space looking for the optimal position to land. A particle, as time passes through its quest, adjusts its position according to its own ‘‘experience’’ as well as the experience of neighboring particles. Tracking and memorizing the best position encountered build particle_s experience. For that reason, PSO possesses a memory (i.e. every particle remembers the best position it reached during the past). PSO system combines local search method(through self experience) with global search methods (through neighboring experience), attempting to balance explorationand exploitation.Abstract Particle Swarm Optimization Algorithm is a kind of auto-adapted search optimization based on community.But the standard particle swarm optimization is used resulting in slow after convergence, low search precision and easily leading to local minimum. A new Particle Swarm Optimization algorithm is proposed to improve from the initial solution and the search precision. The obtained results showed the algorithm computation precision and the astringency are improved,and local minimum is avoided. The experimental results of classic functions show that the improved PSO is efficientand feasible.Key words :particle swarm optimization algorithms ; unconstrained minimization problem;the bestposition;global search methods; the search precision目录一.引言二.PSO算法的基本原理和描述(一)概述(二)粒子群优化算法(三)一种改进型PSO算法——基于遗传交叉因子的粒子群优化算法简介1 自适应变化惯性权重2 交叉因子法(四) PSO与GA算法的比较1 PSO算法与GA算法2 PSO算法与GA算法的相同点3 PSO算法与GA算法的不同点三.PSO算法的实现及实验结果和仿真(一)基本PSO算法(二)算法步骤(三)伪代码描述(四)算法流程图(五)六个测试函数的运行结果及与GA算法结果的比较四结论五. 致谢六.参考文献一、引言混沌是一种有特点的非线形系统,它是一种初始时存在于不稳定的动态状态而且包含着无限不稳定时期动作的被束缚的行为。

粒子群算法论文

VS

详细描述

组合优化问题是指在一组离散的元素中寻 找最优解的问题,如旅行商问题、背包问 题等。粒子群算法通过模拟群体行为进行 寻优,能够有效地求解这类问题。例如, 在旅行商问题中,粒子群算法可以用来寻 找最短路径;在背包问题中,粒子群算法 可以用来寻找最大化的物品价值。

粒子群算法在组合优化问题中的应用

粒子群算法论文

目录

CONTENTS

• 粒子群算法概述 • 粒子群算法的理论基础 • 粒子群算法的改进与优化 • 粒子群算法的实际应用 • 粒子群算法的未来展望

01 粒子群算法概述

粒子群算法的基本原理

粒子群算法是一种基于群体智能的优化算法,通过模拟鸟群、鱼群等生物群体的行 为规律,利用粒子间的信息共享和协作机制,寻找最优解。

高模型的决策能力和性能。

05 粒子群算法的未来展望

粒子群算法与其他智能算法的融合研究

融合遗传算法

通过引入遗传算法的变异、交叉和选 择机制,增强粒子群算法的搜索能力 和全局寻优能力。

混合粒子群优化

结合其他优化算法,如模拟退火、蚁 群算法等,形成混合优化策略,以处 理多目标、约束和大规模优化问题。

粒子群算法的理论基础深入研究

通过对粒子群算法的收敛性进行分析, 可以发现算法在迭代过程中粒子的分 布规律以及最优解的稳定性,有助于 优化算法参数和提高算法性能。

粒子群算法的参数优化

参数优化是提高粒子群算法性能 的关键步骤之一,主要涉及粒子 数量、惯性权重、学习因子等参

数的调整。

通过对参数进行优化,可以改善 粒子的搜索能力和全局寻优能力,

总结词

粒子群算法在机器学习中可以用于特征选择、模型选择 和超参数调整等方面。

详细描述

机器学习是人工智能领域的一个重要分支,旨在通过训 练数据自动地学习和提取有用的特征和规律。粒子群算 法可以应用于机器学习的不同方面,如特征选择、模型 选择和超参数调整等。通过模拟群体行为进行寻优,粒 子群算法可以帮助机器学习模型找到最优的特征组合、 模型参数和超参数配置,从而提高模型的性能和泛化能 力。

粒子群优化方法

粒子群优化方法(原创版3篇)目录(篇1)一、粒子群优化算法的概念和原理二、粒子群优化算法的参数设置三、粒子群优化算法的应用实例四、粒子群优化算法的优缺点正文(篇1)一、粒子群优化算法的概念和原理粒子群优化算法(Particle Swarm Optimization,简称 PSO)是一种基于群体搜索的优化算法,它建立在模拟鸟群社会的基础上。

在粒子群优化中,被称为粒子”(particle)的个体通过超维搜索空间流动。

粒子在搜索空间中的位置变化是以个体成功地超过其他个体的社会心理意向为基础的,因此,群中粒子的变化是受其邻近粒子(个体)的经验或知识影响。

二、粒子群优化算法的参数设置在应用粒子群优化算法时,需要设置以下几个关键参数:1.粒子群规模:粒子群规模是指优化过程中粒子的数量。

对种群规模要求不高,一般取 20-40 就可以达到很好的求解效果,不过对于比较难的问题或者特定类别的问题,粒子数可以取到 100 或 200。

2.粒子的长度:粒子的长度由优化问题本身决定,就是问题解的长度。

粒子的范围由优化问题本身决定,每一维可以设定不同的范围。

3.惯性权重:惯性权重是粒子群优化算法中的一个重要参数,它影响了粒子在搜索空间中的移动方式。

惯性权重的取值范围为 0-1,当惯性权重接近 1 时,粒子移动方式更接近于粒子群优化算法的原始模型,当惯性权重接近 0 时,粒子移动方式更接近于随机搜索。

4.学习因子:学习因子是粒子群优化算法中另一个重要参数,它影响了粒子在搜索空间中的搜索方式。

学习因子的取值范围为 0-1,当学习因子接近 1 时,粒子搜索方式更偏向于全局搜索,当学习因子接近 0 时,粒子搜索方式更偏向于局部搜索。

三、粒子群优化算法的应用实例粒子群优化算法广泛应用于各种优化问题中,如函数优化、机器学习、信号处理、控制系统等。

下面以函数优化为例,介绍粒子群优化算法的应用过程。

假设我们要求解函数 f(x)=x^2-6x+5 的最小值,可以通过粒子群优化算法来实现。

粒子群算法在优化问题中的应用研究

粒子群算法在优化问题中的应用研究近年来,随着计算机技术的飞速发展,优化问题已成为了计算机科学和工程领域中的重要问题之一。

而粒子群算法(Particle Swarm Optimization,PSO)则以其简单、高效的特点备受广泛关注,成为了优化问题中的一种重要方法。

本文将会对粒子群算法在优化问题中的应用进行研究和探讨。

一、粒子群算法原理粒子群算法是一种优化算法,灵感来源于鸟群或鱼群等群体中的集体行为。

在算法中,被称为粒子的个体将会在搜索空间中寻找最优解。

粒子的位置和速度由其历史最优解和群体历史最优解决定,粒子会根据自己的历史和群体历史寻找最优解。

算法通过适应值来确定每个粒子的适应程度。

最基本的粒子群算法可以按照以下步骤进行:1. 初始化种群2. 计算适应值函数3. 计算粒子速度和位置4. 更新历史最优解和群体历史最优解5. 结束条件二、粒子群算法的应用领域粒子群算法已经被广泛应用于很多领域,以下是一些常见的应用领域。

1. 机器学习和数据挖掘在机器学习和数据挖掘中,粒子群算法可以应用于神经网络、聚类和决策树等算法中,以寻找最优解,提高模型的准确性。

2. 多目标优化多目标优化问题是一个在工程领域中十分重要的问题。

而粒子群算法可以应用于多维和多目标优化问题中,通过调整不同的参数来寻找最优解。

3. 物流和制造业在物流和制造业中,粒子群算法可以用于优化生产流程和降低成本。

例如,可以使用粒子群算法来优化仓库的存储布局和物品的运输路径。

4. 交通管理在交通管理领域中,粒子群算法可以优化公共交通和行车路径,减少拥堵和时间成本。

三、粒子群算法在工程领域中的应用在工程领域中,粒子群算法也有着广泛的应用,以下是一些应用案例。

1. 机器人路径规划机器人路径规划是一个在自动化制造业中重要的问题。

使用粒子群算法来规划机器人路径可以提高生产效率和降低成本。

2. 无线传感器网络在无线传感器网络中,节点的位置对于网络的性能非常重要。

粒子群优化算法-毕业论文

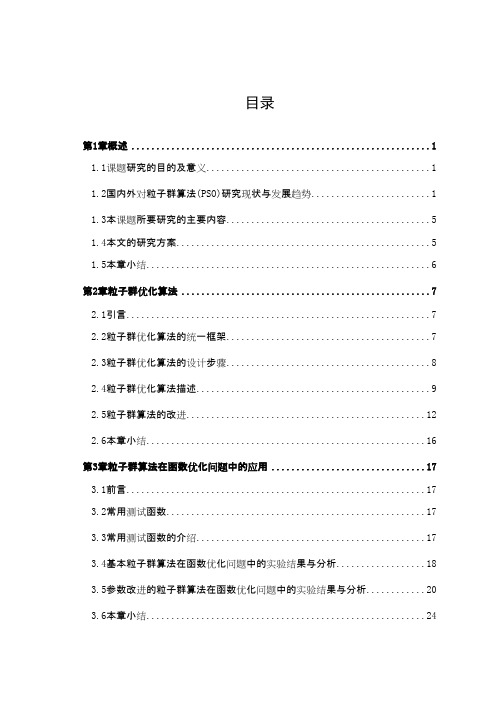

目录第1章概述 (1)1.1课题研究的目的及意义 (1)1.2国内外对粒子群算法(PSO)研究现状与发展趋势 (1)1.3本课题所要研究的主要内容 (5)1.4本文的研究方案 (5)1.5本章小结 (6)第2章粒子群优化算法 (7)2.1引言 (7)2.2粒子群优化算法的统一框架 (7)2.3粒子群优化算法的设计步骤 (8)2.4粒子群优化算法描述 (9)2.5粒子群算法的改进 (12)2.6本章小结 (16)第3章粒子群算法在函数优化问题中的应用 (17)3.1前言 (17)3.2常用测试函数 (17)3.3常用测试函数的介绍 (17)3.4基本粒子群算法在函数优化问题中的实验结果与分析 (18)3.5参数改进的粒子群算法在函数优化问题中的实验结果与分析 (20)3.6本章小结 (24)结论 (25)参考文献 (26)致谢 (29)附录1 (30)附录2 (32)附录3 (33)第1章概述1.1课题研究的目的及意义近年来,受自然隐喻的启发,人们提出了各种各样的计算智能方法,如人工神经网络、遗传算法( Genetic Algorithm,GA )、蚁群优化算法( Ant Colony Optimization ,ACO)、粒子群优化算法( Particle Swarm Optimization,PSO)和人工免疫系统等等,它们被广泛应用于各种NP -困难的优化问题的求解,虽然不能保证获取最优解,但在问题规模较大时也能在可行时间内找到问题的满意解。

粒子群优化(Particle SwarmOptimization,PSO)算法是一种新兴的优化技术,其思想来源于人工生命和进化计算理论。

PSO算法通过粒子追随自己找到的最好解和整个群体的最好解完成优化。

为了避免PSO算法在求解最优化问题时陷入在局部最优及提高PSO算法的收敛速度,提出了对PSO算法进行改进。

对无约束和有约束最优化问题分别设计了基于PSO算法的不同的求解方法和测试函数,并对PSO算法求解多目标优化问题进行了研究。

关于粒子群优化的英文摘要范文

关于粒子群优化的英文摘要范文Particle Swarm Optimization (PSO): A Comprehensive Literature Review.Abstract.Particle swarm optimization (PSO) is a metaheuristic algorithm inspired by the social behavior of bird flockingor fish schooling. It has been widely applied to solve various optimization problems in engineering, science, and business. This paper provides a comprehensive literature review of PSO, covering its history, variants, applications, and challenges.Introduction.PSO was first proposed by Kennedy and Eberhart in 1995. It is a population-based algorithm, where each particle represents a potential solution to the optimization problem. Particles move through the search space, guided by theirown experience (individual best) and the experience of the entire swarm (global best).Variants of PSO.Since its inception, PSO has been extensively modified and improved, resulting in numerous variants. Some of the most notable variants include:Binary PSO: Designed for problems with binary variables.Multi-Objective PSO: Handles optimization problems with multiple objectives.Hybrid PSO: Combines PSO with other optimization algorithms, such as genetic algorithms or simulated annealing.Applications of PSO.PSO has been successfully applied to a wide range ofoptimization problems, including:Engineering design.Machine learning.Supply chain management.Financial modeling.Image processing.Challenges in PSO.Despite its success, PSO faces several challenges:Premature convergence: The swarm may prematurely converge to a local optimum.Parameter tuning: The algorithm's parameters (e.g., inertia weight, acceleration coefficients) can significantly affect its performance.High computational cost: PSO can be computationally expensive for large-scale optimization problems.Recent Advancements.Recent research has focused on addressing these challenges and further improving PSO's performance:Adaptive parameter tuning: Automates the adjustment of PSO parameters.Ensemble PSO: Utilizes multiple PSO runs to enhance robustness and exploration.Cognitive and social components: Explores the balance between individual and swarm behavior.Conclusion.Particle swarm optimization is a powerful and versatile metaheuristic algorithm that has been successfully appliedto a wide range of optimization problems. It is continuously being improved and adapted, with recent advancements addressing challenges and enhancing its capabilities. PSO remains a valuable tool for researchers and practitioners seeking efficient and effective solutions to complex optimization problems.。

粒子群算法论文范文

粒子群算法论文范文在粒子群算法中,每个个体被称为粒子,每个粒子都有一个位置和速度。

每个粒子通过更新自己的速度和位置来最优解。

更新过程涉及到个体的历史最优位置和群体的历史最优位置,被记为pbest和gbest。

粒子根据自己的速度和位置以及pbest和gbest来计算下一次的速度和位置。

通过不断迭代更新,粒子群逐渐收敛于最优解。

PSO算法的核心思想是通过合作和信息交流来实现全局和局部的平衡。

每个粒子都有自己的经验和知识,通过与周围粒子的交流不断更新自己的位置和速度。

当一个粒子找到更好的位置时,会通过更新pbest来存储自己的历史最优位置;当整个粒子群找到更好的位置时,会通过更新gbest来存储全局最优位置。

通过这种方式,粒子群能够在过程中不断自我调整,逐渐靠近最优解。

PSO算法的优势在于其简便性和并行性。

算法的流程简单明了,易于理解和实现。

同时,每个粒子都是独立的个体,可以并行地进行计算,提高了算法的效率。

此外,粒子群算法能够通过参数的调整适应不同类型的问题,并且对问题的数学模型没有要求,具有一定的鲁棒性。

虽然PSO算法具有许多优势,但也存在一些不足之处。

首先,PSO算法对参数的敏感性较高,不同问题需要不同的参数设置才能获得较好的优化效果。

其次,算法的收敛性和局部最优解问题仍然是研究的重点。

虽然算法能够通过速度和位置的更新来实现全局和局部的平衡,但是当空间较大或者存在复杂的函数拓扑结构时,算法容易陷入局部最优解。

在最近的研究中,学者们对PSO算法进行了各种改进和优化。

例如,引入自适应权重、多群体协同、约束处理等方法,来提高算法的性能和适应性。

此外,与其他优化算法相结合的混合算法也被广泛研究,以克服各自算法的局限性。

综上所述,粒子群算法是一种基于群体协作和信息交流的优化算法。

通过不断更新速度和位置来最优解。

该算法具有简便性、并行性和鲁棒性,可以应用于多种优化问题。

但在实际应用中需要根据具体问题进行参数调整,并且对于复杂问题容易陷入局部最优解。

粒子群算法(优化算法)毕业设计毕设论文(包括源代码实验数据,截图,很全面的)

毕业论文题目粒子群算法及其参数设置专业信息与计算科学班级计算061学号3060811007学生xx指导教师徐小平2010年I粒子群优化算法及其参数设置专业:信息与计算科学学生: xx指导教师:徐小平摘要粒子群优化是一种新兴的基于群体智能的启发式全局搜索算法,粒子群优化算法通过粒子间的竞争和协作以实现在复杂搜索空间中寻找全局最优点。

它具有易理解、易实现、全局搜索能力强等特点,倍受科学与工程领域的广泛关注,已经成为发展最快的智能优化算法之一。

论文介绍了粒子群优化算法的基本原理,分析了其特点。

论文中围绕粒子群优化算法的原理、特点、参数设置与应用等方面进行全面综述,重点利用单因子方差分析方法,分析了粒群优化算法中的惯性权值,加速因子的设置对算法基本性能的影响,给出算法中的经验参数设置。

最后对其未来的研究提出了一些建议及研究方向的展望。

关键词:粒子群优化算法;参数;方差分析;最优解IIParticle swarm optimization algorithm and itsparameter setSpeciality: Information and Computing ScienceStudent: Ren KanAdvisor: Xu XiaopingAbstractParticle swarm optimization is an emerging global based on swarm intelligence heuristic search algorithm, particle swarm optimization algorithm competition and collaboration between particles to achieve in complex search space to find the global optimum. It has easy to understand, easy to achieve, the characteristics of strong global search ability, and has never wide field of science and engineering concern, has become the fastest growing one of the intelligent optimization algorithms. This paper introduces the particle swarm optimization basic principles, and analyzes its features. Paper around the particle swarm optimization principles, characteristics, parameters settings and applications to conduct a thorough review, focusing on a single factor analysis of variance, analysis of the particle swarm optimization algorithm in the inertia weight, acceleration factor setting the basic properties of the algorithm the impact of the experience of the algorithm given parameter setting. Finally, its future researched and prospects are proposed.Key word:Particle swarm optimization; Parameter; Variance analysis; Optimal solutionIII目录摘要 (II)Abstract ............................................................................................................................. I II 1.引言. (1)1.1 研究背景和课题意义 (1)1.2 参数的影响 (1)1.3 应用领域 (2)1.4 电子资源 (2)1.5 主要工作 (2)2.基本粒子群算法 (3)2.1 粒子群算法思想的起源 (3)2.2 算法原理 (4)2.3 基本粒子群算法流程 (5)2.4 特点 (6)2.5 带惯性权重的粒子群算法 (7)2.7 粒子群算法的研究现状 (8)3.粒子群优化算法的改进策略 (9)3.1 粒子群初始化 (9)3.2 邻域拓扑 (9)3.3 混合策略 (12)4.参数设置 (14)4.1 对参数的仿真研究 (14)4.2 测试仿真函数 (15)4.3 应用单因子方差分析参数对结果影响 (33)4.4 对参数的理论分析 (34)5结论与展望 (39)致谢 (43)附录 (44)IV11.引言1.1 研究背景和课题意义“人工生命”是来研究具有某些生命基本特征的人工系统。

《粒子群优化算法研究及在阵列天线中的应用》范文

《粒子群优化算法研究及在阵列天线中的应用》篇一一、引言随着科技的进步,优化算法在众多领域中发挥着越来越重要的作用。

粒子群优化算法(Particle Swarm Optimization, PSO)作为一类群体智能优化算法,凭借其出色的全局寻优能力及良好的适应性,已广泛应用于众多工程优化问题。

尤其是在阵列天线的设计与优化中,粒子群优化算法表现出了独特的优势。

本文将详细介绍粒子群优化算法的研究进展及其在阵列天线中的应用。

二、粒子群优化算法概述粒子群优化算法是一种基于群体行为的寻优方法,其核心思想是通过模拟鸟群、鱼群等自然群体的行为规律,利用群体中粒子的协作与竞争关系,实现全局寻优。

算法中,每个粒子代表问题的一个可能解,通过不断更新自身的速度和位置来寻找最优解。

PSO算法具有以下特点:1. 算法简单易实现,参数调整相对容易;2. 具有良好的全局寻优能力,能够处理复杂的非线性问题;3. 粒子间的协作与竞争关系有助于算法跳出局部最优解,提高寻优效率;4. 算法对初始解的依赖性较小,具有较强的鲁棒性。

三、粒子群优化算法在阵列天线中的应用阵列天线是一种由多个天线单元组成的系统,通过调整各单元的幅度和相位,可以实现波束的定向、赋形等功能。

在阵列天线的优化过程中,如何合理地分配各单元的幅度和相位是一个关键问题。

而粒子群优化算法正好可以解决这一问题。

在阵列天线的应用中,PSO算法可以通过以下步骤进行寻优:1. 将阵列天线的每个单元视为一个粒子,粒子的位置代表各单元的幅度和相位;2. 设定目标函数,如天线的增益、副瓣电平等;3. 初始化粒子群,并计算每个粒子的适应度值;4. 根据粒子的适应度值和速度更新公式,更新粒子的速度和位置;5. 根据更新后的粒子位置重新计算适应度值,判断是否达到终止条件(如达到最大迭代次数或适应度值满足要求);6. 若未达到终止条件,则返回步骤4继续迭代;若达到终止条件,则输出最优解。

通过PSO算法的优化,可以有效地提高阵列天线的性能指标,如增益、副瓣电平等。

《粒子群优化算法研究及在阵列天线中的应用》范文

《粒子群优化算法研究及在阵列天线中的应用》篇一一、引言随着科技的发展,优化算法在各个领域的应用越来越广泛。

粒子群优化算法(Particle Swarm Optimization,PSO)作为一种智能优化算法,具有计算效率高、全局搜索能力强等优点,近年来受到了广泛关注。

本文将首先对粒子群优化算法进行深入研究,并探讨其在阵列天线设计中的应用。

二、粒子群优化算法研究2.1 粒子群优化算法概述粒子群优化算法是一种基于群体智能的优化算法,通过模拟鸟群、鱼群等生物群体的行为规律,实现全局寻优。

该算法将问题的解表示为粒子,通过粒子的速度和位置更新来寻找最优解。

2.2 粒子群优化算法的特点粒子群优化算法具有以下特点:(1)全局搜索能力强:粒子群优化算法能够在搜索空间中同时搜索多个区域,从而避免陷入局部最优解。

(2)计算效率高:该算法通过并行计算,加快了求解速度。

(3)参数调整灵活:粒子群优化算法的参数可以根据具体问题进行调整,具有较好的灵活性。

2.3 粒子群优化算法的改进及发展为了进一步提高粒子群优化算法的性能,许多学者对其进行了改进。

例如,引入惯性权重、自适应调整速度和位置更新公式等,使得算法在寻优过程中更加灵活、高效。

此外,还有一些学者将粒子群优化算法与其他优化算法相结合,形成混合优化算法,进一步提高求解效果。

三、粒子群优化算法在阵列天线中的应用3.1 阵列天线概述阵列天线是一种通过组合多个天线单元来形成特定波束的天线系统。

其优点包括高增益、高分辨率和低副瓣等。

阵列天线的性能取决于其天线单元的布局和相位控制。

因此,如何优化阵列天线的布局和相位控制成为了一个重要的问题。

3.2 粒子群优化算法在阵列天线布局优化中的应用粒子群优化算法可以用于阵列天线的布局优化。

具体而言,将每个天线单元的位置表示为一个粒子,通过粒子的速度和位置更新来寻找最优的布局方案。

在寻优过程中,根据阵列天线的性能指标(如副瓣电平、增益等)来评估每个粒子的优劣,并更新粒子的速度和位置。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Bacterial Foraging Oriented by Particle Swarm Optimization Strategy for PID TuningWael Koraniwkorani@Department of Electrical and MachineUniversity of Cairo,EgyptABSTRACTProportional integral derivative(PID)controller tuning is an area of interest for researchers in many disciplines of science and engineering.This paper presents a new algorithm for PID controller tuning based on a combination of the foraging behavior of E coli bacteria foraging and Particle Swarm Op-timization(PSO).The E coli algorithm depends on random search directions which may lead to delay in reaching the global solution.The PSO algorithm may lead to possible entrapment in local minimum solutions.This paper pro-posed a new algorithm Bacteria Foraging oriented by PSO (BF-PSO).The new algorithm is proposed to combines both algorithms’advantages in order to get better optimization values.The proposed algorithm is applied to the problem of PID controller tuning and is compared with conveniently Bacterial Foraging algorithm and Particle swarm optimiza-tion.Categories and Subject Descriptors:I.2[Computing Methodologies]:ARTIFICIAL INTELLIGENCE;I.2.8[Prob-lem Solving,Control Methods,and Search]:Control theory General Terms:Algorithms,Performance.Keywords:Bacterial Foraging,Particle Swarm Optimiza-tion,Tuning of PID controller.1.INTRODUCTIONAs a result of extensive investigation to devise methods of choosing optimum controller setting for the PID controller, Ziegler and Niclhols showed how they could be estimated us-ing open and closed loop tests on the plants.The method is referred to as ZN rules.The ZN setting usually experiences excessive overshoot of the plant response.With the ease of computation,numerical optimization methods become sig-nificant in devising formula for PI and PID controller pa-rameter tuning.The squared error integral criteria are the most common for such optimization.Several optimization techniques using the swarming prin-ciple have been adopted to solve a variety of engineering problems in the past decade.Ant Colony Optimization (ACO)was introduced around1991-1992by M.Dorigo and colleagues as a novel nature-inspired metaheuristic for the solution of hard combinatorial optimization problems.Fa-rooq et al developed a bee inspired algorithm for routing in telecommunication network.The work is inspired by Copyright is held by the author/owner(s).GECCO’08,July12–16,2008,Atlanta,Georgia,USA.ACM978-1-60558-131-6/08/07.the way these insects communicate.Swarming strategies in birdflocking andfish schooling are used in the Parti-cle Swarm Optimization(PSO)introduced by Eberhart and Kennedy[1].A relatively newer evolutionary computation algorithm,called Bacterial Foraging scheme has been pro-posed and introduced recently by K.M.Passino[2].In this paper,the use of both PSO and(E coli)based optimization for PID parameter tuning is investigated.A new algorithm bacterial foraging oriented by particle swarm optimization(BF-PSO)is proposed that combine the above mentioned optimization algorithms.2.BASIC PARTICLE SW ARM OPTIMIZA-TION(PSO)The Particle Swarm Optimization(PSO)model[1]con-sists of a swarm of particles,which are initialized with a population of random candidate solutions.They move iter-atively through the d-dimension problem space to search the new solutions.Each particle has a position represented by a position-vector X i k where(i is the index of the particle),and a velocity represented by a velocity-vector V i k.Each particle remembers its own best position P i Lbest.The best position vector among the swarm then stored in a vector P i Global. During the iteration time k,the update of the velocity from the previous velocity to the new velocity is determined by. V i k+1=V i k+C1R1(P i Lbest−X i k)+C2R2(P i Global−X i k)(1)The new position is then determined by the sum of the previous position and the new velocity.X i k+1=X i k+V i k+1(2)Where R1and R2are random numbers.A particle decides where to move next,considering its own experience,which is the memory of its best past position,and the experience of the most successful particle in the swarm.3.BASIC BACTERIAL FORAGING OPTI-MIZATION(BF)The selection behavior of bacteria tends to eliminate poor foraging strategies and improve successful foraging strate-gies.After many generations a foraging animal takes actions to maximize the energy obtained per unit time spent forag-ing.This activity of foraging led the researchers to use it as optimization process.The E coli bacterium has a control system that enables it to search for food and try to avoidNoxious substances.The bacteria distributed motion can modeled as the following four stages:3.1Swarming and Tumbling via flagella (N s )The flagellum is a left-handed helix configured so that as the base of the flagellum (i.e.where it is connected to the cell)rotate counterclockwise ,as shown in figure 1-aCounterclockwise(a)Clockwise (b)Figure 1:E coli bacteria while it’s swimming or tum-blingfrom the free end of the flagellum looking toward the cell,it produces a force against the bacterium pushing the cell.This mode of motion is called swimming .Bacteria swims either for maximum number of steps N s or less depending on the nutrition concentration and environment condition.But if the flagellum rotate clockwise each flagellum pulls on the cell as shown in figure 1-b,so that the net effect is that each flagellum operates relatively independently of the others and so the bacterium ”tumble ”.Tumbling mode indicates a change in the future swim direction.Alternates between this two modes of operation in the entire life time.3.2Chemotaxis (N c )A chemotaxis step is a set of consequence swim steps fol-lowing by tumble.A maximum of swim steps with a chemo-tactic step is predefined by N s .The actual number of swim steps is determined by the environment.If the environment shows good nutrients concentration in the direction of the swim,the (E .Coli)bacteria swim more steps.The end of the chemotactic step is determined by either reaching the maximum number of steps N s or by reaching a poor envi-ronment.When the swim steps is stopped a tumble action takes place.To represent a tumble,a random unit length vector with direction Delta(n,i)is generated.where j be the index for the chemotactic step,i is the index of bacterium that has the maximum number of bacteria S .This vector is used to define the direction of movement after a tumble.Let N c be the length of the lifetime of the bacteria as measured by the number of chemotaxis steps they take during their life.Let c i >0i =1,2,...,S denote a basic chemotactic step size that we will use to define the lengths of steps during runs.The step size is assumed to be constant.The position of each bacterium is denoted by P (n,i,j,k,ell )where n is the dimension of search space,k is the index of reproduction step and ell is the index of elimination-dispersal events.The new bacterium position after tumbling is given by.P i n,j +1,k,ell=P in,j,k,ell+Delta (n,i )∗ci(3)3.3Reproduction (N re )After N c chemotactic steps,a reproduction step is taken.Let N re be the number of reproduction steps to be taken.For convenience,we assume that S is a positive even integer.LetS r =S(4)be the number of population members who have had suffi-cient nutrients so that they will reproduce (split in two)with no mutations.For reproduction,the population is sorted in order of ascending accumulated cost (higher accumulated cost represents that it did not get as many nutrients during its lifetime of foraging and hence,is not as ”healthy”and thus unlikely to reproduce).The S r least healthy bacteria die and the other S r healthiest bacteria each split into two bacteria,which are placed at the same location.3.4Elimination and dispersal (N ed )Elimination event may occur for example when local sig-nificant increases in heat kills a population of bacteria that are currently in a region with a high concentration of nu-trients.A sudden flow of water can disperse bacteria from one place to another.The effect of elimination and disper-sal events is possibly destroying chemotactic progress,but they also have the effect of assisting in Chemotaxis,since dispersal may place bacteria near good food sources.The bacterial foraging algorithm has been tested for con-trol applications like harmonic estimation for a signal dis-torted with additive noise [3],and adaptive control [2].The combination of bacteria foraging and genetic algorithm is used to tune a PID controller of an automatic voltage reg-ulator [4].In this paper (E coli)is used for tuning PID controller of the plant transfer function and the results are reported.4.BACTERIAL FORAGING OPTIMIZATIONORIENTED BY PARTICLE SW ARM OP-TIMIZATIONThe (BF-PSO)combines both algorithms BF and PSO.This combination aims to make use of PSO ability to ex-change social information and BF ability in finding a new solution by elimination and dispersal.For initialization,the user selects S ,N s ,N c ,N re ,N ed ,P ed ,C 1,C 2,R 1,R 2and c (i ),i =1,2...S .Also initialize thePosition P in,1,1,1,i =1,2...S and Velocity randomly initial-ized.The (BF-PSO)models bacterial Population Chemo-taxis,swarming,reproduction,elimination and dispersal ori-ented by PSO is given below (Initially,j =k =ell =0).Implicit subscribes will be dropped for simplicity.1.Initialize parameters n ,S ,N c ,N s ,N re ,N ed ,P ed ,c (i )(i =1,2...S ),Delta ,C 1,C 2,R 1,R 2.where,•n :Dimension of the search space,•S :The number of bacteria in the population,•S r :Half the total number of bacteria ,•N s :Maximum number of swim length,•N c :Chemotactic steps,•Nre :The number of reproduction steps,•N ed:Elimination and dispersal events,•P ed:Elimination and dispersal with probability,•c(i):The step size taken in the random direction,•C1,C2:PSO random parameter,•R1,R2:PSO random parameter.2.Generate a random direction Delta(n,i)and position.For(e l l=1to Ned)For(k=1to Nre)For(j=1to Nc)For(i=1to S)Evaluate the c o s t f u n c t i o nJ(i,j)=Func(P(i,j))S t o r e the b e s t c o s t f u n c t i o n i n J l a s tJ l a s t=J(i,j)The b e s t c o s t f o r each b a c t e r i a w i l l bes e l e c t e d to be the l o c a l b e s t J l o c a lJ l o c a l(i,j)=J l a s t(i,j)Update p o s i t i o n and c o s t f u n c t i o nP(i,j+1)=P(i,j)+c(i)∗Delta(n,i)J(i,j+1)=Func(P(i,j+1))w h i l e(m<Ns)I f J(i,j+1)<J l a s tthenJ l a s t=J(i,j+1)Update p o s i t i o n and c o s t f u n c t i o nP(i,j+1)=P(i,j+1)+c(i)∗Delta(n,i)J(i,j+1)=Func(P(i,j+1))Evaluate the c u r r e n t p o s i t i o n and l o c a l c o s t f o r each b a c t e r i aPcurrent(i,j+1)=P(i,j+1)J l o c a l(i,j+1)=J l a s t(i,j+1)e l s ePcurrent(i,j+1)=P(i,j+1)J l o c a l(i,j+1)=J l a s t(i,j+1)end i fm=m+1end w h i l enext i(next b a c t e r i a)Evaluate the l o c a l b e s t p o s i t i o n(P l b e s t)f o r each b a c t e r i a and g l o b a l b e s t p o s i t i o n(Pgbest). Evaluate the new d i r e c t i o n f o r each b a c t e r i aV=w∗V+C1∗R1(P l b e s t−Pcurrent)+C2∗R2(Pgbest−Pcurrent)Delta=Vnext j(next chemotactic)f o r(i=1to S)J i health=N c+1Xj=1(i,j,k,ell)endThe Sr b a c t e r i a with the h i g h e s t J h e a l t hremove and the o t h e r Sr b a c t e r i a withthe b e s t v a l u e s c o p i e s.next k(next r e p r o d u c t i o n)With p r o b a b i l i t y Ped,e l i m i n a t e s andd i s pe r s e each bacterium.next e l l(next e l i m i n a t i o n)5.PID TUNING BY PSO,BF AND(BF-PSO)The prime objective of this work is to test the perfor-mance of the developed bacterial foraging oriented by par-ticle swarm optimization algorithm PID controller tuning.Attempt has been made to achieve globally minimal error squared error integral criteria in the step response of a pro-cess which is cascaded with PID controller by tuning the K p proportional gain,K i integral gain and K d differential gain values.Usually,the choice of the controller coefficients is imple-mented by approximate methods,which in turn will not guarantee globally optimal solution for control applications.The values of K p,K i and K d derived through the BF,PSOand(BF-PSO)methods after ensuring the presence of allthe poles of the transfer function confined to the left half ofthe S plane.The performance of the developed algorithm is tested with transfer functions of systems of different orders.The cost function here is the square of integral error.The closedloop PID controller cascaded with the process is tuned for values K p,K i and K d.Results obtained by using(BF-PSO)algorithm are presented in table1.Table2presentsthe tuning results using PSO and BF.These parameters are randomly initialized in the same range for all methods.For thefirst plant,the values of K p,K d found by BF and (BF-PSO)are nearly the same.The solution provided by PSO is drifted by about20%of the values founded by BF and(BF-PSO).This is reflected in the cost values shown in table3where PSO has the worst cost function.The result founded by the three algorithms nearly the same for plant2and7.It is clear the PSO algorithm is unstable for plant4but the solution founded by the other two algorithm almost the same.Also it is obvious that the result is obtained by PSO in plant3is nearer to the best one and the BF algorithm has a bad response.In all cases(BF-PSO)results in a lower overshoot com-pared to other methods.Table1:PID values obtained by BF-PSOplant N.O Transfer FunctionBF-PSOK D K I K P15S4+3S3+7S2+5S0.60—0.872(S+5S4+17S3+60S2+10S)14.7— 3.993(300(S+100)S(S+10)(S+40))0.03—0.164(6S4+3S3+4S2+3S+1)0.400.070.35(250S+500S3+12S2+100S+10)0.110.030.406(S+5S4+17S3+60S2+5S+5)12.710.34 3.767(1S2+0.1S+1) 1.260.83 1.17 Table2:PID values obtained by PSO and BFplant N.OBF PSOK D K I K P K D K I K P10.53—0.800.62—0.56214.69— 4.0514.41— 4.3630.24—0.080.03—0.1740.430.080.3015.920.480.1050.130.100.370.210.180.446 5.820.27 2.8313.000.12 3.787 1.250.78 1.20 3.58 1.110.72 Table3:cost function obtained by BF-PSO and PSOand BFplant N.OCost functionBF-PSO PSO BF115.263319.143615.7906221.692122.375621.88433 1.0525 2.848413.4133420.89124646.520.954350.6999 1.5457 1.2674621.088025.620322.806077.302115.34457.71586.CONCLUSIONIn this paper,a new BF oriented by PSO optimization al-gorithm is proposed.This algorithm combines PSO and BF techniques in order to make use of PSO ability to exchange social information and BF ability infinding a new solution by elimination and dispersal.The proposed technique is ap-plied to the PID parameter tuning for a set of test plants.Figure2:step response of a plant(2)Figure3:step response of a plant(7) Simulation results demonstrate that the proposed algorithm out performance both conventional PSO and BF.7.FUTURE WORKThe work presented in this paper may be extended by considering the following parts.•Application of developed algorithm in other conditional application ex.system identification,model predictivecontrol.•Considering valuable step size of the bacterium to agree the digitization effect of the solution.•Application of the develop algorithm to non linear plant with time delay.8.REFERENCES[1]J.Kennedy and R.C.Eberhart,“Particle SwarmOptimization,”in Proc.of the IEEE Int.Conf.on NeuralNetworks.Piscataway,NJ:IEEE Service Center,1995,pp.1942–1948.[2]K.M.Passino,“Biomimicry of Bacterial Foraging forDistributed Optimization and Control,”IEEE ControlSystems Magazine,vol.22,no.3,pp.52–67,June2002.[3]S.Mishra,“A hybrid Least Square-Fuzzy Bacterial ForagingStrategy for Harmonic Estimation,”IEEE Trans.Evolutionary Computation,vol.9,no.1,pp.61–73,2005.[Online].Available:/10.1109/TEVC.2004.840144[4] D.H.Kim,A.Abraham,and J.H.Cho,“A hybrid GeneticAlgorithm and Bacterial Foraging Approach for GlobalOptimization,”Inf.Sci,vol.177,no.18,pp.3918–3937,2007.[Online].Available:。