多核学习方法

多核学习中的模型解释与可解释性分析(六)

多核学习中的模型解释与可解释性分析在机器学习领域,多核学习作为一种新兴的学习方法,被广泛应用于各种领域,包括计算机视觉、自然语言处理等。

多核学习通过将数据映射到高维空间中,以便更好地进行分类和预测。

然而,随着多核学习模型的复杂性不断提高,其可解释性也成为了一个备受关注的重要问题。

因此,对多核学习模型的解释和可解释性分析成为了当前研究的热点之一。

一、模型解释的重要性模型解释是指通过对机器学习模型进行解释,以便更好地理解模型的预测结果和决策过程。

在实际应用中,模型解释不仅可以帮助我们理解模型的工作原理,还可以为决策提供依据。

特别是在一些对预测结果要求高度可信的领域,如医疗诊断和金融风控中,模型解释更是必不可少的。

因此,多核学习模型的可解释性分析成为了当前研究的热点之一。

二、多核学习模型的可解释性分析方法针对多核学习模型的可解释性分析,目前已经提出了许多方法和技术。

其中,最为常见的方法之一是特征重要性分析。

通过对多核学习模型中使用的特征进行重要性分析,可以帮助我们理解模型是如何对特征进行权重分配的,从而更好地理解模型的预测结果。

此外,基于局部解释的方法也被广泛应用于多核学习模型的解释和可解释性分析中。

通过对模型在局部数据集上进行解释,可以帮助我们更好地理解模型的预测过程和决策规则。

除此之外,还有基于可视化的方法、基于规则提取的方法等多种方法和技术,可以帮助我们更好地理解多核学习模型的工作原理和决策过程。

三、多核学习模型的解释挑战与解决方案虽然多核学习模型的解释和可解释性分析方法已经取得了一定的进展,但是仍然面临着许多挑战。

其中,最主要的挑战之一是模型的复杂性。

多核学习模型通常具有较高的复杂性,其中包括大量的特征和参数,这使得模型的解释变得十分困难。

针对这一挑战,研究人员提出了许多解决方案,如简化模型结构、提高模型可解释性等。

另外,模型的不确定性也是一个重要的挑战。

多核学习模型在处理复杂任务时,往往会面临许多不确定性,这使得模型的解释变得更加困难。

蛋白质二级结构预测的多核学习方法

I S S N l 0 0 1 . 9 0 8 l

2 01 3. O 6. 3 O

计 算 机 应 用, 2 0 1 3 , 3 3 ( S 1 ) : 4 3— 4 5

中图分类号 : T P 1 8 1 文献标志码 : A

M ul t i ・ k e r n e l l e a r n i ng me t h o d f o r p r e di c t i n g pr o t e i n s e c o n da r y s t r u c t ur e s UAN Yu n j u a n .X1 0 NG Hu i l i n

( D e p a r t me n t o fA u t o m a t i o n ,S h a n g h a i J i a o wn g U n i v e r s i t y ,S h a n g ai h 2 0 0 2 4 0 ,C h i n a )

Ab s t r a c t :Ke r n e l me t h o d s h a v e b e e n a p p l i e d i n p r o t e i n s e c o n d a r y s t r u c t u r e p r e d i c t i o n f o r y e a r s .B u t u n f o r t u n a t e l y , c l a s s i i f e r s w i t h o n e s i n g l e k e ne r l c a n g e t u s e o f o n l y o n e k i n d o f p r o p e r t y f r o m p r o t e i n s e q u e n c e .F o r t h e s a k e o f mi x i n g t i n f o r ma t i e s

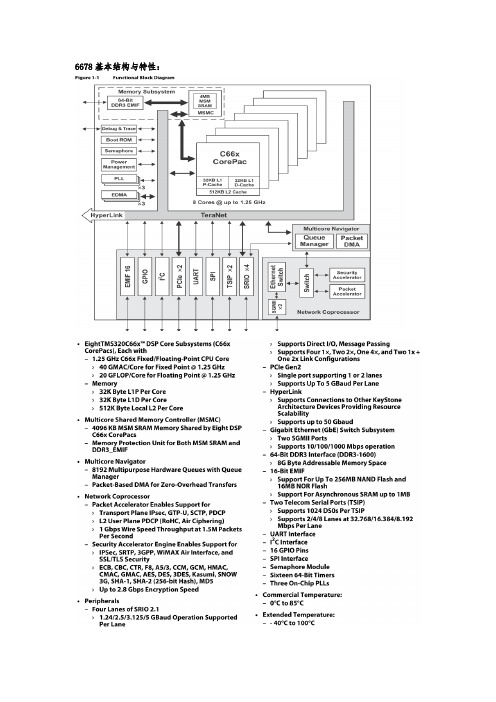

C6678多核处理器开发板学习总结

6678根本构造与特性:6678评估板功耗表:6678空间映射:6678加载过程BOOT配置引脚:8种加载方式:EIMF加载模式:8种PLL BOOT配置0x872E00-0x87FFFF保存给boot配置用,保存了BOOT外设的根本配置参数。

加载过程:上电后,6678读取BOOTMODE电平,数据存储在DEVSTAT存放器中,改存放器数值可编程,各个Core可不同的BOOT模式加载。

6678首先从Core0加载,Core1执行idle处于中断等待状态,当Core0加载完成后,首先Core0的BOOT_MAGIC_ADDRESS被写入加载程序的起始地址,Core0从BOOT_MAGIC_ADDRESS执行,Core0应该对次Core的BOOT_MAGIC_ADDRESS写入执行地址,同时写入IPCGRn存放器触发次Core的中断,对6678而言BOOT_MAGIC_ADDRESS的映射地址是各Core本地L2的0x807FFF,在加载期间,所有的LP、LD被配置为Cache,L2被配置为可寻址Memory每个Core加载完成BOOTPLETE存放器被标志参看手册:sprugy56678根本外设:电源监控:EIMF :评估板连接512Mb NandFlash <NUMONYX_NAND512R3A2DZA6E>DDR3:评估板连接1Gb/1333MHZ DDR3 <SAMSUNG_K4B1G1646G_BCH9> ECC连接1Gb/1333MHZ DDR3(ECC) <SAMSUNG_K4B1G1646G_BCH9>未连接512Mb/1333MHZ DDR3<SAMSUNG_K4B1G0846G_BCH9>主要用到引脚如下:DDRA[0:15]/DDRD[0:63] 数据/地址DDR3_ECKE_0DDR3_ECS_0#DDR3_ECAS# DDRA为列地址DDR3_ERAS# DDRA为行地址DDR3_EWE# 写使能?DDR3_EBA_[0:2] BANK选通DDR3_EDM_[0:8] ?DDR3_EDQSP/N_[0:8]DDR3_ECC_[0:8] 0:7 连接SAMSUNG_K4B1G1646G_BCH9的DDRD[0:7] 纠错DDR3_EMRESETNDDR3_EODT_0 端接电阻DDRSLRATE_[0:1] 回转速率,00最快TSIP:评估板连接接口SPI:评估板连接128Mb SPI NorFlash <NUMONYX_N25Q128A21BSF40F> 评估板连接时钟发生器<TI_CDCE62005RGZT>PCIE:评估板连接接口MDIO:评估板连接PCA9306DCUT 电平转换至PHY芯片配置端<88E1111-B2>IIC:评估板连接1Mb<ST_M24M01_HRMN6TP>Hyperlink:评估板连接CONN接口<IPASS PLUS HD_36H>SRIO:评估板连接接口UART:评估板连接RS232 <TI_MAX3221ECPWR>评估板连接USB _CHB通道<FT2232HL>FT2232HL 配置芯片<ATMEL_AT93C46DN_SH_T IIC>EMAC:评估板连接PHY芯片<MARVELL_88E1111_B2_BAB1C000>评估板时钟DSP时钟:25MHZ输入,可级联使用<CDCE62005RGZT>,由FPGA配置,再使能DSP DSP_CORE_CLKP/N:100MHZDSP_DDR_CLKP/N:66.667MHZDSP_PA_SS_CLKP/N:100MHZDSP_SRIO_SGMII_CLKP/N:312.5MHZDSP_MCM_CLKP/N:312.5MHZDSP_PCIE_CLKP/N:100MHZFT2232HL时钟:12MHZ88E1111时钟:25MHZFPGA时钟:<CDCE62005>评估板电源电源组1:SmartReflex:UCD9222+UCD7242RSJT<获取CVDD、VCC1V0>电源组2:TI_TPS54620RGY Vsense=0.8V Vin=12V Pe=90% 级联TPS73701DRBT <获取VCC3V3_AUX VCC1V8_AUX VCC2V5 VCC1V8 VCC1V2>电源组3:TI_TPS54620RGY Vsense=0.8V Vin=12V Pe=90% 级联TPS51200DRCT <获取VCC1V5 VCC0V75 >电源组4:TPS54231D <获取VCC5 >评估板其他器件:可编程缓冲方向4路缓冲器TI_SN74AVC4T245PWR8位宽数据通道选择器TI_TS3L301DGG两路电平转换器件<VCCA转VCCB> TI_PCA9306DCUT八路电平转换器件<VCCA转VCCB> TI_TXS0108EPWRRJ45 RJ45_W/XFMR&LED时钟选择器IDT_ICS557GI-08LFTFPGA芯片XILINX_XC3S200AN_4FTG256C。

MKXZ工具与方法基本工作手册

MKXZ工具与方法基本工作手册MKXZ(Multiple Kernelized Extreme Learning Machine)是一种基于多核极限学习机的机器学习方法,它可以用于解决多类别分类和回归问题。

本文将介绍MKXZ工具与方法的基本工作手册,包括算法原理、使用方法和实例分析等内容。

一、算法原理1.1 多核极限学习机(MKELM)简介多核极限学习机是一种基于极限学习机(ELM)的机器学习方法,它主要使用随机生成的隐藏层权重和偏置来建立神经网络模型。

MKELM通过使用多个核函数来提高模型的学习能力和泛化能力。

1.2 多核化的极限学习机(MKXELM)简介多核化的极限学习机是在MKELM的基础上发展而来的方法,它通过将样本数据映射到高维空间中,然后在高维空间中进行学习和分类。

MKXELM通过使用多个核函数和核权重来融合不同的核特征,并构建高性能的分类模型。

1.3 MKXZ(Multiple Kernelized Extreme Learning Machine)简介MKXZ是一种基于MKXELM的机器学习方法,它通过使用多个核函数和核矩阵来构建高性能的分类模型。

MKXZ在MKELM的基础上引入了正则化项和粒子群优化算法,可以进一步提高模型的泛化性能和稳定性。

二、使用方法2.1 数据预处理首先,需要对原始数据进行预处理,包括数据清洗、特征选择、数据缩放等步骤。

可以使用pandas和numpy等库来进行数据处理,确保数据的准确性和一致性。

2.2 模型初始化在使用MKXZ之前,需要初始化模型的参数,包括隐藏层节点数、核函数类型、正则化系数等。

可以使用sklearn库中的ELMRegressor和ELMClassifier来初始化模型,并选择合适的参数。

2.3 数据划分将预处理后的数据划分为训练集和测试集,通常使用交叉验证的方式来划分数据集。

可以使用sklearn库中的train_test_split函数来随机划分数据集,并设置训练集和测试集的比例。

多核学习方法

在研究模式识别的势函数方法时, 利用 Mercer 理 论, 把核函数解释为一个特征空间的内积, 并引入 到机器学习中. 但是, 当时核方法的潜能并没有被 完全挖掘. 直到 1992 年, Boser 等[11] 提出 SVM 方法. SVM 的成功促进了核方法的迅速普及和 发展, 逐渐渗透到了机器学习的诸多领域, 如回归 估计[12] 、模式分类[13] 、概率密度估计[14] 、子空间 分析等[15] . 典型的如 Sch¨ olkopf 等[15] 提出了核主 成分分析 (Kernel principal component analysis, KPCA), Mika 等[16] 实现了核 Fisher 判别 (Kernel Fisher discriminant, KFD), Baudat 等[17] 提出的 核判别分析 (Kernel discriminant analysis, KDA), Lai 等[18] 提出了核规范相关分析 (Kernel canonical correlation analysis, KCCA), Bach 等[19] 提出了 核独立分量分析 (Kernel independent component analysis, KICA) 等. 此后, 核方法又得到了大量的 改进和推广, 在多个领域得到了广泛应用. 尽管上述的核方法在众多的应用领域有效并且 实用, 但这些方法都是基于单个特征空间的单核方 法. 由于不同的核函数具有的特性并不相同, 从而 使得在不同的应用场合, 核函数的性能表现差别很 大, 且核函数的构造或选择至今没有完善的理论依1038自 Nhomakorabea动

化

学

报

36 卷

据. 此外, 当样本特征含有异构信息 (Heterogeneous information)[20−26] , 样本规模很大[27−30] , 多维数据 的不规则 (Unnormalised data)[31−32] 或数据在高 维特征空间分布的不平坦 (Non-flat)[33−34] , 采用单 个简单核进行映射的方式对所有样本进行处理并不 合理. 针对这些问题, 近年来, 出现了大量关于核组 合 (Kernel combination) 方法的研究, 即多核学习 方法[23, 31, 35−40] . 多核模型是一类灵活性更强的基于核的学习 模型, 近来的理论和应用已经证明利用多核代替单 核能增强决策函数的可解释性 (Interpretability), 并能获得比单核模型或单核机器组合模型更优的 性能[41−42] . 构造多核模型, 最简单也最常用的一 种方法就是考虑多个基本核函数的凸组合, 其形 M M 如: K = j =1 βj Kj , βj ≥ 0, j =1 βj = 1, 这 里 Kj 是基本核函数, M 是基本核的总个数, βj 是权系数. 因此, 在多核框架下, 样本在特征空间 中的表示问题转化成为基本核与权系数的选择问 题. 在这个由多个特征空间构建的组合空间中, 由 于组合利用了各基本核的特征映射能力, 很好地解 决了核函数的选择以及与核目标度量 (Kernel target alignment, KTA)[43−44] 相关的变量与模型的 选择难题[31, 45−46] . 同时, 通过将异构数据的不同 特征分量分别输入对应的核函数进行映射, 使数 据在新的特征空间中得到更好的表达, 能显著提 高分类正确率或预测精度. 但是, 这里最重要的问 题就是如何得到这个组合的特征空间, 也就是如 何学习得到权系数. 针对这一问题, 近来出现了 多种有效的多核学习理论及方法. 如早期的基于 Boosting[21, 47] 的多核组合模型学习方法, 基于半 定规划 (Semidefinite programming, SDP)[41] 的多 核学习方法, 基于二次约束型二次规划 (Quadratically constrained quadratic program, QCQP)[36] 的学习方法, 基于半无限线性规划 (Semi-infinite linear program, SILP)[24, 37] 的学习方法, 基于超核 (Hyperkernels)[31] 的学习方法, 以及近来出现的简 单多核学习 (Simple MKL)[27, 29] 方法和基于分组 Lasso 思想的多核学习方法. 在权系数与核函数的 组合方面, 研究人员也对多核方法进行了一些改进, 如非平稳的多核学习方法[23] , 局部多核学习方法[40] , 非稀疏多核学习方法[30] 等. 此外, 基于一类具有多 尺度表示特性的核函数, 多核学习方法向多尺度核 方法方向又出现了众多的扩展[32−34, 48−52] . 前述的 这些多核学习方法都是在有限个基本核函数组合假 设下进行的, 容易看到, 有限核的组合受限于选择的 有限性, 为了将其扩展到大量核组合的情形, 近来又 出现了基于无限核的学习方法[39, 53−54] . 从最初在生物信息学领域[55−56] 被提出, 多核

多核学习的基本原理与概念(四)

多核学习的基本原理与概念多核学习是指基于多核学习理论和方法进行的一种学习方式。

它是一种基于多核学习理论和方法进行的一种学习方式。

通过整合多个核心,有效地利用不同的信息来增强模型的泛化能力。

多核学习包括多核学习算法和多核学习模型。

它是一种基于多核学习理论和方法进行的一种学习方式。

通过整合多个核心,有效地利用不同的信息来增强模型的泛化能力。

多核学习包括多核学习算法和多核学习模型。

多核学习的基本原理是通过整合多个核心,有效地利用不同的信息来增强模型的泛化能力。

核心是一个用于描述数据的函数,多核学习算法通过整合多个核心来学习数据的特征。

多核学习算法通过整合多个核心来学习数据的特征。

多核学习的基本概念包括核函数、核方法和支持向量机。

核函数是一种用于度量和处理数据特征的函数,它可以将数据映射到高维空间中,从而有效地捕捉数据的非线性特征。

核函数是一种用于度量和处理数据特征的函数,它可以将数据映射到高维空间中,从而有效地捕捉数据的非线性特征。

核方法是一种通过核函数来处理数据的方法,通过核方法可以有效地处理非线性数据,并增强模型的泛化能力。

核方法是一种通过核函数来处理数据的方法,通过核方法可以有效地处理非线性数据,并增强模型的泛化能力。

支持向量机是一种基于核方法的学习模型,它通过构建最优的超平面来对数据进行分类和回归。

支持向量机是一种基于核方法的学习模型,它通过构建最优的超平面来对数据进行分类和回归。

多核学习的应用包括图像识别、文本分类、生物信息学、医学影像分析等领域。

多核学习在图像识别、文本分类、生物信息学、医学影像分析等领域有着广泛的应用。

多核学习的发展趋势包括深度多核学习、多任务多核学习、增量多核学习等方向。

深度多核学习是一种将深度学习和多核学习相结合的学习方式,多任务多核学习是一种同时学习多个任务的学习方式,增量多核学习是一种通过逐步增加核心来学习数据的特征的学习方式。

总的来说,多核学习是一种通过整合多个核心,有效地利用不同的信息来增强模型的泛化能力的学习方式。

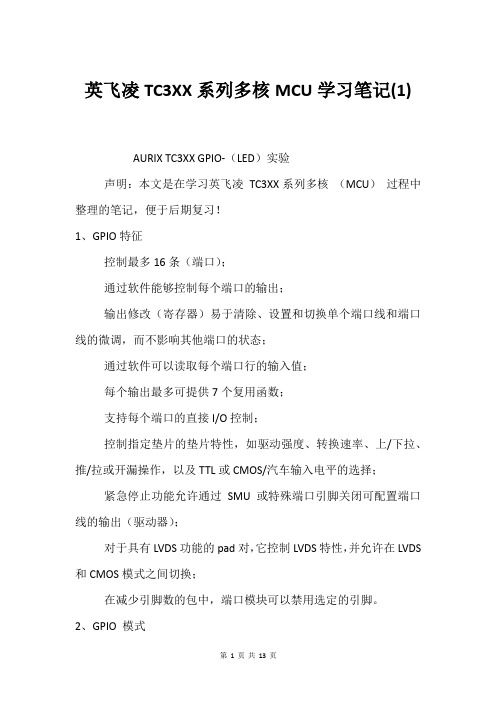

英飞凌TC3XX系列多核MCU学习笔记(1)

英飞凌TC3XX系列多核MCU学习笔记(1)AURIX TC3XX GPIO-(LED)实验声明:本文是在学习英飞凌TC3XX系列多核(MCU)过程中整理的笔记,便于后期复习!1、GPIO特征控制最多16条(端口);通过软件能够控制每个端口的输出;输出修改(寄存器)易于清除、设置和切换单个端口线和端口线的微调,而不影响其他端口的状态;通过软件可以读取每个端口行的输入值;每个输出最多可提供7个复用函数;支持每个端口的直接I/O控制;控制指定垫片的垫片特性,如驱动强度、转换速率、上/下拉、推/拉或开漏操作,以及TTL或CMOS/汽车输入电平的选择;紧急停止功能允许通过SMU或特殊端口引脚关闭可配置端口线的输出(驱动器);对于具有LVDS功能的pad对,它控制LVDS特性,并允许在LVDS 和CMOS模式之间切换;在减少引脚数的包中,端口模块可以禁用选定的引脚。

2、GPIO 模式TC3XX系列(芯片)GPIO共有五种模式NO_PULL, //无输入上下拉PULLUP, //输入上拉PUL(LDO)WN, //输入下拉PUSHPULL, //推挽输出OPENDRAIN, //开漏输出3、GPIO 通用寄存器3.1、IOCR0-端口n输入/输出控制寄存器0 寄存器作用:端口输入/输出控制寄存器选择一个GPIO端口引脚的数字输出和输入驱动程序的功能和特性。

输入的端口方向(输入或输出)、上拉、下拉或无拉设备,以及输出的推拉或开漏功能,可由相应的位字段PCx(x=0-15)选择。

每个32位宽端口输入/输出控制寄存器控制四条GPIO端口线:寄存器Pn_IOCR0控制Pn [3:0]端口线路;寄存器Pn_IOCR4控制Pn [7:4]端口线路;寄存器Pn_IOCR8控制Pn [11:8]端口线路;寄存器Pn_IOCR12控制Pn [15:12]端口线路。

3.2、OMR-端口n输出修改寄存器3.3、PDR0-端口n驱动程序模式寄存器04、GPIO 函数4.1、设置GPIO 状态函数1void IfxPort_set(Pi)nState(Ifx_P *port, uint8 pinIndex, IfxPort_State (ac)(ti)on)2{3 port- >OMR.U = action (参数):port:GPIO 端口号pinIndex:高低电平4.2、设置GPIO输出模式1void IfxPort_setGroupModeOutput(Ifx_P *port, uint8 pinIndex, uint16 mask, IfxPort_OutputMode mode, IfxPort_OutputIdx index) 2{ 3 uint32 i; 4 uint32 iocrVal[4]; 5 uint32 iocrMask[4]; 6 7 IFX_UNUSED_PA(RAM)ETER(index == IfxPort_OutputIdx_general); 8 9/* initialise */10 f(or)(i = 0; i 2、设置GPIO输出高电平1void IfxPort_setPinHigh(Ifx_P *port, uint8 pinIndex)2{3 IfxPort_setPinState(port, pinIndex, IfxPort_State_high);4} port:GPIO端口号pinIndex:1-高电平、0-低电平3、设置GPIO输出低电平1void IfxPort_setPinLow(Ifx_P *port, uint8 pinIndex)2{3 IfxPort_setPinState(port, pinIndex, IfxPort_State_low);4} port:GPIO端口号pinIndex:1-高电平、0-低电平4、设置GPIO翻转电平1void IfxPort_togglePin(Ifx_P *port, uint8 pinIndex)2{3 IfxPort_setPinState(port, pinIndex, IfxPort_State_toggled);4} port:GPIO端口号pinIndex:1-高电平、0-低电平5、读取GPIO电平1boolean IfxPort_getPinState(Ifx_P *port, uint8 pinIndex)2{3 return (__getbit(4} port:GPIO端口号pinIndex:1-高电平、0-低电平5、GPIO 测试实验使用逐飞TC377系列核心板,板上有4路LED,原理图如下:实验:实现点灯,熟悉GPIO使用。

多核支持向量机方法及实现技巧

多核支持向量机方法及实现技巧支持向量机(Support Vector Machine,SVM)是一种常用的机器学习方法,用于二分类和多分类问题。

它的主要思想是在高维空间中找到一个最优超平面,将不同类别的样本分开。

然而,随着数据量的增加和问题复杂度的提高,传统的SVM算法在计算效率和准确性方面面临一些挑战。

为了解决这些问题,多核支持向量机方法被提出并得到了广泛应用。

多核支持向量机(Multiple Kernel Support Vector Machine,MK-SVM)是一种改进的SVM方法,它通过引入多个核函数来提高分类器的性能。

核函数是SVM中的关键组成部分,它用于将数据从低维空间映射到高维空间,从而使得数据在高维空间中更容易分开。

传统的SVM通常使用线性核函数,但是对于复杂的非线性问题,线性核函数的表现可能不佳。

多核支持向量机通过使用多个核函数的组合,可以更好地适应不同类型的数据。

在多核支持向量机中,核函数的选择非常重要。

常用的核函数包括线性核函数、多项式核函数、高斯核函数等。

不同的核函数适用于不同的数据类型和问题。

例如,线性核函数适用于线性可分的问题,而高斯核函数适用于非线性问题。

在实际应用中,我们可以根据特定问题的性质和数据的特点选择最合适的核函数。

除了核函数的选择,多核支持向量机还需要考虑核函数的权重。

不同核函数对最终分类结果的贡献程度不同,因此需要对核函数进行加权。

权重的选择可以通过交叉验证等方法来确定。

在实现过程中,我们可以使用网格搜索等技术来寻找最优的核函数和权重组合。

另一个关键问题是多核支持向量机的训练和预测效率。

传统的SVM算法在处理大规模数据集时可能面临计算复杂度高的问题。

为了提高效率,可以使用一些优化技术,例如核矩阵近似、并行计算等。

核矩阵近似可以通过降低核矩阵的维度来减少计算量,而并行计算可以利用多核处理器的优势来加速计算过程。

此外,多核支持向量机还可以与其他机器学习方法结合,形成集成学习模型。

多核学习中的增量学习与迁移学习方法(六)

在机器学习领域,多核学习是一种比较新的研究方向。

它是指利用多个核函数来对数据进行特征表示和分类,以提高机器学习算法的性能。

与传统的单核学习相比,多核学习具有更强的表达能力和更大的灵活性。

但是,多核学习也面临着一些挑战,其中之一就是如何有效地进行增量学习和迁移学习。

本文将从增量学习和迁移学习的角度出发,探讨多核学习中的方法和技术。

增量学习是指在不断接收新数据的情况下,对已有的模型进行更新和优化的过程。

在多核学习中,增量学习可以帮助模型适应新的数据分布,提高模型的泛化能力。

目前,已经有一些研究工作探讨了在多核学习中如何进行增量学习。

其中一种方法是基于核矩阵的增量学习。

核矩阵是多核学习中的重要概念,它可以用来表示数据之间的相似度。

在增量学习中,可以通过更新核矩阵来实现模型的更新。

另一种方法是基于核特征的增量学习。

在这种方法中,可以通过添加新的核特征来适应新的数据,从而实现增量学习。

这些方法为在多核学习中进行增量学习提供了一些思路和技术手段。

除了增量学习,迁移学习也是多核学习中的一个重要问题。

迁移学习是指在不同的领域或任务之间,通过利用已有的知识来改善学习性能的过程。

在多核学习中,迁移学习可以帮助模型在不同的数据集上进行泛化。

目前,已经有一些研究工作探讨了在多核学习中如何进行迁移学习。

其中一种方法是基于核对齐的迁移学习。

核对齐是指将不同的核函数映射到同一个特征空间中,从而可以比较它们之间的相似度。

在迁移学习中,可以通过核对齐来将来自不同领域的知识整合起来,从而提高模型的泛化能力。

另一种方法是基于核选择的迁移学习。

在这种方法中,可以通过选择合适的核函数来适应不同的数据分布,从而实现迁移学习。

这些方法为在多核学习中进行迁移学习提供了一些思路和技术手段。

除了增量学习和迁移学习,多核学习还面临着一些其他挑战。

其中之一就是如何选择合适的核函数。

在多核学习中,核函数的选择对模型的性能影响非常大。

目前,已经有一些研究工作探讨了在多核学习中如何选择合适的核函数。

C6678多核处理器开发板学习总结

6678基本结构与特性:6678评估板功耗表:6678空间映射:6678加载过程BOOT配置引脚:8种加载方式:EIMF加载模式:8种PLL BOOT配置0x872E00-0x87FFFF保留给boot配置用,保存了BOOT外设的基本配置参数。

加载过程:上电后,6678读取BOOTMODE电平,数据存储在DEVSTAT寄存器中,改寄存器数值可编程,各个Core可不同的BOOT模式加载。

6678首先从Core0加载,Core1执行idle处于中断等待状态,当Core0加载完成后,首先Core0的BOOT_MAGIC_ADDRESS被写入加载程序的起始地址,Core0从BOOT_MAGIC_ADDRESS执行,Core0应该对次Core的BOOT_MAGIC_ADDRESS写入执行地址,同时写入IPCGRn寄存器触发次Core的中断,对6678而言BOOT_MAGIC_ADDRESS的映射地址是各Core本地L2的0x807FFF,在加载期间,所有的LP、LD被配置为Cache,L2被配置为可寻址Memory每个Core加载完成BOOTCOMPLETE寄存器被标志参看手册:sprugy56678基本外设:电源监控:EIMF :评估板连接512Mb NandFlash <NUMONYX_NAND512R3A2DZA6E>DDR3:评估板连接 1Gb/1333MHZ DDR3 <SAMSUNG_K4B1G1646G_BCH9> ECC连接1Gb/1333MHZ DDR3(ECC) <SAMSUNG_K4B1G1646G_BCH9>未连接 512Mb/1333MHZ DDR3<SAMSUNG_K4B1G0846G_BCH9 >主要用到引脚如下:DDRA[0:15]/DDRD[0:63] 数据/地址DDR3_ECKE_0DDR3_ECS_0#DDR3_ECAS# DDRA为列地址DDR3_ERAS# DDRA为行地址DDR3_EWE# 写使能?DDR3_EBA_[0:2] BANK选通DDR3_EDM_[0:8] ?DDR3_EDQSP/N_[0:8]DDR3_ECC_[0:8] 0:7 连接SAMSUNG_K4B1G1646G_BCH9的DDRD[0:7] 纠错DDR3_EMRESETNDDR3_EODT_0 端接电阻DDRSLRATE_[0:1] 回转速率,00最快TSIP:评估板连接接口SPI:评估板连接 128Mb SPI NorFlash <NUMONYX_N25Q128A21BSF40F> 评估板连接时钟发生器<TI_CDCE62005RGZT>PCIE:评估板连接接口MDIO:评估板连接PCA9306DCUT 电平转换至PHY芯片配置端<88E1111-B2>IIC:评估板连接 1Mb <ST_M24M01_HRMN6TP>Hyperlink:评估板连接CONN接口 <IPASS PLUS HD_36H>SRIO:评估板连接接口UART:评估板连接 RS232 <TI_MAX3221ECPWR>评估板连接USB _CHB通道<FT2232HL>FT2232HL 配置芯片<ATMEL_AT93C46DN_SH_T IIC>EMAC:评估板连接PHY芯片<MARVELL_88E1111_B2_BAB1C000>评估板时钟DSP时钟:25MHZ输入,可级联使用<CDCE62005RGZT>,由FPGA配置,再使能DSP DSP_CORE_CLKP/N:100MHZDSP_DDR_CLKP/N:66.667MHZDSP_PA_SS_CLKP/N:100MHZDSP_SRIO_SGMII_CLKP/N:312.5MHZDSP_MCM_CLKP/N:312.5MHZDSP_PCIE_CLKP/N:100MHZFT2232HL时钟:12MHZ88E1111时钟:25MHZFPGA时钟:<CDCE62005>评估板电源电源组1:SmartReflex:UCD9222+UCD7242RSJT<获取CVDD、VCC1V0>电源组2:TI_TPS54620RGY Vsense=0.8V Vin=12V Pe=90% 级联TPS73701DRBT <获取VCC3V3_AUX VCC1V8_AUX VCC2V5 VCC1V8 VCC1V2>电源组3:TI_TPS54620RGY Vsense=0.8V Vin=12V Pe=90% 级联TPS51200DRCT <获取VCC1V5 VCC0V75 >电源组4:TPS54231D <获取VCC5 >评估板其他器件:可编程缓冲方向4路缓冲器 TI_SN74AVC4T245PWR8位宽数据通道选择器 TI_TS3L301DGG两路电平转换器件<VCCA转VCCB> TI_PCA9306DCUT八路电平转换器件<VCCA转VCCB> TI_TXS0108EPWRRJ45 RJ45_W/XFMR&LED时钟选择器 IDT_ICS557GI-08LFTFPGA芯片 XILINX_XC3S200AN_4FTG256C。

多核学习中的增量学习与迁移学习方法(Ⅱ)

在当今信息爆炸的时代,学习的重要性愈发突出。

而在学习的过程中,多核学习以及增量学习与迁移学习方法也成为了研究学者们关注的焦点。

本文将围绕这一主题展开论述。

首先,我们需要了解什么是多核学习。

多核学习是一种通过融合来自多个核函数的信息来提高学习性能的方法。

在多核学习中,如何选择合适的核函数、如何融合多个核函数以及如何权衡不同核函数的重要性都是需要解决的问题。

目前,针对这些问题,学者们提出了很多方法,比如最大间隔多核学习、多核学习的逐步优化等。

这些方法都在一定程度上提高了多核学习的性能。

接着,我们来讨论增量学习与迁移学习方法。

增量学习是一种通过不断地积累新的知识来提高学习性能的方法。

在增量学习中,如何有效地整合新知识、如何避免老知识的遗忘以及如何平衡新老知识的重要性都是需要解决的问题。

目前,针对这些问题,学者们提出了很多方法,比如增量学习的稀疏表示、增量学习的深度学习等。

这些方法都在一定程度上提高了增量学习的性能。

然后,我们来思考增量学习与迁移学习方法之间的关系。

增量学习与迁移学习都是一种通过利用已有知识来提高学习性能的方法。

在增量学习中,我们可以利用已有知识来帮助学习新的知识,从而提高学习性能。

而迁移学习则是一种通过借用已有知识来帮助学习新的领域知识的方法。

因此,增量学习与迁移学习方法有着一定的相似之处,可以相互借鉴。

最后,我们来探讨多核学习中的增量学习与迁移学习方法。

在多核学习中,我们可以利用增量学习与迁移学习方法来提高学习性能。

比如,在多核学习中,我们可以利用增量学习方法来不断地积累新的核函数,从而提高多核学习的性能。

而在多核学习中,我们也可以利用迁移学习方法来借鉴已有的核函数,从而提高多核学习的性能。

因此,多核学习中的增量学习与迁移学习方法有着广阔的应用前景。

综上所述,多核学习中的增量学习与迁移学习方法是当前研究的热点,它们都有着广泛的应用前景。

我们相信随着更多的研究成果的涌现,多核学习的性能会得到进一步的提高,从而为人工智能领域的发展注入新的动力。

多核学习中的交叉验证策略与实现方法(四)

在机器学习领域,多核学习是一个非常重要的研究方向。

随着计算机性能的提升和数据规模的增大,传统的单核学习方法已经无法满足复杂任务的需求。

多核学习通过利用多个核函数来对复杂的数据进行建模和预测,可以取得更好的性能。

然而,在多核学习中,如何选择合适的核函数和参数,以及如何评估模型的性能,都是非常重要的问题。

交叉验证是一种常用的模型评估方法,本文将重点讨论多核学习中的交叉验证策略与实现方法。

首先,我们需要了解交叉验证的概念和原理。

交叉验证是一种通过将数据集划分为训练集和测试集,反复训练模型并评估其性能的方法。

常见的交叉验证方法包括简单交叉验证、K折交叉验证和留一交叉验证。

在多核学习中,由于每个核函数都有不同的参数,因此需要对每个核函数的参数进行交叉验证,以选择最优的参数组合。

这就需要在交叉验证的基础上,将参数搜索的过程嵌入到模型选择的过程中。

这就需要在交叉验证的基础上,将参数搜索的过程嵌入到模型选择的过程中。

其次,我们需要考虑多核学习中的参数搜索问题。

在多核学习中,每个核函数都有不同的参数,如何选择这些参数是一个非常重要的问题。

常见的参数搜索方法包括网格搜索、随机搜索和贝叶斯优化。

在多核学习中,由于每个核函数都有不同的参数,因此需要对每个核函数的参数进行搜索。

传统的参数搜索方法可能会导致计算量巨大,因此需要采用一些高效的参数搜索方法来提高搜索效率。

贝叶斯优化是一种基于贝叶斯优化的参数搜索方法,通过构建参数搜索的代理模型,可以在有限的预算内找到最优的参数组合。

最后,我们需要考虑多核学习中的交叉验证实现方法。

在多核学习中,由于每个核函数都有不同的参数,因此需要对每个核函数的参数进行交叉验证。

常见的交叉验证实现方法包括并行化交叉验证、分布式交叉验证和增量式交叉验证。

并行化交叉验证是一种通过并行计算来加速交叉验证的方法,可以大大减少交叉验证的计算时间。

分布式交叉验证是一种通过将数据和计算任务分布到多台计算机上来加速交叉验证的方法,可以处理大规模数据和计算任务。

多核学习中的增量学习与迁移学习方法(五)

在当今信息爆炸的时代,机器学习和人工智能技术的快速发展使得多核学习成为了一个备受关注的研究领域。

在实际应用中,数据量的增长和数据的稀疏性往往导致传统的机器学习方法在处理大规模数据时效果不佳。

在这种背景下,增量学习和迁移学习成为了解决这一问题的两大重要方法。

增量学习是指模型能够随着新数据的不断输入而不断更新自身的参数,从而实现对新知识的不断吸收和学习。

在多核学习中,增量学习方法可以帮助模型快速适应不断变化的数据分布,提高模型的泛化能力。

增量学习方法可以分为在线学习和批量增量学习两种。

在线学习是在模型接收到新数据后立即进行参数更新,从而实现对新知识的快速学习。

批量增量学习则是将新数据分批次输入模型进行学习,随着数据的不断输入,模型的参数不断更新。

在多核学习中,这两种增量学习方法都可以帮助模型适应不断变化的数据分布,提高模型的预测能力。

同时,增量学习方法还可以有效缓解数据稀疏性带来的问题,提高模型的泛化能力。

除了增量学习方法,迁移学习也是多核学习中一个备受关注的方法。

迁移学习是指将在一个任务上学习到的知识迁移到另一个相关的任务上,从而提高模型在新任务上的性能。

在多核学习中,迁移学习可以帮助模型充分利用已有的知识,提高模型的学习效率和泛化能力。

迁移学习可以分为有监督迁移学习和无监督迁移学习两种。

有监督迁移学习是指在源域和目标域都有标签的情况下进行迁移学习,从而提高模型在目标域上的性能。

无监督迁移学习则是在目标域上没有标签的情况下进行迁移学习,通过挖掘数据间的内在关系来提高模型的泛化能力。

在多核学习中,这两种迁移学习方法都可以帮助模型在面对新的任务时提高学习效率和泛化能力。

在实际应用中,增量学习和迁移学习方法的选择需要根据具体的任务和数据特点来进行。

同时,增量学习和迁移学习方法也可以结合起来,相互之间进行协同学习,从而提高模型在多核学习中的性能。

综上所述,增量学习和迁移学习是多核学习中两大重要的方法。

增量学习可以帮助模型快速适应不断变化的数据分布,提高模型的泛化能力。

多核学习的基本原理与概念

多核学习的基本原理与概念随着社会的不断发展,教育也在不断改革和创新。

多核学习作为一种新型的学习模式,逐渐引起人们的重视。

多核学习是指在教学过程中,教师通过不同的方式和方法,让学生以多种形式获得知识,从而提高学习效果。

一、多元化教学方式在多核学习中,教师不再局限于传统的课堂讲授模式,而是采用多种教学方式。

比如,教师可以组织学生进行小组讨论,让学生在交流中学习;也可以设计实验课程,让学生在实践中积累经验;还可以利用多媒体教学,让学生在视听中获取信息。

这种多元化的教学方式,可以更好地激发学生的学习兴趣,让他们更主动地参与学习过程。

二、个性化学习需求多核学习注重挖掘学生的个性化学习需求,不再以统一的标准来要求学生。

每个学生都有自己的学习特点和兴趣爱好,教师需要根据学生的特点和需求,为他们量身定制学习计划。

比如,对于喜欢阅读的学生,可以引导他们多读一些相关的书籍;对于喜欢运动的学生,可以组织相关的体育活动。

通过个性化的学习需求,可以更好地激发学生的学习潜能,提高学习效果。

三、跨学科知识结合多核学习强调跨学科知识的结合,帮助学生更好地理解知识点。

比如,在学习物理知识时,可以结合数学知识进行讲解;在学习地理知识时,可以结合历史知识进行讲解。

这种跨学科知识的结合,可以帮助学生更好地理解知识,形成知识网络,提高知识的综合运用能力。

四、综合评价体系在多核学习中,不再只通过一次考试来评价学生的学习成果,而是引入综合评价体系。

综合评价体系包括平时表现、作业质量、实验成绩等多个方面,通过综合评价来评价学生的学习成果。

这种评价体系可以更全面地反映学生的学习状况,也可以减少学生的考试压力,让他们更多地关注知识的理解和应用。

五、实践教学结合多核学习强调理论知识与实践能力的结合。

在教学过程中,教师不再只注重理论知识的传授,而是注重培养学生的实践能力。

比如,在化学实验课程中,教师可以引导学生进行实验操作,让他们亲自动手,感受化学反应的过程;在历史课程中,可以组织学生进行田野调查,让他们亲身体验历史的魅力。

多核学习中的增量学习与迁移学习方法(十)

随着人工智能技术的不断发展,机器学习成为了人们关注的焦点。

特别是在多核学习中,增量学习和迁移学习方法成为了研究的热点。

本文将从增量学习和迁移学习的概念、应用以及方法等多个角度进行探讨。

首先,我们来了解一下增量学习和迁移学习的概念。

增量学习是指在已有模型的基础上,通过不断地添加新的数据来更新和优化模型。

这种学习方法可以帮助模型适应新的数据分布,保持模型的准确性。

而迁移学习则是指将已经学习到的知识应用于新的领域,通过利用源领域的知识来加速目标领域的学习过程,提高模型的性能。

在实际应用中,增量学习和迁移学习方法有着广泛的应用。

比如在语音识别领域,当我们需要不断地更新识别模型以适应用户的不断变化的语音输入时,就可以使用增量学习方法来实现模型的动态更新。

而在计算机视觉领域,当我们需要将在一个领域上训练好的模型应用到另一个领域时,就可以使用迁移学习方法来实现模型的知识迁移和应用。

针对增量学习和迁移学习方法,研究者们提出了许多不同的策略和算法。

其中,增量学习方法主要包括增量式学习、批量增量学习和在线增量学习等。

增量式学习是指将新数据逐个地添加到模型中进行学习,适用于数据规模较小的情况;批量增量学习是指将新数据分批添加到模型中进行学习,适用于数据规模较大的情况;在线增量学习则是指将新数据以流的形式添加到模型中进行学习,适用于数据不断增加的情况。

而迁移学习方法主要包括基于实例的迁移学习、基于特征的迁移学习和基于模型的迁移学习等。

基于实例的迁移学习是指将源领域的样本直接用于目标领域的学习,适用于源领域和目标领域的特征空间相似的情况;基于特征的迁移学习是指通过特征变换的方式来实现迁移学习,适用于源领域和目标领域的特征空间不同的情况;基于模型的迁移学习则是指将源领域的模型知识迁移到目标领域,适用于源领域和目标领域的任务类似的情况。

总的来说,增量学习和迁移学习方法在多核学习中发挥着重要作用。

它们可以帮助模型不断地适应新的数据,并将已有的知识迁移到新的领域,从而提高模型的性能。

多核学习中的交叉验证策略与实现方法(五)

随着机器学习和深度学习技术的发展,多核学习逐渐成为了一个热门的研究领域。

多核学习是指在多个核函数中选择最优的核函数来进行学习,以提高模型的准确性和泛化能力。

在多核学习中,交叉验证是一个重要的评估方法,它可以有效地评估模型在未知数据上的泛化能力,并选择最优的核函数。

本文将介绍多核学习中的交叉验证策略与实现方法。

交叉验证是一种常用的模型评估方法,它通过将数据集分成训练集和测试集,多次交替地使用不同的训练集和测试集来评估模型的性能。

在多核学习中,交叉验证可以用来评估不同核函数的性能,并选择最优的核函数。

在进行交叉验证时,需要选择合适的交叉验证策略和实现方法。

1. 交叉验证策略在多核学习中,常用的交叉验证策略包括k折交叉验证和留一交叉验证。

k折交叉验证将数据集分成k个子集,每次将其中一个子集作为测试集,其余k-1个子集作为训练集,多次交替地使用不同的训练集和测试集来评估模型的性能。

留一交叉验证是k折交叉验证的特例,其中k等于数据集的大小。

这两种交叉验证策略都可以有效地评估模型的泛化能力,选择最优的核函数。

2. 实现方法在实现多核学习中的交叉验证时,需要考虑如何选择合适的核函数和评估标准。

首先,可以通过网格搜索的方法来选择最优的核函数参数。

网格搜索是一种通过遍历参数空间来选择最优参数的方法,可以有效地选择最优的核函数参数。

其次,可以通过交叉验证的方法来评估模型的性能。

在进行交叉验证时,需要选择合适的评估标准,例如平均绝对误差(MAE)、均方误差(MSE)等。

通过选择合适的核函数和评估标准,可以有效地评估模型的性能,并选择最优的核函数。

在实现多核学习中的交叉验证时,还需要考虑如何处理不平衡数据集和多标签数据集。

不平衡数据集是指不同类别的样本数量差异较大的数据集,多标签数据集是指每个样本可以属于多个类别的数据集。

在处理不平衡数据集时,可以通过过采样和欠采样的方法来平衡不同类别的样本数量。

在处理多标签数据集时,可以通过多标签分类的方法来处理每个样本可以属于多个类别的情况。

多核学习中的交叉验证策略与实现方法(八)

在当今科技飞速发展的时代,计算机的多核学习技术越来越受到人们的关注。

多核学习是一种利用多个处理器核心来并行处理大规模数据的机器学习方法。

然而,多核学习中存在的一个重要问题是如何有效地评估模型的性能。

交叉验证是一种常用的评估模型性能的方法,而在多核学习中,如何设计和实现交叉验证策略成为了一个挑战。

本文将从交叉验证的概念入手,探讨多核学习中的交叉验证策略与实现方法。

交叉验证是一种通过将数据集划分为训练集和测试集,反复训练和测试模型来评估模型性能的方法。

常见的交叉验证方法包括k折交叉验证和留一交叉验证。

在多核学习中,由于数据规模大、计算复杂度高,如何设计合适的交叉验证策略成为了一个关键问题。

一种常见的多核学习交叉验证策略是并行交叉验证。

在并行交叉验证中,将数据集划分为多个子集,然后并行地训练和测试模型。

这种方法能够充分利用多核处理器的并行计算能力,提高交叉验证的效率。

但是,并行交叉验证也面临着数据划分和模型训练的同步问题,需要合理设计算法以保证并行计算的正确性和有效性。

另一种多核学习交叉验证策略是分布式交叉验证。

在分布式交叉验证中,将数据集分布到多个计算节点上,并行地训练和测试模型。

这种方法能够充分利用集群计算资源,提高交叉验证的效率和扩展性。

但是,分布式交叉验证也需要解决数据通信和同步的问题,需要合理设计通信和同步机制以保证分布式计算的正确性和有效性。

除了并行交叉验证和分布式交叉验证,还有一种常见的多核学习交叉验证策略是基于GPU的交叉验证。

由于GPU具有强大的并行计算能力,可以显著加速模型的训练和测试过程。

在基于GPU的交叉验证中,将数据集和模型放到GPU上进行并行计算,能够大大提高交叉验证的效率。

但是,基于GPU的交叉验证也需要解决数据传输和GPU计算资源的管理问题,需要合理设计算法以充分利用GPU的并行计算能力。

总的来说,多核学习中的交叉验证策略与实现方法是一个复杂而又重要的问题。

在实际应用中,需要根据数据规模、计算资源和算法特点来选择合适的交叉验证策略。

多核学习的应用场景和优势分析(Ⅰ)

多核学习的应用场景和优势分析随着人工智能技术的迅速发展,多核学习作为一种新兴的机器学习方法,正在逐渐受到关注。

相比传统的单核学习方法,多核学习在处理复杂数据和提高模型性能方面具有明显的优势。

本文将从多核学习的应用场景和优势两个方面进行探讨。

一、多核学习的应用场景1. 图像识别图像识别是多核学习的一个重要应用场景。

在图像识别任务中,数据通常具有高维度、复杂的特征,而且存在大量噪音和不确定性。

传统的单核学习方法往往难以有效地处理这些问题,而多核学习可以通过整合多个核函数的信息,提高模型的泛化能力和鲁棒性,从而更好地实现图像识别任务。

2. 自然语言处理自然语言处理是另一个适合多核学习的应用场景。

在处理文本数据时,常常会遇到词汇量大、语义复杂、上下文相关性强等问题。

多核学习可以利用不同的核函数来捕捉文本数据的不同特征,从而提高模型的表达能力和语义理解能力,实现更精准的自然语言处理。

3. 生物信息学在生物信息学领域,多核学习也有着广泛的应用。

生物数据通常具有高维度、稀疏性和复杂的结构,传统的单核学习方法往往难以有效地挖掘这些数据的潜在规律。

而多核学习可以通过结合不同核函数的信息,更好地解释生物数据的复杂结构,实现更准确的生物信息学分析和预测。

二、多核学习的优势分析1. 提高模型性能多核学习可以通过整合多个核函数的信息,提高模型的表达能力和泛化能力,从而更好地挖掘数据的潜在规律,实现更精准的模型预测。

2. 增强模型鲁棒性传统的单核学习方法通常对数据的噪音和不确定性较为敏感,容易出现过拟合或欠拟合的情况。

而多核学习可以通过结合不同核函数的信息,增强模型的鲁棒性,更好地适应复杂的数据环境,提高模型的稳定性和可靠性。

3. 适应复杂数据多核学习可以适应处理高维度、稀疏性、复杂结构的数据,更好地挖掘数据的隐藏信息,实现更精准的数据分析和预测。

4. 提升计算效率在实际应用中,多核学习方法通常能够并行处理多个核函数的计算,从而提升计算效率,降低模型训练和预测的时间成本。

多核学习的基本原理与概念(十)

多核学习的基本原理与概念随着人工智能技术的飞速发展和应用,机器学习作为其中的一个重要分支也得到了广泛的关注和应用。

多核学习作为机器学习领域的一个热门研究方向,其基本原理与概念对于深入理解机器学习的原理和方法具有重要意义。

本文将从多核学习的基本原理、概念和应用等方面展开论述。

多核学习的基本原理多核学习是指利用多个核函数来构建模型,以提高模型的预测性能。

在传统的机器学习中,通常使用一个固定的核函数来进行模型的构建和预测。

但是在实际应用中,不同的数据集和问题往往需要不同的核函数来进行建模,而多核学习的思想就是利用多个核函数的组合来构建模型,以提高模型的泛化能力和预测性能。

多核学习的基本原理可以用数学公式来描述。

假设我们有一个包含n个样本的数据集X={x1, x2, ..., xn},以及对应的标签y={y1, y2, ..., yn}。

多核学习的目标是通过学习一个函数f(x)来预测样本x的标签y。

在多核学习中,我们需要使用多个核函数k1(x, x'), k2(x, x'), ..., km(x, x')来构建模型,即f(x) = α1k1(x, x') + α2k2(x, x') + ... + αmkm(x, x')。

其中,α1, α2, ..., αm为模型的参数,需要通过训练数据来学习得到。

多核学习的基本概念在多核学习中,有一些基本的概念是需要了解的。

首先是核函数的选择。

核函数是多核学习中最基本的组成部分,它可以将数据映射到高维空间中,从而使得原本线性不可分的数据在高维空间中变得线性可分。

常用的核函数包括线性核函数、多项式核函数、高斯核函数等。

在多核学习中,我们需要根据数据集和问题的特点来选择合适的核函数,以提高模型的预测性能。

其次是核函数的组合。

在多核学习中,我们需要将多个核函数进行组合来构建模型。

核函数的组合可以使用简单的加法或乘法运算,也可以通过学习得到参数来进行组合。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

在研究模式识别的势函数方法时, 利用 Mercer 理 论, 把核函数解释为一个特征空间的内积, 并引入 到机器学习中. 但是, 当时核方法的潜能并没有被 完全挖掘. 直到 1992 年, Boser 等[11] 提出 SVM 方法. SVM 的成功促进了核方法的迅速普及和 发展, 逐渐渗透到了机器学习的诸多领域, 如回归 估计[12] 、模式分类[13] 、概率密度估计[14] 、子空间 分析等[15] . 典型的如 Sch¨ olkopf 等[15] 提出了核主 成分分析 (Kernel principal component analysis, KPCA), Mika 等[16] 实现了核 Fisher 判别 (Kernel Fisher discriminant, KFD), Baudat 等[17] 提出的 核判别分析 (Kernel discriminant analysis, KDA), Lai 等[18] 提出了核规范相关分析 (Kernel canonical correlation analysis, KCCA), Bach 等[19] 提出了 核独立分量分析 (Kernel independent component analysis, KICA) 等. 此后, 核方法又得到了大量的 改进和推广, 在多个领域得到了广泛应用. 尽管上述的核方法在众多的应用领域有效并且 实用, 但这些方法都是基于单个特征空间的单核方 法. 由于不同的核函数具有的特性并不相同, 从而 使得在不同的应用场合, 核函数的性能表现差别很 大, 且核函数的构造或选择至今没有完善的理论依

人们对核方法[1−3] 的关注, 得益于支持向量机 (Support vector machine, SVM)[4−5] 理论的发展 和应用, 核函数的采用使得线性的 SVM 很容易推广 到非线性的 SVM. 其核心在于利用相对简单得多的 核函数运算, 既避免了特征空间中复杂的内积计算, 又避免了特征空间 (学习机器) 本身的设计[6−7] . 实 际上, 有关核函数的研究很早就开始了. 早在 1909 年, Mercer[8] 就研究了正负类型的函数与积分等式 理论的联系. 1950 年前后, Aronszajn[9] 发展了再生 核希尔伯特空间的理论. 1964 年, Aizerman 等[10]

收稿日期 2009-07-13 录用日期 2010-04-01 Manuscript received July 13, 2009; accepted April 1, 2010 国家重点基础研究专项基金 (G2007cb311003), 国家自然科学基金 (60625304, 60621062) 资助 Supported by National Key Project for Basic Research of China (G2007cb311003) and National Natural Science Foundation of China (60625304, 60621062) 1. 第二炮兵工程学院指挥自动化系 西安 710025 2. 清华大学计算 机科学与技术系 智能技术与系统国家重点实验室 清华信息科学与技术 国家实验室 北京 100084

1038

自

动

化

学

报Байду номын сангаас

36 卷

据. 此外, 当样本特征含有异构信息 (Heterogeneous information)[20−26] , 样本规模很大[27−30] , 多维数据 的不规则 (Unnormalised data)[31−32] 或数据在高 维特征空间分布的不平坦 (Non-flat)[33−34] , 采用单 个简单核进行映射的方式对所有样本进行处理并不 合理. 针对这些问题, 近年来, 出现了大量关于核组 合 (Kernel combination) 方法的研究, 即多核学习 方法[23, 31, 35−40] . 多核模型是一类灵活性更强的基于核的学习 模型, 近来的理论和应用已经证明利用多核代替单 核能增强决策函数的可解释性 (Interpretability), 并能获得比单核模型或单核机器组合模型更优的 性能[41−42] . 构造多核模型, 最简单也最常用的一 种方法就是考虑多个基本核函数的凸组合, 其形 M M 如: K = j =1 βj Kj , βj ≥ 0, j =1 βj = 1, 这 里 Kj 是基本核函数, M 是基本核的总个数, βj 是权系数. 因此, 在多核框架下, 样本在特征空间 中的表示问题转化成为基本核与权系数的选择问 题. 在这个由多个特征空间构建的组合空间中, 由 于组合利用了各基本核的特征映射能力, 很好地解 决了核函数的选择以及与核目标度量 (Kernel target alignment, KTA)[43−44] 相关的变量与模型的 选择难题[31, 45−46] . 同时, 通过将异构数据的不同 特征分量分别输入对应的核函数进行映射, 使数 据在新的特征空间中得到更好的表达, 能显著提 高分类正确率或预测精度. 但是, 这里最重要的问 题就是如何得到这个组合的特征空间, 也就是如 何学习得到权系数. 针对这一问题, 近来出现了 多种有效的多核学习理论及方法. 如早期的基于 Boosting[21, 47] 的多核组合模型学习方法, 基于半 定规划 (Semidefinite programming, SDP)[41] 的多 核学习方法, 基于二次约束型二次规划 (Quadratically constrained quadratic program, QCQP)[36] 的学习方法, 基于半无限线性规划 (Semi-infinite linear program, SILP)[24, 37] 的学习方法, 基于超核 (Hyperkernels)[31] 的学习方法, 以及近来出现的简 单多核学习 (Simple MKL)[27, 29] 方法和基于分组 Lasso 思想的多核学习方法. 在权系数与核函数的 组合方面, 研究人员也对多核方法进行了一些改进, 如非平稳的多核学习方法[23] , 局部多核学习方法[40] , 非稀疏多核学习方法[30] 等. 此外, 基于一类具有多 尺度表示特性的核函数, 多核学习方法向多尺度核 方法方向又出现了众多的扩展[32−34, 48−52] . 前述的 这些多核学习方法都是在有限个基本核函数组合假 设下进行的, 容易看到, 有限核的组合受限于选择的 有限性, 为了将其扩展到大量核组合的情形, 近来又 出现了基于无限核的学习方法[39, 53−54] . 从最初在生物信息学领域[55−56] 被提出, 多核

学习通过与 SVM 方法相结合, 在众多领域都得到 了研究人员的关注, 如模式分类[45, 57−61] 、多类目标 检测与识别[25, 62−65] 、模式回归[22, 33−34, 46] 、特征提 取[66] 等, 给核机器学习提供了更丰富的设计思路和 更广泛的应用前景. 本文系统综述了多核方法的构造和学习, 在分 析各种典型方法的特点、总结该领域的研究现状和 应用的基础上, 凝炼了其进一步的发展方向. 本文后 续内容如下: 首先, 简单介绍核方法原理和基本核 函数的一些简单扩展; 然后, 从合成核方法、多尺度 核方法、无限核方法三个方面综述了各自的构造理 论、学习方法及其优缺点, 以及相应的应用领域; 最 后, 总结了多核学习方法目前存在的关键问题和难 点, 指出了该领域进一步的研究方向.

1. Department of Command Automation, the Second Artillery Engineering Institute, Xi an 710025 2. Department of Computer Science and Technology, State Key Laboratory of Intelligent Technology and Systems, Tsinghua National Laboratory for Information Science and Technology, Tsinghua University, Beijing 100084

第 36 卷 第 8 期

2010 年 8 月

自 动 化 学 报

ACTA AUTOMATICA SINICA

Vol. 36, No. 8 August, 2010

多核学习方法

汪洪桥 1, 2 孙富春 2 蔡艳宁 1 陈 宁2 丁林阁 2

摘 要 多核学习方法是当前核机器学习领域的一个新的热点. 核方法是解决非线性模式分析问题的一种有效方法, 但在一 些复杂情形下, 由单个核函数构成的核机器并不能满足诸如数据异构或不规则、 样本规模巨大、 样本不平坦分布等实际的应用 需求, 因此将多个核函数进行组合, 以获得更好的结果是一种必然选择. 本文根据多核的构成, 从合成核、 多尺度核、 无限核三 个角度, 系统综述了多核方法的构造理论, 分析了多核学习典型方法的特点及不足, 总结了各自的应用领域, 并凝炼了其进一 步的研究方向. 关键词

DOI

核方法, 多核学习, 合成核, 多尺度核, 支持向量机, 模式识别, 回归

10.3724/SP.J.1004.2010.01037

On Multiple Kernel Learning Methods

WANG Hong-Qiao1, 2 SUN Fu-Chun2 CAI Yan-Ning1 CHEN Ning2 DING Lin-Ge2 Abstract Multiple kernel learning is a new research focus in the current kernel machine learning field. The kernel method is an effective approach for non-linear pattern analysis problems. But in some complicated cases, researchers find that the kernel machines with a single kernel function can not meet some practical requirements such as heterogeneous information or unnormalised data, large scale problems, non-flat distribution of samples, etc. Therefore, it is an inevitable choice to consider the combination of kernel functions for better results. According to the composition of multiple kernels, the construction theories of multiple kernel methods are systematically reviewed, the learning methods of multiple kernel with the corresponding characteristics and disadvantages are also analyzed, and the respective applications are summarized from three aspects, which are the composite kernels, the multi-scale kernels, and the infinite kernels. In addition, the paper generalizes the conclusions and some new directions for future work. Key words Kernel method, multiple kernel learning, composite kernel, multi-scale kernel, support vector machine (SVM), pattern recognition, regression