信息论与编码问题详解

信息论与编码题库及答案

信息论与编码题库及答案信息论是一门关于信息传输和处理的学科,主要研究信息的传输、存储与处理,以及在信息传输过程中可能产生的各种噪声和干扰。

信息论在近年来得到了广泛的应用,尤其在计算机科学、通信工程、数据处理以及加密技术等领域中得到了广泛应用。

作为信息处理学科的一个分支,编码学是信息论中重要的研究领域之一,主要研究在信息传输的过程中如何将信息进行编码,并在保证高可靠性的同时减少信息传输的开销。

现代编码学研究所涉及到的内容非常广泛,包括错误检测、纠正编码、信息压缩以及密码学等领域。

为了帮助广大信息与通信工程学习者更好地掌握编码理论及其应用,以下总结了一些编码学的题库及答案,供大家参考。

一、错误检测编码1. 什么是奇偶校验码?答:奇偶校验码是一种简单的错误检测编码方式,它采用了消息的一位奇偶性作为编码方式。

具体而言,对于一组位数固定的二进制数,在其中加入一个附加位,使得这组数的位数为偶数。

然后将这些二进制数按照某种规则排列,例如相邻的两位组成一组,计算每组中1的个数。

如果某组中1的个数是偶数,则附加位赋值为0,否则为1。

这样,如果在传输的过程中数据出现了单一位的错误,则会被检测出来。

2. 什么是海明编码?答:海明编码是一种通过添加校验位来实现错误检测和纠正的编码方式。

在海明编码中,校验位的数目为2的k次幂个,其中k 表示数据位中最大1的位置数。

具体而言,将原始信息看作一组二进制数,再将这些数按照某种规则排列,然后按照一定的算法计算出每个校验位的值,并将这些值添加到原始信息中。

在传输的过程中,如果发现了错误的位,则可以通过一系列错误检测和纠正的操作来确定和修复出错的信息位。

二、信息压缩编码1. 什么是霍夫曼编码?答:霍夫曼编码是一种基于无损数据压缩的编码方式,它的特点是可以将原始信息中出现最频繁的字符用最短的二进制码来表示,同时将出现次数较少的字符用较长的二进制码来表示。

具体来说,霍夫曼编码首先对原始信息中的字符进行统计,确定每个字符出现的频率。

信息论与编码讲义第十八讲

y = ( y1 , L, y N ) ∈ Y N 。若序列对 x

7

定义5.3.2

(1) ( 2 ) (l ) N长 x , x , L , x

(

)x( ) , x( ) ,L, x( )

( N,ε ) )

定义为

(1) ( 2) 1 (l ) T (1) ( 2) (l ) ( N , ε ) = x , x ,L , x : log p ( s ) − H ( S ) < ε ( x , x ,L, x ) N ∀S ⊆ S

2010-10-31 2

§5.2 离散信道编码定理

设信源序列经过信源编码后变成了如下的序列 …X-2X-1X0X1X2…。 设各随机变量独立同分布。记H(X)为X0的熵,C为信道容量。 如果设备所确定的编码速率R<C/H(X),则能够同时满足以下 两条要求: (1) L/N使正确译码(正确接收)的概率尽可能接近1。 (2) L/N ≥R。 如果设备所确定的编码速率R>C/H(X),则不能够同时满足这 两条要求。 (如果设备所确定的编码速率R=C/H(X),则情况如何?很复 杂,属于边界情况,没有简单整齐的结论。 )

1 2 l

(

)

{(

X (1) , X ( 2) ,L , X (l )

)}

( X ( ) , X ( ) ,L, X ( ) ) 中的任意子集。 式中的 是

2010-10-31 8

§5.2 离散信道编码定理

定义5.3.3 对给定离散无记忆信道和任意 ε > 0 ,若有 一种编码速率为的 ε 码,在 N 足够大时, 能使 pe < ε ,就称 R 是可达的。

第五章: 第五章:信道编码定理(一)

信息论与编码 共析

信息论与编码一、介绍信息论与编码是一门研究信息传递、存储和处理的学科,它于1948年由克劳德·香农提出。

信息论与编码主要关注如何在信息传递过程中通过编码技术来提高信息传输的效率和可靠性。

本文将深入探讨信息论与编码的基本概念、原理以及应用。

二、信息论的基本概念1. 信息的定义信息是指能够改变接收者行为或知识状态的事物或信号。

在信息论中,信息的单位通常用比特(bit)来表示,表示一个二进制的选择。

2. 信息的熵信息的熵是衡量信息量的一个指标,表示信息的不确定性。

熵越高,信息量越大,不确定性越高;熵越低,信息量越小,不确定性越低。

在信息论中,熵的单位通常用比特/秒(bit/s)来表示。

3. 信源和信道信源是指信息的来源,可以是任何能够产生信息的物体或系统。

信道是指信息传递的媒介,可以是实际的通信线路或无线电波等。

三、编码的基本原理1. 数据压缩编码数据压缩编码是一种通过减少信息的冗余性来减小数据的体积的技术。

其中,无损数据压缩编码通过消除冗余和统计特性来实现数据的无损压缩,而有损数据压缩编码通过舍弃部分信息来实现更高的压缩比。

2. 信道编码信道编码是一种在信道传输过程中,为了增强数据的可靠性而对数据进行编码和解码的技术。

常见的信道编码方式包括前向纠错码和卷积码等。

3. 源编码源编码是一种将信息源的符号序列转换为另一符号序列的技术,以便提高数据传输效率。

在源编码中,常用的方式包括霍夫曼编码和算术编码等。

四、信息论与编码的应用1. 通信系统中的应用信息论与编码在通信系统中有广泛的应用。

通过对信源进行编码和压缩,可以提高信息传输的效率和可靠性。

同时,信道编码可以提高数据在信道传输中的可靠性,减少传输错误。

2. 数据存储与压缩信息论与编码在数据存储与压缩领域也有广泛的应用。

通过对数据进行编码和压缩,可以减小存储空间的需求,降低存储成本,并提高数据的读写效率。

3. 图像和音频处理信息论与编码在图像和音频处理中也起到重要的作用。

信息论与编码第三版答案

信息论与编码第三版答案《信息论与编码》是一本非常经典的书籍,已经成为了信息科学领域中的经典教材。

本书的第三版已经出版,相比于前两版,第三版的变化不小,主要是增加了一些新内容,同时也对一些旧内容做了修改和完善。

作为一本教材,上面的题目和习题都是非常重要的,它们可以帮助读者更好地理解书中的相关概念和知识点,同时也可以帮助读者更好地掌握理论和技术。

因此,本文将介绍《信息论与编码》第三版中部分习题的答案,方便读者快速查阅和学习。

第一章:信息量和熵1.1 习题1.1Q:两个随机变量的独立性和无关性有什么区别?A:独立性和无关性是两个不同的概念。

两个随机变量是独立的,当且仅当它们的联合概率分布等于乘积形式的边缘概率分布。

两个随机变量是无关的,当且仅当它们的协方差等于0。

1.2 习题1.7Q:什么样的随机变量的熵等于0?A:当随机变量的概率分布是确定的(即只有一个概率为1,其余全为0),其熵等于0。

第二章:数据压缩2.5 习题2.9Q:为什么霍夫曼编码比熵编码更加高效?A:霍夫曼编码能够更好地利用信源的统计特征,将出现频率高的符号用较短的二进制编码表示,出现频率低的符号用较长的二进制编码表示。

这样一来,在编码过程中出现频率高的符号会占用较少的比特数,从而能够更加高效地表示信息。

而熵编码则是针对每个符号分别进行编码,没有考虑符号之间的相关性,因此相比于霍夫曼编码更加低效。

第四章:信道编码4.2 习题4.5Q:在线性块码中,什么是生成矩阵?A:在线性块码中,生成矩阵是一个包含所有二元线性组合系数的矩阵。

它可以用来生成码字,即任意输入信息序列可以通过生成矩阵与编码器进行矩阵乘法得到相应的编码输出序列。

4.3 习题4.12Q:简述CRC校验的原理。

A:CRC校验是一种基于循环冗余校验的方法,用于检测在数字通信中的数据传输错误。

其基本思想是将发送数据看作多项式系数,通过对这个多项式进行除法运算,得到余数,将余数添加到数据尾部,发送给接收方。

信息论与编码陈运主编答案完整版

p x x( i1 i3 )log p x( i3 / xi1)

i1 i2 i3

i1 i3

∑∑∑ ∑∑∑ = −

p x x x( i1 i2i3 )log p x( i3 / x xi1 i2 ) +

p x x x( i1 i2i3 )log p x( i3 / xi1)

i1

i2 i3 i1 i2 i3 p x( i3 / xi1)

( 1)

5 / 61

⎧p e( 1 ) = p e( 2 ) = p e( 3 ) ⎨

⎩p e( 1 ) + p e( 2 ) + p e( 3 ) =1 ⎧p e( 1 ) =1/3 ⎪ ⎨p e( 2 ) =1/3 ⎪⎩p e( 3 ) =1/3

⎧p x( 1 ) = p e( 1 ) (p x1 /e1 ) + p e( 2 ) (p x1 /e2 ) = p p e⋅( 1 ) + p p e⋅( 2 ) = (p + p)/3 =1/3 ⎪⎪ ⎨p x( 2 ) = p e( 2 ) (p x2 /e2 ) + p e( 3 ) (p x2 /e3 ) =p p e⋅( 2 ) + p p e⋅( 3 ) = (p + p)/3 =1/3

p x( i ) = I x( i ) =−log p x( i ) = log52!= 225.581 bit

(2) 52 张牌共有 4 种花色、13 种点数,抽取 13 张点数不同的牌的概率如下:

413 p x( i ) =

C5213

413 I x( i ) = −log p x( i ) = −log C5213 =13.208 bit

解: (1)

《信息论与编码理论》(王育民李晖梁传甲)课后习题问题详解高等教育出版社

信息论与编码理论习题解第二章-信息量和熵2.1解: 平均每个符号长为:1544.0312.032=⨯+⨯秒 每个符号的熵为9183.03log 3123log 32=⨯+⨯比特/符号所以信息速率为444.34159183.0=⨯比特/秒2.2 解: 同步信号均相同不含信息,其余认为等概,每个码字的信息量为 3*2=6 比特; 所以信息速率为600010006=⨯比特/秒2.3 解:(a)一对骰子总点数为7的概率是366 所以得到的信息量为 585.2)366(log 2= 比特 (b) 一对骰子总点数为12的概率是361 所以得到的信息量为 17.5361log 2= 比特 2.4 解: (a)任一特定排列的概率为!521,所以给出的信息量为 58.225!521log 2=- 比特 (b) 从中任取13张牌,所给出的点数都不相同的概率为13521313521344!13C A =⨯所以得到的信息量为 21.134log 1313522=C 比特.2.5 解:易证每次出现i 点的概率为21i,所以比特比特比特比特比特比特比特398.221log 21)(807.1)6(070.2)5(392.2)4(807.2)3(392.3)2(392.4)1(6,5,4,3,2,1,21log )(2612=-==============-==∑=i i X H x I x I x I x I x I x I i ii x I i2.6 解: 可能有的排列总数为27720!5!4!3!12= 没有两棵梧桐树相邻的排列数可如下图求得, Y X Y X Y X Y X Y X Y X Y X Y图中X 表示白杨或白桦,它有⎪⎪⎭⎫⎝⎛37种排法,Y 表示梧桐树可以栽种的位置,它有⎪⎪⎭⎫⎝⎛58种排法,所以共有⎪⎪⎭⎫ ⎝⎛58*⎪⎪⎭⎫⎝⎛37=1960种排法保证没有两棵梧桐树相邻,因此若告诉你没有两棵梧桐树相邻时,得到关于树排列的信息为1960log 27720log 22-=3.822 比特 2.7 解: X=0表示未录取,X=1表示录取; Y=0表示本市,Y=1表示外地;Z=0表示学过英语,Z=1表示未学过英语,由此得比特比特比特)01(log )01()0()00(log )00()0()(8113.04log 4134log 43)()(02698.04110435log 104354310469log 10469)1()01(log )01()0()00(log )00()0;(104352513/41)522121()0(/)1())11()1,10()10()1,00(()01(104692513/43)104109101()0(/)0())01()0,10()00()0,00(()00()(4512.04185log 854383log 83)1()01(log )01()0()00(log )00()0;(8551/4121)0(/)1()10()01(8351/43101)0(/)0()00()00()(,251225131)1(,2513100405451)10()1()00()0()0(,54511)1(,51101432141)10()1()00()0()0(,41)1(,43)0(222222222222+=====+=======+==+======+========⨯⨯+========+=========⨯⨯+========+=========+======+========⨯=========⨯=========-===⨯+====+======-===⨯+⨯====+=========x y p x y p x p x y p x y p x p X Y H X H c x p z x p z x p x p z x p z x p z X I z p x p x y p x y z p x y p x y z p z x p z p x p x y p x y z p x y p x y z p z x p b x p y x p y x p x p y x p y x p y X I y p x p x y p y x p y p x p x y p y x p a z p y z p y p y z p y p z p y p x y p x p x y p x p y p x p x p2.8 解:令{}{}R F T Y B A X ,,,,==,则比特得令同理03645.0)()(5.0,02.03.0)2.05.0(log 2.0)()2.05.0(log )2.05.0()2.03.0(log )2.03.0(5.0log 5.03.0log 3.0)5log )1(2.02log )1(5.0log )1(3.05log 2.0log 3.02log 5.0(2.0log 2.0)2.05.0(log )2.05.0()2.03.0(log )2.03.0()()();()(2.0)(,2.05.0)(2.03.0)1(3.05.0)()()()()(5.0max 2'2222223102231022222==∴==+-=---++-+=-+-+-+++-----++-=-===-=+=-⨯+=+==p p I p I p pp p I p p p p p p p p p p p p p p X Y H Y H Y X I p I R P p F P pp p B P B T P A P A T P T P2.9 & 2.12解:令X=X 1,Y=X 1+X 2,Z=X 1+X 2+X 3, H(X 1)=H(X 2)=H(X 3)= 6log 2 比特 H(X)= H(X 1) = 6log 2 =2.585比特 H(Y)= H(X 2+X 3)=6log 61)536log 365436log 364336log 363236log 36236log 361(2222222+++++ = 3.2744比特 H(Z)= H(X 1+X 2+X 3)=)27216log 2162725216log 2162521216log 2162115216log 2161510216log 216106216log 21663216log 2163216log 2161(222222222++++++= 3.5993比特 所以H(Z/Y)= H(X 3)= 2.585 比特 H(Z/X) = H(X 2+X 3)= 3.2744比特 H(X/Y)=H(X)-H(Y)+H(Y/X) = 2.585-3.2744+2.585 =1.8955比特H(Z/XY)=H(Z/Y)= 2.585比特 H(XZ/Y)=H(X/Y)+H(Z/XY) =1.8955+2.585 =4.4805比特 I(Y;Z)=H(Z)-H(Z/Y) =H(Z)- H(X 3)= 3.5993-2.585 =1.0143比特 I(X;Z)=H(Z)-H(Z/X)=3.5993- 3.2744 =0.3249比特 I(XY ;Z)=H(Z)-H(Z/XY) =H(Z)-H(Z/Y)=1.0143比特 I(Y;Z/X)=H(Z/X)-H(Z/XY) = H(X 2+X 3)-H(X 3) =3.2744-2.585 =0.6894比特 I(X;Z/Y)=H(Z/Y)-H(Z/XY) =H(Z/Y)-H(Z/Y) =02.10 解:设系统输出10个数字X 等概,接收数字为Y,显然101)(101)()()(919===∑∑==i j p i j p i Q j w i iH(Y)=log10比特奇奇奇奇偶18log 81101452log 211015)(log)()()(log )()(0)(log ),()(log ),()(22,2222=⨯⨯⨯⨯+⨯⨯⨯=--=--=∑∑∑∑∑∑∑≠====x y p x y p x p x x p x x p x p x y p y x p x y p y x p X Y H x y x i y x y x所以I(X;Y)= 3219.2110log 2=-比特2.11 解:(a )接收前一个数字为0的概率 2180)0()()0(==∑=i i i u p u q wbits p pw u p u I )1(log 11log )0()0(log )0;(2212121-+=-==(b )同理 418)00()()00(==∑=ii iu p u q wbits p p w u p u I )1(log 22)1(log )00()00(log )00;(24122121-+=-== (c )同理 818)000()()000(==∑=ii iu p u q wbits p p w u p u I )1(log 33)1(log )000()000(log )000;(28132121-+=-== (d )同理 ))1(6)1(()0000()()0000(4226818p p p p u p u q w ii i+-+-==∑=bitsp p p p p p p p p p w u p u I 42264242268142121)1(6)1()1(8log ))1(6)1(()1(log )0000()0000(log )0000;(+-+--=+-+--==2.12 解:见2.9 2.13 解: (b))/()/()/(1log)()/(1log)()/()/(1log)()/(1log)()/(XY Z H X Y H xy z p xyz p x y p xyz p xy z p x y p xyz p x yz p xyz p X YZ H x y z xyzxyzxyz+=+===∑∑∑∑∑∑∑∑∑∑∑∑(c))/()/(1log)/()()/(1log)/()()/(X Z H x z p xy z p xy p xy z p xy z p xy p XY Z H xyzxyz=≤=∑∑∑∑∑∑(由第二基本不等式) 或)1)/()/((log )/()()/()/(log)/()()/(1log)/()()/(1log)/()()/()/(=-⨯≤=-=-∑∑∑∑∑∑∑∑∑∑∑∑xy z p x z p e xy z p xy p xy z p x z p xy z p xy p x z p xy z p xy p xy z p xy z p xy p X Z H XY Z H xyzxyzxyzxyz(由第一基本不等式)所以)/()/(X Z H XY Z H ≤(a))/()/()/()/()/(X YZ H XY Z H X Y H X Z H X Y H =+≥+等号成立的条件为)/()/(x z p xy z p =,对所有Z z Y y X x ∈∈∈,,,即在给定X 条件下Y 与Z 相互独立。

数学中的信息论与编码技术

数学中的信息论与编码技术在数学领域中,信息论与编码技术是一门研究信息传输和存储的重要学科。

本文将从信息论的基本概念入手,介绍信息熵、信道容量等关键概念,并对编码技术进行探讨,包括纠错码、压缩编码等常见技术。

一、信息论的基本概念信息论是由克劳德·香农于20世纪40年代提出的一门学科,旨在研究如何在信息传输过程中最大化传输效率和最小化信息损失。

信息论的核心是信息熵的概念。

1. 信息熵信息熵是用来描述信息的不确定性的度量,表示一个随机变量的平均信息量。

假设事件发生的概率为p,其信息量可表示为 -log(p)。

而一个随机变量的信息熵则是所有可能事件的信息量的期望值。

例如,一个随机变量只有两个事件发生的可能性,分别为p和1-p,那么该随机变量的信息熵为-H(p) = p*log(p) + (1-p)*log(1-p)。

信息熵越大,表示不确定性越高。

2. 信道容量信道容量是指在给定的信道条件下,最大可达到的信息传输速率。

根据香农的定理,对于任何给定的信噪比,都存在一个能以任意小的误差将信息传输到接收端的编码方案。

二、编码技术编码技术是信息论的重要应用领域,旨在通过对信息的编码和解码来提高信息传输的效率和可靠性。

下面将介绍两种常见的编码技术。

1. 纠错码纠错码是一种编码技术,通过在原始数据中添加冗余信息,使得接收端能够检测和纠正部分错误。

常用的纠错码有海明码、RS码等。

以海明码为例,它通过在数据中添加额外的校验位,使得接收端能够检测到并纠正少量的错误。

海明码的纠错能力取决于添加的校验位数量,通常能够纠正数比特的错误。

2. 压缩编码压缩编码是一种将冗长的数据表示转换为更简洁形式的编码技术,从而实现数据的压缩和存储空间的节省。

常用的压缩编码有霍夫曼编码、算术编码等。

以霍夫曼编码为例,它通过将较频繁出现的字符用较短的编码表示,将不常出现的字符用较长的编码表示,从而减少数据的表示长度。

压缩后的数据可在传输和存储中占用更少的空间。

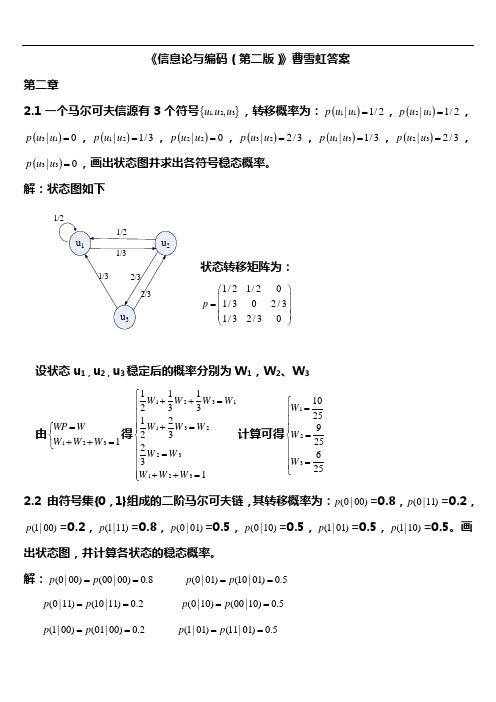

信息论与编码第2章习题解答

信息论与编码第2章习题解答2.1设有12枚同值硬币,其中⼀枚为假币。

只知道假币的重量与真币的重量不同,但不知究竟是重还是轻。

现⽤⽐较天平左右两边轻重的⽅法来测量(因⽆砝码)。

为了在天平上称出哪⼀枚是假币,试问⾄少必须称多少次?解:分三组,每组4个,任意取两组称。

会有两种情况,平衡,或不平衡。

(1) 平衡:明确假币在其余的4个⾥⾯。

从这4个⾥⾯任意取3个,并从其余8个好的⾥⾯也取3个称。

⼜有两种情况:平衡或不平衡。

a )平衡:称⼀下那个剩下的就⾏了。

b )不平衡:我们⾄少知道那组假币是轻还是重。

从这三个有假币的组⾥任意选两个称⼀下,⼜有两种情况:平衡与不平衡,不过我们已经知道假币的轻重情况了,⾃然的,不平衡直接就知道谁是假币;平衡的话,剩下的呢个⾃然是假币,并且我们也知道他是轻还是重。

(2) 不平衡:假定已经确定该组⾥有假币时候:推论1:在知道该组是轻还是重的时候,只称⼀次,能找出假币的话,那么这组的个数不超过3。

我们知道,只要我们知道了该组(3个)有假币,并且知道轻重,只要称⼀次就可以找出来假币了。

从不平衡的两组中,⽐如轻的⼀组⾥分为3和1表⽰为“轻(3)”和“轻(1)”,同样重的⼀组也是分成3和1标⽰为“重(3)”和“重(1)”。

在从另外4个剩下的,也就是好的⼀组⾥取3个表⽰为“准(3)”。

交叉组合为:轻(3) + 重(1)?=======?轻(1) + 准(3)来称⼀下。

⼜会有3种情况:(1)左⾯轻:这说明假币⼀定在第⼀次称的时候的轻的⼀组,因为“重(1)”也出现在现在轻的⼀边,我们已经知道,假币是轻的。

那么假币在轻(3)⾥⾯,根据推论1,再称⼀次就可以了。

(2)右⾯轻:这⾥有两种可能:“重(1)”是假币,它是重的,或者“轻(1)”是假币,它是轻的。

这两种情况,任意取这两个中的⼀个和⼀个真币称⼀下即可。

(3)平衡:假币在“重(3)”⾥⾯,⽽且是重的。

根据推论也只要称⼀次即可。

2.2 同时扔⼀对骰⼦,当得知“两骰⼦⾯朝上点数之和为2”或“⾯朝上点数之和为8”或“骰⼦⾯朝上之和是3和4”时,试问这三种情况分别获得多少信息量?解:设“两骰⼦⾯朝上点数之和为2”为事件A ,则在可能出现的36种可能中,只能个骰⼦都为1,这⼀种结果。

信息论与编码问题详解

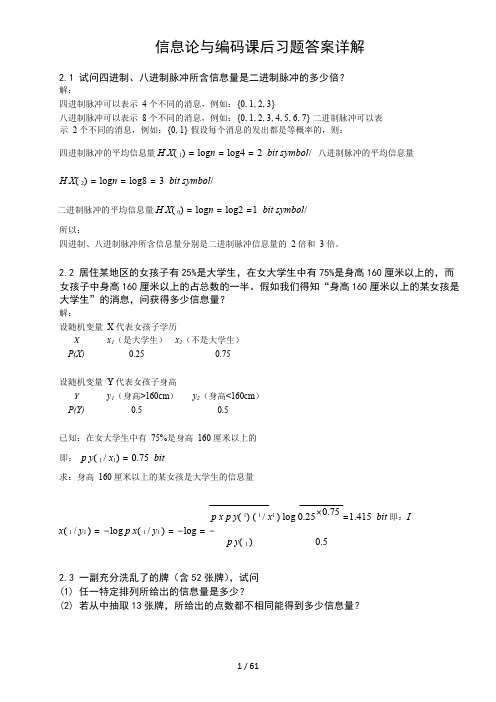

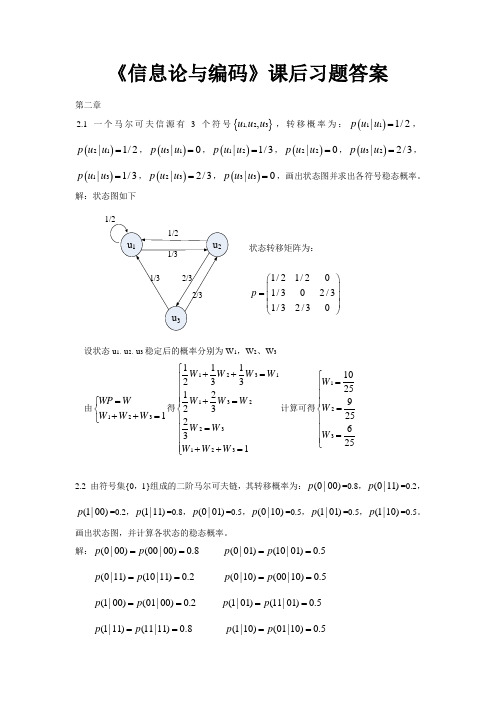

《信息论与编码(第二版)》曹雪虹答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p ==(1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p == 于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

《信息论与编码》课后习题答案

《信息论与编码》课后习题答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭ 状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

《信息论与编码》第三章习题解答

1 p(i, j ) 3 1 , 3

所以从编码树每个内节点长出的三个分支都具有等概率,即第一层节点概率为 第二层节点概率为

1 1 ,…。从而任何一个消息(树叶)出现概率必定为 的整数次幂。 9 3

I (u L ) − H (U ) > δ L

求在(a) , (b)给定的 L=L0 情况下 A 中元素数目的上、下限。 [解] 由概率论中切比雪夫不等式

P{|

其中

σ2 I (U L ) − H (U ) |> δ } ≤ I 2 = ε L Lδ 3 1 3 1 H (U ) = − log − log = 0.81bit 4 4 4 4

H (X ) ,所以 log 3

其 中 (i, k1 ) , (k1 + 1, k 2 ) , (k 2 + 1, j ) 是 由 内 节 点 (i, j ) 分 岔 出 去 的 三 个 节 点 , 所 以

p (i, k1 ) + p(k1 + 1, k 2 ) + p (k 2 + 1, j ) = p(i, j ) 。由于码 D 的平均码长 L =

(b) 求三元 Huffman 码,计算 n 和 η ; [解] (a) 由信源概率分布可知

H (U ) = −

∑p

i =1

10

i

log p i = 3.234bit

相应的 Huffman 编码过程如下图所示; 111 a1 101 a2 100 a3 011 a4 001 a5 000 a6 1101 a7 1100 a8 0101 a9 0100 a10

0.16 (1) 0.14 (1) 0.13 (0) 0.12 (1) 0.1 (1) 0.09 (0) 0.08 (1) 0.07 (0) 0.06 (1) 0.05 (0)

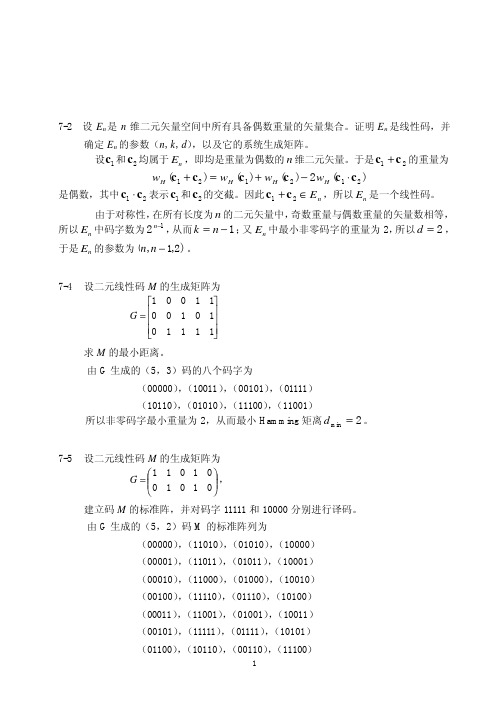

信息论与编码第7-8章习题解答

相应的校验矩阵为

1 0 0 1 ' G 和 G 的差别仅是列的置换,所以 H 和 H ' 的差别也是同样的列置换,所以 1 1 0 1 1 0 1 1 0 1 1 1 1 0 H = 0 1 1 1 0 0 0 I 4×4 0 0 0 1 1 1 1

该码的校验矩阵任意二列线性独立,而第 1,2,3 列之和为零矢量,所以存在 着相关的三列,从而最小 Hamming 重量为 3。

wH (c 1 + c 2 ) = wH (c 1 ) + wH (c 2 ) − 2 wH (c 1 ⋅ c 2 ) 是偶数,其中 c1 ⋅ c 2 表示 c1 和 c 2 的交截。因此 c1 + c 2 ∈ E n ,所以 En 是一个线性码。

由于对称性, 在所有长度为 n 的二元矢量中, 奇数重量与偶数重量的矢量数相等, n −1 所以 En 中码字数为 2 , 从而 k = n − 1 ; 又 En 中最小非零码字的重量为 2, 所以 d = 2 , 于是 En 的参数为 ( n, n − 1,2) 。 7-4 设二元线性码 M 的生成矩阵为 1 0 0 1 1 G = 0 0 1 0 1 0 1 1 1 1 求 M 的最小距离。 [解] 由 G 生成的(5,3)码的八个码字为 (00000) , (10011 ) , (00101) , (01111) (10110) , (01010) , (11100) , (11001) 所以非零码字最小重量为 2,从而最小 Hamming 矩离 d min = 2 。 7-5 设二元线性码 M 的生成矩阵为 1 1 0 1 0 G = 0 1 0 1 0 , 建立码 M 的标准阵,并对码字 11111 和 10000 分别进行译码。 [解] 由 G 生成的(5,2)码 M 的标准阵列为 (00000) , (11010) , (01010) , (10000) (00001) , (11011) , (01011 ) , (10001) (00010) , (11000) , (01000) , (10010) (00100) , (11110) , (01110) , (10100) (00011 ) , (11001) , (01001) , (10011 ) (00101) , (11111) , (01111) , (10101) (01100) , (10110) , (00110) , (11100)

信息论基础与编码课后题答案(第三章)

3-1 设有一离散无记忆信源,其概率空间为12()0.60.4X x x P x ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦,信源发出符号通过一干扰信道,接收符号为12{,}Y y y =,信道传递矩阵为51661344P ⎡⎤⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦,求: (1) 信源X 中事件1x 和2x 分别含有的自信息量;(2) 收到消息j y (j =1,2)后,获得的关于i x (i =1,2)的信息量; (3) 信源X 和信宿Y 的信息熵;(4) 信道疑义度(/)H X Y 和噪声熵(/)H Y X ; (5) 接收到消息Y 后获得的平均互信息量(;)I X Y 。

解:(1)12()0.737,() 1.322I x bit I x bit ==(2)11(;)0.474I x y bit =,12(;) 1.263I x y bit =-,21(;) 1.263I x y bit =-,22(;)0.907I x y bit =(3)()(0.6,0.4)0.971/H X H bit symbol ==()(0.6,0.4)0.971/H Y H bit symbol ==(4)()(0.5,0.1,0.1,0.3) 1.685/H XY H bit symbol ==(/) 1.6850.9710.714/H X Y bit symbol =-= (/)0.714/H Y X bit symbol =(5)(;)0.9710.7140.257/I X Y bit symbol =-=3-2 设有扰离散信道的输入端是以等概率出现的A 、B 、C 、D 四个字母。

该信道的正确传输概率为0.5,错误传输概率平均分布在其他三个字母上。

验证在该信道上每个字母传输的平均信息量为0.21比特。

证明:信道传输矩阵为:11112666111162661111662611116662P ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦,信源信宿概率分布为:1111()(){,,,}4444P X P Y ==, H(Y/X)=1.79(bit/符号),I(X;Y)=H(Y)- H(Y/X)=2-1.79=0.21(bit/符号)3-3 已知信源X 包含两种消息:12,x x ,且12()() 1/2P x P x ==,信道是有扰的,信宿收到的消息集合Y 包含12,y y 。

信息论与编码学习辅导及习题详解

信息论与编码学习辅导及习题详解Information Theory and Coding Learning Coaching and Exercise ExplanationInformation Theory and Coding are two closely related scientific disciplines for signal processing, data communication, and computer networks. These two studies are often used together in applications, making the learning of the concepts of Information Theory and Coding important. This essay will guide through the basic knowledge of these two fields, provide coaching on learning Information Theory and Coding, and go through exercise explanations.I. Information TheoryA. DefinitionInformation Theory is a branch of applied mathematics and electrical engineering dealing with the quantification, storage, and communication of information. It was developed in 1948 by Claude Shannon. The fundamental problem of communication is to convey a message from a sender to a receiver without any errors. Information Theory is the study of how information is transmitted over a communication medium, and how the communication medium affects the transmission process.B. Basic ConceptsSome basic concepts of Information Theory are entropy, noise, channel capacity, coding, and error control. Entropy is a measure of uncertainty, and is used to help determine the amount of information contained in a signal.Noise is any disturbances that have an impact on the transmission of information. Channel capacity is the maximum amount of data that can be transmitted through a communication channel. Coding is the process of translating the message from the source into a form that can be understood by the destination. Error control is the process of detecting, identifying, and correcting any errors that occur during transmission.II. CodingA. DefinitionCoding is a branch of mathematics and computer science dealing with the efficient representation of data. It was developed in the late 1950s and early 1960s. Coding is used in a variety of applications, including data storage, image processing, digital signal processing, and communications. Coding techniques can greatly reduce the amount of data that needs to be stored and transmitted.B. Basic ConceptsThe main concepts of Coding are coding, signaling, modulation, coding rate, coding efficiency, and entropy. Coding is the process of transforming the message from the source into a form that can be understood by the destination. Signaling is the process of conveying information through a medium over a communication link. Modulation is the process of varying some aspect of a signal in order to transmit information. The coding rate is the number of bits required to encode one message. The coding efficiency is the ratio between the actual number of bits used to encode the message, and the total number of bits used. Entropy is a measure of the amount of information contained in a signal.III. Learning CoachingA. FundamentalsThe best way to learn the fundamentals of Information Theory and Coding is to start by familiarizing oneself with the core concepts such as entropy, noise, channel capacity, coding, and error control. Taking a college course in Information Theory and Coding is also beneficial. Alternatively, reading textbooks and studying reference material is a viable option.B. PracticePracticing the concepts of Information Theory and Coding is essential to mastering them. It is important to try to understand the material rather than memorize it. Doing practice problems is the best way to learn and build an understanding of the material.IV. Exercise ExplanationA. Information TheoryFor the Information Theory part of this exercise, the main goal is to determine the maximum rate at which data can be transmitted through a given communication channel. To do this, one needs to first calculate the entropy of the signal to determine the amount of information contained in it. Then, the channel capacity needs to be calculated by taking the s ignal’s entropy, the noise of the channel, and the coding rate into consideration.B. CodingFor the Coding part of this exercise, the main goal is to encode a message into a format that can be understood by the destination. To do this, one needsto first select an appropriate coding technique. Then, the information needs to be encoded using this technique. Finally, the encoded message needs to be transmitted through a communication link.In conclusion, Information Theory and Coding are two important scientific fields for signal processing, data communication, and computer networks. This essay has guided through the basics of these two fields, provided coaching on learning Information Theory and Coding, and gone through exercise explanations. Therefore, it is essential for one to understand the fundamentals of Information Theory and Coding and practice the concepts in order to gain mastery in these fields.。

信息论与编码原理

信息论与编码原理信息论与编码原理是现代通信领域中的重要理论基础,它涉及到信息的传输、存储和处理等方面,对于信息技术的发展和应用具有重要的指导意义。

信息论是由美国数学家克劳德·香农于1948年提出的,它主要研究信息的量化、传输和保密等问题。

而编码原理则是指对信息进行编码和解码的方法和原理,它是信息论的重要应用领域之一。

信息论的基本概念包括信息的度量、信息的传输和存储、信道容量等。

首先,信息的度量是指用来衡量信息量的大小,通常使用的是香农提出的信息熵来度量信息的不确定性。

信息熵越大,表示信息的不确定性越高,反之则表示信息的不确定性越低。

其次,信息的传输和存储是指如何在通信系统中传输和存储信息,这涉及到信道编码、调制解调、多路复用等技术。

最后,信道容量是指在给定的信道条件下,最大的传输速率,它是通信系统设计的重要参考指标。

在信息论的基础上,编码原理主要研究如何将信息进行编码和解码,以便在传输和存储过程中提高信息的可靠性和效率。

编码原理主要包括信源编码、信道编码和误差控制编码等内容。

首先,信源编码是指对来自信源的信息进行编码,以便在传输和存储过程中减少信息的冗余度,提高信息的压缩率。

其次,信道编码是指在信道传输过程中对信息进行编码,以提高信息的可靠性和抗干扰能力。

最后,误差控制编码是指在传输过程中对信息进行编码,以便在接收端对传输过程中产生的误差进行检测和纠正。

信息论与编码原理在现代通信系统中有着广泛的应用,它为通信系统的设计和优化提供了重要的理论基础。

在数字通信系统中,信息论和编码原理被广泛应用于调制解调、信道编码、多路复用、分组交换等方面,以提高通信系统的性能和可靠性。

在无线通信系统中,信息论和编码原理被应用于多天线技术、自适应调制调试、功率控制等方面,以提高无线通信系统的容量和覆盖范围。

在互联网和移动通信领域,信息论和编码原理也被广泛应用于数据压缩、数据加密、错误检测和纠正等方面,以提高数据传输的效率和安全性。

信息论与编码试卷及答案解析

一、(11’)填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是0 。

(3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的N倍。

(4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。

(5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为 3 。

(6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码。

(7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。

(9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关三、(5 )居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1.6米以上的占总数的一半。

假如我们得知“身高1.6米以上的某女孩是大学生”的消息,问获得多少信息量?解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则P(A)=0.25 p(B)=0.5 p(B|A)=0.75 (2分)故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0.75*0.25/0.5=0.375 (2分) I(A|B)=-log0.375=1.42bit (1分)四、(5')证明:平均互信息量同信息熵之间满足I(X;Y)=H(X)+H(Y)-H(XY) 证明:()()()()()()()()()()Y X H X H y x p y x p x p y x p x p y x p y x p Y X I X X Y j i j i Y i j i XYi j i j i -=⎥⎦⎤⎢⎣⎡---==∑∑∑∑∑∑log log log; (2分)同理()()()X Y H Y H Y X I -=; (1分) 则()()()Y X I Y H X Y H ;-= 因为()()()X Y H X H XY H += (1分) 故()()()()Y X I Y H X H XY H ;-+=即()()()()XY H Y H X H Y X I -+=; (1分)五、(18’).黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0.3,白色出现的概率为0.7。

信息论与编码习题参考答案(全)

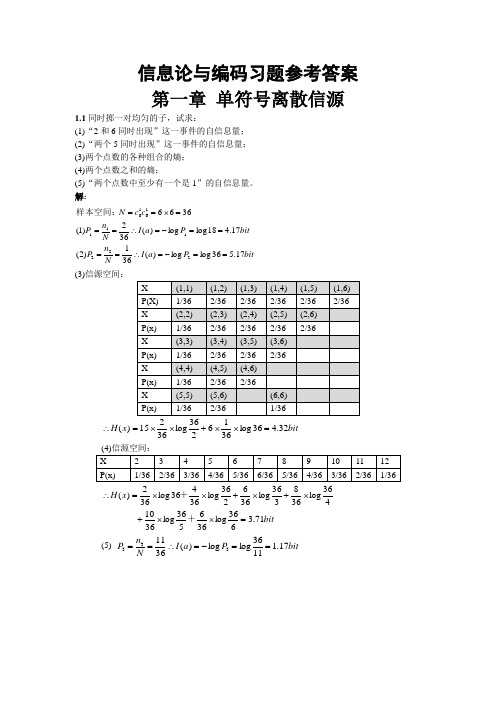

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率Θbitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知ΘbitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

信息论与编码第二版答案 (3)

信息论与编码第二版答案第一章:信息论基础1.问题:信息论的基本概念是什么?答案:信息论是一种数学理论,研究的是信息的表示、传输和处理。

它的基本概念包括:信息、信息的熵和信息的编码。

2.问题:什么是信息熵?答案:信息熵是信息的度量单位,表示信息的不确定度。

它的计算公式为H(X) = -ΣP(x) * log2(P(x)),其中P(x)表示事件x发生的概率。

3.问题:信息熵有什么特性?答案:信息熵具有以下特性:•信息熵的值越大,表示信息的不确定度越高;•信息熵的值越小,表示信息的不确定度越低;•信息熵的最小值为0,表示信息是确定的。

4.问题:信息熵与概率分布有什么关系?答案:信息熵与概率分布之间存在着直接的关系。

当概率分布均匀时,信息熵达到最大值;而当概率分布不均匀时,信息熵会减小。

第二章:数据压缩1.问题:数据压缩的目的是什么?答案:数据压缩的目的是通过消除冗余和重复信息,使数据占用更少的存储空间或传输更快。

2.问题:数据压缩的两种基本方法是什么?答案:数据压缩可以通过无损压缩和有损压缩两种方法来实现。

无损压缩是指压缩后的数据可以完全还原为原始数据;而有损压缩则是指压缩后的数据不完全还原为原始数据。

3.问题:信息压缩的度量单位是什么?答案:信息压缩的度量单位是比特(bit),表示信息的数量。

4.问题:哪些方法可以用于数据压缩?答案:数据压缩可以通过以下方法来实现:•无结构压缩方法:如霍夫曼编码、算术编码等;•有结构压缩方法:如词典编码、RLE编码等;•字典方法:如LZW、LZ77等。

第三章:信道容量1.问题:什么是信道容量?答案:信道容量是指在给定信噪比的条件下,信道传输的最大数据速率。

2.问题:信道容量的计算公式是什么?答案:信道容量的计算公式为C = W * log2(1 + S/N),其中C表示信道容量,W表示信道带宽,S表示信号的平均功率,N表示噪声的平均功率。

3.问题:信道容量与信噪比有什么关系?答案:信道容量与信噪比成正比,信噪比越高,信道容量越大;反之,信噪比越低,信道容量越小。

西电邓家先版信息论与编码第3章课后习题解答

3.1 设信源⎥⎦⎤⎢⎣⎡)(x P X =⎥⎦⎤⎢⎣⎡4.06.021x x 通过一干扰信道,接收符号Y=[]21y y ,信道传递概率如图3.33所示。

求:(1) 信源X 中事件x1,和x2分别含有的自信息。

(2) 收到消息yj(j=1,2)后,获得的关于xi(i=1,2)的信息量。

(3) 信源X 和信源Y 的信息熵。

(4) 信道疑义度H (X|Y )和噪声熵H (Y|X )。

(5) 接收到消息Y 后获得的平均互信息。

解:(1)由定义得:I (X1)= -log0.6=0.74bitI (X2)= -log0.4=1.32bit(2)P (y1)= 0.6×5/6+0.4×3/4=0.8 P (y2)= 0.6×1/6+0.4×1/4=0.2I (xi ;xj )= I (xi )-I (xi|yj )=log[P (xi|yj )/p (xi )]= log[P (yj|xi )/p (yj )]则 I (x1;y1)= log[P (y1|x1)/p (y1)]=log5/6/0.8=0.059bit I (x1;y2)= log[P (y2|x2)/p (y2)]=log1/6/0.2=-0.263bit I (x2;y1)= log[P (y1|x2)/p (y1)]=log3/4/0.8=-0.093bit I (x2;y2)= log[P (y2|x2)/p (y2)]=log1/4/0.2=0.322bit(3)由定义显然 H (X )=0.97095bit/符号H (Y )=0.72193bit/符号(4)H (Y|X )=∑P (xy )log[1/P (y|x )]=2211i j ==∑∑p (xi )P (yj|xi )log[1/P (yj|xi )]=0.6·5/6·log6/5+0.6·1/6·log6+0.4·3/4·log4/3+0.4·1/4·log4 =0.7145bit/符号H (X|Y )= H (X )+H (Y|X )-H (Y )=0.9635bit/符号(5) I (X ;Y )= H (X )-H (X|Y )=0.00745 bit/符号图3.1 二元信道1/63/41/45/6x 1y 1y 2x 23.2设8个等概率分布的消息通过传递概率为p 的BSC 进行传送。

信息论和编码陈运主编答案解析(完整版)

⇒ H X( 2 )

≥ H X( 2 / X1 ) I X( 3;X X1 2 ) ≥ 0

⇒ H X( 3 ) ≥ H X( 3 / X X1 2 )

... I X( N;X X1 2...Xn−1) ≥ 0

⇒ H X( N ) ≥ H X( N / X X1 2...Xn−1)

WORD 完美格式

专业整理

不满足极值性的原因是

。

i

2.7 证明:H(X3/X1X2) ≤ H(X3/X1),并说明当 X1, X2, X3 是马氏链时等式成立。证明:

H X(3 / X X12 ) − H X(3 / X1)

∑∑∑ ∑∑ = −

p x x x( i1 i2i3 )log p x( i3 / x xi1 i2 ) +

⎢p e( 1 ) = p e( 2 ) = p e( 3 ) ⎢

⎢p e( 1 ) + p e( 2 ) + p e( 3 ) =1

⎢p e( 1 ) =1/3 ⎢ ⎢p e( 2 )

⎢

=1/3 ⎢p e( 3 ) =1/3

⎢p x( 1 ) = p e( 1 ) (p x1 /e1 ) + p e( 2 ) (p x1 /e2 ) = p p e⋅( 1 ) + p p e⋅ ( 2 ) = (p + p)/3 =1/3 ⎢⎢ ⎢p x( 2 ) = p e( 2 ) (p x2 /e2 ) + p e( 3 ) (p x2 /e3 ) =p p e⋅( 2 ) + p p e⋅ ( 3 ) = (p + p)/3 =1/3

解: (1)

这个信源是平稳无记忆信源。因为有这些词语:“它在任意时间....而且不论以前发生过什么符 号...........……”

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

《信息论与编码(第二版)》雪虹答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ 2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求: (1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

解:(1)bit x p x I x p i i i 170.4181log)(log )(18161616161)(=-=-==⨯+⨯= (2)bit x p x I x p i i i 170.5361log)(log )(3616161)(=-=-==⨯=(3)两个点数的排列如下: 11 12 13 14 15 1621 22 23 24 25 26 31 32 33 34 35 36 41 42 43 44 45 46 51 52 53 54 55 56 61 62 63 64 65 66共有21种组合:其中11,22,33,44,55,66的概率是3616161=⨯ 其他15个组合的概率是18161612=⨯⨯symbol bit x p x p X H ii i / 337.4181log 18115361log 3616)(log )()(=⎪⎭⎫ ⎝⎛⨯+⨯-=-=∑(4)参考上面的两个点数的排列,可以得出两个点数求和的概率分布如下:symbol bit x p x p X H X P X ii i / 274.3 61log 61365log 365291log 912121log 1212181log 1812361log 3612 )(log )()(36112181111211091936586173656915121418133612)(=⎪⎭⎫ ⎝⎛+⨯+⨯+⨯+⨯+⨯-=-=⎪⎭⎪⎬⎫⎪⎩⎪⎨⎧=⎥⎦⎤⎢⎣⎡∑(5)bit x p x I x p i i i 710.13611log)(log )(3611116161)(=-=-==⨯⨯=2-42.5 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。

假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量? 解:设随机变量X 代表女孩子学历 X x 1(是大学生) x 2(不是大学生)P(X) 0.250.75设随机变量Y 代表女孩子身高Y y 1(身高>160cm ) y 2(身高<160cm ) P(Y) 0.5 0.5已知:在女大学生中有75%是身高160厘米以上的 即:bit x y p 75.0)/(11=求:身高160厘米以上的某女孩是大学生的信息量 即:bit y p x y p x p y x p y x I 415.15.075.025.0log )()/()(log)/(log )/(11111111=⨯-=-=-=2.6 掷两颗骰子,当其向上的面的小圆点之和是3时,该消息包含的信息量是多少?当小圆点之和是7时,该消息所包含的信息量又是多少? 解:1)因圆点之和为3的概率1()(1,2)(2,1)18p x p p =+= 该消息自信息量()log ()log18 4.170I x p x bit =-== 2)因圆点之和为7的概率1()(1,6)(6,1)(2,5)(5,2)(3,4)(4,3)6p x p p p p p p =+++++=该消息自信息量()log ()log6 2.585I x p x bit =-== 2.7 设有一离散无记忆信源,其概率空间为123401233/81/41/41/8X x x x x P ====⎛⎫⎛⎫= ⎪⎪⎝⎭⎝⎭(1)求每个符号的自信息量(2)信源发出一消息符号序列为{202 120 130 213 001 203 210 110 321 010 021 032 011 223 210},求该序列的自信息量和平均每个符号携带的信息量 解:122118()log log 1.415()3I x bit p x === 同理可以求得233()2,()2,()3I x bit I x bit I x bit ===因为信源无记忆,所以此消息序列的信息量就等于该序列中各个符号的信息量之和 就有:123414()13()12()6()87.81I I x I x I x I x bit =+++= 平均每个符号携带的信息量为87.811.9545=bit/符号 2.8 试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解:四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7}二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n X H / 38log log )(2===二进制脉冲的平均信息量symbol bit n X H / 12log log )(0===所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

2-9 “-” 用三个脉冲 “●”用一个脉冲(1) I(●)= I(-)= (2) H= 2-10 (2) P(黑/黑)= P(白/黑)= H(Y/黑)=(3) P(黑/白)= P(白/白)=H(Y/白)= (4) P(黑)= P(白)= H(Y)=2.11 有一个可以旋转的圆盘,盘面上被均匀的分成38份,用1,…,38的数字标示,其中有两份涂绿色,18份涂红色,18份涂黑色,圆盘停转后,盘面上的指针指向某一数字和颜色。

(1)如果仅对颜色感兴趣,则计算平均不确定度 (2)如果仅对颜色和数字感兴趣,则计算平均不确定度 (3)如果颜色已知时,则计算条件熵解:令X 表示指针指向某一数字,则X={1,2,……….,38} Y 表示指针指向某一种颜色,则Y={l 绿色,红色,黑色} Y 是X 的函数,由题意可知()()i j i p x y p x = (1)3112381838()()loglog 2log 1.24()3823818j j j H Y p y p y ===+⨯=∑bit/符号 (2)2(,)()log 38 5.25H X Y H X ===bit/符号(3)(|)(,)()()() 5.25 1.24 4.01H X Y H X Y H Y H X H Y =-=-=-=bit/符号2.12 两个实验X 和Y ,X={x 1 x 2 x 3},Y={y 1 y 2 y 3},l 联合概率(),i j ij r x y r =为1112132122233132337/241/2401/241/41/2401/247/24r r r r r r rr r ⎛⎫⎛⎫⎪ ⎪= ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭(1) 如果有人告诉你X 和Y 的实验结果,你得到的平均信息量是多少? (2) 如果有人告诉你Y 的实验结果,你得到的平均信息量是多少?(3) 在已知Y 实验结果的情况下,告诉你X 的实验结果,你得到的平均信息量是多少? 解:联合概率(,)i j p x y 为22221(,)(,)log (,)724112log 4log 24log 4247244i j i j ijH X Y p x y p x y ==⨯+⨯+∑ =2.3bit/符号X 概率分布 21()3log 3 1.583H Y =⨯=bit/符号(|)(,)() 2.3 1.58H X Y H X Y H Y =-=- Y 概率分布是=0.72bit/符号2.13 有两个二元随机变量X 和Y ,它们的联合概率为并定义另一随机变量Z = XY (一般乘积),试计算: (1) H(X), H(Y), H(Z), H(XZ), H(YZ)和H(XYZ);(2) H(X/Y), H(Y/X), H(X/Z), H(Z/X), H(Y/Z), H(Z/Y), H(X/YZ), H(Y/XZ)和H(Z/XY); (3) I(X;Y), I(X;Z), I(Y;Z), I(X;Y/Z), I(Y;Z/X)和I(X;Z/Y)。