帧间差分法运动检测代码

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理帧间差分法是一种常用的视频运动目标检测技术,它通过比较视频序列中相邻帧之间的差异来检测目标的运动。

该方法常用于视频监控、智能交通系统、视频分析等领域。

本文将介绍帧间差分法的运动目标检测过程及原理,以及其在实际应用中的优势和局限性。

一、帧间差分法的原理帧间差分法的原理基于一个简单的假设:如果某个像素点在相邻两帧之间的亮度发生了变化,那么这个像素点所对应的物体就有可能发生了运动。

根据这个假设,可以通过计算相邻两帧之间的像素点亮度差异来确定目标的运动。

在实际应用中,帧间差分法通常使用以下公式来计算相邻两帧的像素点差异:D(x,y,t) = |I(x,y,t) - I(x,y,t-1)|D(x,y,t)表示在时间t时刻的像素点(x,y)的差分值,I(x,y,t)表示在时间t时刻的像素点(x,y)的亮度值,t-1表示时间t之前的时刻。

通过计算相邻两帧之间的像素点差异,可以得到一副差分图像,该图像中像素点的数值表示了该点在帧间差分中的差异程度。

接着,可以对差分图像进行阈值处理,将高于阈值的像素点标记为目标像素点,从而实现目标的运动检测。

帧间差分法的运动目标检测过程包括以下几个步骤:1. 视频帧获取和预处理首先需要从视频流中获取连续的视频帧,并对每一帧进行预处理,包括灰度化、降噪、边缘检测等操作,以便后续运动目标检测的准确性和鲁棒性。

2. 帧间差分计算对相邻两帧的视频进行帧间差分计算,得到差分图像。

可以使用绝对差值、差分平均值等方式来计算差分图像。

3. 阈值处理对差分图像进行阈值处理,将高于阈值的像素点标记为目标像素点。

阈值的选择是帧间差分法中需要仔细考虑的一个关键问题,合适的阈值能够更好地区分目标和背景,提高检测准确度。

4. 目标区域提取通过连通域分析、形态学处理等方法,将标记为目标像素点的区域进行进一步的提取和分割,得到目标的位置信息。

5. 目标跟踪和输出对提取得到的目标区域进行目标跟踪和输出,可以采用卡尔曼滤波、光流算法等方法来对目标进行跟踪,最终实现目标的运动检测和输出。

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理帧间差分法是一种常用的运动目标检测方法,依靠帧与帧之间的差异来实现对运动目标的检测。

其原理是通过计算相邻帧之间的差异,将运动目标从静态背景中分离出来,从而实现目标检测。

1. 获取视频流或者图像序列,并将其转换为灰度图像。

该过程可以使用OpenCV等图像处理库实现。

2. 按照时间顺序,每隔一定的时间间隔(例如,每秒钟、每隔几帧)取一帧图像,形成连续的图像序列(也可以直接读取视频流)。

如果采用的是视频流,还需将视频流的时间基准与实际时间对齐。

3. 对于每一帧图像,先将其与上一帧图像做差,得到当前帧的差分图像。

若没有前一帧图像,则将当前帧图像作为背景参考。

4. 对于差分图像,可以应用阈值分割算法(例如Otsu算法、自适应阈值法等)来将其二值化。

此时,目标物体所在的像素值区域将为前景,而背景则为另一种像素值。

5. 对于二值化后的图像,可以应用形态学处理(例如开操作、闭操作等)来去除噪声点和孔洞,从而更准确地提取目标轮廓。

6. 最后,可以利用cv2.findContours()函数查找目标的轮廓。

这些轮廓可以代表单个运动目标或者多个运动目标。

且可以通过测量轮廓的面积、宽度、高度、位置等属性,进一步对目标进行分类与识别。

总结起来,帧间差分法是一种基于视频或图像序列的运动目标检测方法,它的优点是实现简单、速度较快,且对于CMOS或CCD摄像头等图像采集设备不稳定、背景不纯,亮度不均等问题具有较好的适应性。

不足之处在于对于复杂的场景或目标缩放、旋转、部分遮挡等情况,其检测效果容易受到影响。

因此,在实际应用中,我们需根据具体情况选择不同的算法方法来实现更准确、可靠的目标检测。

帧校验序列码FCS

帧校验序列码FCS在上位机与PLC通信中,为了更好的校验发送与接收的数据的准确性,⼀般都会加⼀位校验位,校验码的算法有多种,帧校验序列码FCS 就是其中的⼀种。

帧校验序列码FCS ( Frame Check Sequences)是为提⾼通信的可靠性设置的。

将每⼀帧中的第⼀个字符@到该帧中正⽂的最后⼀个ASCII 字符作“异或”运算, 并将异或的结果转换为两个ASCII码, 便得到了FCS , 它作为帧的⼀部分发送到接收端。

接收端计算出收到的帧的FCS , 如果与发送端传送过来的FCS 不同, 可以判定通信有误。

由于近段⼀直在做上位机与PLC有关的通信,了解了⼀些版本语⾔的FCS算法,在此提供⼀些代码供⼤家交流学习。

⾸先是VB写的FCS校验:Function fcs(ByVal inputstr As String) As StringDim slen, i, xorresult As IntegerDim tempfes As Stringslen = Len(inputstr) '求输⼊字符串长度xorresult = 0For i = 1 To slenxorresult = xorresult Xor Asc(Mid$(inputstr, i, 1)) '按位异或Next itempfes = Hex$(xorresult) '转化为16进制If Len(tempfes) = 1 Then tempfes = "0" + tempfesfcs = tempfesEnd Function由于我们的项⽬是c#写的,把VB版本的修改成c#了,代码如下:static string fcs(string data){int xorresult = 0;string tempfes = "";for (int i = 0; i < data.Length; i++){xorresult = xorresult ^ Convert.ToInt32(data[i]);}tempfes = Convert.ToString(xorresult, 16);if (tempfes.Length == 1){tempfes = "0" + tempfes;}return tempfes;}。

OpenCv图像处理篇之帧间差分法

OpenCv图像处理篇之帧间差分法帧差法是背景减图法中的⼀种,只不过是帧差法不需要建模,因为它的背景模型就是上⼀帧的图,所以速度⾮常快,另外帧差法对缓慢变换的光照不是很敏感,所以其⽤途还是有的,有不少学者对其做出了出⾊的改进。

其基本原理可以⽤下⾯公式看出: |i(t)-i(t-1)|<T 背景 |i(t)-i(t-1)|>=T 前景 其中i(t),i(t-1)分别为t,t-1时刻对应像素点的像素值,T为阈值。

当然其缺点也不少,容易出现”双影”和”空洞”现象。

⽤opencv2.3.1+vs2010做了个简单的实验,其实验代码如下:// frame_diff.cpp : 定义控制台应⽤程序的⼊⼝点。

//#include "stdafx.h"#include <opencv2/highgui/highgui.hpp>#include <opencv2/imgproc/imgproc.hpp>#include <opencv2/core/core.hpp>#define threshold_diff 20 //设置简单帧差法阈值using namespace cv;using namespace std;int main(int argc,unsigned char* argv[]){Mat img_src1,img_src2,img_dst,gray1,gray2,gray_diff;bool pause=false;VideoCapture vido_file("IndoorGTTest1.avi");//在这⾥改相应的⽂件名namedWindow("foreground",0);for (;;){if(!pause){vido_file >>img_src1; //因为视频⽂件帧数已经固定了,所以每次到这句语句都是读取相邻的帧数,没到时间视频并不向前⾛cvtColor(img_src1,gray1,CV_BGR2GRAY);imshow("video_src",img_src1);//可以事先不⽤新建⼀个窗⼝waitKey(5);vido_file >>img_src2;cvtColor(img_src2,gray2,CV_BGR2GRAY);imshow("video_src",img_src2);//可以事先不⽤新建⼀个窗⼝waitKey(5);subtract(gray1,gray2,gray_diff);for(int i=0;i<gray_diff.rows;i++)for(int j=0;j<gray_diff.cols;j++)if(abs(gray_diff.at<unsigned char>(i,j))>=threshold_diff)//这⾥模板参数⼀定要⽤unsigned char,否则就⼀直报错gray_diff.at<unsigned char>(i,j)=255;else gray_diff.at<unsigned char>(i,j)=0;imshow("foreground",gray_diff);}char c=(char)waitKey(10);if (c==27){break;}if(c==' ')pause=!pause;}return 0;}实验结果如下: 可以看出其“双影”和”空洞”⽐较明显。

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理

帧间差分法是一种常用的视频图像处理技术,用于运动目标检测和跟踪。

其原理是对连续帧之间的像素值差异进行计算和分析,从而确定哪些像素发生了变化,即表示目标运动。

帧间差分法主要包括以下几个步骤:

1. 预处理:将连续帧进行灰度处理,将彩色图像转化为灰度图像,减少计算量。

2. 帧差计算:计算相邻两帧之间的差异,并对差值进行二值化处理。

这里可以使用简单的相减法,即将后一帧减去前一帧对应像素的灰度值。

3. 二值化处理:将帧差图像进行二值化处理,将差异值大于阈值的像素设置为前景(表示目标运动),小于阈值的像素设置为背景。

4. 运动目标提取:对二值化后的图像进行图像处理方法的应用,如连通区域分析、形态学运算等,提取出连续的前景区域,即运动目标。

5. 运动目标跟踪:对提取到的运动目标进行跟踪,可以使用相关滤波器、卡尔曼滤波器等跟踪算法。

帧间差分法的原理是基于目标运动引起的图像像素值变化。

当物体在连续帧之间发生移动时,其在图像上的位置会发生变化,导致像素值的差异。

利用这一差异性,可以通过计算帧差图像来检测目标运动。

帧间差分法的优点是计算简单,实时性较好,适合用于实时视频监控等应用场景。

但同时也存在一些缺点,比如对光照变化和背景干扰比较敏感,对目标与背景颜色相似的情况可能存在误判。

为了提高运动目标检测的准确性和稳定性,可以结合其他方法进行优化,比如背景建模、光流法等。

还可以采用自适应阈值、多帧差分等方法来改进帧间差分法的性能。

FPGA实现移动目标检测

FPGA实现移动⽬标检测 上⼀篇整理了⼈脸检测,这篇讲⼀下移动⽬标检测。

⽬前逐渐形成三种运动⽬标的检测算法: 1)帧间差分法是采⽤视频序列中的相邻两帧图像做差的⽅法,来检测视频序列中的移动⽬标。

但是受运动⽬标和背景变化的影响,检测过程中有可能出现伪⽬标或者⽬标中出现“空洞”,在⽬标运动不是太快时可以有效的检测到⽬标。

2)背景减除法⾸先在没有⽬标的场景中获取背景图像,然后利⽤实时视频序列和背景图像做差,来实现地移动⽬标的检测。

如何获得背景是背景减除法的关键。

3)光流法是通过给图像中每个像素点赋予⼀个速度⽮量的⽅法建⽴光流场,利⽤光流场中⽮量运动的连续性来检测移动⽬标。

该⽅法的计算量通常很⼤,难以实现实时性的检测。

其中帧差法⽐较简单,可操作性较强。

⼀、帧差法原理 帧差法是通过两帧相邻图像间做差,并选取合适的阈值对图像进⾏⼆值化,从⽽选取出运动的物体。

设 f(x,y)为灰度差分图像,g k(x,y)、g k-1(x,y) 为相邻的两帧灰度图像,D(x,y)为侦差图像,T为差分阈值。

1、缓存两帧灰度图像。

2、两帧灰度图像做差,将结果和设置的阈值进⾏⽐较后转⼆值化输出。

3、对⼆值化结果进⾏框选,确定移动⽬标,类似⼈脸检测。

本设计的难点是如何能缓存两帧图像,以 SDRAM 为例,常⽤的⽅法有两种:掩码法和⾮掩码法,下⾯分别介绍⼀下。

⼆、移动⽬标检测——掩码法1、结构框图 如图所⽰:摄像头采集数据后,再SDRAM通道0中缓存后输出到 VGA_driver,正常的摄像头显⽰⼯程到这就结束了。

⽽为了后续处理,我将 VGA_driver 的输出数据先不输出到VGA引脚,⽽是对其进⾏图像处理:先进⾏ RGB转YCbCr处理,得到 8bit 的灰度数据 Y 分量,然后将 Y 分量输⼊到 SDRAM的通道 1 中,利⽤ SDRAM 的掩码,通道 1 的读出数据包含了 2 帧的灰度数据,将这两帧数据进⾏帧差计算,然后进⾏⼀些图像处理。

帧间差分法 车辆测速 代码

帧间差分法车辆测速代码摘要:一、帧间差分法的简介二、车辆测速的方法及原理三、利用帧间差分法进行车辆测速的代码实现正文:帧间差分法是一种常用的运动目标检测与跟踪技术,通过比较连续两帧或多帧图像之间的差异,检测出运动目标并计算其运动速度。

近年来,帧间差分法已被广泛应用于智能交通、视频监控等领域,特别是在车辆测速方面取得了显著的成果。

车辆测速的方法及原理:车辆测速的基本原理是通过检测车辆在连续帧之间的运动变化,计算其速度。

一般采用的方法有:基于背景减除的测速方法、基于光流法的测速方法和基于帧间差分法的测速方法等。

其中,帧间差分法具有计算简单、实时性好、抗干扰能力强等优点,成为车辆测速领域的研究热点。

利用帧间差分法进行车辆测速的代码实现:为了实现利用帧间差分法进行车辆测速的代码,我们首先需要对视频进行预处理,包括降噪、滤波等操作,提高图像质量。

接着,采用帧间差分法计算车辆的运动变化,并提取出运动车辆的轨迹。

最后,根据轨迹信息计算车辆的速度。

以下是一个简单的Python 代码示例,用于实现帧间差分法进行车辆测速:```pythonimport cv2import numpy as npdef frame_difference(frame1, frame2):diff = cv2.absdiff(frame1, frame2)return diffdef preprocess_image(image):# 降噪、滤波等图像预处理操作return imagedef detect_moving_vehicles(video):# 读取视频cap = cv2.VideoCapture(video)# 循环遍历视频帧while cap.isOpened():ret, frame = cap.read()if not ret:break# 对每一帧进行预处理preprocessed_frame = preprocess_image(frame)# 计算帧间差分diff = frame_difference(preprocessed_frame, frame)# 检测运动车辆vehicles = cv2.inRange(diff, np.array([100, 100, 100]), np.array([255, 255, 255]))# 显示结果cv2.imshow("Vehicles", vehicles)# 按“q”键退出if cv2.waitKey(1) & 0xFF == ord("q"):break# 释放资源cap.release()cv2.destroyAllWindows()if __name__ == "__main__":video = "path/to/your/video.mp4" # 修改为你的视频文件路径detect_moving_vehicles(video)```需要注意的是,此代码仅为示例,实际应用时还需根据具体需求进行优化和调整。

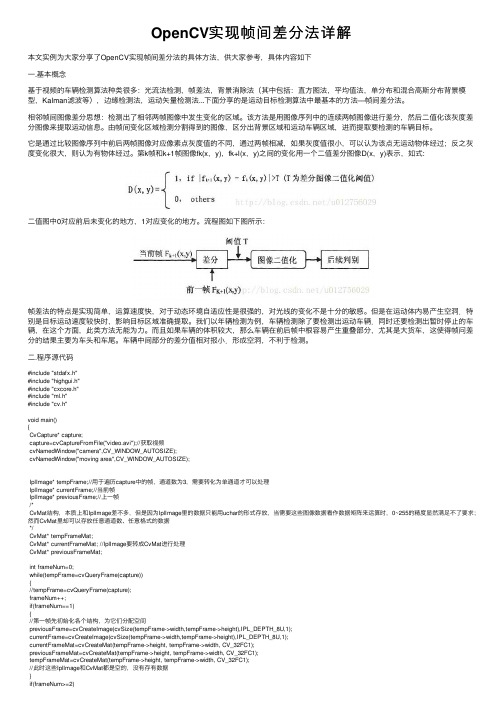

OpenCV实现帧间差分法详解

OpenCV实现帧间差分法详解本⽂实例为⼤家分享了OpenCV实现帧间差分法的具体⽅法,供⼤家参考,具体内容如下⼀.基本概念基于视频的车辆检测算法种类很多:光流法检测,帧差法,背景消除法(其中包括:直⽅图法,平均值法,单分布和混合⾼斯分布背景模型,Kalman滤波等),边缘检测法,运动⽮量检测法...下⾯分享的是运动⽬标检测算法中最基本的⽅法—帧间差分法。

相邻帧间图像差分思想:检测出了相邻两帧图像中发⽣变化的区域。

该⽅法是⽤图像序列中的连续两帧图像进⾏差分,然后⼆值化该灰度差分图像来提取运动信息。

由帧间变化区域检测分割得到的图像,区分出背景区域和运动车辆区域,进⽽提取要检测的车辆⽬标。

它是通过⽐较图像序列中前后两帧图像对应像素点灰度值的不同,通过两帧相减,如果灰度值很⼩,可以认为该点⽆运动物体经过;反之灰度变化很⼤,则认为有物体经过。

第k帧和k+1帧图像fk(x,y),fk+l(x,y)之间的变化⽤⼀个⼆值差分图像D(x,y)表⽰,如式:⼆值图中0对应前后未变化的地⽅,1对应变化的地⽅。

流程图如下图所⽰:帧差法的特点是实现简单,运算速度快,对于动态环境⾃适应性是很强的,对光线的变化不是⼗分的敏感。

但是在运动体内易产⽣空洞.特别是⽬标运动速度较快时,影响⽬标区域准确提取。

我们以年辆检测为例,车辆检测除了要检测出运动车辆.同时还要检测出暂时停⽌的车辆,在这个⽅⾯,此类⽅法⽆能为⼒。

⽽且如果车辆的体积较⼤,那么车辆在前后帧中根容易产⽣重叠部分,尤其是⼤货车,这使得帧问差分的结果主要为车头和车尾。

车辆中间部分的差分值相对报⼩.形成空洞,不利于检测。

⼆.程序源代码#include "stdafx.h"#include "highgui.h"#include "cxcore.h"#include "ml.h"#include "cv.h"void main(){CvCapture* capture;capture=cvCaptureFromFile("video.avi");//获取视频cvNamedWindow("camera",CV_WINDOW_AUTOSIZE);cvNamedWindow("moving area",CV_WINDOW_AUTOSIZE);IplImage* tempFrame;//⽤于遍历capture中的帧,通道数为3,需要转化为单通道才可以处理IplImage* currentFrame;//当前帧IplImage* previousFrame;//上⼀帧/*CvMat结构,本质上和IplImage差不多,但是因为IplImage⾥的数据只能⽤uchar的形式存放,当需要这些图像数据看作数据矩阵来运算时,0~255的精度显然满⾜不了要求;然⽽CvMat⾥却可以存放任意通道数、任意格式的数据*/CvMat* tempFrameMat;CvMat* currentFrameMat; //IplImage要转成CvMat进⾏处理CvMat* previousFrameMat;int frameNum=0;while(tempFrame=cvQueryFrame(capture)){//tempFrame=cvQueryFrame(capture);frameNum++;if(frameNum==1){//第⼀帧先初始化各个结构,为它们分配空间previousFrame=cvCreateImage(cvSize(tempFrame->width,tempFrame->height),IPL_DEPTH_8U,1);currentFrame=cvCreateImage(cvSize(tempFrame->width,tempFrame->height),IPL_DEPTH_8U,1);currentFrameMat=cvCreateMat(tempFrame->height, tempFrame->width, CV_32FC1);previousFrameMat=cvCreateMat(tempFrame->height, tempFrame->width, CV_32FC1);tempFrameMat=cvCreateMat(tempFrame->height, tempFrame->width, CV_32FC1);//此时这些IplImage和CvMat都是空的,没有存有数据}if(frameNum>=2){cvCvtColor(tempFrame, currentFrame, CV_BGR2GRAY);//转化为单通道灰度图,此时currentFrame已经存了tempFrame的内容 /*⽤cvConvert将IplImage转为CvMat,接下来⽤cvAbsDiff对它们处理经过转换后,currentFrame没有改变,但是tempFrameMat已经存了currentFrame的内容*/cvConvert(currentFrame,tempFrameMat);cvConvert(previousFrame,previousFrameMat);cvAbsDiff(tempFrameMat,previousFrameMat,currentFrameMat);//做差求绝对值/*在currentFrameMat中找⼤于20(阈值)的像素点,把currentFrame中对应的点设为255此处阈值可以帮助把车辆的阴影消除掉*/cvThreshold(currentFrameMat,currentFrame,20,255.0,CV_THRESH_BINARY);//cvConvert(currentFrameMat,currentFrame); //观察不⼆值化的情况cvDilate(currentFrame,currentFrame); //膨胀cvErode(currentFrame,currentFrame); //腐蚀cvFlip(currentFrame, NULL, 0); //垂直翻转//显⽰图像cvShowImage("camera",tempFrame);cvShowImage("moving area",currentFrame);}//把当前帧保存作为下⼀次处理的前⼀帧cvCvtColor(tempFrame, previousFrame, CV_BGR2GRAY);cvWaitKey(33);}//end while//释放资源cvReleaseImage(&tempFrame);cvReleaseImage(&previousFrame);cvReleaseImage(¤tFrame);cvReleaseCapture(&capture);cvReleaseMat(&previousFrameMat);cvReleaseMat(¤tFrameMat);cvDestroyWindow("camera");cvDestroyWindow("moving area");}【注意】代码复制他处,略有改动,进⾏视频输出矫正(源代码昰倒的图像)。

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理帧间差分法运动目标检测,是一种常用的视频目标检测方法。

它通过比较视频序列中相邻帧之间的差异,来识别出视频中的运动目标。

这种方法具有简单、快速、实时性强的特点,因此在视频监控、智能交通、安防监控等领域得到了广泛的应用。

下面将介绍帧间差分法运动目标检测的原理和实现过程。

一、原理帧间差分法的原理是通过比较视频序列中相邻帧的像素值差异来识别出视频中的运动目标。

一般来说,视频中的运动目标在相邻帧之间会引起像素值的变化,而静止的背景则保持相对稳定的像素值。

我们可以通过计算相邻帧之间的像素值差异来找出视频中的运动目标。

具体来说,对于视频序列中的每一帧图片,我们可以将其表示为一个像素矩阵。

假设当前帧为I(x, y, t),而前一帧为I(x, y, t-1),那么我们可以通过以下公式计算出两帧之间的像素差异:D(x, y, t) = |I(x, y, t) - I(x, y, t-1)|D(x, y, t)表示像素点(x, y)在时间t上的差分值。

通过计算所有像素点的差分值,我们就可以得到一张差分图像。

在这张差分图像中,像素值较大的地方表示有较大的像素差异,而像素值较小的地方则表示像素差异较小。

通过阈值处理和连通域分析,我们就可以找出视频中的运动目标。

二、实现过程帧间差分法运动目标检测的实现过程可以分为以下几个步骤:1. 读取视频我们需要从视频文件中读取视频序列,并将每一帧的图片进行提取,以便后续的处理。

2. 计算帧间差分对于视频序列中的每一帧图片,我们需要计算其与前一帧之间的差分图像。

这可以通过上文提到的差分公式来实现。

3. 阈值处理得到差分图像之后,我们可以对其进行阈值处理。

通过设定一个合适的阈值,将差分图像中较大的像素差异点标记为前景点,而将较小的像素差异点标记为背景点。

4. 连通域分析通过连通域分析,我们可以将前景点连接成一个个连通区域,从而得到视频中的运动目标。

5. 目标跟踪我们还可以对检测出的运动目标进行跟踪,以便进行后续的分析和处理。

帧间差分与背景差分相融合的运动目标检测算法_朱明旱

自动化测试计算机测量与控制.2005.13(3) C omputer Measurement &Control#215#收稿日期:2004-06-10; 修回日期:2004-07-12。

作者简介:朱明旱(1975-),男,湖南省张家界人,硕士生,主要从事模式识别、图像处理等方向的研究。

罗大庸(1944-),男,湖南省长沙市人,教授,博导,主要从事信息融合技术、计算机视觉与模式识别等方向的研究。

文章编号:1671-4598(2005)03-0215-03 中图分类号:TP393文献标识码:B帧间差分与背景差分相融合的运动目标检测算法朱明旱,罗大庸,曹倩霞(中南大学信息科学与工程学院,湖南长沙 410075)摘要:针对视频序列中运动目标检测进行了研究,提出了一种将帧间差分和背景差分相互融合的运动目标检测算法,首先选取一帧作为背景帧,确立每一个象素点的高斯模型;然后对相邻两帧进行差分处理,区分出变化的区域和没有发生变化的区域,没有发生变化的区域更新到背景帧中,发生变化的区域与背景模型进行拟合,区分出显露区和运动目标,将显露区以很大的更新率收入到背景帧中。

该方法允许在有运动物存在的情况下进行建模,实验表明该方法准确率高,运算速度快,能满足实时检测的需要。

关键词:视频图像序列;高斯模型;运动目标检测;阴影检测Moving Objects Detection Algorithm Based on Two Consecutive Frames Subtraction and Background SubtractionZhu Minghan,Luo Dayo ng ,Cao Q ianxia(Sch ool of Information S cien ce an d En gineering,Cen tral South Un iversity,Changs ha 410075,Chin a)Abstract:Aimed at the complexity of the current algorithm,an algorithm bas ed on tw o con secutive frames sub traction and b ack -groun d su btraction is presented.At firs t,select a frame as a background.T hen su btract tw o con secutive frames to find out moving area an d background area.Update backgr ou nd w ith the backgroun d ar ea w hich is detected.At last ,com pare moving area w ith b ack -groun d to locate moving objection and un covering area.Update backg rou nd w ith un covering area.Th e back grou nd model in th is algo -rithm is obtained even if there ar e some moving objection s.T he results s how that this algorithm combines the advantages of veracity and of runtim e,and fit for real time d etection.Key words :video-frequ ency image sequen ce;Gau ssian m odel;moving ob ject detection;shadow detection0 引言从视频序列中检测出运动物体是计算机视觉、视频图像跟踪等应用领域的重要研究内容,目前已成为热点研究问题[1]。

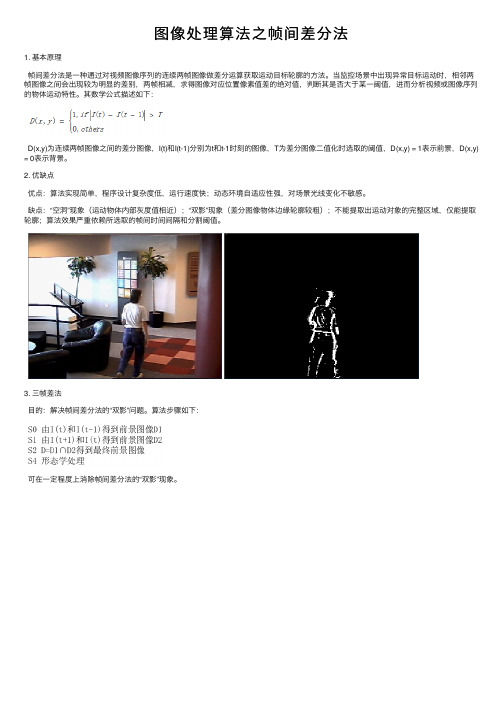

图像处理算法之帧间差分法

图像处理算法之帧间差分法

1. 基本原理

帧间差分法是⼀种通过对视频图像序列的连续两帧图像做差分运算获取运动⽬标轮廓的⽅法。

当监控场景中出现异常⽬标运动时,相邻两帧图像之间会出现较为明显的差别,两帧相减,求得图像对应位置像素值差的绝对值,判断其是否⼤于某⼀阈值,进⽽分析视频或图像序列的物体运动特性。

其数学公式描述如下:

D(x,y)为连续两帧图像之间的差分图像,I(t)和I(t-1)分别为t 和t-1时刻的图像,T 为差分图像⼆值化时选取的阈值,D(x,y) = 1表⽰前景,D(x,y)= 0表⽰背景。

2. 优缺点

优点:算法实现简单,程序设计复杂度低,运⾏速度快;动态环境⾃适应性强,对场景光线变化不敏感。

缺点:“空洞”现象(运动物体内部灰度值相近);“双影”现象(差分图像物体边缘轮廓较粗);不能提取出运动对象的完整区域,仅能提取轮廓;算法效果严重依赖所选取的帧间时间间隔和分割阈值。

3. 三帧差法

⽬的:解决帧间差分法的“双影”问题。

算法步骤如下:

可在⼀定程度上消除帧间差分法的“双影”现象。

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理帧间差分法(Frame Difference Method)是一种常用的视频运动目标检测方法,它通过比较视频帧之间的变化来检测目标的运动。

这种方法广泛应用于视频监控、交通管理、智能交通等领域,并且在实际应用中取得了不错的效果。

1.视频帧获取:需要获取视频输入,并将视频分解成一帧一帧的图像。

2.帧间差分计算:对于连续的两帧图像,通过对两帧图像进行减法操作,计算出图像像素点之间的差值。

这个差值可以表示出两帧图像之间的变化情况,有助于检测出图像中的运动目标。

3.差分图像处理:得到帧间差分图像后,需要对其进行一定的处理,以便进一步提取出图像中的运动目标。

常见的处理方法包括阈值处理、形态学操作等。

4.目标提取与分析:将处理后的帧间差分图像进行目标提取,得到目标的边界信息。

可以进一步对目标进行形状、大小、速度等特征分析。

5.目标跟踪与识别:通过目标提取和特征分析,可以对目标进行跟踪和识别,得到目标的运动轨迹和行为信息。

帧间差分法的原理:帧间差分法主要包括以下几个关键步骤:1.差分计算:通过对两帧图像进行像素级的差分计算,得到一个差分图像。

通常采用的方法是直接相减或者采用其他像素级的差分运算方法。

2.阈值处理:得到的差分图像中可能存在一些噪声或者细微的变化,需要通过设置一个合适的阈值来将目标的变化和噪声区分开来。

3.形态学操作:通过形态学操作,可以进一步处理差分图像,去除一些不必要的细节,加强目标的轮廓信息。

4.目标提取:根据处理后的差分图像,可以得到目标的二值图像,进而提取出目标的轮廓信息。

帧间差分法的优点包括不需要训练数据、对目标的尺度不敏感、对光照变化不敏感等。

帧间差分法在应对复杂场景、目标遮挡、背景复杂等情况下仍然存在一定的局限性,需要结合其他方法进行改进和完善。

三帧差分法

三帧差分法基于OpenCV实现的三帧差分法代码基于帧间差分法进行升级的三帧差分法,不同的测试视频可以设置不同二值化阈值来增强效果。

根据实际情况进行形态学处理。

[cpp] view plain copy1. #include <opencv2/highgui/highgui.hpp>2. #include<opencv2/imgproc/imgproc.hpp> 3. #include <opencv2/core/core.hpp>4.5. #define threshold_diff1 25 //设置简单帧差法阈值6. #define threshold_diff2 25 //设置简单帧差法阈值7.8. using namespace cv;9. using namespace std;10.11. int main(int argc,unsigned char* argv[]) 12. {13. Mat img_src1,img_src2,img_src3;//3帧法需要3帧图片 14. Mat img_dst,gray1,gray2,gray3;15. Mat gray_diff1,gray_diff2;//存储2次相减的图片 16. Matgray_diff11,gray_diff12;17. Mat gray_diff21,gray_diff22;18. Mat gray;//用来显示前景的19. bool pause=false;20.21. VideoCapture vido_file("test3.avi");//在这里改相应的文件名 22. namedWindow("foreground",0);23. for (;;)24. {25. if(!false)26. {27. vido_file >>img_src1; 28. cvtColor(img_src1,gray1,CV_BGR2GRAY);29.30. waitKey(33);31. vido_file >>img_src2; 32. cvtColor(img_src2,gray2,CV_BGR2GRAY);33. imshow("video_src",img_src2);//34.35. waitKey(33);36. vido_file >>img_src3;37. cvtColor(img_src3,gray3,CV_BGR2GRAY);38.39. Sobel(gray1,gray1, CV_8U,1,0,3,0.4,128);40. Sobel(gray2,gray2, CV_8U,1,0,3,0.4,128);41. Sobel(gray3,gray3, CV_8U,1,0,3,0.4,128);42.43. subtract(gray2,gray1,gray_diff11);//第二帧减第一帧44. subtract(gray1,gray2,gray_diff12);45. add(gray_diff11,gray_diff12,gray_diff1); 46.subtract(gray3,gray2,gray_diff21);//第三帧减第二帧47. subtract(gray2,gray3,gray_diff22); 48.add(gray_diff21,gray_diff22,gray_diff2);49.50. for(int i=0;i<gray_diff1.rows;i++)51. for(int j=0;j<gray_diff1.cols;j++) 52. {53. if(abs(gray_diff1.at<unsigned char>(i,j))>=threshold_diff1)//这里模板参数一定要用unsigned char,否则就一直报错54. gray_diff1.at<unsigned char>(i,j)=255; //第一次相减阈值处理 55. else gray_diff1.at<unsigned char>(i,j)=0;56.57. if(abs(gray_diff2.at<unsigned char>(i,j))>=threshold_diff2)//第二次相减阈值处理58. gray_diff2.at<unsigned char>(i,j)=255;59. else gray_diff2.at<unsigned char>(i,j)=0;60. }61. bitwise_and(gray_diff1,gray_diff2,gray);62.63. dilate(gray,gray,Mat());erode(gray,gray,Mat());64.65. imshow("foreground",gray); 66. }67. if( cvWaitKey(33) >= 0 ) 68. break;69. }70. return 0;71. }。

帧间差分法运动目标检测过程及原理

帧间差分法运动目标检测过程及原理帧间差分法是一种常用的视频运动目标检测方法,其原理是通过比较连续两帧图像之间的差异来判断图像中的运动目标。

以下是帧间差分法的运动目标检测过程及原理的详细介绍:1. 获取连续帧图像:首先需要获取前后两帧的视频图像,这两帧图像应该是时间上连续的。

2. 图像灰度化:将获取到的图像进行灰度化处理,将彩色图像转化为灰度图像,此步骤的目的是简化图像处理的计算量。

3. 计算图像差异:比较前后两帧图像的差异,可以使用以下公式计算每个像素的差异:差异 = abs(I1(x, y) - I2(x, y))I1表示前一帧的图像,I2表示后一帧的图像,(x, y)表示像素的坐标。

4. 提取运动目标:根据计算得到的图像差异,可以设置一个阈值(比如差异大于某个阈值的像素点认为是运动目标),将差异大于阈值的像素点提取出来,形成运动目标区域。

5. 运动目标跟踪:对于提取出的运动目标区域,可以根据需要进行进一步的处理,例如检测运动目标的位置、大小、运动轨迹等。

6. 更新帧图像:将当前的图像帧作为前一帧,继续进行后续帧间差分,实现连续的目标检测和跟踪。

帧间差分法的原理是基于连续图像帧之间的变化,当有运动目标出现时,前后两帧图像中相应位置的像素值会发生明显的变化。

通过比较像素点的差异,可以较好地检测出这些运动目标。

这种方法的优势在于简单、实时性较高,适合于动态目标较为明显的场景。

帧间差分法容易受到光照变化、摄像机抖动等因素的影响,可能会导致误检测或漏检测的情况出现。

为了提高准确性,可以结合其他的图像处理方法,例如背景建模等,以进一步优化运动目标检测的效果。

如何进行视频编码的运动模式分析与检测(十)

视频编码是将图像序列转换为数字化形式的过程,其中一个重要的步骤是运动估计和运动补偿。

运动模式分析与检测是运动估计和运动补偿的关键技术。

本文将介绍视频编码中的运动模式分析与检测的基本原理和方法。

一、运动模式的概念与分类运动模式是指在视频序列中物体或场景的运动规律,它描述了图像中各个像素的运动方式。

根据运动模式的不同,可以将其分为三类:帧间运动、帧内运动和全局运动。

1. 帧间运动:帧间运动是指运动目标在连续两帧之间的运动。

常见的帧间运动模式包括:平移、旋转、缩放和视差等。

通过分析连续两帧之间的差异,可以得到运动矢量,从而实现运动估计和运动补偿。

2. 帧内运动:帧内运动是指物体在同一帧中的局部运动。

常见的帧内运动模式包括:亮度变化、颜色变化和形状变化等。

通过对单帧图像的分析,可以捕捉到物体或场景的细微变化。

3. 全局运动:全局运动是指整个图像场景的平移、旋转、缩放等整体性的变化。

全局运动模式的分析和检测可以帮助我们了解不同帧之间的图像整体变化情况。

二、运动模式分析与检测的基本方法运动模式分析与检测的基本方法包括:运动估计、运动补偿和运动分析等。

1. 运动估计:运动估计是指根据连续两帧之间的差异,估计物体或场景的运动矢量。

常用的运动估计方法有全搜索法、三步搜索法和金字塔法等。

全搜索法是最常用的方法之一,它通过计算各个像素点的差异来得到最优的运动矢量。

三步搜索法是一种快速估计方法,它通过分层搜索的方式来减少计算量。

金字塔法则是通过对图像进行多次子采样,从而得到不同分辨率的图像,从而减少计算量和提高运动估计的准确度。

2. 运动补偿:运动补偿是将物体或场景的运动矢量应用到编码过程中,以减少冗余信息。

常用的运动补偿方法有帧内预测和帧间预测等。

帧内预测是根据同一帧中前后像素的运动关系来进行预测,并对预测误差进行编码。

帧间预测是根据连续两帧之间的差异进行预测,并对预测误差进行编码。

3. 运动分析:运动分析是对运动模式进行统计和分析,以便更好地理解图像序列中的运动规律。

帧间差分法 车辆测速 代码

帧间差分法车辆测速代码帧间差分法是一种常用的车辆测速方法,它通过分析连续视频帧之间的差异来实现车辆的速度计算。

本文将详细介绍帧间差分法的原理、步骤以及应用,并结合代码示例进行解析。

首先,我们来了解一下帧间差分法的原理。

在车辆测速中,通常使用摄像机来获取车辆经过的视频图像。

帧间差分法利用视频中相邻帧之间的像素差异来计算车辆速度。

具体来说,它通过比较相邻帧中相同位置的像素值来检测运动对象(即车辆)在图像中的位置变化,进而计算出车辆的移动速度。

接下来,我们来了解一下帧间差分法的步骤。

首先,需要获取视频输入并将其转换为一系列连续的图像帧。

然后,选取两个相邻的帧,并将它们转换为灰度图像。

接着,将这两个灰度图像之间的像素进行差分运算,得到一个差分图像。

在这个差分图像中,车辆的区域将呈现明显的像素变化。

最后,根据车辆在差分图像中的位置变化以及已知的帧间时间间隔,即可计算出车辆的速度。

下面,我们将通过代码示例来演示帧间差分法的具体实现过程。

假设我们已经获取了一段视频,并将其转换为一系列连续的图像帧。

我们将使用Python编写代码来进行车辆测速。

首先,我们需要导入所需的库和模块。

我们将使用OpenCV来处理图像和视频,以及NumPy来进行数组操作。

import cv2import numpy as np```接下来,我们定义一个函数来对相邻两帧之间的像素进行差分运算,并返回差分图像。

```pythondef frame_difference(frame1, frame2):gray1 = cv2.cvtColor(frame1, cv2.COLOR_BGR2GRAY) # 将帧转换为灰度图像gray2 = cv2.cvtColor(frame2, cv2.COLOR_BGR2GRAY)diff = cv2.absdiff(gray1, gray2) # 计算帧差_, diff = cv2.threshold(diff, 30, 255,cv2.THRESH_BINARY) # 二值化图像return diff```然后,我们定义一个函数来计算车辆的速度。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

#include <cv.h>

#include <opencv2/opencv.hpp>

#include <cstdio>

#include <cstdlib>

#include <Windows.h>

#include "highgui.h"

#include "math.h"

int numFrames = (int) cvGetCaptureProperty(pCapture, CV_CAP_PROP_FRAME_COUNT);

int num=numFrames;

printf("vedio's \nwidth = %d\t height = %d\n video's fps = %d\t nums = %d", frameW, frameH, fps, numFrames);

}

//------------------------------------------------------------------------------------

absdiff(frame_r_Gray,background,foreground);//用帧差法求前景

imshow("foreground",foreground);

threshold( foreground, foreground_BW, 50, 255 , 0 );//二值化

imshow("foreground_BW",foreground_BW);

frame_0=frame_r_Gray.clone();

int frameW = (int) cvGetCaptureProperty(pCapture, CV_CAP_PROP_FRAME_WIDTH);

int fps = (int) cvGetCaptureProperty(pCapture, CV_CAP_PROP_FPS);

while(num)

{

capture>>frame;

if(!capture.read(frame)) break;

resize(frame, frame_resize, Size(W,H));

imshow("frame_resize",frame_resize);

num--;

char c = waitKey(33);

if( c ==27 ) break;

}

}

Mat frame_resize;

//Mat frame_r_Gray;

Mat average;

Mat background,foreground,foreground_BW;

//---------------------------------------------------------------------

//获取视频的宽度、高度、帧率、总的帧数

CvCapture* pCapture = NULL;

pCapture = cvCaptureFromAVI("tree.avi");

int frameH = (int) cvGetCaptureProperty(pCapture, CV_CAP_PROP_FRAME_HEIGHT);

//---------------------------------------------------------------------

Mat frame_r_Gray;

Mat frame_0,frame_1;//Mat m(3, 5, CV_32FC1, 1);

//---------------------------------------------------------------------

using namespace std;

using namespace cv;

int W=600;

int H=400;

int

{

VideoCapture capture("tree.avi");

Mat frame;

cvtColor( frame_resize,frame_r_Gray, CV_RGB2GRAY );

//imshow("frame_resize_Gray",frame_r_Gray);

//-----------------------------------------------------------------------------------

//选择前一帧作为背景(读入第一帧时,第一帧作为背景)

if(num==numFrames)

{

background=frame_r_Gray.clone();

frame_0=background;

}

else

{

background=frame_0;