信息论重点 (新)

信息论与编码-第2讲-信源及信息度量1

自信息含义

当事件xi发生以前:表示事件xi发生的不确定性。 当事件xi发生以后:表示事件xi所含有(或所提供)的信

息量。在无噪信道中,事件xi发生后,能正确无误地传输到 收信者,所以I(xi)可代表接收到消息xi后所获得的信息量。 这是因为消除了I(xi)大小的不确定性,才获得这么大小的信 息量。

2.1.1 单符号离散信源的数学模型

(1) 信源的描述方法 (2) 单符号离散信源数学模型

(1) 信源的描述方法

在通信系统中收信者在未收到消息以前,对信源发出 什么消息是不确定的。

① 离散信源:输出的消息常常是以一个个符号形式出现,

这些符号的取值是有限的或可数的。 单符号离散信源:只涉及一个随机事件,可用随机变量描述。 多符号离散信源:每次输出是一个符号序列,序列中每一位出现

② 联合自信息量

信源模型为

x2 y1 ,, x2 ym ,, xn y1 ,, xn y m XY x1 y1 ,, x1 ym , P( XY ) p( x y ),, p( x y ), p( x y ),, p( x y ),, p( x y ),, p( x y ) 1 m 2 1 2 m n 1 n m 1 1

计算y1与各种天气之间的互信息量 对天气x1,不必再考虑 对天气x2, I ( x2 ; y1 ) log2 p( x2 / y1 ) log2 1/ 2 1(比特) p( x ) 1/ 4

i i

验概率的函数。

函数f [p(xi)]应满足以下4个条件 根据上述条件可以从数学上证明这种函数形式是对 数形式。

信息论第一章

Tianjin Polytechnic University

自信息量 ①自信息量

单符号离散信源的数学模型

信源的描述方法 单符号离散信源 单符号离散信源的数学模型

Company Logo

Tianjin Polytechnic University

单符号离散信源的数学模型

Tianjin Polytechnic University

例题

例题:写出相应的数学模型 (1)某二元信源只含有0和1两个消息,发送1的概率是 0.99,而发送0的概率是0.01 解:

X 1 P ( X ) 0.99 0 0.01

(2)某二元信源只含有0和1两个消息,发送1和0的概率 均是0.5

自信息的定义

若噪声太大, 信宿收到受干扰的信息后,对某信息 产生的不确定性依然存在或一点也未消除,则信宿 获得较少的信息或者说一点也没有获得信息.

自信息 I ( xi ) 的定义: 信源中某个符号 x i 的出现所带来的信息量

Tianjin Polytechnic University

自信息的定义

1 2 9 X 0 P ( X ) 0.1 0.1 0.1 0.1

(4)信源只发送一种消息,即永远发送1或者永远发送0

X 0 P ( X ) 1 X 1 或 P ( X ) 1

其不确定性 I ( xi )

Tianjin Polytechnic University

自信息的定义

自信息 I ( xi ) 满足以下几条公理:

(4)可加性:若

p( xi y j ) p( xi ) p( y j )

I ( xi y j ) I ( xi ) I ( y j )

信息管理重点

信息的定义1 信息是用来消除未来的某种不确定性的东西信息论创始人香农的观点2信息是与外界相互交换的内容控制论创始人维纳的观点3信息是事物变化或差异的表现于光远的观点4信息是一切事物运动的方式和状态,以及对这种方式或状态的反映和表述钟义信的观点信息管理界的信息定义:信息是按照用户决策的需要经过加工处理的数据;在信息管理界,信息是按照用户决策的需要经过加工处理的数据;信息的特征①信息存在的依附性、普遍性与客观性②信息产生的主观性、加工性与可开发性③信息运动的储存性、传递性与共享性④信息利用的价值性、时效性与整体性信息的分类(1)按照主体的认识层次:语法信息:事物存在方式和运动状态的外在形式是什么形式语义信息:认识主体所感知或所表述的事物存在方式和运动状态的逻辑内在含义是什么意思语用信息:认识主体所感知或所表述的事物存在方式和运动状态的效用价值有什么用处信息管理关注的主要是语用层次上的信息现象;(2)按信息载体和存储方式划分文献型信息:它包括由传统介质纸张、竹、帛和各种现代介质磁盘、光盘、胶卷等记录和存储的知识信息;实物型信息资源:由实物本身来存储和表现的知识信息;如样品、样机,本身代表一种技术信息;(3)加工程度:从信息管理的角度看,信息按加工深度分为一次信息原始信息、二次信息对原始信息加工处理后的信息、三次信息管理决策信息;零次信息:是通过直接交流获得的未经过人脑进行加工和组织的信息资源;即口头传播的信息资源; 获取方式:通过谈话、咨询、旁听、聚会、讲演、会议、教学、电话交流等;一次信息:是以零次信息资源为基础,对自然状态和社会表象的信息以及大脑存储的信息进行初步加工,经过文字、图像等各种方式表达的信息资源;这类信息资源末经过系统化的组织;通常表现:讲演、手稿、日记、录音、录像、广告等,具有原创性、表达性等特点;二次信息:是指在一次信息资源基础上,进行科学思维加工整理所得到的信息资源;如专着、论文、报告、剧本等;三次信息:是对大量的二次信息资源进行浓缩、编排、综合而产生的系统化成果;如:科学评论、书评、各种资料汇编、信息检索工具书目、文摘、索引、综述、述评等;具有工具性、综合性、系统性的特征;信息资源的内涵及功能内涵:狭义的理解:指人类社会经济活动中经过加工处理的有序化并大量积累起来的有用信息的集合;如科技信息、政策法规信息、市场信息、金融信息等;广义的理解:指人类社会信息活动中积累起来的信息、信息生产者、信息技术等信息活动要素的集合;功能:⑴信息资源的科学认识功能;信息是认识客体的中介;信息是人类思维的材料;⑵信息资源的管理功能;信息是科学决策的依据,信息是合理计划的基础,信息是有序组织的依据,信息是有效控制的手段;⑶信息资源的经济功能;a、信息资源观、财富观已经为社会所认同b、信息创造了经济效益、财富和利润提高社会生产力,增强企业的竞争力,优化产业结构信息产业的崛起信息管理的内涵及管理对象含义:狭义的理解:信息管理就是对信息的收集、整理、存储、传播和利用的过程;也就是信息从分散到集中,从无序到有序,从存储到传播,从传播到利用的过程;这种说法把信息管理局限于对信息本身的管理;对信息的管理广义的理解:信息管理是对信息活动过程中的所有要素,如信息、人员、技术、机构、环境等进行管理,实现各种资源的合理配置,有效满足社会对信息需求的过程;对信息活动诸要素管理根据目前发展的状况,采取广义的说法比较合适;对象:可以认为信息管理就是对信息资源及其开发利用活动的管理;这其中包括两大方面:一是信息资源;二是信息活动;⑴信息资源狭义信息资源:信息本身的集合;广义信息资源:信息、信息技术、信息人员的有机集合;⑵信息活动信息活动是指人类社会围绕信息资源形成、传递和利用而开展的管理活动与服务活功;信息活动分为两个阶段和三个层次.①信息资源形成阶段;活动特点:以信息的产生、记录、传播、收集、加工、处理、存储为过程,目的在于形成可资利用的信息资源;②信息资源的开发利用阶段;以对信息资源的检索、传递、吸收、分析、选择、评价、利用等活动为特征,目的是实现信息资源的价值,达到信息管理的目标 ;三个层次:①个人信息活动:是个体获取、控制信息和开发利用信息资源的活动;个体信息活动效率取决于:个人信息技能、个人的智力水平、信息技术能力和知识素质等;②组织信息活动:组织收集、处理与开发利用组织内信息和外源信息,以实现组织的目标、完成组织任务的活动;形式:各类信息系统③社会信息活动:是社会规模的信息资源开发和利用活动,体现为社会规模的信息产业的形成与发展和社会信息化水平;形式:信息产业、社会信息化信息管理的发展过程及各阶段的特征传统管理阶段、技术管理阶段、资源管理阶段和知识管理阶段 ;传统管理阶段:特点:以信息源的管理为核心,以文献为主要载体,公益性服务为主要目标技术管理阶段年:特点:以信息流的控制为核心,以计算机为工具,以自动化信息处理和信息系统建造为主要工作内容,信息任务主要是解决大量数据的处理和检索;信息资源管理阶段1980--:特点:将信息作为一种重要的资源来开发和利用,强调信息资源是重要的经济资源、管理资源和竞争资源,重视信息资源在组织管理决策与竞争中的作用;注重采用多种方法对人类社会信息过程即相关要素进行综合管理,包括技术、人文、经济等综合管理手段的应用;知识管理阶段KM:技术知识管理的使能器共享知识管理的催化剂人:知识管理的主体知识:知识管理的内容信息资源管理的基本模式与信息管理的技术时期相比较,他提出了信息管理的技术管理、经济管理和人文管理三种模式,并分别对应三种社会背景:信息技术、信息经济和信息文化;技术管理就是用技术的手段从事信息资源的搜集、整理、存储和传播工作,从而更有效的开发和利用信息资源;经济管理是指运用经济手段,按照客观经济规律的要求,管理信息资源,确保合理的开发和利用信息资源;人文管理就是通过信息政策、信息法律、以及信息道德等人文手段;从不同的角度对信息资源进行管理,三者目标一致、功能协调,相辅相成;信息资源管理的思想特点(1)综合性:在管理对象上强调信息管理对象的多样性;在管理内容上着眼于对信息资源处理过程的综合性;在管理方法上将多种方法集于一身,并加以综合应用(2)集成性: 技术、经济、人文手段相结合,实现对信息资源的整体集成管理(3)系统性:IRM是对包括信息、人员、设备、资金等诸要素在内的大信息系统的管理信息资源管理的系统观和过程观系统观: 信息源含收集系统一次信息系统信息检索含存储系统二次信息系统信息研究含加工系统三次信息系统信息服务含传递系统从系统观来看,信息资源管理是对整个信息系统的管理,这四个子系统构成整个信息系统的业务体系;过程观:信息是一种具有生命周期的资源,信息资源管理就是基于信息生命周期的一种人类管理活动;信息资源管理过程环节包括信息的收集、加工、存储、传递、使用和维护阶段信息资源管理的手段和层次P31显性知识与隐性知识的内涵显性知识explicit knowledge:也称编码知识,是经过整理和组织,以语言、文字、公式、计算机程序、数据库等编码形式表现出来,并可以通过正式的、系统化的方式如出版物等加以传播,容易被人们学习的知识;如教科书、参考资料、期刊杂志、专利文献、视听媒体、软件和数据库等隐性知识tacit knowledge :也称隐含经验类知识,是个人或组织经过长期实践积累而拥有的、通常不易用言语表达的难以传播的知识;如技术和技巧等;知识创新的四种基本模式SECIA 社会化模式Socialization :通过共享经验、相互间的交流与沟通,而转化成为新的隐性知识的过程,达到创新的目的;B 外化模式Externalization :把抽象的隐性知识经验等转化为便于交流和理解,可以被他人共享的显性知识的过程;重要环节C 综合化模式Combination :把不同的显性知识结合起来,转化为更复杂和系统的显性知识的过程;D 内化模式Internalization :从显性知识到隐性知识的过程;实质是一个自我学习的过程;通过社会化、外化、综合获得的知识内化为个人的隐性知识,形成技术技巧、能力,提高自身素质;信息管理与知识管理的关系区别和联系联系:信息管理是知识管理的基础,知识管理是信息管理的延伸与发展;信息管理与知识管理都强调知识信息的共享和利用,强调用户的需求,但程度有所不同;前者关注“我是否提供了你需要的信息”,后者关注“是否通过我的服务解决了你的问题”;两者都重视信息和信息技术;信息是知识的原始来源,信息技术也是知识管理的工具;区别:信息管理学的实用体系框架和学科体系结构实用体系框架:学科体系结构:信息科学理论的三大基石及信息管理学的理论基础信息管理学的理论基础:信息学、管理学和系统科学之间的关系是很密切的,三者构成了信息管理学基础理论体系结构,是信息管理学理论体系的主体学科;三大基石:1)信息学是信息管理的基石2)管理学是信息管理的母体3)信息管理也需要系统思想观念和系统工程技术信息产业的内涵和类型内涵:信息产业是从事信息技术设备制造及信息产品生产开发与流通服务的新兴产业群体;类型:信息技术设备制造部门信息商品化部门准信息部门信息化内涵及信息化的发展阶段内涵:信息化是指人类社会活动中,通过普遍采用信息技术,更加有效地开发信息资源,推动经济发展和社会进步的过程;发展阶段:①信息产业化和产业信息化初级阶段②经济信息化③社会信息化信息化的高级阶段信息技术的体系结构4C技术感测技术:是信息的采集技术,对应于人的感觉器官;通信技术:是信息的传递技术,对应于人的神经系统;计算机技术:是信息的处理和存储技术,对应于人的思维器官;控制技术:是信息的使用技术,对应于人的执行器官;对于信息管理领域来说,计算机信息处理技术和通信技术是最重要的两种信息技术工具;信息管理对组织管理的影响信息管理对组织管理的影响SCM、BPR、ERP、CRM信息源基本类型按信息的存在形式:1 记录信息源或文献信息源2 实物信息源3 智力型信息源4 零次信息源信息源其他分类:以组织边界为界限,可将信息源分为内部信息源和外部信息源;根据时间标准来区分,可分为一次信息源和二次信息源;根据信息的运动形式,还可以把信息源分为静态信息源和动态信息源;信息是否数字化,可以将信息源区分为数字化信息源和非数字化信息源;企业信息采集渠道企业信息采集主要有内部途径和外部途径两条获取信息的渠道;一内部途径1.管理监督部门管理各环节现状信息和战略决策信息2.研究开发部门新技术新产品设计研发信息3.市场营销部门竞争环境与竞争对手的动态信息4“葡萄藤”渠道员工对决策的反馈信息5.内部信息网络 Intranet跨平台信息交换与共享二外部途径1.大众传播媒介内容新、范围广信息资料,专题信息采集2.政府机关政策法规、专利标准、统计资料、研究报告等3.社团组织学会、协会等行业团体收集内部通讯和专业简报等非公开出版物,了解最新技术与同行信息4.各种会议研讨会、洽谈会、交易会、发布会、展销会等,获取外部环境信息与竞争对手信息5.个人关系获取非公开的机密信息6.协作伙伴供应链战略伙伴获取信息7.用户和消费者产品需求与反馈信息8.外部信息网络——Internet网络信息采集的主要方法网络查询法:利用Internet 所提供的便利条件,通过多种网上信息查询工具采集所需信息;信息采集的方法1 内部信息索取法2 互通有无交换法3 委托采集法4 实物样品分析法5 实地考察法6 间接调查法7 网络查询法8 大众传媒采集法9 咨询采集法信息组织的内容与基本要求内容:信息描述——初级组织外表特征描述信息揭示——中级组织内容特征揭示信息分析——高级组织信息重组,提供三次信息信息存储——空间组织存储在载体中,便于检索信息主要作用:向用户提供所需要的各层次信息一次信息、二次信息、三次信息;基本要求:1及时性,所谓及时有两层含义:一是时过境迁的信息要及时记录;二是有用信息要迅速采集;2准确性,信息要求准确无误地反映实际情况,信息失真就会造成决策失误;3适用性,信息贵在于适用,满足用户的真正需求;4经济性,取得信息是要付出代价的;注意信息价值与成本的关系,力求以最少的费用,发挥信息的最大作用;语法、语义、语用信息的组织方法语义信息组织+ 组织方法以信息的内容特征为根据序化信息1分类组织法学科分类文献分类专利分类商品分类职能分类2主题组织法主题——信息所论述的主要对象主题词——用来表述信息主题的词语主题法——把主题词作为文献标识,对主题词进行字顺排列,进而表达文献之间相互关系的一种信息组织方法语用信息组织 + 组织方法:以信息的效用特征为依据序化信息的方法1重要性大小组织法根据信息的重要程度序化信息;如大众传媒的栏目设置;2权值组织法赋予信息不同的权重值,以权值大小组织信息,如决策方案的选择,信息服务质量的评估指标等3概率组织法以事件发生的概率大小来组织信息;预测体育比赛的胜负等4特色组织法根据用户的特殊需求组织信息;如摄影信息,旅游信息等语法信息组织 + 组织方法:以信息的外表形式特征为根据序化信息1 字顺组织法2 代码组织法3 地序组织法4 时序组织法信息处理过程的基本环节信息流的运动过程,实际上是信息的处理过程;信息处理过程的基本环节:收集、加工、传递、存储、检索、使用、反馈最简单的信息处理过程:收集、加工、传递、使用四个环节;信息行为的具体表现及基本规律用户的信息行为主要表现:信息查寻行为、信息选择行为和信息使用行为;基本规律穆尔斯定律Mooers内涵:一个信息检索系统,如果对用户来说,取得信息比不取得信息更伤脑筋和麻烦的话,这个系统就不会得到利用;定律表明:信息系统的易用性对用户的信息查寻行为有很大影响; 穆尔斯定律告诉我们:信息的使用与获得信息的容易程度成正比;”齐夫Zipf最小努力原则内涵: 1948年齐夫完成了专着-人类行为与最小努力原则,该原理认为,一个人的整个行为在任何情况下都是受花费最小力气驱使的 ,即受“最小努力原则”的制约;尽量投入最小的力量,追求最大的效益是从事任何工作人们的共同愿望,最小努力原则是人类的基本行为原则定律说明:用户的信息行为如同广义的走路,选择最短路线即遵循信息查询的可近性/快捷性省力原则,获取和吸收信息的工作量最小,符合齐夫最小努力原则;马太效应定律指好的愈好,坏的愈坏,多的愈多,少的愈少的一种现象;马太效应现代涵义:指任何个体、群体或地区,一旦在某一个方面如金钱、名誉、地位等获得成功和进步,就会产生一种积累优势,就会有更多的机会取得更大的成功和进步;马太效应定律说明:用户信息需求与用户积累信息量之间的正相关性;也就是说,用户掌握的信息越多,就会有越多的信息需求,从而引发更多的信息行为,掌握更多更新的信息,依次类推越来越多,反之,越来越少;组织不同层次的信息需求特点分析企业物流和信息流的关系1、信息流是物流的先导,物流是对信息流的回应;2、信息流影响物流,控制和调节物流信息流不畅通就会导致物流不通;3、物流是有形的单向流动,信息流是无形的双向流动;企业信息资源开发利用遵循的基本步骤1明确影响企业竞争和赢利能力的信息资源的范围;2设定信息组织,规范管理制度3制定信息资源开发规划4建设信息网络平台5建设各类计算机信息系统6整合资源,打破信息孤岛,实现信息共享7提供辅助决策信息,实现企业智能;比较分析MRP、MRP-2、ERP之间的关系信息管理逻辑顺序方法的基本步骤信息调查、信息分类、信息登记、信息评价第一步:信息调查信息调查的含义:有目的、有计划地搜集、记录、整理有关数据;调查的目的:查清组织内部、外部信息资源的情况,包括显性信息资源、隐性信息资源等;调查的要求:准确性及时性第二步:信息分类:通过各种途径获得的信息形式是多种多样的,分类的目的是便于分析和综合;第三步:信息登记信息加工描述:信息经过一定的分类之后,需要大量的登记、归纳和整理;第四步:信息评价信息分析与研究:信息评价的目的:更好地使用信息资源;任务:需要研究每一项信息资源的供应、管理和使用情况,核算信息资源的成本,对信息资源的价值与作用进行评价;物理过程方法的基本内涵是基于信息生命周期的一种管理活动;信息生命周期:是信息运动的自然规律;从信息的产生到最终被使用发挥其价值,一般可分为信息的收集、传输、加工、存储、维护这几个阶段;物理过程方法包括四个方面:1信息需求与服务;2信息收集与加工;3信息存储与检索;4信息传递与反馈;BSP方法的步骤一.准备工作;二.研究开始阶段调研;三.定义企业过程;四.业务过程重组;五.定义数据类;六.分析企业/系统关系七.定义信息结构MIS的总体结构;八.形成文档、建议书以及开发计划战略数据规划方法的基本过程第一步:进行业务分析,建立企业模型第二步:进行数据分析,建立主题数据库第三步:子系统划分一体化战略信息管理的内涵从战略规划的角度考察:战略信息管理可以视之为信息战略的展开过程,是企业信息功能战略的制订、实施、监控、调整及其与企业业务战略的整合过程;从理论来源的角度考察:战略信息管理可以视作战略管理与信息管理的交集,是一种跨领域的管理活动从其作用领域来看:战略信息管理是一个作用于所有企业活动领域的相对独立的功能领域;而从其活动内容来看:战略信息管理是围绕企业信息活动以及信息、信息技术、信息人员等相关资源要素实施规划、预算、组织、指挥、控制、协调等活动的多功能领域;企业战略信息管理发展过程的五个阶段说阶段一:文本管理阶段19世纪晚期至20世纪50年代;人类信息管理的核心是对信息的物理载体进行管理,信息管理人员更关心信息载体的安全和保护而不是其传播和使用,与此相对应,信息管理功能是低水平和辅助性的;阶段二:公司自动化技术管理阶段20世纪60年代至70年代;企业信息管理的标志是计算机应用技术的引进和应用,管理重点开始由信息载体演变为信息技术,主要目的是提高信息处理速度和效率;阶段三:信息资源管理阶段20世纪70年代至80年代早期;70年代末,发达国家的企业信息管理进入了信息资源管理时期,企业开始把信息内容本身看作是等同于人力资源、物质资源和资金资源的战略资源,把信息管理功能视为等同于市场营销、生产管理、财务管理和人力资源管理的重要职能;企业内部的信息系统开始朝着集成化的方向发展;阶段四:竞争者分析和竞争情报阶段始于20世纪80年代中期;竞争情报是经过筛选、提炼和分析的竞争对手和竞争环境的信息集合,是企业决策层的主要需求信息;因竞争的加剧,企业认识到必须有效利用信息来制定更积极的战略,维持或赢得竞争优势;企业开始研究和开发能够支持企业决策的信息系统;阶段五:战略信息管理知识管理阶段知识本身被视为企业最重要的战略资源;知识管理主要利用信息、数据,并将其转变为有价值的可控的知识财富;通过建立知识共享机制,运用集体智慧提高企业的应变能力和知识创新能力的一套管理思想和方法体系;基于Intranet的企业信息技术战略规划层次第一个层次是企业内联网;这是企业信息技术战略的基础结构层次;通过Intranet把企业的所有信息资源集成起来,实现企业员工的信息共享和协同作业;第二个层次是企业外联网;这是在Internet和Intranet技术基础上建立起来的与Intranet相联的战略伙伴协作网;通过企业外联网,把与本企业有业务合作关系的企业,诸如供应商和分销商等联成一体,使企业可以有效地进行供应链的管理,并能更好地把握住竞争机会;第三个层次是企业电子商贸网;这同样是利用了Internet和Intranet技术并与Intranet相联的产品销售与用户服务网;通过企业电子商贸网,可以提供联机销售服务,帮助企业建立用户支持系统,拓展市场份额或打开新兴市场;战略信息资源的内涵及管理的过程战略信息资源是与企业战略相关或是企业战略管理过程中所需要及所产生的信息资源的总和,是那些决定企业命运的、为企业决策所必需的、关系到企业发展全局和远期规划的信息资源;战略信息资源的管理过程1 广泛收集一般信息资源;2 加工、提炼形成战略信息资源;3 分析战略信息资源;重点阶段4 传送战略信息资源给用户,最大限度地发挥战略信息资源的价值;信息管理机构的基本功能1、信息汇总与收集功能2、信息管理与检索功能3、信息分析与处理功能4、信息的协调与沟通功能企业信息管理机构的组织模式1、集中式结构模式;中小企业2、分散型结构模式;不设信息管理中心,各职能部门设信息员3、集中-分散型结构模式;大型企业,理想的结构模式企业CIO 的职责和知识能力素质CIO 的职责1从统揽业务全局的高度来考虑信息工作的发展规划,为实现公司的战略发展目标服务;2熟悉各业务部信息流的关系,规范企业信息管理的基础标准,能够综合协调各部门的信息工作;3熟悉信息科学、系统方法和信息技术,能够将数据管理、网络通讯、计算机处理等方面的工作统筹安排,发挥作用;。

信息管理学复习资料【重点】

管理信息学复习要点第一章科学的信息定义:信息是对客观世界中各种事物的运动状态和变化的反映,是客观事物之间相互联系和相互作用的表征,表现的是客观事物运动状态和变化的实质内容。

信息的特征客观性普遍性不完全性依附性价值性时效性可传递性可存储性可扩散性共享性可加工性有用性数据、信息和知识数据是客观记录、分类和存储,它不被用来传递任何特定意义。

可以是数值、字符(串)、图、声音、图像/图片等。

---语法信息信息是被组织起来、对接受者有特定意义的数据。

它可能是一些接受者知道的,也可能不知道但接受者自己能解释。

---语义信息知识通过对数据的加工、提取形成的有重要应用前景、能反映过去经验、具有价值性的数据。

---语用信息信息资源的三要素:信息生产者:是为某种目的生产信息的劳动者,包括原始信息生产者、信息加工者或信息再生产者。

信息:既是信息生产的原料,也是信息生产的产品,是信息生产者的劳动成果,对社会各种活动直接产生效用,是信息资源的目标要素。

信息技术:是能够延长或扩展人的信息能力的各种技术的总称,是对声音、图像、文字等数据和各种传感信号的信息进行收集、加工、存储、传递和利用的技术。

信息技术作为生产工具,对信息收集、加工、存储与传递提供支持与保障。

在信息资源中,信息生产者是最关键的因素,因为信息和信息技术都离不开人的作用,信息是由人生产和消费的,信息技术也是由人创造和使用的。

信息资源的特征信息资源作为经济资源的一种,它具有经济资源的共同特征即需求性、稀缺性和对象的选择性。

信息资源作为一种独立存在的资源,它也有其自身特有的特征,如可共享性、无穷无尽性和驾驭性等。

信息科学信息科学是研究信息运动规律和应用方法的科学,是由信息论、控制论、计算机、人工智能和系统论相互渗透相互结合而成的一门新兴综合性学科。

其支柱为系统论、控制论和信息论。

信息论是信息科学的前导,是一门用数理统计方法研究信息的度量、传递和交换规律的科学。

信息论的主要研究内容。

信息论讲义_第一讲

• 香农定义的信息也有其局限性,存在一些缺陷

– 定义的出发点是假定事物状态可以用一个以经典集 合论为基础的概率模型来描述。 – 没有考虑收信者的主观特性和主观意义,也撇开了 信息的具体含意、具体用途、重要程度和引起后果 等因素。

20

1.1.4 信息、消息与信号

信息: 比较抽象的概念;是系统中传输的对 象;包含在消息之中。 消息:比较具体,但不是物理量;具有不同 形式,例如语言、文字、符号、图像等能够 被人感知;可以传输并被通信双方理解;同 一消息含有不同信息;同一信息可用不同消 息载荷。 信号:最具体,是消息的载荷者;是表示消 息的物理量,可测量、可显示、可描述,是 信息的物理表达层。

12

1.1.2 广义的信息概念

信息本身看不见、摸不着,它必须依附于一定的物 质形式(如文字、声波、电磁波等)。这种运载信 息的物质称为信息的载体,一切物质都有可能成为 信息的载体。

13

1.1.3 概率信息概念

由美国数学家香农1948年提出,亦称香农信息 基于对通信活动基本功 基于对通信活动对象和 基于对通信活动的机制 或狭义信息。概率信息是从 不确定性 能的观察分析,“通信 过程的分析研究,“信 和本质的分析研究, (Uncertainty) 和概率测度出发定义信息的。 的基本问题是在信宿端 源发出的消息总是从可 “人类只有在两种情况 香农针对人类通信活动的特点,提出了 精确或近似地复制发送 能发生的消息符号集合 下有通信的需求, 1)自 端所挑选的消息。通常 中随机选择,通信系统 己有某种形式的消息要 ① 形式化假说 消息是有语义的,即它 无法预先知道信源在什 告诉对方,且估计对方 ② 非决定论 按某种关系与某些物质 么时候会选择什么消息 不知道; 2)自己有某种 ③ 不确定性 概念的实体联系着。通 发送”,即具有通信意 疑问需要对方给出解答” 信中语义方面的问题与 义的消息都是随机发生 经过通信活动后,消除 工程问题没有关系” 的 了 随机事件,获取了信 不确定性

信息论与编码重点

信息论是在信息可以度量的基础上,对如何有效、可靠地传递信息进行讲究的科学,它设计信息度量、信息特性、信息传输率、信道容量、干扰对信息传输的影响等方面的知识。

信息是各种事物运动的状态状态变化方式。

信息是抽象的意识,它是看不见摸不到的。

消息是具体的,它载荷信息,但他不是物理性的。

信号是消息的物理体现。

信号是信息的载体在通信系统中,传送的本质内容是信息,发送端需将信息表示称具体的消息,再将消息载至信号上,才能在实际的信号系统中传输。

一般来说,通信系统的性能指标主要是有效性、可靠性、安全性、经济性。

符号的不确定度在数量上等于它的自信息量,两者的单位相同,但含义却不相同。

不确定度是信号源符号固有的,不管符号是否发出,而自信息量是信源符号发出后给予收信者的。

为了消除该符号的不确定度,接受者需要获得信息量。

冗余度来自两个方面:一是信源符号的相关性,相关程度越大,则信源的实际熵越小,越趋于极限熵H∞(X);反之,相关程度越小,信源实际熵就增大。

二是信源符号分布的不均匀性,当等概率分布时,信源熵最大。

根据信道中所受噪声种类的不同,可分为随机差错信道和突发差信道。

在随机差错信道中,噪声随机独立地影响每个传输码元,如以高斯白噪声为主体的信道;另一类噪声干扰的影响则是前后相关的,错误成串出现,这样的信道称为突发差错信道。

信道中平均每个符号所能传送的信息量定义为信道的信息传输率R ,即R=I(X;Y)=H(X)—H(X/Y)bit/符号。

信道容量C=max I (X;Y) ,max下面有p( ai )信源发出的消息一般要通过信道来传输,因此要求信源的传输与信道的输入匹配。

(1)符号匹配:信源输入的符号必须是信道能够传送的符号,即要求信源符号集就是信号的入口符号集或入口符号集的子集,这是实现信息传输的必要条件,可在信源与信道之间加入编码器予以实现,也可以在信源压缩编码时一步完成。

(2)信息匹配:对于某一信道,只有当输入符号的概率分布p(x)满足以定条件时才能达到其信道容量C,也就是说只有特定的信源才能使某一信道的信息传输率到达最大。

信息论与编码复习

信息论与编码复习

去年考点(部分):

简答题:香农第一定理P106、香农第二定理P141

计算题:马尔可夫信源P37、香农编码P110、霍夫曼编码P111、费诺编码P115、平均错误概率P131(例6.3)、例5.10。

重点:

第二章:本章为基础性内容,主要是理解专业词语的含义,记住公式,可参考笔记。

第三章:

重点3.3节,特别是马尔可夫信源P37~P40,会画状态转移图,会求状态转移概率矩阵(例3.5 P38、例3.6 P40)。

第四章:

各种信道容量的计算P58(例4.1、4.2、4.3)、离散对称信道的判别和信道容量计算P61~P64。

第五章:

定长码、码的分类P91、定长码及定长编码定理P94、编码效率P97、Kraft和McMillan不等式、唯一可译码存在条件P100、编码效率及剩余度P108、变长码编码(例 5.5 P108、例5.6 P110、例5.7 P112、例5.8 P115、例5.9 P116)。

第六章:

最大后验概率译码准则、极大似然译码规则P131、平均错误概率P131(例6.3 P131)、编码效率P150、线性分组码P150(例6.6 、6.7、6.8 P154、例5.10 P161)。

00893市场信息学复习重点4.5

00893市场信息学复习重点第一章1.信息:信息是已被处理成某种形式的数据,这种形式对接受信息者具有意义,并在当前或未来的行动和决策中,具有实际的和可觉察到的价值。

2.数据:即信息的原始材料,其定义是许多非随机的符号组,它们代表数量、行动和客体等。

3.信息时空膨胀规律:信息在空间和时间上都是无限的,随着时间的推进和社会的发展,信息量的增长越来越快。

当前人们已经进入纳米的世界,在时间上越来越浓缩;而在空间上,人类利用“哈勃”太空望远镜可以获得数千万光年远的星体的信息。

4.信息的量:就是信息的多少问题,它是用不确定性的减少来度量的。

5.信息的生命期:是指按需求和目标获取信息、对信息加工处理、信息服务直到信息衰退的整个过程。

信息的生命期包括识别、收集、传递、存储、加工和维护使用六个生命阶段。

6.香农第二编码定理:在有噪声的信道上传输信息的时候,可以对所传输的信息进行适当的编码,只要所传输的信息速率不超过信道的容量,只要编码足够复杂(即编码长度足够长),那么,就总可以找到一种编码方法,使信息传输的差错率无限地逼近于零,而且同时保证信息传输的效率无限逼近于它的极限(即,单位时间所传输的信息量无限逼近于信道的容量)。

但是,如果信息的传输速度超过了信道的容量,上述的结论就不再成立。

7.香农第三编码定理:在信号的输出速率不低于信息率一失真函数值的限制下,可对信号无失真地压缩编码。

8.信息加工:通常人们把信息的生命周期中除了“信息识别”和“信息使用”头尾两阶段外的所有其他信息过程,统称为信息处理或信息加工过程。

9.信息维护:保持信息处于适合使用的状态称为信息维护,狭义上说它包括经常更新存储介质中数据,使其保持正常状态。

广义上说它包括信息系统建成后的全部数据管理工作。

10.再生信息:在决策活动过程中根据决策问题的需要收集有关的信息,对信息进行必要的加工和处理,从而产生出能够使决策者有最大获益的策略信息。

其中产生策略信息这一节称为再生信息的过程。

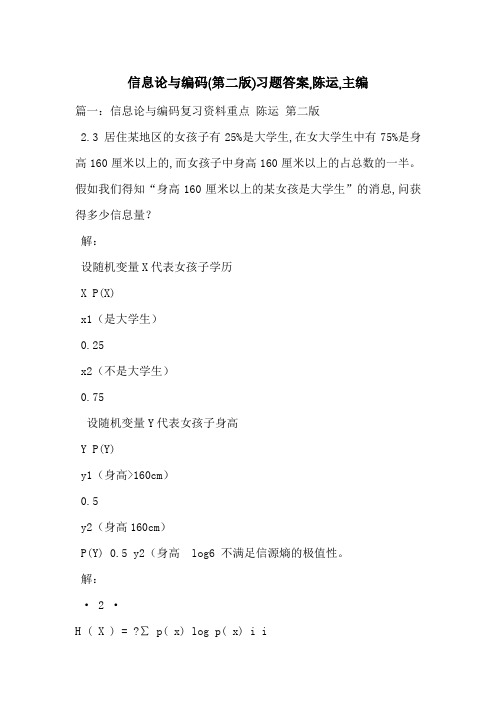

信息论与编码(第二版)习题答案,陈运,主编

信息论与编码(第二版)习题答案,陈运,主编篇一:信息论与编码复习资料重点陈运第二版 2.3 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。

假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量?解:设随机变量X代表女孩子学历 X P(X) x1(是大学生) 0.25 x2(不是大学生) 0.75 设随机变量Y代表女孩子身高 Y P(Y) y1(身高 160cm) 0.5 y2(身高 160cm) 0.5 已知:在女大学生中有75%是身高160厘米以上的即:p(y1/x1)?0.75 bit 求:身高160厘米以上的某女孩是大学生的信息量即:I(x1/y1)??logp(x1/y1)??log p(x1)p(y1/x1) p(y1) ??log 0.25?0.75 0.5 ?1.415 bit 2.4 设离散无记忆信源? ??x1?0??? ?P(X)??3/8? X x2?1x3?21/4 1/4 x4?3? ?,其发出的信息1/8? 为(202120130213001203210110321010021032011223210),求 (1) 此消息的自信息量是多少? (2) 此消息中平均每符号携带的信息量是多少?解: (1) 此消息总共有14个0、13个1、12个2、6个3,因此此消息发出的概率是: ?3?p??? ?8?14 ?1?????4? 25 ?1???? ?8? 6 此消息的信息量是:I??logp?87.811 bit (2) 此消息中平均每符号携带的信息量是:I/n?87.811/45?1.951 bit 2.5 从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%,如果你问一位男士:“你是否是色盲?”他的回答可能是“是”,可能是“否”,问这两个回答中各含多少信息量,平均每个回答中含有多少信息量?如果问一位女士,则中含有的平均自信息量是多少?解:男士:p(xY)?7% I(xY)??logp(xY)??log0.07?3.837 bitp(xN)?93% I(xN)??logp(xN)??log0.93?0.105 bit 2 H(X)???p(xi)logp(xi)??(0.07log0.07?0.93log0.93)?0.366 bit/symbol i 女士: 2 H(X)???p(xi)logp(xi)??(0.005log0.005?0.995log0.995)?0.045 bit/symbol i 2.7 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息;(2) “两个1同时出现”这事件的自信息; (3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, ? , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码重点

信息论是在信息可以度量的基础上,对如何有效、可靠地传递信息进行讲究的科学,它设计信息度量、信息特性、信息传输率、信道容量、干扰对信息传输的影响等方面的知识。

信息是各种事物运动的状态状态变化方式。

信息是抽象的意识,它是看不见摸不到的。

消息是具体的,它载荷信息,但他不是物理性的。

信号是消息的物理体现。

信号是信息的载体在通信系统中,传送的本质内容是信息,发送端需将信息表示称具体的消息,再将消息载至信号上,才能在实际的信号系统中传输。

一般来说,通信系统的性能指标主要是有效性、可靠性、安全性、经济性。

符号的不确定度在数量上等于它的自信息量,两者的单位相同,但含义却不相同。

不确定度是信号源符号固有的,不管符号是否发出,而自信息量是信源符号发出后给予收信者的。

为了消除该符号的不确定度,接受者需要获得信息量。

冗余度来自两个方面:一是信源符号的相关性,相关程度越大,则信源的实际熵越小,越趋于极限熵H∞(X);反之,相关程度越小,信源实际熵就增大。

二是信源符号分布的不均匀性,当等概率分布时,信源熵最大。

根据信道中所受噪声种类的不同,可分为随机差错信道和突发差信道。

在随机差错信道中,噪声随机独立地影响每个传输码元,如以高斯白噪声为主体的信道;另一类噪声干扰的影响则是前后相关的,错误成串出现,这样的信道称为突发差错信道。

信道中平均每个符号所能传送的信息量定义为信道的信息传输率R ,即R=I(X;Y)=H(X)—H(X/Y)bit/符号。

信道容量C=max I (X;Y) ,max下面有p( ai )信源发出的消息一般要通过信道来传输,因此要求信源的传输与信道的输入匹配。

(1)符号匹配:信源输入的符号必须是信道能够传送的符号,即要求信源符号集就是信号的入口符号集或入口符号集的子集,这是实现信息传输的必要条件,可在信源与信道之间加入编码器予以实现,也可以在信源压缩编码时一步完成。

(2)信息匹配:对于某一信道,只有当输入符号的概率分布p(x)满足以定条件时才能达到其信道容量C,也就是说只有特定的信源才能使某一信道的信息传输率到达最大。

信息论重要概念

1. Shannon 信息论研究的核心问题?出发点?重点研究内容? 研究的核心问题:主要是围绕通信的有效性和可靠性而展开的 出发点:收、发两端的联合优化 重点研究内容:各种编码 2.自信息量 I(xi)的定义及其合理性。 I ( x i ) lb

I ( X; Y) P( y j ) I ( X; y j ) P ( y j ) P( xi | y j )lb

j 1 i 1 j 1

M

N

M

P ( xi | y j ) P ( xi )

H (X) H (X) b 1 。 lbD lbD

P( xy )lb

XY

H(XY) = H(X)+H(Y); H(XY) = H(Y) + H(X|Y)

H(XY) = H(X) + H(Y|X) 3. I (X; Y) 0, 当且仅当 X、Y 互相独立时, 等号成立。 H(X/Y)表征了对接收的每一个符号的正确性所产生怀疑的程度,故条件熵 H(X/Y)又称之为疑义度。 条件熵 H (Y/X)是由于信道的干扰或噪声给出的,因此它是唯一地确定信道噪声和干扰所需的平均信息量,故称之为 噪声熵,也称为散布度。 2. 请给出熵的链接准则和信息链接准则。 1) 、H(X1, X2,…, Xn)= H(X1) + H(X2| X1) +H(X3| X2, X1)+ … + H(Xn|Xn–1, Xn–2,…, X2, X1) =

信息论 原理

信息论原理

信息论是一种研究信息传输和处理的数学理论。

它由克劳德·香农于20世纪40年代提出,被广泛应用于通信、计算机科学和统计学等领域。

信息论的核心概念是信息熵。

熵是表示随机变量不确定性的度量,也可以理解为平均信息的度量。

信息熵越大,表示平均信息越多,不确定性也越大。

通过信息熵的定义,我们可以得到一个重要的定理——香农编码定理。

该定理指出,对于一个离散无记忆信源,它的信息熵可以通过最优编码方式达到最小。

最优编码方式即一种编码方法,能够使得编码的平均长度达到信息熵的下界。

这意味着,我们可以使用更短的编码来传输信息,从而提高信息传输的效率。

除了信息熵和编码定理,信息论还引入了其他重要的概念。

其中之一是互信息,用来度量两个随机变量之间的相关性。

互信息越大,表示两个变量之间的相关性越强,反之亦然。

信息熵和互信息等概念在数据压缩、信道编码和错误纠正码等通信领域的研究中得到了广泛应用。

通过理解和运用信息论的原理,人们可以设计出更高效、可靠的通信系统,提高信息传输的质量和效率。

总之,信息论是研究信息传输和处理的数学理论,通过信息熵

和互信息等概念,可以对信息的不确定性和相关性进行度量,从而提高通信和数据处理的效率和可靠性。

00353现代科学技术概论

课程名称:现代科学技术概论课程代码:00353第一部分课程性质与目标一、课程性质与特点现代科学技术概论课程是湖北省高等教育自学考试本科英语专业(二)的免考加试课程。

是为培养自学应考者的科学素养和检验自学应考者对现代科学技术的基本知识和发展状况掌握情况的一门基础课程。

现代科学技术概论具有全面性、历史性和时代性。

该课程总结科学史上的重大事件,严格遵循历史的逻辑,全面清晰地梳理出科学进步的历史线索,并把科学作为社会进步的源头和先导,着力于探讨科学革命——技术革命——产业革命的承递关系,揭示科学发现和突破是技术创新的动力源的思想,同时结合现实揭示科技进步的双面效应。

二、课程目标与基本要求本课程的目标是使自考者掌握现代科学的基本知识,认清中国科技发展面临的严峻形势,增强科学精神和方法论意识,提高科学素养,扩大创新能力。

基本要求是能够掌握科学技术发展的历史框架和科学史上的重大历史事件,掌握现代科学和技术各门学科的基础理论和知识,形成正确的科学技术观念。

三、与本专业其他课程的关系本课程在专业课构成中为基础课程。

无先期课程。

第二部分考核内容与考核目标绪论科学技术的含义、结构和功能一、学习目的与要求通过本章的学习了解科学技术的分类和整体结构,理解科学和技术的含义,明确科学技术的社会功能,形成对科学技术的总体认识。

二、考核知识点与考核目标(一)科学技术的含义(重点)识记:(1)科学的定义(2)技术的定义理解:(1)科学定义的四层含义(2)技术的属性(3)科学和技术的关系(二)科学技术的结构体系(次重点)识记:(1)研究的类型(2)科学的分类(3)技术的分类理解:(1)现代科学技术整体结构的特性(2)科学技术发育的三个阶段(三)科学技术的社会功能(次重点)识记:科学技术的社会功能理解:(1)科学技术的认识功能的表现(2)科学技术社会变革功能的实现途径第一章古代科学技术一、学习目的与要求通过本章的学习了解古代科学技术知识发展萌芽以及中国、古希腊罗马和古阿拉伯的科学技术发展状况,理解中国、古希腊罗马科学技术发展的背景及其为近代科学所作的思想理论和物质技术上的准备,明确古阿拉伯的科学技术知识在科技史上的地位。

信息论基础课件chp2

定度的差

观察者站在通信系统总体立场上

通信前:输入随机变量X和输出随机变量Y之间没有任何关 联关系,即X与Y统计独立:p(xi yj)=p(xi)p(yj) 先验不确定度 I'(xiyj)lo2gp(xi)1p(yj)

通信后:输入随机变量X和输出随机变量Y之间由信道的统 计特性相联系,其联合概率密度: p(xi yj)=p(xi)p(yj /xi )= p(yj)p(xi / yj) 后验不确定度

(4)两个独立事件的联合信息量应等于它们分别的信息量 之和。

根据上述条件可以从数学上证明这种函数形式是对数形式。

定义2.1 随机事件的自信息量定义为该事件发生概

率的对数的负值。设事件x i 的概率为 p ( xi ),则它的

自信息定义为

I(xi)deflogp(xi)logp(1xi)

当统计独立时,表明xi和yj之间不存在统计约束关系,从yj 得不到关于的xi任何信息,反之亦然。

I(xiyj)lo2g p(xi)1 p(yj)lo2g p(x1 iyj)0

互信息量可为正值或负值

当后验概率大于先验概率时,互信息量为正

当后验概率小于先验概率时,互信息量为负

当后验概率与先验概率相等时,互信息量为零。这就是 两个随机事件相互独立的情况。

解:(1) I(a)log20.0643.96bit I(c)log20.0225.51 bit

( 2 ) I ( a c ) l o g 2 0 . 0 6 4 0 . 0 2 2 3 . 9 6 5 . 5 1 9 . 4 7 b i t

( 3 )I( c |a ) lo g 2 0 .0 4 4 .6 4 b it

信息技术复习重点

信息技术复习重点第一章信息、信息科学与信息技术1.1探索信息的真谛1.1.1信息1.什么是信息就一般意义而言,信息可以理解成消息、情报、知识、见闻、通知、报告、事实、数据等等。

信息的传播过程是???1.1.3香农对信息的定义香农认为:信息是有秩序的量度,是人们对事物了解的不确定性的消除或减少。

信息是对组织程度的一种测度,信息能使物质系统有序性增强,减少破坏、混乱和噪音。

香农提出:信息的传播过程是“信源”把要提供的信息经过“信道”传递给“信宿”,信宿接收这些经过“译码”的信息符号的过程。

信道是在物理线路上划分的逻辑通道。

在香农确定信息量名称时,将热力学中的“熵”的概念应用到信息领域。

一个系统的熵就是它的无组织程度的度量。

香农是现代信息论的创始人香农信息论的局限性:主要是由于狭义信息论没有解决信息的语义问题和有效性问题。

1.1.6 数据、消息、信号与信息的区别1.数据数据是对客观实体的一种描述形式,是信息的载体。

信息和数据的区别可以理解为:数据是未加工的信息,而信息是数据经过加工以后的能为某个目的使用的数据,信息是数据的内容或诠释。

数据可分为模拟数据和数字数据两种形式。

2.消息信息论的先驱哈特莱认为信息是包含在消息中的抽象量,消息是具体的,其中蕴含着信息。

按照香农理论,在通信过程中,信息总是经过编码(符号化)成为消息以后,才能经由媒介传播的,而信息的接收者收到信息后,总是要经过译码(解读)才能获取其中的信息的。

3.信号把消息变换成适合信道传输的物理量,这种物理量称为信号。

信号是数据的电磁或光脉冲编码。

信号可以分为模拟信号和数字信号。

1.2信息科学1.2.1 信息科学的产生与定义信息和控制是信息科学的基础和核心。

什么是信息科学:信息科学以香农创立的信息论为理论基础,以现代科学方法论作为主要研究方法、以研究信息及其运动规律为主要内容、以扩展人的信息功能作为主要研究目标的一门科学。

信息科学是以信息为基本研究对象,以信息的运动规律和应用方法为主要研究内容,这是信息科学有别于一切传统科学最基本的特征。

信息论与编码第1章

第一章绪论(第一讲)(2课时)主要内容:(1)教学目标(2)教学计划(3)参考书(4)考试问题(5)信息论的基本概念(6)信息论发展简史和现状(7)通信系统的基本模型重点:通信系统的基本模型难点:通信系统的基本模型特别提示:运用说明:本堂课作为整本书的开篇,要交待清楚课程开设的目的,研究的内容,对学习的要求;在讲解过程中要注意结合一些具体的应用实例,避免空洞地叙述,以此激发同学的学习兴趣,适当地加入课堂提问,加强同学的学习主动性。

信息论与编码(Informatic s & Coding)开场白教学目标:本课程主要讲解香农信息论的基本理论、基本概念和基本方法,以及编码的理论和实现原理。

介绍信息的统计度量,离散信源,离散信道和信道容量;然后介绍无失真信源编码、有噪信道编码,以及限失真信源编码等,然后介绍信道编码理论,最后也简单介绍了密码学的一些知识。

教学重点:信息度量、无失真信源编码、限失真信源编码、信道编码的基本理论及实现原理。

教学计划:信息论:约20学时信道编码:约19学时*密码学:约8学时参考书:1.信息论与编码,曹雪虹张宗橙编,北京邮电大学出版社,20012.信息论—基础理论与应用,傅祖芸编著,电子工业出版社,20013.信息理论与编码,姜丹钱玉美编著4.信息论与编码,吴伯修归绍升祝宗泰俞槐铨编著,1987考试问题:第一章绪论信息论的基本概念信息论发展简史和现状通信系统的基本模型§1.1 信息论的基本概念信息论是一门应用近代数理统计方法来研究信息的传输和处理的科学。

在涉及这门课程的具体内容之前,很有必要在引言中,首先放宽视野,从一般意义上描述、阐明信息的基本含意。

然后,再把眼光收缩到信息论的特定的研究范围中,指明信息论的假设前提,和解决问题的基本思路。

这样,就有可能帮助读者,在学习、研究这门课程之前,建立起一个正确的思维方式,有一个正确的思路,以便深刻理解、准确把握以下各章节的具体内容。

信息论与编码(第二版)习题答案,陈运,主编-最新范文

信息论与编码(第二版)习题答案,陈运,主编篇一:信息论与编码复习资料重点陈运第二版2.3 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。

假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量?解:设随机变量X代表女孩子学历X P(X)x1(是大学生)0.25x2(不是大学生)0.75设随机变量Y代表女孩子身高Y P(Y)y1(身高>160cm)0.5y2(身高160cm)P(Y) 0.5 y2(身高 log6 不满足信源熵的极值性。

解:· 2 ·H ( X ) = ?∑ p( x) log p( x) i ii 6= ?(0.2 log 0.2 + 0.19 log 0.19 + 0.18 log 0.18 + 0.17 log 0.17 + 0.16 log 0.16 + 0.17 log 0.17)= 2.657 bit / symbolH ( X ) > log 2 6 = 2.585不满足极值性的原因是∑6 p( xi ) = 1.07 > 1 。

i2.7 证明:H(X3/X1X2) ≤ H(X3/X1),并说明当X1, X2, X3是马氏链时等式成立。

证明:H ( X 3 / X1 X 2 ) ? H ( X 3 / X1 )= ?∑∑∑ p( xi1 xi 2 xi 3 ) log p( xi 3 / xi1 xi 2 ) + ∑∑ p( xi1 xi 3 ) log p( xi 3 / xi1 )i1 i 2 i 3 i1 i 3= ?∑∑∑ p( xi1 xi 2 xi 3 ) log p( xi 3 / xi1 xi 2 ) + ∑∑∑ p( xi1 xi 2 xi 3 ) log p( xi 3 / xi1 )i1 i 2 i 3 i1 i 2 i 3=p( x x x ) p( xi 3 / xi1 )∑∑i1i 2i 3∑i1 i 2 i 3 p( xi 3 / xi1 xi 2 )≤ ∑∑p( x ? p( xi1xi 3 / xi1 ) ?i 2xi 3 )??1? log2 e∑i1 i 2 i 3 ?? p( xi3 / x i1x i 2 ) ???? ∑∑∑1 i 2 i 3 p( x? = ?i1 xi 2 ) p( xi 3 / xi1 ) ? ∑∑∑ p( xi1 xi 2 xi 3 ) ? log2 ei i1 i 2 i 3 ?= ???∑∑ p( x? ? ?i1 xi 2 )i1 i 2?∑ p( xi 3 / xi1 )? ? ??1? log2 ei 3 ?= 0∴ H ( X3 / X1 X 2 ) ≤ H ( X 3 / X1 )当p( xi 3 / xi1 )p( x?1 = 0时等式等等i 3 / xi1 xi 2 )? p( xi 3 / xi1 ) = p( xi 3 / xi1 xi 2 )? p( xi1 xi 2 ) p( xi 3 / xi1 ) = p( xi 3 / xi1 xi 2 ) p( xi1 xi 2 )? p( xi1 ) p( xi 2 / xi1 ) p( xi 3 / xi1 ) = p( xi1 xi 2 xi3 )? p( xi 2 / xi1 ) p( xi 3 / xi1 ) = p( xi 2 xi 3 / xi1 )∴等式等等的等等是X1 , X 2 , X 3是马 _氏链2.8 证明:H(X1X2 。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1.消息定义信息的通俗概念:消息就是信息,用文字、符号、数据、语言、音符、图片、图像等能够被人们感觉器官所感知的形式,把客观物质运动和主观思维活动的状态表达出来,就成为消息,消息中包含信息,消息是信息的载体。

信号是表示消息的物理量,包括电信号、光信号等。

信号中携带着消息,信号是消息的载体。

信息的狭义概念(香农信息):信息是对事物运动状态或存在方式的不确定性的描述。

信息的广义概念 信息是认识主体(人、生物、机器)所感受的和表达的事物运动的状态和运动状态变化的方式。

➢ 语法信息(语法信息是指信息存在和运动的状态与方式。

) ➢ 语义信息(语义信息是指信宿接收和理解的信息的内容。

) ➢ 语用信息(语用信息是指信息内容对信宿的有用性。

)2.狭义信息论、广义信息论。

狭义信息论:信息论是在信息可以量度的基础上,对如何有效,可靠地传递信息进行研究的科学。

它涉及信息量度,信息特性,信息传输速率,信道容量,干扰对信息传输的影响等方面的知识。

广义信息论:信息是物质的普遍属性,所谓物质系统的信息是指它所属的物理系统在同一切其他物质系统全面相互作用(或联系)过程中,以质、能和波动的形式所呈现的结构、状态和历史。

包含通信的全部统计问题的研究,除了香农信息论之外,还包括信号设计,噪声理论,信号的检测与估值等。

3.自信息 互信息 定义 性质及物理意义 自信息量: ()log ()i x i I x P x =-是无量纲的,一般根据对数的底来定义单位:当对数底为2时,自信息量的单位为比特;对数底为e 时,其单位为奈特;对数底为10时,其单位为哈特自信息量性质:I(x i )是随机量;I(x i )是非负值;I(x i )是P(x i )的单调递减函数。

自信息物理意义: 1.事件发生前描述该事件发生的不确定性的大小 2.事件发生后表示该事件所含有(提供)的信息量 互信息量:互信息量的性质:1) 互信息的对称性2) 互信息可为零3) 互信息可为正值或负值4) 任何两个事件之间的互信息不可能大于其中任一事件的自信息互信息物理意义: 1.表示事件 yj 出现前后关于事件xi 的不确定性减少的量 2.事件 yj 出现以后信宿获得的关于事件 xi 的信息量4.平均自信息性质 平均互信息性质平均自信息(信息熵/信源熵/香农熵/无条件熵/熵函数/熵):(;)()(|)i j i i j I x y I x I x y =-log ()log (|)(1,2,,;1,2,,)i i jp x p x y i n j m =-+=⋯=⋯(|)log ()i j i p x y p x =1()[()][log ()]()log ()ni i i i i H X E I x E p x p x p x ===-=-∑熵函数的数学特性包括:(1)对称性 p =(p1p2…pn)各分量次序可调换 (2)确定性p 中只要有为1的分量,H(p )为0(3)非负性离散信源的熵满足非负性,而连续信源的熵可能为负。

H(p )大于等于0 (4)扩展性扩展性说明,增加一个概率接近于零的事件,信源熵保持不变。

虽然小概率事件出现后,给予收信者较多的信息,但从总体来考虑时,因为这种概率很小的事件几乎不会出现,所以它对于离散集的熵的贡献可以忽略不计。

这也是熵的总体平均性的一种体现。

(5)连续性 (6)递增性(7)极值性(最大离散熵定理) (8)上凸性H(p1,p2…,pn)是概率分布(p1,p2…,pn)的严格上凸函数,即 詹森不等式:如果f 为一个上凸函数,X 为一个随机变量,则:平均互信息I (X ;Y )=H (X )-H (X|Y ) =H (Y )-H (Y|X )=H (X )+H (Y )-H (XY )性质1.对称性:I (X ;Y )=I (Y ;X )2.非负性I (X ;Y )>03.极值性I (X ;Y ) ≤ min{H (X ),H (Y )}5.条件熵 联合熵随机变量X 和Y 的条件熵定义为:条件熵表示已知一个随机变量时,对另一个随机变量的平均不确定性。

条件熵: 疑义度:噪声熵:联合熵:联合熵表示对于二维随机变量的平均不确定性。

12111(,,...,)(,,...,)log n H p p p H nn n n≤=[](1)'()(1)(')H H H αααα+->+-p p p p ∑∑-=i j i j j i y x p y x p Y X H )|(log )()|(∑∑-=i i j jj i x y p y x p X Y H )|(log )()|([](|)i E H Y x =各种熵之间的关系• H (XY )=H (X )+H (Y|X )=H (Y )+H (X|Y ) • H (X|Y )≤H (X ),H (Y|X )≤H (Y )• H (XY )≤H (X )+H (Y )若X 与Y 统计独立,则H (XY )=H (X )+H (Y )6.信源概率空间通常把一个随机变量的样本空间和样本空间中的元素对应的概率称为概率空间。

离散单符号信源X 的概率空间:离散多符号信源可以用随机矢量/随机变量序列来描述,即 X=X1X2LXnL其中每个符号取值于同一个单符号信源空间:7.信源熵 信源熵:信息熵表示离散单符号信源的平均不确定性 信源熵具有以下三种物理含意:– 信息熵H(X)表示信源输出后,每个离散消息所提供的平均信息量。

– 信息熵H(X)表示信源输出前,信源的平均不确定性。

– 信息熵H(X)反映了变量X 的随机性8.多符号与条件熵的关系1.条件熵随着N 的增加是递减的2.N 给定时 平均符号熵>=条件熵)...|()(11-→≥N N N X X X H X H 3.平均符号熵随N 的增加而减小4.若H (X1)<∞ 则)...|(lim )(lim 11-∞→∞→∞==N N N N N X X X H X H HN 次扩展信源的熵:离散平稳无记忆信源的N 次扩展信源的熵等于离散单符号信源熵的N 倍:离散平稳无记忆信源的熵率:9.连续信源熵1()[()][log ()]()log ()ni i i i i H X E I x E p x p x p x ===-=-∑1212...()()()...()q q x x x X P X p x p x p x ⎡⎤⎡⎤=⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦()0i p x ≥1()1ni i p x ==∑12:{,,,}q X x x x 1()()()log ()NqNi i i H H X p p ===-αα∑X ()()()NH H X NH X ==X 1lim ()lim ()()N N N H H NH X H X N∞→∞→∞==⋅=X单变量连续信源的数学模型a x b ()()X P X p x ≤≤⎡⎤⎧⎫=⎨⎬⎢⎥⎣⎦⎩⎭定义连续信源的相对熵:()()()bc aH X p x lbp x dx =-⎰。

相对熵不能反映连续信源的平均不确定度。

定义相对熵的目的在于在形式上与离散信源熵统一并使熵差具有信息测度的意义。

两个连续随机变量的联合熵:2()()()c R H XY p xy lbp xy dxdy =-⎰⎰两个连续随机变量的条件熵:2(/)()(/)c R H X Y p xy lbp x y dxdy =-⎰⎰均匀分布连续信源的相对熵:1(),p x a x b b a=≤≤-,()()c H X lb b a =- Ps :(lb 是log ) 高斯分布连续信源的相对熵:22()221(),2x m p x ex σπσ--=-∞<<∞,2211()2(2)22c H X lbe lb lb e πσπσ=+=Ps :(lb 是log )当均值为0时,微分熵只与平均功率有关指数分布连续信源的相对熵:1() ,0xmp x e x m-=≤<∞,()()c H X lbe lbm lb em =+=m 为均值 Ps (lb 是ln )微分熵10.马尔科夫信源如果离散平稳信源发出的符号只与前面已经发出的m(<N)个符号相关,则称该信源为m 阶马尔科夫信源。

可将m 阶马尔科夫信源发出的符号序列看成长度为m+1的一段段符号序列,m 阶马尔科夫信源的数学模型:111211212112/()()()(/)m m m m n m m n a a a X X X X p a p a p a P X X X X ++++⎧⎫⎡⎤=⎨⎬⎢⎥⎣⎦⎩⎭112112/()(/)m m m m i i i i i i i i i i a x x x x p a p x x x x ++==其中,,为强调m 阶马尔科夫信源的长度特征,一般将其极限熵H ∞记为H m+1,即:111()(/)(/)m mn n m i j i j i i j H H p e p e e lbp e e ∞+====-∑∑马尔科夫链的各态历经定理:11()()(/)1,2,,()0,()1mmn n m j i j i j j i j p e p e p e e j n p e p e ====>=∑∑,,其中11. 信道分类及转移概率矩阵 信道分类信道特性可以用转移概率矩阵来表示:12.信道容量的计算 信道容量:➢ 与信源的概率分布无关;➢ 是完全描述信道特性的参量; ➢ 是信道能够传输的最大信息量。

信道单位时间内平均传输的最大信息量: 一.按损耗分1. 无损信道:有噪无损信道,一个输入对应多个输出。

信道矩阵每一列只有一个非0元素(输入等概)2. 无噪信道:无噪有损信道,一个输出对应多个输入。

信道矩阵每一行只有一个非0元素(输出等概)111212122212.....................J J J J JJ p p p p p p p p p ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎣⎦P {}()1max (;)/t P X C I X Y t =比特秒(;)()(|)()I X Y H X H X Y H X =-=()()max (;)max ()log p x p x C I XY H X r ===()()H X H Y <⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎣⎡=1000000101103530000002121P ⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎣⎡=1010100101P (|)0H Y X =(;)()(|)()I X Y H Y H Y X H Y =-=()()max (;)max ()log p x p x C I X Y H Y s ===()()H Y H X <(|)0H X Y =3. 无噪无损信道:输入、输出之间有确定的一一对应关系。