信息的度量

信息的度量

3.1 具有概率特性的信息

以具有概率特性的反导弹知识为例, 为有效指挥控制反导作战, 对来袭导弹 的到达率搜集信息并处理, 获得所需信息(知识, 如来袭导弹到达率),以得到最有 效作战决策。广义的信息包括知识, 知识是信息的高级发展。假设导弹防御决策 所需的相对知识为在j 时间段单位时间内来袭导弹的到达比例, 需求其熵和知识 量。 设x 为在j 时间段单位时间内来袭导弹的比例,即x= h/q。 其中, h为j时间段单 位时间内来袭导弹到达的数量; q为在j - 1时间段来袭导弹的剩余量,x 为随机变 量。x 的熵H ( x )表明x 的信息量。在信息论中x 的熵(单位: 奈特)表示为:

3.2 非各态历经过程特性的信息语用学度量

非各态历经过程特性的信息语用学计量与按采样定理的采样函数值xi ( t ) 的价值和效用内容有关。设非各态历经过程特性的信息价值和效用可能性为Q (x), 则非各态历经过程特性的信息采样的语用学度量信息量为:

I lbQ x lb1

N

Qx

换算法, 计算带宽Δ f。按采样间隔h= 1 / ( 2Δf )进行采样(采样定理)。可得采样 数N = 2ΔfT。可以证明, N = 2ΔfT 是过程时间函数x ( t)最多的独立符号数。可 推算上述3种过程特性的信息采样序列中每个采样的语法信息量为:

F k

2

I - lb1

2fT lb2fT lbN

N

( 9)

其中, Rxi 1 , R (x )与Δf , T, 采样次序以及语义内容有关。非各态历经过程

i 1

特性的信息采样序列的总信息量为: I= N lb1 /R (x ) ( 10)

3.信息的语用学度量(P ragmatics measure ofinformation)

1.4 信息及其度量

I = log

P(x) = - loga

1.4 信息及其度量

二、度量信息量的方法

I = log

1 p(x) a P(x) = - loga

a=2—比特(bit);

a=e—奈特(nat);

a=10—哈特莱(Det);

1.4 信息及其度量

二、度量信息量的方法

1、离散消息

P(x ) 1)信源每个符号的自信息量;I(xi ) = - log2 i(bit)

越不可能发生的 事件,带来的信 息量越大!

例:

1.4 信息及其度量

二、度量信息量的方法

信息量是概率P(x)的函数; I=f[P(x)] P(x)越小,I越大; P(x)→1时, I→0 P(x)→0时, I→∞

若干个互相独立事件构成的消息,信息具有相加性;

I[P(x1)P(x2)…]=I[P(x1)]+I[P(x2)]+…

1.4 信息及其度量

信息是消息的内涵(有效内容,不确定性); 通信的目的:传输消息中所包含的信息; 信息量—对消息中内容的不确定性的定量描述;

1.4 信息及其度量

一、度量信息量的原则

能度量任何消息,与消息的种类无关;

度量方法与消息的重要程度无关; 消息中所含的信息量与消息中内容的不确定性有关;

I总 23I0 14I1 13I 2 7I3 108(bit)

利用熵的概念来计算: H 1.906 (b/符号)

I总 57 H 57 1 906 108.64(bit)

评注

1.4 信息及其度量

2、连续消息

1 f (x) a

信息的度量

How to measure Information?

信息论基础

本章内容

• 信息及其度量

• 平均信息量-熵

• 通过信道的平均信息量-互信息量 • 信息不增原理 • 各种信息量之间的关系 • 连续随机变量的信息度量

参考书:沈振元等,“通信系统原理”,第11章(PP412-437)

戴善荣, “信息论与编码基础”, 第2章

p ( xi , yj ) p ( xi / yj ) = p ( yj ) p ( xi , yj ) p ( yj / xi ) = p ( xi )

3 联合自信息量和条件自信息量 设输入和输出都可以用离散概率空间来表示:

X = {A, P},其中A={ai}; Y = {B, Q}, 其中B={bj}

Y y1 , y 2 , , y j , P(Y ) = p( y ), p( y ), , p( y ), 2 j 1

这里p(yj)(j=1,2,3等)是集合Y中各个消息 y1,y2 ,y3 …出现的概率。

收信者获得的信息量

当信宿接到集合Y中的一个消息符号后,接收 者重新估计关于信源的各个消息 发生的概率 就变成条件概率,这种条件概率又称为后验概 率。 收信者收到一个消息后,所获得的信息量等 于收到消息前后不确定程度的减少量。

i n n 1 1 pi) ln 2 = 0, ( n = 1, pi = 1) i =1 i =1

n 1 1 p( 1) = ( i i =1 p n ln 2 i=1 n

1

i

故有H ( x ) H 0 0,即等概时有最大熵

例

一个二进制信元X,两个符号出现的概率分别为p和1-p,

信息论——信息的度量

信息论——信息的度量信息的度量 信息具可度量性,其⼤⼩取决于信息所消除的不确定性 举例如下: 消息A:中国⼥⼦乒乓球队夺取亚运会冠军。

消息B:中国男⼦⾜球队夺取世界杯赛冠军。

从事件的描述上来看,其主题内容⼤致相同,那么我们是否可以认为事件A和事件B具有相同的信息量呢?显然是不⾏的。

根据以往经验,我们可以认为事件A是⼀个⼤概率事件,所以事件A的不确定性⽐较⼩,故当事件A发⽣时,我们从这个消息中得到的信息(消除的不确定度)很⼩。

同理对事件B⽽⾔,由于是个极⼩概率事件,我们得到的信息很⼤。

由此我们可以推断:消息B的信息量⼤于消息A。

对于⼀个事件X,我们假设其不确定性为 I(p1) ,其中 p1 是事件X的先验概率。

对应于事件X的消息X所消除的不确定性为 I(p2)。

那么在我们获取了消息X之后,事件X的不确定性就变为了 I(p1)-I(p2) ,由此我们可以知道当我们对⼀个事物的信息获取的越多,其不确定性就越⼩,当其不确定性变为0时,该事件就被确定下来了,我们对其⽆法再获取更多的信息量了。

直观定义: 收到某消息获取的信息量=不确定性减少量=收到该消息前后某事件的不确定性差信息量的数学表⽰ 理论依据(信息量具有的性质): 1.⾮负性对于⼀个事件⽽⾔,当事件被完全确定时,即我们⽆法获取更多信息时,其信息量为0,因此⽆法⽐0更⼩。

2.单调性是先验概率的单调递减函数,即某事件的发⽣概率越⼤,其信息量就越⼩。

3.对于事件A 若 P(a)=0 则 I(Pa)=+∞ 若 P(a)=1 则 I(Pa)=0。

4.两个独⽴事件的联合信息量应等于它们分别的信息量之和。

I(xi)具有两个含义: 1.事件发⽣前,表⽰该事件发⽣的不确定性。

2.事件发⽣后,表⽰该事件所提供的信息量。

术语解释 先验概率(prior probability)是指根据以往经验和分析得到的概率。

信息量的度量

信息量的计算

接着可以计算系统B所包含的关于系统A即篮球 水平高的信息量,由公式可知:

可以计算系统B所包含的关于系统A篮球水平不高 的信息量,由公式可知:

6

信息量的计算

一分球(B1)关于篮球水平(A)的信息量为:

二分球(B2)关于篮球水平(A)的信息量为:

三分球(B3)关于篮球水平(A)的信息量为:

再通过调用函数fft(y);psd(y);rcep (y)对该振动信号进行频域内的性能分析。

12

幅度

振动信号的时域波形

振动信号的时域波形 8 6 4 2 0 -2 -4 -6 -8

0 0.2 0.4 0.6 0.8 1 1.2 1.4 1.6 1.8 2 时 间 /秒

从拟合的时域波形图中可以看到振动波形有逐 渐衰减的趋势。

14

振动信号的功率谱

振动信号的功率谱 40

30

Power Spectrum Magnitude (dB)

20

10

0

-10

-20

-30 0

50 100 150 200 250 300 350 400 450 500

Frequency

功率谱的意义在于它可以对信号中的周期成分进行分

析,上图绘制的是具有95%置信区间的功率谱密度,由上

图可知系统中存在着100Hz和250Hz的周期成分,若是在

实际的系统中可以根据周期成分结合故障的特征频率来确

定故障的类型。

15

振动信号的倒谱

振动信号的倒谱 3

2.5

2

1.5

幅 度 /dB

1

0.5

0

-0.5

0

500

1000

1500

第1章 基本概念6(信息的度量和香浓公式)

1.8 多路复用

波分复用WDM

光通信中的复用技术,原理同FDM

24

1.8 多路复用

图1-19 三种复用示意图

时间 1 23 4

FD M

频率

时间

4

3 2 1

TD M

频率

时间

1234

CDM 频 率

码型

25

1.10 通信系统的性能评价

主要性能指标

有效性 可靠性

27

模拟通信系统的主要性能指标

17

1.8 多路复用

物理信道与逻辑信道

物理信道:指信号通过的通信设备和传 输介质。

逻辑信道:一个物理信道中传输一路信 号的通道。如一个频段、一个时隙等。

18

1.8 多路复用

多路复用的概念

多路复用:在一个物理信道中,利用特 殊技术传输多路信号,即在一条物理信 道中产生多条逻辑信道。

… …

n路 信号 输入

复 用

解 复 一 条物 理 信 道 用

n个 逻 辑 信 道

图1―18 多路复用示意图

n路 信号 输出

19

1.8 多路复用

频分复用FDM

通过调制技术将多路信号分别调制到频 谱互不重叠的频带上,同时传输的一种 多路复用方式。

信号时间上重叠,频谱互不重叠

20

1.8 多路复用

时分复用TDM

通过脉冲调制等技术将多路信号分时在 信道上传输的一种多路复用方式。

香农公式

C Blb(1 S ) (bit/s) N

式中,C 为信道容量(bit / s或b/s) B 为信道带宽(Hz) S/N 是系统的输出信噪比

11

1.7 信息量与香农公式

例子

若一帧电视图像的信息量为99600bit, 电视的帧频为30Hz,为使接收端收到良 好的图像,要求信道的信噪比S/N=1000, 10lgS/N=30dB,求信道的带宽B。

第1章 信源模型及信息的度量

6

二元联合信源

有两个信源X,Y

, an a2 , X a1 , P ( x) P (a ), P (a ), , P (a ) n 1 2

, bm b2 , Y b1 , P ( y ) P (b ), P (b ), , P(b ) 1 m 2

, aq a2 , X a1, P ( x) P (a ), P (a ), , P (a ) q 1 2

例:

a2 a1 P ( ) 0.01 0.99

b1 b2 P ( ) 0 .4 0 .6

可பைடு நூலகம்性公理:

两个消息独立,则 I (ai , b j ) I (ai ) I (b j ) 对同一条消息,观察两次所得到的信息量等 于两次分别收到的信息量之和

I (ai ; b j ck ) I (ai ; b j ) I (ai ; ck / b j )

例题

说明信息论在我们日常生活中的指导意义

P(X): p

1. p=0.5时; H(X)=-0.5log0.5+(-0.5log0.5)=1 bit/符号 2. p=0.99,1-p=0.01时;

H(X)=-0.99log0.99+(-0.01 log0.01)=0 .08bit/符号

3. p=0,1-p=1(或p=1,1-p=0)时; H(X)=-0log0+(-1 log1)=0 bit/符号

XY——样本值共有 m n 个

p ( x i y j ) p ( y j ) p ( xi / y j ) p ( x i ) p ( y j / x i )

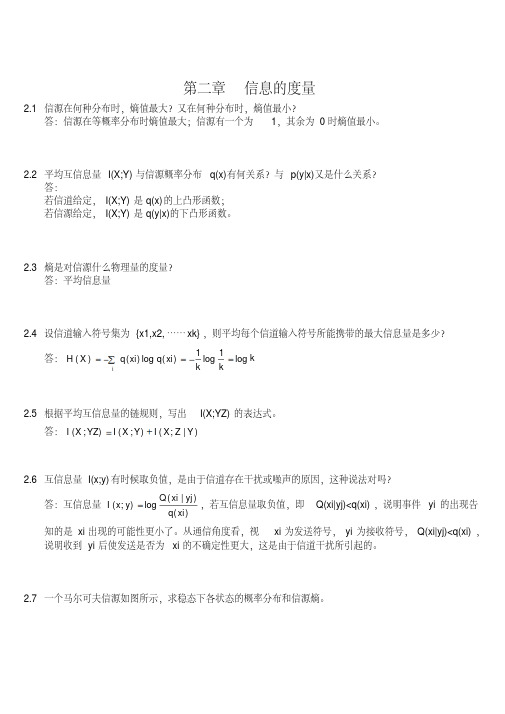

信息论与编码第二章答案

第二章信息的度量2.1信源在何种分布时,熵值最大?又在何种分布时,熵值最小?答:信源在等概率分布时熵值最大;信源有一个为1,其余为0时熵值最小。

2.2平均互信息量I(X;Y)与信源概率分布q(x)有何关系?与p(y|x)又是什么关系?答:若信道给定,I(X;Y)是q(x)的上凸形函数;若信源给定,I(X;Y)是q(y|x)的下凸形函数。

2.3熵是对信源什么物理量的度量?答:平均信息量2.4设信道输入符号集为{x1,x2,……xk},则平均每个信道输入符号所能携带的最大信息量是多少?答:kk k xi q xi q X H i log 1log 1)(log )()(2.5根据平均互信息量的链规则,写出I(X;YZ)的表达式。

答:)|;();();(Y Z X I Y X I YZ X I 2.6互信息量I(x;y)有时候取负值,是由于信道存在干扰或噪声的原因,这种说法对吗?答:互信息量)()|(log );(xi q yj xi Q y x I ,若互信息量取负值,即Q(xi|yj)<q(xi),说明事件yi 的出现告知的是xi 出现的可能性更小了。

从通信角度看,视xi 为发送符号,yi 为接收符号,Q(xi|yj)<q(xi),说明收到yi 后使发送是否为xi 的不确定性更大,这是由于信道干扰所引起的。

2.7一个马尔可夫信源如图所示,求稳态下各状态的概率分布和信源熵。

答:由图示可知:43)|(41)|(32)|(31)|(41)|(43)|(222111110201s x p s x p s x p s x p s x p s x p 即:43)|(0)|(41)|(31)|(32)|(0)|(0)|(41)|(43)|(222120121110020100s s p s s p s s p s s p s s p s s p s s p s s p s s p 可得:1)()()()(43)(31)()(31)(41)()(41)(43)(210212101200s p s p s p s p s p s p s p s p s p s p s p s p得:114)(113)(114)(210s p s p s p )]|(log )|()|(log )|()[()]|(log )|()|(log )|()[()]|(log )|()|(log )|()[(222220202121211111010100000s s p s s p s s p s s p s p s s p s s p s s p s s p s p s s p s s p s s p s s p s p H 0.25(bit/符号)2.8一个马尔可夫信源,已知:0)2|2(,1)2|1(,31)1|2(,32)1|1(x x p x x p x x p x x p 试画出它的香农线图,并求出信源熵。

信息论复习提纲

信道传递概率可以用信道矩阵来表示:

x1 x2 P xr

y1 p( y1 | x1 ) p( y | x ) 1 2 p( y1 | xr )

y2 p( y2 | x1 )

p( y2 | x2 ) p( y2 | xr )

ys p( ys | x1 ) 1 p( ys | x2 ) p( ys | xr )

i

第四章:信道及信道容量

二、离散单符号信道及其信道容量

1.离散单符号信道的数学模型(续14)

例3:求二元删除信道的 H ( X )、H (Y )、H ( X | Y )和I ( X ;Y ) 。

已知

1 3 PX 4 4

1 1 2 2 0 P 1 2 0 3 3

3. 后验概率(后向概率): 贝叶斯公式

p ( xi | y j ) p ( xi y j ) p( y j ) p ( xi ) p ( y j | xi )

p( x ) p( y

i 1 i

r

j

| xi )

(i =1,2,…,r;j =1,2,…,s)

且

p ( xi | y j ) 1

Y y2

ys

i 1, 2,..., r ; j 1, 2,..., s

满足: (1)0≤ p(yj|xi) ≤ 1 (i=1,2,…,r;j=1,2,…,s) (2)

p( y j | xi ) 1

j 1

s

(i=1,2,…,r)

第四章:信道及信道容量

二、离散单符号信道及其信道容量

1.离散单符号信道的数学模型(续2)

r s

第四章:信道及信道容量

信息的统计度量

2.3.2熵函数旳数学特征

1、对称性: 熵函数对每个Pk 对称旳。该性质 阐明熵只与随机变量旳总体构造有关,与事件 集合旳总体统计特征有关;

2、非负性: H(P)=H(p1,p2,…,pq)>=0;

3、扩展性: 当某事件Ek旳概率Pk稍微变化时, H函数也只作连续旳不突变旳变化;

lim

0

H q1(

熵函数旳自变量是X,表达信源整体

信息熵旳单位与公式中旳对数取底有关。通信与信息 中最常用旳是以2为底,这时单位为比特(bit);理 论推导中用以e为底较以便,这时单位为奈特 (Nat);工程上用以10为底较以便,这时单位为笛 特(Det)。它们之间能够引用对数换底公式进行互 换。例如:

1 bit = 0.693 Nat = 0.301 Det

I ( xi / y j ) log p( xi / y j )

在特定条件下( 已定)随机事件发生所带来旳 信息量 条件自信息量满足非负和单调递减性。

例:甲在一种8*8旳 方格盘上随意放入 一种 棋子,在乙看来是不拟定旳。

(1)在乙看来,棋子落入某方格旳不拟 定性为多少?

(2)若甲告知乙棋子落入方格旳行号, 这时,在乙看来棋子落入某方格旳不 拟定性为多少?

j 1

(4)

p( xi y j ) p( xi ) p( y j / xi ) p( y j ) p( xi / y j )

(5) 当X与Y相互独立时, p( y j / xi ) p( y j ),

p( xi / y j ) p( xi ), p( xi y j ) p( xi ) p( y j )

熵旳计算

• 例:设某信源输出四个符号,其符号集合旳 概率分布为:

s1 S p1

李梅 李亦农 《信息论基础教程》 课件教案 第二章 信息的度量

一、自信息和互信息 二、平均自信息 三、平均互信息

第二章:信息的度量

1. 自信息

一、自信息和互信息

二、平均自信息

2. 互信息

三、平均互信息

第二章:信息的度量

自信息和互信息 平均自信息 平均互信息

1. 自信息(量)

公理性条件: (1) 如果p(x1) < p(x2),则I(x1) > I(x2), I(xi )是 p(xi) 调递减函数; 的单

第二章:信息的度量

自信息和互信息 平均自信息 平均互信息

2. 互信息(量) (续9)

互信息量的性质

1) 互信息的对称性 2) 互信息可为正值、负值,或为0 3) 任何两个事件之间的互信息不可能大于其中任一 事件的自信息

第二章:信息的度量

自信息和互信息 平均自信息 平均互信息

2. 互信息(量) (续10)

解:

第二章:信息的度量

自信息和互信息 平均自信息 平均互信息

1. 自信息(量) (续6)

p( x1 ) 1 1 n(n 1) 2 p( xn ) n 1 n(n 1) 2

1 I ( x1 ) log n(n 1) 2

1 I ( xn ) log (n 1) 2

自信息和互信息 平均自信息 平均互信息

2. 互信息(量) (续11)

2) 互信息可正可负,可为零

当后验概率大于先验概率时,互信息为正。

说明事件yj的出现有助于消除事件xi的不确定度。

当后验概率小于先验概率时,互信息为负。

说明收信者未收到 yj 以前,对消息xi是否出现的猜测难度较 小,但接收到消息 yj 后对 xi 是否出现的猜测的难度增加了,也 就是收信者接收到消息 yj 后对 xi出现的不确定性反而增加,所 以获得的信息量为负值。

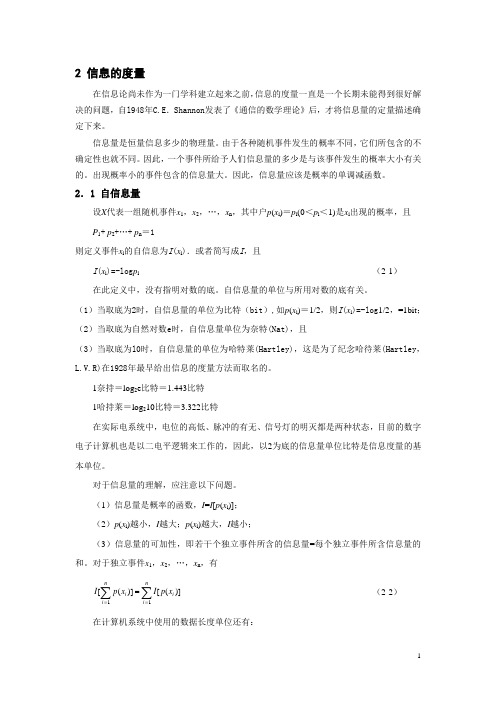

2 信息的度量

2 信息的度量在信息论尚未作为一门学科建立起来之前,信息的度量一直是一个长期未能得到很好解决的问题,自l948年C.E .Shannon 发表了《通信的数学理论》后,才将信息量的定量描述确定下来。

信息量是恒量信息多少的物理量。

由于各种随机事件发生的概率不同,它们所包含的不确定性也就不同。

因此,一个事件所给予人们信息量的多少是与该事件发生的概率大小有关的。

出现概率小的事件包含的信息量大。

因此,信息量应该是概率的单调减函数。

2.1 自信息量设X 代表一组随机事件x 1,x 2,…,x n ,其中户p (x i )=p i (0<p i <1)是x i 出现的概率,且 P 1+ p 2+…+ p n =1则定义事件x i 的自信息为I (x i ).或者简写成I ,且I (x i )=-log p i (2-1) 在此定义中,没有指明对数的底。

自信息量的单位与所用对数的底有关。

(1)当取底为2时,自信息量的单位为比特(bit ),如p (x i )=1/2,则I (x i )=-log 1/2,=1bit ;(2)当取底为自然对数e 时,自信息量单位为奈特(Nat),且(3)当取底为l0时,自信息量的单位为哈特莱(Hartley),这是为了纪念哈待莱(Hartley ,L.V.R)在1928年最早给出信息的度量方法而取名的。

1奈持=log 2e 比特=1.443比特1哈持莱=log 210比特=3.322比特在实际电系统中,电位的高低、脉冲的有无、信号灯的明灭都是两种状态,目前的数字电子计算机也是以二电平逻辑来工作的,因此,以2为底的信息量单位比特是信息度量的基本单位。

对于信息量的理解,应注意以下问题。

(1)信息量是概率的函数,I =I [p (x i )];(2)p (x i )越小,I 越大;p (x i )越大,I 越小;(3)信息量的可加性,即若干个独立事件所含的信息量=每个独立事件所含信息量的和。

信息量的度量如何计算公式

信息量的度量如何计算公式信息量的度量是指在一定的信息传输过程中,信息的多少和质量的度量。

在信息论中,我们通常使用熵来度量信息的多少,熵越大表示信息量越大。

下面我们将介绍信息量的度量以及相关的计算公式。

在信息论中,熵是度量信息量的一个重要概念。

熵的计算公式为:\[H(X) = -\sum_{i=1}^{n} p(x_i) \log_2 p(x_i)\]其中,\(H(X)\)表示随机变量\(X\)的熵,\(p(x_i)\)表示随机变量\(X\)取值为\(x_i\)的概率。

通过计算熵,我们可以得到随机变量\(X\)的信息量。

在实际应用中,我们经常使用二进制编码来表示信息。

在这种情况下,我们可以使用香农编码来计算信息量。

香农编码是一种使用变长编码来表示信息的编码方式,通过根据信息的概率分布来确定每个信息的编码长度,从而实现信息的高效表示。

香农编码的计算公式为:\[L = -\sum_{i=1}^{n} p(x_i) \log_2 p(x_i)\]其中,\(L\)表示信息的平均编码长度。

通过计算香农编码,我们可以得到信息的平均编码长度,从而可以评估信息的压缩效果和传输效率。

除了熵和香农编码,我们还可以使用信息熵来度量信息的多少。

信息熵是一种用于度量信息量的概念,它是对信息量的期望值。

信息熵的计算公式为:\[H(X) = -\sum_{i=1}^{n} p(x_i) \log_2 p(x_i)\]其中,\(H(X)\)表示随机变量\(X\)的信息熵,\(p(x_i)\)表示随机变量\(X\)取值为\(x_i\)的概率。

通过计算信息熵,我们可以得到随机变量\(X\)的平均信息量。

在实际应用中,我们可以使用信息熵来评估信息系统的复杂度和传输效率。

通过计算信息熵,我们可以得到系统中信息的平均复杂度,从而可以评估系统的性能和稳定性。

综上所述,信息量的度量是信息论中的重要概念,我们可以使用熵、香农编码和信息熵来度量信息的多少。

第二章 信息的度量

有时随机变量X和Y之间有一定的关联关 系,一个随机变量发生某结果后,对另一个随 机变量发生的结果会产生影响,这时我们用 条件概率来描述两者之间的关系:如P(yk|xj) 表示X发生xj后,Y又发生yk的条件概率,而 P(yk)表示对xj一无所知时yk发生的概率。有 时相应地称P(yk)为yk的无条件概率。同理 有P(xj|yk)和P(xj)。

概率的基本性质:

(1)0 P ( x j ), P ( yk ), P ( yk | x j ), P ( x j | yk ), P ( x j yk ) 1 ( 2) P ( x j )

j 1 J J

P( y

k 1

K

k

)

P( x

j 1

J

j

| yk )

P( y

2.3.4 自信息量的性质和相互关系 上面介绍的三种自信息量:自信息量、联 合自信息量和条件自信息量在数学上看具有 一些共同的性质: (1)概率为0时,相应的自信息量无意义; (2)非负性。 三种自信息量之间的关系:

I ( xk y j ) log2 P( xk y j ) log2 P( xk ) P( y j | xk ) I ( xk ) I ( y j | xk ) log2 P( y j ) P( xk | y j ) I ( y j ) I ( xk | y j )

Shannon,Weaver 曾把信息理论划分为三个层次 :① 实用性层次(可用于各领域) ②实效性层次 ( 研究信息产生传输的实际效果与 效率问题)

③意义性层次(研究信息的意义和对信息的理解)

本课程只讨论客观信息的度量

在信息论中,常把基本消息称为符号,基本 消息集合就是符号集合或符号表,消息则是符 号串。对认识主体而言,信源在某一时刻输出 什么符号是随机的,可以用概率统计的方法加 以处理。信源在各个时刻的输出组成了一随 机变量输出序列: {Xtk;tk∈T} 式中T为时间参数集,Ex为Xtk的值域或取值空间。

信息论与编码理论-第2章信息的度量-习题解答-20071017

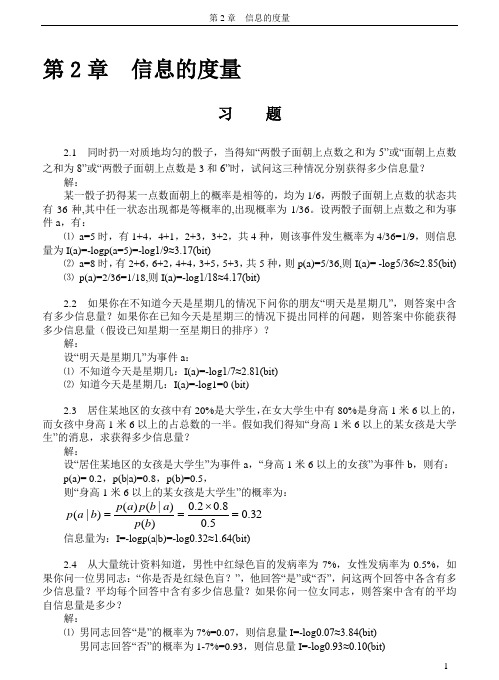

1第2章 信息的度量习 题2.1 同时扔一对质地均匀的骰子,当得知“两骰子面朝上点数之和为5”或“面朝上点数之和为8”或“两骰子面朝上点数是3和6”时,试问这三种情况分别获得多少信息量?解:某一骰子扔得某一点数面朝上的概率是相等的,均为1/6,两骰子面朝上点数的状态共有36种,其中任一状态出现都是等概率的,出现概率为1/36。

设两骰子面朝上点数之和为事件a ,有:⑴ a=5时,有1+4,4+1,2+3,3+2,共4种,则该事件发生概率为4/36=1/9,则信息量为I(a)=-logp(a=5)=-log1/9≈3.17(bit)⑵ a=8时,有2+6,6+2,4+4,3+5,5+3,共5种,则p(a)=5/36,则I(a)= -log5/36≈2.85(bit) ⑶ p(a)=2/36=1/18,则I(a)=-log1/18≈4.17(bit)2.2 如果你在不知道今天是星期几的情况下问你的朋友“明天是星期几”,则答案中含有多少信息量?如果你在已知今天是星期三的情况下提出同样的问题,则答案中你能获得多少信息量(假设已知星期一至星期日的排序)?解:设“明天是星期几”为事件a :⑴ 不知道今天是星期几:I(a)=-log1/7≈2.81(bit) ⑵ 知道今天是星期几:I(a)=-log1=0 (bit)2.3 居住某地区的女孩中有20%是大学生,在女大学生中有80%是身高1米6以上的,而女孩中身高1米6以上的占总数的一半。

假如我们得知“身高1米6以上的某女孩是大学生”的消息,求获得多少信息量?解:设“居住某地区的女孩是大学生”为事件a ,“身高1米6以上的女孩”为事件b ,则有: p(a)= 0.2,p(b|a)=0.8,p(b)=0.5,则“身高1米6以上的某女孩是大学生”的概率为:32.05.08.02.0)()|()()|(=⨯==b p a b p a p b a p信息量为:I=-logp(a|b)=-log0.32≈1.64(bit)2.4 从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%,如果你问一位男同志:“你是否是红绿色盲?”,他回答“是”或“否”,问这两个回答中各含有多少信息量?平均每个回答中含有多少信息量?如果你问一位女同志,则答案中含有的平均自信息量是多少?解:⑴ 男同志回答“是”的概率为7%=0.07,则信息量I=-log0.07≈3.84(bit) 男同志回答“否”的概率为1-7%=0.93,则信息量I=-log0.93≈0.10(bit)2平均信息量为:H 1=-(0.07×log0.07+0.93×log0.93) ≈0.37(bit/符号) ⑵ 问女同志的平均自信息量:H 2=-[0.05×log0.05+(1-0.05) ×log(1-0.05)] ≈0.045(bit/符号)2.5 如有7行9列的棋型方格,若有两个质点A 和B ,分别以等概率落入任一方格内,且它们的坐标分别为(X A ,Y A )、(X B ,Y B ),但A 、B 不能落入同一方格内。

信息及其度量

若a = e,信息量的单位称为奈特(nat) 若 a = 10,信息量的单位称为哈特莱(Hartley)

通常广泛使用的单位为比特,这时有:

1 I log 2 log 2 P( x) P( x)

3.度量信息的方法

(3)P(x) = 1时,I = 0; P(x) = 0时,I = ;

I [ P( x1 ) P( x2 )] I [ P( x1 )] I [ P( x2 )]

满足上述3条件的关系式如下:

1 I loga loga P( x) P ( x)

-信息量的定义

3.度量信息的方法

3.度量信息的方法

信息量是消息出现概率的函数; 消息出现的概率越小,所包含的信息量就越大;

设: P(x) - 消息发生的概率

I - 消息中所含的信息量,

则 P(x) 和 I 之间应该有如下关系:

(1) I 是 P(x) 的函数: I =I [P(x)]

(2)P术》课程

信息及其度量

目 录

01 02

基本概念 度量信息的原则

03

度量信息的方法

1.最佳接收准则

信 息

消息中包含的有意义的内容。

不同形式的消息,可以包含相同的信息。

信息量

信源的不肯定度就是信源提供的信息量。 传输信息的多少用信息量表示。

2.度量信息的原则

度量信息量的原则:

能度量任何消息,并与消息的种类无关; 度量方法应该与消息的重要程度无关; 消息中所含信息量和消息内容的不确定性有关; 如:一条概率几乎为零的消息(太阳将从西方升起)将会使人 感到惊奇和意外,而一个必然事件(如太阳从东方升起),人们不 足为奇,前一条比后一条包含了更多的信息。 这表明:消息所表达的事件越不可能发生,信息量就越大。

信息论度量方法

信息论度量方法

信息论中,信息的度量方法有多种,以下是几种主要的度量方式:

1. 信息量:信息量可以用比特(bit)来度量,比特是信息论中最基本的单位,表示二进制系统中的一个选择。

比特的数量表示传递或存储的信息量

的大小。

2. 信息熵:信息熵是信息理论中度量信息不确定性的概念。

熵的值越大,

表示信息的不确定性越高。

熵可以用来度量某个事件或数据集中的信息量。

3. 信噪比:信噪比是度量信号中有用信息与噪声比例的指标。

它可以用来

衡量信号中噪声对有用信息的影响程度。

4. 信息速率:信息速率是单位时间内传输或处理的信息量。

常用的单位是

比特每秒(bps)或字节每秒(Bps)。

5. 信息传输效率:信息传输效率是指在给定的带宽或资源条件下,能够传输的有效信息量。

它是通过传输速率和信道容量的比值来度量的。

以上信息仅供参考,如有需要,建议查阅相关书籍或咨询专业人士。

信息论第二章信息的度量

I(xi;yj)I(xi)I(xi yj)

log

( xi y j q(xi )

)

(2-6)

称(2-6)式为事件xi和事件yj之间的互信息量。

注:式(2-6)的I(xi ;yj ) 和式(2-3)的I(xiyj )的区别

在于: 前者是事件xi∈X和事件yj∈Y之间的互信息量, 后者是二维空间XY 上元素xi yj 的自信息量。

根据概率互换公式p(xi yj) = p(yj︱xi)q(xi)=φ(xi︱yj)ω(yj) 互信息量I(xi ;yj )有多种表达形式:

I(xi;yj)loq(p x g (ix ) iy (jy )j)I(xi)I(yj)I(xiyj) (2-7)

I(xi;yj)lopg (y(yjjx)i)I(yj)I(yj xi)(2-8)

如底数分别取 2、 e、 10,

则自信息量单位分别为:比特、奈特、哈特

1 na lto2e g 1 .4b 3i3t

1 H a lo r2 1 tg 0 3 .3b 2i2 t

1 bi t0.69 n3 at

1bit0.30H 1art

一个以等概率出现的二进制码元

(0,1)所包含的自信息量为1bit。

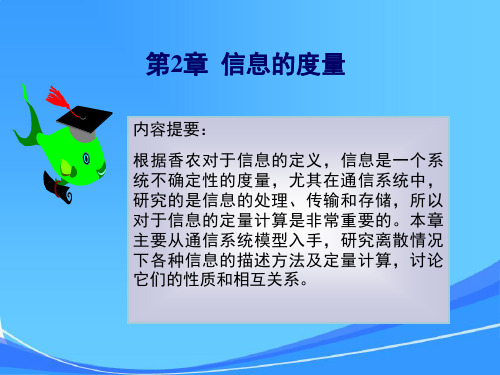

第2章 信息的度量

内容提要:

根据香农对于信息的定义,信息是一个系 统不确定性的度量,尤其在通信系统中, 研究的是信息的处理、传输和存储,所以 对于信息的定量计算是非常重要的。本章 主要从通信系统模型入手,研究离散情况 下各种信息的描述方法及定量计算,讨论 它们的性质和相互关系。

2.1 自信息量和互信息量

I(a i)I(bj)

( 2-4 )

3.条件自信息量

在已知事件yj条件下,随机事件xi发生的概率为条件概率φ(xi

信息度量的基本公式

信息度量的基本公式

信息度量的基本公式是用来衡量信息熵的一种数学模型,它可以有效地计算出信息的不确定性、复杂度等统计特征。

它的核心思想是,当一个系统的状态发生变化时,它所表示的信息量会随之增加或减少。

该公式的基本形式是H(X)=-∑pi log2pi,其中X表示系统的状态,pi表示该状态出现的概率,H(X)表示X的信息度量。

以二进制位为例,假设X的状态有两种,即0和1,那么X的信息度量H(X)= -p0log2p0-p1log2p1。

假如X的状态有n种,则X的信息度量H(X)= -∑pi log2pi,其中pi为状态i出现的概率,i=1,2,…,n。

比如,信息度量H(X)可以应用于英语文本中,其中X 表示文本中出现的所有字符,pi表示每个字符出现的概率。

这样,就可以通过计算H(X)来衡量文本中字符组合出现的不确定性和复杂度。

此外,信息度量的基本公式也可以用来分析图像、声音等多媒体信息,其中X表示图像或声音的各种状态,pi 表示该状态出现的概率。

信息度量的基本公式对于衡量信息的复杂度和不确定性非常有效,它可以有效地用于计算机视觉、语音识别、机器学习等领域。

除此之外,信息度量的基本公式还可以用来分析网络流量的可信性和安全性,其中X表示网络流量中出现的数据包,pi表示数据包出现的概率。

总之,信息度量的基本公式是一个统计方法,可以有效地应用于衡量信息的复杂度和不确定性等方面,广泛应用于计算机视觉、语音识别、机器学习、网络流量安全性等领域。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

东南大学移动通信国家重点实验室

4

信息论与编码课件

2.1 度量信息的基本思路

2.1.1单符号离散信源

➢ 单符号离散信源的实例 ✓ 掷骰子每次只能是1,2,3,4,5,6中的某一个; ✓ 天气预报可能是晴、阴、雨、雪、风、冰雹…

中的一种或其组合以及温度、污染等;

✓ 二进制通信中传输的只是1、0两个数字;等等。

2.1.2度量信息的基本思路

➢例2.1 一个, 0等概的二进制随机序列,求任一 码元的自信息量。

解:任一码元不是为0就是为1 因为 P(0) = P(1) = 1/2 所以 I (0) = I (1) = – lb (1/2) = 1(bit)

✓ 例如,假设天气预报中的天气及温度变化是与污染程 度相关性很小甚至几乎完全独立的,则信源的每一个 输出就能分成独立的两部分。

➢ 直观地,传递xi所包含的信息量是分别传递xi1 和xi2所得到的信息量的和。

东南大学移动通信国家重点实验室

8

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

➢ 信源空间通常用如下方式来描述:

X: [X P]: P(X) :

x1 , P( x1 ),

x2 , , xi , , P(x2 ), , P(xi ),

,

➢显然,信源空间必定是一个完备集,即

N

P(xi ) 1 i 1

xN

P(xN ) (2.1) (2.2)

东南大学移动通信国家重点实验室

1 P( xi

)

lb P( xi

)

为事件xi的自信息量。

(2.3)

东南大学移动通信国家重点实验室

11

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

➢ I(xi)实质上是无量纲的 ➢ 为研究问题的方便,根据对数的底定义信息量的量纲

✓ 对数的底取2,则信息量的单位为比特(bit); ✓ 取e(自然对数),则单位为奈特(nat); ✓ 取10(常用对数),则单位为哈特。 ✓ 利用换底公式容易求得:

1nat1.44bit

1Hart3.32bit

➢ 在通信及目前的绝大多数信息传输系统中,都是以二 进制为基础的,因此信息量单位以比特最为常用

➢ 在没有特别说明的情况下,通常(2.3)式的量纲即为比 特,且底数2被省略。

东南大学移动通信国家重点实验室

12

信息论与编码课件

2.1 度量信息的基本思路

信息论与编码课件

东南大学移动通信国家重点实验室

1

信息论与编码课件

第2章 信息的度量

➢信息论的发展是以信息可以度量为基础 的,度量信息的量称为信息量。

➢对于随机出现的事件,它的出现会给人 们带来多大的信息量?

➢考虑到通信系统或很多实际的信息传输 系统,对于所传输的消息如何用信息量 的方法来描述?

➢本章将围绕这些问题展开讨论。

6

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

➢ 考虑一个单符号离散信源,它的输出被传送给对此感 兴趣的一方。

➢ 设x1为最大可能的输出,xN为最小可能的输出。 ✓ 例气如,x,N为假冰设雹信或源其输它出强代对表流天天气气情。况,x1为晴或多云天 ✓ 哪个输出包含更多的信息,x1还是xN? ✓ 直观地,传递xN 给出了更多的信息。 ➢ 由此可以合理地推算信源输出的信息量应该是输出事

东南大学移动通信国家重点实验室

2

信息论与编码课件

2.1 度量信息的基本思路

2.1.1单符号离散信源

➢ 从讨论信源的特征入手,给出定量度量信息 的方法。

➢ 以天文学范畴的事件为例。

✓ 小行星撞击地球、月食、日食、流星雨、星系的产生 与消亡等等,都是天文学内一个个离散的事件

✓ 如果将一个事件用一个符号来表示,则一个符号代表 一个完整的消息

✓ 如果把都是天文学内的事件看作是天文学这个“信源” 输出的符号,则这个信源可以看作是单符号离散信源。

东南大学移动通信国家重点实验室

3

信息论与编码课件

2.1 度量信息的基本思路

2.1.1单符号离散信源

➢由此给出如下定义: • 定义2.1

如果信源发出的消息是离散的、有限 或无限可列的符号或数字,且一个符号 代表一条完整的消息,则称这种信源为 单符号离散信源。

➢ 这种符号或数字都可以看作某一集合中的事件, 每个符号或数字(事件)都是信源中的元素, 它们的出现往往具有一定的概率。

➢ 因此,信源又可以看作是具有一定概率分布的 某一符号集合。

东南大学移动通信国家重点实验室

5

信息论与编码课件

2.1 度量信息的基本思路

2.1.1单符号离散信源

• 定义2.2

若信源的输出是随机事件X,其出现概率为P(X),,则它 们所构成的集合,称为信源的概率空间或简称为信源空 间。

X中出现xi、Y中出现yj的联合信息量 I (xi ,yj) = I (x i) + I (yj)

➢ 只有对数函数能够同时满足以上条件。

东南大学移动通信国家重点实验室

10

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

➢定义2.3

事件xi的出现所带来的信息量

I (xi

)

lb

件的概率的减函数。 ➢ 信息量的另一个直观属性是,某一输出事件的概率的

微小变化不会很大地改变所传递的信息量,即信息量 应该是信源输出事件概率的连续减函数。

东南大学移动通信国家重点实验室

7

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

➢ 假设与输出xi相关的信息能被分成独立的两部 分,比如xi1与xi2,即xi = { xi1,xi2 }。

➢ 若信源中事件xi的出现所带来的信息量用 I(xi)来表示并称之为事件xi的自信息量,

➢ 则概率为p(xi)的信源输出xi所包含的信息 量I(xi)必须满足以下几个条件:

东南大学移动通信国家重点实验室

9

信息论与编码课件

2.1 度量信息的基本思路

2.1.2度量信息的基本思路

1. 信的源取输值出无x关i所。包含的信息量仅依赖于它的概率,而与它 2. I (xi)是P(xi)的连续函数。 3. I (xi)是P(xi)的减函数,即: ✓ 如果P(xi) > P(xj),则I(xi) < I(xj)。 ✓ 极限情况,若P(xi) = 0, 则 I(xi) → ∞; ✓ 若 P(xi) = 1, 则I(xi) = 0。 4.若两个单符号离散信源(符号集合X, Y )统计独立, 则