线性回归分析

第四章 线性回归分析

(4-1)

, zki 是 k 个对 Y 有显

其中 j ( j 1,2,

, k ) 是回归系数,Y 是被解释变量, z1i , z2i ,

著影响的解释变量 (k 2) , i 是反映各种误差扰动综合影响的随机项,下标 i 表 示第 i 期观察值 (Yi , z1i , z2i ,

, zki ), i 1,2,

2

,n 。

ˆ ˆZ ˆ Z ˆZ ˆ 假设多元样本回归函数为:Y i 0 1 1i 2 2i 3 3i

ˆ。 差为: i Yi Y i

由于有 n 期的观察值,这一模型实际上包含 n 个方程:

Y2 0 1Z12 Yn 0 1Z1n

另 V 对 b0 ,

bk zki )]2

(4-3)

, bk 的一阶偏导数都等于 0,即下列方程组:

2[Y (b

i

0

b1 z1i b1 z1i b1 z1i

bk zki )]( 1) 0, bk zki )]( z1i ) 0, bk zki )]( zki ) 0

把样本数据分别代入样本回归方程,得到回归方程组为:

ˆ b bz Y 1 0 1 11 ˆ b bz Y n 0 1 1n bk zk 1 ,

(4-4)

(4-5)

bk zkn

写成等价的向量方程,则为:

ˆ ZB Y

这样回归残差向量为:

ˆ Y ZB Y Y

再利用向量,矩阵的运算法则,可以得到残差平方和为:

k Zk ,

, bk 分 别 表 示 模 型 参 数 0 ,

线性回归分析

线性回归分析线性回归是一种用来建立和预测变量间线性关系的统计分析方法。

它可以帮助我们了解变量之间的相互影响和趋势,并将这些关系用一条直线来表示。

线性回归分析常被应用于经济学、社会科学、自然科学和工程等领域。

一、概述线性回归分析是一个广泛使用的统计工具,用于建立变量间的线性关系模型。

该模型假设自变量(独立变量)与因变量(依赖变量)之间存在线性关系,并通过最小化观测值与模型预测值之间的误差来确定模型的参数。

二、基本原理线性回归分析基于最小二乘法,通过最小化观测值与模型预测值之间的残差平方和来确定模型的参数。

具体来说,线性回归模型可以表示为:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε,其中Y是因变量,X1到Xn是自变量,β0到βn是回归系数,ε是误差项。

回归系数表示自变量对因变量的影响程度。

三、应用步骤进行线性回归分析时,通常需要以下几个步骤:1. 收集数据:获取自变量和因变量的样本数据。

2. 建立模型:根据数据建立线性回归模型。

3. 评估模型的准确性:通过计算残差、决定系数等指标来评估模型的准确性。

4. 进行预测和推断:利用模型对未知数据进行预测和推断。

四、模型评价指标在线性回归分析中,有几个常用的指标用于评价模型的准确性:1. R平方值:R平方值表示因变量的变异性能够被模型解释的比例,数值范围为0到1。

R平方值越接近1,表示模型对数据的拟合程度越好。

2. 残差分析:进行残差分析可以帮助我们判断模型是否符合线性回归的基本假设。

一般来说,残差应该满足正态分布、独立性和等方差性的假设。

五、优缺点线性回归分析有以下几个优点:1. 简单易懂:线性回归模型的建立和解释相对较为简单,无需复杂的数学知识。

2. 实用性强:线性回归模型适用于很多实际问题,可以解决很多预测和推断的需求。

然而,线性回归分析也存在以下几个缺点:1. 假设限制:线性回归模型对于变量间关系的假设比较严格,不适用于非线性关系的建模。

线性回归分析的基本原理

线性回归分析的基本原理线性回归分析是一种常用的统计分析方法,用于研究两个变量之间的线性关系。

它通过拟合一条直线来描述两个变量之间的关系,并利用这条直线进行预测和推断。

本文将介绍线性回归分析的基本原理,包括模型假设、参数估计、模型评估等内容。

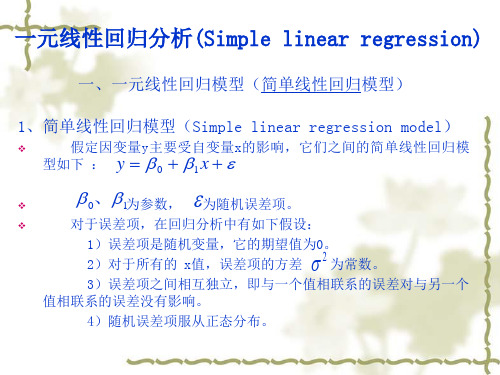

一、模型假设线性回归分析的基本假设是:自变量和因变量之间存在线性关系。

具体来说,假设因变量Y可以通过自变量X的线性组合来表示,即Y =β0 + β1X + ε,其中β0和β1是待估参数,ε是误差项,表示模型无法解释的随机误差。

二、参数估计线性回归分析的目标是估计模型中的参数,即β0和β1。

常用的估计方法是最小二乘法,即通过最小化观测值与模型预测值之间的差异来估计参数。

具体来说,最小二乘法通过求解以下方程组来得到参数的估计值:∑(Yi - β0 - β1Xi) = 0∑(Yi - β0 - β1Xi)Xi = 0其中∑表示对所有样本进行求和,Yi和Xi分别表示第i个观测值的因变量和自变量的取值。

三、模型评估在进行线性回归分析时,需要对模型进行评估,以确定模型的拟合程度和预测能力。

常用的评估指标包括残差分析、决定系数和假设检验。

1. 残差分析残差是观测值与模型预测值之间的差异,残差分析可以用来检验模型的合理性和假设的成立程度。

通常,残差应该满足以下几个条件:残差的均值为0,残差的方差为常数,残差之间相互独立,残差服从正态分布。

通过绘制残差图和正态概率图,可以对残差是否满足这些条件进行检验。

2. 决定系数决定系数是衡量模型拟合程度的指标,表示因变量的变异程度中可以由自变量解释的比例。

决定系数的取值范围为0到1,越接近1表示模型的拟合程度越好。

常用的决定系数是R平方,定义为回归平方和与总平方和的比值。

R平方越大,说明模型对观测值的解释能力越强。

3. 假设检验在线性回归分析中,常常需要对模型的参数进行假设检验,以确定参数的显著性。

常用的假设检验包括对β0和β1的检验。

假设检验的原假设是参数等于0,备择假设是参数不等于0。

线性回归分析

线性回归分析线性回归分析是一种常见的统计分析方法,主要用于探索两个或多个变量之间的线性关系,并预测因变量的值。

在现代运营和管理中,线性回归分析被广泛应用于市场营销、财务分析、生产预测、风险评估等领域。

本文将介绍线性回归分析的基本原理、应用场景、建模流程及常见误区。

一、基本原理线性回归分析基于自变量和因变量之间存在一定的线性关系,即当自变量发生变化时,因变量也会随之发生变化。

例如,销售额与广告投入之间存在一定的线性关系,当广告投入增加时,销售额也会随之增加。

线性回归分析的目标是找到这种线性关系的最佳拟合线,并利用该线性方程来预测因变量的值。

二、应用场景线性回归分析可以应用于许多不同的领域,例如:1.市场营销。

通过分析销售额和广告投入之间的关系,企业可以确定最佳的广告投入量,从而提高销售额。

2.财务分析。

线性回归分析可以用于预测公司的收入、费用和利润等财务指标,并帮助企业制定有效的财务战略。

3.生产预测。

通过分析生产量和生产成本之间的关系,企业可以确定最佳的生产计划,从而提高生产效率。

4.风险评估。

通过分析不同变量之间的关系,企业可以评估各种风险并采取相应的措施,从而减少损失。

三、建模流程线性回归分析的建模流程包括以下步骤:1.确定自变量和因变量。

自变量是用来预测因变量的变量,而因变量是需要预测的变量。

2.收集数据。

收集与自变量和因变量相关的数据,并进行初步的数据处理和清理工作。

3.拟合最佳拟合线。

利用最小二乘法拟合最佳拟合线,并计算相关的统计指标(如拟合优度、标准误等)。

4.判断线性关系的签ificance。

利用t检验或F检验来判断线性关系的签ificance,并进行推断分析。

5.进行预测。

利用已知的自变量的值,通过线性方程来预测因变量的值。

四、常见误区在进行线性回归分析时,有一些常见的误区需要注意:1.线性假设误区。

线性回归分析建立在自变量和因变量之间存在线性关系的基础之上,如果这种关系不是线性的,则建立的回归模型将失效。

统计学中的线性回归分析

统计学中的线性回归分析在统计学中,线性回归分析是一种最常见的应用之一。

线性回归分析是一种用于建立两个或多个变数之间关系的方法。

在这种分析中,一个或多个独立变量被用来预测一个因变量。

线性回归分析被广泛应用于医学、社会科学、自然科学等领域。

什么是线性回归分析?线性回归分析被定义为建立两个或多个变数之间线性关系的方法。

更准确地说,线性回归分析是用来预测连续型变量(因变量)之间关系的方法。

例如,通过线性回归分析可以建立收入和家庭支出之间的关系。

在线性回归中,因变量作为输出变量,而独立变量作为输入变量。

只有一个独立变量和一个因变量的线性回归称为简单线性回归,而有多个独立变量和一个因变量的线性回归称为多元线性回归。

线性回归分析基本原理线性回归分析的基本原理是建立一个数学模型,用以解释因变量的变化。

这个模型被描述为回归方程,它可以被用来求解因变量和独立变量之间的关系。

回归方程显示了一条线性(直线)的趋势,因此被称为线性回归分析。

回归分析有两个关键的部分:截距和回归系数。

回归系数代表着因变量与独立变量之间的关系,截距则是当独立变量取零时因变量的预测值。

线性回归分析的步骤线性回归分析的过程包括以下步骤:1. 定义研究问题:确定要解决的研究问题。

2. 收集数据:收集与研究问题相关的数据。

3. 数据预处理:处理数据,并进行数据清理和预处理以准备数据进行分析。

4. 建立模型:建立具有高度预测能力的回归模型。

5. 模型评估:使用适当的指标,评估模型的性能和准确性。

6. 发现结论:根据模型和数据,得出结论。

线性回归分析的应用线性回归分析可以应用于许多领域中的问题,如社会科学、医学、自然科学和工程学等。

下面将以医学为例来讲解线性回归分析的应用。

在医学研究中,线性回归分析可以用来探索一些生理变量的关系,如心率和血压之间的关系。

研究人员可以收集参与者的心率和血压数据,并使用线性回归分析来确定这些变量之间的相关性。

这些研究可以有助于确定心脏病患者的风险因素,以及对他们进行预防和治疗所需的干预措施。

线性回归分析

3.用参数估计值替代初始值,将方程再次展开,进行线性化,从而又可 一点的导数求得。

以求出一批参数估计值。

4.如此反复,直至参数估计值收敛为止。

04 总结

回归模型的原理及应用

模型表达形式

模型的基本 假定

模型的估计

模型的检验

05 案例

05 案例

05 案例

学生化残差是残差除以它的标准差 后得到的数值,用以直观地判断误 差项服从正态分布这一假定是否成 立 ,若假定成立,学生化残差的 分布也应服从正态分布。学生化残 差由普通残差推导出,在数据诊断 与残差分析 为零、方差为σ2正态分布。 即,μi ∼ N(0,σ2)

Part 03

多元线性回归模 型

03 多元线性回归模型

03 最小二乘法原理

原理:利用样本回归函数估计总体回归函数,是根据一个给定的包含n组X和Y观测数据的样 本,建立样本回归函数,使估计值尽可能接近观测值YiYˆi。最小二乘原理就是根据使样本剩 余的平方和达到最小的准则,确定模型中的参数,建立样本回归函数(回归系数的最小二乘 估计,包括截距系数和斜率系数)。

2.回归模型的分类 (1)按模型中自变量的多少,分为一元回归模型和多元回归模型。 (2)按模型中参数与被解释变量之间是否线性,分为线性回归模型和非线性回归模型。

01 相关方法演示

“分析”

“相关”

“双变量” “偏相关”

“距离”

双变量:用于进行两个/多个变量间的参 数/非参数相关分析,计算两个变量之间 相关性的强弱,如果是多个变量,则给出 两两相关的分析结果。 偏相关:如果需要进行相关分析的两个 变量其取值均受到其他变量的影响,就 可以利用偏相关分析对其他变量进行控 制,输出控制其他变量影响后的相关系 数。 距离:比较特殊的中间过程,调用此过 程可对同一变量内部各观察单位间的数 值或各个不同变量间进行相似性或不相 似性(距离)分析,前者用于检测观测 值的接近程度,后者则常用于考察各变 量的内在联系和结构。

线性回归分析

表:小区超市的年销售额(百万元)与小区常住人口数(万人)统计表

24

10

01-03 回归分析的应用

分析步骤:(一)

11

01-03 回归分析的应用

分析步骤:(二)

反映模型的拟合度

12

01-03 回归分析的应用

分析步骤:(三) • 一元线性回归 y=kx+b

第三组数据的第1个数据(301.665)是回归直线的截距b,第2个数据( 44.797)也叫回归系数,其实就是回归直线的斜率k。

某一类回归方程的总称回归分析的概念50102?分类1回归分析按照涉及的变量多少分为一一元回归分析多元回归分析2按照自变量和因变量之间的关系类型可分为线性回归分析非线性回归分析回归分析的概念60102?步骤回归分析的概念1

Contents 内 容

01 回归分析的起源 02 回归分析的概念 03 回归分析的应用

22

01-03 回归分析的应用

想一想 做一做:

已 知 2009 — 2015 年 淘 宝 “ 双 11 ” 当天销量统计如图所示,请利用散 点图进行回归分析,模拟淘宝“双 11 ” 的 销 量 变 化 规 律 , 并 预 测 2016年的销量。

23

01-03 回归分析的应用

两种回归分析工具使用总结: • 利用回归分析工具进行线性回归的优缺点如下: ① 优点:可以进行一元线性回归,也可以进行多元线性回归。 ② 缺点:只能进行线性回归,不能直接进行非线性回归。 • 利用散点图和趋势线进行回归分析的优缺点如下: ① 优点:不仅能进行线性回归,还能进行非线性回归。 ② 缺点:只能进行一元回归,不能进行多元回归。

线性回归分析

一元线性回归分析1.理论回归分析是通过试验和观测来寻找变量之间关系的一种统计分析方法。

主要目的在于了解自变量与因变量之间的数量关系。

采用普通最小二乘法进行回归系数的探索,对于一元线性回归模型,设(X1,Y1),(X2,Y2),…,(X n,Y n)是取至总体(X,Y)的一组样本。

对于平面中的这n个点,可以使用无数条曲线来拟合。

要求样本回归函数尽可能好地拟合这组值。

综合起来看,这条直线处于样本数据的中心位置最合理。

由此得回归方程:y=β0+β1x+ε其中Y为因变量,X为解释变量(即自变量),ε为随机扰动项,β0,β1为标准化的偏斜率系数,也叫做回归系数。

ε需要满足以下4个条件:1.数据满足近似正态性:服从正态分布的随机变量。

2.无偏态性:∑(εi)=03.同方差齐性:所有的εi 的方差相同,同时也说明εi与自变量、因变量之间都是相互独立的。

4.独立性:εi 之间相互独立,且满足COV(εi,εj)=0(i≠j)。

最小二乘法的原则是以“残差平方和最小”确定直线位置。

用最小二乘法除了计算比较方便外,得到的估计量还具有优良特性。

最常用的是普通最小二乘法(OLS):所选择的回归模型应该使所有观察值的残差平方和达到最小。

线性回归分析根据已有样本的观测值,寻求β0,β1的合理估计值^β0,^β1,对样本中的每个x i,由一元线性回归方程可以确定一个关于y i的估计值^y i=^β0+^β1x i,称为Y关于x的线性回归方程或者经验回归公式。

^β0=y-x^β1,^β1=L xy/L xx,其中L xx=J12−x2,L xy=J1−xy,x=1J1 ,y=1J1 。

再通过回归方程的检验:首先计算SST=SSR+SSE=J1^y−y 2+J1−^y2。

其中SST为总体平方和,代表原始数据所反映的总偏差大小;SSR为回归平方和(可解释误差),由自变量引起的偏差,放映X的重要程度;SSE为剩余平方和(不可解释误差),由试验误差以及其他未加控制因子引起的偏差,放映了试验误差及其他随机因素对试验结果的影响。

线性回归分析的原理与实现

线性回归分析的原理与实现线性回归分析是一种常见的统计分析方法,用于研究变量之间的关系。

它通过建立一个线性模型,来预测一个或多个自变量对因变量的影响程度。

本文将介绍线性回归分析的原理和实现方法。

一、线性回归分析的原理线性回归分析的核心思想是建立一个线性模型,用于描述因变量和自变量之间的关系。

假设我们有一个因变量Y和一组自变量X1,X2,...,Xn,我们的目标是找到一组系数β0,β1,β2,...,βn,使得线性模型Y = β0 + β1X1 + β2X2 + ... +βnXn能够最好地拟合数据。

为了找到最佳的系数估计值,我们需要最小化观测值与模型预测值之间的差距。

这个差距可以用残差来表示,即观测值与模型预测值之间的误差。

我们的目标是使残差的平方和最小化,即最小二乘法。

最小二乘法的数学表达式为:min Σ(Yi - (β0 + β1X1i + β2X2i + ... + βnXni))^2通过求解最小化残差平方和的问题,我们可以得到最佳的系数估计值,从而建立起线性模型。

二、线性回归分析的实现线性回归分析可以通过多种方法来实现。

下面我们将介绍两种常用的实现方法:普通最小二乘法和梯度下降法。

1. 普通最小二乘法普通最小二乘法是一种解析解的方法,通过求解线性方程组来得到系数的估计值。

假设我们的数据集有m个样本,n个自变量。

我们可以将线性模型表示为矩阵形式:Y = Xβ + ε其中,Y是一个m行1列的向量,表示因变量;X是一个m行n+1列的矩阵,表示自变量和常数项;β是一个n+1行1列的向量,表示系数估计值;ε是一个m行1列的向量,表示误差项。

我们的目标是最小化误差项的平方和,即最小化:min ε^Tε通过求解线性方程组X^TXβ = X^TY,可以得到系数的估计值。

2. 梯度下降法梯度下降法是一种迭代解的方法,通过不断调整系数的估计值来逼近最优解。

梯度下降法的核心思想是通过计算损失函数对系数的偏导数,来确定下降的方向。

线性回归分析

1.4 联立方程模型

1.4.1 联立方程模型 1.4.2 联立方程模型的估计方法

1.4 联立方程组模型

1.4.1 联立方程模型 变量 1. 内生变量(Endogenous Variables) 内生变量是由模型系统决定的,也可能对模型系统产生影响的变量. 被解释变量都是内生变量,当然内生变量也可作解释变量. 一般情况下,内生变量与随机误差项相关. 2. 外生变量(Exogenous Variables) 外生变量是影响模型系统,但本身不受模型系统的影响的变量. 外生变量与随机误差项不相关.

1.3 多元回归分析

1.3.3 多元非线性回归分析 利用柯布道格拉斯生产函数,我们可以建立如下的非线性回归模型:

(1.21)

有的非线性模型可以通过线性化转化为线性回归模型,然后用普通最小二乘法估计参数。例如模型(1.21)两边取自然对数有:

(1.22)

1.3 多元回归分析

1.3.4 回归模型的应用 4. 结构分析 结构分析用来研究经济现象中变量之间的相互关系. 例如进行弹性分析. 设消费Yt和收入Xt满足如下模型: lnYt=a0+a1lnXt (1.25) 模型(1.5)两端对Xt求导可得 a1=(dYt/dXt)·(Yt/Xt) 即a1为消费的收入弹性。因此通过估计模型 lnYt=a0+a1lnXt+mt 可以研究消费的收入弹性。

1.4 联立方程模型

实例 模型估计与检验 EViews操作如下: (1)建立工作文件和输入变量 (2)创立系统方程 点击Objects/New Object/System.

1.4 联立方程模型

实例 在打开的对话框中,选择“System”并在“Name for Object”下给系统对象命名,然后点击OK,这时将打开系统如下的对象窗口,然后可以将方程直接键入窗口.

线性回归分析

线性回归分析线性回归分析是一种统计学方法,用于建立一个自变量和一个或多个因变量之间的线性关系模型。

它是一种常用的预测和解释性方法,在实际问题的应用广泛。

首先,线性回归分析的基本原理是通过找到最佳拟合直线来描述自变量和因变量之间的关系。

这条直线可以用一元线性回归方程 y =β0 + β1*x 表示,其中y是因变量,x是自变量,β0和β1是回归系数。

通过确定最佳拟合直线,我们可以预测因变量的值,并了解自变量对因变量的影响程度。

其次,线性回归分析需要满足一些假设前提。

首先,自变量和因变量之间呈线性关系。

其次,误差项满足正态分布。

最后,自变量之间不具有多重共线性。

如果这些假设得到满足,线性回归模型的结果将更加可靠和准确。

线性回归分析的步骤通常包括数据收集、模型设定、模型估计和模型检验。

在数据收集阶段,我们要搜集并整理相关的自变量和因变量数据。

在模型设定阶段,我们根据问题的需求选择适当的自变量,并建立线性回归模型。

在模型估计阶段,我们使用最小二乘法来估计回归系数,并得到最佳拟合直线。

在模型检验阶段,我们通过检验回归方程的显著性和模型的拟合程度来评估模型的质量。

通过线性回归分析,我们可以进行预测和解释。

在预测方面,我们可以利用回归模型对新的自变量数据进行预测,从而得到相应的因变量值。

这对于市场预测、销售预测等具有重要意义。

在解释方面,线性回归分析可以帮助我们了解自变量对因变量的影响程度。

通过回归系数的大小和正负,我们可以判断自变量对因变量的正向或负向影响,并量化这种影响的大小。

线性回归分析在许多领域都有广泛的应用。

在经济学中,线性回归模型被用于解释经济变量之间的关系,如GDP与失业率的关系。

在医学领域,线性回归模型可以用于预测患者的疾病风险,如心脏病与吸烟的关系。

在工程领域,线性回归模型可以用于预测材料的强度与温度的关系。

总之,线性回归分析在实践中具有广泛的应用价值。

然而,线性回归分析也存在一些局限性。

首先,线性回归模型只能处理线性关系,对于非线性关系的建模效果不佳。

线性回归分析

线性回归分析线性回归是一种广泛应用于统计学和机器学习的分析方法,用于建立和预测两个变量之间的线性关系。

它可以帮助我们理解变量之间的相互作用和影响,并进行未来的预测。

本文将介绍线性回归的基本原理、模型建立过程和一些应用实例。

一、线性回归的基本原理线性回归的目标是通过一条直线(或超平面)来拟合数据点,使得预测值和实际观测值之间的误差最小。

这条直线的方程可以表示为:y=β0+β1*x+ε,其中y是因变量,x是自变量,β0和β1是回归系数,ε是误差项。

线性回归的核心假设是,自变量x和因变量y之间存在线性关系,并且误差项ε服从正态分布。

在此基础上,线性回归通过最小二乘法来估计回归系数β0和β1的值,使得预测值和实际值的误差平方和最小。

二、线性回归的模型建立过程1.数据准备:收集包含自变量和因变量的样本数据,确保数据的质量和准确性。

2.模型选择:根据自变量和因变量之间的性质和关系,选择合适的线性回归模型。

3.模型拟合:使用最小二乘法来估计回归系数β0和β1的值,计算出拟合直线的方程。

4.模型评估:通过误差分析、残差分析等方法来评估模型的拟合效果和预测能力。

5.模型应用:利用已建立的模型进行预测和推断,帮助决策和预测未来的结果。

三、线性回归的应用实例线性回归可以应用于各个领域和实际问题中,下面以几个典型的实例来说明其应用:1.经济学:通过分析自变量(如GDP、通货膨胀率)对因变量(如消费水平、投资额)的影响,可以建立GDP与消费的线性回归模型,预测未来消费水平。

2.市场营销:通过分析广告投入与销售额之间的关系,可以建立销售额与广告投入的线性回归模型,帮助制定广告投放策略。

3.医学研究:通过收集患者的生理指标(如血压、血糖水平)和疾病状况,可以建立生理指标与疾病发展程度的线性回归模型,帮助疾病诊断和治疗。

4.金融风险管理:通过分析利率、汇率等宏观经济变量与企业盈利、股价波动之间的关系,可以建立风险预警模型,帮助企业进行风险控制和决策。

线性回归分析

r 2 SSR / SST 1 SSE / SST L2xy Lxx Lyy

❖

两个变量之间线性相关的强弱可以用相关系数r(Correlation

coefficient)度量。

❖ 相关系数(样本中 x与y的线性关系强度)计算公式如下:

❖ 统计学检验,它是利用统计学中的抽样理论来检验样本 回归方程的可靠性,具体又可分为拟合程度评价和显著 性检验。

1、拟合程度的评价

❖ 拟合程度,是指样本观察值聚集在估计回归线周围的紧密 程度。

❖ 评价拟合程度最常用的方法是测定系数或判定系数。 ❖ 对于任何观察值y总有:( y y) ( yˆ y) ( y yˆ)

当根据样本研究二个自变量x1,x2与y的关系时,则有

估计二元回归方程: yˆ b0 b1x1 b2 x2

求估计回归方程中的参数,可运用标准方程如下:

L11b1+L12b2=L1y

L12b1+L22b2=L2y b0 y b1 x1 b2 x2

例6:根据表中数据拟合因变量的二元线性回归方程。

21040

x2

4 36 64 64 144 256 400 400 484 676

2528

练习3:以下是采集到的有关女子游泳运动员的身高(英寸)和体

重(磅)的数据: a、用身高作自变量,画出散点图 b、根据散点图表明两变量之间存在什么关系? c、试着画一条穿过这些数据的直线,来近似身高和体重之间的关 系

测定系数与相关系数之间的区别

第一,二者的应用场合不同。当我们只对测量两个变量之间线性关系的 强度感兴趣时,采用相关系数;当我们想要确定最小二乘直线模型同数据符 合的程度时,应用测定系数。

线性回归分析

第五节 多元线性回归分析

一、多元线性回归分析概述

多元线性回归模型

y 0 1x1 2x2 L mxm

式中β0 β1 β2 … βm 为〔偏〕回归系数 多元线性回归方程

由x预测y时,y有一定的误差,其标准误差为:

sy se

1 1 x x 2

n SSx

因此由x预测y时,y 的95%置信区间为:

yˆ t0.05 sy

实例: 由x预测y的预测区间

第一步:计算当x=2500时, y 的点估计值:

yˆ 190.955 0.094868 2500 428.125

实例:t 检验

dfe n 2 10 2 8, t0.05 2.306,t0.01 3.355 | t | 18.14 t0.01 3.355

结论:回归关系极显著,可得线性回归方程

yˆ 190.955 0.094868x

用光照强度来预测净光合强度是合理的。

第四节 预测值的置信区间

C(i+1)(i+1)为矩阵(X’X)-1的(i+1)(i+1)元素 Q 为误差平方和,自由度:df=n-m-1

第五节 多元线性回归分析

2、回归系数的假设检验

2〕F检验 原假设 H0 :βi=0

统计量为: F

Ui

bi2 / c(i1)(i1)

Q / n m 1 Q / n m 1

其中:Ui 为xi对y的回归平方和,Q 为误差平方和 C(i+1)(i+1)为矩阵(X’X)-1的(i+1)(i+1)元素 自由度:df1 = 1 df2 = n-m-1

报告中的线性回归分析与结果解读

报告中的线性回归分析与结果解读标题一:线性回归分析的基础概念线性回归分析是统计学中常用的一种分析方法,它用于研究两个或更多变量之间的关系。

本节将介绍线性回归的基础概念,包括回归方程、自变量和因变量的定义以及回归系数的含义。

在线性回归中,我们研究的目标变量被称为因变量,记作Y。

而用来预测或解释因变量的变量被称为自变量,记作X。

回归方程可以用来描述因变量和自变量之间的关系,其形式为Y = β0 + β1X1 + β2X2 + ... + βkXk + ε,其中β0、β1、β2...βk 是回归系数,表示自变量对因变量的影响程度,ε是误差项。

线性回归分析的目标是找到最佳的回归系数,使得观测值与回归方程的预测值之间的误差最小化。

一种常用的求解方法是最小二乘法,通过最小化残差平方和来估计回归系数。

解释变量的选择对回归结果的解释能力有重要影响,通常需要依据领域知识、相关性分析等方法进行选择。

标题二:线性回归模型的拟合优度评估线性回归分析的结果需要进行拟合优度评估,以判断回归方程的拟合程度。

一种常用的方法是使用R方(决定系数),它表示因变量的变异中可以被自变量解释的比例。

R方的取值范围在0到1之间,越接近1表示回归方程对观测数据的解释能力越强。

除了R方之外,我们还可以使用调整后的R方(Adjusted R-square)来评估模型拟合优度。

调整后的R方考虑了自变量个数对R方的影响,避免了自变量个数增加而导致R方过高的问题。

此外,我们还可以通过回归分析的残差分布来评估模型的拟合优度。

残差是观测值与回归方程预测值之间的差异,如果残差满足独立性、正态性和方差齐性的假设,表示回归模型对数据的拟合比较好。

标题三:回归系数的显著性检验在线性回归分析中,显著性检验用于判断自变量对因变量的影响是否显著。

常用的显著性检验方法包括t检验和F检验。

对于单个自变量,t检验用于检验自变量的回归系数是否显著。

t统计量的计算公式为t = βj / SE(βj),其中βj是回归系数,SE(βj)是标准误。

线性回归分析

注意: 逐步添加法或逐步剔除法, 都应当强调“逐步” . 不 能一次按照各个变量的统计量的值 fj 的显著性概率 p 是否 小于等于选定的显著性水平 , 来决定是否作为 Y 的自变 量. 因为每添加或剔除一个变量, 都会引起所有回归系数的 变化和统计量的值 fj 的变化. 一次处理会造成误判, 只有逐 步处理, 才是恰当的.

= ( 1, 2, …, k)T

若估计出, ˆ (ˆ1, ˆ2 ,, ˆk )T 则有 Yˆ Xˆ

所以

Y Yˆ e

于是有 Y Yˆ e Xˆ e

两边左乘XT, 得 X T Y X T Xˆ X T e

由几何解释XT e , 故有XTe = 0, 所以可以求出:

Y 1 2X u

其中 ˆ1, ˆ2 为1, 2 的估计值, 则 Y 的计算值Ŷ, 可以

用下式表达:

Yˆ ˆ1 ˆ2 X

所要求出待估参数 ˆ1, ˆ2, 要使 Y 与其计算值Ŷ之间 的“误差平方和”最小. 即: 使得

Q

(Y

Yˆ

2

)

ei2

(4) u ~ N(0, 2u In )

(5) E(XTu) =0 , 或者, X 为确定矩阵

1 X12 X1k

X

1 1

X 22

X n2

X2k

X nk

(6) 秩 ( X ) = k, ( k<n)

2. 普通最小二乘法估计式

在模型中, 代入样本观测值之后, 可得

人均收入X

这两个变量之间的不确定关系,大致可以用下式表示:

Y 1 2 LnX u

线性回归分析

线性回归分析随着社会的发展,经济体制的改革,经济管理人员迫切需要了解到投资项目或者是工程项目的影响因素,这些对投资项目具有直接或间接的影响,通过各种各样的经济分析和技术分析方法来进行综合评价。

为了使我国在日趋激烈的竞争中立于不败之地,必须注重微观管理的决策水平,强化管理手段,而其中最有效的手段之一就是运用线性回归分析方法来确定最优方案。

线性回归分析就是根据两个或多个随机变量X、 Y的相关关系,将X的值代入一个参数方程,求出解,再利用参数的数值判断该方程能否描述这两个变量之间的关系。

线性回归分析的主要作用在于:第一,判断两个随机变量是否线性相关;第二,确定参数;第三,检验假设。

一、线性回归分析方法的介绍回归分析是数理统计的基础,它可以确定被试某种因素和某些指标之间的函数关系,也可以确定一组指标与另一组指标之间的函数关系。

一般我们常用的是线性回归分析。

线性回归分析,也称为“回归”,是数学统计学的一个基本概念。

所谓线性回归,就是依照“自变量”与“因变量”的关系,运用数学公式,将自变量的变化,导致因变量的变化,用回归方程描绘出来。

回归分析是一门应用性很强的学科,在解决实际问题时,既可以从数学上证明或计算出有关结果,又可以直接利用回归分析的结果加以利用,从而弥补了试验设计的不足。

1、解释变量变量就是要研究的因变量,通过解释变量来解释自变量的变化。

2、自变量自变量就是我们要研究的原因变量,即导致投资项目X变化的原因。

3、回归直线通过回归直线将自变量Y与因变量X之间的相互关系表现出来,反映自变量变化情况,并说明因变量X的变化对自变量Y的影响。

4、相关系数相关系数是一种表示自变量与因变量之间关系密切程度的统计量。

在同一时期内,各因素间的相关程度,相关大小的程度用r来表示。

5、 R统计量R统计量是研究对比某两种现象之间的数量关系的统计量。

2、自变量就是我们要研究的原因变量,即导致投资项目X变化的原因。

3、回归直线通过回归直线将自变量Y与因变量X之间的相互关系表现出来,反映自变量变化情况,并说明因变量X的变化对自变量Y的影响。

线性回归分析方法

线性回归分析方法线性回归是一种常用的统计分析方法,用于研究自变量与因变量之间的线性关系。

本文将介绍线性回归的基本原理、模型假设、参数估计方法以及结果解释等内容,帮助读者更好地理解和应用线性回归分析方法。

一、线性回归的基本原理线性回归假设自变量和因变量之间存在线性关系,通过拟合一个线性方程来描述这种关系。

假设我们有一个因变量Y和一个自变量X,线性回归模型可以表示为:Y = β0 + β1X + ε其中,β0是截距,β1是自变量的回归系数,ε是误差项,表示模型无法完全解释的因素。

线性回归的目标是找到最佳的回归系数,使得预测值与真实值之间的误差最小化。

二、线性回归的模型假设在线性回归分析中,有几个关键的假设前提需要满足:1. 线性关系假设:自变量和因变量之间的关系是线性的。

2. 独立性假设:观测样本之间是相互独立的,误差项之间也是独立的。

3. 同方差性假设:误差项具有相同的方差,即误差项的方差在不同的自变量取值下是恒定的。

4. 正态性假设:误差项服从正态分布。

如果以上假设不满足,可能会导致线性回归分析的结果不可靠。

三、线性回归的参数估计方法线性回归的参数估计方法通常使用最小二乘法(Ordinary Least Squares, OLS)来确定回归系数。

最小二乘法的思想是通过最小化观测值与估计值之间的残差平方和来拟合回归模型。

具体而言,我们可以通过以下步骤来估计回归系数:1. 计算自变量X和因变量Y的均值。

2. 计算自变量X和因变量Y与其均值的差。

3. 计算X与Y的差乘积的均值。

4. 计算X的差的平方的均值。

5. 计算回归系数β1和β0。

四、线性回归模型的结果解释线性回归模型的结果可以用来解释自变量对因变量的影响程度以及回归系数的显著性。

通常我们会关注以下几个指标:1. 回归系数:回归系数β1表示自变量X单位变化时,因变量Y的平均变化量。

回归系数β0表示当自变量X为零时,因变量Y的平均值。

2. R平方:R平方是衡量模型拟合优度的指标,它表示因变量Y的变异中有多少百分比可以由自变量X来解释。

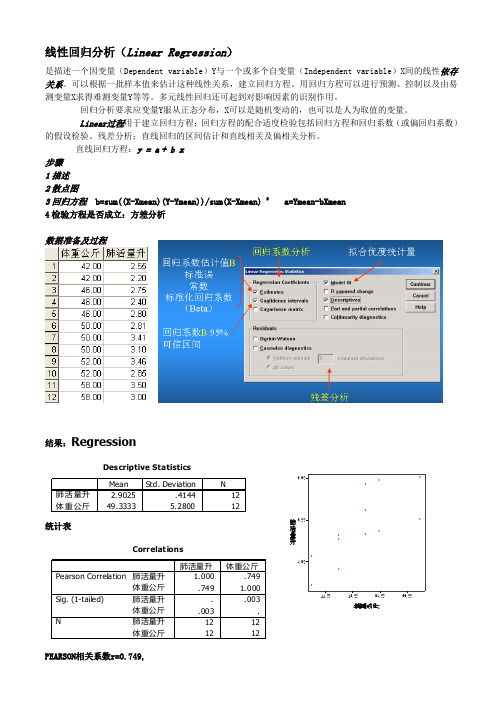

线性回归分析(Linear Regression)

线性回归分析(Linear Regression )是描述一个因变量(Dependent variable )Y 与一个或多个自变量(Independent variable )X 间的线性依存关系。

可以根据一批样本值来估计这种线性关系,建立回归方程。

用回归方程可以进行预测、控制以及由易测变量X 求得难测变量Y 等等。

多元线性回归还可起到对影响因素的识别作用。

回归分析要求应变量Y 服从正态分布,X 可以是随机变动的,也可以是人为取值的变量。

Linear 过程用于建立回归方程;回归方程的配合适度检验包括回归方程和回归系数(或偏回归系数)的假设检验、残差分析;直线回归的区间估计和直线相关及偏相关分析。

直线回归方程:y = a + b x步骤 1描述 2散点图3回归方程 b=sum((X-Xmean)(Y-Ymean))/sum(X-Xmean) 2 a=Ymean-bXmean4检验方程是否成立:方差分析数据准备及过程结果:RegressionDescriptive Statistics2.9025.41441249.33335.280012肺活量升体重公斤Mean Std. DeviationN统计表Correlations1.000.749.7491.000..003.003.12121212肺活量升体重公斤肺活量升体重公斤肺活量升体重公斤Pearson Correlation Sig. (1-tailed)N 肺活量升体重公斤PEARSON 相关系数r=0.749,体重公斤2.503.003.50肺活量升✌✌✌✌✌✌✌✌✌✌✌✌相关系数假设检验H0: ρ=0 两变量无直线相关关系H1: ρ≠0 两变量有直线相关关系a=0.05t=r/sqrt((1-r2)/n-2)t=3.58 v=10 0.005>p>0.002,按a=0.05水平拒绝H0,接受H1,体重与肺活量间成正直线关系引入或剔险变量表模型摘要表SS总(TOTAL SQUARES)=SS回(REGRESSION)+SS剩(RESIDUAL)假设 H0 β总体回归系数=0 无直线关系H1 β≠0 有直线关系a=0.05方程: Y肺活量=0.000413(constant)+0.058833X(体重)****PEMS 结果出现重大偏倚****│直线回归│数据文件名:E:\医学统计\学习笔记\直线回归.xls自变量X的变量名: F1因变量Y的变量名: F2样本例数: n=11均数和标准差───────────────────────变量均数标准差───────────────────────X 50.0000 4.9800Y 2.9345 0.4188───────────────────────直线回归方程:Y=-0.134+0.0614X直线回归的假设检验:方差分析表─────────────────────────────────────变异来源离均差平方和自由度均方 F P ─────────────────────────────────────总 1.7537 10回归 0.9341 1 0.9341 10.2569 0.0108 剩余 0.8196 9 0.0911─────────────────────────────────────【本分析结果完毕】。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

野外实习资料的数理统计分析一元线性回归分析一元回归处理的是两个变量之间的关系,即两个变量X和Y之间如果存在一定的关系,则通过观测所得数据,找出两者之间的关系式。

如果两个变量的关系大致是线性的,那就是一元线性回归问题。

对两个现象X和Y进行观察或实验,得到两组数值:X1,X2,…,Xn和Y1,Y2,…,Yn,假如要找出一个函数Y=f(X),使它在X=X1,X2, …,Xn时的数值f(X1),f(X2), …,f(Xn)与观察值Y1,Y2,…,Yn趋于接近。

在一个平面直角坐标XOY中找出(X1,Y1),(X2,Y2),…,(Xn,Yn)各点,将其各点分布状况进行察看,即可以清楚地看出其各点分布状况接近一条直线。

对于这种线性关系,可以用数学公式表示:Y = a + bX这条直线所表示的关系,叫做变量Y对X的回归直线,也叫Y对X的回归方程。

其中a为常数,b为Y对于X的回归系数。

对于任何具有线性关系的两组变量Y与X,只要求解出a与b的值,即可以写出回归方程。

计算a与b值的公式为:式中:为变量X的均值,Xi为第i个自变量的样本值,为因变量的均值,Yi为第i个因变量Y的样本值。

n为样本数。

当前一般计算机的Microsoft Excel中都有现成的回归程序,只要将所获得的数据录入就可自动得到回归方程。

得到的回归方程是否有意义,其相关的程度有多大,可以根据相关系数的大小来决定。

通常用r来表示两个变量X和Y之间的直线相关程度,r为X和Y的相关系数。

r值的绝对值越大,两个变量之间的相关程度就越高。

当r为正值时,叫做正相关,r为负值时叫做负相关。

r 的计算公式如下:式中各符号的意义同上。

在求得了回归方程与两个变量之间的相关系数后,可以利用F检验法、t检验法或r检验法来检验两个变量是否显著相关。

具体的检验方法在后面介绍。

2.多元线性回归分析一元回归研究的是一个自变量和一个因变量的各种关系。

但是客观事物的变化往往受到多种因素的影响,即使其中有一个因素起着主导作用,但其它因素的作用也是不可忽视的。

因此,我们还需要研究多种变量的关系,这种多个变量之间的关系就叫做多元回归问题。

例如,水稻的产量不仅与生长期内的雨量有关,而且与温度也有关系。

所以寻求水稻的产量不仅与生长期内的雨量之间的相互关系,就是多元回归问题。

如果假设自变量为X1,X2,…,Xm,因变量为Y,而且因变量与自变量之间是线性的关系,则因变量Y与自变量为X1,X2,…,Xm的多元线性回归方程为:Y = a+b1X1+b2X2+…+bmXm式中:a,b1,b2,bm为常数。

因此,只要能够求出a,b1,b2,…,bm这些常数,就可以得到因变量Y与自变量为X1,X2,…,Xm之间的多元回归方程。

具体的算法比较简单,但很烦琐。

这里不再叙述。

求解多元回归的计算机程序很多,只要将自变量的数据以及与其相对应的因变量的数据输入计算机程序中,立刻就可以求出a,b1,b2,…,bm各常数的值,从而可以获得因变量Y与自变量为X1,X2,…,Xm的多元线性回归方程。

例如,设已知因变量Y的自变量X1,X2,X3,共得18组数据,并已知Y对Xi存在着线性关系,求其回归方程。

样品X1 X2 X3 Y1 0.4 53 158 642 0.4 23 163 603 3.1 19 37 714 0.6 34 157 615 4.7 24 59 546 1.7 65 123 777 9.4 44 46 818 10.1 31 117 939 11.6 29 173 9310 12.6 58 112 5111 10.9 37 111 7612 23.1 46 114 9613 23.1 50 134 7714 21.6 44 73 9315 23.1 56 168 9516 1.9 36 143 5417 26.8 58 202 16818 29.9 51 124 99通过求解,得到a=41.6516b1=1.7410b2=-0.0062b3=0.1553所以,回归方程为Y=41.6516+1.7410 X1 -0.0062 X2+0.1553 X3通常可采用单相关系数、偏相关系数和复相关系数来说明这三个自变量与因变量之间是否有明显的线性关系以及它们之间相关的程度如何。

单相关系数是指在不考虑其他因素影响的条件下,所求两个变量之间的相关系数。

用rX1X2、rYX1和rYX2分别表示X1和X2、Y和X1以及Y与X2之间的单相关系数。

偏相关系数是指在这三个变量中,将其中一个变量保持常数时,其他两个变量之间的相关系数。

用rYX1X2和rYX2X1分别表示X2为常数时,Y与X1的偏相关系数和X1为常数时,Y与X2的偏相关系数。

偏相关系数可以用单相关系数求得。

当这三个变量中,同时考虑两个变量对另一个变量相关系数时,叫做复相关系数。

用r(X1X2)Y表示X1和X2、两个自变量对于Y的复相关系数。

3.方差分析方差分析法是分析多组平均数之间差异显著性时常用的一种统计方法。

方差(或均方)是一个表示变异程度的量,它是离均差的平方和与自由度之商。

在一项实验或调查中往往存在着许多造成生物形状变异的因素,这些因素有比较重要的,也有较次要的。

分析时主要是把平方和与自由度按不同的变异起因分解为若干部分,从而构成来自不同起因的方差。

利用它来检验各组平均数之间差异的显著性。

在正态总体及方差相同的基本假定下,我们将利用方差比给出F分布的检验统计量。

因此这种方法称为方差分析法。

方差分析是分析和处理试验或观测数据的主要方法之一。

它首先被应用于农业试验,目前它在农业、工业、生物、医学等各部门有着广泛的应用。

方差分析的方法往往与试验设计的方式紧密地联系在一起。

对于从不同试验设计中得出观测资料,进行方差分析时将有不同的计算方法,类型繁多,但其基本原理却大同小异。

在这里将结合一个较简单的例子介绍方差分析的数学模型和基本方法,以便于读者对方差分析的方法有一个大致的了解。

在实验设计的基础上,分组试验,如分为a组,每组作b个水平的试验,共得到a×b个数据。

然后,算出组平均值和总平均值,组内和组间的离差平方和,组内和组间方差,作F检验。

F=组间方差/组内方差假设HO: μ1 =μ2=···=μb ,表示各水平的均值相等。

当F ≤Fα 时,HO: 真;当F > Fα时,HO:假。

试验中必不可少地会产生误差。

误差有两种:条件误差和试验误差。

前者是由试验条件不同而引起的系统性误差,后者是在相同试验条件下引起的随机误差。

例如,把四种不同的饲料分别喂给4组小鸡,每组5只,它们的增重情况如下:组别增重(Xij)1 55494221522 611123089633 42978195924 16913716885153试问四组小鸡在平均增重量方面有没有明显的差别?通过计算,得到组内和组间方差分别为719.2和8706.3,因此,F=8706.3/719.2=12.1对于给定的显著性水平α,将有临界值Fα一,当α=0.01时,F0.01(3,16)=5.3,其中3与16是自由度。

所以F=12.1>5.3= F0.01(3,16)故,否定各种饲料效果一致的假设,可以认为四种饲料的效果有极明显的差别。

目前现成的计算机方差分析计算程序很多,如SPASS、SAS软件等,将数据输入后,都可以直接计算,并按要求输出结果。

上述例子是单因素的方差分析,比较简单。

对于多因素的方差分析,由于比较复杂,这里就不再叙述了。

4. T检验生物学中所遇到的绝大多数问题,总体标准差σ都是未知的。

在σ未知时,平均数的显著性检验有两种解决方法。

其一是根据以往的经验或从类似的工作中估计出一个σ值,用这个σ做μ检验。

使用估计的σ做检验并不是很可靠的。

因此在实际工作中,一般不用这种方法而广泛使用t检验。

对于一个正态分布总体,若σ未知则服从n-1自由度的t分布,因此,在σ未知时可以用t检验做平均数的显著性检验。

t检验的零假设H0为:μ=μ0备择假设有以下三种情况:(1)HA:μ>μ0,若已知μ不可能小于μ0;(2)HA:μ<μ0,若已知μ不可能大于μ0;(3)HA:μ≠μ0,包括μ>μ0和μ<μ0 。

三种备择假设的拒绝域为:(1)t>tα ;(2)t< -tα;(3)t > tα/2,或表示为t > tα(双侧)。

其中α为给定的显著性水平。

t检验的统计量为:t = (-μ0)/(s/n1/2)例如,已知玉米单交种群单105的平均穗重μ0=300克,喷药后,随机抽取9个果穗,其穗重为分别:308、305、311、298、315、300、321、294、320克。

问喷药后与喷药前的果穗重差异是否显著?根据上面介绍的基本程序:已知玉米穗重是服从正态分布的随机变量,σ未知。

(2)假设:H0 :μ=μ0=300HA:μ≠μ0=300由于问题要求检验的是“果穗重差异是否显著”,并没有明确穗重一定增加或一定减少,所以备择假设为HA:μ≠μ0(3)显著性水平:根据实验的要求(差异是否“显著”)规定α=0.05。

(4)统计量的值:由于σ未知需使用t检验。

t = (-μ0)/(s/n1/2)t = (308-3000)/(9.62/91/2)=2.49(5)建立的拒绝域H0:因HA:μ≠μ0,所以是双侧检验。

当t > t0.05(双侧)时拒绝H0,α=0.05时,经查表t8,0.05(双侧)=2.306。

(6)结论:因t =2.49> t8,0.05(双侧)=2.306 ,所以结论是拒绝H0,接受HA。

即喷药前后果穗重的差异是显著的。

5. F检验t检验属于单个样本的显著性检验,即在样本统计量与零假设所提出的总体参量之间做比较。

这种检验需要我们事先能够提出合理的参量假设值和对参量有某种意义的备择值。

然而,在实际工作中,很难提出这样的假设值及备择值。

因此,限制了这种方法在实际工作中的应用。

为了避免上述问题的出现,在实际应用时,常常选择两个样本,一个作为处理,一个作为对照。

在这两个样本之间做比较。

判断它们之间是否存在足够显著的差异。

当它们之间的差异不能用偶然性解释时,则认为它们之间存在足够显著的差异,这两个样本来自两个不同的总体。

而F检验是关于两个方差的检验,所以常用F检验来解决上述问题。

F检验的程序概述如下:(1)假定从两个正态总体中,独立地抽取含量分别为n1和n2的两个随机样本,计算出s12和s22。

总体平均数μ1和μ2可以相等也可以不相等。

(2)零假设H0为:σ1=σ2备择假设有以下三种情况:(1)HA:σ1>σ2,若已知σ1不可能小于σ2;(2)HA:σ1<σ2,若已知σ1不可能大于σ2;(3)HA:σ1≠σ2 ,包括σ1>σ2和σ1<σ2 。