SAS系统和数据分析逐步回归分析

sas回归分析

sas回归分析数据预处理->数据探索->模型选择->残差检验、共线性争端,强影响点判断->模型修正(否->模型选择,是->模型预测)⼀:数据预处理⼆:数据探索看y是否服从正态分布(PP图)proc univariate data=reg.b_fitness;var Runtime -- Performance;histogram Runtime -- Performance / normal; /*主要从统计指标上⾯看*/probplot Runtime -- Performance /normal (mu=est sigma=est color=red w=2);/*主要从图形来看*/run;看x的离散程度(散点图)看y与x的相关系数(散点图,R^2)proc gplot data=reg.b_fitness;plot Oxygen_Consumption *(Run_PulseRest_PulseMaximum_PulsePerformanceRuntimeAgeWeight);symbol v=dot color=red;run;quit;proc corr data=reg.b_fitness;var Run_Pulse Rest_Pulse Maximum_Pulse Performance Runtime Age Weight;with Oxygen_Consumption;run;三:模型选择CP法(全模型法)功能:在特定的模型⼤⼩范围内,找出指定的最佳模型(具有最⼩CP)BEST=N 表⽰在不同的变量个数组成的模型中,选择N个最好的模型,所有组合数为[2^(变量个数)-1]在由1个⾃变量组成的模型中选N个最好的在由2个⾃变量组成的模型中选N个最好的。

在由M(总共变量的个数)个⾃变量组成的模型中选N个最好的总共会选M*N个模型这⾥统计量为Cp,建议是Cp<=p ,p是所有变量个数加1逐步法向前回归法特点:和变量进⼊的顺序有很⼤关系,如果第⼀个进来的变量的解释效应过⼤,很可能造成后进的变量进不来模型引⼊第⼀个变量进⼊⽅程,对整个⽅程进⾏F检验,并对单个回归系数进⾏T检验,计算残差平⽅和Se1,如果通过检验则保留,否则剔除引⼊第⼆个变量进⼊⽅程,对整个⽅程进⾏F检验,并对单个回归系数进⾏T检验,计算残差平⽅和Se2,那么Se1>Se2,称Se1-Se2为第⼆个变量的偏回归平⽅和,如果该值明显偏⼤,则保留,说明其对因变量有影响,否则剔除。

第7章SAS统计相关与回归分析

第7章SAS统计相关与回归分析相关与回归分析是SAS统计的重要方法之一,用于研究变量之间的关系以及预测和解释变量的变化。

本文将介绍相关与回归分析的基本概念、方法和SAS的实现步骤。

相关分析是一种用来衡量两个或多个变量之间关系强度的统计方法。

它可以通过计算相关系数来量化这种关系。

相关系数的取值范围在-1到1之间,其中1表示完全正相关,-1表示完全负相关,0表示没有相关性。

常用的相关系数有皮尔逊相关系数和斯皮尔曼相关系数。

皮尔逊相关系数用于度量两个连续变量之间的线性关系,而斯皮尔曼相关系数则适用于度量有序变量之间的非线性关系或连续变量之间的非线性关系。

回归分析则是用来建立和预测两个或多个变量之间关系的方法。

它可以通过构建回归模型来找到自变量与因变量之间的最佳拟合线。

常用的回归模型有简单线性回归和多元线性回归。

简单线性回归是指只有一个自变量与一个因变量之间的关系,而多元线性回归则指有多个自变量与一个因变量之间的关系。

回归模型的好坏可以通过R方值来评估,其值越接近1表明模型的拟合度越好。

在SAS中进行相关与回归分析需要使用PROCCORR和PROCREG两个过程。

PROCCORR用于计算相关系数,而PROCREG则用于建立和拟合回归模型。

首先,我们使用PROCCORR过程计算相关系数。

以下是SAS代码示例:```proc corr data=dataset;var variable1 variable2;run;```其中,dataset代表数据集的名称,variable1和variable2代表需要计算相关系数的变量。

运行以上代码后,SAS会输出皮尔逊相关系数和斯皮尔曼相关系数的结果。

接下来,我们使用PROCREG过程进行回归分析。

以下是SAS代码示例:```proc reg data=dataset;model dependent = independent1 independent2;run;```其中,dependent代表因变量,independent1和independent2代表自变量。

SAS系统和数据分析一元线性回归分析

第三十一课一元线性回归分析回归分析是一种统计分析方法,它利用两个或两个以上变量之间的关系,由一个或几个变量来预测另一个变量。

在SAS/STA T中有多个进行回归的过程,如REG、GLM等,REG过程常用于进行一般线性回归模型分析。

一、回归模型1. 基本概念回归模型是一种正规工具,它表示统计关系中两个基本的内容:①用系统的形式表示因变量Y随一个或几个自变量X变化的趋势;②表现观察值围绕统计关系曲线的散布情况。

这两个特点是由下列假设决定的:●在与抽样过程相联系的观察值总体中,对应于每一个X值,存在Y的一个概率分布;这些概率分布的均值以一些系统的方式随X变化。

●图31.1是用透视的方法来显示回归曲线。

Y对给定X具有概率分布这一概念总是与统计关系中的经验分布形式上相对应;同样,描述概率分布的均值与X之间关系的回归曲线,与统计关系中Y系统地随X变化的一般趋势相对应。

图31.1线性回归模型的图示在回归模型中,X称为“自变量”,Y称为“因变量”;这只是传统的称法,并不表明在给定的情况下Y因果地依赖于X,无论统计关系多么密切,回归模型不一定是因果关系,在某些应用中,比如我们由温度表水银柱高度(自变量)来估计温度(因变量)时,自变量实际上依赖于因变量。

此外,回归模型的自变量可以多于一个。

2. 回归模型的构造(1)自变量的选择构造回归模型时必须考虑到易处理性,所以在有关的任何问题中,回归模型只能(或只应该)包括有限个自变量或预测变量。

(2) 回归方程的函数形式选择回归方程函数形式与选择自变量紧密相关。

有时有关理论可能指出适当的函数形式。

然而,通常我们预先并不能知道回归方程的函数形式,要在收集和分析数据后,才能确定函数形式。

我们经常使用线性和二次回归函数来作为未知性质回归方程的最初近似值。

图31.2(a)表示复杂回归函数可以由线性回归函数近似的情况,图31.2(b)表示复杂回归函数可以由两个线性回归函数分段近似的情况。

SAS整理下之相关分析和回归分析

SAS整理下之相关分析和回归分析相关分析1.⽤INSIGHT模块作相关分析先说⼀下建⽴数据集,找到题中的某句话的意思是,“为了弄清楚。

形成的原因,或者是为了分析。

的影响因素。

”找到这句话就成功⼀半了,将这个。

元素就写到Y的列下,其他的元素就设成X1 X2。

这样,有⼏个元素就⼏列,但是Y只有⼀列,⽽X就看题中给得了!!1. 制作散点图⾸先制作变量之间的散点图,以便判断变量之间的相关性。

步骤如下:1) 在INSIGHT模块中,打开数据集;2) 选择菜单“Analyze(分析)”→“Scatter Plot (Y X)(散点图)”;3) 在打开的“Scatter Plot (Y X)”对话框中选定Y变量:Y;选定X变量:x1、x2、x3、x4;4) 单击“OK”按钮,得到变量的分析结果。

从各散点的分布情况看,初步有⼀个跟每个元素的线性关系密切或不密切就⾏了。

2. 相关系数计算1) 在INSIGHT模块中,打开数据集;2) 选择菜单“Analyze(分析)”→“Multivariate (Y X)(多变量)”;3) 在打开的“Multivariate (Y X)”对话框中选定Y变量:Y;选定X变量:x1、x2、x3、x4;4) 单击“OK”按钮,得到分析结果。

结果显⽰各变量的统计量和相关(系数)矩阵,从相关矩阵中可以看出,相关系数⾼的就关系密切,相关系数低的就关系不密切。

5) 为了检验各总体变量的相关系数是否为零,选择菜单:“Tables”→“CORR p-values”,得到相关系数为零的原假设的p值,如图所⽰。

基于这些p值,拒绝原假设,即Y因素与其他⼏个变量之间均存在着显著的正相关关系;若p值>0.05,则⽆法拒绝原假设。

3. 置信椭圆继续上述步骤。

6) 选择菜单:“Curves”→“Scatter Plot Cont Ellipse”→“Prediction:95%”,得到Y与其他⼏个变量的散点图及预测值的置信椭圆变量Y和x1间散点图上的这个椭圆被拉得很长,表明变量Y和x1之间有很强的相关性。

SAS-4-回归与相关分析

一、利用SAS进行回归和相关分析 二、利用Excel的分析工具库进行回归

和相关分析

直线回归分析

直线回归分析(Linear Regression)是基于最小二 乘法(Least Square Method)原理产生的最优无偏 估计。

它是研究一个自变量(Independent)与一个因变 量(Dependent)之间是否存在某种线性关系的统 计学方法。

byx SPxy

b

2 yx

SS

x

SPx2y SS x

SSe SS y SSR

回归方程显著性检验的方差分析表

变异来源 回归 离回归 总平方和

平方和

SSR SSe SSy

自由度

dfR=1 dfe=n-2 dfy=n-1

均方 MSR=SSR/dfR MSe=SSe/dfe

F值 F=MSR/MSe

回归系数和回归截距的显著性检验

直线回归分析又叫简单回归分析(Simple Regression)。

回归分析基本公式

byx

SPxy SS x

,a

y byx x

SPxy (x x)( y y) ;

SS x (x x) 2

直线回归方程的显著性检验

SS y ( yˆ y) 2 ( yi yˆ ) 2

SS R

相关系数与协方差的计算

简单相关系数的基本公式

rxy

SPxy SSx SS y

SPxy (x x)(y y)

SSy ( y y)2

SSx (x x)2

CORREL( ) 函数

协方差的计算

协方差的基本公式

总体协方差

cov xy

SPxy n

样本协方差

(整理)SAS讲义第三十三课逐步回归分析.

第三十三课 逐步回归分析一、 逐步回归分析在一个多元线性回归模型中,并不是所有的自变量都与因变量有显著关系,有时有些自变量的作用可以忽略。

这就产生了怎样从大量可能有关的自变量中挑选出对因变量有显著影响的部分自变量的问题。

在可能自变量的整个集合有40到60个,甚至更多的自变量的那些情况下,使用“最优”子集算法可能并不行得通。

那么,逐步产生回归模型要含有的X 变量子集的自动搜索方法,可能是有效的。

逐步回归方法可能是应用最广泛的自动搜索方法。

这是在求适度“好”的自变量子集时,同所有可能回归的方法比较,为节省计算工作量而产生的。

本质上说,这种方法在每一步增加或剔除一个X 变量时,产生一系列回归模型。

增加或剔除一个X 变量的准则,可以等价地用误差平方和缩减量、偏相关系数或F 统计量来表示。

无疑选择自变量要靠有关专业知识,但是作为起参谋作用的数学工具,往往是不容轻视的。

通常在多元线性模型中,我们首先从有关专业角度选择有关的为数众多的因子,然后用数学方法从中选择适当的子集。

本节介绍的逐步回归法就是人们在实际问题中常用的,并且行之有效的方法。

逐步回归的基本思想是,将变量一个一个引入,引入变量的条件是偏回归平方和经检验是显著的,同时每引入一个新变量后,对已选入的变量要进行逐个检验,将不显著变量剔除,这样保证最后所得的变量子集中的所有变量都是显著的。

这样经若干步以后便得“最优”变量子集。

逐步回归是这样一种方法,使用它时每一步只有一个单独的回归因子引进或从当前的回归模型中剔除。

Efroymoson (1966)编的程序中,有两个F 水平,记作F in 和F out ,在每一步时,只有一个回归因子,比如说X i ,如果剔除它可能引起RSS 的减少不超过残差均方MSE (即ESS/(N-k-1))的F out 倍,则将它剔除;这就是在当前的回归模型中,用来检验 βi =0的F 比=MSE x x x RSS x x x x RSS i i i /)),,(),,,((121121---ΛΛ是小于或等于F out 。

sas 课件第6讲 SAS系统与回归分析

简单线性回归模型

因变量Y和自变量x的n次观测数据(xi ,Yi) 可以用以下方程表示: Yi = 0 + 1 xi + i (i=1,2,. . .,n) Yi : 因变量的第 i 次观测值; xi : 自变量的第 i 次观测值;

0,1: 待估计的未知参数. 0是截距参数,它对应自变量为0时因变

35

一元线性回归分析

一元线性回归的计算--例子

•proc reg data=hbs.fitness ; • model oxygen = runtime ; •run; •proc reg data=hbs.fitness ; • model oxygen = runtime / p cli clm ; • id runtime; • output out=outfit p=poxy r=roxy • l95=l95oxy u95=u95oxy; •run;

相关系数(Correlation Coef.)

• 线性联系是描述变量间联系中最简单 和最常用的一种(Y=a1x1+a2x2+b);

• 相关系数是描述两个变量间线性联系 程度 的统计指标; • 相关系数的计算公式:

r

( X X )(Y Y ) ( X X ) (Y Y )

例:讨论英国11年有执照汽车数x(万辆)与车祸次数Y(千次)的

相关关系(数据见DATA步的数据行),并进行预测.

解:(1) 用编程,首先生成SAS数据集dreg.

data dreg; input year y x @@; cards; 1947 166 352 1948 153 1950 201 441 1951 216 1953 227 529 1954 238 1956 268 692 1957 274 ;

SAS第三十三课逐步回归分析

第三十三课 逐步回归分析一、 逐步回归分析在一个多元线性回归模型中,并不是所有的自变量都与因变量有显著关系,有时有些自变量的作用可以忽略。

这就产生了怎样从大量可能有关的自变量中挑选出对因变量有显著影响的部分自变量的问题。

在可能自变量的整个集合有40到60个,甚至更多的自变量的那些情况下,使用“最优”子集算法可能并不行得通。

那么,逐步产生回归模型要含有的X 变量子集的自动搜索方法,可能是有效的。

逐步回归方法可能是应用最广泛的自动搜索方法。

这是在求适度“好”的自变量子集时,同所有可能回归的方法比较,为节省计算工作量而产生的。

本质上说,这种方法在每一步增加或剔除一个X 变量时,产生一系列回归模型。

增加或剔除一个X 变量的准则,可以等价地用误差平方和缩减量、偏相关系数或F 统计量来表示。

无疑选择自变量要靠有关专业知识,但是作为起参谋作用的数学工具,往往是不容轻视的。

通常在多元线性模型中,我们首先从有关专业角度选择有关的为数众多的因子,然后用数学方法从中选择适当的子集。

本节介绍的逐步回归法就是人们在实际问题中常用的,并且行之有效的方法。

逐步回归的基本思想是,将变量一个一个引入,引入变量的条件是偏回归平方和经检验是显著的,同时每引入一个新变量后,对已选入的变量要进行逐个检验,将不显著变量剔除,这样保证最后所得的变量子集中的所有变量都是显著的。

这样经若干步以后便得“最优”变量子集。

逐步回归是这样一种方法,使用它时每一步只有一个单独的回归因子引进或从当前的回归模型中剔除。

Efroymoson (1966)编的程序中,有两个F 水平,记作F in 和F out ,在每一步时,只有一个回归因子,比如说X i ,如果剔除它可能引起RSS 的减少不超过残差均方MSE (即ESS/(N-k-1))的F out 倍,则将它剔除;这就是在当前的回归模型中,用来检验 βi =0的F 比=MSE x x x RSS x x x x RSS i i i /)),,(),,,((121121--- 是小于或等于F out 。

SAS系统和数据分析逐步回归分析

(1)"。必(全回归模型)。没有对回归变量进行筛选, 建立y与全部自变量的全回归模型。

(2)forward(向前选择)。向前选择技术以模型中 没有变量开始,对每个自变量,forward计算反 映自变量对模型的贡献的F统计量。这些F统 计量与model语句中给岀的$胁1/口=水平上的 值相比较,如果F统计量的显著水平没有一个 比slentry=水平上(如果缺省slentry=这个参 数,则显著水平假设为0.50)的值大,则"nvaM停止。否则,forward在模型中加入具有最大F统 计量的变量,然后forward再计算这些变量的F统计量直到剩下的变量都在模型的外面,再重复 估计过程。变量就这样一个接一个地进入模型直上海财经大学经济信息管理系IS/SHUFE

的平方和分解公式为:

TSS = RSS(X\

这时,回归平方和从

RSS(X|,X2,…X_,X冲…同时残差也发生相应的变化。 残差平 方和从ESS(X\,X»…,Xi,…X)增 加 到

ESSgX"…,X^Xg…X,对回归平方和的贡献,也等 价于删除/后残差平方和所增加的量,同理可表示

为:

比=/?SS(X「X2,…,X:,…X/)_RSS(X|,X2,…,Xi,X田…XJ

但是,向后剔除法有一个优点,它可以使使用者 明白含有许多变量模型的复杂性。

五、stepwise逐步回归过程

stepwise过程对逐步回归提供了九种方法。当

你有许多自变量且想找出哪些自变量是该选入回 归模型时,stepwise是有用的。

由于stepwise可以使你深入地了解自变量与 因变量或响应变量之间的关系,因此,它对考察 分析是很有帮助的。但是,stepwise并不能保证给 你“最好”的模型,甚至具有最大疋的模型也不 一定是“最好”的,并且靠这些均值演变得来的

用SAS作回归分析

用SAS 作回归分析前面我们介绍了相关分析,并且知道变量之间线性相关的程度可以通过相关系数来衡量。

但在实际工作中,仅仅知道变量之间存在相关关系往往是不够的,还需要进一步明确它们之间有怎样的关系。

换句话说,实际工作者常常想知道某些变量发生变化后,另一个相关变量的变化程度。

例如,第六章中已经证明消费和收入之间有很强的相关关系,而且也知道,消费随着收入的变化而变化,问题是当收入变化某一幅度后,消费会有多大的变化?再比如,在股票市场上,股票收益会随着股票风险的变化而变化。

一般来说,收益和风险是正相关的,也就是说,风险越大收益就越高,风险越小收益也越小,著名的资本资产定价模型(CAPM )正说明了这种关系。

现在的问题是当某个投资者知道了某只股票的风险后,他能够预测出这只股票的平均收益吗?类似这类通过某些变量的已知值来预测另一个变量的平均值的问题正是回归分析所要解决的。

第一节 线性回归分析方法简介一、回归分析的含义及其所要解决的问题“回归”(Regression)这一名词最初是由19世纪英国生物学家兼统计学家F.Galton(F.高尔顿)在一篇著名的遗传学论文中引入的。

高尔顿发现,虽然有一个趋势:父母高,儿女也高;父母矮,儿女也矮,但给定父母的身高,儿女辈的平均身高却趋向于或者“回归”到全体人口的平均身高的趋势。

这一回归定律后来被统计学家K.Pearson 通过上千个家庭成员身高的实际调查数据进一步得到证实,从而产生了“回归”这一名称。

当然,现代意义上的“回归”比其原始含义要广得多。

一般来说,现代意义上的回归分析是研究一个变量(也称为因变量Dependent Variable 或被解释变量Explained Variable )对另一个或多个变量(也称为自变量Independent Variable 或Explanatory Variable )的依赖关系,其目的在于通过自变量的给定值来预测因变量的平均值或某个特定值。

SAS实验 相关与回归分析

学生实验报告学生实验报告一、实验目的及要求:1、目的学会和掌握参数估计与假设检验2、内容及要求学会用SAS作总体均值、方差估计,以及单样本均值、方差比例检验,双样本均值、方差、比例的比较和配对样本均值比较检验等操作二、仪器用具:三、实验方法与步骤:步骤一、运行SAS软件,新建各题要用到的数据集;步骤二、新建数据集后,输入analyst命令或在点击解决方案—分析—分析家,进入分析员应用环境;步骤三、在分析员应用环境打开新建的数据集;步骤四、再根据各题要求,点击统计选项来分析。

四、实验结果与数据处理:1.下面是某地一年级的12位女生的体重(kg)和肺活量(L)的数据试求肺活量对体重的回归方程。

体重42 42 46 46 46 50 50 50 52 52 58 58 肺活量2.55 2.2 2.75 2.4 2.8 2.813.41 3.1 3.46 2.85 3.5 3(1)对肺活量和体重进行相关分析。

绘制体重与肺活量的散点图,计算其相关系数。

并对输出结果进行解释。

①将数据保存至EXCEL文件,导入数据,得到数据集;②在INSIGHT环境中调入数据,绘制体重与肺活量的散点图,如图所示。

③在INSIGHT环境中利用多元进行分析,得出体重与肺活量的相关系数。

“单变量统计量”中提供了每个变量的5个统计量,分别为数量、均值、标准差、最小值和最大值。

“相关系数举证”中则提供了变量间的相关系数,体重(weight )和肺活量(pulmonary)的相关系数为0.7495(2)判断体重和肺活量两变量的关系,拟合肺活量对体重的方程,对回归系数进行解释和对回归系数进行检验,绘制残差图。

①用insight 视图下的分析来拟合肺活量对体重的方程;得到简单线性回归方程为 X Y 0588.00004.0+== 对回归系数进行解释和对回归系数进行检验:上表提供模型拟合的汇总度量,肺活量的均值是2.9025 ,模型的5617.02=R ,说明肺活量变异的大约56%可以由体重来说明。

用SAS作回归分析RegressionAnalysis

交互项的检验

使用交互项的系数检验,判断交 互项是否显著,从而决定是否保 留交互项。

交互项模型的应用

场景

适用于研究多个因素之间相互作 用对因变量的影响,以及解释复 杂现象时使用。

06

案例分享与实战演练

案例一:使用SAS进行线性回归分析

总结词

线性回归分析是一种常用的回归分析方法,用于探索自变量和因变量之间的线 性关系。

表示为 y = f(x),其中 f 是一个非线性函数。

03

多重回归

当一个因变量受到多个自变量的影响时,可以使用多重回归分析。多重

回归模型可以表示为 y = b0 + b1x1 + b2x2 + ... + bnxn,其中 b0

是截距,b1, b2, ..., bn 是自变量的系数。

回归分析在统计学中的重要性

线性关系检验

通过散点图、残差图和正态性检验等手段,检验因变 量与自变量之间是否存在线性关系。

独立性检验

检查自变量之间是否存在多重共线性,确保自变量之 间相互独立。

误差项的独立性检验

检验误差项是否独立,即误差项与自变量和因变量是 否独立。

模型的评估与优化

模型评估

01

通过R方、调整R方、AIC等指标评估模型的拟合优度。

使用SAS进行线性回归分析

线性回归模型的建立

确定自变量和因变量

首先需要明确回归分析的目的,并确定影响因变量的自变量。

数据准备

确保数据清洗无误,处理缺失值、异常值和离群点。

模型建立

使用SAS的PROC REG或PROC GLMSELECT过程,输入自变量和 因变量,选择线性回归模型。

模型的假设检验

02

用SAS作回归分析

变量选择准则

(逐步回归)

逐步回归方式挑选有关的选项: NONE:全部进入,不加选择 FORWARD: 逐个加入 BACKWARD: 全部加入后逐个剔除 STEPWISE: 边进边出 MAXR:逐个加入和对换,使R2增加最大 MINR: 逐个加入和对换,使R2增加最小

24

回归的假设检验

原假设:简单线性模型拟合数据不比基线 模型好 b1 = 0, r = 0, |b1| 小,SS(Model) 小

备选假设:简单线性模型拟合数据比基线 模型好 b1 ^= 0, r ^= 0, |b1| 不为零,SS(Model) 大

25

R2

R 2S S(M o d el) b 1 2 S S(C -T o tal)

P R E S S (Y i Y (i))2

42

多变量线性模型的检验

在多变量回归分析输出的回归参数的t -检 验里,都是假定其它相依变量进入回 归的前提下检验该变量进入的显著性。

若模型中有两个变量有相关,在这一检验 中两者的显著性都可被隐蔽起来。所以, 这一检验结果必须小心分析。

删除变量时,必须逐个删除。并在删除每 个变量后,注意观测其它变量的p-值的 变化。

(Yi b0 b1 X i ) 2

+ (b1 b1 ) 2 ( X i X ) 2

+ n (Y b0 b1 X ) 2

= SS(error) + SS(Ind.-var) + SS(Const.)

27

预测值与置信限

预 测 值 : Yx0 b0 + b1x0 均值置信限(CLM):

相关系数是描述两个变量间线性联系程度 的统计指标

SAS系统和数据分析SAS数据库

SAS系统和数据分析SAS数据库SAS(Statistical Analysis System)系统是一种专业的统计分析软件,它由全球最大的私人软件公司SAS Institute开发。

SAS系统提供了一套完整的工具和功能,用于数据管理、数据预处理、统计分析、数据挖掘、预测建模和报告生成等各个环节。

它被广泛应用于学术研究、市场调查、医学研究、金融分析、企业决策等领域。

SAS系统具有强大的数据管理能力。

它可以处理大规模的数据集,支持多种数据格式,如Excel、CSV、数据库等,并且可以对数据进行高效的检索、排序、过滤和变换操作。

此外,SAS系统还提供了一系列的数据管理功能,如变量创建、缺失值处理、数据合并和拆分等,使用户能够高效地管理和整理数据。

SAS系统还具有丰富的统计分析功能。

它提供了各种统计分析方法和模型,包括描述性统计、假设检验、方差分析、回归分析、聚类分析、主成分分析等。

这些功能能够帮助用户发现数据背后的规律和关联,深入分析数据的特征和趋势,并且进行相应的模型建立和预测。

SAS系统的统计模块非常全面,满足了不同领域和行业对于统计分析的需求。

除了统计分析,SAS系统还提供了强大的数据挖掘功能。

数据挖掘是指从大规模数据集中发现有价值的模式和知识。

SAS系统提供了多种数据挖掘技术和算法,包括聚类分析、分类与回归树、关联规则挖掘、神经网络等。

这些算法能够帮助用户挖掘隐含在数据中的信息和规律,发现决策所需的关键变量和因素,支持企业决策和优化业务流程。

此外,SAS系统还具有丰富的数据可视化和报告生成功能。

用户可以利用SAS系统创建各种图表和图形,如柱状图、折线图、散点图等,以直观的方式展示数据的分布和变化。

同时,SAS系统还支持自动化报告生成,用户可以根据需要自定义报告的格式和内容,并且可以将报告导出为各种格式,如PDF、HTML等,以便于与他人共享和交流。

除了SAS系统本身的功能,SAS还开发了一套全面的数据库管理系统,即SAS数据库(SAS Data Management)。

SAS系统和数据分析Spearman等级相关分析

第三十课 Spearman 等级相关分析一、 秩相关的Spearman 等级相关分析前面介绍了使用非参数方法比较总体的位置或刻度参数,我们同样也可以用非参数方法比较两总体之间的相关问题。

秩相关(rank correlation )又称等级相关,它是一种分析i x 和i y 等级间是否相关的方法。

适用于某些不能准确地测量指标值而只能以严重程度、名次先后、反应大小等定出的等级资料,也适用于某些不呈正态分布或难于判断分布的资料。

设i R 和i Q 分别为i x 和i y 各自在变量X 和变量Y 中的秩,如果变量X 与变量Y 之间存在着正相关,那么X 与Y 应当是同时增加或减少,这种现象当然会反映在(i x ,i y )相应的秩(i R ,i Q )上。

反之,若(i R ,i Q )具有同步性,那么(i x ,i y )的变化也具有同步性。

因此:∑∑==-==n i ni i i i Q R d d 1122)((30.1)具有较小的数值。

如果变量X 与变量Y 之间存在着负相关,那么X 与Y 中一个增加时,另一个在减小,d 具有较大的数值。

既然由(i x ,i y )构成的样本相关系数反映了X 与Y 之间相关与否的信息,那么在参数相关系数的公式),(Y X r 中以i R 和i Q 分别代替i x 和i y ,不是同样地反映了这种信息吗?基于这种想法,Charles Spearman 秩相关系数),(Q R r s 应运而生:∑∑∑∑∑∑∑----=22)1()1()1)(1(),(i i i i i i i i s Q n Q R n R Q n Q R n R Q R r (30.2)),(Q R r s 与),(Y X r 形式上完全一致,但在),(Q R r s 中的秩,不管X 与Y 取值如何,总是只取1到n 之间的数值,因此它不涉及X 与Y 总体其他的内在性质,例如,秩相关不需要总体具有有限两阶矩的要求。

SAS系统和数据分析多元线性回归分析

第三十二课 多元线性回归分析一、 多元回归模型表示法通常,回归模型包括k 个变量,即一个因变量和k 个自变量(包括常数项)。

由于具有N 个方程来概括回归模型:N t X X X Y t kt k t t t ,,2,1,22110 =+++++=εββββ(32.1)模型的相应矩阵方程表示为:εβ+=X Y(32.2)式中;⎪⎪⎪⎪⎪⎭⎫⎝⎛=⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=⎪⎪⎪⎪⎪⎭⎫⎝⎛=⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=N k kN N k k N X XX X X X X Y Y Y Y εεεεββββ2110121211121,,111, (32.3)其中,Y 为因变量观察的N 列向量,X 为自变量观察的N × (k +1) 矩阵,β为末知参数的(k +1) )列向量,ε 为误差观察的N 列向量。

在矩阵X 表达式中,每一个元素X ij 都有两个下标,第一个下标表示相应的列(变量),第二个下标表示相应的行(观察)。

矩阵X 的每一列表示相应的给定变量的N 次观察的向量,与截矩有关的所有观察值都等于1。

经典的线性回归模型的假设可以阐述如下: ● 模型形式由(32.1)给定;● 矩阵X 的元素都是确定的,X 的秩为(k+1),且k 小于观察数N ;● ε 为正态分布,E (ε )=0 和()I E 2σεε=' ,式中I 为N×N 单位矩阵。

根据X 的秩为(k+1) 的假定,可以保证不会出现共线性。

如果出现完全共线性,矩阵X 的一列将为其余列的线性组合,而X 的秩将小于(k+1) ),关于误差的假设是最有用的假设,因为用它可以保证最小二乘法估计过程的统计性质。

除了正态性外,我们还假定每一个误差项的平均值为0,方差为常数, 以及协方差为 0 。

假若我们按Y 的分布来表示第三个假设,则可写成下式:),(~2I X N Y σβ(32.4)二、 最小二乘法估计我们的目的是求出一个参数向量使得残差平方和最小,即:εεεˆˆˆ12'==∑=Nt t ESS (32.5)式中:Y Y ˆˆ-=ε (32.6) βˆˆX Y =(32.7)其中,εˆ表示回归残差的N 列向量,而Y ˆ表示Y 拟合值的N 列向量,βˆ表示为估计参数的(k +1) 列向量,将式(32.6)和式(32.7)代入式(32.5),则得:()()βββββˆˆˆ2 ˆˆX X Y X Y Y X Y X Y ESS ''+''-'=-'-= (32.8)为了确定最小二乘法估计量,我们求ESS 对βˆ进行微分,并使之等于0,即: 0ˆ22ˆ='+'-=∂∂ββX X Y X ESS (32.9)所以:())(ˆ1Y X X X ''=-β(32.10)被称为“交叉乘积矩阵”,即X X '矩阵能够保证逆变换,这是因为我们假设X 的秩为(k +1),该假设直接导致了X X '的非奇异性。

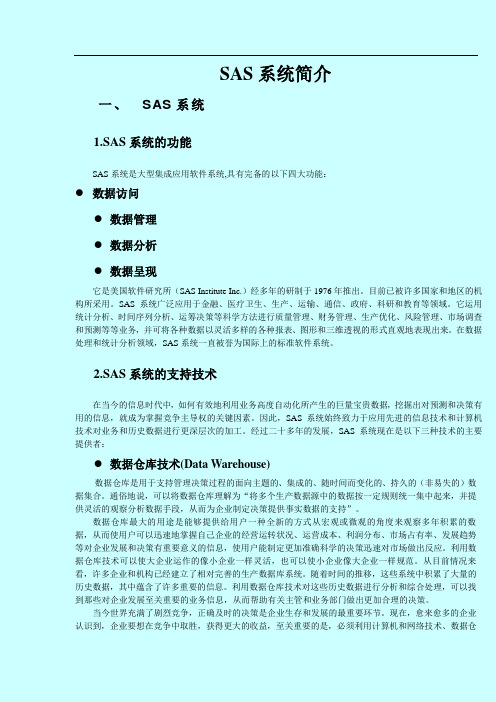

SAS系统和数据分析SAS系统简介

SAS系统简介一、SAS系统1.SAS系统的功能SAS系统是大型集成应用软件系统,具有完备的以下四大功能:●数据访问●数据管理●数据分析●数据呈现它是美国软件研究所(SAS Institute Inc.)经多年的研制于1976年推出。

目前已被许多国家和地区的机构所采用。

SAS系统广泛应用于金融、医疗卫生、生产、运输、通信、政府、科研和教育等领域。

它运用统计分析、时间序列分析、运筹决策等科学方法进行质量管理、财务管理、生产优化、风险管理、市场调查和预测等等业务,并可将各种数据以灵活多样的各种报表、图形和三维透视的形式直观地表现出来。

在数据处理和统计分析领域,SAS系统一直被誉为国际上的标准软件系统。

2.SAS系统的支持技术在当今的信息时代中,如何有效地利用业务高度自动化所产生的巨量宝贵数据,挖掘出对预测和决策有用的信息,就成为掌握竞争主导权的关键因素。

因此,SAS系统始终致力于应用先进的信息技术和计算机技术对业务和历史数据进行更深层次的加工。

经过二十多年的发展,SAS系统现在是以下三种技术的主要提供者:●数据仓库技术(Data Warehouse)数据仓库是用于支持管理决策过程的面向主题的、集成的、随时间而变化的、持久的(非易失的)数据集合。

通俗地说,可以将数据仓库理解为“将多个生产数据源中的数据按一定规则统一集中起来,并提供灵活的观察分析数据手段,从而为企业制定决策提供事实数据的支持”。

数据仓库最大的用途是能够提供给用户一种全新的方式从宏观或微观的角度来观察多年积累的数据,从而使用户可以迅速地掌握自己企业的经营运转状况、运营成本、利润分布、市场占有率、发展趋势等对企业发展和决策有重要意义的信息,使用户能制定更加准确科学的决策迅速对市场做出反应。

利用数据仓库技术可以使大企业运作的像小企业一样灵活,也可以使小企业像大企业一样规范。

从目前情况来看,许多企业和机构已经建立了相对完善的生产数据库系统。

随着时间的推移,这些系统中积累了大量的历史数据,其中蕴含了许多重要的信息。

用SAS作回归分析

其中 S (Yˆi )

第i个观测的预测值的标准差,

是为了把数据标准化。其中Dffits越大越好,

D是different和fit的缩写说明,

第i个观测的预测值 用排除第i个观测的回归对第i个观测的预测值 p 为模型中参数的个数, n 为样本容量

回归诊断

识别有影响的观测

Proc REG 的 Model语句加选项 r 可获得 Cook D 统计量

利用余差可以考 察余差和预测值 的 散 点 图{

重要工具

也可以检验余差

分布的正态性

1.

回归诊2断.

模型合 适

3.

应改曲 线模型

不等方 差

4.

观测值 不独立

单击此处添加标题

回

归

诊

生成余差

单击此处添加标题

断

在PROC REG的model语句加上选项 p,

就

会

输出预测值和相应的余差

单击此处添加标题

PROC

RUN;

回归诊断 识别有影响 的观测

Cook D统计量度量一个观测从分析中 剔除 时参数估计值的变化

对一个观测值其 Cook D 统计量的值 超 过 4/n 时(n为样本容量),这个观测存 在 反常效应,

其中4/n只是经验,没有统一的标准。

回归诊断 识别有影响 的观测

Yˆi

Yˆ Dffitsi 度量第i 个观测对预

Predict Value 预测值

PROC REG DATA=数据集名 ; MODEL 应变量=自变量/r;

Std Err Predict 预测值标准差RUN;

Residual

余差

Std Err Predict 余差标准差

sas回归分析实验报告

sas回归分析实验报告SAS回归分析实验报告引言:回归分析是一种常用的统计方法,用于研究变量之间的关系。

在本次实验中,我们使用SAS软件进行回归分析,探索自变量和因变量之间的关系,并对结果进行解释和推断。

本实验旨在通过实际数据的分析和处理,加深对回归分析方法的理解和应用。

实验设计:本次实验使用了某公司销售数据,其中自变量包括广告费用、产品价格和季节因素,因变量为销售额。

我们的目标是通过回归分析,探究广告费用、产品价格和季节因素对销售额的影响,并建立一个可靠的模型来预测销售额。

数据处理:首先,我们对数据进行了清洗和预处理。

去除了缺失值和异常值,并进行了变量的标准化处理,以确保数据的准确性和可比性。

接下来,我们使用SAS软件进行回归分析。

回归模型建立:我们选择了多元线性回归模型来建立自变量和因变量之间的关系。

通过分析数据,我们发现广告费用、产品价格和季节因素对销售额都可能有影响。

因此,我们的模型为:销售额= β0 + β1 × 广告费用+ β2 × 产品价格+ β3 × 季节因素+ ε其中,β0、β1、β2和β3分别为回归系数,ε为误差项。

回归分析结果:通过SAS软件进行回归分析后,我们得到了如下结果:回归方程:销售额= 1000 + 2.5 × 广告费用+ 1.8 × 产品价格+ 0.3 × 季节因素回归系数的显著性检验结果显示,广告费用和产品价格对销售额的影响是显著的(p < 0.05),而季节因素的影响不显著(p > 0.05)。

模型解释和推断:根据回归方程的结果,我们可以得出以下结论:1. 广告费用对销售额有正向影响:每增加1单位的广告费用,销售额将增加2.5单位。

2. 产品价格对销售额也有正向影响:每增加1单位的产品价格,销售额将增加1.8单位。

3. 季节因素对销售额的影响不显著:季节因素对销售额的变化没有明显的影响。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

SAS系统和数据分析逐步回归分析电子商务系列第三十三课逐步回归分析一、逐步回归分析在一个多元线性回归模型中,并不是所有的自变量都与因变量有显著关系,有时有些自变量的作用可以忽略。

这就产生了怎样从大量可能有关的自变量中挑选出对因变量有显著影响的部分自变量的问题。

在可能自变量的整个集合有40到60个,甚至更多的自变量的情况下,使用“最优”子集算法可能并不行得通。

那么,逐步产生回归模型要含有的X变量子集的自动搜索方法,可能是有效的。

逐步回归方法可能是应用最广泛的自动搜索方法。

这是在求适度“好”的自变量子集时,同所有可能回归的方法比较,为节省计算工作量而产生的。

从本质上说,这种方法在每一步增加或剔除一个X变量时,产生一系列回归模型。

增加或剔除一个X变量的准则,可以等价地用误差平方和缩减量、偏相关系数或F统计量来表示。

无疑选择自变量要靠有关专业知识,但是作电子商务系列 为起参谋作用的数学工具,往往是不容轻视的。

通常在多元线性模型中,我们首先从专业角度选择有关的为数众多的因子,然后用数学方法从中选择适当的子集。

本节介绍的逐步回归法就是人们在实际问题中常用的,并且行之有效的方法。

逐步回归的基本思想是,将变量一个一个引入,引入变量的条件是偏回归平方和经检验是显著的,同时每引入一个新变量后,对已选入的变量要进行逐个检验,将不显著变量剔除,这样保证最后所得的变量子集中的所有变量都是显著的。

这样经若干步以后便得“最优”变量子集。

逐步回归是这样一种方法,使用它时每一步只有一个单独的回归因子引进或从当前的回归模型中剔除。

Efroymoson (1966)编的程序中,有两个F 水平,记作F in 和F out ,在每一步时,只有一个回归因子,比如说X i ,如果剔除它可能引起RSS 的减少不超过残差均方MSE (即ESS/(N-k-1))的F out 倍,则将它剔除;这就是在当前的回归模型中,用来检验βi =0的F 比MSE x x x RSS x x x x RSS i i i /)),,(),,,((121121--- 是小于或等于F out 。

若剔除的变量需要选择,则就选择使RSS 减电子商务系列少最少的那一个(或等价的选择F比最小的)。

用这种方式如果没有变量被剔除,则开始引进一个回归因子,比如X j,如果引进它后使RSS的增加,至少是残差均方的F in倍,则将它引进。

即若在当前模型加X j项后,为了检验βj=0的F比,F ≥F in时,则引进X j,其次,若引进的变量需要选择,则选择F比最大的。

程序按照上面的步骤开始拟合,当没有回归因子能够引进模型时,该过程停止。

二、变量选择的方法若在回归方程中增加自变量X i,称为“引入”变量X i,将已在回归方程中的自变量X j从回归方程中删除,则称为“剔除”变量X j。

无论引入变量或剔除变量,都要利用F检验,将显著的变量引入回归方程,而将不显著的从回归方程中剔除。

记引入变量F检验的临界值为F in(进),剔除变量F检验的临界值为F out(出),一般取F in≥F out,它的确定原则一般是对k个自变量的m个(m≤k),对显著性水平df1=1,df2=1-N的F分布表-m的值,记为F*,则取F in=F out= F*。

一般来说,电子商务系列 也可以直接取F in =F out =2.0或2.5。

当然,为了回归方程中还能够多进入一些自变量,甚至也可以取为1.0或1.5。

1. 变量增加法首先对全部k 个自变量,分别对因变量Y 建立一元回归方程,并分别计算这k 个一元回归方程的k 个回归系数F 检验值,记为{11211,,kF F F },选其最大的记为1i F = max{11211,,k F F F },若有1iF ≥ F in ,则首先将X 1引入回归方程,不失一般性,设X i 就是X 1。

接着考虑X 1分别与X 2,X 3,...,X k 与因变量Y 组成二元回归方程,对于这k -1个回归方程中X 2,...,X k 的回归系数进行F 检验,计算F 值,并选其最大的F 值2j F ,若2jF ≥F in ,则接着就将X j 引入回归方程,不失一般性,设X j 就是X 2。

对已经引入回归方程的变量X 1和X 2,如同前面的方法做下去,直至所有未被引入方程的变量的F 值均小于F in 时为止。

这时的回归方程就是最终选定的回归方程。

显然,这种增加法有一定的缺点,主要是,它不能反映后来变化的情况。

因为对于某个自变电子商务系列 量,它可能开始是显著的,即将其引入到回归方程,但是,随着以后其他自变量的引入,它也可能又变为不显著了,但是,并没有将其及时从回归方程中剔除掉。

也就是增加变量法,只考虑引入而不考虑剔除。

2. 变量减少法与变量增加法相反,变量减少法是首先建立全部自变量X 1,X 2,...,X k 对因变量Y 的回归方程,然后对k 个回归系数进行F 检验,记求得的F 值为{11211,,k F F F },选其最小的记为1i F =min{11211,,k F F F },若有1iF ≤F out ,则可以考虑将自变量X i 从回归方程中剔除掉,不妨设X i 就取为X 1。

再对X 2,X 3,...,X k 对因变量Y 建立的回归方程重复上述过程,取最小的F 值为2j F ,若有2jF ≤F out ,则将X j 也从回归方程中剔除掉。

不妨设X j 就是X 2。

重复前面的做法,直至在回归方程中的自变量F 检验值均大于F out ,即没有变量可剔除为止。

这时的回归方程就是最终的回归方程。

这种减少法也有一个明显的缺点,就是一开始把全部变量都引入回归方程,这样计算量比较大。

若对一些不重要的变量,一开始就不引入,电子商务系列 这样就可以减少一些计算。

3. 变量增减法前面的两种方法各有其特点,若自变量X 1,X 2,...,X k 完全是独立的,则可结合这两种方法,但是,在实际的数据中,自变量X 1,X 2,...,X k 之间往往并不是独立的,而是有一定的相关性存在的,这就会使得随着回归方程中变量的增加和减少,某些自变量对回归方程的贡献也会发生变化。

因此一种很自然的想法是将前两种方法综合起来,也就是对每一个自变量,随着其对回归方程贡献的变化,它随时可能被引入回归方程或被剔除出去,最终的回归模型是在回归方程中的自变量均为显著,不在回归方程中的自变量均不显著。

三、 引入变量和剔除变量的依据如果在某一步时,已有l 个变量被引入到回归方程中,不妨设为lX X X ,,,21 ,即已得回归方程: ll X X X Y ββββ++++= 22110ˆ (33.1) 并且有平方和分解式:ESS RSS TSS += (33.2)显然,回归平方和RSS 及残差平方和ESS 均与引电子商务系列 入的变量相关。

为了使其意义更清楚起见,将其分别设为RSS (l X X X ,,,21 )及ESS (l X X X ,,,21 )。

下面我们来考虑,又有一个变量iX (l ≤i ≤k )被引入回归方程中,这时对于新的回归方程所对应的平方和分解式为:TSS = RSS (l X X X ,,,21 ,i X )+ ESS (l X X X ,,,21 , i X ) (33.3)当变量X i 引入后,回归平方和从RSS (l X XX ,,,21 )增加到RSS (l X X X ,,,21 ,iX ),而相应的残差平方和却从ESS (lX X X ,,,21 )降到ESS (l X X X ,,,21 , i X ),并有: RSS (l X XX ,,,21 , i X )-RSS (l X X X ,,,21 ) = ESS (l X X X ,,,21 )-ESS (l X X X ,,,21 , iX ) (33.4) 记),,,(),,,,(2121l i l i X X X RSS X X X X RSS W -=,它反映了由于引入i X 后,i X 对回归平方和的贡献,也等价于引入i X 后残差平方和所减少的量,称其为i X 对因变量Y 的方差贡献,故考虑检验统计量: ()()()1/,,,,,,,2121--=l N X X X X ESS X X X W F i l l i i (33.5) 其中N 为样本量,l 是已引入回归方程的变量个数,这时若有in i F F ≥,则可以考虑将自变量i X 引入回归方程,否则不能引入。

实际上大于F in 的变量开始时可能同时有几电子商务系列 个,那么是否将它们都全部引入呢?实际编程序时并不是一起全部引入,而是选其最大的一个引入回归方程。

关于剔除变量,如果已有l 个变量被引入回归方程,不失一般性,设其为l X X X ,,,21 ,所对应的平方和分解公式为: ),,,,(),,,,,(2121l i l i X X X X ESS X X X X RSS TSS += (33.6) 其中l i ,,2,1 =为了研究每个变量在回归方程中的作用,我们来考虑分别删掉X i (i =1,2,...,l 后相应的平方和分解公式为:),,,,,(),,,,(11211121l i i l i i X X X X X ESS X X X X X RSS TSS +-+-+= (33.7)这时,回归平方和从),,,,,(21l i X X X X RSS 降为),,,,(1121l i i X X X X X RSS +-,同时残差也发生相应的变化。

残差平方和从),,,,(21l i X X X X ESS 增加到),,,,,(1121l i i X X X X X ESS +-,i X 对回归平方和的贡献,也等价于删除i X 后残差平方和所增加的量,同理可表示为:),,,,(),,,,(),,,,(),,,,(211121112121l i l i i l i i l i i X X X X ESS X X X X X ESS X X X X X RSS X X X X RSS W -=-=+-+- (33.8) 同理,我们来构造检验统计量:()()()1/,,,,,,,,,2121--=l N X X X X ESS X X X X W F l i l i i i (33.9)电子商务系列显然,这时F i 越小,则说明iX 在回归方程中起的作用(对回归方程的贡献)越小,也就是若有out i F F ≤,则可以考虑将自变量iX 从回归方程中剔除掉,我们在编程序时,每次只剔除一个,因此,我们每次选择最小的),,,min(21l i F F F F=来与out F 进行比较。

若有out i F F>则可以不考虑剔除,而开始考虑引入。