数字图像实验 哈夫曼编码的方法和实现1234

Huffman编码实验报告

图像Huffman编码实验报告

1 实验目的

(1)熟练掌握Huffman编码的方法;

(2)理解无失真信源编码和限失真编码方法在实际图像信源编码应用中的差异。

2 实验内容与步骤

(1)针对“image1.bmp”、“image2.bmp”和“image3.bmp”进行灰度频率统计(即计算图像灰度直方图),在此基础上添加函数代码构造Huffman码表,针对图像数据进行Huffman编码,观察和分析不同图像信源的平均码长、编码效率和压缩比。

(2)针对任意一幅图像,得到其差分图像,对差分图像统计灰度频率,进行Huffman编码,计算平均码长、编码效率和压缩比,并与(1)对比。

3 实验结果

(1)对图像数据进行Huffman 编码,得到不同图像信源的平均码长、编码效率和压缩比如下:

image1:5.960179 0.994678 1.342242

image2:4.443604 0.992368 1.800341

image3:6.733643 0.996281 1.188064

(2)对lenna.bmp 进行Huffman 编码,得到其平均码长、编码效率和压缩比分别是:

5.294220 0.994358 1.511082。

数字图像处理实验报告 (图像编码)

实验三图像编码一、实验内容:用Matlab语言、C语言或C++语言编制图像处理软件,对某幅图像进行时域和频域的编码压缩。

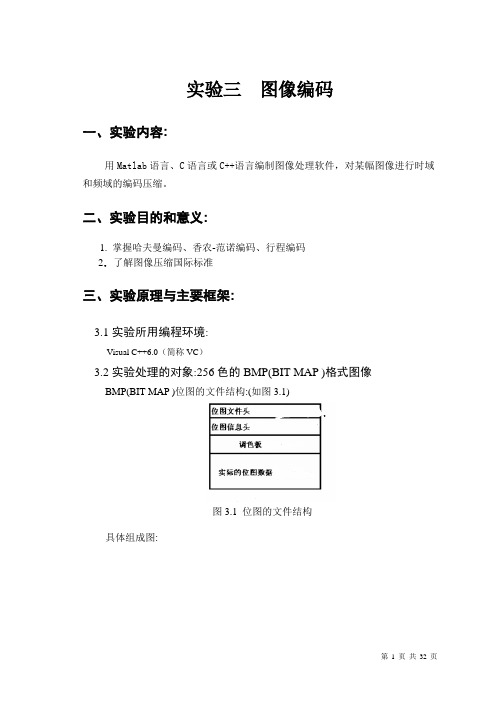

二、实验目的和意义:1. 掌握哈夫曼编码、香农-范诺编码、行程编码2.了解图像压缩国际标准三、实验原理与主要框架:3.1实验所用编程环境:Visual C++6.0(简称VC)3.2实验处理的对象:256色的BMP(BIT MAP )格式图像BMP(BIT MAP )位图的文件结构:(如图3.1)图3.1 位图的文件结构具体组成图:单色DIB 有2个表项16色DIB 有16个表项或更少 256色DIB 有256个表项或更少 真彩色DIB 没有调色板每个表项长度为4字节(32位) 像素按照每行每列的顺序排列每一行的字节数必须是4的整数倍biSize biWidth biHeight biPlanes biBitCount biCompression biSizeImagebiXPelsPerMeter biYPelsPerMeter biClrUsedbiClrImportantbfType=”BM ” bfSizebfReserved1 bfReserved2 bfOffBits BITMAPFILEHEADER位图文件头 (只用于BMP 文件)BITMAPINFOHEADER位图信息头Palette 调色板DIB Pixels DIB 图像数据3.3 数字图像基本概念数字图像是连续图像(,)f x y 的一种近似表示,通常用由采样点的值所组成的矩阵来表示:(0,0)(0,1)...(0,1)(1,0)(1,1)...(1,1).........(1,0)(1,1)...(1,1)f f f M f f f M f N f N f N M -⎡⎤⎢⎥-⎢⎥⎢⎥⎢⎥----⎣⎦每一个采样单元叫做一个像素(pixel ),上式(2.1)中,M 、N 分别为数字图像在横(行)、纵(列)方向上的像素总数。

图像编码中的哈夫曼编码技术解析

图像编码是将图像信号转化为数字信号的过程,它是数字图像处理中一个重要的环节。

在图像编码中,哈夫曼编码技术被广泛应用于无损压缩。

本文将对哈夫曼编码技术进行详细解析,并探讨其在图像编码中的应用。

1. 哈夫曼编码的基本原理哈夫曼编码是一种变长编码方式,它根据字符出现的频率分配不同长度的编码。

出现频率高的字符使用较短的编码,而出现频率低的字符使用较长的编码,以达到压缩数据的目的。

2. 字符频率统计在使用哈夫曼编码前,首先需要对输入的字符进行频率统计。

对于图像编码来说,可以统计每个像素值的出现频率。

通过频率统计,我们可以得到一个字符频率表,表中记录了每个字符出现的频率。

3. 构建哈夫曼树接下来,根据字符频率表构建哈夫曼树。

哈夫曼树是一种特殊的二叉树结构,它的叶子节点对应着字符,而路径上的节点则对应着字符的编码。

构建哈夫曼树的过程是通过不断合并频率最小的两个节点,直至所有节点都合并完成。

4. 生成哈夫曼编码构建完哈夫曼树后,我们可以根据树的结构来生成每个字符对应的哈夫曼编码。

生成哈夫曼编码的方法是往左走为0,往右走为1。

从根节点到每个叶子节点的路径上的0和1组成的序列就是该叶子节点对应的哈夫曼编码。

5. 编码与解码过程在编码过程中,将原始的字符替换为其对应的哈夫曼编码。

编码后的数据可以在传输和存储时占用更小的空间。

解码的过程是根据哈夫曼编码和哈夫曼树来找到原始的字符。

6. 哈夫曼编码在图像压缩中的应用由于图像数据的冗余性较高,在图像编码中使用哈夫曼编码可以达到较好的压缩效果。

通过统计图像中每个像素值的频率,并构建哈夫曼树,可以生成每个像素值对应的哈夫曼编码。

将编码后的数据进行传输和存储,可以大大减小所需的空间。

7. 哈夫曼编码的优势与局限性哈夫曼编码的主要优势是能够根据字符的出现频率来进行编码,使得出现频率高的字符使用较短的编码,从而实现对数据的有效压缩。

然而,哈夫曼编码并不是所有情况下都能获得最优压缩效果,因为它只考虑了字符的出现频率,而没有考虑字符之间的相关性。

(完整word版)图像编码基本方法

一、霍夫曼编码(Huffman Codes)最佳编码定理:在变长编码中,对于出现概率大的信息符号编以短字长的码,对于出现概率小的信息符号编以长字长的码,如果码字长度严格按照符号出现概率大小的相反的顺序排列,则平均码字长度一定小于按任何其他符号顺序排列方式的平均码字长度。

霍夫曼编码已被证明具有最优变长码性质,平均码长最短,接近熵值。

霍夫曼编码步骤:设信源X 有m 个符号(消息)⎭⎬⎫⎩⎨⎧=m m p x p p x x X ΛΛ2121,1. 1. 把信源X 中的消息按概率从大到小顺序排列,2. 2. 把最后两个出现概率最小的消息合并成一个消息,从而使信源的消息数减少,并同时再按信源符号(消息)出现的概率从大到小排列;3. 3. 重复上述2步骤,直到信源最后为⎭⎬⎫⎩⎨⎧=o o o o o p p x x X 2121为止;4. 4. 将被合并的消息分别赋予1和0,并对最后的两个消息也相应的赋予1和0;通过上述步骤就可构成最优变长码(Huffman Codes)。

例:110005.0010010.000015.01120.00125.01025.0654321x x x x x x P Xi 码字编码过程则平均码长、平均信息量、编码效率、冗余度为分别为:%2%9842.2)05.0log 05.01.0log 1.015.0log 15.02.0log 2.025.0log 25.02(45.205.041.0415.0320.0225.022===⨯+⨯+⨯+⨯+⨯⨯-==⨯+⨯+⨯+⨯+⨯⨯=Rd H N η二 预测编码(Predictive encoding )在各类编码方法中,预测编码是比较易于实现的,如微分(差分)脉冲编码调制(DPCM )方法。

在这种方法中,每一个象素灰度值,用先前扫描过的象素灰度值去减,求出他们的差值,此差值称为预测误差,预测误差被量化和编码与传送。

接收端再将此差值与预测值相加,重建原始图像象素信号。

哈夫曼编码实验报告

一、实验目的1.掌握MATLAB软件的使用,以及其设计流程;2.掌握哈夫曼编码的实现方法;3.用MATLAB语言设计哈夫曼编码的实现方法。

4.提高独立进行算法编程的能力。

二、实验仪器或设备装MATLAB软件的微机一台三、总体设计1、二进制Huffman编码的基本原理及算法1).将信源消息符号按其出现的概率大小依次排列为12...np p p≥≥≥2).取两个概率最小的字母分别配以0和1两个码元,并将这两个概率相加作为一个新字母的概率,与未分配的二进制符号的字母重新排队。

3).对重排后的两个概率最小符号重复步骤2的过程。

4).不断继续上述过程,直到最后两个符号配以0和1为止。

5).从最后一级开始,向前返回得到各个信源符号所对应的码元序列,即相应的码子。

2、程序设计的原理1)程序的输入:以一维数组的形式输入要进行huffman编码的信源符号的概率,在运行该程序前,显示文字提示信息,提示所要输入的概率矢量;然后对输入的概率矢量进行合法性判断,原则为:如果概率矢量中存在小于0的项,则输入不合法,提示重新输入;如果概率矢量的求和大于1,则输入也不合法,提示重新输入。

2)huffman编码具体实现原理:1>在输入的概率矩阵p正确的前提条件下,对p进行排序,并用矩阵L记录p排序之前各元素的顺序,然后将排序后的概率数组p的前两项,即概率最小的两个数加和,得到新的一组概率序列,重复以上过程,最后得到一个记录概率加和过程的矩阵p以及每次排序之前概率顺序的矩阵a。

2>新生成一个n-1行n列,并且每个元素含有n个字符的空白矩阵,然后进行huffman编码:将c矩阵的第n-1行的第一和第二个元素分别令为0和1(表示在编码时,根节点之下的概率较小的元素后补0,概率较大的元素后补1,后面的编码都遵守这个原则)然后对n-i-1的第一、二个元素进行编码,首先在矩阵a中第n-i行找到值为1所在的位置,然后在c矩阵中第n-i行中找到对应位置的编码(该编码即为第n-i-1行第一、二个元素的根节点),则矩阵c的第n-i行的第一、二个元素的n-1的字符为以上求得的编码值,根据之前的规则,第一个元素最后补0,第二个元素最后补1,则完成该行的第一二个元素的编码,最后将该行的其他元素按照“矩阵c中第n-i行第j+1列的值等于对应于a矩阵中第n-i+1行中值为j+1的前面一个元素的位置在c矩阵中的编码值”的原则进行赋值,重复以上过程即可完成huffman编码。

图像程序 霍夫曼编码

图像程序- 霍夫曼编码赫夫曼编码设计原理赫夫曼(Huffman)编码是1952年提出的,是一种比较经典的信息无损熵编码,该编码依据变长最佳编码定理,应用Huffman 算法而产生。

Huffman 编码是一种基于统计的无损编码。

设信源X的信源空间为:X:xx?x,12N [X,P]:,PXPxPxPx ?Px():()()()()123N,N其中,,现用二进制对信源X中的每一个符号(i=1,2,,N)进行xP(x),1,iii,1 编码。

根据变长最佳编码定理,Huffman 编码步骤如下:(1) 将信源符号xi 按其出现的概率,由大到小顺序排列。

(2) 将两个最小的概率的信源符号进行组合相加,并重复这一步骤,始终将较大的概率分支放在上部,直到只剩下一个信源符号且概率达到 1.0 为止;(3) 对每对组合的上边一个指定为1,下边一个指定为0(或相反:对上边一个指定为0,下边一个指定为1);(4) 画出由每个信源符号到概率1.0 处的路径,记下沿路径的1 和0;(5) 对于每个信源符号都写出1、0序列,则从右到左就得到非等长的Huffman 码。

Huffman 编码的特点是:(1) Huffman 编码构造程序是明确的,但编出的码不是唯一的,其原因之一是两个概率分配码字“ 0”和“ 1”是任意选择的(大概率为“ 0”,小概率为“ 1”,或者反之) 。

第二原因是在排序过程中两个概率相等,谁前谁后也是随机的。

这样编出的码字就不是唯一的。

(2) Huffman 编码结果,码字不等长,平均码字最短,效率最高,但码字长短不一,实时硬件实现很复杂(特别是译码) ,而且在抗误码能力方面也比较差。

(3) Huffman 编码的信源概率是2 的负幂时,效率达100%,但是对等概率分布的信源,产生定长码,效率最低,因此编码效率与信源符号概率分布相关,故Huffman 编码依赖于信源统计特性,编码前必须有信源这方面的先验知识,这往往限制了哈夫曼编码的应用。

数字图像--图像的哈夫曼编码实验

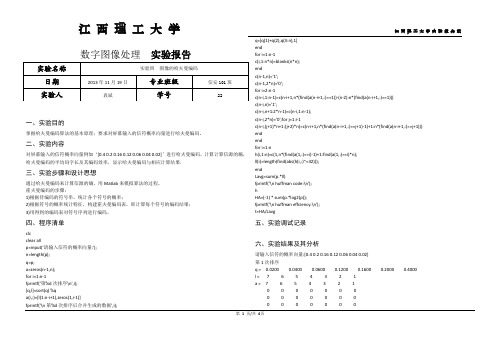

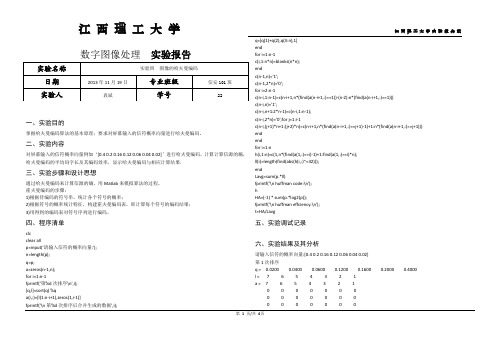

江 西 理 工 大 学江 西 理 工 大 学 实 验 报 告 纸第 1 页/共 4页一、实验目的掌握哈夫曼编码算法的基本原理;要求对屏幕输入的信符概率向量进行哈夫曼编码。

二、实验内容对屏幕输入的信符概率向量例如‘[0.4 0.2 0.16 0.12 0.06 0.04 0.02]’进行哈夫曼编码,计算计算信源的熵,哈夫曼编码的平均码字长及其编码效率,显示哈夫曼编码与相应计算结果.三、实验步骤和设计思想通过哈夫曼编码来计算信源的熵,用Matlab 来模拟算法的过程。

霍夫曼编码的步骤:1)根据待编码的符号串,统计各个符号的概率;2)根据符号的概率统计特征,构建霍夫曼编码表,即计算每个符号的编码结果; 3)用得到的编码表对符号序列进行编码。

四、程序清单clcclear allp=input('请输入信符的概率向量:'); n=length(p); q=p;a=zeros(n-1,n); for i=1:n-1fprintf('第%d 次排序\n',i); [q,l]=sort(q) %qa(i,:)=[l(1:n-i+1),zeros(1,i-1)]fprintf('\n 第%d 次排序后合并生成的数据',i);q=[q(1)+q(2),q(3:n),1] endfor i=1:n-1c(i,1:n*n)=blanks(n*n); endc(n-1,n)='1'; c(n-1,2*n)='0'; for i=2:n-1c(n-i,1:n-1)=c(n-i+1,n*(find(a(n-i+1,:)==1))-(n-2):n*(find(a(n-i+1,:)==1))) c(n-i,n)='1';c(n-i,n+1:2*n-1)=c(n-i,1:n-1); c(n-i,2*n)='0';for j=1:i-1c(n-i,(j+1)*n+1:(j+2)*n)=c(n-i+1,n*(find(a(n-i+1,:)==j+1)-1)+1:n*(find(a(n-i+1,:)==j+1))) end end for i=1:nh(i,1:n)=c(1,n*(find(a(1,:)==i)-1)+1:find(a(1,:)==i)*n); ll(i)=length(find(abs(h(i,:)~=32))); endLavg=sum(p.*ll)fprintf('\n huffman code:\n'); hHA=(-1) * sum(p.*log2(p));fprintf('\n huffman effciency:\n'); t=HA/Lavg五、实验调试记录六、实验结果及其分析请输入信符的概率向量:[0.4 0.2 0.16 0.12 0.06 0.04 0.02] 第1次排序q = 0.0200 0.0400 0.0600 0.1200 0.1600 0.2000 0.4000 l = 7 6 5 4 3 2 1 a = 7 6 5 4 3 2 1 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0数字图像处理 实验报告姓名: 江 西 理 工 大 学 实 验 报 告 纸第 2 页/共 4页0 0 0 0 0 0 0 0 0 0 0 0 0 0第1次排序后合并生成的数据 q =0.0600 0.0600 0.1200 0.1600 0.2000 0.4000 1.0000 第2次排序 q =Columns 1 through 60.0600 0.0600 0.1200 0.1600 0.2000 0.4000 Column 7 1.0000 l =1 2 3 4 5 6 7 a =7 6 5 4 3 2 1 1 2 3 4 5 6 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 第2次排序后合并生成的数据 q =Columns 1 through 60.1200 0.1200 0.1600 0.2000 0.4000 1.0000 Column 7 1.0000 第3次排序 q =Columns 1 through 60.1200 0.1200 0.1600 0.2000 0.4000 1.0000 Column 7 1.0000 l =1 2 3 4 5 6 7 a =7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 0 0 0 0 0 0 00 0 0 0 0 0 0 0 0 0 0 0 0 0第3次排序后合并生成的数据 q =Columns 1 through 60.2400 0.1600 0.2000 0.4000 1.0000 1.0000 Column 7 1.0000第4次排序q =Columns 1 through 60.1600 0.2000 0.2400 0.4000 1.0000 1.0000 Column 7 1.0000l = 2 3 1 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0第4次排序后合并生成的数据 q =Columns 1 through 60.3600 0.2400 0.4000 1.0000 1.0000 1.0000 Column 7 1.0000第5次排序q = Columns 1 through 60.2400 0.3600 0.4000 1.0000 1.0000 1.0000 Column 7 1.0000l = 2 1 3 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 2 1 3 0 0 0 0 0 0 0 0 0 0 0 第5次排序后合并生成的数据 q =Columns 1 through 60.6000 0.4000 1.0000 1.0000 1.0000 1.0000姓名: 江 西 理 工 大 学 实 验 报 告 纸第 3 页/共 4页Column 7 1.0000第6次排序q =Columns 1 through 60.4000 0.6000 1.0000 1.0000 1.0000 1.0000 Column 7 1.0000l = 2 1 3 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 2 1 3 0 0 0 0 2 1 0 0 0 0 0第6次排序后合并生成的数据q = 1 1 1 1 1 1 1c = 0 1 0 c = 01 00 1 1 0 c = 00 01 00 1 1 0 c = 001 000 01 01 00 1 1 0 c = 001 000 01 1 01 00 1 1 0 c = 01 001 000 01 1 01 00 1 1 0 c = 011 010 001 001 000 01 1 01 00 1 1 0 c = 011 010 001 000 001 000 01 1 01 00 1 1 0 c = 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 011 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 000 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 000 1 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c =0111 0111 0110 010 001 000 1 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c =01111 01110 0110 0111 0110 010 001 000 1姓名: 江西理工大学实验报告纸011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 0100111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c =01111 01110 0110 010 0010111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 010 001 0000111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 010 001 000 10111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0七、实验心得通过做这次实验掌握了哈夫曼编码的基本理论和算法流程;掌握了编程实现图像的哈夫曼编码算法。

图像编码中的哈夫曼编码技术解析(一)

图像编码是一种广泛应用于数字图像处理中的技术。

其中,哈夫曼编码作为一种优秀的编码算法,被广泛应用于图像压缩领域。

本文将对哈夫曼编码技术在图像编码中的应用进行详细解析。

一、哈夫曼编码的原理哈夫曼编码是一种变长编码算法,它通过将出现频率较高的字符用较短的编码表示,而将出现频率较低的字符用较长的编码表示,从而实现对数据的高效编码。

在图像编码中,每个像素点都可以看作是一种字符,其灰度值即表示该字符的频率。

二、图像编码的需求在图像编码中,我们往往需要将图像的原始数据进行压缩,以便存储和传输。

而压缩的核心思想就是通过减少冗余信息来减少数据的存储和传输量。

哈夫曼编码正是解决这一需求的有效方法之一。

三、基于哈夫曼编码的图像编码方案在图像编码中,我们可以将哈夫曼编码应用于两个方面:图像压缩和图像解压缩。

1. 图像压缩在图像压缩中,我们首先需要对图像进行离散余弦变换(Discrete Cosine Transform, DCT),将图像从空域变换到频域。

然后,我们将变换后的图像进行量化,将高频部分进行舍弃。

接下来,我们将量化后的图像进行分块,并统计每个像素值出现的频率。

最后,利用哈夫曼编码算法对出现频率进行编码,生成一个哈夫曼编码表。

这个编码表包含了每个像素值对应的变长编码,从而实现了对图像数据的高效压缩。

2. 图像解压缩在图像解压缩中,我们首先需要读取压缩后的图像文件,并解析出哈夫曼编码表。

然后,我们根据哈夫曼编码表对压缩数据进行解码,恢复出原始的像素值。

接下来,我们对解码后的数据进行逆量化和逆离散余弦变换,将图像从频域变换到空域。

最后,我们将逆变换后的图像数据进行重建,得到原始的图像。

四、哈夫曼编码的优势和应用哈夫曼编码作为一种变长编码算法,与传统的定长编码相比,具有如下优势:1. 数据压缩率高:哈夫曼编码可以根据字符的频率灵活选择编码长度,从而大大减少了数据的存储和传输量,实现了高效的数据压缩。

2. 无损压缩:哈夫曼编码是一种无损压缩算法,可以保证压缩后的数据与原始数据完全一致。

哈夫曼编码算法的原理及应用

哈夫曼编码算法的原理及应用随着信息技术的快速发展和数字化时代的到来,数据量的增加、存储和传输的要求也愈加严格。

如何用最少的存储空间传输最多的信息,成为了数字化时代数据处理的重要问题。

哈夫曼编码算法由于它对数据的高效压缩和快速解压,已经成为信息技术领域中常用的压缩算法之一。

一、哈夫曼编码算法的原理哈夫曼编码算法是由美国数学家哈夫曼在1952年发明的一种高效的数据压缩算法,它是一种前缀编码方式,利用不同字符出现的频率不同,将频率小的字符用较短的编码表达,频率大的字符则用较长的编码表示。

在编码表中,任何一个字符的编码都不会是另一个的编码的前缀,这就是哈夫曼编码的前缀编码优势。

采用哈夫曼编码算法最终压缩得到的数据是无损的,因为压缩后的数据是通过编码表进行翻译的,不会出现错误的情况。

哈夫曼编码算法的实现包括两个主要步骤:创建哈夫曼树和生成哈夫曼编码。

创建哈夫曼树:哈夫曼树是由哈夫曼算法创建的,其基本思想是将每个字符看作一棵树,以该字符出现的频率为权值,进行递归合并,直到所有的树合并为一棵哈夫曼树。

哈夫曼树的结构可以用一棵二叉树来表示,每个节点代表一个字符或者一个由多个字符组成的字符串。

生成哈夫曼编码:通过哈夫曼树可以生成哈夫曼编码表,哈夫曼编码表可以用一个映射关系来表示,将每个字符与对应的编码对应起来。

在哈夫曼树的遍历过程中,当向左走时,添加0到编码中,向右走时,添加1到编码中,直到到达叶子节点时,记录下该字符的哈夫曼编码。

二、哈夫曼编码算法的应用哈夫曼编码算法的应用非常广泛,除了在数据压缩中广泛应用外,它在通信、数据存储等领域也有很多应用。

下面我们介绍几个典型的应用场景。

1. 压缩和解压缩作为一种高效的数据压缩算法,哈夫曼编码算法被广泛应用于文件和图像等数据的压缩和解压缩中。

哈夫曼编码通过对数据进行更高效的压缩,可以节约存储空间和传输带宽。

在压缩文件的过程中,压缩后的文件大小通常能缩小到原来的50%以下。

图像编码中的哈夫曼编码技术解析(七)

图像编码中的哈夫曼编码技术解析图像编码是指将图像数据进行压缩和储存的过程,其中哈夫曼编码是一种常用的无损编码技术。

本文将详细解析哈夫曼编码在图像编码中的原理和应用。

一、哈夫曼编码的原理哈夫曼编码是由美国统计学家大卫·哈夫曼于1952年提出的,它是一种根据数据频率进行编码的方法。

其基本思想是,为出现频率较高的数据分配较短的编码,而为出现频率较低的数据分配较长的编码,从而实现数据的高效压缩。

在图像编码中,每个像素点的灰度值可以看作是一种数据,而图像的压缩就是通过对灰度值进行编码来实现的。

具体而言,通过统计图像中不同灰度值的频率,将频率较高的灰度值对应的编码设置为较短的码字,频率较低的灰度值对应的编码设置为较长的码字。

这样,在存储和传输图像时,就可以用较短的码字代表频率较高的灰度值,用较长的码字代表频率较低的灰度值,从而实现图像数据的高效压缩。

二、哈夫曼编码在图像编码中的应用1. 图像压缩由于哈夫曼编码可以根据数据的频率进行编码,因此在图像编码中广泛应用于压缩算法中。

图像数据中有许多颜色的像素点是大量重复的,这些重复的像素点具有较高的频率。

通过对这些像素点进行哈夫曼编码,可以用较短的码字表示,去除冗余的数据,从而达到高效压缩的效果。

这种编码方式不仅可以减小图像文件的存储空间,还可以提高图像在网络传输中的传输速度。

2. 图像解码在图像编码中,哈夫曼编码不仅应用于压缩算法,还应用于解码算法。

对于压缩后的图像数据,需要进行解码才能还原成原始的图像。

在解码过程中,需要利用哈夫曼编码表来对压缩后的码字进行解码。

哈夫曼编码表是由编码过程中所统计的频率信息所生成的,通过哈夫曼编码表中的信息,可以将压缩后的码字重新映射到原始的灰度值,从而实现图像数据的完整解码。

三、哈夫曼编码的优缺点1. 优点哈夫曼编码是一种无损压缩算法,压缩后的图像数据可以完美地还原成原始的图像。

同时,由于哈夫曼编码是根据数据频率进行编码,频率较高的数据使用较短的码字来表示,从而实现了高效的压缩。

哈夫曼编码实验超详尽版

编码步骤

6

在F中选取两棵根结点权值最小的树作为新构造 的二叉树的左右子树,新二叉树的根结点的权 值为其左右子树的根结点的权值之和。 从F中删除这两棵树,并把这棵新的二叉树同样 以升序排列加入到集合F中。 重复二和三两步,直到集合F中只有一棵二叉树 为止。

示例

7

假如有A,B,C,D,E五个字符,出现的频率(即权值) 分别为5,4,3,2,1,那么我们第一步先取两个最小权值 作为左右子树构造一个新树,即取1,2构成新树, 其结点为1+2=3,如图:

原理

3

首先统计信源中各符号出现的概率,按符号出现的

概率从大到小排序; 把最小的两个概率相加合并成新的概率,与剩余的 概率组成新的概率集合; 对新的概率集合重新排序,再次把其中最小的两个 概率相加,组成新的概率集合。如此重复进行,直 到最后两个概率的和为l;原理4 Nhomakorabea

分配码字:码字分配从最后一步开始反向进行,

9

实现过程:首先通过 HuffmanTree() 函数构造哈夫 曼树,然后在主函数 main()中自底向上开始(也就 是从数组序号为零的结点开始)向上层层判断,若 在父结点左侧,则置码为 0,若在右侧,则置码为 1。 最后输出生成的编码。 typedef struct

{ int bit[MAXBIT]; int start; } HCodeType; /* 编码结构体 */

五、程序部分代码及其分析

13

/* 设置找到的两个子结点 x1、x2 的父结点信息 */ HuffNode[x1].parent = n+i; HuffNode[x2].parent = n+i; HuffNode[n+i].weight = HuffNode[x1].weight + HuffNode[x2].weight; HuffNode[n+i].lchild = x1; HuffNode[n+i].rchild = x2;

哈夫曼编码方法

哈夫曼编码方法

哈夫曼编码(Huffman coding)是一种常用的无损数据压缩算法,用于将源数据转换为可变长度的二进制编码。

它基于源数据中不同符号出现的概率来构建一棵哈夫曼树,然后使用该树来生成每个符号对应的编码。

下面是哈夫曼编码的基本步骤:

1. 统计符号频率:对源数据进行扫描,统计每个符号出现的频率或概率。

2. 构建哈夫曼树:根据符号的频率构建一棵哈夫曼树。

频率较高的符号在树中位置较浅,频率较低的符号在树中位置较深。

3. 生成编码:从根节点开始,沿着哈夫曼树的路径向下,给左子树赋值"0",给右子树赋值"1",直到达到叶子节点。

每个叶子节点的编码就是其路径上经过的0和1序列。

4. 压缩数据:使用生成的编码来代替源数据中的符号,将原始数据进行压缩。

哈夫曼编码的优势在于,频率较高的符号被赋予较短的编码,而频率较低的符号被赋予较长的编码,从而实现了数据压缩。

在解压缩时,使用相同的哈夫曼树,根据编码逐位进行解码,恢复原始数据。

哈夫曼编码在通信、数据存储和多媒体处理等领域广泛应用,能够有效地压缩数据并节省存储空间或传输带宽。

1/ 1。

图像编码中的哈夫曼编码技术解析(六)

图像编码中的哈夫曼编码技术解析在图像编码领域,哈夫曼编码技术无疑是一项非常重要的算法。

它通过将出现频率较高的符号赋予较短的二进制编码,从而实现对图像数据进行高效压缩和传输。

本文将对哈夫曼编码技术进行解析,探讨其原理、应用和优缺点。

一、哈夫曼编码的原理哈夫曼编码是一种变长编码方式,其核心思想是通过根据符号的出现频率构建一棵二叉树,并根据树中每个叶子节点相对于根节点的路径,为每个符号赋予一个唯一的二进制编码。

具体而言,哈夫曼编码的过程包括以下几个步骤:1. 统计符号出现频率:首先,需要对图像数据进行统计,计算每个符号(通常是灰度级)在图像中出现的频率。

2. 构建哈夫曼树:根据统计结果,将每个符号作为叶子节点,按照频率从低到高的顺序构建一棵二叉树。

构建的过程中,频率较小的符号离根节点较远,而频率较高的符号离根节点较近。

3. 为叶子节点赋予编码:从哈夫曼树的根节点开始,按照左、右子树的方向分别赋予编码0和1。

遍历树的路径直到叶子节点,并记录下路径上经过的0和1,即可得到每个符号的二进制编码。

通过以上步骤,我们可以得到一个针对当前图像数据的哈夫曼编码表,用于将图像数据进行压缩和传输。

二、哈夫曼编码的应用哈夫曼编码在图像编码中有着广泛的应用。

它可以用于图像压缩、图像传输和图像存储等方面。

1. 图像压缩:由于哈夫曼编码采用变长编码方式,将出现频率较高的符号用较短的二进制编码表示,从而实现对图像数据的高效压缩。

这样可以大大减小图像数据的存储空间,提高了图像传输的速度和效率。

2. 图像传输:在图像传输过程中,由于带宽限制和传输速度要求,需要将图像数据进行压缩。

哈夫曼编码可以对图像数据进行高效压缩,减小传输的数据量,从而提高传输的速度和质量。

3. 图像存储:在图像存储中,由于存储空间通常有限,需要对图像数据进行压缩。

哈夫曼编码可以对图像数据进行高效的压缩,将图像数据存储在较小的空间中。

三、哈夫曼编码的优缺点哈夫曼编码作为一种经典的压缩算法,虽然具有高效的压缩性能,但也存在一些不足之处。

数字图像--图像的哈夫曼编码实验

江 西 理 工 大 学江 西 理 工 大 学 实 验 报 告 纸第 1 页/共 4页一、实验目的掌握哈夫曼编码算法的基本原理;要求对屏幕输入的信符概率向量进行哈夫曼编码。

二、实验内容对屏幕输入的信符概率向量例如‘[0.4 0.2 0.16 0.12 0.06 0.04 0.02]’进行哈夫曼编码,计算计算信源的熵,哈夫曼编码的平均码字长及其编码效率,显示哈夫曼编码与相应计算结果.三、实验步骤和设计思想通过哈夫曼编码来计算信源的熵,用Matlab 来模拟算法的过程。

霍夫曼编码的步骤:1)根据待编码的符号串,统计各个符号的概率;2)根据符号的概率统计特征,构建霍夫曼编码表,即计算每个符号的编码结果; 3)用得到的编码表对符号序列进行编码。

四、程序清单clcclear allp=input('请输入信符的概率向量:'); n=length(p); q=p;a=zeros(n-1,n); for i=1:n-1fprintf('第%d 次排序\n',i); [q,l]=sort(q) %qa(i,:)=[l(1:n-i+1),zeros(1,i-1)]fprintf('\n 第%d 次排序后合并生成的数据',i);q=[q(1)+q(2),q(3:n),1] endfor i=1:n-1c(i,1:n*n)=blanks(n*n); endc(n-1,n)='1'; c(n-1,2*n)='0'; for i=2:n-1c(n-i,1:n-1)=c(n-i+1,n*(find(a(n-i+1,:)==1))-(n-2):n*(find(a(n-i+1,:)==1))) c(n-i,n)='1';c(n-i,n+1:2*n-1)=c(n-i,1:n-1); c(n-i,2*n)='0';for j=1:i-1c(n-i,(j+1)*n+1:(j+2)*n)=c(n-i+1,n*(find(a(n-i+1,:)==j+1)-1)+1:n*(find(a(n-i+1,:)==j+1))) end end for i=1:nh(i,1:n)=c(1,n*(find(a(1,:)==i)-1)+1:find(a(1,:)==i)*n); ll(i)=length(find(abs(h(i,:)~=32))); endLavg=sum(p.*ll)fprintf('\n huffman code:\n'); hHA=(-1) * sum(p.*log2(p));fprintf('\n huffman effciency:\n'); t=HA/Lavg五、实验调试记录六、实验结果及其分析请输入信符的概率向量:[0.4 0.2 0.16 0.12 0.06 0.04 0.02] 第1次排序q = 0.0200 0.0400 0.0600 0.1200 0.1600 0.2000 0.4000 l = 7 6 5 4 3 2 1 a = 7 6 5 4 3 2 1 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0数字图像处理 实验报告姓名: 江 西 理 工 大 学 实 验 报 告 纸第 2 页/共 4页0 0 0 0 0 0 0 0 0 0 0 0 0 0第1次排序后合并生成的数据 q =0.0600 0.0600 0.1200 0.1600 0.2000 0.4000 1.0000 第2次排序 q =Columns 1 through 60.0600 0.0600 0.1200 0.1600 0.2000 0.4000 Column 7 1.0000 l =1 2 3 4 5 6 7 a =7 6 5 4 3 2 1 1 2 3 4 5 6 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 第2次排序后合并生成的数据 q =Columns 1 through 60.1200 0.1200 0.1600 0.2000 0.4000 1.0000 Column 7 1.0000 第3次排序 q =Columns 1 through 60.1200 0.1200 0.1600 0.2000 0.4000 1.0000 Column 7 1.0000 l =1 2 3 4 5 6 7 a =7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 0 0 0 0 0 0 00 0 0 0 0 0 0 0 0 0 0 0 0 0第3次排序后合并生成的数据 q =Columns 1 through 60.2400 0.1600 0.2000 0.4000 1.0000 1.0000 Column 7 1.0000第4次排序q =Columns 1 through 60.1600 0.2000 0.2400 0.4000 1.0000 1.0000 Column 7 1.0000l = 2 3 1 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0第4次排序后合并生成的数据 q =Columns 1 through 60.3600 0.2400 0.4000 1.0000 1.0000 1.0000 Column 7 1.0000第5次排序q = Columns 1 through 60.2400 0.3600 0.4000 1.0000 1.0000 1.0000 Column 7 1.0000l = 2 1 3 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 2 1 3 0 0 0 0 0 0 0 0 0 0 0 第5次排序后合并生成的数据 q =Columns 1 through 60.6000 0.4000 1.0000 1.0000 1.0000 1.0000姓名: 江 西 理 工 大 学 实 验 报 告 纸第 3 页/共 4页Column 7 1.0000第6次排序q =Columns 1 through 60.4000 0.6000 1.0000 1.0000 1.0000 1.0000 Column 7 1.0000l = 2 1 3 4 5 6 7 a = 7 6 5 4 3 2 1 1 2 3 4 5 6 0 1 2 3 4 5 0 0 2 3 1 4 0 0 0 2 1 3 0 0 0 0 2 1 0 0 0 0 0第6次排序后合并生成的数据q = 1 1 1 1 1 1 1c = 0 1 0 c = 01 00 1 1 0 c = 00 01 00 1 1 0 c = 001 000 01 01 00 1 1 0 c = 001 000 01 1 01 00 1 1 0 c = 01 001 000 01 1 01 00 1 1 0 c = 011 010 001 001 000 01 1 01 00 1 1 0 c = 011 010 001 000 001 000 01 1 01 00 1 1 0 c = 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 011 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 000 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c = 0111 0110 010 001 000 1 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c =0111 0111 0110 010 001 000 1 011 010 001 000 1 001 000 01 1 01 00 1 1 0 c =01111 01110 0110 0111 0110 010 001 000 1姓名: 江西理工大学实验报告纸011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 0100111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c =01111 01110 0110 010 0010111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 010 001 0000111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0c = 01111 01110 0110 010 001 000 10111 0110 010 001 000 1011 010 001 000 1001 000 01 101 00 11 0七、实验心得通过做这次实验掌握了哈夫曼编码的基本理论和算法流程;掌握了编程实现图像的哈夫曼编码算法。

哈夫曼编码(Huffmancoding)的那些事,(编码技术介绍和程序实现)

哈夫曼编码(Huffmancoding)的那些事,(编码技术介绍和程序实现)前⾔ 哈夫曼编码(Huffman coding)是⼀种可变长的前缀码。

哈夫曼编码使⽤的算法是David A. Huffman还是在MIT的学⽣时提出的,并且在1952年发表了名为《A Method for the Construction of Minimum-Redundancy Codes》的⽂章。

编码这种编码的过程叫做哈夫曼编码,它是⼀种普遍的熵编码技术,包括⽤于⽆损数据压缩领域。

由于哈夫曼编码的运⽤⼴泛,本⽂将简要介绍:哈夫曼编码的编码(不包含解码)原理代码(java)实现过程⼀、哈弗曼编码原理 哈夫曼编码使⽤⼀种特别的⽅法为信号源中的每个符号设定⼆进制码。

出现频率更⼤的符号将获得更短的⽐特,出现频率更⼩的符号将被分配更长的⽐特,以此来提⾼数据压缩率,提⾼传输效率。

具体编码步骤主要为, 1、统计: 在开始编码时,通常都需要对信号源,也就是本⽂的⼀段⽂字,进⾏处理,计算出每个符号出现的频率,得到信号源的基本情况。

接下来就是对统计信息进⾏处理了 2、构造优先对列: 把得到的符号添加到优先队列中,此优先队列的进出逻辑是频率低的先出,因此在设计优先队列时需要如此设计,如果不熟悉优先队列,请阅读相关书籍,在此不做过多概述。

得到包含所有字符的优先队列后,就是处理优先队列中的数据了。

3、构造哈夫曼树: 哈夫曼树是带权值得⼆叉树,我们使⽤的哈夫曼树的权值⾃然就是符号的频率了,我们构建哈夫曼树是⾃底向上的,先构建叶⼦节点,然后逐步向上,最终完成整颗树。

先把队列中的⼀个符号出列,也就是最⼩频率的符号,,然后再出列⼀个符号。

这两个符号将作为哈夫曼树的节点,⽽且这两个节点将作为新节点,也就是它们⽗节点,的左右孩⼦节点。

新节点的频率,即权值,为孩⼦节点的和。

把这个新节点添加到队列中(队列会重新根据权值排序)。

重复上⾯的步骤,两个符号出列,构造新的⽗节点,⼊列……直到队列最后只剩下⼀个节点,这个节点也就是哈夫曼树的根节点了。

数字图像处理课程设计--Huffman编码理论及算法实现

数字图像处理课程设计课程题目 Huffman编码原理及算法实现Huffman编码理论及算法实现一、基本介绍霍夫曼编码使用变长编码表对源符号(如文件中的一个字母)进行编码,其中变长编码表是通过一种评估来源符号出现机率的方法得到的,出现机率高的字母使用较短的编码,反之出现机率低的则使用较长的编码,这便使编码之后的字符串的平均长度、期望值降低,从而达到无损压缩数据的目的。

霍夫曼树又称最优二叉树,是一种带权路径长度最短的二叉树。

所谓树的带权路径长度,就是树中所有的叶结点的权值乘上其到根结点的路径长度(若根结点为0层,叶结点到根结点的路径长度为叶结点的层数)。

树的路径长度是从树根到每一结点的路径长度之和,记为WPL=(W1*L1+W2*L2+W3*L3+...+Wn*Ln)N个权值Wi(i=1,2,...n)构成一棵有N个叶结点的二叉树,相应的叶结点的路径长度为Li(i=1,2,...n)。

可以证明霍夫曼树的WPL是最小的。

输入符号集合S={s1,s2,···,Sn},其S集合的大小为n。

权重集合W={w1,w2,···,Wn},其W集合不为负数且Wi=weight(Si),1 ≤ i ≤ n。

输出一组编码C(S,W)={c1,c2,···Cn},其C集合是一组二进制编码且Ci为Si相对应的编码,1 ≤ i ≤ n。

霍夫曼树常处理符号编写工作。

根据整组数据中符号出现的频率高低,决定如何给符号编码。

如果符号出现的频率太高,则给符号的码越短,相反符号的号码越长。

假设我们要给一个英文单字"F O R G E T"进行霍夫曼编码,而每个英文字母出现的频率。

二、演算过程(一)进行霍夫曼编码前,我们先创建一个霍夫曼树。

⒈将每个英文霍夫曼树字母依照出现频率由小排到大,最小在左。

⒉每个字母都代表一个终端节点(叶节点),比较F.O.R.G.E.T五个字母中每个字母的出现频率,将最小的两个字母频率相加合成一个新的节点。

图像的霍夫曼编码

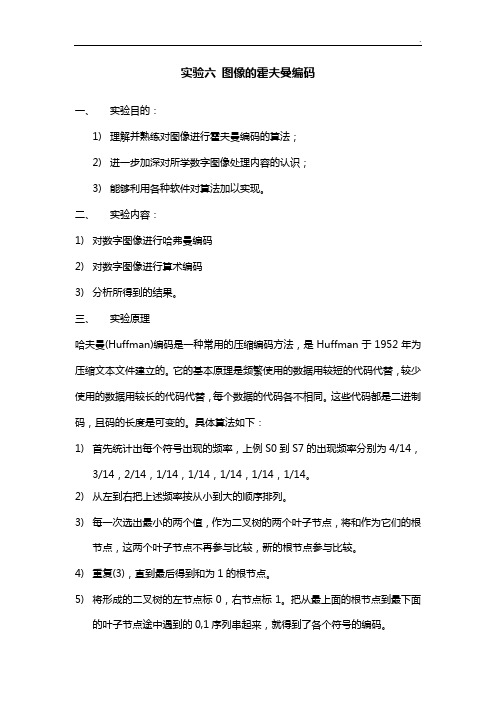

实验六图像的霍夫曼编码一、实验目的:1)理解并熟练对图像进行霍夫曼编码的算法;2)进一步加深对所学数字图像处理内容的认识;3)能够利用各种软件对算法加以实现。

二、实验内容:1)对数字图像进行哈弗曼编码2)对数字图像进行算术编码3)分析所得到的结果。

三、实验原理哈夫曼(Huffman)编码是一种常用的压缩编码方法,是Huffman于1952年为压缩文本文件建立的。

它的基本原理是频繁使用的数据用较短的代码代替,较少使用的数据用较长的代码代替,每个数据的代码各不相同。

这些代码都是二进制码,且码的长度是可变的。

具体算法如下:1)首先统计出每个符号出现的频率,上例S0到S7的出现频率分别为4/14,3/14,2/14,1/14,1/14,1/14,1/14,1/14。

2)从左到右把上述频率按从小到大的顺序排列。

3)每一次选出最小的两个值,作为二叉树的两个叶子节点,将和作为它们的根节点,这两个叶子节点不再参与比较,新的根节点参与比较。

4)重复(3),直到最后得到和为1的根节点。

5)将形成的二叉树的左节点标0,右节点标1。

把从最上面的根节点到最下面的叶子节点途中遇到的0,1序列串起来,就得到了各个符号的编码。

四、实验过程1)实验流程图程序入口函数WinMa注册主窗口类MyRegisterClass主窗口实例化InitInstance消息循环分发消息响应WM_COMMAND消息调用LoadBmpFile函数加载BMP图象文件响应WM_PAINT消息在主窗口内显示bmp对工具栏选项进行处理,调用霍夫曼函数进行编码消息处理函数WndProc霍夫曼编码示意图如下:2)实验代码见实验报告附页。

五、实验结果1)打开要进行编码的图片,如下图所示:2)对图片进行霍夫曼编码,得到如下结果:六、实验总结1)通过本实验,进一步加深了对霍夫曼编码的实验原理和算法的理解和认识;2)加强了分析问题和解决问题的能力;3)熟练了软件的使用能力,提高了利用软件对数字图像进行处理的能力。

哈夫曼编码的方法

1.哈夫曼编码的方法编码过程如下:<1> 将信源符号按概率递减顺序排列;<2> 把两个最小的概率加起来, 作为新符号的概率;<3> 重复步骤<1> 、<2>, 直到概率和达到1 为止;<4> 在每次合并消息时,将被合并的消息赋以1和0或0和1;<5> 寻找从每个信源符号到概率为1处的路径,记录下路径上的1和0;<6> 对每个符号写出"1"、"0"序列〔从码数的根到终节点〕.2.哈夫曼编码的特点①哈夫曼方法构造出来的码不是唯一的 .原因·在给两个分支赋值时, 可以是左支< 或上支> 为0, 也可以是右支< 或下支> 为0, 造成编码的不唯一.·当两个消息的概率相等时, 谁前谁后也是随机的, 构造出来的码字就不是唯一的.②哈夫曼编码码字字长参差不齐, 因此硬件实现起来不大方便.③哈夫曼编码对不同的信源的编码效率是不同的.·当信源概率是2 的负幂时, 哈夫曼码的编码效率达到100%;·当信源概率相等时, 其编码效率最低.·只有在概率分布很不均匀时, 哈夫曼编码才会收到显著的效果, 而在信源分布均匀的情况下, 一般不使用哈夫曼编码.④对信源进行哈夫曼编码后, 形成了一个哈夫曼编码表.解码时, 必须参照这一哈夫编码表才能正确译码.·在信源的存储与传输过程中必须首先存储或传输这一哈夫曼编码表在实际计算压缩效果时, 必须考虑哈夫曼编码表占有的比特数.在某些应用场合, 信源概率服从于某一分布或存在一定规律< 这主要由大量的统计得到>, 这样就可以在发送端和接收端固定哈夫曼编码表, 在传输数据时就省去了传输哈夫曼编码表, 这种方法称为哈夫曼编码表缺省使用.使用缺省的哈夫曼编码表有两点好处:·降低了编码的时间, 改变了编码和解码的时间不对称性;·便于用硬件实现, 编码和解码电路相对简单.这种方法适用于实时性要求较强的场合.虽然这种方法对某一个特定应用来说不一定最好, 但从总体上说, 只要哈夫曼编表基于大量概率统计,其编码效果是足够好的.3.哈夫曼编码举例现在有8个待编码的符号M0,….,M0 它们的概率如下表所示,使用霍夫曼编码算法求出8个符号所分配的代码.〔写出编码树〕待编码的符号概率M00.2M10.4M20.1M30.15M40.03M50.04M60.07M70.01解:为了进行哈夫曼编码, 先把这组数据由大到小排列, 再按上方法处理〔1〕将信源符号按概率递减顺序排列.〔2〕首先将概率最小的两个符号的概率相加,合成一个新的数值.〔3〕把合成的数值看成是一个新的组合符号概率,重复上述操作,直到剩下最后两个符号.5.4.2 Shannon-Famo编码Shannon-Famo<S-F> 编码方法与Huffman 的编码方法略有区别, 但有时也能编出最佳码. 1.S-F码主要准则符合即时码条件;在码字中,1 和0 是独立的, 而且是< 或差不多是>等概率的.这样的准则一方面能保证无需用间隔区分码字,同时又保证每一位码字几乎有1位的信息量. 2.S-F码的编码过程信源符号按概率递减顺序排列;把符号集分成两个子集, 每个子集的概率和相等或近似相等;对第一个子集赋编码"0", 对第二个子集赋编码"1";重复上述步骤, 直到每个子集只包含一个信源符号为止.5.4.3 游程编码游程编码<简写为RLE或RLC>是一种十分简单的压缩方法,它将数据流中连续出现的字符< 称为游程> 用单一的记号来表示.例如,字符串a b a C C C b b a a a a可以压缩为a b a 3c 2b 4a游程编码的压缩效果不太好, 但由于简单, 编码/ 解码的速度非常快, 因此仍然得到广泛的应用.许多图形和视频文件, 如 .BMP,.TIF 与 .AVI 等, 都使用了这种压缩.5.4.4 算术编码1.算术编码算术编码把一个信源集合表示为实数线上的0 到1 之间的一个区间.这个集合中的每个元素都要用来缩短这个区间.信源集合的元素越多,所得到的区间就越小,当区间变小时,就需要更多的数位来表示这个区间,这就是区间作为代码的原理.算术编码首先假设一个信源的概率模型,然后用这些概率来缩小表示信源集的区间.2.举例说明算术编码过程[ 例]设英文元音字母采用固定模式符号概率分配如下:字符 a e i o u概率0.2 0.3 0.1 0.2 0.2范围[0,0.2] [0.2,0.5] [0.5,0.6] [0.6,0.8] [0.8,1.0]设编码的数据串为eai .令high 为编码间隔的高端,low 为编码间隔的低端, range 为编码间隔的长度,rangelow 为编码字符分配的间隔低端,rangehigh 为编码字符分配的间隔高端.初始high=1,low=0,range=high-low, 一个字符编码后新的low 和high 按下式计算:·low =low+range × rangelow·high =low+range×rangehigh<1> 在第一个字符e 被编码时,e 的rangelow=0.2,rangehigh=0.5, 因此: low=0 + 1 × 0.2 =0.2high=0 + 1 × 0.5 =0.5range=high-low=0.5-0.2=0.3此时分配给e 的范围为[0.2,0.5] .<2>第二个字符a 编码时使用新生成范围[0.2,0.5],a 的rangelow=0, rangehigh=0.2, 因此:low=0.2 十0.3 × 0=0.2high=0.2 +0.3 × 0.2=0.26range=0.06范围变成[0.2,0.26] .<3> 对下一个字符i 编号,i 的rangelow=0.5,rangehigh=0.6, 则:low=0.2 +0.06 × 0.5=0.23high=0.2 +0.06 × 0.6=0.236即用[0.23,0.236] 表示数据串eai, 如果解码器知道最后范围是[0.23,0.236 ]这一范围, 它马上可解得一个字符为e, 然后依次得到惟一解a, 即最终得到eai .3.算术编码的特点①不必预先定义概率模型, 自适应模式具有独特的优点;②信源符号概率接近时, 建议使用算术编码, 这种情况下其效率高于Huffman 编码;③算术编码绕过了用一个特定的代码替代一个输入符号的想法, 用一个浮点输出数值代替一个流的输入符号, 较长的复杂的消息输出的数值中就需要更多的位数.④算术编码实现方法复杂一些, 但JPEG 成员对多幅图像的测试结果表明, 算术编码比Huffman 编码提高了5% 左右的效率, 因此在JPEG 扩展系统中用算术编码取代Huffman 编码.。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

实验八哈夫曼编码的方法和实现

一、实验目的

1.掌握哈夫曼编码的基本理论和算法流程;

2. 用VC++6.0编程实现图像的哈夫曼编码。

二、实验内容

1.画出哈夫曼编码的算法流程;

2.用VC++6.0编程实现哈夫曼编码。

三、实验步骤

(1)启动VC++6.0,打开Dip工程。

(2)在菜单栏→insert→resouce→dialog→new,在对话框模版的非控制区点击鼠标右键,在弹出的对话框中选properties,设置为ID:IDD_DLG_Huffman,C标题:哈夫曼编码表。

(3)在弹出的对话框中,添加如下的按钮等控件:

(4)在ResourceView栏中→Menu→选IDR_DIPTYPE ,如图

在图像编码菜单栏下空的一栏中,右键鼠标,

在弹出的对话框中选属性properties,在弹出的对话框中,进行如下的设置

(5)右击哈夫曼编码表菜单栏,在建立的类向导中进行如下设置

(6)在DipDoc.cpp中找到void CDipDoc::OnCodeHuffman()添加如下代码void CDipDoc::OnCodeHuffman()

{

int imgSize;

imgSize = m_pDibObject->GetWidth()*m_pDibObject->GetHeight();

//在点处理CPointPro类中创建用来绘制直方图的数据

CPointPro PointOperation(m_pDibObject );

int *pHistogram = PointOperation.GetHistogram();

//生成一个对话框CHistDlg类的实例

CDlgHuffman HuffmanDlg;

//将绘制直方图的数据传递给CHistDlg对话框类的公有成员变量m_pnHistogram

if( pHistogram != NULL )

{

//设置直方图数据指针

HuffmanDlg.m_fFreq = pHistogram;

HuffmanDlg.m_iSizeImage = imgSize;

if(m_pDibObject->GetNumBits() >= 8)

HuffmanDlg.m_iLeafNum=256;

else

HuffmanDlg.m_iLeafNum=m_pDibObject->GetNumBits();

}

//显示对话框

if ( HuffmanDlg.DoModal() != IDOK)

return;

delete [] pHistogram;

}

(7)在DipDoc.cpp中添加#include "DlgHuffman.h"

(8)将DlgHuffman.h、DlgHuffman.cpp文件拷贝到当前工程目录文件里面;并添加到当前工程。

四、实验结果

五、实验心得及体会

通过做这次实验掌握了哈夫曼编码的基本理论和算法流程;掌握了编程实现图像的哈夫曼编码算法。