第三章 回归分析

第三章_回归分析基本方法最小二乘法

第三章_回归分析基本方法最小二乘法回归分析是统计学中一种通过建立变量之间的关系模型来预测或解释变量之间关系的方法。

最常用的回归分析方法之一是最小二乘法。

最小二乘法是一种通过最小化观测值与预测值之间的误差平方和来估计模型参数的方法。

最小二乘法的基本原理是寻找一条直线或曲线,使得该直线或曲线上的点到各观测值的距离之和最小。

最小二乘法的数学表达式可以表示为:$$\min_{\beta_0,\beta_1,...,\beta_k} \sum_{i=1}^{n}(y_i -(\beta_0 + \beta_1x_{i1} + ... + \beta_kx_{ik}))^2$$其中,$y_i$为观测值,$x_{ij}$为自变量,$\beta_0$为截距,$\beta_1$到$\beta_k$为模型参数。

在实际应用中,最小二乘法可以应用于各种回归模型,如简单线性回归、多元线性回归、非线性回归等。

简单线性回归是最简单的回归模型,假设自变量和因变量之间存在线性关系。

简单线性回归的数学表达式为:$$y = \beta_0 + \beta_1x + \epsilon$$其中,$y$为因变量,$x$为自变量,$\beta_0$为截距,$\beta_1$为斜率,$\epsilon$为误差项。

通过最小二乘法求解简单线性回归模型的参数$\beta_0$和$\beta_1$,可以得到回归方程的估计值。

利用回归方程,可以对因变量进行预测或解释。

多元线性回归是简单线性回归的扩展,假设自变量和因变量之间存在线性关系,但自变量有多个。

多元线性回归的数学表达式为:$$y = \beta_0 + \beta_1x_1 + \beta_2x_2 + ... + \beta_kx_k + \epsilon$$其中,$y$为因变量,$x_1$到$x_k$为自变量,$\beta_0$为截距,$\beta_1$到$\beta_k$为斜率,$\epsilon$为误差项。

数学地质第三章 回归分析

yi

n

(3-9)

n 1 1 y yi x xi n i 1 n i 1 则式(3-9)可化为

n

n n 2 na x b xi xi y i i 1 i 1 a bx y

(3-10)

二、参数a,b的最小二乘估计

由式(3-10)中第一个方程得

y x

一、一元线性回归的数学模型

将式(3-2)及式(3-3)两边取对数,则分别为 Lny=lnα+βx (3-4) 及 lny=lnα+βlnx (3-5) 如果在式(3-4)中令Y=lny,则Y与x即成线性 关系;如果在式(3-5)中令Y=lny,X=lnx,则Y与X 就成线性关系。此外,还有一些函数,只要经过简单 变换,也可变为线性关系。这些统称为可化为线性关 系的情况,只要线性情况得到解决,可化为线性的情 况也就不难解决。

一元线性回归分析,主要是处理两个变量

x、y之间的关系。两个变量之间的关系有线性 和非线性两种情况,这里主要讨论线性关系及 可化为线性关系的非线性情况。

一、一元线性回归的数学模型

线性关系数学模型,如 y=a+bx (a,b为常数) (3-1) 非线性的情况,如指数函数 x y e (α,β为常数) (3-2) 幂函数形式 (3-3)

n Q 2 ( yi a bxi ) 0 a i 1 n Q 2 ( yi a bxi ) xi 0 b i 1

( 3-8)

二、参数a,b的最小二乘估计

即

令

i 1 i 1 n n n a xi b xi2 xi y i i 1 i 1 i 1 na b xi

二、参数a,b的最小二乘估计

选修2-3第三章:回归分析的基本思想及其初步应用(校级优质课)

为了衡量预报的精度,需要估计 的σ2值?

随机误差ei yi bxi a(i 1, 2,....n) ˆ ˆ ˆ ˆ 其估计值为: e y y y bx a

i i i i i

ˆ ei称为相应点(xi ,yi )的残差

(1)根据散点图来粗略判断它们是否线性相关。

(2)是否可以用线性回归模型来拟合数据

施化肥量

30 40 50

x

Q(a,b)= (yi - bxi - a)2 取最小值时,a,b的值.

i=1

推导过程见教材80和81页,推导 方法叫最小二乘法

1、所求直线方程 y = bx + a 叫做回归直 ˆ ˆ ˆ ---线方程;其中

回归直线方程:

(x

i=1 n n i

称为样本点的中心。 2.相应的直线叫做回归直线。 3、对两个相关变量进行的线性分析叫做 线性回归分析。

高二数学 选修2-3

3.1回归分析的基本 思想及其初步应用 (两课时)

复习、变量之间的两种关系

问题1:正方形的面积y与正方形的边长x之间 的函数关系是 确定性关系 y = x2 问题2:某水田水稻产量y与施肥量x之间是否 -------有一个确定性的关系? 例如:在 7 块并排、形状大小相同的试验田 上 进行施肥量对水稻产量影响的试验,得到 如下所示的一组数据:

如:人的身高与年龄; 产品的成本与生产数量;

商品的销售额与广告费;

家庭的支出与收入。等等 探索:水稻产量y与施肥量x之间大致有何 规律?

施化肥量x 15

20

25

30

35

40

45

水稻产量y 330 345 365 y

500 450 400 350 300 10

气象统计方法课件 3回归分析

当b<0,回归直线斜率为负,预报量y随预报因子x增加而减少, 反映预报量与因子是负相关; 当b>0,回归直线斜率为正,预报量y随预报因子x增加而增加, 反映预报量与因子是正相关。

二、回归问题的方差分析

1、意义 评价回归方程的优劣。

2、预报量的方差可以表示成回归估计值的方差 (回归方差)和误差(残差)方差之和。

1

n

n i 1

( yi

y)2

1 n

n i 1

( yˆi

y)2

1 n

n i 1

( yi

yˆ )2

(4)

即: sy2 syˆ2 se2

• 方差分析表明,预报量y的变化可以看成由 前期因子x的变化所引起的,同时加上随机 因素e变化的影响,这种前期因子x的变化影 响可以用回归方差的大小来衡量。如果回 归方差大,表明用线性关系解释y与x的关系 比较符合实际情况,回归模型比较好。

xi

n i 1

yi

n

n

n

b0

i 1

xi

b

i 1xi 2源自i 1xiyi

(3)

(3)式称为求回归系数的标准方程组。

回归系数也可直接表示为:

b0 y bx

n

b

xi yi nxy

i 1

n

xi2 nx 2

i 1

Sxy Sx2

将 b0 =y bx 代入回归方程 yˆi =b0 bxi,得

回归分析与相关分析的区别:

1. 相关分析中,变量x、y处于平等的地位;回归分析中,

变量y称为因变量,处在被解释的地位,x称为自变量, 用于预测因变量的变化。 2. 相关分析中所涉及的变量x和y都是随机变量;回归分 析中,因变量y是随机变量,自变量x可以是随机变量, 也可以是非随机的确定变量。 3. 相关分析主要是描述两个变量之间线性关系的密切程 度;回归分析不仅可以揭示变量x对变量y的影响大小, 还可以由回归方程进行预测和控制。

人教版高中数学第三章3.1第2课时线性回归分析

+

8.95

+

9.90

+

10.9

+

11.8)≈9.487,

所以 R2=1-01.40.16378184≈0.999 1, 所以回归模型的拟合效果较好.

(3)由表中数据可以看出残差点比较均匀地落在不超 过 0.15 的狭窄的水平带状区域中,说明选用的线性回归 模型的精度较高,由以上分析可知,弹簧长度与拉力成线 性关系.由残差表中的数值可以看出第 3 个样本点的残差 比较大,需要确认在采集这个数据的时候是否有人为的错 误,如果有的话,需要纠正数据,重新建立回归模型.

由公式得:^z =0.69x+1.115,则有^y=e0.69x+1.115. (2)由计数器得如下数表:

^y 6.08 12.12 24.17 48.18 96.06 191.52 y 6 12 25 49 95 190

R2=1-244.8614621.8≈0.999 8, 即解释变量天数对预报变量繁殖细菌个数解释了 99.98%.

x 21 23 25 27 29 32 35 z 1.946 2.398 3.045 3.178 4.190 4.745 5.784

利用公式求得回归直线方程为^z =0.272x-3.849, 所以^y =e0.272x-3.849

残差:

yi 7

11

21

24

66 115

yi 6.443 11.101

解析:因为^z =0.25x-2.58,^z =ln y,所以 y=e0.25x

-2.58.

答案:y=e0.25x-2.58

类型 1 线性回归分析(自主研析)

[典例 1] 为研究重量 x(单位:克)对弹簧长度 y(单位: 厘米)的影响,对不同重量的 6 个物体进行测量,数据如 下表所示:

03第三章 回归分析预测法

ˆ ˆ x )2 ˆi ) 2 ( yi Q ei2 ( yi y 0 1 i

第三章>>第一节

二、一元线性回归模型参数的估计

根据微分学求极值的原理,对上式求偏导,并令其为 零 得方程组:

yi n 0 1 xi 2 xi yi 0 xi 1 xi

即哪个或哪些是被解释变量哪个或哪些是解释变量将影响研究对象的最主要的定量的经常发生作用的有数据支持的因素作为解释变量纳入模型之中并确定解释变量和被解释变量之间的变动方向解释变量之间相关性研究建模用于经济结构分析时选用恰当的统计指标慎重使用虚拟变量4确定模型的数学形式依据数理经济理论由散点图相关图趋势图观察样本数据变动模式

随机误差项的影响因素

人们的随机行为 回归模型中 省略的变量

2

1

随机误差项 建立的数学模型 的形式不够完善

3

的影响因素

测量误差

5 4

经济变量之间的 合并误差

第三章>>第一节

一、一元线性回归模型的建立

• (二)随机误差项的意义和标准假定

– 随机误差项u是无法直接观测的,为了进行回归分析, 通常设其满足以下标准假定: – 古典线性回归模型(classical linear regression model,CLRM)基本假定: 1. 零均值假定:u i 的期望为0,即:

• 一致性:随着样本量的增大,估计量的 • 值越来越接近被估计的总体参数

ˆ) P(

较大的样本量

B A

较小的样本量

ˆ

最小方差性证明略。

第三章>>第一节

三、一元线性回归模型的检验

• (一)经济检验

第三章回归分析预测方法

1984

539

7136

1992

769

8683

1985

577

7658

1993

801

9317

1986

613

7784

1994

855

9675

1987

644

8108

2019

842

8542

1988

670

7583

2019

860

8584

1989

695

8002

2019

890

9612

1990

713

8442

2019

920

x

相关但无

线性关系

-3

-2

-1

0

1

2

3

x

2、回归分析与相关分析

研究和测度两个或两个以上变量之间关系的方 法有回归分析和相关分析。

相关分析。研究两个或两个以上随机变量之 间线性依存关系的紧密程度。通常用相关系 数表示,多元相关时用复相关系数表示。

回归分析。研究某一随机变量(因变量)与 其他一个或几个普通变量(自变量)之间的 数量变动的关系。

回本章目录

一、一元线性回归模型

一元线性回归(Linear regression),只研究一个 自变量与一个因变量之间的统计关系。

对于只涉及一个自变量的简单线性回归模型可表

示为: yb0b1xe

其中,b0和b1称为模型的参数;e是随机误差项,

又称随机干扰项,有 e N0,2

在线性回归模型中加入随机误差项是基于 以下原因:

第一节 引言

本章学习目的与要求:

通过本章的学习,了解回归分析预测法 的概念,掌握回归分析中各系数的计算方法 及回归预测方法,能够运用Excel工具来进行 预测。

第三章_回归分析

第三章 回歸分析 §1 一元線性回歸 一、回歸模型設隨機變數y 與引數x 之間存在線性關係,它們的第i 次觀測數據是:(xi,yi)(i=1,2,…,n)那麼這組數據可以假設具有如下的數學結構式:i i i x y εββ++=0(i=1,…,n ),其中β0, β為待估參數,),0(~2σεN i ,且n εεε,,,21 相互獨立,這就是一元線性回歸的數學模型。

二、參數估計 1.回歸係數設b0和b 分別是參數β0, β的最小二乘估計,於是一元線性回歸方程為:i i bx b y+=0ˆ (i=1,2,…,n ) b0,b 叫做回歸係數,它使偏差平方和∑∑==--=-=ni i i ni i i bx b y yy Q 12012)()ˆ(取最小值。

由 ⎝⎛=---=∂∂=---=∂∂∑∑==0)(20)(210100ni i i i ni i i x bx b y b Q bx b y b Q整理得正規方程組: 020()()()i ii i i inb x b y x b x b x y +∑=∑⎛∑+∑=∑⎝解得 xx xy S S b x b y b /,0=-= 其中 222)(x n x x x S i i xx -∑=-∑=y x n y x y y x x S i i i i xy -∑=--∑=))((另外 y n y y y S i i yy -∑=-∑=22)( 2.最小二乘估計b0,b 的統計性質 (1)E(b)= β,E(b0)= β0即b0,b 分別是β0,β的無偏估計 (2)22()/()i D b x x σ=∑-22201()[/()]i D b x x x nσ=+∑-即回歸係數b0,b 與σ2,x 的波動大小有關,b0還與n 有關,這就是說,x 值越分散,數據越多,估計b0,b 越精確。

三、假設檢驗 1.回歸方程顯著性檢驗欲檢驗y 與x 之間是否有線性關係,即檢驗假設H0:β=0。

计量经济学-多元线性回归分析

yi ˆ1 x1i ˆ2 x2i ˆk xki ei 其矩阵形式为

i=1,2…n

y xβˆ e

其中 :

y1

y

y2

yn

x11

x

x12

x 21

x 22

xk1 xk2

x1n x2n xkn

ˆ1

βˆ

ˆ 2

ˆk

在离差形式下,参数旳最小二乘估计成果为

模型中解释变量旳数目为(k)

模型:Yt 1 2t X 2t k X kt ut

也被称为总体回归函数旳随机体现形式。它 旳 非随机体现式为:

E(Yi | X 2i , X 3i , X ki ) 1 2 X 2i 3 X 3i k X ki

方程表达:各变量X值固定时Y旳平均响应。

0.17033

2.652155 0.0157

R-squared

0.9954 Mean dependent var

928.4909

Adjusted R-squared S.E. of regression Sum squared resid Log likelihood F-statistic Prob(F-statistic)

βˆ (xx)1 xY

ˆ0 Y ˆ1 X 1 ˆk X k

⃟随机误差项旳方差旳无偏估计

能够证明,随机误差项旳方差旳无偏估计量为

ˆ 2 ei2 ee

nk nk

四、参数估计量旳性质

在满足基本假设旳情况下,其构造参数旳一般

最小二乘估计、最大或然估计及矩估计仍具有: 线性性、无偏性、有效性。

ˆ1

Байду номын сангаас

Q0

ˆ2

Q

计量地理学第三章——2 回归分析

例1

一元线性回归方法的基本公式为:

y a bx

式中:a,b为待定参数,其表达式如下:

b Lxy Lxx

n i 1

xi yi

1 n

n

(

i 1

xi )(

n i 1

n i 1

xi2

1 n

n

(

i 1

xi )2

yi )

a y bx

变差 来源 回归

误差

总和

平方和

自由度

n

SSR (Yˆi Y )2

地区编号 1 2 3 4 5 6 7 8

月平均销售收 入(万元)y

31

40

30

34

25

20

35

40

月平均广告支 出(万元)x

5 10 5

7

4

3

7

9

要求:对于不同的月平均广告支出预测月平均销售收入

解:由计算结果可知,回归方程为

SST=338.875 SSR=314.532 SSE=24.343

Y 14.669 2.753X

因此,对于不同的月平均广告支出,其月平均销售收入的预测 结果如下:单位:万元

月平均广告支出 平均收入的点预测 平均收入的区间预测

6

31.187

(25.956,36.418)

8

36.693

(31.296,42.090)

12

47.705

(40.872,54.538)

直线回归、相关分析的注意事 项:

1)相关分析只是以相关系数来描述两个变量间线性相关 的程度和方向,并不阐明事物间存在联系的本质,也不是两事 物间存在联系的证据。要阐明两事物间的本质联系,必须凭专 业知识从理论上加以论证。因此,把两个毫无关系的事物放在 一起作相关分析是毫无意义的。同样,回归分析也要有实际意 义。

第3章 多元回归分析:假设检验

7

The t Test (cont)

To perform our test we first need to form " the" t statistic for β : t ≡ β se β

j

βjBiblioteka j( )j

We will then use our t statistic along with a rejection rule to determine whether to accept the null hypothesis, H 0

fail to reject

(

( ) )

(

( ) )

reject

α/2 -c

(1 α)

0 c

reject α/2

15

Summary for H0: βj = 0

Unless otherwise stated, the alternative is assumed to be two-sided If we reject the null, we typically say “xj is statistically significant at the α % level” If we fail to reject the null, we typically say “xj is statistically insignificant at the α % level”

j j

) ( )

j

n k 1

Note this is a t distribution (vs normal) 2 because we have to estimate σ by σ

2

Note the degrees of freedom : n k 1 se β j =

第三章回归分析基本方法最小二乘法

第三章回归分析基本方法最小二乘法回归分析是统计学中一种常用的方法,主要用于研究一个或多个自变量与因变量之间关系的强度和方向。

在回归分析中,最常用的方法是最小二乘法。

最小二乘法是一种通过最小化观测值与拟合值之间的平方误差来估计参数的方法。

其基本思想是通过找到使得平方误差最小的参数值来拟合数据。

最小二乘法可以应用于各种类型的回归模型,包括简单线性回归和多元线性回归。

在简单线性回归中,我们研究一个自变量与一个因变量之间的关系。

假设我们有一组观测数据(x_i,y_i),其中x_i为自变量的取值,y_i为相应的因变量的取值。

我们想要找到一条直线来拟合这些数据点,使得误差最小化。

最小二乘法的目标是找到最合适的斜率和截距来拟合数据,最小化残差平方和。

具体而言,假设我们的模型为y=β_0+β_1*x,其中β_0为截距,β_1为斜率。

我们的目标是找到最合适的β_0和β_1来最小化残差平方和,即最小化∑(y_i-(β_0+β_1*x_i))^2最小二乘法的求解过程是通过对残差平方和关于β_0和β_1求偏导数,令偏导数为0,得到关于β_0和β_1的方程组。

通过求解这个方程组,我们可以得到最佳的β_0和β_1的估计值。

在多元线性回归中,我们考虑多个自变量与一个因变量之间的关系。

假设我们有p个自变量,我们的模型可以表示为y=β_0+β_1*x_1+β_2*x_2+...+β_p*x_p。

最小二乘法的求解过程与简单线性回归类似,只是需要求解一个更复杂的方程组。

最小二乘法在回归分析中的应用非常广泛。

它可以用于预测和建模,也可以用于建立因果关系的推断。

此外,最小二乘法还可以用于进行参数估计和统计检验。

总结起来,最小二乘法是一种基本的回归分析方法,通过最小化观测值与拟合值之间的平方误差来估计参数。

它在简单线性回归和多元线性回归中都有广泛应用,是统计学中重要的工具之一。

第三章 回归分析预测法 《统计预测与决策》PPT课件

残差分析; 异方差及自相关检验(DW)

24

拟合优度

• 拟合优度是指样本回归直线对观测数据 拟合的优劣程度。

• 如果全部观测值都在回归直线上,我们 就获得“完全的”拟合,但这是罕见的 情况,通常都存在一些正ei或负ei。我们 所希望的就是围绕回归直线的剩余尽可 能的小。

(基本假定)

1) 误差项ε是一个期望值为0的随机变量,即 E(ε)=0。对于一个给定的 x 值,y 的期望值

为E ( y ) =b 0+ b 1 x

2) 对于所有的 x 值,ε的方差σ2 都相同

3) 误差项ε是一个服从正态分布的随机变量,且 相互独立。即ε~N( 0 ,σ2 )

a. 独立性意味着对于一个特定的 x 值,它所对应 的ε与其他 x 值所对应的ε不相关

y

(xn ,yn)

yˆ bˆ0 + bˆ1x

(x2 ,y2)

}

ei = yi^-yi

(x1 ,y1) (xi , yi)

17

x

最小二乘估计式

• 根据最小二乘准则建立样本回归函数的 过程为最小二乘估计,简记OLS估计。

• 由此得到的估计值得计算式称为最小二 乘估计式。

18

双变量线性回归模型的最小二乘估计

36

▪ 包含在y里面但不能被p个自变量的线性关系

所解释的变异性

多元回归模型

(基本假定)

1. 误差项ε是一个期望值为0的随机变量,即

E()=0 2. 对于自变量x1,x2,…,xp的所有值,的

方差2都相同 3. 误差项ε是一个服从正态分布的随机变量,

即ε~N(0,2),且相互独立

37

多元回归方程

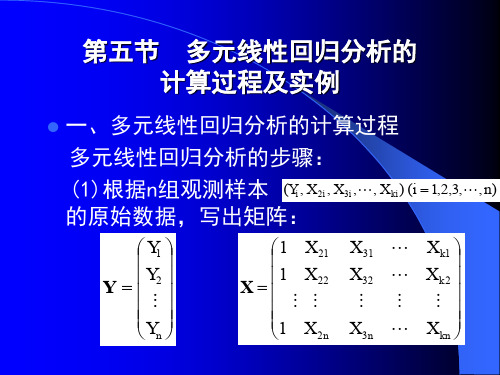

第三章 第五节 多元线性回归分析的计算过程及实例 (1)

1222.1 1981.2 18

1253 3624.6 20

(1)根据n组观测样本原始数据,写出矩阵:

450

Y 507.7

1253

1 1027.2 8

1 1045.2

9

X

1

3143.4

16

1 3624.6 20

(2)计算X'X、(X'X)1、X'Y

在group栏,输入预测期的解释变量的数据/点quick/ estimate equation/键 入(y c x t)/ok,在equation栏,forecast/ok/得到变量期内,被解释变量每 一时期的预测值.

四、具体分析

(一) 设定模型

Yi 1 2 X i 3Ti ui

说明家庭收入对家庭书刊消费有显著影响

t3 2.131,小概率事件发生,拒绝3 0的假设

说明受教育年数对家庭书刊消费有显著影响

P{F F (k 1,n-k)}

F

ESS RSS

k n

1 k

nk n 1

ESS RSS

18 3 1082426 146.2973 18 1 55491.07

Mean dependent var

0.3279 0.0101 0.0000 755.1222

Adjusted R-squared

0.944732

S.D. dependent var

258.7206

S.E. of regression

(8)计算检验统计量t和F的值,作回归参数及回归 方程的检验。

在原假设 H0 : j 0 j 1,2,, n 下的t统计量为:

计量地理学第三章统计分析方法2回归分析

§1 地理要素间的相关分析 §2 地理要素间的回归分析 §3 时间序列分析法 §4 系统聚类分析方法 §5 主成分分析方法 §6 马尔可夫预测方法 §7 地理系统的空间趋势面分析

§2 地理要素间的回归分析

地理回归分析的意义和作用 一元地理回归模型的建立 多元地理回归模型的建立

回归分析的主要内容

– 从一组地理数据出发,确定这些要素(变量)间的定 量数学表达式,即回归模型 – 根据一个或几个要素(自变量)的值来预测或控制另 一个要素(因变量)的取值 – 从某一地理过程中的许多要素中,找出哪些要素(变 量)是主要的,哪些要素是次要的,这些要素之间又 有些什么关系

回归分析的分类

在回归分析中,y的n次观测值y1,y2,…,yn之 间的差异,可以用观测值yi与其算术平均值的离 差平方和来表示,它称为总的离差平方和

S总 l yy (y i - y)

2

S总 l yy (y i - y)

2

2

ˆ i ) (y i - y) 2 ˆ (y i - y QU ˆ U (y i - y) b

地温(y)

-3.6 -1.4 5.1 14.5 22.3 26.9 28.2 26.5 21.1 13.4 4.6 -1.9 155.7 12.98

xy

16.92 3.22 22.44 191.40 450.46 650.98 733.20 651.90 411.45 167.50 18.40 5.32 3323.19

对于幂函数曲线 y dx b ,令y ln y

,

可以将其转化为直线形式: y a bx ;

, ln x , x 可以将其转化为直线形式: y a bx 其 a 中, ln d ;

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

回归分析

lij =

k =1 n

∑ ( xki − xi )( xkj − x j )

k =1

n

liy = ∑ ( xki − xi )( y k − y ) l11b1 + l12 b2 + " + l1m bm = l1 y l 21b1 + l 22 b2 + " + l 2 m bm = l 2 y "" l m1b1 + l m 2 b2 + " + l mm bm = l my

r =0

y与x毫无线性关系

r > 0 b > 0 正相关 r < 0 b < 0 负相关 r > rα r在α水平上显著 l yy σ 2 ~ χ 2 (n − 1) U σ 2 ~ χ 2 (1) Q σ 2 ~ χ 2 ( n − 2)

2.

F检验(方差分析)

回归分析

U ( n − 2) ~ Q

i =1

m

回归分析

二 多元回归效果检验

1. 回归方程的显著检验

原假设 H 0 : βi = 0 i = 1 ~ m l yy = ∑ ( y k − y ) 2 = ∑ ( y k − y ˆk )2 + ∑ ( y ˆk − y)2 = Q + U

U σ 2 ~ χ 2 ( m) Q σ 2 ~ χ 2 (n − m − 1) U m ~ F (m, n − m − 1) F= Q (n − m − 1) F > Fα 拒绝H 0; F < Fα 接受H 0

表示为矩阵形式

LB = L y C = L−1 B = L−1L y = CL y

bi = ∑ cij l jy

j =1 j m

i = 1,2, " , m

b0 = y − ∑ b j x j

回归分析

标准化模型:对原数据进行标准化变换,而对变换后的数 WHY?量纲不同 据建立的回归模型。 yk − y xki − xi xki 标准化变换 y k ′= ′ = σy σi

lij ′=

k =1

其中

∑ ( xki ′ − xi′)( xkj ′ − x ′j ) = ∑ xki ′ xkj ′ =

k =1

n

n

lij lii l jj

回归分析

记 rij = lij ′

正规方程组可表示为矩阵形式

R = (rij ) RB′ = R y C′ = (R ) −1 B′ = C′R y

β的区间估计 (b − t α S y l xx , b + t α S y l xx )

σ未知

2

回归分析

3.

回归值的置信区间

定义残差 则

δi = yi − y ˆi E (δi ) = E ( β0 + βxi + εi − b0 − bxi ) = 0 D(δi ) = D ( yi − b0 − bxi ) = D[ yi − y − b( xi − x )] ( x − x )( xi − x ) = D yi − y − ∑ k yk 2 (x j − x) k ∑ j 1 ( x − x )( xi − x ) = D yi − ∑ + k y 2 k n (x j − x) k ∑ j 2 ( xi − x ) 2 1 = 1 + + σ 2 n ∑ (x j − x) j

i =1 m

ε ~ N (0, σ 2 )

回归超平面 回归方程

Y = βX + ε

y ˆ = b0 + ∑ bi xi

i

E( y ˆ ) = β0 + ∑ βi xi

i

Q = ∑ ( yk − y ˆ k ) 2 = min

k =1

n

∂Q ∂b0 = 0 ∂Q ∂b j = 0

j = 1,2, " , m

寻找β0 , β的好的估计值,得到最能描述y和x关系的回归直线 y ˆ k = b0 + bxk 利用最小二乘法给出b0 , b的计算公式

Q = ∑ ( yk − y ˆ k ) 2 = ∑ ( yk − b0 − bxk ) 2 = min

∂Q 1 = 0 → b0 = (∑ yk − b∑ xk ) = y − bx n ∂b0 ( xk − x )( yk − y ) l xy ∂Q ∑ = =0 → b= 2 l xx ∂b ∑ ( xk − x )

其中

σ y = l yy ⇓

σ i = lii

σ ′y = 1 σ i′ = 1 y ′ = 0 xi′ = 0

新的正规方程组

l11 ′ b1′ + l12 ′ b2 ′ + " + l1′m bm ′ = l1′y l 21 ′ b1′ + l 22 ′ b2 ′ + " + l2 ′ m bm ′ = l2 ′y "" ′ 1b1′ + l m ′ 2 b2 ′ + " + l mm ′ bm ′ = l my ′ l m

I、II进行变换,转化为线性回归;III泰勒级数展开,变为线性。

三

曲线回归的有效性检验

相关指数 标准剩余差

R = 1− Sy =

∑ ( yi − y ) 2 ˆi )2 ∑ ( yi − y

n−2

2 ( ) y − y ˆ ∑ i i

回归分析

§ 多元线性回归

一 模型参数估计

y = β0 + ∑ βi xi + ε

个方向测量的距离;

5) OLS平分线: OLS(Y | X )和OLS(X | Y )的平分线。 Y

c a b

d

O

X

回归分析

应用五种回归方法测椭圆星系速度弥散σ和光学光度之间的关系L~ σn

图:L和σ的对数散点图及它们的五种回归线:1. OLS(Y | X ) 2. OLS(X | Y ) 3. OLS平分线(点虚线) 4. OR(虚线) 5. RMA(点线)

j

回归分析

四 五种一元线性回归及其在天文上的应用

1. 五种线性回归方法

1) OLS(Y | X ):观测点和回归直线上同一 x 的 y 的差; 2) 逆回归OLS(X | Y ):观测点和回归直线上同一 y 的 x

的差;

3) 正交回归线OR :观测点到回归线的垂直距离; 4) 简化主轴回归RMA :观测点对回归线在垂直、水平两

第三章 回归分析

处理变量与变量之间的统计相关关系

星系 氢含量、色指数、光度 太阳 耀斑、黑子、太阳射电辐射流量

统计相关关系

观测误差 深入了解

不完全确定

函数关系

完全确定

实质:概率统计+最小二乘

回归分析

§ 一元线性回归

一 一元线性回归模型及参数估计

y k = β0 + βxk + ε k 一元线性回归模型 εk ~ N (0, σ 2 ) E ( y k ) = β 0 + βx k 正态误差回归模型

一 曲线回归类型的确定

1.

散点图

利用观测数据的散点图,对比已知函数形式的各种曲线,选择 最为接近的曲线作为回归函数

2.

多项式 y = β 0 + β1 x + β 2 x 2 + " + β m x m + ε

二

曲线回归参数的确定

y = β0 + β e x I y = β0 + β ln x y = β + βx l 0

回归分析

E (b0 ) = β0 E (b) = β x2 1 D(b0 ) = σ [ + ] 2 n ∑ ( xk − x ) 1 ] D(b) = σ 2 [ 2 ( ) x − x ∑ k

2

二 回归方程的显著性检验

∑ ( yk − y ) 2 = ∑ ( yk − y ˆk + y ˆk − y)2 = ∑ ( yk − y ˆk )2 + ∑( y ˆ k − y ) 2 + 2∑ ( yk − y ˆ k )( y ˆk − y) = ∑ ( yk − y ˆk )2 + ∑( y ˆk − y)2

回归分析

( xi − x ) 2 1 δ ~ N (0, σ 1 + + ) n ∑ ( x j − x )2

j

P (−δ n < y − y ˆ < δn ) = 1− α y的区间估计 ( y − δ n , y ˆ + δn ) ( xi − x ) 2 1 δ N = uα σ 1 + + n ∑ ( x j − x )2

′ r jy bi′ = ∑ cij

j =1 m

′ =0 b0

′ = ∑ bi′xki ′ ˆk 标准回归方程 y

m y xki − xi m xki m xi ˆ k − yk = ∑ bi′ = ∑ bi′ − ∑ bi′ 即 σy σi σ i i =1 σ i i =1 i =1 m m σy σy y ˆ k = yk + ∑ bi′ xki − ∑ bi′ xi σi σi i =1 i =1 m σy σy ∴ bi = bi′ b0 = y k − ∑ bi′ xi σi σi i =1

F (1, n − 2)

F > Fα (1, n − 2) 拒绝域 回归方程显著

相关系数显著性检验 ⇔ 回归方程的F检验 即