使用matlab计算信源熵

验证最大离散熵定理 使用matlab 绘制二进制信源的熵随概率变化的曲线

验证最大离散熵定理使用matlab 绘制二进制信源的熵随

概率变化的曲线

摘要:

I.引言

- 介绍最大离散熵定理

- 熵的定义和计算方法

II.验证最大离散熵定理

- 使用matlab 进行验证

- 绘制二进制信源的熵随概率变化的曲线

III.结论

- 总结最大离散熵定理的验证过程

- 分析熵随概率变化的趋势

正文:

I.引言

熵是信息论中一个重要的概念,用于衡量信息的不确定性或混乱程度。

最大离散熵定理是信息论中的一个重要定理,它指出在一定条件下,离散信源的最大熵分布是概率分布。

本文将通过使用matlab 绘制二进制信源的熵随概率变化的曲线,来验证最大离散熵定理。

II.验证最大离散熵定理

首先,我们需要使用matlab 进行验证。

matlab 是一种功能强大的数学软件,可以方便地进行各种数学计算和图形绘制。

我们可以使用matlab 编写

代码,计算二进制信源的熵,并绘制熵随概率变化的曲线。

接下来,我们绘制二进制信源的熵随概率变化的曲线。

通过观察曲线,我们可以发现熵随概率变化的趋势。

当概率分布接近最大熵分布时,熵值达到最小;当概率分布远离最大熵分布时,熵值增大。

III.结论

通过使用matlab 绘制二进制信源的熵随概率变化的曲线,我们验证了最大离散熵定理。

我们发现,当概率分布接近最大熵分布时,熵值达到最小;当概率分布远离最大熵分布时,熵值增大。

matlab信源熵计算

MATLAB信源熵计算概述在信息论中,信源熵是一种度量信源中平均信息量的指标。

在MATLAB中,我们可以使用一些函数和算法来计算信源熵。

本文档将介绍如何使用MATLAB计算信源熵的方法,以及相关的概念和原理。

信源熵的定义在信息论中,信源熵表示信源输出的信息的平均量。

假设有一个离散信源,其输出符号的概率分布为P(x1), P(x2), …,P(xn),并且满足∑P(xi) = 1。

则该信源的熵可以通过以下公式计算:H(X) = -∑P(xi)log2(P(xi))其中,H(X)表示信源X的熵。

MATLAB中计算信源熵的方法MATLAB提供了一些函数和算法来计算信源熵。

1. 基于概率分布的计算方法我们可以通过给出信源的概率分布来计算信源熵。

在MATLAB中,可以使用以下代码来计算:prob = [0.2, 0.3, 0.1, 0.4]; % 信源输出概率分布entropy = -sum(prob .* log2(prob)); % 计算信源熵这里的prob是一个包含信源输出概率分布的向量,根据具体情况进行调整即可。

entropy变量将保存计算得到的信源熵。

2. 基于数据样本的计算方法如果我们有信源的数据样本,而不是概率分布,我们也可以通过计算样本的统计信息来估计信源熵。

在MATLAB中,可以使用tabulate函数来统计数据样本的频次,并计算信源熵。

data = [1, 2, 3, 4, 3, 2, 1, 3, 4, 2]; % 数据样本counts = tabulate(data); % 统计样本频次prob = counts(:, 3) / 100; % 计算信源输出概率entropy = -sum(prob .* log2(prob)); % 计算信源熵这里的data是一个包含数据样本的向量,根据具体情况进行调整即可。

entropy变量将保存计算得到的信源熵。

3. 使用Entropy函数MATLAB还提供了一个名为entropy的函数来计算信源熵。

信源熵函数曲线Matlab仿真

信源熵函数曲线Matlab仿真信源熵函数曲线Matlab仿真实验目的1.掌握离散信源熵的原理和计算方法。

2.熟悉matlab软件的基本操作,练习应用matlab软件进行信源熵函数曲线的绘制。

3.理解信源熵的物理意义,并能从信源熵函数曲线图上进行解释其物理意义。

实验原理离散信源相关的基本概念、原理和计算公式产生离散信息的信源称为离散信源。

离散信源只能产生有限种符号。

假定X是一个离散随机变量,即它的取值范围R={x1,x2,x3,…}是有限或可数的。

设第i个变量x i发生的概率为p i=P{X=x i}。

则:定义一个随机事件的自信息量I(x i)为其对应的随机变量x i出现概率对数的负值。

即:I(x i)= -log2p(x i)定义随机事件X的平均不确定度H(X)为离散随机变量x i出现概率的数学期望,即:单位为比特/符号或比特/符号序列。

平均不确定度H(X)的定义公式与热力学中熵的表示形式相同,所以又把平均不确定度H(X)称为信源X的信源熵。

必须注意一下几点:a.某一信源,不管它是否输出符号,只有这些符号具有某些概率特性,必有信源的熵值;这熵值是在总体平均上才有意义,因而是个确定值,一般写成H(X),X是指随机变量的整体(包括概率分布)。

b.信息量则只有当信源输出符号而被接收者收到后,才有意义,这就是给与信息者的信息度量,这值本身也可以是随机量,也可以与接收者的情况有关。

c.熵是在平均意义上来表征信源的总体特征的,信源熵是表征信源的平均不确定度,平均自信息量是消除信源不确定度时所需要的信息的量度,即收到一个信源符号,全部解除了这个符号的不确定度。

或者说获得这么大的信息量后,信源不确定度就被消除了。

信源熵和平均自信息量两者在数值上相等,但含义不同。

当某一符号x i的概率p(x i)为零时,p(x i)log p(x i) 在熵公式中无意义,为此规定这时的p(x i)log p(x i) 也为零。

当信源X中只含有一个符号x时,必有p(x)=1,此时信源熵H(X)为零。

matlab信息熵方法确定权重

matlab信息熵方法确定权重Matlab是一种强大的数学建模和计算工具,可以用于解决各种实际问题。

信息熵是一种用于度量信息量和信息不确定性的方法,通过计算每个变量的信息熵,可以确定变量的权重。

在本文中,我们将介绍如何使用Matlab 的信息熵方法确定权重。

首先,我们需要明确问题的背景和目标。

假设我们有一个包含多个变量的数据集,我们希望确定每个变量对最终结果的影响程度,即各个变量的权重。

接下来,我们需要计算每个变量的信息熵。

信息熵的计算公式为:H(X) = - ΣP(x) log2(P(x))其中,H(X)表示变量X的信息熵,P(x)表示变量X取值为x的概率。

首先,我们需要对数据集进行预处理,以便计算每个变量的概率。

在Matlab中,我们可以使用histcounts函数来计算每个变量的概率分布。

例如,假设我们有一个包含n个样本的数据集,其中变量X有m个不同的取值。

我们可以使用以下代码计算变量X的概率分布:[counts, edges] = histcounts(X, 'Normalization', 'probability');在代码中,X表示待计算的变量,counts表示每个取值的频数,edges 表示每个取值的边界。

接下来,我们可以使用上述公式计算每个变量的信息熵。

在Matlab中,我们可以使用sum和log2函数来计算信息熵。

例如,假设我们有一个包含m个取值的变量X,我们可以使用以下代码计算变量X的信息熵:H = -sum(counts .* log2(counts));在代码中,counts表示变量X的概率分布,.*表示逐元素相乘操作。

计算完所有变量的信息熵后,我们可以将其归一化,以便比较各个变量的影响程度。

在Matlab中,我们可以使用normalize函数来实现归一化操作。

例如,假设我们有一个包含n个变量的信息熵向量H,我们可以使用以下代码将其归一化:normalized_H = normalize(H);在代码中,H表示信息熵向量,normalized_H表示归一化后的信息熵向量。

Matlab中的熵和信息论应用

Matlab中的熵和信息论应用引言在科学与工程领域中,信息论是一门重要的研究领域,而熵则是信息论中的核心概念之一。

在Matlab软件中,我们可以利用其强大的计算能力和丰富的函数库来进行熵的计算和信息论的应用。

本文将介绍Matlab中的熵计算方法和一些常见的信息论应用,包括信道容量、数据压缩和密钥生成等。

一、熵的计算方法熵是信息论中用来度量信源的不确定性或信息的平均量的指标。

在Matlab中,我们可以使用Entropy函数来计算熵。

该函数的用法如下:entropy(X)其中,X是一个向量或矩阵,表示待计算熵的数据。

函数将返回熵的值。

例如,假设我们有一个向量X=[1 2 2 3 4 4 4 4],我们可以使用以下代码来计算熵:X = [1 2 2 3 4 4 4 4];entropy(X)运行结果将返回熵的值。

二、信道容量信道容量是信息论中一个重要的概念,它表示在给定信道条件下,通过信道传输的最大信息传输速率。

在Matlab中,我们可以使用Capacity函数来计算信道容量。

该函数的用法如下:C = capacity(channel,SNR)其中,channel是信道模型,SNR是信噪比。

函数将返回信道容量C的值。

例如,假设我们有一个二进制对称信道,信噪比为10dB,我们可以使用以下代码来计算信道容量:channel = 'BSC';SNR = 10;C = capacity(channel,SNR)运行结果将返回信道容量C的值。

三、数据压缩数据压缩是信息论中的一个重要应用领域。

在Matlab中,我们可以使用Huffman编码来进行数据的无损压缩。

Huffman编码是一种基于字符出现频率的编码方式,出现频率高的字符将被赋予较短的编码,从而实现数据压缩。

以下是在Matlab中实现Huffman编码的基本步骤:1. 统计待压缩数据中每个字符的出现频率;2. 构建Huffman树,树的叶节点代表每个字符,节点的权值为对应字符的频率;3. 从Huffman树的根节点开始,遍历树并分配0或1给每个左/右子树;4. 将Huffman编码表保存到文件;5. 对原始数据进行编码,并将编码后的数据保存到文件。

matlab熵值法

matlab熵值法Matlab熵值法熵值法是一种常用的多指标综合评价方法,可以用于解决决策问题。

在Matlab中,可以利用熵值法进行数据处理和分析,从而得出较为准确的评价结果。

本文将介绍熵值法的基本原理和在Matlab中的应用。

一、熵值法的基本原理熵值法是基于信息论中的熵概念发展而来的一种综合评价方法。

其基本原理是通过计算指标的熵值和权重,将不同指标的数据标准化,并根据标准化后的数据进行综合评价。

具体步骤如下:1. 确定评价指标:根据具体问题,确定需要评价的指标,例如生产效率、环境质量等。

2. 收集数据:收集各指标的数据,可以是实测数据或者经验数据。

3. 数据标准化:将各指标的数据进行标准化处理,一般采用线性标准化或者非线性标准化方法。

4. 计算熵值:根据标准化后的数据,计算各指标的熵值。

熵值越小,表示该指标的信息量越大。

5. 计算权重:根据各指标的熵值,计算各指标的权重。

熵值越小,表示该指标的重要性越高,权重越大。

6. 综合评价:将各指标的权重与标准化后的数据相乘,得到各指标的加权综合值。

根据综合值的大小,对各评价对象进行排序或者分类。

二、Matlab中的熵值法实现在Matlab中,可以利用熵值法进行数据处理和分析。

下面以一个简单的案例来说明如何使用Matlab进行熵值法分析。

假设我们需要对某个城市的环境质量进行评价,评价指标包括空气质量、水质、噪声等。

我们已经收集到了这些指标的数据,并进行了标准化处理。

1. 首先,我们需要定义评价指标和标准化后的数据。

可以使用Matlab中的矩阵来表示,每一行表示一个评价对象,每一列表示一个评价指标。

2. 然后,我们可以使用熵值法的计算公式来计算各指标的熵值和权重。

在Matlab中,可以使用熵值法的计算函数进行计算。

函数的输入参数为标准化后的数据,输出结果为各指标的熵值和权重。

3. 最后,我们可以根据各指标的权重和标准化后的数据,计算各评价对象的综合值。

根据综合值的大小,可以对评价对象进行排序或者分类。

信息论与编码课程作业_huffman编码的matlab_实现

信息论与编码课程作业_huffman编码的matlab_实现信息论与编码课程作业——霍夫曼编码求信源熵和存储前后的信息量的变化一:设计目的:1、学习离散信源平均信息量的计算方法。

2、理解和掌握huffman 编码的基本原理,实现对信源符号的huffman 编码3、熟悉 Matlab 编程;二:设计原理和思路1.信源熵的计算:公式: 21()log a I a p = Matlab 实现:I=log2(1/p) 或I=-log2(p) 熵(平均自信息)的计算公式22111()log log qq i i i i i i H x p p p p ====-∑∑Matlab 实现:HX=sum(-x.*log2(x));或者h=h-x(i)*log2(x(i));2.霍夫曼编码原理;分为两步,首先是码树形成过程:对信源概率进行合并形成编码码树。

然后是码树回溯过程:在码树上分配编码码字并最终得到Huffman 编码。

1、码树形成过程:将信源概率按照从小到大顺序排序并建立相应的位置索引。

然后按上述规则进行信源合并,再对信源进行排序并建立新的位置索引,直到合并结束。

在这一过程中每一次都把排序后的信源概率存入矩阵p 中,位置索引存入矩阵m 中。

这样,由排序之后的概率矩阵 p 以及索引矩阵m 就可以恢复原概率矩阵P 了,从而保证了回溯过程能够进行下去。

2、码树回溯过程:在码树上分配编码码字并最终得到Huffman 编码。

从索引矩阵M 的末行开始回溯。

(1) 在p 的末行2元素位置填入0和1。

(2) 根据该行索引1位置指示,将索引1位置的编码(‘1’)填入上一行的第一、第二元素位置,并在它们之后分别添加‘0’和‘1’。

(3) 将索引不为‘1’的位置的编码值(‘0’)填入上一行的相应位置(第3 列)。

(4) 以m的倒数第二行开始向上,重复步骤(1) ~(3),直到计算至m的首行为止。

三:设计代码:>> clear all;format longdisp(strcat('信息论与编码课程作业——霍夫曼编码求信源熵和存储前后的信息量的变化',13));histgram=zeros(1,255);[c,map]=imread('C:\Documents and Settings\Administrator\桌面\infomation\lenna.bmp');x=rgb2gray(c);[a,b]=size(x);for i=1:afor j=1:bk=x(i,j);histgram(k)=histgram(k)+1;endendf=histgram/a/b;symbols=find(f~=0); %灰度值p=f(symbols); %概率L=length(p);pp=p;%霍夫曼编码m=zeros(L-1,L);for i=1:L-1[p,mark]=sort(p);m(L-i,1:L-i+1)=mark(1:L-i+1);p=[p(1)+p(2),p(3:L),1];endc=cell(L-1,L);c(1,1)={'0'};c(1,2)={'1'};for i=2:L-1;ind=find(m(i-1,:)==1);temp=char(c(i-1,ind));c(i,1)={[temp,'0']};c(i,2)={[temp,'1']};snc=find(m(i-1,:)~=1);for j=3:i+1;con=snc(j-2);c(i,j)=c(i-1,con);endendcodeL=[];averge_long=0;H1=0;disp(strcat('灰度值',32,32,32,'概率',32,32,32,32,32,32,32,32,32,'霍夫曼编码:'));for i=1:L;ind=find(m(L-1,:)==i);code=char(c(L-1,ind));codeLength(i)=length(code);averge_long=averge_long+pp(i)*codeLength(i);H1=H1+pp(i)*log2(1/pp(i));disp(strcat(32,num2str(symbols(i)),32,32,32,num2str(pp(i)),3 2,32, code));enddisp(strcat('信源熵=',num2str(H1),32,32,32,32,'平均码字长度=',num2str(averge_long),32,32,32,32,32,'压缩比=',num2str(8/averge_long)));四:设计运行结果:信息论与编码课程作业——霍夫曼编码求信源熵和存储前后的信息量的变化灰度值概率霍夫曼编码:30 1.5259e-005 101000111100001031 1.5259e-005 101000111100001136 1.5259e-005 101000111100000037 1.5259e-005 101000111100000139 6.1035e-005 1010001111000140 7.6294e-005 1110010101001041 6.1035e-005 0111010111011042 6.1035e-005 0111010111011143 9.1553e-005 1110010101001144 0.00018311 111011101010145 0.00021362 00111101101146 0.00022888 01110101111047 0.00024414 01110101111148 0.00039673 0011110110049 0.00048828 1010001110050 0.00065613 1110010101151 0.00090027 011101011052 0.00086975 001111011153 0.0013123 111001011054 0.0013733 111011101156 0.0018005 01110101057 0.0025177 11010001158 0.0036621 0111111059 0.0033722 0101111060 0.0046539 1100110161 0.0055847 1111010162 0.0061188 001001063 0.0080261 100111064 0.0075226 100001165 0.0083466 101010166 0.0088806 101111167 0.0092773 110011168 0.0095367 110101069 0.0086517 101101070 0.0084229 101011071 0.0075378 100010172 0.0071564 011011173 0.0061493 001001174 0.0056 1111011075 0.0053864 1110110076 0.0045319 1100011177 0.0043488 1011000178 0.0042114 1010111079 0.0039063 1000111180 0.0041199 1010100181 0.0035706 0110101182 0.0039368 1001011083 0.0037537 1000010084 0.003479 0110101086 0.0033417 0101101087 0.0032501 0100110088 0.0034027 0110000189 0.0031128 0011010090 0.0031433 0011110091 0.0036774 0111111192 0.0041046 1010011094 0.0038452 1000111095 0.004364 1011100096 0.0037842 1000110097 0.0037079 1000001198 0.0033722 0101111199 0.0040741 10100001 100 0.0040741 10100010 101 0.0038147 10001101 102 0.0040588 10011111 103 0.0041046 10100111 104 0.004364 10111001 105 0.0048218 11010111 106 0.0052185 11100100 107 0.0049591 11011010 108 0.005188 11100001 109 0.0047455 11010110 110 0.0052032 11100011 111 0.0054474 11110100 112 0.0057526 11111011 113 0.0065308 0100111 114 0.0079346 1001100 115 0.010223 1101111116 0.0095825 1101100 117 0.0089417 1100000 118 0.0086975 1011011 119 0.0081787 1010010 120 0.007782 1001001121 0.0066376 0101011 122 0.0059357 11111111 123 0.0056458 11110111 124 0.0051575 11100000 125 0.0052948 11101001 126 0.005188 11100010 127 0.0059814 0000001 128 0.0058594 11111101 129 0.0065613 0101010 130 0.0062561 0011011 131 0.006897 0110100132 0.0072479 0111011 133 0.0073242 0111110 134135 0.0075226 1000100 136 0.0077515 1001000138 0.008606 1011001139 0.0091095 1100100 140 0.012115 000010141 0.012115 000011142 0.012741 001110143 0.012329 001100144 0.010941 1111001145 0.010147 1101110146 0.0089417 1100001 147 0.0088043 1011101 148 0.0091095 1100101 149 0.010712 1110101150 0.011337 1111100151 0.010513 1110011152 0.012878 010000153 0.012268 001010154 0.013138 010100155 0.012238 001000156 0.012939 010001157 0.012115 000100158 0.012955 010010159 0.012207 000111160 0.011993 000001161 0.013916 011001162 0.012177 000110163 0.012299 001011164 0.0094604 1101001 165 0.0089874 1100010 166 0.0088501 1011110 167 0.0056915 11111010 168 0.0059357 0000000 169 0.0071716 0111001 170 0.0057678 11111100 171 0.0054016 11101111 172 0.0054169 11110001 173 0.0058746 11111110 174 0.0072937 0111100 175 0.0070953 0110110 176177 0.0061035 0001011 178 0.0054016 11110000 179 0.0053864 11101101 180 0.0046692 11010000182 0.0036774 10000000183 0.0033875 01100000184 0.0033264 01011000185 0.0031281 00110101186 0.0035706 01110000187 0.0033264 01011001188 0.0033569 01011011189 0.0036011 01110100190 0.0040436 10011110191 0.0034485 01100010192 0.0036774 10000001193 0.0032654 01001101194 0.0034485 01100011195 0.003006 00010100196 0.0033722 01011100197 0.0036774 10000010198 0.0042419 10110000199 0.0045166 11000110200 0.0041046 10101000201 0.0052643 11101000202 0.0050354 11011011203 0.0045319 11001100204 0.0039825 10011010205 0.0040588 10100000206 0.0039673 10010111207 0.0037537 10000101208 0.0033722 01011101209 0.0026703 111011100210 0.0022125 110100010211 0.0018768 101000110212 0.0015259 000101010213 0.0013428 1110010111214 0.0012665 1110010100215 0.0007782 0011110100216 0.00079346 0011110101217 0.00061035 10100011111218 0.00054932 10100011101219 0.00065613 11101110100220 0.00035095 111011101011 221 0.00033569 111001010101 222 0.00030518 101000111101 223 0.00021362 011101011100 224 0.00016785 1110111010100225 0.00019836 001111011010226 0.00015259 1110010101000227 0.00010681 0111010111010228 6.1035e-005 10100011110010230 3.0518e-005 101000111100110231 1.5259e-005 10100011110011110232 1.5259e-005 10100011110011111233 1.5259e-005 1010001111001110信源熵=7.2193 平均码字长度=7.2492 压缩比=1.1036五:设计新得体会:通过这学期对信息论和编码的学习,以及这次的设计,使我了解了很多东西,也使以前所学的知识得以巩固!,通过这次的设计,进一步学习了离散信源平均信息量、平均码长和压缩比的计算方法。

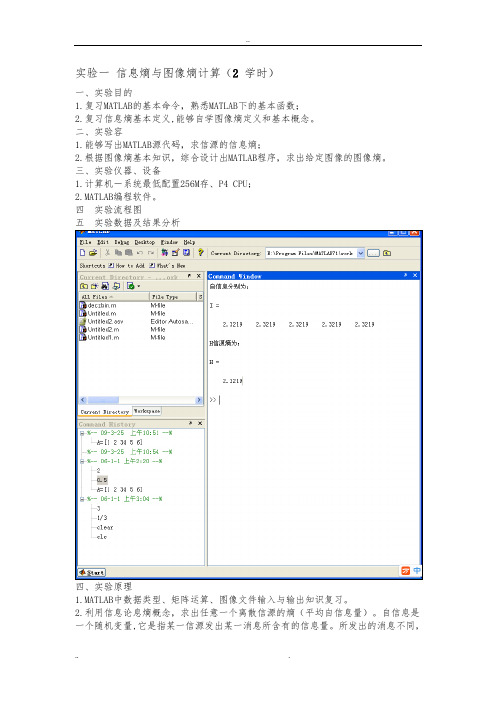

实验一_信息熵与图像熵计算_正确

实验一信息熵与图像熵计算(2 学时)一、实验目的1.复习MATLAB的基本命令,熟悉MATLAB下的基本函数;2.复习信息熵基本定义,能够自学图像熵定义和基本概念。

二、实验容1.能够写出MATLAB源代码,求信源的信息熵;2.根据图像熵基本知识,综合设计出MATLAB程序,求出给定图像的图像熵。

三、实验仪器、设备1.计算机-系统最低配置256M存、P4 CPU;2.MATLAB编程软件。

四实验流程图五实验数据及结果分析四、实验原理1.MATLAB中数据类型、矩阵运算、图像文件输入与输出知识复习。

2.利用信息论息熵概念,求出任意一个离散信源的熵(平均自信息量)。

自信息是一个随机变量,它是指某一信源发出某一消息所含有的信息量。

所发出的消息不同,它们所含有的信息量也就不同。

任何一个消息的自信息量都代表不了信源所包含的平均自信息量。

不能作为整个信源的信息测度,因此定义自信息量的数学期望为信源的平均自信息量:1( ) 1 ( ) [log ] ( ) log ( ) i n i i p a i H E p a p a X 信息熵的意义:信源的信息熵H是从整个信源的统计特性来考虑的。

它是从平均意义上来表征信源的总体特性的。

对于某特定的信源,其信息熵只有一个。

不同的信源因统计特性不同,其熵也不同。

3.学习图像熵基本概念,能够求出图像一维熵和二维熵。

图像熵是一种特征的统计形式,它反映了图像中平均信息量的多少。

图像的一维熵表示图像中灰度分布的聚集特征所包含的信息量,令Pi表示图像中灰度值为i的像素所占的比例,则定义灰度图像的一元灰度熵为:2550 log i i i p p H图像的一维熵可以表示图像灰度分布的聚集特征,却不能反映图像灰度分布的空间特征,为了表征这种空间特征,可以在一维熵的基础上引入能够反映灰度分布空间特征的特征量来组成图像的二维熵。

选择图像的邻域灰度均值作为灰度2分布的空间特征量,与图像的像素灰度组成特征二元组,记为(i,j),其中i表示像素的灰度值(0<=i<=255),j表示邻域灰度(0<=j<=255),2 ( , ) / ij p f i j N上式能反应某像素位置上的灰度值与其周围像素灰度分布的综合特征,其中f(i,j)为特征二元组(i,j)出现的频数,N为图像的尺度,定义离散的图像二维熵为:2550 log ij ij i p p H构造的图像二维熵可以在图像所包含信息量的前提下,突出反映图像中像素位置的灰度信息和像素邻域灰度分布的综合特征。

matlab信源熵计算

Matlab信源熵计算简介信息论是研究信息传输和处理的数学分支领域之一。

其中,信源熵是信息论中的一个重要概念,用于衡量一个信源产生的信息的不确定性程度。

在Matlab中,可以通过一些简单的代码来计算信源熵,帮助我们分析和理解信源的特性。

本文将介绍如何使用Matlab计算信源熵。

我们将先介绍信源熵的概念和计算方法,然后给出用Matlab实现的示例代码,并对代码进行详细解释。

信源熵的计算方法假设一个离散信源产生的符号集合为$S=\\{s_1, s_2, ...,s_n\\}$,每个符号s s出现的概率为s s。

信源熵s(s)可以通过下式计算得到:$$H(S) = -\\sum_{i=1}^n p_i \\log_2 p_i$$其中,$\\log_2$表示以2为底的对数运算。

示例代码下面给出一个使用Matlab计算信源熵的示例代码:% 定义符号集合和对应的概率symbols = {'a', 'b', 'c', 'd'};probs = [0.4, 0.3, 0.2, 0.1];% 计算信源熵entropy = -sum(probs .* log2(probs));% 显示结果disp(['信源熵为:', num2str(entropy)]);在这个代码中,我们首先定义了一个符号集合symbols和对应的概率probs。

然后,我们使用信源熵的计算公式来计算信源熵entropy,最后通过disp函数显示结果。

代码解释让我们逐行解释一下上面的示例代码:1.symbols = {'a', 'b', 'c', 'd'};:这一行定义了一个符号集合,其中包含四个符号a、b、c和d。

2.probs = [0.4, 0.3, 0.2, 0.1];:这一行定义了每个符号出现的概率,分别为0.4、0.3、0.2和0.1。

matlab信息熵方法确定权重 -回复

matlab信息熵方法确定权重-回复Matlab信息熵方法确定权重信息熵方法是一种常用的多准则决策方法,可用于确定权重。

在Matlab 中,我们可以利用该方法来解决多准则决策问题,帮助我们做出准确的权重确定。

本文将采用以下步骤来说明在Matlab中如何使用信息熵方法确定权重。

第一步:准备数据首先,我们需要准备准则矩阵数据。

准则矩阵包含n个准则和m个待评估的方案,我们需要将这些准则进行评分。

评分可以是数字或者是相对权重之间的比较,可以按照自己的需求进行选择。

例如,我们考虑了四个准则(A、B、C、D),并对三个方案(X、Y、Z)进行了评分,我们可以构建一个4×3的准则矩阵。

准则矩阵如下所示:X Y ZA 5 3 2B 4 2 1C 6 3 2D 3 1 1第二步:计算单个指标熵接下来,我们需要计算每个准则的熵。

熵是一种反映混乱程度的量化指标,可以用于衡量权重的不确定性。

准则熵越高,表示准则对决策结果的贡献越大。

在Matlab中,我们可以使用“entropy”函数来计算熵。

例如,我们可以计算准则A的熵:A = [5 4 6 3];entropy(A)计算结果为1.3863。

同样地,我们可以计算准则B、C和D的熵。

B = [3 2 3 1];C = [2 1 2 1];D = [2 1 2 1];entropy(B)entropy(C)entropy(D)计算结果分别为0.5623、0.5623和0。

第三步:计算熵权法得分熵权法是一种根据熵计算准则权重的方法,权重值越大表示准则对决策结果的贡献越大。

在Matlab中,我们可以使用以下公式来计算熵权法得分:权重= 1 - (准则熵/ 总准则熵)其中,总准则熵是所有准则的熵的和。

例如,我们可以计算准则A的权重:total_entropy = entropy(A) + entropy(B) + entropy(C) + entropy(D);weight_A = 1 - (entropy(A) / total_entropy);计算结果为0.4209。

波形的信息熵 matlab

波形的信息熵 matlab波形的信息熵是一种在信号处理领域中常用的指标,用来衡量信号的信息量和其难以压缩的程度。

信息熵的大小与信号的复杂性和随机性密切相关,通常被用来分析和处理一些难以直接控制和预测的信号。

在MATLAB中,计算波形的信息熵可以使用熵函数(entropy)来完成。

该函数可以接受一个一维向量作为输入,并返回其信息熵的值,其基本语法如下:entropy(x)其中x表示输入的一维向量,该函数不仅可以计算离散信号的熵,也可以计算连续信号的熵值。

在使用熵函数计算信息熵时,需要注意如下几个问题:1、数据的类型:数据可以是double或single类型的,但不能是int或uint类型的。

2、数据的一维向量的大小:向量长度需要大于1。

3、数据的范围:数据的范围不能超过double类型的最大值。

4、数据的精度:数据的精度至少需要保留到小数点后15位。

下面我们就用一个简单的例子来说明如何使用熵函数计算波形的信息熵。

假设我们有一个包含200个元素的随机信号,其波形如下所示:首先,我们需要将波形数据导入MATLAB工作区中。

我们可以使用以下命令将数据保存在名为data的变量中:data = [ 0.739 0.040 0.786 0.061 0.783 0.998 0.020 0.123 0.679 0.212 0.803 0.804 0.734 0.112 0.007 0.579 0.512 0.433 0.120 0.329 0.5860.725 0.814 0.449 0.119 0.731 0.861 0.632 0.086 0.241 0.073 0.599 0.316 0.390 0.035 0.352 0.966 0.645 0.541 0.317 0.517 0.970 0.7970.732 0.685 0.185 0.550 0.807 0.275 0.864 0.297 0.029 0.546 0.038 0.419 0.072 0.751 0.423 0.925 0.354 0.750 0.679 0.468 0.760 0.3020.271 0.971 0.425 0.145 0.293 0.938 0.215 0.098 0.718 0.081 0.101 0.863 0.162 0.249 0.896 0.757 0.108 0.006 0.268 0.253 0.158 0.3180.142 0.685 0.047 0.864 0.114 0.284 0.489 0.300 0.904 0.684 0.038 0.114 0.838 0.485 0.163 0.857 0.723 0.251 0.978 0.924 0.299 0.0190.032 0.974 0.953 0.737 0.339 0.419 0.196 0.478 0.096 0.613 0.569 0.108 0.461 0.589 0.414 0.308 0.402 0.829 0.205 0.983 0.766 0.1220.082 0.798 0.574 0.369 0.123 0.264 0.199 0.365 0.919 0.618 0.513 0.290 0.414 0.885 0.136 0.336 0.460 0.983 0.020 0.743 0.756 0.7550.411 0.176 0.418 0.766 0.517 0.069 0.581 0.272 0.175 0.552 0.071 0.622 0.621 0.686 0.694 0.222 0.347 0.146 0.004 0.982 0.541 0.0150.496 0.524 0.599 0.021 0.211 0.765 0.270 0.642 0.149 0.291 0.822 0.640 0.919 0.986 0.108 0.967 0.841 0.323 0.076 0.760 0.806 0.4380.026 0.983 0.341 0.885 0.034 0.642 0.563 0.052 0.506 0.506 0.265 0.796 0.028 0.567 0.373 0.690 0.847 0.066 0.591 0.993 0.809 0.6300.565 0.397 0.551 0.932 0.486 0.756 0.076 0.411 0.278 0.665 0.970 0.052 0.807 0.100 0.563 0.766 0.532 0.762 0.017 0.296 0.886 0.1180.759 0.829 0.676 0.431 0.056 0.964 0.868 0.216 0.446 0.963 0.437 0.196 0.184 0.659 0.620 0.784 0.791 0.290 0.514 0.087 0.987 0.6970.401 0.055 0.148 0.421 0.500 0.839 0.148 0.498 0.280 0.737 0.304 0.232 0.749 0.858 0.086 0.908 0.408 0.276 0.689 0.104 0.931 0.6490.817 0.491 0.697 0.287 0.018 0.618 0.9890.754 0.600 0.943 0.947 0.329 0.082 0.787 0.651 0.942 0.228 0.973 0.184 0.383 0.122 0.4960.466 0.066 0.702 0.925 0.811 0.031 0.850 0.047 0.159 0.286 0.161 0.083 0.952 0.144 0.345 0.712 0.260 0.265 0.353 0.726 0.333 0.1770.844 0.657 0.961 0.700 0.912 0.999 0.097 0.217 0.147 0.279 0.408 0.181 0.528 0.294 0.525 0.919 0.684 0.788 0.780 0.684 0.953 0.0050.626 0.387 0.208 0.189 0.015 0.376 0.111 0.884 0.381 0.593 0.122 0.508 0.676 0.929 0.093 0.396 ];接下来,我们可以使用entropy函数计算该信号的信息熵:H = entropy(data)该命令将计算出data向量的信息熵,并将结果赋值给H变量。

熵值法matlab

熵值法matlab

熵值法是一种用于评价多指标决策的方法,可以用于在多个选择方案中找到最佳的解决方案。

在Matlab中,可以使用一些函数和工具箱来实现熵值法。

其中,entropy函数是用于计算熵值的函数,a=[a1,a2,…,an]是一个包含n个元素的向量,entropy(a)将返回a 的熵值。

在计算熵值时,还需要使用归一化函数normalize,该函数将向量归一化为概率分布向量。

例如,a=[1,2,3],normalize(a)将返回[0.1667,0.3333,0.5],表示a中每个元素出现的概率分别为0.1667,0.3333和0.5。

除了这些基本函数外,还可以使用fuzzy工具箱进行模糊多指标决策分析。

该工具箱提供了模糊综合评价方法,将多个指标的模糊信息转化为模糊综合评价值。

使用fuzzy工具箱,可以通过以下步骤进行模糊多指标决策分析:

1. 确定决策问题和决策指标。

2. 对每个指标进行模糊化。

3. 对每个指标进行标准化,并计算每个指标的权重。

4. 对每个指标的指标值进行熵值计算,并计算每个指标的信息熵。

5. 计算每个指标的贡献度和权重。

6. 将每个指标的贡献度和权重相加,得到最终的综合评价值。

总之,熵值法是一种简单有效的多指标决策方法,可以使用Matlab中提供的函数和工具箱来实现。

使用熵值法可以在多个选择

方案中找到最佳的解决方案,为决策提供有力的支持。

关于信源熵的实验报告

实验报告实验名称关于信源熵的实验课程名称信息论与编码姓名xxx 成绩90班级电子信息1102学号0909112204日期2013.11.22地点综合实验楼实验一MATLAB完成离散信源熵的计算一、实验目的1. 通过信息论与编码学理论,掌握离散信源熵的原理和计算方法。

2. 熟悉matlab 软件的基本操作和基本工具以及使用,掌握利用matlab求解信息熵的原理和方法。

3. 练习使用matlab 求解信源的信息熵。

自学图像熵的相关概念,并应用所学知识,使用matlab 或其他开发工具求解图像熵。

4. 掌握Excel的绘图功能,使用Excel绘制散点图、直方图。

二、实验原理1.离散信源的基本概念、原理和信源熵相关计算公式产生离散信息的信源称为离散信源。

离散信源只能产生有限种符号,因此离散离散消息可以看成是一种有限个状态的随机序列。

随机事件的自信息量I(xi)为其对应的随机变量xi 出现概率对数的负值。

即: I (xi )= -log2p ( xi)随机事件X 的平均不确定度(信源熵)H(X)为离散随机变量 xi 出现概率的数学期望,即:2.离散二元信源的信息熵设信源符号集X={0,1} ,每个符号发生的概率分别为p(0)= p,p(1)= q,p+ q =1,即信源的概率空间为:则该二元信源的信源熵为:H(X) = - p*logp–q*logq = - p*logp –(1 - p)*log(1- p)即:H (p) = - p*logp –(1 - p)*log(1- p) 其中 0 ≤ p ≤13.MATLAB二维绘图用matlab 中的命令plot( x , y) 就可以自动绘制出二维图来。

例:在matlab 上绘制余弦曲线图,y = cos x ,其中 0 ≤ x ≤ 2 。

>>x =0:0.1:2*pi; %生成横坐标向量,使其为 0,0.1,0.2,…,6.2>>y =cos(x ); %计算余弦向量>>plot(x ,y ) %绘制图形4.MATLAB求解离散信源熵求解信息熵过程:1) 输入一个离散信源,并检查该信源是否是完备集。

信息熵的matlab程序实例讲课稿

信息熵的m a t l a b程序实例求一维序列的信息熵(香浓熵)的matlab程序实例对于一个二维信号,比如灰度图像,灰度值的范围是0-255,因此只要根据像素灰度值(0-255)出现的概率,就可以计算出信息熵。

但是,对于一个一维信号,比如说心电信号,数据值的范围并不是确定的,不会是(0-255)这么确定,如果进行域值变换,使其转换到一个整数范围的话,就会丢失数据,请高手指点,怎么计算。

比如数字信号是x(n),n=1~N(1)先用Hist函数对x(n)的赋值范围进行分块,比如赋值范围在0~10的对应第一块,10~20的第二块,以此类推。

这之前需要对x(n)做一些归一化处理(2)统计每一块的数据个数,并求出相应的概率(3)用信息熵公式求解以上求解方法获得的虽然是近似的信息熵,但是一般认为,这么做是没有问题的求一维序列的信息熵的matlab程序代码如下:(已写成调用的函数形式)测试程序:fs=12000;N=12000;T=1/fs;t=(0:N-1)*T;ff=104;sig=0.5*(1+sin(2*pi*ff*t)).*sin(2*pi*3000*t)+rand(1,length(t));Hx=yyshang(sig,10)%———————求一维离散序列信息熵matlab代码function Hx=yyshang(y,duan)%不以原信号为参考的时间域的信号熵%输入:maxf:原信号的能量谱中能量最大的点%y:待求信息熵的序列%duan:待求信息熵的序列要被分块的块数%Hx:y的信息熵%duan=10;%将序列按duan数等分,如果duan=10,就将序列分为10等份x_min=min(y);x_max=max(y);maxf(1)=abs(x_max-x_min);maxf(2)=x_min;duan_t=1.0/duan;jiange=maxf(1)*duan_t;% for i=1:10% pnum(i)=length(find((y_p>=(i-1)*jiange)&(y_p<i*jiange)));% endpnum(1)=length(find(y<maxf(2)+jiange));for i=2:duan-1pnum(i)=length(find((y>=maxf(2)+(i-1)*jiange)&(y<maxf(2)+i*jiange))); endpnum(duan)=length(find(y>=maxf(2)+(duan-1)*jiange));%sum(pnum)ppnum=pnum/sum(pnum);%每段出现的概率%sum(ppnum)Hx=0;for i=1:duanif ppnum(i)==0Hi=0;elseHi=-ppnum(i)*log2(ppnum(i));endHx=Hx+Hi;endend%----------------扩展阅读:实验一:计算离散信源的熵一、实验设备:1、计算机2、软件:Matlab二、实验目的:1、熟悉离散信源的特点;2、学习仿真离散信源的方法3、学习离散信源平均信息量的计算方法4、熟悉Matlab 编程;三、实验内容:1、写出计算自信息量的Matlab 程序2、写出计算离散信源平均信息量的Matlab 程序。

熵函数实验报告

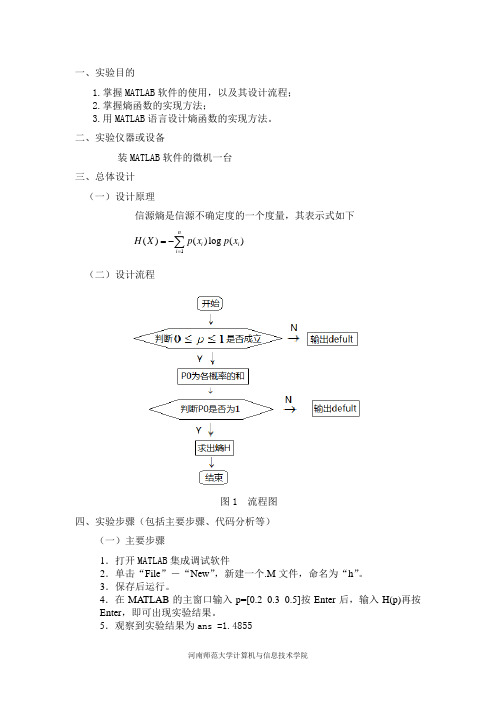

一、实验目的1.掌握MATLAB 软件的使用,以及其设计流程;2.掌握熵函数的实现方法;3.用MATLAB 语言设计熵函数的实现方法。

二、实验仪器或设备装MATLAB 软件的微机一台 三、总体设计 (一) 设计原理信源熵是信源不确定度的一个度量,其表示式如下1()()log ()ni i i H X p x p x ==-∑(二) 设计流程图1 流程图 四、实验步骤(包括主要步骤、代码分析等) (一)主要步骤1.打开MATLAB 集成调试软件2.单击“File ”-“New ”,新建一个.M 文件,命名为“h ”。

3.保存后运行。

4.在MATLAB 的主窗口输入p=[0.2 0.3 0.5]按Enter 后,输入H(p)再按Enter ,即可出现实验结果。

5.观察到实验结果为ans =1.48556.并分析实验结果 (二)主要代码分析function H=H(p)if((p>=0)&(p<=1)) %如果01p ≤≤,执行下列语句 P0=sum(p); %P0为各概率之和if (P0==1) %如果P0=1执行下列语句 H=-sum(p.*log2(p)); elsedisplay('defult') %P0为各概率之和不为1,输出defult end elsedisplay('defult') %如果不是01p ≤≤,输出defult end五、结果分析与总结通过本次实验,我进一步理解了熵函数的意义,通过MATLAB 编程,我进一步理解了熵函数的是对信源不确定度的度量。

但是,我发现自己在MATLAB 编程上还存在很大的欠缺,以后要加强在这方面的练习。

教师签名:年 月 日。

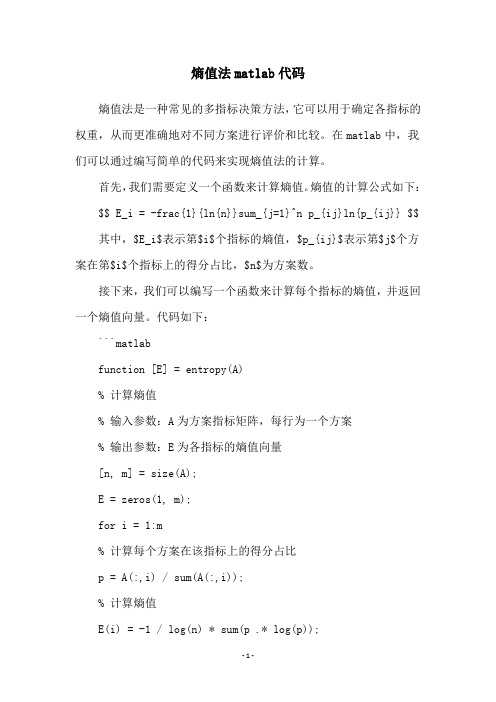

熵值法matlab代码

熵值法matlab代码熵值法是一种常见的多指标决策方法,它可以用于确定各指标的权重,从而更准确地对不同方案进行评价和比较。

在matlab中,我们可以通过编写简单的代码来实现熵值法的计算。

首先,我们需要定义一个函数来计算熵值。

熵值的计算公式如下: $$ E_i = -frac{1}{ln{n}}sum_{j=1}^n p_{ij}ln{p_{ij}} $$ 其中,$E_i$表示第$i$个指标的熵值,$p_{ij}$表示第$j$个方案在第$i$个指标上的得分占比,$n$为方案数。

接下来,我们可以编写一个函数来计算每个指标的熵值,并返回一个熵值向量。

代码如下:```matlabfunction [E] = entropy(A)% 计算熵值% 输入参数:A为方案指标矩阵,每行为一个方案% 输出参数:E为各指标的熵值向量[n, m] = size(A);E = zeros(1, m);for i = 1:m% 计算每个方案在该指标上的得分占比p = A(:,i) / sum(A(:,i));% 计算熵值E(i) = -1 / log(n) * sum(p .* log(p));endend```接下来,我们可以编写一个函数来计算每个指标的权重。

权重的计算公式如下:$$ w_i = frac{1 - E_i}{m - sum_{j=1}^m E_j} $$ 其中,$w_i$表示第$i$个指标的权重,$m$为指标数。

代码如下:```matlabfunction [w] = entropy_weight(A)% 计算熵值权重% 输入参数:A为方案指标矩阵,每行为一个方案% 输出参数:w为各指标的权重向量E = entropy(A);m = size(A, 2);w = (1 - E) / (m - sum(E));end```最后,我们可以测试一下这些函数的效果。

假设我们有5个方案,每个方案有3个指标,分别是收益、成本和风险。

求解平稳分布matlab,计算二阶马尔可夫信源的熵

求解平稳分布matlab,计算⼆阶马尔可夫信源的熵实验三、计算⼆阶马尔可夫信源的熵

⒈实验⽬的和要求

1)掌握MATLAB的矩阵运算功能和图表功能。

2)掌握⼆阶马尔可夫信源熵的求解⽅法。

⒉实验主要内容

80.200 0.

0 0.500.5已知信源的转移矩阵P= , 0.50.500 00.800.2

1)利⽤Matlab强⼤的矩阵运算功能计算⼆阶马尔可夫信源的平稳分布概率。

2) 在

Matlab环境下,编程计算该⼆阶马尔可夫信源的熵。

3.实验原理

对于时齐、遍历的马尔可夫链,已知

p11p12p13p14 pppp22232124 P为信源的转移矩阵,P= ,p(Sj)为稳态概 p31p32p33p34 ppp44 4243 p41率,p(Sj) Wj,且W P W

则信源熵为

H =Hm 1 p(Sj)H(X/Sj)

Sj

其中H(X/Sj)=- p(xi/Sj)logp(xi/Sj),

如H(X/S1)=-(p11logp11 p12logp12 p13logp13 p14logp14)

4.主要仪器

(1)、计算机

(2) Windows 2000 或以上

(3)Microsoft Office 2000 或以上

(4) Matlab 6.0或以上。

matlab计算熵

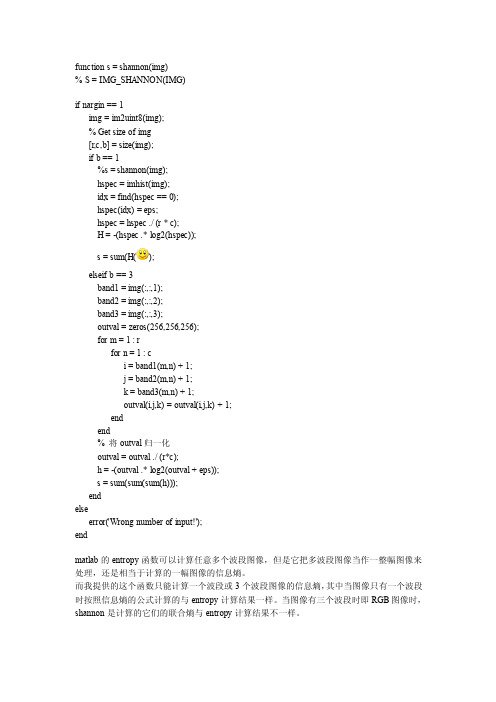

function s = shannon(img)% S = IMG_SHANNON(IMG)if nargin == 1img = im2uint8(img);% Get size of img[r,c,b] = size(img);if b == 1%s = shannon(img);hspec = imhist(img);idx = find(hspec == 0);hspec(idx) = eps;hspec = hspec ./ (r * c);H = -(hspec .* log2(hspec));s = sum(H();elseif b == 3band1 = img(:,:,1);band2 = img(:,:,2);band3 = img(:,:,3);outval = zeros(256,256,256);for m = 1 : rfor n = 1 : ci = band1(m,n) + 1;j = band2(m,n) + 1;k = band3(m,n) + 1;outval(i,j,k) = outval(i,j,k) + 1;endend% 将outval归一化outval = outval ./ (r*c);h = -(outval .* log2(outval + eps));s = sum(sum(sum(h)));endelseerror('Wrong number of input!');endmatlab的entropy函数可以计算任意多个波段图像,但是它把多波段图像当作一整幅图像来处理,还是相当于计算的一幅图像的信息熵。

而我提供的这个函数只能计算一个波段或3个波段图像的信息熵,其中当图像只有一个波段时按照信息熵的公式计算的与entropy计算结果一样。

当图像有三个波段时即RGB图像时,shannon是计算的它们的联合熵与entropy计算结果不一样。

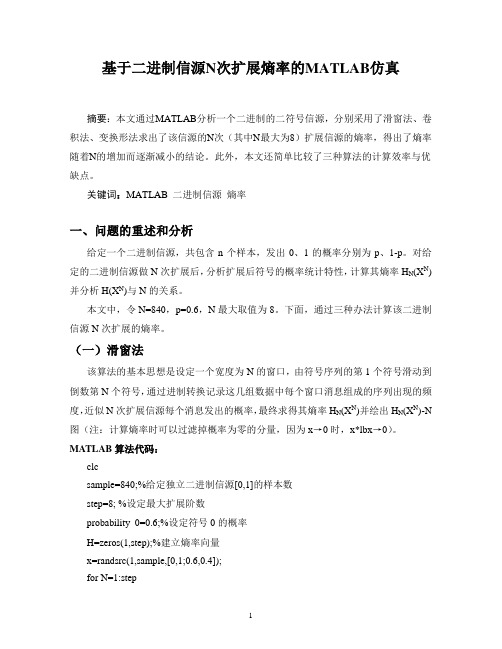

基于二进制信源N次扩展熵率的MATLAB仿真

基于二进制信源N次扩展熵率的MATLAB仿真摘要:本文通过MATLAB分析一个二进制的二符号信源,分别采用了滑窗法、卷积法、变换形法求出了该信源的N次(其中N最大为8)扩展信源的熵率,得出了熵率随着N的增加而逐渐减小的结论。

此外,本文还简单比较了三种算法的计算效率与优缺点。

关键词:MATLAB 二进制信源熵率一、问题的重述和分析给定一个二进制信源,共包含n个样本,发出0、1的概率分别为p、1-p。

对给定的二进制信源做N次扩展后,分析扩展后符号的概率统计特性,计算其熵率H N(X N)并分析H(X N)与N的关系。

本文中,令N=840,p=0.6,N最大取值为8。

下面,通过三种办法计算该二进制信源N次扩展的熵率。

(一)滑窗法该算法的基本思想是设定一个宽度为N的窗口,由符号序列的第1个符号滑动到倒数第N个符号,通过进制转换记录这几组数据中每个窗口消息组成的序列出现的频度,近似N次扩展信源每个消息发出的概率,最终求得其熵率H N(X N)并绘出H N(X N)-N 图(注:计算熵率时可以过滤掉概率为零的分量,因为x→0时,x*lbx→0)。

MATLAB算法代码:clcsample=840;%给定独立二进制信源[0,1]的样本数step=8; %设定最大扩展阶数probability_0=0.6;%设定符号0的概率H=zeros(1,step);%建立熵率向量x=randsrc(1,sample,[0,1;0.6,0.4]);for N=1:stepn=zeros(1,2^N);order=2.^([0:N-1]);for M=0:(2^N-1)for i=1:(sample+1-N)if(order*x(i:N+i-1)'==M)n(M+1)=n(M+1)+1;%记录信源发出的每种符号序列的个数endendendp=n/(sample+1-N);%N次扩展的概率向量p=p(find(p~=0));%过滤掉概率为0的分量,其原理是x→0时,x*lbx→0H(N)=-p*log2(p')/N;%输出每种扩展下的熵率endH%输出熵率向量stem([1:step],H)xlabel('扩展阶数N=1:8');ylabel('熵率');输出:H =0.9756 0.9749 0.9742 0.9715 0.9685 0.9654 0.9587 0.9438H N(X N)-N图:12345678滑窗法扩展阶数N=1:8熵率(二)卷积法该算法的基本思想同滑窗法基本相同,不同的是通过符号序列与2的幂次向量做卷积实现窗口的滑动与进制的转换。