基于Boosting的多分类器融合算法

集成学习Boosting算法综述

集成学习Boosting算法综述一、本文概述本文旨在全面综述集成学习中的Boosting算法,探讨其发展历程、基本原理、主要特点以及在各个领域的应用现状。

Boosting算法作为集成学习中的一类重要方法,通过迭代地调整训练数据的权重或分布,将多个弱学习器集合成一个强学习器,从而提高预测精度和泛化能力。

本文将从Boosting算法的基本概念出发,详细介绍其发展历程中的代表性算法,如AdaBoost、GBDT、GBoost等,并探讨它们在分类、回归等任务中的性能表现。

本文还将对Boosting算法在各个领域的应用进行综述,以期为读者提供全面、深入的Boosting 算法理解和应用参考。

二、Boosting算法概述Boosting算法是一种集成学习技术,其核心思想是将多个弱学习器(weak learner)通过某种策略进行组合,从而形成一个强学习器(strong learner)。

Boosting算法的主要目标是提高学习算法的精度和鲁棒性。

在Boosting过程中,每个弱学习器都针对前一个学习器错误分类的样本进行重点关注,从而逐步改善分类效果。

Boosting算法的基本流程如下:对训练集进行初始化权重分配,使得每个样本的权重相等。

然后,使用带权重的训练集训练一个弱学习器,并根据其分类效果调整样本权重,使得错误分类的样本权重增加,正确分类的样本权重减少。

接下来,使用调整后的权重训练下一个弱学习器,并重复上述过程,直到达到预定的弱学习器数量或满足其他停止条件。

将所有弱学习器进行加权组合,形成一个强学习器,用于对新样本进行分类或预测。

Boosting算法有多种变体,其中最具代表性的是AdaBoost算法。

AdaBoost算法采用指数损失函数作为优化目标,通过迭代地训练弱学习器并更新样本权重,逐步提高分类精度。

还有GBDT(Gradient Boosting Decision Tree)、GBoost、LightGBM等基于决策树的Boosting算法,它们在处理大规模数据集和高维特征时表现出良好的性能。

基于Boosting算法的特征选择研究

基于Boosting算法的特征选择研究一、引言特征选择是机器学习和数据挖掘领域的重要问题之一。

在构建模型和分析数据时,通常会遇到大量的特征。

然而,不是所有的特征都对模型的性能有贡献。

因此,特征选择的目标是从大量的特征中筛选出最具有信息量的特征,提高模型性能和数据分析的效率。

Boosting算法作为一种常用的机器学习方法,近年来在特征选择问题中得到了广泛的应用。

本文将介绍基于Boosting算法的特征选择研究,探讨其原理、方法和应用。

二、Boosting算法的原理与方法Boosting算法是一种综合多个弱分类器的算法,通过串行训练弱分类器并加权组合它们的结果,不断提高整体模型的性能。

在特征选择问题中,Boosting算法可以通过优化特征的权重来选择最具有区分性的特征。

具体而言,Boosting算法的基本步骤包括初始化权重、训练弱分类器、计算错误率、更新样本权重以及组合弱分类器等。

三、基于Boosting算法的特征选择方法1. Adaboost算法Adaboost是最早提出的Boosting算法之一,也是应用最为广泛的特征选择方法之一。

Adaboost通过迭代训练多个弱分类器,并根据分类器的分类错误率来更新样本的权重。

在每轮迭代中,Adaboost会增加错误分类样本的权重,减少正确分类样本的权重,使得后续的弱分类器更加关注那些分类错误的样本。

通过加权组合多个弱分类器的结果,Adaboost能够得到更准确的分类结果,并选择出最重要的特征。

2. Gradient Boosting算法Gradient Boosting是一种更加强大和灵活的Boosting算法。

与Adaboost不同,Gradient Boosting在每轮迭代中不仅仅关注样本的分类结果,还考虑样本的梯度信息。

通过最小化损失函数的负梯度来训练下一个弱分类器,并通过加权组合多个弱分类器的结果来提高模型的性能。

Gradient Boosting在特征选择中具有很强的灵活性,可以适应不同的问题和数据集。

基于Boosting 算法软件可靠性动态赋权组合建模

基于Boosting 算法软件可靠性动态赋权组合建模高云强;唐超;李海峰【摘要】目前,许多软件可靠性增长模型(SRGMs)被提出并应用于软件开发过程,但还没有在不同条件下都表现良好的普适性模型.将若干独立模型进行组合可提高单个模型的可靠性评估和预计精度.本文基于机器学习算法(Boosting算法),建立基于单个模型变异的动态赋权组合模型(ASCM).ASCM模型可有效地改进单个原始模型的拟合性能.【期刊名称】《数字技术与应用》【年(卷),期】2017(000)008【总页数】4页(P120-123)【关键词】软件可靠性;机器学习;动态赋权;组合模型【作者】高云强;唐超;李海峰【作者单位】中国电子科技集团公司第三十二研究所,上海201808;中国电子科技集团公司第三十二研究所,上海201808;北京航空航天大学,北京100083【正文语种】中文【中图分类】TP311.51软件可靠性增长模型(Software Reliability Growth Models, SRGMs)作为开发与运行阶段软件可靠性定量评估与预计的主要手段,从上世纪70年代起,一直是软件可靠性工程领域最关注的研究方向之一[1~3],已被成功地应用于各类安全关键软件的开发过程[4,5]。

很多软件可靠性模型很难取得持续准确的可靠性评估与预计结果。

针对这个问题,本文研究将若干模型组合在一起以提高单个模型的评估和预计精度。

针对参数化软件可靠性模型的组合方法,提出新的基于Boosting算法的动态赋权软件可靠性组合建模方法,有效地改进单个参数化模型的评估和预计性能。

本文研究的方法为模型自组合方法,其首先根据同一个原始模型产生若干个变异模型,然后利用Boosting算法在失效数据集上对这些变异模型分别进行训练从而动态赋予权重值,最终获得一个由多个变异模型组成的线性组合模型(ASCM)。

ASCM 可用于单个模型评估和预计性能的自我改进。

1.1 Boosting算法Boosting算法是一种机器学习算法,将多个弱分类器组合在一起学习,构成一个强分类器。

adaboost多类分类——samme算法 例子

adaboost多类分类——samme算法例子AdaBoost(Adaptive Boosting)是一种集成学习算法,主要用于分类问题。

Samme算法是AdaBoost的一个变种,用于多类别分类问题。

下面是一个使用Python和scikit-learn库实现Samme算法的简单例子:```pythonfrom import AdaBoostClassifierfrom import make_multiclassfrom _selection import train_test_splitfrom import accuracy_score创建模拟数据集X, y = make_multiclass(n_samples=1000, n_classes=3,random_state=42)划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=, random_state=42)创建AdaBoost分类器并使用Samme算法clf = AdaBoostClassifier(algorithm="SAMME",n_estimators=100,learning_rate=,random_state=42)训练模型(X_train, y_train)预测测试集结果y_pred = (X_test)计算准确率accuracy = accuracy_score(y_test, y_pred)print(f"Accuracy: {accuracy}")```在这个例子中,我们首先创建了一个模拟的三类别数据集。

然后,我们使用train_test_split函数将数据划分为训练集和测试集。

接下来,我们创建了一个AdaBoost分类器,并指定使用Samme算法。

我们设置n_estimators为100,表示使用100个弱分类器,learning_rate为,表示每个弱分类器的权重相同。

Boosting原理及应用

Boosting原理及应用[object Object]Boosting是一种用于提升机器学习模型性能的集成学习方法,它通过训练一系列弱分类器,并将它们组合成一个强分类器。

Boosting的原理是通过迭代的方式,逐步改进弱分类器的性能,使得它们在错误分类的样本上有更高的权重,从而达到提升整体分类性能的目的。

Boosting的核心思想是将多个弱分类器进行加权组合,使得它们能够协同工作,并形成一个更强大的分类器。

在每一轮迭代中,Boosting会根据上一轮分类器的性能调整样本权重,使得对错误分类的样本施加更高的权重,从而在下一轮中更加关注这些难以分类的样本。

这种迭代的过程会一直进行,直到达到一定的迭代次数或者分类器的性能不再提升为止。

1. Adaboost(Adaptive Boosting):Adaboost是Boosting算法最经典的实现之一,它通过迭代的方式训练一系列弱分类器,并将它们加权组合成一个强分类器。

Adaboost的特点是能够适应不同的数据分布,对于难以分类的样本会给予更高的权重,从而提升整体的分类性能。

2. Gradient Boosting:Gradient Boosting是一种通过梯度下降的方式逐步优化模型性能的Boosting算法。

它的核心思想是在每一轮迭代中,计算损失函数的负梯度,并将其作为下一轮训练样本的权重调整。

通过迭代的方式,逐步改进弱分类器的性能,从而提升整体的分类准确率。

3. XGBoost(eXtreme Gradient Boosting):XGBoost是Gradient Boosting的一种优化实现,它在Gradient Boosting的基础上引入了一些创新的技术,如正则化、缺失值处理和并行计算等。

XGBoost在很多机器学习竞赛中取得了优秀的成绩,并被广泛应用于各种实际问题中。

4. LightGBM:LightGBM是一种基于梯度提升树的Boosting算法,它在XGBoost的基础上进行了一些改进,使得它能够更快地训练模型,并具有更低的内存消耗。

多 集成算法

多集成算法多集成算法是机器学习领域中常用的一种方法,它通过结合多个基分类器的预测结果来提高整体的预测准确性和鲁棒性。

本文将介绍多集成算法的概念、常见的几种算法以及其在实际应用中的优势和局限性。

一、多集成算法的概念多集成算法是指将多个基分类器(也称为弱分类器)的预测结果进行组合,得到一个综合的预测结果的方法。

这样的组合可以通过多种方式实现,例如加权平均、投票、堆叠等。

多集成算法的基本思想是通过结合多个弱分类器的优点,弥补单个分类器的缺点,从而提高整体的分类性能。

二、常见的多集成算法1. Bagging(装袋法)Bagging是Bootstrap Aggregating的缩写,它通过随机有放回地从原始训练集中抽取多个子训练集,然后使用这些子训练集分别训练多个基分类器。

最后,通过对这些基分类器的预测结果进行投票或平均,得到最终的预测结果。

2. Boosting(提升法)Boosting是一种迭代的方法,它通过训练一系列的基分类器,每个基分类器都试图修正前一个分类器的错误。

在Boosting过程中,每个样本都会被赋予一个权重,这些权重会根据前一个基分类器的预测结果进行调整。

Boosting算法最终将这些基分类器的预测结果进行加权结合,得到最终的预测结果。

3. Random Forest(随机森林)随机森林是一种基于决策树的集成算法。

它通过随机选择特征子集和样本子集,训练多个决策树。

最后,通过对这些决策树的预测结果进行投票,得到最终的预测结果。

随机森林具有较好的鲁棒性和泛化能力,并且可以处理高维数据和大规模数据。

4. Stacking(堆叠法)堆叠法是一种将多个基分类器进行堆叠,形成一个更强大的元分类器的方法。

在堆叠过程中,首先将原始训练集分成两部分,一部分用于训练多个基分类器,另一部分用于训练元分类器。

然后,将这些基分类器的预测结果作为元分类器的输入特征,通过元分类器进行预测。

三、多集成算法的优势和局限性多集成算法具有以下优势:1. 提高预测准确性:通过结合多个基分类器的预测结果,多集成算法可以减少单个分类器的错误率,提高整体的预测准确性。

Boosting算法总结(adaboosting、GBDT、XGBoost)

Boosting算法总结(adaboosting、GBDT、XGBoost)把之前学习xgb过程中查找的资料整理分享出来,⽅便有需要的朋友查看,求⼤家点赞⽀持,哈哈哈作者:tangg, qq:577305810⼀、Boosting算法boosting算法有许多种具体算法,包括但不限于ada boosting \ GBDT \ XGBoost .所谓 Boosting ,就是将弱分离器 f_i(x) 组合起来形成强分类器 F(x) 的⼀种⽅法。

每个⼦模型模型都在尝试增强(boost)整体的效果,通过不断的模型迭代,更新样本点的权重Ada Boosting没有oob(out of bag ) 的样本,因此需要进⾏ train_test_split原始数据集》某种算法拟合,会产⽣错误》根据上个模型预测结果,更新样本点权重(预测错误的结果权重增⼤)》再次使⽤模型进⾏预测》重复上述过程,继续重点训练错误的预测样本点每⼀次⽣成的⼦模型,都是在⽣成拟合结果更好的模型,(⽤的数据点都是相同的,但是样本点具有不同的权重值)需要指定 Base Estimatorfrom sklearn.ensemble import AdaBoostClassifierfrom sklearn.tree import DecisionTreeClassifierada_clf = AdaBoostClassifier(DecisionTreeClassifier(max_depth=2), n_estimators=500)ada_clf.fit(X_train, y_train)ada_clf.score(X_test, y_test)Gradient Boosting ⼜称为 DBDT (gradient boosting decision tree )训练⼀个模型m1,产⽣错误e1针对e1训练第⼆个模型m2,产⽣错误e2针对e2训练第⼆个模型m3,产⽣错误e3......最终的预测模型是:m1+m2+m3+...Gradient Boosting是基于决策树的,不⽤指定Base Estimatorfrom sklearn.ensemble import GradientBoostingClassifiergb_clf = GradientBoostingClassifier(max_depth=2, n_estimators=30)gb_clf.fit(X_train, y_train)gb_clf.score(X_test, y_test)这个算法的Base Estimator是基于decision tree的Xgboost是在GBDT的基础上进⾏改进,使之更强⼤,适⽤于更⼤范围xgboost可以⽤来确定特征的重要程度强烈推荐博客园上【战争热诚】写的⼀篇介绍xgboost算法的⽂章,⾮常详细地介绍了xgboost的优点、安装、xgboost参数的含义、使⽤xgboost实例代码、保存训练好的模型、并介绍了xgboost参数调优的⼀m1+m2+m3+...般流程。

多模型融合推荐算法

多模型融合推荐算法常见的多模型融合算法多模型融合算法可以⽐单⼀模型算法有极为明显的效果提升。

但是怎样进⾏有效的融合,充分发挥各个算法的长处?这⾥总结⼀些常见的融合⽅法:1. 线性加权融合法线性加权是最简单易⽤的融合算法,⼯程实现⾮常⽅便,只需要汇总单⼀模型的结果,然后按不同算法赋予不同的权重,将多个推荐算法的结果进⾏加权,即可得到结果:是给⽤户(user)推荐商品(item)的得分,是算法K的权重,是算法k得到的⽤户(user)对商品item的推荐得分。

这种融合⽅式实现简单,但效果较差。

因为线性加权的参数是固定的,实践中参数的选取通常依赖对全局结果升降的总结,⼀旦设定后,⽆法灵活的按照不同的推荐场景来⾃动变换。

⽐如如果某个场景⽤算法A效果较好,另外⼀种场景⽤算法B效果较好,线性融合的⽅式在这种情况下不能取得好的效果。

为了解决这个问题,达观数据进⾏了改进,通过引⼊动态参数的机制,通过训练⽤户对推荐结果的评价、与系统的预测是否相符⽣成加权模型,动态的调整权重使得效果⼤幅提升。

2. 交叉融合法交叉融合常被称为Blending⽅法,其思路是在推荐结果中,穿插不同推荐模型的结果,以确保结果的多样性。

这种⽅式将不同算法的结果组合在⼀起推荐给⽤户。

交叉融合法的思路是“各花⼊各眼”,不同算法的结果着眼点不同,能满⾜不同⽤户的需求,直接穿插在⼀起进⾏展⽰。

这种融合⽅式适⽤于同时能够展⽰较多条结果的推荐场景,并且往往⽤于算法间区别较⼤,如分别基于⽤户长期兴趣和短期兴趣计算获得的结果。

3. 瀑布融合法瀑布型(Waterfall Model)融合⽅法采⽤了将多个模型串联的⽅法。

每个推荐算法被视为⼀个过滤器,通过将不同粒度的过滤器前后衔接的⽅法来进⾏:在瀑布型混合技术中,前⼀个推荐⽅法过滤的结果,将作为后⼀个推荐⽅法的候选集合输⼊,层层递进,候选结果在此过程中会被逐步遴选,最终得到⼀个量少质⾼的结果集合。

这样设计通常⽤于存在⼤量候选集合的推荐场景上。

adaboostclassifier的超参数

adaboostclassifier的超参数adaboostclassifier是一种常用的机器学习算法,用于分类任务。

它基于boosting算法,通过逐步构建多个弱分类器,最终得到一个强分类器。

在adaboostclassifier中,超参数的选择对于模型的性能和效果至关重要。

本文将介绍一些常用的adaboostclassifier超参数,并探讨它们的含义、选择方法和最佳值。

1. 弱分类器数量弱分类器数量是adaboostclassifier中的一个重要超参数,它决定了最终的强分类器的数量。

选择合适的弱分类器数量可以使得模型在保持准确率的同时,提高模型的泛化能力。

一般来说,可以通过交叉验证来选择最佳的弱分类器数量。

2. 弱分类器算法弱分类器算法是构建弱分类器的具体算法,常用的算法包括决策树、随机森林、支持向量机等。

不同的弱分类器算法对数据的要求和性能表现也不尽相同。

在选择弱分类器算法时,需要根据数据的特点和需求进行权衡和选择。

3. 特征选择特征选择是adaboostclassifier中另一个重要的超参数,它可以帮助减少特征的数量,提高模型的性能和效率。

在进行特征选择时,可以根据特征的相关性、缺失率和方差等因素进行评估和选择。

4. 增益因子增益因子是adaboostclassifier中的一个重要超参数,它决定了弱分类器对数据的重视程度。

增益因子越大,弱分类器对数据的重视程度越高,模型对数据的依赖性也越大;反之,增益因子越小,弱分类器对数据的重视程度越低,模型对特征的依赖性也越小。

在选择增益因子时,需要根据数据的特点和需求进行权衡和选择。

5. 迭代次数adaboostclassifier的迭代次数也是一个重要的超参数,它决定了整个模型的训练次数。

选择合适的迭代次数可以使得模型在保持准确率的同时,减少计算量和时间成本。

一般来说,可以通过交叉验证来选择最佳的迭代次数。

6. 弱分类器的学习率弱分类器的学习率是控制弱分类器权重更新速度的超参数。

Boosting算法之Adaboost和GBDT

Boosting算法之Adaboost和GBDT Boosting是串⾏式集成学习⽅法的代表,它使⽤加法模型和前向分步算法,将弱学习器提升为强学习器。

Boosting系列算法⾥最著名的算法主要有AdaBoost和梯度提升系列算法(Gradient Boost,GB),梯度提升系列算法⾥⾯应⽤最⼴泛的是梯度提升树(Gradient Boosting Decision Tree,GBDT)。

⼀、Adaboost1、Adaboost介绍 Adaboost算法通过在训练集上不断调整样本权重分布,基于不同的样本权重分布,重复训练多个弱分类器,最后通过结合策略将所有的弱分类器组合起来,构成强分类器。

Adaboost算法在训练过程中,注重减少每个弱学习器的误差,在训练下⼀个弱学习器时,根据上⼀次的训练结果,调整样本的权重分布,更加关注那些被分错的样本,使它们在下⼀次训练中得到更多的关注,有更⼤的可能被分类正确。

Adaboost算法框架图2、Adaboost算法过程1)初始化样本权重,⼀共有n个样本,则每个样本的权重为1/n2)在样本分布D t上,训练弱分类器,for t=1,2,……T:a、训练分类器h tb、计算当前弱分类器的分类误差率c、判断误差率是否⼩于0.5,是则继续,否则退出循环d、计算当前弱分类器的权重系数alpha值e、根据alpha值调整样本分布D t+1如果样本被正确分类,则该样本的权重更改为:如果样本被错误分类,则该样本的权重更改为:3)组合弱分类器得到强分类器3、算法伪代码: AdaBoost算法每⼀轮都要判断当前基学习器是否满⾜条件,⼀旦条件不满⾜,则当前学习器被抛弃,且学习过程停⽌。

Adaboost算法使⽤指数损失函数,通过最⼩化指数损失函数,得到在每次迭代中更新的权重参数计算公式。

AdaBoost算法使⽤串⾏⽣成的序列化⽅法,多个基学习器之间存在强依赖关系。

Adaboost的每⼀个弱分类器的⽬标,都是为了最⼩化损失函数,下⼀个弱分类器是在上⼀个分类器的基础上对错分样本进⾏修正,所以, AdaBoost算法是注重减⼩偏差的算法。

gradientboostingclassifier分类 -回复

gradientboostingclassifier分类-回复什么是gradient boosting classifier分类算法?Gradient boosting classifier是一种分类算法,它基于boosting算法的原理,使用多个弱分类器来组合成一个强分类器。

它是一种集成学习方法,可以在处理大规模数据时具有优秀的性能和精度。

该算法主要的特点是,它能够针对数据中的误差进行优化,而且抗噪能力强。

具体来说,这种算法通过对误分类的数据进行重复加权操作,不断地去学习误差信号,以此来改进其分类器的性能。

同时,该算法有自身的分裂判定算法,能有效地避免过拟合,提高模型的泛化能力。

在Gradient Boosting Classifier分类器中,每一次迭代都会生成一个模型,而每个模型都有自己的权重值,使得后续的模型能够接着前一个模型的结果进行进一步优化。

这种方法能够依靠弱模型的组合来生成一个更加精确的模型,有效地提高了模型的准确性。

如何使用Gradient Boosting Classifier分类算法?要使用Gradient Boosting Classifier算法,我们首先需要准备好数据集,并将其拆分为训练集和测试集。

然后,我们需要选择一些基本模型作为基础分类器,并通过它们来生成集成模型。

通常来说,我们可以选择一些简单的分类器,例如决策树或者支持向量机模型。

在使用Gradient Boosting Classifier算法的过程中,我们需要进行一系列的迭代操作,以不断地优化我们的模型。

在每次迭代操作中,我们会根据误差的大小来调整模型的补偿量,并根据该值来更新模型的权重。

此外,我们还需要进行早期停止操作,以防止过拟合现象的发生。

值得注意的是,Gradient Boosting Classifier算法对于数据的特征提取过程十分敏感,因此我们需要对数据进行预处理操作,以确保得到最好的结果。

常见的预处理技术包括:归一化、标准化、离散化等。

基于Boosting算法的文本自动分类器设计

第2 7卷 第Βιβλιοθήκη 2期 20 0 7年 2月

文 章 编 号 :0 1 9 8 ( 07 0 0 8 0 10 — 0 1 2 0 )2— 3 4— 3

计 算 机应 用

Co u e p l ai n mp tr A pi t s c o

分类器有很好的分类精度。 关键 词 : 文本 分类 ; 器学 习 ;osn 法 机 B t g算 i 中图分类 号 : P 1 文 献标 识码 : T3 1 A

De in fa t e tc t g rz to l si e a e n Bo si lo ih sg o u o t x a e o ia in ca sf r b s d o o tng ag rt m i

DONG L - o g , GE u - u HO n - u n ‘ eh n NG G o h a ,Z U Mi g q a

( . oeeo nom t nSi c n ehooy N r w s U i rt ’nS a ni 10 9 C i ; 1 C lg frai c nead Tcnl , o h et nv sy l fI o e g t e i, 口 ha x 7 0 6 , hn a 2 o eefI o ainSi e n eh l y B in om l nvr y B rn 0 8 5 C i ) .C lg n r t c n d Tcno , e gN r a i s , eig107 , hn l o fm o e a c o g U e i t a

近邻分类 、 回归模型 、 策树 、 决 推导 规则 、 贝叶斯 分类 、 经 网 神 络、 支持 向量机 以及相 关反馈 。组合 分类 器方法 是近年 来流 行 的一种 分类 方法 , 将多个 分类器 的判定 结果合并 为一 它是 个分类器 的方法 。即 : 对于需要专家介入 的任务 , 个 独立 的 s 专家 的 判 断 经 过 适 当 归 并 ,比单 个 人 作 出 的判 断 要 好。

boosting方法

boosting方法[object Object]Boosting方法是一种集成学习方法,通过组合多个弱学习器来构建一个强学习器。

它通过迭代的方式逐步提升学习器的性能。

本文将详细介绍Boosting方法的原理、算法和应用。

一、原理Boosting方法的原理基于两个主要观点:一是通过组合多个弱学习器可以构建出一个强学习器;二是通过关注错误样本,不断调整学习器的权重,可以提高学习器的性能。

Boosting方法的基本思想是将多个弱学习器进行线性组合,每个弱学习器的权重由其在前一轮迭代中的错误率决定。

在每一轮迭代中,Boosting方法根据样本的权重进行训练,并根据分类错误的样本调整权重。

通过这种方式,Boosting方法能够逐步减少错误样本的权重,提高学习器的准确性。

二、算法Boosting方法的经典算法有AdaBoost和Gradient Boosting。

1. AdaBoost(Adaptive Boosting)AdaBoost是最早提出的Boosting方法之一、它的核心思想是通过迭代的方式,训练一系列弱学习器,并将它们进行线性组合。

在每一轮迭代中,AdaBoost会根据前一轮迭代中的错误率调整样本的权重,使得错误率高的样本得到更多的关注。

最终,AdaBoost将得到一个强学习器,它的性能优于单个弱学习器。

2. Gradient BoostingGradient Boosting是另一种常用的Boosting方法。

它通过迭代的方式训练一系列弱学习器,并将它们进行线性组合。

与AdaBoost不同的是,Gradient Boosting使用梯度下降的方法来调整学习器的权重。

在每一轮迭代中,Gradient Boosting会计算样本的残差,并将残差作为下一轮迭代的目标。

通过这种方式,Gradient Boosting能够逐步减少残差,提高学习器的准确性。

三、应用Boosting方法在机器学习领域有广泛的应用。

Boosting算法简介

Boosting算法简介转⾃:/baiduforum/article/details/6721749⼀、Boosting算法的发展历史 Boosting算法是⼀种把若⼲个分类器整合为⼀个分类器的⽅法,在boosting算法产⽣之前,还出现过两种⽐较重要的将多个分类器整合为⼀个分类器的⽅法,即boostrapping⽅法和bagging⽅法。

我们先简要介绍⼀下bootstrapping⽅法和bagging⽅法。

1)bootstrapping⽅法的主要过程 主要步骤: i)重复地从⼀个样本集合D中采样n个样本 ii)针对每次采样的⼦样本集,进⾏统计学习,获得假设H i iii)将若⼲个假设进⾏组合,形成最终的假设H final iv)将最终的假设⽤于具体的分类任务 2)bagging⽅法的主要过程 主要思路: i)训练分类器 从整体样本集合中,抽样n* < N个样本针对抽样的集合训练分类器C i ii)分类器进⾏投票,最终的结果是分类器投票的优胜结果 但是,上述这两种⽅法,都只是将分类器进⾏简单的组合,实际上,并没有发挥出分类器组合的威⼒来。

直到1989年,Yoav Freund与Robert Schapire提出了⼀种可⾏的将弱分类器组合为强分类器的⽅法。

并由此⽽获得了2003年的哥德尔奖(Godel price)。

Schapire还提出了⼀种早期的boosting算法,其主要过程如下: i)从样本整体集合D中,不放回的随机抽样n1 < n个样本,得到集合D1 训练弱分类器C1 ii)从样本整体集合D中,抽取n2 < n个样本,其中合并进⼀半被C1分类错误的样本。

得到样本集合D2 训练弱分类器C2 iii)抽取D样本集合中,C1和C2分类不⼀致样本,组成D3 训练弱分类器C3 iv)⽤三个分类器做投票,得到最后分类结果 到了1995年,Freund and schapire提出了现在的adaboost算法,其主要框架可以描述为: i)循环迭代多次 更新样本分布 寻找当前分布下的最优弱分类器 计算弱分类器误差率 ii)聚合多次训练的弱分类器 在下图中可以看到完整的adaboost算法:现在,boost算法有了很⼤的发展,出现了很多的其他boost算法,例如:logitboost算法,gentleboost算法等等。

boosting算法

boosting算法Boosting算法是一种集成学习方法,通过将若干个弱分类器(即分类准确率略高于随机猜测的分类器)进行适当的加权组合,形成一个强分类器,以提高整体分类性能。

在机器学习领域,Boosting算法具有广泛的应用,尤其在解决分类问题上表现出色。

Boosting算法的核心思想是通过迭代的方式,不断调整数据的权重分布,使得前一个弱分类器分错的样本在后续模型中得到更多的关注,从而使得整体模型能够更好地对这些困难样本进行分类。

具体而言,Boosting算法通常包含以下几个步骤:1.初始化样本权重:将所有样本的权重初始化为相等值,表示初始时每个样本的重要性相同。

2.迭代训练弱分类器:对于每一轮迭代,根据当前样本权重分布训练一个弱分类器。

弱分类器的训练过程可以使用各种机器学习算法,如决策树、支持向量机等。

3.更新样本权重:根据当前弱分类器的分类结果,调整样本的权重分布。

被错误分类的样本的权重会得到增加,而被正确分类的样本的权重会减少。

4.计算弱分类器权重:根据弱分类器的分类准确率,计算其在最终分类器中的权重。

分类准确率越高的弱分类器权重越大。

5.组合弱分类器:通过加权组合所有弱分类器,形成一个强分类器。

弱分类器的权重决定了其对最终分类器的影响程度。

Boosting算法的关键在于不断调整样本的权重分布,使得模型能够更加关注分类错误的样本。

这样做的目的是为了解决传统分类算法容易受到噪声样本和异常样本影响的问题。

通过集成多个弱分类器,Boosting 算法可以有效地提高整体的分类性能。

常见的Boosting算法包括AdaBoost、Gradient Boosting和XGBoost等。

AdaBoost是最早提出的Boosting算法,它通过调整样本权重和弱分类器权重来训练模型。

Gradient Boosting是一种迭代的Boosting算法,每一轮迭代都通过梯度下降的方式优化损失函数。

XGBoost是一种改进的Gradient Boosting算法,通过引入正则化项和树剪枝等技术,进一步提高了模型的性能。

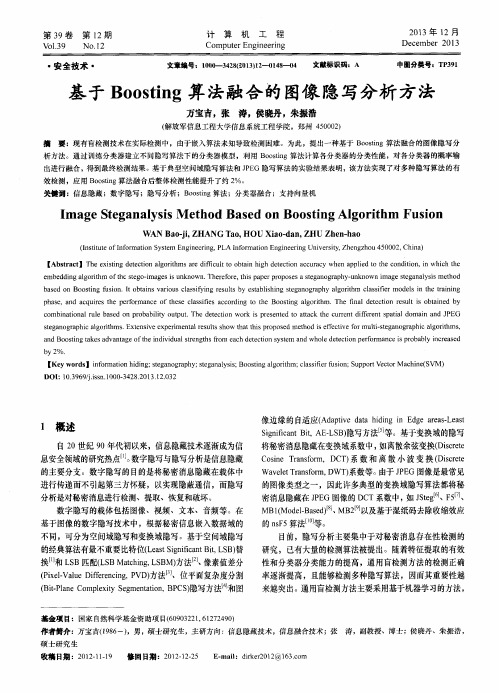

基于Boosting算法融合的图像隐写分析方法

2期 第 3 9 卷 第 1

Vl 0 1 . 3 9 NO. 1 2

计

算

机

工

程

2 0 1 3 年 1 2月

De c e mb e r 2 01 3

Co mp u t e r En gi n e e r i n g

・

安 全技术 ・

文章编号:1 0 0 0 —3 4 2 8 ( 2 n 1 3 ) 1 2 — - 0 1 4 8 — _ _ 0 4

[ A b s t r a c t l T h e e x i s t i n g d e t e c t i o n a l g o r i t h ms a r e d i f i f c u l t t o o b t a i n h i g h d e t e c t i o n a c c u r a c y w h e n a p p l i e d t o t h e c o n d i t i o n , i n w h i c h t h e

adaboost多分类实例

adaboost多分类实例Adaboost多分类实例Adaboost(Adaptive Boosting)是一种常用的集成学习算法,通过将多个弱分类器进行组合,得到一个强分类器。

在实际应用中,Adaboost广泛用于多分类问题。

本文将以Adaboost多分类实例为主题,介绍Adaboost算法的原理和实现过程。

一、Adaboost算法原理Adaboost的核心思想是通过串行训练多个弱分类器,并根据前一个分类器的表现来调整下一个分类器的权重,从而提高分类的准确率。

具体步骤如下:1. 初始化训练样本的权重,通常为均等值。

2. 训练第一个弱分类器,计算分类误差率并更新样本权重。

3. 根据分类误差率计算弱分类器的权重。

4. 更新训练样本的权重,增加被错误分类样本的权重,减少被正确分类样本的权重。

5. 重复步骤2-4,训练后续的弱分类器。

6. 根据所有弱分类器的权重,得到最终的强分类器。

二、Adaboost多分类实例假设我们有一个手写数字识别的问题,需要将0-9的数字进行分类。

我们使用Adaboost算法来解决这个多分类问题。

1. 数据准备我们使用MNIST数据集,该数据集包含60000个训练样本和10000个测试样本,每个样本是一个28x28的灰度图像。

我们将每个图像展开成一个784维的向量作为输入特征。

2. 初始化权重初始时,我们将训练样本的权重设置为均等值。

3. 训练弱分类器我们选择决策树作为弱分类器。

初始时,我们训练一个决策树分类器来对数字0和非0进行分类。

4. 更新样本权重根据分类误差率,更新样本的权重,增加被错误分类的样本的权重,减少被正确分类的样本的权重。

5. 训练后续的弱分类器我们继续训练其他的决策树分类器,每个分类器都根据前一个分类器的表现来调整样本权重。

6. 得到最终的强分类器根据所有弱分类器的权重,得到最终的强分类器。

对于一个新的输入样本,我们将其输入到每个弱分类器中进行分类,根据弱分类器的权重进行加权,得到最终的分类结果。

机器学习中的集成学习方法

机器学习中的集成学习方法机器学习是一门关于让计算机通过数据学习和优化算法的领域。

在机器学习的过程中,集成学习方法被广泛应用于提升模型性能和泛化能力。

本文将介绍机器学习中的集成学习方法,并探讨其在不同领域的应用。

一、集成学习方法概述集成学习是一种通过结合多个弱分类器或回归器来构建一个更强大的模型的方法。

它通过将若干个基分类器组合在一起,以达到获得更高性能和鲁棒性的目标。

常见的集成学习方法包括:Bagging、Boosting、Stacking等。

1. BaggingBagging方法通过从原始数据集中进行有放回的采样,生成多个子集,每个子集用于训练一个基分类器。

最后,通过将这些基分类器的结果进行投票或求均值的方式来预测新样本的类别或数值。

其中,随机森林(Random Forest)是Bagging方法的典型代表。

2. BoostingBoosting方法通过顺序训练多个基分类器,每个基分类器的训练数据集是上一个基分类器错误分类的样本集。

Boosting方法通过不断调整基分类器的权重,使得后续分类器对先前分类器错误分类的样本给予更高的重视。

常见的Boosting算法有Adaboost、GBDT(Gradient Boosting Decision Tree)等。

3. StackingStacking方法通过将多个基分类器的预测结果作为输入,训练一个元分类器来进行最终的分类。

与Bagging和Boosting方法不同的是,Stacking方法的基分类器不是独立学习的,而是相互协作,通过将多个基分类器的预测结果作为特征输入到元分类器中进行训练和预测。

二、集成学习方法的应用集成学习方法在机器学习领域得到了广泛的应用,以下是一些常见的应用场景。

1. 图像分类在图像分类任务中,集成学习方法可以通过将多个基分类器的预测结果进行投票或求均值的方式来提高模型的性能。

例如,在人脸识别任务中,可以使用多个基分类器对人脸图像进行分类,并将它们的预测结果进行集成,以提高识别准确率。

机器学习技术的模型融合方法

机器学习技术的模型融合方法在机器学习领域,模型融合是一种将多个模型结合起来,以提高预测性能和泛化能力的方法。

通过结合多个模型的预测结果,我们可以利用每个模型的优势,弥补其缺陷,从而获得更加准确和可靠的预测结果。

本文将介绍几种常用的机器学习技术的模型融合方法。

1. 基于投票的模型融合方法基于投票的模型融合方法是一种简单而有效的方式。

该方法通过训练多个模型,然后将它们的预测结果进行投票来决定最终的预测结果。

可以使用不同的投票策略,如少数服从多数、加权投票等。

基于投票的模型融合方法通常适用于分类问题。

2. 基于平均的模型融合方法基于平均的模型融合方法是另一种常见的模型融合方法。

该方法通过训练多个模型,然后将它们的预测结果进行平均来得到最终的预测结果。

可以使用算术平均、几何平均等不同的平均方式。

基于平均的模型融合方法通常适用于回归问题。

3. 基于堆叠的模型融合方法基于堆叠的模型融合方法是一种更为复杂和高级的方法。

该方法通常涉及多个层次的模型训练和预测。

在第一层中,每个模型被独立训练。

然后,在第二层中,使用第一层的模型的预测结果作为输入,训练一个更高级的模型,该模型将产生最终的预测结果。

基于堆叠的模型融合方法可以通过将不同类型的模型结合在一起,从而更好地捕捉数据的复杂性。

4. 基于Boosting的模型融合方法Boosting是一种序列化模型融合方法,它通过建立一系列弱分类器的线性组合来提高整体模型的性能。

在Boosting中,每个模型都根据之前模型的预测结果进行学习,从而逐步提高预测准确率。

其中最著名的算法是Adaboost。

Boosting方法通常在分类和回归问题中都有很好的应用效果。

5. 基于Bagging的模型融合方法Bagging是一种并行化模型融合方法,它通过训练多个相互独立的模型,然后将它们的预测结果进行投票或平均来决定最终的预测结果。

Bagging方法通常通过随机抽样和有放回取样来生成不同的训练样本,从而训练出多个模型。

机器学习中的模型融合技巧(Ⅱ)

机器学习中的模型融合技巧机器学习是当下炙手可热的研究领域之一,而模型融合技巧则是在机器学习中常用的一种方法。

模型融合技巧旨在将不同的模型相结合,以提高整体预测的准确性和鲁棒性。

在实际应用中,模型融合技巧被广泛应用于数据挖掘、预测分析、风险评估等领域。

本文将从模型融合的基本概念、常见的模型融合技巧以及如何选择合适的融合方法等方面展开论述。

基本概念模型融合的基本概念是将多个模型的预测结果进行整合,以获得更加准确和稳定的预测结果。

在机器学习中,不同的模型往往会有各自的优势和劣势,通过将多个模型进行融合,可以弥补各自模型的不足,提高整体预测的准确性。

模型融合技巧可以分为Bagging、Boosting、Stacking等不同的方法,每种方法都有其独特的特点和适用范围。

BaggingBagging是一种通过对训练数据集进行有放回的抽样,构建多个模型进行融合的方法。

在Bagging中,每个模型都是基于不同的训练数据集进行训练,最终的预测结果是通过对各个模型的预测结果进行平均或投票得到。

Bagging方法在处理高方差的模型时表现较好,例如决策树等。

BoostingBoosting是一种通过迭代的方式训练多个弱分类器,并将它们组合成一个强分类器的方法。

在Boosting中,每个弱分类器都会根据上一轮分类的错误进行调整,以使得整体模型的性能不断提升。

Adaboost和Gradient Boosting Decision Tree(GBDT)是Boosting方法的代表,它们在处理高偏差的模型时表现较好,例如线性回归等。

StackingStacking是一种将多个不同模型的预测结果作为输入,通过训练一个元模型来得到最终预测结果的方法。

在Stacking中,首先将不同的模型对训练数据集进行预测,然后将这些预测结果作为元特征,再训练一个元模型来获得最终的预测结果。

Stacking方法在处理复杂的预测问题时表现较好,例如图像识别、自然语言处理等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1 引言

在模式识别应用的各个领域,通常,采用单一方法的效果是有限的,采用多方法的有机 组合,使其优势互补,走多特征组合,多方案集成的道路,是目前模式识别的一个发展趋势。 本文将介绍并分析一种高效的多分类器融合算法:AdaBoost 算法[6]。 Boosting 作为一种通用的学习算法,可以提高任一给定算法的性能。 Kearns and Valiant [1,2] 最先指出,在 PAC 学习模型中[3],若存在一个多项式级的学习算法来识别 一组概念,并且识别率很高,那么这组概念是强可学习的;而如果学习算法识别一组概念的 正确率仅比随机猜测的略好, 那么这组概念是弱可学习的。 如果能将一个弱学习算法提升为 强学习算法,那么在学习概念时,只要找到一个比随机猜测略好的弱学习算法,就可以将其 提升为强学习算法,而不必直接去找通常情况下很难获得的强学习算法。此后,众多研究者 提出了一些更有效的 boosting 算法[4,5], 但是这些算法在实际应用中都存在某些不足。

3

手写汉字

笔划分割

结构和部件分析

部件原型知识库

字符分类

标准词典

字符 ID 图2 手写体汉字识别系统基本原理图

4 实验结果

本文实验中所用的数据库包含了 757555 个样本,而且每个字符包含 200 多个样本。所 用的三个分类器的性能见表 1(Recogn.为识别率的缩写) 。应用 Adaboost 算法得到的结果 与传统加权方法的比较见表 2 (E1 为 Adaboost 算法的结果,E2 位传统加权方法的结果)。 图 3 给出了以 AdaBoost 算法循环次数为变量的融合分类器识别率的函数曲线。该曲线 表明融合分类器的识别率在算法循环大约 35 次时达到最高,其后尽管增加循环次数,识别 率并没有更大的提高。以上的实验结果可以作如下解释,由 Adaboost 算法带来的系统错误 最大为[6,10]:

1 H (x ) = ∑ log β t t

ht ( x, y )

图 1 Adaboost 算法(可信度版本)

3 手写体汉字识别系统

本文研究内容的测试平台为手写体汉字识别系统,该系统采用传统的统计模式识别与结 构模式识别相结合的方法, 建立了识别系统的信息传递模型。 同时该系统采用了多分支多级 分类技术, 解决了多级分类过程中误差累积的问题, 整个识别过程分为笔段识别-字根识别字根识别三个层次,其基本原理图如图 2。 本系统在笔段排序和部件分析识别中采用的知识是一种专家知识,表示形式是一条条的 规则。在整字识别中采用的模板也是基于专家知识确定的,因而具有知识表达精炼、内存开 销少、识别效果好、识别速度快等优点。 此外,本系统中采用了三个不同的分类器:基于结构的分类器( e1 ), 动态规划分类器 ( e 2 )和高斯分类器( e3 )。 最终输出的分类器(E1)为这些单个分类器经 Adaboost 算法融合而 得到。

Multiple Classifiers Combination Algorithm Based on Boosting

LIN Lei1,WANG Xiaolong1,LIU Jiafeng1

(1.Department of Computer Science and Engineering, Harbin Institute of Technology Harbin, 150001, P.R. China)

1 {i : H (xi ) ≠ yi } ≤ 1 ∑ exp(− yi f (xi )) = ∏ Z t m m i t

其中,f ( x ) =

t t t

(1)

− yi f ( xi )

(1) 中的不等式部分可由以下事实得到: e ∑ (log1 / β )h (x ) 。

≥1

当, y i ≠ H ( xi ) 。 (1)中的等式部分可以由 Dt 的递归定义展开而得到。

et =

1 ∑ Dt (i )(1 − ht (xi , yi ) + ht (xi , y )) 2 i

et 1 − et

(1+ ht ( xi , yi )− ht ( xi , y )) Dt (i ) 1 β t2 Zt

4. 令: β t =

5. 更新: Dt +1 (i ) =

其中, Z t 为归一化常数,使得 Dt +1 为一概率分布 输出:

基于 Boosting 的多分类器融合算法*

林磊 ,王晓龙 ,刘家锋

1 1 1

(1.哈尔滨工业大学计算机科学与技术学院,哈尔滨 150001)

摘要: 在模式识别应用的各个领域, 多分类器融合被认为是提高系统性能的一种新方 法。 本文应用了一种基于 boosting 的融合方法,此融合方法经联机手写体汉字识别系统的测 试,并且同其它融合方法比较,其效果显著。 关键字: AdaBoost 算法;融合;手写体汉字识别

ht : X × Y → [0,1] ,然后,Байду номын сангаас量减小其错误率( et ): et = Pi ~ Dt [ht ( xi ) ≠ y i ] 。一旦确定了

同时, 权值 Dt 应用图 1 中的规则更新。 弱假设, Adaboost 算法给 ht 确定一个权值 log 1 / β t 。 最终的输出 H 由 T 个弱假设的加权投票得到。 AdaBoost 算法的基本理论特性是:它具有减小训练错误的能力。 文献[6]和[9]给出了算 法输出错误由以下不等式界定:

~

会逐渐地增大。所以,算法循环 m

次数不能过大,否则系统的性能会下降。因此,只有循环次数在合适的范围内时,系统的性 能才能达到最佳。

4

75 72 69 66 63 60

识别正确率

%

1

5

10

15

20

25

30

35

40

45

50

循环次数

55

60

图 3 识别正确率曲线 从表 2 中可以注意到,应用 Adaboost 算法得到的结果较传统加权方法高出 4.75%,较 性能最好的单个分类器高出 8.19%, 由此看到 Adaboost 算法-优化系统性能的效果十分显著。

2 Adaboost 算法

通常, 手写体汉字识别系统分类器的输出不仅仅是一个类别, 而且包含类的后验概率的 信息,即输出的各个类的可信度。而此类问题适用于 AdaBoost 算法的另一个版本,即所谓 的 AdaBoost. M2 算法[6],算法的伪代码如图 1 所示。 AdaBoost 算法的输入训练集为 ( x1 , y1 ), K , ( x m , y m ) ,其中每个 xi 属于输入特征集 X , 每个类别 y i 属于类别集合 Y = { 1, K , k }。 AdaBoost 算法的主要思想是,在一系列的循环

t = 1,K, T 中,反复地调用弱学习算法,同时对输入的训练集保持一系列的权值分布。此权

值对于第 i 个训练例子,在第 t 次循环中的值定义为 Dt (i ) 。初始状态,所有权值都相等,但 是,每循环一次,便增加不正确分类例子的权值,强迫弱学习算法将注意力集中到训练集中 较 难 分 类 的 例 子 上 。 首 先 , 弱 学 习 算 法 的 任 务 是 发 现 适 合 权 值 Dt 的 弱 假 设 :

e system = P[H ( x ) ≠ y ] + O Td m

~

(3)

其中, e system 为系统最大错误, P[H ( x ) ≠ y ] 为由训练样本产生的错误,m 为样本的个 数,d 为弱假设空间的 VC 维数(VC 维数是假设空间复杂性的一种标准的度量[11]) ,T 为 算法循环次数。 随着算法循环次数的增加,等式(3)中的 P[H ( x ) ≠ y ] 一项,如同本文第一部分分析 的那样会逐渐地减小,而等式(3)中的第二项 O Td

Table 1. 单个分类器性能 分类器 Recogn. (首选)

e1 e2

52.35%

62.80%

e3

Table 2. 两种方法结果比较 输出

64.09%

Recogn. (首选)

E1 E2

72.28% 67.53%

5 结论

本文研究了基于 AdaBoost 算法的多分类器融合方法,并且应用于优化手写体汉字识别 系统,实验结果表明经过 AdaBoost 算法优化的系统性能不但优于单个分类器的性能,同时 也优于传统加权融合方法。实际上,AdaBoost 算法还有许多优点,例如,快速、简单、易 于编程,除了循环次数 T 需要调整之外,不存在其它参数。同时,我们对于要优化的弱学习 算法的性能无需深入了解。

Abstract: In various application areas of pattern recognition, combining multiple classifiers is regarded as a new method for achieving a substantial gain in performance of system. This paper presents a boosting method for combining multiple classifiers. This combination method is experimentally tested on online handwritten Chinese character recognition system and the results compare with other combining method. Their effectiveness is considered. Key words: AdaBoost algorithm; Combination; handwritten Chinese character recognition