加权最小二乘法(WLS)

加权最小二乘法详细推导

加权最小二乘法(Weighted Least Squares,WLS)是一种用于线性回归模型的优化方法,它给予不同的数据点不同的权重,以便更好地拟合模型并减少误差。

假设我们有一个线性回归模型y = Xβ,其中y 是目标变量,X 是特征矩阵,β是要估计的参数。

我们还有一个与X 大小相同的权重矩阵W。

加权最小二乘法的目标是最小化损失函数:J(β) = ∑w_i(y_i - x_iβ)^2,其中i 是数据点的索引,w_i 是与第i 个数据点相关的权重。

对J(β) 求关于β的偏导数,并令其为0,得到:

∂J(β)/∂β= 0 = 2∑w_iy_i - 2x_iβ

由于这是一个线性方程,我们可以将其表示为矩阵形式:

X^TWXβ= X^TWy

其中,X^T 是X 的转置,W 是权重矩阵,y 是目标变量。

通过解这个方程,我们可以得到β的估计值:

β= (X^TWX)^(-1)X^TWy

这就是加权最小二乘法的推导。

这种方法考虑了每个数据点的权重,因此可以更好地处理不同大小和分布的数据点。

加权最小二乘法的基本思想即大残差平方

加权最小二乘法的基本思想即大残

差平方

和最小法

加权最小二乘法(Weighted Least Squares Method, WLSM)是统计学中进行参数估计的一种重要方法。

它的基本思想是使用极小化大残差平方和最小法(Large Residual Sum of Squares)对参数进行估计或拟合。

其中,每个观测值都有一个不同的权重,即观测值的可信度,权重可以是固定的,也可以是可变的。

该方法在处理有限样本数据时,特别适用于满足正态分布的数据。

WLSM的基本步骤如下:

(1)确定权重w:可以手动指定,也可以从数据分布中自动求出。

(2)根据观测值和权重,构造误差平方和函数S

(x1,x2,…,xn),其中x1,x2,…,xn为待估计参数。

(3)求取S(x1,x2,…,xn)在各个参数上的偏导数,当这些偏导数全为0时,即为参数的最小值。

(4)使用梯度下降法等数值方法求解上述参数的最小值。

加权最小二乘法 拟合多项式 matlab

加权最小二乘法(Weighted Least Squares, WLS)是一种经典的拟合方法,用于处理数据中的噪声和异常值。

在拟合多项式的过程中,加权最小二乘法能够更好地适应不同的数据权重,从而得到更准确、更可靠的拟合结果。

结合Matlab强大的数学计算和可视化工具,我们可以更方便、更高效地实现加权最小二乘法拟合多项式。

一、加权最小二乘法的基本原理1. 加权最小二乘法的概念在拟合多项式过程中,常常会遇到数据噪声较大或者部分数据异常值较大的情况。

此时,普通的最小二乘法可能无法有效地拟合数据,因此需要引入加权最小二乘法。

加权最小二乘法通过为每个数据点赋予不同的权重,对异常值和噪声进行更有效的处理。

2. 加权最小二乘法的数学原理加权最小二乘法的数学原理主要是在最小化误差的基础上,引入权重矩阵来调整不同数据点的重要性。

通过优化残差的加权和,可以得到适应不同权重的拟合结果。

二、Matlab中的加权最小二乘法1. Matlab工具Matlab提供了丰富的数学计算和拟合工具,通过内置的polyfit函数和curve fitting工具箱,可以方便地实现加权最小二乘法拟合多项式。

Matlab还提供了丰富的可视化工具,可以直观展示加权最小二乘法的拟合效果。

2. 加权最小二乘法的实现在Matlab中,可以通过指定权重向量来调用polyfit函数,实现加权最小二乘法拟合多项式。

利用Matlab内置的拟合评估工具,可以对拟合效果进行全面评估和优化。

三、实例分析以实际数据为例,我们可以在Matlab环境下进行加权最小二乘法的拟合多项式实例分析。

通过构建数据模型、指定权重、调用polyfit函数并结合可视化工具,可以全面了解加权最小二乘法在拟合多项式中的应用效果。

四、个人观点和总结在实际工程和科学研究中,加权最小二乘法拟合多项式是一种非常有效和重要的数据处理方法。

结合Matlab强大的数学计算和可视化工具,可以更方便、更高效地实现加权最小二乘法拟合多项式。

加权最小二乘

异方差的类型

• • 同方差:i2 = 常数 f(Xi) 异方差: i2 = f(Xi)(注:方差与x有关)

异方差一般可归结为三种类型: (1)单调递增型: i2随X的增大而增大 (2)单调递减型: i2随X的增大而减小 (3)复 杂 型: i2与X的变化呈复杂形式

异方差产生原因

1、模型中缺少某些解释变量(即自变量);从而干 扰项产生系统模式。 2、样本数据观测误差;随着数据采集技术的改进, 干扰项的方差可能减少。 3、模型设置不正确。 4、经济结构发生了变化,但模型参数没作相应调整 。比如按照边错边改学习模型,人们在学习的过 程中,其行为误差随时间而减少。 5、异常值的出现也会产生。异常值可以通过查看图 形或检查原始数据找到。

• 标准的线性回归模型中,假设所研究总体中方差恒定, 即因变量的变异不随其自身预测值或其他自变量值得变 化而变动。 • 但在有的研究问题中,这一假设可能被违反,可能是因 变量的变异随其自身数值增大而增大,也可能是随其他 变量值而改变。例如:以地区为观察单位调查某种疾病 的发生率,由于率的标准差本身就和样本量有关,显然 该地区的人数越多,所得到的发生率就会越稳定,即变 异度越低。在这些情况下,如果采用普通最小二乘法( OLS)来分析,可能产生偏差,如果能够根据变异的大 小对相应数据给予不同的权重,在拟合时对变异较小的 测量值赋予较大权重,则能够提高模型的精度。

实际问题的异方差性

• 在实际经济问题中,随机扰动项往往是异方差的,但主要在截 面数据分析中出现。

加权最小二乘法的基本思想

• 加权最小二乘法是对原模型加权,使之变成一个新的不存在异方 差性的的概念

在讲到加权最小二乘法的时候需要引入一个重要的概 念——异方差。那么什么是异方差呢? 对于模型

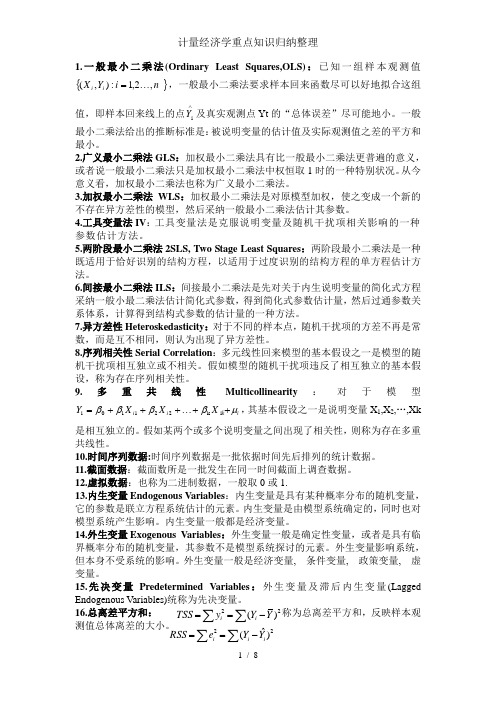

计量经济学重点知识归纳整理

1.一般最小二乘法(Ordinary Least Squares,OLS):已知一组样本观测值{}n i Y X i i ,2,1:),(⋯=,一般最小二乘法要求样本回来函数尽可以好地拟合这组值,即样本回来线上的点∧i Y 及真实观测点Yt 的“总体误差”尽可能地小。

一般最小二乘法给出的推断标准是:被说明变量的估计值及实际观测值之差的平方和最小。

2.广义最小二乘法GLS :加权最小二乘法具有比一般最小二乘法更普遍的意义,或者说一般最小二乘法只是加权最小二乘法中权恒取1时的一种特别状况。

从今意义看,加权最小二乘法也称为广义最小二乘法。

3.加权最小二乘法WLS :加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采纳一般最小二乘法估计其参数。

4.工具变量法IV :工具变量法是克服说明变量及随机干扰项相关影响的一种参数估计方法。

5.两阶段最小二乘法2SLS, Two Stage Least Squares :两阶段最小二乘法是一种既适用于恰好识别的结构方程,以适用于过度识别的结构方程的单方程估计方法。

6.间接最小二乘法ILS :间接最小二乘法是先对关于内生说明变量的简化式方程采纳一般小最二乘法估计简化式参数,得到简化式参数估计量,然后过通参数关系体系,计算得到结构式参数的估计量的一种方法。

7.异方差性Heteroskedasticity :对于不同的样本点,随机干扰项的方差不再是常数,而是互不相同,则认为出现了异方差性。

8.序列相关性Serial Correlation :多元线性回来模型的基本假设之一是模型的随机干扰项相互独立或不相关。

假如模型的随机干扰项违反了相互独立的基本假设,称为存在序列相关性。

9.多重共线性Multicollinearity :对于模型i k i i X X X Y μββββ++⋯+++=i k 22110i ,其基本假设之一是说明变量X 1,X 2,…,Xk 是相互独立的。

计量经济学gls和wls方法

计量经济学gls和wls方法

计量经济学中的GLS和WLS是两种重要的回归分析方法,用于处理模型中的异方差性和序列相关性问题。

广义最小二乘法(GLS)通过对原始模型的变换,解释了误差方差的已知结构(异方差性)、误差中的序列相关形式或同时解释二者的估计量。

它通过一个线性变换来处理异方差性和序列相关性。

在GLS中,被解释变量、解释变量和干扰项都进行相同的线性变换,使得新的干扰项满足球形假设,从而使得高斯马尔可夫定理重新成立,即对参数的估计重新变为最佳线性无偏估计。

加权最小二乘法(WLS)是GLS的一个特例,用于处理异方差性。

在WLS 中,每个残差的平方都用一个等于误差的(估计的)方差的倒数作为权数,从而对异方差性进行调整。

当误差的方差矩阵V(X)为对角矩阵时,WLS成立。

WLS的线性变换也是一个对角矩阵,使得最小化新的残差和过程相当于最小化加权后的旧的残差和过程。

以上内容仅供参考,如需更多信息,建议查阅计量经济学相关的专业书籍或咨询该领域的专家。

异方差加权最小二乘法修正(精)

第五章 案例分析一、问题的提出和模型设定根据本章引子提出的问题,为了给制定医疗机构的规划提供依据,分析比较医疗机构与人口数量的关系,建立卫生医疗机构数与人口数的回归模型。

假定医疗机构数与人口数之间满足线性约束,则理论模型设定为i i i u X Y ++=21ββ (5.31)其中i Y 表示卫生医疗机构数,i X 表示人口数。

由2001年《四川统计年鉴》得到如下数据。

表5.1 四川省2000年各地区医疗机构数与人口数地区人口数(万人) X医疗机构数(个)Y地区人口数(万人) X医疗机构数(个)Y成都 1013.3 6304 眉山 339.9 827 自贡 315 911 宜宾 508.5 1530 攀枝花 103 934 广安 438.6 1589 泸州 463.7 1297 达州 620.1 2403 德阳 379.3 1085 雅安 149.8 866 绵阳 518.4 1616 巴中 346.7 1223 广元 302.6 1021 资阳 488.4 1361 遂宁 371 1375 阿坝 82.9 536 内江 419.9 1212 甘孜 88.9 594 乐山345.91132 凉山 402.41471 南充 709.24064二、参数估计进入EViews 软件包,确定时间范围;编辑输入数据;选择估计方程菜单,估计样本回归函数如下表5.2估计结果为56.69,2665.508..,7855.0)3403.8()9311.1(3735.50548.563ˆ2===-+-=F e s R X Y ii (5.32) 括号内为t 统计量值。

三、检验模型的异方差本例用的是四川省2000年各地市州的医疗机构数和人口数,由于地区之间存在的不同人口数,因此,对各种医疗机构的设置数量会存在不同的需求,这种差异使得模型很容易产生异方差,从而影响模型的估计和运用。

为此,必须对该模型是否存在异方差进行检验。

(完整版)计量经济学重点知识归纳整理

1.普通最小二乘法(Ordinary Least Squares,OLS):已知一组样本观测值{}n i Y X i i ,2,1:),(⋯=,普通最小二乘法要求样本回归函数尽可以好地拟合这组值,即样本回归线上的点∧i Y 与真实观测点Yt 的“总体误差”尽可能地小。

普通最小二乘法给出的判断标准是:被解释变量的估计值与实际观测值之差的平方和最小。

2.广义最小二乘法GLS :加权最小二乘法具有比普通最小二乘法更普遍的意义,或者说普通最小二乘法只是加权最小二乘法中权恒取1时的一种特殊情况。

从此意义看,加权最小二乘法也称为广义最小二乘法。

3.加权最小二乘法WLS :加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采用普通最小二乘法估计其参数。

4.工具变量法IV :工具变量法是克服解释变量与随机干扰项相关影响的一种参数估计方法。

5.两阶段最小二乘法2SLS, Two Stage Least Squares :两阶段最小二乘法是一种既适用于恰好识别的结构方程,以适用于过度识别的结构方程的单方程估计方法。

6.间接最小二乘法ILS :间接最小二乘法是先对关于内生解释变量的简化式方程采用普通小最二乘法估计简化式参数,得到简化式参数估计量,然后过通参数关系体系,计算得到结构式参数的估计量的一种方法。

7.异方差性Heteroskedasticity :对于不同的样本点,随机干扰项的方差不再是常数,而是互不相同,则认为出现了异方差性。

8.序列相关性Serial Correlation :多元线性回归模型的基本假设之一是模型的随机干扰项相互独立或不相关。

如果模型的随机干扰项违背了相互独立的基本假设,称为存在序列相关性。

9.多重共线性Multicollinearity :对于模型i k i i X X X Y μββββ++⋯+++=i k 22110i ,其基本假设之一是解释变量X 1,X 2,…,Xk 是相互独立的。

最小二乘法赋权

最小二乘法赋权

什么是加权最小二乘法赋权,它的基本思想是什么

加权最小二乘法赋权是对原模型进行加权,使之成为一个新的不存在异方差性的模型,然后采用普通最小二乘法估计其参数的一种数学优化技术。

线性回归的假设条件之一为方差齐性,若不满足方差齐性(即因变量的变异程度会随着自身的预测值或者其它自变量的变化而变化)这个假设条件时,就需要用加权最小二乘法(WLS)来进行模型估计。

加权最小二乘法(WLS)会根据变异程度的大小赋予不同的权重,使其加权后回归直线的残差平方和最小,从而保证了模型有更好的预测价值。

扩展资料

在多重线性回归中,我们采用的是普通最小二乘法(OLS)估计参数,对模型中每个观测点是同等看待的。

但是在有些研究问题中,例如调查某种疾病的发病率,以地区为观测单位,地区的人数越多,得到的发病率就越稳定,因变量的变异程度就越小,而地区人数越少,得到的发病率就越大。

在这种情况下,因变量的变异程度会随着自身数值或者其他变量的变化而变化,从而不满足残差方差齐性的条件。

为了解决这个问题,我们采用加权最小二乘法(WLS)的方法来估计模型参数,即在模型拟合时,根据数据变异程度的大小赋予不用的权重,

对于变异程度较小,测量更准确的数据赋予较大的权重,对于变异程度较大,测量不稳定的数据则赋予较小的权重,从而使加权后回归直线的残差平方和最小,确保模型有更好的预测价值。

一种改进的加权最小二乘无网格法

一种改进的加权最小二乘无网格法加权最小二乘无网格法(WLSM)是一种用于求解最小二乘问题的数值方法,它可以用于处理多种不同类型的数据。

本文介绍一种改进的加权最小二乘无网格法,该方法在原有方法的基础上进行了一些改进,使其在求解最小二乘问题时表现更加稳定和高效。

在传统的加权最小二乘无网格法中,通常会采用网格法来对数据进行插值,然后再利用最小二乘方法对插值之后的数据进行拟合。

传统的网格法在处理一些特殊数据时可能会出现一些问题,例如在数据密度不均匀或者数据量很大的情况下,网格法可能会导致插值的精度不够高,从而影响最小二乘问题的求解结果。

为了解决这些问题,我们提出了一种改进的加权最小二乘无网格法,其主要改进如下:1. 自适应插值方法传统的网格法在插值时通常需要事先确定一个网格大小,然而在面对一些特殊数据时,事先确定的网格大小可能并不适用。

我们采用了一种自适应插值方法,在插值过程中根据数据的分布情况自动调整插值步长,以确保插值的精度足够高。

这样一来,即使是面对数据不均匀或者数据量很大的情况,我们也可以保证插值的精度和稳定性。

2. 数据拟合的加权处理在传统的加权最小二乘无网格法中,通常会采用常量权重来对数据进行加权处理,然而在实际应用中,我们往往面对各种各样不同性质的数据,其重要性也是不同的。

我们提出了一种根据数据特点进行自适应加权处理的方法,以确保在进行数据拟合时对重要的数据给予更高的权重,从而提高拟合的精度。

3. 多尺度优化算法为了提高最小二乘问题的求解效率,我们引入了一种多尺度优化算法,该算法可以在不同尺度上进行拟合,然后再通过多尺度之间的交叉验证来选择最佳的拟合结果。

这样一来,即使是面对数据量很大或者求解问题的复杂度很高的情况,我们也可以在较短的时间内获得较为准确的拟合结果。

通过以上的改进,我们的改进的加权最小二乘无网格法在求解最小二乘问题时表现更加稳定和高效。

我们通过实际数据的测试表明,我们的方法在面对各种不同的数据类型和求解问题时都可以表现良好,具有较高的适用性和实用性。

简述用加权最小二乘法消除多元线性回归中异方差性的思想与方法

简述用加权最小二乘法消除多元线性回归中异方差性的思

想与方法

多元线性回归是一种常用的统计分析方法,它的目标是根据观察到的数据,通过拟合一个多元回归模型,并用这个模型来预测和控制变量之间的关系。

但是,由于各种客观因素,多元线性回归在真实数据中往往会遇到异方差性问题。

而加权最小二乘法(WLS)正是为了解决这一问题而开发出来的。

加权最小二乘法是一种基于最小二乘估计的修正方法,它的核心思想是为每个观测数据加以不同的权重,使得拟合的模型更加接近真实数据的分布,同时有效地消除多元线性回归中的异方差性。

在使用WLS预测和控制变量之间关系时,首先要定义残差的权重函数,比如采用标准的平方误差权重的形式。

然后,接下来就是构建最小二乘估计模型,即最小二乘模型所求解的参数为残差的加权和最小。

在此过程中,应该注意到,权重要满足正定条件,这是因为要确保样本容量最大,以及只考虑误差的有效性而不影响模型的拟合。

此外,根据研究的具体目的,可以选择不同的权重函数和参数和迭代模型,以更好地拟合多元线性回归模型。

总之,加权最小二乘法是一种有效的消除多元线性回归中异方差性的方法,它可以有效地提高预测和控制变量之间关系的准确性。

它通过调整残差的权重,将差异缩小到最小,以实现更精确的预测和控制结果。

同时,在模型拟合过程中,还可以根据具体目的来选择不同的权重函数以及迭代模型,从而有效地减少少量异方差的影响。

因此,加权最小二乘法消除多元线性回归中异方差性是一项重要而有效的工作,它可以提高多元线性回归模型的准确性和有效性,同时为统计分析提供了有用的参考。

(完整版)加权最小二乘法(WLS)

加权最小二乘法(WLS)如果模型被检验证明存在异方差性,则需要发展新的方法估计模型,最常用的方法是加权最小二乘法。

加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采用普通最小二乘法估计其参数。

下面先看一个例子。

原模型:+++=i i i x x y 22110βββ,i ki k u x ++βn i ,,2,1 =如果在检验过程中已经知道:2222)()()(u i i i i x f u E u D σσ=== , n i ,,2,1 = 即随机误差项的方差与解释变量2x 之间存在相关性,模型存在异方差。

那么可以用)(2x f 去除原模型,使之变成如下形式的新模型:+++=i i i i i i i x x f x x f x f y x f 222121202)(1)(1)(1)(1βββi i ki i k u x f x x f )(1)(122++βn i ,,2,1 =在该模型中,存在 222222)()(1))(1())(1(u i i i i i i u E x f u x f E u x f D σ=== (4.2.1)即同方差性。

于是可以用普通最小二乘法估计其参数,得到关于参数βββ01,,, k 的无偏的、有效的估计量。

这就是加权最小二乘法,在这里权就是)(12i x f 。

一般情况下,对于模型Y X =+B N (4.2.2)若存在:W2)(),(0)(uE Cov E σ=N 'N =N N =NW =⎡⎣⎢⎢⎢⎢⎤⎦⎥⎥⎥⎥w w w n 12(4.2.3) 则原模型存在异方差性。

设TDDW =⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=n w w w D21, ⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=----112111n w w w D用D 1-左乘(4.2.2)两边,得到一个新的模型:D Y D X D ---=+111B N (4.2.4) 即Y X ***=+B N该模型具有同方差性。

加权最小二乘法例题详解

加权最小二乘法例题详解加权最小二乘法 (WLS) 是一种常见的线性回归模型调整方法,用于解决异方差问题。

在 WLS 中,我们利用加权残差平方和 (SSR) 作为损失函数,通过最小化该函数来寻找最优的回归系数。

具体来说,我们可以用以下公式表示 WLS:$$hat{mathbf{b}} = argmin_{mathbf{b}}frac{1}{n}sum_{i=1}^{n}left(mathbf{y}_{i}-mathbf{X}_{i}math bf{b}ight)^{2}+lambdamathbf{b}^{T}mathbf{Wb}$$其中,$mathbf{y}$是观测值,$mathbf{X}$是特征矩阵,$mathbf{b}$是回归系数向量,$lambda$是平衡系数,$mathbf{W}$是权重矩阵,它确定了每个特征对回归系数的影响程度。

为了求解上述最小二乘问题,我们可以使用矩阵分解的方法,将权重矩阵$mathbf{W}$分解为$mathbf{W}=mathbf{P}mathbf{Q}^{T}$,其中$mathbf{P}$和$mathbf{Q}$是对角矩阵,且$mathbf{P}$的对角线上的元素是特征矩阵$mathbf{X}$的权重,$mathbf{Q}$的对角线上的元素是观测值$mathbf{y}$的权重。

因此,我们可以将 WLS 公式改写为:$$hat{mathbf{b}} = argmin_{mathbf{b}}frac{1}{n}sum_{i=1}^{n}left(mathbf{y}_{i}-mathbf{X}_{i}math bf{b}ight)^{2}+lambdamathbf{b}^{T}mathbf{P}mathbf{Q}^{T}mathbf{b }$$此时,我们可以使用矩阵分解的方法求解最优的回归系数向量$hat{mathbf{b}}$。

具体来说,我们可以将$mathbf{P}mathbf{Q}^{T}$分解为$mathbf{P}=mathbf{D}-mathbf{N}$,其中$mathbf{D}$是对角矩阵,$mathbf{N}$是非对角矩阵,$mathbf{N}$的元素是$mathbf{X}$的特征值,$mathbf{D}$的元素是$mathbf{X}$的特征值对应的对角线上的元素。

计量经济学模型名词解释

计量经济学模型名词解释计量经济学是一门运用数学、统计学和经济学理论研究经济现象的学科。

在计量经济学中,模型是用来描述经济关系和预测经济变量的数学表达式。

以下是一些计量经济学模型中的名词解释:1. 普通最小二乘法(OLS):是一种通过最小化误差的平方和来寻找数据最佳函数匹配的统计方法。

2. 广义最小二乘法(GLS):是一种针对原始模型进行变换,以解释误差方差的方差已知结构(异方差性)、误差中的序列相关形式或同时解释二者的估计量。

3. 加权最小二乘法(WLS):通过使用对某种已知形式的异方差进行调整的估计量,其中每个残差的平方都用一个等于误差的(估计的)方差的倒数作为权数。

4. 解释平方和(SSE):在多元回归模型中,度量拟合值的样本变异。

5. 残差平方和(SSR):实际值与估计值之差的平方的总和,即误差项平方的总和。

6. 总平方和(SST):因变量相对于其样本均值的总样本变异。

7. 高斯马尔科夫假定(横截面数据):包括MLR1-MLR5五个假设,其中MLR1-4表示无偏性,MLR1-5表示得到的估计量是BLUE(最优线性无偏估计量)。

8. 高斯马尔科夫假定(时间序列数据):包括TS.1-TS.5五个假设,涉及线性性、无序列相关等条件。

9. 标准差:一次抽样中个体分数间的离散程度,反映了个体分数对样本均值的代表性。

10. 标准误:多次抽样中样本均值间的离散程度,反映了样本均值对总体均值的代表性。

11. 回归分析:通过建立变量之间的关系模型,对计量经济学模型参数进行估计、显著性检验及分析评价的过程。

12. 异方差:误差项方差的非恒定性质,可能导致参数估计量失效。

13. 多重共线性:自变量之间存在较高线性相关性的情况,可能导致参数估计量失效或经济含义不合理。

14. 随机解释变量:在总体回归函数中引入随机干扰项,用以代表未知的影响因素、残缺证据、众多细小影响因素、数据观测误差和模型设定误差等。

15. 一元线性回归模型:包含一个解释变量和一个被解释变量的简单线性关系模型,其基本假设包括回归模型正确设定、解释变量与误差项相互独立等。

加权最小二乘法

加权最小二乘法

加权最小二乘法(weighted least squares, WLS)是一种线性回归的方法,用于处理具有不同观测误差方差的数据。

在普通最小二乘法(ordinary least squares, OLS)中,假设所有的观测误差方差是相等的。

但在实际应用中,有一

些变量可能有更大的观测误差,或者某些观测点可能有更

大的误差。

WLS通过对不同观测点赋予不同的权重来解决

这个问题,权重的大小与观测误差的方差成反比。

加权最小二乘法的目标是最小化加权残差的平方和,即最

小化:

\\[S = \\sum_{i=1}^{n} w_i(y_i - f(x_i))^2\\]

其中,$n$为观测点数量,$w_i$为第$i$个观测点的权重,$y_i$为第$i$个观测点的观测值,$f(x_i)$为模型对第$i$个观测点的预测值。

为了最小化$S$,可以通过求解加权最小二乘问题的正规方程来获得参数的估计值,即求解:

\\[(X^TWX)\\hat{\\beta} = X^TWy\\]

其中,$X$为设计矩阵,包含自变量的观测值,

$\\hat{\\beta}$为参数的估计值,$W$为权重矩阵,对角线上的元素为权重值,其他元素为零。

通过求解正规方程,可以获得参数的估计值

$\\hat{\\beta}$,进而用于预测新的观测值或进行模型的推断分析。

需要注意的是,加权最小二乘法的权重选择需要根据具体的实际情况来确定,通常可以通过观察观测数据的方差不均匀性、残差分析等方法来确定权重值。

异方差加权最小二乘法

异方差加权最小二乘法

异方差加权最小二乘法(Heteroscedasticity-robust weighted least squares,HRWLS)是一种用来解决异方差问题的最小二乘法。

在传统最小二乘法中,假设所有数据点的误差方差相等,但实际上往往存在不同数据点之间误差方差差异较大的情况,即异方差。

这种情况下,普通最小二乘法的结果可能不准确,需要使用异方差加权最小二乘法。

HRWLS方法采用加权的方式,对不同数据点赋予不同的权重,即根据每个数据点的误差方差来调整其权重。

具体操作方法是,根据模型误差的方差来计算每个数据点的方差权重,再将此权重用于加权最小二乘法中的系数估计。

与传统最小二乘法相比,HRWLS方法考虑了不同数据点之间误差方差的差异性,因此可以提高模型估计的准确性。

异方差的修正

1.

Var

(ui

)

2为已知

i

以一元线性回归模型为例:

Yi 0 1X i ui

经检验ui存在异方差,且Var

(ui

)

2为已知

i

在模型两端同时除以

得

i

Yi

i

0

1

i

1

Xi

i

ui

i

令

2.

Var

(ui

)

2未知

i实际上随机误差项旳方差是未 Nhomakorabea旳,假如模型具

有异方差性,在用WLS法处理时,需要先用戈里瑟 检验等措施找出异方差旳形式,然后再用WLS法估 计参数。

2常见的有以下几种形式:

i

(1)

2 i

X

2 i

( 0且为常数)

设模型为

Yi 0 1 X i ui

在模型两端同时除以X i得

第四节 异方差旳修正

• 加权最小二乘法 • 加权最小二乘法旳矩阵表达

一、加权最小二乘法

假如模型被检验出存在异方差性,则需要发展新 旳措施估计模型,最常用旳措施是加权最小二乘法 (Weighted Least Squares, WLS)。

加权最小二乘法是对原模型加权,使之变成一种 新旳不存在异方差性旳模型,然后采用OLS估计其 参数。

一个加权的残差平方和,权数为wi,所以称为加权 最小二乘法(Weighted Least Squares,简称WLS)。

由此得到的估计量ˆ0*、ˆ1*称为加权最小二乘估计量。

利用微积分中求极值的原理,分别求 ei*2关于ˆ0*和

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一般情况下,对于模型

Y X

若存在:

E( ) 0

2

Cov( , ) E( ) u W

W 1

W 2

W

(4.2.2)

(4.2.3)

W n

则原模型存在 异方差性。

设

即随机误差项的方差与解释变量

1 .f (X 2i ) ¥|

.f (X 2i )

1

.f(X 2i )

X 2i

k

X

ki

.f(X 2i )

.f (X 2i ) Ui

i

1,2,

,n

Si)

U i )

-^E(U i 2

) f (X 2i )

(4・即同方差性。

于是可以用普通最小二乘法估计其参数, 得到关于参数

0, 1 >

的无偏的、

有效的估计量。

这就是加权最小二乘法,在这里权就是 .f(X 2i )

加权最小二乘法(WLS)

如果模型被检验证明存在异方差性, 则需要发展新的方法估计模型, 最常用的方法是加

权最小二乘法。

加权最小二乘法是对原模型加权, 使之变成一个新的不存在异方差性的模型, 然后采用

普通最小二乘法估计其参数。

下面先看一个例子。

原模型:y

i

0 1X

1i

2X

2i

,

k X ki

U

i 1,2, ,n

如果在检验过程中已经知道:

D(U i ) E(U i 2

)

i 2

f (X>i ) J

,

i 1,2, ,n

X 2之间存在相关性,模型存在异方差。

那么可以用... f(X 2)

去除原模型,使之变成如下形式的

新模型:

在该模型中,存在

W DD T

W i

W n

D 1Y

D 1X

(4.2.4)

Cov(N , N )

E(

*T

)

E(D 1

T

)D

1

:WD 1T

1u 2

DD D

u

2

I

于是,可以用普通最小二乘法估计模型

T *

1

. ?WLS

(X X ) 1X Y

1

E(

i

T

(4.2.4),得到参数估计量为:

* T *

用D 1

左乘(422)两边,得到一个新的模型:

* X

该模型具有同方差性。

因为

T 1T

1 1 T 1T 1

(X T

D 1

D 1

X) 1X T

D 1

D "

T 1 1 T 1

(4

25)

(X W X) X W Y

这就是原模型(2.6.2)的加权最小二乘估计量,是无偏的、有效的估计量。

如何得到权矩阵 W ?仍然是对原模型首先采用普通最小二乘法,得到随机误差项的近 似估计量,以此构成权矩阵的估计量,即

2 0

2

W

e2

(4.2.6)

2

e n

当我们应用计量经济学软件包时,只要选择加权最小二乘法,将上述权矩阵输入,估 计过程即告完成。

这样,就引出了人们通常采用的经验方法, 即并不对原模型进行异方差性

检验,而是直接选择加权最小二乘法,

尤其是采用截面数据作样本时。

如果确实存在异方差

性,则被有效地消除了;如果不存在异方差性,则加权最小二乘法等价于普通最小二乘法。