最优化方法-一维搜索方法

最优化方法 第三章第二讲 一维搜索

第三次迭代

令 x1 0.538, f1 1.751,取 F3 x2 0.077 (1.462 0.077) 0.846, F4 f 2 1.870。

因为 f 1 f 2 ,所以新区间为 0.077,0.846。

第四次迭代

令 x 2 0.538, f 2 1.751,取 F1 x1 0.077 (0.846 0.077) 0.231, F3 则 f 1 1.822。

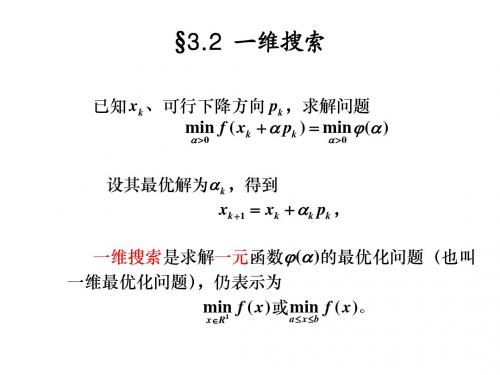

设其最优解为 k ,得到 xk 1 xk k pk ,

一维搜索是求解一元函数 ( ) 的最优化问题(也叫 一维最优化问题) ,仍表示为 min f ( x ) 或 min f ( x )。 1

xR

a xb

定义:若在 a, b内 f ( x )有唯一极小点 x* ,在 x* 的左边 f ( x )严格下降,在 x* 的右边 f ( x )严格上升, 则称 f ( x )在区间 a, b上是下单峰函数。

step 6 令 k k 1,若 k n 2,则转 step 5; 若 k n 2,则转 step 7。

step 7 若 f1 f 2 , 则令 b x2 ,x2 x1 ,f 2 f1 , 转 step 8; 若 f1 f 2 ,则令 a x1,转 step 8。 step 8 令 x1 x2 0.1(b a ) , f1 f ( x1 ) 1 * 若 f1 f 2 ,则 x (a x2 ), 2 1 * 若 f1 f 2 ,则 x ( x1 x2 ), 2 1 * 若 f1 f 2 ,则 x ( x1 b ) 。 2

ab step 3 若 b a ,则 x ,停。否则转 step 4。 2

最优化方法-一维搜索

按任务方式插入n个观测点后,剩下的搜索区间的长度不少于原初始长 度的1/ Fn

令缩短后的长度为S,有: S (b-a)/ Fn

• Fibonacci数列:

• =b- (b-a)=a+(1- )(b-a)

• =a+ (b-a)

•

• 2 0.618法算法

设

值

(t)是单谷函数,[ a

t

与精确极小点

t*

0的,最b大0 ]绝是对初误始差搜t索 区t * 间 , 要求精确极小点近似

记:a= a0,b= b0 , =0.618.

(1) =a+(1- )(b-a), 1 = ()

进退算法的基本步骤:

(((t01 2 3点 回)))及升:::,首若若t则0先[+tt任t00h0++选点,hh一t的点点n个函]的的初数就函 函始值是数 数点.一值 值个下 上t0搜降 升,索, ,初区继 则始间续 从步,前长t算进0h法点,,进停退直到止到到.t某0t个+0 -ht,h0点并点.计的算函数值

4= a4 +( F0 / F2

b4

)(

=

b4

3 /a4

=2.5 , 4= 3 = 1.625

)=0.75+1/2*1.75=1.625

这时,

=

4

,(因为已到k=3=n-2)

4

K=4, 因此

(5取5 =)a=0t5.41===410.,.6542((5=b,515).+5=6=02a.550,47b+6)50,.=1==2(1.b.05476)2255>=2(.55 )

3.3 一维搜索方法 (一维优化)

并令: h 2h

x3 x 2 h ,求 y3 f ( x3 )

重复上述步骤,直到函数值出现“高-低-高”为止。

4. 若在步骤2中,出现 y1 y 2 (图a虚线),则应作后退运算: 令:h h0 置换:x3 x1 y 3 y1 ; x1 x2 y1 y2 ;x2 x3 y2 y3 再令:h 2h

2 2 2 2 ( x2 x3 ) f1 ( x3 x12 ) f 2 ( x12 x2 ) f 3 b ( x1 x2 )( x2 x3 )( x3 x1 )

教材中,c的表达式缺-号

c

( x3 x2 ) x2 x3 f1 ( x1 x3 ) x1 x3 f 2 ( x2 x1 ) x1 x2 f 3 ( x1 x2 )( x2 x3 )( x3 x1 )

入口

x

(0),ε

X

(1)=x(0)-f/x(0)/f//x(0)

∣f/x(1)∣≤ε 或∣x(1)-x(0)∣≤ε ?

x

(*):=x (1)

x

(0):=x (1)

出口

4 3 2 例: 试用牛顿法求 f ( x) 1 x 2 x 2 x 7 x 8 4 3 值,已知探索区间为[a,b]=[3,4],ε=0.05。

4、牛顿法的特点 优点:收敛速度较快 缺点: 1)计算f’ 、f’’,计算工作量大。 2)用数值微分计算f’ 、f’’时,舍入误差会影响收敛速度。 3)x0与 x不能离太远,否则会发散或收敛于非极小点。 与0.618法比较: 0.618 法:1)收敛慢 2)对函数要求不严格 牛顿法正好相反。

5、牛顿法的框图

x3 x 2 h

3. 若 y 2 y1 ,应作前进运算(图a实线):

一维搜索-最优化方法

������2=0.538, ƒ2 = 1.751, ������1=������3+������������23 ������3 − ������3 =0.231

则ƒ2 = 1.822, ƒ1 > ƒ2,故得新区间为 [������4,������4]=[0.231, 0.846]

第五次迭代:

取������2=0.538, ƒ2 = 1.751, ������1=������2 − 0.1 ������4 − ������4 =0.477

问题3:按什么方式取点,求n次函数值之后多长的原始区间 缩短为最终区间长度为1?

• 1:Fibonacci数列:

• F0 =1 ;

F1 = 1 ;

F 迭代公式:Fn2 = Fn1 + n

•

;n 非负整数

n

0

1

2

3

4

5

6

7

…..

1

1

23ຫໍສະໝຸດ 5813 21 …..

Fn

设Ln表示试点个数为n,最终区间长度为1时的原始区间[a ,b] 的最大可能的长度,现在找出Ln的一个上界。设最初的两个 试点为x1,x2,且且x1< x2 。如果极小点位于[a , x1]内,则我们 至多还有n-2个试点,因此x1-a≤Ln-2;如果极小点位于[x1 , b] 内,则包括x2在内还可以有n-1个试点,因此b- x1≦Ln-1。

t (1中)任若设取[两 (a点t,1b)]t1<是<单(tt2谷2) ,函,则数那搜么(索t有) 区的:间一可个缩已短知为搜*[索a区, 间t2],.在[a,b]

( 2 ) 若 (t1 ) (t2 ),则搜索区间可缩短为[ t1,b]

最优化方法-一维搜索方法

% CopyRight@XiaBo % Date:2008.3.20

%% 定义搜索函数fun function f = fun(x) % 这里是一个简单的函数定义, 倘若在一个大型的优化计算中,这个函数一般是和第k 步的迭代点和下降方向有关的 % 是一个关于步长的函数 % x --- 待求步长值 f = x^2-x+2;

.

一维最优化问题:

极值点的必要条件:

f '( x ) 0

3

1. 下单峰函数 定义:设 f ( x ) 是区间 [ a , b ] 上的一元函数,x 是 f ( x ) 在 [ a , b ] 上的极小点,且对任意的 x1 , x2 [ a , b ], x1 x2 , 有 (a)当 x 2 x 时,f ( x1 ) f ( x2 ); (b)当 x1 x 时,f ( x1 ) f ( x2 ) .

cxbx的极小点解出及其的函数值最小的三个点中选择重新标记为左右两点31作业小结各种精确一维搜索算法3233距离最优解远的时候精度太大算法效率低只要求有充分下降即可这种类似与充分足够等描述词汇在与计算相关的描述中要特别在意因为这里的充分已经不再是理论上的要求这里的充分必须与可计算相关到底要多充分就是这里的非精确搜索的准测34armijo是使得下述不等式成立的最小非负整数下有界wolfe准则

2. 若 bk a k , 停止, 且

bk a k . 否则, 2 当 f ( k ) f ( k ) 时,转 3;当 f ( k ) f ( k ) 时,转 4. x

bk 1 bk ,

3. 令 a k 1 k ,

k 1 k ,

k 1 a k 1 0.618(bk 1 a k 1 ), 计算 f ( k 1 ), 令 k : k 1, 转 2。

《一维搜索方法》课件

1

原理

根据斐波那契数列生成黄金分割比例,用于确定搜索范围的分割点。

2

思路

根据斐波那契数列的值,确定左右指针在搜索范围内的位置,直到找到最接近目 标值的点。

3

优缺点

迭代次数逐渐趋近于黄金分割点,但对搜索范围要求较高。

黄金分割法搜索方法的原理和思路

1

原理

将搜索范围按黄金分割点分割,选择较小的一部分作为新的搜索范围。

2

思路

通过反复按黄金分割点计算和调整搜索范围,逐步逼近最接近目标值的点。

3

优缺点

迭代次数相对较少,但需要较复杂的计算公式。

三分搜索方法的原理和思路

1

原理

将搜索范围分割为三等份,并判断目标值位于左、中、右三个部分,逐步缩小搜索范 围。

2

思路

根据目标值与分割点的大小关系,决定下一步搜索的范围,直到找到最接近目标值的 点。

3

优缺点

对于非单调函数,能更快地找到目标值,但需要较多的判断。

多点搜索方法的原理和思路

1

原理

同时使用多个起始点进行搜索,通过不断比较找到最接近目标值的点。

2

思路

根据多个起始点的初始值和搜索步长,逐步调整并比较得到最优解。

3

优缺点

相比于单点搜索,能更准确地找到目标值,但需要同时处理多个起始点的迭代。

2

思路

从起始点开始,依次向右增加或向左减小搜索范围,直到找到最接近目标值的点。

3

优缺点

简单易懂,但需要较多的迭代次数。

二分搜索方法的原理和思路

1

原理

将搜索范围一分为二,并判断目标值位于左半部分还是右半部分,逐步缩小搜索 范围。

2

思路

一维搜索-最优化方法

止 ; 否则 , ������0 = ������1 ,转(2) 。

例题:用切线法求Ψ(t) =������2-5t+2 , 在定义域 t ∈ ( 0 , 10 ) 上的极小点 , 要求 ε = 0.2 。

切线法(Newton法)

设Ψ(t)是区间(a , b)上的二次可微的单谷函数,������∗ 是 Ψ(t) 在 (a , b)上的极小值点, ������������ 是 ������∗ 的一个近似点。 目标 函数Ψ(t) 的一阶导数为������ = Ψ’(t) ,过点 (������������, Ψ’(������������) ) 作导函数 Ψ’(t) 的图像的切线,则此切线的方程为

在实践工作中,应根据问题的具体特点以及工作条 件来选用相应的合适算法。不过,从以往的实践中 来看,0.618法和对分法使用的更多一些。

可望达到上述的最小值,

所以有 c-a = b-c , 即 c = 0.5(b-a)

对分法的步骤

设单谷函数 Ψ(t)存在导函数Ψ’(t),极小值点的初始搜索 区间为(a。,b。),要求极小值点的近似值 ������ҧ 与精确极小值 点 t* 的最大绝对误差 ������ − ������ ∗ ҧ 不超过 ε 。

⑴ 令 a=a。 , b=b。;

⑵ 令 c = 0.5(b-a),计算Ψ’(c);

⑶ 若 Ψ’(c)ຫໍສະໝຸດ <0 ,令 a=c , 转到⑷

若 Ψ’(c)>0 ,令 b=c ,转到⑷

一维搜索法

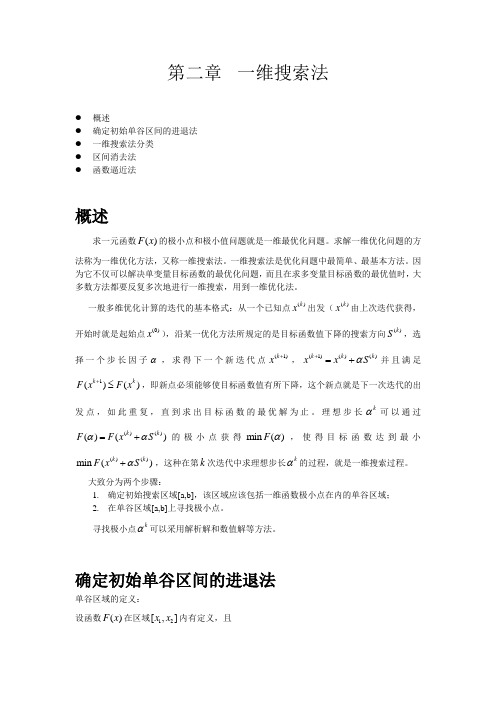

第二章 一维搜索法● 概述● 确定初始单谷区间的进退法 ● 一维搜索法分类 ● 区间消去法 ● 函数逼近法概述求一元函数()F x 的极小点和极小值问题就是一维最优化问题。

求解一维优化问题的方法称为一维优化方法,又称一维搜索法。

一维搜索法是优化问题中最简单、最基本方法。

因为它不仅可以解决单变量目标函数的最优化问题,而且在求多变量目标函数的最优值时,大多数方法都要反复多次地进行一维搜索,用到一维优化法。

一般多维优化计算的迭代的基本格式:从一个已知点()k x 出发(()k x由上次迭代获得,开始时就是起始点(0)x),沿某一优化方法所规定的是目标函数值下降的搜索方向()k S,选择一个步长因子α,求得下一个新迭代点(1)k x +,(1)()()k k k xx S α+=+并且满足1()()k k F x F x +≤,即新点必须能够使目标函数值有所下降,这个新点就是下一次迭代的出发点,如此重复,直到求出目标函数的最优解为止。

理想步长kα可以通过()()()()k k F F x S αα=+的极小点获得min ()F α,使得目标函数达到最小()()min ()k k F x S α+,这种在第k 次迭代中求理想步长k α的过程,就是一维搜索过程。

大致分为两个步骤:1. 确定初始搜索区域[a,b],该区域应该包括一维函数极小点在内的单谷区域;2. 在单谷区域[a,b]上寻找极小点。

寻找极小点kα可以采用解析解和数值解等方法。

确定初始单谷区间的进退法单谷区域的定义:设函数()F x 在区域12[,]x x 内有定义,且(1) 在区域12[,]x x 内存在极小值x *,既有min ()()F x F x *=,12[,]x x x ∈; (2) 对区域1[,]x x *上任意自变量x ,有()()F x F x x >+∆,0x ∆>;对区域2[,]x x *上任意自变量x ,有()()F x F x x <+∆,0x ∆>;则称12[,]x x 为函数()F x 的单谷区域。

一维搜索的最优方法(黄金分割法)-2023年学习资料

d.比较f,>f3-再作前进运算-h=2×2=4-0%=0C2=2,-f1=fx=0-2=03 4,-f2=fx2=-2-a3=a2+h=8f3=f=18-e.此时有∫>f2,f2<f3,故 =%,=2,b=即初始搜索-区间为[2,8].

§4一2黄金分割法(0.618法-一、-消去法的基本原理-基本思路:逐步缩小搜索区间,直至最小 存在的区-间达到允许的误差范围为止。-设一元函数fa的起始搜索区间为[a,b],a是-函数的极 点。-在搜索区间[a,b]内任取两点a1、2。且-a<a1<2<b,计算j1人fo2将fa1' -fa2进行比较,可能出现三种情况:

在极小点附近,函数呈现“大-小-大”-y=fx-X

二、确定搜索区间的进退法-基本思想-从一点出发,按一定的步长,试图确定出函数值-呈现出”高-低 高“的三个点。一个方向不成功,就-退回来沿相反方向搜索。-具体作法:-给出初始点au,初始步长 。>0,若pa。十h〈pao,-则下一步从新点。十,出发,加大步长向前搜索,直到目标-函数上升 停止。若pa4。十h,>pa,则下一步仍然从点-α出发,沿反方向搜索,直到目标函数上升就停止。 样就-可以得到一个搜索区间。

假定给定了搜索方向S,从点X出发沿S方向-进行搜索,要确定步长,使得-fX=fxtas<fX-oa=fxk+ask-即确定步长a,就是单变量函数oa的搜索问题。-称为一维搜索问题。-mi paw=fX+x的S

®在极小点附近,函数呈现“大-小-大”-y-一维搜索的思路-y=fx-1确定极小点a*所在的区 间[a,b],在此区间内,函数呈-现“大-小-大”变化趋势。-搜速区间。-X-2在[a,b]内 *-将区-间长度逐步缩短。-0.618法与二次插值法就是解-决第二个步骤的方法

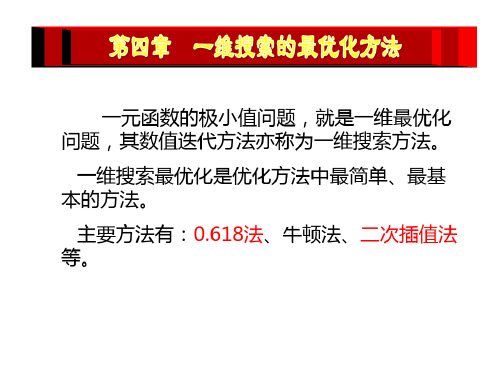

第三章一维优化方法

一维搜索方法概述

初始搜索区间的确定

一维搜索的最优化方法 1、格点法 2、黄金分割法 3、二次插值法 教学要求: 1、掌握初始搜索区间的确定方法 2、掌握黄金分割法 3、掌握二次插值法

第三章一维优化方法

一维搜索方法概述

在优化设计的迭代运算中,在搜索方

向s(k)上寻求最优步长 (k) 的方法称一维

(1- )/ = 故:1- = 2 2 + -1=0

由此可得: =0.618

黄金分割法可使相邻两次搜索区间都具 有相同的缩短率0.618。

x1=a+ 第0三.章3一8维优2化(方b法 -a)

第三章一维优化方法

黄金分割法

二、黄金分割法的搜索过程 1、给出初始搜索区间[a,b]及收敛精度。 2、按坐标点计算公式计算,并计算相应的函数值 3、缩短搜索区间 4、检查是否满足收敛条件 5、若满足收敛条件,则取最后两点的平均值作为极

区间满足收敛条件x m+1- x m+1 ,则最优解为x* xm ,

y* ym 若不能满足精度要求,把当前区间作为初始搜索区间, 重复上述步骤直至满足精度为止。

第三章一维优化方法

格点法

y1 新区间

a x1

ym-1 xm-1

ym xm

ym+

1

xm+1Biblioteka 格点法的区间缩短第三章一维优化方法

yn xn b

如图所示两种情况 1、若y2 <y1 ,则极小点位于x1点右方,

应继续前进搜索。 2、若y2>y1 ,则极小点位于x1点左方,

应反向后退搜索。

第三章一维优化方法

确定初始搜索区间的进退法

第三章一维优化方法

最优化理论与算法 第9章 一维搜索

2020/12/20

最优化理论

9

9. 一维搜索-试探法3

Th9.2.1 设f 是区间[a,b]上的单峰函数, x(1), x(2) [a,b]. 且x(1) x(2) ,则 (1)若f (x(1) ) f (x(2) ),则x [a, x(1) ], f (x) f (x(2) ) (2)若f (x(1) ) f (x(2) ),则x [x(2),b], f (x) f (x(1) ),

•9.2.1, 0.618法

Df 9.2.1设f 是定义在闭区间[a,b] 上的一元实函数, x是f 在[a,b]上 的极小点,且对x(1) , x(2) [a,b], x(1) x(2) ,有

当x(2) x时f (x(1) ) f (x(2) ) 当x x(1)时f (x(1) ) f (x(2) )

证 : 设序列{x(k)}和{d (k)}满足

(x(k ) , d (k ) ) (x, d ); y(k ) y, y(k ) M (x(k ) , d (k ) )

下证 y M (x, d ) , 注意到,对每个k,k 0 , 使

y(k ) x(k ) k d (k )

(9.1.5)

2020/12/20

最优化理论

11

9. 一维搜索-试探法5

0.618法的基本思想:通过取试探点使包含极小点的 区间(不确定区间)不断缩小,当区间长度小到一定 程度时,区间上各点的函数值均接近极小值,此时 该区间内任一点都可以作为极小点的近似值.

设 ( )是搜索区间[a1,b1]上的单峰函数.设在第k次迭代时 搜索区间为[ak ,bk ].取两个试探点k , k [ak ,bk ],k k . 计算(k )和(k ),根据Th1: (1),若(k ) (k ),令ak1 ak ,bk1 k , (2.1) (2),若(k ) (k ),令ak1 k ,bk1 bk , (2.2)

最优化设计:第5章 一维最优化方法

➢用切线代替弧线来逐渐逼近函数根值。

华南理工大学机械与汽车工程学院

19

华南理工大学机械与汽车工程学院

20

5.5 格点法

首先利用m 个等分点α1、 α2 、α3 、…、αm将目标函 数f (α) 的初始单峰搜索区间[a,b]分成m+1 个大小相 等的子区间,计算目标函数f (α) 在这m 个等分点的 函数值,并比较找出其中的最小值f (αk)

华南理工大学机械与汽车工程学院

21

那么在连续的三点αk −1 、αk 和αk +1处目标函数值呈 现“两头大、中间小”的情况,因此极小值点α*必

然位于区间[αk −1 , αk +1] 内,做置换 a = αk −1 , b = αk +1

若αk +1−αk -1 ≤ε ,则将αk 作为α*的近似解。否则,将 新区间等分,并重复上述步骤,直至区间长度缩至

第5章 一维最优化方法

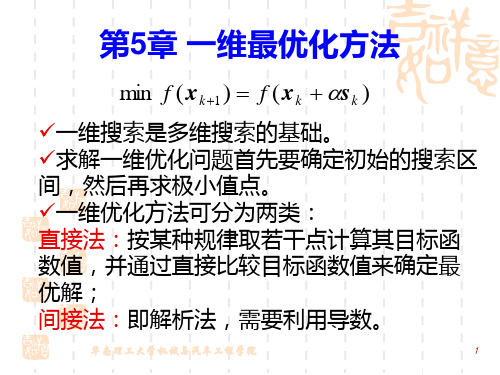

min f ( xk1 ) f ( xk sk )

✓一维搜索是多维搜索的基础。 ✓求解一维优化问题首先要确定初始的搜索区 间,然后再求极小值点。 ✓一维优化方法可分为两类: 直接法:按某种规律取若干点计算其目标函 数值,并通过直接比较目标函数值来确定最 优解; 间接法:即解析法,需要利用导数。

3

➢进退法一般分两步:一是初始探察确定进 退,二是前进或后退寻查。

华南理工大学机械与汽车前工程进学运院 算

4

华南理工大学机械与汽车工程学院

5

后退运算

华南理工大学机械与汽车工程学院6Biblioteka 华南理工大学机械与汽车工程学院

7

5.2 黄金分割法

➢黄金分割法是利用区间消去法的原理,通 过不断缩小单峰区间长度,即每次迭代都 消去一部分不含极小值点的区间,使搜索 区间不断缩小,从而逐渐逼近目标函数极 小值点的一种优化方法。

最优化理论与算法一维搜索

最优化理论与算法一维搜索一维是最优化问题求解中常用的一种算法。

在一维中,我们需要在给定的区间内寻找函数的最小值或最大值。

一维算法的基本思想是通过不断的迭代,在区间内不断缩小最优解的范围,最终找到最优解。

常用的一维算法包括黄金分割法、斐波那契法、插值法等。

黄金分割法是一种较为简单且常用的一维算法。

该算法基于黄金分割点的性质,通过不断缩小区间来逼近最优解。

黄金分割法的具体步骤如下:1.初始化区间的上下界,确定迭代终止条件;2.计算黄金分割点的位置;3.根据黄金分割点分割区间;4.更新区间的上下界;5.判断是否满足迭代终止条件,如果满足,则输出最优解;如果不满足,则返回第2步。

斐波那契法是另一种常用的一维算法。

该算法通过斐波那契数列的性质,不断缩小区间来逼近最优解。

斐波那契法的具体步骤如下:1.初始化斐波那契数列,确定迭代终止条件;2.计算斐波那契点的位置;3.根据斐波那契点分割区间;4.更新区间的上下界;5.判断是否满足迭代终止条件,如果满足,则输出最优解;如果不满足,则返回第2步。

插值法是一种基于函数插值的一维算法。

该算法通过插值函数来拟合原函数,并通过求解插值函数的最小值或最大值来近似求解原函数的最小值或最大值。

插值法的具体步骤如下:1.初始化区间的上下界,确定迭代终止条件;2.根据插值函数拟合原函数,得到插值函数的表达式;3.求解插值函数的最小值或最大值;4.更新区间的上下界;5.判断是否满足迭代终止条件,如果满足,则输出最优解;如果不满足,则返回第2步。

除了上述算法,还存在其他一维算法,如割线法、牛顿法等。

这些算法各有特点,适用于不同类型的最优化问题。

一维算法的优势在于其计算简单、耗时少的特点。

然而,一维算法也存在一些缺点,例如容易陷入局部最优解、收敛速度较慢等。

因此,对于一些复杂的最优化问题,可能需要使用更高维度的算法进行求解。

总之,一维是最优化问题求解中常用的一种算法。

通过在给定的区间内不断迭代,可以逼近最优解。

最优化方法-一维搜索法

搜索区间及其确定方法

• 加步探索法算法的计算步骤: • (1) 选取初始数据.选取初始点 t0 [0, ) (或 t0 [0, tmax ]),

计算0 (t0 ), 给出初始步长h0 0, 加步系数 1,令 k 0 • (2) 比较目标函数值.令 tk 1 tk hk计算 k1 (tk1) ,

方向 Pk 之间应满足

f (Xk1)T Pk 0

4.2

• 事实上,设 (t) f ( X k tPk ), 对 t 求导有

(t) f (X k tPk )T Pk

• 令 '(t) 0, 即 f (X k tPk )T Pk 0 所以 f (X k1)T Pk 0

这一准则对于定义域上的凸函数是完全正确的.若是非凸函数,有 可能导致误把驻点作为最优点。 对于约束优化问题,不同的优化方法有各自的终止准则.

• 定义3.3 当一个算法用于n元正定二次函数求最优 解时,可以从任意初始点出发,至多经过n步迭 代求出最优解,就称此算法具有二次终止性。

• 如果算法具有二次终止性,则认为算法比较好。 • 二次终止性仅仅是判断一个算法优劣的衡量标准

存在

,且

,则称[t1 t2]是函数(t)

的最优解 的一个搜索区间。

搜索区间及其确定方法

•单峰区间和单峰函数有如下有用的性质: •定理3.1 设 : R1 R1, [a, b] 是的单峰区间,任取

t1, t2 [a, b] 并且 t2 t1 . (1)若有 (t2 ) (t1) ,则 [a, t1 ]是(t) 的单峰区间. (2)若有 (t2 ) (t1) ,则[t2 , b]是(t)的单峰区间.

最优化第3章一维搜索方法

§3.1 搜索区间的确定

根据函数的变化情况,可将区间分为单峰区间和多峰区间。 所谓单峰区间,就是在该区间内的函数变化只有一个峰值, 即函数的极小值。

§3.4 插值方法

一、牛顿法

f(x)

利用一点的函数值、 一阶导数以及二阶 导数构造二次多项 式。用构造的二次 多项式的极小点作 为原函数极小点的 近似。

φ0(x)

φ1(x) f(x)

x*

x2

x1

x0 x

§3.4 插值方法

一、牛顿法

设f(x)为一个连续可微的函数,则在点x0附近 进行泰勒展开并保留到二次项:

§3.1 搜索区间的确定

f(x)

f(x)

f(a0) f(a0+h)

f(a0+3h)

f(a0-h) f(a0)

f(a0+h)

0 a0 a

a0+h

a0+3h x b

0 a0-h

a0

a

进退试算法的运算步骤如下:

a0+h x b

(1)给定初始点α0和初始步长h (2)将α0及α0+h 代入目标函数 f(x) 进行计算并比较大小

φ0(x)

φ1(x) f(x)

f ′ (x)

x*

x2 x1

x0

φ ′ 1(x) f ′ (x)

x* x2

x1

x0

牛顿法程序框图

开始

x 给定初始点 ,误差 0

,

令k=0

一维搜索的最优方法(黄金分割法)

05 黄金分割法的应用举例

在函数优化中的应用

一元函数优化

黄金分割法可用于一元函数的极值求解,通过不断缩小搜索区间来逼近最优解。

多元函数优化的辅助手段

在多元函数优化中,黄金分割法可作为辅助手段,用于一维搜索或线搜索过程。

在工程问题中的应用

结构设计优化

在结构设计中,黄金分割法可用于寻 找最优的结构参数,如梁、柱的截面 尺寸等,以实现结构性能和经济性的 平衡。

二分法每次迭代将搜索区间减半,而黄金分割法每次迭代将搜索区间缩小为原来的约 0.618倍。在收敛速度上,二分法通常比黄金分割法更快。但二分法要求函数在搜索区间 内连续且单调,而黄金分割法则没有这样的限制。

与牛顿法相比

牛顿法是一种基于导数信息的搜索方法,具有较快的收敛速度。但在一维搜索问题中,当 导数信息不可用或难以获取时,黄金分割法则更为适用。此外,牛顿法对初始点的选择较 为敏感,而黄金分割法则相对稳健。

解决一维搜索问题的方法有多种,其中黄金分割法是一种较为常用且有效的方法。

黄金分割法简介

黄金分割法是一种通过不断缩小搜索 区间来逼近函数极小值点的方法。

黄金分割法具有简单、快速、稳定等 优点,适用于单峰函数的一维搜索问 题。

它在每次迭代中,通过比较区间两个 端点处的函数值,来确定下一步的搜 索区间。

黄金分割点

在一条线段上,按照黄金分割比 例将线段分割成两部分,分割点

即为黄金分割点。

函数图像

对于一元函数,可以将其图像视 为一条曲线。黄金分割法通过不 断在曲线上选取试探点来逼近最

优解。

搜索区间缩小

每次迭代后,根据试探点的函数 值比较结果,将搜索区间缩小,

使得下一步的搜索更加精确。

黄金分割法的算法步骤

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

例:

x ( 0) x (1 ) x ( 2) x ( 3)

x(4) x(1) h x (1 ) x ( 2)

x ( 4) x (1 )

h : h x ( 4) x (1 )

x ( 0) x (1 ) x (1 ) x ( 2)

x ( 4) x ( 2) x ( 3 )25

极小点区间 [ x( 3) , x(1) ] :

并假设

f ( x (1) ) f ( x ( 2 ) ),

f ( x ( 2 ) ) f ( x ( 3 ) ).

f ( x)

( x)

x* x (1 )

x

x ( 2)

x ( 3)

28

如何计算函数 ( x ) ?

设

( x ) a bx cx 2 ,

( x ) a bx cx

精确一维搜索

1. 一维最优化问题 2. Fibonacci与黄金分割法 3. 进退法 4. 平分法 5. 抛物线搜索法

1

一维搜索的基本概念

2

一. 一维最优化问题

下降迭代算法中最优步长的确定

f ( x k p ) min f ( x p )

k k k k

p

x

k

k

.

k

min f ( x) s.t . x R

令 k : k 1.

3. 若 f ( x ( 4 ) ) f ( x (1) ), 4. 令 x ( 2 ) x ( 1 ) ,

则转 4, 否则,转5.

f ( x (1) ) f ( x ( 4 ) ),

x(1) x( 4) , f ( x ( 2 ) ) f ( x (1) ), 令 h : 2h, 转 2. 5. 若 k 1, 则转 6; 否则,转7.

.

一维最优化问题:

极值点的必要条件:

f '( x ) 0

3

1. 下单峰函数 定义:设 f ( x ) 是区间 [ a , b ] 上的一元函数,x 是 f ( x ) 在 [ a , b ] 上的极小点,且对任意的 x1 , x2 [ a , b ], x1 x2 , 有 (a)当 x 2 x 时,f ( x1 ) f ( x2 ); (b)当 x1 x 时,f ( x1 ) f ( x2 ) .

( 3)

cx

解上述方程组,可得逼近函数 ( x ) 的系数 b 和 c.

令

( x ) b 2cx 0,

( x x ) f ( x ) ( x x ) f ( x ) ( x x ) f ( x ( 3) ) 2 [ ( x ( 2 ) x ( 3 ) ) f ( x (1) ) ( x ( 3 ) x (1) ) f ( x ( 2 ) ) ( x (1) x ( 2 ) ) f ( x ( 3 ) ) ]

( 3)

(4)

14

取值的确定?

通过确定 的取值,使上一次迭代剩余的迭代点恰与下一次 迭代的一个迭代点重合,从而减少算法的计算量。

(1) 设在第 k 次迭代时有 f ( k ) f ( uk ) , 则有

[ a k 1 , bk 1 ] [ a k , uk ]。

在第 k 1 次迭代时选取 k 1 , uk 1 , 则由(4)有 uk 1 a k 1 (bk 1 a k 1 )

6

Fibonacci法的引入

计算n次函数值,如何取点使最终区间最小?

或者最终区间长度为1,计算n次函数值,初始区 7 间最多为多长?

8

9

10

课堂练习

11

12

黄金分割法 思想 通过选取试探点使包含极小点的区间不断缩短, 直到区间长度小到一定程度,此时区间上各点的函数 值均接近极小值。 下面推导黄金分割法的计算公式。

设 f ( x ) 在 [a1 , b1 ] 上单峰,极小点 x [a1 , b1 ]. 假设进行 第 k 次迭代前 x [ak , bk ], 取 k , k [a k , bk ], 规定 k k .

计算 f ( k ) 和 f ( k ) , 分两种情况: 1. 若 f (k ) f ( k ) , 则令 a k 1 k , bk 1 bk ; 2. 若 f ( k ) f ( k ) , 则令 a k 1 a k , bk 1 k . 如何确定 k 与 k?

4. 令 a k 1 a k ,

bk 1 k ,

k 1 k ,

k 1 a k 1 0.382(bk 1 a k 1 ), 计算 f (k 1 ), 令 k : k 1, 转162。

一个以前很好的例子 function answ = goldsection(a,b,eps) % 黄金分割法实现一维搜索 % a ---- 搜索区间左端点 % b ---- 搜索区间右端点 % eps ---- 搜索精度

极小点区间: (1) , x( 3) ] [x

平分法 (优点和缺点都突出的方法)

能否看出 优点和缺点?

26

27

5. 抛物线插值

为什么非要是二次三项式?

思想 在极小点附近,用二次三项式 ( x ) 逼近目标函数 f ( x ),

令 ( x ) 与 f ( x ) 在三点 x (1) x ( 2 ) x ( 3 ) 处有相同的函数值,

(1) ( 2) ( 3 )2 ( 1 )2 ( 1 )2 ( 2 )2

29

以x 作为f (x )的极小点的估计值。

抛物线插值算法步骤:

(1) 给定初始区间 [ x (1) , x ( 3) ] ,

设 f ( (1) ) f ( x ( 2) ),

f ( x ( 2) ) f ( x ( 3) ).

则称 f ( x ) 下是单峰函数。

. . .

a

有没有特殊 形式的下单 峰函数 .

4

. x

.

.

x1 x2 b

性质:通过计算区间 [ a , b ] 内两个不同点的函数值,就可以 确定一个包含极小点的子区间。

定理 设 f ( x ) 是区间 [ a , b ]上的一元函数,x 是 f ( x ) 在 [ a , b ]

令 k : 1 。x

( 0)

x (1) 。 给定精度 。

( 2) 设 ( x ) a bx cx 2 。 ( x ( i ) ) f ( x ( i ) ) , i 1 , 2 , 3 。 解出 令

系数 a , b , c 。 解出 ( x )的极小点 x

b 。 2c (k ) ( k 1) 若| f (x ) f (x ) | , 则算法停止, 否则转( )。 3

上的极小点。任取点 c d [ a , b ] , 则有

(1)如果 f (c ) f (d ) ,则

x [c ,b ]; x [ a , d ]。

(2)如果 f (c ) f (d ) ,

则

如何确定一个下 单峰函数呢?

.

a

.

c

. x

.

d

.

b

5

Fibonacci方法--试探点算法

2. 若 bk a k , 停止, 且

bk a k . 否则, 2 当 f ( k ) f ( k ) 时,转 3;当 f ( k ) f ( k ) 时,转 4. x

bk 1 bk ,

3. 令 a k 1 k ,

k 1 k ,

k 1 a k 1 0.618(bk 1 a k 1 ), 计算 f ( k 1 ), 令 k : k 1, 转 2。

24

( 2) (4) 6. 令 h : h, x( 2) x( 4) , f ( x ) f ( x ),

转 2.

7. 令 x (3) x ( 2 ) , x( 2) x(1) , x(1) x( 4) , 停止计算。

区间 [ x (1) , x ( 3 ) ] 或[ x ( 3 ) , x (1) ] 即为包含极小点的区间。

(1) (1) (1) 2

令

f ( x (1) ) f ( x( 2) ) f ( x( 3) )

( x ) a bx

( 2) ( 3)

( 2)

cx

( 2)2 ( 3)2

( x ) a bx

再求函数 ( x ) 的极小点, 解得

x b 2c

( 2 )2 ( 3 )2

不精确一维线搜 索

32

为什么不精确的搜索好?

距离最优解远的时候,精度太大 算法效率低 有些算法的收敛速度不依赖与搜索的精度

只要求有充分下降即可 这种类似与“充分”、“足够”等描述词汇,在与 计算相关的描述中,要特别在意,因为,这里的 “充分”,已经不再是理论上的要求,这里的“充 分”必须与“可计算”相关 (到底要多充分,就是这里的非精确搜索的准测) 33

ak 2 (bk ak )

如果令 2 1 , uk 1 k ,因此 uk 1 不必重新计算 。 则

5 1 1 0.618 2 (2) 若在第k 次迭代时有f (k ) f ( k ) 。 同理可得。

2

15

算法步骤:

1. 给定初始区间 [a1 , b1 ], 精度要求 0. 令 1 a1 0.382 (b1 a1 ), 1 a1 0.618 (b1 a1 ), 并计算 f (1 ) 与 f ( 1 ). 令 k : 1.

(k )

( 3) 从 x (1) , x ( 2) , x ( 3)和 x 中选择 f ( x ) 的函数值最小的三个点及其