大数据离线分析项目(Hadoop)

Hadoop概述和2.0生态组件简介

Hadoop概述及生态组件简介Hadoop是Apache软件基金会的顶级开源项目,是一套靠得住的,可扩展的,支持散布式计算的开源软件,由原雅虎公司Doug Cutting依照Google 发布的学术论文(Google File System、MapReduce、BigTable)而创建的开源项目。

Doug Cutting被称为Hadoop之父。

而Hadoop是一个虚构的名字,Doug Cutting说明Hadoop的得名:“那个名字是我小孩给一个棕黄色的大象玩具命名的。

我的命名标准确实是简短、容易发音和拼写,没有太多的意义,而且可不能被用于别处,小小孩恰正是这方面的高手”。

因此Hadoop 的logo确实是一只奔跑的棕黄色小象。

Hadoop是一个基础框架,许诺用简单的编程模型在运算机集群对大型数据集进行散布式处置。

它的设计规模从单一效劳器到数千台机械,每一个都提供本地计算和存储,框架本身提供运算机集群高可用的效劳而不是依托硬件来提供高可用性。

用户能够在不了解散布式底层细节的情形下,轻松地在Hadoop上开发和运行处置海量数据的应用程序,低本钱、高靠得住、高扩展、高有效、高容错等特性让Hadoop成为最流行的大数据分析系统。

Hadoop的特点Hadoop是一个能够对大量数据进行散布式处置的软件框架,它是以一种靠得住、高效、可伸缩的方式进行数据处置。

高靠得住性:Hadoop按位存储和处置数据的能力值得人们信任。

高扩展性:Hadoop是在可用的运算机集群间分派数据并完成计算任务的,这些集群能够方便地扩展到数以千计的节点中。

高效性:Hadoop能够在节点之间动态地移动数据,并保证各个节点的动态平稳,因此处置速度超级快。

高容错性:Hadoop能够自动保留数据的多个副本,而且能够自动将失败的任务从头分派。

低本钱:Hadoop 依托于社区效劳,它的本钱比较低。

Hadoop版本演进当前Hadoop已进展到第二代版本,最新稳固版本是。

Hadoop - 介绍

Clint

NameNode

Second NameNode

Namespace backup

Heartbeats,balancing,replication etc

DataNode

Data serving

DataNode

DataNode

DataNode

DataNode

Google 云计算

MapReduce BigTable Chubby

GFS

Hadoop可以做什么?

案例1:我想知道过去100年中每年的最高温 度分别是多少?

这是一个非常典型的代表,该问题里边包含了大量的信息数据。

针对于气象数据来说,全球会有非常多的数据采集点,每个采 集点在24小时中会以不同的频率进行采样,并且以每年持续365 天这样的过程,一直要收集 100年的数据信息。然后在这 100年 的所有数据中,抽取出每年最高的温度值,最终生成结果。该 过程会伴随着大量的数据分析工作,并且会有大量的半结构化 数据作为基础研究对象。如果使用高配大型主机( Unix环境) 计算,完成时间是以几十分钟或小时为单位的数量级,而通过 Hadoop完成,在合理的节点和架构下,只需要“秒”级。

HIVE

ODBC Command Line JDBC Thrift Server Metastore Driver (Compiler,Optimizer,Executor ) Hive 包括

元数据存储(Metastore) 驱动(Driver)

查询编译器(Query Compiler)

1. HDFS(Hadoop分布式文件系统)

HDFS:源自于Google的GFS论文,发表于2003年10月, HDFS是GFS克隆版。是Hadoop体系中数据存储管理的 基础。它是一个高度容错的系统,能检测和应对硬件 故障,用于在低成本的通用硬件上运行。HDFS简化 了文件的一致性模型,通过流式数据访问,提供高吞 吐量应用程序数据访问功能,适合带有大型数据集的 应用程序。 Client:切分文件;访问HDFS;与NameNode交互, 获取文件位置信息;与DataNode交互,读取和写入数 据。 NameNode:Master节点,在hadoop1.X中只有一个, 管理HDFS的名称空间和数据块映射信息,配置副本 策略,处理客户端请求。 DataNode:Slave节点,存储实际的数据,汇报存储信 息给NameNode。 Secondary NameNode:辅助NameNode,分担其工作 量;定期合并fsimage和fsedits,推送给NameNode;紧 急情况下,可辅助恢复NameNode,但Secondary NameNode并非NameNode的热备。

大数据平台项目方案

大数据平台项目方案首先,本方案的目标是为企业提供一个可靠且高效的大数据平台。

该平台能够实现离线和实时数据处理和分析,为企业的决策提供有力的支持。

一、项目概述大数据平台项目是为了实现企业数据的集中管理、全面统计以及全面分析所需的一个大数据计算平台。

项目的主要目标是为企业提供一个高效且可靠的大数据分析平台,以便更好地了解企业的业务和客户。

本项目分为两个阶段:第一阶段是搭建大数据平台,第二阶段是进行数据分析和挖掘。

第一阶段包括数据采集、数据存储、数据预处理和数据分析。

第二阶段包括模型构建、数据挖掘和预测建模。

本项目需要专业的大数据架构设计、数据库设计、算法设计以及关键技术开发人员的参与,并需要建立完整的项目管理体系,保障项目质量与进度。

二、项目计划1.阶段一:搭建大数据平台1.1 数据采集2个月时间本阶段的主要任务是采集相关的数据,包括企业数据、行业数据、用户数据等。

数据来源主要包括开放接口和爬取,如果数据来源网站提供数据下载功能,可优先下载。

此外,还要对数据进行初步清洗,如去重、去噪声等操作。

1.2 数据存储1个月时间本阶段的主要任务是将采集到的数据进行存储,建立数据仓库,以便日后进行数据分析。

建议采用Hadoop分布式文件系统进行数据存储,以保证数据的可靠性和高扩展性。

1.3 数据预处理3个月时间本阶段的主要任务是对数据进行预处理,包括数据清洗、数据归一化、特征选择等,以便后续进行数据分析和挖掘。

本阶段需要进行数据采集、数据清洗、数据集成、数据转换等操作,以便为后续的分析和挖掘提供可靠的数据基础。

1.4 数据分析1个月时间本阶段的主要任务是通过各种大数据分析工具,如Hadoop、Spark、Flink、Storm等,对数据进行分析和挖掘,以便更好地了解企业的业务和客户。

2.阶段二:进行数据分析和挖掘2.1模型构建1个月时间本阶段的主要任务是构建数据模型,为预测和建模提供基础。

2.2数据挖掘2个月时间本阶段的主要任务是对数据进行挖掘,包括分类、聚类、关联规则挖掘、异常检测等操作,以发现数据的新的规律。

ict大数据复习题(含参考答案)

ict大数据复习题(含参考答案)一、单选题(共62题,每题1分,共62分)1.用户将证书上传到弹性负载均衡中,在创建()协议监听的时候绑定证书,提供HTTPS或TCP服务。

A、HTTPSB、HTTPC、TCPD、UDP正确答案:A2.LVS、Nginx节点服务正常时,每隔()秒会对ETCD节点连接,如果连续三次所有的ETCD节点都连接失败,产生集群健康检查告警。

A、1B、2C、3D、5正确答案:D3.ELB七层基于()实现。

A、LVSB、NginxC、HaproxyD、Apache正确答案:B4.常用的数据收集工具不包括?A、LoaderB、SparkC、KettleD、Sqoop正确答案:B5.为了提高Kafka的容错性,Kafka支持Partition的复制策略,以下关于Leader Partition和Follower Partition的描述错误的是:()。

A、Kafka针对Partition的复制需要选出一个Leader。

由该Leader负责Partition的读写操作。

其他的副本节点只是负责数据同步B、由于Leader Server承载了全部的请求压力。

因此从集群的整体考虑,Kafka会将Leader均衡的分散在每个实例上,来确保数据均衡C、一个Kafka集群各个节点间不可能互为Leader和FlowerD、如果Leader失效。

那么将会有其他follower来接管(成为新的Leader)正确答案:C6.Numpy包中创建数组的函数为(____)。

A、arrayB、ndimC、reshapeD、shape正确答案:A7.以下不属于CN自动剔除约束的是:()。

A、设置CN心跳超时时间的值大于0B、集群中的CN 总数必须大于等于3C、多CN故障时只能剔除一个CND、CN剔除以后,逻辑集群的创建、删除、扩容、缩容、回滚、显示操作可以执行正确答案:D8.以下不属于数据科学家主要职责的是(____) 。

如何在Java中实现大数据离线计算

如何在Java中实现大数据离线计算在当今数字化的时代,数据量呈爆炸式增长,如何有效地处理和分析这些海量数据成为了企业和开发者面临的重要挑战。

大数据离线计算是一种常见的数据处理方式,它适用于处理大规模的数据,并且对处理时间的要求相对较低。

在 Java 中,我们可以利用一些技术和框架来实现大数据离线计算。

接下来,让我们逐步了解如何在 Java 中进行大数据离线计算。

首先,我们需要明确大数据离线计算的概念。

离线计算通常是指对预先收集好的数据进行批量处理,而不是实时处理。

这种方式适合处理那些对时效性要求不高,但数据量巨大、计算复杂的任务,比如数据分析报表的生成、历史数据的挖掘等。

要在 Java 中实现大数据离线计算,我们可以使用 Hadoop 生态系统中的相关技术。

Hadoop 是一个开源的分布式计算框架,它由 HDFS (Hadoop 分布式文件系统)和 MapReduce 计算模型组成。

HDFS 是一个用于存储大规模数据的分布式文件系统。

在 Java 中,我们可以通过 Hadoop 的 API 来与 HDFS 进行交互,实现数据的读取和写入。

例如,我们可以使用`FileSystem`类来创建、删除文件和目录,读取文件内容等操作。

而 MapReduce 则是 Hadoop 中的核心计算模型。

Map 阶段将输入数据分解成一组键值对,并进行初步的处理。

Reduce 阶段则对 Map 阶段的输出结果进行汇总和进一步的处理。

在 Java 中实现 MapReduce 任务,需要编写`Mapper`类和`Reducer`类。

```javaimport orgapachehadoopconfConfiguration;import orgapachehadoopfsPath;import orgapachehadoopioIntWritable;import orgapachehadoopioLongWritable;import orgapachehadoopioText;import orgapachehadoopmapreduceJob;import orgapachehadoopmapreduceMapper;import orgapachehadoopmapreduceReducer;import orgapachehadoopmapreducelibinputFileInputFormat;import orgapachehadoopmapreduceliboutputFileOutputFormat;public class WordCount {public static class TokenizerMapper extends Mapper<LongWritable, Text, Text, IntWritable> {private final static IntWritable one = new IntWritable(1);private Text word = new Text();@Overridepublic void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {String line = valuetoString();String words = linesplit("");for (String wordStr : words) {wordset(wordStr);contextwrite(word, one);}}}public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {private IntWritable result = new IntWritable();@Overridepublic void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {int sum = 0;for (IntWritable val : values) {sum += valget();}resultset(sum);contextwrite(key, result);}}public static void main(String args) throws Exception {Configuration conf = new Configuration();Job job = JobgetInstance(conf, "word count");jobsetJarByClass(WordCountclass);jobsetMapperClass(TokenizerMapperclass);jobsetCombinerClass(IntSumReducerclass);jobsetReducerClass(IntSumReducerclass);jobsetOutputKeyClass(Textclass);jobsetOutputValueClass(IntWritableclass);FileInputFormataddInputPath(job, new Path(args0));FileOutputFormatsetOutputPath(job, new Path(args1));Systemexit(jobwaitForCompletion(true)? 0 : 1);}}```在上述示例中,`TokenizerMapper`类将输入的文本行拆分成单词,并将每个单词作为键,值为 1 输出。

2024年大数据专业毕设选题推荐

2023年大数据专业毕设选题推荐选题注意事项:(1)数据是否能够获取(2)工作量是否满足毕设要求(3)代码是否通俗易懂,能否在短期内掌握(4)选题是否具有现实意义(5)个人电脑硬件是否支持运行大数据项目大数据毕设项目主要流程:(1)大数据环境搭建:虚拟机搭建(分布式、伪分布式)、Hadoop、Hbase、Zookeeper、Hive、Hbase、Kafka、Flume等组件的安装(2)数据获取与清洗:爬虫、公开渠道获取等(3)数据分析:选择合适的大数据分析技术(4)数据挖掘:聚类、预测、推荐等(5)可视化展示:大屏、导航栏跳转等一、Hive数据仓库相关选题Hive数据仓库项目的核心仓库分层:ODS(源数据层)、DWD(数据明细层)、DWS(数据汇总层)、ADS(数据应用层)(1)基于hive的民宿价格分析系统选题意义:在消费升级背景下,消费转型、消费提升成为新的研究热点.当前,中国旅游市场在加速复兴中,新型优质的中高端旅游产品推动旅游市场的迅速恢复.近两年民宿标准化文件相继出台,民宿行业对民宿评级工作的有序开展,使得民宿业进入了转型升级通道,也为民宿的理论研究创造出有利的条件。

利用Hadoop、Hive、MapReduce等技术为用户解决在民宿选择问题,通过对用户所提供房屋的容纳人数、便利设施、洗手间数量、床的数量、卧室数量等相关信息,来进行可视化展示,更加详细的面向用户,更加清晰的展示当前房屋情况,为用户提供最合理的价格方案,该系统的设计目标是为用户提供可靠的可视化数据分析服务。

创新点:(1)对Hive数据仓库进行分层建设(2)聚焦热点领域,较强的现实意义(3)可视化大屏展示技术路线:1、数据爬取:基于python爬取去哪网相关民宿信息,并进行数据清洗2、数据分析:基于Hive数据仓库进行数据存储和分析,分析维度包括:民宿价格均值、民宿评分排名、各区域民宿数量、民宿简介词云、民宿均价等3、数据迁移:Sqoop4、数据可视化:springBoot+echarts+MySQL可视化(2)基于hive的厨具用品数据分析可视化选题意义:目前智能手机随处可见,各种年龄段的人群都可以在网络上随心所欲的购买商品。

大数据处理之Hadoop

⼤数据处理之Hadoop⼤数据Hadoop基础:1. SQL功底2. Linux功底3. Java SE怎么学?第⼀阶段:⼤数据基础 Hadoop2.x⼀、⼤数据应⽤发展前景数据公司、政府、⾦融、银⾏、电⼦商务最经典的⼤数据的案例:啤酒和尿布应⽤分析:统计推荐机器学习(分类、聚类)⼈⼯智能,预测(算法)SQL on HadoopHive ⾻灰级玩家Prestore(国外⽐较多)Impala(国外⽐较多,不是很稳定)Phoneix(基于HBase)国外运⽤⽐较多Spark SQLHadoop诞⽣⽹络可扩展,分析可存储Common:⼯具、基础,为服务来源(Google) -----> Hadoop诞⽣的东西GFS(C语⾔编写的) ------> HDFS(Java编写的,也是分布式的):存储海量数据分布式(思想:分⽽治之,⼤数据集分为许多⼩的数据集,每个数据集都进⾏逻辑业务处理(map),合并统计数据集结果(reduce))分布式安全性(副本数据,每⼀个数据会有3个副本)数据是以block的⽅式进⾏存储MapReduce ----------> MapReduce :对海量数据的分析处理BigTable ------> HBase :YARN:分布式资源管理框架(Hadoop2开始出现)管理整个集群的资源(内存、cpu核数)分配调度集群的资源检索⼯具NutchLunence⼆、Hadoop概述2.1 Apache Hadoop 起源Apache Lucene:开源的⾼性能全⽂检索⼯具包Apache Nutch:开源的Web搜索引擎Google三⼤论⽂:MapReduce、GFS、BigTableApache Hadoop:⼤规模数据处理2.2 HDFS 系统架构图NameNode:主节点---存储⽂件的元数据如⽂件名、⽂件⽬录结构、⽂件属性(⽣成时间,副本数,⽂件权限),以及每个⽂件的块列表和块所在的DataNode等。

大数据离线计算平台介绍

中间数据持久化:

避免重算(对daDCE揭秘 • 统一分布式计算引擎API-Bigflow

需求

• 学习成本:

• 学习使用、学习优化

Hadoop

一套逻辑,重写再重写

Spark

未来某种新的计算引擎

• 迁移成本:

• 单机作业迁移分布式、流式与批量 迁移、新引擎迁移大数据离线计算平台介绍目录

• 离线大数据平台发展历程 • 离线计算引擎DCE揭秘 • 统一分布式计算API-Bigflow私有云产品生态搜索

金融

糯米

AI

开放云

ADU

分布式计算

服 务 托 管 研 发 效 率 相 关 工 具 Batch RealTime Iterative

分布式存储

Ojbect Table NFS

批量计算引擎

提升时效性

实时计算引擎

• 维护成本:

• 用户作业维护、引擎演化兼容维护

恢复故障数据、提升结果准确性 一套逻辑,同时需要维护两个系统上完全不同的代码

统一分布式计算API

•

统一分布式计算API-Bigflow:

– 统一流式和批处理计算模型 – 自动优化用户代码 – 针对引擎特性,进一步优化执行 – 简单易学,高层抽象API

环境 初始化

结 算

高精硬件

FPGAGPU整机柜大数据计算平台Python

API层

C++

Java

……

Simplified Unified API - Bigflow

计算引擎

TM

DStream

DCE

(MR/DAG)

MPI/ ELF

Spark/ Flink

资源调度 资源管理 机器资源

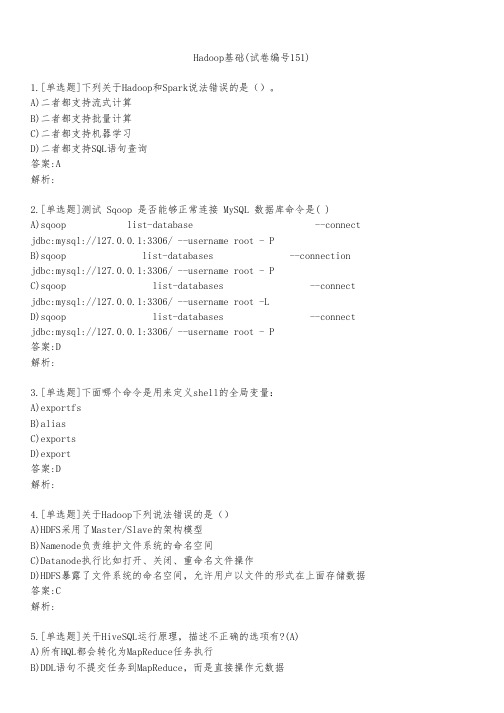

Hadoop基础(试卷编号151)

Hadoop基础(试卷编号151)1.[单选题]下列关于Hadoop和Spark说法错误的是()。

A)二者都支持流式计算B)二者都支持批量计算C)二者都支持机器学习D)二者都支持SQL语句查询答案:A解析:2.[单选题]测试 Sqoop 是否能够正常连接 MySQL 数据库命令是( )A)sqoop list-database --connect jdbc:mysql://127.0.0.1:3306/ --username root - PB)sqoop list-databases --connection jdbc:mysql://127.0.0.1:3306/ --username root - PC)sqoop list-databases --connect jdbc:mysql://127.0.0.1:3306/ --username root -LD)sqoop list-databases --connect jdbc:mysql://127.0.0.1:3306/ --username root - P答案:D解析:3.[单选题]下面哪个命令是用来定义shell的全局变量:A)exportfsB)aliasC)exportsD)export答案:D解析:4.[单选题]关于Hadoop下列说法错误的是()A)HDFS采用了Master/Slave的架构模型B)Namenode负责维护文件系统的命名空间C)Datanode执行比如打开、关闭、重命名文件操作D)HDFS暴露了文件系统的命名空间,允许用户以文件的形式在上面存储数据答案:C解析:5.[单选题]关干HiveSQL运行原理,描述不正确的选项有?(A)C)对于selectcount(*)fromtable操作,一定会启reduce任务D)对于select*fromtable语句不会启MapReduce答案:A解析:6.[单选题]调用Zookeeper对象创建的节点,不包括()。

Hadoop,Spark,Flink适用场景与依赖关系

Hadoop,Spark,Flink适⽤场景与依赖关系三⼤分布式计算系统Hadoop适合处理离线的静态的⼤数据;Spark适合处理离线的流式的⼤数据;Storm/Flink适合处理在线的实时的⼤数据。

前⾔Spark,是分布式计算平台,是⼀个⽤scala语⾔编写的计算框架,基于内存的快速、通⽤、可扩展的⼤数据分析引擎。

Hadoop,是分布式管理、存储、计算的⽣态系统;包括HDFS(存储)、MapReduce(计算)、Yarn(资源调度)。

Hadoop和Apache Spark都是当今蓬勃发展的开源⼤数据框架。

尽管Hadoop和Spark并没有做同样的事情,但是它们是相互关联的。

⼤数据处理⽆处不在Hadoop的需求。

但是,尽管Hadoop具有许多重要的功能和数据处理优势,但它仍存在⼀个主要缺点。

Hadoop的本地批处理引擎MapReduce不如Spark快。

这就是Spark超越Hadoop的优势。

除此之外,当今⼤多数⼤数据项⽬都需要批处理⼯作负载以及实时数据处理。

Hadoop的MapReduce并不适合它,只能处理批处理数据。

此外,当需要低延迟处理⼤量数据时,MapReduce⽆法做到这⼀点。

因此,我们需要在Hadoop之上运⾏Spark。

借助其混合框架和弹性分布式数据集(RDD),可以在运⾏Spark时将数据透明地存储在内存中。

需要Hadoop运⾏SparkHadoop和Spark不是互斥的,可以⼀起⼯作。

没有Spark,就不可能在Hadoop中进⾏实时,快速的数据处理。

另⼀⽅⾯,Spark没有⽤于分布式存储的任何⽂件系统。

但是,许多⼤数据项⽬需要处理数PB的数据,这些数据需要存储在分布式存储中。

因此,在这种情况下,Hadoop的分布式⽂件系统(HDFS)与资源管理器YARN⼀起使⽤。

因此,如果使⽤HDFS在分布式模式下运⾏Spark,则可以通过连接集群中的所有项⽬来获得最⼤的收益。

因此,HDFS是Hadoop在分布式模式下运⾏Spark的主要需求。

实战大数据(Hadoop Spark Flink):从平台构

读书笔记

对想了解大数据的小白来讲还是非常不错的,不过里面的安装步骤太多了[emm]。 快速入门,每个框架讲了怎么安装和简单的使用,对于大体了解很有帮助。 前阶段概念性的东西比较多,可以提供参考。 只能说算是知识普及和实验环境搭建,内容一般,实操的话也没多大意义。 框架搭建流程介绍的很清晰了,而且还附有配置参数相关的代码,很棒哦。 比较快速的过了一遍这本书对于大数据类的项目入门比较好,比较基础的介绍了数据中台以及上层应用层实 际技术框架的常见技术以及概念比如hadoop、flume、spark、sevlet等。 各种框架的安装和word count。 入门读物,很好理清技能树可以用来当作入门读物,能够很好的理清一些技术之间的区别与联系,之后再找 相关技术书籍深入学习。 能够帮助入门大数据常用的框架,对大数据技术有个概貌认知,也能快速入门上手,感知各组件的关系。 六个小时,大体看完,想快速入门的推荐阅读。

资源管理的本质是集群、数据中心级别资源的统一管理和分配。其中多租户、弹性伸缩、动态分配是资源管 理系统要解决的核心问题。

大数据工程师需要掌握Spark Streaming、Flink DataStream等大数据实时计算技术。

大数据工程师需要掌握MapReduce、Hive、Spark Core、Spark SQL、FlinkDataSet等大数据离线计算技术。

3.4 Hadoop分布式 集群的构建

3.5 MapReduce 分布式计算

框架

3.6本章小结

4.2搭建Kafka分布 式消息系统

4.1构建HBase分布 式实时数据库

4.3本章小结

5.1搭建Flume 1

日志采集系统

5.2使用Flume 2

采集用户行为 数据

大数据分析技术基础教学课件3-大数据处理平台Hadoop

mapred-site.xml <configuration>

伪分布式模式 • Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件

分布式模式 • 多个节点构成集群环境来运行Hadoop

Hadoop的安装

Hadoop基本安装配置主要包括以下几个步骤:

第一代Hadoop包含三个大版本,分别是0.20.x,0.21.x和0.22.x,其中,0.20.x最 后演化成1.0.x,变成了稳定版,而0.21.x和0.22.x则增加了NameNode HA等新的 重大特性

第二代Hadoop包含两个版本,分别是0.23.x和2.x,它们完全不同于Hadoop 1.0, 是一套全新的架构,均包含HDFS Federation和YARN两个系统,相比于0.23.x,2.x 增加了NameNode HA和Wire-compatibility两个重大特性

Pig是一个用于大数据分析的工具,包括了一个数据分析语言和其运行环 境。Pig的特点是其结构设计支持真正的并行化处理,因此适合应用于大数 据处理环境。

Ambari是一个用于安装、管理、监控hadoop集群的web界面工具。目前已 支持包括MapReduce、HDFS、HBase在内的几乎所有hadoop组件的管理。

◦ 10年后,摩尔在IEEE国际电子组件大会上将他的语言修正为半导体芯片上集成的晶体管和电阻的 数量将每两年增加1倍。

结合Hadoop与Spark的大数据分析与处理技术研究

结合Hadoop与Spark的大数据分析与处理技术研究随着互联网的快速发展和信息化时代的到来,大数据技术逐渐成为各行各业关注的焦点。

在海量数据的背景下,如何高效地进行数据分析和处理成为了企业和组织面临的重要挑战。

Hadoop和Spark作为两大主流的大数据处理框架,各自具有独特的优势和适用场景。

本文将围绕结合Hadoop与Spark的大数据分析与处理技术展开深入研究。

一、Hadoop技术概述Hadoop作为Apache基金会的顶级项目,是一个开源的分布式计算平台,提供了可靠、可扩展的分布式计算框架。

其核心包括Hadoop Distributed File System(HDFS)和MapReduce计算模型。

HDFS是一种高容错性的分布式文件系统,能够存储海量数据并保证数据的可靠性和高可用性;MapReduce则是一种编程模型,通过将计算任务分解成多个小任务并行处理,实现了分布式计算。

在实际应用中,Hadoop广泛用于海量数据的存储和批量处理,例如日志分析、数据挖掘等场景。

通过搭建Hadoop集群,用户可以将数据存储在HDFS中,并利用MapReduce等工具进行数据处理和分析。

然而,由于MapReduce存在计算延迟高、不适合实时计算等缺点,随着大数据应用场景的多样化和复杂化,人们开始寻求更高效的大数据处理解决方案。

二、Spark技术概述Spark是另一个流行的大数据处理框架,也是Apache基金会的顶级项目。

与Hadoop相比,Spark具有更快的计算速度和更强大的内存计算能力。

Spark基于内存计算技术,将中间结果存储在内存中,避免了频繁的磁盘读写操作,从而大幅提升了计算性能。

除了支持传统的批处理作业外,Spark还提供了丰富的组件和API,如Spark SQL、Spark Streaming、MLlib(机器学习库)和GraphX(图计算库),满足了不同类型的大数据处理需求。

特别是Spark Streaming模块支持实时流式数据处理,使得Spark在实时计算领域具有重要应用前景。

cdh 离线方案

cdh 离线方案CDH离线方案CDH(Cloudera Distribution Including Apache Hadoop)是一个大数据解决方案,由Cloudera公司提供。

它基于Hadoop平台,将各种开源分布式计算软件整合在一起,方便用户进行大数据处理和分析。

CDH离线方案是指在无网络连接或网络不稳定的环境下,使用CDH进行离线数据处理的解决方案。

一、概述在某些场景下,由于网络限制或数据安全性考虑,无法直接连接到互联网或外部网络。

然而,在这些情况下,仍然需要对大规模数据进行处理和分析。

CDH离线方案提供了一个解决方案,使用户能够在离线环境中使用CDH进行数据处理。

二、方案流程1. 数据预处理阶段在离线环境中,需要将待处理的数据通过光盘、移动硬盘等介质传输到CDH集群所在的服务器上。

这些数据可能是结构化数据(如关系型数据库的备份文件)或非结构化数据(如日志文件、文本文件等)。

通过将数据导入CDH集群的Hadoop分布式文件系统(HDFS)中,为后续的离线处理做准备。

2. 离线处理阶段通过CDH提供的离线处理工具,如MapReduce、Hive等,对导入到HDFS中的数据进行处理。

MapReduce具有良好的扩展性和容错性,适合并行化计算任务。

Hive则提供了面向数据仓库的查询和分析功能。

用户可以根据具体需求选择合适的工具进行离线处理。

3. 处理结果导出阶段在离线处理完成后,可以将处理结果导出到光盘、移动硬盘等介质中,以便进一步分析和使用。

CDH提供了多种导出数据的方式,如将结果存储到HDFS中,或者通过Sqoop将数据导出到关系型数据库中。

用户可以根据具体需求选择合适的方式导出处理结果。

三、离线方案的优势1. 数据安全性:离线环境下,不需要将数据传输到外部网络,保证了数据的安全性。

2. 处理效率:CDH离线方案利用CDH集群的计算资源,可以并行处理大规模数据,提高处理效率。

3. 快速部署:CDH离线方案具有良好的可扩展性,可以根据实际需求快速部署和配置CDH集群。

开发中离线数据和在线数据的处理逻辑

开发中离线数据和在线数据的处理逻辑一、数据收集1. 离线数据收集:在数据收集阶段,离线数据通常通过定期或按需的方式从各种数据源(如数据库、日志文件、传感器等)中抽取数据。

这个过程可能需要借助ETL工具进行数据的抽取、转换和加载。

2. 在线数据收集:在线数据通常实时收集,例如通过API接口、实时日志、实时传感器数据等。

这些数据可以实时传输到数据处理系统中,进行实时的数据处理和应用。

二、数据存储1. 离线数据存储:离线数据通常存储在关系型数据库、NoSQL数据库、大数据存储系统(如Hadoop、HDFS)等持久性存储系统中。

这些存储系统能够处理大量的数据,并且能够提供稳定的访问性能。

2. 在线数据存储:在线数据通常存储在内存数据库、分布式缓存等高速存储系统中。

这些系统能够提供实时的数据访问性能,满足实时数据处理和应用的需求。

三、数据处理1. 离线数据处理:离线数据处理通常在数据收集后进行,包括数据的清洗、转换、聚合、分析等操作。

这个过程可能需要借助各种数据处理工具和算法,例如MapReduce、Spark等。

2. 在线数据处理:在线数据处理通常实时进行,包括数据的实时清洗、转换、聚合、分析等操作。

这个过程可能需要借助各种实时数据处理工具和算法,例如Kafka Streams、Flink等。

四、数据同步1. 离线数据同步:离线数据同步通常在数据处理完成后进行,将处理后的数据同步到其他系统或存储中。

这个过程可能需要借助各种数据同步工具和协议,例如Apache NiFi、Apache Kafka等。

2. 在线数据同步:在线数据同步通常实时进行,将实时收集的数据同步到其他系统或存储中。

这个过程可能需要借助各种实时数据同步工具和协议,例如Apache Kafka Streams等。

五、数据应用1. 离线数据应用:离线数据应用通常在数据处理完成后进行,将处理后的数据应用到各种业务场景中。

这个过程可能需要借助各种数据分析工具和可视化工具,例如Tableau、Power BI等。

离线数据分析流程介绍

离线数据分析流程介绍流程介绍数据分析流程介绍离线数据分析3. 离线注:本环节主要感受数据分析系统的宏观概念及处理流程,初步理解hadoop等框架在其中的应⽤环节,不⽤过于关注代码细节⼀个应⽤⼴泛的数据分析系统:“web⽇志数据挖掘”3.1 需求分析3.1.1 案例名称“⽹站或APP点击流⽇志数据挖掘系统”。

3.1.2 案例需求描述“Web点击流⽇志”包含着⽹站运营很重要的信息,通过⽇志分析,我们可以知道⽹站的访问量,哪个⽹页访问⼈数最多,哪个⽹页最有价值,⼴告转化率、访客的来源信息,访客的终端信息等。

3.1.3 数据来源本案例的数据主要由⽤户的点击⾏为记录获取⽅式:在页⾯预埋⼀段js程序,为页⾯上想要监听的标签绑定事件,只要⽤户点击或移动到标签,即可触发ajax请求到后台servlet程序,⽤log4j记录下事件信息,从⽽在web服务器(nginx、tomcat等)上形成不断增长的⽇志⽂件。

形如:58.215.204.118 - - [18/Sep/2013:06:51:35 +0000] "GET /wp-includes/js/jquery/jquery.js?ver=1.10.2 HTTP/1.1" 304 0"http://blog.fens.me/nodejs-socketio-chat/" "Mozilla/5.0 (Windows NT 5.1;rv:23.0) Gecko/20100101 Firefox/23.0"3.2 数据处理流程3.2.1 流程图解析本案例跟典型的BI系统极其类似,整体流程如下:但是,由于本案例的前提是处理海量数据,因⽽,流程中各环节所使⽤的技术则跟传统BI完全不同,后续课程都会⼀⼀讲解:1) 数据采集:定制开发采集程序,或使⽤开源框架FLUME2) 数据预处理:定制开发mapreduce程序运⾏于hadoop集群3) 数据仓库技术:基于hadoop之上的Hive4) 数据导出:基于hadoop的sqoop数据导⼊导出⼯具5) 数据可视化:定制开发web程序或使⽤kettle等产品6) 整个过程的流程调度:hadoop⽣态圈中的oozie⼯具或其他类似开源产品3.2.2 项⽬技术架构图3.2.3 项⽬相关截图(感性认识,欣赏即可)a) Mapreudce程序运⾏b) 在Hive中查询数据c) 将统计结果导⼊mysql./sqoop export --connect jdbc:mysql://localhost:3306/weblogdb --username root --password root --table t_display_xx --export-dir/user/hive/warehouse/uv/dt=2014-08-033.3 项⽬最终效果经过完整的数据处理流程后,会周期性输出各类统计指标的报表,在⽣产实践中,最终需要将这些报表数据以可视化的形式展现出来,本案例采⽤web程序来实现数据可视化效果如下所⽰:。

大数据离线数据处理模块流程

大数据离线数据处理模块流程下载温馨提示:该文档是我店铺精心编制而成,希望大家下载以后,能够帮助大家解决实际的问题。

文档下载后可定制随意修改,请根据实际需要进行相应的调整和使用,谢谢!并且,本店铺为大家提供各种各样类型的实用资料,如教育随笔、日记赏析、句子摘抄、古诗大全、经典美文、话题作文、工作总结、词语解析、文案摘录、其他资料等等,如想了解不同资料格式和写法,敬请关注!Download tips: This document is carefully compiled by theeditor. I hope that after you download them,they can help yousolve practical problems. The document can be customized andmodified after downloading,please adjust and use it according toactual needs, thank you!In addition, our shop provides you with various types ofpractical materials,such as educational essays, diaryappreciation,sentence excerpts,ancient poems,classic articles,topic composition,work summary,word parsing,copy excerpts,other materials and so on,want to know different data formats andwriting methods,please pay attention!1. 数据采集从各种数据源(如数据库、文件系统、网络等)收集数据。

企业大数据项目分析流程包括以下步骤 选择题

企业大数据项目分析流程包括以下步骤选择题步骤1、数据收集大数据处理的第一步是数据的收集。

现在的中大型项目通常采用微服务架构进行分布式部署,所以数据的采集需要在多台服务器上进行,且采集过程不能影响正常业务的开展。

基于这种需求,就衍生了多种日志收集工具,如Flume、Logstash、Kibana等,它们都能通过简单的配置完成复杂的数据收集和数据聚合。

2、数据存储收集到数据后,下一个问题就是:数据该如何进行存储?通常大家最为熟知是MySQL、Oracle等传统的关系型数据库,它们的优点是能够快速存储结构化的数据,并支持随机访问。

但大数据的数据结构通常是半结构化(如日志数据)、甚至是非结构化的(如视频、音频数据),为了解决海量半结构化和非结构化数据的存储,衍生了HadoopHDFS、KFS、GFS等分布式文件系统,它们都能够支持结构化、半结构和非结构化数据的存储,并可以通过增加机器进行横向扩展。

分布式文件系统完美地解决了海量数据存储的问题,但是一个优秀的数据存储系统需要同时考虑数据存储和访问两方面的问题,比如你希望能够对数据进行随机访问,这是传统的关系型数据库所擅长的,但却不是分布式文件系统所擅长的,那么有没有一种存储方案能够同时兼具分布式文件系统和关系型数据库的优点,基于这种需求,就产生了HBase、MongoDB。

大数据处理最重要的环节就是数据分析,数据分析通常分为两种:批处理和流处理。

批处理:对一段时间内海量的离线数据进行统一的处理,对应的处理框架有HadoopMapReduce、Spark、Flink等;流处理:对运动中的数据进行处理,即在接收数据的同时就对其进行处理,对应的处理框架有Storm、SparkStreaming、FlinkStreaming 等。

批处理和流处理各有其适用的场景,时间不敏感或者硬件资源有限,可以采用批处理;时间敏感和及时性要求高就可以采用流处理。

随着服务器硬件的价格越来越低和大家对及时性的要求越来越高,流处理越来越普遍,如股票价格预测和电商运营数据分析等。

医疗大数据挖掘与可视化分析(Hadoop)

医疗大数据挖掘与可视化分析(Hadoop)在当今信息爆炸的时代,医疗行业也不例外,医疗数据的增长速度之快让人咋舌。

如何从这些海量的医疗数据中挖掘出有用的信息,并通过可视化分析呈现给医护人员和决策者,已成为医疗行业发展的重要课题。

而Hadoop作为一种开源的分布式计算框架,为医疗大数据挖掘与可视化分析提供了强大的支持。

医疗大数据挖掘医疗大数据包括患者的病历、影像资料、实验室检查结果、药物处方等各种形式的数据。

这些数据量庞大且多样化,传统的数据处理方法已经无法满足对这些数据进行深入挖掘的需求。

而Hadoop作为一种分布式计算框架,具有良好的横向扩展性和容错性,能够有效地处理医疗大数据。

通过Hadoop集群,可以将医疗数据分布式存储在多台服务器上,并利用MapReduce等计算模型进行数据处理和分析。

在医疗大数据挖掘过程中,可以利用Hadoop平台进行数据清洗、特征提取、模型训练等操作,从而发现患者的病情趋势、药物治疗效果等有用信息。

可视化分析医疗大数据挖掘出来的结果往往是庞大而复杂的,直接呈现给医护人员和决策者很难得到有效的理解和应用。

因此,可视化分析在医疗大数据领域显得尤为重要。

通过可视化手段,可以将抽象的数据转化为直观的图表、图像,帮助用户更直观地理解数据背后蕴含的规律和信息。

Hadoop平台提供了丰富的工具和库,如Apache Zeppelin、Tableau等,可以帮助用户对医疗大数据进行可视化分析。

用户可以通过这些工具创建各种图表、仪表盘,实时监测患者健康状态、药物使用情况等关键指标,为临床决策提供科学依据。

实际应用在实际应用中,医疗大数据挖掘与可视化分析已经取得了一系列成功。

比如利用Hadoop平台对患者就诊记录进行分析,发现不同年龄段患者就诊偏好和病情特点;通过可视化手段展示不同药物治疗效果对比,帮助医生选择最佳治疗方案等。

此外,在公共卫生事件监测、药物不良反应监测等领域也有广泛应用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

大数据离线分析项目(Hadoop)

一、项目总体需求、具体设计

1、总体需求:捕获用户每天的行为数据,生成

业务日志文件,根据日志文件清洗、分析、提取出需要的价值信息(pv:页面浏览量uv:独立访客数独立IP 会话时长等),对网站的良好运营提供有价值的指标。

2、具体设计

2.1捕获(JsSDK)用户行为数据(launch

事件、pageView事件、event事件、

chargerequet事件)

2.2将捕获的数据发送给web服务器,生

成日志文件(Nginx)

2.3将日志文件上传至文件存储系统中

(Shell脚本、Flume)

2.4在文件存储系统中对日志文件进行清

洗,过滤掉脏数据和不需要的字段

(MapReuce job任务)

2.5将过滤后的日志文件导入到数据库中

(HBase)

2.6通过MapReduce程序或Hive进行统

计分析(Hive)

2.7将统计分析后的结果导入到本地数据

库中进行永久储存(Mysql)

2.8在前端进行展示

(SpringMVC+Highcharts)

二、项目架构(画图)

具体分为三个部分(如下图所示):

数据收集层

hadoop、hive、flume、kafka、shell

数据分析层

hive、MapReduce、spark

数据展示层

springmvc + highcharts

三、技术选型、特点、为什么

1.JsSDK捕获前端页面数据。

Javascript 编写

页面日志生成与发送工具(原则:保持对业务代码最小影响)

特点:采用原生的JavaScript编写,以

js文件嵌入到前端,页面触发业务所关注

的事件(按照收集数据的不同分为不同的

事件)时调用相关方法。

2.Java sdk后台服务日志生成与发送工具

JavaSDK代码很简单,可以打成jar包

或者直接拷贝类到具体的项目中,正常逻

辑处理到JavaSDK所关注的事件后,调

用JavaSDK提供的api即可。

3. Nginx web服务器,产生日志文件

特点:Nginx是一个小巧而高效

的Linux下的web服务器软件,

相比较Apache它不仅有稳定性、

丰富的功能集、示例配置文件,更

重要的是Nginx是基于事件的,

它的内存使用很低,系统资源消耗

小很多。

3.shell脚本上传日志文件(数据量一般比较小

的场景,不会立即进行分析)

分割日志,每天定时分割成昨天的日志文件。

(vi split.sh)

上传到HDFS。

(vi put2hdfs.sh)

flume上传(数据量一般比较大的

场景,需要实时处理。

)

5. HBase数据库

数据解析以后,我们把它存入

HBase表。

因为:不同的事件,最

后上传到HDFS里面每行数据的字

段数量是不一样的;而且HBase

中,单表数据量相对比较大

6. MySql 最终结果存储

Mysql是关系型数据库,结构十

分清晰,能够与JavaWeb中的

SpringMVC进行很好的对接;而

且SQL语句是结构化的查询语言,

方便运营页面查询数据

7. SpringMVC+Highcharts 进行报表显示

四、具体实现需求(分析了哪些功能pv、uv)

主要实现需求:

Pv:页面的浏览次数,衡量网站用户访问的网页数量;用户每打开一个页面就记录一次,多次打开同一个页面则浏览量累计。

描述用户访问网站信息,应用于基本的各个不同计算任务

Uv:独立访客数

1天内访问某站点的人数(以cookie为依据)

1天内同一访客的多次访问只计为1个访客

S_time:会话时长

详细需求:

五、项目中遇到了哪些问题,怎么解决

1、日志格式有点混乱,以至于给后面的数据清洗带来困扰

办法:最后调整数据格式,并重新定义了分隔符

2、对日志文件进行分析时,建立Hive 外部表与Hbase表的链接字段搞错,以至于

HBase与Hive整合不成功

办法:查看数据字典,查找字段,并将hive外部表的字段名和HBase表的列名

一样。

六、项目总结

通过本次项目搭建,我对大数据的实际应用,以及客户需求的具体实现有了更为

清晰的认识,同时也对之前所学到的知识进

行了温故与整合。

同时看到了自己的很多不足,究其原因,是对Hadoop以及诸多协作框架的理

解应用仅限于皮毛,缺乏透彻的研究,实

际开发能力仍大有欠缺,需要更多的实战来

历练。

总之,通过本次项目搭建我收获颇丰,

受益匪浅,并清楚了自己以后学习的重点,努力的方向。