基于判别式分析和神经网络的特征选择方法

神经网络中的特征选择方法与技巧

神经网络中的特征选择方法与技巧在机器学习领域中,特征选择是一个重要的任务,它能够帮助我们从大量的特征中选择出最具有代表性的特征,以提高模型的性能和泛化能力。

神经网络作为一种强大的机器学习模型,也需要进行特征选择来优化其性能。

本文将介绍神经网络中常用的特征选择方法和技巧。

一、过滤式特征选择过滤式特征选择是在训练模型之前对特征进行筛选,常用的方法包括相关性分析和方差分析。

相关性分析通过计算特征与目标变量之间的相关系数来衡量特征的重要性,常用的相关系数包括皮尔逊相关系数和斯皮尔曼相关系数。

方差分析则是通过比较特征的方差来判断其对目标变量的影响程度。

这些方法简单直观,计算效率高,但是忽略了特征之间的相互关系。

二、包裹式特征选择包裹式特征选择是将特征选择过程嵌入到模型训练中,通过反复训练模型并评估特征的重要性来选择最佳的特征子集。

常见的包裹式特征选择方法包括递归特征消除和遗传算法。

递归特征消除是一种自底向上的贪心算法,通过反复训练模型并剔除最不重要的特征来选择最佳的特征子集。

遗传算法则是一种模拟自然选择的优化算法,通过模拟进化过程来搜索最佳的特征子集。

这些方法能够考虑特征之间的相互关系,但是计算复杂度较高。

三、嵌入式特征选择嵌入式特征选择是将特征选择过程融入到模型训练中,通过正则化项或其他约束来约束特征的重要性。

常见的嵌入式特征选择方法包括L1正则化和决策树剪枝。

L1正则化通过在损失函数中添加L1范数惩罚项来约束特征的重要性,能够将不重要的特征的权重置为零,从而实现特征选择的效果。

决策树剪枝则是通过剪枝操作来降低决策树模型的复杂度,从而实现特征选择的效果。

这些方法能够直接优化模型的性能,但是需要事先选择合适的模型和正则化参数。

四、特征选择技巧除了上述的特征选择方法,还有一些特征选择的技巧可以帮助我们更好地选择特征。

首先,我们可以通过特征重要性排序来选择最具有代表性的特征。

特征重要性可以通过模型的权重、特征的信息增益或其他指标来计算。

几种常用的特征选择方法

几种常用的特征选择方法特征选择是机器学习中非常重要的一个环节,通过选择合适的特征子集,可以提高模型的准确性、降低过拟合的风险,并减少计算成本。

以下是几种常用的特征选择方法:1. 过滤式特征选择(Filter feature selection):过滤式特征选择方法独立于机器学习算法,将特征子集选择作为单独的预处理步骤。

常见的过滤式方法有基于相关性的选择、方差选择和互信息选择等。

- 基于相关性的选择:计算每个特征与目标变量之间的相关性,选取相关性较高的特征。

例如,皮尔逊相关系数可以用于评估线性相关性,而Spearman相关系数可用于评估非线性相关性。

-方差选择:计算特征的方差,并选择方差较高的特征。

方差较高的特征在总体上具有更多的信息。

-互信息选择:计算每个特征与目标变量之间的互信息,选取互信息较高的特征。

互信息是度量两个变量之间相关性的一种方法。

2. 包裹式特征选择(Wrapper feature selection):包裹式方法将特征选择作为机器学习算法的一部分,通过评估模型的性能来选择特征。

常见的包裹式方法有递归特征消除(RFE)和遗传算法等。

-递归特征消除:通过反复训练模型并消除不重要的特征来选择特征。

该方法从所有特征开始,每次迭代都使用模型评估特征的重要性,并剔除最不重要的特征,直到选择指定数量的特征。

-遗传算法:通过模拟生物进化过程,使用交叉和变异操作来最佳的特征子集。

该方法可以通过评估特征子集的适应度来选择特征,适应度一般通过模型的性能进行度量。

3. 嵌入式特征选择(Embedded feature selection):嵌入式方法将特征选择与机器学习算法的训练过程相结合,通过优化算法自动选择特征。

常见的嵌入式方法有L1正则化(L1 regularization)和决策树算法等。

-L1正则化:L1正则化可以使得训练模型的系数稀疏化,从而实现特征选择。

L1正则化会增加模型的稀疏性,使得部分系数为0,从而对应的特征被选择。

如何利用神经网络进行数据降维与特征选择

如何利用神经网络进行数据降维与特征选择神经网络是一种模仿人脑神经系统的计算模型,它以其强大的处理能力和优秀的学习能力在各个领域得到了广泛应用。

在数据分析和机器学习领域,神经网络也扮演着重要的角色。

本文将探讨如何利用神经网络进行数据降维与特征选择。

数据降维是指通过一定的数学变换将高维数据映射到低维空间,以减少特征维度并保留数据的主要信息。

神经网络在数据降维中具有独特的优势。

首先,神经网络可以通过自动学习数据的非线性关系来提取特征,相比传统的线性降维方法,神经网络能够更好地捕捉到数据的复杂结构。

其次,神经网络可以通过深层结构来逐层提取特征,从而更好地保留数据的重要信息。

最后,神经网络的训练过程中使用了反向传播算法,可以通过最小化损失函数来优化模型参数,从而更好地适应数据。

在实际应用中,常用的神经网络降维方法有自编码器和主成分分析。

自编码器是一种无监督学习的神经网络模型,它通过将输入数据压缩成低维编码再解码重构,实现数据的降维。

自编码器的编码层可以看作是数据的特征提取器,通过训练自编码器,可以得到一组较低维度的特征表示。

主成分分析是一种常用的线性降维方法,通过求解数据的协方差矩阵的特征值和特征向量,可以得到一组与原始数据无关的主成分,从而实现数据的降维。

除了数据降维,特征选择也是数据分析中的重要环节。

特征选择的目标是从原始特征集中选择出一组最具有代表性的特征子集,以提高模型的性能和泛化能力。

神经网络在特征选择中也有一定的应用。

首先,神经网络可以通过权重的大小来判断特征的重要性,权重越大的特征对模型的影响越大,可以作为特征选择的依据。

其次,神经网络可以通过正则化方法(如L1正则化)来约束模型的参数,使得部分特征的权重趋于零,从而实现特征的选择。

此外,神经网络还可以通过特征的重要性排序来进行特征选择,排在前面的特征被认为是最具有代表性的特征。

在实际应用中,为了更好地利用神经网络进行数据降维与特征选择,有几点需要注意。

图像识别中的特征选择方法综述(四)

图像识别中的特征选择方法综述引言:图像识别是近年来备受关注的研究领域。

随着计算机视觉的快速发展,图像识别技术已经被广泛应用于各个领域,如医学影像分析、安防监控和自动驾驶等。

在图像识别中,特征选择是一个关键的步骤,它能够从海量的数据中选取具有代表性的特征,提高图像识别的准确性与效率。

本文将综述当前常用的图像识别中的特征选择方法。

一、传统特征选择方法尺度不变特征变换(SIFT)SIFT是一种基于局部特征的图像描述子,它能够提取图像中的关键点,并计算这些关键点的特征描述子。

SIFT特征具有尺度不变性和旋转不变性等优点,在目标识别和图像匹配中得到了广泛应用。

主成分分析(PCA)PCA是一种常用的线性降维方法,它通过对数据集中的特征进行正交变换,将原始特征转化为新的低维特征。

PCA可以实现特征的压缩和去冗余,有利于减少特征维度,提高分类准确率。

线性判别分析(LDA)LDA是一种监督学习算法,它通过最大化类内散度和最小化类间散度的方式,选择最具判别能力的特征。

LDA能够有效地提高分类器的准确性,并且在数据具有类别信息的情况下表现优异。

相关性分析(RFA)RFA是一种基于相关性的特征选择方法,它通过计算特征与目标变量之间的相关性,选择与目标变量相关性较高的特征。

RFA能够剔除掉与目标变量相关性较低的无用特征,提高分类器的性能。

二、基于深度学习的特征选择方法卷积神经网络(CNN)CNN是一种基于深度学习的图像识别模型,它能够自动学习图像的特征表示。

通过多层卷积和池化操作,CNN能够提取图像中的局部特征和全局特征,并进行融合,从而得到更具有判别性的图像特征。

循环神经网络(RNN)RNN是一种递归神经网络,具有记忆功能。

在图像识别中,RNN能够利用上下文信息,捕捉图像中的时序特征,识别出时序相关的物体以及它们之间的关系。

注意力机制(Attention)注意力机制是一种能够对图像中不同部分产生不同权重的方法。

通过学习图像中的关注重点,注意力机制能够选择具有重要性的特征,提高图像识别的性能。

特征选择方法

特征选择方法在机器学习领域中,特征选择是一个重要的预处理步骤,目的是从原始数据中选取最相关的特征用于模型训练和预测。

与全量特征相比,有选择地使用特征可以降低计算复杂度、提高模型泛化性能以及减少数据维度。

在特征选择方法的研究中,主要有三个方向:过滤法、包装法和嵌入法。

一、过滤法过滤法是将特征选择作为一个独立的过程,通过特征排序或者评估函数来选择最好的特征子集。

其主要优点是快速简洁,不涉及模型构建,不需要对特征子集中的特征进行组合,多用于数据初始处理和预处理。

常用的过滤法有 ReliefF 特征选择、卡方检验、互信息、皮尔逊相关、t检验与平均差异度等。

其中,ReliefF 特征选择算法是最具代表性的过滤法之一。

该算法通过计算每个特征对类别的贡献度来选择最相关的特征。

一般而言,该算法被用于处理带有噪声的多类不平衡数据集,该类方法属于加权型特征选择算法,但是在选取特征时能够考虑不同类别中的样本权重,提高了选取特征的准确性。

二、包装法包装法是将特征选择和模型构建联系起来的方法,即在每一次模型训练过程中对特征子集进行选择,从而提高模型预测性能。

这种方法的优点在于能够更好地适应模型,尤其是个性化和复杂模型中。

包装法的缺点在于计算代价较大。

代表性的包装法有基于遗传算法(GA)的特征选择、递归特征消除(RFE)和贪婪增量算法(GIA)。

递归特征消除是一种经典的包装法之一,基于一个全量特征子集训练出来的模型,依次递归地删除无关紧要的特征,直到达到预设的特征个数或者准确率为止。

通过这样的过程,达到筛选出对模型影响最大的特征子集的目的,并且最终留下到的特征子集不会过于冗余。

三、嵌入法嵌入法是在模型训练的过程中直接学习出最优特征子集的方法。

这种方法能够有效简化特征选择过程,同时减少特征子集中的冗余特征。

嵌入法有点类似于包装法,但是不同之处在于它是在模型训练过程中进行的,是从模型构建的角度去考虑特征的。

常见的嵌入法有 L1 正则化、决策树方法、支持向量机(SVM)等。

神经网络中的特征选择方法与效果评估

神经网络中的特征选择方法与效果评估引言:在机器学习领域,特征选择是一个重要的任务,它能够帮助我们从海量的特征中选择出对于目标任务最有用的特征,从而提高模型的性能和效率。

神经网络作为一种强大的机器学习模型,特征选择在其中也具有重要的作用。

本文将介绍神经网络中常用的特征选择方法,以及如何评估这些方法的效果。

一、过滤式特征选择方法过滤式特征选择方法是在训练神经网络之前,通过一些统计指标或者模型无关的方法对特征进行排序,然后选择排名靠前的特征作为输入。

常用的过滤式特征选择方法有相关系数、方差分析、互信息等。

1. 相关系数相关系数是一种衡量两个变量之间关联程度的统计量。

在特征选择中,我们可以计算每个特征与目标变量之间的相关系数,然后选择相关系数较高的特征作为输入。

然而,相关系数只能衡量线性关系,对于非线性关系的特征选择效果较差。

2. 方差分析方差分析是一种用于比较两个或多个样本均值是否有显著差异的统计方法。

在特征选择中,我们可以计算每个特征在不同类别之间的方差,然后选择方差较大的特征作为输入。

方差分析可以帮助我们发现类别之间的差异,但是对于类别内部的差异不敏感。

3. 互信息互信息是一种衡量两个随机变量之间关联程度的统计量。

在特征选择中,我们可以计算每个特征与目标变量之间的互信息,然后选择互信息较高的特征作为输入。

互信息不仅能够衡量线性关系,还能够衡量非线性关系,因此在特征选择中表现较好。

二、包裹式特征选择方法包裹式特征选择方法是在训练神经网络过程中,通过不断调整特征子集的组合,从而选择出最佳的特征子集作为输入。

常用的包裹式特征选择方法有遗传算法、贪婪搜索等。

1. 遗传算法遗传算法是一种模拟生物进化过程的优化算法。

在特征选择中,我们可以将每个特征看作一个基因,然后通过交叉、变异等操作来生成新的特征子集,并根据神经网络的性能来评估特征子集的好坏。

遗传算法能够在特征空间中进行全局搜索,但是计算复杂度较高。

2. 贪婪搜索贪婪搜索是一种启发式的搜索算法,它通过不断选择当前最优的特征来构建特征子集。

神经网络中的特征选择方法比较

神经网络中的特征选择方法比较神经网络是一种强大的机器学习模型,它可以通过学习数据的模式和规律来进行预测和分类。

然而,神经网络的性能很大程度上取决于输入特征的选择。

在神经网络中,特征选择是一个关键的步骤,它可以帮助我们提取最相关和最有用的特征,从而提高模型的性能和泛化能力。

特征选择是指从原始数据中选择最具有代表性和相关性的特征,以便用于训练和测试模型。

在神经网络中,特征选择可以通过多种方法实现。

下面我们将介绍几种常用的特征选择方法,并比较它们的优缺点。

首先,过滤式特征选择方法是一种常见的特征选择方法。

它通过计算特征与目标变量之间的相关性来选择特征。

常用的过滤式方法包括皮尔逊相关系数、互信息和卡方检验等。

这些方法可以帮助我们找到与目标变量高度相关的特征,但是它们忽略了特征之间的相互关系。

在神经网络中,特征之间的相互关系可能对模型的性能有重要影响,因此过滤式方法可能无法捕捉到这种关系。

其次,包裹式特征选择方法是一种更加精确但计算量较大的特征选择方法。

它通过将特征选择问题转化为一个优化问题,并使用搜索算法来找到最佳的特征子集。

常用的包裹式方法包括遗传算法、模拟退火算法和粒子群优化算法等。

这些方法可以考虑特征之间的相互关系,并找到最佳的特征子集,但是它们的计算复杂度较高,需要耗费大量的时间和计算资源。

此外,嵌入式特征选择方法是一种结合了过滤式和包裹式方法的特征选择方法。

它通过在模型训练过程中自动选择最佳的特征子集。

常用的嵌入式方法包括L1正则化、决策树和随机森林等。

这些方法可以在模型训练过程中自动选择最佳的特征子集,并且计算效率相对较高。

然而,嵌入式方法可能会受到模型选择的影响,选择不同的模型可能会得到不同的特征子集。

综上所述,神经网络中的特征选择方法有多种选择,每种方法都有其优缺点。

过滤式方法简单高效,但忽略了特征之间的相互关系;包裹式方法精确但计算复杂;嵌入式方法结合了过滤式和包裹式方法的优点,但可能受到模型选择的影响。

无线网络中的信号干扰检测方法研究

无线网络中的信号干扰检测方法研究随着无线通信技术的广泛应用,尤其是移动设备的普及,无线网络的需求越来越高。

然而,由于无线信号受到各种干扰的影响,如电磁波干扰、天气干扰等,导致无线网络的连接质量常常受到影响。

因此,研究无线网络中信号干扰检测方法具有重要意义。

信号干扰对于无线网络的影响无线网络中的信号干扰主要包括同频干扰和异频干扰两种类型。

同频干扰是指与目标信号处于相同频段的干扰信号,常见的有共址干扰、碰撞干扰等;异频干扰指在其他频段产生的干扰信号,如邻频干扰、间隔频干扰等。

信号干扰会导致无线网络中的信号质量下降,影响通信质量以及数据传输速度。

在严重情况下,信号干扰还可能导致无线网络的断连,从而降低用户体验和网络服务的稳定性。

传统的信号干扰检测方法在传统的无线网络中,常用的信号干扰检测方法主要包括频谱分析法、特征提取法以及机器学习等。

频谱分析法是最传统的信号干扰检测方法之一,它通过对无线信号的频谱进行分析来判断是否存在干扰信号。

频谱分析法的优点是简单易行,但是它仅仅通过频谱的变化来判断干扰信号,对于复杂的干扰信号往往无法有效检测。

特征提取法是通过提取无线信号的特征参数,构建特征空间,然后通过判别器判断是否存在干扰信号。

特征提取法相对频谱分析法来说,能够更好地处理信号的动态变化,但是对于不同类型的干扰信号,特征提取法的参数选择和构建较为困难,也存在一定的局限性。

机器学习方法是近年来被广泛研究和应用的信号干扰检测方法。

这种方法通过构建分类器来区分正常信号和干扰信号,具有较好的分类性能和鲁棒性。

目前,随着人工智能和深度学习的发展,基于深度学习的机器学习方法在信号干扰检测领域也取得了一定的成果。

基于深度学习的信号干扰检测方法深度学习是一种机器学习中的分支领域,其核心是构建和训练多层神经网络来进行模式识别和分类。

在信号干扰检测方面,基于深度学习的方法相对于传统的方法具有以下优势:1. 处理复杂的非线性关系:深度学习可以通过多层神经网络来学习和表示复杂的非线性关系,从而更好地处理复杂的干扰信号。

中文信息处理与挖掘知到章节答案智慧树2023年山东交通学院

中文信息处理与挖掘知到章节测试答案智慧树2023年最新山东交通学院第一章测试1.本课程将详细介绍的自然语言处理应用有哪些()。

参考答案:自动问答;情感分析;机器翻译;自动摘要2.下列那个概念与自然语言处理无关。

()参考答案:Computer Vision3.黏着型语言比较有代表性的语言是日语。

()参考答案:对4.自然语言中最小的有意义的构成单位是()。

参考答案:词5.中文信息处理的第一步是()。

参考答案:分词6.如果打开校正功能,对于一些典型的语法错误、拼写错误以及用词错误就可以自动检测出来。

( )参考答案:对7.就分词来讲,主要有三类分词方法()。

参考答案:基于规则的分词方法;基于词典的分词方法;基于统计的分词方法8.基于词典的分词方法从匹配的方法来讲,一般使用最大匹配法,而最匹配法又包括()。

参考答案:逆向最大匹配算法;双向最大匹配算法;正向最大匹配算法9.词性标注的主要方法主要有()。

参考答案:统计与规则相结合的词性标注方法;基于规则的词性标注方法;基于统计的词性标注方法10.命名实体识别事实上就是识别出以下三类命名实体。

()参考答案:人名;组织机构名;地名第二章测试1.概率论作为统计语言模型的数学基础,应用到自然语言处理领域,是由于:统计语言处理技术已经成为自然语言处理的主流,而在统计语言处理的步骤中,收集自然语言词汇(或者其他语言单位)的分布情况、根据这些分布情况进行统计推导都需要用到概率论。

()参考答案:对2.设E为随机试验,Ω是它的样本空间,对于E的每一个事件A赋予一个实数,记为P ( A ),如果集合函数P ( ⋅ )满足下列哪些条件,则实数P ( A )为事件A的概率。

()参考答案:规范性;非负性;可列可加性3.设A、B是两个事件,且P(B)>0,则称P(A|B)为在已知事件B发生的条件下,事件A发生的()。

参考答案:条件概率4.某一事件B的发生有各种可能的原因n个,B发生的概率是各原因引起B发生概率的总和,也就是()。

基于神经网络的特征选择与提取方法研究

总第 15期 3

基 于神 经 网络 的特 征 选 择 与提 取方 法研 究

贾花 萍

( 陕西渭 南师范学院 计算机科 学 系 渭 南 7 40 ) 10 0 ( 津 师 范 大 学 天 津 天 30 8 ) 0 3 7

摘 要 特征选择的基本任务是 如何从许多特征中找 出那些最有效的特征, 即研 究如何把高维特征空 间压缩到低维特征空间。特征 选择在数据挖掘、 图象处理 、 数据压缩 、 识别等诸多方面有 广泛 的应用, 模式 本文简介了神经 网络 的特征选择 与提取方法。 关键词 神经 网络 特征选择 提取

文 献标 识 码 A 文章 编 号 0 0 0 — 5 7 8 7 5 4 9 中 图分 类 号 T 3 91 P8.

F a u e Selc in an ta t n Me h d Ba e e t e t d Ex r c i t o s d r o o

o n Neu a t rl Ne wor k

mo tefc ie i . h w ih i n i n l e t r p c o r s i n c a a trsiso elw- me so a p c o - s fe t , . , o hg —d me so a au es a e c mp e so h r ce itc ft o di n in l a ei c n v e f h s s sd r d.Th r eawi er ng fa pl ainso e t r s lci n i aa mi i g i g r c s i g d t o r s in, ie e e e a d a e o p i to n f au e e e to n d t n n , ma ep o e sn , a ac mp e so r c patr e o n to a d S n. Th spa ri to u e h h r ce itc ft e n u a ewo k s l cin a d e ta t n te n r c g iin, n O o i pe n r d c s t ec a a t rsiso h e r ln t r ee to n xr c i o

人工智能应用测试题(附参考答案)

人工智能应用测试题(附参考答案)一、单选题(共40题,每题1分,共40分)1、卷积层是深度神经网络的主要结构之一,已经在大量任务中用到,下面哪一个任务的主流方法中没有用到卷积层A、中文分词B、中英文互译C、场景文字检测D、为图像自动生成描述标题正确答案:A2、近年来基于()的“DeepFakes”(深度伪造)技术应用,使得“换脸”虚假视频的制作门槛不断降低,大量深度伪造数据内容开始涌现。

A、lstmB、GANC、cnnD、rnn正确答案:B3、人工智能平台从结构上应分为公司级、省公司级、云侧、()侧和端侧。

A、中B、边C、后D、前正确答案:B4、语音识别的技术框架阶段顺序是?A、编码、训练、解码B、训练、编码、解码C、解码、训练、编码D、训练、解码、编码正确答案:A5、机器翻译属于下列哪个领域的应用?A、自然语言系统B、人类感官模拟C、专家系统D、机器学习正确答案:A6、在人脸识别系统中主要采用( )。

A、肤色识别B、亮度识别C、色彩识别D、轮廓特征识别正确答案:D7、以下哪一项在神经网络中引入了非线性操作?A、ReLU函数B、卷积函数C、随机梯度下降D、损失函数正确答案:A8、()为每位基层员工配置专属的写作模板,通过自动化获取专业管理和生产数据,让机器自主完成文章创作,过程无需人工干预,大大提高了结构化文档的产出效率。

A、智能写作B、人工写作C、智慧写作D、AI写作正确答案:A9、人工智能的近期目标是A、降低搭建成本B、实现自我学习C、超越人类D、实现机器智能正确答案:D10、样本库功能要求为:数据接入包括()文件导入、HDFS数据导入、FTP文件导入、NFS数据导入和数据库数据导入。

A、远程B、云端C、SAMBAD、本地正确答案:D11、以下关于分词说法不正确的是?A、在实际工程应用中,分词一般只采用一种分词方法。

B、中文不同于英文自然分词,中文分词是文本处理的一个基础步骤。

分词性能的好坏直接影响比如词性、句法树等其他模块的性能。

神经网络中的特征重要性分析方法

神经网络中的特征重要性分析方法神经网络是一种模拟人脑神经元工作原理的计算模型,它通过大量的训练数据来学习和识别模式,并进行预测和分类。

在神经网络中,特征的选择和重要性分析是非常关键的,它们决定了网络的性能和泛化能力。

本文将探讨神经网络中的特征重要性分析方法。

一、特征选择的重要性特征选择是指从原始数据中选择出最具有代表性和区分性的特征,以减少数据维度和计算复杂度,提高模型的训练效果和泛化能力。

在神经网络中,特征选择可以帮助减少过拟合和噪声的影响,提高网络的鲁棒性和可解释性。

二、特征重要性分析的方法1. 信息增益(Information Gain)信息增益是一种常用的特征重要性分析方法,它通过计算特征对于分类任务的贡献程度来评估其重要性。

信息增益越大,表示特征对于分类的影响越大。

在神经网络中,可以通过计算特征在网络中的权重和激活值来评估其重要性。

2. 基尼系数(Gini Index)基尼系数是一种用于衡量数据集纯度和不纯度的指标,它可以用来评估特征的重要性。

基尼系数越小,表示特征对于分类的影响越大。

在神经网络中,可以通过计算特征在网络中的梯度和误差来评估其重要性。

3. L1正则化(L1 Regularization)L1正则化是一种常用的特征选择和重要性分析方法,它通过增加模型的稀疏性来减少特征的数量。

在神经网络中,可以通过添加L1正则化项来约束网络中的权重,从而实现特征选择和重要性分析。

4. DropoutDropout是一种常用的正则化方法,它可以通过随机丢弃网络中的部分神经元来减少过拟合。

在神经网络中,可以通过计算特征在网络中的丢弃率来评估其重要性。

5. 局部敏感度分析(Local Sensitivity Analysis)局部敏感度分析是一种通过改变特征值来评估特征重要性的方法,它可以通过计算特征值的变化对网络输出的影响程度来评估特征的重要性。

在神经网络中,可以通过计算特征在网络中的梯度和误差对特征值的敏感度来评估其重要性。

特征选择方法的比较分析

特征选择方法的比较分析特征选择是机器学习中重要的一环,它帮助我们确定对预测任务最有用的特征,减小了模型的复杂度和训练时间,并提高了模型的准确性。

然而,不同的特征选择方法具有不同的效果和使用场景。

在这篇文章中,我们将比较不同的特征选择方法及其优缺点。

1、过滤式特征选择过滤式特征选择是指在训练模型之前,对特征进行筛选,去掉与标记变量关系不大的特征。

其主要方法是基于特征之间的相关性、方差或信息增益等指标进行排序。

过滤式特征选择算法简单、容易实现,通常用于数据处理阶段。

然而,过滤式特征选择算法存在一定的局限性,如不能处理特征之间的关联性,只能从特征的维度入手,没有考虑特征的组合效应。

2、包裹式特征选择包裹式特征选择是指将特征选择作为模型的一部分,使用模型来评估特征的质量并进行筛选。

常用的包裹式特征选择算法包括递归特征消除和基于遗传算法的特征选择。

包裹式特征选择算法通常可以更准确地筛选出对模型最有用的特征,但是计算成本更高,训练时间更长。

3、嵌入式特征选择嵌入式特征选择是指将特征选择嵌入到机器学习的建模过程中,例如Lasso回归、Elastic Net等。

嵌入式特征选择算法可以同时进行特征选择和模型训练,具有较高的效率,而且可以在特征之间建立有效的关系,更好地利用特征信息。

然而,嵌入式特征选择算法需要评估每个特征的权重和影响,计算量比过滤和包裹式特征选择算法更大。

4、基于深度学习的特征选择随着深度学习的发展,它在特征提取和特征选择方面的应用越来越广泛。

基于深度学习的特征选择算法可以利用神经网络分层结构对特征进行自动提取和筛选,其主要方法包括Autoencoder、Deep Belief Networks和Convolutional Neural Networks。

这些算法在大数据集合和高维数据中表现良好,可以挖掘出更丰富的特征,但是需要更大的计算资源和更长的训练时间。

总的来说,不同的特征选择算法有各自的优劣和使用限制,需要根据实际的数据和任务需求进行选择。

特征选择方法

特征选择方法

特征选择在机器学习和数据挖掘任务中起着关键的作用。

它可以帮助我们从原始数据中选择出最具有预测能力的特征,以提高模型的性能和效果。

针对特征选择问题,常用的方法有:

1. 过滤法(Filter Method):该方法通过对特征进行统计学分析,如相关系数、卡方检验等,从中选择与目标变量最相关的特征。

常用的过滤法有相关系数法、信息增益法、方差选择法等。

2. 包裹法(Wrapper Method):该方法将特征选择看作是一个

搜索问题,通过不断地构建模型并评估性能,来确定最佳的特征子集。

常用的包裹法有递归特征消除法(RFE)和遗传算法等。

3. 嵌入法(Embedded Method):该方法是在学习算法的过程中,通过正则化(如L1正则化)或构建专门的特征选择模型,来对特征的重要性进行评估和选择。

常用的嵌入法有Lasso回归、岭回归等。

4. 基于树模型的方法:该方法通过决策树等树模型,根据特征的重要性进行特征选择。

常用的方法有信息增益、基尼系数等。

除了以上方法,还有一些其他的特征选择方法,如基于稳定性的方法、深度学习中的特征选择方法等。

这些方法可以根据具体的任务和数据集的特点来选择合适的方法进行特征选择。

特征选择的目的是为了去除无关特征、降低数据维度以及提高模型性能等。

正确选择合适的特征选择方法,可以帮助我们更好地理解数据并提高模型的预测能力。

图像识别中的特征选择方法综述(一)

图像识别是一项基于计算机视觉的技术,通过机器学习算法来识别和分类图像中的对象。

而图像识别中的特征选择方法的选择和优化对于准确度和效率的提升至关重要。

本文将对图像识别中的特征选择方法进行综述,介绍不同方法的原理和应用场景。

一、传统的特征选择方法1. 单变量特征选择单变量特征选择是一种简单但有效的特征选择方法,其基本原理是根据单个特征与输出变量之间的关联度进行选择。

例如,可以通过计算特征与输出变量之间的相关系数或使用统计量进行排序来选择重要的特征。

然而,这种方法忽略了特征之间的相互关系,可能导致选择不合适的特征。

2. 基于模型的特征选择基于模型的特征选择方法使用机器学习算法来评估特征的重要性,并选择对模型表现有贡献的特征。

例如,可以使用决策树、逻辑回归等算法进行特征选择。

这类方法考虑了特征之间的相互关系,但可能受到模型选择的影响。

3. 递归特征消除递归特征消除是一种迭代的特征选择方法,基于特征的重要性进行逐步的特征删除。

首先,训练一个模型,并计算特征的重要性。

然后,删除最不重要的特征,并重新训练模型。

重复这个过程,直到达到预设的特征数量或达到模型性能的最佳值。

这种方法的优点是可以找到最佳的特征子集,但计算开销较大。

二、基于深度学习的特征选择方法1. 卷积神经网络 (CNN)卷积神经网络是一种广泛应用于图像识别领域的深度学习模型。

CNN通过在图像上进行卷积操作提取图像的特征,然后使用全连接层进行分类。

CNN可以通过调整网络结构和参数来选择合适的特征。

2. 自编码器自编码器是一种非监督学习的神经网络模型,用于学习输入数据的高维表示。

自编码器包括一个编码器和一个解码器,通过最小化输入与解码器输出之间的重建误差来学习特征表示。

可以通过剪枝自编码器网络中的权重来选择重要的特征。

3. 迁移学习迁移学习是一种通过在不同任务中共享特征来提高模型性能的方法。

可以使用预训练好的模型来提取图像的特征,然后将这些特征用于新任务的训练。

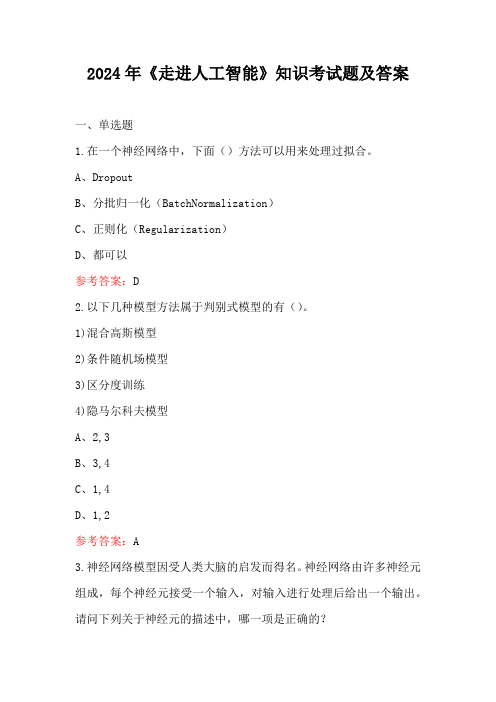

2024年《走进人工智能》知识考试题及答案

2024年《走进人工智能》知识考试题及答案一、单选题1.在一个神经网络中,下面()方法可以用来处理过拟合。

A、DropoutB、分批归一化(BatchNormalization)C、正则化(Regularization)D、都可以参考答案:D2.以下几种模型方法属于判别式模型的有()。

1)混合高斯模型2)条件随机场模型3)区分度训练4)隐马尔科夫模型A、2,3B、3,4C、1,4D、1,2参考答案:A3.神经网络模型因受人类大脑的启发而得名。

神经网络由许多神经元组成,每个神经元接受一个输入,对输入进行处理后给出一个输出。

请问下列关于神经元的描述中,哪一项是正确的?A、每个神经元只有一个输入和一个输出B、每个神经元有多个输入和一个输出C、每个神经元有一个输入和多个输出D、每个神经元有多个输入和多个输出E、上述都正确参考答案:E4.生成对抗网络像是一个博弈系统,生成器生成伪造的样本,判别器判断是真是假,我们理想的结果是()。

A、生成器产生的样本大致相同B、判别器高效的分辨生成器产生样本的真假C、判别器无法分辨生成器产生样本的真假D、生成器产生的样本不尽相同参考答案:C5.已知:1)大脑是有很多个叫做神经元的东西构成,神经网络是对大脑的简单的数学表达。

2)每一个神经元都有输入、处理函数和输出。

3)神经元组合起来形成了网络,可以拟合任何函数。

4)为了得到最佳的神经网络,我们用梯度下降方法不断更新模型。

给定上述关于神经网络的描述,()什么情况下神经网络模型被称为深度学习模型?A、加入更多层,使神经网络的深度增加B、有维度更高的数据C、当这是一个图形识别的问题时D、以上都不正确参考答案:A6.梯度下降算法的正确步骤是什么?1)计算预测值和真实值之间的误差2)重复迭代,直至得到网络权重的最佳值3)把输入传入网络,得到输出值4)用随机值初始化权重和偏差5)对每一个产生误差的神经元,调整相应的(权重)值以减小误差A、1,2,3,4,5B、5,4,3,2,1C、3,2,1,5,4D、4,3,1,5,2参考答案:D7.如果一个模型在测试集上偏差很大,方差很小,则说明该模型()。

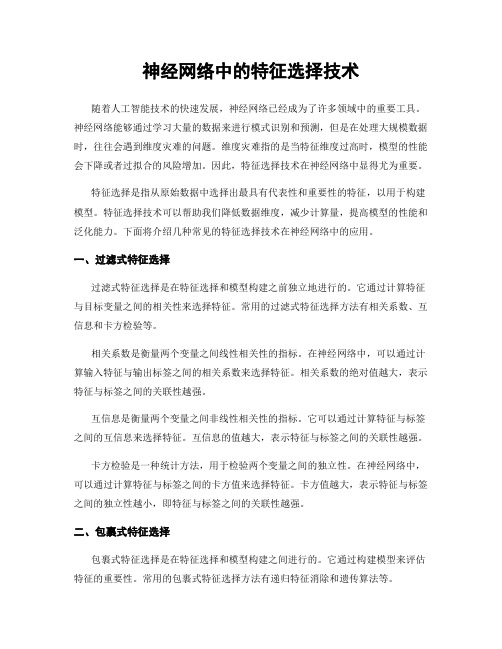

神经网络中的特征选择技术

神经网络中的特征选择技术随着人工智能技术的快速发展,神经网络已经成为了许多领域中的重要工具。

神经网络能够通过学习大量的数据来进行模式识别和预测,但是在处理大规模数据时,往往会遇到维度灾难的问题。

维度灾难指的是当特征维度过高时,模型的性能会下降或者过拟合的风险增加。

因此,特征选择技术在神经网络中显得尤为重要。

特征选择是指从原始数据中选择出最具有代表性和重要性的特征,以用于构建模型。

特征选择技术可以帮助我们降低数据维度,减少计算量,提高模型的性能和泛化能力。

下面将介绍几种常见的特征选择技术在神经网络中的应用。

一、过滤式特征选择过滤式特征选择是在特征选择和模型构建之前独立地进行的。

它通过计算特征与目标变量之间的相关性来选择特征。

常用的过滤式特征选择方法有相关系数、互信息和卡方检验等。

相关系数是衡量两个变量之间线性相关性的指标。

在神经网络中,可以通过计算输入特征与输出标签之间的相关系数来选择特征。

相关系数的绝对值越大,表示特征与标签之间的关联性越强。

互信息是衡量两个变量之间非线性相关性的指标。

它可以通过计算特征与标签之间的互信息来选择特征。

互信息的值越大,表示特征与标签之间的关联性越强。

卡方检验是一种统计方法,用于检验两个变量之间的独立性。

在神经网络中,可以通过计算特征与标签之间的卡方值来选择特征。

卡方值越大,表示特征与标签之间的独立性越小,即特征与标签之间的关联性越强。

二、包裹式特征选择包裹式特征选择是在特征选择和模型构建之间进行的。

它通过构建模型来评估特征的重要性。

常用的包裹式特征选择方法有递归特征消除和遗传算法等。

递归特征消除是一种迭代的特征选择方法。

它通过构建模型并计算特征的重要性来选择特征。

然后,去除最不重要的特征,再次构建模型,重复这个过程,直到达到指定的特征数目为止。

遗传算法是一种优化算法,用于寻找最优解。

在神经网络中,可以将特征选择问题看作是一个优化问题,并使用遗传算法来选择最优的特征子集。

神经网络中的特征选择和降维方法

神经网络中的特征选择和降维方法在机器学习和数据分析领域,特征选择和降维是两个重要的技术,用于减少数据集的维度和提取最相关的特征。

在神经网络中,特征选择和降维方法可以帮助我们更好地理解数据和提高模型的性能。

本文将介绍神经网络中常用的特征选择和降维方法。

一、特征选择方法特征选择是指从原始特征集中选择出一部分最相关的特征,用于构建模型。

常用的特征选择方法有过滤法、包装法和嵌入法。

1. 过滤法过滤法是一种基于特征本身的统计性质进行特征选择的方法。

常用的过滤法包括相关系数法、卡方检验法和信息增益法。

相关系数法通过计算特征与目标变量之间的相关系数,选择相关性较高的特征。

卡方检验法则是通过计算特征与目标变量之间的卡方统计量,选择卡方值较大的特征。

信息增益法则是通过计算特征对目标变量的信息增益,选择信息增益较大的特征。

2. 包装法包装法是一种基于模型性能进行特征选择的方法。

它通过不断地训练模型,并根据模型的性能评估指标选择特征。

常用的包装法有递归特征消除法和遗传算法。

递归特征消除法是一种逐步剔除特征的方法,每次剔除一个特征,并重新训练模型,直到模型的性能下降为止。

遗传算法则是通过模拟生物进化过程,不断地选择和交叉特征,以找到最优的特征子集。

3. 嵌入法嵌入法是一种将特征选择嵌入到模型训练过程中的方法。

常用的嵌入法有L1正则化和决策树算法。

L1正则化是一种添加L1范数惩罚项的方法,可以使得模型的权重稀疏化,从而实现特征选择的目的。

决策树算法则是通过计算特征的重要性,选择重要性较高的特征。

二、降维方法降维是指将高维数据映射到低维空间的过程,旨在减少数据的维度和保留最重要的信息。

常用的降维方法有主成分分析(PCA)和线性判别分析(LDA)。

1. 主成分分析(PCA)主成分分析是一种无监督学习的降维方法,通过线性变换将原始特征映射到新的特征空间中。

它的目标是找到新的特征空间上方差最大的方向,从而实现数据的降维。

主成分分析可以通过计算协方差矩阵的特征值和特征向量来实现。

基于深度学习的人脸表情识别算法

基于深度学习的人脸表情识别算法随着人工智能技术的不断发展,深度学习在各个领域都取得了显著的成果。

其中,基于深度学习的人脸表情识别算法引起了广泛的关注。

人脸表情识别算法可以通过分析人脸图像中的表情特征,准确地判断出人脸所表达的情绪状态,具有重要的应用价值。

本文将介绍基于深度学习的人脸表情识别算法的原理、方法和应用。

一、深度学习在人脸表情识别中的应用深度学习是一种模拟人脑神经网络的机器学习方法,通过多层神经网络的组合,可以实现对复杂数据的高效处理和分析。

在人脸表情识别中,深度学习算法可以通过学习大量的人脸图像数据,提取出人脸表情的特征,并建立起表情和情绪之间的关联模型。

二、基于深度学习的人脸表情识别算法原理基于深度学习的人脸表情识别算法主要包括以下几个步骤:数据预处理、特征提取、特征选择和分类器设计。

1. 数据预处理:首先,需要对人脸图像进行预处理,包括图像去噪、归一化、人脸检测和关键点标定等。

这些预处理步骤可以提高后续特征提取的准确性和稳定性。

2. 特征提取:在深度学习中,卷积神经网络(CNN)是一种常用的特征提取方法。

通过多层卷积和池化操作,CNN可以逐层提取图像的高级特征。

在人脸表情识别中,可以使用预训练好的CNN模型,如VGGNet、ResNet等,提取人脸图像的特征。

3. 特征选择:在特征提取之后,需要对提取到的特征进行选择和降维。

常用的特征选择方法包括主成分分析(PCA)、线性判别分析(LDA)等。

这些方法可以减少特征的维度,提高分类器的效率和准确性。

4. 分类器设计:最后,需要设计一个有效的分类器来对人脸表情进行识别。

常用的分类器包括支持向量机(SVM)、随机森林(Random Forest)等。

这些分类器可以根据提取到的特征,对人脸表情进行分类和识别。

三、基于深度学习的人脸表情识别算法方法基于深度学习的人脸表情识别算法有多种方法,其中最常用的是基于卷积神经网络的方法。

这种方法通过多层卷积和池化操作,逐层提取人脸图像的特征,并通过全连接层将特征映射到不同的表情类别。

深度神经网络模型中的特征选择与降维方法

深度神经网络模型中的特征选择与降维方法随着机器学习和人工智能的发展,深度神经网络(Deep Neural Networks,DNNs)在数据分析和模式识别任务中取得了显著的成功。

然而,DNNs往往需要大量的特征输入,并且这些特征可能包含大量冗余信息和噪声,从而影响模型的性能和效率。

为了解决这个问题,特征选择和降维变得至关重要。

特征选择(Feature Selection)是从原始特征集合中选择一些最有信息量的特征,以提高模型的性能和简化问题的复杂度。

特征选择可以分为三种类型:过滤方法(Filter)、包装方法(Wrapper)和嵌入方法(Embedded)。

过滤方法是一种基于特征间关系的预处理方法,它通过计算特征与输出之间的相关性或信息增益等指标,排除冗余和无关的特征。

其中,相关性分析(Correlation Analysis)可以用来度量特征与输出之间的线性关系,互信息(Mutual Information)可以衡量特征对输出的非线性依赖关系。

此外,还有基于统计检验(Statistical Test)的方法,如卡方检验(Chi-squared Test)和方差分析(ANOVA)。

这些过滤方法能够快速筛选出相关性强的特征,但忽略了特征之间的相互作用和后续模型选择的因素,可能导致选出的特征组合并不是最优的。

包装方法通过将特征选择嵌入到模型的训练过程中,来评估特征的贡献和重要性。

其中,递归特征消除(Recursive Feature Elimination,RFE)是一种常用的包装方法。

RFE将一个初始模型应用于特征集合,并根据特征对模型预测性能的贡献选择特征,并逐步进行特征消除,直到达到指定的特征数量或满足特定的停止准则。

尽管包装方法可以找到较为准确的特征子集,但其计算开销较大。

嵌入方法是将特征选择和模型训练同时进行,在模型的训练过程中学习出最佳的特征子集。

常见的嵌入方法有L1正则化(L1 Regularization)和树模型(Tree-based Models)。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

0 引言

人工神经网络是由大量简单元件相互连接而成的复杂网 络 ,具有高度的非线性 ,能够进行复杂的逻辑操作和非线性关 系实现的系统 。

43 4

计算机应用

2006年

feature ranking, DA )将所有特征按照重要程度排列成一个特 征队列 ,然后利用正则化的 BP神经网络 [6 ]来选择显著特征 集合 。在下文中将这种新方法简称为 DA&NN。

1 DA &NN

基于神经网络的特征选择方法可以看作是一种结构修剪

法 ,在特征选择过程中通过剪掉一些不相关的输入特征 ,达到 减少特征个数的目的 。然而怎样度量特征的重要性程度 ,这 是一个比较关键的问题 。通常不同方法采用不同的指数来衡

1 P nL p =1

j =1

f ′( aLjp )

(1)

从式 ( 1) 可以看出 ,所添加的二项有效地限制了传输函

数的导数 ,使得隐含层和输出层的神经元工作在饱和区域内 。

利用限制隐含层传输函数导数的正则化神经网络具有很好的

泛化能力 。在用网络来解决一个问题时 ,要想使网络获得最低

的泛化误差 ,必须要求隐含层和输出层中各个节点具有不同

Abstract: A new app roach for feature selection based on discrim inant analysis and regularization neural network was p roposed. The neural network was trained by m inim izing an augmented cross2entropy error function. The augmented error function forces the neural network to keep low derivatives of the transfer functions of neurons when learning a classification task. Such an app roach reduced output sensitivity to the input changes. Firstly a feature queue in order could be obtained by using discrim inant analysis based feature ranking. Feature selection was based on the reaction of the cross2validation data set classification error due to the removal of the individual features. The app roach p roposed was compared w ith four other feature selection methods, each of which banks on a different concep t. The algorithm p roposed outperform s the other methods by achieving higher classification accuracy on all the p roblem s tested.

-

trX / i ( Sb ) trX / i ( Sw )

可以从理论上证明 : J i ( X ) 的值越大 , 所对应的第 i个特

征的重要性程度就越大 。于是按照 J i ( X ) 值的大小 ,将 Q个特

征从小到大排列成一个有序的队列 。

1. 2 正则化 B P神经网络 本文使用的是一个三层前馈型的神经网络 。( x1 , x2 , …,

的敏感度

,

所以在误差函

数

中使

用

了

α 1

,α2

这

2个正则化参

数 ,这 2个参数的取值可以通过实验来获得 。式 ( 1) 中 P为训

练样本的个数 , ahkp、aLjp分别为输入为第 p个数据时隐含层中第 k个神经元和输出层第 j个神经元的输入值 ,其计算公式分别

为:

N

nh

∑ ∑ ahkp =

w

0 ik

(mail_yangyang@163. com ) 摘 要 :为了获得重要的特征集合 ,提出了一种基于判别式分析算法和神经网络的特征选择方 法 。通过最小化扩展互熵误差函数来训练神经网络 ,这一误差函数的使用减小了神经网络传输函数 的导数 ,降低了输出敏感度 。该方法首先利用判别式分析算法得到一个有序的特征队列 ,然后通过正 则化神经网络进行特征的选择 ,特征选择过程是基于单个特征的移除带来验证数据集上分类误差变 化这一原理 。与其他基于不同原理的四种方法进行了比较 ,实验结果表明 ,利用该算法训练的网络能 够获得较高分类准确率 。 关键词 :特征选择 ;神经网络 ;判别式分析 ;正则化 ;分类 中图分类号 : TP18 文献标识码 : A

xip

,

aLjp

=

w

h ij

ohip

i =0

i =0

其中 w0ik 为网络第 i个输入与输入层第 k个神经元之间的

其中 NNFS方法采用最小化扩展互熵误差函数来训练网 络 ,使得连接重要特征的权和无用特征的权在数值上存在很 大的差别 。该方法采用正则化神经网络 ,在训练中使用了互 熵误差函数 ,并添加了权值衰退项和网络中非零输入权值的 总数估计项作为正则化项 。权值衰退算法总是试图得到较小

的权值 ,通常会导致较小的神经元输入和较大的 sigmoid 导 数 ,这也加大了输出相对于输入的敏感度 。从表 1、2 和 3 中 NNFS所对应的数据 ,可以发现利用所有特征所得到的测试 集上的准确率和利用选择的特征所得到的准确率相差很大 , 这正是由于较高敏感度所带来的弊端 。基于权值的特征显著 性估量方法都是以这样一个理论为基础的 :连接重要特征的 权值会达到绝对大 ,而连接无用特征的权值比较小 ,在一些地 方可能会接近 0。 SNR方法是一种基于权值的特征显著性估 量方法 ,该方法首先取一个噪音特征作为参考 ,采用一个特征 显著性量度估计公式将所有特征排列成一个有序的特征队 列 ,然后通过神经网络来筛选特征 。 FQ I方法首先利用多层 感知机学习一个数据集 ,计算出每一个特征对应的特征品质 指数 ( the Feature Quality Index) ,根据所得到的数值大小将特 征按照顺序排列 ,再通过神经网络来选择重要特征 。OFE I方 法利 用 了 一 个 特 征 全 面 评 估 指 数 ( the Overall Feature Evaluation Index)来排列所有特征 ,最后利用神经网络选择符 合要求的显著特征集 。

人们提出了很多基于神经网络的特征选择方法 ,其中比 较典 型 的 方 法 有 神 经 网 络 特 征 选 择 器 [1 ] (Neural2Network Feature Selector, NNFS) 、基于信噪比的方法 [2 ] ( Signal2to2Noise Ratio based technique, SNR ) 、基于神经网络输出灵敏度的特 征 排 列 [3 ] ( Neural network output sensitivity based feature ranking,由于算法中采用了 the Feature Quality Index,因此简 称为 FQ I) 、基于模糊熵的特征排列 [4 ] ( Fuzzy entropy based feature ranking, 算 法 中 采 用 了 参 数 the Overall Feature Evaluation Index,因此简称 OFE I) 。

Nj

∑ 1

m j = N j k =1 X jk 其中 , m j代表数据样本中属于第 j类的输入均向量 , N j为 数据样本中属于第 j类的样本个数 , Xjk 为样本数据中属于第 j 类的第 k个样本的输入向量 。然后计算出整个输入数据的均

向量 m。

nL

∑ m =

Pjm j

j=1

其中 , Pj 为样本中属于第 j类的先验概率 , 这一概率可以

Fea ture selection approach ba sed on d iscr im inan t ana lysis and neura l networks

WU Yan, YANG Yang (D epa rtm en t of Com pu ter S cience and Technology, Tong ji U n iversity, S hangha i 200092, Ch ina)

第 26卷第 2期 2006年 2月

计算机应用 Computer App lications

Vol. 26 No. 2 Feb. 2006

文章编号 : 1001 - 9081 (2006) 02 - 0433 - 03

基于判别式分析和神经网络的特征选择方法

武 妍 ,杨 洋 (同济大学 计算机科学与技术系 , 上 200092)

根据实际数据样本集计算获得 , nL 为类别总个数 。下面分别

定义一个类别内的协方差矩阵 Sw 和一个类别间的协方差矩

阵 Sb。

∑ ∑ NL

1

Sw = j =1 Pj N j

( Xjk - m j ) ( Xjk - m j ) t

NL

∑ ∑ Sb =

Pj (m j - m ) (m j - m ) t

j=1

利用矩阵 Sw 和 Sb 可定义一个用于特征排列的判别函数