NVIDIA显卡发展史

n卡命名规则

n卡命名规则摘要:1.n 卡命名规则简介2.n 卡命名规则的历史变迁3.n 卡命名规则的具体内容4.为什么需要命名规则5.命名规则的意义和作用正文:卡是NVIDIA 公司生产的一款显卡产品,为了方便区分和标识,NVIDIA 公司制定了一套n 卡命名规则。

本文将对n 卡命名规则进行详细介绍。

卡命名规则历史悠久,从上世纪90 年代NVIDIA 公司成立之初就开始使用。

随着时间的推移,命名规则也经历了一些变化,以适应市场需求和产品技术的发展。

最早的命名规则主要是以数字和字母组合的形式来表示显卡的性能和定位,如TNT、GeForce 等。

后来,为了更好地反映显卡的性能水平,NVIDIA 公司开始采用以数字为主,后面跟随字母的方式,如GeForce 8800GTX。

目前的n 卡命名规则主要包括三个部分:前缀、数字和后缀。

前缀主要是用来表示显卡的系列和定位,如“GTX”表示高端显卡,“GT”表示中端显卡,“G”表示入门级显卡。

数字部分则是表示显卡的性能水平,数字越大,性能越强。

后缀主要是用来区分显卡的特色功能,如“TI”表示显卡具有更高的性能,“SE”表示简化版显卡。

为了更好地理解n 卡命名规则,我们以GeForce GTX 1080 Ti 为例进行说明。

其中,“GeForce”是前缀,表示这是一款针对游戏玩家的显卡;“GTX 1080 Ti”是数字部分,其中“1080”表示显卡的性能水平,而“Ti”是后缀,表示这款显卡具有更高的性能。

命名规则对于消费者、厂商和开发者来说都非常重要。

首先,命名规则可以帮助消费者更直观地了解显卡的性能和定位,从而更容易选择适合自己的产品。

其次,命名规则也有助于厂商对产品进行定位和差异化,提高市场竞争力和品牌形象。

最后,命名规则对于开发者来说也非常重要,因为开发者在编写软件时需要针对不同性能的显卡进行优化,命名规则可以帮助开发者快速了解显卡性能,从而更好地进行优化工作。

总之,n 卡命名规则是一种简单直观且易于理解的标识方法,对于消费者、厂商和开发者来说都具有重要意义。

NVIDIA显卡架构简介

An Introduction to Modern GPU ArchitectureAshu RegeDirector of Developer TechnologyAgenda•Evolution of GPUs•Computing Revolution•Stream Processing•Architecture details of modern GPUsEvolution of GPUs(1995-1999)•1995 –NV1•1997 –Riva 128 (NV3), DX3•1998 –Riva TNT (NV4), DX5•32 bit color, 24 bit Z, 8 bit stencil •Dual texture, bilinear filtering•2 pixels per clock (ppc)•1999 –Riva TNT2 (NV5), DX6•Faster TNT•128b memory interface•32 MB memory•The chip that would not die☺Virtua Fighter (SEGA Corporation)NV150K triangles/sec 1M pixel ops/sec 1M transistors16-bit color Nearest filtering1995(Fixed Function)•GeForce 256 (NV10)•DirectX 7.0•Hardware T&L •Cubemaps•DOT3 –bump mapping •Register combiners•2x Anisotropic filtering •Trilinear filtering•DXT texture compression • 4 ppc•Term “GPU”introducedDeus Ex(Eidos/Ion Storm)NV1015M triangles/sec 480M pixel ops/sec 23M transistors32-bit color Trilinear filtering1999NV10 –Register CombinersInput RGB, AlphaRegisters Input Alpha, BlueRegistersInputMappingsInputMappingsABCDA op1BC op2DAB op3CDRGB FunctionABCDABCDAB op4CDAlphaFunctionRGBScale/BiasAlphaScale/BiasNext Combiner’sRGB RegistersNext Combiner’sAlpha RegistersRGB Portion Alpha Portion(Shader Model 1.0)•GeForce 3 (NV20)•NV2A –Xbox GPU •DirectX 8.0•Vertex and Pixel Shaders•3D Textures •Hardware Shadow Maps •8x Anisotropic filtering •Multisample AA (MSAA)• 4 ppcRagnarok Online (Atari/Gravity)NV20100M triangles/sec 1G pixel ops/sec 57M transistors Vertex/Pixel shadersMSAA2001(Shader Model 2.0)•GeForce FX Series (NV3x)•DirectX 9.0•Floating Point and “Long”Vertex and Pixel Shaders•Shader Model 2.0•256 vertex ops•32 tex+ 64 arith pixel ops •Shader Model 2.0a•256 vertex ops•Up to 512 ops •Shading Languages •HLSL, Cg, GLSLDawn Demo(NVIDIA)NV30200M triangles/sec 2G pixel ops/sec 125M transistors Shader Model 2.0a2003(Shader Model 3.0)•GeForce 6 Series (NV4x)•DirectX 9.0c•Shader Model 3.0•Dynamic Flow Control inVertex and Pixel Shaders1•Branching, Looping, Predication, …•Vertex Texture Fetch•High Dynamic Range (HDR)•64 bit render target•FP16x4 Texture Filtering and Blending 1Some flow control first introduced in SM2.0aFar Cry HDR(Ubisoft/Crytek)NV40600M triangles/sec 12.8G pixel ops/sec 220M transistors Shader Model 3.0 Rotated Grid MSAA 16x Aniso, SLI2004Far Cry –No HDR/HDR ComparisonEvolution of GPUs (Shader Model 4.0)• GeForce 8 Series (G8x) • DirectX 10.0• • • • Shader Model 4.0 Geometry Shaders No “caps bits” Unified ShadersCrysis(EA/Crytek)• New Driver Model in Vista • CUDA based GPU computing • GPUs become true computing processors measured in GFLOPSG80 Unified Shader Cores w/ Stream Processors 681M transistorsShader Model 4.0 8x MSAA, CSAA2006Crysis. Images courtesy of Crytek.As Of Today…• • • • GeForce GTX 280 (GT200) DX10 1.4 billion transistors 576 mm2 in 65nm CMOS• 240 stream processors • 933 GFLOPS peak • 1.3GHz processor clock • 1GB DRAM • 512 pin DRAM interface • 142 GB/s peakStunning Graphics RealismLush, Rich WorldsCrysis © 2006 Crytek / Electronic ArtsHellgate: London © 2005-2006 Flagship Studios, Inc. Licensed by NAMCO BANDAI Games America, Inc.Incredible Physics EffectsCore of the Definitive Gaming PlatformWhat Is Behind This Computing Revolution?• Unified Scalar Shader Architecture• Highly Data Parallel Stream Processing • Next, let’s try to understand what these terms mean…Unified Scalar Shader ArchitectureGraphics Pipelines For Last 20 YearsProcessor per functionVertex Triangle Pixel ROP MemoryT&L evolved to vertex shadingTriangle, point, line – setupFlat shading, texturing, eventually pixel shading Blending, Z-buffering, antialiasingWider and faster over the yearsShaders in Direct3D• DirectX 9: Vertex Shader, Pixel Shader • DirectX 10: Vertex Shader, Geometry Shader, Pixel Shader • DirectX 11: Vertex Shader, Hull Shader, Domain Shader, Geometry Shader, Pixel Shader, Compute Shader • Observation: All of these shaders require the same basic functionality: Texturing (or Data Loads) and Math Ops.Unified PipelineGeometry(new in DX10)Physics VertexFutureTexture + Floating Point ProcessorROP MemoryPixelCompute(CUDA, DX11 Compute, OpenCL)Why Unify?Vertex ShaderPixel ShaderIdle hardwareVertex ShaderIdle hardwareUnbalanced and inefficient utilization in nonunified architectureHeavy Geometry Workload Perf = 4Pixel Shader Heavy Pixel Workload Perf = 8Why Unify?Unified ShaderVertex WorkloadPixelOptimal utilization In unified architectureUnified ShaderPixel WorkloadVertexHeavy Geometry Workload Perf = 11Heavy Pixel Workload Perf = 11Why Scalar Instruction Shader (1)• Vector ALU – efficiency varies • • 4 MAD r2.xyzw, r0.xyzw, r1.xyzw – 100% utilization • • 3 DP3 r2.w, r0.xyz, r1.xyz – 75% • • 2 MUL r2.xy, r0.xy, r1.xy – 50% • • 1 ADD r2.w, r0.x, r1.x – 25%Why Scalar Instruction Shader (2)• Vector ALU with co-issue – better but not perfect • DP3 r2.x, r0.xyz, r1.xyz } 100% • 4 ADD r2.w, r0.w, r1.w • • 3 DP3 r2.w, r0.xyz, r1.xyz • Cannot co-issue • 1 ADD r2.w, r0.w, r2.w • Vector/VLIW architecture – More compiler work required • G8x, GT200: scalar – always 100% efficient, simple to compile • Up to 2x effective throughput advantage relative to vectorComplex Shader Performance on Scalar Arch.Procedural Perlin Noise FireProcedural Fire5 4.5 4 3.5 3 2.5 2 1.5 1 0.5 0 7900GTX 8800GTXConclusion• Build a unified architecture with scalar cores where all shader operations are done on the same processorsStream ProcessingThe Supercomputing Revolution (1)The Supercomputing Revolution (2)What Accounts For This Difference?• Need to understand how CPUs and GPUs differ• Latency Intolerance versus Latency Tolerance • Task Parallelism versus Data Parallelism • Multi-threaded Cores versus SIMT (Single Instruction Multiple Thread) Cores • 10s of Threads versus 10,000s of ThreadsLatency and Throughput• “Latency is a time delay between the moment something is initiated, and the moment one of its effects begins or becomes detectable”• For example, the time delay between a request for texture reading and texture data returns• Throughput is the amount of work done in a given amount of time• For example, how many triangles processed per second• CPUs are low latency low throughput processors • GPUs are high latency high throughput processors•GPUs are designed for tasks that can tolerate latency•Example: Graphics in a game (simplified scenario):•To be efficient, GPUs must have high throughput , i.e. processing millions of pixels in a single frame CPUGenerateFrame 0Generate Frame 1Generate Frame 2GPU Idle RenderFrame 0Render Frame 1Latency between frame generation and rendering (order of milliseconds)•CPUs are designed to minimize latency•Example: Mouse or keyboard input•Caches are needed to minimize latency•CPUs are designed to maximize running operations out of cache •Instruction pre-fetch•Out-of-order execution, flow control• CPUs need a large cache, GPUs do not•GPUs can dedicate more of the transistor area to computation horsepowerCPU versus GPU Transistor Allocation•GPUs can have more ALUs for the same sized chip and therefore run many more threads of computation•Modern GPUs run 10,000s of threads concurrentlyDRAM Cache ALU Control ALUALUALUDRAM CPU GPUManaging Threads On A GPU•How do we:•Avoid synchronization issues between so many threads?•Dispatch, schedule, cache, and context switch 10,000s of threads?•Program 10,000s of threads?•Design GPUs to run specific types of threads:•Independent of each other –no synchronization issues•SIMD (Single Instruction Multiple Data) threads –minimize thread management •Reduce hardware overhead for scheduling, caching etc.•Program blocks of threads (e.g. one pixel shader per draw call, or group of pixels)•Any problems which can be solved with this type of computation?Data Parallel Problems•Plenty of problems fall into this category (luckily ☺)•Graphics, image & video processing, physics, scientific computing, …•This type of parallelism is called data parallelism•And GPUs are the perfect solution for them!•In fact the more the data, the more efficient GPUs become at these algorithms •Bonus: You can relatively easily add more processing cores to a GPU andincrease the throughputParallelism in CPUs v. GPUs•CPUs use task parallelism•Multiple tasks map to multiplethreads•Tasks run different instructions•10s of relatively heavyweight threadsrun on 10s of cores•Each thread managed and scheduledexplicitly•Each thread has to be individuallyprogrammed •GPUs use data parallelism•SIMD model (Single InstructionMultiple Data)•Same instruction on different data•10,000s of lightweight threads on 100sof cores•Threads are managed and scheduledby hardware•Programming done for batches ofthreads (e.g. one pixel shader pergroup of pixels, or draw call)Stream Processing•What we just described:•Given a (typically large) set of data (“stream”)•Run the same series of operations (“kernel”or“shader”) on all of the data (SIMD)•GPUs use various optimizations to improve throughput:•Some on-chip memory and local caches to reduce bandwidth to external memory •Batch groups of threads to minimize incoherent memory access•Bad access patterns will lead to higher latency and/or thread stalls.•Eliminate unnecessary operations by exiting or killing threads•Example: Z-Culling and Early-Z to kill pixels which will not be displayedTo Summarize•GPUs use stream processing to achieve high throughput •GPUs designed to solve problems that tolerate high latencies•High latency tolerance Lower cache requirements•Less transistor area for cache More area for computing units•More computing units 10,000s of SIMD threads and high throughput•GPUs win ☺•Additionally:•Threads managed by hardware You are not required to write code for each thread and manage them yourself•Easier to increase parallelism by adding more processors•So, fundamental unit of a modern GPU is a stream processor…G80 and GT200 Streaming ProcessorArchitectureBuilding a Programmable GPU•The future of high throughput computing is programmable stream processing•So build the architecture around the unified scalar stream processing cores•GeForce 8800 GTX (G80) was the first GPU architecture built with this new paradigmG80 Replaces The Pipeline ModelHost Input Assembler Setup / Rstr / ZCull Geom Thread Issue Pixel Thread Issue128 Unified Streaming ProcessorsSP SP SP SPVtx Thread IssueSPSPSPSPSPSPSPSPSPSPSPSPTFTFTFTFTFTFTFTFL1L1L1L1L1L1L1L1L2 FB FBL2 FBL2 FBL2 FBL2 FBL2Thread ProcessorGT200 Adds More Processing PowerHost CPU System MemoryHost Interface Input Assemble Vertex Work Distribution Geometry Work Distribution Viewport / Clip / Setup / Raster / ZCull Pixel Work Distribution Compute Work DistributionGPUInterconnection Network ROP L2 ROP L2 ROP L2 ROP L2 ROP L2 ROP L2 ROP L2 ROP L2DRAMDRAMDRAMDRAMDRAMDRAMDRAMDRAM8800GTX (high-end G80)16 Stream Multiprocessors• Each one contains 8 unified streaming processors – 128 in totalGTX280 (high-end GT200)24 Stream Multiprocessors• Each one contains 8 unified streaming processors – 240 in totalInside a Stream Multiprocessor (SM)• Scalar register-based ISA • Multithreaded Instruction Unit• Up to 1024 concurrent threads • Hardware thread scheduling • In-order issueTPC I-Cache MT Issue C-CacheSP SP SP SP SP SP SP SPSFU SFU• 8 SP: Thread Processors• IEEE 754 32-bit floating point • 32-bit and 64-bit integer • 16K 32-bit registers• 2 SFU: Special Function Units• sin, cos, log, exp• Double Precision Unit• IEEE 754 64-bit floating point • Fused multiply-add DPShared Memory• 16KB Shared MemoryMultiprocessor Programming Model• Workloads are partitioned into blocks of threads among multiprocessors• a block runs to completion • a block doesn’t run until resources are available• Allocation of hardware resources• shared memory is partitioned among blocks • registers are partitioned among threads• Hardware thread scheduling• any thread not waiting for something can run • context switching is free – every cycleMemory Hierarchy of G80 and GT200• SM can directly access device memory (video memory)• Not cached • Read & write • GT200: 140 GB/s peak• SM can access device memory via texture unit• Cached • Read-only, for textures and constants • GT200: 48 GTexels/s peak• On-chip shared memory shared among threads in an SM• important for communication amongst threads • provides low-latency temporary storage • G80 & GT200: 16KB per SMPerformance Per Millimeter• For GPU, performance == throughput• Cache are limited in the memory hierarchy• Strategy: hide latency with computation, not cache• Heavy multithreading • Switch to another group of threads when the current group is waiting for memory access• Implication: need large number of threads to hide latency• Occupancy: typically 128 threads/SM minimum • Maximum 1024 threads/SM on GT200 (total 1024 * 24 = 24,576 threads)• Strategy: Single Instruction Multiple Thread (SIMT)SIMT Thread Execution• Group 32 threads (vertices, pixels or primitives) into warps• Threads in warp execute same instruction at a time • Shared instruction fetch/dispatch • Hardware automatically handles divergence (branches)TPC I-Cache MT Issue C-CacheSP SP SP SP SP SP SP SPSFU SFU• Warps are the primitive unit of scheduling• Pick 1 of 24 warps for each instruction slot• SIMT execution is an implementation choice• Shared control logic leaves more space for ALUs • Largely invisible to programmerDPShared MemoryShader Branching Performance• G8x/G9x/GT200 branch efficiency is 32 threads (1 warp) • If threads diverge, both sides of branch will execute on all 32 • More efficient compared to architecture with branch efficiency of 48 threadsG80 – 32 pixel coherence 48 pixel coherence 16 14 number of coherent 4x4 tiles 12 10 8 6 4 2 0% 20% 40% 60% 80% 100% 120% PS Branching EfficiencyConclusion:G80 and GT200 Streaming Processor Architecture• Execute in blocks can maximally exploits data parallelism• Minimize incoherent memory access • Adding more ALU yields better performance• Performs data processing in SIMT fashion• Group 32 threads into warps • Threads in warp execute same instruction at a time• Thread scheduling is automatically handled by hardware• Context switching is free (every cycle) • Transparent scalability. Easy for programming• Memory latency is covered by large number of in-flight threads• Cache is mainly used for read-only memory access (texture, constants).。

20年风云变幻!经典显卡品牌历史回顾

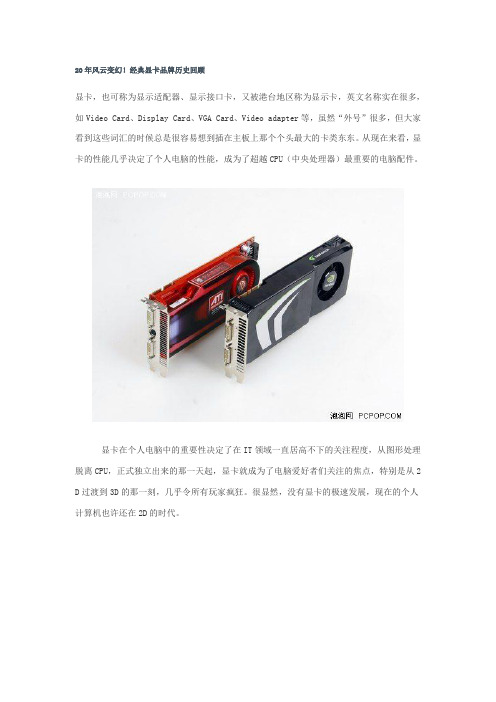

20年风云变幻!经典显卡品牌历史回顾显卡,也可称为显示适配器、显示接口卡,又被港台地区称为显示卡,英文名称实在很多,如Video Card、Display Card、VGA Card、Video adapter等,虽然“外号”很多,但大家看到这些词汇的时候总是很容易想到插在主板上那个个头最大的卡类东东。

从现在来看,显卡的性能几乎决定了个人电脑的性能,成为了超越CPU(中央处理器)最重要的电脑配件。

显卡在个人电脑中的重要性决定了在IT领域一直居高不下的关注程度,从图形处理脱离CPU,正式独立出来的那一天起,显卡就成为了电脑爱好者们关注的焦点,特别是从2 D过渡到3D的那一刻,几乎令所有玩家疯狂。

很显然,没有显卡的极速发展,现在的个人计算机也许还在2D的时代。

正是因为显卡受到了很大的关注,很多玩家都对经典显卡的收藏情有独钟。

很多人都在互联网上记录了显卡的发展历史,而一些我们现在并不曾听过的显卡品牌也经常被一些历史资料提到,3Dfx、帝盟、创新、大力神等都是经常被提起的对象。

随着市场的竞争越来越大,不少经典的显卡品牌都默默的消失了,而也有一些经典的品牌直到现在,都还保持着非常好的出货记录。

今天,笔者就是要带大家回顾一下曾经十分经典的显卡品牌,或许他们还可以勾起你一些非常快乐的回忆。

近几年才开始玩DIY的玩家可能对帝盟这个品牌不太熟悉,但是在90年代,帝盟可是全球数一数二的显卡品牌,做工用料非常豪华,而最后的事实证明,一直做工好的品牌,都会死的很快。

帝盟和创新都是IT界非常早的板卡生产、零售厂商,在业界有很高的声望,生产和销售的显卡不计其数。

下图就是一张帝盟1991年出品的显卡,采用TSENG的主芯片!在3dfx火爆的时候,帝盟是3dfx很好的合作伙伴,Voodoo、Voodoo 2、Voodoo Ba nshee等芯片都有帝盟代工的产品,在市场上的销量非常好。

不仅如此,帝盟还推出过其他很多芯片厂商的显卡产品,包括3Dlabs、S3、NVIDIA、Trident等,甚至还为IBM、惠普等多家厂商OEM过显卡。

NVIDIA显卡发展简史回顾

光阴似箭绿巨人NVIDIA显卡发展简史回顾2008-02-27 14:04:011993年,Jen-Hsun Huang(黄仁勋)、Curtis Priem和Chris Malachowsky 决定成立一个新的图形开发公司,在当时也许是一个很不起眼的事情,可是历史证明,从那时注定今天会出现一个举世闻名的显示芯片制造商——nVIDIA。

他们当时的梦想也非常简单——研制世界最先进的图形加速芯片。

一、初遇挫折nVIDIA公司的第一个产品是NV-1,这是一个好的开始,但是距离成功还很遥远。

D iamond选用了该芯片,制造了非常不受欢迎的Diamond Edge显示卡。

nVIDIA自认为可以做些与众不同的事情,于是用四边形代替了传统的三角形加速方案,可是对于nVIDI A和Diamond,这个转变都非常不受欢迎。

可以说NV-1是个失败,甚至连Jen-Hsun Huang也这样认为。

nVIDIA并没有因为NV-1的失败而停止,他们接受了一家第三方公司的委托,为该公司研制NV-2。

在接受了NV-1教训的基础上,nVIDIA在NV-2的研制策划上花费了相当大的工夫。

可是由于各种原因,这家公司放弃了对NV-2的支持,没有了资金援助,NV-2的研制计划进入了暂停阶段。

当时的nVIDIA已经身无分文,虽然他们已经有一个半产品,但是却没有给他们带来丝毫效益。

看起来nVIDIA也会象其它一些刚刚开始的显示芯片公司一样,注定要从此消失了。

3dfx推出的Voodoo就在这时,nVIDIA启用了极具天才的David Kirk,开始重新研制NV-3。

NV-3的目标是成为当时最先进的图形芯片,并准备在一个芯片中集成优秀的2D和3D性能。

在1 995年,3dfx发布了公司创立以来的第一个产品——Voodoo,并赢得了广泛的欢迎。

而R endition在稍微早些于3dfx的时候也发布了V1000芯片,而且已经被几大显卡厂家采用,销售量最后直逼Voodoo,成为第二家受欢迎的产品。

25年显卡发展史

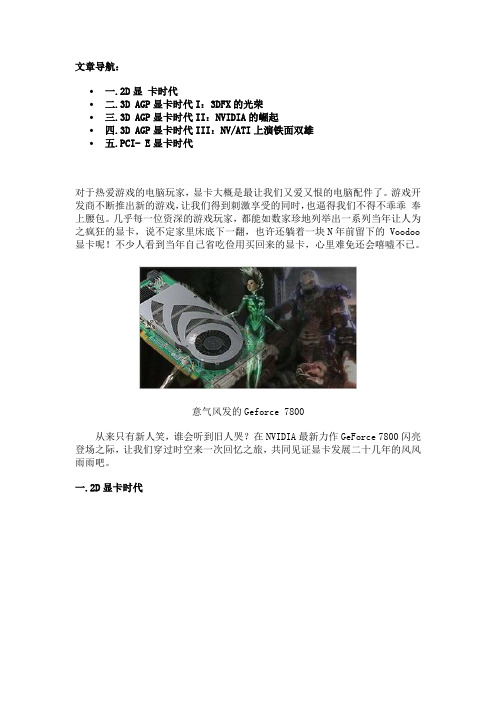

文章导航:∙一.2D显卡时代∙二.3D AGP显卡时代I:3DFX的光荣∙三.3D AGP显卡时代II:NVIDIA的崛起∙四.3D AGP显卡时代III:NV/ATI上演铁面双雄∙五.PCI- E显卡时代对于热爱游戏的电脑玩家,显卡大概是最让我们又爱又恨的电脑配件了。

游戏开发商不断推出新的游戏,让我们得到刺激享受的同时,也逼得我们不得不乖乖奉上腰包。

几乎每一位资深的游戏玩家,都能如数家珍地列举出一系列当年让人为之疯狂的显卡,说不定家里床底下一翻,也许还躺着一块N年前留下的 Voodoo 显卡呢!不少人看到当年自己省吃俭用买回来的显卡,心里难免还会嘻嘘不已。

意气风发的Geforce 7800从来只有新人笑,谁会听到旧人哭?在NVIDIA最新力作GeForce 7800闪亮登场之际,让我们穿过时空来一次回忆之旅,共同见证显卡发展二十几年的风风雨雨吧。

一.2D显卡时代民用显卡的起源可以追朔到上个世纪的八十年代了。

在1981年, IBM推出了个人电脑时,它提供了两种显卡,一种是"单色显卡(简称 MDA), 一种是 "彩色绘图卡" (简称 CGA), 从名字上就可以看出,MDA是与单色显示器配合使用的, 它可以显示80行x25列的文数字, CGA则可以用在RGB的显示屏上, 它可以绘制的图形和文数字资料。

在当时来讲,计算机的用途主要是文字数据处理,虽然MDA解析度为宽720点, 高350点,不足以满足多大的显示要求,不过对于文字数据处理还是绰绰有余的了。

而CGA就具有彩色和图形能力,能胜任一般的显示图形数据的需要了,不过其解析度只有640x200,自然不能与现在的彩色显示同日而语。

1982年,IBM又推出了MGA(Monochrome Graphic Adapter), 又称Hercules Card (大力士卡), 除了能显示图形外,还保留了原来 MDA 的功能。

当年不少游戏都需要这款卡才能显示动画效果。

NVIDIA2010年度显卡大回顾

NVIDIA 2010年度显卡大回顾来源:天极网硬件频道 作者:小菜一碟 责任编辑:林锦伟发表时间:2011-02-09 09:00DX11后来居上NVIDIA2010显卡型号大回顾回顾2010年,显卡市场结束了DX11时代AMD HD5000系列大半年来一方独唱的格局,NVIDIA蓄力已久的新架构“费米”震撼登场,随着而来的GeForce 400系列显卡逐个登台,上演了一场强势的逆袭之战。

在过去的一年,不管是AMD的多屏Eyefinity技术,还是NVIDIA的PhysX 物理加速;都让玩家们体验到了新技术带来的视觉冲击,同时也得到了更好的游戏体验。

但是想体验新的显卡技术,就必须购买两大公司新推出的新型号显卡,那么在过去的2010年,做为显卡市场两大巨头之一的NVIDIA(英伟达)给我们带来了那一些新的产品呢?我们现在就来盘点一下过去一年的NVIDIA显卡首测,跟大家一起回顾绿营的各个战将::颠覆传统NVIDIA DX11卡皇GTX480权威首测第一代“费米”的降临的降临:费米中高端新主力费米中高端新主力::中高端新霸Geforce GTX465国内同步首测:千元价位重磅炸弹GTX460显卡全球首测千元级奇兵突围:NVIDIA千元级奇兵突围千元以下市场的拼杀部队千元以下市场的拼杀部队::千元以下卡皇登场 GTS450显卡全球同步首测:新生代入门级DX11显卡GeForce GT430首测新宠:NVIDIA入门级DX11新宠:继往开来真DX11新作GTX580显卡全球首测二代惊艳高端市场:“费米”二代惊艳高端市场准点迎接3DMARK11的考验:与3DMark11同登场Fermi二代显卡GTX570的考验:首测2011新“Ti給力”农历年关前杀出:2011"Ti"给力GeForce GTX560 Ti首发评农历年关前杀出:测。

NVIDIA PCI-E显卡发展史

NVIDIA PCI-E显卡发展史回顾2003年问世的PCI-Express标准让整个显示市场呈现出百花齐放的局面,虽然目前仍然有不少用户还在坚守AGP平台,出于种种原因而不升级,但就像当年PCI代替ISA、AGP取代PCI一样,PCI-E接口代替AGP接口的趋势是不可避免的。

经过3年多的推广和普及,PCI-E显卡完完全全成为市场主流,丰富的产品也让消费者有了非常大的选择空间。

NVIDIA PCI-ExpressPCI-E采用全新的架构,能够提供比AGP更大的传输带宽,满足不断更新的高性能显卡产品需要,无论是NVIDIA的SLI,TurboCache还是ATI的CrossFie,都是建立在PCI-E高速带宽上的。

PCI-E显卡在市场上的发展时间已经不短了,产品更是琳琅满目,我们认为有必要为大家简单的回顾一下PCI-E显卡的发展,也让我们以此文怀念曾经辉煌过,并带给过我们无穷快乐的AGP时代。

12月18日NVIDIA、ATI全系对决临近岁末,让我们翻开NVIDIA的历史篇章,回味这位绿巨人在PCI-Express 上的进化史:远古时代:GeForce PCX虽然我们可能不知道谁推出了业界第一款PCI-Express显卡,但毫无疑问,NVIDIA在推广PCI-E显卡的普及之路上是走在前列的。

2003年的GeForce FX时代,正处于AGP显卡的鼎盛时期,以GeForce FX5900和Radeon 9800为代表的第一代DX9显卡获得了最广泛的芯片组支持。

虽然Intel高调地发布了支持PCI-E总线的i915P/i925X芯片组,但当时 PCI-E显卡的缺乏和DDR2内存的昂贵让i915P/i925X成了炫耀新技术标准的产品。

而GeForce PCX的推出,很好的缓解了这个问题。

GeForce FX由于当时NVIDIA的工作重心还放在AGP平台上,所以只重点在零售市场推出了三款PCI-E产品(其实在OEM市场还有MX440的PCI-E版)。

cuda发展历程

cuda发展历程2006年6月,美国半导体制造商NVIDIA公司发布了CUDA (Compute Unified Device Architecture)这一并行计算平台和编程模型,它将当时NVIDIA图形处理器(GPU)的潜力拓展到通用计算领域。

CUDA的出现标志着GPU并行计算的革命,极大地推动了科学计算、机器学习和人工智能等领域的发展。

一、CUDA的初衷和概念CUDA的初衷是利用GPU强大的并行处理能力来加速科学计算任务。

之前,GPU主要用于图形渲染,而传统的CPU在并行计算方面的表现有限。

CUDA的概念是通过将计算任务分解为多个并行线程,在GPU上同时执行这些线程以加速计算过程。

这种基于并行的计算模型为科学家和工程师们提供了一个高性能、易用的平台。

二、CUDA的发展里程碑1. 第一代CUDA架构(2007年)NVIDIA在2007年发布了第一代支持CUDA的图形处理器,该架构提供了大量的核心数和全新的线程模型,使得计算性能得到了显著提升。

研究人员和开发者们开始尝试使用CUDA来解决各种科学计算问题,取得了令人瞩目的成果。

2. CUDA C/C++编程语言(2007年)为了简化CUDA编程的难度,NVIDIA公司在2007年发布了CUDA C/C++编程语言。

这个扩展自C/C++的编程语言使得开发者可以更方便地利用GPU进行并行计算,打破了以往GPU编程的限制。

3. CUDA 2.0和GPU互操作(2008年)CUDA 2.0的发布引入了GPU互操作的概念,使得GPU和CPU能够更紧密地结合起来。

这种互操作性使得开发者们能够在应用程序中有效地将CPU和GPU的计算能力结合起来,达到更高的性能。

4. CUDA 3.0和动态并行调度(2010年)CUDA 3.0引入了动态并行调度(Dynamic Parallelism)的概念,这是CUDA的一个里程碑式的突破。

动态并行调度允许GPU线程中创建新的线程,使得计算任务的粒度更细,进一步提高了并行计算的效率和灵活性。

NVIDIA显卡发展史回顾

帝国时代:GeForce 8 PCI-E

如果说,在GeForce 7时代,NVIDIA还有值得畏惧的竞争对手,那么到了GeForce 8时代,NVIDIA进入了一个无对手的“帝国时代”。随着2006年秋季ATI被AMD的收购,行业巨头之间的关系出现了微妙的变化。图形芯片领域,由 之前的双雄争霸变成了一家独大,而这一形势又随着代号G80的GeForce 8800显卡的上市而逐渐明朗和被人们所认同。

NV43:第一款真正意义上的原生PCI-E显卡

基于NV43核心的GeForce 66006600GT是NVIDIA第一款真正意义上的原生PCI-E显卡,它摆脱了BR02桥接芯片的束缚,提供了更快的性能和更好的稳定性。另 外,PCI-E的传输界面也给在GeForce 6600系列上出现的SLI技术有了广泛的应用前景。

NVIDIA PCI-E显卡发展史回顾

2003年问世的PCI-Express标准让整个显示市场呈现出百花齐放的局面, 虽然目前仍然有不少用户还在坚守AGP平台,出于种种原因而不升级,但就像当年PCI代替ISA、AGP取代PCI一样,PCI-E接口代替AGP接口的 趋势 是不可避免的。经过3年多的推广和普及,PCI-E显卡完完全全成为市场主流 ,丰富的产品也让消费者有了非常大的选择空间。

NVIDIA PCI-Express

PCI-E采用全新的架构,能够提供比AGP更大的传输 带宽,满足不断更新的高性能显卡产品需要,无论是NVIDIA的SLI,TurboCache还是ATI的CrossFie,都是建立在PCI-E高速带 宽上的。PCI-E显卡在市场上的发展时间已经不短了,产品更是琳琅满目,我们认为有必要为大家简单的回顾一下PCI-E显卡的发展,也让我们以此文怀念 曾经辉煌过,并带给过我们无穷快乐的AGP时代。

显卡发展史

显卡(又称显示适配器),作用是控制显示器的显示方式。

在显示器里也有控制电路,但起主要作用的是显示卡。

影响显卡性能的主要参数——显示芯片、显存、频率。

1.显卡的性能主要取决于显卡上使用的图形芯片,早期的图形芯片作用比较简单,每件事都由CPU去处理,它们只是起一个传递显示信息的作用,这样就降低了显示速度,增加了CPU的工作量。

随着图形操作系统Windows的出现,这种弊端越来越严重,于是出现了图形加速卡。

现在大部分显示卡都有加速芯片,这些芯片有图形处理功能。

2.显存(VRAM)就是存储显示数据的内存芯片,它的大小直接影响到显卡可以显示的颜色多少和可以支持的最高分辨率。

除了显存位宽影响显卡性能以外;显存容量对显卡性能影响也比较大,对于多数显卡来说显存容量大小对显卡性能虽然有一定的影响,但是影响非常小。

3,显卡的频率主要指两个频率,一是显示芯片的频率,另外一个是显存的频率。

显示芯片的频率有点象CPU的频率,频率越高,性能越强;而显存频率和显示芯片的频率高则性能高的道理一样,但还有点区别。

而对于显卡来说,单纯提高显示芯片频率或者单纯提高显存频率对显卡性能影响不大,所以我们在选择显卡的时候应该把两者的频率都考虑进去。

回答:2008-05-31 17:14评论低抛高吸_1976[文曲星]1.显卡的显存决定显卡的速度吗?同芯片显卡显存大的比显存小的速度快,DDR3显存的比DDRII显存的速度快.不同显卡芯片显存没有可比性.例如:GF4 128M 和6600GT 128M都是128显存,后者的性能比前者强太多太多了,不是一个档次的东西.同样是256M内存,9550比7900差老鼻子了所以不一定256M显存的卡比128M的好2.显存位宽什么意思?简单来说就是单位周期内处理数据的长度,我们说的多少位就是二进制的多少位,用0和1表示的数字串,32位就是1011100010101....这样32个数字序列64位,128,256都是这样的,就是2的多少次方,所以不会出现140位.300位这样的非2的指数次方位.同样的GPU(显卡心脏,图形处理单元),256位显卡每个振荡周期可以吞吐处理256位长度的数据.显然位越高越快例如腿长256米的人和腿长32米的人赛跑,频率一样,谁跑的快?3.现存带宽是越大越好吗?显存带宽=工作频率×显存位宽/8他是显卡核心GPU芯片与显存之间的数据传输速率,越大越好举例说明:同样是256位的7900GT,一个超频了,工作频率提升了,另一个不变显然超频了以后的那块7900GT性能会比前者好.4.核心频率越大就越快吗?这个可不一定,关键看核心的芯片型号.这个和CPU类似,P4 2.0G的CPU核心频率2G,AMD 64 3000+核心频率1.8G 显然1.8G AMD的要比2.0G P4的性能强大总之看芯片8800>7900>7800>7600>7300 这是不变的硬道理有些超频了的显卡说7300GT比得上7600那是靠提升核心频率,提高电容用料,提升风扇风量等一系列手段提升的但是如果你买一款公版的7600GT,轻松一超就比7300强了芯片是诸多要素中对性能影响最关键的,而不是频率5.制作工艺μm数值越小越好吗?是的,很肯定的说是的.比如你是邮递员,要送100封信你说分布在一个城市里送快还是分布在一个楼里快??显然是后者.套用某明星一句话:浓缩的都是精华!6.具体哪几个方面影响显卡的速度?非常多,可以按照下面的顺序依次考虑首先是芯片,就是显卡的型号其次看同型号的显存类型,DDR3的比DDR2的快再次看显存大小,大的比小的好然后看显存的品牌,三星等大厂的肯定比HY的好一些然后看显卡的供电部分,比如用贴片固态电容的肯定豪华.(这个很重要,不影响速度,但是影响稳定性和使用寿命)7.AGP和PCI-E可以互相转换吗?可以升级吗?AGP和PCIE不单纯是接口那么简单,相关的还有总线通道速度等因素所以不能转换PCIE有很多种,全速的是PCI-E 16X,带宽大AGP也有2X 4X 8X等等,速度也不一样不能转换如果新买机器,尽量买PCIE的1.CGA显卡民用显卡的起源可以追溯到上个世纪的八十年代了。

NVIDIA显卡发展史

N V I D I A显卡发展史

注:

1.本表包含了NVIDIA从发展初期至现在所能查询到的全部产品型号和主要参数,包括移动版产品;

2.本表只列出民用显卡的参数,由于专业显卡的应用面和市场份额极小,因此未涉及专业显卡;

3.表中所有参数均为NVIDIA官方公版参数,与显卡厂商自行生产的显卡参数可能会有较大的不同,主要体现在频率及功耗上;

4.以绿色字体标注的型号代表移动版显卡,用于笔记本或其他移动图形设备中;

5.以红色字体标注的型号代表曾经出现在NVIDIA产品计划中,但最终由于各种原因取消生产计划或未能上市的产品;

6.由于涉及的显卡型号众多,参数纷繁复杂,加之很多产品年代过于久远,资料匮乏,因此并不能保证参数的绝对准确以及未遗漏部分型号;

7.本表按产品的系列、数字和字母型号顺序进行排列,未按产品性能进行排列。

NVIDIAGeForce系列

NVIDIAGeForce2系列

NVIDIAGeForce3系列

NVIDIAGeForce4系列

NVIDIAGeForceFX5系列

NVIDIAGeForcePCX系列

NVIDIAGeForce6系列

NVIDIAGeForce7系列

NVIDIAGeForce8系列

NVIDIAGeForce9系列

NVIDIAGeForce100系列(OEM)

NVIDIAGeForce200系列

GeForce300系列

GeForce400系列

…………。

显卡上市时间

显卡上市时间在计算机科技领域中,显卡是一种负责图形处理的重要硬件。

它通常是通过插槽插入到主板上来提供图形渲染和显示功能。

随着计算机技术的不断进步,显卡的性能也不断提升。

下面我们会介绍一些重要的显卡上市时间。

早在1981年,IBM公司就推出了世界上第一款基于显卡的个人电脑――IBM CGA(Color Graphics Adapter)。

该显卡采用数字信号输出,支持16种颜色和4种分辨率。

然而,当时的计算机性能较低,CGA显卡只能处理简单的图形任务。

随着1987年第一款VGA显卡的推出,图形显示技术得到了长足的发展。

VGA显卡支持256种颜色和640x480分辨率,大大提高了图形显示的质量。

从此,计算机游戏、多媒体等领域得到了更加广泛的应用。

1990年代是显卡发展的黄金时代。

1995年,NVIDIA公司推出了第一款图形处理单元(GPU)――NV1。

该GPU拥有50万个晶体管,支持3D渲染和纹理映射等功能,为计算机图形处理带来了革命性的变革。

1999年,NVIDIA进一步推出了GeForce 256显卡,它以领先的性能和突破性的特性震撼了整个行业。

2000年代是显卡竞争的时代。

2000年,ATI(后来被AMD收购)推出了Radeon系列显卡,与NVIDIA展开了激烈的竞争。

这一时期,显卡性能大幅提升,3D游戏图形质量和真实感得到了巨大提高。

2006年,NVIDIA推出了GeForce 8800系列显卡,首次引入了统一着色器架构,使得图形处理更为高效和灵活。

2010年代是显卡技术快速发展的阶段。

2012年,NVIDIA推出了GeForce GTX 680显卡,首次采用了28纳米制程工艺,大幅提升了能效和性能。

2015年,NVIDIA进一步推出了Pascal架构的显卡,如GeForce GTX 1080,刷新了图形处理性能的新纪录。

近年来,随着人工智能和深度学习的兴起,显卡在数据科学领域的应用也越来越广泛。

NV发展史详细介绍

NVIDIA百科名片公司LOGOnVIDIA(全称为nVIDIA Corporation,NASDAQ:NVDA,官方中文名称英伟达),创立于1993年1月,是一家以设计显示芯片和主板芯片组为主的半导体公司。

nVIDIA亦会设计游戏机内核,例如Xbox和PlayStation 3。

nVIDIA最出名的产品线是为游戏而设的Ge Force显示卡系列,为专业工作站而设的Quadro显卡系列,和用于计算机主板的nForce 芯片组系列。

nVIDIA的总部设在美国加利福尼亚州的圣克拉拉。

是一家无晶圆(Fabless)IC半导体设计公司。

现任总裁为黄仁勋。

目录[隐藏]NVIDIA概述NVIDIA品牌NVIDIA产品NVIDIA发展NVIDIA展望NviDIA显卡缺陷CEO黄仁勋简介NVIDIA概述NVIDIA品牌NVIDIA产品NVIDIA发展NVIDIA展望NviDIA显卡缺陷CEO黄仁勋简介[编辑本段]NVIDIA概述NV创始人:黄仁勋NVIDIA公司(Nasdaq代码:nvda)是全球可编程图形处理技术领袖。

专注于打造能够增强个人和专业计算平台的人机交互体验的产品。

公司的图形和通信处理器拥有广泛的市场,已被多种多样的计算平台采用,包括个人数字媒体PC、商用PC、专业工作站、数字内容创建系统、笔记本电脑、军用导航系统和视频游戏控制台等。

NVI DIA全球雇员数量超过4000人。

全球各地众多OEM厂商、显卡制造商、系统制造商、消费类电子产品公司都选择NVIDIA的处理器作为其娱乐和商用解决方案的核心组件。

在PC应用领域(例如制造、科研、电子商务、娱乐和教育等),NVIDIA公司获奖不断的图形处理器可以提供出色的性能和鲜锐的视觉效果。

其媒体和通信处理器能够执行宽带连接和通信应用中要求十分苛刻的多媒体处理任务,并在音频应用能力方面取得突破。

NVIDIA产品和技术的基础是NVIDIA ForceWare,这是一种综合性软件套件,能够实现业内领先的图形、音频、视频、通信、存储和安全功能。

NVIDIA显卡发展史

NVIDIA显卡发展史

注:

1.本表包含了NVIDIA从发展初期至现在所能查询到的全部产品型号和主要参数,包括移动版产品;

2.本表只列出民用显卡的参数,由于专业显卡的应用面和市场份额极小,因此未涉及专业显卡;

3.表中所有参数均为NVIDIA官方公版参数,与显卡厂商自行生产的显卡参数可能会有较大的不同,主要体现在频率及功耗上;

4.以绿色字体标注的型号代表移动版显卡,用于笔记本或其他移动图形设备中;

5.以红色字体标注的型号代表曾经出现在NVIDIA产品计划中,但最终由于各种原因取消生产计划或未能上市的产品;

6.由于涉及的显卡型号众多,参数纷繁复杂,加之很多产品年代过于久远,资料匮乏,因此并不能保证参数的绝对准确以及未遗漏部分型号;。

NVIDIA显卡系列

NVIDIA显卡系列Geforce是一个英文产品的商标。

(Geometry-Force=Geforce)几何很强GeForce是NVIDIA公司出品的显示芯片的一种系列目前已有GeForce256、GeForce2、GeForce3、GeForce4、GeForce FX、Ge Force 6系列,GeForce 7系列,GeForce 8系列,GeForce 9系列和第十代产品“G eForce+定位+型号”系列。

[编辑本段]产品简介:本文所涉及到的规格与数据,均采自Nvidia公版显卡。

第一代产品:GeForce 256DX7.0 OpenGL PCI/AGP4X(DDR版本只有AGP接口)第一款256bit显示核心的可编程GPU,支持T&L立方环境映射、Dot3凹凸映射和HDTV动态补偿和硬件alpha混合。

在显示接口方面,GeForce 256率先开始支持AGP4×快写模式。

第二代产品:GeForce 2DX7.0 OpenGL AGP4XGeFoece 2有明显高低端之分,MX系列为低端,其余系列为中高端。

加入数字振动控制(DVC),TwinView(双头显示)功能。

在当时,FSAA技术已经开始兴起,FSAA可以大量的改善画质,去除难看的锯齿,甚至是旧游戏也可以让它变得更光滑好看,此前只有3dfx的双VSA-100芯片Voodoo5支持。

GeForce2 GT S也可以用硬件FSAA,它的方式是用SuperSampling,但是SuperSampling FSAA 只能使用在低分辨率,很显然的,nVIDIA的SuperSampling方式比3dfx的MultiSa mpling的效率还要差,另外nVIDIA驱动程序没有DirectX的FSAA功能,这使得拥有FSAA技术的GeForce2 GTS并没有得到很好的改善画质的效果。

支持S3TC、FSAA、Pixels Shaders和硬件动态MPEG-2动态补偿功能。

显卡发展史从早期到现在的演变

显卡发展史从早期到现在的演变显卡是计算机硬件中的一个重要组成部分,它负责处理图像和视频的显示。

在计算机产业的发展过程中,显卡经历了多次技术革新和进化,从早期的简单图形处理到现今强大的图形加速器,带给用户更加优质的视觉体验。

本文将从早期显卡的发展出发,梳理显卡的技术发展历程。

1. CGA图形卡时代1981年,IBM推出了PC(Personal Computer),同时引入了CGA (Color Graphics Adapter)图形卡。

这是显卡的开端,它的分辨率为320x200像素,支持16种颜色显示。

虽然相比现代显卡来说简陋,但在当时已经具备了基本的图形显示功能。

CGA图形卡的问世为计算机用户带来了全新的视觉体验,也为后续更先进的显卡技术奠定了基础。

2. VGA图形卡的崛起进入80年代末和90年代初,VGA(Video Graphics Array)图形卡开始流行。

VGA图形卡的分辨率提高到640x480像素,色彩深度增加到256色,显示效果更加清晰、饱满。

这使得计算机用户可以在屏幕上更细腻地呈现图像和文字。

VGA图形卡不仅在个人电脑领域取得了成功,也在其他设备中得到广泛应用,比如监控系统和游戏机等。

3. 显卡加速技术的出现随着图形处理需求的增加,显卡开始引入加速技术,以提高图形处理的效率和性能。

1996年,3dfx公司推出了首款支持3D加速的显卡——Voodoo。

这款显卡通过引入专门的3D处理器,大大提高了计算机的图形处理能力,使得计算机和游戏图形的表现更加逼真。

Voodoo的问世开启了显卡加速技术的新篇章,也为后来的3D显卡奠定了基础。

4. 3D加速显卡的兴起20世纪90年代末期,3D加速显卡成为显卡市场的主流。

NVIDIA和ATI等公司相继推出了多款支持硬件加速的显卡产品。

这些显卡通过在硬件层面上进行图形计算,大大提高了3D游戏的运行速度和图像质量。

3D加速显卡的问世,使得计算机游戏逐渐成为一种具有沉浸式体验的娱乐方式。

25年显卡发展史

25年来,显卡已经从单纯的图形渲染芯片发展为能够承担许多高负

载的虚拟工作站。

以下是显卡的发展史:

1997年,NVIDIA发布了他们的下一款功能强大的3D图形芯片,称为GeForce256、它具有支持单精度浮点运算、多重纹理和可编程着色器等功能。

GeForce256加快了更多游戏的开发,开启了3D渲染的第二次革命。

2004年,NVIDIA发布了一款具有图形功能的主流GPU,称为GeForce 6,它是用于高性能游戏和3D应用的理想替代品。

GeForce 6及以后的GPU增强了3D硬件加速器中的硬件参数,使它们能够更好地实现3D环境的高精度渲染,特别是高分辨率和多重纹理。

2024年,NVIDIA发布了他们的下一款高性能GPU,称为GeForce 8,它使用了更高级别的软件和硬件加速技术,可以为更多强大的游戏和3D

应用带来更好的性能。

2024年,NVIDIA发布了另一款高端GPU,称为GeForce GTX 580,它为虚拟工作站提供了更好的多任务处理能力,使用户能够更轻松地完成更大规模的3D图形设计工作。

2024年,NVIDIA发布了他们的下一款GPU,称为GeForce GTX 980,它是一款强大的专业级GPU,为应用程序开发者提供了更强大的图形渲染性能。

2024年。

nvidia显卡geforce

nvidia显卡geforce

NVIDIA的GeForce 700系列显卡是一系列面向消费者的显卡

产品,发布于2013年。

该系列采用了NVIDIA的Kepler架构,并且包含了多个型号,如GeForce GTX 780、GTX 770、GTX 760等。

这些显卡在当时都属于高性能显卡,并且能够提供流

畅的游戏体验和高质量的图形渲染。

其中,GeForce GTX 780

是当时的旗舰产品,拥有很高的显卡性能和大容量的显存,可以满足用户对于高画质游戏和图形设计的需求。

不过,由于年代久远,GeForce 700系列显卡相对于当前的显卡产品已经不

再具备领先优势,如果需要更高性能的显卡,建议选择更新的NVIDIA GeForce系列。

NVIDIA显卡编年史

追寻绿巨人的足迹NVIDIA显卡编年史--——Green Mile:The W ay It’s Meant To Be Played.1、绿巨人的第一次NVIDIAidia的第一件图形产品代号为NV1,诞生于1995年。

这块显卡除了是NVIDIA的第一块显卡,同时还是史上第一块PCI 接口的声卡。

与世嘉公司的合作诞生了这块显卡,除了将声音与图像处理芯片整合在一起,更增加了一个世嘉土星游戏机的手柄接口。

世嘉也透过NV1的支持,将其代表的硬派游戏代表作如铁甲飞龙和VR战士Remix移植至PC上。

然而由于各种客观条件,NV1在市场上最终还是败给了S3、Trident等老牌显卡厂商。

NV1基于二次曲面技术开发,与当时常见的Polygan渲染的常用3D生成技术有着很大不同,这也就限制了NV1在3D游戏中的发挥。

最后随着微软介入3D API的开发以及操作系统逐步升级至Win95,非主流的NV1也逐渐淡出了市场。

2、挑战者随着V oodoo带来了个人计算机历史上最大的变革,无论是游戏还是硬件都开始了自己3D化的进程。

面对自己失败的NV1和黑历史一般的NV2,NVIDIA没有气馁,他坚信中国一句古话:坏事不过三。

1997年诞生的NV3和前辈一样激进,前辈将声卡和显卡整合到了一起,NV3则将3D与2D加速整合到了一起,消费者们不必再像V oodoo那样用一块2D显卡+3D子卡的方式来运行3D游戏了。

放弃了二次曲面贴图技术,NV3按照流行的Direct3D 5.0和OpenGL的API来进行软硬件的设计。

100Mhz的核心频率,单条渲染管线,4M SGRAM显存,提供16位色3D画面的支持,采用了先进的128bit显存位宽,最高支持960x720的3D游戏分辨率,这些在当时看来都是非常出色的硬件性能指标。

所以NV3零售版本被寄予厚望的NVIDIA取名为RIV A128,意思是128位实时交互视频动画加速器。

3、大规模杀伤性武器诺贝尔用TNT来命名威力巨大的炸药,130年后,NVIDIA用同样的名字来称呼了自己的0第四代产品,1998年的RIV A TNT 拥有强大的3D性能。

10代显卡

10代显卡10代显卡是指英伟达公司的GeForce 10系列显卡,该系列显卡于2016年发布。

这一代显卡包括了GeForce GTX 1050、GeForce GTX 1060、GeForce GTX 1070、GeForce GTX 1080等型号,主要针对中高端玩家市场。

与前一代的显卡相比,10代显卡在性能、能效和功能上都有了一定的提升。

首先是性能方面,10代显卡采用了新的Pascal架构,相比于旧的Maxwell架构,它具有更高的运算性能和更低的功耗。

这使得10代显卡在各种游戏和应用程序中都能提供更优秀的表现。

例如,GeForce GTX 1080相比上一代的GeForce GTX 980,性能提升了约40%。

其次是能效方面,10代显卡采用了新一代的FinFET工艺,使得芯片的功耗更低。

这不仅让显卡在工作时能够保持较低的温度和噪音,还延长了显卡的寿命。

此外,10代显卡还有动态超频功能,能够根据实际使用情况自动调整核心频率和电压,提供更好的性能和能效平衡。

最后是功能方面,10代显卡支持全新的VR(虚拟现实)技术,为用户带来了更真实的游戏和观影体验。

除此之外,10代显卡还在输出接口方面进行了升级,支持HDMI 2.0b、DisplayPort 1.4和HDR(高动态范围)等技术,让用户能够连接更高分辨率的显示器,享受更震撼的画面效果。

综上所述,10代显卡是一代性能优异、能效高、功能丰富的显卡产品。

无论是游戏玩家、设计师还是科学计算等专业用户,都能从中得到更好的体验和性能提升。

随着技术不断发展,未来的显卡产品将会更加出色。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

NVIDIA显卡发展史

注:

1. 本表包含了NVIDIA从发展初期至现在所能查询到的全部产品型号和主要参数,包括移动版产品;

2. 本表只列出民用显卡的参数,由于专业显卡的应用面和市场份额极小,因此未涉及专业显卡;

3. 表中所有参数均为NVIDIA官方公版参数,与显卡厂商自行生产的显卡参数可能会有较大的不同,主要体现在频率及功耗上;

4. 以绿色字体标注的型号代表移动版显卡,用于笔记本或其他移动图形设备中;

5. 以红色字体标注的型号代表曾经出现在NVIDIA产品计划中,但最终由于各种原因取消生产计划或未能上市的产品;

6. 由于涉及的显卡型号众多,参数纷繁复杂,加之很多产品年代过于久远,资料匮乏,因此并不能保证参数的绝对准确以及未遗漏部分型号;

7. 本表按产品的系列、数字和字母型号顺序进行排列,未按产品性能进行排列。