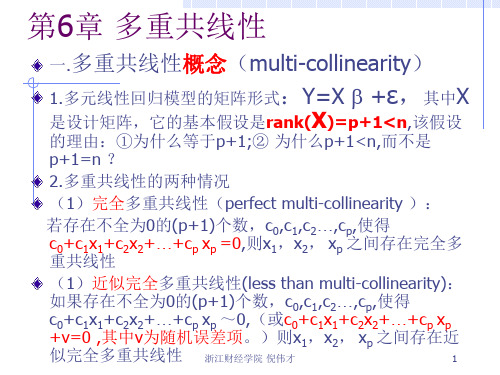

第6章 多重共线性

多重共线性的检验方法

多重共线性的检验方法

多重共线性(multicollinearity)是指在回归模型中,自变量之间存在高度相关或线性相关的情况。

由于存在多重共线性,导致模型的解释能力降低,预测结果不可靠。

因此,需要对回归模型中自变量之间的关系进行检验和分析。

下面介绍几种多重共线性的检验方法。

1. 相关系数矩阵法。

计算自变量之间的相关系数矩阵,判断是否存在较高的相关系数。

相关系数矩阵主要分为Pearson 相关系数和Spearman 相关系数,其中Pearson 相关系数适用于连续变量之间的关系,Spearman 相关系数适用于序数类或等距类别的变量之间的关系。

2. 变量膨胀因子(VIF)法。

VIF 是判断某个自变量对其他自变量的回归系数影响的程度。

如果某个自变量的VIF 值超过10,就表示需要对其进行检验和分析。

3. 特征值检验法。

通过计算相关系数矩阵的特征值和特征向量,判断模型是否存在多重共线性。

如果某个特征值较小,就表示存在多重共线性。

4. 条件数检验法。

条件数是相邻特征值之比的平方根。

如果条件数大于30,就表示模型存在多重共线性。

综上所述,多重共线性的检验方法有多种,不同的检验方法可以互相验证,得到更加准确的判断结果。

在实际应用中,可以根据具体情况选择合适的方法进行多重共线性的检验。

多重共线性

多重共线性多重共线性(multicollinearity )的特征● 多重共线性是指一个回归模型中的一些或全部解释变量之间存在有一种“完全”或准确的线性关系:0...2211=+++k k X X X λλλ其中k λλλ,...,,21为常数,但不同时为零。

● 0...2211≈+++k k X X X λλλ, 近似的多重共线性● 通过巴伦坦图做简单的描述。

共线性部分可用两圆圈的重叠部分来衡量。

重叠部分越大,共线性程度越高。

● 我们定义的多重共线性仅对X 变量之间的线性关系而言,它们之间的非线性关系并不违反无多重共线性的假设i i i i u X X Y +++=2210βββ多重共线性的后果●如果多重共线性是完全的,诸X变量的回归系数将是不正确的,并且它们的标准误差为无穷大●如果多重共线性是不完全的,那末,虽然回归系数可以确定,却有较大的标准误差,意思是,系数不能以很高的精确或准精确加以估计,这会导致:-参数估计不精确,也不稳定-参数估计量的标准差较大,影响系数的显著性检验●多重共线性产生的后果具有一定的不确定性●在近似的多重共线性的情况下,只要模型满足CLRM 假定,回归系数就为BLUE,但特定的样本估计量并不一定等于真值。

多重共线性的来源(1)许多经济变量在时间上由共同变动的趋势,如:收入,投资,消费(2)把一些经济变量的滞后值也作为解释变量在模型中使用,而解释变量和滞后变量通常相关,如:消费和过去的收入多重共线性一般与时间序列有关,但在横截面数据中也经常出现多重共线性的检验● 多重共线性是普遍存在的,造成的后果也比较复杂,对多重共线性的检验缺少统一的准则- 对有两个解释变量的模型,作散点图,或相 关系数,或拟和优度R平方。

- 对有多个解释变量的模型,分别用一个解释 变量对其它解释变量进行线性回归,计算拟 和优度22221,...,,k R R R- 考察参数估计值的符号,符不符合理论 - 增加或减少解释变量,考察参数估计值的变 化- 对比拟和优度和t检验值多重共线性的修正方法● 增加样本观测值,如果多重共线性是由样本引起的,可以通过收集更多的观测值增加样本容量。

多重共线性检验方法

多重共线性检验方法

多重共线性检验方法是检验自变量之间是否存在强相关性的一种方法。

共线性可能导致回归结果不可靠,误差增加,对自变量的解释力下降等问题。

因此,进行多重共线性检验是回归分析中非常重要的一环。

常见的多重共线性检验方法包括变量间的相关系数、方差膨胀因子(VIF)和特征值等。

变量间的相关系数可以通过计算自变量两两之间的皮尔逊相关系数来得到。

如果相关系数大于0.8或0.9,可以认为自变量之间存在强相关性。

方差膨胀因子(VIF)是用来度量自变量间线性关系强度的一种方法。

VIF越大,表示自变量与其他自变量之间的相关性越强。

特征值检验是对协方差矩阵进行特征值分解,通过判断特征值的大小来确定自变量之间的共线性程度。

如果存在特征值较小的情况,可以表明存在多重共线性。

此外,还有其他一些检验方法,如条件数、扰动法等,可以用来检验多重共线性。

综上所述,多重共线性检验是回归分析中重要的一步,通过各种方法来判断自变量之间是否存在强相关性,以保证回归模型的稳健性和可靠性。

多重共线性(统计累赘)的概念、特征及其测量方式和处理方式

试述多重共线性(统计累赘)的概念、特征及其测量方式和处理方式。

1、概念多重共线性是指自变量之间存在线性相关关。

倘若其中两个自变项的关系特别强,则在相互控制后就会使每者的效果减弱,而其他的变相的效果就会因此而增大。

2、特征3、产生原因产生多重相关性的原因主要包括四方面。

一是没有足够多的样本数据; 二是选取的自变量之间客观上就有共线性的关系; 还可能由其它因素导致, 如数据采集所用的方法, 模型设定, 一个过度决定的模型等。

但多数研究者认为共线性本质上是由于样本数据不足引起的。

4、测量方式(1)经验式的诊断方法通过观察,得到一些多重相关性严重存在的迹象。

①在自变量的简单相关系数矩阵中,有某些自变量的相关系数值较大。

②回归系数的代数符号与专业知识或一般经验相反;或者该自变量与因变量的简单相关系数符号相反。

③对重要自变量的回归系数进行t 检验,其结果不显著。

特别是当F 检验能在高精度下通过,测定系数R 2的值也很大,但自变量的t 检验却全都不显著,这时多重相关性的可能将会很大。

④如果增加或删除一个变量,或者增加或删除一个观测值,回归系数发生了明显的变化。

⑤重要自变量的回归系数置信区别明显过大。

⑥在自变量中,某一个自变量是另一部分自变量的完全或近似完全的线性组合。

⑦对于一般的观测数据,如果样本点的个数过少,比如接近于变量的个数或者少于变量的个数,样本数据中的多重相关性就会经常存在。

(2)统计检验方法共线性的诊断方法是基于对自变量的观测数据构成的矩阵X ’X 进行分析,使用各种反映自变量间相关性的指标。

共线性诊断常用的统计量有方差膨胀因子VIF 或容限TOL 、条件指数和方差比例等。

方差膨胀因子VIF 是指回归系数的估计量由于自变量的共线性使其方差增加的一个相对度量。

对于第i 个回归系数,它的方差膨胀因子定义为:VIF=1/1-R 2=1/TOL i 其中R2i 是自变量Xi 对模型中其余自变量线性回归模型的R 平方。

第五讲-多重共线性、异方差、自相关

表 4.3.3 中国粮食生产与相关投入资料

农业化肥施 粮食播种面 受灾面积 农业机械总

用量 X 1

(万公斤)

积X 2

(千公顷)

X3

(公顷)

动力X 4

(万千瓦)

1659.8

114047 16209.3

18022

1739.8

11288பைடு நூலகம் 15264.0

19497

1775.8

108845 22705.3

20913

0.9752 1.53

t值

0.85

19.6 3.35 -3.57

Y=f(X1,X2,X3,X4) -13056 6.17 0.42 -0.17 -0.09

0.9775 1.80

t值

-0.97 9.61 3.57 -3.09 -1.55

Y=f(X1,X3,X4,X5) -12690 5.22 0.40 -0.20

含义:解释变量的样本向量近似线性相关。

多重共线性来源:

(1)解释变量x受到同一个因素的影响; 例如:政治事件对很多变量都产生影响,这些变量同时上升 或同时下降。

(2)解释变量x自己的当期和滞后期;

(3)错误设定。

二、多重共线性的后果

1、完全共线性下参数估计量不存在

Y X

的OLS估计量为: βˆ (XX) 1 XY

1、检验多重共线性是否存在

(1)对两个解释变量的模型,采用简单相关系数法 求出X1与X2的简单相关系数r,若|r|接近1,则说

明两变量存在较强的多重共线性。

(2)对多个解释变量的模型,采用综合统计检验法

若 在OLS法下:R2与F值较大,但t检验值较小, 说明各解释变量对Y的联合线性作用显著,但各解 释变量间存在共线性而使得它们对Y的独立作用不 能分辨,故t检验不显著。

多重共线性解决方法

多重共线性解决方法

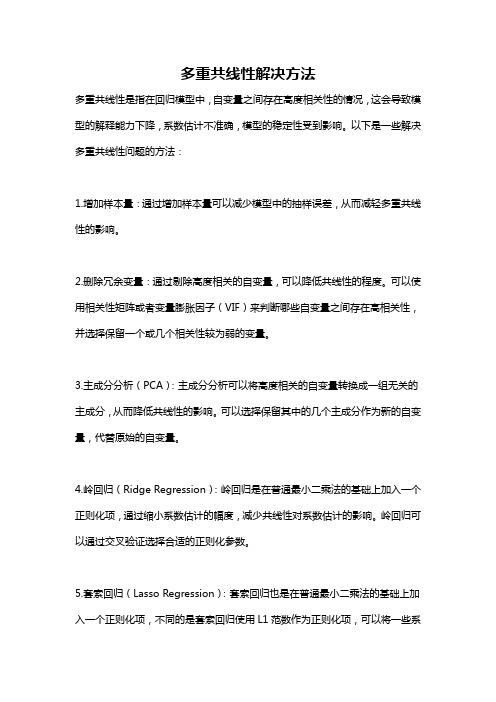

多重共线性是指在回归模型中,自变量之间存在高度相关性的情况,这会导致模型的解释能力下降,系数估计不准确,模型的稳定性受到影响。

以下是一些解决多重共线性问题的方法:

1.增加样本量:通过增加样本量可以减少模型中的抽样误差,从而减轻多重共线性的影响。

2.删除冗余变量:通过剔除高度相关的自变量,可以降低共线性的程度。

可以使用相关性矩阵或者变量膨胀因子(VIF)来判断哪些自变量之间存在高相关性,并选择保留一个或几个相关性较为弱的变量。

3.主成分分析(PCA):主成分分析可以将高度相关的自变量转换成一组无关的主成分,从而降低共线性的影响。

可以选择保留其中的几个主成分作为新的自变量,代替原始的自变量。

4.岭回归(Ridge Regression):岭回归是在普通最小二乘法的基础上加入一个正则化项,通过缩小系数估计的幅度,减少共线性对系数估计的影响。

岭回归可以通过交叉验证选择合适的正则化参数。

5.套索回归(Lasso Regression):套索回归也是在普通最小二乘法的基础上加入一个正则化项,不同的是套索回归使用L1范数作为正则化项,可以将一些系

数估计缩减为零,从而实现变量选择的效果。

6.弹性网回归(Elastic Net Regression):弹性网回归是岭回归和套索回归的结合,同时使用L1和L2范数作为正则化项,可以在预测准确性和变量选择之间进行权衡。

以上方法可以根据具体问题的特点和需求选择合适的方法来解决多重共线性问题。

计量经济学习题第6章多重共线性

计量经济学习题第6章多重共线性第6章多重共线性⼀、单项选择题1、当模型存在严重的多重共线性时,OLS估计量将不具备()A、线性B、⽆偏性C、有效性D、⼀致性2、经验认为某个解释与其他解释变量间多重共线性严重的情况是这个解释变量的VIF()A、⼤于B、⼩于C、⼤于5D、⼩于53、模型中引⼊实际上与解释变量有关的变量,会导致参数的OLS估计量⽅差()A、增⼤B、减⼩C、有偏D、⾮有效4、对于模型y t=b0+b1x1t+b2x2t+u t,与r12=0相⽐,r12=0.5时,估计量的⽅差将是原来的()A、1倍B、1.33倍C、1.8倍D、2倍5、如果⽅差膨胀因⼦VIF=10,则什么问题是严重的()A、异⽅差问题B、序列相关问题C、多重共线性问题D、解释变量与随机项的相关性6、在多元线性回归模型中,若某个解释变量对其余解释变量的判定系数接近于1,则表明模型中存在( )A 异⽅差B 序列相关C 多重共线性D ⾼拟合优度7、存在严重的多重共线性时,参数估计的标准差()A、变⼤B、变⼩C、⽆法估计D、⽆穷⼤8、完全多重共线性时,下列判断不正确的是()A、参数⽆法估计B、只能估计参数的线性组合C、模型的拟合程度不能判断D、可以计算模型的拟合程度⼆、多项选择题1、下列哪些回归分析中很可能出现多重共线性问题()A、资本投⼊与劳动投⼊两个变量同时作为⽣产函数的解释变量B、消费作被解释变量,收⼊作解释变量的消费函数C、本期收⼊和前期收⼊同时作为消费的解释变量的消费函数D、商品价格、地区、消费风俗同时作为解释变量的需求函数E、每亩施肥量、每亩施肥量的平⽅同时作为⼩麦亩产的解释变量的模型2、当模型中解释变量间存在⾼度的多重共线性时()A、各个解释变量对被解释变量的影响将难以精确鉴别B、部分解释变量与随机误差项之间将⾼度相关C、估计量的精度将⼤幅度下降D、估计对于样本容量的变动将⼗分敏感E、模型的随机误差项也将序列相关3、下述统计量可以⽤来检验多重共线性的严重性()A、相关系数B、DW值C、⽅差膨胀因⼦D、特征值E、⾃相关系数4、多重共线性产⽣的原因主要有()A、经济变量之间往往存在同⽅向的变化趋势B、经济变量之间往往存在着密切的关联C、在模型中采⽤滞后变量也容易产⽣多重共线性D、在建模过程中由于解释变量选择不当,引起了变量之间的多重共线性E、以上都正确5、多重共线性的解决⽅法主要有()A、保留重要的解释变量,去掉次要的或替代的解释变量B、利⽤先验信息改变参数的约束形式C、变换模型的形式D、综合使⽤时序数据与截⾯数据E、逐步回归法以及增加样本容量6、关于多重共线性,判断错误的有()A、解释变量两两不相关,则不存在多重共线性B、所有的t检验都不显著,则说明模型总体是不显著的C、有多重共线性的计量经济模型没有应⽤的意义D、存在严重的多重共线性的模型不能⽤于结构分析7、模型存在完全多重共线性时,下列判断正确的是()A、参数⽆法估计B、只能估计参数的线性组合C、模型的判定系数为0D、模型的判定系数为1三、简述1、什么是多重共线性?产⽣多重共线性的原因是什么?2、什么是完全多重共线性?什么是不完全多重共线性?3、完全多重共线性对OLS估计量的影响有哪些?4、不完全多重共线性对OLS估计量的影响有哪些?5、从哪些症状中可以判断可能存在多重共线性?6、什么是⽅差膨胀因⼦检验法?四、判断(1)如果简单相关系数检测法证明多元回归模型的解释变量两两不相关,则可以判断解释变量间不存在多重共线性。

第6章多重共线性

浙江财经学院 倪伟才

12

例题

例3.3的多重共线性

注意:消费额前面的系数为负的,者符 合常识吗?

题后语:整个回归方程作为整体高度显 著(通过F检验),但有些回归系数不能 通过显著性检验,甚至出现正负号得不 到合理的解释,此时应考虑是否存在多 重共线性。

浙江财经学院 倪伟才

13

四、多重共线性的诊断

(1)R2高,F检验显著,但t检验不显著。

Variable |

VIF

1/VIF

-------------+----------------------

x1 | 482.13 0.002074

x2 | 482.13 0.002074

-------------+----------------------

Mean VIF | 482.13

浙江财经学院 倪伟才

浙江财经学院 倪伟才

17

例题讲解

例3.3多重共线性的判断。(VIF) 1通过辅助回归计算x1的VIF 练习:计算x2的VIF 2:直接产生VIF 3:考虑x1,x2的偏相关系数:0.9776

浙江财经学院 倪伟才

18

stata

相关命令请参考

数据:消费和收入财富的多重共线性.dta reg y x1 x2 vif

浙江财经学院 倪伟才

11

2.近似完全多重共线性的后果

将xi2 xi1 i 代入ˆ1

ˆ1=

(yi x i1 )(2

x

2 i1

i2 ) - (

yi xi1

yii )(

xi21( 2 xi21 i2 ) ( xi21)2

x

2 i1

)

①将x2=λx1+v代入^1说明x2,x1共线性程度越 高,即v越趋于0,从而^1 趋于不确定。② var(^1 )会增大;③参数显著性检验的t统计量: t= ^1 / [var(^1 )] (1/2) ,存在共线时,var(^1 ) 会增大,t值会变小。对于给定,当|t|<t(/2) , 接受 原假设(相关系数0)表明x1对y的影响不显著。总 之,实际上x1对y的影响是显著的,但由于共线性, 可导致x1对y的影响不显著的!

计量经济第六章多重共线性

• 2、数据采集的范围有限,或采集 的样本量小于模型的自变量个数。

• 如在罕见疾病的研究过程中,由于病 情罕见、病因又相当复杂,而只能在 少数的患者身上采集大量的变量信息。

3、模型中采用滞后变量

在计量经济模型中,往往需要引入 滞后变量来反映真实的经济关系。 例如,消费=f(当期收入, 前期收入) 显然,两期收入间有较强的线性相 关性。

up

三、方差膨胀因子法

• 自变量间的共线性程度越大时,VIF值也随之 增大。所以也可利用方差膨胀因子来检验 多重共线性问题。 • 一般来说,当VIF >10时,表明 涉及的两个 变量存在高度线性相关,模型存在不完全 多重共线性。

P111 【经典实例】

• 计算得到的方差膨胀因子值分别为

VIF1 =10000,VIF2 =10000,VIF3 =9.6525,VIF4 =11.5875

2 2 2 1

同理易得

ˆ ) Var( 2

• EVIEWS遇到完全多重共线性时,会 显示 • Near singular matrix,无法进行估 计

2、不完全多重共线性下的后果

(1)估计量的方差增大 2 2 x 2 ˆ) 由于 Var ( 1 2 x12x2 (x1 x2 )2

• 可以看出,除了 VIF3 10 ,其余的方 差膨胀因子值均大于10,表明模型中 存在较严重的多重共线性问题。

up

第三节 多重共线性的修正 一、改变模型的形式 二、删除自变量 三、减少参数估计量的方差 四、其它方法 习题

up

• 一、改变模型的形式

• (一)变换模型的函数形式

• 例如将线性回归模型转化为对数模 型或者多项式模型。 • (二)改变模型的自变量的形式

多重共线性名词解释

多重共线性名词解释多重共线性多重共线性,是指同一条曲线在不同时期反映了同一经济行为。

从外部看来,这些具有相同特征或因素的影响在不同的经济行为中是互不相关的。

但是,这些事物之间却存在着内在联系:外在表象或因素之间存在的线性关系可以用一个概念进行解释,就是说,事物在不同时期的不同影响因素是有机整体。

从更广泛的意义上说,每一个影响因素都具有相同的行为,并且,与其他影响因素有机地结合起来,构成一个统一的模式,而该模式又反过来对另一类型的影响因素产生决定性的影响。

11、地方政府支出变动; 12、总统选举(赢者通吃); 13、结构变迁,也叫结构演化; 14、创新系统; 15、全球化; 16、文化遗产。

2、现代主义的城市设计理念,将都市视为由“住宅区—商业区—工业区”三部分组成的体系。

3、城市设计必须考虑城市空间的问题,即研究如何使人们的生活活动与各种建筑要素、城市的生态环境之间保持协调和融洽,从而达到舒适、安全、健康、卫生和高效率的目的。

4、城市形象是城市的面子。

5、美国城市设计师查尔斯·罗奇(Charles Lorich)最早提出这个概念,认为当代城市不仅需要考虑功能、技术和经济的问题,而且还应考虑空间和社会层面的问题。

6、区域化导致市场分割。

7、超大城市化正在发展。

8、现代主义强调标准化、简约化和功能性,注重形式逻辑、数字技术和系统分析,因此在城市设计领域颇受推崇。

9、我国正处于城镇化快速发展阶段。

10、“城乡规划是一门为公众利益服务的艺术。

”6、区域化导致市场分割,尤其在资本积累时期。

城市边缘化现象严重。

7、目前的城市空间扩张伴随着高成本、高风险和高消耗。

8、现代主义空间追求便捷、开放和轻松。

9、城市结构理论的发展与新城市主义思潮的兴起。

10、美国城市设计师查尔斯·罗奇(Charles Lorich)最早提出这个概念,认为当代城市不仅需要考虑功能、技术和经济的问题,而且还应考虑空间和社会层面的问题。

多重共线性

2.采用综合统计检验法

R2与F值较大,但t检验值较小,说明各解释变量对Y的联合线 性作用显著,但各解释变量间存在共线性而使得它们对Y的独 立作用不能分辨,故t检验不显著。

3.3 多重共线性

3、辅助回归模型检验 通过每个解释变量对其它解释变量的辅助回归模型

xi a0 a1 x1 ai 1 xi 1 ai 1 xi 1 ak xk

3.3多重共线性

• • • • 多重共线性及其产生原因 多重共线性的后果 多重共线性的检验 多重共线性的方法

一、多重共线性及其产生原因

1.多重共线性的概念---解释变量间相关

对于多元线性回归模型 yi=b0+b1x1i+b2x2i+…+bkxki+εi 存在一组不全为零的常数λ1,λ2,…λk,使得 λ1x1i + λ2x2i +…+ λkxki +νi=0 其中νi是一个随机误差项,则称模型存在着多重共线性。 “共线性”:变量间线性相关 “多重”:多种组合 “完全多重共线性”: νi=0

3.3 多重共线性

例5.服装需求函数。根据理论和经验分析,影响居民服 装需求的主要因素有:可支配收入X、流动资产拥有量 K、服装类价格指数P1和总物价指数P0 。教材P124的表 3-4给出了有关统计资料。 设服装需求函数为 :Y=a+b1x+b2P1+b3P0+b4K+ε (1)相关系数检验 键入:COR Y X K P1 P0 输出的相关系数矩阵为:

3.3 多重共线性

2、间接剔除重要的解释变量 ⑴利用附加信息

例如,著名的Cobb-Dauglas 生产函数中

附加信息: α +β =1 则

计量经济学:多重共线性

影响比较大的,略去影响较小的。

元线性回归模型并进行OLS估计,拟合优度最大且接近1时,说明

这个变量与其他所有解释变量间存在共线性。

第三节 多重共线性的检验

辅助回归法中的方差膨胀因子:

对 于 多 元 线 性 回 归 模: 型Yi 0 1 X 1i ... k X ki ui 为 判 断 诸 自 变 量 间 是存 否在 多 重 共 线 性 , 进如 行下 辅 助 回 归 : X ji 0 1 X 1i ... j 1,i X j 1,i j 1,i X j 1,i ... k X ki v i , j 1,2,...,k 若 上 述 辅 助 回 归 的 可系 决数 为 R2 X j的 方 差 膨 胀 因 子 为 : j, 则 定 义 自 变 量 1 VIF j 1 R2 j

第一节 多重共线性的概念

若有c0+c1X1i+c2X2i+…+ckXki=0 i=1,2,…,n。其中: ci不全为0,则称

解释变量间存在完全多重共线性

若存在:c0+c1X1i+c2X2i+…+ckXki≈0 i=1,2,…,n。 其中:ci不全为0,

则称为解释变量间存在近似多重共线性。

完全共线性的情况并不多见,一般出现的是在一定程度上的共线性,

第二节 多重共线性的来源与后果

4、参数估计值不稳定,经济含义不合理

样本观测值稍有变动、增加或减少解释变量等都会使参数估计值发生较大变 化,甚至出现符号错误,从而不能正确反映解释变量对被解释变量的影响。

5、模型的预测功能失效

较大的方差容易使预测区间变大,从而使预测失去意义

注意:只要模型满足经典假设,则在近似多重共线性情况下,OLS估计量仍 然满足无偏性、线性性和有效性。但此时,无偏性并不意味着对某一给定样 本,其参数估计值就等于真实值。有效性也不意味着参数估计量的方差一定 很小。

最新应用回归分析-第6章课后习题参考答案

第6章多重共线性的情形及其处理思考与练习参考答案6.1 试举一个产生多重共线性的经济实例。

答:例如有人建立某地区粮食产量回归模型,以粮食产量为因变量Y,化肥用量为X1,水浇地面积为X2,农业投入资金为X3。

由于农业投入资金X3与化肥用量X1,水浇地面积X2有很强的相关性,所以回归方程效果会很差。

再例如根据某行业企业数据资料拟合此行业的生产函数时,资本投入、劳动力投入、资金投入与能源供应都与企业的生产规模有关,往往出现高度相关情况,大企业二者都大,小企业都小。

6.2多重共线性对回归参数的估计有何影响?答:1、完全共线性下参数估计量不存在;2、近似共线性下OLS估计量非有效;3、参数估计量经济含义不合理;4、变量的显著性检验失去意义;5、模型的预测功能失效。

6.3 具有严重多重共线性的回归方程能不能用来做经济预测?答:虽然参数估计值方差的变大容易使区间预测的“区间”变大,使预测失去意义。

但如果利用模型去做经济预测,只要保证自变量的相关类型在未来期中一直保持不变,即使回归模型中包含严重多重共线性的变量,也可以得到较好预测结果;否则会对经济预测产生严重的影响。

6.4多重共线性的产生于样本容量的个数n、自变量的个数p有无关系?答:有关系,增加样本容量不能消除模型中的多重共线性,但能适当消除多重共线性造成的后果。

当自变量的个数p较大时,一般多重共线性容易发生,所以自变量应选择少而精。

6.5 自己找一个经济问题来建立多元线性回归模型,怎样选择变量和构造设计矩阵X才可能避免多重共线性的出现?答:请参考第三次上机实验题——机场吞吐量的多元线性回归模型,注意利用二手数据很难避免多重共线性的出现,所以一般利用逐步回归和主成分回归消除多重共线性。

如果进行自己进行试验设计如正交试验设计,并收集数据,选择向量使设计矩阵X 的列向量(即X 1,X 2, X p )不相关。

6.6对第5章习题9财政收入的数据分析多重共线性,并根据多重共线性剔除变量。

计量教案(6多重共线性)

第六章 多重共线性在多元线性回归分析的经典假设中,假定模型所包含的解释变量之间不存在线性关系,即无多重共线性。

但是由于经济变量本身的固有性质,许多的变量之间总是会存在着一定的相关性。

例如,以企业截面数据为样本估计的生产函数,作为其解释变量的有诸如资本、劳动、能源……等等投入要素,这些投入要素都与企业的生产规模有关,显然,它们之间存在着明显的相关性。

再如,以家庭收入I和商品价格P为解释变量分析家庭生活状况的模型。

由于收入较高的家庭购买商品,普通会选择质地较好、价格较高的;而收入较低的家庭购买商品则会选择较便宜的。

这样两解释变量I与P之间存在着明显的相关性。

本章的目的与要求当解释变量之间存在着线性关系,违背了解释变量之间不存在共线性的经典假定时,如何处理可能浮现的一系列状况,就是本章所要讨论的问题。

通过本章学习,要求重点掌握的内容是:明确多重共线性的概念及其表现形式;充分理解当线性回归模型存在多重共线性情形下,使用普通最小二乘估计模型参数将会引起的各种不良后果;熟练掌握检测多重共线性的各种方法以及在此情形下相应的处理与估计改进方法,从而能够运用这些知识处理经济计量分析实践中的相应问题。

本章内容(计划学时)一、多重共线性的性质1、多重共线性的概念2、解释变量线性关系的表现形式3、多重共线性的产生原因4、多重共线性的性质二、多重共线性的后果与检测1、多重共线性的后果2、多重共线性的检测方法三、多重共线性的补救措施学习重点一、多重共线性的性质二、多重共线性的后果与检测方法三、多重共线性的补救措施学习难点一、多重共线性的性质二、多重共线性的后果与检测方法 三、多重共线性的补救措施第一节 多重共线性的性质一、多重共线性的概念多重共线性就是指线性回归模型中若干解释变量或者全部解释变量的样本观测值之间具有某种线性关系,也就是说,对于有 k 个解释变量的线性回归模型Y = β0 + β1X 1 + β2X 2 + … + βk X k + u (式6-1.1) 即模型中的各解释变量Xi 的样本观测值之间存在一定的线性关系,我们就称模型存在多重共线性。

多重共线性(Multi-Collinearity)

i 0 1 1i 2 2i

k ki i

(i=1,2,…,n)

其基本假设之一是解释变量

X,

1

X2,,

X

k

互相独立 。

如果某两个或多个解释变量之间出现了相关性, 则称为多重共线性。

如果存在

c1X1i+c2X2i+…+ckXki=0

i=1,2,…,n

其中: ci不全为0,即某一个解释变量可以用其它解释 变量的线性组合表示,则称为解释变量间存在完全

2

1

x12i 1 r 2

2

x12i

所以,多重共线性使参数估计量的方差增大。

方差扩大因子(Variance Inflation Factor)为1/(1-r2), 其增大趋势见下表:

相关系 0 0.5 0.8 0.9 0.95 0.96 0.97 0.98 0.99 0.999 数平方 方差扩 1 2 5 10 20 25 33 50 100 1000 大因子

多重共线性(Multi-Collinearity)

§2.8 多重共线性

Multi-Collinearity

一、多重共线性的概念 二、多重共线性的后果 三、多重共线性的检验 四、克服多重共线性的方法 五、案例

一、多重共线性的概念

1、多重共线性

• 对于模型

Y X X X

以二元回归模型中的参数估计量ˆ 为例,ˆ 的方差为

1

1

Var(ˆ )

1

ˆ 2

(X X

)1

22

(

ˆ

2

(

x2

2i

)

x2 )( x2 ) ( x

多重共线性

1981 1982 1983 1984 1985 1986 1987 1988 1989 1990 1991 1992 1993 1994 1995 1996 Y 4901 5489 6076 7164 8792 10133 11784 14704 16466 18320 21280 25864 34501 47111 59405 68498 C(-1) 2976 3309 3638 4021 4694 5773 6542 7451 9360 10556 11362 13146 15952 20182 27216 34529 C(-1)/Y 0.6072 0.6028 0.5996 0.5613 0.5339 0.5697 0.5552 0.5067 0.5684 0.5762 0.5339 0.5083 0.4624 0.4284 0.4581 0.5041

y ( 1 2 ) x1

只能确定综合参数 1 2 的估计值:

ˆ ˆ 1 2 x1i y i x12i

4.2.2 不完全多重共线性下的 后果

(1)参数估计仍是无偏估计,但不稳定;估计量 及其标准差非常敏感,观测值稍微变化,估计 量就会产生较大的变动。 (2)参数估计式的方差随着共线性程度的增大而 增大。 (3)t检验失效,区间估计失去意义;估计量的 方差很大,相应标准差增大,进行t检验时,接 受零假设的可能性增大 (4)严重多重共线性时,甚至参数估计式的符号 与其经济意义相反。得出完全错误的结论。

2i

2i

2 2i

x y x y x x

1i i 1i 2 1i 2 1i

i

x12i 2 x12i

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

5.1 the nature of multicollinearity

three variable linear regression model

Yt= β0+ β1X1t+β2X2t +ut E(Yt)= β0+ β1X1t+β2X2t E(Y suppose that X1,X2 are perfectly linearly

CHAPTER 6 MULTICOLLINEARITY

the assumption 6 of multiple regression can’t be satisfied,namely, among the explanatory variables there is more or less linear function relation e.g. The demand function of chicken Y=B0+B1X1i+B2X2i+B3X3i+B4X4i Yi-demand of chicken, X1-PDI 。 X2-the price of chicken,X3,X4-price of pork and , beef

Ct= β0+ β1Yt+β2Yt-1 + β3Yt-2 +ut

theoretically, OLS estimator is still BLUE, , but practically: :

1 . Even though the variance of OLS estimator is minimum, the estimators have large variance ,making the estimation difficult 2. The confidence interval becomes wider and t ratio . becomes smaller ,leading to the acceptance of the “zero null hypothesis” and some regressors are statistically insignificant 3. R2 , the overall measure of goodness of fit, can be very high 4. The ols estimator and their standard error can be . sensitive to small changes in the data。 。 5.The sign of regression coefficient maybe wrong . 6. It is difficult to separate the influence of every regressor on the regressand

4.Auxiliary regression Auxiliary regression: regress each Xi on the remaining X variables and compute the corresponding Ri2 regressorX1,X2,…,Xk, , X1=f1(X2,X3, …,Xk) X2=f2(X1,X3, …,Xk) Xj=fj(X1,…,Xj-1, Xj+1,…Xk) Xk=fk(X1,X2,…Xk1) RULE: Among the corresponding R12 , R22 , … , Rk2 , the greatest one and statistically significant ,namely, Rj2 indicates that Xj is the main factor leading to mulicollearity

5.eigenvalues(本征值) and condition index(条 本征值)

件指数) 件指数)

CI =

max imum min imum

eigenvalue eigenvalue

=

k

CI<10, slight multicollinearity Ci is between 10~30,moderate , mulicollinearity CI>30,severe or strong multicolliearity ,

Y=f(X1,X2,…Xk), R2 of origin regression ( regression Y1=f1 ( X2,X3,…,Xk ) , R12 of excluding X1 Y2=f2 ( X1,X3,…,Xk ) , R22 of regression excluding X2 Yi=fi(X1, …,Xi-1,Xi+1…,Xk) Yh=fk ( X1,X2,…,Xk-1 ) , RK2 of regression excluding Xk RULE: the Xi corresponding to the greatest Ri2 maybe the regressor leading multicollinearity。 to the most severe multicollinearity。

6、variance inflation factor(方差膨胀因子)

∧ δ2 1 δ2 ) = 2 • VIF j Var = 2 • ( 2 β j Σx Σx j 1− R j j 1 , VIF j = 2 1− R j

is called variance inflation factor Ri is corresponding coefficient of determination in the regression of regressor Xi on the remaining regressors in the model. IF VIF of a variable exceeds 10, the variable is said be highly collinear.

correlated, therefore their coefficient of correlation is 1

r2 =

(Σx1i

x2i )2

Σx1i Σx2i

2

2

=1

Σx ⋅ Σx − Σx1i ⋅ Σx2i

2 1i 2 2i

(Hale Waihona Puke )2=0see the estimator of parameters of regression ∧ (Σ y i ⋅ x 1 i ) ⋅ Σ x 22 i − Σ y i ⋅ x 2 i ⋅ Σ x 1 i ⋅ x 2 i = 2 β1 Σ x 12i ⋅ Σ x 2 i − (Σ x 1 i ⋅ x 2 i )2 ∧ (Σ y i ⋅ x 2 i ) ⋅ Σ x 12i − Σ y i ⋅ x 1 i ⋅ Σ x 1 i ⋅ x 2 i = 2 β2 Σ x 12i ⋅ Σ x 2 i − (Σ x 1 i ⋅ x 2 i )2

1、Do nothing 、 2、use of priori information 、

priori information come from previous empirical work and relevant theory Y=AKαLβ lnY=lnA+αlnk+βLnL+µ suppose constant returns to scale,namely,α+β=1, , substitute β=1- α into double-log model

5.4 REMEDIAL MEASURES OF MULTICOLLINEARITY

Keep these rules in your mind: Multicollinearity is a question of degree and not of kind Multicollinearity is a feature of the sample and not of the population Whether the multicollinearity need to be corrected is decided by the purpose of regression:to forecast or to estimate the accurate regression coefficient.

2 ∧ δ 2 Σx2i Var = β 2 2 1 Σx1i Σx2i − Σx1i x2i

(

)

2

2 ∧ δ 2 Σx1i Var = β 2 2 2 Σx1i Σx2i − Σx1i ⋅ x2i

(

)

2

Because denominator is zero, the regression coefficients are indeterminate and standard error are infinite

5.2 the source and practical consequence of multicollinearity

5.2.1 the source of multicollinearity Multicollinearity may be due to the following factors 1. Data of regressors share a common time trend. 2 . The inherent relationship among the crosseconomic variable especially in crosssection data 3 . Model specification, e.g. polynomial model, or as following