信息论与编码-第一章

信息论与编码复习总结

x2 x3 x4 x5 x6 X x1 P 1 / 6 1 / 6 1 / 6 1 / 6 1 / 6 1 / 6

• • 发出单个符号的信源 – 指信源每次只发出一个符号代表一个消息; 发出符号序列的信源 – 指信源每次发出一组含二个以上符号的符号序列代表一个消息 信源的描述

平均自信息 平均不确定度 信源熵(公式一定要记住) H(X):平均信息量,称为信源 X 的熵。 信源熵、香农熵 离散信源熵 H(X)

(平均不确定度/平均信息量/平均自信息量) 定义:信源的平均不确定度 H(X)为信源中各个符号不确定度的数学期望,即:

H ( X ) p( xi ) I ( xi ) p( xi ) log p( xi )

简答题: 一、 信源编码与信道编码的区别 答:信源编码是压缩信源发出的信息的冗余度,是为了提高信息传输的有效性;而信 道编码是在信源编码器输出的代码组上有目的地增加了一些监督码元,增大了信息的 冗余度,以提高传输信息的可靠性。 二、 能否将三种码(信源编码、信道编码、密码)合成一种码进行编译? 答:提高有效性必须去掉信源符号中的冗余部分,此时信道误码会使接收端不能恢复原 来的信息,也就是必须相应提高传送的可靠性,不然会使通信质量下降; 反之,为了可靠而采用信道编码,往往需扩大码率,也就降低了有效性。安全性也有 类似情况 编成密码,有时需扩展码位,这样就降低有效性;有时也会因失真而使授权用户无法 获得信息,必须重发而降低有效性,或丢失信息而降低可靠性。 从理论方面来说,若能把三种码合并成一种码来编译,即同时考虑有效、可靠和安全, 可使编译码器更理想化,在经济上可能也更优越。 这种三码合一的设想是当前众所关心的课题,但因理论上和技术上的复杂性,要 取得有用的结果,还是相当困难。

信息论与编码(曹雪虹第三版)第一、二章

根据传输介质的不同,信道可分为有线信道和无线信道两大类。有线信道包括 双绞线、同轴电缆、光纤等;无线信道包括微波、卫星、移动通信等。

信道容量的定义与计算

信道容量的定义

信道容量是指在给定条件下,信道能 够传输的最大信息量,通常用比特率 (bit rate)来衡量。

信道容量的计算

信道容量的计算涉及到信道的带宽、 信噪比、调制方式等多个因素。在加 性高斯白噪声(AWGN)信道下,香农 公式给出了信道容量的理论上限。

信道编码分类

根据编码方式的不同,信道编码可分为线性分组码和卷积码 两大类。

线性分组码

线性分组码定义

线性分组码是一种将信息 序列划分为等长的组,然 后对每个组独立进行编码 的信道编码方式。

线性分组码特点

编码和解码过程相对简单 ,适用于各种信道条件, 且易于实现硬件化。

常见的线性分组码

汉明码、BCH码、RS码等 。

将信源消息通过某种数学变换转换到另一个域中,然后对变换 系数进行编码。

将连续的信源消息映射为离散的数字值,然后对数字值进行编 码。这种方法会导致量化噪声,是一种有损的编码方式。

信道编码的定义与分类

信道编码定义

信道编码是为了提高信息传输的可靠性、增加通信系统的抗 干扰能力而在发送端对原始信息进行的一种变换。

信息熵总是非负的,因 为自信息量总是非负的 。

当随机变量为确定值时 ,其信息熵为0。

对于独立随机变量,其 联合信息熵等于各自信 息熵之和。

当随机变量服从均匀分 布时,其信息熵达到最 大值。

03

信道与信道容量

信道的定义与分类

信道的定义

信道是信息传输的媒介,它提供了信号传输的通路,是通信系统中的重要组成 部分。

信息论与编码-曹雪虹-课件第1章

信息论

一门应用概率论、随机过程、数理统计 和近代代数的方法,来研究信息传输、 提取和处理系统中一般规律的学科。

信息论是在信息可以量度的基础上,研究有 效地和可靠地传递信息的科学,它涉及信息 量度、信息特性、信息传输速率、信道容 量、干扰对信息传输的影响等方面的知识

30

信息

是事物运动状态或存在方式的不确定性的描

香农定义的信息也有其局限性,存在一些缺陷 定义的出发点是假定事物状态可以用一个以 经典集合论为基础的概率模型来描述。 没有考虑收信者的主观特性和主观意义,也 撇开了信息的具体含意、具体用途、重要程 度和引起后果等因素。

36

37

狭义信息论:

主要研究信息的测度、信道容量以及信源和信 道编码理论等问题。

接收者在收到信息之前,对它的内容是不知道的, 所以,信息是新知识、新内容;

信息是能使认识主体对某一事物的未知性或不确 定性减少的有用知识;

信息可以产生,也可以消失,同时信息可以被携 带、贮存及处理;

信息是可以量度的,信息量有多少的差别

32

例:气象预报 甲

乙

• “甲地晴”比“乙地晴”的不确定性来的 小

第一层:通信符号如何精确传输?(技术问题)

第二层:传输的符号如何精确携带所需要的含义? (语义问题)

第三层:所接收的含义如何以所需要的方式有效 地影响行为?(效用问题)

Weaver认为仙农的工作属于第一层,但他又证明 仙农的工作是交叉的,对第二、三层也有意义。

信息是认识主体(人、生物、机器) 所感受的和所表达的事物运动的状态和运 动状态变化的方式。

把广义信息分成三个基本层次,即语法 信息,语义信息,语用信息,分别反映事 物运动状态及其变化方式的外在形式、内 在含义和效用价值。

信息论与编码_第一章

信息论发展中的悲情人物

• 诺贝尔经济学获得者:

JOHN NASH

于1951年发表《非合作博弈论》

成就著名的“纳什均衡”理论

1958年(30岁)开始痴迷于信息编码技术,出现精神失 常。直到80年代末,方从癫疯中苏醒,继续从事经济学博弈 论研究,1994年获得诺贝尔经济学奖

奥斯卡影片《美丽心灵》

第二节、信息的概念

(17) 发现格码,1989,R.deBuda。格(lattice)码可趋近频带受限高斯信道 容量。Loeligerz在1992年已证明,这是Zp上的欧氏空间群码。

(18)发现Turbo码,迭代自适应译码算法,1993, C. Berrou and A. Glavieux. (19) LDPC码,近来又重新被发现。

信息定义的总结

• 信息是人与外界交互的内容,是有序程度的度量 和负熵,是用以减少不定性的东西 ,这些都是 Wiener 、 Brillouin 、 Shannon 等人的理解。这些 认识比仅仅把信息看作消息或通信内容要更深刻。 • 在数学上很容易证明, Hartley 的信息概念仅是 Shannon信息概念的一种特殊情形。 • 总起来说,在现有的各种理解中, Shannon 的定 义比较深刻,而且这种定义还导出了相应的算法。

香农信息定义的缺陷(2)

• 只考虑了随机型的不定性,不能解释与其 他型式的不定性(如模糊不定性)有关的 信息问题。 • 这种信息定义只从功能角度上来表述,还 是没有从根本上回答“信息是什么”的问 题。

2、发展

信 息 论 主 要 几 个 方 面 的 进 展

Ⅰ.信源编码与数据压缩 Ⅱ.信道编码与差错控制技术 Ⅲ.多用户信息论与网络通信 Ⅳ.多媒体与信息论 Ⅴ.信息论与密码学和数据安全 Ⅵ.信息论与概率统计 Ⅶ.信息论与经济学 Ⅷ.信息论与计算复杂性 Ⅸ.信息论与系统、控制、信号检测和处理 Ⅹ.量子信息论 Ⅺ.Shannon的其它重要贡献

信息论与编码_第一章.

(Information theory and coding)

主讲老师:姚志强 yaozhiqiang@

学习的意义

• 信息论与编码理论是信息科学的基础理论, 对信息进行定量的分析,对信息处理给出理 论的指导,是20世纪后半叶数字化革命的主 要理论和技术支柱.

• 信息论与编码的许多思想和方法已广泛渗透 到许多领域: [计算机],[通信技术],[统计学], [物理学], [生物学],[系统科学], [经济学], [社会学], ……

需具备的相关数学知识:

高等数学 概率与统计理论 矩阵论 最优化理论 需了解的相关专业方面知识:

通信原理

本课程的主要教学目标: 信息论基本原理与应用

第一章、绪论

第一节、信息论起源和发展 第二节、信息的概念 第三节、信息论的研究内容和核心

第一节、信息论的起源及发展

1、起源

1924年,奈奎斯特(Nyquist):信号带宽和信息 速率间的关系。

主要参考文献

• 《信息理论与编码》 姜丹、钱玉美编著 中国科技大学出版 社(第一版,第二版,第三版);

• 《信息论—基础理论与应用》 傅祖芸编著 电子工业出版社

2001年版;

• 《信息论与编码方法》西南交通大学勒蕃教授著;

• 《信息论与编码》陈运、周亮、陈新编著 电子工业出版社; • 《信息论与编码》仇佩亮 编著 高等教育出版社;

息的理解:信息是用来减少随机不确定性的东西。 • 这篇论文以概率论为工具,深刻阐述了通信 随机不确定性是指由于随机因素所造成的不能肯定 工程的一系列基本理论问题,给出了计算信 的情形,在数值上可以用概率熵来计量。 源信息量和信道容量的方法和一般公式,得 到了一组表征信息传递重要关系的编码定理。

信息论与编码第一章绪论

形成和发展

1. 信息论研究的主要问题(续2)

4)无失真信源编码,所需要的最少码符号数是多少?

香农第一定理: 如果编码后的信源序列的

编码信息率不小于信源的熵,那么一定存

在一种无失真信源编码方法;否则,不存

在这样的一种无失真信源编码方法。

第一章:绪论

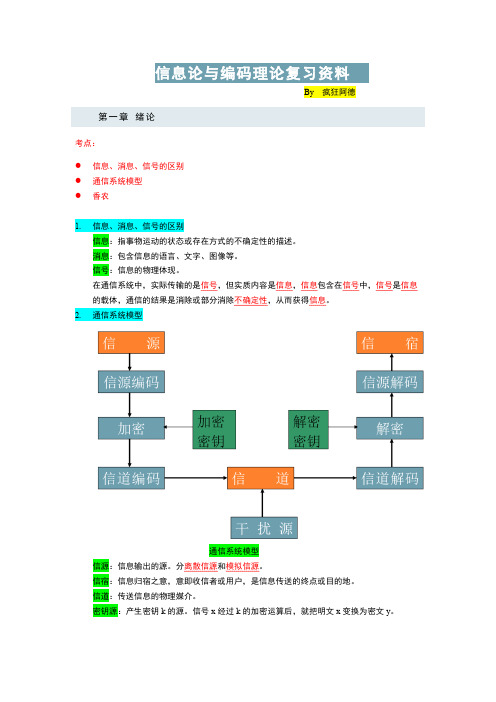

什么是信息 通信系统模型 研究内容

形成和发展

1. 信息论研究的主要问题(续3)

形成和发展

3. 信息的狭义概念(香农信息) (续6)

香农信息的优点:

➢ 有明确的数学表达式,定量化

➢ 与人们直观理解的信息含义一致

➢ 不考虑收信者主观感受的不同,认为同一消息对

任何收信者,所得信息量相同。

第一章:绪论

什么是信息 通信系统模型 研究内容

形成和发展

3. 信息的狭义概念(香农信息) (续7)

3)信道

狭义信道

广义信道

形成和发展

第一章:绪论

什么是信息 通信系统模型 研究内容

1. 通信系统模型(续10)

研究内容:

信道的统计特性

➢

无噪声信道、有噪声信道

➢

离散信道、连续信道、波形信道

➢

有记忆信道和无记忆信道

➢

恒参信道(平稳信道)和随参信道(非平稳信道)

➢

单用户信道和多用户信道

信道传输信息的最高速率

(Carson,1922)、电视(1925-1927)、调频广播

提高可靠性: (可靠传输)

➢ 信道编码

第一章:绪论

一、什么是信息

二、通信系统模型

1. 信息论研究的主要问题

三、信息论的研究内容

信息论与编码

信息论与编码第⼀章1、信息,信号,消息的区别信息:是事物运动状态或存在⽅式的不确定性的描述消息是信息的载体,信号是消息的运载⼯具。

2、1948年以“通信的数学理论”(A mathematical theory of communication )为题公开发表,标志着信息论的正式诞⽣。

信息论创始⼈:C.E.Shannon(⾹农)第⼆章1、⾃信息量:⼀个随机事件发⽣某⼀结果后所带来的信息量称为⾃信息量,简称⾃信息。

单位:⽐特(2为底)、奈特、笛特(哈特)2、⾃信息量的性质(1)是⾮负值(2) =1时, =0, =1说明该事件是必然事件。

(3) =0时, = , =0说明该事件是不可能事件。

(4)是的单调递减函数。

3、信源熵:各离散消息⾃信息量的数学期望,即信源的平均信息量。

)(log )(])(1[log )]([)( 212i ni i i i a p a p a p E a I E X H ∑=-===单位:⽐特/符号。

(底数不同,单位不同)信源的信息熵;⾹农熵;⽆条件熵;熵函数;熵。

4、信源熵与信息量的⽐较(书14页例2.2.2)()log () 2.1.3 i i I a p a =-()5、信源熵的意义(含义):(1)信源熵H(X)表⽰信源输出后,离散消息所提供的平均信息量。

(2)信源熵H(X)表⽰信源输出前,信源的平均不确定度。

(3)信源熵H(X)反映了变量X 的随机性。

6、条件熵:(书15页例2.2.3) 7、联合熵:8、信源熵,条件熵,联合熵三者之间的关系:H(XY)= H(X)+H(Y/X) H(XY)= H(Y)+H(X/Y)条件熵⼩于⽆条件熵,H(Y/X)≤H(Y)。

当且仅当y 和x 相互独⽴p(y/x)=p(y),H(Y/X)=H(Y)。

两个条件下的条件熵⼩于⼀个条件下的条件熵H(Z/X,Y)≤H(Z/Y)。

当且仅当p(z/x,y)=p(z/y)时取等号。

联合熵⼩于信源熵之和, H(YX)≤H(Y)+H(X)当两个集合相互独⽴时得联合熵的最⼤值 H(XY)max =H(X)+H(Y) 9、信息熵的基本性质:(1)⾮负性;(2)确定性;(3)对称性;(4)扩展性(5)可加性 ( H(XY) = H(X)+ H(Y) X 和Y 独⽴ H (XY )=H (X )+ H (Y/X )H (XY )=H (Y )+ H (X/Y ) )(6)(重点)极值性(最⼤离散熵定理):信源中包含n 个不同离散消息时,信源熵H(X)有当且仅当X 中各个消息出现的概率全相等时,上式取等号。

信息论与编码第一章答案

第一章信息论与基础1.1信息与消息的概念有何区别?信息存在于任何事物之中,有物质的地方就有信息,信息本身是看不见、摸不着的,它必须依附于一定的物质形式。

一切物质都有可能成为信息的载体,信息充满着整个物质世界。

信息是物质和能量在空间和时间中分布的不均匀程度。

信息是表征事物的状态和运动形式。

在通信系统中其传输的形式是消息。

但消息传递过程的一个最基本、最普遍却又十分引人注意的特点是:收信者在收到消息以前是不知道具体内容的;在收到消息之前,收信者无法判断发送者将发来描述何种事物运动状态的具体消息;再者,即使收到消息,由于信道干扰的存在,也不能断定得到的消息是否正确和可靠。

在通信系统中形式上传输的是消息,但实质上传输的是信息。

消息只是表达信息的工具,载荷信息的载体。

显然在通信中被利用的(亦即携带信息的)实际客体是不重要的,而重要的是信息。

信息载荷在消息之中,同一信息可以由不同形式的消息来载荷;同一个消息可能包含非常丰富的信息,也可能只包含很少的信息。

可见,信息与消息既有区别又有联系的。

1.2 简述信息传输系统五个组成部分的作用。

信源:产生消息和消息序列的源。

消息是随机发生的,也就是说在未收到这些消息之前不可能确切地知道它们的内容。

信源研究主要内容是消息的统计特性和信源产生信息的速率。

信宿:信息传送过程中的接受者,亦即接受消息的人和物。

编码器:将信源发出的消息变换成适于信道传送的信号的设备。

它包含下述三个部分:(1)信源编码器:在一定的准则下,信源编码器对信源输出的消息进行适当的变换和处理,其目的在于提高信息传输的效率。

(2)纠错编码器:纠错编码器是对信源编码器的输出进行变换,用以提高对于信道干扰的抗击能力,也就是说提高信息传输的可靠性。

(3)调制器:调制器是将纠错编码器的输出变换适合于信道传输要求的信号形式。

纠错编码器和调制器的组合又称为信道编码器。

信道:把载荷消息的信号从发射端传到接受端的媒质或通道,包括收发设备在内的物理设施。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。