普通话语音识别

普通话语音识别技术的研究和应用

普通话语音识别技术的研究和应用语音识别技术在日常生活中越来越普遍,如语音助手、智能音箱等,其中普通话语音识别技术在中国的应用非常广泛。

本文将探讨普通话语音识别技术的研究和应用。

一、普通话语音识别技术的发展普通话语音识别技术在中国的发展历程可以追溯到上世纪80年代。

在当时,由于计算机性能的限制,语音识别技术并不成熟。

20世纪90年代以来,随着计算机技术的飞速发展,语音识别的准确率也逐渐提高。

近年来,由于深度学习技术的出现,语音识别准确率得到了极大的提高。

目前,百度和阿里巴巴等公司在普通话语音识别技术的研究和应用上处于领先地位。

这些公司不仅投入大量资金用于研究和开发,还拥有大量的语音识别数据集和专业的研发团队,令普通话语音识别技术的准确率迅速提升。

二、普通话语音识别技术的原理普通话语音识别技术的原理是基于声学模型、语言模型和发音词典。

其中声学模型用于指定音频片段对应的文本,语言模型用于进一步约束声学模型的输出结果,发音词典则指定单词的发音方式。

具体来说,语音识别系统将输入的语音信号转化为数字信号,并对数字信号进行预处理和特征提取,构建声学模型。

在识别时,声学模型会计算某个语音片段对应文本的概率,选取最有可能的文本作为识别结果。

同时,语言模型会约束识别结果,使其更符合语言规则,从而提高识别准确率。

三、普通话语音识别技术的应用普通话语音识别技术已经得到广泛的应用。

以下是一些典型的应用场景。

1. 语音识别输入普通话语音识别技术可以用于语音识别输入,即将语音转换为文本进行输入。

此技术在很多场景下可以提高效率,例如在开会记录会议内容、在车辆内进行手机操作等。

2. 智能客服智能客服使用普通话语音识别技术进行语音识别,自动分配请求并打开相应的应用程序。

用户只需通过语音说出自己的问题,就可以得到快速、准确的答案。

3. 智能语音助手普通话语音识别技术用于智能语音助手中,例如苹果的Siri、百度的度秘等。

语音助手可以响应用户的语音指令,例如打电话、播放音乐等。

普通话语速变化对语音识别的影响研究

普通话语速变化对语音识别的影响研究随着社会的发展,普通话语速的变化越来越明显。

与此同时,语音识别技术的应用也愈发广泛。

然而,普通话语速变化对语音识别技术的影响又是如何呢?本文将对这一问题进行探讨。

首先,我们需要了解普通话语速变化的具体情况。

随着时代的发展和生活节奏的加快,人们的语速越来越快,这也就导致了语音内容的压缩。

据调查显示,现代人的语速普遍比上一代人快了30%左右。

例如,我们现在常见的表达方式,如“赶快”,“特别”的发音也变得更加简单。

从语音学的角度来分析,语音的速度主要由语音节奏和音节长度两个要素决定。

而语音节奏在现代汉语中越来越不明显,音节长度也越来越短,由此导致了普通话语速的变化。

那么,普通话语速变化对语音识别有何影响呢?根据研究表明,语速的快慢对语音识别有非常大的影响。

大多数的语音识别技术是基于语音信号的频谱特征进行分析和识别的,频谱特征可以通过把语音信号分成多个时间段来获取。

而在语速较快时,语音信号的时间段就会更加短暂,导致频谱特征的分辨率下降,从而影响语音识别的准确性。

此外,普通话语速的变化还会影响到声调。

声调是区分汉语词义的关键要素之一,在语音识别中也是不可或缺的。

然而,在较快的语速下,声调的区分变得更加困难,特别是在连续不断的说话中,声调的变化更加不明显。

这就会导致语音识别出错的情况频繁发生。

为了能够更好地适应普通话语速的变化,语音识别技术也在不断地发展。

例如,随着机器学习技术的应用,可以对不同语速下的语音信号进行分析和标注,从而提高语音识别的准确性。

此外,基于深度学习技术,一些音韵模型也可以更好地适应语音的语速、音调等变化。

总之,普通话语速的变化对语音识别的影响是不可忽视的。

然而,在技术的不断进步下,语音识别的准确性也在不断提高。

相信在未来的发展中,将会有更加先进的技术应用到语音识别领域,使其在普通话语速变化的情况下,仍能准确地识别出语音内容。

语音识别技术在普通话粤语转换中的应用

语音识别技术在普通话粤语转换中的应用第一章:背景介绍在人工智能技术日益发展的今天,语音识别技术已经渐渐成为了各行各业不可或缺的一部分。

在语音识别技术领域,最重要的应用之一就是语音转换。

语音转换指的是将一种语言转化成另一种语言的技术。

在我国,普通话与粤语被认为是两种相当重要的语言,因此在普通话与粤语之间进行转换也成为了一项重要的课题。

本文将围绕语音识别技术在普通话粤语转换中的应用展开探讨。

第二章:语音识别技术的基本原理语音识别技术的基本原理是将语音信号转化成数字信号。

语音信号的本质是波动信号,在计算机中无法直接处理,因此需要将其转化成数字信号,常用的方法是通过A/D采样将模拟信号转化成数字信号。

将语音信号转化成数字信号后,需要进行特征提取,常用的特征包括MFCC、PLP等。

接着,需要使用一些算法对数字信号进行分析处理,目前主要的算法包括隐马尔科夫模型和深度学习算法。

最后就是对处理后的数字信号进行识别,得出相应的文本结果。

第三章:普通话与粤语语音特征的差别普通话和粤语作为两种语言,语音特征有很大区别。

普通话是一种声调语言,声调变化非常重要。

而粤语则是一种精音语言,音节韵律变化非常灵活。

因此,在语音识别技术中,对于普通话和粤语的处理需要有所差别。

另外,普通话和粤语还有不同的语音库,这也会影响到语音识别的精度。

第四章:普通话粤语转换系统的设计和实现普通话粤语转换系统的设计包括语音信号的预处理、特征提取、模型训练和语音转换等环节。

其中,预处理包括对语音信号进行去噪、标准化等处理;特征提取主要考虑如何获取精确的语音特征;模型训练是将语音转换模型训练成具有良好性能的模型;而语音转换则是将普通话转化成粤语或者将粤语转化成普通话。

在具体实现过程中,可以使用开源语音识别框架如Kaldi、Sphinx等,也可以使用成熟的语音转换系统如HTS、STP等。

在系统开发过程中,还需要注意到语音库的匹配问题,确保要转换的语音库和训练模型的语音库相匹配,才能保证系统的准确性。

普通话语音识别技术研究

普通话语音识别技术研究一、引言随着人工智能技术的不断发展,语音识别技术也越来越被重视,特别是普通话语音识别技术。

作为世界上人口最多的国家,中国的语音识别技术大有可为。

本文将从普通话语音识别技术的定义、发展历程、技术原理、应用现状以及未来发展等方面进行详细探讨。

二、普通话语音识别技术的定义普通话语音识别技术是一种人工智能技术,通过分析人类语音的声音特征和语音语义信息,将说话者的语音信息转化为文字信息的技术。

普通话语音识别技术不仅仅是一种简单的语音转写技术,还包含了音素识别、语音特征提取、声学模型训练、语言模型训练、语音信号预处理等多个技术环节。

三、普通话语音识别技术的发展历程普通话语音识别技术的起源可以追溯到上个世纪60年代,当时主要针对的是英语语音识别技术。

直到80年代末90年代初,随着计算机性能和存储技术的不断提升,语音识别技术才得以更好的发展。

在我国,最早的语音识别研究始于20世纪80年代,当时主要成果是基于单词或小句子语音识别。

随着国家艰苦奋斗的科技攻关,2000年代初期,我国开始涉足语音识别领域,并在2003年推出了中国大陆第一款商用普通话识别产品——科大讯飞的“普通话连续语音识别系统”。

此后,随着科技创新的不断推进,我国的普通话语音识别技术在国际上取得了颇高的声誉。

四、普通话语音识别技术的技术原理普通话语音识别技术包含了多个环节,如图1所示。

其中,预处理环节完成了语音信号的人工清洗加工以及数据增强等操作;声学模型训练环节基于大量的语音数据,采用深度学习技术训练语音识别的声学模型,实现对不同说话人不同语音场景的准确识别;语言模型训练环节则采用统计自然语言处理技术,对语音识别结果的置信度进行计算,使识别结果更加准确和可靠。

最后,语音识别引擎将以上各个环节的结果综合起来,输出具体的识别结果。

图1 普通话语音识别技术的技术流程五、普通话语音识别技术的应用现状普通话语音识别技术的应用领域极为广泛,在教育、娱乐、医疗、通讯、安防、智能家居等多个领域都得到了应用。

普通话考试中的语音考察项目及技巧

普通话考试中的语音考察项目及技巧普通话考试作为一项重要的语言能力测试,一直备受关注。

其中语音考察项目的合格与否,直接影响着考生的总分和评级结果。

本文将就普通话考试中的语音考察项目进行详细介绍,并分享一些提升语音能力的技巧。

一、普通话考试的语音考察项目在普通话考试中,语音考察项目包括音、调、音节、音变和语音语调等多个方面。

具体而言,以下是常见的语音考察项目:1. 音节(shēng cì):考察音节的正确发音和重音位置。

在语音中,一个个的音节组成了单词,通过对音节的划分和正确发音,可以更好地表达清晰流利的口语。

2. 音变(yīn biàn):考察在语音组合过程中的音变现象。

音变包括加声、轻声、变调等,通过对音变规则的掌握,可以准确地发音并理解别人的语音。

3. 语音语调(yǔ yīn yǔ diào):考察口语表达中的声调和语调。

普通话有四个声调,要求用正确的声调来表达语义,同时还需要掌握合理的语音语调,使口语更富有韵律感。

4. 卷舌音(juǎn shé yīn):考察舌尖的卷曲能力。

普通话中的一些音,如"zh"、"sh"、"ch"等,需要舌尖卷曲发音,考察学生对这些音的正确掌握程度。

二、提升语音能力的技巧想要在普通话考试中获得好成绩,提升语音能力是至关重要的。

以下是一些技巧,可以帮助你提升普通话语音能力:1. 多听多模仿:多听普通话的标准发音,例如收听新闻广播、观看普通话教学视频等。

并尝试模仿其中的语音语调,帮助自己矫正发音并增强口音。

2. 注重练习:针对不同的语音考察项目,进行有目的性的练习。

可以通过朗读练习、口头表达练习等方式,锻炼口语发音的准确性和流利性。

3. 注意摄音器官的协调:在发音过程中,要注意舌头、嘴唇、颚骨等摄音器官的协调。

细致观察自己的发音过程中的口型和舌位,有针对性地进行调整和练习。

普通话语音识别技术的运用研究

普通话语音识别技术的运用研究第一章引言随着人工智能技术的发展,语音识别技术也得到了很大的发展。

普通话语音识别技术是其中一种重要的技术,在语音助手、智能家居等领域得到了广泛的应用。

本文将对普通话语音识别技术的运用进行研究和探讨,同时探究该技术的原理和发展历程。

第二章技术原理和发展历程普通话语音识别(Mandarin Speech Recognition, MSR)又称普通话语音识别技术、汉语语音识别技术,是一种将人类语音转化为计算机可读语言的技术。

这种技术利用计算机处理语音信号,将发音方式转化为数字信号,从而实现语音的自动识别和理解。

早期的语音识别技术主要针对英语,而普通话语音识别技术的出现,是为了解决我国语言差异性和方言之间交流存在的问题。

普通话语音识别技术的原理是,将语音输入到语音采集器中,语音采集器将语音信号转化为数字信号。

然后,数字信号通过解码器进行解码,生成对应的语言模型,再通过各种算法进行语音识别。

普通话语音识别技术的发展历程可以分为以下几个时期:1. 初步探索时期:20世纪70年代,中国科学院声学研究所制定了一些基本的语音识别方法,实现了语音识别的初步探索。

2. 发展阶段:20世纪80年代到90年代,普通话语音识别技术开始进入正规化的阶段,涌现出了很多有代表性的科研团队。

3. 快速发展阶段:20世纪90年代到21世纪初,随着计算机技术和算法的进步,普通话语音识别技术快速发展,实现了较高水平的语音自然语言处理技术。

4. 深度学习阶段:21世纪后,随着深度学习技术的兴起,普通话语音识别技术得到了进一步的发展和应用。

目前,普通话语音识别技术已经成为了人工智能领域的热点技术之一。

第三章普通话语音识别技术的运用普通话语音识别技术的应用非常广泛,其中最为常见的应用是语音助手。

各大科技企业的智能语音助手,如Apple的Siri、Amazon的Alexa、Microsoft的Cortana、Google的Google Assistant等,均采用了普通话语音识别技术。

普通话语音识别中的基本音素分析

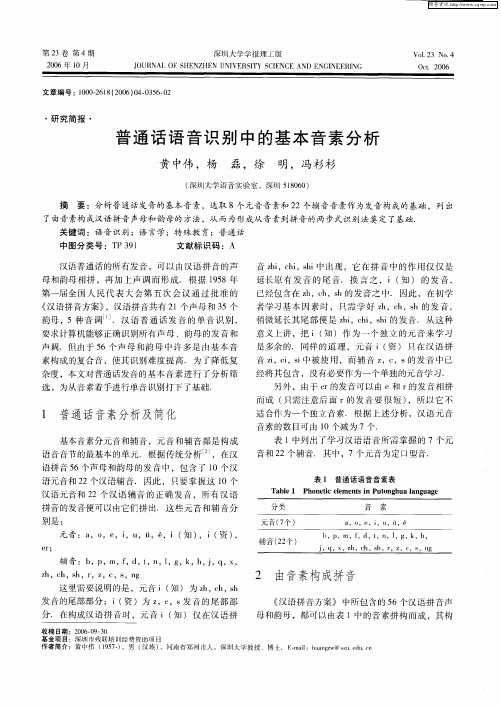

1 普通话音素分析及简化

基本音素分元音和辅音 ,元音和辅音都是构成

语音音 节 的最 基本 的单 元 .根据 传 统分 析 ,在 汉 语 拼音 5 6个声母 和 韵母 的发 音 中 ,包 含 了 1 汉 0个 语 元音 和 2 2个汉 语 辅音 . 因此 ,只要 掌 握这 l 0个 汉 语元音 和 2 2个汉 语 辅 音 的 正 确 发音 ,所 有汉 语

要求计算机能够正确识别所有声母 、 韵母 的发音和

声 调 .但 由于 5 6个 声 母 和 韵母 中许 多 是 由基 本 音

意义上 讲,把 i( 知)作 为一 个独立 的元音来学习 是多余 的. 同样 的道 理 ,元 音 i( ) 只 在 汉 语 拼 资 音 z c, i i i s中被使 用,而辅音 Z , 的发音 中已 , S

摘 要 :分析普通话发音 的基本音素 ,选取 8个元音音素和 2 2个辅音音素作为发音构成的基础,列 出 了由音素构 成 汉语 拼 音声母 和韵母 的 方 法 ,从 而为形 成从 音素 到拼 音 的两步 式识 别法 奠定 了基础 .

关键词 :语音 识 别 ;语 言 学 ;特殊 教 育 ;普 通话

辅 音 :b P m, , , , , , , , , , , , , , f d t n l g k h j q x

z h,c h, s h,r z c,s,n , , g

2 由音素构成拼音

《 汉语拼音方案》 中所包含的 5 6个汉语拼音声 母和韵母 ,都 可 以 由表 l中的音 素 拼 构而 成 ,其 构

已经包 含在 z ,c ,s h h h的发音 之 中. 因此 ,在初 学

第一届全国人 民代 表大会第五 次会议通过批 准 的

《 语拼 音方 案》 汉 ,汉 语拼 音共有 2 1个声 母 和 3 5个 韵 母 ,5种 音 调 ¨ .汉 语 普 通 话 发 音 的单 音 识 别 , J

普通话机考的原理

普通话机考的原理

普通话机考是一种利用计算机和语音识别技术进行普通话口

语评测的考试方式,具体的原理如下:

1.语音输入:考生通过麦克风将自己的普通话口语输入到计

算机上。

语音输入可以是单词、短语、句子甚至是篇章,目的

是为了检测考生的口语表达能力。

2.语音信号处理:计算机通过麦克风接收考生的语音信号后,会对信号进行预处理,比如去噪、降噪、增强信号等,以提高

后续语音识别的准确性。

3.语音识别:计算机使用语音识别算法将考生的口语转换成

文本。

语音识别技术会将输入的语音信号与预先训练好的语言

模型进行匹配,以获得最接近输入语音的文本结果。

4.自动评分:根据语音识别得到的文本,系统会根据事先设

定的评分标准和算法对考生的口语进行评分。

评分标准可能包

括发音准确性、语速、语调、词汇运用等方面的要求。

5.反馈结果:完成评分后,系统会将评分结果反馈给考生,

让考生了解自己的口语表达能力,包括错误的地方和需要改进

的方面。

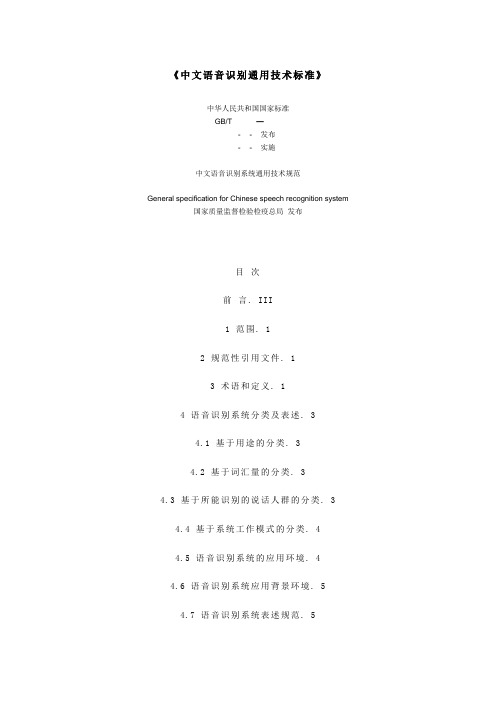

《中文语音识别通用技术标准》

《中文语音识别通用技术标准》中华人民共和国国家标准GB/T ×××××—××××××××-××-××发布××××-××-××实施中文语音识别系统通用技术规范General specification for Chinese speech recognition system 国家质量监督检验检疫总局发布目次前言. III1 范围. 12 规范性引用文件. 13 术语和定义. 14 语音识别系统分类及表述. 34.1 基于用途的分类. 34.2 基于词汇量的分类. 34.3 基于所能识别的说话人群的分类. 34.4 基于系统工作模式的分类. 44.5 语音识别系统的应用环境. 44.6 语音识别系统应用背景环境. 54.7 语音识别系统表述规范. 55 语音识别系统性能指标. 55.1 概述. 55.2 识别性能分类指标. 55.3 响应时间指标. 65.4 系统分类指标要求. 66 语音输入和识别输出. 76.1 语音识别输入准则. 76.2 语音识别输出准则. 77 语音识别系统性能测试方法. 77.1 概述. 77.2 测试语料设计. 87.3 测试语音录制. 87.4 基于语音识别标准库的测试方法. 87.5 基于现场口呼的测试方法. 87.6 测试报告内容. 98 语音识别标准库及规范. 98.1 概述. 98.2 语音识别标准库语音特性的描述. 98.3 语音识别标准库的标注. 98.4 语音识别标准库的来源. 108.5 语音识别标准库的数据转换. 10附录 A (资料性附录)听写系统有关符号读法. 1附录 B (资料性附录)语音识别用无调汉语拼音表. 1参考文献. 2前言请注意本标准的某些内容有可能涉及专利。

人工智能在普通话教学中的应用研究

人工智能在普通话教学中的应用研究近年来,人工智能技术的飞速发展使得其被应用于各个领域。

在语言教学方面,人工智能技术也催生了很多新的教学方法和工具。

在普通话教学中,人工智能技术同样有着广泛的应用前景,它可以为提高学生的语音培养和口语表达能力提供强有力的支持。

人工智能技术与普通话教学的结合发挥的作用不仅体现在语音学习上,也包括在普通话听说写等方面,下面将会从几个角度分别探讨人工智能技术在普通话教学中的应用与研究。

一、语音识别技术的应用语音识别技术是人工智能技术中非常核心的一部分。

它可以将普通话音频数据转换为文本,并通过机器学习技术进行自动分词和语音对齐。

在普通话教育中,基于语音识别技术的口语评测系统可对学生的口音、语音语调等方面进行实时评测和分析,从而帮助学生更好地掌握普通话语音技巧,提高发音准确度。

例如,近期出现的口语评测应用“流利说”就利用了语音识别技术,通过对学生口音的评测,帮助学生针对语音问题进行精准的训练。

因此,基于语音识别技术的口音评测在普通话教学中有着广泛的应用价值。

二、自然语言处理技术的应用人工智能在普通话教学中的另一个重要应用就是整合自然语言处理技术。

自然语言处理技术的应用可通过分析语句的语法、用词等方面,进行学生语言表达的纠错、修正、优化等,在帮助学生提高写作和阅读能力方面具有很大的作用。

例如,人工智能语音与写作批改应用“作业帮”依托自然语言处理技术,可以给学生提供实时的语文作业批改和错题辅导,提高学生的语文应用能力。

此外,在进行作文写作时,通过自然语言处理技术,平台可以对学生的文章进行语法、用词、结构等方面的评估和意见反馈,以帮助学生提升语文写作能力。

三、智能化辅助教学系统的研发为了更好地应对教学中的复杂情境和学生提出的问题,研究人员通过深度学习、自然语言处理、机器人以及语音和图像处理等技术手段,开发了基于人工智能的智能化辅助教学系统。

举例来说,智能语音交互机器人可以作为普通话学习的一个智能助手,它可以和学生进行语音交互和互动,测试学生的普通话表达能力、提供学生普通话发音和口头表达的实时指导和反馈,辅助学生更好地学习。

基于深度学习的普通话语音识别系统设计

基于深度学习的普通话语音识别系统设计1. 引言普通话作为中国的官方语言,被广泛使用。

随着互联网和智能硬件的发展,普通话语音识别技术被越来越多地应用到人机交互、智能客服、智能家居等领域中。

而深度学习作为一种新兴的机器学习技术,被广泛应用于图像处理、自然语言处理等领域,在语音识别领域也有很大的应用前景。

本文主要讨论基于深度学习的普通话语音识别系统的设计。

2. 相关技术介绍(1)语音信号预处理语音信号预处理是将原始语音信号转化为可供机器学习使用的数据形式。

该步骤包括音频读取、时频转换、特征提取等主要操作。

音频读取:使用Python中的wave库或PyAudio库读取音频文件或麦克风中录制的语音信号。

时频转换:将时域上的语音信号转换成频域信号,使用傅里叶变换等方法对信号进行变换。

特征提取:使用Mel频率倒谱系数(MFCC)等方法将语音信号转换成特征向量。

(2)深度学习模型深度学习模型是语音识别系统中的核心模块。

常用的深度学习模型包括卷积神经网络(CNN)、循环神经网络(RNN)等。

CNN:用于处理时频特征矩阵,提取频域上的局部特征。

RNN:用于处理时序信号,通过前向传播和后向传播学习时间序列上的特征。

(3)声学模型和语言模型声学模型和语言模型是语音识别系统中的两个重要模块。

声学模型:用于学习声音和文本之间的对应关系,将特征向量映射为概率分布。

语言模型:用于计算语句的概率分布,根据语句的概率和声学模型输出的概率计算语音识别的结果。

3. 系统设计(1)特征提取首先读取音频文件,对原始音频进行预处理,获取MFCC特征向量。

MFCC可以提取出语音信号在频域的重要特征,常用的MFCC参数包括帧长、帧移、倒谱阶数等。

在MFCC提取后,还可以进一步进行特征归一化、数据增强等操作。

(2)声学模型采用基于深度学习的声学模型,使用CNN/RNN模型处理MFCC特征序列,把它们映射到对应的输出概率分布。

其中RNN 模型可以处理时序信号,捕捉序列之间的高层次关系。

普通话语音识别技术的研究及发展

普通话语音识别技术的研究及发展一、概述普通话语音识别技术指的是利用计算机技术,将人类发出的普通话语音转换成文字或者执行特定的指令。

这一领域的研究和发展始于上个世纪的70年代,随着计算机技术、语音处理技术和机器学习算法的不断发展和突破,普通话语音识别技术取得了显著的进展。

本文将从技术基础、应用场景和发展趋势等方面来介绍普通话语音识别技术。

二、技术基础普通话语音识别技术基于声学模型、语言模型和解码器三个核心技术实现。

其中,声学模型是对声音进行特征提取和建模的过程,建模的目标是将输入的音频转换成一系列数值型的向量表示。

常见的声学特征包括梅尔倒谱系数和线性预测系数等。

语言模型则是为了提高识别准确率而引入的技术,其中建模的目标是预测输入的文本序列出现的概率。

解码器则是将声学模型和语言模型结合,实现对输入音频的识别。

目前,普通话语音识别技术主要采用深度学习算法来进行模型的训练和建模,例如基于循环神经网络的声学模型和基于Transformer的语言模型等。

三、应用场景普通话语音识别技术已经广泛应用于各种场景,例如智能家居、智能手机、智能客服、语音助手等。

其中,在智能家居领域,语音控制和识别已经成为主要的人机交互方式,例如可以通过语音控制音乐播放、空调温度调节等;在智能手机领域,语音识别技术可以应用于语音输入、智能翻译等功能;在智能客服领域,语音识别技术可以帮助企业提高客户服务质量和效率;在语音助手领域,语音识别技术可以有效地解决人类输入难题,例如可以通过语音指令快速地完成某项操作。

四、发展趋势目前,普通话语音识别技术在不断地推陈出新,随着计算机技术、语音处理技术和机器学习算法的不断进步,普通话语音识别技术的应用场景也在不断扩大。

未来几年,普通话语音识别技术将继续向以下方向发展:1. 改善识别准确率:随着深度学习算法的不断发展和突破,普通话语音识别技术的识别准确率将会不断改善。

2. 改进语音交互方式:除了语音指令和语音输入外,普通话语音识别技术还可以通过语音合成、情感识别、语音交互等多种方式来进行人机交互。

python实现汉语数字语音识别实现方法

python实现汉语数字语音识别实现方法在Python中实现汉语数字语音识别需要用到语音识别和自然语言处理技术。

以下是实现步骤:1. 安装语音识别库首先需要安装语音识别库,比如使用SpeechRecognition库,它支持Python 和以上的版本,支持中文的语音识别。

安装命令如下:```shellpip install SpeechRecognition```2. 导入语音识别库在Python代码中导入SpeechRecognition库:```pythonimport speech_recognition as sr3. 创建语音识别对象使用SpeechRecognition库创建一个语音识别对象:```pythonr = ()```4. 读取音频文件使用SpeechRecognition库的`audio_file`函数读取音频文件,该函数接受一个音频文件的路径作为参数:```pythonwith (path_to_audio_file) as source:audio = (source)```其中`path_to_audio_file`是音频文件的路径。

5. 进行语音识别使用SpeechRecognition库的`recognize_google`函数进行语音识别,该函数接受一个音频对象作为参数,返回识别的文本:```pythontext = _google(audio)```6. 输出识别结果将识别的文本输出到控制台:```pythonprint(text)```7. 处理中文数字识别结果由于中文数字和阿拉伯数字的表示方式不同,需要进行转换。

可以使用`zhconv`库来进行中文数字和阿拉伯数字的转换,安装命令如下:```shellpip install zhconv```在代码中导入zhconv库:```pythonimport zhconv as zc```使用zhconv库的`t2n`函数将中文数字转换为阿拉伯数字:```pythonarabic_num = (text)print(arabic_num)```。

普通话机测流程

普通话机测流程一、引言。

普通话机测是指对普通话语音识别系统进行性能评估的过程。

在普通话语音识别技术的发展中,机测是非常重要的环节,它能够客观地评价系统的性能,并为系统的改进提供参考。

本文将介绍普通话机测的流程及相关注意事项。

二、数据准备。

在进行普通话机测之前,首先需要准备好一定量的普通话语音数据。

这些数据应该包含各种不同的语音特征,涵盖不同的发音、语速、声音大小等情况,以确保评估的全面性和客观性。

同时,还需要对数据进行标注和清洗,以保证数据的质量和准确性。

三、特征提取。

在进行机测之前,需要对语音数据进行特征提取。

这一步骤的目的是将语音数据转化为机器可以识别和处理的特征向量,通常包括音频信号的MFCC(Mel-frequency cepstral coefficients)特征等。

特征提取的质量直接影响着后续的语音识别性能,因此需要特别注意。

四、语音识别。

接下来是对提取的特征进行语音识别。

这一步骤需要使用普通话语音识别系统,将提取的特征与语音模型进行匹配,从而得到识别结果。

在这个过程中,需要注意系统的参数设置、模型训练等细节,以确保识别的准确性和稳定性。

五、评价指标。

在完成语音识别之后,需要对识别结果进行评价。

评价指标通常包括识别率、误识率、漏识率等,这些指标能够客观地反映出系统的性能。

在评价指标的选择和计算上,需要考虑到不同应用场景的需求,并选择合适的评价方法。

六、结果分析。

最后一步是对评价结果进行分析。

通过对评价指标的分析,可以发现系统存在的问题和不足之处,为系统的改进提供参考。

同时,还可以对不同参数设置、模型训练等因素进行实验和比较,以寻找最优的配置方案。

七、总结。

普通话机测是对普通话语音识别系统进行性能评估的重要环节。

通过对数据准备、特征提取、语音识别、评价指标和结果分析等环节的详细介绍,希望能够帮助大家更好地理解普通话机测的流程和注意事项,提高系统的性能和稳定性。

普通话水平测试系统中的语音识别和语音评测技术探究

215· · 课程教育研究 Course Education Ressearch 2017年第18期 考索·探微普通话水平测试系统中的语音识别和语音评测技术探究徐丽琍(辽宁省教师培训交流中心 110032)【摘要】普通话水平测试是践行“推广普通话”这一基本国策的重要手段。

随着技术革新,传统的“人工测试”转变到由计算机进行辅助测试的方式。

语言识别技术以及语言评测技术的应用,是不断推动普通话水平测试走向成熟的关键。

【关键词】语音识别技术 语音评测技术【中图分类号】G65 【文献标识码】A 【文章编号】2095-3089(2017)18-0215-01经过20多年的发展,现今的普通话测试是通过计算机辅助测试的方式来完成的,主要在其中运用了语音识别技术以及语音合成技术,但是采用的测试系统是科大讯飞公司生产的测试系统。

一、语音识别技术的基本概述1.预处理因为应试人员输入到测试系统中的是一些计算机没有办法识别的模拟信号,所以在计算机对信号进行处理之前,必须把模拟信号转化为数字信号。

这就是预处理的作用,预处理包括预滤波、预加重、采样和量化等步骤。

预滤波的主要作用是防止采样频率出现混叠干扰,同样可以对电源工频干扰进行抑制。

预加重是针对采样部分高频信号来进行的,主要就是为了提高高频部分语音信号的分辨率,同时对发声过程中声带以及嘴唇的干扰进行消除,使得高频的共振峰更加突出。

普通话水平测试系统中预加重的工作是通过一阶高通滤波器来完成的。

采样和量化是通过A/D转换器来完成的,在每个周期之内,A /D 转换器都会测量以及量化信号各一次。

这样声音信号就会转变为数字音频信号。

在模拟信号向数字信号转换之前,首先需要对模拟信号波形进行分割,其实这就是采样的本质。

具体来说,是在采样周期之内模拟信号的波形上取一个幅度值,这样原本连续的模拟信号就会变为离散信号。

采样周期的倒数为采样频率,在采样频率高于声音信号的最高频率的2倍时,数学信号所表示的声音才能够被准确的还原,这是实际采样过程中的一个难点。

普通话语音状态识别算法的研究

普通话语音状态识别算法的研究语音技术与人工智能领域的乘用率越来越高,语音识别、自然语言处理、语音合成等技术应用于智能家居、金融、教育等热门领域也越来越受到欢迎。

然而,目前市面上的普通话语音识别系统仍有不足,如辨别口音不清或者音频质量不好的情况。

因此,需要一种可靠且精确的普通话语音状态识别算法,以提高识别效果。

普通话语音状态识别算法的基本架构普通话语音状态识别识别通常包含一系列的预处理、特征提取和模型训练。

它的基本结构如下:1. 音频预处理:包括降噪、信号增强等处理,将原始语音转换成适合识别的数据形式。

2. 特征提取:将音频信号转换为适合语音识别的特征向量,常用的包括梅尔频率倒谱系数(MFCC)、线性预测编码(LPC)等。

3. 模型训练:对于不同的声学特征和语言模型,需要采用不同的模型进行训练。

通常采用隐马尔可夫模型(HMM)、支持向量机(SVM)等。

4. 识别:将特定的语音状态分类到某个类别中,通过计算各个类别的概率值来决定最终的语音状态。

普通话语音状态识别常见问题1. 声音质量差:普通话语音场景通常包含清晰度、异响度、噪声等因素,这些因素会影响识别的性能。

2. 训练集不足:一个高效的通用模型需要大量的数据进行训练,而通常的数据集比较有限也不够丰富。

3. 口音差异:中文方言众多,即使是普通话,在不同的地方有不同的语音特点,这就意味着要让系统能够适应不同的口音并且能够识别相应的声音。

普通话语音状态识别算法发展趋势1. 优化识别模型:通过深度学习算法改进传统的语音识别模型,比如递归神经网络(RNN)和卷积神经网络(CNN)。

2. 数据增强和标注:增加识别的数据量可以大大提高模型的准确度,同时增加误差吸受力。

3. 多语言转换:通过使用多语音数据的模型和对异音声音的转换,可以在多种语言和口音之间互相转换。

结语随着智能技术的逐渐成熟和应用范围的不断拓展,普通话语音状态识别算法也变得越来越有价值。

通过不断的优化与发展,将大大提高其在语音识别、自然语言处理、语音合成等领域的应用效果,以更好地服务于用户的需求。

普通话语音识别系统技术研究与应用

普通话语音识别系统技术研究与应用随着科技的发展,普通话语音识别技术越来越成熟。

普通话是我国国家通用语言,流行范围广泛。

因此,开发普通话语音识别系统已经成为了当今众多研究领域中的热点。

本文将介绍普通话语音识别技术的发展历程、技术原理和应用前景。

一、发展历程普通话语音识别技术与计算机技术、信号处理技术、人工智能技术以及语言学等多个领域紧密相关。

20世纪70年代,美国的贝尔实验室成为了最早研究语音识别技术的实验室之一。

至今,语音识别技术已经经历了40多年的演进和发展。

在我国,20世纪80年代,由于计算机技术的发展,声学模型、语言模型和信号处理技术的逐渐成熟,为我国语音识别技术的发展提供了必要的技术支撑。

经过二十年的探索实践,中文普通话语音识别的准确率逐年提高,还有许多具有代表性的研究成果和应用案例。

二、技术原理语音识别技术的核心是信号处理和模型建立。

普通话语音识别系统是通过对输入的语音信号进行处理,再利用高级的语言模型对信号进行识别。

普通话语音识别技术主要包括声学建模、语言模型和声学网络解码等。

1.声学模型声学模型是语音识别系统最核心的部分,它用来建立声音和语音学特征之间的对应关系,用于识别声音的不同音素。

声学模型通常由高斯混合模型(GMM)和隐马尔科夫模型(HMM)组成,并通过训练来提高模型的准确性。

2.语言模型语言模型用于建立输入语音信号与文字转录结果之间的关系,利用上下文信息提高识别准确率。

N元语言模型(N-gram Language Model)是比较常用的语言模型,它假设单词出现概率只与前面N-1个单词相关,该模型易于利用统计方法进行建模,并且准确率相对较高。

3.声学网络解码声学网络解码是将声学模型和语言模型结合起来进行准确的解码和识别。

它主要通过声学模型计算声学特征的概率分布,通过语言模型计算文本的概率分布,同时综合考虑这两个模型的结果,最终得到最佳转录文本。

三、应用前景普通话语音识别技术的应用前景非常广阔。

《中文语音识别通用技术标准》

《中文语音识别通用技术标准》中华人民共和国国家标准GB/T ×××××—××××××××-××-××发布××××-××-××实施中文语音识别系统通用技术规范General specification for Chinese speech recognition system 国家质量监督检验检疫总局发布目次前言. III1 范围. 12 规范性引用文件. 13 术语和定义. 14 语音识别系统分类及表述. 34.1 基于用途的分类. 34.2 基于词汇量的分类. 34.3 基于所能识别的说话人群的分类. 34.4 基于系统工作模式的分类. 44.5 语音识别系统的应用环境. 44.6 语音识别系统应用背景环境. 54.7 语音识别系统表述规范. 55 语音识别系统性能指标. 55.1 概述. 55.2 识别性能分类指标. 55.3 响应时间指标. 65.4 系统分类指标要求. 66 语音输入和识别输出. 76.1 语音识别输入准则. 76.2 语音识别输出准则. 77 语音识别系统性能测试方法. 77.1 概述. 77.2 测试语料设计. 87.3 测试语音录制. 87.4 基于语音识别标准库的测试方法. 87.5 基于现场口呼的测试方法. 87.6 测试报告内容. 98 语音识别标准库及规范. 98.1 概述. 98.2 语音识别标准库语音特性的描述. 98.3 语音识别标准库的标注. 98.4 语音识别标准库的来源. 108.5 语音识别标准库的数据转换. 10附录 A (资料性附录)听写系统有关符号读法. 1附录 B (资料性附录)语音识别用无调汉语拼音表. 1参考文献. 2前言请注意本标准的某些内容有可能涉及专利。

普通话智能测试系统的语音识别网络研究

普通话智能测试系统的语音识别网络研究陈彩华【期刊名称】《西华大学学报(自然科学版)》【年(卷),期】2014(33)2【摘要】The existing computer-aided system uses the algorithm of HMM based log posterior probability to judge the tester's pro-nunciation , but the confusion between HMM models is big .In order to improve the validity and reliability of the system , the author re-constructs the recognition network in algorithm based on the introduction of linguistic knowledge of Putonghua pronunciation , and opti-mizes the probability spaces in algorithm .Experimental results indicate that the improved recognition networks can not only significantly reduce the system's operation time, but also effectively reduce the probability space impact on scoring , and improve the system of eval-uating performance .%现行的计算机辅助普通话水平测试系统主要采用隐马尔科夫模型的对数后验概率算法来衡量考生的发音质量,但是HMM模型之间易混淆。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

i, k

调整。

表 1 基于距离度量的基元扩展准则 条件 类别

d ≤T 1 T 1 < d ≤T 2 d> T 2

0

1

2

在确定了扩展识别基元之后, 利用扩展识别基 元集合对方言普通话语音进行重新标注。 采用强制 对齐的方法 重新标注, 首先要解决的问题是如何 得到用于强制对齐的初始声学模型。 初始模型的生 成遵循以下规则: 1) 对于符合类别 0 的基元, 其初 始 HMM 直接由对应标准普通话 HMM 得到。 2) 对 于符合类别 1 的基元, 其初始 HMM 直接由对应的 方言普通话 HMM 得到。 3) 对于类别 2 所包含的基 元, 由于要产生一个新基元, 其初始模型由标准普通 话 HMM 和 方 言 普 通 话 HMM 之 间 进 行 插 值 得 到 , 在本文中插值系数为 0. 5。

Sma ll da ta set- ba sed acoust ic m odel ing for d ia lecta l Ch inese speech recogn it ion

LI U L inqua n , ZHENG Fa ng , W U W e nhu

(D epartm en t of Com puter Sc ience and Technology, Tsinghua Na tiona l Labora tory for Informa tion Sc ience and Technology, Tsinghua Un iversity, Be ij ing 100084, Ch ina ) Abstract: A sm all developm en t set is u sed to sign ifican tly i m p rove the perfo rm ance fo r dialectal Ch inese speech recogn ition. A un it expan sion m ethod based on the acou st ic d istance is u sed to deal w ith the sound changes betw een standard Ch inese and d ialectal Ch inese, esp ecially w hen g iven on ly a sm all am oun t of d ialectal Ch inese data. T hen the expanded un its are fu rther in teg rated in to a state2dep enden t p honem e2based m odel m erging m ethod. W ith a developm en t set of on ly 1. 0 hou r of Shanghai2d ialectal Ch inese, these m ethods gave a relative syllab le erro r rate (SER ) reduction of 17. 3%. W hen com b ined w ith o ther adap tation techn iques, the m ethod ach ieved a fu rther SER reduction of 6. 6% , w ith the relative SER reduction being 5. 4% m o re than u sing adap tation on ly. Key words: speech recogn ition; acou stic m odeling; d ialectal Ch inese; m odel m erging; un it exp an sion

细分小的方言达上千种。 面对如此繁多的方言普通 话, 采用何种策略来构建识别模型, 既省时又有效是 研究中的关键问题。 我们利用少量方言普通话数据 并结合标准普通话识别模型, 对普通话进行语音识 别。 对于方言普通话, 在发音层面可能造成音节或者 声韵的音素替换, 也可能造成声音变化。 对于前者, 可以通过在发音字典中增加体现方言普通话发音特 [1 ] 点的发音变化来加以解决 。 对于后者, 本文提出了 一种新颖的方言普通话识别声学建模方法。 在实际 应用中, 由于受到方言发音习惯的影响, 标准普通话 的识别基元集合, 尤其在口音较重的情况下, 不能很 [2 ] 好地刻画方言普通话的发音特点 。 本文针对标准普通话和方言普通话的发音差 异, 利用距离度量作为生成准则, 对标准普通话的声 韵集进行了扩展, 之后在扩展声韵集的基础上进行 [3 ] 了状态相关的基于基元的模型归并 (SD PBMM ) 。 另外, 在小数据量情况下, 自适应是提高识别率最常 [4 ] 用的方法 , 因而将前 2 种方法与自适应方法相结 合, 进一步提高了识别率。本文利用 1 h 的上海普通 话语音作为开发集, 实现了对以上三种方法的结合。 实 验 表 明, 相 对 于 基 线 模 型, 音 节 错 误 率 降 低 了 23. 9% 。

N

∑ ∑Ξ

k= 1 m

i, k

= 1

n

∑Ξ

jБайду номын сангаас k

n

= 1

j, k

d ( g m i, k , g n j , k ) ,

( 1)

其中,

d (g 1 , g 2 ) = (u 1 u 2) 2

T - 1 2

( u 1 - u 2 ).

( 2)

式中 Κ i 和 Κ j 分别表示通过标准普通话和方言普通 话训练得到的上下文无关 HMM ; d ( g 1 , g 2 ) 表示任 意 2 个 Gau ssian 混合的M aha lanob is 距离。在此基 础上, 定义了 2 个阈值 T 1 和 T 2 , 作为准则来量化是 否产生新基元。 根据距离将所有的标准普通话基元 分成 3 类, 如表 1 所示。 事实上, 新基元只在类别 2 中, 即 d > T 2 的情况下产生, 此时认为对于同一个 发音, 标准普通话与方言普通话之间存在比较大的 差异, 需要生成一个新的基元来增加此发音在声学 空间的覆盖度。 T 1 和 T 2 定义为所有距离均值的倍 数, 并且 T 1 < T 2。 通常, T 1 和 T 2 通过实验结果进行

ISSN 100020054 清华大学学报 ( 自然科学版) 2008 年 第 48 卷 第 4 期 CN 1122223 N . 48, N o. 4 J T singhua U n iv ( Sci & T ech ) , 2008, V o l

h ttp:

w 39 . net. cn qhxbw. ch ina jou rna l

近年来, 口音问题在语音识别领域受到越来越 多的关注。 我们把地域性的带口音的普通话称之为 方言普通话。 受母方言的影响, 一般人的普通话或多 或少都带有一定的地域特征。 我国有八大方言区, 再

606

清 华 大 学 学 报 ( 自 然 科 学 版)

2008, 48 ( 4)

话发音习惯的影响, 因此方言普通话与标准普通话 又存在很多的相似性。 文 [ 5 ] 给出了上海普通话与标 准普通话在发音层次上的差异, 这些差异可能由发 音习惯、 舌位、 音调等因素造成。 例如在文 [ 2 ] 中标准 普通话的韵母 ie, 在上海普通话中由于舌位不同还 有 2 种相应的发音变化, 即, ie< 和 ie^ ; 另一方 面, 这 2 种发音变化又与其标准普通话发音 ie 有着 密切联系, 是其发音变体。 理论上, 在标准普通话识 别基元的基础上生成针对方言普通话的识别基元集 合能够有效提高识别率, 为此, 与以往由语音学专家 [2 ] 定义识别基元集合不同 , 本文提出了基于数据驱 动方式的针对方言普通话的识 别 基 元 自 动 生 成 方法。 本文规定 2 个基元的相似度由其模型的声学距 离来度量, 距离越小, 说明标准普通话与方言普通话 之间发音变化越小, 反之, 则认为两者之间存在较大 的差异。 为了增加基元模型在声学空间的覆盖度, 对 于这种距离比较大的情况, 考虑增加新的识别基元。 当然, 这种增加要充分考虑到模型的复杂度以及方 言普通话数据量, 否则, 可能造成系统识别率下降和 数据稀疏等问题, 实际中, 一般是二者的折衷。 本文采用了非对称的M aha lanob is 距离作为度 量准则, 主要是考虑到标准普通话和方言普通话发 [6 ] 音的不对称性 , 其定义如式 ( 1) 和 ( 2) 所示。 考虑到 方 言 普 通 话 数 据 量 的 限 制, 只 用 上 下 文 无 关 的 式 ( 1) 表示了具有相同拓扑结 HMM 作为对比模型。 构 ( 都 有 K 个 状 态) , 但 分 别 包 含 M 和 N 个 Gau ssian 混和的上下文无关 HMM 的声学距离: D (Κ i, Κ j) =

基于小数据量的方言普通话语音识别声学建模

刘林泉, 郑 方, 吴文虎

( 清华大学 计算机科学与技术系, 清华信息科学与技术国家实验室, 北京 100084)

摘 要: 为在少量数据情况下显著提高方言普通话的识别 率, 针对标准普通话和方言普通话之间发音差异是连续变化 的特点, 在少量方言普通话的基础上, 提出了基于距离度量 的识别基元扩展方法, 并将扩展基元与状态相关的基于基元 的模型归并方法相结合。采用 1 h 的上海普通话数据作为开 发集, 用本方法, 使音节错误率降低了 17. 3% 。另外与自适 应方法的结合使用, 还可以将音节错误率再降低 6. 6% , 这 比单纯应用自适应方法错误率多降低了 5. 4% 。 关键词: 语音识别; 声学建模; 方言普通话; 状态归并; 识 别基元扩展 中图分类号: T P 391 文章编号: 100020054 ( 2008) 0420605204 文献标识码: A

[4 ] [7 ]

2 状态相关的基于基元的模型归并