【CN109948721A】一种基于视频描述的视频场景分类方法【专利】

视频描述生成方法、装置、设备及存储介质[发明专利]

![视频描述生成方法、装置、设备及存储介质[发明专利]](https://img.taocdn.com/s3/m/6372ebadb307e87100f6963e.png)

专利名称:视频描述生成方法、装置、设备及存储介质专利类型:发明专利

发明人:裴文杰,张记袁,柯磊,戴宇荣,沈小勇,贾佳亚,王向荣申请号:CN201910325193.0

申请日:20190422

公开号:CN109874029A

公开日:

20190611

专利内容由知识产权出版社提供

摘要:本申请公开了一种视频描述生成方法、装置、设备及存储介质。

该方法包括:通过视频描述生成模型的编码器对目标视频进行编码,得到目标视频的目标视觉特征;通过视频描述生成模型的基础解码器对目标视觉特征进行解码,得到各个候选词汇对应的第一选取概率,基础解码器用于采用注意力机制解码出与目标视觉特征匹配的候选词汇;通过视频描述生成模型的辅助解码器对目标视觉特征进行解码,得到各个候选词汇对应的第二选取概率,辅助解码器的记忆结构中包括各个候选词汇对应的参考视觉上下文信息,参考视觉上下文信息根据候选词汇对应的相关视频生成;根据第一选取概率和第二选取概率确定候选词汇中的解码词;根据若干个解码词生成视频描述。

申请人:腾讯科技(深圳)有限公司

地址:518057 广东省深圳市南山区高新区科技中一路腾讯大厦35层

国籍:CN

代理机构:北京三高永信知识产权代理有限责任公司

代理人:张所明

更多信息请下载全文后查看。

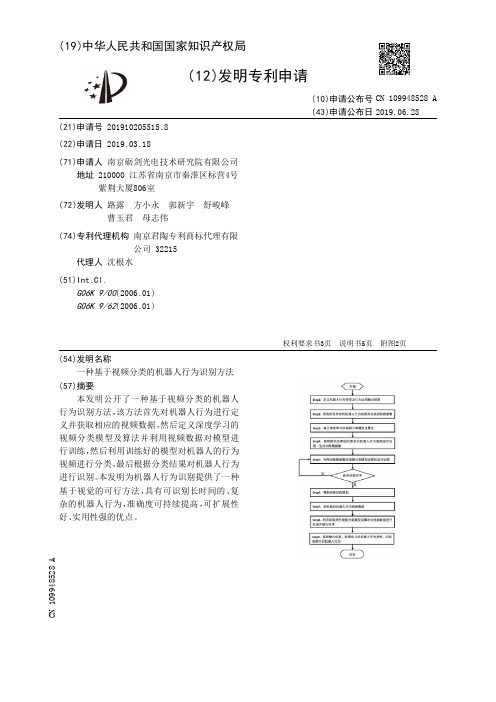

【CN109948528A】一种基于视频分类的机器人行为识别方法【专利】

(19)中华人民共和国国家知识产权局(12)发明专利申请(10)申请公布号 (43)申请公布日 (21)申请号 201910205515.8(22)申请日 2019.03.18(71)申请人 南京砺剑光电技术研究院有限公司地址 210000 江苏省南京市秦淮区标营4号紫荆大厦806室(72)发明人 路露 方小永 郭新宇 舒峻峰 曹玉君 母志伟 (74)专利代理机构 南京君陶专利商标代理有限公司 32215代理人 沈根水(51)Int.Cl.G06K 9/00(2006.01)G06K 9/62(2006.01)(54)发明名称一种基于视频分类的机器人行为识别方法(57)摘要本发明公开了一种基于视频分类的机器人行为识别方法,该方法首先对机器人行为进行定义并获取相应的视频数据,然后定义深度学习的视频分类模型及算法并利用视频数据对模型进行训练,然后利用训练好的模型对机器人的行为视频进行分类,最后根据分类结果对机器人行为进行识别。

本发明为机器人行为识别提供了一种基于视觉的可行方法,具有可识别长时间的、复杂的机器人行为,准确度可持续提高,可扩展性好、实用性强的优点。

权利要求书3页 说明书5页 附图2页CN 109948528 A 2019.06.28C N 109948528A权 利 要 求 书1/3页CN 109948528 A1.一种基于视频分类的机器人行为识别方法,其特征在于,具体包括如下步骤:步骤1:定义机器人行为类型及行为识别输出结果;步骤2:获取所有类型的机器人行为视频并形成原始数据集;步骤3:建立深度学习的视频分类模型及算法;步骤4:按照模型及算法的要求对机器人行为视频进行处理,生成训练数据集;步骤5:利用训练数据集对视频分类模型及算法进行训练;步骤6:得到训练好的模型;步骤7:获取新的机器人行为视频数据;步骤8:利用训练好的视频分类模型及算法对视频数据进行处理并输出结果;步骤9:根据输出结果,按照定义的机器人行为类型,识别视频中的机器人行为。

视频场景识别方法、装置、存储介质和电子装置[发明专利]

![视频场景识别方法、装置、存储介质和电子装置[发明专利]](https://img.taocdn.com/s3/m/71b43a144693daef5ff73d03.png)

专利名称:视频场景识别方法、装置、存储介质和电子装置专利类型:发明专利

发明人:易阳,涂娟辉,李峰,高孟平

申请号:CN201910146975.8

申请日:20190227

公开号:CN110147711A

公开日:

20190820

专利内容由知识产权出版社提供

摘要:本发明公开了一种视频场景识别方法、装置、存储介质和电子装置。

其中,该方法包括:获取将要进行场景识别的目标视频;对目标视频的视频序列进行抽帧采样,得到子视频序列,并对目标视频的音频序列进行抽帧采样,得到子音频序列;从子视频序列中提取出目标视频特征,并从子音频序列中提取出目标音频特征;通过第一目标模型对目标视频特征进行处理,得到第一分类结果,并通过第二目标模型对目标音频特征进行处理,得到第二分类结果;基于第一分类结果和第二分类结果确定目标视频的目标场景。

本发明解决了相关技术中对视频场景进行识别的准确率低的技术问题。

申请人:腾讯科技(深圳)有限公司

地址:518000 广东省深圳市南山区高新区科技中一路腾讯大厦35层

国籍:CN

代理机构:北京康信知识产权代理有限责任公司

代理人:周婷婷

更多信息请下载全文后查看。

一种基于场景的算法配置的视频分析的装置及方法[发明专利]

![一种基于场景的算法配置的视频分析的装置及方法[发明专利]](https://img.taocdn.com/s3/m/25e007d387c24028905fc34a.png)

专利名称:一种基于场景的算法配置的视频分析的装置及方法专利类型:发明专利

发明人:袁振杰,魏庆伟,陈世赫

申请号:CN201810355054.8

申请日:20180419

公开号:CN108337486A

公开日:

20180727

专利内容由知识产权出版社提供

摘要:本发明公开了一种基于场景的算法配置的视频分析的装置及方法,包括:自定义场景模块,用于获取场景信息,所述场景信息包括分析目标,所述分析目标的数据量和影响视频设备的参数,并根据所述场景信息确定所述视频设备的数量和类型;设备管理模块,用于获取所述分析目标的样本视频序列和所述视频设备的设备应用附加信息;算法配置模块,用于根据所述视频设备的数量和类型、所述样本视频序列和所述设备应用附加信息确定与所述场景对应的最优算法。

可见,本发明实施例能够根据当前的场景结合算法配置进行视频智能分析。

申请人:北京软通智城科技有限公司

地址:100193 北京市海淀区西北旺东路10号院东区16号楼5层506

国籍:CN

代理机构:北京集佳知识产权代理有限公司

代理人:王宝筠

更多信息请下载全文后查看。

视频分类方法、装置、终端设备及存储介质[发明专利]

![视频分类方法、装置、终端设备及存储介质[发明专利]](https://img.taocdn.com/s3/m/a7827768cc22bcd127ff0c4a.png)

专利名称:视频分类方法、装置、终端设备及存储介质专利类型:发明专利

发明人:梁大为

申请号:CN201910182107.5

申请日:20190311

公开号:CN110046278A

公开日:

20190723

专利内容由知识产权出版社提供

摘要:本申请实施例提供了一种视频分类方法、装置、终端设备及存储介质。

在本申请中,使用至少一个视频分类模型获取待分类视频的标签类型,确定至少一个标签分类模型,至少一个标签分类模型用于根据该标签类型获取待分类视频的分类标签,使用至少一个标签分类模型获取待分类视频的分类标签。

通过本申请,在获取到待分类视频的标签类型之后,使用至少一个标签分类模型就可以获取到待分类视频的分类标签,无需使用所有的分类模型,从而相比于上述方法,本申请可以降低计算量,节省设备的计算资源。

申请人:北京奇艺世纪科技有限公司

地址:100080 北京市海淀区北一街2号鸿城拓展大厦10、11层

国籍:CN

代理机构:北京润泽恒知识产权代理有限公司

代理人:莎日娜

更多信息请下载全文后查看。

一种基于视频内容自动化结构解析的视频分类技术[发明专利]

![一种基于视频内容自动化结构解析的视频分类技术[发明专利]](https://img.taocdn.com/s3/m/eab363e47cd184254a35358b.png)

专利名称:一种基于视频内容自动化结构解析的视频分类技术专利类型:发明专利

发明人:胡燕祝

申请号:CN201810549570.4

申请日:20180602

公开号:CN108804623A

公开日:

20181113

专利内容由知识产权出版社提供

摘要:本发明提供了一种对视频自动筛选的技术,其具体内容涉及一种视频内容自动化结构解析的方法。

一种基于视频内容自动化结构解析的视频筛选技术,其特征是:A.在生成带有ID的URL参数时,执行如下操作:A1.对目标源视频进行解码。

A2.将视频分割为各种镜头。

A3.从分割好的镜头当中提取关键帧。

B.在筛选时,会执行如下操作:B1.判断分析背景点,建立背景模型。

B2.利用训练好的模型对目标进行检测。

B3.计算新像素值和样本集中每个样本值的距离。

申请人:北京非斗数据科技发展有限公司

地址:100000 北京市海淀区马甸东路19号24层2831

国籍:CN

更多信息请下载全文后查看。

一种短视频分类方法[发明专利]

![一种短视频分类方法[发明专利]](https://img.taocdn.com/s3/m/e8f3868764ce0508763231126edb6f1aff0071eb.png)

(19)中华人民共和国国家知识产权局(12)发明专利申请(10)申请公布号 (43)申请公布日 (21)申请号 201910540170.1(22)申请日 2019.06.20(71)申请人 杭州趣维科技有限公司地址 310007 浙江省杭州市西湖区天目山路294号杭钢、冶金科技大厦16层(72)发明人 魏陈超 范俊 (74)专利代理机构 杭州天昊专利代理事务所(特殊普通合伙) 33283代理人 董世博(51)Int.Cl.G06K 9/62(2006.01)G06K 9/00(2006.01)G06F 16/75(2019.01)(54)发明名称一种短视频分类方法(57)摘要本发明公开了一种短视频分类方法,包括以下步骤:网络训练;网络测试,包括对待分类的短视频进行等间隔截帧,每个视频截取一定帧数;对截取的帧,通过图像处理,取出一定大小的图片输入模型进行预测,在Softmax之前融合截取的帧和不同流的预测分数,最终得出结果,所述模型通过如下方式得到:一个输入视频被分为K段,一个片段从它对应的段中随机采样得到,不同片段的类别得分采用段共识函数进行融合来产生段共识,得到一个视频级的预测,然后对所有模式的预测融合产生最终的预测结果。

权利要求书2页 说明书4页 附图1页CN 110647903 A 2020.01.03C N 110647903A1.一种短视频分类方法,其特征在于,包括以下步骤:网络训练,包括选择BN-Inception构建模块;在学习过程中,Batch Normalization将估计每个bach内的激活均值和方差,并使用它们将这些激活值转换为标准高斯分布;在用预训练模型初始化后,冻结所有Batch Normalization层的均值和方差参数,但第一个标准化层除外;在BN-Inception的全局pooling层后添加一个额外的dropout层;使用小批量随机梯度下降算法来学习网络参数;用在ImageNet上预训练的模型对网络权重进行初始化;网络测试,包括对待分类的短视频进行等间隔截帧,每个视频截取一定帧数;对截取的帧,通过图像处理,取出一定大小的图片输入模型进行预测,在Softmax之前融合截取的帧和不同流的预测分数,最终得出结果,所述模型通过如下方式得到:一个输入视频被分为K 段,一个片段从它对应的段中随机采样得到,不同片段的类别得分采用段共识函数进行融合来产生段共识,得到一个视频级的预测,然后对所有模式的预测融合产生最终的预测结果。

一种基于云技术的智能视频分析方法[发明专利]

![一种基于云技术的智能视频分析方法[发明专利]](https://img.taocdn.com/s3/m/a8604a8148d7c1c708a145e9.png)

专利名称:一种基于云技术的智能视频分析方法专利类型:发明专利

发明人:不公告发明人

申请号:CN201710498221.X

申请日:20170627

公开号:CN109145687A

公开日:

20190104

专利内容由知识产权出版社提供

摘要:一种基于云技术的智能视频分析方法:将生物特征识别与局部统计特征识别有机结合——由同一张图像的不同尺度子图像构成尺度空间,基于核函数检测图像的关键点,然后基于8邻域生成关键点描述子,引入测度函数,结合生物特征,进行人脸的匹配。

该方法引入了尺度不变性、旋转与光照不敏感性等优异特性。

同时,为了实现快速匹配,研发了快速特征提取与高效测度方法。

申请人:江苏华扬信息科技有限公司

地址:212009 江苏省镇江市镇江新区智慧大道689号亚太国际1518室

国籍:CN

更多信息请下载全文后查看。

视频场景分类方法、装置、设备及存储介质[发明专利]

![视频场景分类方法、装置、设备及存储介质[发明专利]](https://img.taocdn.com/s3/m/922e8506a4e9856a561252d380eb6294dd882262.png)

专利名称:视频场景分类方法、装置、设备及存储介质专利类型:发明专利

发明人:李根,许世坤,朱延东,王长虎

申请号:CN201810996637.9

申请日:20180829

公开号:CN109145840B

公开日:

20220624

专利内容由知识产权出版社提供

摘要:本公开实施例公开了一种视频场景分类方法、装置、设备及存储介质。

其中,方法包括:从视频帧序列中,抽取多个待处理视频帧;将所述多个待处理视频帧输入至场景分类模型中,得到场景分类模型输出的多个待处理视频帧对应的场景类别;其中,场景分类模型包括聚合模型、分类器和多个特征提取模型,场景分类模型通过每个特征提取模型提取输入的待处理视频帧中的图像特征,通过聚合模型聚合多个待处理视频帧中的图像特征得到聚合特征,通过分类器对聚合特征进行分类得到对应的场景类别。

本公开实施例能够实现视频中的场景分类。

申请人:北京字节跳动网络技术有限公司

地址:100041 北京市石景山区实兴大街30号院3号楼2层B-0035房间

国籍:CN

代理机构:北京品源专利代理有限公司

代理人:孟金喆

更多信息请下载全文后查看。

一种视频分类方法、装置及电子设备[发明专利]

![一种视频分类方法、装置及电子设备[发明专利]](https://img.taocdn.com/s3/m/fffa233654270722192e453610661ed9ac515571.png)

专利名称:一种视频分类方法、装置及电子设备专利类型:发明专利

发明人:李涛,李岩

申请号:CN201910684309.X

申请日:20190726

公开号:CN110399841B

公开日:

20220325

专利内容由知识产权出版社提供

摘要:本公开关于一种视频分类方法、装置及电子设备。

方法包括:针对多个模态中的每个模态,提取待处理视频在该模态上的特征;获取待处理的视频文件,作为待处理视频;利用多头自注意力机制,计算所述待处理视频在该模态上的注意力值,所述注意力值用于表示所述待处理视频在该模态上的特征与所述待处理视频在其他模态上的特征间的上下文关系;融合所述待处理视频在每个模态上的所述注意力值,得到所述待处理视频的融合特征;利用预先训练得到的模型,对所述融合特征进行映射,得到所述待处理视频的分类结果,所述模型用于实现融合特征到分类结果的映射。

可以使得融合特征能够有效的反映出不同模态上的特征间的上下文关系,进而得到更准确的分类结果。

申请人:北京达佳互联信息技术有限公司

地址:100085 北京市海淀区上地西路6号1幢1层101D1-7

国籍:CN

代理机构:北京柏杉松知识产权代理事务所(普通合伙)

更多信息请下载全文后查看。

一种视频分类方法、装置、存储介质及计算机程序产品[发明专利]

![一种视频分类方法、装置、存储介质及计算机程序产品[发明专利]](https://img.taocdn.com/s3/m/2df2ade6ba4cf7ec4afe04a1b0717fd5360cb2b5.png)

专利名称:一种视频分类方法、装置、存储介质及计算机程序产品

专利类型:发明专利

发明人:祝毅晨,朱雨钦,区志财,唐剑

申请号:CN202210095247.0

申请日:20220126

公开号:CN114677613A

公开日:

20220628

专利内容由知识产权出版社提供

摘要:本申请公开了一种实现视频分类的方法装置、存储介质及计算机程序产品,将待处理视频高效地构建成了一张视频图,利用图像分类器对能够体现出待处理视频的主要信息视频图的特征进行学习,在预测时只需要使用2D神经网络结构,因此非常高效,而且可以在目前的各类嵌入式设备中进行部署,高效实现了视频分类,有利于在嵌入式设备上进一步发展视频识别,可用性高。

申请人:美的集团(上海)有限公司,美的集团股份有限公司

地址:201799 上海市青浦区双联路158号1幢11层B区1152室

国籍:CN

代理机构:北京安信方达知识产权代理有限公司

更多信息请下载全文后查看。

视频的场景分类方法及装置、存储介质、终端[发明专利]

![视频的场景分类方法及装置、存储介质、终端[发明专利]](https://img.taocdn.com/s3/m/eafc8bcb541810a6f524ccbff121dd36a22dc445.png)

专利名称:视频的场景分类方法及装置、存储介质、终端专利类型:发明专利

发明人:虞钉钉,胡贤良,徐清,于祥雨

申请号:CN202110551518.4

申请日:20210520

公开号:CN113496208B

公开日:

20220304

专利内容由知识产权出版社提供

摘要:一种视频的场景分类方法及装置、存储介质、终端,所述方法包括:获取输入视频,并从所述输入视频中提取图像序列,所述图像序列包括多帧图像,其中,每帧图像具有时间标签;将所述多帧图像输入至场景分类模型,以得到各帧图像的场景分类结果;根据相邻两帧图像之间的场景相似度对所述图像序列进行划分,以得到多个图像子序列,根据每个图像子序列的场景分类结果和该图像子序列的时间信息确定所述输入视频的场景分类结果。

通过本发明的方案,可以对视频进行场景分类。

申请人:华院计算技术(上海)股份有限公司

地址:200436 上海市静安区万荣路1268号云立方A栋9楼

国籍:CN

代理机构:北京集佳知识产权代理有限公司

代理人:张振军

更多信息请下载全文后查看。

一种基于显著信息的视频分类方法[发明专利]

![一种基于显著信息的视频分类方法[发明专利]](https://img.taocdn.com/s3/m/ec8816ddeefdc8d377ee3290.png)

专利名称:一种基于显著信息的视频分类方法专利类型:发明专利

发明人:刘琚,刘晓玺,顾凌晨

申请号:CN201910407378.6

申请日:20190516

公开号:CN110263638A

公开日:

20190920

专利内容由知识产权出版社提供

摘要:为了解决3D视频分类网络的特征包含较多冗余信息的问题,本发明提出了一种基于显著信息的短视频分类方法。

主要思想在于组合不同大小卷积核,搭建多个显著信息提取模块,获得多尺度、具有代表性的显著信息;此外,为了解决网络中传统池化单元对视频信息造成的大量损失,设计了一种卷积池化相结合的双路池化单元对显著信息提取模块的输出进行针对性池化操作;最终,为了加快网络的收敛速度,优化网络收敛路径,实现端到端的训练,本发明设计了一种全新的损失函数,最终实现更精准的视频分类。

该方法可以产生具有精确表征能力的视频特征,其在动作识别和场景识别场景中进行了实验,均达到优异的效果,充分证明方法具有较强的泛化能力。

申请人:山东大学

地址:250061 山东省济南市历下区经十路17923号

国籍:CN

代理机构:济南圣达知识产权代理有限公司

代理人:李健康

更多信息请下载全文后查看。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

(19)中华人民共和国国家知识产权局

(12)发明专利申请

(10)申请公布号 (43)申请公布日 (21)申请号 201910238135.4

(22)申请日 2019.03.27

(71)申请人 北京邮电大学

地址 100876 北京市海淀区西土城路10号

(72)发明人 黄麟 肖波 马占宇

(74)专利代理机构 北京挺立专利事务所(普通

合伙) 11265

代理人 叶树明

(51)Int.Cl.

G06K 9/62(2006.01)

G06K 9/46(2006.01)

(54)发明名称

一种基于视频描述的视频场景分类方法

(57)摘要

本发明公开了一种基于视频描述的视频场

景分类方法,包括:基于DCT变换以及帧滑动窗口

快速提取视频关键帧,并对视频关键帧进行划

分;采用3d卷积神经网络对视频不定长关键帧序

列进行特征提取;通过Sent2Vec方式获取每个视

频描述的嵌入表示作为视频的语义表示;基于提

取的特征和语义表示得到最终模型架构三维卷

积循环神经网络。

本发明借助于视频描述,实现

一种快速、准确的视频场景分类方法,该方法可

快速准确地提取视频关键帧,相比使用视频所有

的帧或者按照一定时间间隔抽样,结果更加准确

快速。

同时可提升视频场景分类的准确性,通过

长短期记忆神经网络训练学习视频的关键帧时

序关系,更符合视频这一流媒体的性质。

可处理

任意长度视频关键帧序列。

权利要求书2页 说明书6页 附图2页CN 109948721 A 2019.06.28

C N 109948721

A

1.一种基于视频描述的视频场景分类方法,其特征在于,包括:

步骤一、基于离散余弦变换以及帧滑动窗口快速提取视频关键帧,并对视频关键帧进行划分;

步骤二、采用三维卷积神经网络对视频不定长关键帧序列进行特征提取,提取出视频关键帧深度特征;

步骤三、通过句子向量生成的方式获取每个视频描述的嵌入表示作为视频描述文本特征;

步骤四、基于提取的视频关键帧深度特征和视频描述文本特征得到模型架构,该模型架构为三维卷积循环神经网络3d -ConvRNN -Net。

2.如权利要求1所述的方法,其特征在于,步骤一具体包括:

将视频的帧图片调整为设定像素大小后进行离散余弦变换,取频率信号矩阵左上角的设定大小部分为当前的帧信息;计算当前帧的离散余弦变换变化压缩表示,与之前的关键帧队列计算欧式距离,如果欧式距离大于一定阈值,则认为是关键帧,否则,不是关键帧。

3.如权利要求1或2所述的方法,其特征在于,

离散余弦变换变换的方法包括:

其中,n指的是图片大小为n*n;f(x ,y)指的是图片坐标[x ,y]的像素值;图片f经过离散余弦变换后为T,T的大小为n*n;T(u ,v)指的是图片离散余弦后[u ,v]位置的值。

4.如权利要求2所述的方法,其特征在于,

欧式距离的计算方法包括:

其中,k为维护的关键帧队列;x i 为当前帧第i个离散余弦变换特征;y ki 为关键帧队列中第k帧的第i个离散余弦变换特征,dist即为所求欧式距离。

5.如权利要求1所述的方法,其特征在于,步骤二具体包括:

将步骤一产生的视频关键帧按照时间顺序排序,形成视频关键帧序列,通过三维卷积神经网络3dConvNet完成关键帧的深度特征提取,其中三维卷积神经网络主要由3d卷积核,批量归一化层,随机丢弃层等构成。

6.如权利要求5所述的方法,其特征在于,通过三维卷积神经网络3dConvNet完成关键帧的深度特征提取,包括:

权 利 要 求 书1/2页2CN 109948721 A。