多数据源融合的建筑物变化检测

变化检测

2000年影像 2006年影像研究区为南美洲一处热带雨林,通过查看前后两幅影像的坐标系、研究范围、空间分辨率和几何精纠正、大气校正情况,确保了了两幅影像已经配准完毕。

利用Flicker等工具查看前后两期影像存在的差异。

可以明显地发现,粉红色区域为森林采伐区域,2006年研究去内森林采伐区域面积增大了许多。

>> Change Detection Difference Map工具点击Change Detection》Change Detection Difference Map,分别选择2000年影像的第四波段(近红外波段)和2006年影像的第四波段(近红外波段),Define Class Thresholds选择默认,勾选Normalize Data Range[0-1],设置输出路径,取消自动保存配准影像。

根据两幅影像在近红外波段数值相减得到的结果进行变化分级,正值为森林增加,零值为森林不变,负值为森林减少,绝对值越大,变化越大。

Simple Difference = DN2000-DN2006Percent Difference =(DN2000-DN2006)/ DN2000Normalization: Normalization = (DN - min) / (max - min)Standardization: Standardization = (DN - mean) / stdev加载生成的影像,利用多窗口查看对应位置的森林变化分级情况。

差值变化检测结果分类图像以彩色显示,红色表示的前后比较产生了正值差异,即植被生长的区域,且随着颜色加深,增长越多;蓝色表示的前后比较产生了负值差异,即森林砍伐的区域,且随着颜色加深,砍伐越多。

在ToolBox中,打开Classification》Post Classification》Class Statistics,依次选06检测结果和06年影像(此处不能使用00年影像)统计各个变化。

图像配准技术在测绘数据处理中的应用

图像配准技术在测绘数据处理中的应用随着科技的不断进步,图像配准技术在测绘数据处理中的应用日益广泛。

通过将不同遥感图像或摄影图像进行配准,可以准确地确定各个图像之间的几何关系,从而提高测绘数据的精度和可靠性。

本文将探讨图像配准技术在测绘数据处理中的应用,并讨论其优点和挑战。

一、图像配准技术的原理图像配准技术是通过利用图像中的特征点或控制点,确定不同图像之间的几何关系,从而将它们精确地对齐。

主要包括特征提取、特征匹配和几何变换三个步骤。

在特征提取阶段,系统会自动或人工选择出具有代表性的特征点,例如边缘、角点或纹理等。

特征点能够对应到不同图像中,作为图像配准的依据。

接下来,在特征匹配阶段,系统会根据特征点的相似性度量,自动或人工找到不同图像中的相应特征点。

最后,在几何变换阶段,系统会根据特征点的位置关系,计算出适当的几何变换模型,将不同图像进行配准对齐。

二、图像配准技术在测绘数据处理中的应用1. 建筑物识别与更新图像配准技术可应用于建筑物识别与更新。

通过将不同时间或不同源头的航空影像或卫星影像进行配准,可以实现建筑物的变化检测和更新。

利用图像配准技术,能够精确地确定建筑物的位置、形状、面积等参数,为城市规划和更新提供可靠的基础数据。

2. 地表变化监测地表变化监测是测绘数据处理中的重要应用领域之一。

通过图像配准技术,可以将不同时间的遥感图像进行精确的配准,进而准确地检测和监测地表的变化情况。

这对于土地管理、环境保护和自然灾害监测等方面具有重要意义。

3. 数字高程模型生成数字高程模型是测绘数据处理的重要产品之一。

利用图像配准技术,可以将多张影像进行几何校正,并提取出高程信息,最终生成精确的数字高程模型。

这对于地形分析、地图制作和三维可视化等方面具有广泛的应用价值。

4. 地理信息系统更新地理信息系统(GIS)是现代测绘数据处理的核心工具之一。

通过图像配准技术,可以将不同来源的遥感图像与现有的GIS数据进行配准,实现地理信息系统的更新与整合。

智能建筑环境监测技术措施实时监测建筑环境指标

智能建筑环境监测技术措施实时监测建筑环境指标如今,智能建筑环境监测技术在建筑设计和管理中扮演着重要的角色。

通过实时监测建筑环境指标,可以提供数据支持,帮助我们优化建筑设计、提高室内舒适度、减少能源消耗,从而实现可持续发展目标。

本文将介绍几种常见的智能建筑环境监测技术措施,并探讨其实时监测建筑环境指标的应用。

一、传感器技术传感器技术是实现智能建筑环境监测的基础。

通过安装各类传感器,如温度传感器、湿度传感器、CO2传感器等,可以实时获取房间内各项环境指标的数据。

这些数据可以通过物联网技术传输到中央监控系统,并进行分析和反馈。

通过传感器技术的应用,建筑管理人员可以及时了解建筑内环境的变化,并采取相应措施改善室内环境。

二、智能照明系统智能照明系统是实现智能建筑环境监测的重要手段之一。

智能照明系统通过感应器和控制系统,可以根据环境参数自动调节照明亮度和色温,以达到节能和舒适的目的。

例如,在阳光充足的时候,照明系统可以自动调暗或关闭室内灯光,从而减少能源消耗。

智能照明系统还可以与其他系统集成,实现智能化的建筑管理。

三、能源管理系统能源管理系统可以帮助监测建筑的能源使用情况,并进行分析和优化控制。

通过安装智能电表、智能插座等设备,可以实时监测建筑能源的消耗情况,比如电力、供暖、空调等。

能源管理系统可以根据建筑内环境参数和能源使用情况进行智能决策,提供建议和优化方案,以降低能源消耗并提高建筑的能源利用率。

四、空气质量监测系统空气质量是影响室内环境舒适度和人体健康的重要指标之一。

通过安装空气质量监测系统,可以实时监测和分析室内空气中的污染物含量,如PM2.5、CO2、TVOC等。

当空气质量超过一定标准时,系统可以发出警报,并采取相应措施,如通风、过滤等,以改善室内空气质量。

五、智能建筑管理系统智能建筑管理系统是以上技术措施的集成和综合应用。

通过集成传感器技术、智能照明系统、能源管理系统和空气质量监测系统等,智能建筑管理系统可以实现对整个建筑环境的实时监测和控制。

多源遥感数据融合技术在土地变化监测中的应用

多源遥感数据融合技术在土地变化监测中的应用随着社会经济的发展,土地利用和土地变化的监测变得日益重要。

而多源遥感数据融合技术的出现为土地变化监测提供了一种有效的手段。

本文将探讨多源遥感数据融合技术在土地变化监测中的应用,并讨论其意义和挑战。

1. 多源遥感数据融合技术的意义多源遥感数据融合技术通过融合不同分辨率、不同类型的遥感数据,能够提供高质量、全面、准确的土地变化信息。

多源遥感数据融合技术可以从不同空间和时间尺度上观测土地变化,对于了解土地利用和土地覆盖的动态变化具有重要意义。

2. 2.1 土地利用分类多源遥感数据融合技术可以结合光谱、空间、时间等信息,对土地进行精细分类。

通过融合高分辨率的光学遥感数据和高时序的雷达遥感数据,可以实现对土地利用类型的精确识别和分类。

这对于农业产量估算、自然资源管理和城市规划等方面具有重要意义。

2.2 土地变化检测多源遥感数据融合技术可以通过对时间序列数据的分析,检测和监测土地的变化情况。

通过融合具有高时间分辨率的遥感数据和高空间分辨率的遥感数据,可以实现对土地的变化检测和监测。

这对于土地资源管理和环境保护具有重要意义。

2.3 土地覆盖变化研究多源遥感数据融合技术可以结合多种数据源的信息,对土地覆盖的变化进行深入研究。

通过融合光学遥感数据、热红外遥感数据和雷达遥感数据等多种数据,可以实现对土地覆盖类型、植被覆盖变化、水体分布变化等方面的研究。

这对于生态环境的保护和气候变化研究具有重要意义。

3. 多源遥感数据融合技术在土地变化监测中的挑战3.1 数据不同步由于不同遥感数据的获取时间和频率不同,可能存在数据不同步的问题。

这导致了在进行数据融合时需要考虑数据之间的对齐问题,增加了数据处理的复杂性。

3.2 数据不一致不同遥感数据可能存在着数据源类型、光谱范围、辐射校正等方面的差异,这使得数据在进行融合时需要进行预处理,以保证数据的一致性和可比性。

3.3 数据融合方法选择多源遥感数据融合技术有多种方法,如基于物理模型的方法和基于统计模型的方法等。

基于多源遥感数据的城市变化监测研究——以郑州市为例

来的 , 有宏观、 速 、 具 快 准确 、 时 等特 点 , 人类 实 现 全 及 是 球 范 围 内的多 层 次 、 视 角 、 多 多领 域 的 对 地 立 体 观 测 而 植被 、 体变 化 。 水

获取丰富的资源信Βιβλιοθήκη 的一种综合性 空间探测技术 , 被广

1 研 究 区及数 据

泛应用于现代社会持续发展 、 资源综合 规划与利用 、 城 1 1 研 究 区概 况 . 乡规 划 与管 理 、 自然 灾 害 防治 、 境 动 态 监 测 等 多 个 科 环 郑州市是河南省省会 , 于河南省 中部偏北 , 位 东经 学研 究 和应用 领 域 中 。 124 14 1 , 1 。2 一 1。4 北纬 3 。6 3 。8 北临黄河 , 4 1 ~ 45 , 西

校 正 的 目的 就 是 要 改 正 原 始 影 像 的几 何 变 形 。作 者 通

青年科研基金项 目(0 8 0 2 20 A 3 )

作者 简 介 :刘 乐 乐 (9 4一 ) 男 , 南 平 顶 山 人 , 士 研 究 生 , 18 , 河 硕

主要从 事 国土 资 源 遥 感 监 测及 可持 续 利 用 研 究 , E ma ) i ( — i l— 1 u

第2 9卷

21 0 0年

第 1 期

2月

地域研究 与开发

AREAL RES EARCH AND DEVEL 0PM ENT

Vo . 9 No 1 12 .

F b. 2 O e O1

基 于 多 源 遥 感 数 据 的城 市 变 化 监 测 研 究

— —

以郑 州 市 为 例

刘 乐 乐。 ,汪 云 甲 ,陈 国 良 ,乔 浩 然

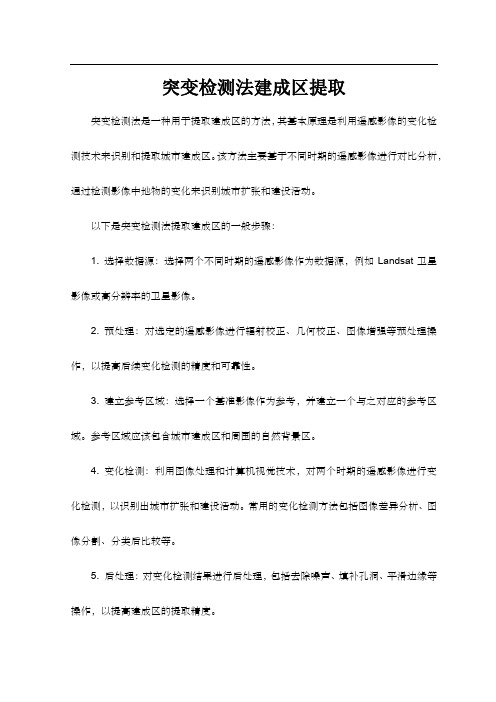

突变检测法建成区提取

突变检测法建成区提取

突变检测法是一种用于提取建成区的方法,其基本原理是利用遥感影像的变化检测技术来识别和提取城市建成区。

该方法主要基于不同时期的遥感影像进行对比分析,通过检测影像中地物的变化来识别城市扩张和建设活动。

以下是突变检测法提取建成区的一般步骤:

1. 选择数据源:选择两个不同时期的遥感影像作为数据源,例如Landsat卫星影像或高分辨率的卫星影像。

2. 预处理:对选定的遥感影像进行辐射校正、几何校正、图像增强等预处理操作,以提高后续变化检测的精度和可靠性。

3. 建立参考区域:选择一个基准影像作为参考,并建立一个与之对应的参考区域。

参考区域应该包含城市建成区和周围的自然背景区。

4. 变化检测:利用图像处理和计算机视觉技术,对两个时期的遥感影像进行变化检测,以识别出城市扩张和建设活动。

常用的变化检测方法包括图像差异分析、图像分割、分类后比较等。

5. 后处理:对变化检测结果进行后处理,包括去除噪声、填补孔洞、平滑边缘等操作,以提高建成区的提取精度。

6. 提取建成区:基于变化检测结果,利用图像分割、分类、聚类等技术,提取出城市建成区的范围。

7. 精度评估:利用已知的地面数据或其他辅助信息,对提取的建成区结果进行精度评估,以便进一步优化和完善提取方法。

突变检测法是一种比较直接和有效的方法来提取建成区范围,尤其适用于城市扩张和建设活动的监测和研究。

然而,该方法也受到数据源的限制,需要不同时期的遥感影像作为输入。

此外,变化检测和后处理步骤需要一定的图像处理和计算机视觉技术,对算法和技术的要求较高。

变化检测

疑问:什么是变化?

农田? 裸地?

房子变化?

Time 2

影像预处理 影像对影像 变化检测

聚合、合并 后处理

识别与标注

发展特点

• 变化检测应 用趋于广泛 性;

• 数据趋于多 元性;

• 方法趋于综 合性

四种变化检测方法分别在不同领域的应用现状(据Menz, 2011)

(来自吕志勇报告)

3 变化检测的技术

3.1 相对辐射校正

将目标影像辐射值同参考影像辐射值进行匹配,寻找两者间的辐射关 系,即为相对辐射校正。

美国某一城市1972-2001年

2 变化检测的概念

1.1 变化检测的内涵

• 遥感影像变化检测是一门根据配准后的不同时相的遥感影 像来获取、分析变化区域和变化性质的理论和方法。

• 变化检测包括以下五个方面的内容:

1)确定被检测区域是否发生了变化 2)确定哪里发生了变化,并统计变化区域的面积 3)确定变化的性质,即变化前后的地物类别 4)对变化检测的结果进行精度评定 5)分析变化检测的规律性,并预测未来可能的发展趋势

2 变化检测的概念

2.1 变化检测的内涵

• 精度评定

主要包括属性精度评价和几何精度评价,常用的评价方法是扩展误差 矩阵和kappa系数评价法。主要的指标是虚检率、漏检率和总体精度。

AA BB AB BA AA BB AB BA

不变 变化

不变

变化

Time 1 遥感影像

正射影像

变化信息 变化图斑 改进后的 变化图斑 变化信息图

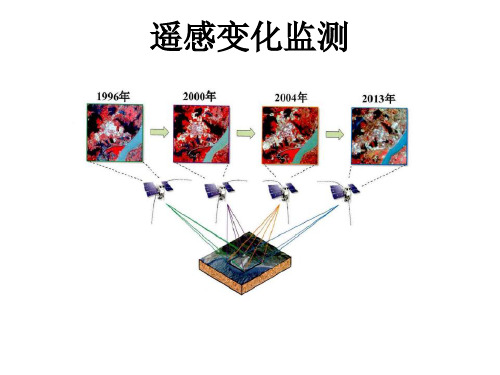

遥感变化监测

内容

• 变化监测的背景 • 变化检测的概念 • 变化检测技术

亚马逊雨林这个世界上最绿 的地方,如今却像一个正烧得通红的 板。1 变化监测的背景

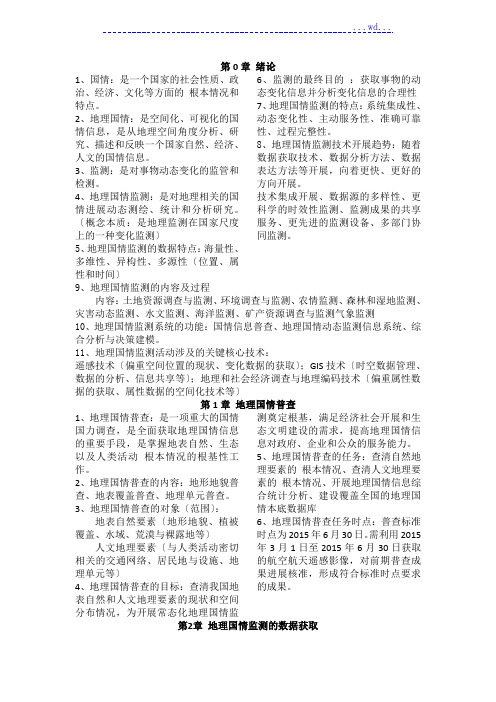

地理国情监测复习资料

...wd...第0章绪论1、国情:是一个国家的社会性质、政治、经济、文化等方面的根本情况和特点。

2、地理国情:是空间化、可视化的国情信息,是从地理空间角度分析、研究、描述和反映一个国家自然、经济、人文的国情信息。

3、监测:是对事物动态变化的监管和检测。

4、地理国情监测:是对地理相关的国情进展动态测绘、统计和分析研究。

〔概念本质:是地理监测在国家尺度上的一种变化监测〕5、地理国情监测的数据特点:海量性、多维性、异构性、多源性〔位置、属性和时间〕6、监测的最终目的:获取事物的动态变化信息并分析变化信息的合理性7、地理国情监测的特点:系统集成性、动态变化性、主动服务性、准确可靠性、过程完整性。

8、地理国情监测技术开展趋势:随着数据获取技术、数据分析方法、数据表达方法等开展,向着更快、更好的方向开展。

技术集成开展、数据源的多样性、更科学的时效性监测、监测成果的共享服务、更先进的监测设备、多部门协同监测。

9、地理国情监测的内容及过程内容:土地资源调查与监测、环境调查与监测、农情监测、森林和湿地监测、灾害动态监测、水文监测、海洋监测、矿产资源调查与监测气象监测10、地理国情监测系统的功能:国情信息普查、地理国情动态监测信息系统、综合分析与决策建模。

11、地理国情监测活动涉及的关键核心技术:遥感技术〔偏重空间位置的现状、变化数据的获取〕;GIS技术〔时空数据管理、数据的分析、信息共享等〕;地理和社会经济调查与地理编码技术〔偏重属性数据的获取、属性数据的空间化技术等〕第1章地理国情普查1、地理国情普查:是一项重大的国情国力调查,是全面获取地理国情信息的重要手段,是掌握地表自然、生态以及人类活动根本情况的根基性工作。

2、地理国情普查的内容:地形地貌普查、地表覆盖普查、地理单元普查。

3、地理国情普查的对象〔范围〕:地表自然要素〔地形地貌、植被覆盖、水域、荒漠与裸露地等〕人文地理要素〔与人类活动密切相关的交通网络、居民地与设施、地理单元等〕4、地理国情普查的目标:查清我国地表自然和人文地理要素的现状和空间分布情况,为开展常态化地理国情监测奠定根基,满足经济社会开展和生态文明建设的需求,提高地理国情信息对政府、企业和公众的服务能力。

遥感影像变化检测方法的比较研究

遥感影像变化检测方法的比较研究在当今科技飞速发展的时代,遥感技术已成为获取地球表面信息的重要手段。

而遥感影像变化检测则是遥感技术中的一个关键环节,它对于监测土地利用变化、城市扩张、自然灾害评估等众多领域都具有极其重要的意义。

本文将对几种常见的遥感影像变化检测方法进行比较研究,以期为相关研究和应用提供有益的参考。

一、遥感影像变化检测的基本概念遥感影像变化检测,简单来说,就是通过对不同时期获取的同一地区的遥感影像进行分析和处理,从而识别出该地区在时间上发生的变化。

这些变化可以包括土地覆盖类型的改变、建筑物的新建或拆除、植被的生长或破坏等。

二、常见的遥感影像变化检测方法1、基于像元的方法基于像元的方法是最早也是最常用的变化检测方法之一。

它直接对每个像元的灰度值或光谱特征进行比较。

其中,差值法是最为简单直观的一种。

通过计算两个时期影像对应像元的差值,如果差值超过一定的阈值,则认为该像元发生了变化。

这种方法计算简单,但容易受到噪声和辐射差异的影响,导致检测结果的准确性不高。

另一种常见的基于像元的方法是比值法。

它通过计算两个时期影像对应像元的比值来判断变化。

比值法在一定程度上能够减少辐射差异的影响,但对于复杂的地物变化,可能会出现误判。

2、基于对象的方法随着高分辨率遥感影像的普及,基于对象的方法逐渐受到重视。

这种方法首先对影像进行分割,得到具有相似特征的对象,然后比较不同时期对象的特征属性,如形状、大小、纹理等。

相比基于像元的方法,基于对象的方法能够更好地考虑地物的空间上下文信息,减少“椒盐噪声”现象,提高检测的准确性。

3、分类后比较法该方法首先对两个时期的遥感影像分别进行分类,然后比较分类结果,从而确定变化区域。

这种方法的优点是能够综合考虑多种地物特征,但由于分类过程本身存在误差,可能会导致变化检测结果的误差累积。

4、基于深度学习的方法近年来,深度学习在遥感影像处理领域取得了显著的成果。

在变化检测中,常用的深度学习模型如卷积神经网络(CNN)可以自动学习影像中的特征,从而实现更加准确和精细的变化检测。

多源遥感数据处理与信息提取技术研究

多源遥感数据处理与信息提取技术研究遥感技术的快速发展使得我们能够获取到大量的遥感数据,这些数据可用于地球表面的监测、环境变化的分析以及资源管理等方面。

然而,由于不同遥感平台、传感器和分辨率的差异,多源遥感数据的融合与处理成为了一个具有挑战性的任务。

本文将探讨多源遥感数据处理与信息提取技术的研究进展。

多源遥感数据处理包括数据融合、数据预处理和特征提取等方面。

数据融合技术旨在将不同遥感数据源的信息进行有意义的整合,以提高数据的精度和可靠性。

一种常用的数据融合方法是基于物理模型的方法,其中通过将遥感数据与地物信息进行模拟和匹配,实现数据融合。

此外,统计学方法、机器学习和人工智能等方法也被广泛应用于遥感数据融合中。

数据预处理技术则是对原始遥感数据进行去噪、滤波、坐标转换和数据校正等处理,以减弱噪声和偏差,使得数据更适用于后续的分析和应用。

在数据预处理过程中,需要充分考虑不同遥感数据源之间的异构性和不确定性,以确保处理结果的准确性和一致性。

特征提取是多源遥感数据处理中的关键步骤,它旨在从多维遥感数据中提取有用的地物信息。

常用的特征提取方法包括数字图像处理方法、频域分析法和纹理分析法等。

信息提取是多源遥感数据处理的一个重要应用方向,它包括地物分类、目标检测和变化检测等内容。

地物分类是将遥感图像中的像元划分到特定类别中的过程,常用算法有最大似然分类、支持向量机和神经网络等。

在地物分类中,多源遥感数据融合能够提供更丰富的空间、光谱和时序信息,从而提高分类精度和鲁棒性。

目标检测是利用遥感图像来检测特定目标的存在与位置,如建筑物、道路和车辆等。

多源遥感数据的综合利用可以提高目标检测的准确性和鲁棒性,对于国土安全、环境保护等领域具有重要意义。

变化检测则是利用遥感图像来检测不同时间段地表的变化情况,可以用于自然灾害监测、城市扩张分析和农作物生长监测等方面。

多源遥感数据的综合利用可以提高变化检测的精度和可靠性。

多源遥感数据处理与信息提取技术的研究还面临着一些挑战。

融合检测算法

融合检测算法是一种用于多个数据源或传感器数据的综合处理和分析的方法。

这种算法的主要目的是通过结合不同来源的信息,以获取更全面、更准确的结果。

以下是对融合检测算法的简要介绍和描述:首先,融合检测算法的基础在于将多个来源的数据进行整合,并采用一种或多中方法来处理这些数据,以获取更全面的信息。

这可能包括数据的融合、数据融合后的分析以及可能的应用结果反馈等。

在许多情况下,融合检测算法可以提高系统的可靠性和准确性,尤其是在处理复杂、多变的环境或条件时。

在实现方式上,融合检测算法通常包括以下几个步骤:1. 数据收集:首先需要从多个数据源或传感器收集数据。

这些数据可能包括温度、湿度、压力、光照、位置等信息。

2. 数据预处理:对收集到的数据进行清洗、去噪、标准化等处理,以提高数据的可用性和准确性。

3. 数据融合:将来自不同来源的数据进行整合,以获取更全面的信息。

这可能包括加权平均、卡尔曼滤波等数据处理方法。

4. 特征提取:从融合后的数据中提取出有用的特征,以便进行进一步的分析和处理。

5. 模型训练和预测:使用提取的特征进行模型训练,建立预测模型,用于预测或决策。

6. 结果反馈和应用:将预测或决策的结果反馈给系统,并根据实际应用进行调整和优化。

与其他数据分析和处理方法相比,融合检测算法具有以下几个优点:1. 更高的准确性和可靠性:通过整合来自不同来源的数据,融合检测算法能够获取更全面、更准确的信息,从而提高了系统的可靠性和准确性。

2. 更广泛的应用场景:融合检测算法适用于各种环境条件和场景,无论是简单的日常环境还是复杂、多变的环境或条件。

3. 可扩展性和灵活性:融合检测算法可以通过调整参数、引入新的数据源或传感器等方式进行扩展和优化,以满足不断变化的需求和挑战。

然而,值得注意的是,融合检测算法并不是万能的,也存在着一些挑战和限制。

例如,数据的完整性和可靠性、数据处理方法的选择和参数的设定等因素都可能影响融合检测算法的效果。

无人机测绘数据处理与分析的基本方法

无人机测绘数据处理与分析的基本方法近年来,随着无人机技术的飞速发展,无人机测绘已经成为一种高效、精确的数据采集方法。

然而,采集到的大量数据如何进行处理和分析,是无人机测绘的关键环节。

本文将介绍无人机测绘数据处理与分析的基本方法。

一、数据处理1. 数据预处理在进行数据处理之前,首先需要对采集到的数据进行预处理。

这包括数据清洗、去噪和校正等步骤。

数据清洗是指去除采集过程中产生的无效数据,如传感器故障或异常数据。

去噪是指去除数据中的噪声,提高数据的质量和准确性。

校正是指根据地面控制点或其他参考数据进行数据的几何和辐射校正,以消除数据中的系统误差。

2. 数据配准数据配准是将无人机采集到的多个影像或点云数据进行对齐,以获得一致的坐标系统。

常用的数据配准方法包括特征点匹配、相位相关法和地面控制点法等。

特征点匹配是通过提取图像或点云中的特征点,并将其与其他数据中的特征点进行匹配,以实现数据的配准。

相位相关法是通过计算两幅影像或点云数据之间的相位相关系数,来确定它们之间的相对位置关系。

地面控制点法是通过在地面上布设一定数量的控制点,并测量它们在不同数据中的坐标,从而实现数据的配准。

3. 数据融合数据融合是将多个数据源的信息进行整合,以获得更全面、准确的数据。

在无人机测绘中,常用的数据融合方法包括影像与点云数据的融合、多时相影像的融合和多源数据的融合等。

影像与点云数据的融合是将无人机采集到的影像和点云数据进行融合,以获得更丰富的地物信息。

多时相影像的融合是将不同时间采集到的影像数据进行融合,以监测地表变化。

多源数据的融合是将不同传感器采集到的数据进行融合,以提高数据的精度和可信度。

二、数据分析1. 特征提取特征提取是从无人机采集到的数据中提取出有用的地物特征。

在无人机测绘中,常用的特征提取方法包括边缘检测、纹理分析和目标识别等。

边缘检测是通过检测图像或点云中的边缘信息,来提取地物的形状和轮廓。

纹理分析是通过分析图像或点云中的纹理信息,来提取地物的纹理特征。

基于多源数据融合的异常检测技术研究

基于多源数据融合的异常检测技术研究随着互联网的普及和物联网技术的进步,数据的量级和复杂度不断增加,如何从海量数据中发现异常现象成为了一项重要的技术。

传统的异常检测技术运用单一源数据进行分析,但由于数据来源的局限性,这种方法往往会产生较大的误检率和漏检率。

而基于多源数据融合的异常检测技术则能够克服单一数据源的局限性,提高检测的精度和准确性。

本文将对多源数据融合的异常检测技术进行详细的探讨。

一、多源数据融合的概念与优势多源数据融合是指将来自多个不同数据源的数据进行集成、融合和处理,生成新的信息和知识,以便对某个特定目标或问题进行综合分析和研究。

多源数据融合具有以下三个显著的优势:1. 提供更全面、更准确的信息。

通过获取来自不同数据源的多维数据,可以更全面、更准确地反映被观测对象的特征和状态。

2. 减少误差和不确定性。

通过将多源数据进行融合,不仅有助于发现数据中的异常点和噪声,还可以减少不同源数据之间的差异和不确定性,提高了研究结果的可信度。

3. 增强决策支持的能力。

多源数据融合能够为决策者提供更多全面的信息来源,从而支持更明智的决策。

多源数据融合在异常检测中的应用,可以分为以下两个方面:1. 基于多源数据特征提取的异常检测方法。

由于不同数据源往往含有不同的信息,通过对不同数据源中的数据进行特征提取,可以获得更加丰富的信息,从而提高异常检测的效果。

例如,可以采用时间序列分析、频域分析等方法,对多源数据进行处理融合,提取其特征,再运用聚类分析、监督学习等方法进行异常检测。

2. 基于多源数据融合的异常检测方法。

多源数据融合技术可以通过整合来自不同数据源的数据,建立更加全面和准确的数据模型,从而提高异常检测的精度和准确度。

例如,可以使用贝叶斯网络、支持向量机等算法,对多源数据进行整合分析,发现规律性和异常点,从而实现精确的异常检测。

在实际应用中,多源数据融合技术在异常检测领域的应用具有广泛的应用前景。

例如,在电力系统中,可以采用多传感器检测技术,对发电机的转速、振动等参数进行实时监测,同时,通过多传感器数据的合并,提高了故障诊断的准确度和精度。

耦合多源大数据提取城中村建筑物——以广州市天河区为例

为了更好地了解城市内部结构,为城中村治理、改造 态的重要数据来源。因此 ,部分学者结合多源大数 提供科学依据,大量学者对城中村开展了相关研究。 据 对 城中村进行探讨。例 如 ,:Liu等 结 合 遥 感 影

早期的城中村研究,多以土地利用类型现状图、 像 、路网与兴趣点(POI)数 据 等 ,将城中村作为城市 调查问卷为数据源,从 土 地 利 用 规 划 、空 间 结 构 、社 用地类别提取出来;Niu等[15]和 Chen等M 融合多

第8页

地理与地理信息科学

第 34卷

l 研究区域概况与数据来源

本文研究数据主要包括天河区建筑物轮廓数 据 、腾 讯 用 户 密 度 (TUD)数据及兴趣点(POI)数 据 。

本文研究区广州市天河区(图 1)的行政区域面 积为 96. 33 km2,2015 年人口为 150. 61 万人[17]。20 世 纪 8 0 年代 以 前 ,天 河 区 由 大 量 传 统 村 落 构 成 ,随 着 3 0 多年来经济的迅猛发展,天河区逐渐成为广州

算 其 占 地 面 积 、楼 层 高 度 、建 筑 密 度 和 楼 房 间 距 信 息 ,通 过 随 机 森 林 方 法 对 上 述 特 征 进 行 训 练 以 提 取 城 中 村 。选取 广 州 市 天 河 区 作 为 研 究 区 ,将 城 中 村 识 别 结 果 与 实 地 调 研 数 据 、百 度 街 景 地 图 进 行 对 比 验 证 分 析 。结 果 显 示 :城 中

会 治理及改造模式等方面对城中村进行探讨[3 1 ]。 源大 数 据 ,识别出广州市天河区与越秀区建筑物功

但这些方法可能受到人为因素、时间和空间等限制, 能 ,并对城中村空间结构进行分析。虽然这些研究

导致数据获取效率较低[8]。随 着 遥 感 技 术 的 发 展 , 采 用 多 源 大 数 据 从 不 同 的 角 度 探 讨 了 城 中 村 的 提

如何进行测绘数据的多源融合和分析

如何进行测绘数据的多源融合和分析测绘数据的多源融合和分析在现代科技的发展下变得越来越重要。

随着卫星遥感、地理信息系统和无人机技术的不断进步,我们可以获得各种各样的测绘数据,如高分辨率遥感影像、激光雷达数据、航空摄影数据等等。

然而,这些数据通常来自不同的传感器和平台,具有不同的格式和精度,如何进行有效的多源融合和分析成为了一个具有挑战性的问题。

首先,多源融合是将来自不同数据源的信息进行整合和处理,以提高数据的准确性和可靠性。

在这个过程中,我们需要考虑数据源之间的误差和不确定性,以及如何有效地校正和配准这些数据。

例如,我们可以利用地面控制点或标定板等方法对不同数据源进行定位和配准,以确保它们在同一地理坐标系下对齐。

此外,我们还可以利用卫星遥感图像和激光雷达数据的辐射和反射特性来消除光照条件和大气干扰等因素对测绘数据的影响,从而提高测绘数据的质量和精度。

其次,多源分析是对融合后的数据进行进一步的处理和分析,以获得更全面和准确的地理信息。

在这个过程中,我们可以利用不同数据源的优势和特点,结合地理信息系统技术和机器学习算法等方法,进行地物分类、变化检测、地形分析等任务。

例如,我们可以利用高分辨率遥感影像和激光雷达数据来识别和提取地物的空间和光谱特征,从而实现精细的地物分类和边界提取。

此外,我们还可以利用多源数据的时间序列信息和变化检测算法来监测和分析地表的动态变化,如城市扩张、土地利用变化等,为城市规划和资源管理等决策提供科学依据。

在实际应用中,测绘数据的多源融合和分析可以应用于很多领域。

例如,它可以用于土地资源调查和评价,通过多源数据的融合和分析,我们可以获取更准确和全面的土地利用、土地覆盖和土地类型等信息,为土地规划和土地资源管理等决策提供支持。

此外,它还可以用于环境监测和生态保护,通过多源数据的融合和分析,我们可以实时监测和评估自然和人为灾害的潜在风险和影响,从而及时采取措施进行预警和应对。

此外,它还可以用于城市规划和建设,通过多源数据的融合和分析,我们可以实现城市的三维建模和可视化,为城市规划和设计提供参考和指导。

基于深度学习的变化检测技术研究

基于深度学习的变化检测技术研究随着城市化进程的加速,人们的对城市及其周边环境的关注度越来越高。

如何对城市及周边的变化进行快速且准确的检测?这就需要利用现成的技术,其中基于深度学习的变化检测技术是一种新兴的技术,这种技术具有准确度高,自适应能力强,对于大规模数据的处理优势明显等优点,成为了各大学者研究的热点。

为什么要进行变化检测?随着社会不断发展,城市化进程不断加快,城市中各种新的建筑、设施、道路等等必然会涌现出来,这对城市规划和管理提出了更高的要求。

而不断富含的遥感数据则提供了城市更新、基础设施更新等研究人员处理数据、评估城市发展状况的珍贵数据源。

在这样的背景下,如何利用数据来发现变化,继而根据发现的变化来进行科学的城市规划、城市管理尤为重要。

传统的变化检测方法中,经典方法主要包括差值法、比率法、阈值法、协方差矩阵和双差值等方法;而这些传统的方法的缺点其对于细节处理不好,对于噪声等复杂情况的处理能力不足。

然而,基于深度学习的变化检测技术可以很好地解决这些问题。

深度学习技术是一种以数据为基础的学习方法,它可以在给定的输入数据中发掘内在的规律和特征,以达到分类和预测等目的。

在变化检测中,深度学习技术可以用于遥感影像的处理,得到建筑物、水体等的影像分类、目标检测等预测结果。

同时,卷积神经网络(Convolutional Neural Network,简称CNN)作为一种基于深度学习的网络结构,可以有效地处理图像数据信息,因此,基于卷积神经网络的遥感影像变化检测技术已经成为了一种主流的方法。

在基于深度学习的遥感影像变化检测方法中,根据实际的需求可以分为两种方式:有监督的和无监督的方法。

有监督的变化检测方法是基于给定的训练数据,利用卷积神经网络对影像进行分类,进而得到变化图像。

而无监督的变化检测是在不需要先验知识的条件下,将影像信息进行自底向上的聚类,得到图像变化区域。

其中有监督的变化检测方法中,基于遥感影像分类的变化检测方法是一种常见的方法,它利用卷积神经网络对遥感影像进行精细分类,以获取影像中的目标。

测绘技术中的建筑物与土地分析与评估方法

测绘技术中的建筑物与土地分析与评估方法随着城市建设的不断发展,对于建筑物和土地的分析与评估变得越来越重要。

测绘技术在这个过程中扮演了重要的角色。

本文将探讨测绘技术在建筑物和土地分析与评估中的方法,包括测量技术、数据处理和地理信息系统应用等。

一、测量技术建筑物和土地的测量是建立分析和评估的基础。

在测绘技术中,常用的测量技术包括全站仪测量、GPS定位和遥感技术等。

全站仪是一种高精度测量仪器,可用于对建筑物和土地的位置、高程和形状等进行测量。

通过全站仪的测量,可以获取建筑物和土地的准确坐标和形态数据,为后续的分析与评估提供基础数据。

GPS定位是一种利用全球卫星导航系统进行定位的技术。

通过在建筑物和土地上放置GPS接收器,可以获取其准确位置信息。

GPS定位技术可以用于快速获取大量建筑物和土地数据,提高分析与评估的效率。

遥感技术是通过卫星或无人机等平台获取建筑物和土地的影像数据。

遥感数据包括高分辨率影像和激光雷达数据等,可以提供建筑物和土地的详细信息,如建筑物的形状、材质和植被覆盖等。

遥感技术在大规模土地分析与评估中发挥了重要作用。

二、数据处理建筑物和土地的测量数据需要进行处理和分析,以提取有用的信息和指标。

数据处理方法包括数据配准、特征提取、分类和变化检测等。

数据配准是将不同数据源的建筑物和土地数据进行对齐,以便进行比较和分析。

通过配准,可以将测量数据与卫星影像等遥感数据进行融合,获取更全面的建筑物和土地信息。

特征提取是从建筑物和土地的数据中提取有意义的特征。

对于建筑物,可以提取形状特征、纹理特征和颜色特征等。

对于土地,可以提取地形特征、植被特征和土壤特征等。

特征提取可以帮助识别建筑物和土地的不同属性,为评估提供参考。

分类是将建筑物和土地划分为不同的类别。

通过分类,可以将建筑物分类为住宅、商业和工业等,将土地分类为农田、森林和湖泊等。

分类可以帮助分析建筑物和土地的空间分布和用途,为评估提供基础。

变化检测是对建筑物和土地的变化进行监测和分析。

遥感建筑监测方案

遥感建筑监测方案遥感建筑监测方案一、引言近年来,随着城市化进程的不断加快,建筑数量的快速增长以及土地利用的复杂性,对城市建筑监测的需求也在不断提高。

传统的人工调查方法往往耗时耗力且效果有限,因此,开展遥感建筑监测成为当前和未来城市发展监管的必然趋势。

本文旨在介绍一种基于遥感技术的建筑监测方案。

二、方案内容1. 数据源本方案将主要采用卫星遥感数据作为建筑监测的数据源。

卫星遥感数据具有全球覆盖、定期更新的特点,可以提供较大范围和高空间分辨率的建筑信息。

2. 数据获取通过卫星遥感影像拍摄,获取目标区域的影像数据。

常用的卫星有Landsat、SPOT和Sentinel等,可根据需求选择合适的卫星进行数据获取。

3. 数据预处理对获取到的遥感影像进行预处理,主要包括去噪、几何校正、辐射校正等。

通过预处理,能够提高数据的质量,为后续建筑监测提供可靠的基础。

4. 建筑提取在预处理完成后,通过图像处理和机器学习算法对影像中的建筑进行提取。

常用的方法包括阈值分割、边缘检测、特征提取等。

通过建筑提取,可以得到目标区域中的建筑物边界和轮廓信息。

5. 建筑分类将提取出来的建筑物进行分类,可以分为住宅、商业、工业等不同类型。

通过建筑分类,可以对不同类型的建筑进行统计和分析,为城市规划和建设提供参考。

6. 建筑变化检测利用多期遥感影像数据进行建筑变化检测,可以监测出建筑的新增、拆除和变化情况。

通过分析变化信息,可以及时发现违规建设和不合理规划,为城市管理和土地利用提供数据支撑。

7. 建筑属性提取通过建筑监测,可以获取到建筑的属性信息,如建筑面积、高度、层数等。

这些信息可以被用于建筑用途评估、建筑能耗计算和城市热岛效应分析等方面。

8. 数据可视化通过将建筑监测结果进行可视化展示,可以更直观地展示建筑分布、变化和属性信息。

可采用地理信息系统(GIS)等工具进行数据可视化,方便用户对城市建筑信息进行查询和分析。

三、技术支持1. 专业软件建议采用专业的遥感图像处理软件,如ENVI、Erdas和ArcGIS等,以支持建筑监测的各项处理和分析功能。

地质灾害遥感监测技术的实施流程和注意事项

地质灾害遥感监测技术的实施流程和注意事项地质灾害是指由地壳运动或地质作用引发的造成人类生命财产损失的灾害事件,如地震、滑坡、泥石流等。

在地质灾害的预防和减轻工作中,遥感技术作为一种非接触式、全球性的监测手段,发挥着重要的作用。

本文将从实施流程和注意事项两个方面进行讨论。

一、实施流程1. 确定监测区域:地质灾害遥感监测需要明确监测的范围和区域。

根据历史灾害发生的情况、地质构造和地质条件等因素进行综合分析,确定具有较高灾害风险的区域。

2. 获取遥感数据:通过卫星遥感、航空摄影等手段获取高分辨率、多光谱或全谱的遥感图像数据。

这些数据包含了地表覆盖、地形高程、植被分布等信息,为地质灾害监测提供了基础数据。

3. 遥感图像预处理:遥感图像预处理是遥感监测的重要环节。

包括辐射校正、大气校正、几何校正等步骤,以消除图像中的噪声和光照影响,提高图像的可用性。

4. 地质灾害识别与提取:利用遥感图像进行地质灾害的识别与提取,采用目视解译或计算机自动解译的方式,将灾害信息从遥感图像中提取出来。

常用的方法有目标特征分析、变化检测等。

5. 灾害监测与分析:通过遥感监测手段,不断观察和记录地质灾害的演变过程,及时掌握灾害的发展态势。

同时,结合其他相关地质数据,进行灾害分析和评估,为风险防范和救援决策提供支持。

6. 灾后评估与监测报告:地质灾害遥感监测不仅可以在平时进行,还可以在灾后对损失进行评估。

通过对灾后遥感图像的对比分析,评估灾害的损失程度,并形成监测报告,为相关部门制定灾后补救和预防措施提供参考。

二、注意事项1. 数据质量:在进行遥感监测时,遥感图像的质量对结果的准确性至关重要。

因此,需注意遥感图像的分辨率、质量、时序等方面的要求,选择合适的数据源。

2. 数据处理:在进行图像预处理和地质灾害的识别与提取时,要注意选择合适的算法和方法,以提高遥感图像的信息提取效果。

同时,要重视对图像处理过程中的参数选择和计算精度控制。

3. 地质灾害类型:不同类型的地质灾害对遥感技术的要求和处理方法也不尽相同。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

A Systematic Approach for Building ChangeDetection using Multi-Source Data1Abdullah H.¨Ozcan,2Cem¨Unsalan,3Peter Reinartz1Tubitak B˙ILGEM,Turkey2Yeditepe University,Turkey3DLR,Germany(e-mail:abdullah.ozcan@.tr)Abstract—Recent sensors give valuable data for remote sensing applications.Among these,building and change detection are important problems.Therefore,researchers worked on these problems using both2D and3D data.Some previous studies used only2D data due to their availability.Yet others used either 3D data alone or2D and3D data in a joint manner.Besides, some studies only focused on building detection.Yet others used detected building information in change detection.In this study, we focus on3D change detection based on building information. Therefore,wefirst detect buildings.At this step,we benefit from both2D and3D data.Then,we locate changes based on these detected buildings.We detect building pixels using panchromatic, multispectral,and Digital Surface Model(DSM)data using a decision tree classifier.Then,we refine the detected building pixels using morphological and shape based operations.Finally, we apply an object based hierarchical change detection method on the refined pixels.We tested our method on780buildings and obtained promising results.I.I NTRODUCTIONAutomatic building and change detection are two important problems in remote sensing.As the frequency and strength of recent natural disasters increase,the need for automated systems for building and change detection also increase. Therefore,there are many studies on these either in a separate or joint manner.The work on building detection can be divided into two different groups.In thefirst category,researchers used only2D data(panchromatic,multispectral,or both).The rationale here is that,obtaining the3D data is hard and expensive.Therefore, the maximum information from2D should be extracted in a cheap and fast manner.In our previous study,we reviewed the literature on2D building detection[8].In the second category, researchers used either3D data alone or2D and3D data together[5],[9],[10].Although3D data is hard to obtain, it provides valuable information for both building and change detection problems.In this study,we benefit from both2D and 3D data in the building detection part of our method.The3D data is obtained from the stereo2D data pair obtained by the semiglobal matching algorithm[1].Change detection methods can be divided into two main groups as in building detection.In thefirst category,there are methods using only2D data.In these,panchromatic and multispectral data can be used separately or in a joint manner [2].In the second category,3D information is taken into account.Adding3D information to change detection also allows detecting depth changes.In this study,we benefit from both2D and3D information in the change detection step of our method.Our systematic approach is composed of three steps.The first one is building detection using classification.Here,we benefit from panchormatic,multispectral,and DSM data from the region to be analyzed.As we obtain the building pixels,we apply a shape based refinement method to extract buildings. Here,we benefit from the boxfitting method introduced by Sirmacek and¨Unsalan[7].Finally,we apply object based change detection on the extracted building shapes on bitem-poral images.In the following sections,we provide each step in detail.II.C LASSIFICATION BASED B UILDING D ETECTIONIn our system,thefirst step is building detection.We approach this problem in a standard feature extraction and classification framework.We extract both novel and known eight featuresfirst.Then,we feed them to a decision tree classifier.Next,we explain these steps in detail.A.Features Extracted from Panchromatic ImagesThefirst extracted feature is the gray value that is obtained directly from the panchromatic image.This feature may seem simple.However,its usage with other features improves the classification performance.The second extracted feature is the variance of the gray values.The variance value for a pixel is calculated by taking a window around it.Our third extracted feature is based on the highest change in a given window.To calculate this feature,we take a window centered around the pixel.Then,we search for the maximum disparity between this pixel and the others in the window.Again,this feature is valuable for detecting building and ground passings.B.Features Extracted from Multispectral DataWe used the multispectral data to extract two features.The first one is based on the shadow information.We extract the shadow information usingshadow=4πarctanb−gb+g(1) where b and r represent the blue and red bands respectively. Shadow information may be used to locate buildings[7].It also gives information for detecting building and ground passings.Therefore,it provides a valuable information.The second extracted feature using the multispectral data is the angular vegetation index.This index was introduced by us in an earlier work to linearize the NDVI[11].It can be formulated asθ=arctannir−rnir+r(2)where nir and r are the near infrared and red bands re-spectively.By definition,this index gives information on the vegetation density in a given pixel.Therefore,it can be used to discriminate background and building pixels.C.Features Extracted from DSM DataWe extract three features using DSM data.Thefirst feature is the local height of the pixel.For a selected pixel,(x m,y m), we define its local height asI h=D(x m,y m)−min(W(x,y))(3) where,W(x,y)is the subwindow centered around(x m,y m). This feature may be used to locate buildings based on their height information.Unfortunately,it has a tendency to connect closely located buildings.The second feature extracted from DSM data is the variance of the height information.Calculating this feature is similar to the variance feature in panchromatic images.The only difference is that,here we benefit from the height information instead of the grayscale values.The third feature extracted from DSM data is similar to local thresholding.However,in this feature we calculate the local height based on the perpendicular two lines crossing the pixel.Besides,we take the line length as twice the window size in thefirst feature.This feature is expected to be helpful in locating large buildings on a nearlyflat surface.D.Classification with a Decision TreeThe extracted features using panchromatic,multispectral, and DSM data provide different information.Although,one may think that the height information is sufficient for build-ing detection,this is not the case.Tree clusters or natural hillocks may also be taken as building based on their height information.Also closely located buildings is a problem.Here, multispectral data may be of use.However,this may not be sufficient on bare soil.Therefore,using all extracted features is a good strategy for building detection.In this study,we pick the decision tree structure as the classifier.Decision tree is a supervised learning algorithm[3]. Among other classifiers,it is the simplest and easiest one to interpret.This algorithm is robust to errors and can be used even if the training data contains errors.Decision tree algorithm is in fact a set of rules.From root to leaves,it asks simple comparison questions.At each node,the algorithm builds the tree in a greedy manner and chooses the most informative feature.In this study,we used the ID3algorithm to select which feature to test at each node.At each step,the entropy of the whole training set is measured if a particular feature for the next step is chosen.In this study,we picked 4300pixels to train the decision tree.After training,there remains40nodes in our tree.In these,every feature is used as a rule to classify pixels as either building or non-building.III.S HAPE BASED R EFINEMENTPixel based classification does not take the shape informa-tion into account.Since we focus on building change detection in this study,we should embed the shape information to our method.In this section,we provide a way for this purpose. First,we benefit from morphological operations.Then,we use a boxfitting algorithm to detect buildings in a more refined manner.A.Morphological RefinementThefirst step in shape based refinement is using morpholog-ical operations.Here,the aim is removing noisy terms before feeding them to boxfitting.To do so,wefirst cluster connected building pixels intofive groups based on their pixelwise area. Then,we apply morphological erosion operation via different structuring elements for each group.In other saying,we apply a larger structuring element to larger building pixel blocks.Similarly,we apply different levels of sized structuring elements to each building block.Every step eliminates non building shaped pixel blocks.The remaining pixel blocks are kept as building centers.They will be used in the boxfitting algorithm next.As we localize center pixels,then we apply morphological dilation operation to obtain the original sized building pixel blocks.B.Box Fitting based RefinementThe second step in shape based refinement is the boxfitting method.In the initial version of this method,the box was fit to the target object in one orientation[7].In thefinal version of the method,this shortcoming is overcome.A small rectangle is gradually grown starting from the center of the building(seed point).When the rectangles hits the edges of the building the growing stops.This operation is done at different angles.For each angle an energy is calculated which is the sum of minimum distance between virtual building edge pixels and real building edge pixels in perpendicular direction. Then the box with the smallest energy is picked.There are some complex buildings that can not be represented with a single rectangle.Sirmacek et al.also improved the method for complex building shapes[6].They extracted the skeleton of the building,found junction points and divided building into elongated segments.therefore,they canfit rectangles on each segment of the building.We also propose similar method for complex building shapes.We represent the building with more than one rect-angle.However,we don’tfind junctions of the building for this purpose.First,wefit a rectangle for the complex shape building.If the ratio of the rectangle area to the building area is less than90%,then we subtract the rectangle pixelsfrom detected building pixels and morphologically clean the remaining small parts.Then,we select the biggest remaining area andfind another seed point forfitting another rectangle. We do this iteration until the total area of the rectangles exceeds at least90%of the building ing this method, complex building shapes can be represented with more than one rectangle.IV.C HANGE D ETECTIONThere are many studies in the literature using the error-prone bitemporal DSMs in a subtraction process for detecting change [4],[9],[10].Unfortunately there are many unwanted results of DSM subtraction.Viewing angle of the sensor,illumination, outliers,tree(s)etc.cause unwanted results on the generated DSM.There are also some cases that DSM subtraction would give misleading results.Assume that there are two buildings. Then they are demolished and one new building(different sized in vertical and horizontal)is constructed at the same area.Subtracting DSM will not give the correct result in this case.Therefore,we consider object based change detection in this study.For object based change detection,we detected building boundaries and represented them with rectangles in the pre-vious ing these and related DSM information, we detect changed buildings from bitemporal images.Our systematic approach is as follows.First,we analyse bitemporal images forfinding missed buildings in the detection step.If one building is detected in thefirst(or second)bitemporal image and not detected in the second(orfirst)bitemporal image,then we compare the height information for the same area.If the height of the area is similar in both images,then we accept it as a building and correct the building detection step. If a building is not detected in both images,then it will also be not used in change detection.After this correction method, we proceed to building change detection.We apply our building change detection method on separate buildings.Here,there can be four different change detection category.These are:•Category1:No building to building or building to no building change.•Category2:Same building with height change.•Category3:Two buildings to one building or one building to two buildings change.•Category4:Different buildings with height and size change.Following are the examples for the above categories.If a building is collapsed or a new building is constructed,then it will be in thefirst category.If the size of a building is not changed,but its height changes then it will be in the second category.If there were two buildings(or one building)in the first time and one building(or two buildings)in the second time at the same area,then it would be in the third category.If a building is collapsed and a new building is constructed with different size,then it will be in the fourth category.Therefore, for each category we use the detected building area and DSM information tofind building change category.Our change detection approach is a hierarchical structure where we detect every change category in an order.First we detect the fourth category changes.If there are buildings in this category,then we discard them in further processing.Then we find the changed buildings in thefirst category.We discard these also in further processing.Next,we check changed buildings in the second category.Finally,we detect changed buildings in the third category.V.E XPERIMENTSIn this section,we test the strengths and weaknesses of our building and change detection methods.First,we evaluate the building detection performance of our method.Then, we test the change detection performance.In both tests,we benefit from WorldView-2satellite images and the DSM data extracted from them.A.Building Detection PerformanceOur bitemporal test images contain381buildings in time-1and399buildings in time-2with different size and shape properties.We provide the building detection performance on these images(in terms of True Detection’TD’anf False Alarm ’FA’)in Tables I and II.As can be seen in these tables,the overall true detection performance of our method is91.3%and 90.4%for both times respectively.TABLE IB UILDING DETECTION PERFORMANCE ON BITEMPORAL IMAGES INTIME-1.Image Name#Buildings TD FAIstanbul1(t1)1411302Istanbul2(t1)75681Istanbul3(t1)81722Istanbul4(t1)84781Total3813486TABLE IIB UILDING DETECTION PERFORMANCE ON BITEMPORAL IMAGES INTIME-2.Image Name#Buildings TD FAIstanbul1(t2)1461353Istanbul2(t2)79722Istanbul3(t2)85732Istanbul4(t2)89810Total3993617We provide the detected buildings as well as the ground truth for four Istanbul images in Fig.1.We can analyze the performance of our building detection method on these images in detail.Unfortunately,some closely located buildings are missed by our method.In some cases,DSM of the building is not generated.This might be caused by matching errors, interpolation technique or viewing angle of the sensor in the DSM generation step.Therefore,our decision tree algorithm can not detect the building.Some false alarms are mainly because of closely located buildings such that the space between them is detected as a building.Fig.1.Detected buildings in time-1and time-2.Each row corresponds to one bitemporal Istanbul image set(from thefirst to the fourth).Thefirst column corresponds to time-1and the second column to time-2.B.Change Detection PerformanceWe analyze the change detection performance of our method based on four categories given above.Based on this definition, we provide the results for each bitemporal image set and change category separately in Table III.In this table,we provide the detected vs the actual number of changes in fractional form.In all four categories,there are total of 31changes and our system was able to detect29of them correctly.There are two missed detections and one false alarm. Missed change detections are because of missed building in the bitemporal image set.The false alarm is caused by very different DSM information of the same building in two images. This may be because of the viewing angle of the sensor.TABLE IIIB UILDING CHANGE DETECTION PERFORMANCE OF OUR METHOD.Image Set C1C2C3C4Istanbul16/6-/-1/1-/-Istanbul29/10-/--/--/-Istanbul35/61/1-/--/-Istanbul45/5-/--/-2/2Total25/271/11/12/2In Fig.2,we provide the detected changes for all our bitemporal image set.In thisfigure,we apply following the color code to discriminate change categories:Category one is represented by yellow;category two is represented by magenta;category three is represented by green;category four is represented by red.The reader may check the change detection performance of our method visually by looking at thisfigure.VI.F INAL C OMMENTSIn this study,we proposed a method for building and change detection using multi-source data and shape informa-tion.Therefore,we benefit from panchromatic,multispectral, and DSM data.First,we extract novel and known features using these data.Then,we used them in a decision-tree to eliminate non-building areas in pixel wise manner.Wethen Fig.2.Change detection results on four bitemporal Istanbul images.First column corresponds to time-1,the second column corresponds to time-2,the third column corresponds to the categorized changes.refined building pixels by shape information.This was for building detection.We tested this step on a large and diverse data set and obtained promising results.Then,we used the detected buildings on change detection.Our change detection method is based on objects.It also has a hierarchical structure. Test results on four bitemporal images show the effectiveness of our method.R EFERENCES[1]P.dAngelo and P.Reinartz,“Semi-global matching results on the isprsstereo matching benchmark,”in Int.Archives Photogrammetry,Remote Sensing and Spatial Information Sciences,vol.XXXVIII-4/W19,2011.[2]M.˙Ilsever and C.¨Unsalan,Two Dimensional Change Detection Meth-ods:Remote Sensing Applications.Springer,2012.[3]T.M.Mitchell,Machine Learning.McGraw-Hill,1997.[4]H.Murakami,K.Nakagawa,H.Hasegawa,T.Shibata,and E.Iwanami,“Change detection of buildings using an airborne laser scanner,”ISPRS Journal of Photogrammetry and Remote Sensing,vol.54,pp.148–152, 1999.[5] A.H.¨Ozcan,C.¨Unsalan,and P.Reinartz,“Building detection usinglocal features and DSM data,”in Proceedings of RAST’13,2013,pp.139–143.[6] B.Sirmacek,P.dAngelo,and P.Reinartz,“Detecting complex buildingshapes in panchromatic satellite images for digital elevation model enhancement,”in ISPRS Workshop on Modeling of Optical Airborne and Space Borne Sensors,2010.[7] B.Sirmacek and C.¨Unsalan,“Building detection from aerial imagesusing invariant color features and shadow information,”in Proceedings of ISCIS’08,2008.[8]——,“A probabilistic framework to detect buildings in aerial andsatellite images,”IEEE Transactions on Geoscience and Remote Sensing, vol.49,no.1,pp.211–221,2011.[9]J.Tian,S.Cui,and P.Reinartz,“Building change detection based onsatellite stereo imagery and digital surface models,”IEEE Transactions on Geoscience and Remote Sensing,vol.52,no.1,pp.406–417,2014.[10]J.Tian and P.Reinartz and P.d’Angelo and M.Ehlers“Region-basedautomatic building and forest change detection on Cartosat-1stereo imagery,”in ISPRS Journal of Photogrammetry and Remote Sensing, 2013.[11] C.¨Unsalan and K.L.Boyer,“Linearized vegetation indices based ona formal statistical framework,”IEEE Transactions on Geoscience andRemote Sensing,vol.42,pp.1575–1585,2004.A CKNOWLEDGMENTThis work is supported by TUBITAK under project no 110E302.。