第4章续 多变量寻优方法

第四讲---多变量优化模型

2

函数存在唯一的驻点

(1) A是正定矩阵

对称矩阵

xmin A 1b, f min c bT A 1b

(2) A是负定矩阵

(2) a>0, 抛物线开口向下,

xmax b 4ac b 2 arg max{ f ( x)} , f max x 2a 4a

xmax A 1b, f max c bT A 1b

问题描述的一般形式

可行解集合

S {x n : gi (x) ci , i 1, 2,, m}

min{ f ( x)} n

x

寻优算法的目标函数

寻优算法的目标函数导言寻优算法(Optimization Algorithm)是一种用于求解优化问题的计算方法。

它通过不断调整问题的解,使得目标函数的取值尽可能接近最优解。

目标函数(Objective Function)是寻优算法中的核心概念,它用于衡量问题的解的质量和优劣程度。

本文将会对寻优算法的目标函数进行全面而深入的探讨,包括目标函数的定义、性质、分类以及设计方法等方面。

目标函数的定义目标函数是指在优化问题中用于评价各个解的一个函数。

根据问题的具体情况,目标函数可以是一个标量函数,也可以是一个向量函数。

标量函数的取值是一个实数,用于表示解的优劣程度。

向量函数的取值是一个向量,其中每个分量表示解在不同方面的优劣程度。

在寻优算法中,目标函数通常由用户定义,根据问题的要求和限制,通过数学方法进行建模。

目标函数的定义需要满足以下几个要求:1.目标函数应能准确地衡量解的质量,能够将问题的约束条件和目标要求统一起来。

例如,在旅行商问题中,目标函数可以是旅行商的总行驶距离,通过最小化这个距离来求解最优路径。

2.目标函数应具备可计算性,能够通过解的参数计算出其对应的目标函数值。

目标函数的计算过程应该高效,并且能够容易地被寻优算法调用。

3.目标函数应具有连续性和光滑性,以便寻优算法能够通过局部搜索等技术找到全局最优解。

在某些情况下,目标函数可能具有非连续性和不可导性,这时需要使用特殊的寻优算法和技术。

目标函数的性质目标函数在寻优算法中起着至关重要的作用,它的性质决定了寻优算法的效果和可行性。

目标函数的主要性质包括:单调性如果目标函数是单调的,那么在解空间中,解的质量和目标函数值之间存在一一对应的关系。

这样的情况下,寻优算法可以通过比较目标函数值来选择更优的解。

单调性是目标函数的一种重要性质,如果目标函数不是单调的,寻优算法需要使用其他策略来进行搜索。

凸性如果目标函数是凸的,那么在解空间中,解的质量和目标函数值之间存在凸性关系。

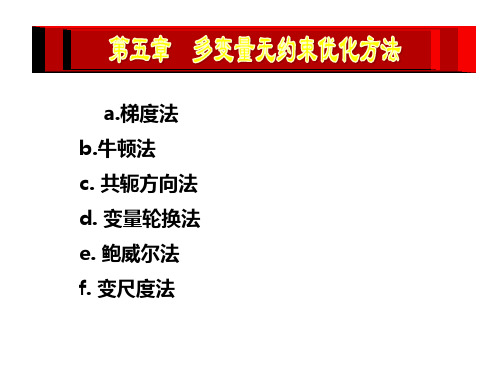

多变量约束优化方法

多变量约束优化方法多变量约束优化问题是指在给定一组目标函数和一组约束条件下,通过调整多个自变量的取值,找到使目标函数最优化且满足约束条件的解。

这类问题在实际应用中非常常见,如工程设计、金融管理、运筹学、物流和供应链管理等领域。

传统的优化方法对于多变量约束优化问题求解存在一些问题,如计算复杂度高、易陷入局部最优解等。

因此,为了有效解决这类问题,研究者们提出了多种多变量约束优化方法,下面将介绍其中几种主流的方法。

一、线性规划方法(Linear Programming, LP)线性规划是最简单且常用的多变量约束优化方法之一、它的目标函数和约束条件都是线性的。

线性规划问题可以通过单纯形法(Simplex Method)或内点法(Interior Point Method)求解。

虽然线性规划方法的计算复杂度比较低,但它只适用于线性目标函数和线性约束条件的情况。

二、非线性规划方法(Nonlinear Programming, NLP)非线性规划方法可以处理目标函数和约束条件是非线性的情况。

常用的非线性规划方法有梯度法、牛顿法和拟牛顿法等。

这些方法通过迭代的方式,在每一步计算目标函数在当前点的梯度,并根据梯度的信息调整自变量的取值,以逐步逼近最优解。

非线性规划方法的计算复杂度较高,但是可以处理复杂的实际问题。

三、遗传算法(Genetic Algorithm, GA)遗传算法是一种通过模拟生物进化过程的优化方法。

它通过模拟自然选择、交叉和变异等过程,逐步解空间中的最优解。

遗传算法具有全局收敛性和并行计算的特点,对于复杂的多变量约束优化问题有较好的适应性。

四、粒子群优化算法(Particle Swarm Optimization, PSO)粒子群优化算法是一种通过模拟鸟群或鱼群的行为进行优化的方法。

在粒子群优化算法中,每个个体(粒子)的位置代表潜在解,速度代表解的方向。

粒子的位置和速度通过迭代的方式进行更新,直到找到最优解。

3.3(变量轮换法)无约束条件多变量函数的选优方法

二、优化方法

变量轮换法、单纯形加速法、一阶梯度法、共轭 梯度法等。

3.3.1.1 变量轮换法

一、基本思想 把多变量的优化问题转化为一系列单变量的优化问 题方法。 二、基本原理 沿着坐标轴的方向轮流进行搜索,直至最优点。又

称坐标轮换法。

三、计算方法(两种计算方法) (一)第一种计算方法 1 以 二元函数情况为例 设二元函数f(X)=f(x1,x2) ,区间a1≤ x1≤b1, a2≤ x2≤b2,初始点X(0)=(x1(0) ,x2(0)) , f(X(0)) 。 (1) 令x1=x1(0) 不动,变动x2,求以x2为单变量的函数最优 值X(1)=(x1(0) ,x2(1)),得f(X (1)); (2)再令x2=x2(1)不动,变动x1,求以x1为单变量的函数最 优值X(2)=(x1(1),x2(1)),得f(X (2)) ;

(4)若f(X(k))-f(X(k-1))<成立, 则停止搜索,否则进入

下一轮寻优(令X(1) = X(n+1) ),直至满足精度为止。

程序框图

f(X) ,X1 ,k=1,e,

f(X)=min[f(Xki+iei)] Y END

f(Xki)-f(Xki-1)< Y N in N k=k+1 X1 =Xkn

20

11 8.75 8.1875

36

9 2.25 0.5625 0.1406 0.0352

X(5)=(7.5,5.75) f(x1)=70.0625-15.75x1+x12 X(6)=(7.875,5.75) 8.0469 X(7)=(7.875, 5.9375) 8.0117

7 X(6)=(7.875,5.75) f(x2)=43.266-11.875x2+ x22

多变量约束优化方法

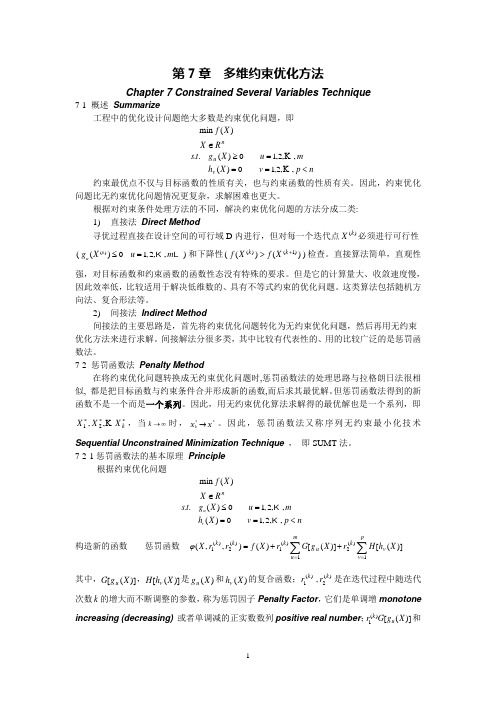

第7章 多维约束优化方法Chapter 7 Constrained Several Variables Technique7-1 概述 Summarize工程中的优化设计问题绝大多数是约束优化问题,即nR X X f ∈)(m innp v X h m u X g t s v u <===≥,,2,10)(,,2,10)(..约束最优点不仅与目标函数的性质有关,也与约束函数的性质有关。

因此,约束优化问题比无约束优化问题情况更复杂,求解困难也更大。

根据对约束条件处理方法的不同,解决约束优化问题的方法分成二类: 1) 直接法 Direct Method寻优过程直接在设计空间的可行域D 内进行,但对每一个迭代点)(k X 必须进行可行性()(()01,2,,)k u g X u m ≤= 和下降性))()(()1()(+>k k X f X f 检查。

直接算法简单,直观性强,对目标函数和约束函数的函数性态没有特殊的要求。

但是它的计算量大、收敛速度慢,因此效率低,比较适用于解决低维数的、具有不等式约束的优化问题。

这类算法包括随机方向法、复合形法等。

2) 间接法 Indirect Method间接法的主要思路是,首先将约束优化问题转化为无约束优化问题,然后再用无约束 优化方法来进行求解。

间接解法分很多类,其中比较有代表性的、用的比较广泛的是惩罚函数法。

7-2 惩罚函数法 Penalty Method在将约束优化问题转换成无约束优化问题时,惩罚函数法的处理思路与拉格朗日法很相似, 都是把目标函数与约束条件合并形成新的函数,而后求其最优解。

但惩罚函数法得到的新函数不是一个而是一个系列。

因此,用无约束优化算法求解得的最优解也是一个系列,即**2*1,,kX X X ,当k →∞时,**k X X →。

因此,惩罚函数法又称序列无约束最小化技术Sequential Unconstrained Minimization Technique , 即SUMT 法。

多参数寻找最优解算法_解释说明以及概述

多参数寻找最优解算法解释说明以及概述1. 引言1.1 概述本篇长文将介绍多参数寻找最优解算法,该算法可以应用于各个领域的优化问题。

在实际问题中,往往存在多个参数需要同时调整以获取最佳解,而传统的单参数最优化算法无法满足这种需求。

因此,我们需要一种能够同时考虑多个参数的寻找最优解算法。

1.2 文章结构本文分为五个主要部分进行阐述和探讨。

首先,在引言部分我们将概述本篇文章的目的和内容,并介绍多参数寻找最优解算法的定义和特点(第2部分)。

接着,在第3部分我们将详细解释说明该算法的原理,并提供相应的流程图解析。

在第4部分,我们将通过具体的案例来展示该算法的实现步骤与技巧分享,并进行案例选择和分析方法论述。

最后,在第5部分中,我们将总结研究成果并讨论存在问题及改进方向,并展望未来相关研究领域。

1.3 目的本文旨在深入探讨多参数寻找最优解算法,并且通过具体案例的分析展示其实现步骤与技巧。

我们希望读者能够对该算法的原理和应用有一个清晰的了解,并能够在实际问题中灵活运用。

通过本文的阅读,读者将能够了解到该算法在不同领域的应用,并对相关的研究方向和改进方法提供参考和启示。

2. 多参数寻找最优解算法2.1 定义多参数寻找最优解算法是一种用于在具有多个参数的问题中找到最优解的方法。

通常,在现实世界中的许多问题都具有多个输入或参数,而这些参数之间可能存在复杂的相互关系。

因此,通过使用多参数寻找最优解算法,可以更全面地分析和评估各种可能的参数组合,并找到最佳的解决方案。

2.2 特点多参数寻找最优解算法具有以下特点:- 能够同时考虑多个参数的影响:相比于单一参数优化方法,如经典的梯度下降算法,在处理多个参数时更加有效。

- 考虑了各个参数之间的相互关系:该算法考虑到不同参数之间可能存在着相关性或交互作用,从而能够更全面地搜索最优解空间。

- 涵盖了广泛的应用领域:由于许多实际问题涉及到多个变量或条件,因此该算法在各种领域中都具有广泛应用价值。

凸优化问题的多变量优化算法研究

凸优化问题的多变量优化算法研究第一章:引言凸优化问题是数学中的一个重要分支,广泛应用于工程、经济学、金融等领域。

多变量优化算法是解决凸优化问题的一种重要手段。

本章将介绍本文的研究目的和意义,概述凸优化问题和多变量优化算法的基本概念。

第二章:凸优化问题基础本章将介绍凸集、凸函数和凸优化问题的基本概念。

首先介绍集合、函数和向量等基础数学概念,然后引入凸集和凸函数的定义,并讨论它们之间的关系。

接着介绍最小值和最大值等重要概念,并给出一些例子来说明。

第三章:多变量优化算法基础本章将介绍多变量函数极值点求解方法中常用的一些基础算法。

首先介绍最速下降法,它是求解无约束极小值点常用方法之一。

然后讨论共轭梯度法,在求解二次型极小值点时具有较好性能。

接着介绍拟牛顿法,它通过构造目标函数二阶导数的近似矩阵来优化搜索方向。

最后介绍粒子群优化算法,它是一种基于群体智能的优化算法,用于求解复杂的非线性优化问题。

第四章:多变量凸优化问题求解算法研究本章将介绍多变量凸优化问题求解算法的研究现状和发展趋势。

首先介绍线性规划和二次规划等常见凸优化问题,并给出相应的求解方法。

然后讨论约束条件下的凸优化问题,包括等式约束和不等式约束,并给出相应的求解方法。

接着介绍凸二次规划和半定规划等特殊类型的凸优化问题,并讨论它们在实际应用中的意义。

第五章:多变量凸优化算法实验研究本章将设计一系列实验来评估不同多变量凸优化算法在不同类型问题上的性能表现。

首先选择一些典型的凸函数作为测试函数,并设计不同维度、不同条件下的测试实例。

然后选择最速下降法、共轭梯度法、拟牛顿法和粒子群优化算法作为对比对象,对它们在测试实例上的求解结果进行对比分析。

最后讨论实验结果,并分析不同算法在不同问题上的适用性。

第六章:结论与展望本章将总结全文的研究内容和结果,并对未来的研究方向进行展望。

首先总结本文对凸优化问题和多变量优化算法的研究,指出它们在实际应用中的重要性和应用前景。

多变量最值问题求解的常用解法

多变量最值问题求解的常用解法

1. 枚举法:若实际问题中的目标函数为只有已知解的有限多解,则

可以用枚举法列举所有的解,并依据目标函数的需求,选择其中的最

优解。

2. 穷举法:用于解决多变量最优化问题,即多元非线性函数最值问题,又称暴力搜索法。

穷举法的思想就是将问题的所有解范围分割成一个

个小区间,然后将所有小区间取点,最终求取各点函数值得出最值。

3. 暴力搜索法:通过搜索问题中可能出现的每一种情况,最终求取最

优解。

4. 遗传算法:是一种著名的进化计算方法,它具有简单易行、收敛速

度快等优点,在解决多变量最优化问题时能够取得很好的效果。

5. 模拟退火算法:模拟退火算法是一种建立在模拟物理过程的算法,

该算法采取尝试性的搜索方式,避免局部最优的出现和陷入,对多变

量最优化问题常常可以取得满意的解。

3.3(变量轮换法)无约束条件多变量函数的选优方法

3 程序框图

f(X) ,X0 ,k=1, f(X)=min[f(Xki)]

f(Xki)-f(Xki-1)< Y

Y

END

N

in N

k=k+1

X0 =Xkn

(二)第二种计算方法

第i 行

设ei为第i个坐标轴的单位矢量, ei=(0,0…,1,…,0)T 。 (1) 给定初始点X(1)=(x1(1),x2(1) ,…,xn(1)) ; (2) 从X(1)出发,先沿着第一坐标轴由e1进行搜索,求 出 新 点 X(2) 及 最 优 步 长 1 , 即 X(2)=X(1) + 1e1 , f(X(2))=f(X(1)+1e1)=min[f(X(1)+e1)],将其代入f(X)= f(x1,x2,x3,…,xn) 中只有一个变量,只有当取 最小,f(X)才能取到最小,也就是说1为沿第一坐标 轴方向上的最优步长, X(2)为沿第一坐标轴方向上的

单变量的函数最优值X0(2)=(x1(1),x2(1) ,x3(0) , …, xn (0)),

得f(X0(2)) ,每次固定n-1个变量,只对一个变量寻优, 对n个变量寻优后,才完成第一轮;

(3)若f(X(k))-f(X(k-1))<成立, 则停止搜索,否则进入 下一轮寻优,直至满足精度为止。

最优点。

(3) 类似地,从X(2)出发,先沿着第二坐标轴由e2进行搜

索,求出新点 X(3) 及最优步长 2 ,即 X(3)=X(2) + 2e2 ,

f(X(3))=f(X(2)+2e2)=min[f(X(2)+e2)],…, X(n+1)=X(n) +nen,f(X(n+1))=f(X(n)+nen)=min[f(X(n)+en)]。这样, 从初始点X(1)经n次搜索得到新点X(n+1),完成一轮迭代。

数学建模案例之多变量最优化

数学建模案例之多变量无约束最优化问题1[1]:一家彩电制造商计划推出两种产品:一种19英寸立体声彩色电视机,制造商建议零售价(MSRP)为339美元。

另一种21英寸立体声彩色电视机,零售价399美元。

公司付出的成本为19英寸彩电195美元/台,21英寸彩电225美元/台,还要加上400000美元的固定成本。

在竞争的销售市场中,每年售出的彩电数量会影响彩电的平均售价。

据估计,对每种类型的彩电,每多售出一台,平均销售价格会下降1美分。

而且19英寸彩电的销售量会影响21英寸彩电的销售量,反之也是如此。

据估计,每售出一台21英寸彩电,19英寸的彩电平均售价会下降0.3美分,而每售出一台19英寸的彩电,21英寸彩电的平均售价会下降0.4美分。

问题是:每种彩电应该各生产多少台?清晰问题:问每种彩电应该各生产多少台,使得利润最大化?1.问题分析、假设与符号说明这里涉及较多的变量:s:19英寸彩电的售出数量(台);t:21英寸彩电的售出数量(台);p:19英寸彩电的售出价格(美元/台);q:21英寸彩电的售出价格(美元/台);C:生产彩电的成本(美元);R:彩电销售的收入(美元);P:彩电销售的利润(美元)这里涉及的常量有:两种彩电的初始定价分别为:339美元和399美元,成本分别为:195美元和225美元;每种彩电每多销售一台,平均售价下降系数a=0.01美元(称为价格弹性系数);两种彩电之间的销售相互影响系数分别为0.04美元和0.03美元;固定成本400000美元。

变量之间的相互关系确定:假设1:对每种类型的彩电,每多售出一台,平均销售价格会下降1美分。

假设2:据估计,每售出一台21英寸彩电,19英寸的彩电平均售价会下降0.3美分,而每售出一台19英寸的彩电,21英寸彩电的平均售价会下降0.4美分。

因此,19英寸彩电的销售价格为:p=339 - a ×s - 0.03×t ,此处a=0.0121英寸彩电的销售价格为:q=399 - 0.01×t - 0.04×s因此,总的销售收入为:R=p ×s + q ×t生产成本为:C=400000 + 195×s + 225×t净利润为:P = R - C因此,原问题转化为求s ≥0和t ≥0,使得P 取得最大值。

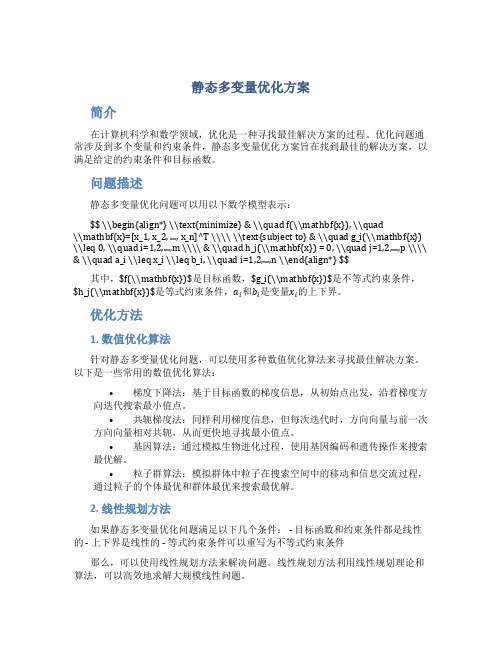

静态多变量优化方案

静态多变量优化方案简介在计算机科学和数学领域,优化是一种寻找最佳解决方案的过程。

优化问题通常涉及到多个变量和约束条件,静态多变量优化方案旨在找到最佳的解决方案,以满足给定的约束条件和目标函数。

问题描述静态多变量优化问题可以用以下数学模型表示:$$ \\begin{align*} \\text{minimize} & \\quad f(\\mathbf{x}), \\quad\\mathbf{x}=[x_1, x_2, ..., x_n]^T \\\\ \\text{subject to} & \\quad g_i(\\mathbf{x}) \\leq 0, \\quad i=1,2,...,m \\\\ & \\quad h_j(\\mathbf{x}) = 0, \\quad j=1,2,...,p \\\\ & \\quad a_i \\leq x_i \\leq b_i, \\quad i=1,2,...,n \\end{align*} $$其中,$f(\\mathbf{x})$是目标函数,$g_i(\\mathbf{x})$是不等式约束条件,$h_j(\\mathbf{x})$是等式约束条件,a i和b i是变量x i的上下界。

优化方法1. 数值优化算法针对静态多变量优化问题,可以使用多种数值优化算法来寻找最佳解决方案。

以下是一些常用的数值优化算法:•梯度下降法:基于目标函数的梯度信息,从初始点出发,沿着梯度方向迭代搜索最小值点。

•共轭梯度法:同样利用梯度信息,但每次迭代时,方向向量与前一次方向向量相对共轭,从而更快地寻找最小值点。

•基因算法:通过模拟生物进化过程,使用基因编码和遗传操作来搜索最优解。

•粒子群算法:模拟群体中粒子在搜索空间中的移动和信息交流过程,通过粒子的个体最优和群体最优来搜索最优解。

2. 线性规划方法如果静态多变量优化问题满足以下几个条件: - 目标函数和约束条件都是线性的 - 上下界是线性的 - 等式约束条件可以重写为不等式约束条件那么,可以使用线性规划方法来解决问题。

最优化第四部分

无,且xk+1=xk,则缩短步长,仍从xk出发进行下一次轴向移动;若

无,且xk+1xk,则仍从xk出发用步长k进行下一次轴向移动.

最优化理论与方法 第四部分 直接搜索的数值解法

从xk+1出发的模式移动是指以1为步长沿加速方向:dk=xk+1–xk

移动一步,得到新的参考点y=xk+1+dk=2xk+1–xk , 然后 , 从新的参 考点y出发 , 仍以k为步长进行轴向移动.

所以第三次轴向移动结束,令 x3 y (3, 2)T .由于 f ( x3 ) f ( x2 ) ,

2 1 0.1 , 且 x3 x2 ,

因此,令 x3 x2 (2 , 1)T , 3 2 ,

取参考点 y x3 (2,1)T .

最优化理论与方法 第四部分 直接搜索的数值解法

二、Powell 法

本节介绍由Powell提出的一种求解无约束最优化问题

(4.1.1)的直接法. 它本质上是以正定二次函数为背景,以共 轭方向为基础的一种方法. 本节分别介绍原始Powell法和Powell法. 补充:共轭方向 设H为一正定对称矩阵,若有一组非零向量S1,S2,……,Sn

满足 量(方向)。 当H为单位矩阵时,有

由梯度法的分析知,此时点X1的梯度必与方向S0垂直,即有

f X S

1 T

0

0

(4-21)

和

f X 1 HX1 B

(4-22)

最优化理论与方法 第四部分 直接搜索的数值解法

从点X1开始沿另一下降方向S1作一维搜索,得 (4-23) X 2 X 1 S1

1

若欲使X2成为极小点,根据极值的必要条件,应有

单纯行法寻优子程序多变量寻优

三、单纯行法寻优子程序(多变量寻优)clearclear allE=0.01;H=0.5;X(1)=1;A0(1)=0.1;B0(1)=5;X(2)=50;A0(2)=5;B0(2)=100;XR(1)=0;XR(2)=0;XS(1)=0;XS(2)=0;u=1.5;lamta=0.7;DT=1;ST=800;LP=ST/DT;global y;QL=0;for j=1:3 %初始三角形确定for i=1:2if i==jZ(i,j)=X(i)+H;elseZ(i,j)=X(i);endendendfor j=1:3 %控制产生点不能超出边界for i=1:2if Z(i,j)<A0(i)Z(i,j)=A0(i);endif Z(i,j)>B0(i)Z(i,j)=B0(i);endX(i)=Z(i,j);endQ(j)=simuQ(X); %调用目标函数子程序endfor k=1:100QH=0;for j=1:3 %求最大值if Q(j)>QHQH=Q(j);JH=j;endendQG=0;for j=1:3 %求次大值if (j~=JH)&(Q(j)>QG)QG=Q(j);JG=j;endendQL=QH; %求最小值for j=1:3if Q(j)<QLQL=Q(j);JL=j;endendif (QH-QL)/QL<E %搜索结束条件判断for i=1:2X(i)=Z(i,JL); %搜索结果endreturnendfor i=1:2XR(i)=0; %计算反射点for j=1:3XR(i)=XR(i)+Z(i,j);endXR(i)=2*(XR(i)-Z(i,JH))/2-Z(i,JH);endfor i=1;2 %计算QR值if XR(i)<A0(i)XR(i)=A0(i);endif XR(i)>B0(i)XR(i)=B0(i);endX(i)=XR(i);endQR=simuQ(X);if QR<QG %当QR<QG成立时if (u*QR+(1-u)*QH)<QL %判断扩张是否合理,小于为合理for i=1:2 %计算扩张点XE(i)=u*XR(i)+(1-u)*Z(i,JH);endfor i=1:2 %计算QE值if XE(i)<A0(i)XE(i)=A0(i);endif XE(i)>B0(i)XE(i)=B0(i);endX(i)=XE(i);endQE=simuQ(X);if QE<QRfor i=1:2XS(i)=XE(i); %XE点取代XS点endQS=QE; %QE取代QS elsefor i=1:2XS(i)=XR(i);endQS=QR;end%endfor i=1:2 %使用反射点取代最坏点Z(i,JH)=XS(i);endQ(JH)=QS;continue;end %QR<QG循环结束else %当QR<QG不成立时for i=1:2 %计算压缩点XS(i)=(1-lamta)*Z(i,JH)+lamta*XR(i);endfor i=1;2 %计算QS值if XS(i)<A0(i)XS(i)=A0(i);endif XS(i)>B0(i)XS(i)=B0(i);endX(i)=XS(i);endQS=simuQ(X);if QS<QGfor i=1:2 %取代最坏点Z(i,JH)=XS(i);endQ(JH)=QS;elsefor j=1:3 %计算收缩后新单纯形for i=1:2Z(i,j)=0.5*(Z(i,j)+Z(i,JL));endendendendend %外循环结束disp(['最优函数值Q=',num2str(Q(JL)),'最优变量X(1)=',num2str(X(1)),'最优变量X(2)=',num2str(X(2))]);plot((1:LP)*DT,y); % 绘制仿真曲线title('单纯行法仿真曲线');FCSP; % 调用求品质指标子程序最优函数值Q=1168.0465 最优变量X(1)=0.2392 最优变量X(2)=49.75过渡时间Ts=97 上升时间Tr=31 超调量MP%=19.4732 衰减率FA%=0.88141 计算目标函数程序function Q=simuQ(X)X1=0;X2=0;X3=0;X4=0;DT=1;ST=800;Ig=1;Q=0;C=exp(-DT/12.5);D=1-C;LP=ST/DT;global y;global y;for i=1:LPX1=X1+DT/X(1)/X(2)*(1-X4);X2=C*X2+0.53*D*(X1+(1-X4)/X(1));X3=C*X3+D*X2;X4=C*X4+D*X3;y(i)=X4;Q=Q+abs(y(i)-Ig)*DT*DT*i;endreturn;求品质指标程序function FCSP(y) %求取计算控制系统调节品质指标子程序Ig=1;MP=0;Ts=0;Tr=0;DT=1;ST=800;Ig=1;LP=ST/DT;global y%求第一个波峰ym1ym1=0;for i=1:LPif ym1<y(i)ym1=y(i);i1=i;endendif i1==LPdisp('无超调量!');return;end%求第一个波谷ymym=ym1;for i=i1:LPif ym>y(i)ym=y(i);i2=i;endend%求第二峰值ym2=ym;for i=i2:LPif ym2<=y(i)ym2=y(i);i3=i;endend%求上升时间Try1=0;for i=1:LPif y1<=Igy1=y(i);elseTr=(i-1)*DT;break;endendMP=(ym1-Ig)/Ig*100; %超调量MPif i3==LP%disp('无第二峰值!');disp('超调量MP%=',num2str(MP));return;endFA=(ym1-ym2)/(ym1-Ig);%衰减率FA%求过渡时间Tsif MP<5Ts=i1*DT;elsefor i=LP:-1:1if abs(y(i)-Ig)/Ig*100>5Ts=(i-1)*DT;break;endendenddisp(['过渡时间Ts=',num2str(Ts),'上升时间Tr=',num2str(Tr),'超调量MP%=',num2str(MP),'衰减率FA%=',num2str(FA)]);return;。

多变量无约束优化方法

f ( X ( k ) ) ,

梯 度 法 计 算 框 图

f ( X

(k)

) <

是

?

否

求 ( k ) ,使得 min f [ X ( k ) ( k ) S ( k ) ]

k 1 k

输出:X ( k ) X *, f ( X ( k ) ) f ( X * )。

停

X ( k ) ( k ) S ( k ) X ( k 1 )

间接法:收敛速度快。

无约束最优化方法的一般过程:

(1) 选择初始点X ( 0 )。这一点越靠近局部极小 点X * 越好。

(2) 已取得某设计点X ( k ) ( k 0,1, 2,)。选择一个 设计方向S ( k )。沿此方向搜索,函数值应是下降的。S ( k )称 为下降方向。

(3) 从X ( k )出发,沿S ( k )的方向进行搜索,确 定步长因子 ( k ),得到新的设计点X ( k 1 )。 X ( k 1 ) = X ( k ) + ( k ) S ( k ) 并满足f ( X ( k 1 ) ) f ( X ( k ) )。具有这种性质的算法, 称为下降算法。 ( k )可以由一维搜索方法来确定的最 优步长因子。

1. 已知下列无约束优化问题

min f ( X ) 2 x12 x2 2 a. 指出其精确解。 b. 用梯度法求解。(迭代两次,初始点X ( 0 ) [ 1,1 ] T )

2.已知下列优化问题

1

四. x 2 4 x 4 2 已知下列无约束优化问题 min f ( X ) x

二、梯度法(最速下降法)的计算过程 和算法框图

梯度法的具体迭代步骤如下: (1) 给定初始点X ( 0 ) R n ,迭代精度, 维数n。 (2) 置0 k

系统工程(第四章)

2 优化变量

• 对于过程系统参数优化 过程系统参数优化问题,优化变量向量就 过程系统参数优化 是过程变量向量。过程变量向量包括决策变量 决策变量 和状态变量 状态变量 • 决策变量等于系统的自由度,它们是系统变量 中可以独立变化以改变系统行为的变量; • 状态变量是决策变量的函数,它们是不能独立 变化的变量,服从于描述系统行为的模型方程

过程系统优化问题可表示为

Min

f (w, x, z) = 0

c(w, x, z) = 0

F(w, x)

h(w, x) = 0

g(w, x) ≥ 0

w-决策变量向量(w1,…,wr); x-状态变量向量(x1,…,xm) z-过程单元内部变量向量(z1,…,zs) F-目标函数 f-m维流程描述方程组(状态方程) c-s维尺寸成本方程组 h-l维等式设计约束方程 g-不等式设计约束方程

4.2.3 化工过程系统最优化方法的分类

• • • • • 无约束最优化与有约束最优化 线性规划与非线性规划 单维最优化和多维最优化 解析法与数值法 可行路径法和不可行路径法

(1) 无约束最优化与有约束最优化

• 在寻求最优决策时,如果对于决策变量及状态变 量无任何附加限制,则称为无约束最优化 无约束最优化 • 问题的最优解就是目标函数的极值。这类问题比 较简单,求解方法是最优化技术的基础 • 在建立最优化模型方程时,若直接或间接的对决 策变量施以某种限制,则称为有约束最优化 有约束最优化。又 有约束最优化 等式约束最优化和 可分为等式约束最优化和不等式约束最优化 等式约束最优化 不等式约束最优化。 • 求解方法是通过把有约束最优化问题转化成无约 束最优化模型进行求解

• 实际生产操作必须根据环境和条件的变化来 调节决策变量(即操作变量),从而使整个 过程系统处于最佳状态,也就是目标函数达 到最优。这就是操作参数优化问题 操作参数优化问题

多目标及离散变量优化方法

03 离散变量优化方法

离散变量定义与特点

离散变量定义

离散变量是指在决策或优化问题中取 值只能为整数的变量。它们通常用于 描述某些离散的、不连续的现象或事 物。

离散变量的特点

离散变量通常具有有限或可数的取值 范围,并且其取值是整数。此外,离 散变量在优化问题中通常对应于某些 约束条件或决策规则。

离散变量优化方法分类

因此,需要进一步研究和发展更有效的多目标及离散变量 优化方法,以解决实际应用中的复杂问题。

02 多目标优化问题概述

多目标优化定义

多目标优化问题是指在满足多个目标函数最优化的过程中,需要同时考虑多个相 互冲突的目标,并寻求一个最优解集合,使得这些目标在某种意义下达到最优或 相对最优。

多目标优化问题通常涉及到多个相互矛盾的目标,如成本、时间、质量等,需要 在这些目标之间进行权衡和折中,以获得一个满意的解。

精确解法

精确解法是指能够求出优化问题的精确解的方法。对于离 散变量优化问题,精确解法通常包括穷举法、回溯法等。

近似解法

近似解法是指通过一定的近似手段来求解离散变量优化问 题的方法。常见的近似解法包括遗传算法、模拟退火算法、 蚁群算法等。

启发式解法

启发式解法是指基于经验或直观的求解方法,通常用于求 解大规模或复杂的离散变量优化问题。常见的启发式解法 包括贪心算法、元启发式算法等。

离散变量优化方法应用场景

组合优化问题

离散变量优化方法广泛应用于组合优化问题 ,如旅行商问题、排班问题、装箱问题等。

调度与分配问题

在生产、物流和供应链等领域,离散变量优化方法 常用于解决调度与分配问题,如任务调度、车辆路 径规划等。

人工智能与机器学习

离散变量优化方法在人工智能和机器学习领 域也有广泛应用,如神经网络的训练、特征 选择等。

多目标优化 方法

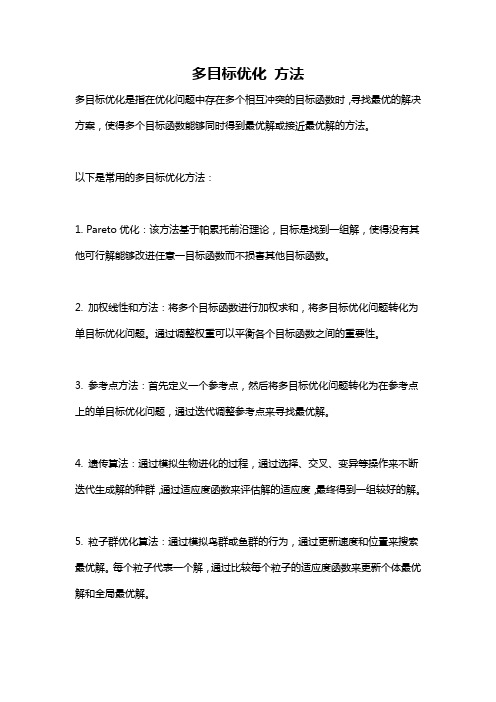

多目标优化方法

多目标优化是指在优化问题中存在多个相互冲突的目标函数时,寻找最优的解决方案,使得多个目标函数能够同时得到最优解或接近最优解的方法。

以下是常用的多目标优化方法:

1. Pareto优化:该方法基于帕累托前沿理论,目标是找到一组解,使得没有其他可行解能够改进任意一目标函数而不损害其他目标函数。

2. 加权线性和方法:将多个目标函数进行加权求和,将多目标优化问题转化为单目标优化问题。

通过调整权重可以平衡各个目标函数之间的重要性。

3. 参考点方法:首先定义一个参考点,然后将多目标优化问题转化为在参考点上的单目标优化问题,通过迭代调整参考点来寻找最优解。

4. 遗传算法:通过模拟生物进化的过程,通过选择、交叉、变异等操作来不断迭代生成解的种群,通过适应度函数来评估解的适应度,最终得到一组较好的解。

5. 粒子群优化算法:通过模拟鸟群或鱼群的行为,通过更新速度和位置来搜索最优解。

每个粒子代表一个解,通过比较每个粒子的适应度函数来更新个体最优解和全局最优解。

以上是一些常见的多目标优化方法,选择合适的方法取决于具体的问题和需求。

多目标最优化问题常用求解方法

多目标最优化问题常用求解方法在这个快节奏的时代,我们每个人都像个多面手,试图在工作、生活、家庭和个人兴趣之间找到一个平衡点。

你有没有想过,科学界也面临着类似的挑战?没错,今天我们要聊的就是“多目标最优化问题”,这听起来像个高深的数学问题,但其实和我们日常生活息息相关。

说白了,就是如何在多个目标中找到最佳方案,简直就像你在选择晚餐时,想吃披萨、汉堡又不想胖,这可咋办?1. 什么是多目标最优化?多目标最优化,顾名思义,就是在一个问题中,有多个需要优化的目标。

就好比你想在考试中既考得高分,又希望能留点时间玩游戏。

很显然,两个目标是有点冲突的。

在数学中,这就需要我们找到一个折中的方案,尽可能让两个目标都满意。

这个过程听起来简单,但实际上可没那么容易,尤其是在目标彼此矛盾时。

1.1 多目标的复杂性想象一下,如果你是个商家,想要最大化利润的同时,又想减少生产成本。

这就像在沙滩上走路,两只脚却在不同的方向移动,走起来可真费劲!所以,优化的过程中,我们常常会遇到“帕累托前沿”这个概念,听起来高大上,其实就是找一个折衷的方案,让各个目标都尽量满意。

1.2 常见的求解方法说到求解方法,我们可就要聊聊那些“招数”了。

首先是“权重法”,这就像做菜时加盐,你需要决定到底放多少,才能让整道菜刚刚好。

把各个目标赋予不同的权重,然后统一成一个目标进行优化,简单有效。

但问题是,权重的设置就像量体裁衣,得小心翼翼,稍不留神就可能“翻车”。

2. 经典算法那么,还有哪些经典的算法可以解决这些麻烦呢?来,接着往下看。

2.1 进化算法进化算法就像自然选择,你总是能看到那些更强壮的个体存活下来。

这种方法通过模拟自然选择的过程,逐步逼近最优解。

听起来很神奇吧?而且这一方法还挺受欢迎,特别是在复杂的多目标问题中,它能在短时间内找到不错的解,真是个“快枪手”!2.2 粒子群优化再说说粒子群优化,这就像一群小鸟在空中飞舞,每只鸟都有自己的目标,同时也受到其他鸟的影响。

第四篇最优化问题讲解

第四篇:最优化问题(五)第13章最优化问题的其它主题13.1 非线性规划和库恩—塔克( Kuhn-Tucker )条件1•仅存在非负约束的情况。

问题:假设f可微Max - - f(x1)S.t. X i _0分析: 最大值的位置可能有二种情况(1)若局部最大值出现在可行集内部,如下图(a)中的A点,则极大值的一阶条件为:d /dx厂f \Xi) = 0且x「0⑵ 若局部最大值出现在纵轴上,如下图(b)中的B点,且一阶条件依然有效,则有:d二/dxi= f \Xi)= 0且为二0⑶ 若局部最大值出现在纵轴上,如下图(c)中的C点或D点,且一阶条件无效,则有:d /dx i= f \x i) 0且X| = 0总而言之,f在x1上取极大值,必须满足以下三个条件之一(1) f'(小0 且x10⑵f'(为)=0 且= 0⑶ f 3 0 且X[ = 0这三种情况综合起来等价于:f '(x1p 0 , x1- 0 且X|f'(xj=o (13.5)(这个三个条件的共同特点是:X i和f '(X i)至少一个为零,这个特点称为X i和f'(X i)互补松弛)(13.5)就是f整体极大化问题的必要条件(一阶条件)。

推广:对有n个选择变量的可微目标函数最优值问题:MaX !U f(X i,X2,lH,X n)s.t. X j _0(j =1,2,3,..., n)一阶条件为:f j 7 ,为 - 0 且X j f j=0 j 1,2,3,111, n) ( 13.7)2.不等式约束效应考察以下含有不等式约束条件的求最大值问题:Max「二 f (X1,X?,X3)1S.t.g (为兀必)汀1g2(X1,X2,X3)-D且 X i ,x>,x 3 _0引入两个虚拟变量S i 和S 2,可以将问题转化为Max - - f(x 1,x ,,x 3) S.t.g 1(X i ,x 2,X 3) S i =「1g 2(为,X 2,X 3)S 2 =「2且 X i ,X 2,X 3 —0定义:由于X j 和S i 必须非负,故这些变量的一阶条件必须修改得与(13,.7)f 「0 , X j-0 且 X j f j =0 (「1,2,3,111, n) 一致,故极值存在的一阶条件为:Z' -0 , X j - 0 且 Z' c X =0j 1,2,3) X jX jZ'兰 0 , S K 0 且 Z' cS =0 (“ 1,2) 「S°SZ'=0 (H 1,2)(13.10)if (X i , X 2,X 3)1i[r i -g (X i ,X 2,X 3)- S J2[「2 - g (X i ,X 2,-Z' :X2.z ' :Z ' :Z ' : Z' : Z' :Z'1 2若令Z 二f (X i,X2,X3) i[r i - g (X i,X2,X3)] 2上 - g(X1,X2,X3)] 则一阶条件等价于:(^ 1,2)为什么?下面我们举例说明如何使用库恩-塔克条件求最优解例1:求如下效用最大化问题的最优解。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

4.4:梯度法解析法(间接法):在确定搜索方向时,需要计算目标函数导数的方法。

梯度法,共轭梯度法,变尺度法,牛顿法。

● 方法又称最速下降法,它是在n X 点附近沿负梯度方向一维搜索,并按负梯度方向逐步进行寻优的方法。

最简单最基本的无约束优化问题方法 ● 收敛性判别准则给定允许误差0>ε,如果)(kx k X f p -=满足ε≤k p则搜索停止,从而得到问题的近似解。

● 迭代步骤1:取初始点0X ,梯度模的允许误差ε,最大迭代次数MAXI ,令k =0; 2:计算梯度)(k x k X f p -=3:检验是否满足收敛性判别准则ε≤k p若满足,则迭代停止,得到kX X ≈min ;否则进行4 4:求单变量极值问题的最优解k λ)()(0k k k k k p X f p X f Min λλλ+=+>5:令k k k k p X Xλ+=+16:判断是否满足εϕ≤-+)()(1k k X f X f)(0.1)(0.10.1)(kk k X f X f X f =≥=<ϕϕ时时若满足,则迭代停止,得到kX X ≈min ;否则进行7 7:令 k =k+1 8:判断迭代次数MAXI k ≥若满足,则迭代停止(非正常),取kX X ≈min ,否则转向2 ● 迭代框图● 优点程序简单,计算机实现起来容易。

对起始点要求也不甚严格,即使从一个较差的初始点出发,一般也能收敛到极小点。

● 缺点在极小点附近收敛得很慢,对于目标函数而言,在起始点远离极小点时,开头几步下降较快,到了极值点时,下降便开始变缓慢,甚至在极小点附近出现来回摆动的情况。

它的收敛快慢与变量尺度关系很大。

2221)(x x X f +=一次迭代 [0,0]22219)(x x X f +=十次迭代]10165.6,10276.5[66--⨯⨯对于小扰动会出现不稳定。

舍入误差或者一维搜索步长的确定不准确,带来小扰动,这些小扰动在个别情况下甚至可能使实际下降方向与理论下降方向成正交的荒谬结论,破坏了方法的收敛性。

4.5:共轭梯度法(FR 法)找到某一个方向的共轭方向,可以一步直接达极值点。

● 计算方法正定二次函数X Z CX X X f T T+=21)(,C 为n n ⨯对称正定阵。

若np p ,,1为任意一组C 的共轭向量,则由任意初始点1X 出发,按如下格式迭代)()(k k k k k p X f p X f Min λλλ+=+n k p X X kk k k ,,11 =+=+λ则至多迭代n 步即收敛。

● 找共轭方向取1X 处的目标函数负梯度方向作为第一个搜索方向)(1)1(1X f g p x -=-=然后沿着1p 方向作一维搜索)()(11111p X f p X f Min λλ+=+由此得到一个新的点2X ,并计算出相应的梯度方向 1112p X X λ+=)(2)2(X f g x =因为梯度方向和前一搜索方向在1λ处正交0)()()()2()1(21=-=-g g X f X f T x T x为了在)1(g 和)2(g构成的正交系中寻求共轭方向2p ,令11)2(2p g p υ+-=即,共轭方向为2X 处的负梯度方向与前一个搜索方向的线性组合,这里的关键是选择1υ使得1p 和2p 共轭。

对于正定二次函数有kk T k k k k T T k k k k TT k k x k Cp C p g g Z C p X g Z C X X f g λλλ或)()()()()()1()1()(=-++=+==++于是得到如下关系1+k p 为)1(+-k g 与k p 的线性组合 k k k k p g p υ+-=++)1(11+k p 与k p 共轭0)(!=+k T k Cp p二次正定函数)1(+k g 与)(k g关系k k T k k k k Cp C p g g λλ或)()()1(=-+从而2212)(2)1()()(kx k x k k k X f Xf gg++==υ),2,1()1(1 =+-=++k p g p kk k k υ迭代步骤1:给定起始点1X ,梯度的模允许误差0>ε,维数n ,最大迭代轮次MAXI ,令k =1 2:检验是否满足收敛性判别准则ε≤)(1X f x若满足,迭代停止,得到1min X X ≈,否则转向33:令)(1)1(1X f g p x -=-=4:求单变量极值问题的最优解)()(k k k k k p X f p X f Min λλλ+=+k k k k p X X λ+=+15:判断是否满足εϕ≤-+)()(1k k X f X f)(0.1)(0.10.1)(kk k X f X f X f =≥=<ϕϕ时时若满足,迭代停止,得到1min +≈k XX ,否则转向66:判断k =n 是否成立。

若成立,令11+=k X X ,转向10;否则,转向7 7:检验是否满足收敛性准则ε≤+)(1k x X f若满足,迭代停止,得到1min +≈k X X ,否则转向88:计算21)()(kx k x k X f Xf +=υk k k x k p X f p υ+-=++)(11k =k +19:正定性检查gb <0, gb 为)(k x X f 与kp 的内积若满足,则转向4;否则,令kX X =1转向10 10:判断迭代轮次J 是否达到规定的最大值 MAXI J ≥ 若满足,则迭代停止,取1min X X ≈,否则转向2“再开始”:n 步迭代后,为了避免舍入误差造成的不良后果,以加快收敛速度,由起始点1X出发,每进行n 步迭代以后,如果不满足收敛性判别准则,再由1111),(++==n n x X X X f p 重新开始,也就是进行n 步以后的第一次迭代取负梯度方向。

“正定性检查”:即检查寻查方向kp 与梯度方向)(k g的夹角是否为钝角,若不为钝角,则取负梯度方向重新开始迭代。

迭代框图优点迭代程序简单,储存量小。

● 缺点)(k x X f 较小时,计算k υ可能会带来较大的舍入误差,甚至可能引起不稳定。

4.6:变度量法(DFP 法及BFGS 法)DFP 法是由Davidon 于1959年提出的,Flethei-Powell 于1963年改进的一种算法。

比共轭梯度法有更快的收敛速度,在高维问题求解中有着明显优势。

● 广义牛顿法对二次严格凸函数X Z CX X X f T T+=21)( 从初始点1X 出发,沿着方向)()()(1111111Z C X Z CX C X f C p T x ---+-=+-=-=沿着此方向搜索,只需要一次迭代可以直接得到最优解 Z C p X X 1112--=+=0)()()(122=+-=+=-T T T T x Z C Z C Z C X X f广义牛顿法迭代公式k k k p X X +=+1牛顿法中每次迭代都必须计算搜索方向T k x k xx T k x k X f X f X f C p )())(()(11---=-=引进一组矩阵121,,,,+n n H H H H 来替代111))((,,))((--n xx xx X f X fk k k H H H ∆+=+1修正矩阵k H ∆不断修正,每次迭代都能逼近1))((-k xx X f 。

DFP 法中修正矩阵为)()()()()()()()()(k k T k kT k k k k T k T k k k gH g H g g H g X X X H ∆∆∆∆-=∆∆∆∆=∆BFGS 法中修正矩阵为)()()()()()()()()()()()(1k T k kTk k T k k k T k k k T k k k T k k gX H g X X g H X X g X g H g H ∆∆∆∆-∆∆-∆∆⎥⎦⎤⎢⎣⎡∆∆∆∆+=∆ 其中kk k k k k k x k k k k X X X gggX f g g H p -=∆-=∆=-=++1)()1()()()()(一维搜索kk k k k k k k k pX Xp X f p X f Min λλλλ+=+=++1)()(迭代步骤1:给定起始点1X ,允许误差0>ε,维数n ,最大迭代轮次MAXI ,初始矩阵I H =1,令J =02:检验是否满足收敛性判别准则ε≤)(1X f x若满足,迭代停止,得到1min X X ≈,否则转向3 3:判断迭代轮次J 是否达到规定的最大值 MAXI J ≥ 若满足,则迭代停止,取1min X X ≈,否则转向4 4:令)(1)1(X f g x =k =15:令)(k k k g H p -=当k =1时,转向7,否则转向6 6:正定性检查gb <0, gb 为)(k x X f 与kp 的内积若满足,则转向7;否则,令I H k =)(k k g p -=转向77:求单变量极值问题的最优解)()(k k k k k p X f p X f Min λλλ+=+k k k k p X X λ+=+18:检验是否满足收敛性准则ε≤+)(1k x X f若满足,迭代停止,得到1min +≈k XX ,否则转向99:判断是否满足εϕ≤-+)()(1k k X f X f)(0.1)(0.10.1)(kk k X f X f X f =≥=<ϕϕ时时若满足,迭代停止,得到1min +≈k XX否则,当k =n 时,令11+=k X X ,I H k =,J =J +1令转向3当k <n 时,令kk k k k k k x k X X X g g gX f g -=∆-=∆=++++1)()1()(1)1()(10:若取L =0,则选用DFP 法计算)()()()()()()()()(k k T k kT k k k k T k T k k k gH g H g g H g X X X H ∆∆∆∆-=∆∆∆∆=∆若L ≠0,则选用BFGS 法计算)()()()()()()()()()()()(1k T k k Tk k T k k k T k k k T k k k T k k g X H g X X g H X X g X g H g H ∆∆∆∆-∆∆-∆∆⎥⎦⎤⎢⎣⎡∆∆∆∆+=∆ 转向1111:令k =k +1,转向5 迭代框图● 优点保留了广义牛顿法的优点,克服其计算不便的缺点。

收敛速度快,避开牛顿法的繁琐计算,不必计算赫森矩阵的逆。

● 缺点此方法对一维搜索的精度要求比较高,当舍入误差较大时,就不易保证度量矩阵k H 的正定性,会出现数值不稳定。