实验三决策树算法实验实验报告

决策树分类实习报告

实习报告:决策树分类实验一、实习背景随着人工智能和机器学习的不断发展,越来越多的任务需要使用机器学习算法进行数据分析和处理。

决策树作为一种常见的机器学习算法,在分类和回归任务中有着广泛的应用。

本次实习,我选择了决策树分类任务,并使用Python的sklearn库进行实验。

二、实习目的1. 熟悉决策树算法的基本原理和实现方式;2. 掌握决策树模型的训练、评估和改进方法;3. 应用决策树算法解决实际问题,提高对机器学习算法的理解和应用能力。

三、实习内容1. 数据集选取与预处理:本次实验选用OpenML的汽车数据集,包含214个样本,11个特征。

首先,对数据集进行加载和探索性分析,了解数据的分布和特点。

然后,进行数据预处理,包括缺失值填充、异常值处理和特征选择等。

2. 模型训练与评估:使用决策树分类器对预处理后的数据集进行训练。

通过调整模型参数,如最大深度、分裂准则等,评估不同模型在测试集上的性能。

评估指标包括准确率、召回率、F1分数等。

3. 改进模型:为了提高模型性能,采用GridSearchCV方法寻找最佳的超参数组合。

同时,针对过拟合问题,限制树的最大深度,并调整类别权重以应对数据集的不平衡。

4. 结果展示:最后,在使用最佳参数的决策树模型上,对测试集进行预测,并使用混淆矩阵、准确率评分和分类报告形式展示模型结果。

四、实习心得1. 决策树算法易于理解和实现,但模型性能受到参数设置的影响较大。

因此,在实际应用中,需要对参数进行调整和优化。

2. GridSearchCV方法是一种有效的参数调整工具,可以较大程度地提高模型性能。

3. 过拟合问题是决策树算法常见的问题之一。

通过限制树的最大深度、调整类别权重等方法,可以有效减轻过拟合现象,提高模型在实际任务中的表现。

4. 本次实习使我更深入地了解了决策树算法,提高了我在实际项目中应用机器学习算法的能力。

五、实习展望1. 进一步学习其他机器学习算法,如支持向量机、随机森林等,提高模型的泛化能力。

(完整版)生物数据挖掘-决策树实验报告

实验四决策树一、实验目的1.了解典型决策树算法2.熟悉决策树算法的思路与步骤3.掌握运用Matlab对数据集做决策树分析的方法二、实验内容1.运用Matlab对数据集做决策树分析三、实验步骤1.写出对决策树算法的理解决策树方法是数据挖掘的重要方法之一,它是利用树形结构的特性来对数据进行分类的一种方法。

决策树学习从一组无规则、无次序的事例中推理出有用的分类规则,是一种实例为基础的归纳学习算法。

决策树首先利用训练数据集合生成一个测试函数,根据不同的权值建立树的分支,即叶子结点,在每个叶子节点下又建立层次结点和分支,如此重利生成决策树,然后对决策树进行剪树处理,最后把决策树转换成规则。

决策树的最大优点是直观,以树状图的形式表现预测结果,而且这个结果可以进行解释。

决策树主要用于聚类和分类方面的应用。

决策树是一树状结构,它的每一个叶子节点对应着一个分类,非叶子节点对应着在某个属性上的划分,根据样本在该属性上的不同取值将其划分成若干个子集。

构造决策树的核心问题是在每一步如何选择适当的属性对样本进行拆分。

对一个分类问题,从已知类标记的训练样本中学习并构造出决策树是一个自上而下分而治之的过程。

2.启动Matlab,运用Matlab对数据集进行决策树分析,写出算法名称、数据集名称、关键代码,记录实验过程,实验结果,并分析实验结果(1)算法名称: ID3算法ID3算法是最经典的决策树分类算法。

ID3算法基于信息熵来选择最佳的测试属性,它选择当前样本集中具有最大信息增益值的属性作为测试属性;样本集的划分则依据测试属性的取值进行,测试属性有多少个不同的取值就将样本集划分为多少个子样本集,同时决策树上相应于该样本集的节点长出新的叶子节点。

ID3算法根据信息论的理论,采用划分后样本集的不确定性作为衡量划分好坏的标准,用信息增益值度量不确定性:信息增益值越大,不确定性越小。

因此,ID3算法在每个非叶节点选择信息增益最大的属性作为测试属性,这样可以得到当前情况下最纯的划分,从而得到较小的决策树。

实验三决策树算法实验实验报告

实验三决策树算法实验实验报告一、引言决策树算法是一种常用的机器学习算法,它通过构建一个决策树模型来解决分类和回归问题。

在本次实验中,我们将使用决策树算法对一个分类问题进行建模,评估算法的性能,并对实验结果进行分析和总结。

二、实验目的1.学习理解决策树算法的基本原理和建模过程。

2. 掌握使用Python编程实现决策树算法。

3.分析决策树算法在不同数据集上的性能表现。

三、实验过程1.数据集介绍2.决策树算法实现我们使用Python编程语言实现了决策树算法。

首先,我们将数据集随机分为训练集和测试集,其中训练集占70%,测试集占30%。

然后,我们使用训练集来构建决策树模型。

在构建决策树时,我们采用了ID3算法,该算法根据信息增益来选择最优的特征进行分割。

最后,我们使用测试集来评估决策树模型的性能,计算并输出准确率和召回率。

3.实验结果与分析我们对实验结果进行了统计和分析。

在本次实验中,决策树算法在测试集上的准确率为0.95,召回率为0.94、这表明决策树模型对于鸢尾花分类问题具有很好的性能。

通过分析决策树模型,我们发现花瓣长度是最重要的特征,它能够很好地区分不同种类的鸢尾花。

四、实验总结通过本次实验,我们学习了决策树算法的基本原理和建模过程,并使用Python实现了决策树算法。

通过实验结果分析,我们发现决策树算法在鸢尾花分类问题上具有很好的性能。

然而,决策树算法也存在一些不足之处,例如容易过拟合和对数据的敏感性较强等。

在实际应用中,可以使用集成学习方法如随机森林来改进决策树算法的性能。

决策方法分析实验报告(3篇)

第1篇一、实验背景在现代社会,决策无处不在,无论是企业运营、政府管理还是个人生活,都需要做出各种决策。

有效的决策方法对于提高决策质量、降低决策风险具有重要意义。

本实验旨在通过分析不同的决策方法,探讨其在实际应用中的优势和局限性,为今后的决策实践提供参考。

二、实验目的1. 了解常见的决策方法及其基本原理。

2. 分析不同决策方法在实践中的应用效果。

3. 探讨决策方法在实际应用中的优势和局限性。

4. 提出优化决策方法的建议。

三、实验内容1. 实验方法本实验采用文献研究、案例分析、比较分析等方法,对以下决策方法进行分析:(1)专家决策法(2)德尔菲法(3)头脑风暴法(4)SWOT分析法(5)决策树法(6)模糊综合评价法2. 实验步骤(1)查阅相关文献,了解各种决策方法的基本原理和适用范围。

(2)收集实际案例,分析不同决策方法在案例中的应用效果。

(3)比较分析各种决策方法的优缺点,探讨其在实际应用中的适用性。

(4)总结实验结果,提出优化决策方法的建议。

四、实验结果与分析1. 专家决策法专家决策法是一种基于专家经验的决策方法。

其优点是决策速度快、成本低,且能充分利用专家的知识和经验。

但缺点是容易受到专家主观因素的影响,且决策结果缺乏客观性。

2. 德尔菲法德尔菲法是一种通过多轮匿名调查,逐步收敛意见的决策方法。

其优点是能减少个体主观因素的影响,提高决策的客观性。

但缺点是决策过程复杂,耗时较长。

3. 头脑风暴法头脑风暴法是一种通过集体讨论,激发创意的决策方法。

其优点是能充分发挥集体的智慧,提高决策的创造性。

但缺点是容易受到群体思维的影响,且决策结果缺乏严谨性。

4. SWOT分析法SWOT分析法是一种通过分析企业的优势、劣势、机会和威胁,制定战略决策的方法。

其优点是能全面分析企业内外部环境,为决策提供依据。

但缺点是分析结果容易受到主观因素的影响。

5. 决策树法决策树法是一种通过构建决策树,对决策问题进行定性和定量分析的方法。

决策树算法实验总结

决策树算法实验总结

决策树算法是一种常用的机器学习算法,它通过对数据集进行递归划分,构建出一棵树状的决策模型。

在实验中,我们使用了决策树算法进行分类任务,并对实验结果进行总结。

首先,我们需要准备一个带有标签的训练数据集,其中包含了多个特征和对应的类别标签。

然后,我们可以使用决策树算法对训练数据集进行训练,构建出一棵具有判断条件的决策树。

在实验中,我们可以使用不同的指标来评估决策树算法的性能,例如准确率、精确率、召回率等。

这些指标可以帮助我们了解决策树算法在分类任务中的表现。

此外,我们还可以通过调整决策树算法的参数来提高其性能。

例如,可以通过限制树的最大深度、设置叶子节点的最小样本数等来控制决策树的复杂度,避免过拟合问题。

在实验总结中,我们可以描述决策树算法在实验中的表现,比较其与其他算法的优劣势,并提出进一步改进的方向。

此外,还可以讨论决策树算法在不同数据集上的适用性,并分析其在实际应用中可能遇到的问题和局限性。

总而言之,决策树算法是一种简单而有效的机器学习算法,可以用于分类任务。

通过实验总结,我们可以更好地理解决策树算法的原理和性能,为进一步的应用和改进提供指导。

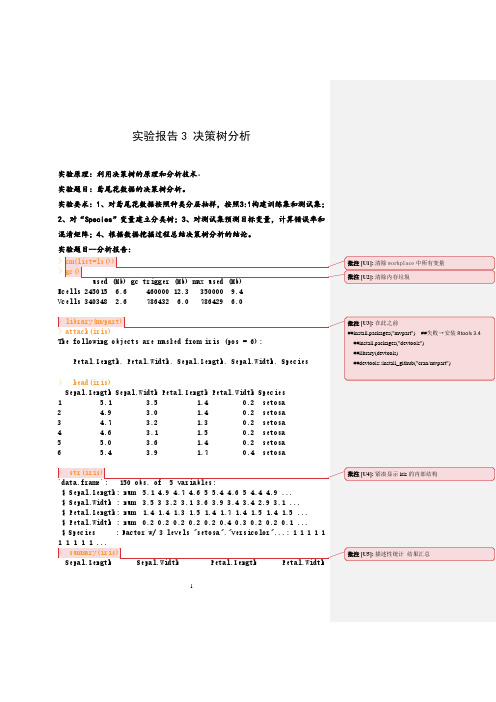

实验报告 决策树

4 0.01000000

3 0.03909774 0.09182077 0.03029535

Variable importance

Petal.Width Petal.Length Sepal.Length Sepal.Width

32

32

22

14

Node number 1: 114 observations, complexity param=0.75 mean=2, MSE=0.6666667 left son=2 (38 obs) right son=3 (76 obs) Primary splits: Petal.Length < 2.6 to the left, improve=0.7500000, (0 missing) Petal.Width < 0.8 to the left, improve=0.7500000, (0 missing) Sepal.Length < 5.55 to the left, improve=0.5917874, (0 missing) Sepal.Width < 3.35 to the right, improve=0.2148810, (0 missing) Surrogate splits: Petal.Width < 0.8 to the left, agree=1.000, adj=1.000, (0

1 1 1 1 1 ...

> summary(iris)

Sepal.Length

Sepal.Width

Petal.Length

Petal.Width

批注 [U1]: 清除 workplace 中所有变量 批注 [U2]: 清除内存垃圾

决策树 实验报告

实验(实习)名称决策树分析一.实验要求:(1)学习决策树分类学习方法,学习其中C4.5学习算法,了解其他ADtree、Id3等其它分类学习方法。

(2)应用Weka软件,学会导入数据文件,并对数据文件进行预处理。

(3)学会如何选择学习函数并调节学习训练参数以达到最佳学习效果。

(4)学习并应用其他决策树学习算法,可以进行各种算法对照比较。

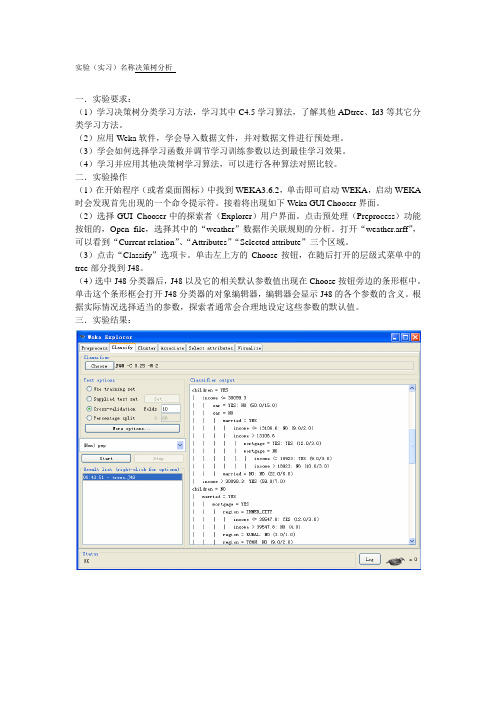

二.实验操作(1)在开始程序(或者桌面图标)中找到WEKA3.6.2,单击即可启动WEKA,启动WEKA 时会发现首先出现的一个命令提示符。

接着将出现如下Weka GUI Chooser界面。

(2)选择GUI Chooser中的探索者(Explorer)用户界面。

点击预处理(Preprocess)功能按钮的,Open file,选择其中的“weather”数据作关联规则的分析。

打开“weather.arff”,可以看到“Current relation”、“Attributes”“Selected attribute”三个区域。

(3)点击“Classify”选项卡。

单击左上方的Choose按钮,在随后打开的层级式菜单中的tree部分找到J48。

(4)选中J48分类器后,J48以及它的相关默认参数值出现在Choose按钮旁边的条形框中。

单击这个条形框会打开J48分类器的对象编辑器,编辑器会显示J48的各个参数的含义。

根据实际情况选择适当的参数,探索者通常会合理地设定这些参数的默认值。

三.实验结果:计算正确率可得:(74+132)/(74+30+64+132)=0.69四.实验小结:通过本次试验,我学习了决策树分类方法,以及其中C4.5算法,并了解了其他ADtree、Id3等其它分类方法,应用Weka软件,学会导入数据文件,并对数据文件进行预处理,今后还需努力。

决策树实验报告

决策树实验报告决策树实验报告引言决策树是一种常见的机器学习算法,被广泛应用于数据挖掘和预测分析等领域。

本文将介绍决策树的基本原理、实验过程和结果分析,以及对决策树算法的优化和应用的思考。

一、决策树的基本原理决策树是一种基于树形结构的分类模型,通过一系列的判断和决策来对数据进行分类。

决策树的构建过程中,首先选择一个特征作为根节点,然后根据该特征的取值将数据划分为不同的子集,接着对每个子集递归地构建子树,直到满足停止条件。

构建完成后,通过树的分支路径即可对新的数据进行分类。

二、实验过程1. 数据准备为了验证决策树算法的效果,我们选择了一个包含多个特征的数据集。

数据集中包含了学生的性别、年龄、成绩等特征,以及是否通过考试的标签。

我们将数据集分为训练集和测试集,其中训练集用于构建决策树模型,测试集用于评估模型的准确性。

2. 决策树构建在实验中,我们使用了Python编程语言中的scikit-learn库来构建决策树模型。

首先,我们导入所需的库和数据集,并对数据进行预处理,包括缺失值处理、特征选择等。

然后,我们使用训练集来构建决策树模型,设置合适的参数,如最大深度、最小样本数等。

最后,我们使用测试集对模型进行评估,并计算准确率、召回率等指标。

3. 结果分析通过实验,我们得到了决策树模型在测试集上的准确率为80%。

这意味着模型能够正确分类80%的测试样本。

此外,我们还计算了模型的召回率和F1值等指标,用于评估模型的性能。

通过对结果的分析,我们可以发现模型在某些特征上表现较好,而在其他特征上表现较差。

这可能是由于数据集中某些特征对于分类结果的影响较大,而其他特征的影响较小。

三、决策树算法的优化和应用1. 算法优化决策树算法在实际应用中存在一些问题,如容易过拟合、对噪声敏感等。

为了提高模型的性能,可以采取以下措施进行优化。

首先,可以通过剪枝操作减少决策树的复杂度,防止过拟合。

其次,可以使用集成学习方法,如随机森林和梯度提升树,来进一步提高模型的准确性和鲁棒性。

决策树实验报告

决策树实验报告一、实验背景随着人工智能和机器学习技术的不断发展,决策树作为一种常见的模型学习方法,在数据分析、分类和预测等方面得到越来越广泛的应用。

本次实验旨在通过使用决策树算法解决某一具体问题,掌握决策树模型的构建及优化方法。

二、实验过程1.数据预处理:本次实验使用Kaggle平台上的“泰坦尼克号生存预测”数据集。

首先进行数据清洗,将缺失值和无关数据进行处理,再将字符串转换为数字,使得数据能够被计算机处理。

接着对数据进行切分,将数据集划分成训练集和测试集。

2.模型建立:本次实验使用Python编程语言,在sklearn库中使用决策树算法进行分类预测。

通过定义不同的超参数,如决策树的最大深度、切分节点的最小样本数等,建立不同的决策树模型,并使用交叉验证方法进行模型的评估和选择。

最终,确定最优的决策树模型,并用该模型对测试集进行预测。

3.模型优化:本次实验采用了两种优化方法进行模型的优化。

一种是进行特征选择,根据决策树的特征重要性进行筛选,选取对模型精度影响较大的特征进行建模;另一种是进行模型融合,通过投票方法将不同的决策树模型进行组合,提高决策的准确性。

三、实验结果本次实验的最优模型使用了决策树的最大深度为5,切分节点的最小样本数为10的超参数。

经过交叉验证,模型在训练集上的平均精度达到了79.2%,在测试集上的精度达到了80.2%。

优化后的模型在测试集上的精度进一步提高至81.2%。

四、实验结论本次实验使用了决策树算法,解决了“泰坦尼克号生存预测”问题。

经过数据预处理、模型建立和模型优化三个阶段,最终得到了在测试集上精度为81.2%的最优模型。

决策树模型具有良好的可解释性和易于理解的特点,在分类预测和决策分析中得到越来越广泛的应用。

决策树算法的设计与应用实验

决策树算法的设计与应用实验

决策树(DecisionTree)是在已知各种情况发生概率的基础上,通过构成决策树来求取净现值的期望值大于等于零的概率,评价项目风险,判断其可行性的决策分析方法,是直观运用概率分析的一种图解法。

由于这种决策分支画成图形很像一棵树的枝干,故称决策树。

在机器学习中,决策树是一个预测模型,他代表的是对象属性与对象值之间的一种映射关系。

决策树是一种树形结构,其中每个内部节点表示一个属性上的测试,每个分支代表一个测试输出,每个叶节点代表一种类别。

量化投资策略:决策树算法的应用

分类树(决策树)是一种十分常用的分类方法。

它是一种监督学习,所谓监督学习就是给定一堆样本,每个样本都有一组属性和一个类别,这些类别是事先确定的,那么通过学习得到一个分类器,这个分类器能够对新出现的对象给出正确的分类。

这样的机器学习就被称之为监督学习。

机器学习中,决策树是一个预测模型;他代表的是对象属性与对象值之间的一种映射关系。

树中每个节点表示某个对象,而每个分叉路径则代表的某个可能的属性值,而每个叶结点则对应从根节点到该叶节点所经历的路径所表示的对象的值。

决策树仅有单一输出,若欲有复数输出,可以建立独立的决策树以处理不同输出。

数据挖掘中决策树是一种经常要用到的技术,可以用于分析数据,同样也可以用来作预测。

从数据产生决策树的机器学习技术叫做决策树学习,通俗说就是决策树。

决策树算法应用实验报告

一、实验背景随着大数据时代的到来,数据挖掘技术在各个领域得到了广泛应用。

决策树算法作为一种常用的数据挖掘方法,因其易于理解和实现的特点,在分类和回归任务中具有很高的应用价值。

本实验旨在通过实践操作,深入了解决策树算法的原理、实现过程及其在实际问题中的应用。

二、实验目的1. 理解决策树算法的基本原理和分类方法。

2. 掌握决策树算法的编程实现。

3. 学会使用决策树算法解决实际问题。

4. 分析决策树算法的优缺点和适用场景。

三、实验环境1. 操作系统:Windows 102. 编程语言:Python3. 库:NumPy、Pandas、Scikit-learn四、实验内容1. 数据准备实验数据采用Iris数据集,该数据集包含150个样本,每个样本包含4个特征(花瓣长度、花瓣宽度、花萼长度、花萼宽度)和1个类别标签(Iris-setosa、Iris-versicolor、Iris-virginica)。

2. 决策树算法实现(1)基于ID3算法的决策树实现首先,定义计算信息熵、条件熵和信息增益的函数。

然后,根据信息增益选择最优特征进行节点分裂,递归地构建决策树。

```pythondef calculate_entropy(data):# ...def calculate_condition_entropy(data, feature, value):# ...def calculate_information_gain(data, feature, value):# ...def build_tree(data):# ...```(2)基于CART算法的决策树实现首先,定义计算Gini指数的函数。

然后,根据Gini指数选择最优特征进行节点分裂,递归地构建决策树。

```pythondef calculate_gini_index(data):# ...def build_tree_cart(data):# ...```3. 模型评估使用交叉验证方法评估决策树模型的性能。

【报告】id3算法实验报告

【关键字】报告id3算法实验报告篇一:ID3算法实验报告一、实验原理决策树通过把实例从根节点排列到某个叶子节点来分类实例,叶子节点即为实例所属的分类。

树上的每一个节点说明了对实例的某个属性的尝试,并且该节点的每一个后继分支对应于该属性的一个可能值,例如下图。

构造好的决策树的关键在于如何选择好的逻辑判断或属性。

对于同样一组例子,可以有很多决策树能符合这组例子。

人们研究出,一般情况下或具有较大概率地说,树越小则树的预测能力越强。

要构造尽可能小的决策树,关键在于选择恰当的逻辑判断或属性。

由于构造最小的树是NP-难问题,因此只能采取用启发式策略选择好的逻辑判断或属性。

用信息增益度量期望熵最低,来选择分类属性。

公式为ID3算法创建树的Root结点如果Examples都为正,那么返回label=+中的单结点Root 如果Examples都为反,那么返回lable=-单结点树Root如果Attributes为空,那么返回单节点树Root,lable=Examples中最普遍的目标属性值否则开始A目标属性值lable=Examples中最普遍的否则在这个新分支下加一个子树ID3(example-vi,target-attribute,attributes-|A|)结束返回Root二、算法实现训练数据存放在Data.txt 中第一行为训练样本数量和每个样本中属性的数量第二行为每个属性取值的数量之后n行为所有样本节点数据结构struct DTNode{int name; //用1,2,3...表示选择的属性,0表示不用分类,即叶节点int data[D_MAX+1]; //表示此节点包含的数据,data[i]=1,表示包含二维数组data[][]中的第i条数据int leaf;//leaf=1 正例叶节点;leaf=2 反例叶节点;leaf=0不是节点int c; //c=1 正类;c=0 反类DTNode *child[P+1];//按属性值的个数建立子树};定义函数void Read_data() //从数据文件Data.txt中读入训练数据DT_pointer Create_DT(DT_pointer Tree,int name,int value)//创建决策树int chose(int *da)//选择分类属性float Gain(int *da,int p) //计算以p属性分类的期望熵float Entropy(int *da) //计算数据的熵int test_leaf(int *da) //尝试节点属性void Out_DT(DT_pointer Tree) //用线性表形式输出建立的决策树int Class(int *da) //对输入的尝试样本分类全局变量FILE *fp;int p_num; //属性的数量int pi[P_MAX+1]; //每个属性有几种取值int d_num;//数据的数量int data[P_MAX+1][D_MAX+1];//存储训练数据三、程序不足1.、默认训练数据是正确的,对是否发生错误不予考虑2、没有考虑训练数据可以包含缺少属性值的实例3、只能分正反两类四、程序源码#include#include#include#include#include#define P_MAX 10#define D_MAX 50#define P 5//一条数据包括所有属性的取值(1,2,3...)和分类的值(0或1)FILE *fp;int p_num; //属性的数量int pi[P_MAX+1]; //每个属性有几种取值int d_num;//数据的数量int data[P_MAX+1][D_MAX+1];//存储训练数据//定义结点类型struct DTNode{int name; //此节点分类属性的名称int data[D_MAX+1]; //表示此节点包含的数据int leaf; //leaf=1 正例叶节点;leaf=2 反例叶节点;叶节点int c; //c=1 正类;c=0 反类DTNode *child[P+1];//按属性值的个数建立子树};typedef struct DTNode *DT_pointer;DT_pointer DT = NULL;int root = 0;int test_leaf(int *da) leaf=0不是int i;int a,b;a = 0;// a=0表示没有0类a=1表示有0类for(i = 1; i { if(*(da+i) ==1 && data[i][0] == 0){a = 1;break;}}b = 0;//b=0表示没有1类b=1表示有1类for(i = 1;i { if(*(da+i) == 1 && data[i][0] == 1){b = 1;break;}}if(a == 0 && b == 1)return 1;//是1叶节点else if(a == 1 && b == 0)return 2;//是0叶节点else if(a == 0 && b == 0)return 2;//此节点无数据elsereturn 0;//不是叶节点}int test_c(int a) //给叶节点附属性值{if(a == 1)return 1;elsereturn 0;}float Entropy(int *da) //计算数据的熵{int i;篇二:ID3算法实验报告装订线:ID3算法分析与实现学院xxxxxxxxxxxxxxxxxxxx 专业xxxxxxxxxxxxxxxx 学号xxxxxxxxxxx 姓名xxxx 指导教师xxxxXX年x月xx日题目ID3算法分析与实现摘要:决策树是对数据进行分类,以此达到预测的目的。

决策树分类实验报告

一、实验背景与目的决策树是一种常用的机器学习分类算法,它通过树形结构对数据进行分类,具有直观、易于理解和解释的特点。

本实验旨在通过构建决策树模型,对某数据集进行分类,并评估模型性能。

二、实验环境与数据1. 实验环境:- 操作系统:Windows 10- 编程语言:Python- 数据处理库:Pandas、NumPy- 机器学习库:Scikit-learn2. 数据集:本实验采用鸢尾花数据集(Iris dataset),该数据集包含150个样本,每个样本有4个特征(花瓣长度、花瓣宽度、花萼长度、花萼宽度)和1个标签(类别:Iris-setosa、Iris-versicolor、Iris-virginica)。

三、实验步骤1. 数据预处理:- 加载数据集,并使用Pandas库进行数据清洗和预处理。

- 将数据集分为训练集和测试集,采用8:2的比例。

- 对数据进行归一化处理,使特征值在[0, 1]范围内。

2. 决策树模型构建:- 使用Scikit-learn库中的DecisionTreeClassifier类构建决策树模型。

- 设置模型参数,如树的深度、最大叶子节点数等。

3. 模型训练:- 使用训练集对决策树模型进行训练。

4. 模型评估:- 使用测试集对训练好的模型进行评估,计算分类准确率、召回率、F1值等指标。

5. 结果分析:- 分析模型的性能,并探讨不同参数设置对模型性能的影响。

四、实验结果与分析1. 模型参数设置:- 树的深度:10- 最大叶子节点数:202. 模型性能评估:- 分类准确率:0.9778- 召回率:0.9778- F1值:0.97783. 结果分析:- 决策树模型在鸢尾花数据集上取得了较好的分类效果,准确率达到97.78%。

- 通过调整模型参数,可以进一步提高模型性能。

- 决策树模型易于理解和解释,有助于分析数据特征和分类规则。

五、实验结论本实验通过构建决策树模型,对鸢尾花数据集进行分类,并取得了较好的分类效果。

决策树分类模型实验报告

一、实验背景决策树分类模型是一种常用的机器学习算法,通过构建一棵树状结构来对数据进行分类。

在实验中,我们将使用Python编程语言和Scikit-learn库来实现决策树分类模型,并使用鸢尾花数据集进行训练和测试。

二、实验目的1. 理解决策树分类模型的基本原理和算法流程;2. 掌握使用Python和Scikit-learn库实现决策树分类模型的方法;3. 通过实验验证决策树分类模型的性能,并分析其对不同数据集的适用性。

三、实验环境1. 操作系统:Windows 10;2. 编程语言:Python3.7;3. 数据库:Scikit-learn库。

四、实验步骤1. 数据导入与预处理首先,我们需要导入鸢尾花数据集。

鸢尾花数据集是机器学习领域常用的数据集,包含150个样本,每个样本有4个特征,分别是花萼长度、花萼宽度、花瓣长度和花瓣宽度,以及对应的类别标签(Iris-setosa、Iris-versicolor、Iris-virginica)。

```pythonfrom sklearn.datasets import load_irisiris = load_iris()X = iris.dataY = iris.target```2. 决策树模型构建接下来,我们使用Scikit-learn库中的DecisionTreeClassifier类来构建决策树分类模型。

我们需要设置一些参数,如树的深度、最大叶节点数、最小样本数等。

```pythonfrom sklearn.tree import DecisionTreeClassifierclf = DecisionTreeClassifier(max_depth=3, min_samples_leaf=5)```3. 模型训练与测试使用训练集对模型进行训练,并使用测试集对模型进行测试。

```pythonfrom sklearn.model_selection import train_test_splitX_train, X_test, Y_train, Y_test = train_test_split(X, Y, test_size=0.3, random_state=0)clf.fit(X_train, Y_train)Y_pred = clf.predict(X_test)```4. 模型评估使用准确率、召回率、F1值等指标来评估模型的性能。

决策树分类实验报告

决策树分类实验报告决策树分类实验报告引言:决策树是一种常用的机器学习算法,它通过构建一棵树状的决策模型来进行分类。

在本次实验中,我们将使用决策树算法对一个数据集进行分类,并评估模型的性能和准确率。

数据集介绍:我们选择了一个包含多个特征的数据集,其中每个样本都有一个类别标签。

该数据集包含了不同类型的动物,并根据它们的特征进行分类。

特征包括动物的体重、身高、食性等。

我们的目标是根据这些特征来预测动物的类别。

实验步骤:1. 数据预处理:在进行决策树分类之前,我们首先对数据进行预处理。

这包括处理缺失值、标准化数据等操作。

缺失值的处理可以采用填充平均值或者使用其他样本的特征进行预测。

标准化数据可以使得不同特征之间的数值范围一致,避免某些特征对分类结果的影响过大。

2. 特征选择:在构建决策树模型之前,我们需要选择最具有分类能力的特征。

常用的特征选择方法包括信息增益、信息增益比等。

通过计算每个特征的分类能力指标,我们可以选择最优的特征作为分类依据。

3. 构建决策树模型:在选择了最优特征之后,我们可以开始构建决策树模型。

决策树的构建过程包括选择根节点、划分子节点等步骤。

通过递归地选择最优特征并划分子节点,我们可以构建一棵完整的决策树模型。

4. 模型评估:构建完决策树模型后,我们需要对其进行评估。

常用的评估指标包括准确率、精确率、召回率等。

准确率是指模型分类正确的样本数占总样本数的比例,精确率是指模型预测为正类的样本中真实为正类的比例,召回率是指真实为正类的样本中被模型预测为正类的比例。

实验结果:经过数据预处理、特征选择和模型构建,我们得到了一棵决策树模型。

通过使用测试集对模型进行评估,我们得到了如下结果:准确率:90%精确率:92%召回率:88%结论:本次实验中,我们成功地使用决策树算法对一个数据集进行了分类。

通过对数据进行预处理、特征选择和模型构建,我们得到了一棵准确率为90%的决策树模型。

该模型在分类任务中表现良好,具有较高的精确率和召回率。

决策树算法实验报告

决策树算法实验报告哈尔滨工业大学数据挖掘理论与算法实验报告(2022年度秋季学期)课程编码 S1300019C 授课教师高宏学生姓名赵天意学号 14S101018学院电气工程及自动化学院一、实验内容使用ID3算法设计实现决策树二、实验设计给定特征是离散的1组实例,设计并实现决策树算法,对实例建立决策树,观察决策树是否正确。

三、实验环境及测试数据实验环境:Windows7操作系统,Python2.7 IDLE 测试数据:样本 outlook temperature Humidity 1 sunny hot High 2 sunny hot High 3 overcast hot High4 rainy mild High5 rainy cool normal6 rainy cool normal7 overcast cool normal8 sunny mild High9 sunny cool normal 10 rainy mild normal 11 sunny mild normal 12 overcast mild High 13 overcast hot normal 14 rainy mild high windy FALSE TRUE FALSE FALSE FALSE TRUE TRUE FALSE FALSE FALSE TRUE TRUE FALSE TRUE play no no yes yes yes no yes no yes yes yes yes yes no 四、实验过程编写决策树程序,输出决策树,输入实例,输出预测类别五、实验结果样本建立的决策树与对所有样本的预测六、遇到的困难及解决方法、心得体会建树过程中用到了递归思想,递归建树。

1/ 1。

决策树算法实验报告

决策树算法实验报告实验三决策树算法实验实验报告实验三决策树算法实验一、实验目的:熟悉和掌握决策树的分类原理、实质和过程;掌握典型的学习算法和实现技术。

二、实验原理:决策树学习和分类.三、实验条件:四、实验内容:1根据现实生活中的原型自己创建一个简单的决策树。

2 要求用这个决策树能解决实际分类决策问题。

五、实验步骤:1、验证性实验:(1)算法伪代码算法Decision_Tree(data,AttributeName) 输入由离散值属性描述的训练样本集data; 候选属性集合AttributeName。

输出一棵决策树。

(1)创建节点N;(2)If samples 都在同一类C中then (3)返回N作为叶节点,以类C标记;(4)If attribute_list为空then(5)返回N作为叶节点,以samples 中最普遍的类标记;//多数表决(6)选择attribute_list 中具有最高信息增益的属性test_attribute; (7)以test_attribute 标记节点N;(8)For each test_attribute 的已知值v//划分samples ;(9)由节点N分出一个对应test_attribute=v的分支;(10令Sv为samples中test_attribute=v 的样本集合;//一个划分块(11)If Sv为空then(12)加上一个叶节点,以samples中最普遍的类标记;(13)Else 加入一个由Decision_Tree(Sv,attribute_list-test_attribute)返回节点值。

(2)实验数据预处理Age:30岁以下标记为“1”;30岁以上50岁以下标记为“2”;50岁以上标记为“3”。

Sex:FEMAL----“1”;MALE----“2”Region:INNER CITY----“1”;TOWN----“2”;RURAL----“3”;SUBURBAN----“4”Income:5000~2万----“1”;2万~4万----“2”;4万以上----“3”Married Children Car MortgagePep:以上五个条件,若为“是”标记为“1”,若为“否”标记为“2”。

实验3-------决策树资料

clementine决策树分类模型一.基于决策树模型进行分类的基本原理概念分类就是:分析输入数据,通过在训练集中的数据表现出来的特性,为每一个类找到一种准确的描述或者模型。

由此生成的类描述用来对未来的测试数据进行分类。

数据分类是一个两步过程:第一步,建立一个模型,描述预定的数据类集或概念集;第二步,使用模型进行分类。

clementine 8.1中提供的回归方法有两种:C5.0(C5.0决策树)和Neural Net(神经网络)。

下面的例子主要基于C5.0决策树生成算法进行分类。

C5.0算法最早(20世纪50年代)的算法是亨特CLS(Concept Learning System)提出,后经发展由J R Quinlan在1979年提出了著名的ID3算法,主要针对离散型属性数据;C4.5是ID3后来的改进算法,它在ID3基础上增加了:对连续属性的离散化;C5.0是C4.5应用于大数据集上的分类算法,主要在执行效率和内存使用方面进行了改进。

优点:在面对数据遗漏和输入字段很多的问题时非常稳健;通常不需要很长的训练次数进行估计;比一些其他类型的模型易于理解,模型推出的规则有非常直观的解释;也提供强大的增强技术以提高分类的精度。

二. 范例说明该范例的背景是客户详细的个人投资计划作为一种市场营销活动的结果,snapshottrainN.db(训练数据)描述的是不同age(年龄),不同sex(性别),不同region(地域),不同income(收入),不同married(婚姻),等等的数据,通过分类算法对训练数据进行建模得到决策树模型,通过得到的决策树模型来判断测试数据集(snapshottestN.db)里面的每个记录的pep(个人投资计划)属性是yes还是no。

使用clementine建立流程图,如图1所示:图1 总流程图三. 数据集说明数据集snapshottrainN.db,以下是该数据集的所有字段名:• id. 唯一的识别号• age. 年龄• sex. 性别• region.地理位置• income. 收入• merried. 是否已婚• children. 有几个孩子• car. 是否有汽车• save_act. 是否有储蓄账户• current_act. 是否有活期存款• mortgage. 是否有抵押• pep. 是否有个人投资计划四. 训练模型通过下面的操作,将完成如图2所示的流。

决策树决策分析实验

决策树决策分析实验公司内部档案编码:[OPPTR-OPPT28-OPPTL98-OPPNN08]决策树决策分析实验一、实验目的和内容进一步了解模型及决策树的概念掌握决策支持系统决策分析建模的原理学习用决策树实现单级决策与多级决策的决策支持系统的方法二、方案设计1、单级决策问题单级决策问题是指在一个决策问题中只有一个层次的决策。

反映在决策树模型中,就是只有一个决策节点。

(1)背景及问题:为了适应市场的需求,某物流公司提出了两个扩大配送能力的方案。

一方案是建设新的物流中心,另一方案是扩建原有的物流中心。

建设新的物流中心需要投资600万元,扩建原有物流中心需要投资280万元,两个方案的每年益损值(以万元为单位)及自然状态的概率如表1所示。

试用决策树法确定应采用那种决策方案表1:每年益损值及自然状态的概率自然状态概率(%)新建物流中心年收益(万元)扩建原有物流中心年收益(万元)市场好20080市场差-4060(2)画出决策树,如下图1所示。

(3)计算事件节点的期望益损值:节点②:[]68060010)40(3.0102007.0=-⨯-⨯+⨯⨯节点③:[]46028010603.010807.0=-⨯⨯+⨯⨯故:最优方案为新建一个物流中心。

将节点①上方标上期望收益值680(万元),并剪去扩建原有物流中心方案枝。

2、多级决策问题多级决策问题是指在一个决策问题中有两个或两个以上层次的决策。

反映在决策树模型中,就是有两个或两个以上的决策节点。

绘制多级决策问题的决策树图时,一般常从第一级决策问题画起,然后发展到第二级决策问题,直至最后一级决策问题。

其结构与单级决策问题无本质的区别,只是比较复杂,计算量更大一些。

(1)背景及问题的提出为生产某种新型的港口装卸机械,提出了两个建厂方案(均考虑10年经营期):一是投资300万元建大厂;另一个方案是:先投资160万元建小厂,若产品销路好,则三年后考虑是否扩建成大厂,扩建投资为140万元。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

实验三决策树算法实验一、实验目的:熟悉和掌握决策树的分类原理、实质和过程;掌握典型的学习算法和实现技术。

二、实验原理: 决策树学习和分类.三、实验条件:四、实验内容:1 根据现实生活中的原型自己创建一个简单的决策树。

2 要求用这个决策树能解决实际分类决策问题。

五、实验步骤:1、验证性实验:(1)算法伪代码算法Decision_Tree(data,AttributeName) 输入由离散值属性描述的训练样本集data; 候选属性集合AttributeName。

输出一棵决策树。

(1)创建节点N;资料.(2)If samples 都在同一类C中then (3)返回N作为叶节点,以类C标记;(4)If attribute_list为空then(5)返回N作为叶节点,以samples 中最普遍的类标记;//多数表决(6)选择attribute_list 中具有最高信息增益的属性test_attribute; (7)以test_attribute 标记节点N;(8)For each test_attribute 的已知值v //划分samples ;(9)由节点N分出一个对应test_attribute=v的分支;(10令Sv为samples中test_attribute=v 的样本集合;//一个划分块(11)If Sv为空then(12)加上一个叶节点,以samples中最普遍的类标记;(13)Else 加入一个由Decision_Tree(Sv,attribute_list-test_attribute)返回节点值。

(2)实验数据预处理Age:30岁以下标记为“1”;30岁以上50岁以下标记为“2”;50岁以上标记为“3”。

Sex:FEMAL----“1”;MALE----“2”Region:INNER CITY----“1”;TOWN----“2”; RURAL----“3”; SUBURBAN----“4” Income:5000~2万----“1”;2万~4万----“2”;4万以上----“3” Married Children CarMortgage资料.Pep:以上五个条件,若为“是”标记为“1”,若为“否”标记为“2”。

Age sex region income married children car mortgage pep1 2 1 1 2 1 1 2 21 2 1 1 2 2 2 2 12 1 4 1 2 1 2 2 12 1 1 1 1 2 2 2 21 2 1 1 1 2 2 2 21 2 1 1 2 1 2 1 12 1 2 1 1 2 1 1 22 1 1 1 2 1 1 2 12 13 1 2 2 1 2 12 1 2 2 2 1 2 2 22 2 1 2 2 2 2 1 1资料.2 1 2 2 1 1 2 1 12 2 1 2 1 2 2 1 21 1 12 1 2 2 2 13 2 1 2 1 1 1 2 21 1 12 1 1 1 2 11 1 32 2 2 1 2 13 1 2 2 1 2 2 2 13 2 3 3 1 1 1 2 13 2 2 3 1 2 1 1 23 1 3 3 1 1 2 2 13 2 1 3 1 2 1 2 23 2 1 3 1 1 1 1 13 1 1 3 1 2 1 1 2资料.3 1 3 3 1 2 2 2 23 24 3 1 2 2 1 13 1 3 3 2 2 1 1 2(3)Matlab语句:[Tree RulesMatrix]= DecisionTree(DataSet, AttributName);六、实验结果:资料.资料.资料.实验程序:function [Tree RulesMatrix]=DecisionTree(DataSet,AttributName)%输入为训练集,为离散后的数字,如记录1:1 1 3 2 1;%前面为属性列,最后一列为类标if nargin<1error('请输入数据集');elseif isstr(DataSet)[DataSet AttributValue]=readdata2(DataSet);elseAttributValue=[];endend资料.if nargin<2AttributName=[];endAttributs=[1:size(DataSet,2)-1];Tree=CreatTree(DataSet,Attributs);disp([char(13) 'The Decision Tree:']);showTree(Tree,0,0,1,AttributValue,AttributName);Rules=getRule(Tree);RulesMatrix=zeros(size(Rules,1),size(DataSet,2));for i=1:size(Rules,1)rule=cell2struct(Rules(i,1),{'str'});rule=str2num([rule.str([1:(find(rule.str=='C')-1)]) rule.str((find(rule.str=='C')+1):length(rule.str))]);for j=1:(length(rule)-1)/2资料.RulesMatrix(i,rule((j-1)*2+1))=rule(j*2);endRulesMatrix(i,size(DataSet,2))=rule(length(rule));endendfunction Tree=CreatTree(DataSet,Attributs) %决策树程序输入为:数据集,属性名列表%disp(Attributs);[S ValRecords]=ComputEntropy(DataSet,0);if(S==0) %当样例全为一类时退出,返回叶子节点类标for i=1:length(ValRecords)if(length(ValRecords(i).matrix)==size(DataSet,1))break;end资料.endTree.Attribut=i;Tree.Child=[];return;endif(length(Attributs)==0) %当条件属性个数为0时返回占多数的类标mostlabelnum=0;mostlabel=0;for i=1:length(ValRecords)if(length(ValRecords(i).matrix)>mostlabelnum)mostlabelnum=length(ValRecords(i).matrix);mostlabel=i;end资料.endTree.Attribut=mostlabel;Tree.Child=[];return;endfor i=1:length(Attributs)[Sa(i) ValRecord]=ComputEntropy(DataSet,i);Gains(i)=S-Sa(i);AtrributMatric(i).val=ValRecord;end[maxval maxindex]=max(Gains);Tree.Attribut=Attributs(maxindex);Attributs2=[Attributs(1:maxindex-1) Attributs(maxindex+1:length(Attributs))];资料.for j=1:length(AtrributMatric(maxindex).val)DataSet2=[DataSet(AtrributMatric(maxindex).val(j).matrix',1:maxindex-1)DataSet(AtrributMatric(maxindex).val(j).matrix',maxindex+1:size(DataSet,2))];if(size(DataSet2,1)==0)mostlabelnum=0;mostlabel=0;for i=1:length(ValRecords)if(length(ValRecords(i).matrix)>mostlabelnum)mostlabelnum=length(ValRecords(i).matrix);mostlabel=i;endendTree.Child(j).root.Attribut=mostlabel;资料.Tree.Child(j).root.Child=[];elseTree.Child(j).root=CreatTree(DataSet2,Attributs2);endendendfunction [Entropy RecordVal]=ComputEntropy(DataSet,attribut) %计算信息熵if(attribut==0)clnum=0;for i=1:size(DataSet,1)if(DataSet(i,size(DataSet,2))>clnum) %防止下标越界classnum(DataSet(i,size(DataSet,2)))=0;clnum=DataSet(i,size(DataSet,2));资料.RecordVal(DataSet(i,size(DataSet,2))).matrix=[];endclassnum(DataSet(i,size(DataSet,2)))=classnum(DataSet(i,size(DataSet,2)))+1;RecordVal(DataSet(i,size(DataSet,2))).matrix=[RecordVal(DataSet(i,size(DataSet,2))).matrix i];endEntropy=0;for j=1:length(classnum)P=classnum(j)/size(DataSet,1);if(P~=0)Entropy=Entropy+(-P)*log2(P);endend资料.elsevalnum=0;for i=1:size(DataSet,1)if(DataSet(i,attribut)>valnum) %防止参数下标越界clnum(DataSet(i,attribut))=0;valnum=DataSet(i,attribut);Valueexamnum(DataSet(i,attribut))=0;RecordVal(DataSet(i,attribut)).matrix=[]; %将编号保留下来,以方便后面按值分割数据集endif(DataSet(i,size(DataSet,2))>clnum(DataSet(i,attribut))) %防止下标越界Value(DataSet(i,attribut)).classnum(DataSet(i,size(DataSet,2)))=0;clnum(DataSet(i,attribut))=DataSet(i,size(DataSet,2));end资料.Value(DataSet(i,attribut)).classnum(DataSet(i,size(DataSet,2)))= Value(DataSet(i,attribut)).classnum(DataSet(i,size(DataSet,2)))+1;Valueexamnum(DataSet(i,attribut))= Valueexamnum(DataSet(i,attribut))+1;RecordVal(DataSet(i,attribut)).matrix=[RecordVal(DataSet(i,attribut)).matrix i];endEntropy=0;for j=1:valnumEntropys=0;for k=1:length(Value(j).classnum)P=Value(j).classnum(k)/Valueexamnum(j);if(P~=0)Entropys=Entropys+(-P)*log2(P);endend资料.Entropy=Entropy+(Valueexamnum(j)/size(DataSet,1))*Entropys;endendendfunction showTree(Tree,level,value,branch,AttributValue,AttributName)blank=[];for i=1:level-1if(branch(i)==1)blank=[blank ' |'];elseblank=[blank ' '];endend资料.blank=[blank ' '];if(level==0)blank=[' (The Root):'];elseif isempty(AttributValue)blank=[blank '|_____' int2str(value) '______'];elseblank=[blank '|_____' value '______'];endendif(length(Tree.Child)~=0) %非叶子节点if isempty(AttributName)disp([blank 'Attribut ' int2str(Tree.Attribut)]);资料.elsedisp([blank 'Attribut ' AttributName{Tree.Attribut}]);endif isempty(AttributValue)for j=1:length(Tree.Child)-1showTree(Tree.Child(j).root,level+1,j,[branch 1],AttributValue,AttributName);endshowTree(Tree.Child(length(Tree.Child)).root,level+1,length(Tree.Child),[branch(1:length(branch)-1) 0 1],AttributValue,AttributName); elsefor j=1:length(Tree.Child)-1showTree(Tree.Child(j).root,level+1,AttributValue{Tree.Attribut}{j},[branch 1],AttributValue,AttributName);endshowTree(Tree.Child(length(Tree.Child)).root,level+1,AttributValue{Tree.Attribut}{length(Tree.Child)},[branch(1:length(branch)-1) 0资料.1],AttributValue,AttributName);endelseif isempty(AttributValue)disp([blank 'leaf ' int2str(Tree.Attribut)]);elsedisp([blank 'leaf ' AttributValue{length(AttributValue)}{Tree.Attribut}]);endendendfunction Rules=getRule(Tree)if(length(Tree.Child)~=0)Rules={};资料.for i=1:length(Tree.Child)content=getRule(Tree.Child(i).root);%disp(content);%disp([num2str(Tree.Attribut) ',' num2str(i) ',']);for j=1:size(content,1)rule=cell2struct(content(j,1),{'str'});content(j,1)={[num2str(Tree.Attribut) ',' num2str(i) ',' rule.str]};endRules=[Rules;content];endelseRules={['C' num2str(Tree.Attribut)]};end资料.end资料.。